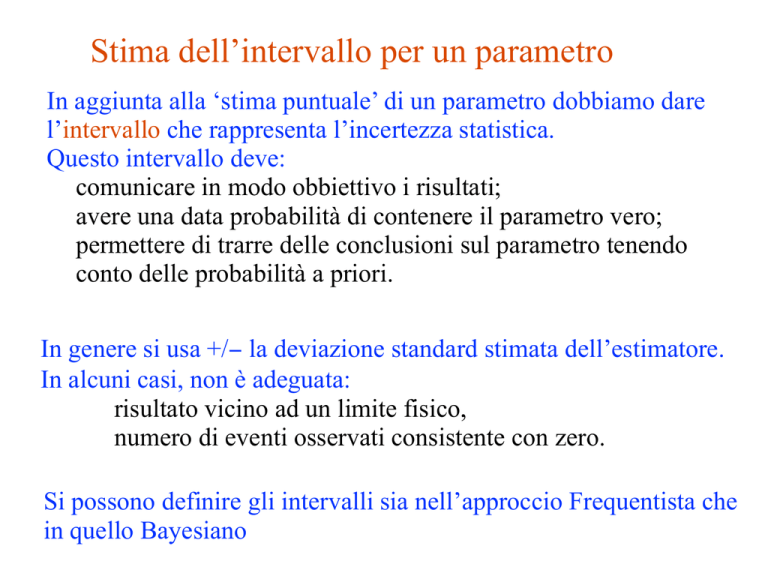

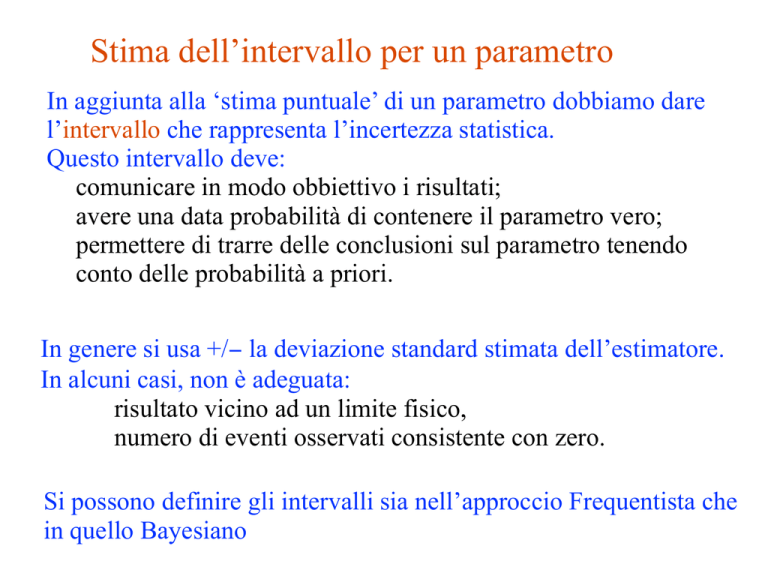

Stima dell’intervallo per un parametro

In aggiunta alla ‘stima puntuale’ di un parametro dobbiamo dare

l’intervallo che rappresenta l’incertezza statistica.

Questo intervallo deve:

comunicare in modo obbiettivo i risultati;

avere una data probabilità di contenere il parametro vero;

permettere di trarre delle conclusioni sul parametro tenendo

conto delle probabilità a priori.

In genere si usa +/− la deviazione standard stimata dell’estimatore.

In alcuni casi, non è adeguata:

risultato vicino ad un limite fisico,

numero di eventi osservati consistente con zero.

Si possono definire gli intervalli sia nell’approccio Frequentista che

in quello Bayesiano

Intervalli di confidenza: approccio frequentista

Dato un estimatore

per il parametro θ e la stima

Sia data per tutti i possibili θ la distribuzione del campione

Si fissa i valori per le code di probabilità superiore e inferiore, per

esempio α = 0.05, β = 0.05, quindi si trovano le funzioni uα(θ) e

vβ(θ) tali che:

Intervallo di confidenza dalla fascia di confidenza

La regione tra uα(θ) e vβ(θ) è la fascia di confidenza.

Determiniamo i punti dove il valore

osservato interseca la fascia di

confidenza

Questo è l’intervallo di confidenza [a, b]

Livello di confidenza = 1 − α − β = probabilità che

l’intervallo “copra” il vero valore del parametro (questo vale

per ogni valore possibile del parametro θ)

Intervalli di confidenza in pratica

La ricetta per trovare [a, b] si riduce a risolvere

→ a è il valore ipotetico di θ tale che

→ b è il valore ipotetico di θ tale che

Significato di un intervallo di confidenza

Intervalli di confidenza centrali o unilaterali

Intervalli di confidenza dalla likelihood

Nel limite di campione infinito vale per l’estimatore ML dei

parametri

:

(Gaussiana n-dimensionale con covarianza V)

definisce una regione di confidenza iper-ellissoidale

Se

allora

Si noti che n è il numero di parametri

Esempio di intervallo dal ln L(θ )

Per n=1 parametri, CL = 0.683, Qγ = 1.

Si osservi che l’intervallo è asimmetrico rispetto al massimo

Si dimostra che anche se la likelihood non è Gaussiana l’intervallo

può essere approssimato con il metodo grafico (MINOS)

Regioni di confidenza approssimative da L(θ )

Per determinare la regione di confidenza con CL = 1−γ si prende:

Per campioni finiti approssimano le regioni di confidenza

La probabilità di copertura non è garantita essere 1−γ ;

non ci sono teoremi per stimare di quanto si sbaglia (usare un MC).

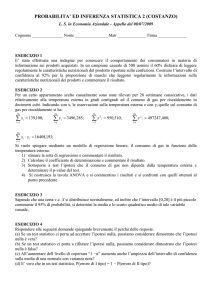

Limite sui parametri di una distribuzione di Poisson

Consideriamo di nuovo il caso di n = ns + nb eventi dove

nb eventi da processi noti (fondo)

ns eventi da processi nuovi (segnale)

sono variabili di Poisson con medie s e b e perciò anche n = ns + nb

è una variabile di Poisson con media = s + b. Supponiamo b sia noto.

Stiamo cercando l’evidenza per il processo di segnale,

ma il numero di eventi trovati è circa uguale al numero di

eventi aspettati per il solo fondo, per esempio b = 4.6 e noi

troviamo nobs = 5 eventi.

L’evidenza per il segnale s non è statisticamente rilevante

→ vogliamo mettere un limite superiore su s.

Limite superiore per una Poissoniana

Troviamo il parametro s tale che la probabilità di osservare gli

eventi che abbiamo visto o meno è uguale a un valore fissato,

piccolo, per esempio γ = 0.05:

Risolviamo per s = sup, e troviamo il limite superiore per s con un

livello di confidenza di 1−γ.

Esempio: supponiamo b = 0 e troviamo nobs = 0. Per 1−γ = 0.95,

→

In generale è utile ricordare che:

m

n=0

n

e

n!

=1

F⇥2 (2 ; 2(m + 1))

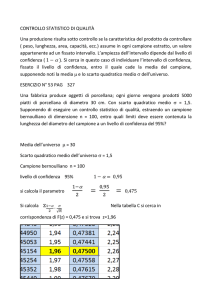

Calcoliamo il limite per la Poissoniana

Per determinare slo, sup, possiamo usare la relazione con la

distribuzione del χ2:

Quantile della distribuzione del χ2

Per fluttuazioni verso il basso di n il

risultato per sup =0; cioè l’intervallo

di confidenza è vuoto.

Limiti vicino ad un contorno fisico

Supponiamo che sia b = 2.5 e che si osservi n = 0.

Se scegliamo CL = 0.9, dalla formula per sup troviamo

Punto di vista fisico:

Sapevamo già che s ≥ 0; non possiamo riportare come risultato

di un esperimento complesso un limite superiore negativo!

Punto di vista statistico:

L’intervallo copre il valore vero del parametro nel 90% dei casi;

chiaramente questo non è uno di quelli.

Questo è un dilemma piuttosto comune quando il limite del

parametro è vicino ad un contorno fisico, per esempio nel caso di

mν stimato con E2 − p2 .

Limite aspettato per s = 0

Fisico: avrei dovuto usare CL = 0.95 — quindi sup = 0.496

Anche meglio: per CL = 0.917923 otteniamo sup = 10−4 !

Un momento... con b = 2.5 le fluttuazioni di Poisson in n sono circa

√2.5 = 1.6. Come faccio ad ottenere un limite così basso?

Guardiamo il valore medio del limite

nell’ipotesi di fondo soltanto (s = 0):

questo valore è la sensibilità.

Distribuzione del limite per un CL

del 95% con b = 2.5, s = 0.

Limite superiore medio = 4.44

Approccio Bayesiano

Nella statistica Bayesiana dobbiamo iniziare con ‘pdf a priori’ π(θ),

che rappresenta la nostra conoscenza di θ prima dell’esperimento.

Il teorema di Bayes ci dice come modificare la pdf in seguito ai

risultati dell’esperimento

Possiamo integrare la pdf a posteriori p(θ | x) per ottenere un

intervallo con qualsivoglia copertura

.

Per esempio per una Poissoniana il limite superirore al 95% di CL si

otterrà da

Probabilità a priori per una Poissoniana

Poichè sappiamo che s ≥0, poniamo π(s) = 0 per s<0.

Spesso si traduce la nostra ‘ignoranza a priori’ con

- Non è normalizzata:

va bene se L(s) decresce rapidamente per s grande.

- Non è invariante rispetto ad un cambio dei parametri.

una probabilità piatta per la massa del bosone di Higgs implica

una probabilità non piatta per il numero di eventi con un Higgs.

- Non rappresenta veramente il nostro grado di conoscenza ma

possiamo usarla come punto di riferimento:

ci permette di costruire degli intervalli dei quali possiamo

studiare le proprietà dal punto di vista frequentista (la copertura

dipenderà dal vero valore di s).

Intervallo Bayesiano con priori piatta per s

Bisogna risolvere per sup la seguente equazione

1

=

=

=

e

sup

L(n|s)ds

0

⇥

L(n|s)ds

0

sup

n

(s+b)

(s

+

b)

e

ds

0

⇥

n e (s+b) ds

(s

+

b)

0

(sup +b)

e

b

(sup +b)i

n

i=0

i!

n

bi

i=0 i!

Per b = 0, il limite superiore Bayesiano è identico a quello

classico (per pura coincidenza)

Intervallo Bayesiano con priori piatta per s (2)

Altrimenti il limite Bayesiano è sempre maggiore

(‘conservativo’) di quello classico

Non è mai negativo; non dipende da b se n = 0.

N.B.: questo metodo può essere usato anche con la likelihood

estesa: