9

CAMPIONAMENTO CON PROBABILITA’ VARIABILE

9.1

INTRODUZIONE

Un tipo di campionamento di largo impiego nella pratica delle indagini, è quello nel

quale si assegna ad ogni unità della popolazione una probabilità di selezione

variabile, direttamente proporzionale alla sua dimensione, supposta nota prima

della selezione del campione.

Abbiamo già incontrato nel capitolo 3 una tecnica di questo tipo, denominata

campionamento di Poisson, nella quale si è ipotizzato che le singole unità della

popolazione potessero avere una diversa probabilità di inclusione. Abbiamo inoltre

visto, in quella occasione, che lo schema di estrazione portava alla formazione di

un campione a dimensione variabile. In questo capitolo esamineremo una tecnica

analoga che consente la selezione di campioni di dimensione fissa.

Tale forma di campionamento, che in seguito chiameremo campionamento con

probabilità variabile (CPV) ed è spesso indicata con la sigla PPS (dalle iniziali dei

termini inglesi probability proportional to size) o con la sigla πPS (inclusion

probability proportional to size) può essere considerata come la più generale tra

quelle probabilistiche per campioni di dimensione fissa . Un qualsiasi metodo di

selezione equiprobabilistico può infatti essere visto come un caso particolare di

questo quando le unità della popolazione abbiano la stessa dimensione, oppure

quando questa ultima sia considerata ininfluente nella fase di estrazione del

campione.

La principale giustificazione del CPV, la stessa ricordata per il campionamento di

Poisson, sta nel fatto che nella pratica si riscontra spesso una relazione statistica più

o meno stretta tra dimensione dell’unità e caratteri oggetto di studio. Di

conseguenza, l'utilizzazione dell'informazione sulla dimensione, tradotta in termini

di probabilità di selezione, consente la costruzione di stimatori migliori di quelli

ricavabili da una selezione equiprobabilistica.

1

La selezione delle unità può essere effettuata con o senza ripetizione ma,

diversamente da quanto abbiamo osservato per il campionamento casuale semplice,

la scelta tra le due strategie non è ovvia. Possono infatti verificarsi condizioni di

indagine nelle quali la selezione senza ripetizione risulta meno vantaggiosa di

quella con ripetizione, sia per la precisione delle stime, sia per le complicazioni

teoriche e computazionali che essa presenta. Per questi motivi, la selezione con

ripetizione merita, nel CPV, un’attenzione ben maggiore di quella che riceve

nell’ambito del campionamento equiprobabilistico.

9.2

ESTRAZIONE CON RIPETIZIONE

Sia X una variabile i cui valori noti Xi (i = 1,..,N) sono interpretabili come misure

di ampiezza (o dimensione) delle unità oggetto di indagine, nell'ipotesi che esse

siano anche unità di selezione. Per fare qualche esempio, X può esprimere la

superficie di un'azienda agricola, il numero di addetti di un'azienda industriale, il

numero di studenti di una scuola, quello dei componenti di una famiglia, ecc..

Supponiamo di voler estrarre un campione di n unità in modo che la probabilità di

selezionare l'i-esima unità sia:

pi = X i

∑X

i

= Xi X

Supponiamo inoltre che i valori Xi siano interi. Qualora non lo fossero, per renderli

tali sarebbe sufficiente moltiplicare la variabile X per una potenza di 10.

La selezione del campione si realizza attraverso l'esecuzione delle seguenti fasi:

(a) si associano i primi X1 numeri naturali (da 1 a X1) alla prima unità, i secondi

X2 (da [X1 + 1] a [X1 + X2]) alla seconda e così via;

(b) si seleziona casualmente un numero compreso tra 1 e X (estremi inclusi) e si

considera selezionata nel campione l'unità cui è associato il campo di numeri

naturali che comprende quello estratto;

(c) si ripete la fase (b) n volte, considerando ogni volta ancora presente nella

popolazione l'unità precedentemente estratta.

Il procedimento, piuttosto semplice, è ulteriormente illustrato dalla seguente

applicazione. I dati tella Tab. 9.1 (P. V. Sukhatme e B. V. Sukhatme 1970, p. 51) si

2

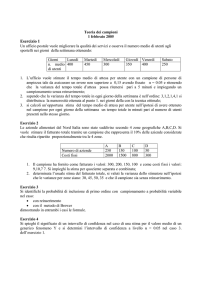

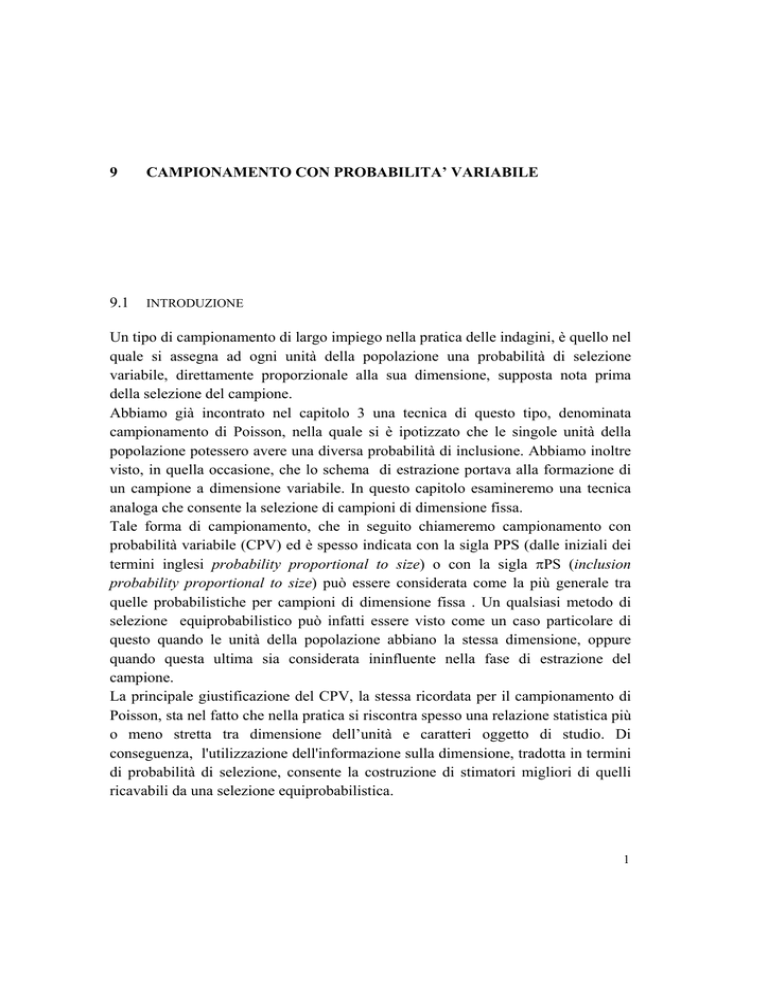

TAB. 9.1: Valori della superficie totale coltivabile e della superficie coltivata

a riso per una popolazione fittizia di 25 aziende agricole

pi = X i X

Azienda N.

Superficie totale

Cumulata valori

Xi

X ic

1

1232

1232

0,053

2

327

1559

0,014

3

1346

2905

0,058

4

1285

4190

0,055

5

428

4618

0,018

6

871

5489

0,038

7

1042

6513

0,044

8

1262

7775

0,054

9

497

8272

0,021

10

1016

9288

0,044

11

651

9939

0,028

12

1170

11109

0,051

13

2630

13739

0,114

14

515

14254

0,022

15

895

15149

0,039

16

1055

16204

0,046

17

2110

18314

0,091

18

979

19239

0,042

19

671

19964

0,029

20

120

20084

0,005

21

541

20625

0,023

22

1331

21956

0,057

23

842

22798

0,036

24

162

22960

0,007

25

206

23165

0,009

3

riferiscono ad una popolazione fittizia di 25 aziende agricole per ciascuna delle

quali si suppone nota la dimensione in termini di superficie complessiva coltivabile,

denotata con Xi per l' i-esima azienda. Nella tabella, oltre ai valori Xi, è riportata la

loro serie cumulata, i cui termini sono indicati con X ic e la loro probabilità di

selezione pi.

Utilizzando una routine informatica, si seleziona un numero casuale, r, compreso

tra 1 e il totale della variabile X, cioè 23165; quindi si confronta il valore estratto

con i valori X ic della cumulata e si seleziona l’unità i per la quale risulta realizzata

la seguente disuguaglianza:

X ic−1 < r ≤ X ic

Ad esempio, se r = 1985, è immediato osservare che tale valore è compreso tra

1559 (termine i-1) e 2905 (termine i) e pertanto viene estratta l’unità cui

corrisponde l’i-esimo valore della distribuzione della variabile X, nella fattispecie

la terza unità. Ancora, se r = 11805, abbiamo: 11109 < 11805 ≤ 13739, e

conseguentemente viene estratta la 13a unità. Il procedimento viene iterato fini al

raggiungimento della dimensione campionaria desiderata ed è evidente che la stessa

unità della popolazione può essere selezionata più di una volta.

D. B. Lahiri (1951) ha proposto un metodo alternativo di selezione che non richiede

il calcolo di alcuna cumulata. Si seleziona casualmente un numero i compreso tra 1

e N. Quindi, ancora casualmente, un numero j compreso tra 1 e il massimo tra i

valori Xi, che denotiamo con Xmax. Se quest'ultimo numero è più piccolo del valore

Xi, corrispondente all'i-esimo valore della popolazione individuato alla prima delle

due estrazioni, è definitivamente selezionata nel campione l'i-esima unità,

altrimenti si ripete il procedimento fino a che la condizione non è soddisfatta. Per

verificare che il procedimento ha termine e porta ad estrarre l'i-esima unità con

probabilità pi = X i X si può osservare che la probabilità, q, che una prova,

consistente nelle due suddette estrazioni, non porti ad alcuna selezione è:

q=

4

1

N

N

⎛

i =1

⎝

Xi ⎞

⎟⎟ ,

max ⎠

∑ ⎜⎜1 − X

mentre la probabilità di selezionare l'i-esima unità ad una qualunque estrazione è

ovviamente:

1 ⎛ Xi

⎜

N ⎜⎝ X max

⎞

⎟⎟

⎠

Pertanto, la probabilità che il procedimento abbia termine con l'estrazione dell'iesima unità è:

p

X

p i + qp i + q 2 pi + L = i = i

X

1− q

pi =

9. 3 STIMA DEL TOTALE NEL CAMPIONAMENTO PPS

Per ricavare uno stimatore del totale (o della media) adeguato al tipo di selezione

descritto, è opportuno partire da uno stimatore di carattere generale che combini

linearmente i valori campionari yj con coefficienti wj. Lo stimatore, che per il

momento denotiamo con T1, può essere scritto come segue:

N

T1 = ∑ wi Yi t i'

(9.1)

i =1

Dove t i' è una variabile casuale che assume valori interi compresi tra 0 (se l'i-esima

unità della popolazione non risulta inclusa nel campione) e n (se la stessa unità è

selezionata ripetutamente per n volte).

I valori dei coefficienti vengono normalmente ricavati sotto la condizione che lo

stimatore sia corretto per una qualsiasi dimensione campionaria:

()

E (T1 ) = ∑ wi Yi E t i' = Y

N

i =1

e poiché E (t i ) , che esprime la frequenza attesa di inclusione dell'i-esima unità, è

pari a npi, avremo:

5

N

E (T1 ) = ∑ wi Yi np i = Y

i =1

wi =

da cui:

1

.

np i

Lo stimatore assume dunque la forma:

Yi t i'

i =1 np i

(9.2)

1 N

Z i t i' = z

∑

n i =1

(9.3)

N

y pps = ∑

oppure, posto Z i = Yi pi

:

y pps =

Dalla (9.2) o dalla (9.3) è quindi immediato ricavare, dividendo per N, lo stimatore

della media Y della popolazione, che denotiamo con la consueta notazione y pps :

y pps =

1 N

z

Z i t i' =

∑

Nn i =1

N

(9.4)

Dalla (9.3) è inoltre immediato verificare che il totale Y è stimato come media

semplice dei valori campionari zi ciascuno dei quali rappresenta una stima corretta

del totale stesso della popolazione.

9.4

VARIANZA DELLO STIMATORE DELLA MEDIA

La trasformata Zi introdotta nella (9.3) ci consente di ricavare facilmente la

varianza degli stimatori y pps e y pps . Infatti:

6

V ( y pps ) = V ( z ) =

=

V (Z i )

=

n

1 N

2

pi (Z i − Z ) =

∑

n i =1

(9.5)

2

⎞

1 N ⎛Y

= ∑ pi ⎜⎜ i − Y ⎟⎟ .

n i =1 ⎝ pi

⎠

e ovviamente:

V ( y pps ) =

1

V ( y pps ) =

N2

1

=

nN 2

⎞

⎛Y

pi ⎜⎜ i − Y ⎟⎟

∑

i =1

⎠

⎝ pi

N

2

(9.6)

Per fini computazionali la varianza del totale (e della media) può essere riscritta

nella seguente forma alternativa:

⎤

1 ⎡ N Yi 2

1 ⎡ N Yi 2

2⎤

− Y ⎥ = ⎢X ∑

−Y 2⎥.

V ( y pps ) = ⎢∑

n ⎣ i =1 pi

⎦ n ⎣ i =1 X i

⎦

(9.7)

Dalle precedenti espressioni si può osservare che se le probabilità di selezione pi

sono proporzionali ai rispettivi valori Yi, la varianza si annulla poiché ogni singola

osservazione, rapportata alla sua probabilità di selezione, stima con esattezza il

totale della popolazione. Naturalmente non è possibile definire numericamente in

tal modo le probabilità iniziali in quanto i valori Yi non sono noti se non dopo aver

osservato il campione. Ma è in genere ragionevole ritenere che se le probabilità di

selezione possono essere definite sulla base di una variabile nota che sia

ragionevole assumere approssimativamente proporzionale alla variabile di studio

Y, la varianza di stima anche se non nulla sarà ridotta rispetto a quella di stimatori

alternativi.

Una stima corretta da campione della (9.5) si può ricavare facilmente utilizzando la

trasformazione di variabile già introdotta nella (9.3): v( y pps ) = v( z ) . Infatti

essendo:

v ( z ) = v (Z i ) n

(9.8)

7

è sufficiente ricavare uno stimatore corretto di V(Zi) da inserire al numeratore della

(9.8). Tale stimatore ha la seguente espressione:

v (Z i ) =

1

2

∑ (z i − z ) ,

n − 1 i∈s

che si traduce nella seguente:

⎞

⎛ yi

1

⎜⎜ − y pps ⎟⎟

v( y pps ) =

∑

n(n − 1) i∈s ⎝ pi

⎠

9.5

2

UN METODO ALTERNATIVO PER RICAVARE LA VARIANZA DEGLI

STIMATORI

La varianza dello stimatore (9.2) può essere ricavata anche seguendo il

procedimento già introdotto nel Cap.2 per il campionamento casuale semplice

senza ripetizione. Ricordando che nello stimatore (9.2) l’unico termine aleatorio è

rappresentato da t i' , possiamo scrivere:

⎡1 N Y t ' ⎤ 1 ⎡ N ⎛ Y

V ( y pps ) = V ⎢ ∑ i i ⎥ = 2 ⎢∑ ⎜⎜ i

⎣ n i =1 pi ⎦ n ⎢⎣ i =1 ⎝ pi

2

⎞

Y Y

⎟⎟ V t i' + 2∑∑ i j Cov t i' t 'j

i j >i p i p j

⎠

()

e quindi, tenendo presente che:

()

( )

V t i' = np i (1 − p i ) e Cov t i' t 'j = − pi p j

dopo ovvie semplificazioni si ottiene:

⎤ 1 ⎡ N Yi 2

⎤

1 ⎡ N Yi 2 N 2

− ∑ Yi − 2∑ Yi Yi ⎥ = ⎢∑

−Y 2⎥

V ( y pps ) = ⎢∑

n ⎣ 1=1 pi i =1

i< j

⎦

⎦ n ⎣ i =1 pi

8

⎤

( )⎥

⎥⎦

come volevasi dimostrare (cfr. espressione 9.7)

9.6

SELEZIONE SENZA RIPETIZIONE

La selezione senza ripetizione si “potrebbe” realizzare in modo analogo a quella

con ripetizione già descritta nel paragrafo 9.2, avendo cura di togliere dalla lista

della popolazione le unità di volta in volta estratte nel campione. Questa ultima

operazione implica che ad ogni fase del processo di estrazione debbano essere

ricalcolate le probabilità associate alle unità non ancora estratte.

Per chiarire il procedimento, consideriamo la probabilità di inclusione, πi dell'iesima unità della popolazione in un campione di n = 2 unità. Tale probabilità è data

dalla somma della probabilità di selezionare l’i-esima unità alla prima prova e della

probabilità di selezionarla alla seconda data la mancata estrazione alla prima;

ovvero, dopo che per prima sia stata estratta una qualunque altra unità. In termini

formali:

= probabilità di estrazione alla prima prova;

pi

N

pi p j

∑1− p

j ≠ i =1

=

j

probabilità di estrazione alla seconda prova, condizionata all’estrazione

della j-esima unità (j ≠ i ; j = 1,..,N), alla prima estrazione.

e quindi:

π i = pi +

pi p j

N

∑1− p

j ≠ i =1

j

⎡

= pi ⎢1 +

⎣⎢

pj ⎤

⎥

⎥

j ⎦

N

∑1− p

j ≠ i =1

Inoltre, la probabilità di inclusione del secondo ordine, cioè la probabilità che le

unità i e j siano congiuntamente incluse nel campione è:

π ij = pi p j (1 − pi )−1 + pi p j (1 − p j )−1

[

= pi p j (1 − pi ) + (1 − p )

−1

−1

]

9

I problemi, come si può facilmente intuire, sorgono quando n > 2, Infatti, il

computo delle probabilità di inclusione del primo e soprattutto del secondo ordine,

già complesso per n = 3, diventa proibitivo per dimensioni campionarie appena

maggiori.

Il procedimento appena descritto per n = 2 è sufficientemente semplice, tuttavia

vedremo tra breve che le probabilità di inclusione del primo e del secondo ordine

che da esso scaturiscono non risultano ottimali in rapporto all’obiettivo principale

di questa strategia campionaria che è quello di ottenere stimatori con un elevato

grado di precisione in rapporto alle alternative possibili, a parità di informazioni

disponibili a priori.

A questo fine è opportuno prescindere inizialmente dalla procedura di calcolo delle

probabilità di inclusione sia del primo che del secondo ordine e passare a definire lo

stimatore di Horvitz e Thompson del totale Y (o della media Y ), la sua varianza e

lo stimatore campionario della varianza dello stesso stimatore.

Lo stimatore di HT del totale, che indichiamo con yπ, assume l’espressione generale

già introdotta del Cap. 1, e cioè:

N

yπ = ∑

i =1

Yi t i

πi

La varianza dello stimatore si ricava facilmente come segue:

⎡ N Yt ⎤ N Y2

Y Yj

V ( y ) = V ⎢∑ i i ⎥ = ∑ i 2 V (t i ) + 2∑∑ i

Cov(t i , t j )

π

π

π

π

=

1

=

1

>

i

i

i

j

i

j

i

i ⎦

i

⎣

N

(1 − π i )

Y Yj

(π ij − π iπ j )

= ∑ Yi 2

+ 2∑∑ i

πi

i =1

i

j >i

(9.9)

πi π j

Questa espressione può essere espressa in termini più semplici; infatti,

considerando che: πii = πi, gli ultimi due termini possono essere riunificati in un

unico termine come segue:

V ( yπ ) = ∑∑

i

10

j

Yi Y j

πi π j

(π

ij

− π iπ j )

E posto Yi π i = Y i e (π ij − π i π j ) = ∆ ij , si ottiene infine la notazione molto

∨

compatta:

∨

∨

V ( yπ ) = ∑∑ Yi Y j ∆ ij

i

(9.10)

j

E’ infine agevole ricavare uno stima corretta della varianza dello stimatore:

∨

∨

v( yπ ) = ∑∑ Yi t i Y j t j

i

j

∆ ij

π ij

∨

∨

∨

= ∑∑ Yi t i Y j t j ∆ ij

i

(9.11)

j

Dalla quale è immediato rilevare che la condizione di stimabilità della varianza

dello stimatore yπ è subordinata alla disponibilità di valori positivi della probabilità

congiunta πij per ogni possibile coppia di unità i e j nella popolazione.

Yates e Grundy (1953), hanno dimostrato che la (9.10) può essere espressa in una

forma diversa, ma equivalente, che consente di ricavare uno stimatore alternativo di

quello nella (9.11). Indichiamo questa diversa forma della varianza con la

notazione VYG:

⎛Y

Yj ⎞

1

⎟

VYG ( yπ ) = − ∑∑ ∆ ij ⎜ i −

⎟

⎜π

2 i j

π

i

j

⎠

⎝

2

(9.12)

Dalla quale è possibile ricavare il seguente stimatore alternativo della varianza di

yπ :

∆ ij ⎛ y i y j ⎞

1

⎜ −

⎟

vYG ( yπ ) = − ∑∑

2 i j π ij ⎜⎝ π i π j ⎟⎠

La (9.12) ci consente di sviluppare due importanti considerazioni:

(i) Perchè la varianza sia positiva il termine ∆ ij deve essere negativo e quindi

deve valere la condizione π ij < π i π j ;

(ii) La differenza tra parentesi può ridursi a zero nel caso in cui le probabilità di

inclusione del primo ordine siano proporzionali ai rispettivi valori della

variabile Y.

11

Riguardo a questa ultima considerazione è evidente che, come si è già osservato in

precedenza per le probabilità di selezione iniziali, non è possibile fissare le

probabilità di inclusione πi proporzionali ai rispettivi valori Yi dato che questi non

sono noti a priori. Tuttavia, se se sono disponibili da lista i valori Xi di una variabile

ausiliaria, normalmente interpretabile come “dimensione” dell’unità i, tali che sia

ipotizzabile un rapporto di approssimata proporzionalità con quelli della variabile

di studio: Yi X i ≅ c (con c = costante), allora è intuitivo che il riuscire a stabilire

per le probabilità di inclusione del primo ordine valori proporzionali a quelli della

variabile ausiliaria: π i X i = c si tradurrà in una notevole riduzione della varianza

dello stimatore.

Da tutto questo discende l’esigenza di fissare i valori delle probabilità di inclusione

proporzionali a quelli della variabile X. In altri termini è necessario che: π i X i = c

e poiché per la definizione:

N

∑π

i =1

i

=n

Si ricava immediatamente che:

πi =

nX i

nX i

=

= npi ;

X

∑ Xi

(i = 1, 2,...,N),

(9.13)

i

dove i valori pi corrispondono alle probabilità iniziali introdotte nel precedente

paragrafo 9.2.

A questo riguardo, due considerazioni della massima importanza. La prima è che i

termini npi non possono essere maggiori di 1, se come in questo caso assumono non

più il significato di frequenze attese di inclusione (cfr § 9.2 ) bensì quello di

probabilità di inclusione. Qualora, quindi, per una o più unità della popolazione

dovesse verificarsi che npi > 1 , si dovrebbe enucleare tali unità dalla popolazione

inserendole con certezza (probabilità pari a 1) nel campione o in una strato dal

quale selezionarle separatamente dalle altre.

La seconda è che solo per n = 1 è immediato soddisfare la condizione in (9.13)

anche se in questo caso si ha che πij = 0 per ogni coppia di valori i e j (i ≠ j).

Per n = 2, il procedimento descritto all’inizio di questo paragrafo non consente di

soddisfarla, se non in modo approssimato, e per n > 2 le difficoltà aumentano

esponenzialmente.

Il soddisfacimento della (9.13) richiede che si riesca ad individuare un insieme

opportuno di probabilità iniziali ed uno opportuno schema ad hoc di selezione ad

12

esse combinato. Brewer e Hanif (1983) riportano una numerosa serie di schemi che

soddisfano la condizione citata per n = 2; alcuni di questi schemi sono semplici altri

piuttosto complessi. Qui, a titolo di esempio, ne riportiamo uno per n = 2

relativamente semplice, dovuto a Brewer (1975).

Lo schema di Brewer prevede che si calcolino in via prioritaria le quantità:

ci =

X i (X − X i )

,

X (X − 2 X i )

quindi, lo schema è definito dai seguenti due passi:

(i) si estrae la prima unità con probabilità:

N

pi* = ci ∑ ci .

i =1

(ii) Senza rimpiazzare nella popolazione l’unità estratta per prima, che indichiamo

con i1, si estrae una seconda unità, diciamo j|i1, con probabilità:

p *j i1 = X i X − X i1 .

E’ possibile verificare che, con questo schema, per i = 1,..., N :

π i = 2X i X ,

come richiesto dalla (9.13) e che per ogni coppia i ≠ j:

π ij =

2X i X j

X − Xi − X j

X (∑i ci ) ( X − 2 X i )(X − 2 X j )

.

Inoltre, lo schema descritto garantisce che ∆ ij < 0 per ogni coppia i ≠ j e,

conseguentemente, che esista uno stimatore non negativo della varianza dello

stimatore yπ , almeno nella versione di Yates e Grundy.

Riguardo al caso n > 2, ci limitiamo a riportare uno schema relativamente semplice,

applicabile nei casi in cui il campione sia di dimensione piuttosto elevata: il

campionamento sistematico con probabilità variabile.

13

La selezione sistematica con probabilità variabile è stata originariamente proposta

da Madow (1949), e successivamente riesaminata da diversi AA. Tra questi Rao e

Hartley (1962) cui si deve la sistemazione che segue.

Le unità della popolazione sono in via preliminare disposte secondo un ordine

casuale. Quindi, calcolata la distribuzione cumulativa X Cj delle misure di ampiezza

note Xi’ (utilizziamo l’indice i’ per identificare le unità della popolazione nel nuovo

ordine in cui si dispongono):

j

X Cj = ∑ X i ' ; ( j = 1,..., N ) ,

i '=1

e il rapporto K:

K = X /n

;

N

X = ∑ X i'

i '=1

(con gli opportuni provvedimenti per rendere K intero), si seleziona casualmente un

numero b compreso tra 1 e K e si include nel campione l’unità associata al termine

j, della serie cumulata, che soddisfa la disuguaglianza:

X Cj−1 < b + tK ≤ X Cj .

Si può osservare che in questo schema ogni unità non può essere selezionata più di

una volta se, per ogni i’, Xi’ ≤ K o, il che è equivalente, se npi’ ≤ 1. E’ inoltre facile

verificare che la probabilità di inclusione dell’i’-esima unità è esattamente npi’.

Relativamente complesso il procedimento per determinare la varianza. Rao e

Hartley, ricorrendo ad un approccio di tipo asintotico, hanno ricavato la seguente

espressione valida per valori abbastanza elevati di N in rapporto alla dimensione

campionaria n.

V HR ( y ) ≅

14

⎞

⎛ Yi '

1

⎟⎟[1 − (n − 1) pi ' ]

⎜

p

Y

−

∑

i

'

N 2 n i ' ⎜⎝ pi '

⎠

L’espressione mostra che questa varianza è inferiore alla corrispondente nel

campionamento con ripetizione in virtù del fattore [1 − (n − 1) pi ' ] .

Una stima campionaria della precedente varianza, anch’essa ricavata da Rao e

Hartley, è la seguente:

N N ⎡

N

y j' ⎞

1

⎤⎛ y

v HR ( y ) = 2

∑ ∑ ⎢1 − n( pi ' + p j ' ) + ∑ p 2j ' ⎥⎜⎜ i ' − ⎟⎟

N (n − 1) i '=1 j '>i '⎣

j '=1

⎦⎝ pi ' p j ' ⎠

9.7

2

CONFRONTO TRA SELEZIONE CON E SENZA RIPETIZIONE

Concludiamo, con un confronto tra selezione con probabilità variabile con e senza

ripetizione. Nel campionamento casuale semplice, l’estrazione senza ripetizione

risulta sempre vantaggiosa rispetto a quella con ripetizione, almeno in termini di

precisione delle stime. E’ possibile oltretutto dimostrare che stime basate sulle sole

unità distinte di un campione casuale semplice con ripetizione risultano più precise

di quelle basate sull’intero campione (Raj e Kamis, 1958).

La relazione tra selezione con e senza ripetizione valida per il campionamento

casuale semplice non è generalizzabile al CPV. Per mettere a confronto i due tipi di

selezione occorre in primo luogo fissare dei parallelismi tra i procedimenti. Oltre a

quello consueto relativo alla uguale dimensione campionaria, si assume

normalmente che sia soddisfatta l’uguaglianza πi = npi. Tale uguaglianza risponde

alla logica aspettativa che le probabilità di inclusione del primo ordine siano

proporzionali alle probabilità iniziali di selezione, ma allo stesso tempo restringe il

confronto alle situazioni nelle quali la frequenza attesa di inclusione non superà il

valore 1.

Sotto queste assunzioni, D. Raj (1966) ha dimostrato che, indipendentemente dai

valori osservabili yi (i = 1,..., N), una condizione sufficiente affinché lo stimatore

di Horvitz e Thompson del totale Y abbia varianza inferiore allo stimatore (9.2), è

che:

π ij >

(n − 1) π π

n

i

j

(9.14)

15

per ogni i e j.

Lo stesso autore ha dimostrato che una condizione necessaria affinché, sotto le

stesse assunzioni, la selezione senza ripetizione sia migliore di quella con

ripetizione è la seguente:

π ij ≤

2(n − 1)

π iπ j

n

(9.15)

Dalla disuguaglianza è inoltre immediato ricavare che, per n = 2, lo stimatore della

varianza di stima (9.12) sarà positivo soltanto se risulterà soddisfatta la (9.15).

16