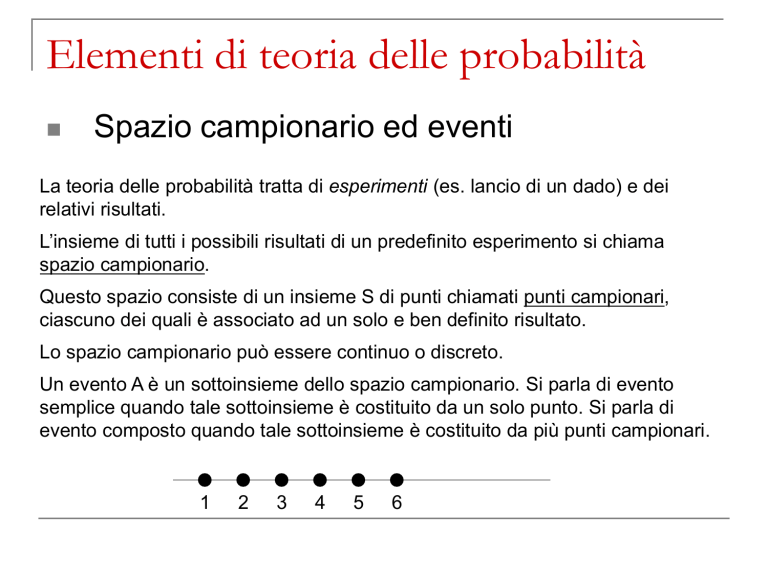

Elementi di teoria delle probabilità

Spazio campionario ed eventi

La teoria delle probabilità tratta di esperimenti (es. lancio di un dado) e dei

relativi risultati.

L’insieme di tutti i possibili risultati di un predefinito esperimento si chiama

spazio campionario.

Questo spazio consiste di un insieme S di punti chiamati punti campionari,

ciascuno dei quali è associato ad un solo e ben definito risultato.

Lo spazio campionario può essere continuo o discreto.

Un evento A è un sottoinsieme dello spazio campionario. Si parla di evento

semplice quando tale sottoinsieme è costituito da un solo punto. Si parla di

evento composto quando tale sottoinsieme è costituito da più punti campionari.

1

2

3

4

5

6

Elementi di teoria delle probabilità

Relazione tra eventi

Se due eventi A e B non contengono punti campionari in comune si dicono

mutuamente esclusivi o disgiunti

1 2 3 4 5 6

Se due eventi A e B non sono mutuamente esclusivi i punti campionari in

comune costituiscono la loro intersezione:

A B

1

2

3

4

5

6

1 2 3 4 5 6

L’unione di due eventi A e B è un evento costituito da tutti i punti di A e di B:

A B

Elementi di teoria delle probabilità

Spazio campionario a due dimensioni

Si consideri l’esperimento “misura simultanea della velocità e della direzione

del vento”. Lo spazio campionario (continuo) è costituito da punti le cui

coordinate sono la velocità e la direzione del vento. Questo spazio campionario

ha quindi due dimensioni

Direzione

360

0

0

Velocità (m/s)

Elementi di teoria delle probabilità

Spazio campionario condizionato

Se anziché considerare tutti i possibili risultati consideriamo solo quelli

caratterizzati da un velocità maggiore o uguale a un prefissato valore (es 1

m/s) lo spazio campionario risulterà ridotto rispetto al precedente

Direzione

360

0

0

1

Velocità (m/s)

Elementi di teoria delle probabilità

La probabilità

A ciascun punto dello spazio campionario relativo ad un prefissato esperimento può

essere associato un numero chiamato misura di probabilità o più semplicemente

probabilità

Def.: Se un evento casuale può manifestarsi in n modi ugualmente probabili e

mutuamente esclusivi e se na di questi modi sono caratterizzati dall’attributo A,

allora la probabilità che si manifesti un evento con attributo A è:

Prob A na n

Se un evento casuale si manifesta un gran numero di volte (n volte) ed un

evento di attributo A si manifesta na volte, allora la probabilità che un evento

con attributo A si manifesti è:

Prob A lim na n

n

Elementi di teoria delle probabilità

Assiomi della teoria delle probabilità

Assioma 1: La probabilità di un evento A è un numero compreso tra 0 e 1:

0 P A 1

Assioma 2: La probabilità dell’evento certo S è l’unità:

PS 1

Assioma 3: La probabilità di un evento che è l’unione di due eventi mutuamente

esclusivi è la somma delle probabilità dei due eventi:

P A B=P A PB

Elementi di teoria delle probabilità

Probabilità dell’unione

Dati due eventi, disgiunti o meno, la probabilità dell’evento unione è:

P A B=P A PB P A B

Probabilità condizionata

La probabilità condizionata di un evento A dato B, cioè la probabilità dell’evento A

condizionata al fatto che l’elemento B si sia manifestato è:

P A|B=

P A B

PB

P A B=P A|B PB

Rinormalizzazione sullo spazio

campionario condizionato

Elementi di teoria delle probabilità

Indipendenza

Si dice che due eventi sono indipendenti quando:

P A|B=P A

La probabilità che l’evento B si sia manifestato non altera la probabilità

del manifestarsi dell’evento A

P A B=P A PB

La variabile casuale

La variabile casuale è una variabile numerica il cui valore non può essere

previsto con certezza prima di un esperimento. Di fatto è la quantificazione

numerica del concetto di spazio campionario: è dunque possibile associare ad

ogni punto dello spazio campionario un valore della variabile casuale.

Il comportamento della variabile casuale sull’intero spazio campionario viene

descritto dalle leggi di probabilità.

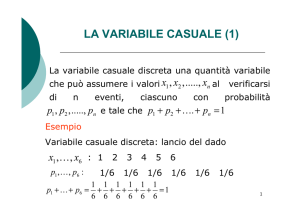

Variabili casuali discrete

Variabili casuali continue

Variabile discreta

Funzione di probabilità di massa

La funzione di probabilità di massa della variabile discreta X è:

pX x=PX x

pX(x) esprime la probabilità che la variabile casuale X assuma il valore x.

0 pX x 1

pX xi =1

Pa X b=

xi b

pX xi

xi a

Variabile discreta

Funzione di probabilità cumulata

La funzione di probabilità cumulata rappresenta la probabilità dell’evento che la

variabile casuale assuma un valore minore o uguale a quello assegnato:

FX x=PX x

Per variabili casuali discrete questa funzione equivale alla somma della

funzione di probabilità di massa relativamente all’intervallo dei valori

minori o uguali ad x che la variabile casuale X può assumere:

FX x=

pX xi

xi x

Variabile continua

Funzione di densità di probabilità

Supponiamo che l’asse x sia suddiviso in un numero sufficientemente ampio di

piccoli intervalli di lunghezza infinitesimale dx; è allora plausibile definire una

funzione fX(x) tale che la probabilità che X ricada nell’intervallo di estremi x e x+dx

risulti pari a fX(x)dx: tale funzione è detta funzione di densità di probabilità.

Poiché gli intervalli sono mutuamente esclusivi ne segue che:

x2

Px1 X x 2 =

x

f X xdx

1

La probabilità che X assuma un singolo valore x è zero in quanto la lunghezza dx

risulta zero: in effetti fX(x) non rappresenta una probabilità come pX(x), bensì una

densità di probabilità. Pertanto fX(x) può anche essere maggiore di uno, ma mai

negativa.

-

f X xdx 1

Variabile continua

Funzione di probabilità cumulata

La definizione di funzione di probabilità cumulata per una variabile casuale

continua è del tutto equivalente a quella fornita per una variabile casuale discreta:

FX x=PX x P- X x

FX x=

dFX x d

=

dx

dx

x

- fX udu

f X udu f X x

-

x

Variabile continua

Funzione di probabilità cumulata

0 FX x 1

FX =0

FX =1

FX x ε FX x ε 0

FX x2 FX x1 P x1 X x2

Funzione di probabilità congiunta

Quando si considerano due o più variabili simultaneamente il loro comportamento

probabilistico viene descritto dalla funzione congiunta di probabilità e dalla

funzione congiunta di probabilità cumulata.

Variabili discrete

pX,Y x,y=PX x Y y

FX,Y x,y=P X x Y y

pX,Y xi ,yi

xi x yi y

Funzione congiunta di

probabilità di massa.

Funzione congiunta di

probabilità di massa cumulata.

Funzione di probabilità congiunta

Variabili continue

P x1 X x2 y1 Y y2

x2 y2

x y

1

f X,Y x,ydxdy

1

FX,Y x,y=P X x Y y

fX,Y x0 ,y0 dx0dy0

x

Funzione congiunta di

probabilità di densità di

probabilità.

y

Funzione congiunta di

probabilità cumulata.

Funzione marginale di probabilità

Il comportamento di una variabile indipendentemente dall’altra viene descritto

dalla funzione marginale di probabilità.

Variabili discrete

pX x=PX x=

p X,Y x,yi

Funzione marginale di

probabilità di massa.

tutti gli yi

Variabili continue

f X x

fX,Y x,ydy

Funzione marginale di densità di

probabilità.

Funzione condizionata di probabilità

Variabili discrete

p X|Y x,y=PX x| Y y=

p X,Y x,y

p X,Y xi ,y

P X x Y y

PY y

p X,Y x,y

p Y y

Funzione condizionata

di probabilità di massa.

tutti gli xi

Variabili continue

f X|Y x,y

f X,Y x,y

f Y y

Funzione condizionata

di densità di probabilità.

Distribuzioni di probabilità per Y=g(X)

X e Y variabili casuali legate dalla relazione Y=g(X):

X variabile indipendente;

Y variabile dipendente;

Siano note

f X x

FX x

Sia il legame Y=g(X) biunivoco e monotono crescente:

Y è minore o uguale di y0 se e sole se X è minore o uguale ad un valore x0

t.c. y0=g(x0), ovvero:

x0 g

1

y0

Distribuzioni di probabilità per Y=g(X)

Sotto queste condizioni la funzione di probabilità cumulata della variabile Y

può essere derivata dalla funzione di probabilità cumulata della variabile X:

1

1

FY y PY y P X g y FX g y

Se il legame Y=g(X) è anche continuo e derivabile si può derivare anche la

funzione di densità di probabilità di Y:

d

d

d

1

f Y y FY y FX g y

dy

dy

dy

g 1 y

f X xdx

Distribuzioni di probabilità per Y=g(X)

quindi:

f Y y

dg 1 y

f X g 1 y

dy

dx

f Y y f X x

dy

fY ydy f X xdx

La probabilità che Y ricada nell’intervallo di ampiezza dy centrato in y è

uguale alla probabilità che X ricada nel corrispondente intervallo centrato in

x=g-1(y)