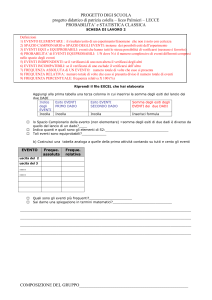

LA PROBABILITÀ

“Un tizio, costretto a viaggiare molto per lavoro, era angosciato all’idea che sul suo aereo ci fosse

una bomba. Così, dopo aver calcolato che la probabilità che ciò si avverasse era minima, ma non

abbastanza per lui, adesso viaggia sempre con una bomba in valigia. Secondo lui, la probabilità

che a bordo ci siano due bombe è infinitesimale”.

John Allen Paulos – Gli snumerati

INTRODUZIONE

A ben pensarci, la nostra vita di tutti i giorni è costellata da considerazioni di natura probabilistica,

anche se non necessariamente formalizzate come tali. Sono esempi di ciò la valutazione, nell’uscire

di casa la mattina, della possibilità che piova o meno nel corso della giornata (per decidere se

prendere o no l’ombrello), la rinuncia a partecipare ad una gara o un concorso “perché non ho

possibilità di farcela”, le previsioni del tipo “la squadra X ha ormai vinto al 90% il campionato”, le

statistiche che ci informano sulle probabilità di morte per il fumo o per il mancato uso delle cinture

di sicurezza in caso di incidente stradale, per non parlare delle speranze di vincita in giochi e

lotterie.

In tutte le situazioni di incertezza, si tende in sostanza a dare una “misura” dell’incertezza che, sia

pur indicata con vari termini, esprime il significato intuitivo della “probabilità”. Il fatto che la

probabilità abbia un significato intuitivo comporta anche che lo stabilirne le regole può, entro certi

limiti, essere guidato dall’intuizione.

BREVE STORIA DEL CALCOLO DELLA PROBABILITA’

Le origini del (moderno) Calcolo delle probabilità si fanno tradizionalmente risalire alla

corrispondenza tra Pascal e Fermat su un problema di gioco d’azzardo (1654): un noto giocatore

dell’epoca riscontrava che le sue deduzioni probabilistiche non si accordavano con le sue fortune, o

meglio sfortune, di gioco e si rivolse a Pascal chiedendo lumi al riguardo. Nato come teoria

matematica dei giochi, il Calcolo delle probabilità crebbe progressivamente di importanza tanto che

già Laplace, agli inizi del XIX secolo , poteva affermare “è notevole il fatto che una scienza,

iniziata con l’analisi dei giochi d’azzardo dovesse essere elevata al rango dei più importanti

oggetti della conoscenza umana”. La teoria conobbe un grande sviluppo nel XX secolo, quando

Kolmogorov nel 1933 [2] introdusse l’approccio assiomatico che ancora oggi ne costituisce il

fondamento.

Al giorno d’oggi, le applicazioni del Calcolo delle probabilità sono presenti in ogni ramo della

scienza, nella tecnologia, nella finanza. Del resto, la fine della visione newtoniana della Fisica e

l’avvento di quella quantistica hanno dimostrato l’impossibilità di fare previsioni esatte in ogni

circostanza: il principio di indeterminazione di Heisenberg (1927) afferma che non è possibile

conoscere simultaneamente la posizione e la velocità di un dato oggetto con precisione arbitraria.

Nel secolo XX ebbe anche grande impulso la Statistica, che del Calcolo delle Probabilità

rappresenta in un certo senso il “braccio operativo”, studiando come combinare le probabilità che

misurano l’incertezza relativa ad un certo fenomeno con le osservazioni sperimentali del fenomeno

stesso.

LA

COSTRUZIONE

DI

UN

MODELLO

PROBABILISTICO: GLI

INGREDIENTI

ESSENZIALI

Possiamo definire il Calcolo delle probabilità come la teoria matematica dell’incertezza.

La teoria dice come si devono formulare in maniera corretta delle valutazioni probabilistiche o, in

altri termini, come si deve formulare un modello probabilistico.

Come ogni modello matematico, anche quello probabilistico, da un lato, consente la trattazione di

un problema di interesse in modo logico e rigoroso; dall’altro, rappresenta necessariamente

un’astrazione della realtà e ne cattura solo alcuni aspetti. Inoltre, il modello deve condurre a risultati

“utili”, che siano in accordo con l’evidenza sperimentale. Altrimenti se ne impone la revisione.

Vediamo ora quali sono gli elementi essenziali per la costruzione di un modello probabilistico.

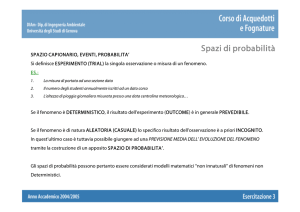

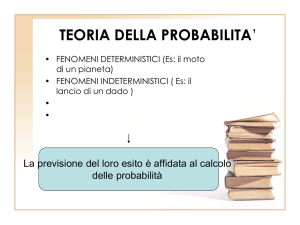

Definiamo esperimento aleatorio un qualsiasi fenomeno il cui risultato non può essere previsto a

priori: ad esempio il lancio di un dado , il lancio di due dadi, il tempo che farà domani.

Occorre innanzitutto individuare quali sono gli eventi in gioco, cioè le diverse situazioni che si

possono presentare quando si considera un certo fenomeno, in particolare gli eventi elementari o

esiti. Per illustrare questi concetti, peraltro piuttosto intuitivi, ricorriamo ad un semplice esempio.

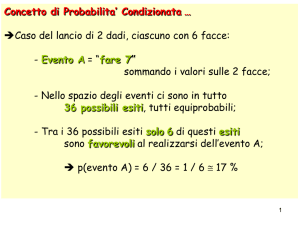

Consideriamo il lancio simultaneo di due dadi di diverso colore: gli esiti, o eventi elementari,

possono essere individuati dalle coppie ordinate di interi da 1 a 6. L’insieme di tutti i possibili esiti

di un esperimento aleatorio è detto spazio campionario.

Nel lancio di due dadi l’insieme dei possibili esiti è dato dalle 36 coppie ordinate di interi da 1 a 6:

S 1,1; 1,2; 1,3; 1,4; 1,5; 1,6; 2,1; 2,2; 2,3; 2,4; 2,5........

A partire dagli eventi elementari si possono costruire eventi “complessi”, quali l’evento “uscita di

un 7 (come somma)”, che possiamo descrivere come la collezione di esiti:

E={(1,6), (2,5), (3,4), (4,3), (5,2), (6,1)} .

È evidente che possiamo descrivere gli “oggetti” sopra introdotti in termini insiemistici: lo spazio

campionario può essere visto come un insieme del quale gli esiti costituiscono gli elementi o

“punti”.

Gli eventi sono allora sottoinsiemi dell’insieme S.

Come abbiamo già ricordato, il modello probabilistico è una astrazione della realtà che ne cattura

alcuni aspetti. Non sorprenderà quindi l’osservazione che lo spazio campionario è una costruzione

matematica non necessariamente unica, che dipende da ciò che pensiamo sia importante.

Se il lancio dei due dadi del nostro esempio avviene sul pavimento del salotto, i dadi possono finire

sotto il divano che ne nasconderà il valore della faccia superiore. Se si è interessati a tenere conto di

questo fatto, si potrà “arricchire” lo spazio campionario con la coppie (D,i), (i,D), i=1,…,6, (D,D).

Analoghe considerazioni possono essere fatte per gli eventi: una volta fissato lo spazio campionario,

quali considerare dipende da cosa si ritiene importante. Se l’interesse è per l’evento E “uscita di un

7”, sarà sufficiente limitarsi a considerare l’evento E e l’evento complementare E segnato.

Se si deve decidere se fare o meno una gita per il giorno successivo e quale abbigliamento

prevedere in caso di effettuazione tenendo conto delle previsioni di pioggia, gli eventi da

considerare potrebbero essere “tempo asciutto”, “pioggia leggera”, “pioggia intensa” e non

necessariamente i millimetri di pioggia che potrebbero cadere sul luogo della gita.

Quando gli esiti possono essere contati, lo spazio campionario si dice discreto. Come caso

particolare, se il numero di esiti è limitato, lo spazio campionario si dice finito.

Dopo avere introdotto gli eventi, vediamo ora come assegnare ad essi le probabilità, per essere in

grado di misurare –questo appunto è lo scopo del Calcolo delle probabilità– l’incertezza relativa al

verificarsi

o

meno

di

un

evento.

LE DEFINIZIONI DI PROBABILITÀ E L’IMPOSTAZIONE ASSIOMATICA

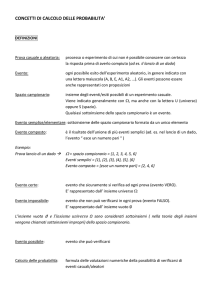

Esistono sostanzialmente quattro definizioni di probabilità:

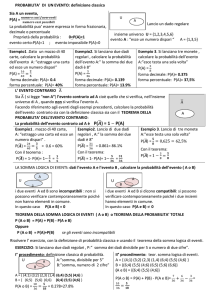

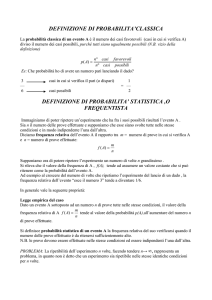

a)definizione di probabilita’classica

La probabilità classica di un evento A è il numero dei casi favorevoli (casi in cui si verifica A)

diviso il numero dei casi possibili, purché tutti siano ugualmente possibili (N.B. vizio della

definizione)

p ( A)

n casi favorevoli

n casi possibili

Es: Che probabilità ho di avere un numero pari lanciando il dado?

3

casi in cui si verifica il pari (o dispari)

6

casi possibili

p

3 1

6 2

N.B. Questa definizione, di cui risalta immediatamente il carattere tautologico, risente delle

circostanze in cui è nato il Calcolo delle probabilità (in relazione a problemi di gioco

d’azzardo) e può essere fatta risalire a Pascal; in realtà, è piuttosto una regola per calcolare le

probabilità in situazioni in cui ci sia un numero finito di alternative che possono essere

considerate, per motivi di simmetria e simili, ugualmente probabili.

b) definizione di probabilita’ statistica ,o frequentista

Immaginiamo di poter ripetere un’esperimento che ha fra i suoi possibili risultati l’evento A .

Sia n il numero delle prove effettuate e supponiamo che esse siano svolte tutte nelle stesse

condizioni e in modo indipendente l’una dall’altra.

Diciamo frequenza relativa dell’evento A il rapporto tra m = numero di prove in cui si verifica A

e n = numero di prove effettuate:

f ( A)

m

n

Supponiamo ora di potere ripetere l’esperimento un numero di volte n grandissimo .

Si rileva che il valore della frequenza di A , f(A), tende ad assumere un valore costante che si può

ritenere come la probabilità dell’evento A.

Ad esempio al crescere del numero di volte che ripetiamo l’esperimento del lancio di un dado , la

frequenza relativa dell’evento “esce il numero 3” tende a diventare 1/6.

In generale vale la seguente proprietà:

Legge empirica del caso

Dato un evento A sottoposto ad un numero n di prove tutte nelle stesse condizioni, il valore della

frequenza relativa di A f ( A)

m

tende al valore della probabilità p(A),all’aumentare del numero n

n

di prove effettuate.

Si definisce probabilità statistica di un evento A la frequenza relativa del suo verificarsi quando il

numero delle prove effettuato è da ritenersi sufficientemente alto.

N.B. le prove devono essere effettuate nelle stesse condizioni ed essere indipendenti l’una dall’altra.

PROBLEMA: La ripetibilità dell’esperimento n volte, facendo tendere n→ ∞, rappresenta un

problema, in quanto non è detto che un esperimento sia ripetibile nelle stesse identiche condizioni

per n volte.

N.B. La probabilità statistica è un valore calcolato “a posteriori”

Situazioni in cui è impossibile usare la probabilità classica e si usa quella statistica:

la probabilità di incidenti automobilistici

la probabilità di vita e di morte

la probabilità di furti

la probabilità che hanno dei macchinari di produrre pezzi difettosi

la probabilità che ha una persona di trovare un posto di lavoro

la probabilità di contrarre una certa malattia

la probabilità che un farmaco sia efficace

3) definizione soggettiva della probabilita’(Bruno De Finetti)

Per gli eventi per i quali non è possibile calcolare teoricamente il numero dei casi favorevoli e

possibili , né si può sottoporre l’evento a prove sperimentali ripetute nelle stesse condizioni, si può

utilizzare la definizione soggettiva di probabilità.

Si usa ad esempio per stimare la probabilità di vittoria di una squadra in un torneo.

In generale il calcolo della probabilità di un evento viene considerato come una scommessa.

Essa è la misura del grado di fiducia che un individuo coerente assegna al verificarsi di un dato

evento in base alle sue conoscenze.

Numericamente la probabilità soggettiva di un evento A è il rapporto fra la somma P che una

persona è disposta a scommettere sul realizzarsi di A e la somma V che la persona stessa riceverà se

l’evento si realizza:

p ( A)

P

V

Vediamo

un

esempio:

Ad una corsa di cavalli, una persona è disposta a pagare 90 euro per riceverne 120 in caso di vittoria

del cavallo Furia . La probabilità soggettiva dell’evento vittoria del cavallo Furia è : 90/120.

Oss: La persona deve però essere disposta a ricevere 90 e dare 120 euro in caso di perdita di Furia.

4) definizione di probabilita’ assiomatica (Kolmogorov)

La probabilità assiomatica impone delle regole. Quindi la probabilità si può dare con degli assiomi

(o proprietà della probabilità). Diamo le regole della probabilità , non definiamo cosa è.

La probabilità assiomatica è una funzione che associa ad ogni evento A un numero reale p in

modo da soddisfare i seguenti assiomi:

1) p( A) 0

2) p () 1

3) Se A e B sono due eventi disgiunti (A B=Ø) allora p( A B) p( A) p( B)

REGOLE BASE DEL CALCOLO DELLA PROBABILITA’

Le diverse definizioni della probabilità conducono alle stesse regole-base del calcolo delle

probabilità.

Assiomi

Sia A un evento . Sia S = A U Ā lo spazio campionario, ovvero l’insieme contenente tutti i

possibili risultati di un esperimento casuale. Allora si ha:

1) p( A) 0 (per ogni evento A)

2) p( S ) 1

3) Se A e B sono due eventi disgiunti (A B = Ø) allora si ha: p( A B) p( A) p( B)

Definizioni eventi

Siano dati due eventi A e B. Si definiscono :

1) Evento somma = evento A B = è l’evento che si verifica se si verifica A o B

(N.B. : è un o inclusivo !)

2) Evento prodotto = evento A B = è l’evento che si verifica se si verificano sia A che B

simultaneamente

3) Evento opposto di A= evento

A = è l’evento che si verifica se non si verifica A

4) Eventi incompatibili o disgiunti =

simultaneamente, cioè: A B

eventi A e B che non possono verificarsi

5) Eventi indipendenti = eventi A e B per cui il verificarsi di A è indipendente dal verificarsi

di B e viceversa

Teoremi

TEOREMA 1

p ( ) 0

TEOREMA 2

p ( A) 1 p ( A)

N.B. S = A U Ā (so che per definizione l’intersezione tra A e Ā è l’insieme Ø)

Ω

Ā

A

TEOREMA 3

p( A B) p( A) p( B) p( A B)

N.B. Pensa all’area:

Se A e B sono insiemi disgiunti, diremo allora che l’area dell’unione (area di AUB) è uguale

alla somma dell’area di A e dell’area di B. Cioè

A

B

area ( A B) area ( A) area ( B)

Se invece A e B non sono insiemi disgiunti, diremo allora che l’area dell’unione è uguale

alla somma delle due aree, meno l’area dell’intersezione. Cioè:

area ( A B) area ( A) area ( B) area ( A B)

A

B

La stessa cosa accade per la probabilità.

DEFINIZIONE PROBABILITA’ CONDIZIONATA

La probabilità che un evento casuale A si realizzi , nell’ipotesi che un altro evento B si realizzi, si

chiama probabilità condizionata di A , rispetto a B e si indica con il simbolo: p( A / B) .

A

B

m= risultati favorevoli all’evento A

r

m

k

k= risultati favorevoli all’evento B

r= risultati favorevoli all’evento A B

n= eventi elementari possibili

r

r

p ( A B)

: p( A / B) n

k k

p( B)

n

Si ha

TEOREMA 4 (DELLA PROBABILITA’ COMPOSTA)

p( A B) p( A) p( B / A) p( B) p( A / B)

dove p( A / B) è la probabilità condizionata dell’evento A rispetto all’evento B e p( B / A) ha

significato analogo.

A

B

A B

IMPORTANTE:

A è indipendente da B se e solo se p ( A / B ) p ( A) e quindi se e solo se per il teorema della

probabilità composta si ha p( A B) p( A) p( B)

TEOREMA 5 ( FORMULA DELLA PROBABILITA’ TOTALE)

Siano H1, H2, ....Hn n eventi mutuamente incompatibili , la cui unione dà l’universo, e sia A un

evento che si verifica ogni volta solo insieme a uno degli n tre eventi Hi. Allora:

p( A) p( H1 ) p( A / H1 ) p( H 2 ) p( A / H 2 ) ................ p( H n ) p( A / H n )

TEOREMA 6 (FORMULA DI BAYES)

Supponiamo che un evento A si verifichi a diverse condizioni relativamente alla natura delle quali

possiamo fare n ipotesi : H1, H2, H3, .. , Hn

Allora si ha :

p( Hi / A)

p( Hi ) p( A / Hi )

n

p( H ) p( A / H )

i

, i 1,.., n

i

1

TEOREMA 7 (SCHEMA DELLE PROVE RIPETUTE o DI BERNOULLI)

Dato un evento E sottoposto a n esperimenti indipendenti ognuno con probabilità p costante di

verificarsi, essendo q=1-p la probabilità che ha l’evento di non verificarsi, allora la probabilità di

ottenere k successi su n prove è :

n

p( k ,n ) p k q n k

k

ESEMPI DI APPLICAZIONE DEI TEOREMI

Supponiamo di avere uno scatolone contenente 10000 pezzi , di cui 15 hanno il difetto A , 13 hanno

il difetto B, 6 hanno entrambe i difetti.

Qual è la probabilità che prendendo un pezzo qualsiasi , lo si estragga difettoso?

A = evento 1 = ho estratto la pallina con difetto A ;

B = evento 2 = ho estratto la pallina con difetto B

A U B = estraggo pallina difettosa

Per il teorema 3 si ha:

p( A B) p( A) p( B) p( A B)

=

15

13

6

22

10000 10000 10000 10000

DA SVOLGERE

1-Si lanciano due dadi da gioco . Qual è la probabilità che il totale dei punti ottenuti sia almeno 10?

(S:1/6)

2-Da un’urna che contiene 40 palline di cui 12 bianche, 11 rosse ,17 verdi si estraggono

contemporaneamente due palline . Calcola la probabilità che esse siano: a) entrambe bianche; b)

entrambe rosse; c) una rossa e una verde . ( S: 11/130; 11/156;187/780)

3- Si prendano a caso 3 lampadine fra 15 lampadine , di cui 5 difettose. Determinare la probabilità

che: a) nessuna sia difettosa; b) una e una sola sia difettosa; c)almeno una sia difettosa (S: 24/91;

45/91; 67/91)

4-Un’urna contiene 20 palline numerate da 1 a 20. Si estrae una pallina ; calcolare la probabilità che

il numero sorteggiato sia : a) multiplo di 4 o di 5; b) multiplo di 5 o di 7.(S: 0,4; 0,3)