INTRODUZIONE ALLA TEORIA DELLA PROBABILITÀ

E DEI PROCESSI ALEATORI

DICAT – Università di Genova

Versione: 1.7

06.09.2011

Luigi Carassale

1

Sommario

1

Teoria della Probabilità ................................................................................................................ 5

1.1

Eventi e spazio campionario.................................................................................................. 5

1.2

Probabilità ............................................................................................................................. 6

1.2.1

Definizione classica (eventi equiprobabili, Laplace, 1812) ........................................... 6

1.2.2

Definizione empirica (frequentista, Von Mises 1920) ................................................... 7

1.2.3

Definizione assiomatica (Kolmogorov 1933) ................................................................ 8

1.3

Teoremi classici della probabilità.......................................................................................... 9

1.3.1

Teorema dell’evento complementare ............................................................................. 9

1.3.2

Teorema dell’evento totale........................................................................................... 10

1.4

Probabilità condizionata e composta ................................................................................... 11

1.5

Variabili Aleatorie ............................................................................................................... 14

1.5.1

Definizione ................................................................................................................... 14

1.5.2

Distribuzione di probabilità ......................................................................................... 14

1.5.3

Funzione di probabilità (di una variabile aleatoria discreta)........................................ 16

1.5.4

Densità di probabilità (di una variabile aleatoria continua) ......................................... 18

1.5.5

Valore atteso ................................................................................................................ 21

1.5.6

Momenti statistici di una variabile aleatoria ................................................................ 23

1.5.7

Funzione caratteristica di una variabile aleatoria continua .......................................... 26

1.5.8

Cumulanti ..................................................................................................................... 26

1.5.9

Entropia ........................................................................................................................ 27

1.5.10 Trasformazioni lineari di variabili aleatorie................................................................. 28

1.5.11 Trasformazioni non lineari di variabili aleatorie.......................................................... 29

1.6

Modelli di variabili aleatorie ............................................................................................... 30

1.6.1

Distribuzione normale (o Gaussiana) ........................................................................... 30

1.6.2

Distribuzione uniforme ................................................................................................ 31

1.6.3

Modello log-normale.................................................................................................... 32

1.6.4

Modello di Rayleigh..................................................................................................... 33

1.6.5

Modello di binomiale ................................................................................................... 33

1.6.6

Modello di Poisson....................................................................................................... 36

2

1.7

1.7.1

Espansione in serie di funzioni ortogonali ................................................................... 37

1.7.2

Principio di massima entropia ...................................................................................... 38

1.7.3

Trasformazione non-lineare di variabili Gaussiane ..................................................... 40

1.8

Rappresentazione della relazione probabilistica fra due grandezze .................................... 43

1.8.1

Distribuzione congiunta di probabilità ......................................................................... 43

1.8.2

Densità congiunta di probabilità .................................................................................. 43

1.8.3

Variabili aleatorie statisticamente indipendenti ........................................................... 45

1.8.4

Valore atteso ................................................................................................................ 46

1.8.5

Somma di variabili aleatorie statisticamente indipendenti .......................................... 46

1.8.6

Correlazione e covarianza ............................................................................................ 46

1.8.7

Modello normale bi-variato ......................................................................................... 49

1.8.8

Distribuzione condizionata di probabilità di una variabile aleatoria ........................... 49

1.9

2

Rappresentazioni approssimate della densità di probabilità................................................ 37

Proprietà delle variabili aleatorie Gaussiane ....................................................................... 51

1.9.1

Indipendenza statistica di variabili non-correlate ........................................................ 51

1.9.2

Linearità dello spazio delle variabili Gaussiane .......................................................... 51

1.9.3

Teorema del limite centrale.......................................................................................... 52

1.9.4

Simmetria polare delle variabili Gaussiane ................................................................. 53

1.9.5

Variabili Gaussiane e cumulanti .................................................................................. 53

1.9.6

Variabili Gaussiane e massima entropia ...................................................................... 54

Vettori Aleatori .......................................................................................................................... 55

2.1

Definizione .......................................................................................................................... 55

2.2

Momenti statistici ................................................................................................................ 55

2.3

Modello normale (Gaussiano) ............................................................................................. 56

2.4

Grandezze statistiche di ordine superiore al secondo .......................................................... 57

2.5

Entropia ed informazione mutua ......................................................................................... 58

2.6

Rappresentazione di vettori aleatori .................................................................................... 58

2.6.1

2.7

3

Analisi a componenti principali (PCA) ........................................................................ 58

Simulazione di vettori Gaussiani ......................................................................................... 60

Processi aleatori ......................................................................................................................... 61

3

3.1

Definizioni ........................................................................................................................... 61

3.1.1

Medie statistiche del primo ordine ............................................................................... 62

3.1.2

Medie statistiche del secondo ordine ........................................................................... 63

3.2

Processi aleatori stazionari .................................................................................................. 63

3.2.1

Medie temporali di una funzione campione ................................................................. 66

3.2.2

Processi aleatori ergodici ............................................................................................. 67

3.2.3

Rappresentazione nel dominio della frequenza di processi stazionari ......................... 67

3.3

Rappresentazione congiunta di una coppia di processi aleatori .......................................... 71

3.3.1

Medie statistiche congiunte del secondo ordine .......................................................... 71

3.3.2

Densità di Potenza spettrale incrociata ........................................................................ 73

3.3.3

Funzione di coerenza ................................................................................................... 73

3.4

Trasformazioni lineari di processi stazionari ...................................................................... 74

3.4.1

4

5

Derivazione di processi stazionari ............................................................................... 76

3.5

Momenti spettrali ................................................................................................................ 77

3.6

Modelli di processi stazionari.............................................................................................. 79

3.6.1

Processo armonico ....................................................................................................... 79

3.6.2

Processo a banda stretta ............................................................................................... 80

3.6.3

Processo a banda estesa................................................................................................ 81

3.6.4

Rumore bianco ............................................................................................................. 82

Analisi statistica di processi aleatori stazionari ......................................................................... 83

4.1

Analisi nel dominio del tempo - stima della funzione di autocorrelazione ......................... 84

4.2

Analisi nel dominio della frequenza - stima della funzione densità di potenza spettrale ... 84

Simulazione di processi aleatori ................................................................................................ 87

5.1

Metodo di Shinozuka........................................................................................................... 87

Equation Chapter (Next) Section 1

4

1

Teoria della Probabilità

Il concetto di probabilità, utilizzato a partire dal '600, è diventato con il passare del tempo la base di

diverse discipline scientifiche. I primi studi che portarono successivamente a concetti legati alla

probabilità possono essere trovati a metà del XVI secolo in Liber de ludo aleæ di Girolamo Cardano

(scritto nel 1526, ma pubblicato solo un secolo e mezzo dopo, nel 1663) e in Sulla scoperta dei dadi

di Galileo Galilei (pubblicato nel 1656). In particolare, Galileo spiegò il motivo per cui, lanciando

tre dadi, il 10 sia più probabile del 9 nonostante che entrambi i risultati si ottengano da un uguale

numero di combinazioni.1

La nascita del concetto moderno di probabilità viene attribuita a Blaise Pascal (1623-1662) e Pierre

de Fermat (1601-1665).2 Nel 1657 Christiaan Huygens (1629-1695) scrisse un Libellus de

ratiociniis in ludo aleæ, il primo trattato sul calcolo delle probabilità, nel quale introduceva il

concetto di valore atteso. Nel 1713 viene pubblicato postumo Ars conjectandi di Jakob Bernoulli,

dove veniva dimostrato il teorema che porta il suo nome, noto anche come legge dei grandi numeri.

Successivamente, de Moivre pervenne ad una prima formulazione, poi generalizzata da Pierre

Simon Laplace (1749-1827), del Teorema del limite centrale. La teoria della probabilità raggiunse

così basi matematicamente solide e, con esse, il rango di nuova disciplina.

1.1 Eventi e spazio campionario

In teoria della probabilità si considera un fenomeno osservabile esclusivamente dal punto di vista

della possibilità o meno del suo verificarsi, prescindendo dalla sua natura. Un ruolo centrale in

questo contesto è svolto dal concetto di evento.

Si consideri una singola osservazione o misura di un fenomeno (es. la tensione di snervamento in un

provino metallico soggetto alla prova di trazione, il numero di studenti in un aula, la velocità del

vento in un determinato luogo e in un dato istante). Se il fenomeno in esame è deterministico, il

risultato dell’osservazione (o dell’esperimento) può essere predetto con esattezza. Se il fenomeno è

aleatorio, il risultato dell’osservazione non è noto a priori; tuttavia è possibile identificare un

insieme , che contiene tutti i possibili risultati dell’esperimento. L’insieme è chiamato spazio

campionario; gli elementi di sono detti punti campionari.

Si definisce evento, E, un insieme di punti campionari (e quindi di risultati possibili

dell’osservazione). Lo spazio campionario Ω contiene tutti i possibili punti campionari, quindi gli

eventi sono sottoinsiemi dello spazio campionario. Si definisce evento elementare l’evento che

contiene un solo punto campionario; evento certo, quello che contiene tutti i punti campionari (cioè

coincide con lo spazio campionario); evento impossibile, quello che non contiene punti campionari.

Gli eventi vengono normalmente indicati con lettere maiuscole. Dati due eventi A e B, si indica con

AB la loro unione, ovvero l'evento costituito dal verificarsi dell'evento A oppure dell'evento B. Si

indica con AB la loro intersezione, ovvero l'evento costituito dal verificarsi sia dell'evento A che

1

Il 9 si ottiene con le sei combinazioni (1,2,6), (1,3,5), (1,4,4), (2,2,5), (2,3,4), (3,3,3), il 10 con le sei combinazioni

(1,3,6), (1,4,5), (2,2,6), (2,3,5), (2,4,4), (3,3,4). Tuttavia, mentre una combinazione di tre numeri uguali può presentarsi

in un solo modo, una con due numeri uguali può presentarsi in tre modi diversi, una con tre numeri diversi in sei modi

diversi. Si può quindi ottenere il 10 in 27 modi (6+6+3+6+3+3), il 9 in 25 modi (6+6+3+3+6+1).

2

Il Cavalier de Méré (un accanito giocatore passato alla storia per questo) aveva calcolato che ottenere almeno un 6 in 4

lanci di un dado era equivalente ad ottenere almeno un doppio 6 in 24 lanci. Tuttavia, visto che giocando secondo tale

convinzione invece di vincere perdeva, scrisse a Pascal lamentando che la matematica falliva di fronte all'evidenza

empirica. Da ciò scaturì una corrispondenza tra Pascal e Fermat in cui iniziò a delinearsi il concetto di probabilità

nell'accezione frequentista.

5

dell'evento B. Se AB = i due eventi A e B vengono detti mutuamente esclusivi o incompatibili

(non possono verificarsi simultaneamente). Il complemento di un evento A rispetto a Ω, Ω\A, è detto

negazione di A e indica il suo non verificarsi (ovvero il verificarsi dell'evento complementare).

Esempio 1.1. Eventi.

Nel lancio di un dado, i possibili risultati sono i numeri 1, 2, … 6. Ognuno è un punto

campionario ω dello spazio campionario Ω = {1, 2, 3, 4, 5, 6}. Si considerino i seguenti

eventi:

A = “occorrenza di un numero pari” = 2,4, 6;

B = “occorrenza di un numero dispari” = 1, 3, 5;

C = “occorrenza del numero 2” = 2;

D = “occorrenza del numero 7” = ;

E = AB = ;

A e B sono eventi incompatibili;

C è un evento elementare, D è un evento impossibile, E è l’evento certo.

1.2 Probabilità

Esistono diverse definizioni di probabilità. Nel seguito si forniranno 3 definizioni che hanno rilievo

per la loro importanza storica o utilità pratica.

1.2.1 Definizione classica (eventi equiprobabili, Laplace, 1812)

Secondo la prima definizione di probabilità, per questo detta classica, la probabilità P(A) di

occorrenza dell’evento A è definita come:

P A

NA

N

(1.1)

dove N è il numero di risultati possibili (assumendo che siano equiprobabili) e NA è il numero di

risultati favorevoli all’evento A.

Esempio 1.2. Definizione classica di probabilità

Lancio di una moneta Ω = {T, C}; sia A:=T, allora P(A) = 1/2;

Lancio di un dado Ω = {1, 2,…,6}; sia A = {1, 2}, allora P(A) = 2/6 = 1/3;

Estrazione numero roulette: Ω = {0, 1,…,90}; sia A = “estrazione numero dispari” = {1,

3,…,89}, allora P(A) = 45/91.

La definizione classica consente di calcolare effettivamente la probabilità in molte situazioni.

Inoltre, è una definizione operativa e fornisce quindi un metodo per il calcolo. Presenta tuttavia

diversi aspetti negativi non irrilevanti:

si applica soltanto a fenomeni con risultati equiprobabili;

presuppone un numero finito di risultati possibili;

la definizione è circolare perché utilizza la nozione di probabilità (eventi equiprobabili) per

definire la probabilità stessa.

6

1.2.2 Definizione empirica (frequentista, Von Mises 1920)

Per superare tali difficoltà, Richard von Mises (1883-1953) propose di definire la probabilità di un

evento come il limite cui tende la frequenza relativa dell'evento al crescere del numero degli

esperimenti. Si consideri un esperimento che possa essere ripetuto un numero infinito di volte e si

assuma che un evento E si sia verificato un numero nE di volte durante l’esecuzione di n

esperimenti. La probabilità di occorrenza dell’evento E si definisce come il limite per n che tende a

infinito della sua frequenza relative nE/n:

P E lim

n

nE

n

(1.2)

Esempio 1.3. Definizione frequentista di probabilità: convergenza alla definizione classica

Si simuli il lancio di un dado e si verifichi mediante la definizione (1.2) che l’evento A =

{1, 2} ha probabilità 1/3.

Il codice Matlab riportato in Figura 1-1 genera una successione di numeri casuali, x,

mediante il comando rand. I valori di x così generati sono compresi nell’intervallo chiuso

[2-53, 1-2-53]. A partire da x, il codice genera numeri interi, y, casuali equiprobabili compresi

fra 1 e 6.

La Figura 1-2 mostra i primi 10 risultati di una sequenza casuale. La Figura 1-3 mostra la

convergenza della probabilità calcolata mediante la definizione frequentista al valore

ottenuto dalla definizione classica (1/3). Si osserva che per avere una buona corrispondenza

fra i due valori sono necessari circa 104 esperimenti.

% Convergenza definizione frequentista probabilità

%

%

%

%

%

%

Esempio: lancio di un dado

n = numero esperimenti

A = evento

y = risultati esperimenti

fA = elenco eventi favorevoli (1) e sfavorevoli (0)

PA = probabilità di occorrenza evento A

n = 1e6;

x = rand(n,1);

y = round(6 * x + 0.5);

A = [1 2];

fA = zeros(n,1);

for k=1:n

fA(k) = sum(A==y(k));

end

PA = cumsum(fA) ./ (1:n)';

figure(1)

plot(1:10,y(1:10),'xr')

ylim([0 7])

grid on

xlabel('j')

ylabel('y_j')

figure(2)

semilogx(1:n,PA, 1:n, ones(n,1)*length(A)/6,'r--')

xlabel('n')

ylabel('n_E/n')

grid on

set(gca,'xMinorGrid','off')

Figura 1-1. Codice Matlab per verifica convergenza definizione frequentista di probabilità.

7

7

6

5

yj

4

3

2

1

0

1

2

3

4

5

6

7

8

9

10

j

Figura 1-2. Lancio di un dado: punti campionari corrispondenti a 10 esperimenti.

0.45

0.4

0.35

0.3

nE/n

0.25

0.2

0.15

0.1

0.05

0

0

10

1

10

2

10

3

10

n

4

10

5

10

6

10

Figura 1-3. Convergenza della frequenza relativa al valore della probabilità definita mediante

la (1.1).

La definizione frequentista, come quella classica, è operativa, cioè consente di calcolare

praticamente la probabilità di eventi in molte circostanze; inoltre, è coerente con quanto fornito

dalla definizione classica nel caso di eventi equiprobabili. Tuttavia è necessario osservare:

il "limite" delle frequenze relative non corrisponde all'analogo concetto matematico; ad

esempio, data una successione {an}, si dice che a è il suo limite se per ogni ε > 0 esiste un

numero naturale N tale che |an - a| < ε per ogni n > N, e, comunque dato ε, è sempre

possibile calcolare N; nella definizione frequentista, invece, N non è sempre calcolabile;

non tutti gli esperimenti sono ripetibili; ad esempio, ha sicuramente senso chiedersi quale sia

la probabilità che vi sia vita su Marte o che tra 50 anni il tasso di natalità in Africa diventi la

metà di quello attuale, ma in casi simili non è possibile immaginare esperimenti ripetibili

all'infinito.

1.2.3 Definizione assiomatica (Kolmogorov 1933)

L'impostazione assiomatica della probabilità venne proposta da Andrey Nikolaevich Kolmogorov

nel 1933 in Grundbegriffe der Wahrscheinlichkeitsrechnung (Concetti fondamentali del calcolo

delle probabilità). Va notato che la definizione assiomatica non è una definizione operativa e non

fornisce indicazioni su come calcolare la probabilità. Il nome deriva dal procedimento per

"assiomatizzazione" basato sull'individuare di concetti primitivi, da cui individuare i postulati e, per

via deduttiva, i teoremi.

8

L'impostazione assiomatica muove dal concetto di σ-algebra, o classe additiva. Dato un qualsiasi

esperimento casuale, i suoi possibili risultati costituiscono gli elementi di un insieme non vuoto Ω,

detto spazio campionario, e ciascun evento è un sottoinsieme di Ω. La probabilità viene vista, in

prima approssimazione, come una misura, cioè come una funzione che associa a ciascun

sottoinsieme di Ω un numero reale non negativo tale che la somma delle probabilità di tutti gli

eventi sia pari a 1.

Si assuma che ogni evento nello spazio campionario sia associato a un numero reale P(E),

chiamato probabilità di E. Questo numero soddisfa le tre seguenti condizioni:

1. La probabilità è un numero non-negativo: P(E) ≥ 0;

2. La probabilità dell’evento certo è unitaria: P(Ω) = 1;

3. Dati due eventi A e B definiti come mutuamente esclusivi, allora P(AB) = P(A) + P(B).

Si osservi che, come conseguenza degli assiomi precedenti, necessariamente, P(E) 1.

I tre assiomi introdotti da Kolmogorov sono coerenti con la definizione empirica fornita da Von

Mises e con la definizione classica enunciata da Laplace.

1.3 Teoremi classici della probabilità

Dagli assiomi precedenti si ricavano i teoremi di seguito riportati.

1.3.1 Teorema dell’evento complementare

Si definisce evento complementare Ec = \E dell’evento E, l’evento che comprende tutti i punti

campionari di Ω non compresi in E (Figura 1-4).

Ec

E

Figura 1-4. Evento complementare.

Un evento E e il suo complementare Ec sono mutuamente esclusivi, cioè la loro intersezione

fornisce l’evento vuoto, mentre la loro unione genera l’evento certo

E Ec 0

E Ec

(1.3)

Applicando alla (1.3) l’Assioma 3 si deduce:

P Ec 1 P E

(1.4)

In particolare, essendo Ωc = , l’applicazione della (1.4) dimostra che l’evento vuoto ha probabilità

di occorrenza zero (P(0) = 0). La (1.4) e l’assioma 1 dimostrano che P(E) 1.

9

Esempio 1.4. Probabilità dell’evento complementare

Sia P = 10-6 la probabilità di collasso di una struttura in un anno. La probabilità che tale

struttura non collassi in un anno è 1 – P = 1 – 10-6.

1.3.2 Teorema dell’evento totale

Il teorema della probabilità totale consente di calcolare la probabilità dell'unione di due, ovvero la

probabilità che si verifichi almeno uno di essi. Essa è la somma delle probabilità dei singoli eventi

se sono mutuamente esclusivi; in caso contrario, alla somma va sottratta la probabilità

dell’intersezione. Si consideri due eventi E1 e E2 in (Figura 1-5):

E1E2

E1

E2

Figura 1-5. Evento totale.

L’unione degli eventi E1 e E2 può essere scritta come:

E1 E2 E1 E2 E2 E1 E1 E2

(1.5)

dove (E1 – E2) contiene i punti campionari presenti in E1, ma non in E2 (E2 – E1 è definito

analogamente). I tre eventi rappresentati dagli insiemi del termine di destra della (1.5) sono

mutuamente esclusivi, quindi per l’Assioma 3 risulta:

P E1 E2 P E1 E2 P E2 E1 P E1 E2

(1.6)

Da Figura 1-5 risulta inoltre che E1 E1 E2 E1 E2 . La probabilità di occorrenza

dell’evento E1 – E2 risulta pertanto:

P E1 E2 P E1 P E1 E2

(1.7)

Sostituendo la (1.7) (e un’espressione analoga per E2 – E1) nella (1.6), la probabilità di occorrenza

dell’evento totale E1 E2 risulta:

P E1 E2 P E1 P E2 P E1 E2

(1.8)

Dalla (1.8) e dall’assioma di positività discende la condizione:

P E1 E2 P E1 P E2

(1.9)

10

Esempio 1.5. Probabilità dell’evento totale.

Si consideri il lancio di un dado e si considerino i seguenti eventi:

E1 1, 2,3;

E2 3, 4;

1,

,6

Applicando la definizione (1.1) risulta:

P E1 1 2

P E2 1 3;

P E1 E2 1 6

Applicando il teorema dell’evento totale risulta:

P E1 E2 P E1 P E2 P E1 E2 2 3

1.4 Probabilità condizionata e composta

Si dice probabilità condizionata di A dato B, e si scrive P(A|B), la probabilità che l'evento A ha di

verificarsi quando si sappia che B si è verificato.

P A | B

P A B

P B

P B 0

(1.10)

La definizione di probabilità condizionata può essere facilmente spiegata considerando il caso di

uno spazio campionario contenente N punti campionari equiprobabili . Sia NB il numero di

risultati favorevoli per l’evento B e NAB il numero di risultati favorevoli contemporaneamente per

gli eventi A e B (e quindi per l’evento A B). Sostituendo nella (1.10) la definizione classica di

probabilità (Eq. (1.1)):

P A | B

N AB N N AB

N NB NB

(1.11)

La probabilità condizionata P(A|B) può essere dunque interpretata come la probabilità di occorrenza

di A nello spazio campionario ridotto determinato da B (Figura 1-6).

B

A

Figura 1-6. Probabilità condizionata.

Esempio 1.6. Probabilità condizionata.

Si consideri il lancio simultaneo di due dadi. Si voglia determinare la probabilità di

occorrenza del numero 7 (evento A), dato che uno dei due dadi ha fornito il numero 1

(evento B). Lo spazio campionario contiene i 36 punti campionari equiprobabili:

(1, 1), (1, 2), (1, 3), (1, 4), (1, 5), (1, 6),

(2, 1), (2, 2), (2, 3), (2, 4), (2, 5), (2, 6),

(3, 1), (3, 2), (3, 3), (3, 4), (3, 5), (3, 6),

(4, 1), (4, 2), (4, 3), (4, 4), (4, 5), (4, 6),

(5, 1), (5, 2), (5, 3), (5, 4), (5, 5), (5, 6),

(6, 1), (6, 2), (6, 3), (6, 4), (6, 5), (6, 6).

11

Il numero di risultati favorevoli a A è NA = 6, quindi P(A) = 1/6; il numero di risultati

favorevoli a B è NB=11, quindi P(B) = 11/36; il numero di risultati favorevoli

simultaneamente ad A e B è NAB = 2, quindi P(AB) = 1/18; il numero di risultati

favorevoli a A, dato che si è verificato B sono 2 su 11 possibilità, quindi P(A|B)=2/11.

Attraverso il concetto di probabilità condizionata si perviene al teorema della probabilità composta,

che consente di calcolare la probabilità dell'intersezione di due o più eventi, ovvero la probabilità

che essi si verifichino entrambi. Nel caso di due eventi, si ha

P A B P A | B P B P B | A P A

(1.12)

Nel caso che la probabilità di A dato B, P(A|B), sia uguale a P(A), i due eventi vengono definiti

stocasticamente (o probabilisticamente, o statisticamente) indipendenti e dalla stessa definizione

segue una diversa formulazione della probabilità composta, caso particolare del precedente:

P A B P A P B

(1.13)

Esempio 1.7. Eventi statisticamente indipendenti.

Si consideri i seguenti eventi legati al lancio di un dado:

1, 2,3, 4,5,6;

A 1, 2;

B 1,3,5;

C 2, 4,6

P A 2 / 6;

P B 3/ 6;

P C 3/ 6 ;

A B 1,

P A B 1/ 6 P A P B A, B indipendenti;

B C ,

P B C 0 P B P C B, C dipendenti.

Si osserva che gli eventi A e B sono indipendenti, ma non mutuamente esclusivi, mentre gli

eventi B e C sono mutuamente esclusivi, ma non indipendenti. Si potrebbe osservare, in

proposito, che due eventi mutuamente esclusivi non possono essere statisticamente

indipendenti, in quanto la realizzazione di uno comporta la non-realizzazione dell’altro.

Il codice Matlab riportato in Figura 1-7 valuta, applicando la definizione frequentista, la

probabilità di occorrenza dell’evento A = {1, 2} e la probabilità di occorrenza di A

condizionata all’occorrenza di B = {2, 4, 5}. La Figura 1-8 mostra che, all’aumentare del

numero di esperimenti n, le probabilità P(A) e P(A|B) tendono al medesimo valore. Ciò

indica che gli eventi A e B sono statisticamente indipendenti.

12

%

%

%

%

%

%

%

%

%

%

%

%

Esempio: lancio di un dado

verifica che gli eventi A = [1 2] e B = [2 4 5] sono statisticamente

indipendenti.

n = numero di esperimenti

y = risultati esperimenti (lanci dado)

fA = elenco eventi favorevoli (1) e sfavorevoli (0) per A

fB = elenco eventi favorevoli (1) e sfavorevoli (0) per B

fAB = elenco eventi favorevoli (1) e sfavorevoli (0) per A e B

contemporaneamente

PA = probabilità di occorrenza evento A

PAcB = probabilità di occorrenza di A dato B

n = 1e5;

x = rand(n,1);

y = round(6 * x + 0.5);

A = [1 2];

B = [2 4 5];

fB = zeros(n,1);

fAB = zeros(n,1);

for k=1:n

fA(k) = sum(A==y(k));

fB(k) = sum(B==y(k));

fAB(k) = sum(A==y(k)) & sum(B==y(k));

end

PA = cumsum(fA) ./ (1:n)';

PAcB = cumsum(fAB) ./ cumsum(fB);

Figura 1-7. Codice Matlab per verifica indipendenza statistica mediante definizione

frequentista di probabilità.

0.5

0.45

0.4

P(A), P(A|B)

0.35

0.3

0.25

0.2

0.15

0.1

0.05

0

0

10

10

1

10

2

10

3

10

4

10

5

n

Figura 1-8. Probabilità di A (linea blu), e probabilità di A dato B (linea rossa).

13

1.5 Variabili Aleatorie

In teoria della probabilità, una variabile casuale (o variabile aleatoria o variabile stocastica o

random variable) può essere pensata come il risultato numerico di un esperimento quando questo

non è prevedibile con certezza (ossia non è deterministico). Ad esempio, il risultato del lancio di un

dado può essere matematicamente modellato come una variabile casuale che può assumere uno dei

sei possibili valori 1, 2, 3, 4, 5, 6. Bruno de Finetti definiva numero aleatorio (termine suggerito

dallo stesso per denotare la variabile casuale) un numero ben determinato ma non noto per carenza

di informazioni.

1.5.1 Definizione

Dato uno spazio campionario Ω su cui è definita una misura di probabilità, una variabile aleatoria è

una funzione (misurabile) dallo spazio campionario a uno spazio misurabile (es. l’insieme dei

numeri naturali, l’insieme dei numeri reali, ecc.; Figura 1-9).

In questo capitolo, si considerano variabili aleatorie a valori scalari (dette mono-variate). Variabili

aleatorie a valori vettoriali sono definite nei capitoli successivi.

Una variabile aleatoria è definita continua se ha valori in intervalli continui di . Una variabile è

detta discreta si ha valori in un insieme di numeri finito o numerabile (es. ). Una variabile

aleatoria è detta mista se assume valori in un insieme continuo, ma possiede un numero discreto di

valori aventi probabilità di occorrenza finita.

Nel seguito, le variabili aleatorie verranno indicate con lettere maiuscole (es. X), mentre le

corrispondenti lettere minuscole (es. x) verranno utilizzare per identificare generici valori assunti da

X, detti realizzazioni. La realizzazione x può essere interpretata come l’immagine del punto

campionario attraverso X (Figura 1-9).

x = X()

x

Figura 1-9. Variabile aleatoria X.

1.5.2 Distribuzione di probabilità

La distribuzione di probabilità (o distribuzione cumulative, o cumulative distribution function,

CDF) è una funzione che definisce la probabilità che la variabile aleatoria X assuma valori minori o

uguali ad un parametro in .

FX P X

(1.14)

La distribuzione di probabilità è definite per qualsiasi valore dell’argomento in e possiede le

seguenti proprietà (facilmente deducibili dalla (1.14) e dagli assiomi della teoria della probabilità):

FX P X P 0

(1.15)

FX P X P 1

(1.16)

14

P 1 X 2 FX 2 FX 1

1 2

(1.17)

Dalla (1.17) discende (per l’assioma di positività) che la distribuzione di probabilità è una funzione

non-decrescente i cui valori appartengono all’intervallo chiuso [0, 1]. Sarebbe possibile dimostrare

anche l’implicazione inversa: una funzione non-decrescente che soddisfa le condizioni (1.15) e

(1.16) rappresenta la distribuzione di probabilità di una qualche variabile aleatoria.

Esempio 1.8. Stima distribuzione di probabilità di una variabile aleatoria discrete

La Figura 1-10 mostra il codice Matlab per la stima della distribuzione di probabilità di una

variabile aleatoria discreta X, rappresentativa dei risultati del lancio di un dado. La Figura

1-11 mostra la distribuzione di probabilità stimata. Si osserva la struttura discontinua della

funzione, tipica delle variabili aleatorie discrete. I salti nella funzione rappresentano

probabilità finite di avere risultati in corrispondenza dei valori 1, 2,…,6.

% stima distribuzione di probabilità di v.a. discreta

n = 1e5;

X = round(6*rand(n,1) + 0.5);

% lancio di un dado

xi = linspace(-2, 10, 3001);

FX = zeros(size(xi));

for k=1:length(xi)

FX(k) = sum(X<=xi(k))/n;

end

plot(xi,FX,'.')

xlabel('\xi')

ylabel('F_X(\xi)')

grid on

ylim([0 1.1])

Figura 1-10. Codice Matlab per stima distribuzione di probabilità: esempio variabile aleatoria

discreta

1

FX()

0.8

0.6

0.4

0.2

0

-2

0

2

4

6

8

10

Figura 1-11. Distribuzione di probabilità dei risultati del lancio di un dado stimata mediante il

codice di Figura 1-10.

Esempio 1.9. Stima distribuzione di probabilità di una variabile aleatoria continua

Il codice riportato in Figura 1-12 stima la distribuzione di probabilità della variabile

aleatoria continua X, il cui spazio campionario è generato attraverso una trasformazione

non-lineare di numeri casuali Gaussiani u. Per ogni valore (k) dell’ascissa discretizzata, la

distribuzione di probabilità è ottenuta valutando la probabilità dell’evento X (k)

mediante la definizione frequentista. La Figura 1-13 mostra la distribuzione di probabilità

stimata.

15

%

n

u

X

stima CDF della variabile aleatoria X

= 1e5;

% numero esperimenti

= randn(n,1);

= u + 0.1*u.^2 + 0.05*u.^3;

% generazione spazio campionario per X

xi = linspace(-10, 10, 300); % definizione ascissa discretizzata

FX = zeros(size(xi));

for k=1:length(xi)

FX(k) = sum(X<=xi(k))/n;

end

plot(xi,FX)

xlabel('\xi')

ylabel('F_X(\xi)')

grid on

ylim([0 1.1])

Figura 1-12. Codice Matlab per stima distribuzione di probabilità

1

FX()

0.8

0.6

0.4

0.2

0

-10

-8

-6

-4

-2

0

2

4

6

8

10

Figura 1-13. Distibuzione di probabilità di una variabile aleatoria continua stimata mediante il

codice di Figura 1-12.

1.5.3 Funzione di probabilità (di una variabile aleatoria discreta)

Si consideri una variabile aleatoria discrete X che può assumere gli n valori discreti j (j = 1,…,n).

Si definisce funzione di probabilità di X la funzione:

PX j P X j

(1.18)

che definisce, la probabilità di realizzazione di ogni possibile valore j. La funzione di probabilità e

la distribuzione di probabilità sono legate dalla relazione:

PX j FX j FX j

FX

P

j

X

j

(1.19)

(1.20)

dove j- indica un numero reale minore, ma arbitrariamente vicino a j. La Figura 1-14 mostra la

funzione di probabilità e la corrispondente distribuzione di probabilità di una variabile aleatoria

discreta.

16

0.8

0.7

1

0.6

0.8

PX()

FX()

0.5

0.6

0.4

0.3

0.4

0.2

0.2

0.1

0

1

2

3

4

0

1

2

3

4

Figura 1-14. Funzione di probabilità e distribuzione di probabilità di una variabile discrete.

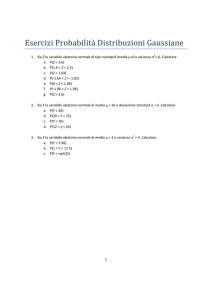

Esempio 1.10. Stima della funzione di probabilità

Si consideri un esperimento realizzando lanciando due dadi. Sia X ottenuto come somma

dei risultati forniti dai due dati. La Figura 1-15 riporta il codice per simulare il lancio di due

dadi; la funzione di probabilità è valutata attraverso la funzione riportata in Figura 1-15

realizzata introducendo la definizione frequentista di probabilità nella (1.18).

La Figura 1-17 mostra la funzione di probabilità (a) e la distribuzione di probabilità (b)

stimata sulla base di 105 lanci di dadi simulati.

% esempio lancio di due dadi

n = 1e5;

X1 = round(6*rand(n,1) + 0.5);

X2 = round(6*rand(n,1) + 0.5);

X = X1 + X2;

% lancio di un dado 1

% lancio di un dado 2

[PX, xi] = pf1(X);

figure(1)

for k=1:length(xi)

plot(xi(k)*[1 1],PX(k)*[0 1],'b',xi(k),P(k),'.b')

hold on

end

hold off

xlim([0 14])

grid on

xlabel('\xi')

ylabel('P_X(\xi)')

Figura 1-15. Codice Matlab per simulazione del lancio di due dadi.

function [P, xi] = pf1(x)

% stima funzione di probabilità per v.a. discreta X di cui sono disponibili

% n realizzazioni contenute nel vettore x

% P = funxione di probabilità

% xi = ascissa P

xi = min(x):max(x);

% ascissa funz di probabilità

P = zeros(length(xi),1);

z = x - min(x) + 1;

for k=1:length(x)

P(z(k)) = P(z(k)) + 1;

end

P = P / length(x);

end

Figura 1-16. Codice Matlab per stima dai dati della funzione di probabilità di una variabile

aleatoria discreta.

17

0.18

1

0.16

0.14

0.8

0.1

FX()

PX()

0.12

0.08

0.6

0.4

0.06

0.04

0.2

0.02

0

0

2

4

6

8

10

12

0

14

0

2

4

6

8

10

12

(a)

14

(b)

Figura 1-17. Funzione di probabilità (a) e distribuzione di probabilità (b).

1.5.4 Densità di probabilità (di una variabile aleatoria continua)

La distribuzione di probabilità, FX, di una variabile aleatoria continua, X, è una funzione continua in

, ma non necessariamente derivabile. Si assuma che i punti in cui FX non è derivabile formino un

insieme numerabile. Ove FX è derivabile, si definisce la densità di probabilità pX() (o probability

density function, o pdf) come derivata di FX rispetto all’argomento :

pX

d FX

d

(1.21)

In virtù delle proprietà di FX si deducono le seguenti proprietà della densità di probabilità:

pX 0

(1.22)

FX pX d

(1.23)

pX d 1

2

P 1 X 2 FX 2 FX 1 pX d

1

(1.24)

1 2

(1.25)

In cui si è supposto che, nei punti dove pX non è definita (FX non derivabile), essa assuma un

qualsiasi valore positivo finito.

La Figura 1-18 descrive la relazione fra pX e FX definita dalla (1.23): l’ordinata FX() equivale

all’area sottesa da pX a sinistra dell’ascissa .

La Figura 1-19 mostra che l’occorrenza di un punto * in cui FX non è derivabile si riflette in una

discontinuità in pX.

18

(a)

(b)

Figura 1-18. Relazione fra densità (a) e distribuzione (b) di probabilità.

Figura 1-19. Punti singolari nella densità di probabilità.

La (1.25) afferma che l’area sottesa dalla densità di probabilità, compresa fra due valori di ascissa,

1 e 2, rappresenta la probabilità che la variabile aleatoria assuma un valore compreso in tale

intervallo (Figura 1-20). Ponendo 1 = e 2 = + , la (1.25) può essere riscritta nella forma:

P X

pX d

p X

(1.26)

Nella quale, l’applicazione del teorema della media impone di assumere che pX sia continua in .

Figura 1-20. Significato probabilistico di densità e distribuzione di probabilità.

19

L’applicazione della definizione empirica di probabilità alla (1.26) fornisce uno strumento per

stimare la densità di probabilità attraverso la relazione:

n

n n

pX lim

(1.27)

dove n() è il numero di volte in cui il valore di X è compreso nell’intervallo (, + ] in n

esperimenti. La densità così ottenuta è rappresentata da un istogramma (Figura 1-21) che, se è

sufficientemente piccolo può essere interpretato come la discretizzazione di una funzione di

variabile continua.

Figura 1-21. Stima della densità di probabilità.

Esempio 1.11. Stima della densità di probabilità.

Si consideri la variabile aleatoria del precedente Esempio 1.9 e si stimi la densità di

probabilità utilizzando la definizione frequentista.

%

n

u

X

stima pdf della variabile aleatoria X

= 1e6;

% numero esperimenti

= randn(n,1);

= u + 0.1*u.^2 + 0.05*u.^3;

% generazione spazio campionario per X

xi = linspace(-10, 10, 300); % definizione ascissa discretizzata

pX = zeros(size(xi));

Dx = xi(2) - xi(1);

for k=1:length(xi)

pX(k) = sum(X > xi(k)-Dx/2 & X <= xi(k)+Dx/2)/n/Dx;

end

plot(xi,pX)

xlabel('\xi')

ylabel('p_X(\xi)')

grid on

xlim([-6 6])

Figura 1-22. Codice Matlab per stima densità di probabilità.

20

0.45

0.4

0.35

pX()

0.3

0.25

0.2

0.15

0.1

0.05

0

-6

-4

-2

0

2

4

6

Figura 1-23. Densità di probabilità stimata mediante il codice riportato in Figura 1-22.

Il codice riportato in Figura 1-22 è molto semplice perché implementa brutalmente

l’estimatore definito dalla (1.27). Sfortunatamente, tale algoritmo è piuttosto inefficiente,

avendo una complessità computazionale pari a n2. In alternativa, la densità di probabilità

può essere stimata mediante la funzione riportata in Figura 1-24, che ha complessità

computazionale pari a n.

function [p, xi] = pdf1(x,Nx)

% stima pdf per v.a. continua X di cui sono disponibili le realizzazioni

% raccolte nel vettore x

% p = pdf

% xi = ascissa pdf

% Nx = numero punti ascissa pdf

xi = linspace(min(x),max(x),Nx)';

Dx = (max(x)-min(x)) / Nx;

% ascissa discretizzata pdf

% ampiezza intervalli

p = zeros(Nx,1);

z = (x - min(x)) / (max(x) - min(x));

z1 = round((Nx-1) * z)+1;

for k=1:length(x)

p(z1(k)) = p(z1(k)) + 1;

end

p = p / length(x) / Dx;

end

% x è mappato in [0 1]

% numero d'ordine intervallo ascissa

% normalizzazione

Figura 1-24. Codice Matlab per stima distribuzione di probabilità.

1.5.5 Valore atteso

Il valore atteso (o media, o expectation) di una variabile aleatoria X, è un numero E[X] che

formalizza l'idea euristica di valore medio di un fenomeno aleatorio.

In generale il valore atteso di una variabile aleatoria discreta è dato dalla somma dei possibili valori

di tale variabile, ciascuno moltiplicato per la probabilità di essere assunto (ossia di verificarsi), cioè

è la media ponderata dei possibili risultati. Se la variabile aleatoria X può assumere i valori j (j =

1,2,…), il valore atteso è definito dalla relazione:

E X j PX j

(1.28)

j 1

21

Per una variabile aleatoria continua il valore atteso è essere definito mediante un integrale.

E X

dFX

p d

X

(1.29)

Si osservi che la definizione di valore atteso ottenuta attraverso l’integrale di Stieltjes nella (1.29)

può essere applicata anche nei casi in cui la funzione densità di probabilità non è definita, come per

le variabili aleatorie discrete e miste.

Il valore atteso è un operatore lineare che dallo spazio delle variabili aleatorie conduce nello spazio

dei numeri reali. Esso gode quindi delle proprietà:

E aX bY a E X b E Y

(1.30)

dove X e Y sono variabili aleatorie, mentre a e b sono costanti reali.

Il valore atteso ha la proprietà di monotonia, cioè se una variabile aleatoria X appartiene

all’intervallo [a, b], allora anche il suo valore atteso E[X] appartiene ad [a, b].

Il valore atteso di una variabile aleatoria di cui è disponibile un insieme di realizzazioni può essere

stimato attraverso la media statistica. Ciò può essere dimostrato facilmente nel caso di variabili

aleatorie discrete (il concetto è altrettanto valido per le variabili continue) sostituendo la definizione

frequentista di probabilità nella (1.28)

E X

j 1

nj

j

(1.31)

n

dove nj rappresenta il numero di volte che si è realizzato il valore j nel corso di n esperimenti, con

n grande a sufficienza. La (1.31) contiene la somma dei risultati possibili j moltiplicati per il

numero di volte che questi si sono realizzati nj. Questa somma corrisponde alla somma dei valori xk

realizzati dalla variabile aleatoria negli n esperimenti (ammesso che n sia grande a sufficienza a fin

che l’insieme dei risultati xk contenga tutti i risultati j aventi una probabilità di occorrenza

significativa). La (1.31) può dunque essere riscritta nella forma:

E X

1 n

xk

n k 1

(1.32)

Il concetto di valore atteso può essere esteso al caso di una variabile aleatoria Y legata, attraverso

una funzione deterministica, ad una variabile aleatoria X di cui è nota la densità di probabilità (cioè,

Y = f(X), con f funzione deterministica). Il valore atteso di Y è fornito dalle espressioni:

E Y E f X f j PX j

(1.33)

j 1

E Y E f X

f p d

X

(1.34)

per i casi di variabili aleatorie discrete e continue, rispettivamente.

22

1.5.6 Momenti statistici di una variabile aleatoria

Si definisce momento statistico di ordine k (k ≥ 1) di una variabile aleatoria X il valore atteso della

potenza di ordine k di X:

mk X E X k

k 1, 2,

(1.35)

Sostituendo la (1.35) nelle (1.33) e (1.34), ponendo f(X) = Xk, si ottengono le espressioni:

mk X kj PX j

k 1, 2,

(1.36)

k 1, 2,

(1.37)

j 1

mk X

k

pX d

Il momento statistico di ordine 1, X = m1[X], è detto valore medio (o media); il momento statistico

di ordine 2, X2 = m2[X], è detto valore quadratico medio (o media quadratica).

Si definisce momento statistico centrale di ordine k (k ≥ 2) di una variabile aleatoria X la quantità:

k

k X E X X

k 2,3,

(1.38)

Il momento statistico centrale di ordine 2, X2 = 2[X] è detto varianza, mentre la sua radice

quadrata, X, è detta deviazione standard.

I momenti statistici centrali sono legati ai momenti statistici da relazioni ricorsive. Arrestandosi

all’ordine 4, risultano:

2 m2 m12

3 m3 3m 2 m1 2 m13

(1.39)

4 m4 4 m3 m1 6 m2 m12 3m14

Nel caso in cui X è una variabile aleatoria continua, la media X = m1[X] rappresenta, da un punto di

vista grafico, la posizione (ascissa) del baricentro dell’area sottesa dalla densità di probabilità;

pertanto, la media misura la posizione della funzione di densità di probabilità rispetto all’asse reale.

La media ha la medesima dimensione (unità di misura) delle realizzazioni della variabile aleatoria.

La varianza X2 = 2[X] rappresenta il momento d’inerzia dell’area sottesa dalla densità di

probabilità rispetto all’asse baricentrico; pertanto, la varianza rappresenta una misura di dispersione,

intono al valore medio, delle realizzazioni di una variabile aleatoria. La deviazione standard ha la

medesima dimensione delle realizzazioni della variabile aleatoria.

In accordo con le (1.39), media, varianza e media quadratica sono legate dalla relazione:

2X 2X 2X

(1.40)

Il rapporto fra deviazione standard e media è detto coefficiente di variazione:

IX

X

X

(1.41)

23

Il momento centrale di ordine 3, adimensionalizzato con la deviazione standard è detto skewness (o

coefficiente di asimmetria). Il momento centrale di ordine 4 adimensionalizzato con la deviazione

standard è detto kurtosis (o coefficiente di piattezza).

skw X

3 X

;

3X

kurt X

4 X

4X

(1.42)

Lo skewness è generalmente indicato con il simbolo 3. Frequentemente, al valore del kurtosis

definito dalla (1.42) si sottrae 3; in questo caso modo si ottiene un valore detto coefficiente di

eccesso (o eccesso di kurtosis), generalmente indicato con il simbolo 4.

3 X

3 X

;

3X

4 X

4 X

3

4X

(1.43)

La Figura 1-25 mostra l’effetto della media e della deviazione standard sulla forma della densità di

probabilità. La media determina una traslazione della curva lungo l’asse delle ascisse, mentre la

deviazione standard controlla l’ampiezza della curva (alla quale corrisponde un abbassamento per

conservare l’area unitaria).

La Figura 1-26 mostra l’effetto di skewness e coefficiente di eccesso sulla forma della densità di

probabilità. La condizione 3 = 0 corrisponde ad una funzione simmetrica rispetto alla media; la

condizione 3 > 0 rappresenta la situazione in cui la densità di probabilità ha la coda di destra più

alta della coda di sinistra. Una variabile aleatoria avente 4 > 0 è detta supergaussiana e ha densità di

probabilità alta sulla moda (ascissa corrispondente al picco) e sulle code; una variabile aleatoria

avente 4 < 0 è detta subgaussiana e ha densità di probabilità bassa sulla moda e sulle code; il caso

4=0 corrisponde alla distribuzione Gaussiana che verrà descritta nel seguito. Per lo studio delle

code della distribuzione è generalmente conveniente diagrammare le funzioni di densità di

probabilità con ordinata in scala logaritmica, come mostrato in Figura 1-27 per i casi già discussi in

Figura 1-26.

È possibile dimostrare che il coefficiente di eccesso è inferiormente limitato a 4 = -2; tale valore è

attinto da variabili aleatorie con densità del tipo:

pX

1

1 1

2

(1.44)

Una variabile aleatoria è detta standardizzata se è centrata rispetto alla sua media e scalata in modo

da avere varianza unitaria:

X X

Xˆ

X

(1.45)

da cui ovviamente risulta Xˆ 0 e Xˆ 1 .

24

0.4

0.4

X = 0

X = 1

X = 0

X = 1

0.35

0.3

0.25

0.25

Y

p (), p ()

0.3

Y

p (), p ()

0.35

Y = 1

Y = 1

0.2

X

X

0.2

0.15

0.15

0.1

0.1

0.05

0.05

0

-4

-3

-2

-1

0

,

1

2

3

Y = 0

Y = 2

0

-6

4

-4

-2

0

,

(a)

2

4

6

(b)

Figura 1-25. Densità di probabilità: influenza della media (a) e deviazione standard (b).

0.45

3 = 0.5

4 = 0

0.4

0.7

3 = -0.5

4 = 0

3 = 0

4 = 5

0.6

3 = 0

4 = 0

Z

0.4

Y

0.25

Y

0.2

3 = 0

4 = -0.5

0.3

X

X

3 = 0

4 = 0

0.5

p (), p (), p ()

0.3

Z

p (), p (), p ()

0.35

0.15

0.2

0.1

0.1

0.05

0

-4

-3

-2

-1

0

, ,

1

2

3

0

-4

4

-3

-2

-1

(a)

0

, ,

1

2

3

4

(b)

0

10

0

10

-1

10

-1

10

-2

10

-2

10

-3

10

-3

Y

-4

X

X

Y

Z

p (), p (), p ()

10

Z

p (), p (), p ()

Figura 1-26. Densità di probabilità: influenza skewness (a) e coefficiente di eccesso (b).

-3

-2

-1

0

, ,

1

2

3

4

-4

-3

(a)

-2

-1

0

, ,

1

2

3

4

(b)

Figura 1-27. Densità di probabilità (scala logaritmica): influenza skewness (a) e coefficiente di eccesso (b).

I momenti statistici della variabile aleatoria X possono essere stimati a partire da un insieme di sue

realizzazioni xj (j = 1,…,n) attraverso un’espressione analoga alla (1.32)

mk X E X k

1 n k

xj

n j 1

(1.46)

25

1.5.7 Funzione caratteristica di una variabile aleatoria continua

Si definisce funzione caratteristica (o funzione generatrice dei momenti) della variabile aleatoria X,

la funzione a valori complessi:

X E exp i X ei pX d

(1.47)

dove l’argomento è definito in ℝ. In base alla (1.47), la funzione caratteristica è la trasformata di

Fourier della densità di probabilità, pertanto essa determina completamente la struttura

probabilistica di X.

La funzione caratteristica può essere rappresentata attraverso la serie di McLaurin:

1 dk X

k

k 1 k ! d

X X 0

k

(1.48)

0

Operando per derivazione sulla (1.47), i termini della (1.48) risultano nella forma:

X 0 1

dk

i k E X k i k mk X

k

d 0

k 1, 2,

(1.49)

che, sostituendo nella (1.48), forniscono un’espressione della funzione caratteristica in termini di

momenti statistici.

ik

m k X k

k 1 k !

X 1

(1.50)

La (1.50) dimostra che, conoscendo i momenti statistici fino all’ordine infinito, è possibile

rappresentare la funzione caratteristica e quindi la densità di probabilità. In questo senso, la

conoscenza dei momenti statistici è equivalente alla conoscenza della distribuzione di probabilità,

quindi determina completamente la struttura probabilistica della variabile aleatoria.

1.5.8 Cumulanti

Si definisce log-funzione caratteristica ΨX(θ) della variabile aleatoria X il logaritmo naturale della

funzione caratteristica ΦX(θ); tale funzione può essere espansa attraverso la serie di McLaurin come

segue:

X log X

j 1

1 d j X

j! d j

j

0

i

j X

j!

j 1

j

(1.51)

i cui coefficienti κj[X] sono detti cumulanti. I cumulanti sono legati ai momenti statistici ed ai

momenti centrali attraverso le relazioni ricorsive riportate in appendice A; tali relazioni, fino

all'ordine 4, hanno la forma:

26

1 m1

2 m 2 m12 2

(1.52)

3 m3 3m 2 m1 2 m12 3

4 m 4 3m 2 2 4 m3 m1 12 m 2 m12 6 m14 4 3 22

Si osserva che il quarto cumulante adimensionalizzato rispetto alla deviazione standard corrisponde

al coefficiente di eccesso definito in (1.43).

1.5.9 Entropia

Sia X una variabile aleatoria discreta con funzione di probabilità PX(ξj). Si definisce entropia (di

Shannon) la quantità:

H X PX j log PX j

(1.53)

j

dove la sommatoria è estesa a tutti i valori ξj che X può assumere. Considerando la funzione

f p p log p diagrammata in Figura 1-28, l'entropia può essere generalizzata nella forma:

H X f PX j

(1.54)

f(p)

j

0

0.2

0.4

0.6

0.8

1

p

Figura 1-28. Funzione f(p) nell'intervallo [0,1]

Dalla (1.54) si osserva che H è un numero non negativo ed è nullo nel caso in cui X sia

deterministica (un particolare ξj ha probabilità uno e tutti gli altri hanno probabilità zero). In

generale H è piccola se un valore ξj ha una probabilità di occorrenza dominante, mentre H è grande

se molti valori ξj hanno probabilità di occorrenza comparabile.

In termini qualitativi, l'entropia misura il grado di "aleatorietà" di una variabile aleatoria o, in

termini più corretti, specifica quanto una variabile aleatoria è strutturata.

In teoria dell'informazione l'entropia è utilizzata per quantificare il contenuto di informazione di un

canale digitale.

Sia ora X una v.a. continua; si definisce entropia (differenziale) la quantità:

H X pX log pX d

(1.55)

27

dove l'integrazione è estesa all'intero dominio di definizione di pX. A differenza dell'entropia di

Shannon, l'entropia integrale può assumere valori negativi (dato che la funzione densità di

probabilità può essere maggiore di uno); da un punto di vista qualitativo possiede il medesimo

significato.

1.5.10 Trasformazioni lineari di variabili aleatorie

Sia X una variabile aleatoria continua e Y una sua trasformazione lineare tale che Y = aX + b con

a, b . Le rispettive distribuzioni di probabilità sono legate dalla relazione

b

b

FY PY Y PY aX b PX X

FX

a

a

(1.56)

Segue che le densità di probabilità sono legate dalla relazione

pY

dFY 1 dFX

1

b

pX

d

a d b a

a

(1.57)

a

Le funzioni caratteristiche di X e Y ed i loro logaritmi sono legate dalle relazioni

Y E exp i Y E exp i aX b

E exp i aX exp i b X a exp i b

Y log Y X a ib

(1.58)

(1.59)

Dalla (1.59) segue che i cumulanti delle due variabili aleatorie X e Y sono legati nel seguente modo

1 Y a1 X b

j Y a j j X

j2

(1.60)

Nel caso particolare in cui b = 0 la (1.60) vale anche per i momenti e assume la forma

m j aX a j m j X

j aX a j j X

(1.61)

La (1.61) dimostra che momenti e cumulanti di ordine j sono operatori omogenei di grado j.

Infine l'entropia di X e Y si relazionano nel seguente modo

H Y pY log pY d

1

X b 1

X b

pX

log p X

d

a

a a

a

(1.62)

1

p X log p X d

a

H X log a

28

da cui si deduce che l'entropia aumenta con la scala a ed è invariante rispetto alla posizione. In altri

termini, fissata la forma della distribuzione di probabilità, l'entropia cresce all'aumentare della

varianza ed è invariante rispetto al valor medio.

1.5.11 Trasformazioni non lineari di variabili aleatorie

Sia X una variabile aleatoria continua e Y = g(X) con g funzione monotona crescente. La funzione di

distribuzione FY può essere relazionata a FX imponendo che P Y sia pari a P X g 1

dove g-1 è la funzione inversa di g (Figura 1-29).

Figura 1-29.

Da questa uguaglianza discende la relazione:

FY FX g 1

(1.63)

che in termini di densità di probabilità risulta:

dFY dFX

dg 1

dg 1

1

pY

p X g

d

d g 1 d

d

(1.64)

Se la funzione g è monotona decrescente la relazione che lega FX e FY può essere ricavata

eguagliando P Y e P X g 1 (Figura 1-30).

Figura 1-30.

Da questa uguaglianza discendono le relazioni

29

FY 1 FX g 1

pY p X g 1

dg 1

d

(1.65)

Le (1.65) possono essere unificate per comprendere sia il caso di funzione crescente che

decrescente attraverso la relazione:

pY p X g 1

dg 1

d

(1.66)

Le entropie di X e Y sono legate dalla relazione

H Y pY log pY d

pX g

1

dg 1

dg 1

1

log p X g

d

d

d

dg 1

p X log p X

d

d

g

dg

H X p X log

d

(1.67)

d

L'integranda nella (1.67) fornisce un contributo positivo all'entropia per i valori di ξ per cui

dg d 1 , mentre fornisce un contributo negativo quando dg d 1 . Questo effetto è pesato

dalla densità di probabilità pX.

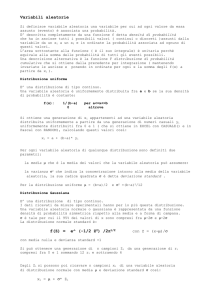

1.6 Modelli di variabili aleatorie

Nel presente capitolo si introducono alcuni modelli probabilistici rilevanti per lo studio della

meccanica delle vibrazioni e dell’affidabilità strutturale. Il modello normale (o Gaussiano) è

descritto con maggiore enfasi in virtù delle sue caratteristiche probabilistiche e della sua importanza

applicativa.

1.6.1 Distribuzione normale (o Gaussiana)

Una variabile aleatoria X ha distribuzione normale (o Gaussiana) se la sua densità di probabilità è

nella forma:

2

1

1 X

pX

exp

2 X

2 X

(1.68)

Una variabile aleatoria X, con distribuzione normale X e varianza X2 è formalmente definita

attraverso l’espressione X = N(X, X2). La Figura 1-31 mostra la densità di probabilità di una

variabile aleatoria normale standardizzata; nel piano semilogaritmico la curva è costituita da una

parabola.

30

0

0.4

10

0.35

-1

0.3

10

pX()

pX()

0.25

0.2

-2

10

0.15

-3

0.1

10

0.05

0

-4

-4

-3

-2

-1

0

1

2

3

10

4

-4

-3

-2

-1

0

(a)

1

2

3

4

(b)

Figura 1-31. Densità di probabilità normale: ordinata in scala decimale (a) e logaritmica (b).

La distribuzione di probabilità è data dall’espressione:

1

FX

2 X

1 2

exp 2 X X d

(1.69)

che può essere scritta in forma analitica attraverso la funzione di errore

X

1

FX 1 erf

2

X

(1.70)

Per ispezione della (1.68) è immediato verificare che se Y = aX + b, con a e b costanti

deterministiche e X = N(X, X2), allora Y = N(aX + b, a2X2).

La funzione caratteristica di una variabile Gaussiana può essere ottenuta calcolando la trasformata

di Fourier della (1.68) e risulta:

1

X exp i X 2X 2

2

(1.71)

Se X è una variabile aleatoria Gaussiana standardizzata, X = N(0,1), allora densità di probabilità e

distribuzione di probabilità risultano:

1

1

exp 2

2

2

2

1

1

FX

exp

d 1 erf

2

2

2

1

X exp 2

2

pX

(1.72)

(1.73)

(1.74)

Si osserva che la funzione caratteristica di una variabile Gaussiana standardizzata è formalmente

identica alla corrispondente funzione densità di probabilità.

1.6.2 Distribuzione uniforme

Una variabile aleatoria continua ha distribuzione uniforme se la sua densità di probabilità è espresso

nella forma:

31

1/ b a

pX

0

per a b

altrove

a b

(1.75)

Il modello uniforme è utilizzato quando una variabile aleatoria può assumere valori equiprobabili in

un intervallo chiuso [a, b]. La funzione di distribuzione può essere ottenuta dalla (1.75) per

integrazione e risulta:

per a

per a b

0

FX a / b a

1

(1.76)

per b

La media e la varianza di una variabile aleatoria uniforme risultano:

X a b / 2

(1.77)

2X b a /12

(1.78)

FX()

pX()

2

1/(b-a)

0

0

a

1

0

b

0

a

b

Figura 1-32. Densità e distribuzione di probabilità di una variabile aleatoria uniforme.

1.6.3 Modello log-normale

Una variabile aleatoria X è della log-normale se Y = log(X) ha distribuzione normale. La densità di

probabilità di una variabile log-normale è espressa nella forma:

log m 2

1

pX

exp

2

2

s

2 s

(1.79)

dove m e s sono i parametri della distribuzione (e rappresentano, rispettivamente, la media e la

deviazione standard di Y). La media e la varianza di X risultano:

s2

X exp m

2

exp 2m s exp s 1

2

X

2

(1.80)

2

32

0.25

1

0.9

0.2

0.8

0.7

0.6

pX()

FX()

0.15

0.1

0.5

0.4

0.3

0.05

0.2

0.1

0

0

2

4

6

8

10

12

14

16

18

0

20

0

2

4

6

8

10

12

14

16

18

20

Figura 1-33. Densità e distribuzione di probabilità di una variabile aleatoria log-normale (m = 1, s = 1).

1.6.4 Modello di Rayleigh

Una variabile aleatoria X è detta di Rayleigh se ha densità di probabilità nella forma:

pX

2

exp

2

b2

2b

(1.81)

dove b è il parametro della distribuzione.

0.7

1

0.9

0.6

0.8

0.5

0.7

0.6

pX()

FX()

0.4

0.3

0.5

0.4

0.3

0.2

0.2

0.1

0.1

0

0

0.5

1

1.5

2

2.5

3

3.5

4

4.5

5

0

0

0.5

1

1.5

2

2.5

3

3.5

4

4.5

5

Figura 1-34. Densità e distribuzione di probabilità di una variabile aleatoria di Rayleigh (b = 1).

1.6.5 Modello di binomiale

Si consideri una successione di variabili aleatorie discrete, Xk (k = 1,2,…), aventi spazio

campionario Ω = {0, 1}. Si assuma che gli eventi legati a ogni possibile coppia di variabili aleatorie

Xh e Xk (h,k = 1,2,…; hk) siano statisticamente indipendenti; sia inoltre P(Xk = 1) = p.

La successione Xk è detta sequenza di Bernoulli. La funzione di probabilità di una variabile aleatoria

di Bernoulli risulta dunque:

PX k 0 P X k 0 1 p

PX k 1 P X k 1 p

(1.82)

Sia Ym una variabile aleatoria discreta definita come la somma dei primi m termini di una sequenza

di Bernoulli (Figura 1-35):

33

m

Ym X k

(1.83)

k 1

9

8

7

Xk, Yk

6

5

4

3

2

1

0

0

5

10

15

k

20

25

30

Figura 1-35. Sequenza di Bernoulli (blu) e corrispondente sequenza binomiale (rosso).

La funzione di probabilità di Ym può essere ottenuta operando in modo ricorsivo. Per m=1, la

funzione di probabilità di Ym = Y1 risulta:

PY1 0 P Y1 0 P X 1 0 1 p

PY1 1 P Y1 1 P X 1 1 p

(1.84)

Analogamente, per m=2, la funzione di probabilità di Ym = Y2 risulta (per il teorema dell’evento

totale e per l’ipotesi di indipendenza statistica fra le variabili di Bernoulli):

PY2 0 P Y2 0 P X 1 0 X 2 0 1 p

2

PY2 1 P Y2 1 P X 1 1 X 2 0 X 1 0 X 2 1 2 p 1 p

(1.85)

PY2 2 P Y2 2 P X 1 1 X 2 1 p 2

Le (1.84) e (1.85) possono essere generalizzate, per un m qualsiasi in , attraverso l’espressione:

m

m

PYm P Ym p 1 p

(1.86)

dove il binomio di Newton è espresso nella forma:

m

m!

! m !

(1.87)

Sostituendo la (1.86) nell’espressione di media e varianza risulta:

Ym mp

Y2m mp 1 p

(1.88)

34

da cui si evince che la media e la varianza di una variabile binomiale sono lineari in m.

Esempio 1.12. Sequenze di Bernoulli e variabili binomiali

Il codice riportato in Figura 1-36 simula una serie di sequenze di Bernoulli di lunghezza n e

la variabile Binomiale Ym ottenuta per m = n. La stima di media (Figura 1-37a), varianza

(Figura 1-37b) e funzione di probabilità (Figura 1-38) è effettuata applicando la definizione

frequentista di probabilità. I risultati della stima sono confrontati con quanto previsto dal

modello binomiale.

Nseq = 10000;

% numero realizzazioni

n = 30;

p = 0.2;

% numero esperimenti di Bernoulli

% prob. di successo esperimenti di Bernoulli

X = rand(n,Nseq) >= (1-p);

Y = cumsum(X);

% sequenza di Bernoulli

% sequenza binomiale

m = n;

% considero m = n esperimenti

% stima funzione di probabilità dai dati

[PY_data, eta_data] = pf1(Y(m,:));

% modello binomiale

eta = 0:m;

% ascissa per PY

PY_bi = factorial(m)./factorial(eta)./factorial(m-eta) .* (p.^eta) .* ((1p).^(m-eta));

figure(1)

plot(1:n,mean(Y,2),'--.b', 1:n,(1:n)*p,'-r')

xlabel('m')

ylabel('\mu_{Y_m}')

figure(2)

plot(1:n,var(Y,[],2),'--.b', 1:n,(1:n)*(1-p)*p,'-r')

xlabel('m')

ylabel('\sigma^2_{Y_m}')

figure(3)

bar(eta_data,PY_data)

hold on

plot(eta, PY_bi,'-*r')

hold off

xlabel('\eta')

ylabel('p_{Y_m(\eta)}')

xlim([0 20])

Figura 1-36. Codice Matlab per simulazione di sequenze di Bernoulli e binomiali; stima di

media, varianza e funzione di probabilità della variabile binomiale.

6

5

4.5

5

4

3.5

4

m

2Y

Y

m

3

3

2.5

2

2

1.5

1

1

0.5

0

0

5

10

15

m

20

25

0

30

(a)

0

5

10

15

m

20

25

30

(b)

Figura 1-37. Media (a) e varianza (b) della variabile binomiale simulata nel codice di Figura

1-36: stima dai dati (blu), modello (rosso).

35

0.2

0.18

0.16

0.14

pY ()

m

0.12

0.1

0.08

0.06

0.04

0.02

0

0

2

4

6

8

10

12

14

16

18

20

Figura 1-38. Funzione di probabilità della variabile binomiale simulata nel codice di Figura

1-36: stima dai dati (blu), modello (rosso).

1.6.6 Modello di Poisson

Una variabile aleatoria discrete Y ha distribuzione di Poisson se la sua funzione di probabilità è

nella forma:

PY

exp

!

0,1,

(1.89)

Dalla (1.89) risulta, evidentemente, che PY(0) = e-; inoltre Y = Y2 = . Al variare del parametro ,

la funzione di probabilità assume le forme mostrate in Figura 1-39.

0.5

0.45

= 0.7

0.4

0.35

PY ()

0.3

= 2.5

0.25

0.2

= 5.0

0.15

0.1

0.05

0

0

2

4

6

8

10

12

Figura 1-39. Funzione di probabilità di una variabile di Poisson al variare del parametro .

Una variabile aleatoria di Poisson, Y, può essere interpretata come il limite, per m , di una

sequenza binomiale Ym derivata da una sequenza di Bernoulli Xk avente probabilità di successo

p0. In tal caso la variabile Y è definita dal parametro = mp.

36

La Figura 1-39 mostra la funzione di probabilità di tre variabili aleatorie binomiali definite,

rispettivamente, dai parametri m = 10, 20 e 100 e p = 0.50, 0.25, 0.05 (blu) e di una variabile

aleatoria di Poisson definita dal parametro = 5.

0.25

m = 10

PYm(), P Y ()

0.2

m = 20

m = 100

0.15

0.1

0.05

0

0

1

2

3

4

5

6

7

8

9

10

Figura 1-40. Convergenza di variabili binomiali (blu) a una variabile di Poisson (rosso).

1.7 Rappresentazioni approssimate della densità di probabilità

Si affronta il problema di definire un'approssimazione della densità di probabilità di una variabile

aleatoria sulla base di limitate informazioni sintetiche, come ad esempio un numero finito di

momenti statistici e cumulanti.

1.7.1 Espansione in serie di funzioni ortogonali

Sia X una variabile aleatoria continua e X la sua versione standardizzata; pX e pX sono le

rispettive densità di probabilità. Sia inoltre pG la densità di probabilità di una variabile

Gaussiana standardizzata, ovvero

1 2

pG

e

2

2

(1.90)

Se pX ha le code sufficientemente basse (è sufficiente che pX

serie di funzioni ortogonali è uniformemente convergente in :

pX

pG

a j j

(1.91)

j 0

dove Ψj son un insieme di funzioni ortogonali in

j

pG L2 ), allora la seguente

che può essere definito come segue:

1

H j pG

j!

(1.92)

in cui Hj(ξ) sono polinomi di Hermite (Appendice B).

Le funzioni definite in (1.92) sono ortonormali in

, cioè:

d

j

k

jk

(1.93)

37

Sfruttando la (1.93), i coefficienti aj della serie (1.91) possono essere valutati attraverso la

relazione:

aj

p Xˆ

pG

j d

1

pX H j d

j!

1

E H j Xˆ

j!

(1.94)

I coefficienti della serie (1.91) sono proporzionali al valore atteso dei polinomi di Hermite in X̂ .

Sostituendo la (1.92) e la (1.94) nella (1.91), pX̂ assume la forma:

1

pXˆ pG b j H j

j 1 j !

(1.95)

dove i coefficienti

bj

j ! a j E H j Xˆ

(1.96)

sono detti momenti di Hermite o quasi-momenti.

I primi momenti di Hermite hanno la forma:

b0 1

b1 E Xˆ 0

b2 E Xˆ 2 1 0

(1.97)

b3 E Xˆ 3 3 Xˆ 3 Xˆ 3 X

b4 E Xˆ 4 6 Xˆ 2 3 4 Xˆ 4 X

In generale i momenti di Hermite sono legati ai cumulanti dalla relazione ricorsiva:

j 1!

k j r br

r 3 r ! j r 1 !

j 3

bj k j

(1.98)

Nota la densità di probabilità della variabile standardizzata X̂ , pX(ξ) può essere calcolata attraverso

la (1.57)

pG

1

pX

bj H j

j 1 j !

(1.99)

dove μ e σ sono la media e la deviazione standard di X. La (1.99) è chiamata serie di Gram-Charlier

tipo A.

1.7.2 Principio di massima entropia

Si suppongo di conoscere la variabile aleatoria X attraverso le grandezze

38

c j pX Fj d E Fj X

j 1,..., n

(1.100)

dove Fj sono funzioni arbitrarie tali da far convergere l'integrale nella (1.100). La conoscenza di un

numero finito di cj non permette di stimare il valore esatto di pX . Tuttavia se p0(ξ) è la densità

di probabilità compatibile con il vincolo (1.100) che massimizza l'entropia di X, allora p0

rappresenta la v.a. compatibile con i vincoli meno strutturata possibile. In altre parole, il principio di

massima entropia fornisce una densità di probabilità, compatibile con i dati, facendo meno

assunzioni possibili sulla sua struttura. La densità di probabilità che soddisfa il principio di massima

entropia è nella forma:

n

p0 A exp a j Fj

j 0

(1.101)

dove A e aj sono costanti determinate imponendo le (1.100) e la condizione di normalizzazione.

Se si sceglie Fj(ξ) = Hj(ξ), la (1.101) riscritta per la variabile standardizzata X̂ , è chiamata serie di

Gram-Charler tipo C e assume la forma

n

pXˆ A exp j H j

j 0

(1.102)

dove γj sono costanti da determinare. A tale scopo, si considera una funzione f(ξ) che cresce per

|ξ|→∞ più lentamente di un'esponenziale. Sotto questa ipotesi sussiste la relazione

f dpXˆ

p df 0

Xˆ

(1.103)

che può essere facilmente dimostrata attraverso la formula di integrazione per parti. Scegliendo

f Hi 1 , sostituendo la (1.102) nella (1.103) e sfruttando le proprietà dei polinomi di

Hermite (Appendice B) risulta:

n

j

j 1

j

H i 1 H j 1 pXˆ d i 1 H i 2 p Xˆ d 0