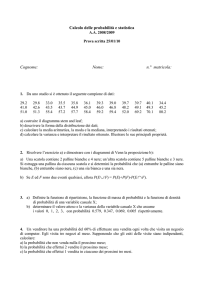

STATISTICA

Insieme delle tecniche per la raccolta e l'elaborazione dei dati

al fine di estrarre da essi delle informazioni

CONTENUTI

raccolta dei dati

elaborazione numerica delle informazioni

presentazione dei risultati

FINALITÀ

trarre conclusioni sull'intera popolazione, anche quando si

conoscono solamente i dati di uno o più campioni

agevolare l'analisi e i processi decisionali

COMPONENTI

STATISTICA DESCRITTIVA: insieme dei metodi per la raccolta dei

dati, la loro organizzazione in tabelle e grafici e la loro

sintesi mediante appositi indici che ne descrivono le

caratteristiche essenziali

STATISTICA INFERENZIALE: insieme dei metodi per elaborare i

dati e dedurre delle conclusioni che vanno oltre la diretta

evidenza dei dati. Più precisamente dalla conoscenza di uno o

più campioni estratti dalla popolazione vogliamo risalire alle

caratteristiche

della

popolazione

stessa.

Ad

esempio:

supponiamo di voler conoscere la velocità d'accrescimento

somatico di una determinata specie animale o vegetale; è ovvio

che non è possibile prendere tutti gli individui esistenti di

quella specie, ma solamente alcuni di essi (un campione).

Tuttavia le conclusioni devono non essere limitate ai pochi

casi

del

campione

utilizzato,

ma

estese

a

tutta

la

popolazione, per rivestire una effettiva importanza generale e

contribuire alla costruzione di teorie scientifiche.

TERMINOLOGIA

INSIEME: collezione di qualsiasi tipo di oggetti (individui,

animali, piante, risposte, sintomi,..)

VARIABILE: entità logica che può assumere vari valori i quali

costituiscono l'insieme. Generalmente X, Y, Z, T, indicano delle

variabili; x1, x2, indicano i valori assunti dalla variabile X;

y1, y2, indicano i valori assunti dalla variabile Y e così anche

per le altre variabili; ci sono due tipi di variabile:

VARIABILE QUALITATIVA: essa generalmente è classificata in

categorie (colore di una roccia, forma di una foglia,

gruppo sanguigno)

VARIABILE QUANTITATIVA: essa è espressa tramite un valore

numerico. VARIABILE DISCRETA: essa può assumere solamente

1

dei valori isolati (numero di figli per famiglia, numero di

alberi per Km2); VARIABILE CONTINUA: essa può assumere tutti

i valori in un dato intervallo (peso, altezza, livello di

pressione)

POPOLAZIONE: insieme di tutti i possibili oggetti osservabili

(individui = oggetti)

CAMPIONE: sottoinsieme finito della popolazione con cui si

lavora realmente

FREQUENZE: denotando con X la variabile che descrive i vari

oggetti in un insieme e supponendo che essa assume un dato

valore xi (qualitativo o quantitativo) un certo numero di volte

fi , allora fi è detto FREQUENZA ASSOLUTA di xi . Siano x1, x2, , xr i

valori distinti assunti da X e siano f1, f2, , fr le corrispondenti

frequenze assolute, allora:

r

n f i f1 f 2 f r

i 1

indica il numero totale di oggetti nell'insieme (nel caso che

l'insieme considerato sia un campione n è detto DIMENSIONE DEL

CAMPIONE); inoltre pi =fi / n

è detta FREQUENZA RELATIVA o

PROPORZIONE di xi. Si osserva che: p1+ p2+ + pn=1.

ESEMPIO: in tutta la popolazione del numero di figli per

famiglia in una certa zona geografica si estrae il seguente

campione: 1,0,2,2,4,1,1,3. Le osservazioni distinte sono: x1=0, x2=1,

x3=2, x4=3, x5=4; le frequenze assolute sono: f1=1, f2=3, f3=2, f4=1, f5=1;

le frequenze relative: p1=1/8, p2=3/8, p3=1/4, p4=1/8, p5=1/8.

FASI DELL'INDAGINE STATISTICA

1. disegno sperimentale: programmazione di ricerche statistiche;

in questa fase frequentemente sorgono dei problemi tecnici,

amministrativi ed etici. Per quanto riguarda la statistica si

deve considerare due aspetti:

le inferenze deducibili devono essere sufficientemente

precise

i risultati devono essere pertinenti alle domande formulate

Ci sono due tipi di indagine:

ESPERIMENTO

INCHIESTA

L'indagine statistica deve essere programmata in funzione dello

scopo per cui è fatta:

stimare certe caratteristiche della popolazione

indagare sull'associazione tra certe caratteristiche della

popolazione

confronto dell'efficacia tra diversi metodi sperimentali

2

2. campionamento: raccolta dei dati relativi ad una popolazione

eseguita con precise modalità. Essa può essere fatta in vari

modi:

CAMPIONAMENTO CASUALE SEMPLICE: ogni individuo o oggetto di

una popolazione ha la stessa probabilità di entrare nel

campione

CAMPIONAMENTO PROPORZIONALE o STRATIFICATO: la popolazione è

suddivisa in vari sottoinsiemi costituiti da individui

aventi una stessa caratteristica che si ritiene rilevante ai

fini dell'indagine da eseguire. La proporzione di individui

nei vari sottoinsiemi della popolazione e la corrispondenti

proporzione nel campione devono essere uguale

CAMPIONAMENTO A PIÙ STADI: per comodità la popolazione è

suddivisa in varie unità di primo stadio" tra cui scegliere

il campione; ogni unità di primo stadio selezionata è

suddivisa in varie unità di secondo stadio" tra cui

scegliere il campione e così per tutte le volte che si

ritiene necessario.

3. descrizione dei dati raccolti: acquisizione delle prime

informazioni dai dati raccolti; a volte questa fase è fine a se

stessa a volte essa è preliminare alla fase di inferenza

statistica; generalmente tale fase consiste nelle seguenti

operazioni:

organizzare i dati in tabelle e grafici

calcolare indici sintetici che descrivono quantitativamente

alcune caratteristiche dei dati

In questa fase si può anche verificare l'adeguatezza: del

disegno sperimentale e del campionamento.

4. utilizzo dei tests: processo logico - matematico che porta alla

deduzione delle caratteristiche della popolazione.

3

STATISTICA DESCRITTIVA

TIPI DI DATI - SCALE DI MISURA

A proprietà formali differenti dei dati (che di conseguenza

consentono operazioni differenti) sono associati differenti TIPI

DI SCALE DI MISURA:

Scala nominale (o classificatoria)

livello più basso di informazione

utilizzata quando i dati possono essere raggruppati in

categorie, le quali sono identificate con simboli; gli

individui

attribuiti

a

classi

diverse

sono

tra

loro

differenti;

quelli

della

stessa

classe

sono

tra

loro

equivalenti

rispetto

alla

proprietà

utilizzata

nella

classificazione

l'attribuzione di numeri per identificare le varie categorie

nominali (es.: i giocatori di squadre) non autorizza ad

elaborare quei numeri come tali

Scala ordinale (o per ranghi)

contiene

una

quantità

di

informazione

superiore

alla

precedente

alla proprietà di equivalenza tra gli individui della stessa

classe si aggiunge quella di gradazione tra le classi (es.: un

reagente colora una serie di provette secondo la quantità di

sostanza analizzata contenuta, consentendo di ordinare le

provette in base all'intensità del colore)

le risposte, apparentemente definite a livello nominale,

possono venire espresse su scala ordinale (es.: giovane,

adulto, anziano; insufficiente, sufficiente, discreto, buono,

ottimo)

eventuali rappresentazioni simboliche (es.: --, -, =, +, ++)

impossibilità di valutare la distanza tra livelli (es.: tra

insufficiente e sufficiente c'è una distanza diversa che tra

buono ed ottimo?)

Scala di intervalli

alle due caratteristiche della scala ordinale si aggiunge

quella di poter misurare le distanze tra tutte le coppie di

osservazioni

si fonda su una misura oggettiva e costante, anche se punto di

origine e unità di misura sono arbitrari (es.: la temperatura

misurata in gradi Celsius o Fahrenheit, i calendari)

4

solo le differenze possono essere manipolate quantitativamente

ESEMPIO: le misure della temperatura possono essere facilmente

ordinate e le differenze tra loro sono direttamente confrontabili

e quantificabili; ma una temperatura di 40 gradi non è il doppio

di una di 20 gradi rispetto allo zero assoluto.

Scala di rapporti

alle tre proprietà della scala precedente aggiunge quella ad

avere una origine naturale

è il tipo di misurazione più sofisticato e completo (es.:

altezza, distanza, età, peso, reddito procapite)

non solo le differenze ma gli stessi valori possono essere

moltiplicati o divisi per quantità costanti senza che

l'informazione ne risulti alterata

0 (zero) significa quantità nulla (a differenza di quanto

avviene per esempio con la temperatura di 0 (zero) gradi

Celsius)

CLASSIFICAZIONE IN TABELLE

Prima di qualunque elaborazione, una serie di dati va organizzata

e sintetizzata in DISTRIBUZIONE DI FREQUENZA (o di INTENSITÀ)

poiché una serie non ordinata non permette quasi mai di

evidenziare le caratteristiche del fenomeno in esame.

DATI QUALITATIVI

ESEMPIO (scala nominale): gruppi sanguigni di un campione estratto

da una certa popolazione:

gruppo

frequenza

A

60

B

16

AB

7

0

66

totale

149

Tab.1 frequenza dei gruppi sanguigni nel campione prescelto

5

ESEMPIO (scala ordinale): valutazioni riportate dagli studenti di

due corsi all'esame di genetica (è preferibile avere le

osservazioni ordinate in senso crescente o decrescente):

valutazione

Corso 1

Corso 2

insufficiente

35

25

sufficiente

35

30

buono

20

15

ottimo

10

5

totale

101

77

Tab.2 frequenza delle valutazioni riportate nel Corso 1 e nel Corso 2 all'esame di genetica

DATI QUANTITATIVI

DATI DISCRETI

Definire le classi:

a) identificare il valore minimo (0 nell'esempio) e quello

massimo (9 nell'esempio), contando quante volte compare ogni

variabile si ottiene la frequenza assoluta fi

b) dalla frequenza assoluta fi si calcola la frequenza relativa pi

formata dal rapporto tra la frequenza assoluta fi ed il numero

totale di casi n; essa è utile soprattutto quando si vogliono

confrontare due o più distribuzioni dello stesso fenomeno

aventi numero differente di osservazioni

Nella organizzazione dei dati discreti è preferibile definire una

classe per ogni valore osservato, a volte questo può portare ad

avere un numero elevato di classi.

Quante classi di frequenza costruire? Da un minimo di 4-5 ad un

massimo di 15-20 (prassi abituale) in funzione del numero

complessivo di osservazioni. Infatti:

se il numero di classi è troppo basso: perdita d'informazione

sulle caratteristiche della distribuzione e la rende non

significativa

se il numero di classi è troppo alto: disperde i valori e non

manifesta con evidenza la forma della distribuzione

ESEMPIO: conteggio del numero di foglie (variabile discreta)

spuntate su 45 rami di uguale lunghezza di una pianta in un dato

intervallo di tempo:

5 6 3 4 7 2 3 2 3 2 6 4 3 9 3

2 0 3 3 4 6 5 4 2 3 6 7 3 4 2

5 1 3 4 3 7 0 2 1 3 1 5 0 4 5

6

Distribuzione di frequenze assolute e relative (arrotondate) delle

foglie di 45 rami:

classe(xi)

0

1

2

3

4

5

6

7

8

9

freq.assol.(fi) freq.rel.(pi) freq.cumulata

3

3

7

12

7

5

4

3

0

1

45

0,0667

0,0667

0,1556

0,2667

0,1556

0,1111

0,0889

0,0667

0,0000

0,0222

1

0,0667

0,1333

0,2889

0,5556

0,7111

0,8222

0,9111

0,9778

0,9778

1,0000

Tab.3 distribuzione di frequenza del numero di foglie

DATI CONTINUI

PROCEDURA:

a) individuare il valore minimo e massimo (=64cm e 198cm)

b) stabilire l'intervallo di variazione (=140cm, da 60 cm a

199cm compresi), che ovviamente deve comprendere l'intero

campo di variazione (=134cm, da 64 cm a 198cm compresi)

c) sulla base di n(=40) si decide il numero di classi (nel caso

specifico potrebbero essere 7, con passo 20cm=140cm/7)

Avvertenze:

definire con precisione il valore minimo e quello massimo di

ogni classe, per evitare incertezze nell'attribuzione di un

singolo dato tra due classi contigue

la determinazione dei valori estremi, del numero di classi e

dell'intervallo di ogni classe è soggettiva; tale scelta può

tradursi in una rappresentazione completamente diversa dei

dati, generalmente per piccoli campioni gli effetti delle

scelte sono maggiori rispetto agli effetti su grandi campioni

la classe iniziale e terminale non devono essere aperte (ad

esempio < 80cm quella iniziale; < 180cm quella finale),

poiché:

si perderebbe l'informazione del loro valore minimo e

massimo e quindi del valore centrale (indispensabili per

calcolare la media e gli altri parametri da essa derivati)

verrebbe

impedita

o

resa

soggettiva

anche

la

rappresentazione grafica, per la quale è indispensabile

conoscere i valori iniziale e terminale

N.B.: non è necessario costruire intervalli uguali; ma la loro

rappresentazione grafica ed il calcolo dei parametri fondamentali

esigono alcune avvertenze non sempre intuitive

7

ESEMPIO (raggruppamento in classi di una variabile continua):

altezza (cm) di 40 piante (misure eseguite per arrotondamento):

98 111 119 130

107 83 100 128

130 120 108 95

163 152 104 119

170

143

192

161

143

127

124

178

156

117

129

135

126

125

143

146

113

64

198

158

127

119

131

176

Distribuzione di frequenza assoluta e relativa (%) dell'altezza

delle 40 piante:

classe val.cent.(xi)

60-79

69,5

80-99

89,5

100-119

109,5

120-139

129,5

140-159

149,5

160-179

169,5

180-199

189,5

freq.assol.(fi) freq.rel.(pi) freq.cumulata

1

0,025

0,025

3

0,075

0,1

10

0,25

0,35

12

0,3

0,65

7

0,175

0,825

5

0,125

0,95

2

0,05

1

40

1

Tab.4 distribuzione di frequenza dell'altezza delle piante

OSSERVAZIONI

Rispetto all'elenco grezzo, la tabella di distribuzione

frequenze fornisce diversi vantaggi:

informazione sulla tendenza centrale

informazione sulla variabilità

informazione sulla forma: simmetria, curtosi

delle

e uno svantaggio:

distruzione di informazione riguardo la distribuzione dei dati

all'interno di ogni classe (per questa ragione, quando è

richiesta la conoscenza di tutti i dati compresi in un

particolare intervallo, viene usato il valore centrale di ogni

classe)

CALCOLO DEL VALORE CENTRALE: esso è calcolato tramite i limiti

veri della classe, questi ultimi devono essere calcolati in

funzione del metodo di misurazione adottato:

ARROTONDAMENTO (esempio: viene misurata una altezza pari a

74cm per tutte le piante che sono alte da un minimo di 73.5 cm

ad un massimo di 74.5cm): la classe 80-99 ha limiti veri 79.599.5 e un valore centrale pari a (79.5+99.5)/2=89.5

TRONCAMENTO (esempio: viene misurata una altezza pari a 74cm

per tutte le piante che sono alte da un minimo di 74cm,

incluso, ad un massimo di 75cm, escluso): la classe 80-99 ha

limiti veri 80-100 e un valore centrale pari a (80+100)/2=90

8

N.B.: le distribuzioni delle frequenze relative o percentuali sono

indispensabili quando si confrontano due o più gruppi di misure,

che presentano lo stesso numero di osservazioni

RAPPRESENTAZIONI GRAFICHE

Le rappresentazioni grafiche forniscono:

una sintesi visiva delle caratteristiche fondamentali delle

distribuzioni

impressioni percepite con maggiore facilità

meno particolari

una

descrizione

espressa

mediante

una

interpretazione

soggettiva

DATI QUALITATIVI

GRAFICI A COLONNE O GRAFICI A NASTRI

Per ciascuna classe si disegna un rettangolo di lunghezza

proporzionale alla frequenza e larghezza arbitraria, i rettangoli

sono disgiunti.

Per tabelle a più entrate si possono considerare grafici a nastri

o a colonne suddivise o raggruppate.

Consideriamo la tabella Tab.1:

70

60

50

fi 40

30

20

10

0

A

B

AB

gruppo sanguigno

9

0

Consideriamo la tabella Tab.2 (tabella a due entrate)

Colonne raggruppate:

40

35

30

25

fi

20

15

10

5

0

Corso 1

Corso 2

insuf

suf

buono

ottimo

valutazione

Colonne suddivise:

70

60

50

fi 40

30

20

10

0

Corso 2

Corso 1

insuf

suf

buono

valutazione

10

ottimo

AREOGRAMMI A TORTA (o CIRCOLARI)

E' un cerchio suddiviso in settori circolari la cui area è

proporzionale alla frequenza della classi; il generico settore che

rappresenta una classe di frequenza fi è descritto da un angolo ai,

dove:

ai:360°= fi : n

Consideriamo la tabella Tab.1:

A

B

AB

0

DATI QUANTITATIVI

DATI DISCRETI

GRAFICI A COLONNE O GRAFICI A NASTRI

Rappresentazione di dati in distribuzioni di frequenza assoluta (o

relativa o percentuale) non raggruppati. Si costruiscono allo

stesso modo dei grafici per dati quantitativi.

Consideriamo la tabella Tab.3:

14

12

10

fi 8

6

4

2

0

0

1

2

3

4

5

6

numero foglie

11

7

8

9

DATI CONTINUI

I grafici più

di FREQUENZA,

raggruppati in

relativa, o di

comunemente usati sono gli ISTOGRAMMI e i POLIGONI

essi servono per rappresentare dati quantitativi

distribuzioni di frequenza assoluta, o di frequenza

percentuali.

ISTOGRAMMI

Grafici a rettangoli verticali, i rettangoli vengono costruiti in

corrispondenza degli estremi di ciascuna classe. La variabile

relativa alle osservazioni è riportata lungo l'asse delle ascisse,

mentre sull'asse delle ordinate si rappresenta la densità di

frequenza assoluta Fi=fi / ampiezza classe (o la densità di frequenza

relativa Pi=pi / ampiezza classe) delle classi.

Gli

istogrammi sono rappresentazioni grafiche di tipo areale:

ogni classe è rappresentata da un singolo rettangolo

area del rettangolo proporzionale alla frequenza della classe

base del rettangolo proporzionale all'ampiezza della classe

(per distribuzioni di frequenza con classi di ampiezza uguale

ragionare in termini di altezze o di aree è equivalente)

Consideriamo la tabella Tab.4:

0,7

0,6

0,5

Fi 0,4

0,3

0,2

0,1

0

69,5

89,5

109,5

129,5

149,5

altezza piante

12

169,5

189,5

Fusione errata di due classi:

0,7

0,6

0,5

Fi 0,4

0,3

0,2

0,1

0

69,5

89,5

109,5

129,5

149,5

169,5

189,5

169,5

189,5

altezza piante

Fusione esatta di due classi:

0,7

0,6

0,5

Fi 0,4

0,3

0,2

0,1

0

69,5

89,5

109,5

129,5

149,5

altezza piante

POLIGONI DI FREQUENZA

Essi possono essere ottenuti unendo con una spezzata i punti

centrali di ogni classe del corrispondente istogramma. Sull'asse

delle ascisse viene rappresenta la variabile relativa alle

osservazioni, sull'asse delle ordinate viene rappresenta la

densità della frequenza assoluta (o della frequenza relativa o

della percentuale di ogni classe). La spezzata è unita all'asse

orizzontale all'inizio e alla fine (il valore centrale della 1a

classe con quello di una precedente classe fittizia di valore 0;

il valore centrale dell'ultima classe con quello di una classe

successiva fittizia di valore 0)

13

Consideriamo la tabella Tab.4:

0,7

0,6

0,5

Fi 0,4

0,3

0,2

0,1

0

69,5

89,5

109,5

129,5

149,5

169,5

189,5

altezza piante

N.B.: asse verticale deve mostrare lo zero reale (o origine") al

fine di non travisare le caratteristiche dei dati

INDICI SINTETICI

Essi

danno

delle

informazioni

quantitative

sull'ordine

di

grandezza

delle

osservazioni

(misure

di

posizione),

sulla

variabilità delle osservazioni (misure di dispersione, misure di

forma). Nel seguito si considerano sia

dati semplici x1, x2, , xn

(cioè dati che si presentano con frequenza unitaria) sia dati

ponderati x1, x2, , xr con frequenze assolute f1, f2, , fr (dove si ha f1+

f2+ +fr=n)

OSSERVAZIONE: nel caso di una distribuzione di frequenza con dati

raggruppati x1, x2, , xr rappresentano i valori centrali delle classi e

f1, f2, , fr le corrispondenti frequenze assolute e r è il numero di

classi.

14

MISURE DI POSIZIONE

MEDIA

MEDIA ARITMETICA:

per dati semplici:

1 n

1

E ( X ) x xi x1 x2 xn

n i 1

n

per dati ponderati:

E( X ) x

1 r

1

xi f i x1 f1 x2 f 2 xr f r

n i 1

n

OSSERVAZIONE: la media aritmetica sarà indicata con quando si

riferisce alla popolazione, quando si riferisce al campione sarà

indicata con x

MEDIA GEOMETRICA (solo se i dati sono tutti positivi):

per dati semplici:

EG ( X ) n

n

x

i

i 1

n x1 x2 xn

per dati ponderati:

EG ( X ) n

n

x

i 1

i

fi

n x1f1 x2f 2 xrf r

MEDIA QUADRATICA:

per dati semplici:

1 n 2

1 2

x1 x22 xn2

xi

n i 1

n

EQ ( X )

per dati ponderati:

EQ ( X )

1 r 2

1 2

x1 f1 x22 f 2 xr2 f r

xi f i

n i 1

n

MEDIA ARMONICA:

per dati semplici:

EH ( X )

n

n

1

1 1

1

15

x1 x2

xn

i 1 xi

n

per dati ponderati:

EH ( X )

n

r

fi

x

i 1

i

n

f1 f 2

f

r

x1 x2

xr

MEDIANA

È il valore che

ordinato di dati.

occupa

la

posizione

centrale

in

un

insieme

PROPRIETÀ:

non è influenzata dai valori estremi

SI USA:

per attenuare l'effetto di valori estremi molto alti o bassi

nel caso di scale ordinali o di ranghi

PER CALCOLARLA:

a. ordinare i valori

b. se il campione ha un numero dispari di dati, la mediana è il

valore del dato centrale, in posizione (n+1)/2; per esempio la

mediana dei dati 1,4,5,7,20 è 5

c. se il campione ha un numero pari di dati, la mediana è la media

aritmetica dei valori numerici dei due valori centrali

(posizioni n/2 e n/2+1) ; per esempio la mediana dei dati 1,4,5,7,20,

21 è (5+7)/2=6

OSSERVAZIONE: per il calcolo della mediana di una distribuzione di

frequenza per dati raggruppati vedere calcolo dei quantili

MODA

è il valore più frequente di una distribuzione

PROPRIETÀ:

non è influenzata dalla presenza di alcun valore estremo

nelle distribuzioni di frequenza per dati raggruppati essa è

molto sensibile alla modalità di costruzione delle classi

SI USA:

solo a scopi descrittivi

16

DISTRIBUZIONI DI FREQUENZA

UNIMODALI: hanno un'unica moda

BIMODALI (e PLURIMODALI): hanno mode secondarie

Esempio di distribuzione bimodale:

Fi

X

INTERVALLO MEDIO

È la media aritmetica tra il valore più piccolo e quello più

grande fra i valori osservati.

PROPRIETÀ:

si calcola rapidamente anche con un elevato numero di dati

SI USA:

quando non ci sono valori erratici (outliers) per evitare un

valore dell'intervallo medio molto distorto, per esempio in

meteorologia, nel caso di una serie di dati sulla temperatura

o per il calcolo della precipitazione media mensile, essendo

improbabile la presenza di valori estremi

QUANTILI (O FRATTILI)

Sono misure di posizione non-centrale con esclusive finalità

descrittive, più precisamente un q-quantile (0<q<1) è il valore x

tale che una frazione pari a q delle osservazioni sono minori di x

o equivalentemente è il valore x per cui la frequenza relativa

cumulata è pari a q.

DECILI: dividono i dati ordinati in decine

PERCENTILI: dividono i dati ordinati in centesimi

PROPRIETÀ:

individuano i valori che delimitano una percentuale o frazione

stabilita

di

valori

estremi

(es.:

nel

monitoraggio

17

dell'inquinamento indicano i valori che rientrano in una data

percentuale dei valori massimi o minimi)

1,2

1

0,8

freq cum. 0,6

0,4

0,2

0

60

80

100 120 140 160 180 200

altezza piante

Consideriamo la tabella Tab.4: calcolare lo 0.05-quantile

si suppone una distribuzione di dati uniforme all'interno di

ogni classe

calcolo eseguito tramite la formula che esprime l'equazione di

una retta passante per due punti

denotando con x lo 0.05-quantile si ha quindi:

q 0.025

x 79

0.1 0.025 99 79

quindi avendo q=0.05 si ottiene:

x 79 20

0.05 0.025

85. 6

0.1 0.025

OSSERVAZIONE: MEDIANA=0.5-quantile (q=0.5)

18

MISURE DI DISPERSIONE O VARIABILITA'

CAMPO DI VARIAZIONE

E' la differenza tra il valore massimo e il valore minimo

PROPRIETÀ:

intuitivo e semplice, in particolare quando i dati sono

ordinati

incapace di misurare come i dati sono distribuiti entro

l'intervallo

risente della presenza di valori anomali

misura puramente descrittiva

SCARTO MEDIO ASSOLUTO

Come si calcola:

per dati semplici:

n

Sm

x

i 1

i

x

n

per dati ponderati:

r

Sm

x

i 1

i

x fi

n

SCARTO MEDIO ASSOLUTO DALLA MEDIANA

E' la media degli scarti assoluti dei singoli dati dalla loro

mediana e viene calcolato come sopra, sostituendo la mediana alla

media

DEVIANZA

E' la base delle misure di dispersione dei dati, essa può essere

calcolata in due differenti modi:

I METODO:

per dati semplici:

SQ xi x

n

i 1

19

2

per dati ponderati:

SQ xi x f i

r

2

i 1

II METODO:

per dati semplici:

n

SQ xi2 nx 2

i 1

per dati ponderati:

r

SQ xi2 f i nx 2

i 1

ESERCIZIO

Calcolare la devianza (SQ) nei due modi descritti dei valori: 5,

6, 7, 7, 8, 10.

x

5 6 7 7 8 10 43

7.16

6

6

Allora si ha:

I METODO:

SQ x

i

2

x

5 7.16 6 7.16 7 7.16 7 7.16 8 7.16 10 7.16

2

2

2

2

14.8356

II METODO:

SQ xi2 nx 2 25 36 49 49 64 100 6 7.16 2 14.84

n

i 1

20

2

2

VARIANZA

media dei quadrati degli scarti dei valori dalla loro media, cioè

devianza diviso il numero di osservazioni.

2

SQ

n

OSSERVAZIONE: nella statistica inferenziale, cioè quando si

utilizzano i dati del campione per stimare le caratteristiche di

una popolazione, si usa sempre la VARIANZA CAMPIONARIA (correzione

di Student):

s2

SQ

n 1

n-1: n° di osservazioni indipendenti, è chiamato GRADI DI LIBERTÀ

(gdl, df); poiché la somma degli scarti dalla media è uguale a

zero, l'ultimo valore è fissato a priori e non è libero di

assumere qualsiasi valore

DEVIAZIONE STANDARD (O SCARTO QUADRATICO MEDIO)

E' la radice quadrata della varianza

2

Analogamente per la deviazione standard campionaria si ha

s s2

COEFFICIENTE DI VARIAZIONE

Misura la dispersione percentuale relativa dei dati in rapporto

alla media

cv

x

100

PROPRIETÀ:

è un numero puro svincolato da ogni scala di misura e dalla

tendenza centrale del fenomeno studiato

in quanto rapporto, ha significato solo se calcolato per

variabili misurate con una scala di rapporti

21

SI USA PER CONFRONTARE:

la variabilità di due o più gruppi con medie molto diverse

dati espressi in unità di misura diverse

popolazioni differenti per lo stesso carattere (es.: confronto

tra la variabilità di specie animali di taglie diverse, come

cani e cavalli)

MOMENTI

Essi servono per calcolare le misure di forma.

MOMENTI DI ORDINE K (rispetto a un valore c):

per dati semplici:

x

k

n

mk

i 1

i

c

n

per dati ponderati:

x

k

r

mk

i 1

i

c fi

n

MOMENTI PIÙ COMUNEMENTE USATI

MOMENTO RISPETTO ALL'ORIGINE: c = 0

MOMENTO CENTRALE: c x

OSSERVAZIONE:

Momento di ordine 1 rispetto all'origine (k=1, c=0) è la media

Momento centrale di ordine 1 (k=1, c x ) è nullo (è la somma

degli scarti dalla media)

Momento centrale di ordine 2 (k=2, c x ) è la varianza

Allo stesso modo si possono calcolare i momenti centrali di ordine

3 (m3), 4 (m4), 5 (m5),..., n (mn).

MISURE DI FORMA

Servono per quantizzare due caratteristiche di una distribuzione

di frequenza:

SIMMETRIA

CURTOSI

22

Si ha SIMMETRIA se in una distribuzione di frequenza i valori

equidistanti dalla mediana presentano la stessa frequenza. Si ha

ASIMMETRIA POSITIVA quando i valori maggiori sono più frequenti

dei valori minori. Si ha ASIMMETRIA NEGATIVA quando i valori

minori sono più frequenti dei valori maggiori

Esempio di distribuzione simmetrica:

0,45

0,4

0,35

0,3

F0,25

i

0,2

0,15

0,1

0,05

0

-3

-2

-1

0

1

2

3

4

5

6

X

Esempio di distribuzione con asimmetrica positiva:

0,3

0,25

0,2

Fi 0,15

0,1

0,05

0

0

1

2

3

4

X

23

5

6

7

8

Esempio di distribuzione con asimmetrica negativa:

0,3

0,25

0,2

Fi 0,15

0,1

0,05

0

1

2

3

4

5

6

7

8

9

X

I momenti centrali di ordine dispari (m3,m5,...) sono indici di

simmetria :

sono nulli per distribuzioni simmetriche

sono non-nulli per distribuzioni asimmetriche (quanto maggiore

è l'asimmetria, tanto più grande è il valore del momento

centrale di ordine dispari)

hanno valore positivo in distribuzioni con asimmetria

positiva

hanno valore negativo in distribuzioni con asimmetria

sinistra

N.B.: i valori dei momenti dipendono dalla scala utilizzata; per

avere una misura adimensionale, che permetta i confronti tra più

distribuzioni, bisogna dividerli per la potenza n (n=3 per il

terz'ordine,

n=4

per

il

quart'ordine,

ecc.)

dello

scarto

quadratico medio

INDICI DI ASIMMETRIA

Dovrebbero essere nulli se e solo se la distribuzione è simmetrica

INDICE 1 DI FISHER: 1

m3

3

2

m3

INDICE 1 DI PEARSON: 1 3

Ovviamente tra questi due ultimi indici vale la relazione:

1 1

N.B.: nel caso di distribuzioni simmetriche gli indici1, 1 danno

un risultato nullo; ma non sempre vale l'inverso, cioè non sempre

l'indice di asimmetria uguale a zero esprime la perfetta simmetria

di una distribuzione.

24

La CURTOSI è il grado di appiattimento, rispetto alla

normale (o gaussiana) delle curve unimodali simmetriche

MESOCURTICA:

distribuzione

avente

forma

uguale

distribuzione normale

LEPTOCURTICA: eccesso di frequenza nelle classi centrali

PLATICURTICA: difetto di frequenza nelle classi centrali

curva

alla

INDICI DI CURTOSI

INDICE 2 DI FISHER: 2

m4

3

4

m

INDICE 2 DI PEARSON: 2 44

OSSERVAZIONE:

distribuzione mesocurtica o normale: 2=3, 2=0

distribuzione leptocurtica: 2>3, 2>0

distribuzione platicurtica: 2<3, 2<0

Ovviamente tra questi due indici vale la relazione 2=2+3

N.B.: tutti gli indici presentati si applicano sia alle variabili

discrete che alle continue, con l'ovvia approssimazione data dal

raggruppamento in classi

25

ESERCIZIO

Delle due serie di dati:

A: 5 7 2 4 3

B: 15 11 9 8 10 12

calcolare le misure di tendenza centrale, di dispersione e gli

indici di forma

ESERCIZIO

Determinare

la

distribuzione

di

frequenza

delle

seguenti

misurazioni del livello di acido urico serico (in mg per 100 ml)

di 50 maschi adulti:

5.1,

5.5,

4.3,

5.4,

6.1,

4.3,

5.3,

4.9,

3.9,

6.2,

6.2,

6.0,

4.1,

5.5,

5.1,

4.1,

5.9,

5.7,

5.8,

4.9,

4.8,

4.8,

5.7,

5.1,

5.2,

4.5,

5.9,

4.7,

5.9,

5.6,

5.6,

6.4,

4.6,

4.7,

5.7,

5.0,

5.5,

5.5,

5.3,

4.9,

6.1, 6.3, 4.9,

5.4, 4.4, 5.5,

5.6, 5.5, 5.6,

5.9

determinare i limiti veri e i valori centrali di ogni classe della

distribuzione e disegnarne l'istogramma. Calcolare le misure di

tendenza centrale, di dispersione e gli indici di forma di tale

distribuzione di frequenza.

26

ESERCIZIO

Concentrazioni (mg/l) di sodio e cloruri in 36 laghi appenninici:

rappresentare graficamente i dati e la loro distribuzione di

frequenza

calcolare le misure di tendenza centrale, di dispersione e gli

indici di forma

Lago

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

Sodio(mg/l)

1,78

1,63

1,85

2,10

1,35

1,40

1,82

1,35

2,06

1,85

1,51

2,00

2,02

1,90

1,60

2,18

1,82

1,90

1,75

2,11

2,30

1,95

2,60

2,44

2,18

2,51

2,37

2,54

2,06

2,77

2,31

2,81

2,33

1,45

1,78

2,09

27

Cloruri(mg/l)

1,60

1,80

2,90

2,90

2,90

2,90

2,00

2,00

2,00

2,20

2,30

2,30

2,80

2,80

2,80

2,50

2,50

2,50

2,60

2,60

2,60

2,70

2,90

2,90

3,00

3,10

3,10

3,30

3,30

3,40

3,40

3,60

3,70

3,80

3,80

3,90

PROBABILITÀ

Si possono considerare due tipi di esperimenti:

ESPERIMENTI DETERMINISTICI: in cui è possibile prevedere

esattamente i risultati ottenuti da esperimenti ripetuti

(esempio: misurazione dell'accelerazione a di un corpo di

massa m sottoposto ad una forza F)

ESPERIMENTI CASUALI: in cui non è possibile prevedere

esattamente i risultati ottenuti da esperimenti ripetuti

(esempio: misurazione dell'altezza di una pianta)

In un esperimento casuale il risultato non è prevedibile

esattamente, ma può essere stimato, in altre parole ci sono dei

risultati che sono più frequenti di altri e quindi ci si aspetta

questi risultati si presentino più facilmente rispetto ad altri.

Con la PROBABILITÀ si cerca di quantificare tale aspettativa

CONCETTO DI PROBABILITÀ

Sono necessari i seguenti concetti:

EVENTO: risultato di un esperimento o di una osservazione

PROBABILITÀ (DI UN EVENTO): numero reale compreso fra 0 ed 1

(0,1 inclusi) che valuta la possibilità del verificarsi

dell'evento stesso; probabilità piccole, cioè prossime a 0,

indicano un evento poco probabile, probabilità grandi, cioè

prossime a 1, indicano un evento molto probabile

La probabilità si può definire in quattro modi diversi:

DEFINIZIONE FREQUENTISTA

La probabilità di un evento è pari alla frequenza relativa con cui

esso si verifica in un numero molto elevato di ripetizioni nelle

medesime condizioni

OSSERVAZIONE: si basa sul principio che la probabilità di un

evento è pari alla frequenza relativa con cui esso si presenta in

una serie di esperienze fatte nelle stesse condizioni quando il

numero delle osservazioni è elevato. Questo approccio si applica

naturalmente in tutti quei casi in cui non sono note a priori le

leggi dei fenomeni studiati, ma possono essere determinate a

posteriori, infatti, l'unico modo per rispondere ai quesiti

empirici è condurre una serie di osservazioni od esperimenti, in

condizioni controllate statisticamente, per rilevare la frequenza

relativa del fenomeno.

28

DEFINIZIONE SOGGETTIVA

La probabilità di un evento è la misura che si attribuisce

all'avverarsi dell'evento secondo l'esperienza personale di un

individuo

OSSERVAZIONE: si fonda sul principio che la probabilità è una

stima del grado di aspettativa di un evento secondo l'esperienza

personale di un individuo. Questo approccio ha vaste ed

interessanti applicazioni nelle scienze sociali ed economiche,

dove l'attesa di un fenomeno o una convinzione possono influire

sui fenomeni reali (svalutazione, prezzi di mercato, comportamenti

sociali), inoltre esso ha applicazioni nel determinare la

probabilità di eventi unici o irripetibili: catastrofi, guerre,

estinzione di una specie animale. Questo approccio ha delle

limitazioni per la ricerca sperimentale perché è difficile

misurare un grado di aspettativa, dato che sperimentatori diversi

attribuiscono probabilità differenti allo stesso fenomeno

DEFINIZIONE CLASSICA

La probabilità di un evento è pari al rapporto tra il numero dei

casi favorevoli all'evento e il numero dei casi possibili

supponendo che tutti i casi siano equiprobabili

OSSERVAZIONE: non si richiede alcun dato sperimentale, ma i

risultati devono essere conosciuti a priori (esempio: lancio di

una moneta, lancio di un dado). Questo approccio ha delle

limitazioni per la ricerca sperimentale poiché questa è basata su

un approccio non teorico ma empirico, in particolare non sarebbe

possibile rispondere a quesiti che per loro natura richiedano

osservazioni ripetute

DEFINIZIONE ASSIOMATICA

La probabilità di un evento è un numero che soddisfa i tre assiomi

del calcolo delle probabilità

OSSERVAZIONE:

questo

approccio

è

troppo

astratto,

esso

è

generalmente usato nello studio teorico della probabilità. La

limitazione di questo approccio è che non fornisce un metodo

pratico per calcolare la probabilità di un evento

N.B.: nel contesto delle scienze sperimentali si deve calcolare la

probabilità di eventi che sono generalmente ripetibili in

condizioni almeno approssimativamente uguali o simili, pertanto di

norma si fa ricorso all'impostazione frequentista

29

TEORIA DELLA PROBABILITÀ

Sia U lo spazio di tutti i possibili risultati. Un evento A è un

qualsiasi sottoinsieme di U. L'EVENTO IMPOSSIBILE è mentre U è

l'EVENTO CERTO. Dato un evento A l'evento A , COMPLEMENTARE di A,

si verifica quando A non è verificato. Dati due eventi A1, A2,

l'evento A1A2, UNIONE di A1 e A2, si verifica quando almeno uno fra

gli eventi A1 e A2 sono verificati; l'evento A1A2, INTERSEZIONE di

A1 e A2, si verifica quando entrambi gli eventi A1 e A2 sono

verificati. Se A1A2= si dice che gli eventi A1 e A2 sono

mutuamente esclusivi.

Evento A

Evento A1A2

Evento A

Evento A1A2

ESEMPIO: nel lancio di un dado U={1, 2, 3, 4, 5, 6}. Consideriamo i due

eventi A1={1, 3}, A2={3, 4}, allora si ha: A1 {2,4,5,6} , A1A2={1, 3, 4},

A1A2={3}

La probabilità è una funzione che associa un numero reale ad ogni

evento in U, tale funzione soddisfa i seguenti ASSIOMI:

per ogni evento A di U si ha P(A)0

P(U)=1

per ogni scelta degli eventi A1, A2,. . ., An in U a due a due

mutuamente esclusivi si ha:

P(A1A2. . . An )= P(A1) +P(A2)++ P(An)

TEOREMA DELLA PROBABILITÀ TOTALE: per ogni scelta degli eventi A1,

A2 si ha:

P(A1A2)= P(A1) +P(A2) - P(A1A2)

Dati due eventi A1, A2 la probabilità che si verifichi A1 supposto

che A2 sia verificato è indicata con P(A1|A2) ed è detta PROBABILITÀ

CONDIZIONATA. Essa si può calcolare nel seguente modo:

30

TEOREMA DELLA PROBABILITÀ COMPOSTA:

P(A1A2)= P(A1|A2) P(A2)

P(A1A2)= P(A2|A1) P(A1)

Se P(A2|A1)= P(A2) (o P(A1|A2)= P(A1)) allora A1 e A2

indipendenti, in tal caso si ha: P(A1A2)= P(A1) P(A2).

sono

eventi

TEOREMA DI BAYES: siano A1, A2,. . ., An eventi mutuamente esclusivi

tali che A1A2. . . An =U e sia B un altro evento in U allora si

ha:

P( Ai | B)

P( Ai ) P( B | Ai )

n

P( A ) P( B | A )

k 1

k

k

Generalmente le probabilità P(Ai) sono dette probabilità a priori,

mentre P(Ai|B) sono dette probabilità a posteriori

OSSERVAZIONE: il teorema di Bayes è un semplice strumento per

stimare le cause Ai di una certa osservazione B. Ad esempio in

medicina B può essere un certo sintomo di un paziente; A1, A2,...,

An le possibili diagnosi; in questo caso P(Ai) indica la probabilità

della i-esima diagnosi, P(B|Ai) la probabilità di avere un paziente

che presente i sintomi B supposto che sia affetto dalla malattia

Ai, P(Ai|B) la probabilità di avere la diagnosi Ai supposto di aver

riscontrato i sintomi B.

ESEMPIO: in un certo lago è stata osservata una moria del 50% dei

pesci di una certa specie. In base alla conoscenza delle industrie

presenti nei pressi del lago si suppone che le cause di tale moria

si possano principalmente attribuire ad inquinamento da una

sostanza S1 o da una sostanza S2. La probabilità di avere

inquinamento da S1 è pari a 0.05, di avere inquinamento da S2 è

pari a 0.1. La probabilità di osservare una moria del 50% dei

pesci della suddetta specie supposto di avere inquinamento da S1 è

pari a 0.9, se si suppone di avere inquinamento da S2 è pari a

0.15, per altre cause è pari a 0.005. Calcolare la probabilità di

avere inquinamento da sostanza S1 (supponendo di aver fatto la

suddetta osservazione)

31

ESEMPIO: un paziente ha temperatura corporea maggiore di 39°C.

Nella popolazione sono stati rilevati i seguenti dati: la

probabilità di avere un individuo affetto da virus influenzale è

pari a 0.1, la probabilità di avere un individuo affetto da

meningite è pari a 0.005; la probabilità di osservare una

temperatura corporea maggiore di 39°C in un individuo affetto da

virus influenzale è pari a 0.05, in un individuo affetto da

meningite è pari a 0.7, per altre ragioni è pari a 0.001.

Calcolare la probabilità che il paziente abbia la meningite

(supponendo di aver fatto la suddetta osservazione)

CALCOLO COMBINATORIO

Permette di calcolare il numero di raggruppamenti di oggetti

aventi particolari proprietà, come conseguenza esso è utile per

calcolare la probabilità di un evento

ESEMPIO Gara di corsa tra 10 concorrenti

a. quanti differenti ordini d'arrivo sono possibili?

b. quale è la probabilità di indovinare i primi tre :

nell'ordine ?

senza stabilire il loro ordine?

c. conviene scommettere 10.000 lire per guadagnarne 500.000 se si

indovineranno i primi 2 :

nell'ordine?

senza stabilire il loro ordine?

Requisiti fondamentali degli eventi:

si escludono a vicenda

sono tutti ugualmente possibili

vengono generati da eventi puramente casuali

avvengono in modo indipendente

I raggruppamenti si distinguono in :

PERMUTAZIONI

DISPOSIZIONI

COMBINAZIONI

32

PERMUTAZIONI SEMPLICI

I gruppi che si possono formare collocando n elementi differenti

a1, a2, a3, . . ., an

in tutti gli ordini possibili

Il numero di permutazioni di n elementi è : P n = n! dove n! si dice n

fattoriale e si ha n! = 1 2 3... n

ESEMPIO Le permutazioni degli elementi a, b, c sono: abc, acb, bca, bac, cba,

cab. Osservazione: il numero di permutazioni di 3 elementi (a, b, c) è

pari a P 3 = 3!=1 2 3=6.

ESEMPIO Il numero delle permutazioni degli elementi a, b, c, d è

P4=4!=1 2 3 4 = 24

I primi 25 numeri fattoriali:

1! = 1

2! = 2

3! = 6

4! = 24

5! = 120

6! = 720

7! = 5.040

8! = 40.320

9! = 362.880

10! = 3.628.800

11! = 39.916.800

12! = 479.001.600

13! = 6.227.020.800

14! = 87.178.291.200

15! = 1.307.674.368.000

16! = 20.922.789.888.000

17! = 355.687.428.096.000

18! = 6.402.373.705.728.000

19! = 121.645.100.408.832.000

20! = 2.432.902.008.176.640.000

21! = 51.090.942.171.709.440.000

22! = 1.124.000.727.777.607.680.000

23! = 25.852.016.738.884.976.640.000

24! = 620.448.401.733.239.439.360.000

25! = 15.511.210.043.330.985.984.000.000

N.B.: per definizione si usa: 0! = 1 e 1! = 1

33

DISPOSIZIONI SEMPLICI

I gruppi di k elementi

differenti

che

si

possono

formare

con

n

oggetti

a1, a2, a3, . . ., an

dove ogni gruppo di k elementi si diversifica dagli altri o per

almeno un elemento o per l'ordine degli elementi

Il numero di disposizioni semplici di n elementi in classe k è :

D n,k

n!

(n - k)!

ESEMPIO Le disposizioni degli elementi a, b, c, d (cioè n=4) in classe

3 (cioè k=3) sono :

abc, abd, acd, acb, adb, adc,

bac, bad, bcd, bca, bda, bdc,

cab, cad, cbd, cba, cda, cdb,

dab, dac, dbc, dba, dca, dcb

infatti il numero delle disposizioni di 4 elementi in classe 3 è:

D 4,3

4!

4! 24

24

(4 - 3)! 1! 1

Per il calcolo delle disposizioni di n elementi in classe k in

alternativa alla formula data precedentemente si può utilizzare la

seguente:

Dn,k=n(n - 1)(n – k + 1)

Infatti, il numero delle disposizioni di 4 elementi in classe 3 si

può calcolare come segue:

D 4,3 4 3 2

CASI SPECIALI:

Dn,0=1: si ha solo il gruppo vuoto

Dn,n= Pn=n! : si ottiene il numero di permutazioni semplici

34

COMBINAZIONI SEMPLICI

I gruppi di k elementi

differenti

che

si

possono

formare

con

n

oggetti

a1, a2, a3, . . ., an

dove ogni gruppo di k elementi si diversifica dagli altri per

almeno un elemento (l'ordine degli elementi è irrilevante)

Il numero di combinazioni semplici di n elementi in classe k è:

C n,k

D n,k

n!

k! (n - k)! k!

ESEMPIO Le combinazioni degli elementi a, b, c, d (cioè n=4) in classe

3 (cioè k=3) sono: abc, abd, acd, bcd.

Infatti il numero delle combinazioni di 4 elementi in classe 3 si

può calcolare come segue:

C 4,3

4!

24

4

(4 - 3)!3! 1 6

OSSERVAZIONI

il numero di combinazioni semplici di n elementi in

pari al numero di disposizioni di n elementi in

diviso il numero di permutazioni di k elementi

per ogni n 0 e per ogni k, con 0 k n, il numero

sempre un numero intero

n

a volte Cn,k si denota con il simbolo

ed

k

chiamato COEFFICIENTE BINOMIALE:

si usa anche nel calcolo delle potenze di binomi,

n

classe k è

classe k,

Cn,k risulta

esso

cioè:

n

n

k nk

k 0 k

si può calcolare con il TRIANGOLO DI TARTAGLIA:

1

n=0

1 1

n=1

1 2 1

n=2

1 3 3 1

n=3

. . . . .

.

. . . . . . . .

.

n

0

n n

1 k 1

n

k

35

n n

k 1 n

nn

è

CASI SPECIALI

Cn,0=1: si ha solo il gruppo vuoto

Cn,n=1: si ha solo il gruppo formato da tutti gli elementi

possibili

ESEMPIO In un esperimento sulla fertilità di un terreno, si

vogliono esaminare in modo sistematico gli equilibri binari tra:

Ca, Mg, Na, N, P, K

a. Quante coppie di elementi occorrerà prendere in considerazione?

b. Per valutare tutti gli equilibri ternari, quanti gruppi diversi

si dovranno formare ?

RISPOSTA:

a.

C 6,2

6!

56

15

(6 - 2)! 2!

2

C 6,3

6!

456

20

(6 - 3)!3!

6

b.

ESEMPIO Risposte ai tre quesiti introduttivi

a. In una corsa con 10 concorrenti, i possibili ordini d'arrivo

sono le permutazioni di 10 elementi : P10 = 10! = 12345678910 =

3.628.800

b. I possibili gruppi dei primi 3 concorrenti tra 10:

tenendo conto dell'ordine d'arrivo, sono le disposizioni di

10 elementi in classe 3:

D10,3 10 9 8 720

Quindi la probabilità di indovinare è 1/720= 0,001389

senza distinzioni dell'ordine di arrivo, sono le combinazioni

di 10 elementi in classe 3:

C10,3

D10,3 720

120

3!

6

Quindi la probabilità di indovinare è 1/120 = 0,00833

c. La probabilità di indovinare i primi 2 tra 10, stabilendo chi

sarà primo e chi secondo, è data dalle disposizioni di 10

elementi in classe 2:

D10,2 10 9 90

36

Quindi la probabilità di indovinare è 1/90, meno favorevole del

rapporto 1/50 fissato nella scommessa (non conviene scommettere)

La probabilità di indovinare i primi 2 tra 10, senza stabilire

l'ordine, è data dalle combinazioni di 10 elementi in classe 2:

C10,2

D10,2 90

45

2!

2

Probabilità di indovinare : 1/45, più favorevole del rapporto

1/50 fissato nella scommessa (conviene scommettere)

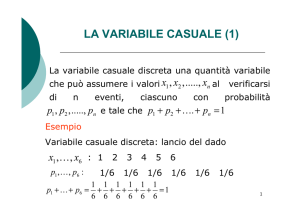

DISTRIBUZIONE DI PROBABILITÀ

Una variabile che in seguito ad un esperimento o osservazione

può assumere diversi valori che sono imprevedibili a priori è

detta VARIABILE ALEATORIA o VARIABILE CASUALE

Una DISTRIBUZIONE DI PROBABILITÀ (di una variabile casuale) è

una funzione che associa ad ogni possibile valore della

variabile casuale un valore per la probabilità

DISTRIBUZIONI DISCRETE

UNIFORME

MULTINOMIALE

POISSONIANA

IPERGEOMETRICA

BINOMIALE

DISTRIBUZIONI CONTINUE

RETTANGOLARE

ESPONENZIALE NEGATIVA

NORMALE (o GAUSSIANA)

2

t DI STUDENT

37

DISTRIBUZIONI DISCRETE

Una variabile casuale X ha distribuzione discreta se essa può

assumere solo dei valori isolati: x1, x2,. . .; la probabilità che X

assuma il valore xk è denotata con P(X= xk )=Pk. Si ha che:

P1 +P2 + =1

La funzione

F ( x) P( X x) Pk

xk x

è detta FUNZIONE DI DISTRIBUZIONE CUMULATIVA

OSSERVAZIONE: F(x) è una funzione a gradinata, è crescente ed ha

valori compresi tra 0 e 1

DISTRIBUZIONE UNIFORME

È una distribuzione teorica finita

Si suppone che il risultato di un singolo esperimento può assumere

valori a, a+1, a+2, . . . , b, dove a, b sono numeri interi, inoltre ogni

risultato ha la stessa probabilità di verificarsi (ad esempio la

probabilità di ottenere 1, 2, 3, 4, 5, 6 con un dado non truccato è

uguale per ognuno dei risultati)

Quindi la variabile casuale è X = risultato dell'esperimento", si

denota Pk=P(X=k) la probabilità di ottenere un generico risultato k

(compreso fra a e b) ed è pari a:

Pk

1

(b a) 1

ab

2

media:

varianza: 2

(b a) 1

2

1

12

Per i dadi (a=1, b=6) è semplice verificare che Pk= 1/6

38

DISTRIBUZIONE BINOMIALE (O DI BERNOULLI)

È una distribuzione teorica finita

Si suppone che in un esperimento si possono avere solo due

possibili risultati A e B rispettivamente con probabilità (a priori o a

posteriori) e 1 - .

Questa distribuzione fornisce la probabilità Pk che nel corso di n

prove identiche ed INDIPENDENTI si abbia k volte il risultato A (e n

- k volte B), dove 0 k n.

Quindi la variabile casuale è X = numero di volte che si ha il

risultato A", si denota P(X=k)=Pk e si ha:

Pk Cn ,k k (1 ) nk

N.B.: le prove possono essere successive oppure simultanee, purché

non si influenzino reciprocamente

ESEMPIO Nella specie umana nascono più maschi che femmine, con un

rapporto di 107 maschi per 100 femmine (a posteriori, sulla base

dei

dati

rilevati,

si

può

affermare

che

la

probabilità

frequentista di un nato maschio (risultato A) è = 0.52 e di un

nato femmina (risultato B) è di 1 - = 0.48

Con la distribuzione binomiale si può calcolare le specifiche

probabilità di 0, 1, 2, 3, 4 (=k) nascite di figli maschi nelle

famiglie con 4 figli (n=4):

0 figli maschi: P0 C4, 0 (1 ) 1 1 0.48 0.05

1 figli maschi: P1 C4,1 (1 ) 4 0.52 0.48 0.23

2 figli maschi: P2 C4, 2 (1 ) 6 0.52 0.48 0.37

3 figli maschi: P3 C4,3 (1 ) 4 0.52 0.48 0.28

4 figli maschi: P4 C4, 4 (1 ) 1 0.52 1 0.07

0

1

2

3

4

4

4

3

3

2

1

0

39

2

2

3

4

famiglie di 4 figli

0,400

0,350

0,300

0,250

P 0,200

0,150

0,100

0,050

0,000

0

1

2

3

4

num. maschi

num. maschi

(n=10)

0

1

2

3

4

5

6

7

8

9

10

P

0,001

0,007

0,034

0,099

0,188

0,244

0,220

0,136

0,055

0,013

0,001

famiglie di 10 figli

0,300

0,250

0,200

P 0,150

0,100

0,050

0,000

0

1

2

3

4

5

6

num. maschi

40

7

8

9

10

La distribuzione binomiale:

è asimmetrica perché 0.5

tende ad essere simmetrica

osservazioni n anche se 0.5

all'aumentare

del

numero

di

ESEMPI Probabilità di ottenere 3 volte il numero 1 lanciando un

dado 5 volte (n=5, k=3, =1/6, 1-=5/6)

ESEMPIO Probabilità che 9 esperimenti di laboratorio risultino

positivi e 1 negativo, se di solito gli esperimenti sono positivi

nel 20% dei casi (n=10, k=9, =0.2, 1-=0.8)

OSSERVAZIONI:

quando n é elevato, la forma è praticamente normale e quasi

simmetrica anche se é sensibilmente diverso da 0.5

le probabilità associate ai diversi valori della variabile

casuale sono espresse dai termini dello sviluppo del binomio

(+ (1-))n dove e 1- sono le probabilità dei due diversi

eventi semplici A e B

la media del numero di successi è =n

la varianza del numero di successi è 2=n (1-)

per quanto riguarda le proporzioni (o frequenze relative) di

(1 )

risultati A si ha: =, 2

n

DISTRIBUZIONE MULTINOMIALE

È una distribuzione teorica finita, essa può essere vista come una

estensione di quella binomiale

Si suppone di avere r eventi distinti ed indipendenti A1, A2, ..., Ar

rispettivamente di probabilità 1, 2, ..., r (dove 1+2+·····+ r=1) che

possono comparire nel corso di n prove INDIPENDENTI, successive o

simultanee

La probabilità di ottenere k1 volte l'evento A1, k2 volte l'evento

A2,. . ., kr volte l'evento Ar, (dove k1+k2+·····+ kr=n) è:

P k1 ,k2 ,,kr

n!

1k1 2k2 rkr

k1!k 2 !k r !

41

OSSERVAZIONE: la distribuzione binomiale può essere vista come la

distribuzione multinomiale dove: r=2, A1=A, A2=B, 1= , 2=1-

ESEMPIO Nella popolazione di una certa regione geografica si ha la

seguente suddivisione per gruppo sanguigno: 10% gruppo AB

(A1=individuo ha gruppo AB, 1 = 0.10), 20% gruppo B (A2 =individuo ha

gruppo B, 2 = 0.20), 30% gruppo A (A3 =individuo ha gruppo A, 3 =

0.30), 40% gruppo 0 (A4 =individuo ha gruppo 0, 4 = 0.40),

su 10 persone estratte, qual è la probabilità che 2 abbiano il

gruppo AB, 3 il gruppo B, 2 il gruppo A e 3 il gruppo 0

su 8 persone estratte, qual è la probabilità che 4 abbiano

gruppo 0 e 4 abbiano gruppo A?

Risposte:

P 2,3, 2,3

10!

0.102 0.203 0.302 0.403 0.012

2!3!2!3!

P0, 0, 4, 4

8!

0.100 0.200 0.304 0.404 0.046

0!0!4!4!

DISTRIBUZIONE POISSONIANA

È una distribuzione teorica infinita, totalmente determinata da un

solo parametro: la media

È la distribuzione limite della binomiale: per n e 0, in

modo tale che n= sia costante: Poisson nel 1837 dimostrò che:

Pk

k

n n

(1 ) nk

e lim

n

k!

0 k

PROPRIETÀ

la media è uguale a

la varianza 2 è uguale a , infatti applicando le condizioni

su enunciate:

2 lim

n (1 ) lim

(1 )

n

n

0

0

descrive accuratamente eventi che si verificano raramente in

uno spazio (o in un tempo) molto grande, per esempio: numero

di piante di una certa specie per unità di superficie, numero

di microrganismi per unità di volume

è asimmetrica per piccoli valori di , tende ad essere

simmetrica per grandi valori di

42

k (=0.9)

0

1

2

3

4

5

6

7

8

9

10

p

0,407

0,366

0,165

0,049

0,011

0,002

0,000

0,000

0,000

0,000

0,000

k (=2)

0

1

2

3

4

5

6

7

8

9

10

p

0,135

0,271

0,271

0,180

0,090

0,036

0,012

0,003

0,001

0,000

0,000

k (=12)

0

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

0,000

0,000

0,000

0,002

0,005

0,013

0,025

0,044

0,066

0,087

0,105

0,114

0,114

0,106

0,090

0,072

0,054

0,038

0,026

0,016

0,010

0,006

0,003

0,002

Distr. di Poisson =0.9

0,5

0,4

p 0,3

0,2

0,1

0

0

1

2

3

4

5

6

7

8

9

10

X

Distr. di Poisson =2

0,300

0,250

0,200

p 0,150

0,100

0,050

0,000

0

1

2

3

4

5

6

7

8

9

10

X

p

Distr. di Poisson =12

0,150

p

0,100

0,050

0,000

0

5

10

15

X

43

20

25

ESEMPIO In letteratura, è famoso l'esempio di Bortkewitch, un

veterinario dell'armata prussiana del XIX secolo che per 20 anni

contò il numero di soldati di 10 corpi d'armata che ogni anno

morivano a causa di un calcio di mulo:

numero di decessi i

eventi osservati k

0

109

1

65

2

22

3

3

4

1

Media:

0 109 1 65 2 22 3 3 4 1 122

x

0.61

200

200

Varianza:

(0 0.61) 2 109 (1 0.61) 2 65 (2 0.61) 2 22 (3 0.61) 2 3 (4 0.61) 2 1

2

0.6079

200

Applicando la distribuzione di Poisson, si determinano

probabilità teoriche di osservare 0, 1, 2, 3, 4 decessi ogni anno:

P0

le

0.610 1

0.544

0! e 0.61

0.611 1

P1

0.3318

1! e 0.61

0.612 1

P2

0.101

2! e 0.61

0.613 1

P3

0.0203

3! e 0.61

0.614 1

P4

0.0029

4! e 0.61

numero di decessi i

eventi osservati k

freq. relative attese

eventi attesi (su 200)

0

1

2

3

4

109

65

22

3

1

0.544 0.3318 0.101 0.0203 0.0029

108.8 66.36

20.2

4.1

0.6

Lo scarto tra osservato ed atteso è molto piccolo

ESEMPIO In una comunità planctonica la popolazione di Eudiaptomus

vulgaris è presente col 2% degli individui:

campionando 200 individui quale è la probabilità di non

trovare Eudiaptomus?

campionando 100 individui quale è la probabilità di trovarlo 4

volte?

44

con una presenza del 5%, come cambierebbero le probabilità

precedenti?

Risposte:

Campionando 200 individui: media della popolazione (presenza 2%):

= n=200 0.02=4; probabilità di non trovare individui:

40 1

P0

0.0183

0! e 4

media della popolazione (presenza 5%): = n=2000.05=10; probabilità

di non trovare individui:

10 0 1

P0

0.0000454

0! e10

Campionando 100 individui: media della popolazione (presenza 2%):

=n=1000.02=2; probabilità di trovare 4 individui:

24 1

P4

0.0902

4! e 2

media della popolazione (presenza 5%): = n=1000.05=5; probabilità

di non trovare individui:

54 1

P4

0.1755

4! e 5

DISTRIBUZIONE IPERGEOMETRICA

Quando in un'urna ci sono moltissime biglie ogni estrazione non

altera sostanzialmente le probabilità di quelle successive, il che

equivale a supporre che ogni biglia estratta sia reintrodotta (o

che il numero di biglie sia praticamente infinito), ma quando

nell'urna

ci

sono

poche

biglie

e

l'estrazione

è

senza

reintroduzione, le probabilità di estrarre biglie di un dato

colore non sono costanti, ma dipendono dagli eventi precedenti,

tali probabilità possono essere calcolate con la distribuzione

ipergeometrica

ESEMPIO Da un'urna con N biglie, delle quali m bianche e N - m

nere, si estraggono n biglie (n N) senza reintroduzione.

Determinare la probabilità P(k / n) che delle n biglie estratte k (k m e

k n) siano bianche; si ha che:

P k / n

Cm,k C N m,n k

45

C N ,n

La distribuzione ipergeometrica è definita da tre parametri:

N numero totale di individui che formano la popolazione

m numero degli individui del gruppo considerato

n numero di individui estratti

OSSERVAZIONE:

Per N la distribuzione ipergeometrica converge verso la

binomiale

m

m )

n ( ponendo

N

N

media n

varianza 2 n (1 )

N n

( ponendo m e 1 N m )

N 1

N

N

ESEMPIO In un lago sono presenti 12 pesci appartenenti a specie

diverse, ma con il 50% di trote; pescando 4 pesci a caso,

calcolare la probabilità che nessuno sia trota?

Con la notazione precedente si ha: N=12, m=6, n=4, k=0; quindi

P0 / 4

C6, 0 C6 , 4

C12, 4

15

0.0303

495

ESEMPIO In una piccola riserva naturale sono presenti 9 cinghiali:

3 femmine e 6 maschi; per ridurre il loro numero viene decisa una

battuta di caccia, nella quale ne verranno catturati 5 senza

attenzione al sesso; calcolare la probabilità:

a. che vengano catturate tutte le 3 femmine

b. che vengano catturate 2 femmine

c. che venga catturata 1 femmina

d. che non venga catturata alcuna femmina

Risposte(animali presenti N = 9, animali catturati n = 5, femmine

presenti m= 3, femmine catturate r):

MEDIA E VARIANZA DI UNA VARIABILE CASUALE

In generale, se X è una variabile casuale che assume valori x1, x2, . .

., xr rispettivamente con probabilità P1, P2, . . ., Pr (dove può anche

essere r=) allora la media di X si calcola nel seguente modo:

r

E ( X ) xi Pi

(dove può anche essere r=)

i 1

mentre per la varianza si ha:

46

r

2 var( X ) ( xi ) 2 Pi

(dove può anche essere r=)

i 1

OSSERVAZIONE: queste formule sono conseguenza delle rispettive

formule per media e varianza di distribuzioni di frequenza essendo

la probabilità di un evento pari alla frequenza con cui l'evento

si verifica in una lunga serie di ripetizioni

47

DISTRIBUZIONI CONTINUE

Una variabile casuale X ha distribuzione continua se essa può

assumere tutti i valori reali appartenenti ad un intervallo (a,b),

dove in generale è possibile avere anche i casi limiti: a=- e/o

b=+. La distribuzione di probabilità di una variabile casuale

continua è data in termini di una funzione f(x), x (a,b), detta

FUNZIONE DI DENSITÀ DI PROBABILITÀ di X; per ogni x1 , x2 (a,b), con x1

x2,si ha:

x2

P( x1 X x2 ) f ( x)dx

x1

Si osserva che si ha:

b

P(a X b) f ( x)dx 1

a

Inoltre la funzione F(x), x (a,b), definita come segue:

x

F ( x) P( X x) f (t )dt

a

è detta funzione di distribuzione cumulativa; essa è crescente ed

assume valori compresi tra 0 e 1.

Data una variabile casuale X con funzione di densità f(x), x (a,b),

la media di X si calcola come segue:

b

E ( X ) x f ( x)dx

a

mentre per la varianza si ha:

b

var( X ) ( x ) 2 f ( x)dx

2

a

OSSERVAZIONE: queste formule sono conseguenza delle rispettive

formule per media e varianza di distribuzioni di frequenza per

dati raggruppati, dove le sommatorie sono sostituite da integrali

48

DISTRIBUZIONE RETTANGOLARE

Dati a, b due numeri reali, con a < b,

relativa al generico intervallo (a,b) è:

la

densità di frequenze

1

ba

f ( x)

dove x (a,b)

PROPRIETÀ:

ab

2

(b a) 2

2

varianza:

12

media:

è l'equivalente continuo della distribuzione uniforme

DISTRIBUZIONE ESPONENZIALE NEGATIVA

Dato >0 la funzione di densità è definita come segue:

f ( x) e x

dove x (0,+) (prende il nome dall'esponente negativo che compare

nella relazione)

PROPRIETÀ:

1

media:

varianza:

f(x) è una funzione decrescente che tende a 0 per x+

2

1

2

2

DISTRIBUZIONE NORMALE (DISTRIBUZIONE DI GAUSS)

Dato numero reale, numero

densità è definita come segue:

f ( x)

reale

1

2

2

e

positivo

la

funzione

x 2

2 2

dove x (-,+); tale distribuzione è indicata con N(µ,2), inoltre:

X N(µ,2)

denota che X è una variabile avente questo tipo di distribuzione

49

di

Proprietà:

media µ

varianza 2

è simmetrica rispetto alla media

ha media, moda e mediana coincidenti (e pari µ)

f(x) è crescente da - a µ ed è decrescente da µ a +

sia per x+ sia per x - si ha che f(x) tende a zero

l'area sottesa dalla curva normale nell'intervallo:

(µ-,µ+) è pari a 0.6827

(µ-2,µ+2) è pari a 0.9545

(µ-3,µ+3) è pari a 0.9973

OSSERVAZIONE:

è la più importante distribuzione continua

proposta da Gauss (1809) nell'ambito della teoria degli

errori, è stata attribuita anche a Laplace (1812), che ne

definì le proprietà principali in anticipo rispetto alla

trattazione più completa di Gauss

il

nome

deriva

dalla

convinzione

che

i

fenomeni

fisico-biologici solitamente si distribuiscono con frequenze

più elevate nei valori centrali e frequenze progressivamente

minori verso gli estremi

è detta anche CURVA DEGLI ERRORI ACCIDENTALI, in quanto,

soprattutto nelle discipline fisiche, la distribuzione degli

errori

commessi

nel

misurare

ripetutamente

la

stessa

grandezza, è molto bene approssimata da questa curva

essa può essere considerata il limite della distribuzione

binomiale per n, mentre né né 1- tendono a 0, infatti per

il teorema di De Moivre (1833), quando n (a condizione che

né né 1- tendano a 0), la probabilità Pi della binomiale

tende a:

Pi

1

2 n (1 )

e

i n 2

2 n (1 )

dalla densità della distribuzione normale sostituendo:

n con la media sperimentale

n(1-) con la varianza calcolata 2

il conteggio i con la misura x

LEGGE DEI GRANDI NUMERI:

PROPORZIONI

(in

prove

identiche

e

indipendenti

di

un

esperimento con due o più risultati anche su scale nominali):

al crescere del numero di prove indipendenti la proporzione di

un risultato tende alla probabilità del risultato stesso

50

MEDIE (in prove identiche e indipendenti di un esperimento di

conteggio o di misurazione): al crescere del numero di prove

indipendenti la media aritmetica dei valori osservati di una

variabile casuale tende alla media della variabile casuale

TEOREMA DEL LIMITE CENTRALE:

Siano X1, X2, . . . , Xn variabili casuali aventi stessa distribuzione di

probabilità con media e varianza 2, sia Sn= X1+X2+ +Xn.

Allora al crescere di n si ha che Sn tende ad assumere una

distribuzione normale con media n e varianza n2.

Tendono alla normale:

la distribuzione binomiale quando n (in pratica quando sia

n sia n(1-) sono maggiori di 5)

la distribuzione poissoniana, quando la media è elevata (in

pratica quando la media 10)

DISTRIBUZIONE NORMALE STANDARDIZZATA

Consente di ricondurre alla stessa forma le infinite distribuzioni

normali determinate dalle diverse medie e varianze

È ottenuta mediante il cambiamento di variabile:

Z

X

questa trasformazione rende Z a media nulla e varianza unitaria

cioè si ha Z N(0,1) e quindi la densità di probabilità di Z è:

2

1 z2

f ( z)

e

2

UTILIZZO PRATICO DELLA DISTRIBUZIONE NORMALE STANDARDIZZATA

Tramite delle tabelle si possono calcolare i valori dell'integrale

della

funzione

di

densità

della

distribuzione

normale

standardizzata, quindi tramite queste tabelle si possono calcolare

i valori dell'integrale della funzione di densità di una qualsiasi

distribuzione normale, tramite il seguente rapporto:

Z

X

51

ESEMPIO: In una popolazione di lunghezze di pesci si ha: µ = 35cm e

= 6cm. Calcolare la probabilità di pescare pesci di lunghezza l

(non tenendo conto della approssimazione della misura):

a. l 42cm

b. l 42cm

c. l 23cm

d. 42cm l 50cm

e. 29cm l 42cm

f. l = 33cm (tenendo conto che l'approssimazione della misura è

fatta per arrotondamento al più vicino cm)

Risposte:

a. probabilità di pescare pesci con l 42cm (area a destra di z=(4235) / 6 = 1.17) 0.121 (12.1%)

b. probabilità di pescare pesci con l 42cm (area a sinistra di

z=1.17) 1-0.121=0.879 (87.9%)

c. probabilità di pescare pesci con l 23cm (area a sinistra di

z=(23-35) / 6=-2) 0.0228 (2.28%)

d. probabilità di pescare pesci con 42cm l 50cm (area tra

z=1.17 e z=2.5) 0.121-0.062=0.1148 (11.48%)

e. probabilità di pescare pesci con 29cm l 42cm (area tra z= -1

e z=1.17) 1-0.1587-0.121=0.7203 (72.03%)

f. eseguendo misure per arrotondamento al più vicino cm si registra

l = 33cm per tutti i pesci di lunghezza tra 32.5cm e 33.5cm

(area tra z=-0.42 e z=-0.25) 0.4013-0.3409=0.0604 (6.04%)

ESEMPIO: In una specie di roditori adulti, i maschi e le femmine

sono distinguibili dalle dimensioni :

femmine: µ = 37.5cm = 3.8cm

maschi: µ = 34.5cm = 3.2cm

Domande:

a. rispetto alle medie del loro sesso, sono più rari i maschi di

lunghezza 40cm o le femmine di lunghezza 41cm ?

b. si consideri il gruppo del 5% delle femmine di lunghezza

maggiore, qual è la lunghezza minima in tale gruppo di roditori?

c. si consideri il gruppo del 5% dei maschi di lunghezza minore,

qual è la lunghezza massima in tale gruppo di roditori?

d. sia l la lunghezza minima nel gruppo del 30% delle femmine di

dimensioni maggiori, quanti maschi hanno lunghezza maggiore di

l?

e. sia l la lunghezza massima nel gruppo del 20% delle femmine di

dimensioni minori, quanti maschi hanno lunghezza minore di l?

CORREZIONI PER LA CONTINUITA' IN PROBABILITA' DISCRETE

Come già sottolineato, molte distribuzioni discrete (binomiale,

poissoniana,...)

sono

bene

approssimate

dalla

distribuzione

normale al crescere delle dimensioni del campione.

52

Tuttavia mentre le prime forniscono le probabilità per singoli

valori della variabile casuale, cioè la probabilità di ottenere

esattamente il valore x per la variabile casuale considerata, con

le distribuzioni continue (tra cui la normale) si calcola l'area

sottesa dalla densità di probabilità in un intervallo

Per calcolare la probabilità di verificarsi di un singolo valore

x, con la distribuzione normale si deve calcolare l'area sottesa

dall'intervallo x ±0.5.

ESEMPIO: Si supponga che, da dati di letteratura, sia noto che in

una

popolazione

zooplanctonica

lacustre,

gli

individui

di

Eudiaptomus vulgaris siano il 10% del totale individui. In un

campionamento casuale di 120 individui qual è la probabilità di

trovare:

a. esattamente 15 individui di Eudiaptomus

b. almeno 15 individui di Eudiaptomus

c. meno di 15 individui di Eudiaptomus

OSSERVAZIONE: n = 120, =0.1, x = 15

µ = n = 120 0.1 = 12

= n(1-) = 120 0.1 0.9 = 10.8, =3.29

2

Risposte (completare punti b,c):

a. BINOMIALE:

P15 C120,15 15 (1 )12015

120!

0.115 0.9105 0.074

105!15!

NORMALE:

area tra x-0.5=14.5 e x+0.5=15.5 (area tra z=0.76 e z=1.06)

0.2236-0.1466=0.079

2

Si considerino variabili casuali indipendenti X1, X2,. . .,X aventi

distribuzione normale con media nulla e varianza unitaria. La

variabile casuale:

2 =X12+ X22+ +X2

ha una distribuzione detta DISTRIBUZIONE 2 CON GRADI DI LIBERTÀ.

Proprietà:

distribuzione

asimmetrica

all'aumentare di

media =

varianza 2=2

che

53

tende

alla

simmetria

Tramite delle tabelle si possono calcolare i valori dell'integrale

della funzione di densità associata alla distribuzione 2, questi

valori dipendono dal numero di gradi di libertà

t DI STUDENT

Si consideri due variabili casuali indipendenti: Z avente

distribuzione normale standard e X avente distribuzione 2 con

gradi di libertà. La variabile casuale T :

T