Calcolo della probabilità

Spazio dei risultati

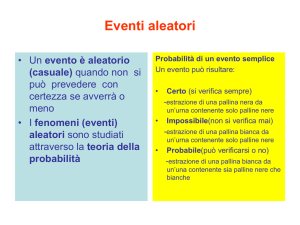

Se si esegue una prova (es. tiro di un dado) si indica con U tutti i possibili

risultati che può dare.

U

E

E=evento

U=universo

Evento:

- aleatorio: può accadere E ⊆ U

- certo: accade di sicuro E=U

- impossibile: E ∩ U = ∅

Probabilità classica (Pascal)

Si può utilizzare SOLO se i casi sono equiprobabili (es si può utilizzare con il

lancio di un dado, ma non di un dado truccato)

La probabilità che è si verifichi è

casi favorevoli

p( E ) =

casi possibili

0 ≤ p( E ) ≤ 1

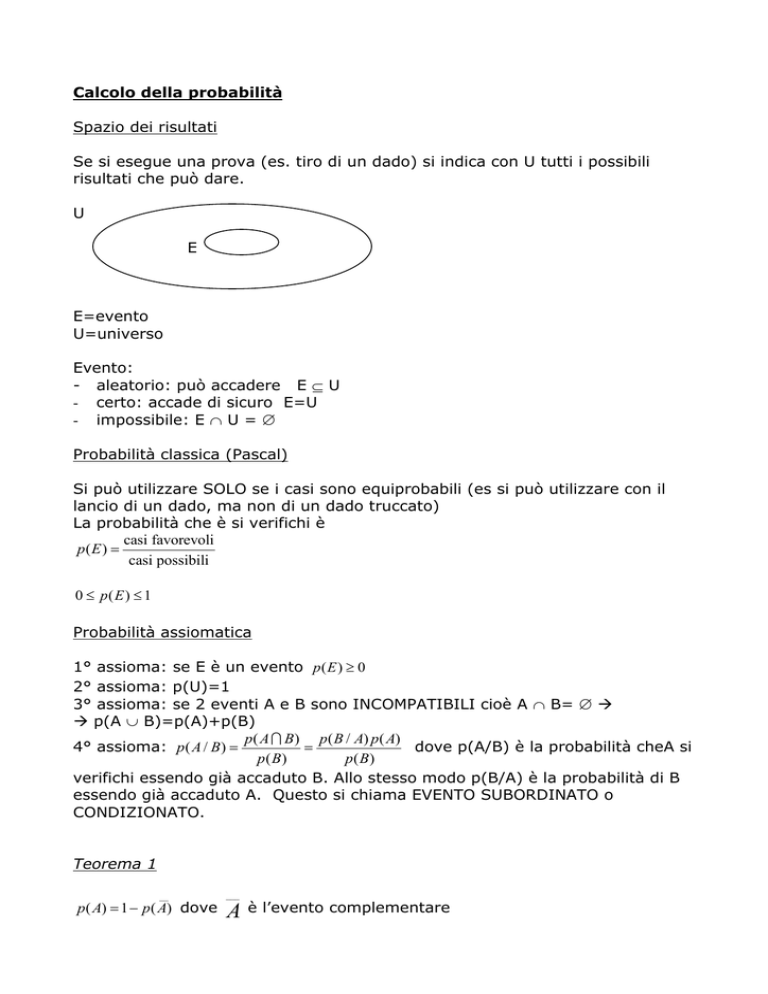

Probabilità assiomatica

1° assioma: se E è un evento p ( E ) ≥ 0

2° assioma: p(U)=1

3° assioma: se 2 eventi A e B sono INCOMPATIBILI cioè A ∩ B= ∅ Æ

Æ p(A ∪ B)=p(A)+p(B)

p ( A ∩ B) p( B / A) p( A)

4° assioma: p ( A / B) =

=

dove p(A/B) è la probabilità cheA si

p( B)

p( B)

verifichi essendo già accaduto B. Allo stesso modo p(B/A) è la probabilità di B

essendo già accaduto A. Questo si chiama EVENTO SUBORDINATO o

CONDIZIONATO.

Teorema 1

__

p( A) = 1 − p( A) dove

___

A è l’evento complementare

dim:

__

A∪ A =U

__

A∩ A = ∅

dato che la loro intersezione è nulla, A ed il suo complementare sono eventi

incompatibili Æ

__

__

p( A ∪ A) = p( A) + p( A)

ma

__

p( A ∪ A) = p(U ) = 1

__

__

p( A) + p( A) = 1 → p( A) = 1 − p( A)

c.v.d .

Teorema 2

Generalizzazione del 3° assioma

p ( A ∪ B ) = p ( A) + p ( B ) − p ( A ∩ B )

Evento totale

U

A

H1

H2

H3

Hn

A evento trasversale

Siano H1, H2, … Hn una partizione di U e sia A un eventi trasversale rispetto ad

essi

p( A) = p ( A ∩ H1 ) + p ( A ∩ H 2 ) + ... + p ( A ∩ H n ) =

= p( A / H1 ) p ( H1 ) + p ( A / H 2 ) p ( H 2 ) + ... + p ( A / H n ) p ( H n )

es. un esempio di evento trasversale: hai 2 urne. Nella prima ci sono 3 palline

rosse e 2 nere. Nella seconda ce ne sono 7 rosse e 5 nere. Come evento

trasversale potresti considerare “estrarre una pallina rossa”. Sarà, a parole, la

probabilità di estrarre una pallina rossa, avendo scelto l’urna 1, per la

probabilità di scegliere l’urna 1 più la probabilità di estrarre una pallina rossa

avendo scelto l’urna 2 per la probabilità di scegliere l’urna 2. In numeri:

3 1 7 1

p ( A) = * + *

5 2 12 2

Teorema di Bayes

Risalire alle cause vedendo l’effetto

p( A / B) =

p( B / A) p( A)

p( B)

STATISTICA

Sia X una variabile casuale reale (può assumere tutti i valori di R).

p(X=x) si assume nulla

Si calcola la probabilità che X cada in un intervallo quindi, perché la probabilità

che assuma un valore ben preciso è tendente a 0. Il calcolo della probabilità è

basato su una funzione, detta funzione densità di probabilità che gode di 3

proprietà fondamentali:

1. E’ sempre positiva

f ( x) ≥ 0

∀x ∈ D

2. L’integrale da -∞ a +∞ di f(x) vale 1

∫

+∞

−∞

f ( x) dx = 1

3. La probabilità che X cada in un intervallo [a,b] è l’integrale di f(x)dx da a

b

a b.

p (a ≤ X ≤ b) = ∫ f ( x)dx

a

a

b

La probabilità che X assuma un valore compreso tra a e b è rappresentata

dall’area colorata in rosso, quindi dall’integrale calcolato nell’intervallo [a,b].

Si definisce allora la funzione di ripartizione, cioè la funzione integrale per

definizione calcolata da -∞ ad x di f(t)dt.

Es.

⎧0

⎪

f ( x) = ⎨3 x 2

⎪0

⎩

f(x)

∫

1

0

rispetta

3 x 2 dx = 3[

x<0

0 ≤ x ≤1

x >1

tutte

3

le

x 1

]0 = 1

3

condizioni:

non

è

negativa

in

nessun

punto

e

La funzione di ripartizione allora sarà

x<0

⎧0

⎪⎪ x 2

F ( x) = ⎨ ∫ 3t dt = [t 3 ]0x = x3

0

⎪

⎪⎩1 x > 1

0 ≤ x ≤1

Per x>1 vale 1 perché per definizione la funzione di ripartizione va da -∞ a x,

bisogna ricordarsi questo aspetto!!

Media di X

X=x

x1

x2

…

xn

p(X=x)

p1

p2

…

pn

Per le variabili discrete (cioè che assumono solo valori per definiti es. numeri

interi) la media E(x)= x1p1 + x2p2 +…+ xnpn

Invece nelle variabili continue E(x) è

∫

+∞

−∞

x * f ( x) dx

Varianza di X

2

б è

∫

+∞

−∞

( x − E ( x)) 2 f ( x)dx

DISTRIBUZIONE NORMALE

Supponiamo di voler effettuare una misura: possiamo supporre che le

probabilità di ottenere una misura maggiore o minore siano simmetriche. La

funzione densità di probabilità di tale distribuzione è la curva normale o

gaussiana:

g ( x) =

1

e

δ 2π

1 ⎛ x−M ⎞

− ⎜

⎟

2⎝ δ ⎠

E la sua funzione di ripartizione è

2

1

∫−∞ δ 2π e

x

1 ⎛ t −M ⎞

− ⎜

⎟

2⎝ δ ⎠

2

dt

Un integrale non calcolabile con funzioni elementari: bisogna usare delle

tabelle specifiche.

La curva ha il suo massimo in x=M, cioè nel punto di ascissa che individua la

media della distribuzione. Possiede due flessi nei punti M+б e M-б dove б è lo

scarto quadratico medio, radice quadrata della varianza.

Le tabelle in cui leggiamo i valori della funzione di ripartizione e quindi la

probabilità si riferiscono ad una gaussiana standard in cui M=0 (la funzione è

centrata quindi in 0) e б2=1.

Si scrive così: X~N(M, б2) ovvero la variabile casuale è approssimabile ad una

distribuzione normale di media M e varianza б2.

Standardizzare una distribuzione significa operare una sostituzione

nell’integrale per ricondurre la funzione alla curva standard di cui possediamo

le tabelle. La sostituzione diventa

z=

x−M

δ

G( z) = ∫

z

−∞

1 − 12 t 2

e dt

2π

Quando si usa la curva standard bisogna fare attenzione agli estremi di

integrazione, che sono da cambiare!

DISTRIBUZIONE BINOMIALE

Variabile discreta. Assume solo valori interi. Dobbiamo usarla se si interessa

sapere la probabilità di ottenere m successi in n prove.

X~Bin(n, p) X è approssimabile ad una distribuzione binomiale con n prove

con probabilità p.

Esempio: Supponiamo che una prova consista nel tirare contemporaneamente

2 monete. Decido che il successo sia rappresentato da ottenere 2 croci, quindi

p=1/4. Voglio sapere qual è la probabilità che io ottenga 3 successi in 5 prove.

p(X=3)=

⎛ 5⎞ 3

5−3

⎜ ⎟ p (1 − p )

⎝ 3⎠

Quando nÆ+∞ (e in statistica significa superiore a 25-30) possiamo

approssimare la distribuzione binomiale ad una normale con questi parametri:

X~N(np, np(1-p))

L’approsimazione di una variabile discreta ad una continua comporta

attenzione a certi particolari. Ad esempio se volevo conoscere la probabilità

che X assumesse un valore appartenente ad un determinato intervallo tenevo

in considerazione che essa potesse assumere solo valori interi. Prendiamo che

io volessi sapere p(x≥5). Quando approssimo a normale considererò p(x≥4.5)

perché approssimando i valori maggiori o uguali a 4.5 ottengo 5. Bisogna

quindi stare attenti a questo aspetto di approssimazione negli esercizi.

DISTRIBUZIONE DI POISSON

Sia E un evento che in media si presenta λ volte. Sia X il numero di volte in cui

X si può presentare. X~P(λ) X è approssimabile ad una poissoniana con

parametro λ.

X=x

0

1

2

…

N

p(X=x)

λx

p(X=x)=

x!

e−λ

esempio: Se in media ci sono 50 guasti al giorno (λ) sulle linee telefoniche qual

è la probabilità che in un’ora vengano segnalati meno di 3 guasti.

p(X<3)=p(X=0)+p(X=1)+p(X=2)

λ=50/8

(considero solo le 8 ore lavorative e non le 24 di un giorno intero)

X~P(50/8)

( 50 / 8)

0

0!

= 5,17%

( 50 / 8)

+

1

e

− (50 / 8)

1!

e

− (50 / 8)

( 50 / 8)

+

2!

2

e − (50 / 8) =

DISTRIBUZIONE GEOMETRICA

Sia E un evento che può accadere con probabilità p e sia X il numero di prove

da effettuare affinchè E accada.

X=x

p(X=x)

1

p

2

p(1-p)

…

…

n

p(1-p)n-1

X~G(p) X è approssimabile ad una distribuzione geometrica con probabilità p.

E(x)=1/p

б2=(1-p)/p2

esempio: Carlo l’arciere colpisce il bersaglio con una probabilità del 20%

(p=0.2). Qual è la probabilità che Tizio impieghi più di 5 lanci per colpirlo.

p(X>5)=1-(p(X=1)+p(X=2)+ p(X=3)+p(X=4)+p(X=5))=

=1-(0.2*0.80+0.2*0.8+0.2*0.82+0.2*0.83+0.2*0.84)=32.8%

Ricapitolando possiamo dividere le variabili casuali in 2 gruppi:

1. Variabili discrete

- Binomiale

- Poissoniana

- Geometrica

2. Variabili continue

- Normale (Gaussiana)

- Funzione densità di probabilità

Calcolo combinatorio

1° caso

Disposizioni semplici di n oggetti presi k alla volta, ovvero i gruppi di k oggetti

DISTINTI TRA LORO scelti tra gli n dati, considerando diversi 2 gruppi che

differiscono per l’ordine degli elementi (es. ABC ≠ BCA)

Dn ,k = n(n − 1)(n − 2)...(n − k + 1)

es. diposizioni di 9 oggetti presi 3 alla volta D9,3 = 9(9 − 1)(9 − 2) = 9 *8*7

2° caso

Permutazioni: disposizioni di n oggetti presi n alla volta

Pn = n !

es. Quanti anagrammi di SALE posso creare? P4 = 4!

Ma potrebbero esserci oggetti ripetuti (es. anagramma di PAOLA la A si ripete

2 volte, quindi se permuto, mi verranno alcuni risultati uguali e li conterò più

volte!) Æ Permutazioni di n oggetti con k ripetuti:

Pn ( k ) =

n!

k!

e se ci sono k elementi di un tipo che si ripetono e h elementi di un altro:

Pn ( k ,h ) =

n!

k !h !

3° caso

Disposizione di n oggetti presi k alla volta con ripetizione (es. Se vogliono

considerare le possibili disposizioni di ABC e prendere in esame anche

disposizioni come AAB oppure CCC oppure BCC e via dicendo)

D r n,k = n k

4° caso

Dati n oggetti DISTINTI vogliamo formare gruppi da k oggetti non ripetuti. 2

gruppi che differiscano per l’ordine sono considerati uguali (es ABC = CBA).

Cn , k =

Dn ,k

k!

=

n(n − 1)(n − 2)...(n − k + 1) ⎛ n ⎞

n!

=⎜ ⎟=

k!

⎝ k ⎠ k !(n − k )!

5° caso

Combinazioni con ripetizione (es. AAB che poi è considerato uguale a BAA ABA)

⎛ n + k − 1⎞ (n + k − 1)!

Cnr,k = ⎜

⎟=

k

⎝

⎠ k !(n − 1)!

Metodo dei trapezi: integrazione numerica

a

x1

x2

b

Si divide l’intervallo di integrazione in n parti e si trova lo step, cioè la

lunghezza di un singolo intervallo (b-a)/n

Prendi in esame l’area sottesa alla curva nell’intervallo [a, x1]: puoi

approssimare ad un trapezio, che avrà area

step

A=

( f (a ) + f ( x1 ))

2

Sommando le varie aree ottieni la formula

A=

step

( f (a) + f (b) + 2( f ( x1 ) + f ( x2 ) + ... + f ( xn−1 )) )

2

Metodo di Newton-Fourier : calcolo degli zeri di una funzione

Sia f: IÆR

Derivabile nel suo dominio

Consideriamo un punto x0 ∈ I

x1

x0

L’equazione della retta tangente in x0 sarà

y - f(x0)=f’(x0)(x- x0)

Essa intersecherà l’asse x nel punto x1 , più vicino allo zero della funzione.

Se ripetiamo il procedimento troveremo un punto x2 ancora più vicino allo zero della

funzione, arrivando infine a trovarlo con una buona approssimazione.

Per ottenere la formula iterativa:

Considero la retta passante per xn : y - f(xn)=f’(xn)(x- xn)

Intersecherà l’asse x in xn+1 , punto che appartiene alla medesima retta: possiamo

sostituire le sue coordinate nell’equazione delle retta

0 - f(xn)=f’(xn)(xn+1- xn)

Ricaviamo xn+1

xn+1 = xn -

f ( xn )

f '( xn )

Con la calcolatrice si può iterare la formula e quando inizierà a dare lo stesso risultato

si avrà trovato lo zero della funzione.

Condizioni per utilizzare il metodo:

Nell’intervallo considerato f’(x) non deve essere mai 0!

Inoltre c’è una condizione sulla derivata seconda: nell’intervallo considerato deve

essere sempre posivita o sempre negativa.

Inoltre: se la concavità della funzione è rivolta verso l’alto, si parte dall’estermo

dell’intervallo più alto (quindi da quello positivo), se è rivolta verso il basso si parte

dall’estremo più basso (il negativo)!!