Capitolo 2

Eventi numerici e variabili aleatorie

2.1

Probabilità di eventi numerici

Nel capitolo precedente si sono considerate le nozioni di esperimento, risultato, evento. Un evento è

individuato dai risultati di un determinato esperimento che godono di una certa proprietà o che presentano

un certo attributo. La probabilità viene assegnata ad eventi così definiti o a loro combinazioni ottenute

tramite le operazioni logiche di unione e negazione. Allo scopo di garantire che tali combinazioni siano

esse stesse degli eventi, si richiede che la classe degli eventi F sia chiusa rispetto alle due operazioni logiche

(sia cioè una σ-algebra).

Spesso il risultato di un esperimento è un numero (si pensi ad esperimenti che richiedono di contare

o misurare). In molti altri casi invece, per una più agevole rappresentazione, a risultati non numerici

vengono associati valori numerici. In entrambe le circostanze il numero X (ϖ) associato al risultato ϖ di

un certo esperimento ha valore incerto (casuale o aleatorio) prima dell’esperimento stesso. Si noti come

X (ϖ) sia una funzione a valori numerici degli elementi di Ω.

Affinché si possa parlare di probabilità con riferimento alla rappresentazione numerica degli eventi

(ovvero con riferimento alla funzione X (ϖ)) bisogna individuare i requisiti necessari per poter trasferire

la probabilità dagli elementi di F (gli eventi) agli insiemi numerici corrispondenti. In generale si può

assumere che gli insiemi numerici per i quali interessi effettuare delle attribuzioni di probabilità abbiano

la forma di intervalli, ovvero che appartengano alla σ-algebra di Borel di R indicata con B. Detto B un

qualsiasi intervallo vogliamo dunque poter determinarne la probabilità. Ma X ∈ B corrisponde all’evento

X −1 (B) = {ϖ ∈ Ω : X (ϖ) ∈ B} che viene anche detto controimmagine di B tramite X. Quindi affinché

X sia ben definita e si possa calcolare

(

)

P ({ϖ ∈ Ω : X (ϖ) ∈ B}) = P X −1 (B)

(2.1)

è necessario che sia X −1 (B) ∈ F, ovvero che le controimmagini degli elementi di B appartengano ad F.

In tal caso la funzione X (ϖ) è detta misurabile.

31

32

A. Pollice - Appunti di Probabilità

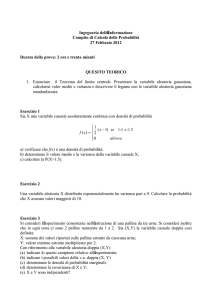

X(ϖ) non è una variabile aleatoria

'

F

&

X(ϖ) è una variabile aleatoria

A

$'

A

A

ϖ XX A

XX

A XX −1

yXAX XXXXX

X (B) X

X

z X(ϖ)

AXXX

XX

A

B

A

%

U

A

9

X −1 (B)

&

$

B

%

Definizione 2.1 Una funzione reale X definita sullo spazio Ω è detta variabile aleatoria se per qualsiasi

elemento B della σ-algebra di Borel di R la controimmagine X −1 (B) di B tramite X è un evento.

La definizione di variabile aleatoria porta a spostare l’attenzione dallo spazio Ω su cui la v.a. è definita

allo spazio euclideo R in cui si trovano i valori da essa assunti, dalla σ-algebra F alla σ-algebra di Borel B.

Definizione 2.2 La funzione PX (B) mette in corrispondenza le attribuzioni di probabilità relative agli

elementi di F con quelle relative ai corrispondenti elementi di B ed è nota come distribuzione di probabilità

della variabile aleatoria X. La distribuzione di probabilità permette di calcolare la probabilità con cui X

assume valori appartenenti a qualsivoglia insieme B elemento di B. Si ottiene pertanto un nuovo spazio

di probabilità dato dalla terna (R, B, PX ).

Esempio 2.1 Si consideri un esperimento nel quale si scelga a caso una persona da un gruppo di n

persone equiprobabili. In tal caso lo spazio dei risultati Ω è l’insieme delle n persone del gruppo e la

probabilità di qualsiasi elemento A dell’insieme delle parti F di Ω è data da P (A) = # (”elem. di A”) /n.

L’esperimento continui rilevando l’età in anni compiuti X della persona scelta a caso. Dire che X = 17

equivale all’evento che si verifica

( quando) la persona estratta ha compiuto 17 anni, quindi PX (17) =

P ({ϖ ∈ Ω : X (ϖ) = 17}) = P X −1 (17) = # (”persone che hanno compiuto 17 anni”) /n.

Operando in modo analogo per i diversi valori dell’età degli n individui si ottiene la distribuzione di

probabilità dell’età degli stessi.

2.2

Variabili aleatorie discrete

Nell’esempio precedente si è considerata una variabile aleatoria X (ϖ) che può assumere un numero finito

di valori distinti (nella fattispecie le diverse età degli individui appartenenti al gruppo espresse in anni

compiuti).

Definizione 2.3 Una variabile aleatoria si dice discreta se può assumere un numero finito o al più

un’infinità numerabile di determinazioni.

Cap.2: Eventi numerici e variabili aleatorie

33

In tal caso risulta abbastanza agevole passare dallo spazio di probabilità dell’esperimento (Ω, F, P ) allo

spazio

della variabile aleatoria (R, B, PX ), infatti si ha PX (xi ) = P ({ϖ ∈ Ω : X (ϖ) = xi }) =

( di probabilità

)

P X −1 (xi ) .

∪

Definizione 2.4 L’insieme RX = ϖ∈Ω X (ϖ) = {xi ∈ R, i = 1, 2, . . .} ha per elementi i possibili valori

di X (ϖ) ed è detto insieme di definizione o campo di variazione della variabile aleatoria X.

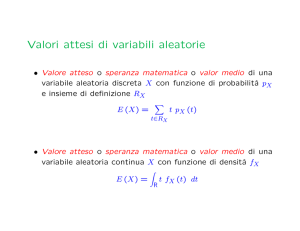

Definizione 2.5 Per una variabile aleatoria discreta X si dice funzione di probabilità la funzione definita

su R data dall’espressione

{

PX (X = x)

x ∈ RX

pX (x) =

(2.2)

0

altrove

La funzione di probabilità di una variabile aleatoria discreta ha valori non negativi, inoltre, qualora l’argomento coincida con una delle possibili determinazioni della variabile aleatoria, la funzione ne restituisce

la probabilità.

Teorema 2.1 Per qualsiasi variabile aleatoria discreta X a valori in RX = {xi ∈ R : i = 1, 2, . . .} si ha

∑

pX (t) = 1

(2.3)

t∈RX

Dimostrazione: infatti dalla definizione di RX si ha che

∪

{ϖ ∈ Ω : X (ϖ) = t}

Ω=

t∈RX

ed inoltre gli eventi {ϖ ∈ Ω : X (ϖ) = t} sono incompatibili al variare di t in RX , quindi

∑

∑

∪

pX (t)

PX (X = t) =

{ϖ ∈ Ω : X (ϖ) = t} =

1 = P (Ω) = P

t∈RX

t∈RX

t∈RX

Esempio 2.2 Si consideri il lancio di un dado e la variabile aleatoria X (ϖ) = ϖ2 definita dal quadrato

del risultato. In tal caso Ω = {x ∈ R : x = 1, 2, 3, 4, 5, 6}, mentre RX = {x ∈ R : x = 1, 4, 9, 16, 25, 36}.

Poiché a ciascun elemento di Ω corrisponde un solo elemento di RX e viceversa, la funzione di probabilità

di X è la seguente

1

x ∈ RX

6

pX (x) =

0

x∈

/ RX

Si consideri ora la variabile aleatoria Y (ϖ) = (ϖ − 3)2 . In tal caso RY = {y ∈ R : y = 0, 1, 4, 9}. Si

verifica facilmente che vale

1

y=0

6

2

y=1

6

2

y=4

pY (y) =

6

1

y=9

6

0

y∈

/ RY

34

A. Pollice - Appunti di Probabilità

Si noti che le due funzioni pX e PX differiscono in quanto la prima è strettamente positiva su RX ⊂ B

(singoli numeri) mentre la seconda è definita su tutto B (insiemi di numeri). Dalla funzione di probabilità

pX di una variabile aleatoria discreta è immediato ottenere la sua distribuzione PX , cioè la probabilità

con cui X assume valori appartenenti a qualsiasi elemento di B ovvero a qualsiasi intervallo o unione di

intervalli di R.

Teorema 2.2 Data una variabile aleatoria discreta X e un insieme numerico A appartenente a B si ha

∑

PX (A) =

pX (t)

(2.4)

t∈A

Dimostrazione: esendo gli eventi {ϖ ∈ Ω : X (ϖ) = t} incompatibili al variare di t in RX ,

(

)

∪

∑

∑

PX (A) = P

{ϖ ∈ Ω : X (ϖ) = t} =

PX (X = t) =

pX (t)

t∈A

t∈A

t∈A

Esempio 2.3 Sia X una variabile aleatoria discreta a valori nell’insieme RX = {x ∈ R : x = 0, 1, 2, 3, 4}

( ) ( )4

e la sua funzione di probabilità sia data dall’espressione pX (x) = x4 21 per x ∈ RX . Se A è l’insieme

appartenente a B dato da A = {x ∈ R : 0 ≤ x < 1.5}, allora

PX (A) = PX (X = 0) + PX (X = 1)

=

(4 ) ( 1 )4

0

2

+

(4) ( 1 )4

1

2

= ··· =

5

16

Esempio 2.4 Sia X una variabile aleatoria discreta a valori nell’insieme

( 1 )x RX = {x ∈ R : x = 1, 2, 3, . . .}

e la sua funzione di probabilità sia data dall’espressione pX (x) = 2 per x ∈ RX . Se A è l’insieme

appartenente a B e dato dai numeri interi dispari A = {x ∈ R : x = 1, 3, 5, 7, . . .}, allora

( ) ( )3 ( )5

1

1

1

2

PX (A) =

+

+

+ ··· = ··· =

2

2

2

3

2.3

Variabili aleatorie continue

Alle variabili aleatorie discrete, che possono assumere al massimo un’infinità numerabile di valori, si

contrappongono le variabili aleatorie continue che assumono probabilità positiva su intervalli di numeri

reali.

Definizione 2.6 La variabile aleatoria X si dice continua o dotata di densità se la probabilità che X

assuma valori nell’insieme A ∈ B è assegnata nel modo seguente

∫

PX (A) =

fX (t) dt

(2.5)

A

dove la funzione fX è definita su tutto R ed è tale che

∫

fX (x) ≥ 0 per x ∈ R,

fX (t) dt = 1

R

La funzione fX viene detta funzione di densità (di probabilità) della variabile aleatoria X.

(2.6)

Cap.2: Eventi numerici e variabili aleatorie

35

Definizione 2.7 L’insieme RX ⊂ R in cui fX è strettamente positiva è detto insieme di definizione della

variabile aleatoria continua X.

Esempio 2.5 Sia X una variabile aleatoria continua la cui densità, individuata a meno di una costante

c, abbia la forma seguente

{ 2

cx 0 < x < 1

fX (x) =

0

altrove

L’intervallo (0, 1) è l’insieme di definizione di X. È possibile inoltre individuare la costante c osservando

che

∫

∫ 1

1

1=

fX (t) dt =

ct2 dt = c → c = 3

3

R

0

Si noti che (analogamente a quanto detto per la funzione di probabilità di una variabile aleatoria discreta) la funzione di densità fX permette di ricavare la distribuzione di probabilità PX , cioè la probabilità

con cui X assume valori appartenenti a qualsiasi elemento di B ovvero a qualsiasi intervallo o unione di

intervalli di R.

Esempio 2.6 Sia X una variabile aleatoria continua la cui densità abbia la forma seguente

{ −x

e

x>0

fX (x) =

0 altrove

La probabilità assegnata all’intervallo (0, 1] è data da

∫

PX ((0, 1]) =

1

e−t dt = 1 − e−1

0

2.4

Funzione di ripartizione

Un’altra funzione di notevole utilità per la descrizione del comportamento probabilistico delle variabili

aleatorie è la funzione di ripartizione.

Definizione 2.8 Si dice funzione di ripartizione di una variabile aleatoria (discreta o continua) X la

funzione FX (x) definita per valori di x con x ∈ R e data da

FX (x) = PX (X ≤ x)

x∈R

(2.7)

L’ordinata di FX calcolata nel punto x indica la probabilità con cui la variabile aleatoria X assume valori

non maggiori di x.

Si noti che la funzione di ripartizione di una variabile aleatoria discreta è data da

∑

FX (x) =

pX (t)

x∈R

(2.8)

t≤x

In altri termini per calcolare FX nel punto x basta sommare la probabilità di tutti i punti t di RX che

soddisfano la disuguaglianza t ≤ x.

36

A. Pollice - Appunti di Probabilità

Esempio 2.2 (cnt) Le funzioni di ripartizione delle variabili aleatorie

sono rispettivamente date da

0

x<1

1

1≤x<4

0

6

2

1

4

≤

x

<

9

6

6

3

3

9

≤

x

<

16

FX (x) =

F

(y)

=

Y

6

6

4

5

6

16 ≤ x < 25

6

5

25 ≤ x < 36

1

6

1

x ≥ 36

X ed Y definite nell’esempio 2.2

y<0

0≤y<1

1≤y<4

4≤y<9

y≥9

Esempio 2.3 (cnt) Per l’esempio 2.3 la funzione di ripartizione è data per x = 0, 1, 2, 3, 4 da FX (x) =

∑

∑x (4) ( 1 )4

t≤x pX (t) =

t=1 t

2 , ovvero da

0

1

16

5

x<0

0≤x<1

1≤x<2

16

FX (x) =

11

16

15

6

1

2≤x<3

3≤x<4

x≥4

Esempio 2.4 (cnt) Per l’esempio 2.4 la funzione di ripartizione è data per x = 1, 2, . . . da

FX (x) =

∑

pX (t) =

x ( )t

∑

1

t≤x

t=1

2

=

1

1 1 − 21x

=1− x

1

2 1− 2

2

Teorema 2.3 Per la funzione di ripartizione FX di una variabile aleatoria discreta X valgono le seguenti

proposizioni:

1. FX è non decrescente;

2. FX è continua a destra;

3. limx→∞ FX (x) = 1 e limx→−∞ FX (x) = 0;

4. PX (X = x) = FX (x) − limh→0+ FX (x − h).

Cap.2: Eventi numerici e variabili aleatorie

37

Dimostrazione:

1. Se x1 ≤ x2 con x1 , x2 ∈ R, allora

PX (x1 < X ≤ x2 ) = PX (X ≤ x2 ) − PX (X ≤ x1 ) = FX (x2 ) − FX (x1 )

pertanto poiché la probabilità PX (x1 < X ≤ x2 ) deve essere non negativa si ha FX (x1 ) ≤ FX (x2 ).

2. Poiché l’insieme limh→0+ (x, x + h] è vuoto, allora vale

FX (x + h) = PX (X ≤ x + h) = PX (X ≤ x) + PX (x < X ≤ x + h)

∑

lim FX (x + h) = FX (x) + lim

h→0+

h→0+

pX (t) = FX (x)

x<t≤x+h

3. Basta scrivere la funzione di ripartizione FX in termini della funzione di probabilità pX

∑

lim FX (x) = lim

x→∞

x→∞

pX (t) =

t≤x

pX (t) = 1

t∈RX

lim FX (x) = lim

x→−∞

∑

∑

x→−∞

pX (t) = 0

t≤x

4. Essendo limh→0+ (x − h, x] = {x} si ha che

FX (x − h)

=

lim FX (x − h)

=

h→0+

=

PX (X ≤ x − h) = PX (X ≤ x) − PX (x − h < X ≤ x)

∑

pX (t)

FX (x) − lim

h→0+

x−h<t≤x

FX (x) − PX (X = x)

Dall’ultima proprietà enunciata si ottiene che per x ∈ RX vale PX (X = x) = FX (x)−limh→0+ FX (x − h) =

pX (x). L’altezza del salto della funzione di ripartizione nel punto x ∈ RX coincide con la probabilità con

cui X assume il valore x.

Si noti inoltre che, analogamente a quanto fatto nella dimostrazione del punto (a) del teorema precedente, è possibile utilizzare la funzione di ripartizione per ottenere le probabilità di diversi eventi:

1.

PX (X < a) = FX (a− );

2.

PX (X = a) = FX (a) − FX (a− );

3.

PX (X > a) = 1 − FX (a);

4.

PX (X ≥ a) = 1 − FX (a− );

5.

PX (a < X ≤ b) = FX (b) − FX (a);

6.

PX (a ≤ X ≤ b) = FX (b) − FX (a− );

7.

PX (a ≤ X < b) = FX (b− ) − FX (a− );

8.

PX (a < X < b) = FX (b− ) − FX (a).

38

A. Pollice - Appunti di Probabilità

Esempio 2.2 (cnt) Tramite le funzioni di ripartizione già determinate risulta immediato il calcolo delle

seguenti probabilità per X ed Y :

PX (X < 4) =

1

6

2

6

−

PX (X > 1) = 1 −

PY (Y < 4) =

2

3

1

6

PY (Y = 4) =

1

3

1

6

PY (Y > 1) = 1 −

3

6

PX (X ≥ 1) = 1 − 0

PY (Y ≥ 1) = 1 −

1

6

PX (X = 4) =

PX (9 < X ≤ 36) = 1 −

3

6

PY (9 < Y ≤ 36) = 1 − 1

PX (9 ≤ X ≤ 36) = 1 −

2

6

PY (9 ≤ Y ≤ 36) = 1 −

5

6

PX (9 ≤ X < 36) =

5

6

−

2

6

PY (9 ≤ Y < 36) = 1 −

5

6

PX (9 < X < 36) =

5

6

−

3

6

PY (9 < Y < 36) = 1 − 1

Esempio 2.3 (cnt) Tramite la funzione di ripartizione già determinata risulta immediato il calcolo delle

seguenti probabilità per X:

5

PX (X < 2) = 16

PX (X = 2) =

11

16

−

5

16

PX (X > 1) = 1 −

5

16

PX (X ≥ 1) = 1 −

1

16

PX (3 < X ≤ 6) = 1 −

15

16

PX (3 ≤ X ≤ 6) = 1 −

11

16

PX (3 ≤ X < 6) = 1 −

11

16

PX (3 < X < 6) = 1 −

15

16

Cap.2: Eventi numerici e variabili aleatorie

39

Esempio 2.4 (cnt) Tramite le funzioni di ripartizione già determinata risulta immediato il calcolo delle

seguenti probabilità per X:

PX (X < 2) =

PX (X = 2) =

1

2

( )2

2 ( )x i

∑

1

1

1

1

− =

=

2

2

2

4

xi =1

PX (X > 1) = 1 −

1

1

=

2

2

PX (X ≥ 1) = 1

6 ( )t

3 ( )t

∑

∑

1

1

PX (3 < X ≤ 6) =

−

2

2

t=1

t=1

6 ( )t

2 ( )t

∑

∑

1

1

PX (3 ≤ X ≤ 6) =

−

2

2

t=1

t=1

5 ( )t

2 ( )t

∑

∑

1

1

PX (3 ≤ X < 6) =

−

2

2

t=1

t=1

5 ( )t

3 ( )t

∑

∑

1

1

PX (3 < X < 6) =

−

2

2

t=1

=

7

64

=

15

64

=

7

32

=

3

32

t=1

Considerata la definizione generale di funzione di ripartizione di una variabile aleatoria, la funzione di

ripartizione di una variabile aleatoria continua X con funzione di densità fX è data da

∫ x

fX (t) dt x ∈ R

(2.9)

FX (x) = PX (X ≤ x) =

−∞

Tutte le proprietà riportate per le funzioni di ripartizione delle variabili aleatorie discrete valgono per

quelle continue. Inoltre qualora A ∈ B sia un intervallo aperto a sinistra e chiuso a destra, ovvero della

forma (a, b] si ha:

∫

PX ((a, b]) =

∫

b

fX (t) dt =

a

b

−∞

∫

fX (t) dt −

a

−∞

fX (t) dt = FX (b) − FX (a)

Si noti che se A = {t ∈ R : t = a} è un intervallo degenere, allora

∫ a

PX (A) = PX (X = a) =

fX (t) dt = 0

(2.10)

(2.11)

a

Ciò significa che è nulla la probabilità che una variabile aleatoria continua assuma un qualsiasi valore a

specificato. Di conseguenza si può scrivere la seguente uguaglianza

∫ b

PX ((a, b)) = PX ((a, b]) = PX ([a, b)) = PX ([a, b]) =

fX (t) dt

(2.12)

a

In generale la funzione di densità fX di una variabile aleatoria continua X risulta uguale (eccetto che

negli eventuali punti di discontinuità) alla derivata della funzione di ripartizione FX

fX (x) = FX′ (x) =

dFX (x)

dx

(2.13)

40

A. Pollice - Appunti di Probabilità

Esempio 2.7 Data la variabile casuale continua X con funzione di ripartizione

x<0

0

x2

FX (x) =

0≤x<2

4

1

x≥2

si ricava facilmente la funzione di densità, data da

{ x

2 0≤x<2

fX (x) =

0

altrove

Inoltre la probabilità associata all’intervallo (1.35, 2.48) è data da

∫

∫

2.48

2

fX (t) dt =

1.35

ovvero

∫

2.48

1.35

)

11( 2

t

dt =

2 − 1.352

2

22

fX (t) dt = FX (2.48) − FX (1.35) = 1 −

1.35

1.352

4

Esempio 2.8 (distribuzione uniforme) Data la variabile casuale continua X con funzione di ripartizione

x<m

0

x−m

m

≤

x<M

FX (x) =

M −m

1

x≥M

si ricava facilmente la funzione di densità data da

{ 1

M −m

fX (x) =

0

m≤x<M

altrove

La funzione di ripartizione e la funzione di densità appena definite individuano la cosiddetta distribuzione

uniforme sull’intervallo (m, M ). Si noti come la densità, costante nell’intervallo (m, M ), assegni un

peso uguale a tutti i punti dell’intervallo (la probabilità di ciascun punto è comunque nulla). Inoltre la

probabilità associata all’intervallo (a, b), posto che m ≤ a < b ≤ M , è data da

∫

∫

b

fX (t) dt =

a

a

b

1

b−a

dt =

M −m

M −m

In altri termini in questo caso la probabilità di un intervallo è proporzionale alla sua lunghezza b − a.

Un importante caso particolare della distribuzione uniforme si ha quando m ed M sono rispettivamente

uguali a 0 e 1. In tal caso la funzione di ripartizione e la funzione di densità hanno la forma seguente

{

x<0

0

1

0≤x<1

x

0≤x<1

FX (x) =

fX (x) =

0

altrove

1

x≥1

Cap.2: Eventi numerici e variabili aleatorie

41

Esempio 2.9 Data la variabile casuale continua X con funzione di ripartizione

0

x<0

x

0

≤

x<2

8

FX (x) =

2

x

2≤x<4

16

1

x≥4

si ricava facilmente la funzione di densità data da

1

8

x

fX (x) =

8

0

0≤x<2

2≤x<4

altrove

Inoltre la probabilità associata all’intervallo (−1.35, 2.48) è data da

∫

−1.35

ovvero

∫

2.48

fX (t) dt =

0

∫

2.48

−1.35

2.5

2

1

dt +

8

∫

2.48

2

)

t

1

11(

dt = (2 − 0) +

2.482 − 22

8

8

82

fX (t) dt = FX (2.48) − FX (−1.35) =

2.482

−0

16

Vettori aleatori

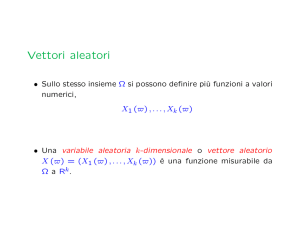

Sullo stesso insieme Ω si possono definire più funzioni X1 (ϖ) , . . . , Xk (ϖ) a valori numerici, ciascuna

delle quali quantifica un aspetto collegato ad ogni possibile risultato elementare ϖ dell’esperimento. Se si

considerano simultaneamente le k funzioni per un certo risultato sperimentale ϖ ∈ Ω si ottiene il vettore

X (ϖ) = (X1 (ϖ) , . . . , Xk (ϖ)) le cui determinazioni sono aleatorie come lo è il risultato dell’esperimento

ϖ. Trasponendo quanto detto per le variabili aleatorie semplici o unidimensionali è evidente che una

variabile aleatoria k-dimensionale o vettore aleatorio è una funzione misurabile da Ω a Rk .

Esempio 2.10 Si supponga di lanciare una sola volta due dadi. Si definiscano

X1 =”minimo dei due punti riportati”

X2 =”somma dei due punti riportati”

Si indica con (X1 , X2 ) il corrispondente vettore aleatorio bidimensionale.

Esempio 2.11 Si supponga di estrarre a caso un individuo da un certo gruppo di soggetti. Siano

X1 =”peso del soggetto estratto”

X2 =”perimetro toracico del soggetto estratto”

X3 =”altezza del soggetto estratto”

Si indica con (X1 , X2 , X3 ) il corrispondente vettore aleatorio tridimensionale.

{

}

∪

Definizione 2.9 L’insieme RX = ϖ∈Ω X (ϖ) = (xi1 , . . . , xik ) ∈ Rk , i = 1, 2, . . . ha per elementi le

possibili configurazioni del vettore X (ϖ) avente per componenti variabili aleatorie discrete ed è detto

insieme di definizione o campo di variazione del vettore aleatorio discreto X.

42

A. Pollice - Appunti di Probabilità

Definizione 2.10 Sia X = (X1 , . . . , Xk ) un vettore aleatorio discreto, si dice funzione di probabilità

(congiunta) di X la funzione definita su Rk data dall’espressione

{

PX (X = x)

0

pX (x) =

x ∈ RX

altrove

(2.14)

Nell’espressione precedente l’uguaglianza in parentesi è da intendersi valida per tutte le componenti dei

vettori X ed x, in altri termini la funzione di probabilità del vettore aleatorio X restituisce la probabilità

congiunta associata alla k-upla di valori x = (x1 , . . . , xk ), ovvero

pX (x) = pX1 ,...,Xk (x1 , . . . , xk )

(2.15)

= PX1 ,...,Xk (X1 = x1 , . . . , Xk = xk ) = PX (X = x)

Analogamente al caso unidimensionale si dimostra che vale

∑

pX (t1 , . . . , tk ) = 1

(2.16)

(t1 ,...,tk )∈RX

Inoltre anche in questo caso se A appartiene alla σ-algebra di Borel di Rk indicata con B k si ha che la

probabilità di A ⊂ RX ⊂ Rk è uguale alla somma delle probabilità dei singoli elementi di A

∑

PX (A) =

pX (t1 , . . . , tk )

(2.17)

(t1 ,...,tk )∈A

(

)

Esempio 2.10 (cnt) La funzione di probabilità della variabile aleatoria bidimensionale X = X1 , Ẋ2

può essere agevolmente rappresentata nella seguente tabella

pX1 ,X2 (x1 , x2 )

x2

2

3

4

5

6

7

8

9

10

11

12

x1

1

1/36

2/36

2/36

2/36

2/36

2/36

0

0

0

0

0

2

0

0

1/36

2/36

2/36

2/36

2/36

0

0

0

0

3

0

0

0

0

1/36

2/36

2/36

2/36

0

0

0

4

0

0

0

0

0

0

1/36

2/36

2/36

0

0

5

0

0

0

0

0

0

0

0

1/36

2/36

0

6

0

0

0

0

0

0

0

0

0

0

1/36

(

)

Si verifica facilmente che PX X1 = Ẋ2 = 0 (risultato ovvio: il minimo non può mai essere uguale alla

somma). Inoltre se

{

}

A = (x1 , x2 ) ∈ R2 : (x1 , x2 ) = (3, 6) , (3, 7) , (3, 8) , (3, 9)

si ha che PX (A) =

1+2+2+2

.

36

Cap.2: Eventi numerici e variabili aleatorie

43

Esempio 2.12 Da un’urna contenente tre palline numerate da 1 a 3 si estraggano due palline senza

reimmissione. Siano

X1 =”numero più piccolo fra i due estratti”

X2 =”numero più grande fra i due estratti”

(

)

La funzione di probabilità del vettore aleatorio X = X1 , Ẋ2 può essere rappresentata dalla seguente

tabella

pX1 X2 (x1 , x2 )

x1

x2

1

2

2

1/3

0

3

1/3 1/3

)

(

Anche in questo caso ovviamente PX X1 = Ẋ2 = 0. Inoltre se

{

}

A = (x1 , x2 ) ∈ R2 : (x1 , x2 ) = (1, 2) , (1, 3)

si ha che PX (A) =

1+1

3 .

(

)

Esempio 2.13 Sia X = X1 , Ẋ2 una variabile aleatoria bidimensionale discreta con distribuzione

individuata a meno di una costante c

{

cx1 x2 (x1 , x2 ) ∈ RX

pX1 X2 (x1 , x2 ) =

0

altrove

con

{

}

RX = (x1 , x2 ) ∈ R2 : (x1 , x2 ) = (1, 1) , (2, 1) , (2, 2) , (3, 2)

Si può calcolare il valore della costante c osservando che

1=

∑

pX1 X2 (t1 , t2 ) = c + 2c + 4c + 6c → c =

(t1 ,t2 )∈RX

1

13

(

)

Si noti che la funzione di probabilità di X1 , Ẋ2 può essere scritta in forma tabellare nel modo seguente

pX1 X2 (x1 , x2 )

x2

1

2

(

)

In questo caso PX X1 = Ẋ2 =

1+4

13 .

1

1/13

0

x1

2

2/13

4/13

3

0

6/13

Inoltre se

{

}

A = (x1 , x2 ) ∈ R2 : (x1 , x2 ) = (1, 2) , (2, 1) , (3, 2)

si ha che PX (A) =

0+2+6

13 .

44

A. Pollice - Appunti di Probabilità

Definizione 2.11 Il vettore aleatorio k-dimensionale X = (X1 , . . . , Xk ) si dice continuo o dotato di

densità se la probabilità che X assuma valori nell’insieme A ∈ B k è assegnata nel modo seguente

∫

∫

PX (A) = · · ·

fX (t) dt1 · · · dtk = PX (A)

(2.18)

A

dove la funzione fX è definita su tutto Rk ed è tale che

∫

∫

k

fX (x) ≥ 0 per x ∈ R ,

···

Rk

fX (t) dt1 · · · dtk = 1

(2.19)

La funzione fX viene detta funzione di densità (congiunta) del vettore aleatorio (X1 , . . . , Xk ).

Definizione 2.12 L’insieme RX ⊂ Rk in cui fX è strettamente positiva è detto insieme di definizione del

vettore aleatorio continuo.

Esempio 2.14 Sia (X1 , X2 ) un vettore aleatorio continuo dotato della seguente funzione di densità

definita a meno della costante c

)

0 < x1 < 1

( 2

c 7x1 + x22

0 < x2 < 1

fX1 ,X2 (x1 , x2 ) =

0

altrove

L’insieme di definizione RX del vettore aleatorio (X1 , X2 ) coincide con il quadrato di vertici opposti nei

punti (0, 0) e (1, 1) del piano (x1 , x2 ). È possibile determinare il valore della costante c nel modo seguente

1 =

)

∫1∫1 ( 2

2

0 0 c 7t1 + t2 dt1 dt2

∫1∫1

= 7c

0

∫1

= 7c

=

0

7

3c

0

t21 dt1 dt2 + c

t21 dt1 + c

+ 13 c → c =

∫1

0

∫1∫1

0

0

t22 dt1 dt2

t22 dt2

3

8

Inoltre la probabilità associata ad

{

}

A = (x1 , x2 ) ∈ R2 : 0 < x1 < 0.3, 0.2 < x2 < 3

è data da

3

PX (A) =

8

∫

0.3 ∫ 1

0

7t21 + t22 dt1 dt2 = · · · ∼

= 0.0561

0.2

Si noti che per tutti gli insiemi di volume nullo (come gli insiemi degeneri: il punto, la retta in un

dominio almeno bidimensionale, il piano in un dominio almeno tridimensionale e così via) la probabilità

associata è uguale a zero essendo nulla la misura del dominio di integrazione nella (2.18).

Cap.2: Eventi numerici e variabili aleatorie

45

Esempio 2.15 Sia X = (X1 , X2 ) un vettore aleatorio continuo dotato della seguente funzione di densità

{

8x1 x2 0 < x2 ≤ x1 < 1

fX1 ,X2 (x1 , x2 ) =

0

altrove

La particolarità di questo esempio è costituita dalla forma dell’insieme di definizione RX del vettore

aleatorio (X1 , X2 ) che coincide con il triangolo avente vertici nei punti (0, 0), (1, 0) e (1, 1) del piano

(x1 , x2 ). Si noti innanzi tutto che

∫

1

∫

t1

PX (RX ) = 8

0

t1 t2 dt1 dt2 = · · · = 1

0

Inoltre la probabilità associata all’insieme

A = {(x1 , x2 ) : 0 < x1 < 0.9, 0.2 < x2 < 3}

è data da

∫

0.9

∫

t1

PX (A) = 8

0.2

t1 t2 dt1 dt2 = · · · ∼

= 0.5929

0.2

Invece la probabilità associata all’insieme

B = {(x1 , x2 ) : x1 = 0.9, 0.2 < x2 < 3}

è uguale a zero, essendo B rappresentato da un segmento in R2 .

Definizione 2.13 Si dice funzione di ripartizione di un vettore aleatorio X = (X1 , . . . , Xk ) la funzione

FX (x) definita per valori di x = (x1 , . . . , xk ) con x ∈ Rk e data da

FX (x) = PX (X ≤ x)

x ∈ Rk

(2.20)

La disuguaglianza in parentesi è da intendersi valida per tutte le componenti dei vettori X ed x, in altri

termini X ≤ x equivale a X1 ≤ x1 , . . . , Xk ≤ xk . L’ordinata di FX calcolata nel punto x indica la

probabilità con cui le componenti del vettore aleatorio X assumono valori non maggiori di x1 , . . . , xk

rispettivamente.

Si noti che la funzione di ripartizione di un vettore aleatorio discreto è data da

∑

FX (x) =

pX (t)

x ∈ Rk

(2.21)

t≤x

In altri termini per calcolare FX nel punto x = (x1 , . . . , xk ) basta sommare la probabilità di tutti i

punti k-dimensionali t = (t1 , . . . , tk ) di RX ⊂ B k che soddisfano simultaneamente le k disuguaglianze

t1 ≤ x1 , . . . , tk ≤ xk .

46

A. Pollice - Appunti di Probabilità

Esempio 2.10 (cnt) Anche per la funzione di ripartizione del vettore aleatorio discreto (X1 , X2 ) può

essere fornita la seguente rappresentazione in forma tabellare

FX1 X2 (x1 , x2 )

x2

2⊢3

3⊢4

4⊢5

5⊢6

6⊢7

7⊢8

8⊢9

9 ⊢ 10

10 ⊢ 11

11 ⊢ 12

12 ⊢

x1

1⊢2

1/36

3/36

5/36

7/36

9/36

11/36

11/36

11/36

11/36

11/36

11/36

2⊢3

1/36

3/36

6/36

10/36

14/36

18/36

20/36

20/36

20/36

20/36

20/36

3⊢4

1/36

3/36

6/36

10/36

15/36

21/36

25/36

27/36

27/36

27/36

27/36

4⊢5

1/36

3/36

6/36

10/36

15/36

21/36

26/36

30/36

32/36

32/36

32/36

5⊢6

1/36

3/36

6/36

10/36

15/36

21/36

26/36

30/36

33/36

35/36

35/36

6⊢

1/36

3/36

6/36

10/36

15/36

21/36

26/36

30/36

33/36

35/36

1

Esempio 2.12 (cnt) Anche per la funzione di ripartizione del vettore aleatorio discreto (X1 , X2 ) può

essere fornita la seguente rappresentazione in forma tabellare

FX1 X2 (x1 , x2 )

x2

2⊢3

3⊢

x1

1⊢2 2⊢

1/3 1/3

2/3

1

Esempio 2.13 (cnt) Anche per la funzione di ripartizione del vettore aleatorio discreto (X1 , X2 ) può

essere fornita la seguente rappresentazione in forma tabellare

FX1 X2 (x1 , x2 )

x2

1⊢2

2⊢

1⊢2

1/13

1/13

x1

2⊢3

3/13

7/13

3⊢

3/13

1

Considerata la definizione generale di funzione di ripartizione di un vettore aleatorio, la funzione di

ripartizione di un vettore aleatorio continuo X = (X1 , . . . , Xk ) con funzione di densità fX è data da

∫

FX (x) = PX (X ≤ x) =

x1

−∞

∫

···

xk

−∞

fX (t) dt1 · · · dtk

x ∈ Rk

(2.22)

In generale la funzione di densità fX di un vettore aleatorio k-dimensionale continuo X risulta uguale

(eccetto che negli eventuali punti di discontinuità) alla derivata k-esima mista della funzione di ripartizione

FX

fX (x) =

∂ k FX (x1 , . . . , xk )

∂x1 · · · ∂xk

(2.23)

Cap.2: Eventi numerici e variabili aleatorie

47

Esempio 2.14 (cnt) Il calcolo della funzione di ripartizione per l’esempio 2.14 porta alla seguente

funzione a tratti

0

x1 < 0 ∨ x2 < 0

( 2

)

1

2

0 < x1 < 1 ∧ 0 < x2 < 1

8 x1 x2 7x1 + x2

(

)

1

x2 7 + x22

x1 > 1 ∧ 0 < x2 < 1

FX1 ,X2 (x1 , x2 ) =

8

( 2

)

1

0 < x1 < 1 ∧ x2 > 1

8 x1 7x1 + 1

1

x1 > 1 ∧ x2 > 1

La determinazione della funzione di ripartizione implica il calcolo dei seguenti tre integrali

3

8

∫ x ∫ x

1

2

0

0

2

∫ 1∫ x

3

2

8

0

0

∫ x ∫ 1

1

3

8

0

0

2

7t1 + t2 dt1 dt2 =

2

1

8

2

7t1 + t2 dt1 dt2 =

2

2

7t1 + t2 dt1 dt2 =

(

)

2

2

x1 x2 7x1 + x2

1

8

1

8

(

)

2

x2 7 + x2

(

)

2

x1 7x1 + 1

Esempio 2.15 (cnt) La funzione di ripartizione relativa all’esempio 2.15 è la seguente

0

2x21 x22 − x42

x41

FX1 ,X2 (x1 , x2 ) =

2x22 − x42

1

x1 < 0 ∨ x2 < 0

0 < x2 < x1 < 1

0 < x 1 < 1 ∧ x1 < x 2

x1 > 1 ∧ 0 < x 2 < 1

x1 > 1 ∧ x2 > 1

A causa della particolare forma dell’insieme di definizione della variabile aleatoria doppia, la

determinazione della funzione di ripartizione implica il calcolo dei seguenti tre integrali

8

∫ x ∫ t

2

1

0

t1 t2 dt1 dt2 + 8

x2

8

∫ x ∫ t

1

1

0

8

∫ x ∫ t

2

1

0

2.6

∫ x ∫ x

1

2

0

0

0

t1 t2 dt1 dt2 + 8

0

2 2

4

t1 t2 dt1 dt2 = 2x1 x2 − x2

4

t1 t2 dt1 dt2 = x1

∫ 1 ∫ x

2

x2

0

2

4

t1 t2 dt1 dt2 = 2x2 − x2

Distribuzioni marginali e condizionate

Dato un vettore aleatorio k-dimensionale X si può essere interessati al comportamento probabilistico di

un sottoinsieme di un numero h < k di sue componenti.

Definizione 2.14 Sia X un vettore aleatorio discreto k-dimensionale con funzione di probabilità pX . La

48

A. Pollice - Appunti di Probabilità

funzione di probabilità marginale di un sottoinsieme di h < k delle sue componenti è data da

∑

∑

pX1 ,...,Xh (x1 , . . . , xh ) =

···

pX (x1 , . . . , xh , th+1 , . . . , tk )

(th+1 ,...,tk )∈A

(2.24)

{

}

con A = (th+1 , . . . , tk ) ∈ Rk−h : (x1 , . . . , xh , th+1 , . . . , tk ) ∈ RX

Quindi la funzione di probabilità marginale di un sottoinsieme di h componenti di un vettore aleatorio

k-dimensionale X restituisce la probabilità associata alla h-upla di valori x1 , . . . , xh , ovvero

pX1 ,...,Xh (x1 , . . . , xh ) = PX1 ,...,Xh (X1 = x1 , . . . , Xh = xh )

(2.25)

Esempio 2.10 (cnt) Le due funzioni di probabilità marginali del minimo e della somma dei risultati

del lancio di due dadi sono facilmente ottenibili sommando le righe e le colonne della tabella in cui è

rappresentata la funzione di probabilità congiunta

pX1 X2 (x1 , x2 )

x2

2

3

4

5

6

7

8

9

10

11

12

pX1 (x1 )

x1

1

1/36

2/36

2/36

2/36

2/36

2/36

0

0

0

0

0

11/36

2

0

0

1/36

2/36

2/36

2/36

2/36

0

0

0

0

1/4

3

0

0

0

0

1/36

2/36

2/36

2/36

0

0

0

7/36

4

0

0

0

0

0

0

1/36

2/36

2/36

0

0

5/36

5

0

0

0

0

0

0

0

0

1/36

2/36

0

1/12

6

0

0

0

0

0

0

0

0

0

0

1/36

1/36

pX2 (x2 )

1/36

1/18

1/12

1/9

5/36

1/6

5/36

1/9

1/12

1/18

1/36

Esempio 2.12 (cnt) Le due funzioni di probabilità marginali del numero più piccolo e di quello più

grande ottenuti estraendo in blocco due numeri dai primi tre interi sono facilmente ottenibili sommando

le righe e le colonne della tabella in cui è rappresentata la funzione di probabilità congiunta

pX1 X2 (x1 , x2 )

x2

2

3

pX1 (x1 )

x1

1

1/3

1/3

2/3

2

0

1/3

1/3

pX2 (x2 )

1/3

2/3

Esempio 2.13 (cnt) Come nel caso precedente si ha

pX1 X2 (x1 , x2 )

x2

1

2

pX1 (x1 )

1

1/13

0

1/13

x1

2

2/13

4/13

6/13

3

0

6/13

6/13

pX2 (x2 )

3/13

10/13

Cap.2: Eventi numerici e variabili aleatorie

49

Definizione 2.15 Sia X un vettore aleatorio continuo k-dimensionale con funzione di densità fX . La

densità marginale di h < k delle sue componenti è data da

∫

∫

fX1 ···Xh (x1 , . . . , xh ) = · · ·

fX (x1 , . . . , xh , th+1 , . . . , tk ) dth+1 · · · dtk

(2.26)

Rk−h

Esempio 2.14 (cnt) L’applicazione della definizione precedente porta alle due seguenti densità

marginali

∫ ∞

fX1 (x1 ) =

fX1 X2 (x1 , t2 ) dt2

−∞

∫ 1

3

=

8

∫

fX2 (x2 ) =

7x21 + t22 dt2 =

0

∞

3

8

0 < x1 < 1

fX1 X2 (t1 , x2 ) dt1

−∞

∫ 1

=

)

1(

21x21 + 1

8

7t21 + x22 dt1 =

0

)

1(

7 + 3x22

8

0 < x2 < 1

Esempio 2.15 (cnt) Con ragionamento analogo all’esempio precedente, e considerando il particolare

insieme di definizione della variabile doppia si ottiene

∫ ∞

fX1 X2 (x1 , t2 ) dt2

fX1 (x1 ) =

−∞

∫ x1

= 8

x1 t2 dt2 = 4x31 0 < x1 < 1

0

∫ ∞

fX2 (x2 ) =

fX1 X2 (t1 , x2 ) dt1

−∞

∫ 1

= 8

)

(

t1 x2 dt1 = 4x2 1 − x22

0 < x2 < 1

x2

Tramite la funzione di probabilità marginale e la funzione di densità marginale è possibile ricavare la

funzione di ripartizione marginale di un sottoinsieme di h componenti del vettore aleatorio k-dimensionale

X a seconda che esso sia rispettivamente discreto o continuo (mediante somma o integrazione). Inoltre

in entrambi i casi la funzione di ripartizione marginale può essere ricavata dalla funzione di ripartizione

congiunta della X

FX1 ,...,Xh (x1 , . . . , xh ) =

FX (x1 , . . . , xh , th+1 , . . . , tk )

lim

th+1 → ∞

..

.

tk → ∞

= FX (x1 , . . . , xh , ∞, . . . , ∞)

= PX (X1 ≤ x1 , . . . , Xh ≤ xh , Xh+1 ≤ ∞, . . . , Xk ≤ ∞)

= PX1 ,...,Xh (X1 ≤ x1 , . . . , Xh ≤ xh )

L’estensione del concetto di probabilità condizionata alle variabili aleatorie porta alla considerazione

di funzioni di probabilità e di densità condizionate.

50

A. Pollice - Appunti di Probabilità

Definizione 2.16 Dato un vettore aleatorio discreto X con funzione di probabilità pX , la funzione di

probabilità condizionata di un sottoinsieme di h < k elementi di X restituisce la probabilità associata a

tali elementi dato che i restanti k − h assumano un certo valore

pX1 ···Xh |Xh+1 ···Xk (x1 , . . . , xh |xh+1 , . . . , xk )

= PX1 ···Xh |Xh+1 ···Xk (X1 = x1 , . . . , Xh = xh | Xh+1 = xh+1 , . . . , Xk = xk )

=

pX (x1 , . . . , xh , xh+1 , . . . , xk )

pXh+1 ···Xk (xh+1 , . . . , xk )

(2.27)

La definizione precedente è valida a condizione che sia pXh+1 ···Xk (xh+1 , . . . , xk ) > 0.

Esempio 2.10 (cnt) La funzione di probabilità condizionata pX1 |X2 (x1 |4) è ottenuta dividendo per la

loro somma gli elementi della terza riga della tabella in cui è rappresentata la funzione di probabilità

congiunta. Risulta

2

x1 = 1

3

1

x1 = 2

pX1 |X2 (x1 |4) =

3

0

altrove

Viceversa la funzione di probabilità condizionata pX2 |X1 (x2 |4) è ottenuta dividendo per la loro somma

gli elementi della quarta colonna della tabella

1

x2 = 8

5

x2 = 9

25

pX2 |X1 (x2 |4) =

2

x2 = 10

5

0

altrove

Definizione 2.17 Dato un vettore aleatorio continuo X con funzione di densità fX , la funzione di densità

di un sottoinsieme di h < k elementi di X condizionata a che i restanti k − h assumano un valore noto è

definita da

fX (x1 , . . . , xh , xh+1 , . . . , xk )

(2.28)

fX1 ···Xh |Xh+1 ···Xk (x1 , . . . , xh |xh+1 , . . . , xk ) =

fXh+1 ···Xk (xh+1 , . . . , xk )

La definizione precedente è valida a condizione che sia fXh+1 ···Xk (xh+1 , . . . , xk ) > 0.

Cap.2: Eventi numerici e variabili aleatorie

51

Esempio 2.14 (cnt) Le due funzioni di densità condizionate sono date da

fX1 |X2 (x1 |x2 ) =

3(7x21 +x22 )

7+3x22

0 < x1 < 1

fX2 |X1 (x2 |x1 ) =

3(7x21 +x22 )

21x21 +1

0 < x2 < 1

Esempio 2.15 (cnt) Le due funzioni di densità condizionate sono date da

fX1 |X2 (x1 |x2 ) =

fX2 |X1 (x2 |x1 ) =

2.7

x2 ≤ x1 < 1

2x1 x2

x2 (1−x22 )

2x1 x2

x31

0 < x2 ≤ x1

Indipendenza tra variabili aleatorie

In questo paragrafo viene introdotto un concetto che generalizza quello di indipendenza tra due o più

eventi e che riguarda le variabili aleatorie.

Definizione 2.18 Se FX1 X2 è la funzione di ripartizione congiunta di X1 e X2 ed FX1 e FX2 sono le due

distribuzioni marginali, le due variabili aleatorie si dicono stocasticamente indipendenti se vale

FX1 X2 (x1 , x2 ) = FX1 (x1 ) FX2 (x2 )

(x1 , x2 ) ∈ R2

(2.29)

In particolare per le variabili aleatorie discrete la definizione di indipendenza è trasferita alla funzione

di probabilità

pX1 X2 (x1 , x2 ) = pX1 (x1 ) pX2 (x2 )

(x1 , x2 ) ∈ R2

(2.30)

Esempio 2.10 Gli elementi della variabile doppia in questione non sono stocasticamente indipendenti.

Per verificare ciò si consideri ad esempio la coppia (x1 , x2 ) = (2, 7) (si può procedere analogamente con

altre coppie di valori)

2

1 1

pX1 X2 (2, 7) =

̸= · = pX1 (2) · pX2 (7)

36

4 6

Per le variabili aleatorie continue la definizione di indipendenza riguarda la funzione di densità

fX1 X2 (x1 , x2 ) = fX1 (x1 ) fX2 (x2 )

(x1 , x2 ) ∈ R2

(2.31)

Esempio 2.14 (cnt) Anche in questo caso le due variabili X1 e X2 non sono indipendenti, infatti

fX1 X2 (x1 , x2 ) =

)1(

) 1(

)

3( 2

7x1 + x22 ̸=

21x21 + 1

7 + 3x22 = fX1 (x1 ) fX2 (x2 )

8

8

8

La definizione precedente è generalizzabile a un numero di variabili aleatorie superiore a due.

52

A. Pollice - Appunti di Probabilità

Definizione 2.19 Se FX1 ···Xk è la funzione di ripartizione congiunta del vettore aleatorio X = (X1 , . . . , Xk )

ed FXi sono le distribuzioni marginali delle componenti unidimensionali Xi per i = 1, . . . , k, queste ultime

si dicono (stocasticamente) mutualmente indipendenti se vale

FX1 ···Xk (x1 , . . . , xk ) =

k

∏

FXi (xi )

(x1 , . . . , xk ) ∈ Rk

(2.32)

i=1

Si noti che la mutua indipendenza delle componenti del vettore aleatorio X = (X1 , . . . , Xk ) implica

quella di tutti i possibili accoppiamenti delle sue componenti unidimensionali. Il contrario non è altrettanto

vero: se tutte le possibili coppie di componenti unidimensionali di X sono indipendenti, non è detto che

lo siano mutuamente tutte le k componenti.

La funzione di ripartizione di un vettore aleatorio (X1 , . . . , Xk ) permette di studiare dal un punto

di vista probabilistico il comportamento di tale vettore aleatorio e quindi anche le relazioni tra le variabili aleatorie componenti Xi . Al contrario le funzioni di ripartizione marginali non forniscono alcuna

informazione sulle relazioni tra le stesse variabili aleatorie.

2.8

Trasformazioni di variabili aleatorie

Sia g (·) una funzione misurabile definita su Rk e a valori in Rh ed X una variabile aleatoria k-dimensionale,

allora Y = g (X), ovvero

Y1 = g1 (X1 , . . . , Xk )

..

.

Yh = gh (X1 , . . . , Xk )

è una variabile aleatoria h-dimensionale. In tal caso, poiché Y è funzione di X, la funzione di ripartizione

di Y può essere ottenuta attraverso la funzione di probabilità (nel caso discreto) o la funzione di densità

(nel caso continuo) della X

({

})

FY (y) = PY (Y ≤ y) = PX

t ∈ Rk : g (t) ≤ y

(2.33)

In particolare nel caso in cui X ed Y = g (X) siano variabili aleatorie discrete unidimensionali (k =

h = 1) si può ricavare la funzione di probabilità della Y da quella della X

pY (y) = PY (Y = y)

= PX (g (X) = y)

= PX ({t ∈ R : g (t) = y})

∑

=

pX (t)

{t∈R:g(t)=y}

(2.34)

Cap.2: Eventi numerici e variabili aleatorie

53

Esempio 2.15 Si consideri la variabile aleatoria discreta X corrispondente al risultato del lancio di

un dado e la sua trasformazione Y = (X − 4)2 . Tale trasformazione non è biunivoca: alcuni punti

nell’insieme di definizione della Y , dato da RY = {x ∈ R : x = 0, 1, 4, 9}, corrispondono a coppie di punti

dell’insieme di definizione della X, dato da RX = {x ∈ R : x = 1, 2, 3, 4, 5, 6}. Pertanto la funzione di

probabilità di Y è data da

1

y=0

6

1

1

y=1

6 + 6

1

1

y=4

pY (y) =

6 + 6

1

y=9

6

0

altrove

Si noti che qualora la funzione g sia anche biunivoca, ovvero invertibile, cioè qualora vi sia corrispondenza biunivoca tra i valori di Y e quelli di X, le due variabili aleatorie

assumono

valori diversi tra loro,

(

)

ma con le stesse probabilità, infatti in tal caso PY (Y = y) = PX X = g −1 (y) .

Nel caso in cui la variabile aleatoria X sia unidimensionale e continua e la funzione g sia strettamente

monotona con derivata prima continua (ovvero nel caso in cui esista la funzione inversa di g e sia derivabile),

anche la variabile aleatoria Y = g (X) è unidimensionale e continua, inoltre se fX è la funzione di densità

della X si ha

FY (y) = PX (g (X) ≤ y)

(

)

= PX X ≤ g −1 (y)

∫ g−1 (y)

fX (t)dt

=

−∞

∫ y

( −1 ) dg −1 (s) ds

=

fX g (s) ds (2.35)

−∞

Per ottenere l’espressione∫ finale si è operata la trasformazione s = g (t) della variabile di integrazione.

y

Inoltre essendo FY (y) = −∞ fY (s) ds dall’espressione precedente si ricava

(

fY (y) = fX g

−1

) dg −1 (y) (y) dy (2.36)

Esempio 2.16 Sia X una variabile aleatoria continua con densità uniforme nell’intervallo (0, 1). La

trasformazione Y = − log X ha come dominio l’intervallo (0, 1) e come codominio la semiretta (0, ∞),

pertanto l’insieme di definizione della variabile aleatoria Y è (0, ∞). La funzione di densità della variabile

aleatoria Y è data da

y>0

1 × |−e−y | = e−y

fY (y) =

0

altrove

Tale funzione di densità è detta esponenziale di parametro 1.

54

A. Pollice - Appunti di Probabilità

Quanto appena asserito per le variabili aleatorie unidimensionali discrete e continue può essere facilmente esteso al caso di vettori aleatori. Infatti se X = (X1 , . . . , Xk ) ed Y = (Y1 , . . . , Yh ) sono vettori

aleatori discreti, vale analogamente

∑

pY (y1 , . . . , yh ) =

pX (t1 , . . . , tk )

(2.37)

k :g(t ,...,t )=(y ,...,y )

(t

,...,t

)∈R

{ 1 k

1

1

k

h }

Esempio 2.17 Si consideri il vettore aleatorio discreto (X1 , X2 ) corrispondente al risultato del lancio

di due dadi distinti e la sua trasformazione

{

Y1 = X1 + X2

Y2 = X1 − X2

La funzione di probabilità di (X1 , X2 ) è rappresentata da

pX1 X2 (x1 , x2 )

x2

1

2

3

4

5

6

x1

1

1/36

1/36

1/36

1/36

1/36

1/36

2

1/36

1/36

1/36

1/36

1/36

1/36

3

1/36

1/36

1/36

1/36

1/36

1/36

4

1/36

1/36

1/36

1/36

1/36

1/36

5

1/36

1/36

1/36

1/36

1/36

1/36

6

1/36

1/36

1/36

1/36

1/36

1/36

Con qualche calcolo si perviene alla seguente funzione di probabilità per il vettore aleatorio (Y1 , Y2 )

pY1 Y2

y2

−5

−4

−3

−2

−1

0

1

2

3

4

5

2

0

0

0

0

0

1/36

0

0

0

0

0

3

0

0

0

0

1/36

0

1/36

0

0

0

0

4

0

0

0

1/36

0

1/36

0

1/36

0

0

0

5

0

0

1/36

0

1/36

0

1/36

0

1/36

0

0

6

0

1/36

0

1/36

0

1/36

0

1/36

0

1/36

0

y1

7

1/36

0

1/36

0

1/36

0

1/36

0

1/36

0

1/36

8

0

1/36

0

1/36

0

1/36

0

1/36

0

1/36

0

9

0

0

1/36

0

1/36

0

1/36

0

1/36

0

0

10

0

0

0

1/36

0

1/36

0

1/36

0

0

0

11

0

0

0

0

1/36

0

1/36

0

0

0

0

12

0

0

0

0

0

1/36

0

0

0

0

0

Si noti che tale trasformazione è biunivoca: ciascuna coppia di punti dell’insieme di definizione della Y

corrisponde a una sola coppia di punti dell’insieme di definizione della X.

Cap.2: Eventi numerici e variabili aleatorie

55

Nel caso in cui il vettore aleatorio k-dimensionale X sia continuo, la funzione g sia invertibile e la sua

inversa g −1 sia derivabile, allora anche il vettore aleatorio Y = g (X) è k-dimensionale e continuo,

Y1 = g1 (X1 , . . . , Xk )

..

(2.38)

.

Yk = gk (X1 , . . . , Xk )

inoltre se fX è la funzione di densità della X si ha

FY (y)

=

(

)

FX g −1 (y)

∫ g−1 (y1 ,...,yk )

1

=

−∞

∫ y1

=

−∞

∫

···

yk

−∞

∫

···

−1

gk

(y1 ,...,yk )

−∞

fX (t1 , . . . , tk ) dt1 · · · dtk

(2.39)

(

)

fX g1−1 (s1 , . . . , sk ) , . . . , gk−1 (s1 , . . . , sk ) |det J| dṡ1 · · · dsk

Dove nell’espressione precedente si è operata la trasformazione

s1 = g1 (t1 , . . . , tk )

..

.

sk = gk (t1 , . . . , tk )

delle variabili di integrazione, e J è la matrice jacobiana della trasformazione data da

J =

Inoltre essendo FY (y) =

∫ y1

∫ yk

−∞ · · · −∞ fY

∂g1−1

∂s1

···

..

.

∂gk−1

∂s1

∂g1−1

∂sk

..

.

···

∂gk−1

∂sk

(2.40)

(s1 , . . . , sk ) ds1 · · · dsk dall’espressione precedente si ricava

(

)

fY (y) = fX g1−1 (y1 , . . . , yk ) , . . . , gk−1 (y1 , . . . , yk ) |det J|

(2.41)

56

A. Pollice - Appunti di Probabilità

Esempio 2.18 Sia (X1 , X2 ) un vettore aleatorio continuo le cui componenti siano indipendenti ed

abbiano entrambe distribuzione uniforme nell’intervallo (0, 1). La trasformazione biunivoca

{

Y1 = X1 − X2

Y2 = X2

ha come dominio l’insieme (0, 1) × (0, 1). La trasformazione inversa è

{

X1 = Y1 + Y2

X2 = Y2

pertanto la matrice jacobiana della trasformazione è data da

(

)

1 1

J=

0 1

la funzione di densità del vettore aleatorio (Y1 , Y2 ) è dunque data da

(

)

fY1 Y2 (y1 , y2 ) = fX1 X2 g1−1 (y1 , y2 ) , g2−1 (y1 , y2 ) |det J|

= 1 × 1 × |1|

0 < y1 + y2 < 1, 0 < y2 < 1

1

=

0

altrove

Si noti come la trasformazione g (X) dia luogo a un insieme di defizione non banale per la Y , in corrispondenza di quello della X. Tale insieme di definizione ha infatti la forma di un parallelepipedo delimitato

dalle rette y2 = 0, y2 = 1, y2 = −y1 ed y2 = 1 − y1 . Se si vuole ottenere la densità marginale fY1 (y1 )

della variabile aleatoria Y1 = X1 − X2 bisogna integrare la densità congiunta fY1 Y2 (y1 , y2 ) rispetto a y2

nel dominio di integrazione opportuno, ovvero nell’insieme di definizione della sola Y2 . Risulta che

∫

fY1 (y1 ) =

fY1 Y2 (t1 , t2 ) dt2

RY2

∫1

−y1 dt2 = 1 + y1

∫ 1−y1

=

dt2 = 1 − y1

0

0

−1 < y1 < 0

0 < y1 < 1

altrove

Per la sua forma grafica l’espressione precedente è detta densità triangolare.

Operando in modo analogo all’esempio appena riportato è possibile individuare l’epressione generale

della densità della somma S di due variabili aleatorie X1 e X2 indipendenti, aventi rispettivamente densità

fX1 ed fX2

∫

fS (s) =

fX1 (s − t2 ) fX2 (t2 ) dt2

(2.42)

R

Nell’integrale precedente, anche detto convoluzione per funzioni di densità, il dominio di integrazione va

adattato opportunamente all’insieme di definizione delle variabili aleatorie X1 e X2 , dove le funzioni di

densità sono positive.

Cap.2: Eventi numerici e variabili aleatorie

57

Esempio 2.19 Siano X1 e X2 due variabili aleatorie indipendenti entrambe con distribuzione esponenziale di parametro 1. Si noti che la densità esponenziale è positiva per valori positivi della variabile aleatoria, pertanto l’insieme di integrazione dell’espressione precedente deve essere tale che valgano

simultaneamente s − t2 > 0 e t2 > 0

∫ s

fS (s) =

e−(s−t2 ) e−t2 dt2 = s e−s s > 0

0

L’espressione precedente è detta densità gamma di parametri 1 e 2.