1

1.1

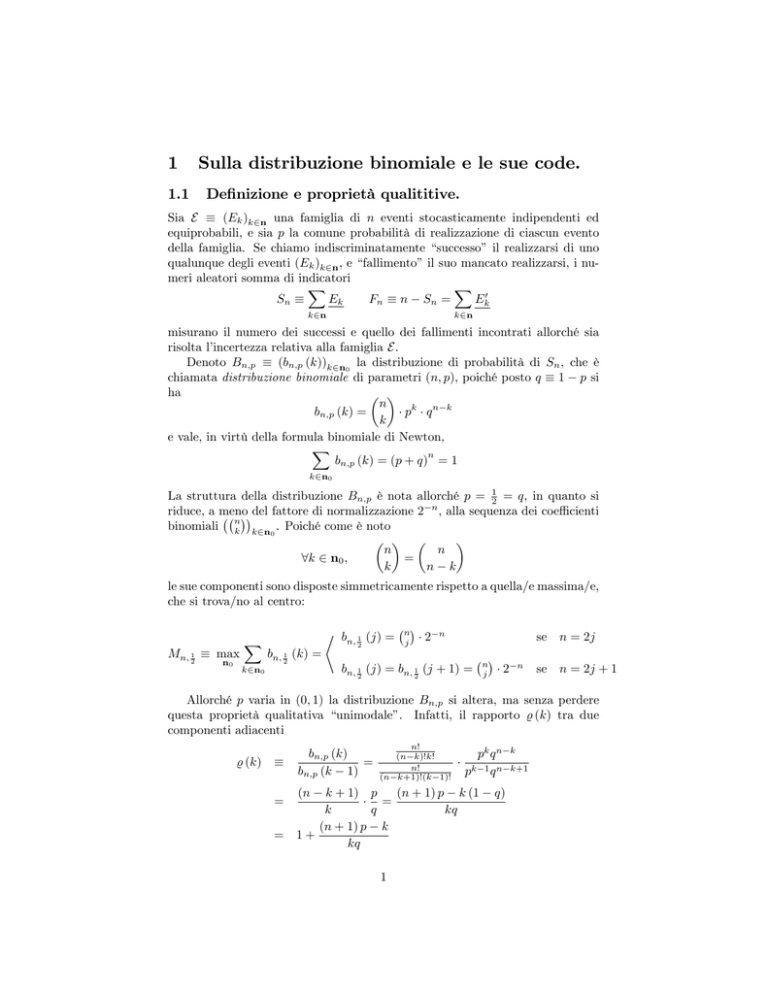

Sulla distribuzione binomiale e le sue code.

De…nizione e proprietà qualititive.

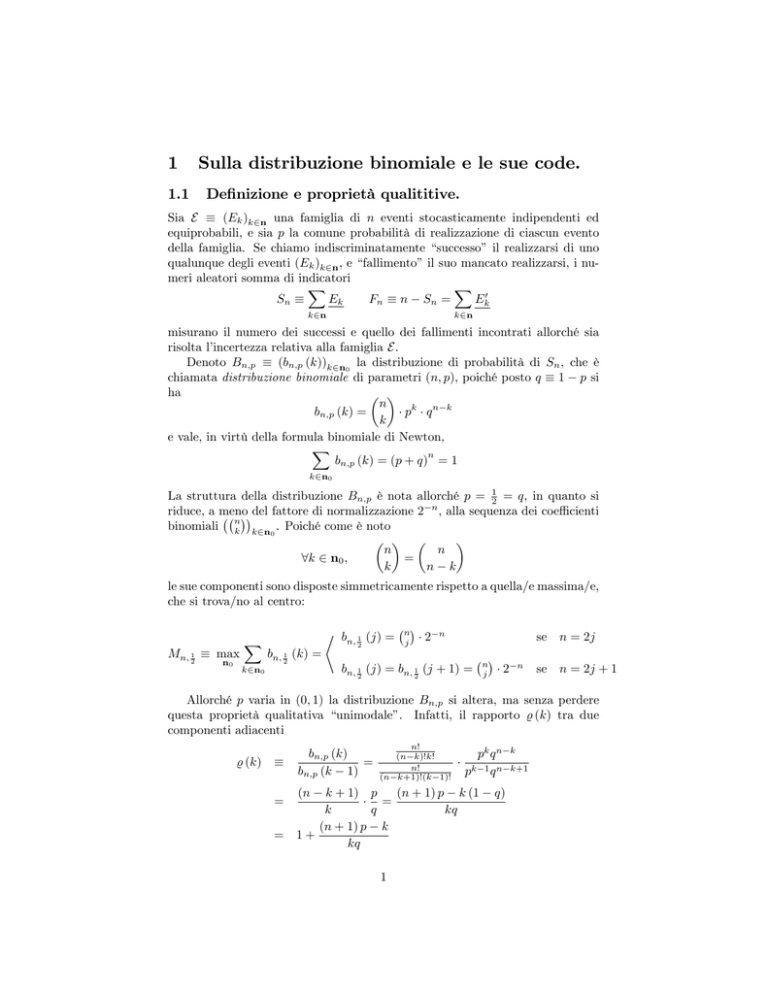

Sia E

(Ek )k2n una famiglia di n eventi stocasticamente indipendenti ed

equiprobabili, e sia p la comune probabilità di realizzazione di ciascun evento

della famiglia. Se chiamo indiscriminatamente “successo” il realizzarsi di uno

qualunque degli eventi (Ek )k2n , e “fallimento” il suo mancato realizzarsi, i numeri aleatori somma di indicatori

X

X

Fn n S n =

Ek0

Sn

Ek

k2n

k2n

misurano il numero dei successi e quello dei fallimenti incontrati allorché sia

risolta l’incertezza relativa alla famiglia E.

Denoto Bn;p

(bn;p (k))k2n0 la distribuzione di probabilità di Sn , che è

chiamata distribuzione binomiale di parametri (n; p), poiché posto q 1 p si

ha

n

bn;p (k) =

pk q n k

k

e vale, in virtù della formula binomiale di Newton,

X

n

bn;p (k) = (p + q) = 1

k2n0

La struttura della distribuzione Bn;p è nota allorché p = 21 = q, in quanto si

riduce, a meno del fattore di normalizzazione 2 n , alla sequenza dei coe¢ cienti

binomiali nk k2n . Poiché come è noto

0

8k 2 n0 ;

n

k

=

n

n

k

le sue componenti sono disposte simmetricamente rispetto a quella/e massima/e,

che si trova/no al centro:

Mn; 21

max

n0

X

bn; 12 (k) =

k2n0

* b 1 (j) =

n; 2

n

j

2

n

n

j

bn; 12 (j) = bn; 21 (j + 1) =

n

2

se

n = 2j

se

n = 2j + 1

Allorché p varia in (0; 1) la distribuzione Bn;p si altera, ma senza perdere

questa proprietà qualitativa “unimodale”. Infatti, il rapporto % (k) tra due

componenti adiacenti

bn;p (k)

=

bn;p (k 1)

% (k)

=

=

n!

(n k)!k!

n!

(n k+1)!(k 1)!

(n

pk q n

k + 1) p

(n + 1) p k (1

=

k

q

kq

(n + 1) p k

1+

kq

1

k

pk 1 q n k+1

q)

1

p

e 1 + p nqnq = nq

.

è decrescente con k 2 n tra i valori estremi 1 + (n+1)p

q

Pertanto % (k) si mantiene comunque minore di 1 e, se già vale % (1) < 1, cioè se

n<

1

p

1=

q

p

o, equivalentemente, p <

1

n+1

allora Bn;p è a componenti costantemente decrescenti.

In caso contrario, cioè per n su¢ cientemente grande, ossia se

n

q

p

o, equivalentemente, p

1

n+1

il rapporto tra le componenti adiacenti di Bn;p è inizialmente maggiore di 1, per

divenire poi minore di 1 non appena l’indice k “abbia attraversato” la soglia1

(n + 1) p. Se tale soglia è un numero intero mn;p , vi sono due uguali componenti massime di Bn;p , precisamente bn;p (mn;p ) e bn;p (mn;p 1). Altrimenti,

la componente massima è quella di massimo indice inferiore a (n + 1) p, cioè

l’indice b(n + 1) pc (parte intera inferiore di (n + 1) p). Per de…nizione di parte

intera inferiore, b(n + 1) pc = (n + 1) p quando (n + 1) p è intero, e quindi

b(n + 1) pc

(n + 1) p < b(n + 1) pc + 1

Ne segue che in entrambi i casi la posizione

mn;p

b(n + 1) pc

identi…ca l’indice del massimo di Bn;p ; questo valore massimo è tuttavia raggiunto anche per l’indice precedente se mn;p = (n + 1) p, cioè se (n + 1) p è

intero.

q

Proposizione: 1. Se n

p , la distribuzione Bn;p è a componenti strettamente decrescenti, con la possibile eccezione delle prime due, che coincidono se

n = pq . 2. Se n > pq , allorché k cresce tra 0 e n, i termini della sequenza …nita

(bn;p (k))k2n0 prima aumentano e poi diminuiscono.

1 Nell’ipotesi

fatta, la soglia (n + 1) p è appunto maggiore o uguale ad 1.

2

1.2

Media e varianza della distribuzione binomiale

E (Sn )

=

X

k bn;p (k) =

=

k2n

=

X

n!

k

pk q n

(n k)!k!

X n

k

1

1

k2n

X

= np

n 1

X

k 2 bn;p (k) =

k2n0

= np

X

n

k

k

k2n

= np

X

1

1

= np @

X

h2(n 1)0

= np ((n

1

q (n

1) (k 1)

1

1

ph q n

1 h

ph q n

h

k

1 h

1 h

+

X

h2(n 1)0

1) p + 1) = np (np + q)

var (Sn ) = E Sn2

1.3

h

k

1) (k 1)

ph q n

pk q n

h

n

q (n

n

k

n

h2(n 1)0

0

k

k2

pk

(h + 1)

1

k

= np

k2n0

X

1

h

= np (p + q)

=

pk

n

h2(n 1)0

E Sn2

pk q n

(n 1)!

pk q n

(n k)! (k 1)!

n

k2n

= np

n

k

k

k2n0

k2n0

X

X

E 2 (Sn ) = np (np + q)

n

1

h

ph q n

n2 p2 = npq

Una stima della probabilità che si veri…chino almeno

r successi, allorché r è maggiore di np.

Voglio ottenere una stima (per eccesso) della “coda destra” della distribuzione Bn;p , cioè della probabilità dell’evento (Sn r) allorché r è maggiore2

di np (e di mn;p ). A tal …ne procedo ad una maggiorazione delle componenti

(bn;p (k))k2n\(r 1)c mediante quelle corrispondenti di una progressione geometrica, sostituendo (k) (che varia con k) con un numero indipendente da k, ma

2 S’intende che non ha senso parlare di stima se la coda si riduce al solo ultimo termine

(che basta calcolare direttamente); pertanto posso anche supporre r < n.

3

1

1 hA

sempre strettamente compreso tra

(k) e 1. Tale numero è

1+

np r

rq

Infatti, per k > r > np, si ha

1+

np r

(n + 1) p

>1+

rq

kq

k

np r

(n + 1) p k

>

rq

kq

nkp rk > r (n + 1) p rk

nk > r (n + 1)

r

k>r+

n

()

()

()

()

dove la disuguaglianza …nale, per essere k ed n due interi, e

veri…cata. Posso trarre una prima conseguenza:

prob (Sn

r)

=

<

n

X

k=r

+1

X

bn;p (k) <

n

X

bn;p (r) 1 +

k=r

bn;p (r) 1 +

k=r

np r

rq

r

n

np r

rq

k r

= bn;p (r)

minore di 1, è

k r

rq

np r

Per rendere la stima realmente signi…cativa devo ancora stimare bn;p (r); valore

che è maggiorato da tutte le componenti di Bn;p il cui indice è compreso tra m

ed r 1. Poiché tali indici non esauriscono l’insieme di quelli che descrivono la

distribuzione, posso scrivere

1>

r

X

r

X

bn;p (k) >

k=mn;p

bn;p (r) = (r

mn;p + 1) bn;p (r)

k=mn;p

pervenendo così alla stima

bn;p (r) <

r

1

(mn;p

1)

<

1

r

np

dove ho tenuto conto che la posizione reciproca di np e mn;p = b(n + 1) pc non

è determinata, ma vale senz’altro

mn;p

1 < mn;p

p = b(n + 1) pc

In conclusione,

prob (Sn

1.4

r) <

p

rq

(np

2

r)

(n + 1) p

p = np

(r > np)

Una stima della probabilità che non si veri…chino più

r successi, allorché r è minore di np.

Una analoga stima della “coda sinistra”della distribuzione binomiale Bn;p , cioè

della probabilità dell’evento (Sn r), risulta immediatamente disponibile grazie

4

alla conclusione appena raggiunta. Infatti, a¤ermare che il numero dei successi

non supera r equivale ad a¤ermare che il numero dei fallimenti non è inferiore a

n r; posso allora applicare il procedimento del precedente paragrafo al numero

aleatorio Fn , sostituendo r con n r, la probabilità di successo p con quella

di fallimento q, e l’ipotesi r > np (così come l’ipotesi r > mn;p ) con l’ipotesi

n r > nq, che diviene pertanto r < np (risp. n r > mn;p cioè r < n mn;p ).

Ottengo

prob (Fn

n

r) <

rp

(nq

2

n + r)

e in de…nitiva

prob (Sn

1.5

r) <

=

rp

(np

2

r)

rp

(r

2

np)

(r < np)

(r < np)

La legge “debole” dei grandi numeri per la distribuzione binomiale

La stima delle code appena raggiunta assume un aspetto ancora più signi…cativo

qualora si passi a considerare la famiglia di numeri aleatori Snn n2N , ciascuno dei

quali conta il “numero medio di successi”. Come Sn , così anche Snn è descritto

dalla distribuzione Bn;p ; essa però è riferita al dominio nk k2n anziché al

0

dominio n0 . In questo modo tutti i numeri aleatori della famiglia Snn n2N hanno

dominio contenuto nell’intervallo [0; 1], ed è possibile “confrontare meglio” tra

loro le distribuzioni della famiglia (Bn;p )n2N al variare del parametro n. In primo

luogo, esse hanno la stessa media e varianza inferiore (la seconda addirittura

in…nitesima al divergere di n)

E

var

Sn

n

Sn

n

=

=

np

1

E (Sn ) =

=p

n

n

1

npq

pq

var (Sn ) = 2 =

n2

n

n

Inoltre è possibile concludere che, nella famiglia di queste distribuzioni binomiali

riferite al numero medio di successi, la parte “centrale”, cioè quella concentrata

in un intervallo che contiene la media p, assorbe la maggior parte della probabilità, in quantità via via esclusiva.

Infatti, il risultato ottenuto nel paragrafo precedente prende un forma assai espressiva nella formulazione appena introdotta, che ha sempre a¤ascinato

studiose e semplici utenti della teoria della probabilità. Dando ad r il valore

n (p + ") nella stima della coda destra, ed il valore n (p ") nella stima di quella

sinistra, posso scrivere

prob

prob

Sn

n

Sn

n

n (p + ") q

(p + ") q

=

n2 " 2

n"2

n (p ") p

(p ") p

")) <

=

n2 " 2

n"2

p+"

=

prob (Sn

n (p + ")) <

p

=

prob (Sn

n (p

"

5

e concludere per l’evento complementare alle due “code”

prob

Sn

n

p <"

(p + ") q + (p

n"2

>1

") p

=1

p + (1 2p) "

n"2

Proposizione (Legge “debole” dei grandi numeri per la distribuzione binomiale). Sia E (Ek )k2n una famiglia di n eventi stocasticamente indipendenti

ed equiprobabili, e sia p la comune probabilità di realizzazione di ciascun evento

della famiglia. Per ogni n 2 N, il numero aleatorio “frequenza di successi relativi

agli n eventi”

1X

Sn

Ek

n

n

k2n

è retto dalla distribuzione binomiale

n

k

Bn;p

sul dominio

E

Sn

n

k

k2no

k

n

Dn

e si ha

pk q n

[0; 1]

k2no

=p

Sn

n

var

=

pq

n

Fissato " 2 (0; min fp; qg), la probabilità che Snn non appartenga all’intorno

aperto della media p di raggio " è in…nitesima al divergere di n; in altre parole

lim

n !+1

1.6

prob

Sn

n

p <"

=1

Additività della media di numeri aleatori discreti arbitrari

Siano X ed Y due numeri aleatori discreti a distribuzione congiunta

P

(

i;j )i2m;j2n

= (prob [(X = xi ) ^ (Y = yj )])

Le due distribuzioni marginali sono3

PX

= Pe =

X

i i2m

0

X

=@

ij

=

ij

j2n

PY

= e0 P =

Y

j j2n

X

i2m

3 Con

1

A

!i2m

j2n

abuso di notazione, attribuisco dimensione variabile al vettore e, le cui componenti

sono tutte uguali ad 1, in modo ch’esso sia moltiplicabile per la matrice P da ambo i lati.

Precisamente, assumo e0 2 Rm (riga) e e 2 Rn (colonna).

6

Per la media di X e Y procedo in modo parallelo e speculare

0

1

X

X

X

X

X

A=

E (X) =

xi i =

xi @

xi

ij

E (Y )

=

i2m

i2m

X

X

yj

Y

j

j2n

=

j2n

yj

j2n

X

ij

i2m

!

i;j

i2m;j2n

X

=

yj

i;j

i2m;j2n

Le distribuzioni condizionali reciproche si ottengono per normalizzazione tramite

i valori delle marginali

!

pj

ij

=

(j 2 n)

PXj(Y =yj ) =

Y

Y

j

PY j(X=xi )

=

0

ip

X

i

=

j

i2m

ij

X

i

j2n

(i 2 m)

e da queste si costruiscono i numeri aleatori speranza condizionale E (XjY ) e

E (Y jX)

per

E (XjY )

assume

per

E (Y jX)

assume

j 2 n,

8

valore E (Xj (Y = yj ))

>

>

>

>

<

>

>

>

>

:

con probabilità

>

>

>

>

:

con probabilità

7

i2m

=

X

i

P

i2m

P

Y

j

i 2 m,

8

valore E (Y j (X = xi ))

>

>

>

>

<

P

i2m

P

j2n

=

P

j2n

P

j2n

xi prob (X = xi jY = yj )

xi

ij

Y

j

ij

yj prob (Y = yj j (X = xi ))

yj

ij

ij

X

i

L’additività dell’operatore di calcolo della media può essere mostrata in due

modi. Il primo è a questo punto molto più semplice e diretto, e ammonta a

svolgere due riordinamenti speculari dell’ordine di sommatoria. Il secondo è più

complesso e farraginoso, ma a¤ronta in maggiore dettaglio la struttura delle

relazioni condizionali che intercorrono tra i due numeri aleatori.

1:

E (X + Y )

=

X

(xi + y;j )

i2m;j2n

X

=

i2m

X

=

0

xi @

X

j2n

X

i

xi

+

i2m

ij

1

A+

ij

X

X

yj

j2n

X

i2m

ij

!

Y

j

yj

j2n

= E (X) + E (Y )

2:

E (X + Y )

=

X

(xi + y;j )

ij

i2m;j2n

=

X

i2m

=

X

i2m

=

X

i2m

0

X

@

xi

ij

j2n

0

X

xi @

j2n

xi

X

i

+

ij

+

1

X

A+

X

X

i2m

X

i E

i2m

= E (X) + E [E (Y !X)]

= E (X) + E (Y )

8

yj

j2n

ij

1

A

0

X

X@

yj

i

j2n

(Y j (X = xi ))

ij

X

i

1

A