Esercizio 8

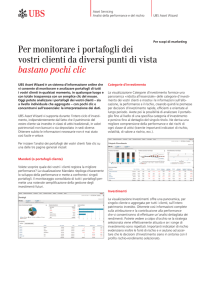

La Swiss Economic Research della Union Bank of Switzerland conduce un controllo periodico dei livelli dei prezzi e

dei salari nella principali città del mondo. Una delle variabili rilevate è il prezzo dell’hamburger Big Mac, Y (misurato

in termini del logaritmo del numero di minuti-lavoro necessari per acquistare un Big Mac). Il Big Mac è un bene

di consumo assai comune, le cui caratteristiche sono identiche in tutto il mondo e, quindi, ci si aspetta che il suo

prezzo, in termini reali, sia identico ovunque. Ovviamente, questa affermazione non è vera e gli economisti utilizzano

il cosiddetto indice di parità Big Mac per valutare l’inefficenza del sistema di cambi valutari. Ci si pone l’obbiettivo

di costruire un modello di regressione lineare multipla che spieghi la variabilitá di Y in 57 città (l’anno di riferimento

è il 2000) utilizzando i seguenti predittori (tutte le variabili sono contenute nel file ubs.txt:

X1 : logaritmo naturale del salario reale medio. Il salario reale medio (ovvero il potere d’acquisto del salario

medio) di ogni città è commisurato, in termini percentuali, al salario reale medio di Zurigo. La variabile X1 è

quindi il logaritmo (naturale) di questa percentuale.

X2 : logaritmo naturale del numero di minuti-lavoro necesari per acquistare un Kg. di riso

X3 : logaritmo naturale del numero di giorni di vacanza remunerati nell’arco dell’anno

X4 : logaritmo naturale del numero di minuti-lavoro necesari per acquistare un Kg. di pane

D5 : variabile indicatrice = 1 se la città si trova in Asia, = 0 altrimenti

D6 : variabile indicatrice = 1 se la città si trova in Europa, Nord-America o Oceania, = 0 altrimenti

Ne segue, ovviamente che le aree geografiche di riferimento sono Africa e America del Sud.

1. Disegnare i diagrammi di dispersione di Y contro X j , j = 1, . . . , 4 utilizzando simboli diversi per ciascuna area

geografica di riferimento e proporre dei commenti adeguati.

2. Stimare un modello di regressione lineare multipla in cui le variabili esplicative siano costituite da X j , j = 1, . . . , 4,

D5 e D6 . Analizzare i residui del modello e commentare i risultati.

3. Generalizzare il modello da cui si è partiti nel punto 2., inserendo i seguenti otto termini di interazione:X j Ds , j =

1, . . . , 4, s = 5, 6. e selezionare le variabili in modo adeguato.

4. Scrivere l’equazione stimata del modello a cui si è pervenuti

5. Analizzare i residui del modello a cui si è giunti e commentare i risultati.

6. Un economista affermerebbe che, al crescere del salario reale e a parità di ogni altra condizione, il costo di

un Big Mac diminuirebbe (per acquistare un Big Mac sarebbe necessario un minor numero di minuti-lavoro).

Secondo il modello che abbiamo costruito, l’economista avrebbe ragione?

7. L’economista sostiene anche che, a parità di ogni altra condizione, all’aumentare del numero di giorni di vacanza

remunerati, il costo del Big Mac diminuisce (infatti, per acquistare un Big Mac sarebbe necessaria una quantitá

inferiore di minuti-lavoro). Possiamo essere d’accordo con l’economista?

8. L’economista sostiene inoltre che, se il costo del pane aumenta, allora, a parità di ogni altra condizione, aumenta

anche il costo del Big Mac. Possiamo essere d’accordo con lei/lui?

Soluzione.

1. Per cancellare tutto ciò che è memorizzato in R, chiudere le finestre grafiche, caricare i dati e disegnare i grafici

diamo i seguenti comandi:

>

>

>

>

>

>

>

>

>

+

rm(list = ls())

graphics.off()

ubs = read.table("ubs.txt", header = T)

attach(ubs)

x11()

plot(X1, Y, type = "n")

points(X1[D5 == 1], Y[D5 == 1], col = "blue", pch = 19)

points(X1[D6 == 1], Y[D6 == 1], pch = 19)

points(X1[D5 == 0 & D6 == 0], Y[D5 == 0 & D6 == 0], col = "red",

pch = 19)

>

+

>

>

>

>

>

+

>

+

>

>

>

>

>

+

>

+

>

>

>

>

>

+

>

+

legend(x = 1.5, y = 3, legend = c("Asia", "Europa", "Africa e Sud America"),

pch = c(19, 19, 19), col = c("blue", "black", "red"))

x11()

plot(X2, Y, type = "n")

points(X2[D5 == 1], Y[D5 == 1], col = "blue", pch = 19)

points(X2[D6 == 1], Y[D6 == 1], pch = 19)

points(X2[D5 == 0 & D6 == 0], Y[D5 == 0 & D6 == 0], col = "red",

pch = 19)

legend(x = 3.5, y = 3, legend = c("Asia", "Europa", "Africa e Sud America"),

pch = c(19, 19, 19), col = c("blue", "black", "red"))

x11()

plot(X3, Y, type = "n", ylim = c(2, 6.5))

points(X3[D5 == 1], Y[D5 == 1], col = "blue", pch = 19)

points(X3[D6 == 1], Y[D6 == 1], pch = 19)

points(X3[D5 == 0 & D6 == 0], Y[D5 == 0 & D6 == 0], col = "red",

pch = 19)

legend(x = 2.4, y = 6.4, legend = c("Asia", "Europa", "Africa e Sud America"),

pch = c(19, 19, 19), col = c("blue", "black", "red"))

x11()

plot(X4, Y, type = "n")

points(X4[D5 == 1], Y[D5 == 1], col = "blue", pch = 19)

points(X4[D6 == 1], Y[D6 == 1], pch = 19)

points(X4[D5 == 0 & D6 == 0], Y[D5 == 0 & D6 == 0], col = "red",

pch = 19)

legend(x = 2, y = 5, legend = c("Asia", "Europa", "Africa e Sud America"),

pch = c(19, 19, 19), col = c("blue", "black", "red"))

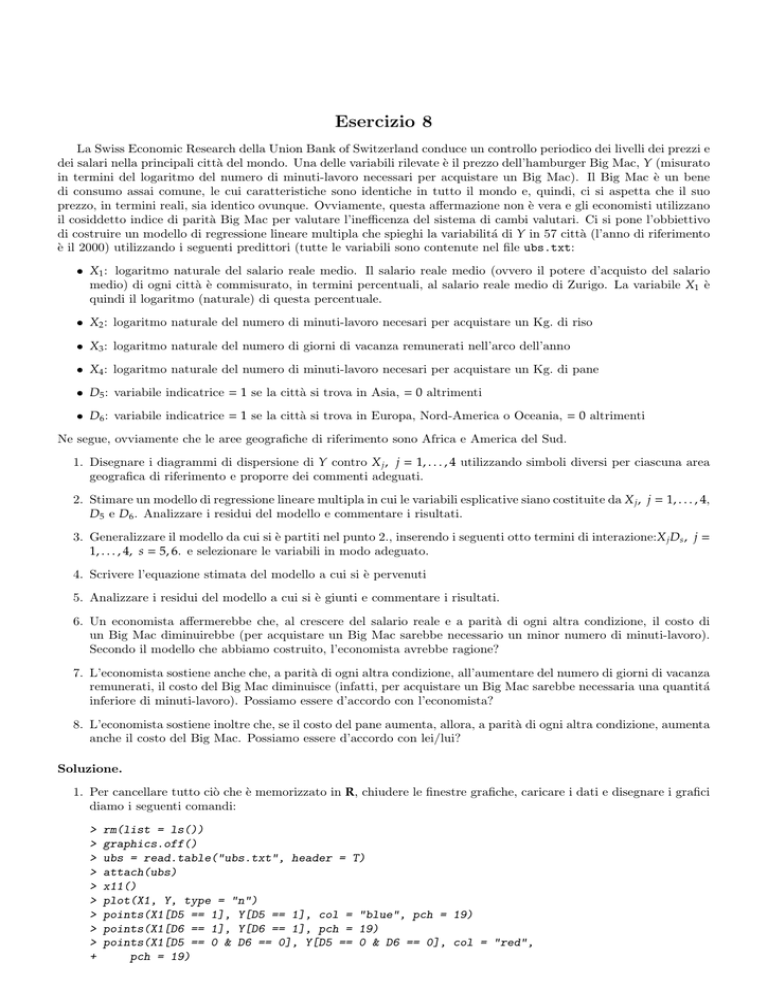

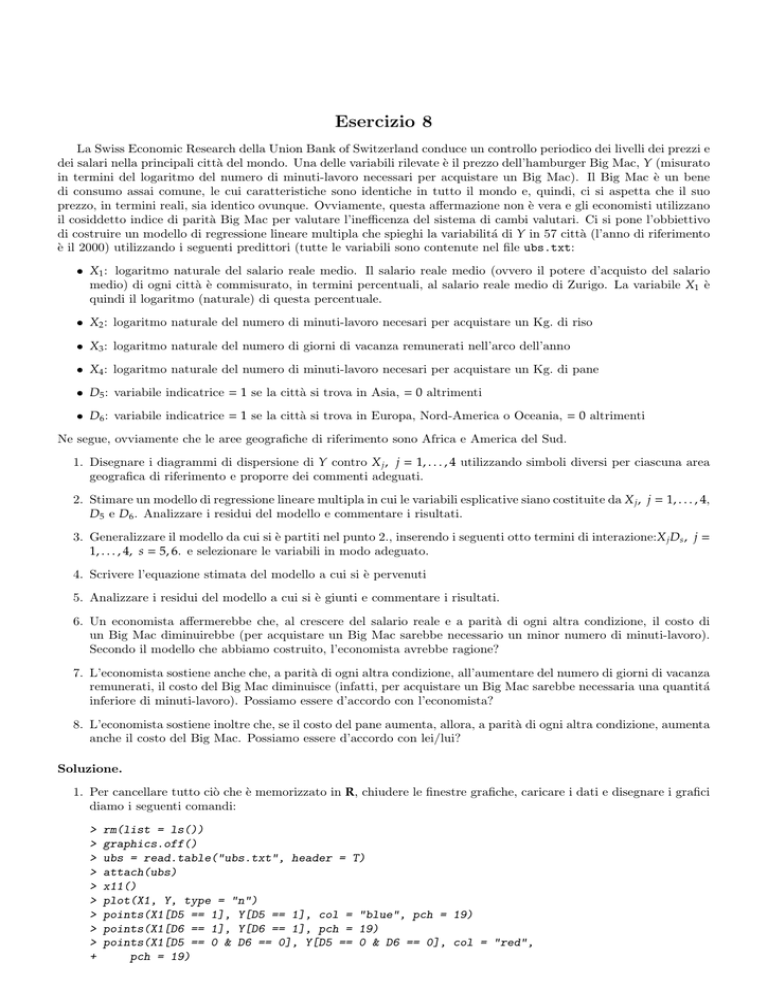

I quattro grafici richiesti sono rappresentati in Figura 1. Da questa figura si evince che:

Il logaritmo del costo del Big Mac (Y) decresce al crescere del logaritmo del salario reale (X1 ): al crescere

del logaritmo del salario reale, il logaritmo della quantità di lavoro necessaria per comprare un Big Mac

diminuisce. Questa relazione non sembra essere influenzata dalla zona geografica di appartenenza: i punti

neri, rossi e blu possono essere interpolati da un’unica retta.

Il logaritmo del costo del Big Mac cresce al crescere del logaritmo del costo di un chilogrammo di riso (X2 )

e al crescere del logaritmo del costo del pane (X4 ). La relazione positiva tra Y e X4 è ovvia ed intutitiva;

non altrettanto possiamo dire della relazione tra Y e X2 . Come spesso avviene per i prezzi delle derrate

alimentari, è facile verificare che esiste una correlazione positiva tra il prezzo del riso e quello del pane

(e quindi tra i logaritmi dei due prezzi). Questa correlazione positiva implica anche che il logaritmi del

prezzo del Big Mace sia correlato positivamente con il logaritmo del prezzo del riso. In realtà la variabile

che influenza direttamente il logaritmo del costo del Big Mac è il logaritmo del prezzo del pane, non il

logaritmo del prezzo del riso: questo è un esempio di ciò che tecnicamente si definisce correlazione spuria.

Non sembra esistere alcuna relazione tra il costo del Big Mac e il logaritmo del numero di giorni di vacanza

remunerati nell’arco dell’anno.

2. Dobbiamo stimare un modello del tipo

Yi = β0 + β1 X1,i + β2,i X2,i + β3 X3,i + β4 X4,i + β5 D5,i + β6 D6,i + εi .

(1)

Per far questo utilizziamo il comando

> ubs.0.lm = lm(Y ~ X1 + X2 + X3 + X4 + D5 + D6)

Disegnamo innanzitutto il grafico dei residui e il diagramma di dispersione dei residui (ei ) contro i valori stimati

della funzione di regressione ( ŷi ) (si osservi come, utilizzando la funzione par(), si possano disegnare più grafici

un una singola finestra grafica):

>

>

>

>

x11()

par(mfrow = c(2, 1))

plot(resid(ubs.0.lm), ylab = "residui")

plot(fitted(ubs.0.lm), resid(ubs.0.lm), ylab = "residui", xlab = expression(hat(y)[i]))

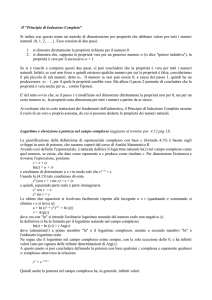

I due grafici sono riportati nella Figura 2:

●

●

●

●

● ●●

●

●

●

●

Asia

Europa

Africa e Sud America

●

2.5

●

●

●

1.5

2.5

3.5

2.5

3.5

Y

●

●

●● ●

●●

●

●● ● ●

● ● ●● ●

●●

●

●

●

● ● ●●

● ●

●●● ●

●

●●

●

3.5

●

●

●

Y

4.5

●

●

● ●

4.5

●

●

4.5

●

●

●

●

●

● ●

●

●●●

●

●

●

● ●

●●

●

●

●

●

● ●● ● ● ●●

●●

●

● ●

●

●

●

● ●

●

● ●● ●

●

●

●

2.0

●●

●

●

●

Asia

Europa

Africa e Sud America

3.0

X1

●

●

4.0

5.0

X2

●

Asia

Europa

Africa e Sud America

●

4

●

●

●

2

●

●● ●

●

●

2.4

2.6

●

●● ●

●

●

●

●

●

●

●●

● ●

●

● ●

● ●

●

●

●

● ●● ●

●

●

●● ●

● ●●● ●

●

●

●●

●● ●

●

2.8

3.0

3.2

4.5

●

3.4

X3

●

3.5

●

●

3

Y

5

●

●

●

2.5

●

Y

6

●

●

Asia

Europa

Africa e Sud America

●

●

●

●

●

●

●

●

●

●

●

●

●

● ●

●

●●

●

●

●

●●●●●● ●● ●

●

●

●●

●

●

●

●●●●

●● ● ●

●

●

●●

●

●

●

●

●

2.0 2.5 3.0 3.5 4.0 4.5

X4

Figura 1: Diagrammi di dispersione di Y contro X j , j = 1, . . . , 4.

Nel primo grafico nella Figura 2 si osserva che i residui sembrano oscillare in modo casuale intorno allo

zero, senza particolari regolarità e con una variabilità stabile;

il secondo grafico rappresenta i residui contro i valori stimati della funzione di regressione. Questo grafico

rappresenta una sintesi dei diagrammi di dispersione dei residui contro le variabili esplicative, essendo

i termini ŷi , i = 1, . . . , n delle combinazioni lineari dei regressori inclusi nel modello. Non emergono

particolari relazioni tra le due variabili e questo depone a favore della bontà del modello stimato.

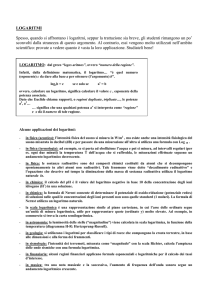

Esaminiamo ora i diagrammi di dispersione dei residui contro i regressori quantitativi inclusi nel modello (Figura

3):

>

>

>

>

>

>

x11()

par(mfrow = c(2, 2))

plot(X1, resid(ubs.0.lm),

plot(X2, resid(ubs.0.lm),

plot(X3, resid(ubs.0.lm),

plot(X4, resid(ubs.0.lm),

ylab

ylab

ylab

ylab

=

=

=

=

"residui")

"residui")

"residui")

"residui")

Non appaiono evidenti forme di dipendenza tra i residui, che rappresentano la parte di variabilità delle variabile

risposta non spiegabile dal modello, e i regressori, che rappresentano la parte di informazione campionaria che

utilizziamo per spiegare il comportamento della variabile risposta.

Cerchiamo ora di capire se il modello sia gaussiano, prendendo in considerazione il grafico quantile-quantile dei

residui standardizzati (Figura 4):

0.6

0.0

●

● ●●

● ● ● ●

●

●

●

●●

● ●

●

● ●

●●

−0.6

residui

●

●

●●

●

0

10

●

●

●

●

●

●

●

●

●

●●

●

●●

● ●

●●

●● ●

●

● ●

●

●

●

●

●

●

●

●

20

30

40

50

Index

0.0

●

●

● ●● ● ●

●

●

●

●

●

● ●

●

●●

●

● ●

● ●

● ●

●

●

●

−0.6

residui

0.6

●

●

●

●

●

●

●●

●

●

●

●

2.5

●

●

3.0

●

●

●

●

●

●

●

●

●

●

●

●

●

●

3.5

4.0

●

4.5

5.0

y^i

Figura 2: Grafico dei residui e diagramma di dispersione dei residui contro i valori stimati della funzione di regressione.

> qqnorm(rstandard(ubs.0.lm))

> qqline(rstandard(ubs.0.lm))

(il comando rstandard(ubs.0.lm) fornisce i residui standardizzati del modello, ed il suo output è equivalente

a quanto si otterrebbe dividendo il vettore dei residui (che si ottiene con il comando resid(ubs.0.lm)) per la

radice quadrata della stima della varianza dei disturbi). Il grafico in Figura 4 è coerente con l’assunzione di

gaussianità del modello.

Esaminiamo ora la sintesi dei risultati della stima del modello:

> summary(ubs.0.lm)

Call:

lm(formula = Y ~ X1 + X2 + X3 + X4 + D5 + D6)

Residuals:

Min

1Q

Median

-0.57908 -0.15635 -0.01254

3Q

0.09939

Max

0.72457

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 4.55877

0.66175

6.889 8.95e-09 ***

X1

-0.56832

0.07542 -7.536 8.74e-10 ***

X2

0.14368

0.08819

1.629

0.1096

●

●

●

●

● ●

−0.2

● ●

●

●

●

●

●

1.5

2.5

●

0.6

● ●

3.5

0.2

●

●

●

● ●

●

●

●

●

● ●●

●

● ●●

● ●

●

●

●

●

●●

●

● ●● ● ●

●

●

●

−0.2

●

−0.6

0.2

●●

●

−0.6

residui

●

●

residui

0.6

●

●

4.5

●

●

●

● ●

●

● ●●

●

●●

●● ● ●

●

●●●●● ●

●●

● ●

●

● ● ●●

●

●● ●

●

● ●

●

●

●

●●

2.0

3.0

4.0

−0.6

●

●

2.4

2.6

2.8

3.0

3.2

●

0.2

0.6

●●

−0.2

●●

●

●●

●

●

●

● ●

● ●● ●

●●●

●● ●

●

●● ●●

●

●●

●● ●

●

●

●● ●

●

−0.6

●

●

●

●

residui

0.6

0.2

●●

●

●

●

●

−0.2

residui

●

●

●

5.0

X2

●

●

●

●

X1

●

●

●

●

●

●

●

●

3.4

●

●

●

● ●

●

●

● ● ●●

●

●●●

●

●

●●

●●●

●

●●●

● ●● ●● ● ●● ●

●

●●

●● ● ●

● ●● ●

●

●

●

●

●

●

●

●

●

●

2.0 2.5 3.0 3.5 4.0 4.5

X3

X4

Figura 3: Diagrammi di dispersione dei residui contro i regressori quantitativi

X3

0.03731

X4

0.14223

D5

-0.24239

D6

-0.21683

--Signif. codes: 0 '***'

0.12705

0.09194

0.12072

0.11901

0.294

1.547

-2.008

-1.822

0.7703

0.1282

0.0501 .

0.0745 .

0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

Residual standard error: 0.2616 on 50 degrees of freedom

Multiple R-Squared: 0.8776,

Adjusted R-squared: 0.8629

F-statistic: 59.72 on 6 and 50 DF, p-value: < 2.2e-16

Il coefficiente di determinazione lineare multipla assume un valore soddisfacente (0.8776) e cosı̀ pure il coefficiente

di determinazione lineare multipla corretto (0.8629). La radice quadrata della stima della varianza dei residui

è pari a 0.2616.

Poichè l’analisi dei residui depone a favore dell’attendibilità dei test che abbiamo studiato (le assunzioni su

cui essi si basano sembrano valere), possiamo saggiare alcuni sistemi di ipotesi di particolare interesse. Il test

congiunto sui coefficienti di regressione ci induce a ritenere che, ad un livello di significatività pari a 0.05, almeno

uno di essi sia diverso da 0 (il livello di significatività osservato è inferiore a 2.2·10−16 . A questo punto dobbiamo

chiederci se nel modello siano state incluse delle variabili ridondanti. I passi da seguire sono i seguenti:

a) Per ogni j, 0 ≤ j ≤ 6, impostare il sistema di ipotesi:

H0 : β j = 0

3

Normal Q−Q Plot

●

●

2

●

1

●● ●

●●

●●

●●

●

0

●

●●●

●●●

●●

●●

●●●●

●●

●

●

●●●

●●●

●●●

●

●●●●

●●

●

●●

−1

Sample Quantiles

●

●

●

−2

●

●

●

−2

−1

0

1

2

Theoretical Quantiles

Figura 4: grafico quantile-quantile dei residui standardizzati

H1 : β j , 0

e controllare il livello di significatività osservato corrispondente al valore osservato della statistica test.

b) Confrontare il livello di significatività osservato con il livello di significatività che abbiamo fissato. Assumiamo di avere fissato un livello di significatività pari a 0.05.

c) Poniamo uguale a zero quel coefficiente in corrispondenza del quale abbiamo riscontrato il più alto livello

di significatività tra tutti quelli che eccedono il livello 0.05.

d) Ristimiamo il modello e ripetiamo i passi a)-d) fino a quando i livelli di significatività osservati, associati

ai test indicati nel punto a), risultano tutti inferiori a 0.05.

Applicando questa procedura, giungiamo al modello finale:

Yi = β0 + β1 X1,i + β2 X2,i + β5 D5,i + β6 D6,i + εi :

> ubs.2.lm = lm(Y ~ X1 + X2 + D5 + D6)

> summary(ubs.2.lm)

Call:

lm(formula = Y ~ X1 + X2 + D5 + D6)

Residuals:

Min

1Q

Median

-0.597891 -0.120872 -0.008774

3Q

0.163878

Max

0.694550

(2)

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 5.22173

0.42494 12.288 < 2e-16 ***

X1

-0.61704

0.06765 -9.122 2.25e-12 ***

X2

0.16950

0.08320

2.037

0.0467 *

D5

-0.25632

0.11817 -2.169

0.0347 *

D6

-0.27641

0.11299 -2.446

0.0178 *

--Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

Residual standard error: 0.2626 on 52 degrees of freedom

Multiple R-Squared: 0.8717,

Adjusted R-squared: 0.8618

F-statistic: 88.31 on 4 and 52 DF, p-value: < 2.2e-16

L’equazione di regressione stimata è quindi:

ŷi = 5.2217 − 0.6170x1,i + 0.1695x2,i − 0.2563d5,i − 0.2764d6,i

con s2 = 0.26262 = 0.069.

3. Per generalizzare il modello introdotto nell’equazione (1), dobbiamo stimare il seguente modello:

Yi

=

β0 + β1 X1,i + β2,i X2,i + β3 X3,i + β4 X4,i + β5 D5,i + β6 D6,i +

+β7 X1,i D5,i + β8 X2,i D5,i + β9 X3,i D5,i + β10 X4,i D5,i +

+β11,i X1,i D6,i + β12,i X2,i D6,i + β13 X3,i D6,i + β14 X4,i D6,i + εi .

Stimiamo il modello ed esaminiamo una sintesi dei risultati inferenziali con i seguenti comandi:

> ubs.3.lm = lm(Y ~ X1 + X2 + X3 + X4 + D5 + D6 + X1:D5 + X2:D5 +

+

X3:D5 + X4:D5 + X1:D6 + X2:D6 + X3:D6 + X4:D6)

> summary(ubs.3.lm)

Call:

lm(formula = Y ~ X1 + X2 + X3 + X4 + D5 + D6 + X1:D5 + X2:D5 +

X3:D5 + X4:D5 + X1:D6 + X2:D6 + X3:D6 + X4:D6)

Residuals:

Min

1Q

Median

-0.60845 -0.12903 -0.04264

3Q

0.13925

Max

0.69760

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 6.133644

2.445863

2.508

0.0161 *

X1

-0.572081

0.294927 -1.940

0.0591 .

X2

0.204056

0.221660

0.921

0.3625

X3

-0.941549

0.469474 -2.006

0.0514 .

X4

0.496844

0.193897

2.562

0.0141 *

D5

-0.687259

2.703625 -0.254

0.8006

D6

-1.779641

2.590122 -0.687

0.4958

X1:D5

-0.253511

0.345541 -0.734

0.4672

X2:D5

-0.242635

0.373769 -0.649

0.5198

X3:D5

1.336510

0.648420

2.061

0.0455 *

X4:D5

-0.591804

0.264198 -2.240

0.0304 *

X1:D6

0.001661

0.309575

0.005

0.9957

X2:D6

-0.116692

0.247404 -0.472

0.6396

X3:D6

1.016958

0.491028

2.071

0.0445 *

X4:D6

-0.343852

0.231393 -1.486

0.1447

--Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

(3)

Residual standard error: 0.2509 on 42 degrees of freedom

Multiple R-Squared: 0.9054,

Adjusted R-squared: 0.8739

F-statistic: 28.72 on 14 and 42 DF, p-value: < 2.2e-16

Conducendo l’analisi dei residui in modo analogo a quanto svolto nel punto precedente, possiamo ritenere di

poter condurre dei test su diversi sistemi di ipotesi. In particolare, possiamo procedere alla selezione delle

variabili, seguendo la procedura indicata nel punto 2. (continuiamo a fissare un livello di significatività pari a

0.05). Giungiamo quindi al modello finale:

Yi = β0 + β1 X1,i + β4 X4,i + εi .

(4)

Le stime e la sintesi dei risultati si ottengono con i comandi:

> ubs.15.lm = lm(Y ~ X1 + X4)

> summary(ubs.15.lm)

Call:

lm(formula = Y ~ X1 + X4)

Residuals:

Min

1Q

Median

-0.713322 -0.157931 -0.003569

3Q

0.129550

Max

0.663239

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 5.11389

0.42595

12.01 < 2e-16 ***

X1

-0.65886

0.06100 -10.80 4.17e-15 ***

X4

0.17215

0.08317

2.07

0.0433 *

--Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1

Residual standard error: 0.2681 on 54 degrees of freedom

Multiple R-Squared: 0.8611,

Adjusted R-squared: 0.8559

F-statistic: 167.3 on 2 and 54 DF, p-value: < 2.2e-16

Ora siamo alle prese con un problema spinoso: partendo da due modelli diversi siamo giunti a due modelli finali

diversi, descritti dalle equazioni (2) e (4). Quale dei due dobbiamo scegliere? Stiamo toccando un tema molto

difficile, al quale non si possono dare risposte definitive: il tema della scelta di uno tra diversi modelli statistici.

Cerchiamo di ragionare sul problema.

a) Siamo pervenuti al modello (4) partendo da un modello più generale di quello costituito da (1). Possiamo

quindi ritenere di avere sfruttato una maggiore quantità di informazione rispetto al percorso seguito per

giungere a (2).

b) Il modello (4) è più semplice (nel senso che contiene meno parametri e meno variabili) e, forse, più ragionevole del modello (2). In effetti, appare più sensato far dipendere il logaritmo del prezzo del Big Mac dal

logaritmo del costo del pane (X4 ) piuttosto che dal logaritmo del costo del riso (X2 ) (si rifletta su quanto

detto sopra a proposito della cosiddetta correlazione spuria).

La dipendenza della variabile risposta dalle diverse aree geografiche potrebbe essere una complicazione

superflua. In effetti, dall’analisi grafica delle interazioni tra le variabili in gioco, non sembra che la regione

di appartenenza giochi un ruolo fondamentale. Questa, tuttavia, è solo una considerazione di natura

euristica. È forse più logico ritenere che le tre regioni geografiche si distinguano essenzialmente per il

diverso ammontare e per il diverso modo di distribuirsi della ricchezza. L’informazione riguardante questi

aspetti è probabilmente fornita più dalle osservazioni sulla variabile X1 (logaritmo del salario reale), che

dalla regione di appartenenza. Nelle città asiatiche presenti nell’insieme di dati esaminato, troviamo delle

realtà molto variegate: in alcune città il livello del salario compete con quello europeo e nord-americano

(Hong Kong e Tokio, ad esempio); in altre (Jakarta e Bombay, ad esempio) il livello di questa variabile è

molto basso e simile a quello dei paesi africani e sud-americani. Si esamini l’output dei seguenti comandi:

> ubs[D5 == 1, 1:8][order(X1[D5 == 1]), ]

> ubs[D6 == 1, 1:8][order(X1[D6 == 1]), ]

> ubs[D5 == 0 & D6 == 0, 1:8][order(X1[D5 == 0 & D6 == 0]), ]

In altri termini, la suddivisione per regione di appartenenza, nel campione esaminato, non discrimina

nettamente delle realtà economiche distinte e quindi non appare in grado di fornire particolari spiegazioni

sul comportamento della variabile risposta.

Alla luce di queste considerazioni, possiamo ritenere che il modello (4) sia da ritenersi più adeguato del modello

(2) (si osservi, inoltre, che la perdita di termini di varianza spiegata è trascurabile).

4. L’equazione stimata è:

ŷi = 5.1140 − 0.6589x1,i + 0.1722x4,i

con s2 = 0.26812 = 0.0719

5. Si tratta di analizzare i residui del modello a cui si è giunti, in modo analogo a quanto fatto nel punto 2.

6. A questa domanda si risponde saggiando il sistema di ipotesi

H0 : β1 ≥ 0

H1 : β1 < 0.

Fissiamo un livello di significatività 0.05. Il valore osservato della statistica test è toss = −10.8. Accetteremo

l’ipotesi nulla se toss > t54,0.05 . Il valore del quantile cercato si ottiene con il comando:

> qt(0.05, 54)

[1] -1.673565

Poiché −10.8 < −1.6736, ad un livello di significatività 0.05 riteniamo che il valore atteso del logaritmo del

prezzo di un Big Mac diminuisca al crescere del logaritmo del salario reale e, quindi, che l’economista abbia

ragione.

7. In fase di selezione delle variabili, abbiamo visto che, ad un livello di significatività 0.05, il logaritmo del numero

di giorni di vacanza remunerati nell’arco dell’anno (X3 ) non sembra influire sul logaritmo del prezzo di un Big

Mac, quindi, sulla base dell’informazione campionaria di cui disponiamo, non siamo d’accordo con l’economista.

8. A questa domanda si risponde saggiando il sistema di ipotesi

H0 : β4 ≤ 0

H1 : β4 > 0.

Fissiamo un livello di significatività 0.05. Il valore osservato della statistica test è toss = 2.07. Accetteremo

l’ipotesi nulla se toss < t54,0.95 . Il valore del quantile cercato si ottiene con il comando:

> qt(0.95, 54)

[1] 1.673565

Poiché 2.07 > 1.6736, ad un livello di significatività 0.05 riteniamo che il valore atteso del logaritmo del prezzo

di un Big Mac cresca al crescere del logaritmo del prezzo del pane e, quindi, che l’economista abbia ragione.