290

CAPITOLO B.1. ELEMENTI DI TEORIA DELLA PROBABILITÀ

B.1.2

Trasformazioni Nonlineari di Variabili Aleatorie (monodimensionali)

Consideriamo una trasformazione nonlineare monodimensionale g(·) che definisce la variabile aleatoria x a partire dalla variabile

aleatoria u, i.e.:

x = g(u)

Per semplicità, limitiamoci inizialmente a considerare il caso di trasformazione invertibile, i.e. esiste la trasformazione inversa

u = γ(x)

con γ(·) tale che

γ g(u) = u

Considerato, allora, un generico intervallo Iu sull’asse della variabile aleatoria u, e il corrispondente intervallo Ix = {x : x =

g(u), u ∈ Iu } sull’asse della variabile aleatoria u, gli eventi Eu = {u ∈ Iu } e Ex = {x ∈ Ix } hanno medesima probabilità di

verificarsi, i.e.

pX (x) dx =

Ix

pU (u) du

Iu

Poichè l’equilibrio delle probabilità deve mantenersi comunque scelto l’intervallo Iu , possiamo scrivere

pX (x) |dx| = pU (u) du (B.1.3)

u=γ(x)

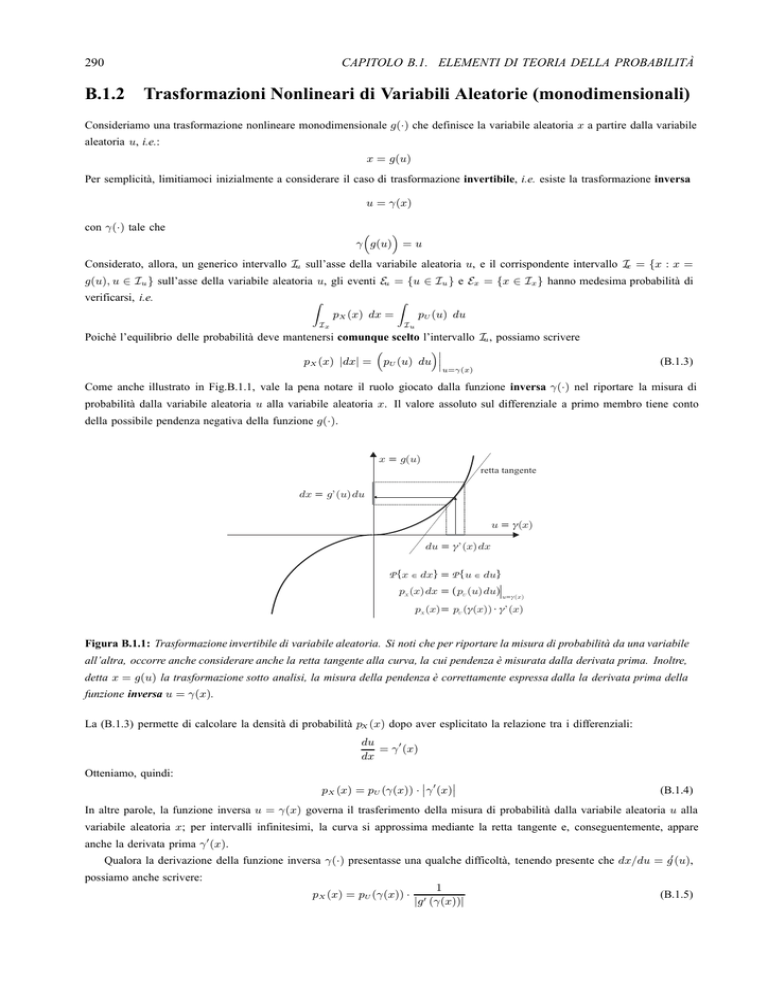

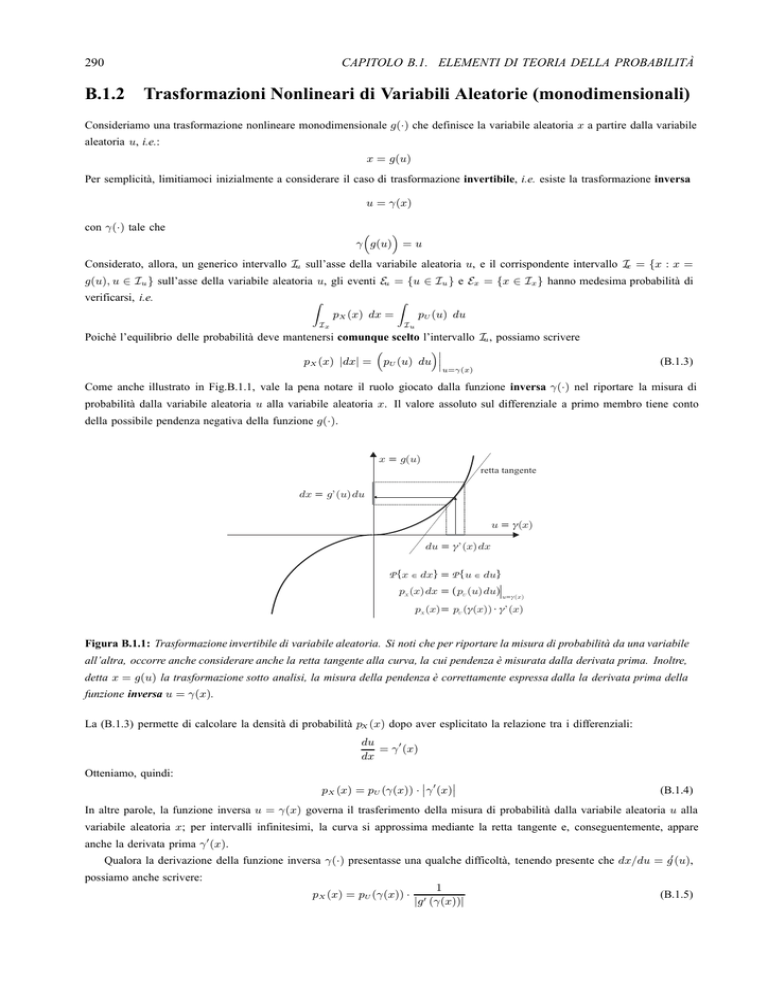

Come anche illustrato in Fig.B.1.1, vale la pena notare il ruolo giocato dalla funzione inversa γ(·) nel riportare la misura di

probabilità dalla variabile aleatoria u alla variabile aleatoria x. Il valore assoluto sul differenziale a primo membro tiene conto

della possibile pendenza negativa della funzione g(·).

x = g(u)

retta tangente

dx = g'(u) du

u = g(x)

du = g'(x) dx

P {x Î dx} = P {u Î du}

a

pX (x) dx = pU (u) du

f

u=g( x )

pX (x)= pU ( g(x))× g'(x)

Figura B.1.1: Trasformazione invertibile di variabile aleatoria. Si noti che per riportare la misura di probabilità da una variabile

all’altra, occorre anche considerare anche la retta tangente alla curva, la cui pendenza è misurata dalla derivata prima. Inoltre,

detta x = g(u) la trasformazione sotto analisi, la misura della pendenza è correttamente espressa dalla la derivata prima della

funzione inversa u = γ(x).

La (B.1.3) permette di calcolare la densità di probabilità pX (x) dopo aver esplicitato la relazione tra i differenziali:

du

= γ (x)

dx

Otteniamo, quindi:

pX (x) = pU (γ(x)) · γ (x)

(B.1.4)

In altre parole, la funzione inversa u = γ(x) governa il trasferimento della misura di probabilità dalla variabile aleatoria u alla

variabile aleatoria x; per intervalli infinitesimi, la curva si approssima mediante la retta tangente e, conseguentemente, appare

anche la derivata prima γ (x).

Qualora la derivazione della funzione inversa γ(·) presentasse una qualche difficoltà, tenendo presente che dx/du = g (u),

possiamo anche scrivere:

pX (x) = pU (γ(x)) ·

1

|g (γ(x))|

(B.1.5)

B.1.2. TRASFORMAZIONI NONLINEARI DI VARIABILI ALEATORIE (MONODIMENSIONALI)

291

Trasformazioni nonlineari del tipo “molti a uno”

Se la funzione g(·) non è iniettiva, i.e. più valori di u corrispondono allo stesso valore di x, possiamo considerare separatamente

gli intervalli di iniettività (monotonia) della funzione g(·), applicando a ciascun intervallo quanto sopra esposto. Allora, detto L

il numero di intervalli di monotonia della funzione g(·), osserviamo che solo L(x) ≤ L intervalli di monotonia contribuiscono a

determinare un particolare assegnato valore x, i.e. fissato x, l’equazione

g(u) = x

ammette L(x) radici distinte che chiamiamo ul = γl (x) per l = 1, · · · , L(x).

La densità di probabilità si ottiene sommando sugli L(x) intervalli di monotonia:

L(x)

pX (x) =

pU (γl (x)) · γl (x)

l=1

oppure, se si preferisce,

L(x)

pX (x) =

pU (γl (x)) ·

l=1

1

|g (γl (x))|

Esempio: trasformazione parabolica (quadratore)

Il dispositivo che opera una trasformazione parabolica è spesso riferito come “quadratore”. Con riferimento alla Fig.B.1.2, la trasformazione

d’interesse è

x = u2

(B.1.6)

con u variabile aleatoria che può assumere, in generale, sia valori positivi che negativi.

g(u) = u2

g1(x) = x

g2(x) = - x

x = u2

u

u2 = - x

0

u1 = x

Figura B.1.2: Trasformazione parabolica (quadratore).

In questo caso, la (B.1.6) risulta non iniettiva per x ≥ 0, con L = 2 intervalli di monotonia, u < 0, e u ≥ 0. Per x ≥ 0 l’equazione

u2 = x

√

√

√

(x) = ±1/2 x.

ammette sempre L(x) = 2, i.e. u1,2 = ± x. Le due funzioni inverse sono quindi γ1,2 (x) = ± x, con derivate prime γ1,2

La densità di probabilità della variabile aleatoria x prende la forma seguente, valida solo per x ≥ 0:

1

1

1

pX (x) = √ · pU √

+ pU − √

2 x

x

x

Nel caso in cui la variabile aleatoria u assume solo valori non negativi, allora la (B.1.6) è invertibile, e abbiamo, per x ≥ 0:

1

1

pX (x) = √ · pU √

, quando risulta p U (u) = 0 per u < 0

2 x

x

Se invece la variabile aleatoria u assume solo valori non positivi, abbiamo, sempre solo per x ≥ 0:

1

1

pX (x) = √ · pU − √

, quando risulta p U (u) = 0 per u > 0

2 x

x

292

CAPITOLO B.1. ELEMENTI DI TEORIA DELLA PROBABILITÀ

B.1.3

Trasformazioni Nonlineari di Variabili Aleatorie (N -dimensionali)

Consideriamo N variabili aleatorie (x1 , x2 , · · · , xN ) ottenute per trasformazione nonlineare invertibile da altre N variabili

aleatorie (u1 , u2 , · · · , uN ):

x1 = g1 (u1 , u2 , · · · , uN ) ;

x2 = g2 (u1 , u2 , · · · , uN ) ;

xN = gN (u1 , u2 , · · · , uN )

Essendo la trasformazione invertibile, dalle N funzioni g1 (· · ·), · · · , gN (· · ·) possiamo determinare le N trasformazioni inverse:

u1 = γ1 (x1 , x2 , · · · , xN )

;

u2 = γ2 (x1 , x2 , · · · , xN ) ;

uN = γN (x1 , x2 , · · · , xN );

(B.1.7)

e calcolare lo Jacobiano della trasformazione:

∂γ1 (· · · )

∂u

1

∂γ2 (· · · )

∂u

1

def

J (x1, x2 , · · · , xN ) = det

..

.

∂γ (· · · )

N

∂u1

∂γ1 (· · · )

∂u2

···

∂γ2 (· · · )

∂u2

···

..

.

..

.

∂γN (· · · )

∂u2

···

∂γ1 (· · · ) ∂uN

∂γ2 (· · · )

∂uN

..

.

∂γN (· · · )

∂uN

Lo Jacobiano permette di scrivere riportare la trasformazione nonlineare nelle densità di probabilità:1.1

pX1 ,X2 ,···,XN (x1 , x2 , · · · , xN ) = pU1,U2 ,···,UN γ1 (x1 , x2 , · · · , xN ), · · · , γN (x1 , x2 , · · · , xN ) · J (x1 , x2 , · · · , xN )

(B.1.8)

Nel caso di trasformazioni nonlineari suriettive ma non iniettive si procede sostanzialmente come descritto per il caso monodimensionale.

1.1 Nella

(B.1.8), il lettore attento avrà riconosciuto il passaggio fondamentale della tecnica cosiddetta “d’integrazione per sostituzione”, impiegata

nell’integrazione di funzioni di più variabili. L’unica differenza, sostanziale, consiste nel fatto che la probabilità di eventi associati a intervalli

definiti sullo spazio delle variabili aleatorie (γ1 (x1 , x2 , · · · , xN ) si ottiene mediante integrazione della densità di probabilità, i.e.

P {(x1 , x2 , · · · , xN ) ∈ I} def

=

···

pX1 ,X2 ,···,XN (x1 , x2 , · · · , xN ) dx1 dx2 , · · · , dxN

(x1 ,x2 ,···,xN )∈I

per cui lo Jacobiano deve far parte integrante della densità di probabilità dopo la trasformazione, come indicato nella (B.1.8).

Nel caso di un integrale di più variabili, invece, lo Jacobiano determina come si modifica l’elemento di ipervolume misurato dal prodotto dei

differenziali, i.e.

du1 du2 , · · · , duN = J(x1 , x2 , · · · , xN ) · dx1 dx2 , · · · , dxN

Allora, la (B.1.8) esprime il fatto che, dopo aver trasformato l’elemento di ipervolume, per ottenere la densità di probabilità delle variabili aleatorie

(x1 , x2 , · · · , xN ) dopo la trasformazione, occorre avere l’accortezza di considerare il prodotto dello Jacobiano con la densità di probabilità

delle variabili aleatorie (u1 , u2 , · · · , uN ), avendo effettuato in quest’ultima il necessario cambio di variabile definito dalle trasformazioni inverse

(B.1.7).