UNIVERSITA’ DEL SALENTO – INGEGNERIA CIVILE

RICHIAMI DI CALCOLO

DELLE PROBABILITÀ

ing. Marianovella LEONE

INTRODUZIONE

Per misurare la sicurezza di una struttura, ovvero la sua affidabilità, esistono due approcci

fondamentali:

Misura di tipo deterministico–Metodo delle Tensioni Ammissibili, Metodo del Calcolo a

Rottura

Misura di tipo probabilistico–Metodo probabilistico, Metodo semiprobabilistico agli Stati

Limite

Le misure di tipo probabilistico sono più complesse ma allo stesso tempo più realistiche, dal

momento che tengono conto delle variabilità e delle incertezze dei parametri da cui la sicurezza

della struttura dipende.

Tra i metodi di tipo probabilistico quello che maggiormente interessa è il Metodo

Semiprobabilistico agli Stati Limite, metodo su cui attualmente si basa la Normativa

Italiana.

INTRODUZIONE

Il metodo è detto semiprobabilistico poiché che si basa su una relazione di tipo

deterministico, ovvero:

Domanda

Sd Rd

Richiesta

Sd ed Rd hanno carattere probabilistico.

Il metodo infatti considera la resistenza dei materiali ed i valori delle azioni

agenti sulla struttura come variabili aleatorie, ovvero grandezze cui non si

può assegnare un unico valore (deterministico) ma che, se misurate,

assumono di volta in volta un valore differente, casuale.

VARIABILE ALEATORIA DISCRETA O CONTINUA

Vi sono due tipi di variabile aleatoria:

Variabile aleatoria discreta, capace di assumere solo un numero finito di

valori: ad es. il risultato del lancio di un dado può assumere sei valori possibili.

Variabile aleatoria continua, capace di assumere qualsiasi valore all’interno

di uno o più intervalli assegnati: ad es. il valore della resistenza a

compressione dei cubetti di calcestruzzo

PROBABILITÀ: VARIABILE ALEATORIA DISCRETA

Si consideri una variabile casuale di tipo discreto ad es. il

risultato del lancio di un dado.

Si supponga di effettuare n=7 lanci con i risultati riportati

in tabella.

Si indica con “a” l’evento per cui il risultato del lancio è 3

ed “na” il numero di volte in cui tale evento si verifica, nel

nostro caso na = 2.

Si definisce frequenza relativa all’evento “a”

fa = na /n = 2/7

La somma delle frequenze relative a tutti gli eventi

possibili è ovviamente pari a 1.

a fa = 1

f

a

7

2

1

1

1

1

1

1

7 ( 3 ) 7 ( 6 ) 7 ( 2 ) 7 (1) 7 ( 5 ) 7 ( 4 ) 7

N. Lanci

Risultati

1

3

2

6

3

2

4

3

5

1

6

5

7

4

PROBABILITÀ: VARIABILE ALEATORIA DISCRETA

Al crescere del numero n di lanci, la frequenza relativa esprime in termini

numerici la tendenza di ciascun evento a verificarsi, ovvero la probabilità che

l’evento “a” si verifichi e cioè:

p(a ) lim (n a / n )

n

Se l’evento a è CERTO na coincide con n e la probabilità è pari a 1

Se l’evento a è IMPOSSIBILE na è nullo e la probabilità è pari a 0

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

22-24

25-27

28-30

31-33

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

22-24

25-27

28-30

31-33

ni rotture

nell’intervallo

Frequenza fi relativa

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

ni rotture

nell’intervallo

Frequenza fi relativa

22-24

0

Fa=0/12=0

25-27

28-30

31-33

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

ni rotture

nell’intervallo

Frequenza fi relativa

22-24

0

Fa=0/12=0

25-27

1

Fa=1/12=0,083

28-30

31-33

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

ni rotture

nell’intervallo

Frequenza fi relativa

22-24

0

Fa=0/12=0

25-27

1

Fa=1/12=0,083

28-30

7

Fa=7/12=0,583

31-33

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Per poter estendere il concetto di probabilità al caso delle variabili aleatorie continue, occorre

dividere il campo di variabilità della grandezza in un numero finito di intervalli e contare il

numero di volte in cui ciascuno dei valori cade all’interno dell’intervallo considerato.

Consideriamo i risultati di 12 prove di compressione su altrettanti cubetti:

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

Intervallo

ni rotture

nell’intervallo

Frequenza fi relativa

22-24

0

Fa=0/12=0

25-27

1

Fa=1/12=0,083

28-30

7

Fa=7/12=0,583

31-33

4

Fa=4/12=0,333

FREQUENZA RELATIVA

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

RESISTENZA A COMPRESSIONE (MPa)

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Si definisce densità δi il rapporto tra la frequenza relativa fi e l’estensione

dell’intervallo adottato di.

fi

i

di

Il passaggio dalle frequenze relative alla probabilità per le variabili aleatorie continue si

ottiene facendo tendere ad infinito il numero n di prove e a zero l’ampiezza di degli

intervalli in cui è stato suddiviso il campo di variabilità della resistenza a compressione.

Si definisce funzione densità di probabilità f(x) come:

f(x) lim i

n

di 0

PROBABILITÀ: VARIABILE ALEATORIA CONTINUA

Accanto alla funzione densità di probabilità si definisce la funzione probabilità

cumulata F della variabile aleatoria x con riferimento ad un certo valore “a”:

a

F(a) f(x)dx

Che rappresenta la funzione che associa ad ogni possibile valore della

variabile aleatoria x la probabilità che essa assuma valori compresi tra –

(limite inferiore del campo di variabilità) ed a. In altre parole:

F(a) = p ( x < a )

INTERPRETAZIONE GRAFICA

Se f(x) è la funzione densità di probabilità di una variabile aleatoria x, essa può

essere rappresentata graficamente

f(x)dx 1

f(x)

x

INTERPRETAZIONE GRAFICA

Se f(x) è la funzione densità di probabilità di una variabile aleatoria x, essa può

essere rappresentata graficamente

f(x)dx 1

f(x)

x

INTERPRETAZIONE GRAFICA

Se f(x) è la funzione densità di probabilità di una variabile aleatoria x, essa può

essere rappresentata graficamente

f(x)

f(x)dx 1

P(X x0 ) F(x0 )

Probabilità che la variabile

aleatoria assuma valori

compresi tra –∞ ed X0

x0

x

INTERPRETAZIONE GRAFICA

Se f(x) è la funzione densità di probabilità di una variabile aleatoria x, essa può

essere rappresentata graficamente

f(x)

f(x)dx 1

P(X x3 ) 1 F(x3 )

Probabilità che la variabile aleatoria

assuma valori compresi tra X3 +∞

x3

x

INTERPRETAZIONE GRAFICA

Se f(x) è la funzione densità di probabilità di una variabile aleatoria x, essa può

essere rappresentata graficamente

f(x)dx 1

f(x)

P(x1 X x2 ) F(x2 ) F(x1)

Probabilità che la variabile aleatoria assuma valori

compresi tra X1 ed X2

x1

x2

x

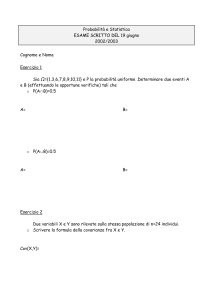

DEFINIZIONE DI FRATTILE

Assegnato un valore P* della probabilità, esisterà uno ed un solo valore xk della

variabile x per il quale vale

P* P(x xk ) F(xk )

Si definisce frattile della probabilità P* il valore xk della variabile aleatoria x che

soddisfa tale uguaglianza.

f(x)

Si definisce “frattile superiore al p%” quel valore della variabile

aleatoria cui corrisponde la probabilità p% di non essere superato

x0 = frattile superiore al 5%

5%

x0

x

DEFINIZIONE DI FRATTILE

Assegnato un valore P* della probabilità, esisterà uno ed un solo valore xk della variabile x

per il quale vale

P * P ( x xk ) F ( xk )

Si definisce frattile della probabilità P* il valore xk della variabile aleatoria x che soddisfa

tale uguaglianza.

f(x)

Si definisce “frattile inferiore al p%” quel valore della variabile

aleatoria cui corrisponde la probabilità p% di non essere minorato

x0 = frattile inferiore al 95%

95%

x0

x

DEFINIZIONE DI MEDIA, MEDIANA E MODA

Fra tutti i valori che una variabile casuale può assumere ce ne sono alcuni

che sono più frequenti di altri, in qualche modo “tipici” e vengono

generalmente posti al centro dell’intervallo di variabilità.

I parametri media, mediana e moda forniscono una valutazione

significativa di tali valori tipici.

DEFINIZIONE DI MEDIA, MEDIANA E MODA

Con riferimento ad una variabile aleatoria continua x, con una funzione di densità di

probabilità f(x), la media μ della popolazione indicata anche come valore atteso

vale:

E( x )

xf ( x )dx

La mediana x50 è il valore per il quale la funzione F(x) di probabilità cumulata

assume il valore 0,5 (ossia 50%)

La moda è il valore associato al punto di massimo della funzione f(x) di densità di

probabilità

I valori di media, mediana e moda coincidono nel caso di distribuzioni f(x) simmetriche

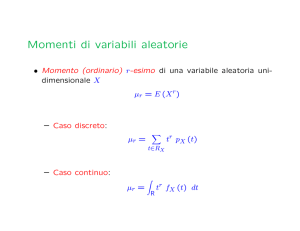

DEFINIZIONE DI VARIANZA E DEVIAZIONE STANDARD

Con riferimento ad una variabile aleatoria continua x, caratterizzata da una

funzione di densità di probabilità f(x) e media μ, si definisce varianza la quantità:

( x ) f ( x )dx

2

2

La deviazione standard si definisce come

2

TEORIA DEI CAMPIONI

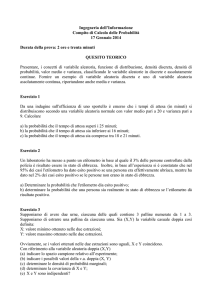

Ci si pone spesso davanti al problema di determinare conclusioni valide per un ampio gruppo di

individui o di oggetti; in questi casi, invece di esaminare l’intero gruppo, detto POPOLAZIONE,

esame che può comportare diverse difficoltà e diventare anche impossibile, si può far ricorso all’esame

di una piccola parte della popolazione: questa piccola parte viene chiamata un CAMPIONE.

ES: Desideriamo trarre conclusioni circa la statura (o il peso) di 12.000 studenti adulti (la popolazione)

esaminando solo 100 studenti (il campione) estratti dalla popolazione

ES: Desideriamo trarre conclusioni circa la percentuale dei bulloni difettosi costruiti da una certa

fabbrica durante i sei giorni di una settimana, esaminando ogni giorno 20 bulloni prodotti in diverse

ore della giornata lavorativa. In questo caso la popolazione sono i bulloni prodotti nella settimana

lavorativa mentre il campione sono i 120 bulloni scelti.

LA POPOLAZIONE PUO’ ESSERE FINITA O INFINITA, IL NUMERO SARA’ DETTO

GRANDEZZA DELLA POPOLAZIONE E DI SOLITO E’ DENOTATO CON “N”.

IL CAMPIONE E’ GENERALMENTE FINITO ED IL NUMERO SARA’ DETTO

GRANDEZZA DEL CAMPIONE

TEORIA DEI CAMPIONI

LA MEDIA CAMPIONARIA: non è altro che la media aritmetica delle

osservazioni campionarie, cioè del campione. Se un campione di osservazioni è

sufficientemente rappresentativo dell’intera popolazione, la media calcolata sul

campione sarà molto vicino a quella vera della popolazione stessa.

N. Prelievi

Rci

N. Prelievi

Rci

1

29

7

29

2

32

8

30

3

31

9

28

4

30

10

32

5

30

11

33

6

29

12

27

E

29 32 31 30 30 29 29 30 28 32 33 27

30

12

TEORIA DEI CAMPIONI

ESEMPIO

Supponiamo che la popolazione sia composta da 2066 intervistati a cui chiediamo l’età. L’età

media calcolata su tutta la popolazione di intervistati è 22,7 anni.

Supponendo di non conoscerla, si vuole stimare l’età media estraendo a caso un

campione di dieci intervistati.

Le osservazioni sono le seguenti: 27; 22; 26; 22; 23; 28;29; 27; 25; 22

La loro età media è = (27+22+26+22+23+28+29+27+25+22)/10=25,1.

Questo campione può dirsi

popolazione di intervistati?

sufficientemente

rappresentativo

dell’intera

Il campione oltre a essere troppo piccolo, non contiene nessun intervistato di età

inferiore a 20 anni e comprende un numero sproporzionato rispetto alla realtà di

persona con età superiore a 26anni.

QUESTA MEDIA CAMPIONARIA NON È QUINDI UNA BUONA STIMA

DELLA MEDIA DELLA POPOLAZIONE!!

TEORIA DEI CAMPIONI

Cosa fare per ottenere un campione maggiormente rappresentativo?

Aumentando il campione si ha modo di aumentare le probabilità che la composizione del

campione rispecchi quelle che è la strutta della età reale della popolazione.

Portando il campione a 500 unità, la forma della sua distribuzione assume effettivamente

un profilo che ricorda quella dell’intera popolazione (ovviamente su scala diversa). L’età

media campionaria in questo caso è 22,9 anni: molto vicina a quella reale.

TEORIA DEI CAMPIONI

LA MEDIA DELLE MEDIE CAMPIONARIE È UNA BUONA

STIMA DEL VALORE MEDIO DELLA POPOLAZIONE

Esempio:

Quelle che seguono sono le medie di venti diversi campioni da 10 unità ciascuno:

la media campionaria è diversa per ogni campione.

22,7 23,5 23,1 21,9 23,3 22,5 22,8 22,8 22,5 22,8 21,7 22,7 21,7 22,4 22,3 22,8 23,2

23,5 23,1 22,8

La media delle medie campionarie approssima bene quella dell’intera popolazione. La stima

della media della popolazione sarà:

22,9

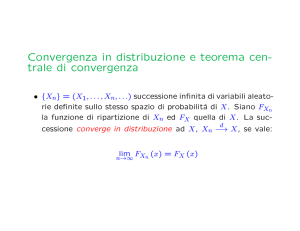

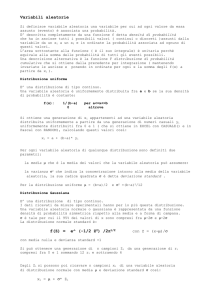

MODELLI DI DISTRIBUZIONI DI VARIABILI

CASUALI

1) Distribuzione uniforme o rettangolare

La legge di distribuzione della probabilità, nell’intervallo di definizione [a,b] è data da

f(x) = 1 / (b-a)

Si ha cioè una densità di probabilità uniforme

E’ semplice calcolare il valore della media, ovvero

E(x) xf (x)dx (b a) / 2

La distribuzione è simmetrica pertanto media e mediana coincidono; non ha senso

invece definire il parametro moda.

MODELLI DI DISTRIBUZIONI DI VARIABILI CASUALI

2) Distribuzione Normale o Gaussiana

La variabile x può assumere un qualsiasi valore tra - e +

f(x)

1

f ( x)

e

2

xf

( x)dx

1 ( x )2

2 2

x

( x ) 2 f ( x)dx

MODELLI DI DISTRIBUZIONI DI VARIABILI CASUALI

f ( t ) e t

3) Distribuzione Esponenziale

0t

t

t

0

0

F (t ) f (t )dt e t dt (1 e t )

1,2

1

PDF

0,8

0,6

0,4

0,2

0

0

1

2

3

tem po

4

5

MODELLI DI DISTRIBUZIONI DI VARIABILI CASUALI

4) Distribuzione di Weibull

(t )

f (t )

1

e

t

MODELLI DI DISTRIBUZIONI DI VARIABILI CASUALI

5) Distribuzione LogNormale

Distribuzioni lognormali con uguale valore dello scarto quadratico medio s(y) e

diverso valore (maggiore per la distribuzione b) della media m(y)