Diagonalizzazione

May 17, 2015

1

Introduzione

In questo capitolo ci occuperemo del problema della diagonalizzazione. Dato un endomorfismo

L : V → V su uno spazio vettoriale V di dimensione finita sul campo K reale o complesso, cerchiamo

di rispondere alle seguenti due domande.

1. Esiste una base ordinata B di V tale che [L]B sia una matrice diagonale?

2. In caso affermativo, come si fa a trovare una tale base B?

Vista la facilità di calcolo che offrono le matrici diagonali, una risposta affermativa alla prima

domanda chiarisce la comprensione di come agisce su V l’operatore L. Una risposta affermativa

alla seconda domanda rende più facile la soluzione di molti problemi che si possono formulare nel

contesto dell’algebra lineare.

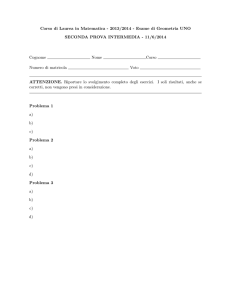

Esempio Nel piano R2 sia L la riflessione rispetto alla retta y = mx. La definizione di L è

geometrica e vogliamo trovare le coordinate di L(a, b). Vedremo tra qualche lezione che L è

lineare, ma per il momento ammettiamo questo fatto. Per calcolare L(a, b) dobbiamo trovare la

matrice [L]S ove S è la base standard. Consideriamo la base B = {(1, m), (−m, 1)}. La matrice di

L rispetto a questa base è facile da calcolare: L(1, m) = (1, m), L(−m, 1) = −(−m, 1).

y

(a, b)

•

• L(a, b)

(1, m)

(−m, 1)

x

y = mx

Segue che

[L]B =

1

0

0

,

−1

[L]S = PS←B [L]B PB←S ,

PB←S = (PS←B )−1 =

1

1 + m2

PS←B =

1

−m

1

m

−m

,

1

m

1

e quindi

1

[L]S =

1 + m2

1

m

−m

1

1

0

0

1

−1

−m

1

1

m

1 − m2

=

1

2m

1 + m2

2m

−1 + m2

1

(1 − m2 )a + 2mb, 2ma + (−1 + m2 )b .

2

1+m

Esempio Consideriamo il sistema differenziale lineare a coefficienti costanti

(

ẋ1 = a11 x1 + a12 x2

ẋ2 = a21 x1 + a22 x2

L(a, b) =

che scriviamo in modo compatto

dx1

dt

= dx

,

2

dt

ẋ = Ax,

x1 (t)

x=

,

x2 (t)

ẋ =

ẋ1 (t)

ẋ2 (t)

a11

A=

a21

a12

a22

∈ M2 (R).

Il punto denota la derivazione rispetto alla variabile t. Il sistema non si può integrare direttamente

perché ciascuna equazione contiene entrambe le funzioni incognite. Vediamo cosa succede con un

cambio lineare delle funzioni incognite (cambio della base in R2 )

P ∈ M2 (R)

x = P y,

matrice invertibile.

Poiché P è matrice costante, abbiamo

ẋ = P ẏ,

P ẏ = AP ẏ,

ẏ = By,

B = P −1 AP.

È possibile scegliere P in modo che il sistema equivalente ẏ = By sia integrabile? In caso affermativo, si integra il sistema calcolando la soluzione y e poi si calcola la soluzione x = P y.

Supponiamo che la matrice B sia diagonale B = diag (λ1 , λ2 ). Allora il sistema si riduce a

(

ẏ1 = λ1 y1

ẏ1

λ1 0

y1

ẏ = diag (λ1 , λ2 )y,

=

,

ẏ2

0 λ2

y2

ẏ2 = λ2 y2

Nel nuovo sistema (equivalente al sistema iniziale) le funzioni incognite sono separate ed il sistema

è facilmente integrabile

y1 = c1 eλ1 t ,

Se P = v1

2

y2 = c2 eλ2 t ,

c1 , c2 costanti arbitrarie.

v2 , ove v1 , v2 sono le colonne di P , allora

c1 eλ1 t

x(t) = P y(t), x(t) = v1 v2

= c1 eλ1 t v1 + c2 eλ2 t v2 .

c2 eλ2 t

Autovalori e autovettori

Definizione. Un endomorfismo L : V → V su uno spazio vettoriale di dimensione finita si dice

diagonalizzabile se esiste una base ordinata B rispetto alla quale [L]B è una matrice diagonale.

Una matrice quadrata A si dice diagonalizzabile se LA è diagonalizzabile.

Vogliamo determinare quando un endomorfismo L su uno spazio vettoriale V di dimensione

finita è diagonalizzabile e, in caso affermativo, come trovare una base ordinata B = {v1 , v2 , . . . , vn }

per V tale che [L]B sia una matrice diagonale.

Ricordiamo che se [L]B = (aij ), allora

L(vj ) =

n

X

aij vi

i=0

Infatti

a1j

[L(vj )]B = [L]B [vj ]B = [L]B ej = ...

anj

2

e quindi L(vj ) = a1j v1 + . . . + anj vn .

Notiamo che se [L]B = D = diag (λ1 , λ2 , . . . , λn ), allora

L(vj ) = λj vj

Viceversa, se esiste una base ordinata B = {v1 , v2 , . . . , vn } tale che L(vj ) = λj vj per scalari

λ1 , λ2 , . . . , λn , allora chiaramente

λ1 0 · · · 0

0 λ2 · · · 0

[L]B = .

..

.. .

..

..

.

.

.

0

0

···

λn

Quindi ogni vettore v della base B soddisfa l’equazione

L(v) = λv

per qualche scalare λ. Inoltre, essendo v vettore in una base, è v 6= 0.

Definizione. Sia L un endomorfismo dello spazio vettoriale V . Un vettore non nullo v in V

si dice un autovettore di L se esiste uno scalare λ tale che L(v) = λv. Lo scalare λ si dice

l’autovalore di L corrispondente all’autovettore v.

Se A è una matrice n × n ad elementi in K, una n-upla non nulla v ∈ K n si dice un autovettore

di A se v è un autovettore di LA , ovvero se Av = λv per qualche scalare λ che si dirà l’autovalore

di A corrispondente all’autovettore v.

Una coppia (λ, v) con v autovettore e λ autovalore corrispondente, si dirà una autocoppia di L

o di A.

Quanto visto sopra ci permette di enunciare il seguente

Teorema. Un endomorfismo L su uno spazio vettoriale di dimensione finita V è diagonalizzabile

se e solo se esiste una base B di V formata da autovettori di L. Se L è diagonalizzabile e B =

{v1 , v2 , . . . , vn } è una base ordinata di autovettori di L allora [L]B è una matrice diagonale, [L]B =

diag (λ1 , λ2 , . . . , λn ), e λj è l’autovalore corrispondente a vj , j = 1, 2, . . . , n.

Quindi per diagonalizzare un endomorfismo o una matrice quadrata bisogna trovare una base

di autovettori.

Esempio Non tutti gli operatori lineari sono diagonalizzabili, non sempre si può trovare una base

di autovettori. Un semplice esempio geometrico lo conferma. Ammettiamo che la rotazione del

piano di angolo π/2 sia un operatore lineare (lo dimostreremo). Ogni vettore del piano viene

trasformato nel suo ortogonale (in senso antiorario). Quindi nessun vettore può essere un autovettore, semplicemente perché un autovettore viene trasformato in un vettore parallelo.

Osservazione Se λ, v è un’autocoppia di L, allora anche cv, λ è un’autocoppia per ogni scalare

c 6= 0. Segue che Lhvi ⊆ hvi. Se λ = 0, allora v ∈ ker L, Lhvi = {0}. Se λ = 1, L agisce come

l’identità sul sottospazio hvi. Se λ 6= 0, Lhvi = hvi. Sul campo R, possiamo vedere hvi come

una retta passante per l’origine sulla quale L agisce come una contrazione se λ < 1 o come una

dilatazione se λ > 1.

Esempio Supponiamo che V = C ∞ (R), lo spazio vettoriale di dimensione infinita formato dalle

funzioni derivabili con derivate di tutti gli ordini. Consideriamo l’operatore D : C ∞ → C ∞ definito

da D(f ) = f 0 . Allora D è un operatore lineare. Quali sono gli autovettori? La funzione f è autovettore se e solo se esiste λ reale tale che f 0 = λf . Segue che f è soluzione dell’equazione

differenziale y 0 = λy. Segue che f = ceλt con c 6= 0 costante (ricordare che gli autovettori devono

essere vettori non nulli!). Segue che ogni numero reale è autovalore di D. Per λ = 0, gli autovettori

il cui autovalore corrispondente è 0 sono le funzioni costanti (non nulle). Nel seguito ci occuperemo

solo di spazi di dimensione finita.

Come si trovano gli autovettori? Prima cosa da fare è trovare i possibili autovalori. Vediamo prima

il caso delle matrici.

Teorema. Sia A una matrice in Mn (K). Uno scalare λ ∈ K è un autovalore di A se e solo

se det(A − λ1n ) = 0. Se λ è autovalore di A e v 6= 0, allora v è autovettore con λ autovalore

corrispondente se e solo se v ∈ N(A − λ1n ).

3

dim. Uno scalare λ è autovalore se corrisponde ad un autovettore v ∈ K n , quindi se e solo

se esiste v ∈ K n , v 6= 0 tale che Av = λv, se e solo se (A − λ1n )v = 0, se e solo se il sistema

lineare omogeneo (A − λ1n )x = 0 ha soluzioni non triviali, se e solo se la matrice A − λ1n non è

invertibile, se e solo se det(A − λ1n ) = 0. Il secondo asserto è immediato.

Definizione. Se A è matrice n × n, il polinomio p(t) definito da

p(t) = pA (t) = det(A − t1n )

si dice il polinomio caratteristico di A e l’equazione

p(t) = 0

si dice l’equazione caratteristica di A.

Per semplificare la notazione, nel seguito scriveremo A − λ al posto di A − λ1n .

7 −4

Esempi 1. Trovare autovalori e autovettori di A =

. L’equazione caratteristica è

5 −2

7 − t

−4 = t2 − 5t + 6 = (t − 2)(t − 3) = 0

5

−2 − t

e quindi gli autovalori sono λ1 = 2 e λ2 = 3. Gli autovettori si trovano calcolando N(A − 2) e

N(A − 3).

λ1 = 2

5 −4

5 −4

A−2=

∼

5 −4

0 0

quindi x2 è incognita libera e 5x1 = 4x2 e (A − 2) = h(4, 5)i. Gli autovettori con autovalore 2 sono

tutti i multipli non nulli del vettore v1 = (4, 5) (un solo autovettore linearmente indipendente).

λ2 = 3

4 −4

1 −1

A−3=

∼

5 −5

0 0

quindi N(A − 3) = h(1, 1)i. Gli autovettori associati all’autovalore 3 sono i multipli non nulli del

vettore v2 = (1, 1) (un solo vettore linearmente indipendente). I due vettori v1 , v2 sono linearmente

indipendenti e quindi formano una base di R2. Segue che A è matrice diagonalizzabile. Messi i

vettori v1 , v2 in colonna e posto P = v1 v2 , allora

4 1

−1 1

−1 1

7 −4

4 1

2 0

−1

−1

P =

, P =

, P AP =

=

.

5 1

5 −4

5 −4

5 −2

5 1

0 3

Notare che, posto B = {v1 , v2 }, abbiamo

A = [LA ]S ,

[LA ]B =

2

0

0

,

3

P = PS←B .

2. Trovare autovalori e autovettori di

5

A = −3

−3

12 −6

−10 6

−12 8

Calcoliamo det(A − t) con Laplace seguendo la prima riga

5 − t

12

−6 6 = (5 − t)[(t − 8)(t + 10) + 72] − 12(3t − 6) − 6(6 − 3t) =

det(A − t) = −3 −10 − t

−3

−12

8 − t

(5 − t)(t2 + 2t − 8) + 18(2 − t) = (5 − t)(t − 2)(t + 4) + 18(2 − t) = (2 − t)[(t − 5)(t + 4) + 18] =

(2 − t)(t2 − t − 2) = (2 − t)(t − 2)(t + 1) = −(t − 2)2 (t + 1)

4

Quindi abbiamo due soli autovalori, λ1 = 2 con molteplicità 2 e λ2 = −1 con molteplicità 1.

λ1 = 2

3

12 −6

1 4 −2

A − 2 = −3 −12 6 ∼ 0 0 0

−3 −12 6

0 0 0

N(A − 2) = {(−4u + 2v, u, v)} = hv1 = (−4, 1, 0), v2 = (2, 0, 1)i. La dimensione di N(A − 2) è

uguale alla molteplicità di 2 come zero del polinomio caratteristico.

λ2 = −1

1 0 1

6

12 −6

1 2 −1

1 2 −1

6 ∼ 1 3 −2 ∼ 0 1 −1 ∼ 0 1 −1

A + 1 = −3 −9

−3 −12 9

1 4 −3

0 2 −2

0 0 0

N(A + 1) = hv3 = (−1, 1, 1)i. La dimensione di N(A + 1) è uguale alla molteplicità di 1 come zero

del polinomio caratteristico.

Si vede facilmente che l’insieme {v1 , v2 , v3 } è linearmente indipendente e quindi è una base di

R3 formata da

autovettori di A. Segue che A è matrice diagonalizzabile. Verificare che, se P =

v1 v2 v3 (mettendo i vettori in colonna!),

2 0 0

P −1 AP = 0 2 0 .

0 0 −1

È sempre vero che la molteplicità di un autovalore λ coincide con la nullità di A − λ come succede

nei due esempi ora visti? La risposta è negativa come adesso vedremo. Vedremo che in generale

la nullità non supera la molteplicità (più avanti definizioni

precise)

e può essere più piccola.

1 1

3. Trovare autovalori e autovettori della matrice A =

. Il polinomio caratteristico si calcola

0 1

facilmente p(t) = (1 − t)2 . Quindi un solo autovalore λ = 1 con molteplicità 2, N(A − 1) = h(1, 0)i

che ha dimensione 1, null (A − 1) = 1 < 2. Segue che non può esistere una base di R2 formata da

autovettori di A e quindi A non è diagonalizzabile.

Stessa

cosa anche sul campo complesso.

−2 −6

4. Trovare autovalori e autovettori di A =

. Polinomio caratteristico p(t) = t2 − 2t + 10.

3

4

Ha due soluzioni complesse coniugate λ1 = 1 + 3i e λ2 = 1 − 3i (sappiamo che un polinomio di

grado due a coefficienti reali, se non ha radici reali, ha due radici complesse coniugate).

λ1 = 1 + 3i

−3 − 3i

−6

0

0

A − (1 + 3i) =

∼

3

3 − 3i

1 1−i

N(A − 1 − 3i) = hv1 = (−1 + i, 1)i.

λ2 = 1 − 3i

A − (1 − 3i) =

−3 + 3i

−6

0

∼

3

3 + 3i

1

0

1+i

N(A − 1 − 3i) = hv2 = (−1 − i, 1)i. Si vede che v2 = v1 . Viene il sospetto che se (λ, v) è una

autocoppia di una matrice reale A, allora anche (λ, v) è una autocoppia di A. Vedremo che è

proprio cosı̀. La matrice reale A è diagonalizzabile considerata come matrice complessa ma non è

diagonalizzabile sui reali.

3

Polinomio caratteristico

Ricordiamo la definizione del polinomio caratteristico di una matrice quadrata A = (aij ) di ordine

n

a11 − t

a12

···

a1n a21

a22 − t · · ·

a2n p(t) = pA (t) = det(A − t) = .

.

.. .

.

..

..

..

. an1

an2

· · · ann − t

Se v = (v1 , v2 , . . . , vn ) ∈ Cn , porremo v = (v 1 , v 2 , . . . , v n ) e chiameremo v il vettore coniugato

di v.

5

Teorema. Sia A una matrice quadrata di ordine n ad elementi in K = R, C.

1) Il polinomio caratteristico p(t) è un polinomio di grado n a coefficienti in K. Il monomio di

grado più alto in p(t) è (−1)n tn .

2) Gli autovalori di A sono le radici di p(t), ovvero le soluzioni dell’equazione caratteristica di A.

3) Gli autovalori di A sono complessivamente n purché contati con la molteplicità. Possono essere

numeri complessi anche se A è matrice reale.

4) Se A è matrice reale e (λ, v) ∈ C × Cn è autocoppia di A, allora anche la coppia coniugata (λ, v)

è autocoppia di A.

(

dim. 1) Poniamo 1n = (δij ), δij =

1

0

se

se

i=j

i 6= j

. Ricordando la formula che definisce il

determinante, abbiamo

p(t) = det(A − t1n ) =

X

sgn(j1 j2 · · · jn )(a1j1 − tδij1 )(a2j2 − tδ2j2 ) · · · (anjn − tδnjn ).

j1 j2 ···jn

Segue che p(t) è polinomio a coefficienti in K. La potenza di t più alta che compare in p(t) è

prodotta dal termine (a11 − t)(a22 − t) · · · (ann − t). Segue che p(t) = (−1)n tn + termini di grado

inferiore.

2) Questo lo sappiamo già.

3) Questo segue dal Teorema fondamentale dell’algebra.

4) Se Av = λv, coniugando si ottiene Av = λv. D’altra parte, poiché A = A,

Av = Av = Av,

λv = λ̄v̄.

Segue che

Av = λv

e quindi (λ, v) è una autocoppia di A.

Definizione. L’insieme degli autovalori distinti, reali o complessi, di una matrice quadrata A si

dice lo spettro di A e lo si denota σ(A). Se λ ∈ σ(A), la molteplicità mλ di λ come radice del

polinomio caratteristico si dice la molteplicità algebrica dell’autovalore λ.

Quindi, se mλ è la molteplicità algebrica dell’autovalore λ, (t − λ)mλ è la massima potenza

di t − λ che divide p(t). Se λ1 , λ2 , . . . , λk sono gli autovalori distinti di A, e m1 , m2 , . . . , mk le

rispettive molteplicità algebriche, allora

p(t) = (−1)n (t − λ1 )m1 (t − λ2 )m2 · · · (t − λk )mk ,

m1 + m2 + . . . + mk = n.

Le seguenti considerazioni sui coefficienti del polinomio caratteristico hanno interesse prevalentemente teorico ma per ordine basso posso essere utili anche per il calcolo del polinomio caratteristico.

Se n = 2, e λ1 , λ2 sono gli autovalori di A

p(t) = t2 − (Tr A)t + det A,

λ1 + λ2 = Tr A,

λ1 λ2 = det A.

Lo si vede direttamente

a11 − t

a12 = (a11 − t)(a22 − t) − a12 a21 = t2 − (a11 + a22 )t + (a11 a22 − a12 a21 ) =

a21

a22 − t

t2 − (Tr A)t + det A = (t − λ1 )(t − λ2 ) = t2 − (λ1 + λ2 )t + λ1 λ2 .

Per il caso generale ci servono alcune definizioni.

Definizione. Sia A una matrice quadrata di ordine n e sia r, 1 ≤ r ≤ n, un intero. Sia I =

{i1 , i2 , . . . , ir } un sottoinsieme ordinato di {1, 2, . . . , n}, 1 ≤ i1 < i2 < . . . < ir ≤ n. Denotiamo con

AI la sottomatrice principale di ordine r di A relativa agli indici i1 , i2 , . . . , ir : se A = (aij ),

allora

ai1 i1 ai1 i2 · · · ai1 ir

ai2 i1 ai2 i2 · · · ai2 ir

AI = .

..

..

..

..

.

.

.

air i1 air i2 · · · air ir

Il determinante di una sottomatrice principale di ordine r di A si dice un minore principale di

ordine r di A.

6

Le sottomatrici principali di ordine 1 (uguali ai minori principali di ordine 1) sono gli elementi

diagonali della matrice. L’unica sottomatrice principale di ordine n di una matrice di ordine n è

la matrice stessa e il minore di ordine n è il determinante della matrice.

Se I 0 = {1, 2, . . . , n} \ I = {j1 , j2 , . . . , jn−r } è il complementare di I in {1, 2, . . . , n}, allora AI si

ottiene da A sopprimendo le righe e le colonne di indice j1 , j2 , . . . , jn−r . Il numero delle sottomatrici principali di ordine r di A è uguale al numero dei sottoinsiemi ordinati di cardinalità r di

{1, 2, . . . , n} e quindi è uguale al coefficiente binomiale

n

n!

.

=

r!(n − r)!

r

a11 a12 a13

Ad esempio, per n = 3, r = 2, le tre sottomatrici principali di A = a21 a22 a23 sono

a31 a32 a33

a22 a23

a11 a13

a11 a12

A{2,3} =

, A{1,3} =

, A{1,2} =

a32 a33

a31 a33

a21 a22

e i minori pricipali di ordine 3 sono

a22 a33 − a23 a32 ,

a11 a33 − a13 a31 ,

a11 a22 − a12 a21 .

Poniamo, per 1 ≤ r ≤ n

X

cr =

det AI =

X

minori di ordine r di A,

I⊆{1,...,n}

#I=r

in particolare

c1 = a11 + a22 + . . . + ann = Tr A,

cn = det A.

Se λ1 , λ2 , . . . , λn sono n variabili, poniamo, per 1 ≤ r ≤ n,

X

sr =

λi1 · · · λir , s1 = λ1 + . . . + λn ,

sn = λ1 · · · λn .

1≤i1 <...<ir ≤n

Le funzioni sr si dicono le funzioni simmetriche elementari in n variabili. Segue che

(t − λ1 )(t − λ2 ) · · · (t − λn ) = tn − s1 t + . . . + (−1)r sr tn−r + . . . + (−1)n sn .

Teorema. Sia A una matrice quadrata di ordine n. Sia p(t) il polinomio caratteristico di A e

siano λ1 , λ2 , . . . , λn gli autovalori di A ciascuno ripetuto tante volte quanta è la sua molteplicità

algebrica. Segue che cr = sr , r = 1, 2, . . . , n,

n

n

n−1

(−1) p(t) = t − c1 t

r

+ . . . + (−1) cr t

n−r

n

n

+ . . . + (−1) cn = t +

n

X

(−1)r cr tn−r .

r=1

dim. Poniamo A = a1 a2 · · · an ove a1 , a2 , . . . , an sono le colonne di A. Sappiamo

che det A = det a1 a2 · · · an , come funzione delle colonne, è lineare in ciascuna delle entrate

(vedi P9 nella lista delle proprietà fondamentali del determinante). Osserviamo che, se sostituiamo

alla colonna aj la colonna standard ej , allora, con Laplace seguendo la j-esima colonna, si ottiene

a11 · · · 0 · · · a1n

..

. ..

..

..

.

. ..

.

.

b

det a1 · · · ej · · · an = det aj1 · · · 1 · · · ajn

= det AI , I = {1, . . . , j, . . . , n}

.

.

.

..

..

..

..

. ..

.

an1 · · · 0 · · · ann

che è il minore principale di ordine n − 1 ottenuto sopprimendo la riga e la colonna di indice j.

Iterando, la sostituzione in A delle colonne j1 , . . . , js con le colonne standard ej1 , . . . , ejs dà

det(a1 · · · aj1 −1 ej1 aj1 +1 · · · ajs −1 ejs ajs +1 · · · an ) = det AI ,

7

I = {1, . . . , n} \ {j1 , . . . , js }

il minore principale di ordine n − s di A ottenuto sopprimendo le righe e le colonne di indice

j1 , . . . , js . Ora, dalla multilinearità del determinante segue

p(t) = det(A − t) = det(a1 − te1 a2 − te2 · · · an − ten ) =

n

X

(−1)s ts

X

det(a1 · · · aj1 −1 ej1 aj1 +1 · · · ajs −1 ejs ajs +1 · · · an ) =

1≤j1 <...<js ≤n

s=0

det A +

n

X

(−1)s ts

s=1

X

det AI

s=n−r n

=

t +

"

n

X

(−1)n−r tn−r

r=1

I⊆{1,...,n}

#I=n−s

(−1)

n

X

det AI =

I⊆{1,...,n}

#I=r

#

n

X

r

n−r

t +

(−1) cr t

.

n

r=1

Infine, poiché

tn +

n

X

(−1)r cr tn−r = (−1)n p(t) = (t − λ1 ) · · · (t − λn ) = tn +

r=1

n

X

(−1)r sr tn−r

r=1

abbiamo sr = cr , r = 1, . . . , n.

−3 1 −3

3

10 . Calcoliamo i coefficienti

Esempio Cerchiamo gli autovalori della matrice A = 20

2 −2 4

dell’equazione caratteristica usando il Teorema ora visto. Abbiamo

3 10 −3 −3 −3 1

= 32 − 6 − 29 = −3, c3 = det A = 18.

+

+

c1 = Tr A = 4, c2 = 4 20 3

−2 4 2

Segue che il polinomio caratteristico di A è

p(t) = t3 − 4t2 − 3t + 18.

Poiché p(t) è un polinomio a coefficienti interi possiamo tentare di vedere se ha soluzioni intere.

Queste vanno cercate tra i fattori di 18 che sono ±1, ±2, ±3, ±6, ±9, ±18. Facendo un po’ di prove

si trova p(−2) = 0. Dividendo p(t) per t + 2 si trova p(t) = (t + 2)(t − 3)2 . Segue che A ha due

autovalori λ1 = −2 con molteplicità algebrica 1 e λ2 = 3 con molteplicità algebrica 2. Vediamo se

A è diagonalizzabile.

1 −1 3

−1 1 −3

5

10 ∼ 0 1 −2.

λ1 = −2 A + 2 = 20

0 0

0

2 −2 6

N(A + 2) = hv1 =(−1, 2, 1)i.

−6 1 −3

2 0 1

0

10 ∼ 0 1 0.

λ2 = 3 A − 3 = 20

2 −2 1

0 0 0

N(A − 3) = hv2 = (−1, 0, 2)i.

Segue che la matrice non ha una base di autovettori e quindi non è diagonalizzabile.

4

Matrici simmetriche

In questa sezione dimostriamo un importante risultato riguardante gli autovalori di una matrice

reale simmetrica.

Teorema. Sia A ∈ Mn (R) una matrice reale simmetrica. Allora tutti gli autovalori di A sono

reali.

dim. Sia (λ, v) una autocoppia di A, Av = λv. Allora abbiamo anche Av = λv. Calcoliamo

in due modi vt Av

vt Av = vt (Av) = vt (λv) = λ(vt v),

At =A

vt Av = (vt A)v = (Av)t v = (λv)t v = λ(vt v).

8

Segue che λ(vt v) = λ(vt v) e quindi

(λ − λ)(vt v) = 0.

Osserviamo che

z1

z2

v= .

..

⇒

z1

z2

v= .

..

zn

vt v = z 1

⇒

z2

z1

z2

· · · zn . =

..

zn

zn

z 1 z1 + z 2 z2 + . . . z n zn = |z1 |2 + |z2 |2 + . . . + |zn |2 ≥ 0

e l’uguale vale se e solo se z1 = z2 = . . . = zn = 0, ovvero v = 0. Poiché v è un autovettore, è

v 6= 0 e quindi vt v > 0. Da (λ − λ)(vt v) = 0 segue

λ=λ

e quindi λ è un numero reale.

Vedremo nel capitolo successivo dedicato all’ortogonalità che, non solo una matrice reale ha tutti

gli autovalori reali, ma anche che LA è diagonalizzabile.

5

Matrici simili

Definizione. Due matrici quadrate A e B dello stesso ordine n (ad elemnti nel campo K) si

dicono simili se B = P −1 AP con P ∈ Mn (K) matrice invertibile.

La relazione di similarità tra due matrici è una relazione di equivalenza:

1) riflessiva: A = A, P = 1n ,

2) simmetrica: se B = P −1 AP , allora A = (P −1 )−1 BP −1 .

3) transitiva: se B = P −1 AP , C = Q−1 BQ, allora C = Q−1 (P −1 AP )Q = (P Q)−1 A(P Q).

Teorema. a) Se A e B sono matrici simili, allora A e B hanno lo stesso polinomio caratteristico,

pA (t) = pB (t).

b) La matrice A è diagonalizzabile se e solo se A è simile ad una matrice diagonale.

dim. a) Se B = P −1 AP , allora

pB (t) = det(B − t) = det(P −1 AP − t) = det(P −1 AP − tP −1 P ) = det(P −1 (A − t)P ) =

det(P −1 ) det(A − t) det P = (det P )−1 det(A − t) det P = det(A − t) = pA (t).

b) Per definizione, la matrice A è diagonalizzabile se la trasformazione lineare associata LA è

diagonalizzabile. Quindi se A è diagonalizzabile, allora esiste una base B in K n rispetto alla quale

[LA ]B = D è matrice diagonale. Se S denota la base standard di K n , posto P = PS←B , abbiamo,

ricordando che [LA ]S = A,

D = [LA ]B = PB←S [LA ]S PS←B = P −1 AP

e quindi A è simile alla matrice diagonale D.

Viceversa, supponiamo A simile alla matrice diagonale D. Esiste allora una matrice invertibile P

tale che D = P −1 AP . Se v1 , v2 , . . . , vn sono le colonne della matrice P , essendo P invertibile,

l’insieme B = {v1 , v2 , . . . , vn } è una base per K n e P = PS←B . Segue che

[LA ]B = PB←S [LA ]S PS←B = P −1 AP = D

e quindi A è diagonalizzabile.

Dal primo asserto del Teorema segue che matrici simili hanno gli stessi autovalori con le stesse

molteplicità algebriche. Ma non è vero che matrici che hanno gli stessi autovalori sono simili

(trovare un controesempio).

Osserviamo che se L : V → V è un endomorfismo (con V di dimensione finita), le matrici A = [L]A

e B = [L]B associate ad L rispetto alle basi A e B di V sono simili:

B = P −1 AP,

ove

P = PA←B

Segue che det[L]B = det B = det(P −1 AP ) = det A = det[L]A e quindi det[L]B non dipende dalla

scelta della base B per rappresentare L. Questo fatto giustifica la definizione seguente.

9

Definizione. Se L : V → V è un endomorfismo dello spazio vettoriale di dimensione finita V , il

determinante di L è definito da

det L = det[L]B

ove B è una qualunque base per V .

Il polinomio caratteristico di L è definito da

pL (t) = det(L − t) = det(L − t idV ).

Segue che (λ, v) (λ ∈ K e v in V ) è una autocoppia se e solo se v 6= 0 e v ∈ ker(L − λ idV ).

Se B è una base per V , ricordo l’isomorfismo φB : V → K n , φB (v) = [v]B . Posto A = [L]B ,

abbiamo il seguente diagramma commutativo

L

V −−−−→

φB y

V

φ

y B

K n −−−−→ K n

LA

Segue che (λ, v) è autocoppia di L se e solo se (λ, [v]B ) è autocoppia di A:

se (λ, [v]B ) è autocoppia di A, allora (λ, v) è autocoppia di L

φB ◦ L(v) = LA ◦ φB (v) = A[v]B = λ[v]B = λφB (v) = φB (λv)

⇒

L(v) = λv,

se (λ, v) è autocoppia di L, allora (λ, [v]B ) è autocoppia di A

A[v]B = LA ◦ φB (v) = φB ◦ L(v) = φB (λv) = λφB (v) = λ[v]B .

Questo risultato spiega come si calcolano autovalori e autovettori di L: si calcolano autovalori e

autovettori di una qualunque matrice associata e poi si ritorna a V .

Esempio Sia L : P2 → P2 definito da L(P (x)) = P (1) + P 0 (0)x + (P 0 (0) + P 00 (0))x2 . È immediato

verificare che L è lineare. Calcoliamo gli autovettori di L e vediamo se L è diagonalizzabile. Sia

S = {1, x, x2 } la base standard di P2 . Poiché L(1) = 1 (questo dice che 1 è un autovettore),

L(x) = 1 + x + x2 , L(x2 ) = 1 + 2x2 , abbiamo

1 1 1

A = [L]S = 0 1 0

0 1 2

Il polinomio caratteristico di A è pA (t) = −(t − 1)2 (t − 2) e quindi gli autovalori sono λ1 = 1 con

molteplicità 2 e λ

molteplicità

1.

2 = 2 con

0 1 1

0 1 1

λ1 = 1 A − 1 = 0 0 0 ∼ 0 0 0, N(A − 1) = h(1, 0, 0), (0, −1, 1)i,

0 1 1

0 0 0

−1 1 1

1 −1 −1

0 , N(A − 2) = h(1, 0, 1)i.

λ2 = 2 A − 2 = 0 −1 0 ∼ 0 1

0

1 0

0 0

0

Segue che L è diagonalizzabile e la base diagonalizzante è B = {1, −x + x2 , 1 + x2 }.

6

Autovettori linearmente indipendenti

Supponiamo nel seguito che V sia uno spazio vettoriale di dimensione finita sul campo K e che

L : V → V sia un endomorfismo di V . Gli autovettori di L saranno, a meno che non si affermi il

contrario, sempre scalari nel campo K.

Teorema. Siano (λ1 , v1 ), (λ2 , v2 ), . . . , (λk , vk ) autocoppie di L con λ1 , λ2 , . . . , λk autovalori distinti. Allora {v1 , v2 , . . . , vk } è linearmente indipendente.

dim. Induzione su k. Se k = 1, allora, essendo v1 un autovettore, v1 6= 0 e quindi è linearmente

indipendente. Ora supponiamo che il risultato sia vero per k − 1 autovalori con k ≥ 2 e facciamo

vedere che {v1 , v2 , . . . , vk } è linearmente indipendente. Siano c1 , c2 , . . . , ck scalari tali che

c1 v1 + c2 v2 + . . . + ck vk = 0.

10

Applichiamo L − λk ad entrambi i lati di questa uguaglianza. Otteniamo

c1 (λ1 − λk )v1 + c2 (λ2 − λk )v2 + . . . + ck−1 (λk−1 − λk )vk−1 = 0.

Per l’ipotesi induttiva, l’insieme {v1 , v2 , . . . , vk−1 } è linearmente indipendente. Segue che

c1 (λ1 − λk ) = c2 (λ2 − λk ) = . . . = ck−1 (λk−1 − λk ) = 0

Poiché per ipotesi λ1 , λ2 , . . . , λk sono distinti, segue che λi − λk 6= 0, i = 1, 2, . . . , k − 1. Segue

che c1 = c2 = . . . = ck−1 = 0 e quindi ck vk = 0. Essendo vk un autovettore, vk 6= 0 e dunque

ck = 0. In conclusione abbiamo c1 = c2 = . . . = ck = 0 e quindi l’unica combinazione lineare dei

vi è quella triviale. Segue che {v1 , v2 , . . . , vk } è linearmente indipendente.

Corollario. Se V ha dimensione n ed L ha n autovalori distinti, allora L è diagonalizzabile.

dim. Supponiamo che L abbia n autovalori distinti λ1 , λ2 , . . . , λn . Sia vi un autovettore

corrispondente a λi , i = 1, 2, . . . , n. Allora {v1 , v2 , . . . , vn } è linearmente indipendente e quindi

una base per V che ha dimensione n.

Sappiamo che l’insieme

Vλ = ker(L − λ) = {v | L(v) = λv}

è un sottospazio di V . È formato dal vettore nullo e da tutti gli autovettori di L il cui autovettore

corrispondente è λ.

Definizione. Il sottospazio Vλ si dice l’autospazio di L corrispondente all’autovalore λ. La

dimensione di Vλ

nλ = dim Vλ = null (L − λ)

si dice la molteplicità geometrica dell’autovalore λ.

Teorema. Per ogni autovalore λ di L, la molteplicità geometrica non supera la molteplicità algebrica

nλ ≤ mλ

dim. Sia {v1 , v2 , . . . , vr }, r = nλ , una base di Vλ . Completiamo questa base ad una base

B = {v1 , . . . vr , vr+1 , . . . , vn } per V . La matrice A di L rispetto a questa base ha la forma

λ1r ∗

A = [L]B =

0

C

dove C è una matrice quadrata di ordine n − r. Segue che il polinomio caratteristico di A ha la

forma (ricordare la formula per il determinante di matrici a blocchi)

(λ − t)1r

∗

p(t) = det

= (λ − t)r det(C − t).

0

C − t1n−r

Segue che (t − λ)nλ divide p(t) e pertanto mλ ≥ nλ .

Teorema. Siano λ1 , λ2 , . . . , λk autovalori distinti di L e siano Vλ1 , Vλ2 , . . . , Vλk i corrispondenti

autospazi.

a) Per ogni i = 1, 2, . . . , k, sia vi un vettore in Vλi . Se

v1 + v2 + . . . + vk = 0

allora vi = 0 per ogni i = 1, 2, . . . , k.

b) Sia Si un sottoinsieme linearmente indipendente dell’autospazio Vλi , i = 1, 2, . . . , k. Allora

S = S1 ∪ S2 ∪ . . . ∪ Sk .

dim. a) Supponiamo che qualche vi 6= 0. Rinumerando eventualmente i vettori, possiamo

supporre che esista un intero h con 1 ≤ h ≤ k tale che vi 6= 0 per 1 ≤ i ≤ h e vi = 0 per

i > h. Segue che i vi , i = 1, . . . , h, sono autovettori corrispondenti ad autovalori distinti e dunque

linearmente indipendenti, contraddizione.

b) Per ogni i = 1, 2, . . . , k, numeriamo i vettori di Si come segue

Si = {vi1 , vi2 , . . . , vini }.

11

Dunque S = {vij | 1 ≤ i ≤ k, 1 ≤ j ≤ ni }. Consideriamo una combinazione lineare nulla dei vij

X

ci,j vij = 0.

i,j

Per ogni i, poniamo

wi =

ni

X

cij vij .

j=1

Segue che wi ∈ Vλi e w1 + w2 + . . . + wk = 0. Da a) segue che wi = 0 per ogni i. Ma ciascun

insieme Si è linearmente indipendente, e quindi cij = 0. Segue che l’unica combinazione lineare

nulla dei vij è quella triviale e pertanto i vettori vij sono linearmente indipendenti.

7

Diagonalizzabilità

Supponiamo, come nella sezione precedente, che V sia uno spazio vettoriale di dimensione finita

sul campo K e che L : V → V sia un endomorfismo di V . Gli autovettori di L saranno, a meno

che non si affermi il contrario, sempre scalari nel campo K.

Definizione. Sia p(t) un polinomio a coefficienti nel campo K. Diremo che p(t) si spezza su K

se p(t) ha tutte le sue radici in K, ovvero, se p(t) ha grado n,

p(t) = c(t − λ1)(t − λ2 ) · · · (t − λn ),

con

λ1 , λ2 , . . . , λn ∈ K, c ∈ K, c 6= 0.

Detto ancora in un altro modo, tenendo conto delle molteplicità,

p(t) = c(t − λ1 )m1 (t − λ2 )m2 · · · (t − λk )mk

con λ1 , λ2 , . . . , λk ∈ K distinti, c ∈ K, c 6= 0 e m1 + m2 + . . . mk = n.

Dal Teorema fondamentale dell’algebra segue che ogni polinomio a coefficienti complessi si

spezza su C (mentre sappiamo che un polinomio a coefficienti reali può non spezzarsi su R, ad

esempio un polinomio di secondo grado con discriminante negativo).

Teorema. Se L è diagonalizzabile, allora il suo polinomio caratteristico si spezza su K.

dim. Se esiste una base ordinata B di V con [L]B = diag (λ1 , λ2 , . . . , λn ), allora i λi sono in K

e il polinomio caratteristico di L è p(t) = ±(t − λ1 )(t − λ2 ) · · · (t − λn ) e quindi p(t) si spezza su

K.

Segue che una condizione necessaria affinchè L sia diagonalizzabile è che il polinomio si spezzi su

K. La condizione non è sufficiente, come abbiamo visto in precedenti esempi. Il Teorema seguente

fa vedere quali condizioni bisogna aggiungere per la diagonalizzabilità.

Teorema. Supponiamo che V abbia dimensione n e che λ1 , λ2 , . . . , λk siano gli autovettori distinti di L con molteplicità algebriche m1 , m2 , . . . , mk e molteplicità geometriche n1 , n2 , . . . , nk .

Supponiamo che il polinomio caratteristico di L si spezzi su K (quindi m1 + m2 + . . . + mk = n).

Allora

a) L è diagonalizzabile se e solo se le molteplicità geometriche coincidono con le molteplicità algebriche

ni = mi ,

per ogni i = 1, 2, . . . , k.

b) Se L è diagonalizzabile e Bi è una base dell’autospazio Vλi , allora B = B1 ∪ B2 ∪ . . . ∪ Bk è una

base di autovettori per V .

dim. Supponiamo L diagonalizzabile e sia B una base di autovettori di L. Per ogni i sia

Bi = B ∩ Vλi l’insieme degli autovettori in B il cui autovalore corrispondente è λi . Sia di = #Bi .

Chiaramente di ≤ ni = dim Vλi perché Bi è un sottoinsieme linearmente indipendente di uno spazio

di dimensione ni . Ora d1 + d2 + . . . + dk = n perché B contiene n vettori ciascuno dei quali è

autovettore e gli unici autovettori possibili sono i λi . Segue che

n=

k

X

i=1

di ≤

k

X

ni ≤

i=1

12

k

X

i=1

mi = n.

Segue

k

X

(mi − ni ) = 0 e, poiché mi − ni ≥ 0 per ogni i, è ni = mi per ogni i.

i=1

Viceversa, supponiamo che ni = mi per tutti gli i. Facciamo vedere che L è diagonalizzabile e

simultaneamente dimostriamo b). Sia Bi una base di Vλi . Da un Teorema precedente segue che

B = B1 ∪ B2 ∪ . . . ∪ Bk è linearmente indipendente. Inoltre, poiché ni = mi , B contiene n vettori e

quindi è una base per V .

In conclusione per verificare se un endomorfismo L : V → V è diagonalizzabile si procede come

segue.

I. Si calcola il polinomio caratteristico di L.

II. Si calcolano le radici del polinomio caratteristico.

Se il polinomio caratteristico non si spezza su K, allora L non è diagonalizzabile. Se il polinomio

caratteristico si spezza su K, si procede.

III. Si calcolano gli autospazi e le dimensioni degli autospazi. Se le molteplicità geometriche coincidono con le molteplicità algebriche, allora L è diagonalizzabile. Altrimenti, se qualche molteplicità

geometrica è minore della corrispondente molteplicità algebrica, L si dice difettivo (perché gli

mancano degli autovettori) e non è diago-nalizzabile.

8

Diagonalizzabilità e somma diretta

Rimando alla definizione di somma diretta generalizzata e alle sue caratterizzazioni che si trovano

nella sezione 6 del capitolo Spazi vettoriali 2.

Teorema. Un operatore lineare L su uno spazio vettoriale V di dimensione finita è diagonalizzabile

se e solo se V è la somma diretta degli autospazi di L.

dim. Siano λ1 , λ2 , . . . , λk gli autovalori distinti di L.

Supponiamo L diagonalizzabile. Sia Bi una base per l’autospazio Vλi . Sappiamo che allora B1 ∪

B2 ∪ . . . ∪ Bk è una base per V e dunque V = Vλ1 ⊕ Vλ2 ⊕ · · · ⊕ Vλk .

Viceversa, supponiamo che V = Vλ1 ⊕ Vλ2 ⊕ · · · ⊕ Vλk . Per ogni i = 1, 2, . . . , k, scegliamo una base

Bi di Vλi . Allora B = B1 ∪ B2 ∪ . . . ∪ Bk è una base di V . Poiché B è una base di autovettori di L,

allora L è diagonalizzabile.

Terminologia

Endomorfismo diagonalizzabile. Matrice diagonalizzabile. Autovettore. Autovalore. Autocoppia.

Polinomio caratteristico. Equazione caratteristica. Molteplicità algebrica. Sottomatrice principale.

Minore principale. Matrici simili. Similarità. Determinante di un endomorfismo. Polinomio

caratteristico di un endomorfismo. Autospazio. Molteplicità geometrica. Endomorfismo difettivo.

Saper fare

• Determinare se una coppia (λ, v) è

un’autocoppia di una data matrice.

• Calcolare molteplicità algebrica e geometrica di un autovalore.

• Determinare gli autovettori corrispondenti ad un dato autovalore.

• Calcolare gli autospazi di una matrice,

calcolarne basi e dimensioni.

• Determinare l’autovalore corrispondente

ad un dato autovettore.

• Stabilire se un endomorfismo è diagonalizzabile o no.

• Calcolare il polinomio caratteristico di

una matrice data A e usarlo per calcolare gli autovalori di A.

• Trovare una base di autovettori per una

matrice diagonalizzzabile.

Vero o Falso?

• Gli autovalori sono scalari non nulli.

qualunque vettore v tale che Av = λv.

• Un

autovettore

corrispondente

all’autovalore λ della matrice A è un

• Gli autovalori di una matrice triangolare, superiore o inferiore sono gli ele13

• Matrici simili hanno gli stessi autovettori.

menti diagonali della matrice.

• Se le matrici A e B hanno lo stesso polinomio caratteristico, allora A e B devono avere esattamente gli stessi autovettori.

• Se L è diagonalizzabile, allora Ln , n ≥ 2,

è diagonalizzabile.

• Se A e B sono matrici simili, allora At e

B t sono simili.

• Una matrice A quadrata di ordine n ha

esattamente n autovalori, reali o complessi, contati con la molteplicità.

• Se A, matrice quadrata, è simile alla matrice λ1, allora A = λ1.

• Una combinazione lineare non nulla di

autovettori di una matrice A è ancora

un autovettore di A.

• Esistono matrici diagonalizzabili non

scalari con un unico autovalore.

• Se λ è un autovalore della matrice A,

allora λ è un autovalore di A.

• Un endomorfismo su uno spazio vettoriale n-dimensionale che ha meno di n autovalori distinti non è diagonalizzabile.

• Se λ è un autovalore della marice A, allora λ2 è un autovalore di A2 .

• Due autovettori distinti corrispondenti

allo stesso autovalore sono sempre linearmente dipendenti.

• Se λ è un autovalore di A allora λ 6= 0.

• Se λ è un autovalore di un endomorfismo

L, allora ogni vettore in Vλ è un autovettore di L.

• Se ogni autovalore di A è diverso da zero,

allora A è una matrice invertibile.

• Se tutti gli autovalori della marice A

sono nulli, allora A = 0.

• Se λ1 , λ2 sono autovalori distinti di un

operatore lineare L, allora Vλ1 ∩ Vλ2 =

{0}.

• La matrice A e la sua trasposta At hanno

gli stessi autovalori.

• Se A ∈ Mn (K) ha due autovalori distinti λ1 e λ2 e dim Vλ1 = n − 1, allora A

è diagonalizzabile.

• Se L è un operatore lineare invertibile

diagonalizzabile, allora L−1 è diagonalizzabile.

• Se λ e µ sono autovalori di A e B risp.,

allora λ + µ è autovalore di A + B.

• Se due matrici hanno gli stessi autovalori, comprese le molteplicità, allora le

matrici sono simili.

• Se λ e µ sono autovalori di A e B risp.,

allora λµ è autovalore di AB.

Esercizi

1. Per ciascuna delle seguenti matrici A ∈ Mn (K),

a) Determinare tutti gli autovalori di A.

b) Per ogni autovalore λ di A, trovare l’insieme degli autovettori corrispondenti a λ.

c) Se possibile, trovare una base di K n formata da autovettori di A.

d) Se si è riusciti a trovare una tale base, determinare una matrice invertibile P ed una matrice

−1

diagonale

D tali

che P AP = D.

1 2

7 4

i 1

i) A =

, K = R,

ii) A =

, K = R,

iii) A =

, K = C,

3 2

−1 3

2 −i

0 −2 −3

2 0 −1

iv) A = −1 1 −1 , K = R,

v) A = 4 1 −4 , K = R,

2

5

2 0 −1

2

−2 1

0

0 2 2

vi) A = 1 −1 −1 , K = R, C

vii) A = 2 0 2 , K = R,

3 −3

2 2 0

1

−2 1 4

1+i

0

0

ix) A = 2 − 2i 1 − 3i 0 , K = C,

viii) A = −2 1 4 , K = R,

4

1

−2 1

2i

0

0 0 1

1 1 0

x) A = 1 0 −1 , K = R, C

xi) A = 0 1 2 , K = R, C,

0 1 1

0 0 3

14

−1

xii) A = 8

−10

0

−1

xiv) A =

0

0

−1 −2

−11 −8 ,

11

7

1 0 0

0 0 0

,

0 0 −1

0 1 0

K = R,

K = R, C

1

xiii) A = 8

−8

1

4

xv) A =

4

7

−4

−11

8

2 3

3 2

5 6

6 5

−4

−8 , K = R,

5

4

1

, K = R.

7

4

2. Per ciascun operatore lineare L su V , trovare gli autovalori di L ed una base ordinata B per V

tale che [L]B sia una matrice diagonale.

a) V = P2 (R); L(p(x)) = xp0 (x) + p(2)x + p(3),

0

b) V = P3 (R); L(p(x))

=

(x) + p00 (2)x − p(2),

xp a b

c d

,

d) V = M2 (R); L(A) = At + 2Tr(A)12 .

c) V = M2 (R); L

=

c d

a b

3. Trovare una matrice A di taglia 3 × 3 tale che

Av1 = v1 ,

Av2 = 2v2 ,

Av3 = 3v3 ,

ove

1

v1 = 2 ,

2

2

v2 = −2 ,

1

−2

v3 = −1 .

2

4. Sia L l’operatore lineare su Mn (R) definito da L(A) = At .

a) Calcolare gli autovalori di L.

b) Descrivere gli autovettori di L corrispondenti a ciascun autovalore di L.

c) Trovare, se possibile, una base ordinata B per Mn (R) tale che [L]B sia diagonale. (Provare prima

con n = 2).

5. Siano A, B matrici in Mn (C).

a) È vero o falso che, se B è invertibile, esiste z ∈ C tale che A + zB non sia invertibile?

b) È vero o falso che è possibile trovare matrici A e B quadrate di ordine 2 tali che, per ogni z ∈ C,

sia A che A + zB siano invertibili?

6. Sia D : Pn (R) → Pn (R) l’operatore lineare definito da D(P (x)) = P 0 (x). Trovare autovalori e

autovettori di D e stabilire se D è diagonalizzabile.

0 −2

7. Sia A =

. Trovare una matrice P invertibile 2 × 2 tale che P −1 AP sia una matrice

1 3

diagonale D. Trovare un’espressione per An , n ≥ 2.

8. Sia L un operatore lineare invertibile su uno spazio vettoriale di dimensione finita. È vero o

falso che L è diagonalizzabile se e solo se L−1 è diagonalizzabile?

9. Sia A ∈ M(K).

a) Far vedere che A e At hanno lo stesso polinomio caratteristico e quindi gli stessi autovalori con

la stessa molteplicità algebrica..

b) È vero o falso che per ogni autovalore λ gli autospazi corrispondenti Vλ di A e Vλ0 di At

coincidono?

c) È vero o falso che dim Vλ = dim Vλ0 , per ogni autovalore λ?

d) È vero o falso che se A è diagonalizzabile, anche At è diagonalizzabile?

10. Siano B e C matrici quadrate di ordine p e q rispettivamente. È vero o falso che la matrice a

blocchi

B 0

A=

0 C

è diagonalizzabile se e solo se B e C sono diagonalizzabili.

Definizione. Due operatori lineari L ed M su uno spazio vettoriale V di dimensione finita si

dicono simultaneamente diagonalizzabili se esiste una base ordinata B per V rispetto alla

quale [L]B ed [M ]B sono entrambe matrici diagonali. Analogamente, due matrici A, B ∈ Mn (K) si

dicono simultaneamente diagonalizzabili se LA e LB sono simultaneamente diagonalizzabili

come operatori su K n .

11. Siano A, B ∈ Mn (K).

a) Far vedere che A e B sono simultaneamente diagonalizzabili se e solo se esiste una matrice

15

invertibile P tale che le matrici P −1 AP e P −1 BP siano entrambe diagonali.

b) È vero o falso che se A e B sono simultaneamente diagonalizzabili, allora AB = BA?

c) Far vedere che se AB = BA, allora A e B hanno un autovettore comune (su C).

d) Far vedere che se AB = BA e A e B sono diagonalizzabili, allora A e B sono simultaneamente

diagonalizzabili.

12. Sia A ∈ Mn (K) una matrice nilpotente (vuol dire Ak = 0 per qualche intero k > 1.)

a) Trovare gli autovalori di A.

b) È vero o falso che A è diagonalizzabile?

16