Metodi di soluzione di alcuni tipi di esercizi

Corso di Matematica per Farmacia

Università di Milano, a.a. 2015/16

December 4, 2015

Questo documento vuole essere un aiuto a focalizzare le tecniche di soluzione

di alcuni tipi di esercizi che abbiamo incontrato durante il corso. Naturalmente,

questo breve documento non sostituisce un libro, né tantomeno la pratica di

soluzione degli esercizi.

Non tutti i tipi di esercizi che abbiamo incontrato sono considerati; questo

non vuol dire in alcun modo che gli altri non entreranno nei testi di esame,

ma solo che altri o sono considerati assolutamente standard e non meritano

discussione (ad esempio il dominio di definizione delle funzioni, o alcuni aspetti

dello studio di funzione), o semplicemente che i loro metodi di soluzione non

possono essere riassunti in breve, e quindi si rimanda per essi al libro di testo.

Nel preparare queste pagine ho cercato di fare attenzione, ma naturalmente

la cura con cui sono preparate non è paragonabile a quella con cui si prepara

un libro: spero che non siano rimasti errori, ma in ogni caso in cui si avesse

contrasto con quanto affermato nel libro, si può tranquillamente assumere che

l’errore sia in queste pagine.

1

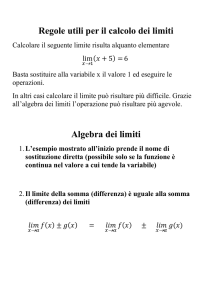

Limiti

1. La funzione y = f (x) ammette y = y0 come limite per x → x0 se per ogni

ε > 0 piccolo a piacere esiste un δ > 0 tale che per tutti gli x 6= x0 con

|x − x0 | < δ si ha |f (x) − y0 | < ε. In questo caso si scrive

lim f (x) = y0 .

x→x0

2. Attenzione alla condizione x 6= x0 nella definzione precedente!

3. Se esiste un δ > 0 tale che per tutti gli x < x0 con x0 − x < δ si ha

|f (x) − a| < ε, si dice che y = f (x) ammette a come limite per x che tende

ad x0 da sinistra. In questo caso si scrive

lim f (x) = a .

x→x−

0

1

Allo stesso modo, se esiste un δ > 0 tale che per tutti gli x > x0 con

x − x0 < δ si ha |f (x) − b| < ε, si dice che y = f (x) ammette b come limite

per x che tende ad x0 da destra. In questo caso si scrive

lim f (x) = b .

x→x+

0

La funzione y = f (x) ammette un limite per x → x0 se e solo se i suoi

limiti da destra e da sinistra esistono e coincidono.

4. La funzione y = f (x) è continua in x = x0 se e solo se

lim f (x) = f (x0 ) .

x→x0

Si noti che questa scrittura richiede l’esistenza del limite, e che questo

coincida con il valore assunto dalla funzione nel punto x0 .

5. Il limite di y = f (x) si può anche considerare per x → ±∞. In questo

caso la funzione y = f (x) ammette y = y0 come limite per x → ∞ se per

ogni ε > 0 piccolo a piacere esiste un A > 0 tale che per tutti gli x con

x > A si ha |f (x) − y0 | < ε. In questo caso si scrive

lim f (x) = y0 .

x→∞

Allo stesso modo, la funzione y = f (x) ammette y = y0 come limite per

x → −∞ se per ogni ε > 0 piccolo a piacere esiste un B > 0 tale che per

tutti gli x con x < −B si ha |f (x) − y0 | < ε. In questo caso si scrive

lim f (x) = y0 .

x→−∞

6. Il limite di una somma di funzioni è uguale (se questi esistono) alla somma

dei limiti.

7. Il limite di un prodotto di funzioni è uguale (se questi esistono) al prodotto

dei limiti.

8. Il limite di un quoziente tra funzioni è uguale (se questi esistono) al

quoziente dei limiti, purché il limite del denominatore sia diverso da zero.

9. Si ha, con k una costante,

sin(kx)

1 − cos(kx)

k2

= k ; lim

.

=

x→0

x→0

x

x2

2

lim

10. Il numero e è definito come

n

1

1 +

= e.

n→∞

n

lim

2

11. Più in generale,

lim

x→∞

k

1 +

x

x

= ek .

12. Dovendo calcolare il limite del prodotto (o quoziente) di due espressioni

per x → 0, è conveniente isolare in ognuno dei fattori il termine che cresce

più velocemente, o si annulla più lentamente, per x → 0 (per i polinomi,

quello di grado minimo).

13. Dovendo calcolare il limite del prodotto (o quoziente) di due espressioni

per x → ±∞, è conveniente isolare in ognuno dei fattori il termine che

cresce più velocemente, o si annulla più lentamente, per x → ±∞ (per i

polinomi, quello di grado massimo).

2

Derivate

2.1

Aspetti generali

1. E’ sufficiente ricordare la definizione di derivata di una funzione,

f (x + ε) − f (x)

df

= lim

.

ε→0

dx

ε

2. Inoltre, è bene ricordare le regole di derivazione per somma (o differenza),

prodotto o quoziente di funzioni:

(f ± g)0

=

f 0 ± g0 ;

(f g)0

=

f 0 g + f g0 ;

0

=

(f 0 g − f g 0 )/g 2 .

(f /g)

3. Per una funzione composta F (x) = f [g(x)] vale la

F 0 (x) = f 0 [g(x)] · g 0 (x) .

4. Inoltre, se f −1 è la funzione inversa di f (dunque f −1 [f (x)] = x), la

derivata di f −1 nel punto f (x) soddisfa

df −1 [f (x)]

1

= 0

.

dx

f (x)

5. Una tabella delle derivate delle funzioni elementari è fornita nella pagina

web del corso.

3

2.2

Uso delle derivate per calcolare i limiti

1. Se si deve calcolare il limite

lim

x→x0

f (x)

g(x)

e risulta

lim f (x) = 0 ,

lim g(x) = 0 ,

x→x0

x→x0

si può usare il teorema de L’Hopital: se esiste il limite

lim

x→x0

f 0 (x)

,

g 0 (x)

allora esiste anche

lim

x→x0

ed inoltre si ha

lim

x→x0

f (x)

g(x)

f (x)

f 0 (x)

= lim 0

.

x→x0 g (x)

g(x)

2. Allo stesso modo, se si deve calcolare il limite

lim

x→x0

f (x)

g(x)

e risulta

lim f (x) = ±∞ ,

lim g(x) = ±∞ ,

x→x0

x→x0

si ha che se esiste il limite

lim

x→x0

f 0 (x)

,

g 0 (x)

allora esiste anche

lim

x→x0

ed inoltre si ha

lim

x→x0

f (x)

g(x)

f (x)

f 0 (x)

= lim 0

.

x→x0 g (x)

g(x)

3. I problemi del tipo in cui si deve calcolare il limite

lim f (x) g(x)

x→x0

e risulta

lim f (x) = 0 ,

x→x0

lim g(x) = ∞ ,

x→x0

si riportano a quelli di uno dei due tipi precedenti.

4

2.3

Polinomio o serie di Taylor

1. Data una funzione f (x) che sia derivabile n volte in un intervallo I che

contiene il punto x = x0 , il suo polinomio di Taylor di ordine n in questo

punto è definito come

Pn (x; x0 ) =

n

X

(x − x0 )k

k!

k=0

f (k) (x0 ) .

2. Quando si ha n = ∞, si parla di serie di Taylor.

3. Per x ∈ I si ha

f (x) = Pn (x; x0 ) + Rn (x; x0 )

dove Rn è il resto di ordine n. Esiste un punto y compreso tra x ed x0

per cui vale la formula di Lagrange per il resto,

Rn (x; x0 ) =

(x − x0 )n+1 (n+1)

f

(y) .

(n + 1)!

4. Per la funzione f (x) = ex si ha la serie di Taylor

e

x

=

∞

X

xk

k=0

k!

.

Vale quindi la formula approssimata

ex ≈ 1 + x + x2 /2 + x3 /6 + ...

5. Per la funzione f (x) = sin(x) si ha la serie di Taylor

sin(x) =

∞

X

(−1)k x2k+1

k=0

.

(2k + 1)!

Vale quindi la formula approssimata

sin(x) ≈ x − x3 /6 + ...

6. Per la funzione f (x) = cos(x) si ha la serie di Taylor

∞

X

(−1)k x2k

cos(x) =

k=0

(2k)!

Vale quindi la formula approssimata

cos(x) ≈ 1 − x2 /2 + ...

5

.

7. Per la funzione f (x) = log(1 + x) si ha la serie di Taylor

log(1 + x) =

∞

X

(−1)k xk+1

k=0

k+1

.

Vale quindi la formula approssimata

log(1 + x) ≈ x − x2 /2 + ...

8. Per le funzioni (1 + x)a vale la formula approssimata

(1 + x)a ≈ 1 + ax + ... ;

in particolare,

√

1+x ≈

1

≈

1+x

3

1 + x/2 + ...

1 − x + ...

Integrali

1. E’ necessario ricordare le regole fondamentali di integrazione; in particolare, che l’integrale di una funzione f (x) è una sua primitiva, cioè una

funzione F (x) (sempre definita a meno di una costante additiva C) tale

che dF (x)/dx = f (x). Ne segue che

Z

df

dx = f (x) ;

dx

ed inoltre che

Z

Z

Z

[f (x) + g(x)] dx =

f (x) dx +

g(x) dx ;

Z

Z

k f (x) dx = k

f (x) dx .

2. E’ comodo ricordare gli integrali elementari, come riportati ad esempio

nella tabella del capitolo X.2 del testo. Naturalmente, tutti questi possono

essere ricavati in modo semplice nel caso non li si ricordi.

3. E’ anche comodo ricordare che se F (x) è una primitiva di f (x), allora

Z

1

F (ax) + C ,

f (ax) dx =

a

Z

f (x + b) dx = F (x + b) + C ,

Z

1

F (ax + b) + C .

f (ax + b) dx =

a

6

4. Il metodo di integrazione per parti si basa sulla formula di derivazione di

un prodotto di funzioni:

d

[f (x) g(x)] = f 0 (x) g(x) + f (x) g 0 (x) ;

dx

questa significa anche che

f 0 (x) g(x) =

d

[f (x) g(x)] − f (x) g 0 (x) .

dx

Integrando ambo i membri abbiamo

Z

Z

0

f (x) g(x) dx = [f (x) g(x)] −

f (x) g 0 (x) dx .

Se nell’integrale da calcolare si ravvisa la possibilità di decomporre la

funzione integranda come prodotto di due funzioni, e di identificare una

di queste come una derivata, si applica la formula precedente.

5. Il metodo di integrazione per sostituzione (o cambio di variabili) si basa

sulla possibilità di esprimere la variabile indipendente come funzione di

un’altra variabile, sempolificando con ciò l’espressione della funzione integranda – o più precisamente del differenziale f (x)dx = dF da integrare.

Nel far ciò, è necessario ricordare che se x = φ(t), allora il differenziale dx

si esprime come

dx = (dφ/dt) dt .

A volte è più conveniente esprimere la sostituzione come t = ψ(x); in

questo caso abbiamo

dt = (dψ/dx) dx .

6. Per integrare funzioni del tipo [ax2 + bx + c]−1 , cioè per calcolare

Z

1

dx ,

ax2 + bx + c

si scrive il denominatore come somma o differenza di quadrati:

ax2 + bx + c = a[x2 + 2(b/2a)x + (c/a)] = a[(x + (b/2a))2 + ((c/a) − (b/2a)2 )]

= a[(x + (b/2a))2 ± k 2 ]

con il segno dettato dal segno di (c/a − b2 /4a2 ).

Con la sostituzione

x +

b

= t;

2a

dx = dt ,

l’integrale diviene

1

a

Z

1

dt

t2 ± k 2

7

e ci siamo quindi ricondotti

Z

dt

=

2

t + k2

Z

dt

=

t2 − k 2

ad un integrale elementare. Infatti,

1

arctan(x/k) + C ;

k

1

−

log |(t + k)/(t − k)| + C .

2k

√

7. Per integrare funzioni del tipo [ ax2 + bx + c]−1 , cioè per calcolare

Z

1

√

dx ,

ax2 + bx + c

si procede come sopra, cioé innanzi tutto si scrive l’argomento della radice

in termini di somma o differenza di quadrati:

ax2 + bx + c = a[x2 + 2(b/2a)x + (c/a)] = a[(x + (b/2a))2 + ((c/a) − (b/2a)2 )]

= a[(x + (b/2a))2 ± k 2 ]

con il segno dettato dal segno di (c/a − b2 /4a2 ).

Con la sostituzione

b

= t;

2a

x +

dx = dt ,

l’integrale diviene

r

1

a

Z

√

t2

1

dt

± k2

e ci siamo quindi nuovamente ricondotti ad un integrale elementare. Infatti

(si vedano le tabelle degli integrali elementari),

Z

p

1

√

dt = log |t + t2 ± a2 | + C .

t2 ± a 2

8. Gli integrali del tipo

Z

αx + β

dx

ax2 + bx + c

o del tipo

Z

√

αx + β

dx

ax2 + bx + c

si trattano come quelli visti in precedenza, ricordando che

Z

Z

Z

αx + β

x

1

dx = α

dx + β

dx

ax2 + bx + c

ax2 + bx + c

ax2 + bx + c

8

(ed analogamente per il tipo con radice) e trasformando il termine del

denominatore. Inoltre, dopo la trasformazione si useranno le formule elementari

Z

t

1

dt =

log(t2 ± a2 ) ,

t2 ± a2

2

Z

1

t

dt = − log(a2 ∓ t2 ) ;

2

2

−t ± a

2

Z

p

t

√

dt =

t2 ± a2 ,

t2 ± a2

Z

p

t

√

dt = − ±a2 − t2 .

2

2

−t ± a

9. Per le funzioni razionali (quoziente di polinomi), cioè della forma1

f (x) =

Pn (x)

Qm (x)

con Pn un polinomio di grado n e Qm un polinomio di grado m, si procede

in modo diverso a seconda della relazione esistente tra m ed n.

Se m < n diciamo che si tratta di una frazione razionale regolare; se questo

non è il caso, possiamo sempre scrivere

Rs (x)

Pn (x)

= Mn−m (x) +

,

Qm (x)

Qm (x)

dove M è un polinomio di grado n − m e Rs un polinomio di grado s < m,

col che ci siamo ridotti a considerare una fazione razionale regolare.

10. Per integrare una frazione razionale regolare R(x)/Q(x), si decompone il

denominatore in elementi di primo o di secondo grado, cioè si scrive

Q(x) = Q(1) (x) Q(2) (x) ... Q(r) (t)

(alcuni di questi fattori potranno ripetersi) e si riscrive la frazione come

R(1)

R(r)

R(x)

=

+ ... +

Q(x)

Q(1) (x)

Q(r) (x)

dove R(k) è una costante se Q(k) è di grado uno, o un polinomio di grado

uno se Q(k) è di grado due. A questo punto ci si è riportati ad integrali

elementari.

1 Le

funzioni di questo tipo, e di quelli ai punti successivo, non sono state considerate a

lezione; vengono incluse solo per completezza, cosicché lo studente abbia un punto di riferimento se e quando le incontrerà in corsi successivi.

9

11. Per integrare delle funzioni razionali trigonometriche, cioè funzioni del tipo

R(sin(x), cos(x))

con R funzione razionale (polinomio o quoziente di polinomi) si procede

alla sostituzione

tan(x/2) = t ;

questa implica che

x = 2 arctan(t) ,

dx = 2

dt

.

1 + t2

Usando le formule trigonometriche si ottiene inoltre

sin(x) =

1 − t2

t

,

cos(x)

=

.

1 + t2

1 + t2

Quindi in questo modo la funzione razionale R(sin(x), cos(x)) si trasforma

in una nuova funzione razionale di t, e possiamo procedere come discusso

sopra.

4

Probabilità

4.1

Permutazioni e simili

1. Se abbiamo n oggetti, i modi in cui possono essere ordinati (detto anche

il numero delle loro permutazioni è n!.

2. Se abbiamo n oggetti e da questi dobbiamo sceglierne k il numero di modi

in cui possiamo effettuare questa scelta (se non teniamo conto dell’ordine

in cui sono stati scelti) è

n!

n

:=

.

k

k! (n − k)!

3. Se abbiamo n oggetti e da questi dobbiamo sceglierne k, il numero di modi

in cui possiamo effettuare questa scelta – tenendo conto dell’ordine in cui

sono stati scelti – è

n!

n

:=

.

k

(n − k)!

4. Per n grandi, il fattoriale n! può essere valutato tramite la formula di

Stirling

√

n! ' 2π n nn e−n .

10

4.2

Calcolo delle probabilità

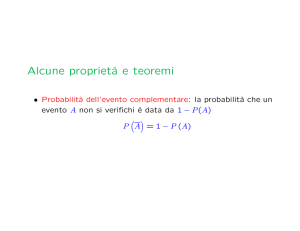

1. Un evento casuale deve appartenere ad una serie di possibilità (A1 , ..., An );

ad ognuno di questi eventi è associata una probabilità P (Ai ). Se A e B

sono eventi, lo sono anche A ∩ B e A ∪ B.

2. Si dice che (A1 , ..., An ) sono eventi elementari se sono mutualmente incompatibili e se la lista è esaustiva. Queste due condizioni significano,

rispettivamente,

P (Ai ∩ Aj ) = 0

(i 6= j) ;

n

X

P (Ai ) = 1 .

i=1

3. Per due eventi A e B si ha

P (A ∪ B) = P (A) + P (B) − P (A ∩ B) ;

per tre eventi (A, B, C) si ha

P (A ∪ B ∪ C)

=

[P (A) + P (B) + P (C)] +

− [P (A ∩ B) + P (A ∩ C) + P (B ∩ C)] +

+ P (A ∩ B ∩ C) ;

e cosı̀ via per quattro o più eventi.

4. Due eventi si dicono indipendenti se

P (A ∩ B) = P (A) · P (B) .

5. La probabilità condizionata P (A|B) è la probabilità dell’evento A se è noto

che l’evento B si verifica. Questa soddisfa

P (A|B) =

P (A ∩ B)

.

P (B)

Se sono note tutte le possibili condizioni Bk , allora

X

P (A) =

P (A|Bk ) · P (Bk ) .

k

6. Se A e B sono indipendenti, segue immediatamente dalle formule precedenti che

P (A|B) = P (A) .

7. La formula di Bayes permette di invertire le probabilità condizionate. Se

si conoscono le P (A|Bi ) rispetto a tutti le possibili condizioni Bi , e dunque

X

P (A) =

P (A|Bk ) · P (Bk ) ,

k

allora

P (Bi |A) =

P (A|Bi ) · P (Bi )

P (A|Bi ) · P (Bi )

= P

.

P (A)

k P (A|Bk ) · P (Bk )

11

4.3

Variabili casuali o variabili aleatorie

1. Se (Ai , ..., An ) sono degli eventi elementari, ognuno con la sua probabilità

P (Ai ) = pi , una variabile casuale è una funzione che associa ad ogni Ai

un valore numerico x(Ai ) = xi .

2. Il valore atteso, o media (matematica) della variabile casuale x viene indicato con uno dei seguenti simboli (tutti hanno lo stesso significato):

E(x) = hxi = x .

La media è definita come

E(x) =

X

p i xi .

i

3. Non bisogna confondere la media matematica (valore atteso) con la media

empirica quando si considera un certo numero N di eventi casuali (indipendenti ed identicamente distribuiti); per un grande numero N di prove, la

media empirica converge alla media matematica, ma le due hanno significato diverso. In particolare, la media matematica ha senso anche per un

solo evento.

4. Per la somma di variabili casuali vale

E(x + y) = E(x) + E(y) .

5. Siano x ed y variabili casuali, con x che ha valori xi in corrispondenza

degli eventi Ai ed y che ha valori yj in corrispondenza degli eventi Bj . Se

gli eventi Ai e gli eventi Bj sono indipendenti, le variabili casuali x ed y

si dicono indipendenti.

6. Per il prodotto di variabili casuali x, y come al punto precedente, vale

XX

E[x y] =

xi yj P (Ai |Bj ) P (Bj ) .

i

j

Se le variabili casuali x ed y sono indipendenti (e solo in questo caso), si

ha

XX

E[x y] =

xi yj P (Ai ) P (Bj ) = E(x) · E(y) .

i

j

7. La dispersione

σ 2 (x) ≥ 0

di una variabile casuale x è definita come lo scarto quadratico medio dalla

media, cioè

σ 2 (x) = E[(x − E(x))2 ] .

Questa può essere descritta anche come

σ 2 (x) = E[x2 ] − (E[x])2 = hx2 i − hxi2 .

12

8. La radice quadrata σ(x) della dispersione σ 2 (x) è detta deviazione standard per la variabile casuale x.

9. La dispersione di una somma di variabili casuali soddisfa

σ 2 (x + y) = σ 2 (x) + σ 2 (y) + 2 [hx · yi − hxi · hyi] .

Se x ed y sono variabili indipendenti (e solo in questo caso) si ha

σ 2 (x + y) = σ 2 (x) + σ 2 (y) .

10. Per la somma di N variabili casuali x(1) , ..., x(N ) indipendenti ed identicamente distribuite, indicando con X = x(1) + ... + x(N ) la loro somma si

ha

σ 2 (X) = N σ 2 (x) ,

e quindi

√

σ(X) =

N σ(x) .

11. Se consideriamo la media delle N variabili (x(1) , ..., x(N ) ), cioè

ξ =

1 (1)

X

,

x + ... + x(N ) =

N

N

questa ha dispersione

σ 2 (ξ) = σ 2 (X/N ) = (1/N ) σ 2 (X) = σ 2 (x)

e deviazione standard

4.4

1

σ(ξ) = √ σ(x) .

N

Distribuzioni di probabilità rilevanti

Alcune proprietà, enunciate ma non dimostrate a lezione, sono dimostrate in un

dispensa separata, che non viene richiesta per l’esame.

1. Consideriamo n variabili casuali indipendenti ed identicamente distribuiti,

in cui la probabilità che ogni variabile assuma un certo valore di interesse

(”successo”) sia p (indichiamo con q = 1−p la probabilità complementare).

Allora la probabilità di avere k successi in n prove è data dalla distribuzione

binomiale

n!

n

pk (1 − p)n−k .

P(k; n) =

pk q n−k =

k

k! (n − k)!

2. Per la distribuzione binomiale, il valore atteso di k in n prove è semplicemente

E(k; n) = n p := A .

13

3. Per la distribuzione binomiale, la dispersione del valore atteso di k 2 in n

prove risulta essere

E(k 2 ; n) = A2 + A (1 − p) .

4. Ne segue che la dispersione di k in n prove è

σ 2 (k; n) = hk 2 i − (hki)2 = n p (1 − p) = n p q := A (1 − p) ,

e la deviazione standard

σ =

√

npq =

p

Aq .

5. Se abbiamo un A assegnato (e quindi p = A/n) e consideriamo il limite

per n grande (e quindi p piccolo), allora la distribuzione binomiale è ben

descritta dalla distribuzione di Poisson

P (k) =

Ak −A

e

.

k!

6. Nella distribuzione di Poisson, il valore atteso di k è dato da

E(k) = hki = A .

7. Nella distribuzione di Poisson, il valore atteso di k 2 è dato da

E(k 2 ) = hk 2 i = A2 + A .

8. Quindi, nella distribuzione di Poisson si ha dispersione

σ 2 (k) = hk 2 i − (hki)2 = (A2 + A) − (A)2 = A ;

e deviazione standard

√

σ =

σ2 =

√

A.

9. Se nella distribuzione binomiale

n

P(k; n) =

pk (1 − p)n−k

k

consideriamo p = 1/2, e quindi q = 1 − p = p, abbiamo

1

n!

1

n

P(k; n) =

=

.

n

k

2

k!(n − k)! 2n

10. Nel limite di n grande, la distribuzione binomiale con p = 1/2 è ben

descritta dalla distribuzione normale; scrivendo k = (n/2)(1 + x) e considerando il limite per n → ∞ e x → 0 con nx = z costante, abbiamo

2

1

e−x /2 .

P0 (x) = √

2π

Questa può anche essere considerata come una distribuzione di probabilità

per una variabile casuale continua x.

14

11. Più in generale si ha una distribuzione gaussiana con parametri µ, σ se

P (x) = √

1

2σ 2 π

exp[−(x − µ)2 /(2σ 2 )] .

Qui µ rappresenta la media di x e σ 2 la sua dispersione. La distribuzione

normale corrisponde a µ = 0, σ = 1.

12. In generale, data una qualsiasi somma di N variabili casuali indipendenti

xi , anche con distribuzioni diverse tra loro (media mi , varianza s2i ), purché

tutte con varianza finita, per N grande la distribuzione di X = x1 +...+xN

converge ad una distribuzione gaussiana con media e varianza

N

X

µ(X) =

2

mi , σ (X) =

i=1

N

X

s2i .

i=1

13. Se consideriamo la media X di N variabili xi indipendenti ed identicamente distribuite, cioè

N

1 X

xi ,

X =

N i=1

allora le formule precedenti forniscono

σ 2 (x)

,

N

hXi = hxi , σ 2 (X) =

e quindi anche

σ(x)

σ(X) = √ .

N

14. La distribuzione normale viene descritta dalle tavole statistiche; in particolare viene di solito fornita la funzione

Z x

Φ(x) =

P0 (x) dx .

0

Per usare le tavole è bene ricordare che

Z 0

Z

P0 (x) dx =

−x

e che

x

P0 (x) dx ,

0

Z

∞

P0 (x) dx =

0

15

1

.

2

5

Statistica

5.1

Misure semplici

1. Se abbiamo diverse misure di una grandezza x,

la valutazione migliore che possiamo fornire per

misure,

1

M (x) =

(x1 + ... + xn ) =

n

siano queste (x1 , ..., xn ),

x è la media M (x) delle

n

1 X

xk .

n

k=1

La dispersione delle misure intorno ad un valore x è misurata dallo scarto

quadratico medio,

n

1 X

[x − x]2 ;

n

k=1

questo è minimo se scegliamo x = M (x), la media di x. In questo caso,

D(x) =

n

1 X

[x − M (x)]2 = M (x2 ) − [M (x)]2 .

n

k=1

2. Se le x sono un campione estratto da una distribuzione di probabilità,

dobbiamo avere

lim M (x) = hxi = E(x) ;

n→∞

lim D(x) = σ 2 (x) .

n→∞

3. Questo non basta ad assicurare che il campione sia in effetti estratto dalla

distribuzione di probabilità considerata, ad esempio una distribuzione

gaussiana con media e dispersione corrispondenti alla media e dispersione

empirica; per controllare questa ipotesi sono necessari altri test statistici,

tra cui il più diffuso è quello cosiddetto del χ2 (“chi quadro”).

4. Per calcolare il χ2 , si divide l’intervallo in cui i dati possono cadere in n

sottointervalli Ik (non sovrapponentesi e che coprano tutto l’intervallo),

e si considerano il numero empirico di misure nk nell’intervallo Ik , ed

il numero “teorico” (cioé corrispondente alla distribuzione di probabilità

ipotizzata, ad esempio una gaussiana) tk . Allora

χ2 =

n

X

(tk − nk )2

k=1

tk

.

Si tratta di una misura dello scarto quadratico pesata con la rilevanza

statistica dei dati in ogni intervallo.

5. Una volta effettuato questo calcolo, delle apposite tabelle dicono qual è la

probabilità di ottenere, a seguito di fluttuazioni statistiche, un χ2 pari o

superiore a quello ottenuto; questo numero viene anche indicato come la

“significanza statistica” dell’ipotesi sulla distribuzione.

16

5.2

Fit lineare

1. In molti casi sappiamo a priori che certi fenomeni sono descritti da una

relazione lineare, del tipo y = kx o y = a + kx, ma non conosciamo i

parametri a e k, che devono essere misurati sperimentalmente; dato che

ogni misura è soggetta ad errori, si tratta di una determinazione statistica.

Assumendo che i valori xi siano noti, e che i corrispondenti valori yi siano

stati misurati con precisione equivalente per i diversi valori di xi , si usa

abitualmente il criterio di minimizzare la somma (o la media) degli scarti

quadratici, cioé la funzione

F =

n

1 X

[y(xi ) − yi ]2 ,

n i=1

dove y(x) è la legge (lineare) ipotizzata.

2. Nel caso di una legge lineare omogenea, cioé

y(x) = k x ,

il miglior fit corrisponde alla scelta

k =

hx yi

.

hx2 i

3. Nel caso di una legge lineare non omogenea,

y(x) = a + k x

il miglior fit corrisponde alla scelta

k =

hxi hxyi − hx2 i hyi

hxyi − hxihyi

, a =

.

2

σ (x)

σ 2 (x)

17