TEORIA DELLA

PROBABILITÁ E

DELL’INFERENZA

STATISTICA

CALCOLO DELLE PROBABILITA’

Esperimento casuale: una generica operazione la cui

esecuzione, detta prova, è suscettibile di fornire un risultato –

compreso in un insieme di risultati necessari ed

incompatibili – che non può essere previsto con certezza.

Esempio: Lancio di un dado (prova)

• necessarietà:

possibili risultati

• incompatibilità:

possibili risultati.

si

presenterà

si

presenterà

almeno

uno

dei

solo

uno

dei

Gli esperimenti casuali riguardano quindi tutti i casi in cui

bisogna effettuare una previsione in condizioni di

incertezza.

Nel formulare tali previsioni, si esprime il “grado di incertezza”

relativo al presentarsi di un certo risultato con una valutazione

numerica che prende il nome di PROBABILITA’.

CONCEZIONI ALTERNATIVE DELLA PROBABILITA’

1. Impostazione classica: la probabilità del verificarsi di un

certo risultato è data dal rapporto tra numero di casi

favorevoli al verificarsi di quel risultato ed il numero totale

di casi possibili, ammesso che questi possano essere

considerati tutti ugualmente possibili.

Critica: Non applicabile agli esperimenti i cui risultati non

possono ritenersi tutti ugualmente possibili

2. Impostazione frequentista: all’aumentare del numero

delle prove (per n) la probabilità del verificarsi di un certo

risultato coincide con la frequenza relativa di tale risultato.

Pr lim

n

ni

n

a condizione che le prove si svolgano tutte nelle medesime

condizioni.

Critica: Non sempre tutte le prove si svolgono nelle stesse

condizioni.

3. Impostazione soggettiva: la probabilità è l’espressione del

grado di fiducia che un individuo ripone nel verificarsi di un

certo evento.

Critica: Le valutazioni della probabilità possono variare da

individuo ad individuo

4.

Impostazione assiomatica

a) Concetti primitivi

“La prova genera l’evento con una certa probabilità”

i.

Prova: esperimento il cui risultato non è prevedibile

con certezza

ii.

Evento: possibile risultato di una prova

iii. Probabilita: numero associato al presentarsi di un

evento

b) Assiomi: regole formali a cui deve sottostare una

valutazione di probabilità.

A partire dagli assiomi è possibile costruire tutta la teoria

della probabilità.

SPAZIO CAMPIONARIO

s

Insieme dei possibili risultati ottenibili da una prova.

Esempi:

S

1. Lancio di una moneta:

2. Lancio di un dado:

S

T , C

1, 2, 3, 4,5, 6

3. Numero di minuti in cui una lampadina resta accesa prima

di bruciarsi:

S x : x 0

N.B. Nei primi due esempi S ha cardinalità finita, nel terzo esempio

S ha cardinalità nel continuo.

EVENTO

Un qualunque sottoinsieme dello spazio campionario S.

AS

Si realizza il risultato della prova

appartenente ad A.

Tipi di Eventi (es: lancio di un dado):

1 , 2 , 3 , 4 , 5 , 6

Eventi Elementari

Eventi

Composti

1, 3 , 1, 2, 6 ,

, 1, 2, 3, 4,5, 6

S

Evento Certo

Evento Impossibile

Esempio: sottoinsiemi dell’evento “durata di una lampadina”

S

x : x

500 ;

x

x : 600

: x 0

x 700 ; .........

OPERAZIONI SUGLI EVENTI

a) Unione o Somma Logica fra due eventi A e B è quell'evento C

che si verifica quando si verifica A oppure B oppure A e B

contemporaneamente:

C AB

A

B

S

b) Intersezione o Prodotto Logico fra due eventi A e B è

quell'evento D che si verifica quando si verificano sia A che B

contemporaneamente:

D A B

A

B

S

c) Complementazione o Negazione di un evento A è quell'evento

E che si verifica allorquando A non si verifica:

A

A

S

Esempio: lancio di un dado

A

1, 2, 4 ;

B= 1, 2, 6 ;

1, 2, 4, 6

1, 2

A B A B

A B A B

A

3, 5, 6

B

3, 4, 5

Eventi Incompatibili: non contengono elementi comuni e quindi la

loro intersezione da luogo all’evento impossibile.

In pratica, il verificarsi dell’uno implica il non verificarsi dell’altro in una

prova.

A B

A

3, 5 ;

B= 1, 2, 4 ;

incompatibili

B= 1, 3, 6 ;

compatibili

A B

A

3, 5 ;

Rappresentazioni Grafiche

Eventi Compatibili

S

S

B

A

Unione

A

Intersezione

B

Eventi Incompatibili

S

S

A

Unione

B

A

Intersezione

B

SPAZIO DEGLI EVENTI (Z)

Una classe di eventi ai quali si vuole assegnare una probabilità.

Questa classe deve essere un'algebra, ovvero deve contenere lo

spazio campionario S e come elementi

Quando S è costituito da un numero finito k di elementi, lo

spazio degli eventi può essere rappresentato dall'insieme di tutti i

possibili sottoinsiemi di S ed ha cardinalità 2k.

Esempio: lancio di un dado

S

1, 2, 3, 4,5, 6 ,

k=6

Sottoinsiemi di S (e di Z)

numero di eventi

1

1 , 2 , 3 ......

1, 2 , 1, 3 , 1, 4 ......

1, 2, 3 , 1, 2, 4 , 1, 2, 5 ......

1, 2, 3, 4 , 1, 3, 4, 5 , 1, 4, 5, 6 ......

1, 2, 3, 4, 5 , 1, 3, 4, 5, 6 , 2, 3, 4, 5, 6 ......

S 1, 2, 3, 4, 5, 6

totale

6

15

20

15

6

1

64 ( 26 )

In alcuni casi interessano solo alcuni eventi di un

esperimento.

Esempio: Costruire lo spazio degli eventi relativo all’alternativa tra

punteggio pari e punteggio dispari nel lancio di un dado.

Z

, 1, 3, 5 , 2, 4, 6 , S

1, 2, 3, 4, 5, 6

ASSIOMI

A Z

i)

P

:

0 P ( A) 1

ii )

P(·): funzione di

probabilità

P(S)=1

iii) P(A+B)=P(A)+P(B)

se

A B=

Le impostazioni classica e frequentista soddisfano gli assiomi.

Solitamente, nel misurare la probabilità si fa sempre riferimento

alla definizione classica.

L’assioma iii) permette di definire una misura della probabilità per

tutti gli eventi (elementari e composti) inclusi nello spazio degli

eventi Z.

TEOREMI

) 0

1) P(O

P(A) 1 - P(A)

2)

P(A B) P(A) P(B) - P(A B)

3)

Teorema delle Probabilità Totali

A

B

AB

S

Generalizzazione al caso di 3

eventi

P(A B C)

P(A) P(B) P(C) - P(A B) P(A C) P(B C) P(A B C)

A

B

C

S

A BC

BC

PROBABILITA’ DI EVENTI SUBORDINATI.

INDIPENDENZA STOCASTICA

Tra 2 eventi A e B può sussistere una relazione per la quale, sapendo

che una prova ha generato un risultato che appartiene a B, si è

indotti a modificare la valutazione del verificarsi di A.

Esempio: probabilità che una certa squadra vince una partita dopo

che alla fine del primo tempo è in svantaggio di 3 reti a zero.

PROBABILITA’ SUBORDINATA

La probabilità dell'evento B, dato che si è verificato l'evento A, è il

rapporto fra la probabilità del contemporaneo verificarsi di A e

B e la probabilità di A, se questa è diversa da zero:

P

P

A | B

B |

A

P

P

A B ;

P B

B A ;

P A

P

B

0

P

A

0

Teorema delle Probabilità Composte

Dati 2 eventi A e B per i quali P(A)>0 e P(B)>0,

se i due eventi sono stocasticamente dipendenti risulta:

P(A B) P(A|B) P(B) P(A) P(B|A)

• si verifica B

• B nuovo S

B

A

S

• la probabilità subordinata è data

dall’area dell’intersezione rispetto

all’area di B

Se risulta:

P

P

A | B

B | A

P

P

A ;

B.

allora A e B sono stocasticamente indipendenti.

In questo caso:

P

A B

P

A P B

Problema

La produzione di pneumatici in una fabbrica avviene in tre turni: il

50% di giorno – il 30% di sera – il 20% di notte. Il controllo della

conformità dei pneumatici prodotti si basa su un campione di 200

pezzi, ripartiti secondo le proporzioni dei 3 turni di produzione, che ha

rivelato ciò che segue:

TURNO DI PRODUZIONE

Giorno

ESITO

Conformità

Non conformità

totale

Sera

Notte

totale

97

54

33

184

3

6

7

16

100

60

40

200

1) Calcolare la probabilità che un pneumatico scelto a caso:

a) sia difettoso;

b) sia difettoso e prodotto in ciascuno dei 3 turni;

c) sia difettoso essendo stato prodotto in ciascuno dei 3 turni;

d) essendo difettoso sia stato prodotto in ciascuno dei 3 turni.

2) È lecito sostenere che la qualità del prodotto è influenzata dal

turno di produzione?

Le probabilità cercate possono essere ottenute dalla tabella delle

frequenze relative:

TURNO DI PRODUZIONE

ESITO

Giorno (G)

Sera (S)

Notte (N)

totale

Conformità (C)

0,485

0,27

0,165

0,92

Non conformità (D)

0,015

0,03

0,035

0,08

0,5

0,3

0,2

1

totale

a)

b)

c)

P(D) = 0,08

b.1 P(D G) = 0,015

b.2 P(D S) = 0,03

b.3 P(D N) = 0,035

c.1

P(D|G) =

c.2

c.3

P(D G)

0, 015

0, 03

P(G)

0,5

P(D|S) =

P(D S)

0, 03

0,1

P(S)

0,3

P(D|N) =

P(D N)

0, 035

0,175

P(N)

0,2

d)

d.1

P(G|D) =

d.2

P(S|D) =

d.3

P(N|D) =

P(D G)

0, 015

0,1875

P(D)

0, 08

P(D S)

0, 03

0,375

P(D)

0, 08

P(D N)

0, 035

0, 4375

P(D)

0, 08

2)

Se la qualità del prodotto non fosse influenzata dal turno di

produzione, si dovrebbe avere:

P(D|G) = P(D|S) = P(D|N) = P(D)

ma evidentemente così non è.

INTRODUZIONE ALL’INFERENZA STATISTICA

1) PRINCIPALI DISTRIBUZIONI DI PROBABILITA’

Binomiale, Poisson

Normale o Gaussiana

Chi – quadrato

t di Student

F di Fisher-Snedecor

2) UNIVERSO E CAMPIONE

Campionamento non probabilistico

Campionamento probabilistico

3) DISTRIBUZIONI CAMPIONARIE E PROPRIETA’

DEGLI STIMATORI

4) METODI DI STIMA PUNTUALE ED INTERVALLARE

5) TEST PER LA VERIFICA DI IPOTESI

VARIABILE CASUALE

Una Variabile Casuale X è una regola (funzione reale) che

associa ad E (evento elementare di S) uno ed un solo numero

reale.

Notazione:

X: variabile casuale

x: realizzazione di una variabile casuale

E1

E6

E2

E3

E5

R

E4

x1

S

x2

x3

N.B.: la precedente corrispondenza è UNIVOCA.

E’ possibile associare una misura di probabilità allo spazio numerico della

v.c. utilizzando la misura di probabilità definita sui sottoinsiemi dello

spazio campionario S.

"Si verifica l'evento E con probabilità P(E)“

"La v.c. X assume il valore x con probabilità P(x)"

Una v.c. X è una variabile che assume valori nello spazio

dei numeri reali secondo una funzione di probabilità P(X).

P[X(E)]

S

E

1

X(E)

0

Rappresentazione grafica dello schema

di costruzione di una v.c. discreta

E1

E6

E2

E5

1

p3

E3

E4

S

x1

x2

R

x3

Una Variabile Casuale è nota se è nota la sua distribuzione

di probabilità

p2

p1

0

ESEMPI

1. Consideriamo una famiglia con 3 figli

E1

E2

E3

E4

E 5 E6

E7

E8

S={MMM, MMF, MFM, FMM, MFF, FMF, FFM, FFF}

P=

1/8

1/8

1/8

1/8

1/8

1/8

1/8

1/8

Variabile casuale X=“numero dei figli maschi”

E5

E2

X

0

1

2

3

E8

E6 E7

E3 E 4

E1

X

0

1

2

3

Px

0.125

0.375

0.375

0.125

1

pi

1/8

3/8

3/8

1/8

VARIABILI CASUALI DISCRETE

Assumono valori discreti (solitamente sono ottenute come risultato di

un conteggio).

Per ogni realizzazione xi risulta:

pi 0

i 1,

pi

1

pi = p(xi) = probabilità che

X assuma il valore xi

pi

x1

E X

,k

x2

x3

xipi

Var X

xi

2

pi

xi

Esempio: si lanciano simultaneamente 2 monete.

Eventi elementari di S:

E1=TT

E2=TC

E3=CT

E4=CC

Variabile casuale “X=numero di croci”

Ei

xi

pi

TT

0

1/4

TC

1

1/4

CT

1

1/4

CC

2

1/4

Ad ogni xi associamo una probabilità pari alla somma delle probabilità

degli eventi corrispondenti.

xi

pi

0

1/4

1

2/4

2

1/4

Le xi sono le realizzazione della v.c., mentre le pi identificano la

distribuzione di probabilità della v.c. in questione

VARIABILI CASUALI CONTINUE

Ammettono infiniti valori, quindi non è possibile attribuire le singole

probabilità ad ogni realizzazione xi.

Si associa ad ogni intervallo una funzione f(x) detta funzione di

densità di probabilità.

N.B.:

f(x) NON è la probabilità che

X assuma il valore x!

f(x)

x

f(x) è la probabilità che X sia compresa in un intervallo

infinitesimale intorno dx ad x .

f

x

p x dx X x dx

La funzione di densità f(x) è nulla per quei valori compresi in

intervalli esterni al campo di definizione

Condizione necessaria affinché una funzione di densità f(x)

individui una v.c. X continua è :

f x 0

f x dx 1

x : X

N.B.:

E X

P X x0

x0

x0

xf

x dx

Var X 2 E x

2

f

x dx

0

FUNZIONE DI RIPARTIZIONE

Ordinando le realizzazioni della v.c.:

xi x0

F x0 P X x0

pi

v.c. discrete

x0

x ,

f

x dx

v.c. continue

Proprietà:

1) è non decrescente

xi x j F xi F x j

2)

0 F(x) 1

3)

x

lim F x 0

lim F x 1

x

v.c. discrete

X: “Punteggio ottenuto nel lancio di un dado”

X

1

2

3

4

5

6

F(x)

1

5/6

4/6

3/6

2/6

1/6

0

P(x)

1/6

1/6

1/6

1/6

1/6

1/6

1

2

3

pi

1

1/6

1

4

5

6

2

3

x

4

5

6

xi

v.c. continue

F x1

x1

f(x)

f(x)dx

x

x 0 x1

P(x0 X x1 ) P(X x1 ) P(X x0 )

x1

F(x1 ) F(x0 )

f(x)dx

x0

F ( x)

F ( x1 )

F ( x0 )

x 0 x1

Relazione importante:

F(x0 )

x0

f

x dx

d

dx

x

F(x) f(x)

MODELLI PER VARIABILI CASUALI DISCRETE

Variabile Casuale di Bernoulli

X ~ Ber p

Regola i casi riconducibili ad una prova che si può concludere con

2 possibili risultati:

E

SUCCESSO

E

INSUCCESSO

p = probabilità di successo

Esempi: lancio di una moneta, Espressione di un voto referendario,

Lancio di un dado (pari-dispari)

0 insuccesso E

X:

1 successo E

P X 1 p

P X 0 1 p q

Distribuzione di probabilità

P X x px

1

px

p0

1

x 0,1

1

p

1 x

p

1 0

p

1 x

p1

1

p

11

1 p p 1

Media e varianza

E X

Var

0

X

xipi

p

2

xi

1

0(1 p) 1(p) p

2 pi

p

1

p

2

p

p 1 p p 1 p p(1 p)

N.B.: la varianza è massima se p = 0,5

Problema

Una macchina di precisione produce pezzi di ricambio per

macchine agricole con una percentuale pari al 10% di pezzi

difettosi. Su una produzione oraria di 5 pezzi, si richiede:

a) qual e’ la probabilità di avere meno di 3 pezzi difettosi?

b) qual e’ la probabilità di avere tra 2 e 4 pezzi difettosi?

c) qual e’ la probabilità di avere al più 2 pezzi difettosi?

d) qual e’ la probabilità di avere almeno 4 pezzi difettosi?

disegnare la funzione di probabilità e di ripartizione della v.c. che

descrive i risultati dell’esperimento

calcolare la media e la varianza della distribuzione.

Variabile Casuale Binomiale

X ~ Bin n,p

Regola la probabilità in tutti i casi riconducibili ad una

estrazione con reimmissione

di n palline da un’urna.

p(x) = probabilità di x successi in n prove

In ognuna delle n prove p è la probabilità di successo ed è costante.

p(0) = p(X = 0) =

Probabilità che in n prove non si verifichi

alcun successo

p(1) = p(X = 1) =

Probabilità che in n prove si verifichi 1

successo

p(n) = p(X = n) =

Probabilità che in n prove si verifichino n

successi

n = numero di prove

Quindi:

x = numero di successi in n prove

n – x = numero di insuccessi in n prove

La funzione di probabilità deve tener conto di tutte le possibili

sequenze di successi ed insuccessi (principio della probabilità

totale per eventi incompatibili).

n

2

Numero di possibili sequenze di successi ed insuccessi

(corrispondente al numero di elementi dello spazio degli

eventi)

Quanti sono i modi di combinarsi di una

specifica sequenza?

n

n!

x ! n x !

x

n elementi presi x ad x

Qual è la probabilità di

ognuna delle

sequenze?

n

x

px

1 p

n x

La funzione di probabilità della v.c. binomiale è quindi:

n x

P X x

p

x

1 p

n x

Media

E X E X1 X2 X3 ... Xn

E X1 E X2

... E Xn

p p .. p np

Varianza

VAR

X

VAR

X1

X2 X3 ... Xn

p 1 p p 1 p ... p 1 p

np 1 p npq

La variabile casuale “numero di pezzi difettosi (successo) su 5 pezzi prodotti

(prove)” segue la distribuzione Binomiale, con parametri

n = 5 e p = 0,1 (10%)

quindi:

= np = 5 0,1 = 0,5

2 = np(1-p) = 5 0,1 0,9 = 0,45

Le probabilità elementari possono essere determinate per mezzo della

funzione:

0 x 5

n x

n x

n!

px

p

1

p

con

n

x

x

x! n x !

5!

5 0

5

p0

0 ,10 0 ,95 1 1 0 ,59049 0 ,59049

0

p 1 p

0! 5!

5!

5 1

4

p1

0 ,11 0 ,9 4 5 0 ,1 0 ,6561 0 ,32805

1

p 1 p

1! 4!

5!

5 2

3

p2

0 ,12 0 ,93 10 0 ,01 0 ,729 0 ,0729

2

p 1 p

2! 3!

5!

5 3

2

p3

0 ,13 0 ,92 10 0 ,001 0 ,81 0 ,0081

3

p 1 p

3! 2!

5!

5 4

1

p4

0 ,14 0 ,91 5 0 ,0001 0 ,9 0 ,00045

4

p 1 p

4! 1!

5!

5 5

0

p5

0 ,15 0 ,9 0 1 0 ,00001 1 0 ,00001

5

p 1 p

5! 0!

Dati n = 5 e p = 0,1, la v.c. X = “numero di pezzi difettosi su 5 prodotti”

è definita come segue:

x

f(x)

F(x)

0

0,59049

0,59049

1

0,32805

0,91854

2

0,07290

0,99144

3

0,00810

0,99954

4

0,00045

0,99999

5

0,00001

1

Totale

1

a)

P(X < 3) = P(0) + P(1) + P(2) =

= 0,59049 + 0,32805 + 0,0729 = 0,99144

b)

P(2 X 4) = P(2) + P(3) + P(4) =

= 0,0729 + 0,0081 + 0,00045 = 0,08145

c)

P(X 2) = P(0) + P(1) + P(2) =

= 0,59049 + 0,32805 + 0,0729 = 0,99144

d)

P(X 4) = P(4) + P(5) =

= 0,00045 + 0,00001 = 0,00046

Variabile Casuale di Poisson

LA VC NORMALE O GAUSSIANA

Una vc si dice normale o gaussiana (da Gauss che la propose come

modello descrittivo degli errori di misura) se la sua fd è la

1 x

seguente:

1

2

2

f X N x ; , 2

2

e

dove x e x2 rispettivamente rappresentano il valor medio e la

varianza di X;

X

è una vc continua; (base dei logaritmi neperiani) sono note costanti

matematiche.

3,1415

ed

e 2,7183

La sua rappresentazione grafica è la seguente:

0,5

0,4

0,3

0,2

0,1

0

-4

-3

-2

-1

0

1

2

3

4

ed ovviamente la probabilità dell’evento certo sarà data da

pX

b

f x dx

1

a

Oltre ai due valori caratteristici appena esaminati se ne

possono definire altri; tra essi una certa importanza ha la

media quadratica:

E X

x

b

2

a

2

f x dx

È facile dimostrare che:

VX EX 2 EX

2

Per la dimostrazione basta svolgere il quadrato dell’altra

formulazione di VX , semplificare ed ottenere la seconda

formulazione che è di maggiore praticità a fini computazionali.

Lo studio analitico della funzione evidenzia:

1) la curva è simmetrica rispetto all’ordinata del punto di massimo;

2) quest’ultimo si trova in corrispondenza del valore x ; segue

che la mediana (MED , valore che divide una distribuzione di

frequenze in due parti esattamente uguali) e la moda (MOD , valore

cui corrisponde il massimo valore di una distribuzione di frequenze)

coincidono, nella normale, con la media aritmetica;

3) la curva è definita tra meno infinito e più infinito;

4) La curva presenta due punti di flesso (cambiamento di

concavità) in corrispondenza con i valori x

L’assetto grafico della curva è determinato dai parametri

µ

e

σ , il primo determina il posizionamento della

curva sull’asse delle ascisse; per questo µ si definisce

come un parametro di posizione.

Il secondo, essendo una misura di variabilità con

riferimento alla media, mostra quanto siano più o meno

dispersi i valori della distribuzione intorno al valore medio.

Allora, bassi valori di σ indicano valori della distribuzione

(probabilità) poco dispersi o anche, come si dice, molto

concentrati, intorno a µ , al contrario alti valori di σ

indicano valori della distribuzione molto dispersi rispetto

alla media. Pertanto il parametro σ è detto parametro di

forma della distribuzione.

Se una vc ha una distribuzione normale la probabilità che x

assuma un certo valore in un certo intervallo, poniamo a-b, si

ottiene da:

b

p( a X b )

b

f x dx

a

a

1

e

2

1 x

2

2

dx

che in termini grafici altro non è se non la superficie delimitata a

sinistra dall’ordinata nel punto a, a destra dall’ordinata del punto

b, inferiormente dall’asse delle ascisse e superiormente dalla curva

normale tra a e b. Ovviamente, la probabilità dell’evento certo,

cioè

p( X ) f x dx

1

2 e

1 x

2

2

dx 1

da cui si ha anche che:

p( X )

f x dx

1

e

2

1 x

2

2

dx

1

2

Esempio, se una vc normale ha media pari a 3,6 e varianza pari a

81, la probabilità che x sia compreso tra -4,2 e 7,5 si ha

risolvendo l’integrale

p( 4.2 X 7.5)

7.5

f x dx

4.2

7.5

4.2

1

e

9 2

x 3.6 2

4 ( 81)

dx

Per fortuna esiste la possibilità di operare in modo estremamente

più semplice, ma a tale fine occorre definire una particolare vc

normale, detta vc normale standardizzata, la cui caratteristica è

quella di avere media pari a zero e varianza unitaria, cioè:

f Z

1

z2

1

e 2

N Z ; 0 ,1

2

Si può dimostrare che data una normale N X ; , 2

si può sempre passare ad una NZ ; 0 ,1

semplicemente trasformando le x in z con la relazione

Z

x

Siccome per la normale standardizzata esistono tavole che

contengono la determinazione degli integrali coinvolti con il calcolo

di

p( z1 Z z 2 )

z2

f Zdz

z1

allora basta passare da X a Z, risolvere il nostro problema su Z ed

averlo risolto per X senza dover calcolare alcun integrale.

Tutto questo sarà molto più chiaro con alcuni esempi numerici;

prima vediamo più da vicino come sono costruite le tavole per la

normale standardizzata.

In primo luogo: la tabulazione avviene solo per la parte positiva

della distribuzione, dal momento che essendo la media della

standardizzata uguale a zero basta avere

prob0 Z a

per avere

prob a Z 0

Poi, le tavole forniscono l’area sotto la normale standardizzata

secondo il seguente schema:

L’immissione rappresenta l’area sottostante la distribuzione standardizzata dalla media aritmetica a Z

Z

0.0

0.1

0.2

0.3

0.4

0.5

0.6

0.7

0.8

0.9

1.0

1.1

1.2

1.3

1.4

1.5

1.6

1.7

1.8

1.9

2.0

2.1

2.2

2.3

2.4

2.5

2.6

2.7

2.8

2.9

3.0

3.1

3.2

3.3

3.4

3.5

3.6

3.7

3.8

3.9

.00

.01

.02

.0000 .0040 .0080

.0398 .0438 .0478

.0793 .0832 .0871

.1179 .1217 .1255

.1554 .1591 .1628

.1915 .1950 .1985

.2257 .2291 .2324

.2580 .2612 .2642

.2881 .2910 .2939

.3159 .3186 .3212

.3413 .3438 .3461

.3643 .3665 .3686

.3849 .3869 .3888

.4032 .4049 .4066

.4192 .4207 .4222

.4332 .4345 .4357

.4452 .4463 .4474

.4554 .4564 .4573

.4641 .4649 .4656

.4713 .4719 .4726

.4772 .4778 .4783

.4821 .4826 .4830

.4861 .4864 .4868

.4893 .4896 .4898

.4918 .4920 .4922

.4938 .4940 .4941

.4953 .4955 .4956

.4965 .4966 .4967

.4974 .4975 .4976

.4981 .4982 .4982

.49865 .49869 .49874

.49903 .49906 .49910

.49931 .49934 .49936

.49952 .49953 .49955

.49966 .49968 .49969

.49977 .49978 .49978

.49984 .49985 .49985

.49989 .49990 .49990

.49993 .49993 .49993

.49995 .49995 .49996

.03

.0120

.0517

.0910

.1293

.1664

.2019

.2357

.2673

.2967

.3238

.3485

.3708

.3907

.4082

.4236

.4370

.4484

.4582

.4664

.4732

.4788

.4834

.4871

.4901

.4925

.4943

.4957

.4968

.4977

.4983

.49878

.49913

.49938

.49957

.49970

.49979

.49986

.49990

.49994

.49996

.04

.0160

.0557

.0948

.1331

.1700

.2054

.2389

.2704

.2995

.3264

.3508

.3729

.3925

.4099

.4251

.4382

.4495

.4591

.4671

.4738

.4793

.4838

.4875

.4904

.4927

.4945

.4959

.4969

.4977

.4984

.49882

.49916

.49940

.49958

.49971

.49980

.49986

.49991

.49994

.49996

.05

.0199

.0596

.0987

.1368

.1736

.2088

.2422

.2734

.3023

.3289

.3531

.3749

.3944

.4115

.4265

.4394

.4505

.4599

.4678

.4744

.4798

.4842

.4878

.4906

.4929

.4946

.4960

.4970

.4978

.4984

.49886

.49918

.49942

.49960

.49972

.49981

.49987

.49991

.49994

.49996

.06

.0239

.0636

.1026

.1406

.1772

.2123

.2454

.2764

.3051

.3315

.3554

.3770

.3962

.4131

.4279

.4406

.4515

.4608

.4686

.4750

.4803

.4846

.4881

.4909

.4931

.4948

.4961

.4971

.4979

.4985

.49889

.49921

.49944

.49961

.49973

.49981

.49987

.49992

.49994

.49996

.07

.0279

.0675

.1064

.1443

.1808

.2157

.2486

.2794

.3078

.3340

.3577

.3790

.3980

.4147

.4292

.4418

.4525

.4616

.4693

.4756

.4808

.4850

.4884

.4911

.4932

.4949

.4962

.4972

.4979

.4985

.49893

.49924

.49946

.49962

.49974

.49982

.49988

.49992

.49995

.49997

.08

.0319

.0714

.1103

.1480

.1844

.2190

.2518

.2823

.3106

.3365

.3599

.3810

.3997

.4162

.4306

.4429

.4535

.4625

.4699

.4761

.4812

.4854

.4887

.4913

.4934

.4951

.4963

.4973

.4980

.4986

.49897

.49926

.49948

.49964

.49975

.49983

.49988

.49992

.49995

.49997

.09

.0359

.0753

.1141

.1517

.1879

.2224

.2549

.2852

.3133

.3389

.3621

.3830

.4015

.4177

.4319

.4441

.4545

.4633

.4706

.4767

.4817

.4857

.4890

.4916

.4936

.4952

.4964

.4974

.4981

.4986

.49900

.49929

.49950

.49965

.49976

.49983

.49989

.49992

.49995

.49997

Allora se z = 0.22 la superficie al di sotto della

standardizzata (tra 0 e z) è pari a 0.0871, cioè è circa il 9%

dell’intera distribuzione, se invece è pari a 0.30 la superficie

è 0.1179, cioè circa il 12% della distribuzione, e così via.

Le tavole della normale standardizzata sono riportate in

appendice ad ogni testo di statistica.

Vediamo allora un po’ di esempi numerici e la soluzione di

alcuni problemi.

Esempi:

Si calcoli usando la tavola della normale standardizzata la

probabilità che: 1.96 Z 1.96

Data la simmetria su

0

della distribuzione, basta

moltiplicare per 2 il valore che si trova sulla tavola in

corrispondenza di 0.96, cioè 0.4750.

Questo valore indica la probabilità tra 0 e 1.96, quindi

0.4750 x 2 = 0.95 dice che la probabilità richiesta, in termini

percentuali, è il 95%.

Si calcoli ora la probabilità che in una normale con media

pari a 10 e varianza pari a

compreso tra 8 e 12.

4,

X assuma un valore

Per usare la standardizzata si devono determinare su

quest’ultima distribuzione quei valori che corrispondono a 8

e a 12;

essi sono:

z1

X1

8 10

1

2

z2

X2

12 10

1

2

Allora dalle tavole della normale standardizzata:

prob0 Z z 2 0.3413

probz1 Z z 2 2 0.3413 0.6826

e pertanto la probabilità richiesta per X è approssimativamente

del 68%.

Sia X una vc normale con media 16000 e scarto quadratico

medio pari a 2000.

Calcolare la probabilità che X sia compreso tra 15000 e

18000.

z1

15000 16000

0.5

2000

z2

18000 16000

1

2000

Allora:

prob 0.5 Z 1 prob 0 Z 0,5 0.1915

prob 0 Z 1 0.3413

prob 0.5 Z 1 0.1915 0.3413 0.5328

allora la probabilità richiesta per X è di circa il 53%.

MODELLI PER VARIABILI CASUALI CONTINUE

Variabile Casuale Normale

X ~ N , 2

,

E’ funzione di due parametri

2

2

f

x

Se

f

1

2

x dx

2

e

1 x

2

-

+

1

x

o

x f x 0

x

f(x) è simmetrica rispetto a

f x f x

Media e varianza

E X

VAR

X

2

V.C. Normale Standardizzata

Se 0 e 2 1

f

z

1

2

e

1 2

z

2

Relazione tra

Z

N

X

N , 2

Z 0,1

z

,

2

e

Z 0,1

X Z

P x1 X x2 P z1 Z z2

z1

x1

z2

x2

P Z z0 F z0

z0

f

z dz

Dalle tavole:

F z 1 F

z

F

z

1 F z

F 0 0.5

F z2 F z1

F 0 0.5

0

z1

z2

P X x P Z z

x

x

P Z

F

z

Problema

Un meteorologo ritiene che la probabilità che a Napoli piova durante

un giorno del mese di dicembre è uguale a 0,2.

a) Calcolare il numero di giorni di pioggia previsti dal meteorologo

durante tutto il mese.

b) Determinare inoltre la probabilità che nel mese di dicembre vi

siano al massimo 3 giorni di pioggia.

Soluzione

n = 30; p = 0,2

B (30, 0,2)

a) La previsione può essere fatta in termini di valore atteso, ossia:

E(X) = n p = 31 0,2 = 6,2.

b) Essendo n sufficientemente elevato, le probabilità cercate possono

essere approssimate dalla distribuzione Normale standardizzata:

P

X

P

3 6, 2

3 P Z

4,

8

Z

1 P

1, 46

Z

1, 46

1 0, 9279 0, 0721

DISTRIBUZIONI DI PROBABILITA’ “SPECIALI” DERIVATE

DALLA NORMALE STANDARDIZZATA

Distribuzione CHI-QUADRATO (c2n.

La somma dei quadrati di n variabili casuali indipendenti Normali

standardizzate si distribuisce come una v.c. c2 con n gradi di libertà

(g.l.).

Al crescere di n la c2 tende alla distribuzione Normale.

Distribuzione t di Student ( tn)

Sia X una v.c. Normale standardizzata e sia Z una v.c. c2n

indipendente da X.

Il rapporto: X

Z / n si distribuisce come una v.c. t di Student

con n gradi di libertà (t n ) .

La tn è simile alla Normale ma ha code più alte.

Al crescere di n la t tende alla Normale

Distribuzione F di Fisher ( F n1,n2 )

Siano Z1 e Z2 due v.c. indipendenti c2

g.l.;

Il rapporto : Z1

n1

Z2

con n1 e n2 rispettivi

n2

Si distribuisce come una v.c. F di Fisher-Snedecor con n1 e n2

g.l.

TEOREMA DI BAYES

Per introdurre il problema si partirà da un esempio.

Si abbiano due

urne: la prima, U1, contenente 4 palline bianche e 6 nere, la seconda, U2,

contenente 3 palline bianche e 5 nere..

Si estragga a sorte un' urna e si estragga poi dall’urna prescelta una

pallina.

Ammesso che la pallina estratta sia di colore bianco, ci si chiede: qual è

la probabilità che essa provenga dall'urna U1 se la probabilità di

selezionare ciascuna delle due urne è 0,50?

Si noti la particolarità del problema: finora le probabilità degli eventi

sono

state

sempre

determinate

prima

dell'esecuzione

dell'esperimento; qui la situazione è, in un certo senso, opposta: si

conosce il risultato dell'esperimento e si vuole calcolare la probabilità

che esso sia dovuto ad una certa "causa", nell'esempio che la pallina

provenga dall'urna U1.

Simili problemi si presentano ogni volta che un evento A può essere

visto come risultato ("effetto") di uno tra k possibili eventi ("cause"),

C1, C2, .... Ck, incompatibili e tali che uno di essi si deve verificare, e

interessa valutare la probabilità che, avveratosi A, sia Ci la causa che

l'ha prodotto. Conviene perciò introdurre una formula generale che

consenta il calcolo della probabilità in questione.

A questo fine si considerino innanzitutto gli eventi incompatibili C1, C2,

.... Ck, e si ammetta che essi costituiscano

una partizione dello spazio

campionario

Ω, ossia che Ω= C1

Allora

l’evento

A

può

essere

C2

espresso

....

nel

modo

Ck

seguente

A = A Ω =A ( C1 C2 .... Ck) = (A C1 ) (A C2 ).... (A Ck)

P(A B)

P(A)

(1.7)

P(B/A) =

(1.8)

P(A B)=P(A)-P(B/A)

Si osservi che l'evento A è espresso come unione degli eventi incompatibili

A Ci i = 1,2,. , n ; ne segue, per il terzo assioma della probabilità, che

P(A)=P(A C1)+P(A C2)+...+P(A Ck).

P(Ci A)

P(A)

Dalla (1.7) si ottiene

P(Ci | A)=

Applicando la (1.8) ad ogni elemento al secondo membro dell'equazione

precedente, si può anche scrivere

P(A) = P(C1)P(A|C1)+ P(C2)P(A|C2)+ ... + P(Ck)F(A| Ck)

(1.10)

Il problema è ora quello di calcolare la probabilità condizionata P(C1|A).

che, considerando la (1.8) e la (1.10), può essere posta nella forma

P(C i ) P( A | C i )

P(C1|A)=

k

1

P (C j ) P( A | C j )

(1.11)

La formula (1.11) va sotto il nome di formula di Bayes (dal nome

dell'ecclesiastico Thomas Bayes, 1702-1761, che la introdusse). È

opportuno

ribadire che P(C1|A) è la probabilità che l'evento A, già

realizzatosi, sia dovuto alla causa Ci ; tale probabilità è nota come

probabilità a posteriori, mentre P(Ci) è chiamata probabilità a priori della

causa C1.

Esempio1

Si riprenda l'esempio introduttivo. Dunque, ammesso che la pallina estratta

sia bianca, si vuole calcolare la probabilità che essa provenga dall’urna U1.

Se si indica con A l'evento in oggetto, con C1 l'urna U1 e con C2 l'urna U2,

la

probabilità

cercata

è

data

da

1 4

P(C1 ) P( A | C1 )

2 10

P(C1|A) =

0,52

P(C1 ) P( A | C1 ) P(C 2 ) P( A | C 2 ) 1 4 1 3

2 10 2 8

Esempio2

È noto che in una data popolazione la percentuale dei fumatori è pari al

35%. Si sa anche che il 20% dei fumatori ed il 6% dei non fumatori sono

affetti da una malattia respiratoria cronica. Si vuole determinare la

probabilità che un individuo affetto dalla malattia sia fumatore. Definiti gli

eventi: F: "fumatore",: "non fumatore", M: "malato", le informazioni

disponibili

consentono

di

P(F) =0,35; P ( F ) = 0,65; P(M| F) =0,20; P(M | F )= 0,06.

scrivere

Pertanto

PARTIZIONI E TEOREMA DI BAYES

PARTIZIONI

E

TEOREMA

DI

BAYES

Supponiamo che gli eventi A1, A2, . .. , An formino una partizione di uno

spazio campionario S; e cioè, che gli eventi Ai siano incompatibili e la loro

unione

sia

S.

Ora,

sia

B

un

qualsiasi

altro

evento.

Allora B = S B = (A1 A2... An) B = (A1 B) (A2 B) ... (An B)

dove gli AiB sono incompatibili.

Di conseguenza,

P(B) = P(A1 B) + P(A2 B) +...+ P(An B)

Quindi, per il teorema di moltiplicazione,

P(B)= P(A1)P(B|A1)+ P(A2)P(B|A2)+...+ P(An)P(B|An)

(1)

D'altra parte, per ogni valore di i, la probabilità condizionata di Ai dato

B è definita da

P( Ai B)

P(Ai|B) =

P ( B)

Impiegando la (1) per sostituire P(B) e impiegando P(Ai B) = P(Ai)P(B| Ai)

per sostituire P(Ai B), otteniamo da questa equazione il seguente

teorema.

Teorema di Bayes :

Supponiamo che A1, A2,... , An, sia una partizione di S e che B sia un

evento qualsiasi. Allora per ogni valore di i,

P( Ai ) P( B | Ai )

P(Ai|B) =

P( A1 ) P( B | A1 ) P( A2 ) P( B | A2 ) ... P( An ) P( B | An )

Esempio3:

Tre macchine A, B e C producono rispettivamente il 50%, il 30% e il

20% del numero totale dei pezzi prodotti da una fabbrica. Le

percentuali

di

pezzi

difettosi

di

queste

macchine

sono

,

rispettivamente, il 3%, il 4% e il 5%. Viene estratto un pezzo a caso:

determinare

la

probabilità

che

esso

sia

difettoso.

Sia X l'evento “un pezzo è difettoso".

Allora per la (1) precedente

P(X) = P(A)P(X|A)+P(B)P(X|B)+P(C)P(X|C)=(.50)(.03)+(.30)(.04)+(.20)(.05)= .037

Si noti che si può anche considerare questo problema come un processo

stocastico rappresentato dal diagramma ad albero adiacente.

Esempio4 :

Si consideri la fabbrica dell'esempio precedente. Supponiamo che si

estragga un pezzo a caso e che esso sia difettoso. Si determini la

probabilità che quel pezzo sia stato prodotto dalla macchina A; ossia, si

determini P(A| X).

Per il teorema di Bayes,

P( A) P( X | A)

(.50)(.03)

15

P(A|X) =

P( A) P( X | A) P( B) P( X | B) P(C ) P( X | C )

(.50)(.03) (.30)(.04) (.20)(.05) 37

In altri termini, dividiamo la probabilità del cammino in questione per la

probabilità dello spazio campionario ridotto, ossia di quei cammini che

conducono ad un elemento difettoso.

ESERCIZI SUL TEOREMA DI BAYES

Determinare P(B|A) se (i) A è un sottoinsieme B, (ii) A e B sono

incompatibili.

(i)

Se A è un sottoinsieme di B, allora ogniqualvolta si verifica A deve

verificarsi B ; quindi P(B|A)=1 Alternativamente, se A è un sottoinsieme di

B, allora AB = A; quindi

P( A B) P( A)

1

P(B|A)=

P( A)

P( A)

(ii)

Se A e B sono incompatibili, e cioè disgiunti, allora ogniqualvolta si

verifica A non può verificarsi B; quindi P(B |A) = 0.

Alternativamente, se

A e B sono incompatibili, allora A

quindi

P(B/A)= P(A B) / P(A) = P(Ø) / P(A) = 0 / P(A) = 0

B =Ø

·

Tre macchine, A, B e C, producono rispettivamente il 60%, il 30% e il

10% del numero totale dei pezzi prodotti da una fabbrica. Le percentuali di

produzione difettosa di queste macchine sono rispettivamente del 2%, 3% e

4%. Viene estratto a caso un pezzo che risulta difettoso. Determinare la

probabilità che questo pezzo sia stato prodotto dalla macchina C.

Sia X= {pezzi difettosi}. Vogliamo determinare P(C|X), la probabilità che un

pezzo sia stato prodotto dalla macchina C se si sa che quel pezzo è

difettoso.

Per

il

teorema

di

Bayes,

ESERCIZIO .

Una scatola contiene tre monete, delle quali due non sono truccate mentre

l'altra ha due teste. Scegliendo casualmente una delle tre monete e

lanciandola,

(a)

qual è la probabilità che risulti testa?

(b)

qual è la probabilità di aver scelto la moneta truccata sapendo che

il risultato del lancio è testa?

Soluzione:

Indichiamo con T e C, rispettivamente, gli eventi “uscita di testa" e "uscita di

croce", con M1 e M2 la scelta della prima e seconda moneta; entrambe non

truccate, e con M3 la scelta della moneta truccata.

Per il quesito (a) si ha

P(T) = P[(TM1)+(TM2)+(TM3)] = P(TM1)+P(TM2)+P(TM3)]

= P(T|M1 )P(M1 )+P(T|M2)P(M2)+P(T|M3 )P(M3)=

= 1 1 1 1 (1) 1 2

23

23

3

3

Per il quesito (b) si ha (teorema di Bayes)

P(M3|T)=

P(T | M 3 ) P(M 3 )

(1)(1 / 3) 1

P(T | M i ) P(M i ) (2 / 3) 2

i

Teorema di Tchebycheff

Finora si sono considerate media, varianza e deviazione standard

di un esperimento in modo separato per ana1izzare alcune

caratteristiche di una v.c. e della sua distribuzione di probabilità.

Si consideri ora un’utilizzazione congiunta di questi indici al fine di

fornire informazioni circa il modo in cui le probabilità si addensano

in intervalli centrati sulla media e di ampiezza proporzionale alla

deviazione

standard

della

variabile.

Intuitivamente si può pensare che a valori bassi della deviazione

standard corrisponda una massa di probabilità molto concentrata

intorno alla media, mentre a valori elevati della deviazione standard

la

probabilità

sia

più

diffusa

attorno

alla

media.

Si cercherà di quantificare tale idea intuitiva.

Esempio

Si consideri la variabile X= numero di teste uscite dal lancio di 5 monete.

μ=E[X]=2,5, Σ ( X – μ)2f(x) = 40/32 , σ2=Var(X)=1,25 , σ=1,12

Nella figura 3.20 è rappresentata la distribuzione di probabilità della v.c X

unitamente alla probabilità compresa negli intervalli μ±σ e μ±2σ

Teorema:

Se la v.c. X ha media finita μ e deviazione standard finita

σ, e k è un numero positivo qualunque, allora la massa di probabilità che

si trova al di fuori dell’intervallo chiuso [( μ- kσ) ,( μ + kσ)] è inferiore a

1/k2. In simboli:

o, equivalentemente, la probabilità sull’intervallo complemento è

superiore a (1- 1/k2 ),cioè:

1

P(| X |) k ) 1 2

k

Infatti, si supponga che la variabile casuale X abbia media μ e deviazione

standard σ. Tra tutti i valori possibili di X si scelgano quelli che distano da μ

in valore assoluto, più della quantità kσ , dove k è un numero reale positivo.

I valori di X vengono cosi divisi in due sottoinsiemi: i valori compresi

nell’intervallo [(μ- kσ), ( μ+ kσ)] e quelli invece che si collocano al di fuori di

tale intervallo. Per comodità si indichino con xi*

i valori esterni

all’intervallo che soddisfano cioè la relazione | xi*- μ| ≥ kσ .

Dalla

definizione

di

σ

si

avrà:

Poiché i valori xi* un sottoinsieme di tutti i possibili valori di X, e più

precisamente :

f ( x *) Pr(| x

i

i

i

| k )

Detta relazione potrà allora scriversi:

2

k

2

2

Pr(| xi | k )

da cui segue:

1

Pr(| xi | k ) 2

k

Questo teorema è molto importante perchè permette di

associare un livello di probabilità a degli intervalli senza

conoscere la forma della distribuzione della funzione di

probabilità f(x). Ma chiedendo solamente che la v.c. X abbia

media e varianze finite. È quindi

un teorema che vale

sotto condizioni assolutamente generali.

Togliendo il valore assoluto nell'espressione del teorema., si può scrivere:

Pr(k X k ) 1

e quindi:

1

k2

Pr( k X k ) 1

1

k2

La rappresentazione grafica del teorema di Tchebycheff equivale a

suddividere l’insieme possibile della v.c. X nei seguenti sottoinsiemi:

Nota: Per valori di σ>0 la probabilità espressa dal teorema di Tchebycheff

è una funzione decrescente di σ, nel senso che a valori via via più elevati di

σ vengono associati livelli di probabilità sempre più bassi per un valore di k

costante. Infatti, quanto più σ è piccolo tanto più piccolo è l'intervallo intorno

a μ entro il quale cade una stessa percentuale di valori della v.c X, cioè

quanto più σ è piccolo, tanto più la media è rappresentativa dell’intera

distribuzione dei valori della variabile X

Dalle Figure si vede che σ1 >σ2 > σ3

Esercizio sul teorema di Tchebycheff

Le confezioni di pasta alimentare di una certa linea di produzione hanno un

peso che può essere assimilato ad una variabile aleatoria X avente media μ =

0,5 Kg e deviazione standard σ = 0.003 kg. Si determini:

a)

il limite inferiore della probabilità che, estraendo a sorte una

confezione, il

peso della confezione sia compreso nell'intervallo di estremi 0,5 ± 2 × 0,003

b)

il limite superiore della probabilità che X sia esterna all'intervallo (0.491;

0.509)

c)

il limite inferiore per P(0.495 < X < 0.505)

d)

l'intervallo intorno alla media in cui è compresa la variabile aleatoria X

con probabilità almeno uguale al 95%

Soluzione

a) Si tratta di una applicazione diretta della formula: P(| X |) k ) 1

1

k2

dalla quale risulta evidente che k = 2; pertanto l'estremo inferiore cercato è dato

da:

P(| X 0,5 |) 0,006 ) 1

1

22

b) Per utilizzare ancora la precedente formula, dobbiamo prima ricavare k.

Dalla relazione 0.5 - k(0.03) = 0.491 otteniamo k = 3. Pertanto l'estremo

superiore cercato è dato da: P[( X 0,491) ( X 0,509 )]

1

0,11

2

3

c) Dalla relazione 0.5 - k(0.03) = 0.495 si trova k = 1,7. Ne consegue che il

limite inferiore cercato é 0,65

1

4,47

d) anche qui si tratta di trovare k; si ha allora k

1 0,95

Pertanto l'intervallo richiesto è: (μ – 4,47σ ; μ + 4,47σ) ovvero (0,487; 0,513)

Semplici teoremi sui valori caratteristici di una variabile

casuale.

Siano : X una v.c. ; a , b due costanti

1.

2.

3.

E a X b a E X b

E

a X a

2

2

E X 2

var a X b a 2 var X

Valore caratteristico incrociato per una distribuzione congiunta di

variabili casuali

(covarianza)

cov XY EX EX Y EY

Siano X , Y due v.c. con funzione di densità congiunta pij ; il valore

caratteristico cov(XY) detto covarianza è fornito dalla relazione:

Tale valore è di notevole rilievo perché è una misura del legame

lineare tra X e Y.

Ancora due semplici teoremi

Se X , Y sono due v.c.

EX Y EX EY

var X Y var X var Y 2 cov XY

Indipendenza e covarianza

Siano X Y due v.c.

Esse sono indipendenti se e solo se

PXY PX PY

Se tale condizione si verifica allora ovviamente cov (XY) = 0

perché l’indipendenza esclude la possibilità di legami.

ATTENZIONE! Non è vero in genere il contrario,

cioè la covarianza nulla non

implica indipendenza.

Si può dimostrare però che se X , Y sono v.c. Normali la

covarianza nulla è condizione necessaria e sufficiente per

l’indipendenza.

Un ultimo teorema: se X , Y sono v.c. indipendenti

EXY EXEY

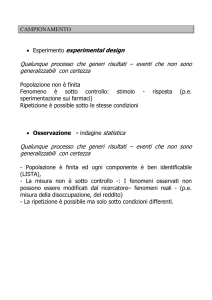

Le fasi dell’indagine

statistica

Il campionamento

Le fasi dell’indagine

Le fasi di un’indagine sono:

La progettazione dell’indagine

-

come si acquisiscono i dati?

indagine censuaria o campionaria?

quanto tempo?

quali risorse?

La rilevazione dei dati

L’elaborazione dei dati

La pubblicazione dei risultati

Le fonti dei dati

La precisione e la qualità dei dati influiscono sulla

validità dei risultati

La precisione e la qualità dei dati dipendono dal

tipo di metodo scelto per l’acquisizione dei dati

I dati statistici possono provenire da:

– Data base statistici (dati pubblici)

– Dalla propria rilevazione

– Da Esperimenti

Data base statistici

Questo metodo è solitamente preferito per la

velocità di acquisizione e bassi costi

I dati possono essere su supporto cartaceo,

magnetico o possono essere acquisiti in linea

(Internet)

Ad esempio:

I dati pubblicati dall’ISTAT,

dalla Banca d’Italia

I dati forniti da Enti riconosciuti sono chiamati

dati primari o dati di fonti ufficiali

Ad esempio:

•I dati di famose società statistiche private

• I dati finanziari forniti dagli uffici studi delle

banche o assicurazioni

I dati forniti da Enti non ufficiali sono chiamati dati

secondari o dati di fonti non ufficiali

La rilevazione propria e la conduzione di

esperimenti

Quando i dati pubblicati non sono sufficienti a colmare il

proprio bisogno di informazioni, vengono effettuati degli

studi in proprio per ottenere i dati necessari:

Attraverso la rilevazione dei dati le variabili

che caratterizzano il fenomeno sono osservate

e registrate senza controllare la presenza di

fattori che possano influire sul loro valore

Attraverso gli esperimenti le variabili che

caratterizzano il fenomeno sono osservate e

registrate controllando l’influenza di alcuni

fattori sul loro valore

L’indagine statistica

– Con l’indagine statistica le informazioni vengono

raccolte dalle persone

– L’indagine

attraverso

intervista

intervista

intervista

statistica

può

essere

personale (face to face)

telefonica

auto-amministrata

Un buon questionario deve essere costruito:

• Rendendo il questionario quanto più breve possibile

• Inserendo domande breve, semplici e chiare

• Partendo da domande generiche per poi entrare nello

specifico (tecnica ad imbuto)

• Utilizzando domande chiuse a scelta dicotomica o multipla

• Utilizzando domande aperte solo quando è necessario

• Inserendo domande di controllo

• Strutturando il questionario a seconda del tipo di intervista

realizzata

Il campionamento

Perché si ricorre ad un’indagine campionaria:

–Per i costi

–Per la numerosità elevata della Popolazione

–Per la possibilità di distruggere le unità della

popolazione quando si raccolgono i dati

Il campione deve essere rappresentativo della

popolazione e non distorto

La Popolazione (“universo”)

Insieme finito o infinito, di UNITA' statistiche

Esempio popolazione Italiana:

definito:

residente in Italia

sul territorio Italiano

nei contenuti

al censimento del

nello spazio

2001

nel tempo

Il Campione

Insieme delle n UNITA' statistiche selezionate tra le

N che compongono la popolazione :

il fine è rappresentare la popolazione

le n unità che costituiscono il campione

sono le unità campionarie

Differenti tipi di campione

Un campione può essere:

Casuale o probabilistico

si attribuisce ad ogni unità statistica della

una probabilità positiva di essere estratta

si utilizzano in modo appropriato le tecniche

per

la

selezione

casuale

(Tavole

di

generazione dei numeri casuali, software)

Non probabilistico o a scelta ragionata

• Le unità campionarie sono scelte sulla

base di informazioni a priori in modo da

somigliare per alcuni caratteri strutturali

alla popolazione da cui sono tratte

Campione probabilistico

Campione non

probabilistico

Campionamento

CASUALE SEMPLICE

Campionamento

PER QUOTE

Campionamento

STRATIFICATO

Campionamento

UNITA’ TIPO

Campionamento

SU PIU' STADI

Campionamento

ELEMENTI ANOMALI

Campionamento

DI AREE

Campionamento

RUOTATO

Campionamento

IN DUE FASI

La struttura del campione è data dall'insieme di LISTE che si adoperano

per formarlo. Se la lista della popolazione è unica il campione ha una

struttura semplice; se sono necessarie più liste la struttura è complessa

Campione casuale semplice

E’ il campione della teoria statistica

Il campionamento casuale semplice si realizza

semplicemente scegliendo a caso dalla popolazione n

elementi dall’universo N , in modo tale che ogni unità

abbia la stessa probabilità di essere estratta

POPOLAZIONE

N unità

CAMPIONE

n unità

PROBABILITA' DI INCLUSIONE di i

i

FRAZIONE di CAMPIONAMENTO f= n/N

n

N

• Esempio

– Si vogliono controllare, in un elenco

provinciale di 1.000 aziende, 50 bilanci

– Dall’elenco si estraggono casualmente 50

aziende

– Usare il generatore di numeri casuali in

Excel

Soluzione

Si generano 50 numeri tra 1 e1000

Approssimando

X(100)

50 numeri

uniformemente

distribuiti tra 0 e 1

0.3820002

0.1006806

0.5964843

0.8991058

0.8846095

0.9584643

0.0144963

0.4074221

0.8632466

0.1385846

0.2450331

382.00018

100.68056

596.48427

899.10581

884.60952

958.46431

14.496292

407.4221

863.24656

138.58455

245.03311

.

.

.

.

50 Numeri casuali

tra 0 e 1000,

ognuno ha probabilità

1/1000 di essere estratto

383 383

101 101

597 597

900 900

885 885

959 959

15 15

408 408

864 864

139 139

246 246

50 numeri casuali

interi tra 1 e 1000

uniformemente

distribuiti

. .

. .

Saranno selezionate le aziende

con i numeri identificativi 383, 101, ...

Campione stratificato

STRATIFICARE significa ripartire, cioè individuare

nella popolazione

Sottopopolazioni al massimo

omogenee rispetto alla variabile o alle variabili da

rilevare

da ogni Strato viene estratto un campione casuale

semplice

– Con questo campione è possibile ottenere

informazioni circa:

• l’intera popolazione

• ogni strato

• le relazioni tra gli strati

A pari numerosità, le STIME sono più Efficienti di

quelle ottenibili con un Campionamento Casuale

Semplice

Professione

• dipendente

• autonomo

• lib.prof.

Età

• sotto 20

• 20-30

• 31-40

• 41-50

Sesso

• Maschio

• Femmina

Ci sono più modi per costruire un campione casuale

stratificato. Ad esempio, nel campione si può rispettare

proporzionalmente la numerosità degli strati della popolazione

(selezione proporzionale)

Un campione di numerosità 1.000 deve essere estratto

Altri modi sono:

Selezione uniforme

Selezione Ottimale

Selezione Ottima di NEYMAN-TCHUPROW

Sono legati alla varianza tra

gli strati e all’interno degli

strati

Strato

1

2

3

4

Reddito

Proporzione popolaz.

sotto E. 15.000

15.000-29.999

30.000-50.000

oltre E. 50.000

25%

40%

30%

5%

n. Strato

250

400

300

50

Totale 1.000

Campione a grappoli

Il campionamento a grappoli è un campionamento

casuale in cui le unità da estrarre sono gruppi di

elementi contigui detti Grappoli (cluster)

E' particolarmente utile quando:

non è disponibile un elenco dei singoli

elementi della popolazione

i

costi

di

rilevazione

aumentano

notevolmente al crescere della distanza tra

gli elementi

Gli elementi che fanno parte di uno stesso grappolo

sono fisicamente vicini, comportando che abbiano

caratteri simili, ossia che le misure del carattere da

rilevare siano più o meno tra loro correlate

Esempio:

indagini su vaste aree territoriali (Regioni, Città ecc.);

in tali casi i grappoli vengono solitamente definiti in

termini di sub-aree (Comuni, Quartieri, ecc.).

Il campione deve essere formato da un numero elevato

di grappoli di piccole dimensioni

Pochi grappoli di grande dimensione possono essere

giustificati solo se eterogenei nel loro interno, ossia se

è molto elevata la varianza NEI gruppi e invece bassa

quella TRA i gruppi

L’errore campionario

Svolgendo un’indagine statistica possono essere

commessi due tipi di errori:

L’errore campionario

L’errore extra campionario

Tale tipo di errore si riferisce alla differenza tra il

campione e la popolazione, ovvero tra la stima ottenuta

dal campione ed il parametro della popolazione.

Diminuisce all’aumentare della numerosità campionaria

L’errore extra campionario

Tale tipo di errore si ha se si commettono degli sbagli durante

il processo di rilevazione dei dati

Non diminuisce all’aumentare della numerosità campionaria

E’ di tre tipi:

Errore nell’acquisizione dei dati

(es: codifica sbagliata)

Errore di non risposta

Errore di selezione

La distribuzione

campionaria

Calcolare i parametri di una popolazione è quasi

sempre proibitivo per la numerosità della stessa

Per questo, per conoscere le caratteristiche della

popolazione viene considerato un campione, e

facendo inferenza, si calcola una statistica

relativamente ai parametri di interesse

La distribuzione campionaria della statistica è lo

strumento che ci dice come si distribuisce la

statistica attorno al parametro

La distribuzione campionaria

della media

•

Esempio

– Un dado è lanciato un numero infinite di

volte

– Sia X la variabile che rappresenta il numero

di punti in ogni faccia del dado

– La distribuzione di probabilità di X è:

x

1 2 3 4 5 6

p(x) 1/6 1/6 1/6 1/6 1/6 1/6

E(X) = 1(1/6) +

2(1/6) + 3(1/6)+

………= 3.5

V(X) = (1-3.5)2 (1/6 +

(2-3.5)2 (1/6 + ………

………. = 2.92

Supponiamo di voler stimare m dalla media x

di un campione di numerosità n = 2

Qual è la distribuzione di x ?

Campione

Media Campione

Media Campione

Media

1

1,1

1

13

3,1

2

25

5,1

3

2

1,2 1,5

14

3,2

2,5

26

5,2

3,5

3

1,3

2

15

3,3

3

27

5,3

4

4

1,4 2,5

16

3,4

3,5

28

5,4

4,5

5

1,5

3

17

3,5

4

29

5,5

5

6

1,6 3,5

18

3,6

4,5

30

5,6

5,5

7

2,1 1,5

19

4,1

2,5

31

6,1

3,5

8

2,2

2

20

4,2

3

32

6,2

4

9

2,3 2,5

21

4,3

3,5

33

6,3

4,5

10

2,4

3

22

4,4

4

34

6,4

5

11

2,5 3,5

23

4,5

4,5

35

6,5

5,5

12

2,6

4

24

4,6

5

36

6,6

6

Campione

Media Campione

Media Campione

Media

1

1,1

1

13

3,1

2

25

5,1

3

2

1,2 1,5

14

3,2

2,5

26

5,2

3,5

3

1,3

2

15

3,3

3

27

5,3

4

4

1,4 2,5

16

3,4

3,5

28

5,4

4,5

5

1,5

3

17

3,5

4

29

5,5

5

6

1,6 3,5

18

3,6

4,5

30

5,6

5,5

7

2,1 1,5

19

4,1

2,5

31

6,1

3,5

8

2,2

2

20

4,2

3

32

6,2

4

9

2,3 2,5

21

4,3

3,5

33

6,3

4,5

10

2,4

3

22

4,4

4

34

6,4

5

11

2,5 3,5

23

4,5

4,5

35

6,5

5,5

12

2,6

4

24

4,6

5

36

6,6

6

E( x) =1.0(1/36)+

1.5(2/36)+….=3.5

6/36

5/36

4/36

V(X) = (1.0-3.5)2(1/36)+

(1.5-3.5)2(2/36)... = 1.46

3/36

2/36

1/36

1

1.5

2.0

2.5

3.0

3.5

4.0

x x e

2

x

4.5

5.0

x2

2

5.5 6.0

x

n5

x 3. 5

2x

2

x .5833 ( )

5

n 10

x 3. 5

2

2x .2917 ( x )

10

n 25

x 3. 5

2x

.1167 ( )

25

2

x

1

6

E’ da notare che x è più piccolo

1

di x. Al più grande campione

corrisponde il 2 più piccolo. Inoltre

x

x tende a cadere sempre più vicino a ,

quanto più cresce la numerosità del campione

2

6

1

6

Teorema del Limite Centrale

– Da qualsiasi popolazione si estragga un

campione, la distribuzione della media

campionaria si approssima ad una Normale

per campioni sufficientemente grandi

– Quanto è più grande il campione tanto più la

distribuzione campionaria di

si

x

approssima ad una Normale

4.3.1 La distribuzione campionaria della

media campionaria

1. x x

x2

2.

n

3. Se x è normale, x è normale. Se x non è normale x si distribuis ce

approssima tivamente come una normale per campioni sufficient emente

grandi

2

x

•

Esempio

La quantità di soda pop contenuta ogni

bottiglia si distribuisce in modo normale con

media 32.2 ml. E deviazione standard di 0.3

ml..

– Trovare la probabilità che una bottiglia,

acquistata da un consumatore, contenga più di

32 ml.

Soluzione

La variabile casuale X è la quantità di soda pop nella

bottiglia

0.7486

x 32 32.2

P( x 32 ) P(

)

x

.3

P( z .67 ) 0.7486

x = 32

= 32.2

– Trovare la probabilità associata alla possibilità di

avere in 4 bottiglie una quantità media maggiore

di 32 ml.

Soluzione

La variabile casuale X è l’ammontare medio di

soda pop per bottiglia

x 32 32.2

P( x 32) P(

)

x

.3 4

0.9082

P( z 1.33) 0.9082

0.7486

x = 32

x 32 = 32.2

x 32.2

•

Esempio

Lo stipendio medio settimanale dei laureati un anno dopo la

laurea è di 600 Euro.

Supponiamo che tale variabile si distribuisca in modo

normale con una deviazione standard di 100 Euro.

– Trovare la probabilità che 25 laureati, estratti casualmente,

abbiano uno stipendio settimanale inferiore a 550 Euro.

Soluzione

x 550 600

P( x 550) P(

)

x

100 25

P( z 2.5) 0.0062

– Se in un campione di 25 laureati, estratto

casualmente, lo stipendio medio settimanale è di

550 Euro, cosa si può commentare sulla media

della popolazione pari a 600?

Soluzione

Con = 600 la probabilità di avere un

campione con media pari a 550 è molto bassa

(0.0062). L’affermazione che i laureati hanno

uno stipendio medio settimanale pari a 600 è,

molto probabilmente, ingiustificata.

E’ molto più realistico assumere che sia più

piccola di 600, perché così, sarebbe molto più

probabile una media nel campione pari a 550.

La distribuzione normale standardizzata

Per fare inferenza sui parametri della popolazione è

necessario utilizzare la distribuzione campionaria

(esempio )

Utilizzando la distribuzione normale standardizzata i

valori sono tabulati:

P(1.96 z 1.96) .95, or P(1.96

- Z.025

Z.025

x

1.96) .95

n

Può essere scritto come :

P(1.96

x 1.96

) .95

n

n

che diventa :

P( 1.96

x 1.96

) .95

n

n

La distribuzione normale standardizzata Z

.025

.025

Distribuzione normale of

-1.96

0

-1.96

x

.025

.025

1.96

n

1.96

n

Sostituend o 600, 100, e n 25 all' esempio 5.2

100

100

P (600 1.96

x 600 1.96

) .95

25

25

Con

P (560.8 x 639.2) .95

Conclusione

– C’è il 95% delle possibilità che la medi

campionaria sia compresa nell’intervallo [560.8,

639.2] se la media della popolazione è 600.

– Se la media del campione fosse 550, la media

della popolazione probabilmente non sarebbe

600.

In generale

P( z 2

x z 2

) 1

n

n

Creazione della distribuzione

campionaria

attraverso una

simulazione al computer

Riproducendo un data sets di numeri casuali

che provengono da una data distribuzione, si

possono verificare le caratteristiche della

distribuzione.

Si simula un esperimento del lancio del dadi

(la creazione della distribuzione della media).

Sono mostrati di seguito gli effetti dell’aumento

della numerosità campionaria.

Simulazione del lancio del dadi

Media = 3.486

Stand. Dev. = 1.215

Media = 3.495

Stand. Dev. = 0.749

n = 10

6

M

or

e

5.

5

5

4.

5

4

3.

5

3

2.

5

2

1.

5

1

Media = 3.494

Stand. Dev. = 0.544

e

M

or

6

5.

5

5

4.

5

4

3.

5

2.

5

2

1.

5

1

6

M

or

e

5.

5

5

4.

5

4

3.

5

n=5

3

2.

5

2

1.

5

1

n=2

3

Valori della variabile

Calcolare la media

…e probabilità associate

0

5.

5

5

4.

5

4

3

3.

5

6

M

or

e

More

2.

5

1

Excel

2

0.1666667

0.1666667 Osservazione 1 Osservazione 2 Media Camp Bin

4

6

5

0.1666667

6

6

6

0.1666667

0.1666667

1

3

2

6 di taglia 2 1

3,5

0.1666667

Campione

2

1

1,5

Frequenza

Creazione valori

di una

1

28

1

1

1

distribuzione 1,5

della 65 Creare un2 istogramma1per la 1,5

90

2

3

2,5

media simulata2

distribuzione

della media

2,5

98

4

3

3,5

campionaria

3

121

3

3

3

3,5

177

6

3

4,5

4

152

3

2

2,5

4,5

107

6

5

5,5

5

81

6

2

4

5,5

55

6

1

3,5

6

26

5

5

5

1.

5

1

2

3

4

5

6

Valori

1

1,5

2

2,5

3

3,5

4

4,5

5

5,5

6

La distribuzione campionaria

della proporzione

Il parametro di interesse per i dati qualitativi è il

numero di volte che un particolare risultato si

verifica (numeri di successi)

Per stimare la proporzione (frequenza) p della

popolazione si utilizza la frequenza

del

^

p

campione

^ è una binomiale

La distribuzione campionaria p

Si preferisce utilizzare, per fare inferenza,

l’approssimazione normale della distribuzione

binomiale

Approssimazione della Binomiale ad una

Distribuzione Normale

– L’approssimazione è migliore quando:

La dimensione del campione è grande

La probabilità di successo p, è prossima

a 0.5.

– Per ottenere buoni risultati:

np > 5; n(1 - p) > 5

•

Esempio

– Approssimare la probabilità binomiale P(x=10) quando

n = 20 e p = .5

– I parametri per l’approssimazione sono:

= np; 2 = np(1 - p)

Costruiamo una distribuzione normale

per approssimare la binomiale P(X = 10)

= np = 20(.5) = 10; 2 = np(1 - p) = 20(.5)(1 - .5) = 5

La probabilità esatta è P(X = 10) = .176

P(9.5<YNormale<10.5)

L’ approssimazione

9.5 10

P(XBinomiale = 10)

~= P(9.5<Y<10.5)

10.5

9.5 10

10.5 10

P(

Z

) .1742

2.24

2.24

Altri esercizi di approssimazione

P(X<=8) = P(Y< 8.5)

8

P(X>= 14) = P(Y > 13.5)

Per grandi campioni l’effetto del fattore di

correzione del continuo è veramente molto

piccolo e può essere trascurato

13.5

8.5

14

Approssimazione della distribuzione

campionaria della proporzione

E( p

^) = p

– Si può dimostrare che

e

– V( p

^ ) = p(1-p)/n

Se sia np > 5 e np(1-p) > 5, allora

z

p̂ p

p(1 p)

n

si distribuisce approssimativamente come una

variabile normale standardizzata

Esempio

– Un’Azienda ha una quota di mercato del 30%. In

un’indagine campionaria di 1.000 consumatori è

stato chiesto quale marca preferiscono.

– Quale è la probabilità che più del 32% di tutti i

rispondenti dicano di preferire quella marca?

Soluzione

La variabile “numero di rispondenti che preferiscono la

marca X” si distribuisce come una binomiale con n =

1000 and p = .30.

Inoltre, np = 1000(.3) = 300 > 5

n(1-p) = 1000(1-.3) = 700 > 5.

p̂ p

.

32

.

30

.0838

P(p̂ .32) P

p(1 p) n .01449

Distribuzione campionaria

del confronto tra medie

La differenza tra medie è un parametro rilevante

quando si confrontano due popolazioni

Per fare inferenza tra 1 - 2 dobbiamo osservare

la distribuzione di

x1 x 2

Il valore atteso e la varianza saranno:

E ( x1 x2 ) E ( x1 ) E ( x2 ) 1 2

V ( x1 x2 ) V ( x1 ) V ( x2 )

12

n

22

n

La distribuzione di x1 x 2 è normale con

media 1 - 2 e deviazione standard di 12 22

n

n

se

– I due campioni sono indipendenti

– Le popolazioni originarie si distribuiscono in

modo normale

Se le popolazioni originarie non sono normali ma

il campione è maggiore di 30 la distribuzione

x1 x 2 si approssima ad una normale

Esempio

– I voti medi (in centesimi) di diploma di due

differenti Istituti sono 62 (stand.dev. = 14,5), e

60 (stand. dev. = $18,3).

– Qual è la probabilità che la media campionaria

degli studenti dell’Istituto A sia maggiore di

quella degli studenti dell’Istituto B (nWLU = 50;

nUWO = 60)

Soluzione

1 - 2 = 62 – 60 = 2

12

22

14,52 18,32

3,128

n

n

50

60

P( x1 x2 0) P(

x1 x2 ( 1 - 2 )

12

n1

22

n2

P( z .64) .5 .2389 .7389

02

)

3,128