CAUSALITÀ, INDUZIONE, PROBABILITÀ

Il ragionamento causale

Causalità e induzione

Induzione e probabilità

Il mondo antico sostanzialmente non conosce l’idea

di legge nel senso della scienza moderna: in quel

mondo la ‘legge’ è soprattutto una nozione giuridica

e politica.

Esempio: la dicotomia greca antica tra nomos

(‘legge’) e physis (‘natura’) nel primo libro della

Repubblica di Platone.

L’idea moderna di legge naturale si afferma

pienamente solo con Newton: la formulazione

matematica delle leggi svolge un ruolo essenziale nel

fondare l’idea che la legge sia una prescrizione

necessaria.

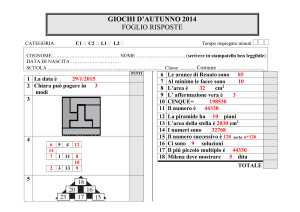

Interazioni ‘causali’: un semplice esempio

1

2

3

1

3

2

Gli urti sono processi ‘causali’, ma nel senso di essere

governati con necessità da leggi (meccaniche).

Sullo sfondo di questa stretta relazione tra causalità

e legge, è possibile dimostrare il fondamento

empirico della relazione causale?

È il problema affrontato da David Hume (1711-1776):

- ammettendo che la conoscenza autentica sia in

larga parte di tipo causale, qual’è il fondamento di

questa conoscenza?

- perché ci ‘fidiamo’ della conoscenza causale e

perché non possiamo farne a meno?

“Tutti gli oggetti della ragione e della ricerca umane

si possono naturalmente dividere in due specie, cioè

relazioni di idee e materie di fatto.”

RELAZIONI TRA IDEE

“Alla prima specie appartengono le scienze della

geometria, dell’algebra e dell’aritmetica; e, in breve,

qualsiasi affermazione che sia certa intuitivamente e

dimostrativamente. [...] Proposizioni di questa specie

si possono scoprire con una semplice operazione del

pensiero, senza dipendenza alcuna da qualche cosa

che esista in qualche parte dell’universo. Anche se

non esistessero in natura circoli o triangoli, le verità

dimostrate da Euclide conserverebbero sempre la

loro certezza ed evidenza.”

MATERIE DI FATTO

“Le materie di fatto, che sono la seconda specie di

oggetti dell’umana ragione, non si possono accertare

nella stessa maniera, né l’evidenza della loro verità,

per quanto grande, è della stessa natura della

precedente. Il contrario di ogni materia di fatto è

sempre possibile, perché non può mai implicare

contraddizione e viene concepito dalla mente con la

stessa facilità e distinzione che se fosse del pari

conforme a realtà.”

“Che il sole non sorgerà domani è una proposizione

non meno intelligibile e che non implica più

contraddizione dell’affermazione che esso sorgerà.

Invano tenteremo, dunque, di dimostrare la sua

falsità; se essa fosse falsa dimostrativamente,

implicherebbe una contraddizione e non potrebbe

mai essere distintamente concepita dalla mente.”

D. Hume, Ricerca sull’intelletto umano (1748)

“È chiaro che in tutti i ragionamenti riguardanti le materie di

fatto sono basati sulla relazione di causa ed effetto e che noi

non possiamo mai inferire l’esistenza di un oggetto da quella

di un altro a meno che questi non siano connessi insieme, in

modo immediato o mediato. Quindi, per capire questi

ragionamenti, dobbiamo avere una perfetta dimestichezza

con l’idea di causa, e a questo scopo dobbiamo guardarci

intorno e trovare qualcosa che sia la causa di un’altra.”

Analisi dell’idea di causa := analisi di quelle condizioni generali

che ritroviamo nelle relazioni causali empiriche

contiguità

precedenza temporale della causa

congiunzione costante

Queste tre condizioni sono, per Hume, tutto ciò che di

‘causale’ possiamo ritrovare nell’esperienza.

Le domande fondamentali per Hume sono allora due:

1 Perché il fatto che tutto ciò che esiste debba avere una causa

ci appare un principio necessario? [PROBLEMA DELLA

CAUSALITÀ]

2 Qual’è il fondamento di quell’inferenza che, a partire da una

serie di fenomeni, ci porta a ipotizzare le cause di quei

fenomeni, e perché tendiamo ad attribuire necessità anche a

questo tipo di inferenza? [PROBLEMA DELL’INDUZIONE]

Problema della causalità (domanda 1):

perché la relazione causale dovrebbe essere

necessaria?

Problema dell’induzione (domanda 2):

come siamo arrivati a stabilire il carattere causale di

certe interazioni?

ATTENZIONE!

Logicamente, la domanda 2 precede la domanda 1:

una risposta alla 2 implica una risposta alla 1

La domanda

“come siamo arrivati a stabilire il carattere causale di

certe interazioni?”

rivela che l’assunzione implicita nell’uso di argomenti

induttivi è un principio di uniformità della natura:

“ne segue allora che tutti i ragionamenti riguardanti

la causa e l’effetto sono fondati sulla supposizione

che il corso della natura continuerà a essere

uniformemente lo stesso.”

Il nuovo problema è allora: in che misura è possibile

giustificare il principio di uniformità della natura?

Giustificazione logica?

Non necessaria: il principio di uniformità non è di

natura logica, cioè negare il principio non è

contraddittorio.

Giustificazione empirica?

Circolare: per giustificare il principio di uniformità

dovremmo ricorrere al principio stesso.

“In tutti i ragionamenti derivanti dall’esperienza c’è

un passo compiuto dalla mente che non è sorretto

da alcun argomento o processo dell’intelletto.”

Questo passo è invece sorretto dall’abitudine, una

caratteristica della natura umana che Hume

interpreta come una predisposizione – di fronte al

ricorrere di certi eventi secondo una certa

successione – ad attendersi la ripetizione di quegli

eventi in quella successione.

Hume si riferisce all’abitudine come a un tratto

originario e istintivo della natura umana, non

ulteriormente analizzabile in termini di strutture

psicologiche più profonde.

“Adoperando questa parola, non pretendiamo d’aver

dato la ragione ultima di tale inclinazione. Noi non

facciamo che indicare la presenza di un principio

della natura umana, che è universalmente

riconosciuto e che è molto noto nei suoi effetti.”

Argomento induttivo: argomento nel quale la relazione tra

premesse e conclusione non è necessaria ma ‘probabile’.

Esempi

• Un ortolano vende una cassetta di arance a metà prezzo.

• Voglio comprare una cassetta di arance e spendere poco.

• L’ortolano prende un’arancia dallo strato più alto della cassetta e,

tagliandola a metà, mi mostra che l’arancia è buona.

Argomento 1

Questa arancia è buona

quindi

Tutte le arance della cassetta

sono buone.

Campione di popolazione

Intera popolazione

Argomento 2

Prendo dalla cassetta un’arancia

a caso ed è buona.

quindi

Tutte le arance della cassetta

sono buone.

Argomento 3

Quasi tutte le arance della cassetta

sono buone.

Queste quattro arance sono prese

a caso dalla cassetta.

quindi

Queste quattro arance sono buone.

Campione di popolazione

Intera popolazione

Intera popolazione

+

Campione di popolazione

Campione di popolazione

Argomento induttivo

La relazione tra premesse e conclusione

non è necessaria ma ‘probabile’

Ma cosa significa ‘probabile’?

Il problema è serio perché non esiste un’unica

interpretazione possibile della nozione di

probabilità.

La probabilità:

un enigma filosofico?

Origini moderne del concetto di probabilità: tra il 1650 e il 1800

(gli antichi non hanno sviluppato un’idea robusta di probabilità).

Fin dall’inizio della sua storia moderna, il concetto di probabilità si

è sviluppando lungo due linee fondamentali:

ONTOLOGIA

della probabilità

EPISTEMOLOGIA

della probabilità

Caso

Aleatorietà

…………..

Incertezza

Verosimiglianza

…………………..

Alcune tappe storicamente fondamentali

1654 Corrispondenza tra Pascal e Fermat Nascita ‘ufficiale’

della probabilità moderna: il XVII secolo è ricchissimo di riflessioni

sulla probabilità (dalla nascita delle compagnie di assicurazione al

tema teologico della ‘scommessa’ di Pascal sull’esistenza di Dio)

1812 Laplace, Teoria analitica della probabilità (contiene il Saggio

filosofico sulla probabilità)

1933 Formulazione matematica del moderno calcolo delle

probabilità (A.N. Kolmogorov)

Interesse filosofico della probabilità

La moderna immagine scientifica del mondo ha a che fare

sempre di più con l’incertezza, e la probabilità rappresenta

uno strumento fondamentale per ‘modellizzare’ l’incertezza.

Molte singole scienze dipendono in modo cruciale dalla

probabilità per le loro stesse formulazione e applicazione

(fisica, chimica, biologia, meteorologia, economia, …).

La probabilità potrebbe dare qualche idea su come affrontare

il problema dell’induzione e degli argomenti induttivi in

generale.

Laplace e la formulazione “classica”

della probabilità (1812):

Se n è il numero di eventi possibili e m il numero di eventi

‘favorevoli’ a un certo risultato R, si pone la probabilità p(R)

pari al rapporto

Eventi ‘favorevoli’

Eventi possibili

Esempio canonico con i dadi:

Probabilità (“uscita del 3”) = 1/6

perché

1

= numero di eventi favorevoli all’uscita del 3

6

= numero di eventi possibili (le 6 facce del dado)

Sfondo deterministico della nozione laplaciana

di probabilità

“Dobbiamo dunque considerare lo stato presente dell'universo

come effetto del suo stato anteriore e come causa del suo stato

futuro. Un'intelligenza che, per un dato istante, conoscesse tutte

le forze da cui è animata la natura e la collocazione rispettiva degli

esseri che la compongono, e fosse abbastanza profonda da

sottoporre questi dati ad analisi (matematica), abbraccerebbe

nella stessa formula i movimenti dei corpi più grandi dell'universo

e dell'atomo più leggero: nulla sarebbe incerto per essa e

l’avvenire come il passato sarebbe presente ai suoi occhi”.

L’uso della probabilità si giustifica sulla base dell’ignoranza

umana di tutte le forze in gioco

Prima implicazione importante:

La teoria laplaciana si fonda su un’interpretazione epistemica

della probabilità, nella quale la probabilità ha a che fare

essenzialmente con la conoscenza (o la credenza) di soggetti

umani razionali.

La formulazione laplaciana richiede però condizioni molto

forti:

1. individuazione di tutti i “casi possibili”;

2. possibilità di individuare i casi “favorevoli” all’evento di

cui si valuta la probabilità;

3. assunzione che tutti i casi possibili sono

“ugualmente” possibili (equipossibilità).

Ma 1 & 2 potrebbero non essere realizzabili, mentre

l’assunzione 3 è a rischio di circolarità: “possibile” significa

infatti “probabile”, e allo stesso tempo la probabilità è

definita nei termini del possibile.

Nel tentativo di superare i limiti della formulazione “classica”

vengono proposte 3 diverse interpretazioni:

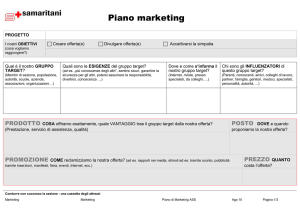

INTERPRETAZIONE FREQUENTISTA (von Mises)

INTERPRETAZIONE LOGICA (Keynes, Carnap)

INTERPRETAZIONE SOGGETTIVA (De Finetti)

IMPORTANTE!

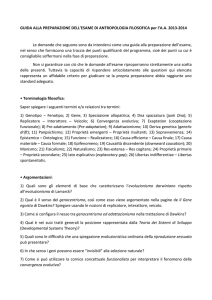

Int. frequentista

Struttura formale

della probabilità

Int. logica

(Kolmogorov)

Int. soggettiva

.......

Uno spazio di probabilità (A.N. Kolmogorov 1933) è

una tripla

, B, p

dove:

1. è un insieme;

2. B è un’algebra di Boole di sottoinsiemi di ;

3. p è una funzione p: B [0,1] tale che:

3.1 p() = 1

3.2

se R,S sono elementi di B e RS = ,

allora p(RS) = p(R) + p(S).

Le 3 interpretazioni riguardano l’idea filosofica di

probabilità: esse rappresentano 3 diversi modi di

‘concepire’ la probabilità, ma tutte e 3 devono

rispettare le condizioni matematiche del calcolo delle

probabilità.

Nonostante le notevoli differenze di interpretazione

concettuale, esiste un’identica struttura formale per

una teoria della probabilità (realizzata dagli assiomi

di Kolmogorov).

Dunque le proprietà matematiche della probabilità

non ci dicono da sole quale interpretazione della

probabilità dovremmo privilegiare.

La probabilità è un esempio di quei problemi

filosofici che possono avere una formulazione

matematica ma che non possono essere risolti

soltanto con la matematica.

INTERPRETAZIONE FREQUENTISTA

La probabilità di un evento si identifica con la sua

frequenza di occorrenza (in un insieme di eventi

‘simili’).

L’uso della probabilità è ristretto ai casi in cui si

dispone di un insieme di eventi ripetibili (non esiste

probabilità di un caso singolo!).

La probabilità deve essere trattata come una teoria

matematica che si occupa di fenomeni osservabili:

“Come oggetto della geometria è lo studio dei

fenomeni dello spazio, così la teoria della probabilità

ha a che fare con fenomeni di massa ed eventi

ripetuti.” (R. von Mises, 1928)

L’interpretazione frequentista non è soltanto

epistemica: la probabilità ha anche a che fare con

come è fatto il mondo.

INTERPRETAZIONE SOGGETTIVA

L’interpretazione soggettiva rifiuta invece che la

probabilità debba parlare di proprietà del mondo.

In questa interpretazione, la probabilità di un evento

si identifica con il grado di fiducia che i singoli

soggetti assegnano al verificarsi di quell’evento.

INTERPRETAZIONE LOGICA

Secondo i logicisti, la probabilità di un evento si

identifica con il grado con cui l’evidenza disponibile

su quell’evento giustifica l’effettiva realizzazione

dell’evento. Questo grado è secondo i logicisti un

fatto oggettivo.

L’interpretazione logica rifiuta dunque la tesi

soggettiva che non esistano fatti probabilistici

oggettivi.

Esempio:

“la probabilità di vita su Marte è x”

Soggettivisti: x rappresenta il grado di fiducia che i

soggetti attribuiscono all’effettiva presenza di vita su

Marte.

Logicisti: x rappresenta il grado di ‘sostegno’ che

l’evidenza osservativa a disposizione può assegnare

all’effettiva presenza di vita su Marte. Questo

‘sostegno’ non è un fatto puramente soggettivo, ma

ha una sua oggettività razionale.

Applicazione al problema dell’induzione:

inferenza probabilistica

Premessa: “Tutti gli oggetti osservati

soddisfano la legge X”

Conclusione: “Tutti gli oggetti

soddisfano la legge X”

La verità della premessa rende la verità della

conclusione ‘altamente probabile’.

In realtà, nessuna interpretazione della probabilità è

davvero adatta!

Interpretazione frequentista: la frazione di casi

osservati potrebbe essere troppo bassa.

Interpretazione soggettiva: la probabilità della

conclusione è solo il grado di credenza di un soggetto

individuale.

Interpretazione logica: sotto l’ipotesi che esistano

fatti

probabilistici

oggettivi,

la

relazione

probabilistica tra la premessa e la conclusione

potrebbe essere uno di questi casi.

Tuttavia l’interpretazione logica ha molti difetti

tecnici di per sé, che la rendono problematica.

[Ian Hacking, Introduzione alla probabilità e alla

logica induttiva, Saggiatore 2005]