Corso di Sistemi di telecomunicazione

A.A. 2009/2010

TEORIA DELLA STIMA

Ref. ‘Detection, Estimation and Modulation

Theory, Part I’, H.L.Van Trees, ed. John

Wiley&Sons, Inc. 1968

Prof. C. Regazzoni

1

CONTENUTI

• Introduzione

• Parametri casuali: stima Bayesiana

• Stima di parametri non casuali

• Stima a massima verosimiglianza

• Disuguaglianza di Cramer-Rao

• Limite inferiore del minimo MSE

• Stima di parametri multipli

• Ipotesi composta

2

INTRODUZIONE

• Nella teoria della decisione viene considerato un

problema in cui si presenta una tra diverse ipotesi;

• Come risultato di una particolare ipotesi, veniva

osservato una variabile casuale vettoriale r.

• Basandoci sulla nostra osservazione, occorreva

cercare di scegliere l’ipotesi vera.

• Adesso consideriamo il problema della stima di

parametri

3

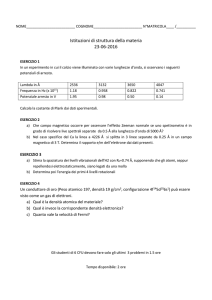

INTRODUZIONE

Il problema della stima: esempio

• Vogliamo misurare una tensione a ad un certo istante

di tempo;

• da considerazioni fisiche sappiamo che la tensione è

tra -V e +V volt;

• La misurazione della tensione è corrotta da rumore

che può essere modellato come variabile casuale n

indipendente con distribuzione Gaussiana a media

nulla;

• La variabile osservata è:

r an

• La densità di probabilità che governa il processo

dell’osservazione è, in questo caso:

( R A )2

pr|a ( R | A ) pn ( R A )

exp

2 n

2 n2

1

Il problema della teoria della stima consiste

nell’osservare r e stimare a

4

INTRODUZIONE

Il problema della stima

• L’esempio precedente mostra le caratteristiche

principali del problema della stima;

• Un modello per il problema generico della stima è

mostrato nella seguente figura:

5

INTRODUZIONE

Il problema della stima

• Il modello ha 4 componenti:

1. Spazio dei parametri

L’uscita della sorgente è un parametro (o variabile).

Noi vediamo questa uscita come un punto nello

spazio dei parametri. Nel caso di un singolo

parametro, questo corrisponde ad un segmento nella

retta:

A

2. Mappaggio probabilistico dallo spazio dei

parametri allo spazio delle osservazioni

Questa componente è la legge probabilistica che

governa l’effetto di a sull’osservazione.(es rumore)

3. Spazio delle osservazioni

L’osservazione è un punto denotato dal vettore R.

4. Regola di stima

Dopo avere osservato R, vogliamo stimare il valore

del parametro a. Denotiamo la stima con:

â( R )

Studieremo diverse regole di stima e la loro

implementazione

6

PARAMETRI CASUALI: STIMA DI BAYES

• Nel problema del decisore di Bayes alle quantità che

dobbiamo specificare sono assegnati dei costi Cij e

delle probabilità a priori Pi;

• La matrice dei costi assegna un costo ad ogni possibile

azione da intraprendere, data ogni possibile ipotesi vera

• Nel problema della stima a e

â( R )sono variabili

continue;

occorre assegnare un costo a tutte le possibili coppie

[a, â( R ]) nell’intervallo di interesse.

• Il costo è una funzione a due variabili C(a, â);

• In molti casi di interesse è realistico assumere che il

costo dipenda solo dall’errore di stima, che è:

a ( R ) â( R ) a

• La funzione di costo C(a) è funzione di un’unica

variabile.

7

PARAMETRI CASUALI: STIMA DI BAYES

• Nella seguente figura sono mostrati alcuni esempi di

funzioni di costo:

C( a ) a2

Un costo elevato è assegnato

se l’errore è elevato.

C( a ) | a |

0

|

a

|

2

C( a )

1 | a |

2

8

PARAMETRI CASUALI: STIMA DI BAYES

• La funzione di costo viene scelta tenendo conto di due

fattori:

1. Vorremmo che la funzione di costo sia coerente

con la natura del problema (richieste dell’utente);

2. Vorremmo che la funzione di costo sia tale per cui il

problema della stima risulti analiticamente

trattabile (lo scopo è trovare una stima che

minimizzi il valore aspettato del costo).

• In pratica, le funzioni di costo rappresentano un

compromesso tra i due obiettivi sopra citati.

• Analogamente alle probabilità a priori del problema

della decisione, nel problema della stima abbiamo una

densità di probabilità a priori pa(A).

• Assumeremo che pa(A) sia nota; nel caso che non fosse

nota, può essere adottata una procedura analoga al

test minimax.

9

PARAMETRI CASUALI: STIMA DI BAYES

• Una volta specificate la funzione di costo e la

probabilità a priori, possima screivere un’espressione

per la funzione di rischio:

R EC [ a ,â( R )] dA C [ A â( R )] pa ,r ( A,R )dR

• La media è eseguita sulla variabile a e sulle variabili

osservate r.

• La stima di Bayes è la stima che minimizza il rischio.

• Consideriamo il caso in cui la funzione di costo è

rappresentato dall’ errore quadratico. Il rischio

in questo caso è:

R ms dA [ A â( R )] 2 pa ,r ( A,R )dR

• La densità congiunta può essere riscritta come segue:

pa,r ( A, R) pr (R) pa|r ( A | R)

R ms pr ( R )dR [ A â( R )] 2 pa|r ( A | R )dA

10

PARAMETRI CASUALI: STIMA DI BAYES

• L’integrale più interno della funzione di rischio a minimo

MSE e Pr(R) sono non negativi

possiamo minimizzare la funzione di rischio

minimizzando l’integrale più interno.

• Denotiamo la stima a minimo MSE con a ( R )

ˆms

• Per trovare la stima differenziamo l’integrale interno

rispetto ad aˆ ( Re) poniamo il risultato uguale a 0:

d

2

[ A aˆ (R )] pa|r ( A | R )dA

daˆ

2 Apa|r ( A | R )dA 2aˆ (R ) pa|r ( A | R ) dA

• Ponendo il risultato uguale a zero ed osservando che il

secondo integrale è uguale a 1, abbiamo:

â ms ( R ) Apa|r ( A | R ) dA

• Questo minimo è unico, poiché la derivata seconda

della funzione da minimizzare è uguale a due;

• La stima è uguale alla media della densità a posteriori.

11

PARAMETRI CASUALI: STIMA DI BAYES

• Ricaviamo ora la stima di Bayes per il criterio del

valore assoluto dell’errore:

R abs pr ( R )dR [| A â( R ) |] pa|r ( A | R )dA

• Per minimizzare l’integrale più interno scriviamo:

I( R )

â( R )

[ â( R ) A( R )] pa|r ( A | R )dA

[ A( R ) â( R )] pa|r ( A | R )dA

â( R )

• Differenziando rispetto a â(R) e ponendo il risultato

uguale a zero, abbiamo:

âabs ( R )

pa|r ( A | R )dA

pa|r ( A | R )dA

âabs ( R )

• Questa è la definizione del mediano della densità a

posteriori.

12

PARAMETRI CASUALI: STIMA DI BAYES

• Ricaviamo ora la stima di Bayes nel caso di costo

uniforme:

âunf ( R ) / 2

R unf pr ( R )dR 1

pa|r ( A | R )dA

â ( R ) / 2

unf

• Per minimizzare questa equazione, massimizziamo

l’integrale più interno.

• Di particolare interesse è il caso in cui è

arbitrariamente piccolo, ma non zero.

• Un andamento tipico di densità di probabilità a

posteriori è mostrato nella seguente figura:

13

PARAMETRI CASUALI: STIMA DI BAYES

• Si vede che per piccolo, la migliore stima è il valore

di A per cui la densità di probabilità a posteriori ha il

suo massimo;

• Denotiamo la stima per questo caso particolare con

âmap(R), la stima massima a posteriori.

• Per trovare la stima massima a posteriori, dobbiamo

conoscere dove si trova il massimo della probabilità

condizionale. Poiché il logaritmo è una funzione

monotona, possiamo cercare il massimo di ln[pa|r(A|R)]

• Se il massimo cade nell’intervallo di valori di A

permesso e ln[pa|r(A|R)] ha una derivata prima continua,

allora una condizione necessaria, ma non sufficiente, per

un massimo può essere ottenuta differenziando

ln[pa|r(A|R)] rispetto ad A e ponendo il risultato uguale

a zero:

ln[ pa|r ( A | R )

A

0

(1)

A â( R )

14

PARAMETRI CASUALI: STIMA DI BAYES

• L’equazione (1) è l’equazione MAP;

• Dobbiamo cercare di verificare che la soluzione

ottenuta sia effettivamente il massimo assoluto.

• Possiamo riscrivere l’espressione di pa|r(A|R) per

cercare di separare la variabile osservata R dalla

conoscenza a priori:

pa|r ( A | R )

pr|a ( R | A ) pa ( A )

pr ( R )

• Facendo il logaritmo:

ln[ pa|r ( A | R )] ln[ pr|a ( R | A )] ln[ pa ( A )] ln[ pr ( R )]

• Per la stima MAP siamo interessati solo nel trovare il

valore di A in cui il termine a sinistra è massimo;

• Siccome l’ultimo termine a destra non è funzione di A,

possiamo considerare solo la funzione:

l( A ) ln[ pr|a ( R | A )] ln[ pa ( A )]

(2)

15

PARAMETRI CASUALI: STIMA DI BAYES

• Il primo termine dell’equazione (2) descrive la

dipendenza di R da A e il secondo termine descrive

la conoscenza a priori.

• L’equazione MAP può essere riscritta come:

ln[ pr|a (R | A)

ln[ pa ( A)

l ( A)

0

A A aˆ (R )

A

A A aˆ (R )

A aˆ (R )

16

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 1

• Consideriamo:

ri a ni

i 1,2,..... , N

• Assumiamo che la variabile a sia Gaussiana, N(0,a), e

che i campioni ni siano variabili Gaussiane indipendenti

N(0,n). Quindi:

( R A )2

1

pr|a ( R | A )

exp i

2 n2

i 1 2 n

N

A2

1

pa ( A )

exp

2 a 2 a2

• Per trovare âms(R) abbiamo bisogno di conoscere

pa|r(A|R).

• Una possibilità consiste nel trovare pr(R) e sostituirla

nella regola di Bayes sulla probabilità condizionale per

ricavare pr|a(R|A), ma questa procedura è piuttosto

noiosa.

17

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 1

• E’ più facile osservare che pa|r(A|R) è la densità di

probabilità di a per ogni R dato, quindi:

pa|r ( A | R )dA 1

• Pr(R) è solo una costante di normalizzazione.

N 1

1 N

2

(

R

A

)

i

2

2 n 2 a 1 i 1

A

i

1

pa|r ( A | R )

exp

2

2

2

pr ( R )

n

a

• Completando il quadrato all’esponente e considerando

come una costante i termini dipendenti solo da Ri2

si ottiene:

2

2

N

1

1

a

pa|r ( A | R ) k ( R ) exp

A

Ri

2 2p a2 n2 / N N i 1

dove:

1

N

2

p

2 2

a

n

1

a2 n2

N a2 n2

è la varianza a posteriori.

18

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 1

• Osserviamo che pa|r(A|R) è una densità Gaussiana.

• La stima âms(R) è la seguente media condizionale:

1 N

Ri

âms ( R )

2

2

a n / N N i 1

a2

• Siccome la varianza a posteriori non è funzione di R,

il rischio quadratico medio è uguale alla varianza a

posteriori (v. espressione del rischio).

OSSERVAZIONI:

1. I valori Ri entrano nella densità a posteriori solo

attraverso la loro somma, cioè:

N

l( R ) Ri

i 1

è la statistica sufficiente. Il concetto di statistica

sufficiente è lo stesso introdotto nella teoria della

decisione.

19

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 1

2. La regola di stima usa l’informazione disponibile in

maniera logica ed intuitiva:

- Se a2 << n2/N , la conoscenza a priori è migliore dei

dati osservati è la stima è molto vicina alla media a

priori (in questo caso la media a priori è zero).

- Se a2 >> n2/N , la conoscenza a priori è di poca utilità

e la stima usa principalmente i dati ricevuti. Nel caso

limite âms è la media aritmetica degli Ri:

1 N

lim âms ( R ) Ri

N i 1

n2

N a2

0

20

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 1

La stima MAP per questo caso si ricava facilmente:

- Osservando l’espressione della pa|r(A|R), vediamo che

siccome la densità è Gaussiana, il massimo valore di

pa|r(A|R) si ha in corrispondenza della media

condizionale, cioè:

âmap ( R ) âms ( R )

- Siccome il valore mediano condizionale di una densità

Gaussiana corrisponde alla media condizionale,

abbiamo anche che:

âabs ( R ) âms ( R )

21

PARAMETRI CASUALI: STIMA DI BAYES

• Nell’esempio precedente si può quindi osservare che

tutte e tre le funzioni di costo considerate in

precedenza portano alla stessa stima.

• Questa invarianza rispetto alla scelta della funzione

di costo è una caratteristica importante perché

spesso, nella scelta della funzione di costo C(a), sono

considerati giudizi soggettivi.

• Alcune condizioni per cui vale questa proprietà di

invarianza sono contenute nelle due proprietà

seguenti:

22

PARAMETRI CASUALI: STIMA DI BAYES

PROPRIETA’ 1

• Assumiamo che la funzione di costo C(a) sia una

funzione simmetrica con convessità verso l’alto e che

la densità di probabilità a posteriori pa|r(A|R) sia

simmetrica rispetto alla sua media condizionale:

C( a ) C( a )

simmetria

C( bx1 ( 1 b )x2 ) bC ( x1 ) ( 1 b )C( x2 )

convessità

per ogni b nell’intervallo (0,1) e per ogni x1 e x2.

Funzione simmetrica

convessa

Funzione simmetrica

strettamente convessa

23

PARAMETRI CASUALI: STIMA DI BAYES

• Definendo:

z a âms a E [ a | R ]

la simmetria della densità a posteriori implica che:

pz|r ( Z | R ) pz|r ( Z | R )

• La stima â che minimizza qualsiasi funzione di questa

classe è identica a âms (che è la media condizionale).

DIM:

• Possiamo minimizzare il rischio condizionale.

Usando la definizione di z e la proprietà di simmetria

definiamo:

R B ( â | R ) C( â ams Z ) p z|r ( Z | R )dZ

C( â âms Z ) p z|r ( Z | R )dZ

C( âms â Z ) p z|r ( Z | R )dZ

C( âms â Z ) p z|r ( Z | R )dZ

24

PARAMETRI CASUALI: STIMA DI BAYES

• Usando la condizione di convessità e considerando

il secondo integrale dell’espressione precedente,

possiamo scrivere:

1

R B ( â | R ) E C [ Z ( âms â )] C [ Z ( âms â )]| R

2

1

1

E C [ ( Z ( âms â )) ( Z ( âms â ))] | R

2

2

E[C(Z) |R) ]

• Nell’espressione, l’uguaglianza può essere raggiunta

se âms = â. Questo completa la dimostrazione.

• Se la funzione di costo è strettamente convessa,

allora la stima â è unica ed uguale a âms.

• La funzione di costo uniforme non è convessa, quindi

si introduce la seconda proprietà.

25

PARAMETRI CASUALI: STIMA DI BAYES

PROPRIETA’ 2

• Assumiamo che la funzione di costo sia simmetrica,

non decrescente e che la densità a posteriori

pa|r(A|R) sia simmetrica (rispetto alla media

condizionale), unimodale e soddisfi la seguente

condizione:

lim C( x ) pa|r ( x | R ) 0

x

• La stima â che minimizza ogni funzione di costo

in questa classe è identica a âms.

• La dimostrazione di questa proprietà è simile alla

precedente.

26

PARAMETRI CASUALI: STIMA DI BAYES

• D’ora in poi prenderemo in considerazione solo

le stime a minimo valore quadratico medio e a

massima probabilità a posteriori.

• Le proprietà 1 e 2 assicurano che ogni volta che le

densità a posteriori soddisfano le assunzioni date

precedentemente, le stime che otteniamo saranno

ottime per una larga classe di funzioni di costo.

27

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 2

• Il parametro a appare nel segnale in modo non

lineare. Denotiamo questa dipendenza con s(A).

• Ogni osservazione ri consiste di s(A) più una

variabile aleatoria ni Gaussiana N(0, n).

• Le variabili ni sono statisticamente indipendenti tra

loro e rispetto al parametro a:

ri s( A ) ni

• Quindi:

N

[ Ri s( A )] 2

2

A

1

pa|r ( x | R ) k ( R ) exp i 1

2

2

2

n

a

28

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 2

• L’espressione precedente non può essere semplificata

ulteriormente senza specificare esplicitamente s(A).

• L’equazione MAP risulta essere:

a2 N

s( A )

[

R

s

(

A

)]

A

0

i

2

A

n i 1

Aâmap ( R )

• Per risolvere l’equazione in maniera esplicita, occorre

specificare s(A).

• Quando s(A) è una funzione non lineare di A, non è

possibile trovare una soluzione analitica.

29

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 3

• Un altro tipo di problema che frequentemente si

presenta è la stima di un parametro in una densità

di probabilità.

•Il numero di eventi in un esperimento obbedisce ad

una legge di Poisson con valore medio a:

An

Pr ( n eventi | a A )

exp( A )

n!

n 0,1,...

• Vogliamo osservare il numero di eventi e stimare il

parametro a della legge di Poisson.

• Assumiamo che a sia una variabile casuale con una

densità esponenziale:

exp( A )

pa ( A )

0

A0

altrimenti

• La probabilità a posteriori di a è:

Pa|n ( A | N )

Pr( n N | a A ) pa ( A )

Pr( n N )

30

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 3

• Quindi la densità a posteriori risulta essere:

pa |n ( A | N ) k ( N )[ A N exp( A( 1 ))],

A0

dove

( 1 )N 1

k( N )

N!

ha lo scopo di normalizzare la densità in modo che

il suo integrale sia unitario.

• La stima a minimo valore quadratico medio (MS)

è la media condizionale:

( 1 ) N 1 N 1

âms

exp[ A( 1 )] dA

A

N!

( 1 ) N 1

1

( N 1)

( N 1 )

N

2

1

(1 )

31

PARAMETRI CASUALI: STIMA DI BAYES

Esempio 3

• Per trovare âmap facciamo il logaritmo della densità

a posteriori:

ln pa |n ( A | N ) N ln A A( 1 ) ln k( N )

• Differenziando rispetto ad A, ponendo la derivata

uguale a zero e risolvendo, otteniamo:

N

âmap ( N )

1

• Osserviamo che âmap è diverso da âms(la pa|n(A|N)

non è simmetrica rispetto alla media).

32

PARAMETRI CASUALI: STIMA DI BAYES

SINTESI

• La stima a minimo errore quadratico medio è sempre

la media della densità a posteriori (media

condizionale);

• La stima massima a posteriori (MAP) è il valore di A

in corrispondenza del quale la densità a posteriori

ha il suo massimo;

• Per una vasta classe di funzioni di costo la stima

ottima è la media condizionale ogni volta che la

densità a posteriori è una funzione unimodale

simmetrica rispetto alla media condizionale.

33

STIMA DI PARAMETRI NON ALEATORI

• In molti casi non è realistico trattare i parametri

sconosciuti come variabili aleatorie;

• Vogliamo trovare criteri di stima adatti per la stima

di parametri non aleatori;

cerchiamo di adattare la procedura di Bayes a

questo caso, cercando di eliminare la media su

pa(A).

• Come esempio consideriamo la stima MMSE:

R ( A ) [ â( R ) A ] 2 pr|a ( R | A )dR

dove l’operazione di media è solo su R, poiché è

l’unica variabile aleatoria nel modello.

• Minimizzando la funzione di rischio, si ottiene:

âms ( R ) A

• Il risultato ottenuto è corretto, ma di nessun valore,

poiché A è la quantità sconosciuta che stiamo

cercando di stimare

questo approccio non è di alcun aiuto.

34

STIMA DI PARAMETRI NON ALEATORI

• Un metodo più utile per la stima di parametri non

aleatori consiste nell’esaminare altre possibili misure

di qualità delle procedure di stima e quindi vedere se

possiamo trovare stime che siano buone in termini di

queste misure.

• La prima misura di qualità da considerare è il valore

medio della stima:

E [ â( R )] â( R ) pr|a ( R | A )dR

• I possibili valori della media possono essere

raggruppati in tre classi:

1. Se E[â(R)] =A per tutti i valori di A, diciamo che la

stima è non polarizzata. Questo significa che il valore

medio della stima è uguale alla quantità che vogliamo

stimare.

2.Se E[â(R)] =A+B, dove B non è funzione di A, diciamo

che la stima ha polarizzazione nota. Possiamo ottenere

una stima non polarizzata sottraendo B da â(R).

3.Se E[â(R)] =A+B(A), diciamo che la stima ha una

polarizzazione non nota.

35

STIMA DI PARAMETRI NON ALEATORI

• Chiaramente anche una stima non polarizzata potrebbe

dare un cattivo risultato su una particolare

realizzazione.

• Un semplice esempio è dato dalla seguente figura:

• La densità di probabilità della stima è centrata in A,

ma la varianza di questa densità è così larga che è

molto probabile commettere errori grandi.

• Una seconda misura di qualità è la varianza dell’errore

di stima:

Var [ â( R ) A ] E [ â( R ) A ] 2 B 2 ( A )

• Questa fornisce una misura di quanto si può espandere

l’errore.

• In generale noi cercheremo di trovare stime non

polarizzate con piccola varianza.

36

STIMA A MASSIMA VEROSIMIGLIANZA

• Consideriamo il semplice problema riportato

nell’esempio 1:

r A n

1

pr|a ( R | A ) ( 2 n )1 exp ( R A )2

2

• Scegliamo come stima il valore di A che più

verosimilmente genera il valore ricevuto R.

• Nel semplice caso additivo vediamo che questo

equivale a scegliere il valore più probabile del rumore

(N=0) e sottraendola da R.

• Denotiamo il valore ottenuto usando questa procedura

come stima a massima verosimiglianza:

âml ( R ) R

• Nel caso generale denotiamo la funzione pr|a(R|A), vista

come funzione di A, come funzione di verosimiglianza

(likelihood).

• Frequentemente noi lavoriamo con il logaritmo,

ln[pa|r(A|R)], e denotiamo questa funzione come

loglikelihood.

37

STIMA A MASSIMA VEROSIMIGLIANZA

• La stima a massima verosimiglianza (ML) âml(R) è

quel valore di A per cui la funzione di verosimiglianza

è massima.

• Se il massimo è interno al rango di A e la ln[pr|a(R|A)],

ha una derivata prima continua, allora una condizione

necessaria su âml(R) è ottenuta differenziando

ln[pr|a(R|A)] rispetto ad A e ponendo il risultato uguale

a zero:

ln pr|a ( R | A )

A

0

A âml ( R )

• Questa è chiamata equazione di verosimiglianza.

•Se confrontiamo l’equazione MAP con l’equazione di

verosimiglianza vediamo che la stima ML corrisponde

matematicamente al caso limite di una stima MAP in

cui la conoscenza a priori tende a zero.

38

STIMA A MASSIMA VEROSIMIGLIANZA

• Per vedere se la stima ML è una buona stima,

dovremmo calcolarne la polarizzazione e la varianza.

• Spesso questi calcoli sono difficili da svolgere

anziché affrontare il problema direttamente,

procederemo nel seguente modo:

1. ricaveremo, per prima cosa, un limite inferiore

sulla varianza di ogni stima non polarizzata;

2.in secondo luogo, confronteremo la varianza di

âml(R) con questo limite inferiore

39

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

• Consideriamo la varianza di ogni stima â(R) di una

variabile A. Può essere dimostrato il seguente:

TEOREMA:

(a) Se â(R) è una qualunque stima non polarizzata di A,

allora:

ln p ( R | A ) 2

r|a

Var [ â( R ) A ] E

A

o equivalentemente:

1

1

2

ln pr|a (R | A)

(b) Var[aˆ (R) A] E

2

A

dove si assume che siano soddisfatte le seguenti

condizioni:

(c)

ln pr|a ( R | A )

A

e

2 ln pr|a ( R | A )

2 A

esistono e sono integrabili in senso assoluto.

• Quando la stima è tale per cui vale l’uguaglianza,

allora viene chiamata stima efficiente.

40

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

DIM:

• La dimostrazione è una semplice applicazione della

disuguaglianza di Schwartz.

• Siccome â(R) è una stima non polarizzata, allora:

E [ â( R ) A ] pr|a ( R | A )[ â( R ) A ] dR 0

• Differenziando rispetto ad A:

d

pr|a (R | A)[ aˆ (R ) A]dR

dA

pr|a (R | A)[ aˆ (R ) A]dR 0

A

dove la condizione (c) ci permette di portare la

differenziazione dentro l’integrale.

pr|a ( R | A )

pr|a ( R | A )dR

A

[ â( R ) A ] dR 0

41

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

• Il primo integrale è uguale a 1. Osserviamo che:

pr|a ( R | A )

A

ln pr|a ( R | A )

A

pr|a ( R | A )

• Sostituendo questa espressione nella precedente

abbiamo:

ln pr|a ( R | A )

A

ln pr|a ( R | A )

A

pr|a ( R | A )[ â( R ) A ] dR 1

pr|a ( R | A ) pr|a ( R | A )[ â( R ) A ] dR 1

• Usando la disuguaglianza di Schwartz:

ln p ( R | A ) 2

r|a

p

(

R

|

A

)

d

R

r|a

A

2

[ â( R ) A ] pr|a ( R | A )dR 1

42

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

• Nella disuguaglianza precedente, l’uguaglianza si

ottiene se:

ln pr|a ( R | A )

A

[ â( R ) A ] k ( A )

(3)

per tutti i valori di R e A.

• I due termini a sinistra nella disuguaglianza

precedente sono le medie dell’espressione (a):

-1

ln p ( R | A ) 2

r|a

E [ â( R ) A ] 2 E

A

(4)

• Per dimostrare la (b) osserviamo che:

pr|a ( R | A )dR 1

• Differenziando rispetto ad A, abbiamo:

pr|a ( R | A )

A

ln pr|a ( R | A )

dR

A

pr|a ( R | A )dR 0

43

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

• Differenziando di nuovo rispetto ad A, abbiamo:

2 ln pr|a ( R | A )

A

2

pr|a ( R | A )dR

ln pr|a ( R | A ) 2

A

pr|a ( R | A )dR 0

2

2 ln p ( R | A )

ln

p

(

R

|

A

)

r|a

r|a

E

E

2

A

A

• che insieme alla equazione (4) dà la condizione (b).

44

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

OSSERVAZIONI

1. Il risultato ottenuto mostra che ogni stima non

polarizzata deve avere una varianza più grande di un

certo valore;

2.Se l’uguaglianza (3) è soddisfatta, la stima âml(R)

sarà proprio uguale al limite; questo può essere

dimostrato combinando l’equazione (4) con l’equazione

di verosimiglianza:

0

ln pr|a ( R | A )

A

Aâml ( R )

( â( R ) A )k ( A ) Aâ ( R )

ml

• Il termine a destra è uguale a zero se:

â( R ) âml ( R )

oppure

k( âml ( R )) 0

• Siccome ci interessa una soluzione che dipende dai

dati, allora consideriamo la prima delle due condizioni

se una stima efficiente esiste, allora è âml(R) e può

essere ottenuta come unica soluzione alla equazione

di verosimiglianza.

45

DISUGUAGLIANZA DI CRAMER-RAO

Parametri non aleatori

3.Se una stima efficiente non esiste, non sappiamo

quanto buona sia âml(R); inoltre non sappiamo quanto la

varianza si avvicini al limite inferiore.

4.Allo scopo di utilizzare il limite, dobbiamo verificare

che la stima che stiamo considerando sia non

polarizzata.

Vediamo ora alcuni esempi dell’applicazione della

disuguaglianza di Cramer-Rao, considerando la stima

di parametri non aleatori.

46

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 2

• Riprendiamo l’esempio 1:

ri A ni

i 1,2, ..... , N

• Abbiamo che:

ln pr|a (R | A) N 1 N

Ri A

2

A

n N i 1

(5)

ponendo la derivata uguale a zero, otteniamo:

1 N

âml ( R ) Ri

N i 1

• Per ricavare la polarizzazione, eseguiamo l’operazione

di media:

1 N

1 N

E [ âml ( R )] E( Ri ) A A

N i 1

N i 1

la stima âml(R) è non polarizzata.

47

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 2

• Siccome l’espressione (5) ha la forma richiesta dalla

(3), possiamo affermare che âml(R) è una stima

efficiente.

• Per valutare la varianza differenziamo l’equazione (5):

2 ln pr|a (R | A)

A2

N

n2

• Usando la condizione (b) della disuguaglianza di

Cramer-Rao e il risultato di efficienza appena

ottenuto, abbiamo:

Var [ âml ( R ) A ]

n2

N

48

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 3

• Riprendiamo l’esempio 3. In questo caso abbiamo che:

ln Pr( n N | A )

( N ln A A ln N ! )

A

A

N

1

1 ( N A )

(6)

A

A

• La stima ML è:

âml ( R ) N

• La stima è chiaramente non polarizzata ed efficiente.

49

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 4

• Per valutare la varianza, differenziamo l’equazione (6):

2 ln Pr( n N | A )

A2

N

A2

• Quindi:

A2

A2

Var [ âml ( N ) A ]

A

E( N ) A

• In entrambi gli esempi 1 e 3, osserviamo che la stima

potrebbe essere ricavata con la stima MAP (ponendo

a nell’equazione MAP, ricordando che âms= âmap e

ponendo 0 nel risultato ottenuto precedentemente

nell’esempio 4.

50

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 2

• Riprendiamo ora l’esempio 2. In questo caso abbiamo:

(togliendo il contributo della pa(A)):

ln pr|a ( R | A ) 1 N

s( A )

(7)

[

R

s

(

A

)]

i

2

A

A

n i 1

• In generale, il termine a destra non può essere scritto

nella forma richiesta dall’equazione (3), e quindi una

stima non polarizzata ed efficiente non esiste.

• L’equazione di verosimiglianza è:

s( A ) 1 1 N

0

Ri s( A )

2

Aâml ( R )

A n N i 1

• Se l’intervallo di valori assunto da s(A) contiene

( 1 / N )iN1 Ri allora una soluzione esiste:

1 N

s [ âml ( R )] Ri

N i 1

(8)

51

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 3

• Se la (8) è soddisfatta, allora:

1 N

1

âml ( R ) s Ri

N i 1

• Questa equazione assume che esista la funzione

inversa di s( . ).

• Se questa non esiste allora anche in

assenza di rumore non siamo in grado di determinare

A senza ambiguità.

• Quando progettiamo un sistema, dobbiamo sempre

scegliere una funzione s( . ) che ci permetta di trovare

A senza ambiguità in assenza di rumore.

• Se l’intervallo di valori assunto da s(A) non contiene

( 1 / N )iN1 Riallora il massimo si trova in uno dei punti

estremi dell’intervallo.

52

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 3

• Vediamo che la stima a massima verosimiglianza

commuta su operazioni non lineari (questo non è vero

per le stime MS o MAP).

• Se la stima non è polarizzata, valutiamo il limite sulla

varianza differenziando la (7):

2 ln pr|a ( R | A )

A2

1 N

2 s( A ) N s( A ) 2

[ Ri s( A )]

2

2

n i 1

A

n2 A

• Osservando che:

E [ ri s( A )] E( ni ) 0

otteniamo il seguente limite per ogni stima non

polarizzata:

Var [ â( R ) A ]

n2

N [ s( A ) / A ] 2

53

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 3

• Vediamo che il limite è esattamente lo stesso ricavato

2

per l’esempio 2, a meno del fattore [ s( A ) / A ]

• La ragione intuitiva per cui abbiamo questo fattore

può essere ottenuta analizzando la tipica funzione

mostrata nella seguente figura:

• Definiamo:

Y s( A )

ri Y ni

54

DISUGUAGLIANZA DI CRAMER-RAO

Esempio 3

• La varianza nella stima di Y è proprio 2/N.

• Se y, l’errore nella stima di Y, è abbastanza piccolo,

così che la pendenza è costante, allora:

Y

A

s( A )

A Aâ( R )

e

Var( a )

Var( y )

[ s( A ) / A ]

2

n2

N [ s( A ) / A ] 2

• Osserviamo che se y è elevato, non ci sarà più una

semplice relazione lineare tra y e a; questo ci dice

quando ci possiamo aspettare che il limite di

Cramer-Rao fornisca una risposta accurata nel caso in

cui il parametro da stimare sia presente nel problema

con una legge non lineare.

• Precisamente, quando l’errore di stima è piccolo

relativamente a A 2 s( A ) / A

, 2dovremmo aspettarci

che la vera varianza sia vicina al limite dato dalla

disuguaglianza di Cramer-Rao.

55

STIMA ML:

proprietà

• Possono essere dimostrate le seguenti proprietà:

1. La soluzione dell’equazione di verosimiglianza converge

in probabilità al valore corretto di A per N che tende

all’infinito.(N numero di osservazioni indipendenti)

Ogni stima con questa proprietà è chiamata

consistente, quindi la stima ML è consistente.

2.La stima ML è asintoticamente efficiente, cioè:

lim

Var [ âml ( R ) A ]

N

2

E ln pr|a ( R | A )

2

A

1

1

3.La stima ML è asintoticamente Gaussiana, N(A, a).

• Queste proprietà riguardano il comportamento della

stima ML con un elevato numero di osservazioni; esse

forniscono una motivazione per l’utilizzo della stima

ML anche quando una stima efficiente non esiste.

56

Limite inferiore sul minimo MSE

nella stima di parametri casuali

• Dimostriamo il seguente teorema:

Siano a una variabile aleatoria e r il vettore di

osservazioni. Il valore MSE di ogni stima â(R) soddisfa

la disuguaglianza:

ln p (R , A) 2

r,a

E [aˆ ( R ) a ]2 E

A

r , a

2 ln pr , a (R , A)

E

2

A

r,a

1

1

(9)

• Osserviamo che la densità di probabilità è una densità

congiunta e che la media è eseguita sia su a che su r.

• Si assume che esistano le funzioni indicate e valgano:

pr ,a ( R , A )

1.

è assolutamente integrabile rispetto

A

ad R e A.

2 p ( R, A )

r ,a

2.

è assolutamente integrabile rispetto

A2

ad R e A.

57

Limite inferiore sul minimo MSE

nella stima di parametri casuali

3. La media condizionale dell’errore, dato A, è:

B( A ) [ â( R ) A ] pr|a ( R | A )dR

(10)

• Assumiamo che:

lim B( A ) pa ( A ) 0

A

lim B( A ) pa ( A ) 0

A

DIM.

• Moltiplichiamo entrambi i membri della (10) per pa(A)

e quindi differenziamo rispetto ad A:

d

[ pa ( A )B( A )] pr ,a ( R , A )dR

dA

p ( R , A )

r ,a

A

[ â( R ) A ] dR

58

Limite inferiore sul minimo MSE

nella stima di parametri casuali

• Integriamo rispetto ad A:

[ pa ( A )B( A )]

p ( R , A )

r ,a

1

A

[ â( R ) A ] dAdR

• L’assunzione nella condizione (3) rende la parte

a sinistra uguale a zero.

• Seguendo lo stesso procedimento usato per la

dimostrazione della disuguaglianza di Cramer-Rao

si ottiene alla fine:

ln p ( R , A ) 2

r ,a

E [ â( R ) a ] 2 E

A

o, equivalentemente:

1

2 ln p ( R , A )

2 ln p ( A )

r ,a

2

a

E [ â( R ) a ] E

E

2

2

A

A

• L’uguaglianza vale solo se:

ln pr ,a ( R , A )

k [ â( R ) A ]

A

per ogni R e A.

59

1

Limite inferiore sul minimo MSE

nella stima di parametri casuali

• Differenziando nuovamente, si ottiene una condizione

equivalente:

2 ln pr ,a ( R , A )

(11)

k

A2

• Osservando che questa equazione può essere riscritta

in termini della densità a posteriori, abbiamo che:

2 ln pa|r ( A | R )

A

2

k

• Integrando quest’ultima equazione due volte e

applicando l’esponenziale al risultato, abbiamo:

pa|r ( A | R) exp( kA2 C1 A C2 )

(12)

per ogni R e A.

• L’equazione (11) afferma semplicemente che la densità

di probabilità a posteriori di a deve essere Gaussiana

per tutti gli R per fare in modo che esista una stima

efficiente.

60

Limite inferiore sul minimo MSE

nella stima di parametri casuali

• Possiamo osservare che se la (11) è soddisfatta allora

la stima MAP sarà efficiente.

• Siccome la stima a minimo MSE non può avere un errore

maggiore, questo ci dice che:

âms ( R ) âmap ( R )

ogni volta che esiste una stima efficiente.

• Quando una stima efficiente non esiste, generalmente

è computazionalmente più semplice risolvere la

equazione MAP piuttosto che trovare la media

condizionale.

• Quando non esiste una stima efficiente, non sappiamo,

usando sia âms(R), sia âmap(R), quanto il valore MSE si

avvicina al limite inferiore.

Si hanno propieta’ asintotiche “buone”.

(v. ML per parametri non random).

61

STIMA DI PARAMETRI MULTIPLI

• In molti problemi di interesse noi vogliamo stimare

più di un parametro.

• Il modello è mostrato nella seguente figura:

62

STIMA DI PARAMETRI MULTIPLI

• Se ci sono K parametri da stimare, allora li descriviamo

tramite un vettore di parametri a nello spazio

K-dimensionale.

• Gli altri elementi del modello rimangono invariati.

• Può essere considerato sia il caso in cui a sia un vettore

di parametri aleatori, sia il caso in cui a sia un vettore

di parametri reali (non aleatori).

• Anche nel caso vettoriale ci sono tre cose di interesse,

che sono:

1. Procedure di stima;

2. Misure di errore;

3. Limiti sulle prestazioni.

63

STIMA DI PARAMETRI MULTIPLI

Procedure di stima

• Nel caso di stima di Bayes minimizziamo il rischio per

un’arbitraria funzione di costo scalare C(a, â), ma per

i nostri scopi consideriamo solo funzioni di costo

dipendenti dall’errore:

a ( R ) ˆa( R ) a

• Per il criterio MSE la funzione di costo è:

C( a ( R )) aT ( R )a ( R )

• Si può dimostrare che la stima MS si riduce:

aˆ ms ( R ) Ai pa / r ( A | R )dA

i

Inoltre la stima MS commuta su operazioni

lineari,cioe’ se:

b Da

dove D è una matrice L x K, e vogliamo minimizzare

L 2

T

E [ b ( R )b ( R )] E b ( R )

i 1 i

il risultato sarà:

ˆ ms ( R ) Da

ˆ ms ( R )

b

64

STIMA DI PARAMETRI MULTIPLI

Procedure di stima

• Nel caso di stima MAP, abbiamo un insieme di K

equazioni simultanee:

ln pa|r ( A | R )

Ai

0

i 1,2 , ..... , K

ˆ map ( R )

A a

• Per la stima ML dobbiamo trovare il valore di A che

massimizza pr|a(R|A).

• Se il massimo è interno ed esiste la derivata parziale

di pr|a(R|A) rispetto ad Ai, allora una condizione

necessaria è ottenuta dalle seguenti equazioni di

verosimiglianza:

A [ln pr|a ( R | A )]

ˆ ml ( R )

A a

0

In entrambi i casi si deve verificare che si abbia un

massimo assoluto.

65

STIMA DI PARAMETRI MULTIPLI

Misure di errore

• Per parametri non casuali la prima misura di errore è la

polarizzazione:

B( A ) E [ a ( R )] E [ ˆa( R )] A

• Se ogni componente del vettore è nulla per ogni A,

allora la stima è polarizzata.

• La seconda misura di interesse analoga alla varianza

dell’errore è la matrice di covarianza:

E [( a a )( aT aT )]

Dove:

a E( a ) B( A )

Consideriamo il caso di limite sull’errore relativo ad una

singola componente Ai. Si possono definire altri limiti, ad

esempio nel caso Gaussiano utilizzando l’intera matrice

di covarianza.(v. Van Trees).

66

STIMA DI PARAMETRI MULTIPLI

Limiti sulle prestazioni

• Consideriamo una stima non polarizzata Ai. Allora:

2 Var[aˆi (R) Ai ] J*ii

i

dove J*ii sono gli elementi ii-esimi della matrice KxK J-1.

Gli elementi di J sono:

ln pr|a (R | A) ln pr|a (R | A)

J ij E

Ai

A j

2 ln pr|a (R | A)

-E

Ai A j

La matrice J e’ detta “matrice dell’informazione di Fisher”

(Fisher’s information matrix).

L’uguaglianza vale se e solo se:

K

ln p r|a ( R | A)

j 1

A j

aˆi ( R) Ai K ij ( A)

Ai , R

67

IPOTESI COMPOSITE

• Fino ad ora abbiamo considerato l’ipotesi semplice.

• Per capire cosa si intende per ipotesi composite

consideriamo il seguente

ESEMPIO 1

•Sotto l’ipotesi 0 la variabile osservata r è Gaussiana a

media nulla e varianza 2.

• Sotto l’ipotesi 1 la variabile osservata r è Gaussiana a

media m e varianza 2.

• Il valore di m può essere un qualsiasi valore nello

intervallo [M0,M1]. Quindi:

R2

1

H 0 : pr|H 0 ( R | H 0 )

exp

2 2

2

( R M )2

1

H1 : pr|H1 ( R | H1 )

exp

2

2 2

M 0 M M1

68

IPOTESI COMPOSITE

• Chiamiamo H1 ipotesi composita perché il valore del

parametro M, che caratterizza l’ipotesi, può assumere

un insieme di valori.

• Un modello per questo problema di decisione è

mostrato nella figura seguente:

69

IPOTESI COMPOSITE

(Esempio-continuazione)

• L’uscita della sorgente è un valore M che vediamo come

un punto nello spazio dei parametri .

• Quindi definiamo le ipotesi come un sottospazio di .

• In questo caso H0 corrisponde al punto M=0 e H1

corrisponde all’intervallo [M0, M1].

• Assumiamo che la densità di probabilità che governa

il processo di mapping dallo spazio dei parametri allo

spazio dell’osservazione pr|m(R|M) sia nota per tutti

i valori di M in .

• La componente finale è una regola di decisione che

divide lo spazio delle osservazioni in due parti che

corrispondono alle due possibili decisioni.

• È importante osservare che siamo interessati solo nel

prendere una decisione è che l’attuale valore di M non è

di nostro interesse.

• Per questa ragione il parametro M è spesso chiamato

‘parametro non voluto’.

Fine esempio

70

IPOTESI COMPOSITE

• Nel test di ipotesi composita l’uscita della sorgente è

quindi un punto nello spazio dei parametri denotato

dal vettore .

• Le ipotesi sono sottospazi di .

• La densità di probabilità che governa il mapping dallo

spazio dei parametri allo spazio delle osservazioni è

denotata da pr|(R| ) e si assume essere nota per tutti

i valori di in .

• La componente finale del modello è la regola di

decisione.

71

IPOTESI COMPOSITE

• Per completare la formulazione del problema, dobbiamo

caratterizzare il parametro .

• Come nel caso della stima dei parametri, può essere

una variabile aleatoria o non aleatoria.

• Consideriamo il caso in cui sia una variabile

(vettore) aleatoria con una densità di probabilità nota;

denotiamo la densità di sotto le due ipotesi con

p|H0(|H0) e p|H1(|H1)

il rapporto di verosimiglianza è:

( R )

pr|H1 ( R | H1 )

pr|H 0 ( R | H 0 )

pr| ( R | ) p |H1 ( | H1 )d

pr| ( R | ) p |H 0 ( | H 0 )d

• La densità di probabilità nota su ci permette di

ridurre questo problema ad un semplice problema di

hipothesis-testing integrando su .

72

IPOTESI COMPOSITE

Esempio 1

Riprendiamo l’esempio 1.

• Assumiamo che la densità di probabilità che governa m

su H1 sia:

M2

pm|H1 ( M | H1 )

exp

2 2

2 m

m

1

M

Quindi il rapporto di verosimiglianza diventa:

M2

( R M )2

1

1

dM

exp

exp

2 2

2 2 2 m

2

m

( R )

2

R

1

exp

2

2

2

73

IPOTESI COMPOSITE

Esempio 1

• Integrando ed applicando il logaritmo naturale ad

entrambi i membri dell’uguaglianza, otteniamo:

2

2

2

2

2 ( m ) ln 1 ln1 m

R2

2

2

2

m

H0

H1

• Questo risultato è identico a quello ottenuto nel

secondo esempio visto nella teoria della decisione;

ciò è dovuto alla particolare scelta della densità di

probabilità che governa m.

( ha lo stesso significato visto in quel caso: soglia

determinata dal criterio adottato).

74

IPOTESI COMPOSITE

• Come ci aspettavamo, il test usa solo l’ampiezza di R,

perché m ha una densità di probabilità simmetrica.

• Per il caso generale rappresentato dall’equazione di

verosimiglianza, il calcolo può risultare più complicato,

ma la procedura da seguire rimane la stessa.

• Quando è una variabile aleatoria con una densità

non nota, la migliore procedura di test non è

chiaramente specificata.

• Un approccio possibile consiste nel test minimax sulla

densità sconosciuta.

• Un approccio alternativo consiste nel considerare

diverse densità basandosi sulla parziale conoscenza a

priori di che si ha a disposizione.

• In molti casi la struttura del test non e’ molto sensibile

all’andamento della densità di probabilità.

75

IPOTESI COMPOSITE

• Il secondo caso di interesse è il caso in cui è una

variabile non aleatoria.

• Qui, come nel problema della stima di parametri non

aleatori, cercheremo una procedura ed analizzeremo

i risultati.

• Una prima osservazione è che, siccome non ha densità

di probabilità su cui eseguire una media, il test di

Bayes non è significativo.

consideriamo il test di Neyman-Pearson

• Cominciamo la discussione esaminando ciò che

chiamiamo ‘limite di misurazione perfetta’ sulle

prestazioni del test.

• Per chiarire l’idea, riprendiamo l’esempio 1.

76

IPOTESI COMPOSITE

Esempio 2

• In questo caso = M e si ha che:

( R M )2

1

H1 : pr|m ( R | M )

exp

2

2 2

M 0 M M1

R2

1

H 0 : pr|m ( R | M )

exp

2 2

2

dove M è un parametro non aleatorio sconosciuto.

• È chiaro che ogni test che progettiamo, non potrà

mai essere migliore di un ipotetico test in cui il

ricevitore prima misura perfettamente M (o,

alternativamente, conosce M perché gli viene detto)

e quindi progetta il test ad ottimo rapporto di

verosimiglianza.

• Quindi noi possiamo limitare le curve ROC per ogni

test con la curva ROC di questa misurazione fittizia.

77

IPOTESI COMPOSITE

Esempio 2

• In questo esempio consideriamo le seguenti curve dette

“Power Function”:

78

IPOTESI COMPOSITE

Esempio 2

• Questa curva è chiamata funzione di potenza. Essa

è semplicemente PD per tutti i valori di M (più

generalmente ) per diversi valori di PF.

• Siccome H0=H1 per M = 0, PD= PF.

• Le curve mostrate nella figura precedente

rappresentano un limite sulla bontà di un test.

• Ora volgiamo vedere quanto le prestazioni ottenute

dal nostro test si avvicinano a questo limite.

79

IPOTESI COMPOSITE

Esempio 2

• Le migliori prestazioni che possiamo ottenere

sarebbero raggiunte se la curva di test uguagliasse

il limite per tutti gli M appartenenti .

• Chiamiamo questo test UMP (il più uniformemente

potente). In altre parole, per una data PF un test UMP

ha una PD maggiore o uguale ad ogni altro test per

ogni M appartenente .

• Le condizioni affinchè esista un test UMP possono

essere viste nella seguente figura:

80

IPOTESI COMPOSITE

Esempio 2

• Costruiamo prima il limite di misurazione perfetta; poi

consideriamo altri possibili test e le relative

prestazioni;

• Il test A è un normale test a rapporto di

verosimiglianza (LRT) progettato secondo l’assunzione

che M = 1.

• La prima osservazione è che la potenza di questo test

è uguale al limite quando M = 1, che segue dal modo in

cui abbiamo costruito il limite.

• Per altri valori di M la potenza del test A può essere

uguale o meno al limite.

• Similarmente il test B è un LRT progettato sotto

l’assunzione M = 2 e il test C è un LRT progettato sotto

l’assunzione M = -1.

• In ogni caso la loro potenza uguaglia il limite nei punti

per i quali il test è stato progettato.

81

IPOTESI COMPOSITE

Esempio 2

• Nella figura le curve relative ai test LRT non sono

quantitativamente corrette, ma servono per fare

notare che la potenza uguaglia il limite per il valore

di M per cui e’ stato progettato il test. Cio’ non toglie

che possa eguagliarlo anche in altri punti.

• Le condizioni per un test UMP ora sono chiare:

dobbiamo essere in grado di progettare un test LRT

completo (compreso il valore di soglia) per ogni M

appartenente a senza conoscere M.

82

IPOTESI COMPOSITE

• In generale il limite può essere raggiunto per

ogni particolare semplicemente progettando un

normale LRT per quel particolare .

• Ogni UMP test deve essere non meno buono di altro

test per quel particolare . Ciò fornisce una condizione

necessaria e sufficiente per la sua esistenza.

PROPRIETA’:

Un test UMP esiste se e solo se il test LRT per ogni

appartenente a può essere completamente definito

(inclusa la soglia) senza la conoscenza di .

• Il ‘se’ della proprietà è ovvio. Il ‘solo se’ segue

direttamente dalla nostra discussione nel paragrafo

precedente: se esiste per cui non possiamo

trovare un LRT senza conoscere , dovremmo usare

un altro test perché non conosciamo . Però

questo test sarà inferiore per quel particolare al

test LRT e quindi non è uniformemente il più potente.

83

IPOTESI COMPOSITE

Esempio 2

• Ritorniamo all’esempio e usiamo il risultato ottenuto

dalla seguente figura:

• Sappiamo che il test di verosimiglianza è:

H1

R

H0

e

R2

1

dR

PF

exp

se M 0

2

2

2

L’apice + indica che M assume solo valori positivi.

84

IPOTESI COMPOSITE

Esempio 2

• Questo è mostrato nella seguente figura:

• Analogamente, se M è minore di zero:

H0

e

R

H1

R2

1

dR

PF

exp

2 2

2

se M 0

85

IPOTESI COMPOSITE

Esempio 2

• Rispetto all’esempio 1 traiamo le seguenti conclusioni:

1. Se M può assumere solo valori non negativi, allora

esiste il test UMP.

2.Se M può assumere solo valori non positivi, allora

esiste il test UMP.

3.Se M può assumere valori positivi e negativi, allora il

test UMP non esiste.

• Nella seguente figura è mostrata la funzione potenza

per i test LRT ottenuti sotto l’ipotesi che M sia positivo.

86

IPOTESI COMPOSITE

• Ogni volta che il test UMP esiste, lo usiamo e il test

lavora bene come se conoscessimo .

• Un problema più difficile si ha quando il test UMP non

esiste.

• Discuteremo ora alcuni test possibili per il caso in cui

non esiste il test UMP.

• Confiniamo la nostra discussione ad una possibile

procedura di test, il test di verosimiglianza

generalizzato.

• Se conosciamo il segno di M:

Il test UMP esiste perche’,per Neym.Pears., serve solo

PF e questa dipende solo da p(R|Ho). In questo caso

se p(R|Ho) e’ nota e non dipende da M (fissata pF, fisso

la soglia).

• Se non conosciamo il segno di M, anche fissato PF, non

sappiamo fissare la soglia (conosciamo |Rth|, ma non

il segno).

87

IPOTESI COMPOSITE

Test di verosimiglianza generalizzato

• Il limite di misurazione perfetta suggerisce che una

procedura logica consista nello stimare assumendo

che H1 sia vera, quindi nello stimare assumendo che

H0 sia vera ed nell’usare queste stime nel test di

verosimiglianza, come se fossero corrette.

• Se sono usate le stime a massima verosimiglianza

il risultato è chiamato LRT generalizzato.

• In particolare:

max pr|1 ( R | 1 ) H1

g( R ) 1

max pr| 0 ( R | 0 )

0

H0

dove 1 assume tutti i valori in H1 e 0 assume tutti i

valori in H0.

• In altre parole, facciamo una stima ML di 1 assumendo

che sia vera l’ipotesi H1, quindi valutiamo pr|1(R|1)

per 1 ˆ1e usiamo questo valore al numeratore. Una

procedura simile fornisce il valore per il denominatore.

88

IPOTESI COMPOSITE

Esempio 2

• Riprendiamo i dati dell’esempio 1, quindi = M.

• Anziché una, abbiamo N osservazioni indipendenti,

che denotiamo con il vettore R.

• Le densità di probabilità sono:

( R M )2

1

pr|m ,H1 ( R | M , H1 )

exp i

2 2

i 1 2

N

R2

1

pr|m ,H 0 ( R | M , H 0 )

exp i

2 2

i 1 2

N

• In questo esempio H1 è un’ipotesi composita, mentre

H0 è un’ipotesi semplice.

89

IPOTESI COMPOSITE

Esempio 2

• Dalla stima a massima verosimiglianza otteniamo:

N

(come visto prima)

Ri

quindi

Mˆ 1 i 1

N

2

N

R

(

1

/

N

)

R

i 1 j

1

i

exp

2

2

2

H1

i 1

g( R )

N 1

R2

H0

exp i

2 2

i 1 2

N

• Cancellando i termini comuni ed applicando il logaritmo:

2H

N 1

Ri ln

ln g ( R )

2

2 N i 1 H

0

• Il termine a sinistra è sempre maggiore o uguale a zero,

così può sempre essere scelto maggiore o uguale a uno.

un test equivalente è:

2H

1

1 NR 2

1 i 1

N 2 i 1 H 0

dove 1 è maggiore o uguale a zero. Equivalentemente:

1

| z |

1

N

H1

Ri

1

1

N 2 i 1

H0

90

IPOTESI COMPOSITE

Esempio 2

• La funzione di potenza di questo test si ricava

facilmente.

• La variabile z ha una varianza pari a 2; su H0 la sua

media è zero e su H1 la sua media è M N

• Le densità di probabilità sono riportate nella figura

seguente.

91

IPOTESI COMPOSITE

Esempio 2

• Si ha che:

1

1

Z2

Z2

1

dZ

dZ

PF

exp

exp

2 2

2 2

2

2

1

2erfc 1

e

1

( Z M N )2

1

dZ

PD ( M )

exp

2

2

2

( Z M N )2

1

dZ

exp

2

2

1 2

M N

M N

erfc 1

erfc 1

92

IPOTESI COMPOSITE

Esempio 2

• La funzione di potenza risultante è riportata nella

figura seguente:

• Nella figura è riportato il limite di misurazione

perfetta per fare un confronto. Come ci si aspetta,

la differenza si avvicina a zero quando

M N

93

IPOTESI COMPOSITE

Esempio 2

• Come esistono casi in cui la stima ML fornisce

risultati scarsi, ci sono casi in cui il test di

verosimiglianza generalizzato fornisce risultati

scadenti.

• In questi ultimi casi dobbiamo cercare altre procedure

test.

• Fortunatamente, nella maggior parte dei problemi

fisici di interesse sia il test UMP che il test di

verosimiglianza generalizzato danno risultati

soddisfacenti.

94