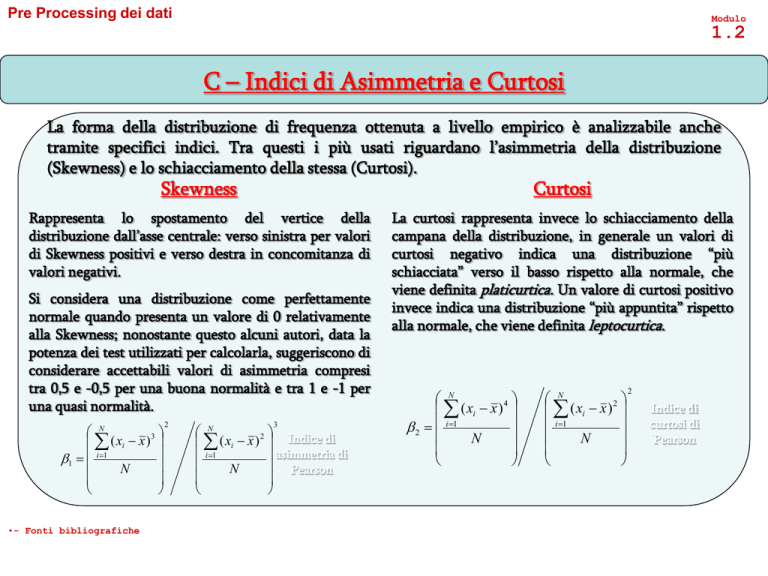

Pre Processing dei dati

Modulo

1.2

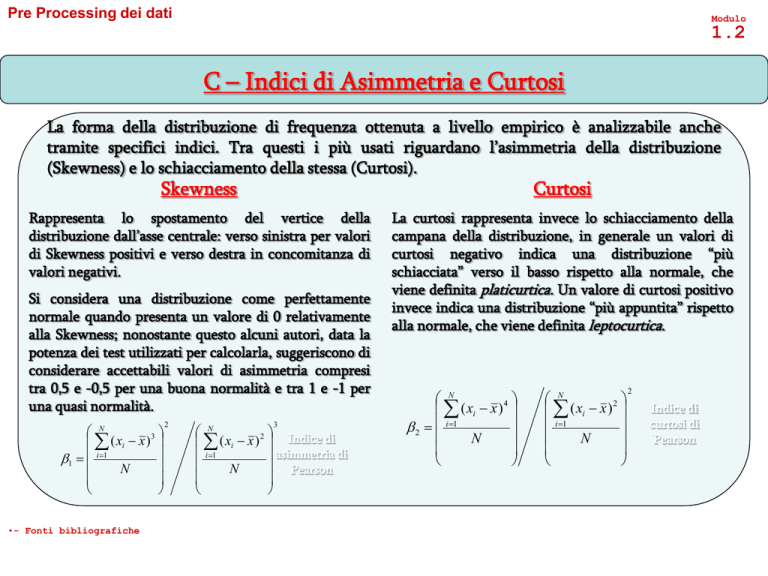

C – Indici di Asimmetria e Curtosi

La forma della distribuzione di frequenza ottenuta a livello empirico è analizzabile anche

tramite specifici indici. Tra questi i più usati riguardano l’asimmetria della distribuzione

(Skewness) e lo schiacciamento della stessa (Curtosi).

Skewness

Curtosi

Rappresenta lo spostamento del vertice della

distribuzione dall’asse centrale: verso sinistra per valori

di Skewness positivi e verso destra in concomitanza di

valori negativi.

La curtosi rappresenta invece lo schiacciamento della

campana della distribuzione, in generale un valori di

curtosi negativo indica una distribuzione “più

schiacciata” verso il basso rispetto alla normale, che

viene definita platicurtica. Un valore di curtosi positivo

invece indica una distribuzione “più appuntita” rispetto

alla normale, che viene definita leptocurtica.

Si considera una distribuzione come perfettamente

normale quando presenta un valore di 0 relativamente

alla Skewness; nonostante questo alcuni autori, data la

potenza dei test utilizzati per calcolarla, suggeriscono di

considerare accettabili valori di asimmetria compresi

tra 0,5 e -0,5 per una buona normalità e tra 1 e -1 per

una quasi normalità.

N

( xi x ) 3

1 i 1

N

•- Fonti bibliografiche

2

3

N

( xi x ) 2 Indice di

i 1

asimmetria di

Pearson

N

N

( xi x ) 4

2 i 1

N

N

( xi x ) 2

i 1

N

2

Indice di

curtosi di

Pearson

Pre Processing dei dati

Modulo

1.2

D – Indici complessivi di Normalità

Esistono infine alcuni test statistici che consentono di valutare se la

distribuzione è normale. Tra questi di particolare rilievo, anche perché

proposti nei più diffusi software statistici, sono il test di Kolmogorov Smirnov

ed il test di Shapiro-Wilk. Se il test statistico che viene condotto su tali indici

risulta significativo si deve rifiutare l’ipotesi nulla che la distribuzione in

oggetto sia normale.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Analisi della Distribuzione Univariata

I quattro step precedentemente illustrati sono implementati su SPSS e

raggiungibili attraverso la voce analyze della barra degli strumenti.

Esempio di calcolo degli indicatori

di normalità su alcune variabili

relative ai punteggi ottenuti alle

scale cliniche del MMPI-II,

da un campione di soggetti sani.

•- Fonti bibliografiche

Histogram

Normal Q-Q Plot of Scala L

30

3

2

20

1

Frequency

10

Expected Normal

0

-1

Std. Dev = 8,61

-2

Mean = 48,0

N = 78,00

0

,0

5

7 ,0

0

70

,

5

60

,

0

60

,

5

50

,

0

5 ,0

5

40

,

0

40

,

5

3

Dev from Normal

Scala L

-3

30

Scala L

40

50

Observed Value

80

Detrended Normal Q-Q Plot of Scala

L

1,0

42

55

70

,8

,6

60

,4

,2

50

0,0

40

-,2

-,4

30

40

50

60

70

80

30

N =

Observed Value

78

Scala L

60

70

80

Histogram

Normal Q-Q Plot of Scala F

20

3

2

1

0

Expected Normal

Frequency

10

-1

Std. Dev = 11,27

-2

Mean = 55,1

N = 78,00

0

,0

5

9 ,0

0

9 ,0

5

8 ,0

0

8 ,0

5

7 ,0

0

7 ,0

5

6 ,0

0

6 ,0

5

5 ,0

0

5 ,0

5

4 ,0

0

4

Dev from Normal

Scala F

-3

30

Scala F

40

50

60

Observed Value

110

Detrended Normal Q-Q Plot of Scala F

2,0

100

65

90

1,5

80

60

56

18

1,0

70

,5

60

50

0,0

40

-,5

30

40

50

60

70

80

90

100

30

N =

Observed Value

78

Scala F

70

80

90

100

Scala K

Histogram

Normal Q-Q Plot of Scala K

16

3

14

2

12

1

10

8

Frequency

4

Expected Normal

0

6

-1

Std. Dev = 9,53

2

Mean = 47,5

0

N = 78,00

-2

,0

0

7 ,0

5

60

,

0

60

,

5

50

,

0

50

,

5

4 ,0

0

40

,

5

30

,

0

3

-3

20

Scala K

30

40

50

Observed Value

80

Detrended Normal Q-Q Plot of Scala K

,3

70

,2

60

,1

50

0,0

40

-,1

30

-,2

20

30

40

50

60

70

80

20

N =

Observed Value

78

Scala K

60

70

80

Indici di Asimmetria, Curtosi e Normalità Univariata

Descriptive Statistics

Scala L

Scala F

Scala K

Valid N (lis twis e)

N

Statis tic

78

78

78

78

Skewness

Statis tic

Std. Error

,689

,272

1,295

,272

,162

,272

Kurtos is

Statis tic

Std. Error

,361

,538

2,093

,538

-,812

,538

Tests of Normality

a

Scala L

Scala F

Scala K

Kol mogorov-Smi rnov

Statis tic

df

Sig.

,119

78

,008

,116

78

,011

,070

78

,200*

Shapi ro-Wilk

Statis tic

df

,952

78

,902

78

,975

78

*. This i s a lower bound of the true s ignifi cance.

a. Lilli efors Signi ficance Correcti on

Sig.

,005

,000

,132

Pre Processing dei dati

Modulo

1.2

Outlier Univariati

I valori anomali, o Outlier, sono quei casi che in una presentano valori estremamente

elevati o estremamente bassi rispetto al resto della distribuzione.

Per individuare tali outlier univariati è possibile standardizzare i punteggi relativi ala

variabile in esame e calcolare una distribuzione delle frequenze, solitamente si

considerano come valori anomali quei punteggi che corrispondono ad un punteggio Z

maggiore di 3 in valore assoluto (Tabachnick e Fidell, 1989). In ogni caso è sempre

necessario considerare la distribuzione nella sua interezza, anche perchè dati infrequenti

non sempre sono anche “anomali”.

Per concludere, i valori anomali sono in grado di influenzare molti indicatori, come la

media, la deviazione standard, l’asimmetria e la curtosi. Essi sono in grado quindi di

influenzare anche gli indici di associazione tra variabili come avviene con il coefficiente

di correlazione di Pearson.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Outlier Univariati

In presenza di casi anomali univariati che influenzano i risultati delle analisi è

possibile utilizzare degli estimatori dei parametri che risultano meno influenzati

dalla presenza ditali valori. Ad esempio, la mediana e la moda spesso possono

risultare più affidabili della media. Sono inoltre disponibili alcune statistiche

che risultano “robuste” alla presenza di tali valori, come ad esempio la media

trimmed che viene calcolata eliminando il 5% dei casi con punteggi più elevati e

più bassi.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Outlier univariati

Nel nostro esempio risulta opportuno, almeno per le variabili relative alla scala L

ed alla scala F che non raggiungono i requisiti di normalità, esaminare in prima

istanza la presenza di outlier univariati. Sebbene esista la possibilità di

visualizzare i valori estremi, uno degli strumenti più funzionali a questo scopo

risulta il Box Plot fornito da SPSS

Visualizzazione dei valori anomali

Relativamente a tre variabili

Ottenute dalle scale di controllo

Dell’MMPI-II

•- Fonti bibliografiche

M-Estimators

Scala L

Scala F

Scala K

Huber's

a

M-Estimator

47,22

53,25

47,16

Tukey's

b

Biweight

46,91

52,55

47,15

Hampel's

c

M-Estimator

47,33

53,31

47,28

Andrews'

d

Wave

46,88

52,54

47,15

a. The weighting constant is 1,339.

b. The weighting constant is 4,685.

c. The weighting constants are 1,700, 3,400, and 8,500

d. The weighting constant is 1,340*pi.

Analisi dei Box Plot per l’individuazione degli Outlier

80

80

110

100

42

55

65

70

60

56

18

60

70

90

80

60

50

70

50

60

40

50

40

30

40

30

20

30

N=

78

N=

N=

78

Scala L

78

Scala K

Scala F

Des cr iptive Statistic s

Sca la L

Sca la F

Sca la K

Vali d N (lis twis e)

N

Sta tis tic

78

78

78

78

Ske wne ss

Sta tis tic

Std .

,6 89

1 ,29 5

,1 62

Erro r

,2 72

,2 72

,2 72

Kurtos is

Sta tis tic

Std .

,3 61

2 ,09 3

-,81 2

Erro r

,5 38

,5 38

,5 38

Tes ts of Nor mality

a

Sca la L

Sca la F

Sca la K

Kol mo g or ov-Smi rn ov

Sta tis tic

df

Sig .

,1 19

78

,0 08

,1 16

78

,0 11

,0 70

78

,2 00 *

Sta tis tic

,9 52

,9 02

,9 75

*. This i s a lo wer b ou nd o f the tr ue s ign ifi ca nce.

a . L illi efo rs Sig ni fican ce Cor re cti on

Sha pi ro -Wilk

df

78

78

78

Sig .

,0 05

,0 00

,1 32

Pre Processing dei dati

Modulo

1.2

Outlier univariati

Un primo passo per raggiungere una distribuzione adeguatamente normale nei

propri dati, requisito necessario alle successive analisi, risulta quello di

considerare i dati anomali come errori di misurazione e/o campionamento.

In questo senso, quando questi sono pochi, può essere opportuno eliminarli

dall’analisi e ricalcolare gli indici di normalità.

Eliminazione dei casi anomali

individuati e confronto degli

indici di normalità prima e

dopo tale resezione.

•- Fonti bibliografiche

Analisi dei Box Plot per l’individuazione degli Outlier

80

80

42

55

70

70

60

60

Outlier eliminati 2

50

50

40

40

30

30

N=

N=

78

72

Scala L

Scala L

110

80

100

65

70

90

60

56

18

80

60

Outlier eliminati 5

70

50

60

50

40

40

30

30

N =

78

N =

71

Scala F

Scala F

Descriptive Statistics

Scala L

Scala F

Scala K

Valid N (lis twis e)

N

Statis tic

78

78

78

78

Skewness

Statis tic

Std. Error

,689

,272

1,295

,272

,162

,272

Descriptive Statistics

Kurtos is

Statis tic

Std. Error

,361

,538

2,093

,538

-,812

,538

Scala L

Scala F

Scala K

Valid N (lis twis e)

N

Statis tic

71

71

71

71

Skewness

Statis tic

Std. Error

,337

,285

,404

,285

,150

,285

Kurtos is

Statis tic

Std. Error

-,382

,563

-,736

,563

-,749

,563

Pre Processing dei dati

Modulo

1.2

Trasformazioni sui dati (Normalizzazione)

Al fine di rendere normale la distribuzione di una variabile, oltre all’eliminazione

quando possibili dei valori anomali, sono state

- proposte diverse tecniche.

Alcune di esse agiscono senza alterare le proprietà metriche (es., il livello di

misurazione) delle variabili originali, altre invece portano a modificazioni più

consistenti di tali proprietà.

Le prime risultano più adeguate in condizioni di Non-normalità “Moderata” (Valori di

asimmetria e curtosi compresi tra |.5| e |1|.)

Le seconde sono spesso necessarie nei casi di forte violazione della normalità (Valori

di asimmetria e curtosi maggiori di |1|.)

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Trasformazioni sui dati (Normalizzazione)

L’asimmetria o semilimitazione laterale della distribuzione del carattere statistico

sotto esame può essere ridotta tramite opportune

trasformazioni operate direttamente

sui dati. Si distinguono generalmente quattro condizioni:

Asimmetria Positiva

Moderata

Asimmetria Negativa

Elevata

Moderata

Trasformazione

Logaritmica o Radice

Quadrata

Trasformazione in

Reciproco

X * Log10 ( X )

1

*

X

X

X* X

Trasformazione

Logaritmica o Radice

Quadrata

X * Log10 ( K X )

X* K X

Elevata

Trasformazione in

Reciproco

1

X

KX

*

X*= Nuova variabile

*: Nell’effettuare le trasformazioni in caso di asimmetria negativa è necessario utilizzare una

costante (k) di solito uguale a 1 + il valore più elevato presente nella distribuzione originale.

Pre Processing dei dati

Modulo

1.2

Trasformazioni sui dati

Trasformazione logaritmica sui dati grezzi di un carattere statistico distribuito in

maniera quesi-normale, presentando una non-normalità moderata ed una

semilimitazione a sinistra.

Esempio di trasformazione dei dati

Da esempio precedente per

Scale L e F

Riduzione di una asimmetria

moderata positiva

•- Fonti bibliografiche

Distribuzioni Grezze, con valori anomali e dati non trasformati

Histogram

Histogram

30

20

Asimmetria

positiva

Moderata

20

Asimmetria

positiva

Moderata

10

Std. Dev = 8,61

Mean = 48,0

N = 78,00

0

Frequency

10

Std. Dev = 11,27

Mean = 55,1

N = 78,00

0

,0

9 5 ,0

9 0 ,0

8 5 ,0

8 0 ,0

7 5 ,0

7 0 ,0

6 5 ,0

6 0 ,0

5 5 ,0

5 0 ,0

4 5 ,0

40

,0

7 5 ,0

7 0 ,0

6 5 ,0

6 0 ,0

5 5 ,0

5 0 ,0

4 5 ,0

4 0 ,0

35

Outliers

Scala L

Outliers

Scala F

Histogram

Histogram

20

16

14

12

10

10

8

Mean = ,223

N = 71,00

0

,213

,200

,238

,225

L_TRASF

,263

4

Std. Dev = ,07

2

Mean = 1,720

0

N = 71,00

0

85

1,825

1, 00

8

1,775

0

1 ,7 5

1,725

1, 00

7

1,675

0

1 ,6 5

1,625

1,600

1,

,188

Frequency

6

Std. Dev = ,02

,250

F_TRASF

Distribuzioni dopo eliminazione dei dati anomali e trasformazione

logaritmica del punteggio.

Pre Processing dei dati

Modulo

1.2

Analisi della “Linearità della relazione”

Molte analisi statistiche richiedono, oltre alla normalità della distribuzione del

carattere statistico sotto indagine, che le relazione tra i punteggi siano di tipo lineare.

-

Se la relazione tra due variabili X e Y è lineare, allora la variazione nei punteggi in Y

attesa in concomitantanza di una variazione nei punteggi di X è costante per tutti i

valori di X.

Spesso la non linearità della relazione tra due variabili e la non normalità delle

distribuzioni delle stesse sono fenomeni collegati.

Spesso i tentativi di “normalizzare” la distribuzione di un carattere statistico sotto

esame tendono a provocare una “linearizzazione” delle relazioni che il carattere ha

con le altre variabili.

La linearità può essere rilevata tramite il diagramma di dispersione (Scatterplot) che

rappresenta le distribuzioni congiunte delle due variabili.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Creazione ed analisi dello Scatterplot

Esempio di analisi della linearità

della relazione tra due variabili,

produzione dello Scatterplot

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

La distribuzione normale multivariata rappresenta una generalizzazione della normale

univariata quando il numero di variabili che vengono prese in considerazione è maggiore

di 1.

Considerando il caso di due variabili X e Y, se le distribuzioni dei valori di Y per ogni

valore dato di X sono di forma normale, e si verifica anche il contrario, allora la

distribuzione congiunta di X e Y viene definita normale bivariata.

La distribuzione normale bivariata risulta essere una condizione particolarmente

desiderabile almeno per due motivi:

A- Questa distribuzione ha la proprietà di rendere la regressione di Y su X lineare.

B- Essa determina che gli scarti quadratici delle Y per ciascuna X siano effettivamente

identici (Omoschedasticità).

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

Se abbiamo più di due variabili, l’universo determinato dalle loro distribuzioni congiunte

rappresenterà una situazione più complicata, e difficilmente rappresentabile a livello

grafico. Si parlerà in questo caso di Normalità Multivariata in riferimento alla assunzione

che riguarda l’insieme delle variabili che vengono considerate in analisi.

Se consideriamo un insieme di p variabili, la distribuzione multivariata delle p variabili è

normale se:

-Tutte le distribuzioni univariate sono normali,

-Le distribuzioni congiunte di tutte le coppie di variabili sono normali,

-Tutte le combinazioni lineari delle variabili sono normali.

La normalità multivariata è una proprietà particolarmente rilevante. Infatti se essa viene

rispettata le relazioni tra le variabili considerate sono sicuramente lineari, ed i modelli di

analisi preposti a valutare gli indici di associazione, di conseguenza, affidabili.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

Distanza di Mahalanobis

Si definisce innanzi tutto la distanza generalizzata o distanza di Mahalanobis (Di2) come

la distanza del vettore dei punteggi di un soggetto (Xi) dal centroide del campione (Xm),

ponderata per la covarianza tra le varibili.

(Xi Xm)

D

S

2

2

i

La distanza di Mahalanobis può essere utilizzata per diagnosticare la presenza di outlier,

o valori anomali, multivariati. Questi rappresentano combinazioni di punteggi delle

singole variabili che risultano particolarmente “strani”, appunto “anomali” rispetto al

resto dei valori delle variabili. Non si tratta quindi di casi che necessariamente

presentano valori estremi su una o più variabili.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

Q-Q Plot

Se la distribuzione delle variabili è normale multivariata e il numero dei casi meno il

numero delle variabili è maggiore di 25, allora i valori della distanza generalizzata

seguono la distribuzione del chi quadrato. Di fatto si può sfruttare questa proprietà per

costruire un test di normalità multivariata nel modo seguente:

A- Si ordinano i valori Di2 per ogni soggetto dal più basso al più alto.

B- Si calcola per ogni Di2 il corrispondente punteggio percentile nella distribuzione χ2.

C- Si costruisce il grafico dei due valori di punteggi Di2 e χ2 (Q-Q Plot), se la

distribuzione è normale multivariata le due serie di punteggi formano un grafico

che ha un andamento lineare.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

Coefficinte di Curtosi Multivariata di Mardia

Per esaminare l’ipotesi di normalità multivariata Mardia (1970) ha sviluppato dei

coefficienti di curtosi e di asimmetria multivariata. Se la distribuzione delle p variabili è

normale multivariata, e se il campione è sufficientemente ampio (almeno 50 soggetti*) il

coefficiente di curtosi multivariata di Mardia dovrebbe essere minore o uguale a p(p+2).

Tramite i valori della distanza di Mahalanobis è possibile calcolare questo coefficiente nel

modo seguente:

N

2 2

i

(D )

K

N

i 1

•- Seber, 1984

Pre Processing dei dati

Modulo

1.2

Normalità Multivariata

Calcolo delle distanze di Mahalanobis e produzione del Q-Q plot per il test di

normalità multivariata.

Calcolo del coefficiente di curtosi di Mardia.

Dopo aver in precedenza testato la

normalità delle distribuzioni delle

scala L, F e K, si testa l’ipotesi di

normalità

multivariata

della

distribuzione congiunta delle tre

variabili.

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Il Q-Q plot per la verifica della normalità bivariata

-

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Il Q-Q plot per la verifica della normalità bivariata

-

-

-

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Outliers Multivariati

-

Rif. Outliers multivariati

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Outliers Multivariati

-

-

-

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Multicollinearità

-

•- Fonti bibliografiche

Pre Processing dei dati

Modulo

1.2

Multicollinearità

-

-

-

•- Fonti bibliografiche