Analisi preliminari dei dati

1. Errori di immissione dei dati

• Gli errori di immissione pregiudicano

irrimediabilmente i risultati delle ricerche e

sono purtroppo molto frequenti. Verificare

sempre che i dati siano stati correttamente

immessi (Min.-Max, Range, Distribuzione di

frequenza, Media e DS).

2. Dati mancanti

• I dati mancanti in genere non vanno

eliminati dato che esistono semplici o

sofisticate procedure di sostituzione

3. Outliers

• Gli outliers univariati (valori estremi

presenti nella distribuzione) e multivariati

(anomali combinazioni dei punteggi delle

singole variabili) possono distorcere i

risultati. Nel caso di outliers univariati è

possibile ricorrere ad alcune statistiche più

robuste di quelle utilizzate normalmente

(ad esempio la più semplice è la media

trimmed che si calcola eliminando il 5%

dei casi dei casi più elevati e più bassi)

4. Livello di misura delle variabili

• Il livello di misura delle variabili deve

essere almeno degli intervalli equivalenti e

deve essere presente un numero

appropriato di categorie ordinabili (ad es.

Likert con 5 o più categorie).

5. Valutazione della normalità della

distribuzione univariata e multivariata

• Quando si hanno dei dati a disposizione per

prima cosa è opportuno verificare se la

distribuzione è normale perché se non lo è si

hanno delle distorsioni delle stime più o meno

gravi a seconda del grado di non normalità.

• In modo elementare una distribuzione è normale

quando:

• -Media = Mediana = Moda

• -Forma della distribuzione a campana

a. Per verificare se la distribuzione è

normale univariata

• -Istogramma (forma a campana)

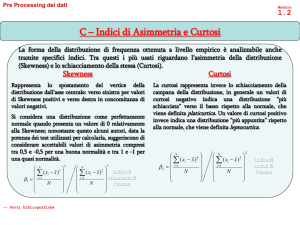

• -Indici di Asimmetria (Skewness) e Curtosi (Kurtosis).

Asimmetria Negativa i dati si concentrano nella parte

destra della distribuzione (“guardano verso i valori

negativi”), Asimmetria Positiva i dati si concentrano nella

parte sinistra della distribuzione (“guardano verso i valori

positivi”)

• Ottenuti i valori di Asimmetria e Curtosi è necessario

effettuare il Test di Verifica delle Ipotesi che consiste nel

dividere tali valori per il proprio Errore Standard. La

distribuzione si considera distribuita normalmente se i

risultati ottenuti hanno un valore compreso tra –1 e 1

(devono comunque avvicinarsi il più possibile allo 0) in

funzione del livello di significatività scelto (almeno .01).

• a1. Rappresentazione grafica dei Quantili o Q-QPlot o Cumulative

Normal Plot

• La distribuzione è normale se i punti si addensano lungo la diagonale

positiva degli assi.

• a2. Box Plot

• Si tratta di una rappresentazione grafica di 5 indici (Minimo, Massimo,

Mediana e i due Quartili intermedi). Il rettangolo (box) di solito colorato

indica la Differenza Interquartilica e fornisce indicazioni sulla simmetria

della distribuzione.

• a3. Test statistici per la verifica della normalità (KolmogorovSmirnov o Shapiro-Wilk)

• Si tratta di test molto potenti che confrontano la differenza tra la

distribuzione cumulata attesa e quella osservata. Risentono

dell’ampiezza campionaria Se i valori sono significativi (p<.01) esiste

una differenza significativa rispetto alla normale.

• a4. Trasformazioni

• E’ possibile normalizzare la distribuzione ma occorre procedere con

molta cautela specialmente nei casi di forti violazioni della normalità

della distribuzione

• b. Per verificare se la distribuzione è

normale multivariata

• La distribuzione normale multivariata rappresenta

una generalizzazione della normale univariata. Nel

caso in cui tutte le distribuzioni univariate siano

normali è probabile che anche quella multivariata

lo sia. E’ possibile utilizzare un test grafico, il Q-Q

Chi-quadrato della Distanza di Mahalanobis

basato sull’utilizzo dei quantili della distribuzione

del Chi quadrato. La Distanza di Mahalanobis può

essere utilizzata anche per rilevare la presenza di

outliers multivariati

6. Linearità della relazione tra le variabili

verificabile con un diagramma di dispersione

• La linearità della relazione tra le variabili è

verificabile con un diagramma di

dispersione

7. Fattorializzabilità della matrice dei dati

• E’ possibile verificare la grandezza delle correlazioni tra le

variabili (che deve essere elevata) mediante due test

implementati in molti package statistici:

• a. Test di Sfericità di Bartlett (Bartlett, 1954) indica se la

matrice di correlazione è una matrice identità (1 sulla

diagonale e 0 fuori). Se il test è significativo e il campione

è sufficientemente ampio è possibile effettuate l’AFE

• b. Test di Adeguatezza Campionaria o Kaiser-Meyer-Olkin

(KMO) (Kaiser, 1970, 1974) indice che permette di

confrontare la grandezza delle correlazioni osservate

rispetto alle correlazioni parziali. I valori devono essere

>.70