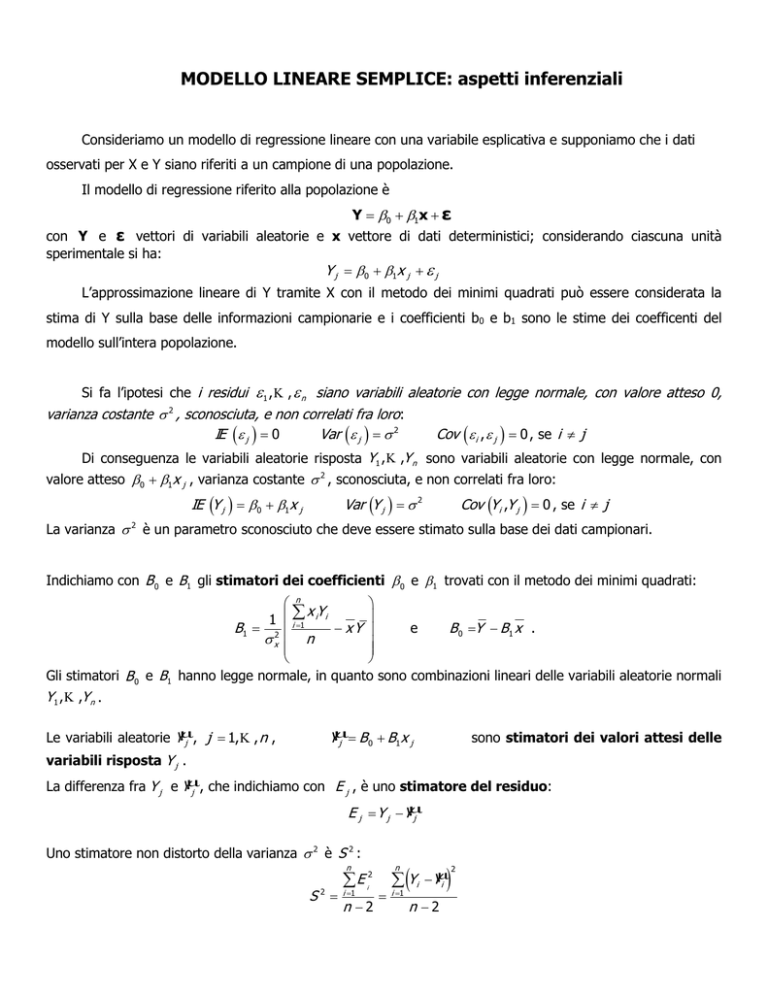

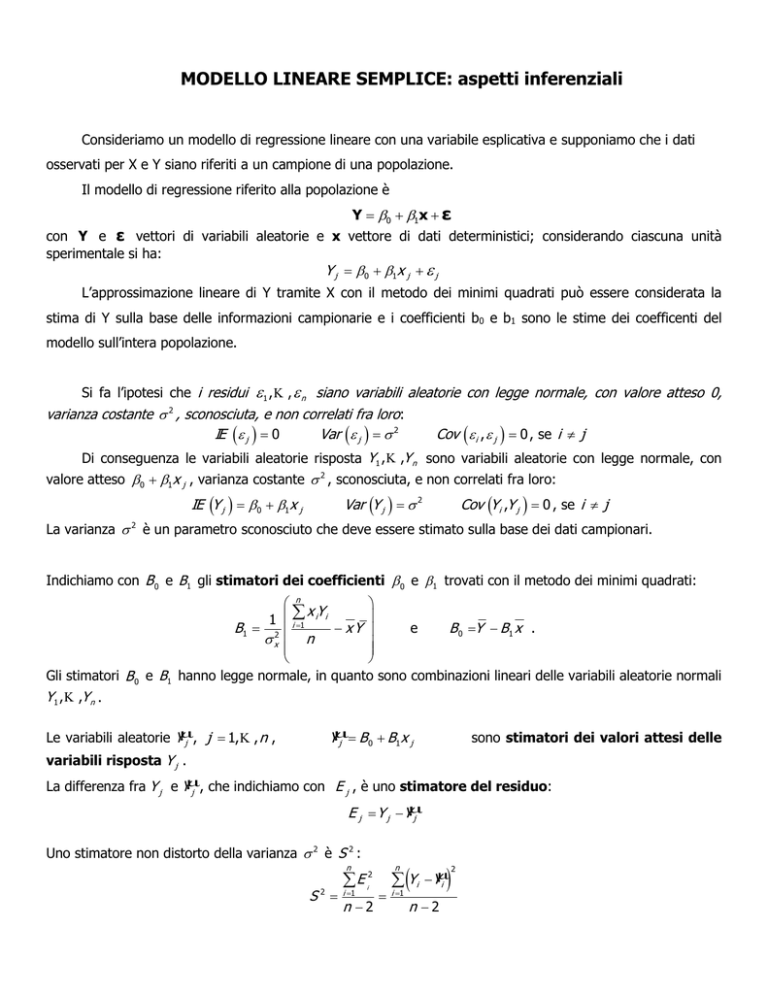

MODELLO LINEARE SEMPLICE: aspetti inferenziali

Consideriamo un modello di regressione lineare con una variabile esplicativa e supponiamo che i dati

osservati per X e Y siano riferiti a un campione di una popolazione.

Il modello di regressione riferito alla popolazione è

Y 0 1x ε

con Y e ε vettori di variabili aleatorie e x vettore di dati deterministici; considerando ciascuna unità

sperimentale si ha:

Y j 0 1x j j

L’approssimazione lineare di Y tramite X con il metodo dei minimi quadrati può essere considerata la

stima di Y sulla base delle informazioni campionarie e i coefficienti b0 e b1 sono le stime dei coefficenti del

modello sull’intera popolazione.

Si fa l’ipotesi che i residui

1 , K , n siano variabili aleatorie con legge normale, con valore atteso 0,

varianza costante , sconosciuta, e non correlati fra loro:

IE j 0

Var j 2

2

Cov i , j 0 , se i j

Di conseguenza le variabili aleatorie risposta Y1 , K ,Y n sono variabili aleatorie con legge normale, con

valore atteso 0 1x j , varianza costante 2 , sconosciuta, e non correlati fra loro:

IE Y j 0 1x j

Var Y j 2

Cov Yi ,Y j 0 , se i j

La varianza 2 è un parametro sconosciuto che deve essere stimato sulla base dei dati campionari.

Indichiamo con B 0 e B1 gli stimatori dei coefficienti 0 e 1 trovati con il metodo dei minimi quadrati:

n

x iY i

1

B 0 Y B1 x .

e

B1 2 i 1

xY

x n

Gli stimatori B 0 e B1 hanno legge normale, in quanto sono combinazioni lineari delle variabili aleatorie normali

Y1 , K ,Y n .

Le variabili aleatorie Yµ

j , j 1, K , n ,

Yµ

j B 0 B1 x j

sono stimatori dei valori attesi delle

variabili risposta Y j .

La differenza fra Y j e Yµ

j , che indichiamo con E j , è uno stimatore del residuo:

E j Y j Yµ

j

Uno stimatore non distorto della varianza 2 è S 2 :

n

S2

E 2

i 1

i

n 2

Yi Yµi

n

i 1

n 2

2

Stimatori dei coefficienti

Indichiamo con B 0 e B1 gli stimatori dei coefficienti 0 e 1 . Si può dimostrare che:

n

IE B 0 0

Var B 0 2

x i2

IE B1 1 Var B1

e

i 1

n 2 X2

2

n X2

Stimatori delle varianze di B 0 e B1 si trovano quindi usando lo stimatore S 2 di 2 :

n

S B20 S 2

B 0 0

: t [n 2]

SB 0

Si ha:

x i2

e

i 1

n 2 X2

S B21

S2

n X2

B1 1

: t [n 2]

SB1

e

Questo permette di calcolare intervalli di confidenza ed effettuare test per i coefficienti 0 e 1 .

a) Intervallo di confidenza per k , k=0,1, a livello di significatività 1 :

B k

S Bk t , B k S Bk t

dove t è il quantile 1 /2 di una variabile aleatoria t di Student a n-2 gradi di libertà.

b) Test sulla nullità dei coefficienti k , k=0,1, a livello :

H 1 : k 0

H 0 : k 0

Se H 0 è vera la variabile aleatoria

Bk

ha legge t [n 2] . Questo permette di effettuare il test.

S Bk

Stimatori dei valori attesi delle variabili aleatorie Y1 ,… , Yn

Il valore atteso di ciascuna variabile aleatoria Y j , con j 1,K , n , è:

IE Y j 0 1x j

Un suo stimatore non distorto è:

Yµj B 0 B1x j

Si può dimostrare che la sua varianza è:

xj x

2 1

µ

Var Y j

1

n

X2

che viene anche indicata con

S 2h j2 .

e che uno stimatore non distorto della varianza di Yµ

j è

2

2 2

Var Yµ

j hj

Gli stimatori Yµ

hanno legge normale, in quanto sono combinazioni lineari delle variabili aleatorie normali

j

B 0 e B1 .

Si ha:

Yµ

j IE Y j

S hj

: t [n 2]

Intervallo di confidenza per IE Y j a livello di significatività 1 :

Yµ t

j

S h j , Yµ

j t S hj

dove t è il quantile 1 /2 di una variabile aleatoria t di Student a n-2 gradi di libertà.

Stimatori dei residui

Le variabili aleatorie

j

non sono osservate nel campione, sono stimate tramite le variabili

E j Y j Yµ

j .

Si ha:

1

n

hanno legge normale perché combinazione lineare di variabili aleatorie con

IE E j 0

e

Var E j 2 h j2

Le variabili aleatorie E 1 , K , E n

legge normale.

La varianza può essere stimata con lo stimatore S Ej2 :

S Ej2 S 2 h j2

Si ha:

1

n

Ej

: t [n 2]

S Ej

Le realizzazioni campionarie

ej

s Ej

sono dette residui standardizzati o residui studentizzati

utilizzate per il grafico dei residui rispetto ai valori stimati.

e sono spesso

Se il modello è corretto le realizzazione

campionarie dei residui standardizzate stanno, con probabilità 1 , nell’intervallo t ,t .

Stimatori dei valori predetti delle variabili aleatorie risposta

Dopo aver stimato il modello sulla base di n osservazioni, si effettua una nuova osservazione della variabile

esplicativa, che indichiamo con x 0 , di cui non si ha la corrispondente osservazione della variabile risposta.

Per la nuova osservazione si considera il modello:

Y0 0 1x 0 0

B1 sono

Si predice il valore atteso della nuova variabile risposta, IE Y 0 , con Yµ

0 B 0 B1x 0 dove B 0 e

calcolati sulla base delle prime n osservazioni.

Indichiamo con 2h02 la varianza di Yµ

0 :

2

2

Var Yµ

0 h0

1 x0 x

2

X2

n

Intervallo di confidenza per IE Y 0 , valore atteso di Y 0 , a livello di significatività 1 :

Yµ S h t

0

0

,Yµ

0 S h0 t

dove t è il quantile 1 /2 di una variabile aleatoria t di Student a n-2 gradi di libertà.

“Intervallo di confidenza” per la risposta Y 0 a livello di significatività 1 . Si ha

2 2

2 2

µ

1 IP Yµ

0 t 1 S h0 Y 0 Y 0 t 1 S h0

Osserviamo che

Yµ t

0

2 2

1 S 2 h02 , Yµ

0 t 1 S h0

non è propriamente un intervallo di confidenza in quanto non si riferisce a un parametro.