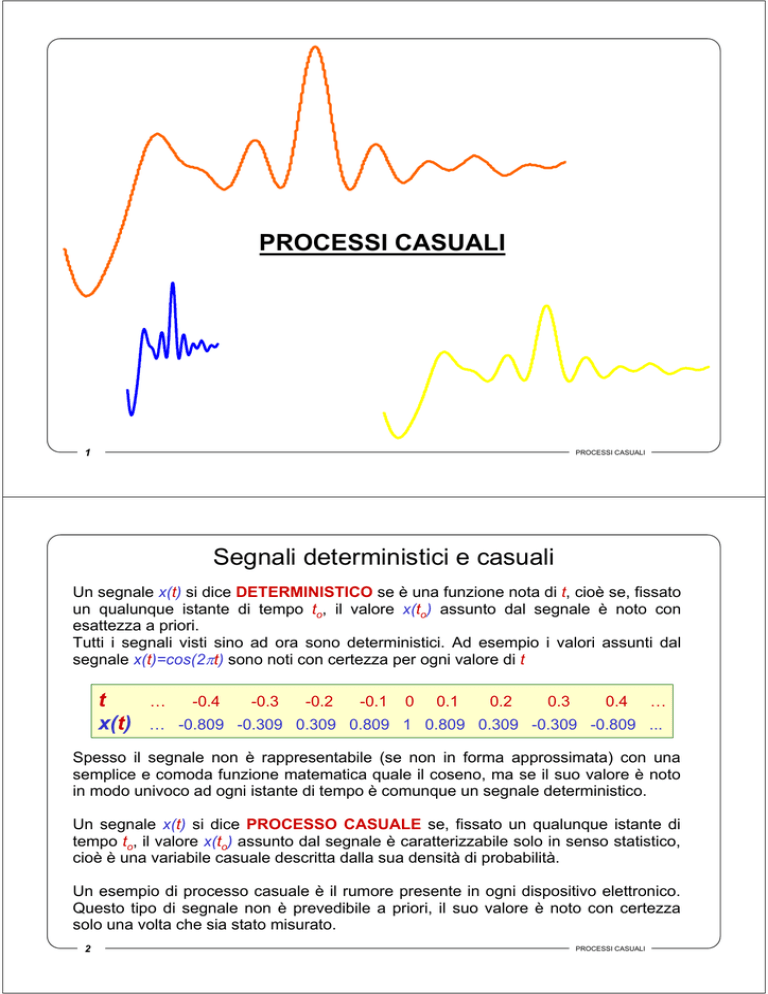

PROCESSI CASUALI

1

PROCESSI CASUALI

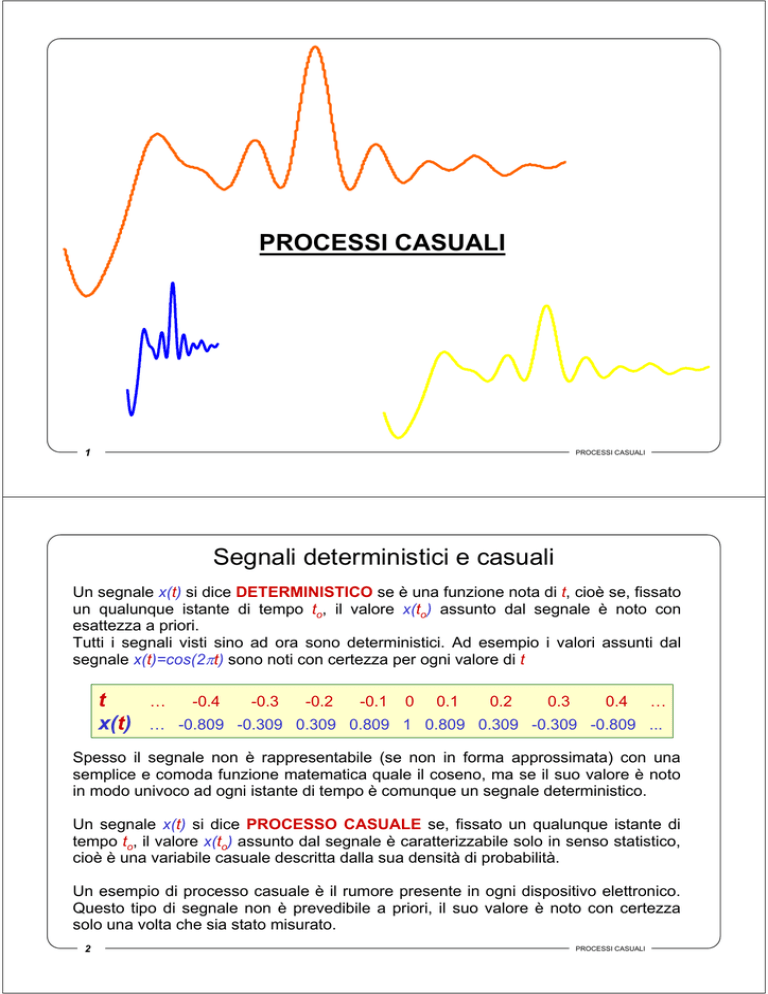

Segnali deterministici e casuali

Un segnale x(t) si dice DETERMINISTICO se è una funzione nota di t, cioè se, fissato

un qualunque istante di tempo to, il valore x(to) assunto dal segnale è noto con

esattezza a priori.

Tutti i segnali visti sino ad ora sono deterministici. Ad esempio i valori assunti dal

segnale x(t)=cos(2πt) sono noti con certezza per ogni valore di t

t

x(t)

…

-0.4

-0.3

-0.2

-0.1

0

0.1

0.2

0.3

0.4

…

… -0.809 -0.309 0.309 0.809 1 0.809 0.309 -0.309 -0.809 ...

Spesso il segnale non è rappresentabile (se non in forma approssimata) con una

semplice e comoda funzione matematica quale il coseno, ma se il suo valore è noto

in modo univoco ad ogni istante di tempo è comunque un segnale deterministico.

Un segnale x(t) si dice PROCESSO CASUALE se, fissato un qualunque istante di

tempo to, il valore x(to) assunto dal segnale è caratterizzabile solo in senso statistico,

cioè è una variabile casuale descritta dalla sua densità di probabilità.

Un esempio di processo casuale è il rumore presente in ogni dispositivo elettronico.

Questo tipo di segnale non è prevedibile a priori, il suo valore è noto con certezza

solo una volta che sia stato misurato.

2

PROCESSI CASUALI

Introduzione ai processi casuali (1)

Il rumore termico

Un classico e importante esempio utile a introdurre il concetto di processo casuale

è rappresentato dalla debole tensione elettrica v1(t) esistente ai capi di un resistore.

Questa tensione, variabile nel tempo, è causata dal movimento caotico degli

elettroni dovuto ad una temperatura del materiale superiore allo zero assoluto.

Se si registra la tensione v1(t) si ottiene (dopo aver effettuato la misura!) un segnale

che può essere considerato deterministico.

v1(t)

t

3

PROCESSI CASUALI

Introduzione ai processi casuali (2)

Se però si prende un secondo resistore identico al primo, posto alla stessa temperatura,

e si esegue la misura della tensione elettrica ai suoi capi, si ottiene un nuovo segnale

v2(t), con caratteristiche simili ma diverso dal precedente poiché gli elettroni si

muovono in modo diverso, ed indipendentemente, nei due resistori.

v2(t)

t

v1(t)

t

4

PROCESSI CASUALI

Introduzione ai processi casuali (3)

Se lo scopo è determinare l’effetto del rumore termico prodotto dal resistore su

un’apparecchiatura elettronica o un sistema di trasmissione, non è di alcuna utilità

aver visto l’andamento delle tensioni v1(t) o v2(t) ai capi dei due resistori se il

resistore effettivamente montato nell’apparecchiatura è un altro (o anche il primo, ma

in un tempo successivo: il rumore termico non si ripete in modo prevedibile!).

E’ utile invece riuscire a descrivere le caratteristiche della tensione di rumore comuni

a tutti i resistori dello stesso tipo e a quella temperatura.

In questo modo, qualsiasi sia il resistore (di quel valore e a quella temperatura)

montata nell’apparecchiatura, potremo dire, per esempio, con quale probabilità si

presenteranno certi valori di tensione o quale sarà la potenza di rumore.

Si abbandona dunque il concetto di certezza (proprio dei segnali deterministici) per

passare a quello dell’incertezza, descritto dalla teoria delle probabilità, proprio dei

processi casuali.

I valori del processo in generici istanti di tempo sono considerati variabili casuali, e

descritti come tali (attraverso le relative densità di probabilità).

5

PROCESSI CASUALI

Dimensione temporale e di insieme

Le tensioni elettriche esistenti ai capi di tutti i resistori dello stesso tipo e temperatura

costituiscono le realizzazioni del processo casuale rumore termico.

Dimensione

d’insieme

tempo

realizzazioni

Dimensione

temporale

x1 (t )

6

x2 (t )

....

xi (t )

....

xN (t )

PROCESSI CASUALI

Descrizione dei processi casuali

Di un processo casuale è utile conoscere le caratteristiche comuni a tutte le realizzazioni

Un processo casuale è descritto completamente dalle densità di probabilità congiunte di

tutti gli ordini e per tutti gli istanti di tempo. Tuttavia in molti casi questa informazione

completa non è disponibile. In pratica per descrivere il processo casuale x(t) si utilizzano

soprattutto:

la densità di probabilità delle ampiezze del processo px(a)

che descrive con quale probabilità una realizzazione del processo casuale x(t) assume un

valore uguale ad a. In generale px(a) dipende anche dal tempo. Tuttavia noi ci

occuperemo di una classe di processi casuali detti stazionari le cui caratteristiche

statistiche non dipendono dal tempo t .

la funzione di autocorrelazione del processo Rx(τ )

che descrive quantitativamente il legame tra il valore assunto da una realizzazione del

processo casuale al tempo t +τ e quello assunto dalla stessa realizzazione al tempo t .

Anche in questo caso, limitando l’analisi ai processi casuali stazionari, Rx(τ ) non dipende

dal tempo t ma solo dal ritardo τ tra le due misure.

7

PROCESSI CASUALI

Densità di probabilità del processo casuale (1)

Per un prefissato tempo t, il processo x(t) è una variabile casuale con densità di

probabilità px(a) (chiamata d.d.p. del processo casuale):

P(a < x(t ) ≤ a + da )

da →0

da

p x (a ) = lim

che ci dice con quale probabilità una qualsiasi realizzazione del processo assume valori in

un intorno infinitesimo di a. A partire dalla d.d.p. si possono definire:

+∞

µ x = E[ x(t )] = ∫ ap x (a )da

• Valore medio:

• Valore quadratico medio:

• Varianza:

[

[

2

∫

a p x (a )da

2

−∞

σ = E x(t ) − µ x

2

x

]

E x(t ) =

−∞

+∞

]= ∫ a − µ

+∞

2

2

x

[

]

p x (a )da = E x(t ) − µ x2

2

−∞

• La probabilità che una qualsiasi realizzazione assuma valori in un dato intervallo:

P[a1 < x(t ) ≤ a2 ] =

8

a2

∫ p (a )da

x

a1

PROCESSI CASUALI

Densità di probabilità del processo casuale (2)

I parametri che caratterizzano il processo casuale x(t) possono essere calcolati in modo

approssimato attraverso medie aritmetiche su un numero molto elevato di realizzazioni:

• Valore medio:

1

µx ≈

N

• Valore quadratico medio:

[

E x(t )

2

]

N

∑ x (t )

1

≈

N

• Varianza:

σ x2 ≈

1

N

i

i =1

N

N

∑ x (t )

i =1

N

2

∑ x j (t )

j =1

∑ x (t ) − N

1

i

i =1

2

i

L’indice i della sommatoria si riferisce a diverse realizzazioni

9

PROCESSI CASUALI

Densità di probabilità di un processo gaussiano

p (a )

1

p(a) =

⎛ (a − µ x )

exp⎜⎜ −

2σ x2

2πσ x2

⎝

2

1

2πσ x2

⎞

⎟

⎟

⎠

0 .606

2πσ x2

0 .135

2πσ

P (µ x − σ x < x ≤ µ x + σ x ) =

∫

µ x + 2σ x

∫

µ x − 2σ x

µ x + 3σ x

∫

µ x −3σ x

10

2σ X

µX

1

m x −σ x

P (µ x − 3σ x < x ≤ µ x + 3σ x ) =

2σ X

⎛ (a − µ x )2 ⎞

⎟ da ≈ 0.683

exp⎜⎜ −

2

⎟

σ

2

2π σ x2

x

⎝

⎠

m x +σ x

P (µ x − 2σ x < x ≤ µ x + 2σ x ) =

2

x

σX σX

⎛ (a − µ x )2 ⎞

⎟ da ≈ 0.954

exp⎜⎜ −

2

⎟

2

σ

2

2π σ x

x

⎝

⎠

1

⎛ (a − µ x )2 ⎞

⎟ da ≈ 0.997

exp⎜⎜ −

2

⎟

2

2

σ

2π σ x

x

⎝

⎠

1

PROCESSI CASUALI

a

Funzione Q e funzione errore complementare (erfc)

B = P(x > µ x + β )

p (a )

∞

2πσ

2

x

µx +β

σx σx

⎛ β ⎞

⎛β ⎞ 1

⎟

= Q⎜⎜ ⎟⎟ = erfc⎜⎜

⎟

σ

2

2

σ

⎝ x⎠

x ⎠

⎝

B

C=B

µX

β

t

0,00

0,05

0,10

0,15

0,20

0,25

0,30

0,35

0,40

0,45

0,50

0,60

∫

=

0 .606

Q(t)

5,000E-01

4,801E-01

4,602E-01

4,404E-01

4,207E-01

4,013E-01

3,821E-01

3,622E-01

3,446E-01

3,264E-01

3,085E-01

2,743E-01

t

0,8

1,0

1,2

1,4

1,6

1,8

2,0

2,4

2,8

3,2

3,6

4,0

⎛ (a − µ x )2 ⎞

⎟ da

exp⎜⎜ −

2

⎟

2

2

σ

2πσ x

x

⎝

⎠

1

β

a

Q(t)

2,119E-01

1,587E-01

1,151E-01

8,080E-02

3,806E-01

3,590E-02

2,280E-02

8,200E-03

2,600E-03

6,871E-04

1,591E-04

3,167E-05

s

0,0

0,1

0,2

0,3

0,4

0,5

0,6

0,7

0,8

1,0

1,2

1,4

erfc(s)

1,000E+00

8,875E-01

7,730E-01

6,714E-01

5,716E-01

4,795E-01

3,961E-01

3,222E-01

2,579E-01

1,573E-01

9,700E-02

4,770E-02

s

1,6

1,8

2,0

2,2

2,4

2,6

2,8

3,0

3,3

3,7

4,0

5,0

erfc(s)

2,370E-02

1,090E-02

4,700E-03

1,900E-03

6,885E-04

2,360E-04

7,502E-05

2,209E-05

3,057E-06

1,671E-07

1,542E-08

1,537E-12

per t > 3 Q(t ) ≈

(

exp − t 2 / 2

2π t

( )

exp − s 2

per s > 2 erfc( s ) ≈

πs

11

PROCESSI CASUALI

Processi casuali stazionari con valor medio non nullo

Un processo casuale con valor medio diverso da zero può essere rappresentato come

la somma di un processo a valor medio nullo e di una costante (segnale

deterministico) uguale al valor medio.

Una realizzazione di

x(t) ed y(t)

0.8

0.7

0.6

0.5

0.4

0.3

0.2

0.1

0

-0.1

-0.2

-0.3

-0.4

-0.5

-0.6

-0.7

-0.8

-40

yi(t)

xi(t)

-20

0

tempo

12

Le d.d.p delle ampiezze di

x(t) ed y(t)

y(t) = x(t) + 0.5

20

0.8

0.7

0.6

0.5

0.4

0.3

0.2

0.1

0

-0.1

-0.2

-0.3

-0.4

-0.5

-0.6

-0.7

40 -0.8

d.d.p.

0

)

0.05

0.1PROCESSI0.15

0.2

CASUALI

Autocorrelazione dei processi casuali stazionari (1)

L’autocorrelazione del processo x(t) è definita come valor medio di x*(t)x(t+τ).

Se il processo è stazionario l’autocorrelazione non dipende da t, ma solo da τ.

[

Rx (τ ) = E x * (t ) x (t + τ )

]

Per τ =0 si ottiene

Rx (0) = E[| x (t ) |2 ]

L’autocorrelazione è interpretabile come media aritmetica, su un gran numero

di realizzazioni, dei prodotti dei valori del processo agli istanti t e t+τ.

1

Rx (τ ) ≈

N

N

∑ x (t ) x (t + τ )

i =1

*

i

i

L’indice i della sommatoria si riferisce a diverse realizzazioni

13

PROCESSI CASUALI

Autocorrelazione dei processi casuali stazionari (2)

Consideriamo per esempio due processi casuali stazionari a valor medio nullo, ma con

caratteristiche differenti. Il primo ha realizzazioni che variano lentamente nel tempo (ad

es. il rumore di un motore di un’auto al minimo), mentre il secondo ha realizzazioni che

variano con grande rapidità (ad es. Il fruscio di fondo di un disco rovinato) ...

[

Rx (τ ) = E x * (t ) x (t + τ )

µx = 0

]

[

]

Rx (0 ) = E | x (t ) |2 = σ x2

τ

x(t)

x(t+τ)

x(t)

2

2

1

1

0

0

-1

-1

-2

-2

0

14

τ

50

100

150

200

0

50

100

150

x(t+τ)

200

PROCESSI CASUALI

Autocorrelazione dei processi casuali stazionari (3)

Alcune realizzazioni di un

processo che varia lentamente

Se x(t) varia lentamente nel

tempo, x(t+τ ) è solitamente

poco diverso da x(t): il

prodotto xi(t)xi(t+τ ) ha segno

positivo per quasi tutte le

realizzazioni.

Per τ=0 l’autocorrelazione Rx(0)

è la varianza del processo; per

τ>0 l’autocorrelazione Rx(τ) è

sempre minore di Rx(0).

Rx (τ ) ≈

1

N

N

∑ x (t )x (t + τ ) > 0

i =1

i

i

2

0

-2

0

50

100

150

200

0

50

100

150

200

0

50

100

150

200

0

50

100

150

200

0

50

100

150

200

2

0

-2

2

0

-2

2

0

-2

2

0

-2

valore elevato!

x(t)

15

τ

x(t+τ )

PROCESSI CASUALI

L’autocorrelazione dei processi casuali stazionari (4)

Alcune realizzazioni di un

processo che varia rapidamente

Se x(t) varia rapidamente nel

tempo , x(t+τ ) è spesso molto

diverso da x(t): il prodotto

xi(t)xi(t+τ ) ha segno casuale

nelle varie realizzazioni e

quindi l’autocorrelazione ha un

valore prossimo a zero.

1

Rx (τ ) ≈

N

16

N

∑ x (t )x (t + τ ) ≈ 0

i =1

i

i

2

0

-2

0

50

100

150

200

0

50

100

150

200

0

50

100

150

200

0

50

100

150

200

0

50

100

2

0

-2

2

0

-2

2

0

-2

2

0

-2

τ

x(t)

x(t+τ )

150

PROCESSI CASUALI

200

Esempio di valutazione dell’autocorrelazione (1)

xi* (t ) xi (t + τ )

0.5

0.5

0.5

0

0

0

-0.5

τ =0

-0.5

i =1

τ =0.2

-0.5

i =100

0.5

0.5

0.5

0

0

0

-0.5

τ =0.6

-0.5

τ =0.8

-0.5

0.5

0.5

0.5

0

0

0

-0.5

τ =0.4

τ =1.2

-0.5

τ =1.4

-0.5

17

τ =1

τ =1.6

PROCESSI CASUALI

Esempio di valutazione dell’autocorrelazione(2)

Rx (τ ) = E[ x* (t ) x (t + τ )]

1

Risultato del calcolo

0.8

0.6

0.4

0.2

0

τ

-0.2

-0.4

-4

18

-2

0

2

Nota: è evidente, dalla

definizione di

autocorrelazione, che per

qualsiasi processo casuale

stazionario Rx(τ) è una

funzione pari, cioè

Rx(-τ)=Rx(τ)

4

PROCESSI CASUALI

Proprietà dell’autocorrelazione

1. L’autocorrelazione in τ=0 coincide con la potenza media del processo casuale.

[

]

Rx (0 ) = E x (t ) = E [Px ] = P ≈

2

1

N

N

∑ x (t )

i =1

2

i

2. Rx(0 ) è il massimo valore che può assumere l’autocorrelazione.

Rx (τ ) ≤ Rx (0)

3. Rx(τ) è inoltre una funzione pari

Rx (τ ) = Rx (−τ )

4. Dato un processo y(t) con media µy possiamo scrivere y(t)=x(t)-µy, ove x(t) è un

processo a media 0. Vale la seguente relazione

R y (τ ) = Rx (τ ) + µ y2

19

PROCESSI CASUALI

Autocovarianza dei processi casuali stazionari

[

C x (τ ) = E ( x (t ) - µ x )

*

(x(t + τ ) - µx ) ] = Rx (τ ) − µ x 2

Per un processo a valor medio nullo, l’autocovarianza coincide con

l’autocorrelazione

[

]

C x (0 ) = E | x (t ) - µ x |2 = Rx (0 ) − µ x = σ x2

20

2

PROCESSI CASUALI

Il coefficiente di correlazione (1)

Dato un processo casuale, si definisce coefficiente di correlazione del

processo, l’autocovarianza normalizzata:

[

]

C (τ ) E (x(t) −µx ) (x(t +τ) −µx ) Cx(τ )

= 2

ρx (τ) = x =

2

Cx(0)

E | x(t) −µx |

σx

ρ x (τ ) =

*

[

C x (τ )

≤1

C x (0)

]

ρ x (0) = 1

21

PROCESSI CASUALI

Il coefficiente di correlazione (2)

Il coefficiente di correlazione del processo è una funzione i cui valori sono

limitati tra -1 e +1. Ovviamente il suo valore in τ=0 è unitario e, salvo casi

molto particolari, è l’unico massimo.

Il valore del coefficiente di correlazione in funzione di τ è una misura della

predicibilità di una realizzazione del processo all’istante t+τ noto il valore

della realizzazione all’istante t.

••Se

(τ)=±1:x(t)

x(t)eex(t+

x(t+ττ))sisidicono

diconocompletamente

completamentecorrelati,

correlati,c’è

c’èun

unlegame

legame

Seρρxx(τ)=±1:

deterministico

fra

i

due

campioni

e

quindi

è

possibile

predire

deterministico fra i due campioni e quindi è possibile predire

perfettamente

perfettamenteililvalore

valoredell’uno

dell’unonoto

notoililvalore

valoredell’altro.

dell’altro.

••Se

ρ

(τ)=0

[cioè

se

C

(τ)=0]:

x(t)

e

x(t+

τ

)

sono

Se ρxx(τ)=0 [cioè se Cxx(τ)=0]: x(t) e x(t+τ) sono incorrelati,

incorrelati, non

non èè possibile

possibile

predire

il

valore

dell’uno

noto

il

valore

dell’altro.

predire il valore dell’uno noto il valore dell’altro.

22

PROCESSI CASUALI

Una semplice dimostrazione del legame

correlazione/predicibilità

Consideriamo il processo casuale stazionario a valor medio nullo x(t). Indichiamo per

brevità con x1 e x2 le due variabili casuali x(t1) e x(t2) e per semplicità assumiamo x1 e x2

reali. Dimostreremo che:

1 - quanto più due variabili casuali x1 e x2 (a valor medio nullo) sono correlate, tanto

meglio possiamo stimare dall’una il valore dell’altra.

2 - la stima sarà la migliore possibile, se l’errore di stima è incorrelato con i dati.

Dire che la variabile casuale x2 è correlata con la variabile casuale x1 equivale a dire

che il valore assunto da x2 è in parte proporzionale a quello assunto da x1 più una

variabile casuale indipendente da x1 e quindi non predicibile. In breve:

x2 = rx1 + n

dove n è una variabile casuale indipendente da x1, a valore medio nullo e varianza

σ n2 = E[n 2 ]

23

PROCESSI CASUALI

La stazionarietà del processo ci dice che la varianza σ2 delle due variabili casuali x1 e x2 è

la medesima, imponendo un legame tra la varianza di n e il coefficiente r.

In formule abbiamo:

[ ] [ ]

⇒ E [x ] = E [(rx + n ) ] = σ

r E [x ]+ E [n ]+ 2r E [x n] = σ

⇒ r σ + E [n ] = σ

123

E x12 = E x22 = σ 2

2

2

1

2

2

2

2

2

1

2

2

2

2

2

1

=0

da cui:

perchè indipendenti

σ n2 = (1 − r 2 )σ 2

Piu’ |r| è prossimo a 1, piu’ σn2 è piccolo e tanto meno x1 si discosta da x2.

Si può dimostrare che il coefficiente di correlazione fra x1 e x2 è uguale a r:

ρ x (τ ) = E [x1 x2 ] / E [x12 ] = r

Infatti:

[ ]

E [x1 x2 ] = E [x1 (rx1 + n )] = rE x12

Piu’ il coefficiente di correlazione è in modulo prossimo a 1, piu’ x2 è predicibile da x1.

24

PROCESSI CASUALI

Stima lineare di x2 da x1 (predire il futuro)

Conoscendo il valore assunto da x1, cerchiamo di predire al meglio (stimare) il

valore che assumerà x2 cercando il coefficiente di proporzionalità a

xˆ 2 = ax1

Il valore ottimo di a si ha se la differenza (in media quadratica) tra il valore

stimato e il valore effettivamente assunto da x2 è minima, cioè se è minimo

[

]

[

)

E ( x2 − x2 ) 2 = E ( x2 − ax1 ) 2

]

Derivando rispetto ad a e uguagliando a zero si ottiene il valore ottimo di a

[ ]

a = E [x1 x2 ] / E x12 = r

Il valore ottimo di a coincide, ovviamente, con il coefficiente r, infatti:

[ ]

E [x1 x2 ] = E [x1 (rx1 + n )] = rE x12

25

PROCESSI CASUALI

Come si fa a predire il futuro?

IlIlvalore

valoreottimo

ottimodidiaacoincide

coincidecon

conrrche

cheèèililcoefficiente

coefficientedidicorrelazione

correlazionedelle

delle

e

x

variabili

casuali

x

variabili casuali x1 e x2

1

2

[ ]

a = E [x1 x2 ] / E x12 = ρ x (τ )

Questa considerazione ci consente di definire una procedura per stimare al

meglio il valore che assumerà x2 una volta noto il valore assunto da x1

1a fase: apprendimento - Analizzando N (numero grande) realizzazioni del

processo casuale, si calcola il coefficiente di correlazione (ricordare che µx=0)

E [x (t ) x (t + τ )] N

ρ x (τ ) =

≈ ∑ xi (t )xi (t + τ )

E[ x 2 (t )]

i =1

N

∑ x (t )

i =1

2

i

2a fase: predizione - Si stima x(t+τ ) da x(t)

xˆ (t + τ ) = ρ x (τ ) x (t )

26

PROCESSI CASUALI

L’errore di stima

Si nota che l’errore di stima, essendo causato solo dalla variabile casuale n, ha

valore quadratico medio pari a quello di n

[

]

[

]

)

E ( x2 − x2 ) 2 = E ( x2 − ax1 ) 2 = σ x2 (1 − r 2 )

Da questa espressione si capisce subito che:

1 - l’errore di stima è nullo se le variabili casuali sono totalmente correlate (|r|=1)

2 - l’errore di stima è massimo se le variabili casuali sono incorrelate (|r|=0)

Infine, è importante notare che l’errore di stima è incorrelato con il dato (x1),

infatti:

[

]

= E [x x ] − aE [x ] = rE [x ] − rE [x ] = 0

E [x1 ( x2 − ax1 )] = E x1 x2 − ax12 =

1 2

2

1

2

1

2

1

27

PROCESSI CASUALI

Valor medio e autocorrelazione temporale

Si abbia un processo casuale stazionario x(t) di cui si conosce una sua realizzazione

limitata nel tempo da –T/2 a T/2 che indichiamo con xT(t)

Valor medio temporale

1

η x = lim

T →∞ T

T /2

∫x

T

( t ) dt

−T / 2

Autocorrelazione temporale

1

ℜ x (τ ) = lim

T →∞ T

T /2

∫x

*

T

( t ) x T ( t + τ ) dt

−T / 2

1

ℜ x ( 0 ) = lim

T →∞ T

T /2

∫| x

T

( t ) |2 dt = Px

−T / 2

Per un processo stazionario

E [η x ] = µ x

E [ℜ x (τ )] = R x (τ )

E [ℜ x ( 0 )] = E [ Px ] = R x ( 0 ) = P = potenza del processo

28

PROCESSI CASUALI

Processi casuali ergodici

Tra i processi casuali stazionari esistono alcuni processi per i quali si possono ricavare

la densità di probabilità e la funzione di autocorrelazione da una sola realizzazione.

Questi processi sono detti ERGODICI.

Nota importante:

Per un processo

ergodico tutte le

realizzazioni hanno

la medesima

potenza.

tempo

realizzazioni

Osservare tutte le realizzazioni ad un istante di tempo (o per una coppia di istanti)

permette di ricavare le stesse informazioni statistiche ottenibili dall’osservazione

prolungata nel tempo di una singola realizzazione.

Un esempio di processo ERGODICO è rappresentato dal rumore termico.

29

PROCESSI CASUALI

Processi casuali ergodici (d.d.p. ampiezze)

La

Ladensità

densitàdidiprobabilità

probabilitàdei

deivalori

valoriassunti

assuntida

daun

unprocesso

processocasuale

casualeergodico

ergodicopuò

può

essere

esserevalutata,

valutata,oltre

oltreche

chedall’insieme

dall’insiemedelle

dellerealizzazioni

realizzazioni(ad

(adun

unsolo

soloistante

istantediditempo,

tempo,

arbitrario,

anche

da

una

sola

realizzazione,

come

percentuale

del

tempo

in

cui

il

arbitrario, anche da una sola realizzazione, come percentuale del tempo in cui il

processo

processoassume

assumeampiezze

ampiezzefra

fraaaeea+da

a+dadiviso

divisoper

perl’ampiezza

l’ampiezzadell’intervallo

dell’intervalloda.

da.

Realizzazione del processo casuale

0.8

0.7

0.6

0.5

0.4

0.3

0.2

0.1

0

-0.1

-0.2

-0.3

-0.4

-0.5

-0.6

-0.7

-0.8

-40

30

-20

0 tempo 20

40

0.8

0.7

0.6

0.5

0.4

0.3

0.2

0.1

0

-0.1

-0.2

-0.3

-0.4

-0.5

-0.6

-0.7

-0.8

0

0.05

0.1

PROCESSI CASUALI

0.15

Processi casuali ergodici

Il valor medio temporale coincide col valor medio di insieme (processo ergodico per la

media).

L’autocorrelazione temporale coincide con l’autocorrelazione di insieme (processo

ergodico per l’autocorrelazione).

T /2

1

η x = lim

T →∞ T

1

ℜ x (τ ) = lim

T →∞ T

∫x

( t ) dt = µ x

−T / 2

T /2

∫x

T

*

T

( t ) x T ( t + τ ) dt = R x (τ )

−T / 2

31

PROCESSI CASUALI

Densità spettrale di potenza (1)

La densità spettrale di potenza di un processo casuale stazionario x(t) è definita

come la trasformata di Fourier dell’autocorrelazione Rx(τ )

∞

Sx ( f ) =

∫ R (τ ) exp{− j 2πfτ }dτ

Rx (τ ) =

x

−∞

∞

∫ S ( f ) exp{ j 2πfτ }df

x

−∞

Perchè la Sx(f) è una densità spettrale di potenza?

1 - Come si è visto l’autocorrelazione in τ=0, per un processo stazionario,

rappresenta la potenza del processo stesso

Rx (0) = E[ℜ x (0)] = E[ Px ] = P

2 - L’autocorrelazione in τ=0 è uguale all’integrale della sua TDF (th. valore origine):

∞

R x ( 0) =

∫ S ( f ) df

x

=P

−∞

La densità spettrale di potenza per un processo casuale x(t) rappresenta quindi

come è distribuita, statisticamente, la potenza alle varie frequenze.

32

PROCESSI CASUALI

Densità spettrale di potenza (2)

Dato un processo y(t) con media µy possiamo scrivere:

y (t ) = x (t ) − µ y

Ove x(t) è un processo a media 0.

Valgono le seguenti relazioni

R y (τ ) = Rx (τ ) + µ y

2

S y (τ ) = S x (τ ) + µ y δ ( f )

2

Un processo stazionario, con media diversa da 0, ha una densità spettrale di potenza

con un impulso nell’origine di area pari al quadrato della media.

Viceversa un processo con media 0 ha una densità spettrale di potenza senza impulsi

per f=0.

33

PROCESSI CASUALI

Densità spettrale di potenza (significato fisico)

Si supponga che il processo casuale y(t) sia ottenuto da x(t) attraverso un filtro ideale

passa banda centrato sulla frequenza f0 (e, simmetricamente, -f0) con piccola banda ∆f. Si

può ben dire che y(t) contiene le sole frequenze di x(t) nella banda del filtro, cioè in un

intorno di ±fo. Se ∆f è sufficientemente piccolo si ha

Sy ( f ) = Sx ( f0 )

per

f0 − ∆f / 2 < f < f0 + ∆f / 2

e simmetricamente intorno a -f0. La potenza di y(t), cioè la potenza di x(t) nelle bande ∆f ,

è data da

+∞

P=

∫S

y

( f ) df = 2S x ( f 0 ) ∆ f

−∞

Dunque Sx(f0) ha effettivamente il significato di potenza per unità di banda in un intorno di

f0, cioè di densità spettrale di potenza. Nota: l’aggettivo “spettrale” viene usato per

indicare tutto ciò che si riferisce al “dominio” delle frequenze. Si noti che metà della

potenza è attribuita alle frequenze negative! Poiché ciò ha poco senso fisico, spesso si

preferisce definire una densità spettrale unilatera (doppia della “bilatera”; è ovvio che poi

nei calcoli si considerano le sole frequenze positive!)

IMPORTANTE: la densità spettrale di potenza non può essere negativa (a nessuna

frequenza, filtrando, si otterrebbe un processo y(t) con potenza negativa!!)

34

PROCESSI CASUALI

Processi casuali attraverso sistemi LTI (1)

Se un processo casuale x(t) stazionario passa attraverso un sistema lineare tempoinvariante con risposta all’impulso h(t) e risposta in frequenza H(f), il processo casuale in

uscita y(t) è stazionario ed ha le seguenti caratteristiche:

1. In generale la densità di probabilità del processo in uscita y(t) è diversa da quella di

x(t). Solo la densità di probabilità Gaussiana rimane tale nel passaggio del processo

casuale attraverso il sistema LTI: cambiano solo valor medio e varianza.

2. Il valor medio del processo in uscita è legato a quello d’ingresso dalla seguente

relazione:

µ y = µ x ⋅ H ( 0)

3. L’autocorrelazione del processo d’uscita è legata a quella d’ingresso dalla seguente

relazione:

R y (τ ) = Rx (τ ) ∗ h (τ ) ∗ h (− τ )

4. La densità spettrale di potenza del processo in uscita è legata a quella d’ingresso dalla

seguente relazione:

S y ( f ) = Sx ( f ) ⋅ H ( f )

2

35

PROCESSI CASUALI

Processi casuali attraverso sistemi LTI (2)

5. La potenza del processo in uscita dipende dalla densità spettrale di potenza del

processo d’ingresso e dalla risposta in frequenza del sistema LTI secondo la relazione

∞

Py = ∫ S y ( f )df =

−∞

∞

∫ S x ( f ) ⋅ H ( f ) df

2

−∞

6. La varianza del processo in uscita dipende dalla densità spettrale di potenza e dal valor

medio del processo d’ingresso e dalla risposta in frequenza del sistema LTI:

∞

∞

σ = Py − µ y = ∫ S y ( f )df − µ y = ∫ S x ( f ) ⋅ H ( f ) df − µ x H (0 )

2

y

2

−∞

36

2

2

2

−∞

PROCESSI CASUALI

2

Processi casuali bianchi (1)

Si definisce bianco (a valor medio nullo) un processo casuale stazionario con densità

spettrale di potenza costante.

Quindi un processo casuale bianco (a valor medio nullo) ha autocorrelazione

impulsiva.

ATTENZIONE: questa caratteristica è indipendente dalla densità di probabilità delle

ampiezze che può essere di tipo qualsiasi (ad es. Gaussiana, uniforme …)

Si tratta, evidentemente, di una idealizzazione (anche la luce che diciamo “bianca”, da cui

deriva il nome, ha spettro che non si estende all’infinito). Notiamo che un processo

veramente bianco avrebbe potenza infinita!

Nel mondo reale osserviamo solo processi filtrati (con banda più o meno larga). Se la

banda del processo in ingresso è più larga di quella del filtro, possiamo assegnare valori

arbitrari alla densità spettrale fuori banda (senza che cambino i risultati del calcolo). Un

valore costante è il più comodo dal punto di vista matematico.

37

PROCESSI CASUALI

Processi casuali bianchi (2)

x(t)

2

Rx(τ)

0

Sx(f)

N0/2

-2

0

100

τ

px(a)

-5

0

N0/2

f

5

Nota: autocorrelazione impulsiva significa che il valore x(t+τ) del processo bianco al

tempo t+τ è assolutamente impredicibile dal valore x(t) all’istante t : il processo varia in

modo infinitamente rapido!

Se il processo bianco ha valor medio µx diverso da zero, si ha Sx(f)=(N0/2)+|µx|2 δ(f) e

Rx(τ)= (N0/2)δ(τ)+|µx|2

38

PROCESSI CASUALI

Processi casuali bianchi (3)

Solitamente la densità spettrale (bilatera) di un processo casuale x(t) bianco viene indicata

con Sx(f)=N0/2 e quindi la funzione di autocorrelazione con Rx(τ)= N0/2 δ(τ)

Nota: si indica quindi con N0 la densità spettrale di potenza unilatera.

E’ importante saper calcolare la potenza di un processo y(t) ottenuto da un processo bianco

x(t) attraverso un filtro con risposta all’impulso h(t) e risposta in frequenza H(f). Si ha

+∞

+∞

σ = ∫ S y ( f )df = ∫ Sx ( f ) H ( f ) df =

2

2

y

−∞

−∞

+∞

+∞

N

N

2

= 0 ∫ Sx ( f ) H ( f ) df = 0 ∫ h2 (t )dt

2 −∞

2 −∞

39

PROCESSI CASUALI

Correlazione tra uscita e ingresso di un sistema LTI

La correlazione tra due processi casuali ergodici y(t) e x(t) è definita nel modo seguente:

ℜ

yx

1

(τ ) = Tlim

→∞ T

T /2

∫

y * ( t ) x ( t + τ )dt = R yx (τ

)

−T / 2

Se i due processi casuali y(t) e x(t) sono rispettivamente l’uscita e l’ingresso di un sistema

LTI la loro correlazione è uguale alla convoluzione tra l’autocorrelazione dell’ingresso e la

risposta all’impulso del sistema LTI:

R yx (τ ) = R x (τ ) ∗ h (τ

)

Si nota che se il processo d’ingresso è bianco (autocorrelazione impulsiva), la correlazione

tra uscita e ingresso coincide con la risposta all’impulso del sistema.

R yx (τ ) = δ (τ ) ∗ h (τ ) = h (τ

)

Questa proprietà è spesso utilizzata nei sistemi di telecomunicazione per stimare la

risposta impulsiva del canale di trasmissione che è ignoto a priori.

40

PROCESSI CASUALI

Correlazione tra uscita e ingresso bianco

x(t)

Processo bianco

y(t)

?

h(t)

Processo correlato

h(τ)

ℜ

yx

1

(τ ) = Tlim

→∞ T

T /2

∫

y * ( t ) x ( t + τ )dt

=

−T / 2

41

se Sx(f)=1 e

quindi Rx(τ)=δ(τ)

PROCESSI CASUALI

Un esempio importante di processo bianco (1)

Si consideri il processo x(t) le cui realizzazioni sono costituite da treni di impulsi equispaziati

a passo T, con ritardo iniziale τ casuale e area a casuale indipendente da impulso a impulso

con valor medio nullo e varianza σ 2.

x(t ) =

∞

∑ a δ (t − nT − τ )

n = −∞

n

x1(t)

T

τ

t

x2(t)

T

42

τ

t

PROCESSI CASUALI

Un esempio importante di processo bianco (2)

Si può dimostrare che il processo casuale x(t) è STAZIONARIO ed ERGODICO,

con le seguenti proprietà

1. Il valor medio è nullo: µx = 0

2. La varianza è: σ 2 / T

3. L’autocorrelazione è impulsiva (processo bianco): Rx (τ ) = (σ 2 / T ) δ (τ )

4. La densità spettrale di potenza è costante (processo bianco): Sx (τ ) = (σ 2 / T )

43

PROCESSI CASUALI

Se il processo casuale x(t) passa attraverso un sistema LTI con risposta in frequenza

H(f) e risposta all’impulso h(t), in uscita si ottiene un processo y(t) con:

Densità spettrale di potenza: Sy (f ) = (σ 2 / T) |H(f)|2

h(t)

y1(t)

T

H(f)

Sx (f)

f

44

τ

t

Sy (f)

f

f

PROCESSI CASUALI

Il processo casuale y(t) costruito nel modo indicato precedentemente può essere

usato per rappresentare (nel tempo) una sequenza casuale di bit. Ciascuno di essi

sarà codificato, ad esempio, con un impulso rettangolare, di base T, ed ampiezza:

+A (“1”) o -A (“0”):

A

y1(t)

h(t)

+1

+1

T

-1

+1

+1

-1

τ

-1

t

T

1/T

Sx (f)

f

Sx ( f ) = 1 / T

45

|H(f)|2

(AT)2

A2T

Sy (f)

f

h(t ) = A ⋅ rect (t / T )

H ( f ) = AT ⋅ sinc(Tf )

f

S y ( f ) = A2T ⋅ sinc2 (Tf )

PROCESSI CASUALI