POLITECNICO DI TORINO

Facoltà di Ingegneria

Corso di Laurea in Ingegneria Informatica

Dipartimento di Automatica e Informatica

Studio e realizzazione di un sistema di

puntamento oculare

per l'accesso al computer

da parte di disabili motori gravi

Relatore: Ing. Fulvio CORNO

Tesi di Laurea di:

Isabella SIGNORILE

Anno Accademico 2001/2002

Sommario

Molte persone danno per scontato azioni come il parlare e il comunicare. Capacità

molto importanti nella vita di ogni giorno e in molti aspetti della vita di relazione, che

particolari tipi di disabilità possono influenzare, comportando graduali cambiamenti:

pertanto è importante essere consapevoli di come si possa mantenere una

comunicazione efficace.

A questo proposito il computer è una preziosa risorsa per creare ausili di

comunicazione potentissimi e personalizzati alle esigenze individuali, soprattutto per

le persone disabili, per le quali esso offre spazi di integrazione scolastica, lavorativa

e sociale.

Sembra doveroso prima di proseguire dare una definizione del termine ausilio

informatico: per ausilio informatico si intende un ambiente informatico utilizzato da

una persona disabile per prevenire, alleviare o eliminare una menomazione, disabilità o

handicap. Un adeguato ausilio di comunicazione è la porta d'accesso all'integrazione e

offre la possibilità di instaurare con chiunque un'interazione comunicativa.

Le difficoltà che una persona disabile si trova a dover affrontare variano in relazione

alle sue esigenze di vita e alle sue capacità residue. Ad esempio la persona può

sentirsi esclusa ed incompresa a causa della sua impossibilità ad instaurare delle

relazioni con il mondo esterno (la famiglia, gli amici, i colleghi, i compagni di scuola,

etc.) , tale condizione è, nella maggior parte dei casi, causata da una comunicazione

carente o assente.

Il computer è uno strumento di comunicazione, non solo per la persona disabile.

Le tecnologie nell'ambito dei supporti per disabili stanno assumendo sempre maggiore

importanza.

All'interno di questo settore, la presente tesi si colloca nella sottoarea specifica dei

supporti informatici per disabili motori gravi.

A questo proposito si accenna ad una particolare categoria di disabili : le persone

affette da Sclerosi Laterale Amiotrofica (SLA).

La SLA è una malattia neurologica, la più grave tra quelle che colpiscono i

motoneuroni, ovvero le cellule nervose del cervello e del midollo spinale che

controllano i muscoli. La malattia è caratterizzata dal fatto che i motoneuroni vanno

incontro a degenerazione e muoiono, la morte di queste cellule avviene gradualmente,

nel giro di mesi o anche di anni ed ha come conseguenza un progressivo indebolimento

muscolare ed infine la paralisi.

Con il progredire della malattia vengono a mancare capacità come il movimento ed il

parlare, che conducono il malato all'immobilità e all'impossibilità di comunicare.

La SLA colpisce solamente il sistema motorio e risparmia tutte le altre funzioni

neurologiche, inoltre sono raramente toccati i muscoli che controllano i movimenti

oculari.

Un malato di SLA, giunto ad un certo stadio della malattia, potrebbe quindi essere in

grado di esprimersi solamente più attraverso il movimento degli occhi. Da qui nasce

l'idea di utilizzare un ausilio di comunicazione che utilizzi il movimento oculare.

Un sistema di puntamento oculare è appunto un ausilio di questo genere.

I dispositivi standard di puntamento, come ad esempio il mouse o il joystick, sono

spesso difficilmente accessibili ad un disabile motorio per la difficoltà nel compiere

e coordinare i propri movimenti. Una possibile soluzione a questo problema è

rappresentata da un dispositivo che utilizzi lo sguardo come canale di comunicazione.

I primi sistemi basati sull'uso congiunto dell'elaboratore e dello sguardo come "fonte

di decisione" sono nati negli Stati Uniti.

La categoria di sistemi, di questo tipo, su cui si è concentrata la propria attenzione

nell'ambito dello sviluppo della tesi sono stati i sistemi ottici. I sistemi ottici si

basano sull'elaborazione dell'immagine dell'occhio dell'utente ripresa da una

telecamera posta sopra oppure sotto il monitor.

Come funziona un sistema ad inseguimento dell'occhio? Scopo del sistema è quello di

individuare su quale punto del video, del computer, è fissato lo sguardo dell'utente. Il

click del mouse è realizzato tramite una pausa di fissazione dell'occhio sul punto

desiderato. Dietro questo sistema di predizione dello sguardo dell'utente sta

ovviamente un software apposito che si occupa dell'acquisizione, dell'elaborazione

delle immagini e del calcolo della direzione dello sguardo.

Il lavoro di tesi svolto ha avuto infatti lo scopo di realizzare un software che fosse

in grado di predire la direzione dello sguardo dell'utente, limitatamente ad una

tabella di sei celle. La tabella in questione, che rimane visualizzata sullo schermo

durante tutto il tempo d'utilizzo del sistema, ha come unica finalità quella di

mostrare come funziona il sistema progettato, infatti ogni cella su cui l'utente fissa

il proprio sguardo si colora di rosso.

Viene presentato uno schema che mostra la struttura pensata e successivamente

ideata per il progetto:

Il punto di partenza è ovviamente l'acquisizione delle immagini con una webcam, per

realizzare questa operazione si sono utilizzate le funzioni di VFW (Video For

Windows). Ogni immagine acquisita viene trasformata in un'immagine binaria (dove

compaiono cioè solo i colori bianco e nero), dopodiché viene scandita e la

concentrazione di pixel neri viene analizzata in modo da individuare delle aree

specifiche all'interno dell'immagine.

Le due aree più importanti individuate dagli algoritmi sono quella contenente l'occhio

destro (si lavora solo sul movimento di un occhio) e quella contenente l'iride

dell'occhio. Il centro dell'iride coincide col centro della pupilla.

Gli algoritmi di rilevazione dell'occhio destro e del centro pupilla forniscono le

coordinate che identificano la posizione dell'occhio e del centro pupilla nell'immagine

catturata. L'algoritmo di rilevazione del riferimento fornisce invece le coordinate di

un punto di riferimento posto sulla fronte dell'utente (uno stampino nero) che

rappresenta l'origine di un sistema di riferimento comune a tutti i punti man mano

calcolati che vengono espressi in questo sistema di riferimento solidale col viso

dell'utente.

Ad ogni immagine acquisita corrisponderà quindi un punto indicante la direzione dello

sguardo (gaze) e ad una sequenza di immagini corrisponderà una sequenza di punti

(campioni) da cui l'algoritmo di calcolo della fissazione estrarrà le coordinate del

punto fissato. Tali coordinate vengono restituite dall'algoritmo solamente quando la

fissazione in questione risulta terminata e ne ha avuto inizio una nuova.

A questo punto l'algoritmo di predizione individuerà la cella della tabella da colorare

di rosso, cioè la cella fissata dall'utente, in base alle coordinate del punto di

fissazione calcolato dall'algoritmo precedente e in base anche ai risultati ottenuti da

una procedura di calibrazione.

Infatti ogni volta che l'utente intende utilizzare il sistema deve prima inizializzarlo

eseguendo questa procedura, in cui gli è richiesto di fissare il proprio sguardo su sei

differenti punti, ognuno dei quali corrispondente ad una cella della tabella.

Al termine della procedura il sistema è riuscito a memorizzare le coordinate dei sei

punti fissati dall'utente, che rappresentano una sorta di "mappa" del video a cui

l'algoritmo di predizione si riferisce per riuscire ad determinare su quale delle sei

celle fosse indirizzato lo sguardo dell'utente.

La durata della pausa di fissazione richiesta, affinché gli algoritmi riescano a

calcolare il punto fissato, è paria a 2 - 3 secondi, quindi se l'utente sceglie di "far

colorare" una cella della tabella deve mantenere il suo sguardo fisso su di essa per

almeno 2 - 3 secondi.

Il numero di campioni elaborati al secondo dal sistema è 2,67 campioni al secondo.

Sicuramente le modifiche e i miglioramenti da apportare al lavoro sono ancora molti e

questo al fine di renderlo un sistema realmente ed utilmente utilizzabile da un

disabile motorio grave, come può essere un malato di SLA.

Lo sviluppo di questo progetto mi ha permesso di avvicinarmi ad un mondo che spesso,

per distrazione o superficialità, si è portati a trascurare. Senza conoscerlo è

difficile capire quali siano gli ostacoli che un disabile motorio grave incontra.

Più ci si addentra in questo mondo è più nascono idee su come poter in futuro

ampliare il sistema per fornire un controllo dell'elaboratore, e non solo, sempre

maggiore.

La speranza è quella di poter integrare il software realizzato con un software di

comunicazione che permetta di creare le condizioni affinché il disabile abbia

l'opportunità di comunicare in modo efficace ovvero di tradurre il proprio pensiero in

una serie di segni intelligibili per l'interlocutore.

Molto è stato fatto nel campo della disabilità motoria, ma purtroppo i risultati

maggiori si sono avuti prevalentemente all'estero. Non sempre è immediata la

possibilità di utilizzare materiale proveniente da altri paesi, questo a causa di

incompatibilità di simboli, lingua e abitudini.

E' per questo motivo che si rende sempre più urgente la necessità di sviluppare

materiale accessibile anche in Italia dove purtroppo le realizzazioni proposte sono

ancora insufficienti.

Questa tesi ha la speranza di porre delle basi su cui sviluppare ampliamenti futuri in

questo senso.

Ringraziamenti

Devo un doveroso ringraziamento a tutti coloro che hanno reso possibile la

realizzazione di questo progetto.

In primo luogo ai miei genitori per il sostegno e l'incoraggiamento che hanno saputo

darmi in questi cinque anni di studio.

Ringrazio Lorenzo DeFilippis per avermi aiutato nel reperimento della necessaria

bibliografia e per avermi permesso di addentrarmi in questo particolare ambito

sociale, al fine del completamento dei miei studi.

Ringrazio inoltre Luca Federzoni (tecnico informatico) per la sua disponibilità e

l'assistenza tecnica fornitami durante la progettazione del software.

Ringrazio il mio relatore, il professor Fulvio Corno per la disponibilità e la pazienza

con cui mi ha seguito durante lo svolgimento di questa tesi.

Infine un grazie a tutte le persone che mi hanno dimostrato la loro fiducia e il loro

appoggio.

Indice

SOMMARIO

3

RINGRAZIAMENTI

9

INDICE

11

1. INTRODUZIONE

16

2. STATO DELL'ARTE

22

2.1 INTRODUZIONE

22

2.2 BREVE STORIA DEL SOFTWARE ACCESSIBILE

23

2.3 SOFTWARE ACCESSIBILE

30

2.3.1 AUSILI INFORMATICI

30

2.3.2 CONVEGNI

34

3.INTRODUZIONE AI SISTEMI EYE-TRACKING

36

3.1 INTRODUZIONE

36

3.2 COMUNICAZIONE AUMENTATIVA ED ALTERNATIVA

37

3.3 SCELTA DELLO SGUARDO COME CANALE DI COMUNICAZIONE

40

Indice

3.4 CONDIZIONI D'USO DI UN SISTEMA A PUNTAMENTO OCULARE DA PARTE

43

DI PERSONE AFFETTE DA DISABILITA' FISICHE

3.5 SOMMARIO

46

4. DESCRIZIONE DELLA STRUTTURA DEL SISTEMA PROGETTATO

48

4.1 INTRODUZIONE

48

4.2 ANALISI E SPECIFICA DEI REQUISITI

49

4.3 SOLUZIONE DEL PROBLEMA

50

4.4 PROGETTO LOGICO

51

4.4.1 ACQUISIZIONE PERIODICA DELLE IMMAGINI DALLA WEBCAM

54

4.4.2 RILEVZIONE POSIZIONE DELL'OCCHIO E DELLA PUPILLA

58

4.4.3 INDIVIDUAZIONE DEL RIFERIMENTO E DETERMINAZIONE DELLA

DIREZIONE DELLO SGUARDO

65

4.4.4 CALCOLO PUNTO DI FISSAZIONE

70

4.4.5 INDIVIDUAZIONE DELL'AREA FISSATA

73

4.5 LA PROCEDURA DI INIZIALIZZAZIONE DEL SISTEMA:

74

LA CALIBRAZIONE

5. REALIZZAZIONE SPERIMENTALE DEI SINGOLI MODULI

DEL SISTEMA

80

5.1 INTRODUZIONE

80

5.2 LINGUAGGIO DI PROGRAMMAZIONE E LIBRERIE

81

5.3 REALIZZAZIONE DEL SOFTWARE

82

5.3.1 SUPPORTI ALL'IMPLEMENTAZIONE

APPLICAZIONE DIMOSTRATIVA

DI UNA

83

Indice

5.3.2 IMPLEMENTAZIONE DEL SOFTWARE

85

5.3.2.1 RAPPRESENTAZIONE SCHEMATICA DEI MODULI

DEL PROGETTO

87

5.3.2.2 DESCRIZIONE DEI DIVERSI MODULI DEL

PROGETTO

89

5.3.2.3 BREVE DESCRIZIONE DEI FILE

D'INTESTAZIONE DEL SISTEMA

6. VALUTAZIONI

99

103

6.1 INTRODUZIONE

103

6.2 INDIVIDUAZIONE DI CATEGORIE DI DISABILITA'

104

6.3 UTILIZZO DEL SISTEMA

106

6.3.1 PRESENTAZIONE DEL SISTEMA

106

6.3.2 ANALISI DEI DATI OTTENUTI DA UNA PROVA DI

UTILIZZO DEL SISTEMA

6.4 VALUTAZIONI TECNICHE: FATTORI DI QUALITA'

7. DIREZIONI FUTURE DI RICERCA

110

113

118

7.1 INTRODUZIONE

118

7.2 POSSIBILITA' DI APPLICAZIONE PER NORMODOTATI

119

7.3 MIGLIORAMENTI FUTURI PREVISTI

121

7.4 POSSIBILITA' DI APPLICAZIONE DA PARTE DI MALATI DI SLA

123

8. CONCLUSIONI

126

Indice

9. BIBLIOGRAFIA

128

APPENDICI

APPENDICE A. AUSILI INFORMATICI E TECNOLOGIE PER DISABILI

132

APPENDICE B. SISTEMI DI PUNTAMENTO OCULARE

139

APPENDICE C. ANATOMIA E FISIOLOGIA DELL'OCCHIO UMANO, MOVIMENTI

OCULARI

147

APPENDICE D. ELABORAZIONE ED ANALISI DELL'IMMAGINE

153

APPENDICE E. CODICE SORGENTE DEI MODULI DEL SISTEMA

159

1 Introduzione

Il problema dell’integrazione dei disabili e dei portatori di handicap in generale, è

oggi di grande attualità.

Spesso una persona disabile soffre per la sua impossibilità ad instaurare delle

relazioni con il mondo esterno (la famiglia, gli amici, i colleghi, i compagni di scuola,

etc.) , tale condizione è, nella maggior parte dei casi, causata da una comunicazione

carente o assente.

Infatti comunicare è sinonimo di relazione, una relazione è sempre comunicativa.

Il computer è uno strumento di comunicazione, non solo per la persona disabile.

Oggigiorno l'utilizzo dell'elaboratore è molto diffuso nei centri di assistenza per

disabili di ogni genere, mentali e motori. Le tecnologie nell'ambito dei supporti per

disabili stanno assumendo sempre maggiore importanza.

All'interno di questo settore, la presente tesi si colloca nella sottoarea specifica dei

supporti informatici per disabili motori gravi.

Lo scopo della presente tesi è quello di fornire un sistema software che funzioni da

emulatore di mouse, (la parte hardware non richiede nient'altro che una webcam e

ovviamente un computer) e che permetta all'utente disabile di controllare con il

proprio sguardo ciò che avviene sul video.

L'utilizzo di tale sistema andrà poi affiancato a quello di un software di

comunicazione appropriato.

Si fa infatti riferimento alla comunicazione alternativa, cioè a quell'insieme di

strategie di comunicazione alternative alla comunicazione verbale e grafica.

Per quando riguarda le informazioni raccolte nel campo dei supporti informatici per

disabili motori gravi e in particolare sui sistemi di puntamento oculare, si è fatto per

la maggior parte ricorso a documenti reperiti in Internet.

16

Capitolo 1: Introduzione

Testi scritti, riguardanti ausili informatici e tecnologie per disabili e trattanti il

problema di disabilita' ed accessibilità, sono invece stati forniti dall'EasyLabs di

Torino.

Come già spiegato sopra, lo scopo della tesi è quello di fornire il prototipo di un

sistema a puntamento oculare, che permetta ad un disabile motore grave l'accesso

all'elaboratore senza utilizzare i dispositivi standard di selezione (mouse e tastiera),

che spesso richiedono una fermezza nei movimenti non presente nel disabile.

Per raggiungere questo obiettivo è stato realizzato un sistema capace di individuare,

quale, tra diverse aree, sia quella fissata dall'utente sul video.

La scelta dello sguardo come canale di comunicazione non è casuale: in passato e

anche tuttora uno dei sistemi utilizzati per comunicare con persone che non sono in

grado, a causa delle loro disabilità, di usufruire di altri strumenti comunicativi (la

parola, la scrittura, sistemi di accesso all computer che prevedono l'uso degli arti, sia

inferiori che superiori), è l'écran. Questo è un sistema che si basa appunto

sull'utilizzo di una lastra di plexiglass trasparente su cui sono riportate le lettere

dell'alfabeto. La lastra viene posta tra il

disabile e l'interlocutore, il quale deve capire su quale lettere si posa lo sguardo

dell'altra persona.

Con l'esperienza si raggiunge una buona velocità di composizione delle parole:

sfruttando la

rapidità dell'occhio si possono scambiare notevoli quantità di informazioni.

Un tale sistema ha però molti limiti, fra cui quello di poter comunicare soltanto con

interlocutori esperti ed "allenati" ed inoltre l'impossibilità di poter parlare a più di

una persona per volta.

I sistemi ad inseguimenti dell'occhio che si basano sull'elaborazione delle immagini

sono di gran lunga più accurati ed affidabili.

Esistono in commercio due categorie di prodotti: dispositivi da fissare al capo

dell'utente oppure dispositivi "remoti", come ad esempio telecamere montate sopra o

sotto il monitor del computer.

17

Capitolo 1: Introduzione

Quest'ultima possibilità è forse preferibile, in quanto nulla è fisicamente collegato

all'utente, che, in questo modo, si sente più a suo agio.

Il sistema sviluppato durante la tesi funziona da emulatore di mouse, dove il "clik"

(selezione di una determinata area) è realizzato tramite una pausa di fissazione dello

sguardo sul punto dello schermo che l'utente desidera attivare.

Il prototipo realizzato come progetto di tesi prevede la possibilità di distinguere in

quale zona del video sia indirizzato lo sguardo della persona.

E' previsto che sul video venga mostrata, all'utente del sistema, una tabella

composta da sei elementi (zone), questo significa che l'algoritmo di rilevazione delle

fissazioni individuerà non il punto fissato dall'utente, ma l'area entro cui cade il suo

sguardo .

Tutti gli algoritmi realizzati per il progetto del sistema sono stati scritti in

linguaggio C.

Avendo finora illustrato come è realizzato il sistema e quale sia il suo scopo, c'è da

aggiungere che esso è destinato ad una particolare categoria di disabili: le persone

affette da Sclerosi Laterale Amiotrofica (SLA).

La SLA è una malattia fatale, degenerativa, che colpisce i motoneuroni, cioè le cellule

nervose del cervello e del midollo spinale che controllano i muscoli.

Questa malattia comporta l'indurimento (Sclerosi) della porzione laterale (Laterale)

del midollo spinale e dimagrimento (Amiotrofica) muscolare.

In Francia è detta Malattia di Charcot, dal nome del neurologo che la identificò per

primo nel 1869. Nei paesi i lingua inglese si chiama ALS (Amyotrophic Lateral

Sclerosis) oppure MND (Moto Neuron Disease). Negli USA è anche nota come

malattia di Lou Gehring, famoso giocatore di baseball che contrasse la malattia nel

1939, all'apice della sua carriera agonistica.

In Italia è una malattia neurologica poco conosciuta.

A causa della SLA i motoneuroni muoiono prima del tempo, provocando alla persona

colpita un progressivo indebolimento muscolare e conducendola alla paralisi, ma i

18

Capitolo 1: Introduzione

primi segni della malattia compaiono solo quando la perdita progressiva dei

motoneuroni supera la capacità di compenso dei motoneuroni superstiti.

Generalmente la SLA colpisce persone adulte di entrambi i sessi, in un'età compresa

fra i 40 e i 70 anni.

Le cause della malattia sono ancora sconosciute, sicuramente è determinata da più

circostanze: si ipotizza che una certa predisposizione genetica e più fattori

ambientali debbano interagire. In ogni caso non può essere considerata ereditaria.

Il primo sintomo della SLA è una progressiva perdita di forza, che può riguardare

tutti i movimenti dei muscoli volontari. Oltre alla debolezza si possono avvertire

rigidità (spasticità), contrazioni muscolari involontarie, a volte anche dolorose

(crampi).

La SLA può alterare il controllo muscolare delle strutture che intervengono nella

parola, comportando varie difficoltà nella comunicazione.

La malattia colpisce solo il sistema nervoso e risparmia tutte le altre funzioni

neurologiche: le funzioni mentali, sensoriali, sessuali, il controllo di vescica ed

intestino sono preservati.

Quando la mobilità agli arti superiori , l'abilità di scrittura e la parole vengono

gravemente compromesse, è necessario utilizzare strumenti alternativi di

comunicazione.

In genere le persone colpite da SLA sono comunque in grado di controllare il

movimento degli occhi, che, ad un certo stadio della malattia, può rappresentare

l'unica modalità che permette al paziente di interagire ancora con gli altri e con il

computer. Il computer può

rappresentare maggiore libertà di espressione, tramite esso si possono esprimere

opinioni, domande, risposte, richieste, affermazioni e sentimenti.

E' necessario tenere presente che qualora si usi un metodo di comunicazione

alternativa,

questo sarà lento. Tuttavia non vi sono limiti a ciò che si può comunicare: Stephen

Hawking, un noto fisico affetto da SLA, grazie ad uno strumento di comunicazione

19

Capitolo 1: Introduzione

alternativa è in grado di tenere conferenze ed ha inoltre scritto molti testi

diffusamente letti.

La tesi è strutturata nel modo seguente.

Nel capitolo due si mostra lo stato dell'arte evidenziando quale sia stato il punto di

partenza di questo lavoro e quali siano state le motivazioni che hanno portato allo

sviluppo di tale sistema.

Nel capitolo tre si illustra come è stato impostato il problema di ricerca, aprendo

anche una finestra sul mondo della disabilità fisica e sulle difficoltà che un disabile

motore grave incontra nell'utilizzo di un elaboratore.

Nel capitolo quattro si mostra come è stato affrontato concettualmente il problema,

giungendo, mediante una scomposizione in sottoinsiemi più semplici, alla

rappresentazione dell'architettura del sistema.

Nel capitolo cinque si illustra il progetto sotto un punto di vista tecnicamente più

specifico, discutendo su ciò che si è realizzato materialmente.

Nella sezione sei si descrivono le attività sperimentali svolte che hanno permesso una

valutazione critica del sistema.

Nella sezione sette vengono approfondite le prospettive future di ricerca.

Nelle conclusioni si riassumono gli scopi, le valutazioni di questi e le prospettive

future.

20

2 Stato dell'arte

2.1 INTRODUZIONE

Fare la storia della legislazione in favore dei disabili significa anche fare la storia

della condizione delle persone handicappate e capire meglio come, quando e quanto

sono cambiate nel nostro Paese la concezione dell’handicap e soprattutto la

condizione di quanti ne sono portatori.

In questo sguardo retrospettivo non occorre tornare molto indietro: basta fermarsi

alla fine del secolo scorso e agli inizi del ‘900.

E’ soltanto a partire da questo periodo che si comincia a delineare un quadro

evolutivo della normativa in questo settore.

Come si vedrà in seguito si tratta di un’evoluzione lenta, complessa, frammentaria, a

volte contraddittoria e che soltanto con adeguate forzature possiamo

completamente considerare a favore dei portatori di handicap.

22

Capitolo 2: Stato dell'arte

2.2 BREVE STORIA DEL SOFTWARE ACCESSIBILE

Nel 1984 l'Ufficio del Servizio di Educazione Speciale e Riabilitazione del

dipartimento dell'Educazione Statunitense insieme alla Casa Bianca prese l'iniziativa

di condurre un processo che portasse i produttori degli elaboratori e del software e

gli utilizzatori a riflettere sulla questione riguardante l'accesso e l'uso

dell'elaboratore e del software da parte di persone con disabilità.

Il primo incontro di tale iniziativa si tenne nel Febbraio del 1984 presso la Casa

Bianca.

Il risultato ottenuto fu il riconoscimento del problema dell'accessibilità ad un

ambiente informatico di comune utilizzo e la richiesta, da parte dei produttori, di

ulteriori informazioni inerenti ai tipi di disabilità, alle limitazioni che incontra una

persona disabile nell'utilizzare un elaboratore tradizionale, alle strategie che

avrebbero potuto incrementare l'usabilità dell'elaboratore stesso.

L'accesso al computer e ai programmi software deve garantire a chiunque, incluse le

persone disabili, la possibilità di usare vantaggiosamente la tecnologia in ambito

lavorativo, educativo e ricreativo.

In seguito all'incontro di febbraio, fu stesa la prima versione della White Paper che

venne distribuita come preparazione per un secondo incontro tenutosi il 24-25

ottobre 1985.

Risultato di questo secondo incontro fu la formazione di un gruppo di lavoro volto ad

identificare e documentare idee e considerazioni aventi lo scopo di incrementare

l'accessibilità degli elaboratori standard da parte sia di persone disabili, che

normodotate.

A grandi linee il problema generale può essere suddiviso in una serie di questioni più

semplici:

Una porzione importante della popolazione presenta delle disabilità (acquisite

alla nascita, o in seguito ad un incidente, a causa di una malattia o semplicemente

dovute alla vecchiaia) che impediscono loro di utilizzare i computer standard e i

software tradizionali.

23

Capitolo 2: Stato dell'arte

I costi per le modifiche necessarie da apportare agli elaboratori, per venire

incontro alle esigenze delle persone disabili, sarebbero non eccessivi o

addirittura irrisori ed incrementerebbero il numero di possibili utenti.

La caratteristica di accessibilità di un prodotto ne rende anche più semplice

l'utilizzo da parte delle persone non disabili, in quanto queste possono usufruire

di benefici quali minor fatica, maggiore velocità e minor probabilità d'errore.

La maggior parte delle modifiche al design dovrebbero realizzarsi gratuitamente

oppure ad un prezzo contenuto, per ottenere un beneficio diretto sul mercato di

massa.

La maggior parte dei cambiamenti necessari a rendere un prodotto accessibile

dovrebbero già essere inclusi direttamente nel prodotto stesso.

La White Paper rappresenta il primo passo compiuto dalle industrie del software per

andare incontro alle esigenze dei disabili.

Lo scopo di questo documento è triplice.

In primo luogo si propone di informare le persone che operano nel campo della

riabilitazione.

In secondo luogo di documentare l'importanza e le ragioni del software accessibile.

Infine di riuscire a sensibilizzare i produttori stimolandoli a lavorare, al fine di

garantire alle persone disabili la possibilità di usufruire di tutte le prestazioni in

condizioni di adeguata affidabilità ed autonomia.

Ma che cosa si intende per accessibilità?

L'accessibilità si riferisce alla progettazione dell'ambiente costruito, dei prodotti e

dei servizi di uso generale in modo che questi possano essere utilizzati agevolmente

dalla più ampia percentuale di popolazione, incluse le persone disabili od anziane.

Più specificatamente per accessibilità informatica si intende la possibilità, anche da

parte di persone con impedita capacità motoria, di accedere ad un ambiente

24

Capitolo 2: Stato dell'arte

informatico di comune utilizzo e di fruire di tutte le prestazioni in condizioni di

adeguata affidabilità ed autonomia.

Il 26 luglio 1990 di fronte a tremila persone il Presidente Bush firmò la legge ADA

(the Americans with Disabilities Act), la prima legge al mondo riguardante i diritti

civili delle persone disabili.

La frase pronunciata dal Presidente in quell'occasione - "Let the shamful walls of

exclusion finally come tumbling down" - sintetizza il messaggio della legge ADA:

milioni di Americani disabili avevano trovato una protezione legale che assicurava loro

uguali opportunità ed accesso alla vita pubblica americana.

Oggi in Europa 37 milioni di cittadini soffrono varie forme di handicap.

L'Italia, in base ad una stima della Divisione della popolazione dell'ONU, è fra i paesi

a elevato tasso di invecchiamento per la più alta percentuale di ultrasessantenni

(24%) e per la più bassa percentuale (14%) di giovani di età inferiore ai 15 anni. In

base alle previsioni dell'Istituto di ricerche sulla popolazione del CNR in futuro nel

nostro paese ci saranno 17 milioni di anziani e 8-9 milioni di giovani.

E' evidente l'importanza crescente del tema della disabilità negli anni a venire. Il

progressivo invecchiamento della popolazione italiana, infatti, rende necessari

interventi, anche attraverso tecnologie innovative, per migliorare le condizioni di vita

delle persone che, a causa dell'età, soffrono di disabilità di varia natura.

La continua innovazione tecnologica è riuscita a raggiungere risultati di rilievo,

garantendo a molti disabili una vita uguale a quella delle persone normodotate:

studiano, lavorano, viaggiano e praticano sport perfino a livello agonistico.

In futuro la società si dovrà porre l'obiettivo di ricercare una sempre migliore

integrazione dei disabili.

25

Capitolo 2: Stato dell'arte

CLASSIFICAZIONE DELLE DISABILITA'

Finora si è parlato di disabilità senza specificare cosa si intendesse con questo

termine.

Disabilita' è la limitazione, più o meno grave, della capacità di assolvere compiti e

soddisfare bisogni in modo adeguato, a causa di menomazioni (qualsiasi perdita o

anomalia a carico di strutture o funzioni psicologiche, fisiologiche o anatomiche) o

danni, singoli e multipli.

Si riporta di seguito una suddivisione per tipo di handicap, al fine di chiarire il

conteso specifico.

Disabilità fisica: un individuo che presenta tale disabilità incontra diverse

limitazioni nell'uso dei dispositivi standard di input dell'elaboratore. La causa di

tali problemi è dovuta ad un basso controllo muscolare, alla debolezza e alla

fatica, alla difficoltà a provare sensazioni tattili, ad afferrare oggetti ed in

genere a compiere operazioni complesse (ad esempio premere e ruotare). Per una

persona affetta ad esempio da paralisi celebrale o sclerosi multipla o distrofia

muscolare, i movimenti rotatori possono risultare molto difficili od impossibili.

Queste persone devono quindi poter utilizzare ausili che sfruttino le loro abilità

residue. La possibilità di collegare dispositivi di input alternativi permette

l'accesso ad un elaboratore anche a persone con disabilita' motorie più gravi. Le

cause più comuni di questo tipo di disabilità sono:

danni alla spina dorsale (paraplegia, tetraplegia), traumi celebrali, ictus celebrali,

mancanza di arti o dita (per amputazioni o difetti di nascita), morbo di Parkinson,

sclerosi multipla, sclerosi laterale amiotrofica (SLA), distrofia muscolare.

Disabilità visiva: in questa categoria di disabilità rientrano persone aventi una

vista molto debole, quelle colpite da istagmo ed infine quelle cieche. I problemi

più comuni sono: vista offuscata, presbiopia, miopia, mancanza di visione

periferica, sensibilità anormale alla luce, diminuzione di vista notturna, etc.

26

Capitolo 2: Stato dell'arte

Secondo il trend demografico, che indica un aumento della popolazione anziana, i

problemi legati a questo tipo di disabilita' aumenteranno certamente nei prossimi

anni. I problemi principali che questa categoria di disabili presenta, nell'utilizzo

di un elaboratore, sono legati alla loro difficoltà nel visualizzare testi ed

immagini sullo schermo o nell'utilizzare strumenti in cui le operazioni da compiere

sono dipendenti dalla capacità visiva dell'utente (ad esempio il mouse) oppure il

cui sistema di input sia basto sul video (ad esempio touschscreen). Per le persone

che presentano ancora capacità visive residue, un aiuto può essere rappresentato

da caratteri molto grandi e elevati contrasti di colore.

Se invece i problemi di vista sono più seri si può ricorrere all'utilizzo del braille

oppure agli screen reader , che sono programmi aventi la funzione di lettore

vocale. Questi programmi utilizzano cioè un sintetizzatore vocale che legge il

testo scritto sul video ed emette una serie di messaggi vocali interattivi, che

facilitano l'organizzazione dei percorsi e permettono all'utente non vedente di

muoversi con sicurezza all'interno dei dati contenuti nel computer.

Disabilità uditiva: in questa categoria di disabilita' sono compresi ogni tipo e

grado di disturbo uditivo. Problemi di udito si riscontrano in persone di ogni età,

ma sono comunque una delle principali conseguenze del processo 'invecchiamento.

L'individuo colpito da tale disabilita' incontra poche difficoltà nell'utilizzo di un

elaboratore, in quanto gli output sonori possono essere sostituiti con immagini

grafiche, ovviamente c'è da tenere in considerazione i problemi di linguaggio che

una persona sordomuta può dover affrontare.

Disabilità cognitiva: la persona colpita da tale disabilità può presentate diversi

problemi: incapacità a ricordare, assenza o danneggiamento di specifiche funzioni

cognitive (soprattutto il linguaggio). I problemi cognitivi possono interessare la

memoria, la percezione, la capacità a risolvere problemi di vario genere e

difficoltà concettuali. Le cause di tale disabilita' possono essere: ritardi mentali

(nella maggior parte dei casi la causa è sconosciuta, sebbene infezioni, sindrome

di Down nascita prematura, trauma alla nascita o mancanza di ossigeno possono

27

Capitolo 2: Stato dell'arte

provocare un ritardo mentale) , amnesie di breve o lungo termine, processo di

invecchiamento. La persona disabile che presenta problemi cognitivi incontra le

difficoltà maggiori nell'uso dei software standard. Strategie di soluzione in

quest'area sono molto generali e possono rivolgersi a problemi di linguaggio, di

astrazione o altro.

Disabilità multiple: spesso si verifica che la causa di un danno singolo ne induca

anche altri. In particolare ciò può succedere quando il danno o il trauma è molto

grave o se la persona è in età avanzata. Alcune persone possono presentare sia

disabilità mentali che fisiche, con la conseguente limitazione funzionale in più

aree della loro attività quotidiana. La paralisi celebrale spesso è accompagnata da

problemi visivi, uditivi e disordini linguistici o problemi cognitivi.

IL PASSAGGIO IN EUROPA

Le ripercussioni dell'avvenimento del luglio 1990 si sono fatte sentire anche in

Europa.

Nel marzo del 1992 iniziò un progetto di elaborazione delle "Nordic Guidelines for

Computer Accessibility" da parte della NNH (Nordic Committee on Disability).

La NNH è una cooperazione, sotto il Nordic Council of Ministers, comprendente i

governi danese, finlandese, norvegese e svedese.

Lo scopo della NNH è la realizzazione di obbiettivi nazionali di piena partecipazione

nella società e di uguaglianza per le persone disabili.

Il Nordic Guidelines for Computer Accessibility è il risultato di un progetto

riguardante l'informazione tecnologica (IT). L'IT è una parte delle infrastrutture

della società moderna.

Gli elaboratori sono ormai parte integrante nell'educazione e nel lavoro. E' stato

stimato che il 70% del lavoro d'ufficio in Europa è svolto in posti di lavoro

informatizzati (stima della IDC Svezia).

28

Capitolo 2: Stato dell'arte

La Cooperazione Internordica di Standardizzazione delle informazioni Tecnologiche

(INSTAT/IT) ha supportato questo progetto con la seguente dichiarazione:

"ISTAT/IT crede che si debba provvedere affinché le persone disabili abbiano la

possibilità di usare attrezzature IT. INSTAT/IT accoglie favorevolmente il

progetto e lo considera un buon inizio in questo settore. Stiamo attendendo i

risultati, sotto forma di guida, e ci aspettiamo di poterli usare per un lavoro di

standardizzazione regionale, nazionale ed internazionale".

Alla base di questa pubblicazione ci sono due documenti: il primo è la White Paper

citata in precedenza, mentre l'altro è una specifica di requisiti prodotta in

collaborazione dall'Agenzia Svedese per lo Sviluppo Amministrativo e dall'Istituto

Svedese di Handicap.

L'Organizzazione Mondiale della Sanità stima la percentuale di popolazione disabile

almeno nel 10%. Queste persone non costituiscono un gruppo omogeneo e statico,

anche il tipo di disabilità può essere temporaneo o permanente e variare d'intensità.

Nei paesi industrializzati si vive di più, ma le nascite diminuiscono. Le persone hanno

acquisito le abitudini introdotte dalle attuali tecnologie, ma per alcuni l'accesso ad

esse può essere progressivamente ridotto a causa di limitazioni dovute all'età

avanzata.

Queste riflessioni devono sicuramente aiutare a riflettere sull'importanza della

questione dell'accessibilità all'elaboratore.

Con l'avvento e la diffusione della telematica, nuove possibilità di integrazione

economica e sociale si aprono per la popolazione disabile ed anziana. Tuttavia a

quest'interessante prospettiva si contrappongono problematiche che, se non

opportunamente considerate, possono aumentare l'isolamento di queste categorie di

persone.

Rendere un terminale/servizio di facile uso per una persona disabile è garanzia di

alta usabilità per ogni utente.

29

Capitolo 2: Stato dell'arte

Per fare ciò è però necessario lo sviluppo di nuove aree di conoscenza, che includano i

tipi e il grado di disabilità, le conseguenze e le limitazioni che deve affrontare una

persona disabile, gli aspetti psicologici ed economici ed infine le strategie per

incrementare l'usabilità del prodotto.

2.3 SOFTWARE ACCESSIBILE

2.3.1 AUSILI INFORMATICI

Viene proposta una descrizione di alcuni ausili informatici suddivisi per tipo di

disabilità.

Particolare importanza sarà data ai supporti informatici per disabili motori.

Cerchiamo prima di tutto di dare una definizione del termine ausilio.

L'ausilio è un oggetto che permette a chi lo utilizza di instaurare delle relazioni con

le persone che lo circondano.

In questo sta la vera utilità dell'ausilio: dare alla persona disabile la possibilità di

entrare in relazione con gli altri, a casa, a scuola, al lavoro, etc.

Questa possibilità fa sì che la persona disabile abbia un'immagine di sé migliore,

perché si sente parte attiva nei suoi rapporti con gli altri e non un emarginato o un

diverso.

Anche l'ausilio informatico è un oggetto, che serve a creare relazioni comunicative,

che determinano apprendimenti cognitivi che possono aumentare e facilitare contesti

relazionali e sociali: tutto ciò contribuisce al rafforzamento dell'identità della

persona.

Volendo dare una definizione più tecnica, l'ausilio è uno strumento che consente al

disabile di fare ciò che altrimenti non riuscirebbe a fare, oppure di farlo in maniera

più sicura, veloce, meno faticosa, più accettabile psicologicamente, o infine per

prevenire l'instaurarsi o l'aggravarsi di una disabilità.

30

Capitolo 2: Stato dell'arte

Disabilità visiva

Negli Atti della IV Conferenza Internazionale del Computer per Persone portatrici di

Handicap (1994) viene esposto un metodo che permette agli utenti ciechi di "vedere",

attraverso le proprie mani, il funzionamento di Windows: le finestre vengono

percepite tramite una simulazione fisica di oggetti che si sovrappongono.

Un altro metodo sfrutta invece l'udito, senso che generalmente una persona cieca

possiede ben sviluppato. Si parte dal presupposto che si possa determinare se un

suono proveniente da un'orchestra sia generato da uno strumento in prima, seconda o

terza fila.

Con un ragionamento analogo i suoni prodotti dalle singole finestre di Windows

avranno una tonalità diversa in modo che l'utente cieco possa percepire le

disposizioni delle finestre sul video.

Disabilità uditiva

Dal momento che tale disturbo non comporta un grave disagio nell'utilizzo

dell'elaboratore, pochi sono gli sviluppi. Del resto è sufficiente, per facilitare

l'utente affetto da questa disabilità, l'introduzione di immagini che sostituiscano i

messaggi sonori.

Disabilità cognitiva

Per quanto riguarda questo campo della disabilità viene particolarmente sviluppato il

discorso inerente ad informatica e didattica. A tal fine in Italia si tiene

regolarmente un Convegno Nazionale dal titolo Informatica, Didattica e Disabilità.

L'elaboratore può essere sfruttato per stimolare, tramite immagini e suoni, i ragazzi

sia normodotati che afflitti da disabilità mentali.

Per quanto riguarda la disabilità verbale grave si ricordano i metodi per la

comunicazione aumentativa ed alternativa, tra cui ad esempio il linguaggio Bliss: si

tratta di un linguaggio simbolico in cui ad ogni simbolo è associato un termine, sia

31

Capitolo 2: Stato dell'arte

questo un sostantivo, un verbo o un aggettivo. Ogni categoria di simboli è

rappresentata da un colore diverso in modo da facilitare l'individuazione delle parole.

La storia di questo linguaggio è singolare: fu ideato per facilitare la comunicazione

tra i vari paesi della Cina dal momento che il grande numero dei dialetti impediva alle

persone di comunicare tra loro.

Il termine Comunicazione Aumentativa ed Alternativa (AAC) si riferisce a tutte le

strategie di comunicazione che sono alternative o incrementano la comunicazione

verbale e grafica.

Esistono sia prodotti hardware che software per la AAC.

I prodotti software godono delle potenzialità sempre crescenti dell'informatica e

della enorme capacità di memorizzazione ed elaborazione dei dati del computer, e al

tempo stesso permettono l'uso del computer anche per attività diverse dalla AAC.

Disabilità fisica

Non esiste una separazione netta tra i supporti rivolti a questo tipo di disabilita' e

quelli analizzati precedentemente per disabilità cognitive, in quanto spesso i due

problemi sono strettamente collegati.

La società EasyLabs di Torino ha permesso di inquadrare il problema

dell'accessibilità all'elaboratore grazie all'elevato numero di ausili informatici di cui

dispone.

Si ricordano: tastiere speciali, riprogrammabili (in cui è possibile ridefinire a piacere

il significato dei tasti), tastiere a video, mouse speciali, sistemi per il controllo del

computer

e per la comunicazione attivabili attraverso sensori esterni, accessibili anche con

ridottissime capacità motorie.

L'utilizzo di una comune tastiera può essere critico a causa di problemi nel controllo

degli arti superiori. Per superare tale difficoltà è, a volte, sufficiente adottare delle

modifiche alle impostazioni software del computer che si sta utilizzando, in altri casi

è possibile identificare delle soluzioni alternative. Ad esempio si può utilizzare una

32

Capitolo 2: Stato dell'arte

tastiera ridotta (caratterizzata da dimensioni ridotte e tasti piccoli, ravvicinati e

molto sensibili), oppure una tastiera espansa (tastiera di grandi dimensioni, con tasti

ingranditi).

Esistono inoltre tastiere a video con cui l'iterazione avviene tramite un dispositivo di

puntamento oppure tastiere con display indipendenti dal computer.

I mouse speciali sono una valida alternativa al mouse standard per coloro che

presentano difficoltà nel controllare il movimento del puntatore e le funzioni dei

tasti.

In questa categoria rientrano gli emulatori di mouse: dispositivi che permettono di

controllare, attraverso sistemi diversi, il movimenti del puntatore e di svolgere tutte

le funzioni, o quasi, del mouse. Ad esempio il progetto sviluppato nell'ambito delle

presente tesi è relativo proprio ad un emulatore di mouse, che sfrutta il movimento

oculare.

In alcuni casi è possibile utilizzare per il movimento del puntatore un mouse standard

e per la selezione fare ricorso a sistemi che consentano di realizzare il clik con

l'ausilio di uno o

più sensori esterni tramite dispositivi d'interfaccia. In altri casi è invece possibile

ricorrere a soluzioni software per l'esecuzione del comandi del mouse.

Vi sono comunque vari aspetti da considerare riguardo all'utilizzo di un ausilio che

favorisca l'utente nell'accesso all'elaboratore:

L'ausilio deve garantire la massima autonomia all'utente

L'uso dell'ausilio dev'essere il più semplice possibile

Dev'essere garantito il comfort dell'utente nell'utilizzo dell'ausilio

Va considerato anche l'aspetto economico, inteso non solo come costo d'acquisto

dell'ausilio, ma anche come costo dell'apprendimento all'uso dell'ausilio

Caratteristiche fondamentali dell'ausilio devono essere: semplicità e praticità

d'uso

33

Capitolo 2: Stato dell'arte

Dovrebbe essere garantita un certa durata d'uso dell'ausilio

L'ausilio si deve adattare alle esigenze dell'utente

Particolare importanza dev'essere infine data alla valutazione, cioè l'insieme delle

attività necessarie per individuare le risorse tecnologiche appropriate per il

superamento di difficoltà fisiche che inibiscono la possibilità di comunicare ed agire

in modo autonomo.

Per questo è necessario sia un esame delle capacità residue della persona disabile, sia

delle esigenze a cui si vuole dare risposta, per definire quale sia l'ausilio più indicato.

Alcuni ausili e software di particolare interesse vengono recensiti nell'appendice A.

2.3.2 CONVEGNI

Nell'ambito degli sviluppi di ausili informatici per disabili si è avuta una progressiva

crescita d'interesse che ha portato negli ultimi anni ad organizzare convegni

nazionali ed internazionali. A livello nazionale si ricorda il già citato Informatica,

Didattica e Disabilità che lo scorso anno si è tenuto a Roma, e anche HANDIMatica,

convegno nazionale per l'integrazione del disabile che si occupa di tecnologie

avanzate, informatiche e telematica per favorire l'integrazione delle persone

disabili.

A livello internazionale citiamo Closing in the Gap, convegno che si tiene a

Minneapolis.

Quella dell'ottobre del 2001 è stata la diciannovesima edizione.

Il titolo del convegno è "Microcomputer Technologies in Rehabilitation and Special

Education".

34

3 Introduzione ai sistemi eye-tracking

3.1 INTRODUZIONE

Il problema affrontato in questo capitolo punta allo studio del superamento di quelle

"barriere" che il disabile motorio grave (come ad esempio un malato di sclerosi

laterale amiotrofica ad un certo stadio della malattia) incontra nell'utilizzo di un

elaboratore.

Aprendo una piccola finestra sul mondo della disabilità fisica, è immediato

riconoscere quanti problemi completamente diversi si propongono all'osservatore.

Risulta quindi difficile un tentativo di generalizzazione.

Il problema dell'impostazione della ricerca è stato svolto seguendo sostanzialmente

un'unica strada, rivolta a persone che hanno difficoltà di tipo meccanico relative

all'utilizzo dei dispositivi standard di input. Queste persone possono essere affette

da sclerosi multipla, distrofia muscolare, paralisi celebrale. Le conseguenze di tali

malattie e quindi le cause delle difficoltà accennate sopra sono: debolezza,

intorpidimento, paralisi, tremori.

Un riguardo particolare si è avuto nei confronti dei malati di sclerosi laterale

amiotrofica (SLA). Il progredire della malattia provoca un progressivo indebolimento

muscolare ed infine conduce alla paralisi, ma la persona colpita da questa malattia

resta comunque in grado di controllare il movimento oculare.

Nel capitolo seguente si accenna inoltre ai linguaggi simbolici utilizzati in campi

diversi: la comunicazione aumentativa ed alternativa (AAC) si occupa di tutte le

strategie di comunicazione che sono alternative o che incrementano la comunicazione

verbale e grafica. Queste strategie hanno lo scopo di fornire un ausilio di

comunicazione che incoraggi la comunicazione e favorisca l'integrazione del disabile.

Il riferimento alla AAC, nell'ambito dello sviluppo della presente tesi, è legato alla

potenzialità che un sistema di accesso all'elaboratore, quale può essere un

36

Capitolo 3: Introduzione ai sistemi eye-tracking

sistema di puntamento oculare, unito ad un software di comunicazione, può offrire ad

un disabile motore.

3.2 COMUNICAZIONE AUMENTATIVA ED ALTERNATIVA

Non è facile scavalcare il muro che si erge tra le persone che non sono capaci di

esprimersi verbalmente e il mondo, che le circonda, in cui la parola costituisce il

mezzo di comunicazione per eccellenza.

Le difficoltà aumentano quando la patologia risulta complessa e comporta, oltre

all'assenza della parola, deficit fisici e psichici. In queste situazioni diventa difficile

stabilire un canale di comunicazione, o per lo meno una comunicazione che vada oltre

lo stretto necessario. Esiste il rischio reale di scambiare l'impossibilità di esprimersi

con l'incapacità di comprendere e di apprendere, con la conseguenza che il soggetto

disabile viene di fatto privato della possibilità di gestire, anche in minima parte, la

propria vita.

Dietro le apparenze ci sono spesso abilità nascoste e potenzialità inimmaginabili.

Scoprirle, rinforzarle e sfruttarle nella vita quotidiana è una sfida difficile che

richiede talvolta strumenti particolari. La Comunicazione Aumentativa Alternativa è

uno di essi. Conosciuta e applicata in Canada e negli Stati Uniti da quasi 40 anni,

diffusa in molti paesi europei, in Italia comincia ora timidamente a farsi la strada tra

dubbi, incertezze e ostilità.

Come già detto in precedenza l'espressione Comunicazione Aumentativa ed

Alternativa (Augmentative and Alternative Communication, AAC) si riferisce a tutte

le strategie di comunicazione che sono alternative o incrementano (augmentative in

inglese) la comunicazione verbale e grafica.

Attualmente interventi di AAC vengono effettuati nelle seguenti condizioni di

disabilità:

condizioni congenite (sindromi genetiche, ecc.);

condizioni acquisite (esiti di trauma cranico, ictus, ecc.);

37

Capitolo 3: Introduzione ai sistemi eye-tracking

condizioni neurologiche evolutive (Sclerosi Laterale Amiotrofica, AIDS

cerebrale, Sclerosi Multipla, Morbo di Parkinson, ecc.);

condizioni temporanee.

La AAC si pone come obiettivo la compensazione di una disabilità (temporanea o

permanente) del linguaggio espressivo; vengono infatti create le condizioni affinché il

disabile abbia l’opportunità di comunicare in modo efficace, ovvero di tradurre il proprio

pensiero in una serie di segni intelligibili per l’interlocutore.

Esistono sia prodotti software che hardware per la AAC, essi mirano a fornire al

disabile strumenti di comunicazione, alternativi al linguaggio verbale, che possono

essere suddivisi nelle seguenti categorie:

le tabelle di comunicazione

VOCA (Voice Output Communication Aids)

software di comunicazione

I prodotti hardware normalmente sono dedicati alla funzione di comunicatori,

rientrano in questa categoria i sistemi AAC con uscita in voce (Voice Output

Communication Aid, VOCA) o senza uscita in voce. I VOCA sono sistemi dedicati alla

comunicazione, che non necessitano di essere collegati ad un PC . Tramite questi

strumenti il disabile ha la possibilità di comunicare non solo indicando un simbolo, ma

anche associando ad esso un messaggio verbale che viene udito dagli altri.

I VOCA si differenziano fra loro per numero di messaggi, tempo totale di

registrazione, modalità d'accesso (selezione diretta dal dispositivo o tramite sensori

esterni, selezione indiretta con scansione manuale o automatica con sensori esterni).

Esistono prodotti pensati e studiati per la AAC sia a tecnologia povera che sistemi ad

alta tecnologia.

38

Capitolo 3: Introduzione ai sistemi eye-tracking

Di norma per ogni singola persona è necessaria un'integrazione di prodotti a

tecnologia sia povera e che ricca.

Spesso un software pensato per la AAC va ad affiancarsi a sistemi poveri quali

tabelle cartacee (con selezione diretta per mezzo dell'indicazione attraverso l'uso di

un arto o similari - ad esempio un caschetto con un bastoncino - o selezione indiretta

per mezzo di una doppia codifica, spesso indispensabile per coloro che non riescono

ad usare né gli arti, né lo sguardo per indicare) o écran per la selezione di simboli

codificati attraverso lo sguardo.

I prodotti software godono delle potenzialità sempre crescenti dell'informatica e

della enorme capacità di memorizzazione ed elaborazione dei dati di un computer.

Essi permettono di riprodurre sullo schermo le tabelle di comunicazione, ad ogni cella

della tabella è possibile associare un simbolo e l’uscita in voce.

I prodotti software con uscita in voce sono quindi in tutto assimilabili alla famiglia

dei comunicatori, ma non hanno di norma limitazioni nel numero di simboli/messaggi

utilizzabili, né limitazioni per quanto riguarda il tempo di registrazione a

disposizione, possono consentire l'accesso attraverso modalità diverse (tastiere,

dispositivi di puntamento, sensori esterni sia in selezione diretta che indiretta), sono

molto flessibili nella creazione e personalizzazione delle tabelle di comunicazione che

spesso sono collegabili e richiamabili fra loro aumentando così il numero di simboli a

disposizione dell'utente.

L'idea del comunicatore propone un meccanismo che, funzionando per associazione di

idee oppure dal generale al particolare, permetta ad un disabile motore, non in grado

di parlare (la SLA ad esempio porta alla paralisi anche dei muscoli deputati alla

parola) , di indicare quello che vuole e farsi capire.

Questo vuol dire che la prima tabella conterrà delle immagini. Ad un'immagine

possono essere associate altre immagini a cui si potrà accedere nel caso venga

selezionata la prima immagine.

Questo sistema può essere raffigurato come un albero.

39

Capitolo 3: Introduzione ai sistemi eye-tracking

I diversi messaggi contenuti nella tabella possono essere rappresentati in modi

diversi: oggetti concreti, miniature di oggetti, simboli grafici (foto, disegni), lettere

o parole.

Il contenuto delle immagini è strettamente personale ed il compito della loro

compilazione va lasciato all'educatore insieme all'interessato.

Le tabelle di comunicazione infatti vanno costruite valutando un insieme di aspetti

contemporaneamente: selezione del vocabolario (in funzione dei bisogni dell'utente e

del contesto in cui verrà utilizzata), gli aspetti fisici e sensoriali del disabile

(mobilità, postura, vista, etc.), il fattore intellettivo.

Un software di comunicazione aumentativa ed un sistema di accesso che sfrutta il

movimento oculare rappresentano sicuramente un utile strumento di comunicazione

per una persona affetta da SLA, che la malattia ha privato della possibilità di

movimento e di parola.

Alcuni prodotti hardware e software di Comunicazione Aumentativa ad Alternativa

sono presentati nell'appendice A.

3.3 SCELTA DELLO SGUARDO COME CANALE DI COMUNICAZIONE

Il problema dell’integrazione dei disabili e dei portatori di handicap in generale è oggi

di grande attualità, anche se rispetto ad alcuni decenni fa sono stati compiuti

notevoli passi avanti: si ricordi ad esempio negli anni ’60 la nascita delle “scuole

speciali” per disabili, in cui di fatto queste persone erano relegate per buona parte

della loro vita.

Tra le funzioni che più spesso sono precluse a una persona disabile, la più importante

è senz’altro quella della comunicazione: chi non può parlare o utilizzare le mani per

esprimersi ben difficilmente potrà scambiare le proprie idee con il mondo esterno.

40

Capitolo 3: Introduzione ai sistemi eye-tracking

Il sistema sviluppato nell’ambito di questa tesi permette di impartire comandi ad un

elaboratore tramite lo sguardo.

La scelta dello sguardo come canale di comunicazione non è casuale: in passato e

anche tuttora uno dei sistemi più usati per comunicare con i disabili è l’écran, un

sistema che si basa sull’utilizzo di una lastra di plexiglass trasparente su cui sono

disegnate le lettere dell’alfabeto. Tale lastra viene posta tra il disabile e

l’interlocutore. Quest’ultimo deve

capire su quale lettera si posa lo sguardo

dell’altro. Con l’esperienza si raggiunge una buona velocità di composizione delle

parole: sfruttando la rapidità dell’occhio si possono scambiare notevoli quantità di

informazioni.

Tale sistema ha molti limiti, fra cui il poter comunicare soltanto con interlocutori

esperti ed “allenati” e l’impossibilità di parlare a più di una persona per volta. Il limite

più evidente è comunque quello di richiedere la presenza costante di un’altra persona,

precludendo di fatto la possibilità di produrre in modo indipendente documenti

scritti.

Per ovviare a questo limite si possono utilizzare i cosiddetti sistemi a scansione. Tali

sistemi si basano sulla capacità del disabile di riuscire a coordinare almeno un arto

del proprio corpo. Spesso questa capacità può essere limitata, è necessario un certo

tempo per il training e lo scambio di informazioni è piuttosto lento.

Tali sistemi si basano sull’uso del calcolatore: un cursore scandisce automaticamente

il video (scansione elemento per elemento oppure riga-colonna, quest'ultima è più

veloce) su cui sono visualizzate le lettere dell'alfabeto, il disabile sceglie la lettera

che desidera scrivere e la conferma con un impulso sul sensore (ad esempio premendo

un pulsante di dimensioni più o meno grandi, con una qualunque parte del corpo: la

mano, il gomito, la testa, ecc.). Per scrivere una parola sono necessari diversi minuti,

per scrivere una pagina occorre una giornata intera, non considerando gli errori di

battitura.

Sono nati pochi anni fa negli Stati Uniti i primi sistemi basati sull’uso congiunto del

calcolatore e dello sguardo come “fonte di decisione”.

41

Capitolo 3: Introduzione ai sistemi eye-tracking

Possiamo suddividere tali sistemi in due categorie:

sistemi ottici: i quali tipicamente utilizzano la riflessione infrarossa

sistemi elettrici: i quali sfruttano la registrazione elettrooculografica EOG

Per quanto riguarda i sistemi del primo tipo, questi hanno normalmente costi molto

elevati, ma sono sicuramente migliori per precisione ed affidabilità.

Il secondi non hanno l'ergonomicità sufficiente a renderli sistemi commerciali alla

portata di tutti, a causa della presenza dei fili elettrici che devono essere collegati

all'utente e che ne limitano la libertà di movimento.

I sistemi ottici si basano per la maggior parte sul metodo PCCR (Pupil Center Corneal Reflection) che sfrutta la riflessione della cornea per determinare il

movimento dello sguardo.

Un diodo (LED) emette raggi infrarossi a bassa potenza ed illumina l’occhio.

Il raggio di luce infrarossa genera una riflessione luminosa sulla superficie della

cornea dell'occhio e provoca il cosiddetto effetto "occhi rossi", quest'effetto

migliora l'immagine della pupilla alla telecamera e rende più facile alle funzioni di

elaborazione dell'immagine localizzare il centro pupilla.

L'elaboratore calcola il punto fissato dall'occhio, interpolando le coordinate del

punto sullo schermo, basandosi sulla posizione relativa del centro pupilla e sulla

riflessione della cornea nell'immagine dell'occhio.

Ma non tutti i sistemi ottici si basano su questo metodo, vi sono anche sistemi ottici

che sfruttando algoritmi di elaborazione dell'immagine, riescono a determinare le

coordinate del centro pupilla e in seguito a opportune considerazioni geometriche a

determinare il punto fissato sullo schermo dall'utente.

Il progetto argomento della presente tesi utilizza proprio questa modalità, come

verrà ampiamente descritto in seguito.

42

Capitolo 3: Introduzione ai sistemi eye-tracking

Una panoramica su alcuni dei sistemi di puntamento oculare attualmente in

commercio, che fanno riferimento ai diversi metodi descritti sopra viene illustrata

nell'appendice B.

3.4 CONIDIZIONI D'USO DI UN SISTEMA A PUNTAMENTO OCULARE DA

PARTE DI PERSONE AFFETTE DA DISABILITA' FISICHE

Viene presentata una breve panoramica su alcune delle malattie più frequenti a cui un

sistema di input alternativo, com'è appunto il progetto sviluppato nell'ambito di

questa tesi, può essere rivolto:

SCLEROSI MULTIPLA: la sclerosi multipla implica un processo autoimmunitario,

cioè una risposta immunitaria anomala diretta contro il sistema nervoso centrale

dell’individuo stesso. I sintomi iniziali sono difficoltà nei movimenti e sensazioni

d'intorpidimento. Raramente i sintomi iniziali comprendono incoordinazione dei

movimenti, alterazioni dell'articolazione della parola e difficoltà nel movimento di

uno o più arti. Dolore o perdita della vista dovuta ad un'infiammazione del nervo

ottico è un altro dei sintomi più comuni, che però spesso è reversibile.

DISTROFIA MUSCOLARE: è una malattia muscolare, le forme più comuni sono

quella di Duchenne e quella di Becker. La prima evolve verso una paralisi totale

dei muscoli, mentre la seconda ha un andamento più lieve e meno debilitante. Non

in tutte le forme di distrofia il livello intellettivo rimane del tutto normale, ad

esempio la distrofia miotonica di Steinert colpisce anche il sistema nervoso

centrale, oltre alla muscolatura scheletrica e gli occhi (cataratta).

SCLEROSI LATERALE AMIOTROFICA: come già spiegato in precedenza, la SLA

è una malattia fatale degenerativa che porta ad una paralisi progressiva dei

quattro arti e dei muscoli deputati alla deglutizione e alla parola. Le persone

colpite da questa patologia sono comunque ancora in grado, anche nella fase finale

43

Capitolo 3: Introduzione ai sistemi eye-tracking

della malattia, di controllare il movimento degli occhi, inoltre le capacità

cognitive non vengono assolutamente intaccate.

Affinché un utente disabile sia effettivamente in grado di utilizzare un sistema a

puntamento oculare, deve soddisfare una serie di condizioni, necessarie al corretto

utilizzo del sistema stesso.

Le condizioni d'uso richieste vengono di seguito elencate:

Buon controllo di almeno un occhio: l'utente dev'essere in grado di spostare lo

sguardo in alto, in basso, a destra e a sinistra entro l'area dello schermo. Deve

essere inoltre in grado di focalizzare lo sguardo su un punto per il tempo

richiesto dal sistema. Diversi problemi relativi al movimento oculare possono

interferire con il buon uso di un sistema eye-tracking: istagmo (costante ed

involontario movimento dell'occhio), strabismo alternato, ecc.

Visione adeguata: l'utente deve poter vedere chiaramente ciò che è visualizzato

sullo schermo. I sistemi di inseguimento in genere lavorano anche in presenza di

lenti a contatto e occhiali. In particolare il progetto sviluppato nell'ambito di

questa tesi è stato testato su persone che portavano occhiali da vista con lenti

antiriflesso. Anche la diblopia (visione doppia) e problemi di visione offuscata

possono rendere difficile all'utente fissare il proprio sguardo su di un punto. In

caso di cecità il sistema non potrà essere utilizzato.

Buon controllo del capo: l'utente deve essere capace di mantenere una posizione

di fronte allo schermo dell'elaboratore. In particolare il viso dell'utente deve

restare entro l'inquadratura della telecamera. Movimenti incontrollati del capo

rendono impossibile l'uso di un sistema di questo tipo. Una soluzione potrebbe

essere quella di utilizzare un opportuno sistema di supporto del capo.

Effetti collaterali delle medicine: gli anticonvulsioni possono causare istagmo,

visione offuscata, diblopia, mal di testa e confusione. Alcuni antidepressivi

possono provocare visione offuscata e dilatazione anormale della pupilla. Il

Baclofen, un comune farmaco per ridurre gli spasmi muscolari, può causare

44

Capitolo 3: Introduzione ai sistemi eye-tracking

disorientamento, mal di testa, visione offuscata e dilatazione della pupilla.

L'utilizzo contemporaneo di alcuni tipi di medicine e di un sistema a puntamento

oculare resta quindi piuttosto difficile.

In base alle considerazioni appena fatte, possiamo quindi valutare se una persona

affetta da una delle patologie descritte sopra possa essere in grado o meno di

utilizzare un sistema a puntamento oculare.

Per quanto riguarda le condizioni cognitive dell'utente di un sistema di questo tipo è

chiaro che dev'essere in grado di comprendere il funzionamento del sistema di input

al fine di poter operare, tramite questo, le scelte che il software di comunicazione gli

propone (ad esempio un software di comunicazione aumentativa).

Altre considerazioni, sempre inerenti alle condizioni d'uso di un sistema eyetracking (ad inseguimento dell'occhio), si riferiscono questa volta all'ambiente in cui

il dispositivo viene utilizzato.

Un fattore molto importante da tenere in conto è infatti l'illuminazione

dell'ambiente di lavoro.

Nell'ambito dello sviluppo della presente tesi si è condotto uno studio su quali

fossero le condizioni di luce migliori affinché il sistema potesse operare

correttamente.

Si è potuto appurare che questo lavora bene al buio con una o due sorgenti luminose

(semplici lampade) che illuminino il viso dell'utente.

Questa problematica è comunque stata ampiamente affrontata nei capitoli successivi.

45

Capitolo 3: Introduzione ai sistemi eye-tracking

3.5 SOMMARIO

E' difficile mostrare le proprie potenzialità ed abilità in mancanza di un canale

comunicativo.

Chi non può parlare o utilizzare le mani per esprimersi ben difficilmente potrà

scambiare le proprie idee con il mondo esterno.

La funzione comunicativa aumenta e facilita contesti relazionali e sociali, che

contribuiscono a loro volta a rafforzare l'identità di una persona.

Il progetto sviluppato nella presente tesi vuole fornire un sistema di input

alternativo per disabili motori gravi, in modo che essi possano accedere

all'elaboratore e ai programmi software, che garantiscono loro la possibilità di usare

vantaggiosamente la tecnologia per instaurare delle relazioni comunicative col mondo

esterno.

46

4

Descrizione della struttura

del sistema progettato

4.1 INTRODUZIONE

Questo capitolo spiega com'è stato affrontato concettualmente il problema e la

soluzione logica che ne è seguita.

Punto di partenza sono le conclusioni della sezione precedente che costituiscono le

specifiche informali preliminari.

Verrà in principio affrontato il problema dell'Analisi e Specifica dei Requisiti, che

permette di definire gli obbiettivi che ci si è posti.

Seguirà una descrizione concettuale della strategia utilizzata cercando di dare il più

possibile delle risposte ai requisiti sopra esposti ed infine verrà posta particolare

attenzione alla struttura del progetto che porterà ad una suddivisione modulare del

sistema.

48

Capitolo 4: Descrizione della struttura del sistema progettato

4.2 ANALISI E SPECIFICA DEI REQUISITI

Viene fornita in questo contesto una prima descrizione di tipo informale.

Analisi dei requisiti:

Scopo del sistema è fornire uno strumento capace di consentire l'utilizzo

dell'elaboratore da parte di disabili motori gravi che non sono in grado di

adoperare mouse e tastiera. L'accesso al computer è importante in quanto esso

rappresenta uno strumento comunicativo potente e personalizzabile che può

aiutare il disabile ad instaurare delle relazioni con il mondo esterno (famiglia,

amici, colleghi, etc.).

Figura 1

Il progetto di un tale sistema interessa solamente il livello software e riguarda

l'ideazione di una serie di algoritmi, che permettono di tradurre il movimento

dello sguardo in un comando per l'elaboratore.

L'hardware necessario è rappresentato unicamente da una webcam collegata alla

porta USB dell'elaboratore.

L'uso di tastiera e del mouse non è interdetto, anzi concorre allo stesso

risultato.

49

Capitolo 4: Descrizione della struttura del sistema progettato

Il sistema deve permettere all'utente il controllo dell'elaboratore utilizzando

esclusivamente lo sguardo come mezzo di interazione.

Il sistema non deve essere chiuso, ma deve permettere ampliamenti futuri e

forti personalizzazioni.

4.3 SOLUZIONE DEL PROBLEMA

Come prima cosa si cercherà di dare delle risposte ad ognuno dei requisiti presentati

nel paragrafo precedente.

Quale soluzione alternativa all'utilizzo del mouse e della tastiera si è scelto di

usare lo sguardo come canale di comunicazione tra l'utente e il proprio

elaboratore. Pensando al tipo di patologie a cui un sistema del genere può essere

rivolto, si è inoltre pensato di poter associare l'uso del sistema di puntamento

oculare realizzato, con quello di un software di comunicazione aumentativa ed

alternativa. Questa potrebbe rivelarsi un'ottima combinazione per un malato di

SLA .

Gli algoritmi realizzati si basano su elementi geometrici e di elaborazione delle

immagini. Essendo questo progetto un primo prototipo l'accuratezza del sistema

è tale da poter individuare non il punto esatto, ma l'area sul video in cui cade lo

sguardo dell'utente.

Il movimento degli occhi è rilevato da una webcam, posta sotto il monitor del PC.

Le immagini catturate dalla webcam vengono elaborate da diversi algoritmi e sulla

base di un certo numero di campioni acquisiti il sistema riesce a determinare

dove sia diretto lo sguardo dell'utente. Non sono richiesti alla webcam requisiti

particolari, in quanto le condizioni su cui si basa il buon funzionamento del

sistema sono legate soprattutto alle condizioni di luce dell'ambiente in cui questo

si trova ad operare.

50

Capitolo 4: Descrizione della struttura del sistema progettato

Anche se l'utente del sistema non è in grado di adoperare mouse e tastiera, deve

essere comunque data la possibilità ad altre persone, che possono assisterlo

nell'uso del sistema stesso, di interagire con l'elaboratore tramite i sistemi di

input standard (mouse e tastiera).

E' fondamentale che l'utente possa in ogni momento comunicare, tramite il

proprio elaboratore. Durante il tempo di utilizzo del sistema la webcam è

connessa al computer e le immagini acquisite vengono di volta in volta elaborate al

fine di tradurre lo spostamento dello sguardo dell'utente in un determinato

comando. Questo comando dipenderà dal tipo di software di comunicazione che si

sta utilizzando insieme al sistema di puntamento oculare.

Vi saranno una serie di parametri che dovranno essere modificati in funzione

dell'utente che utilizza il sistema. Questo significa che, prima di poter essere

utilizzato, il sistema dovrà essere sottoposto ad una procedura di calibrazione.

4.4 PROGETTO LOGICO

Si descrive come il progetto è stato suddiviso dal punto di vista logico, fino ad

arrivare ad un'architettura del sistema.

Il cuore del sistema è rappresentato da una serie di algoritmi che provvedono alla

gestione della webcam, all'elaborazione delle immagini acquisite e alla rilevazione di

una serie di campioni da cui è poi possibile ricavare le coordinate di un unico punto di

fissazione, in base al quale si riesce a prevedere quale sia l'area che l'utente stava

fissando.

Si parte dall'ipotesi che sul video dell'elaboratore sia visualizzata una tabella

suddivisa in celle. Data l'accuratezza attuale del sistema progettato, si assume che

le celle siano in tutto sei e che individuino quindi altrettante posizioni sul video (altodestra, alto-centro, alto-sinistra, basso-sinistra, basso-centro, basso-destra).

51

Capitolo 4: Descrizione della struttura del sistema progettato

Durante la procedura di calibrazione si chiede all'utente di fissare sei punti sullo

schermo: da ogni fissazione si ottiene un punto di coordinate x,y, che verranno di

volta in volta memorizzate.

La procedura di calibrazione ha lo scopo di inizializzare il sistema.

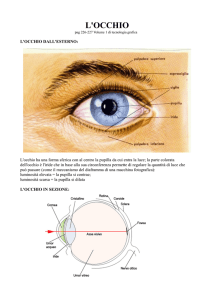

Si riporta nella figura a fianco la tabella

utilizzata per la calibrazione.

Figura 2

La figura 2 mostra la suddivisone dello schermo dell'elaboratore in sei aree

rettangolari. I punti segnati in ognuna di esse rappresentano i punti fissati

dall'utente durante la procedura di calibrazione.

Ogni volta che il sistema calcola un punto di fissazione, questo viene confrontato con

i punti della calibrazione e da tale confronto si può determinare su quale, tra le sei

aree, sia diretto lo sguardo dell'utente.

Un punto di fissazione viene calcolato sulla base di un numero minimo di campioni,

operando su di essi una media, escludendo però quei punti che, non rispettando una

determinata soglia, non possono essere considerati parte della fissazione in corso.

Le coordinate di ogni punto-campione vengono calcolate in base ad una serie di

considerazioni geometriche. Le coordinate del centro pupilla, delle immagini

analizzate, vengono riportate nello stesso riferimento, per poterne valutare le

variazioni.

Il riferimento comune viene individuato da un segno nero posto sulla fronte

dell'utente.

Per alcuni cenni relativi all'anatomia e fisiologia dell'occhio umano e ai movimenti

oculari, si rimanda all'appendice C.

52

Capitolo 4: Descrizione della struttura del sistema progettato

Schematicamente le fasi che fanno parte dell'architettura del sistema in esame

sono:

Acquisizione periodica delle immagine dalla webcam

Rilevazione posizione dell'occhio, della pupilla e del riferimento sul viso

Determinazione della direzione dello sguardo (calcolo gaze, in inglese gaze

significa sguardo)

Calcolo punto di fissazione

Individuazione area fissata dall'utente

Le fasi elencate sopra sono riportate nel diagramma di figura 3.

Figura 3

53

Capitolo 4: Descrizione della struttura del sistema progettato

Vengono di seguito descritti, dettagliatamente, i singoli blocchi che compongono il

diagramma.

4.4.1 ACQUISIONE PERIODICA DELLE IMMAGINI DALLA WEBCAM

La procedura di acquisizione delle immagini riguarda la cattura delle immagini tramite

webcam.

La gestione delle webcam è stata realizzata tramite le funzioni della AviCap window

class, facente parte delle funzioni VFW (Video For Window) e che permette di

incorporare procedure di cattura video in una qualunque applicazione.

Lo studio delle condizioni migliori che permettessero di ottenere delle immagini su

cui i vari algoritmi potessero poi essere applicati con successo ha riguardato

principalmente tre fattori: posizione della webcam, posizione dell'utente rispetto al

video e alla webcam e condizioni d'illuminazione dell'ambiente.

Prima di tutto la webcam viene posta sotto e non sopra il monitor del PC. Il motivo di

questa scelta è dovuto al problema che si verifica quando l'utente rivolge lo sguardo

in basso.

Con la webcam sopra il monitor, si ottiene infatti un'immagine in cui l'iride