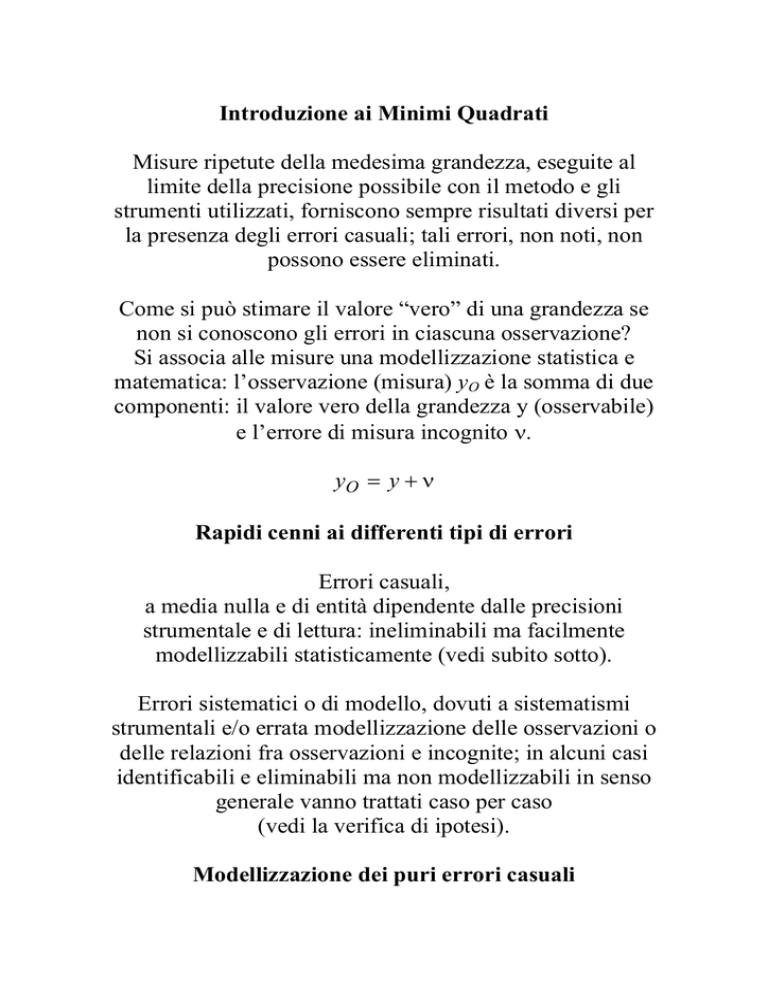

Introduzione ai Minimi Quadrati

Misure ripetute della medesima grandezza, eseguite al

limite della precisione possibile con il metodo e gli

strumenti utilizzati, forniscono sempre risultati diversi per

la presenza degli errori casuali; tali errori, non noti, non

possono essere eliminati.

Come si può stimare il valore “vero” di una grandezza se

non si conoscono gli errori in ciascuna osservazione?

Si associa alle misure una modellizzazione statistica e

matematica: l’osservazione (misura) yO è la somma di due

componenti: il valore vero della grandezza y (osservabile)

e l’errore di misura incognito ν.

yO = y + ν

Rapidi cenni ai differenti tipi di errori

Errori casuali,

a media nulla e di entità dipendente dalle precisioni

strumentale e di lettura: ineliminabili ma facilmente

modellizzabili statisticamente (vedi subito sotto).

Errori sistematici o di modello, dovuti a sistematismi

strumentali e/o errata modellizzazione delle osservazioni o

delle relazioni fra osservazioni e incognite; in alcuni casi

identificabili e eliminabili ma non modellizzabili in senso

generale vanno trattati caso per caso

(vedi la verifica di ipotesi).

Modellizzazione dei puri errori casuali

Un buon modello formale per descrivere

le osservazioni di precisione è quello di considerarle come

estrazioni di variabili casuali gaussiane o normali,

definite da media y e varianza σ2;

f ( yO ) =

−

1

e

2 1/ 2

(2πσ )

1

2σ 2

( yO − y ) 2

ove

f(yO): distribuzione di densità di probabilità

y: valore vero, incognito, dell’osservazione (osservabile)

σ2: parametro di dispersione o varianza.

Nota

Indichiamo con P ( ym ≤ yO ≤ y M ) la probabilità di

ottenere una misura che cada nell’intervallo di valori

compresi tra ym e yM; tale probabilità è data da

yM

P( ym ≤ yO ≤ y M ) = ∫ f ( yO )dyO

ym

Indicativamente il risultato di una misura cade con il

99.9% di probabilità nell’intervallo y-3σ e y+3σ; inoltre,

formalmente si ha probabilità nulla di ottenere da

un’osservazione il valore dell’osservabile: infatti

y

∫ f ( yO )dyO = 0

y

Caso Rm

Se supponiamo di avere m osservabili, cioè di

osservare m grandezze diverse, possiamo utilizzare lo

stesso modello visto precedentemente e scrivere in

modo compatto, utilizzando la notazione vettoriale:

yO = y + ν

con

yO

f (y O ) =

⎡ y1O ⎤

⎡ y1 ⎤

⎡ ν1 ⎤

⎢y ⎥

⎢y ⎥

⎢ν ⎥

2O ⎥

2

⎢

=

; y = ⎢ ⎥; ν = ⎢ 2 ⎥

⎢ ... ⎥

⎢ ... ⎥

⎢ ... ⎥

⎢

⎥

⎢ ⎥

⎢ ⎥

y

⎣ ym ⎦

⎣ν m ⎦

⎣ mO ⎦

1

(2π) m / 2 (det C yy ) m / 2

1

− ( y O − y )T C−yy1 ( y O − y )

e 2

ove m è la dimensione di y.

Cyy è la matrice di covarianza delle osservazioni.

C yy

⎡ σ12 σ

12

⎢

σ 21 σ 22

⎢

=

⎢ ...

...

⎢

⎢⎣σ m1 σ m 2

... σ1m ⎤

⎥

... σ 2 m ⎥

... ... ⎥

⎥

2

... σ m ⎥⎦

contiene:

in diagonale le varianze delle singole osservazioni, fuori

diagonale le covarianze fra coppie di osservazioni; la

matrice è simmetrica e definita positiva, quindi invertibile.

Nota

Se yO segue una distribuzione normale con media y e

covarianza Cyy si indica

[

y O ~ N y , C yy

]

Terminologia

Campione bernoulliano

Un campione bernoulliano è un insieme di elementi

estratti indipendentemente da una Variabile Casuale (VC).

Esempio:

più ripetizioni indipendenti della stessa osservazione

Statistiche campionarie

Variabili casuali funzioni della VC

dalla quale il campione è stato estratto:

1

media campionaria: yˆ = ∑i =1,..., N yOi ;

N

varianza campionaria corretta:

1

2

σˆ 2 =

∑i =1,..., N ( yOi − yˆ )

N −1

Stima dei parametri statistici di una VC

Calcolo dei valori dei parametri caratteristici di una VC

(ad esempio media e varianza,…) a partire da

un campione bernoulliano per mezzo di

opportuni stimatori, definiti in base a determinati

criteri statistici.

Correttezza

Uno stimatore è corretto se la sua media

coincide con la media della VC.

Consistenza

Uno stimatore è consistente se,

al tendere a infinito della numerosità del campione,

la sua media tende alla media della VC in probabilità

e la sua varianza tende a 0 in probabilità.

Minima varianza

Uno stimatore è di minima varianza se

la sua varianza è la minore tra quelle degli

stimatori dello stesso parametro statistico della VC.

Robustezza

Uno stimatore è robusto se

non viene significativamente influenzato da

pochi elementi del campione

non appartenenti alla VC considerata.

Accuratezza

Definisce la dispersione dei valori campionari

intorno alla media campionaria;

la varianza campionaria è un indice di accuratezza.

Precisione

Definisce la dispersione dei valori campionari

intorno alla media teorica della VC

dalla quale si ritiene estratto il campione;

Misure molto accurate (σ2 piccolo) risultano poco precise

se si hanno errori di modello.

I Minimi Quadrati

Formalizzazione del problema e degli obiettivi

Non è sempre possibile osservare direttamente grandezze

alle quali siamo interessati. Se ad esempio vogliamo

determinare coordinate di punti sulla superficie terrestre,

non è possibile eseguire la loro misura diretta; possiamo

però fare misure di angoli e distanze o di basi, e costruire

un modello fisico e geometrico che leghi tali osservabili

alle coordinate dei punti.

In questo caso quindi le osservabili y (angoli, distanze e

basi) possono essere descritte funzionalmente a partire da

parametri incogniti x (le coordinate dei punti).

Ovvero

Siano date m osservazioni

⎡ y1o ⎤

⎢y ⎥

2

yo = ⎢ o ⎥

⎢ ... ⎥

⎢

⎥

y

⎢⎣ mo ⎥⎦

per ogni osservazione i-esima valga

yio = yi + ν i

ν i ≠ 0; E [ν i ] = 0

ovvero

yo = y + ν

E [y o ] = y

y: vettore delle osservabili, incognite;

y o : vettore delle osservazioni, note;

ν: vettore degli errori di osservazione, incogniti.

Sia noto il modello stocastico delle osservazioni,

ovvero la loro matrice di covarianza:

C yy = C νν = σ 02Q

ove σ 02 rappresenta un fattore di precisione “comune”;

Q è detta matrice dei cofattori ed esprime in diagonale le

precisioni relative delle diverse osservazioni, fuori

diagonale le correlazioni fra le diverse osservazioni.

Sia x un vettore contenente n parametri incogniti:

⎡ x1 ⎤

⎢x ⎥

2

x=⎢ ⎥

⎢ ... ⎥

⎢ ⎥

⎣ xn ⎦

con n ≤ m

Sia noto il modello deterministico del problema,

ovvero la relazione funzionale fra x e y

y = f (x)

con f funzione nota.

Il sistema in x sarebbe risolvibile

supponendo di conoscere le osservabili y;

in tal caso infatti si avrebbe

x = f −1 (y )

Però il sistema non è risolvibile

utilizzando direttamente le osservazioni,

perché queste sono affette da errori incogniti;

non è cioè possibile in alcun modo risolvere la

x = f −1 (y o )

poiché, a causa degli errori, si ha

y o = y + ν = f ( x) + ν ≠ f ( x)

Si pone il problema di trovare un metodo che,

sfruttando le informazioni disponibili, permetta la miglior

stima possibile (in senso statistico) dei parametri incogniti

x ( x̂ ) e delle osservabili y (yˆ );

si cerca inoltre un metodo che permetta di

stimare la precisione di stima delle incognite;

infine sono necessari strumenti per valutare

la presenza di errori nel modello adottato.

Il metodo adottato

nell’elaborazione delle osservazioni GPS e

nella compensazione delle reti

è quello dei Minimi Quadrati.

Il metodo si presta a problemi lineari, ovvero nella forma

yo = y + ν

y = Ax + b ,

ν ≠ 0, E [ν ] = 0 , C νν = C yy = σ 02Q

ove y0, ν, x e Cyy hanno il significato già visto;

A è detta matrice disegno (nota), dim[A]= m × n,

b è il termine noto, dim[b]= m × 1.

Minimi quadrati, principio e stimatori

Dato il problema precedentemente introdotto, in forma

lineare, si cercano x̂ e ŷ consistenti, con ŷ a minima

distanza da y o ; ovvero xˆ e yˆ tali che

yˆ = Axˆ + b

(y o − y )T Q −1 (y o − y ) = min

Nel seguito vengono riportate senza dimostrazione

le stime fornite dai MQ.

Dalle equazioni di condizione precedentemente postulate

si ricava il cosiddetto sistema normale

Nxˆ = AT Q −1 ( y o − b) ,

ove N è definita matrice normale, N = AT Q −1A

Si hanno due casi:

A è di rango pieno, ovvero le sue colonne sono

linearmente indipendenti:

Ax = 0 ⇒ x = 0

in questo caso il problema

non presenta deficienza di rango;

A non è di rango pieno, ovvero alcune sue colonne sono

linearmente dipendenti dalle altre:

Ax = 0 per qualche x ≠ 0

in questo caso il problema presenta deficienza di rango.

Soluzione del problema senza deficienza di rango

Se A è di rango pieno lo è anche N, che è dunque

invertibile. Si hanno dunque le seguenti stime.

Stima dei parametri incogniti:

xˆ = N −1AT Q −1 (y o − b) ;

stima delle osservabili e degli scarti:

yˆ = Axˆ + b

νˆ = yˆ o − yˆ ;

La ridondanza e le stime di covarianza

Ridondanza: differenza fra numero di osservazioni

e numero di parametri incogniti,

detta anche numero di gradi di libertà:

R = m−n

Si può dimostrare che m = n ⇒ yˆ = y 0 ,

ovvero quando la ridondanza è nulla non è possibile

ristimare le osservazioni e quindi gli scarti di osservazione

Si può inoltre dimostrare che lim xˆ = x; lim yˆ = y

R →∞

R →∞

ovvero: al tendere all’infinito del numero di osservazioni,

gli errori di osservazione si scaricano solo sulle stime degli

errori e non sulle stime dei parametri incogniti e delle

osservabili.

Quindi una ridondanza elevata consente:

la validazione reciproca delle osservazioni;

una stima più precisa dei parametri incogniti;

una stima delle loro precisioni di stima.

stima del σ 02 :

νˆ T Q −1νˆ

2

σˆ 0 =

;

m−n

stima della matrice di covarianza dei parametri:

C xˆxˆ = σˆ 02 N −1 ;

stima della matrice di covarianza delle osservabili:

C yˆyˆ = σˆ 02 AN −1AT ;

stima della matrice di covarianza degli scarti

C νˆ νˆ = σˆ 02 (Q − AN −1AT )

Note

Il metodo dei minimi quadrati fornisce stime corrette e di

minima varianza per i parametri incogniti.

Le stime sono indipendenti dal valore di σ 02 :

quindi non è necessario conoscere tale valore a priori;

dipendono però da Q, A e b

(modelli stocastico e deterministico).

Esempio di applicazione dei MQ

Siano A, B e C tre punti; sia HA la quota nota di A;

Siano stati misurati i dislivelli da A a B ( DH AB o ), da B a

C ( DH BC o ) e da C a A ( DH CAo ).

Evidentemente vale la

H B − H A = DH AB

H A − H C = DH CA

H C − H B = DH BC

Soluzione mediante MQ

Si scrive il modello deterministico del problema:

DH AB O = H B − H A + ν AB

DH CAO = H A − H C + ν CA

DH BCO = H C − H B + ν BC

ovvero

yO = y + ν

y = Ax + b

ove

⎡− H A ⎤

⎡0 1⎤

H

⎡

⎤

A = ⎢− 1 0 ⎥, x = ⎢ C ⎥, b = ⎢ H A ⎥

⎢

⎥

⎢

⎥

⎣H B ⎦

⎢⎣ 1 − 1⎥⎦

⎣⎢ 0 ⎥⎦

Modello stocastico

Nel presente esempio si considerano le misure

di uguale precisione (che indichiamo con σ2)

e scorrelate:

⎡σ 2

⎢

C yy = ⎢ 0

⎢0

⎣

0

σ2

0

0⎤

⎥

0⎥

σ2 ⎥

⎦

ovvero

C yy = σ 2 I

Una volta calcolate la matrice normale e la sua inversa,

⎡ 2 − 1⎤

N = AT Q −1A = AT I −1A = AT A = ⎢

⎥

⎣− 1 2 ⎦

1 ⎡2 1⎤

N −1 = ⎢

3 ⎣1 2⎥⎦

le soluzioni fornite dai MQ sono le seguenti.

Parametri incogniti

⎡ Hˆ C ⎤

= N −1AT Q −1 (y 0 − b) =

xˆ = ⎢

⎥

⎣ Hˆ B ⎦

⎡ DH AB O + H A ⎤

1 ⎡ 2 1 ⎤ ⎡0 − 1 1 ⎤ ⎢

⎥

= ⎢

−

=

DH

H

CA

A

⎥

⎢

⎥

O

⎢

⎥

3 ⎣1 2⎦ ⎣1 0 − 1⎦

⎢⎣ DH BC

⎥⎦

O

⎡ H A ⎤ 1 ⎡ DH ABO + DH BCO − 2 DH CAO ⎤

=⎢

⎥

⎥ + 3 ⎢ 2 DH

−

−

DH

DH

H

AB

CA

BC

⎣ A⎦

⎣

O

O

O⎦

Osservabili

⎡ DHˆ AB ⎤

⎥

⎢

yˆ = ⎢ DHˆ CA ⎥ = Axˆ + b =

⎢ DHˆ BC ⎥

⎦

⎣

⎡− H A ⎤ ⎡ DH AB O ⎤

⎡νˆ ⎤

⎡0 1⎤

ˆ

⎡H ⎤

⎥ 1

⎢

= ⎢− 1 0 ⎥ ⎢ C ⎥ + ⎢ H A ⎥ = ⎢ DH CAO ⎥ − ⎢νˆ ⎥

⎥

⎢

⎥ Hˆ

⎢

3⎢ ⎥

⎣

⎦

B

⎥

⎢

⎢⎣ 0 ⎥⎦ ⎣ DH BC O ⎦

⎢⎣νˆ ⎥⎦

⎢⎣ 1 − 1⎥⎦

Scarti

⎡νˆ ⎤

1

νˆ = y O − yˆ = ⎢νˆ ⎥

3⎢ ⎥

⎢⎣νˆ ⎥⎦

ove si è posto

νˆ = DH ABO + DH BCO + DH CAO

Precisione delle stime

1 2

3νˆ

ν

Q

ν

1

σˆ 02 =

=9

= νˆ 2

m−n

3− 2 3

ˆT

−1 ˆ

1 ⎡2 1⎤

C xˆxˆ = σˆ 02 N −1 = νˆ 2 ⎢

9 ⎣1 2⎥⎦

σ Hˆ

2

= C xx (1,1) =

νˆ = C xx (2,2) = σ Hˆ

C

B

3

⎡ 2 − 1 − 1⎤

1

C yˆyˆ = σˆ 02 AN −1AT = νˆ 2 ⎢− 1 2 − 1⎥

⎥

9 ⎢

⎣⎢− 1 − 1 2 ⎥⎦

σ DHˆ

2

= C yˆ yˆ (1,1) =

νˆ = σ DHˆ

= σ DHˆ

AB

CA

BC

3

Il problema della deficienza di rango

Nel caso A non sia di rango pieno non lo è neppure N;

risulta perciò impossibile invertire il sistema normale per

la stima di xˆ . Geometricamente si ha la seguente

situazione: ad una stima “ottimale” delle osservabili y

(ovvero a minima distanza dalle osservazioni yO)

corrispondono infinite soluzioni per i parametri incogniti

Definiamo il nucleo N di A come: N ( A) = {x 0 | Ax 0 = 0};

supponiamo di conoscere il valore vero delle osservabili,

y; evidentemente se x̂ è soluzione di Axˆ + b = y , anche

xˆ + x 0 lo è; infatti

A (xˆ + x 0 ) + b = Axˆ + b + Ax 0 = yˆ + 0 = yˆ

in sostanza le osservazioni non contengono abbastanza

informazione per stimare tutti i parametri desiderati; tale

caratteristica non dipende dalla ridondanza ma dal disegno

del problema.

Ad esempio si consideri l’anello di livellazione iniziale e

si supponga di voler stimare tutte le quote dalle misure di

dislivello:

yO = y + ν

y = Ax + b

⎡ DH AB O ⎤ ⎡− 1 1 0 ⎤ ⎡ H A ⎤

⎢

⎥ ⎢

⎥⎢H ⎥ + v

0

1

1

DH

=

−

BC

O⎥ ⎢

⎢

⎥⎢ B ⎥

⎢⎣ DH CA ⎥⎦ ⎢⎣ 1 0 − 1⎥⎦ ⎢⎣ H C ⎥⎦

O

è facile verificare che A non è di rango pieno e che, in

particolare,

⎧⎡1⎤

⎫

⎪

⎪

N (A ) = ⎨⎢1⎥t , ∀ t ∈ R ⎬

⎢⎥

⎪⎢1⎥

⎪

⎩⎣ ⎦

⎭

in effetti, pensando al problema dal punto di vista fisico, è

evidente che i valori delle osservabili di dislivello del

triangolo non vengono modificati aggiungendo un valore

H comune alle 3 quote supposte incognite:

DH AB = H B − H A = ( H B + H ) − ( H A + H )

DH BC = H C − H B = ( H C + H ) − ( H B + H )

DH CA = H A − H C = ( H A + H ) − ( H C + H )

ovvero le quote dei punti (parametri incogniti), presentano

1 grado di libertà, rispetto ai dislivelli (osservabili);

la situazione non cambia aggiungendo una o più

osservazioni di dislivello (a titolo di esercizio lo si

verifichi aggiungendo ad esempio DH AC ).

La rimozione della deficienza di rango

Per rimuovere la deficienza di rango in un problema ai

MQ si deve innanzitutto identificare preventivamente

quali siano i parametri non stimabili del problema: ad

esempio in una rete di livellazione, con sole osservazioni

di dislivelli, sono stimabili le quote di tutti i punti della

rete meno uno.

A tale punto sono possibili (e necessari) due approcci

alternativi.

1. Si vincolano i parametri non stimabili del problema: ciò

equivale a fissare un Sistema di Riferimento in cui

verranno fornite le soluzioni per i restanti parametri

realmente stimabili. Nel problema della rete di livellazione

questo equivale ad attribuire la quota “zero” ad uno dei

punti della rete stessa.

Tale approccio è quello seguito, appunto, nella definizione

dei Sistemi di Riferimento, globali o nazionali.

2. Si riformula il problema aggiungendo nuove

osservazioni sui parametri non stimabili; ad esempio, nella

rete di livellazione, misurando direttamente la quota di uno

o più punti ed inserendo le relative equazioni di

osservazione nel sistema. Tipicamente, nell’ambito delle

reti geodetiche, tali osservazioni aggiuntive, dette anche

pseudoosservazioni, non sono (non possono essere)

ottenute direttamente, ma derivano da fonti esterne, che

abbiano risolto a monte il problema di definire un Sistema

di Riferimento. Ad esempio, in Italia, è prassi inquadrare

le reti locali di livellazione ai caposaldi IGMI (Istituto

Geografico Militare Italiano), utilizzando per questi le

quote trascritte nelle monografie dei punti.

La linearizzazione di un problema non lineare

Non esiste una formulazione dei MQ analoga a

quella già vista nel caso lineare y = Ax + b e

applicabile al problema generale in forma non lineare

y = f (x)

ove

⎧ f1 ( x1 , x2 ,..., xn )

⎪ f ( x , x ,..., x )

⎪ 2 1 2

n

f ( x) = ⎨

...

⎪

⎪⎩ f m ( x1 , x2 ,..., xn )

Per risolvere il problema generale è prima

necessario linearizzarlo

Si suppone di conoscere valori approssimati per

i parametri incogniti:

~

x T = [~

x1 ,..., ~

xn ] ≅ xT : ~

x1 ≅ x1 ,..., ~

xn ≅ xn ;

è allora possibile linearizzare la relazione y = f (x)

mediante uno sviluppo di Taylor arrestato al primo ordine

x:

nell’intorno di ~

∂f

∂f

y1 ≅ f1 (~

x ) + 1 (~

x ) ⋅ ( x1 − ~

x1 ) + ... + 1 (~

x ) ⋅ ( xn − ~

xn )

∂x1

∂xn

∂f

∂f

y2 ≅ f 2 (~

x ) + 2 (~

x ) ⋅ ( x1 − ~

x1 ) + ... + 2 (~

x ) ⋅ ( xn − ~

xn )

∂x1

∂xn

…

∂f

∂f

y m ≅ f m (~

x ) + m (~

x ) ⋅ ( x1 − ~

x1 ) + ... + m (~

x ) ⋅ ( xn − ~

xn )

∂xn

∂x1

ovvero

y = f (~

x ) + J (~

x )(x − ~

x)

o anche

η = Aξ

ove

η = y − f (~

x ) : η1 = y1 − f1 (~

x ),...,η m = y m − f m (~

x)

ξ = x−~

x : ξ1 = x1 − ~

x1 ,..., ξ n = xn − ~

xn

∂f

dim[A ] = m × n;

x)

Aij = i (~

∂x j

Nella prassi operativa si svolgono dunque

le seguenti operazioni:

x;

si forniscono i valori approssimati ~

si calcolano i corrispondenti ~

y;

si calcolano le derivate e quindi gli elementi Aij ;

y.

si calcola il vettore ηO = y O − ~

Si ottiene dunque il problema lineare

ηO = η + ν

E [ηO ] = η = Aξ

con dim[ηΟ, η , ν]=m; dim[ξ]=n; dim[A]= m × n.

Mediante MQ si risolve il problema lineare rispetto

al vettore dei parametri incogniti ξ;

si calcolano i parametri finali mediante la

xˆ = ~

x + ξˆ

yˆ = ~

y + ηˆ

Nota

il metodo da adottarsi per ricavare

i valori approssimati dipende da caso a caso e non viene

considerato in questa esposizione generale.

Gli effetti della linearizzazione

A causa delle approssimazioni introdotte dalla

linearizzazione y=Ax+b per il problema y=f(x)

le prime stime xˆ 1, yˆ 1 fornite dai MQ non possono essere

considerate definitive.

In particolare gli x̂1 divengono nuovi valori approssimati

~

x1 a partire dai quali si effettua una nuova stima.

Il processo iterativo termina quando due stime successive

differiscono in modo non significativo, ovvero quando

xˆ n − ~

xn < ε

con ε assegnato.

Un esempio di linearizzazione per

un problema non lineare

Sia P un punto di posizione incognita in R3:

⎡X P ⎤

P = ⎢ YP ⎥

⎢

⎥

⎣⎢ Z P ⎥⎦

siano invece P1, P2, P3 e P4 quattro punti di posizione nota:

⎡X 1⎤

⎡X 2 ⎤

⎡X 4 ⎤

⎢ ⎥

⎢

⎢

⎥

⎥

P1 = ⎢ Y 1 ⎥ P 2 = ⎢ Y 2 ⎥ … P 4 = ⎢ Y 4 ⎥

⎢Z1 ⎥

⎢Z 2 ⎥

⎢Z 4 ⎥

⎣ ⎦

⎦

⎦

⎣

⎣

Da P sono state misurate le distanze ai quattro punti,

ottenendo i valori ρ1P O ; ρ2P O ; ρ3P O ; ρ4P O ; si indichi con ρ O

il vettore delle osservazioni di distanza.

E’ noto un valore approssimato della posizione di P

~

⎡X P ⎤

~ ⎢~ ⎥

P = ⎢ YP ⎥

⎢⎣ Z~ P ⎥⎦

si vuole stimare la posizione di P.

Procedimento

La generica equazione di osservazione da P a Pi è

ρ Pi = ( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

ρ Pi O = ρ Pi + ν i

la relazione che lega le distanze (osservate a meno degli

errori) alle incognite (la posizione di P) è non lineare;

il sistema è ridondante: 4 osservazioni per 3 incognite;

è possibile risolverlo mediante MQ ma deve

prima essere linearizzato.

Linearizzazione della generica distanza da P a Pi:

ρiP = ( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

~

~

≅ ( X P − X i ) 2 + (YP − Y i ) 2 + ( Z~P − Z i ) 2 +

~

(X P − X i )

~

+

(X P − X P) +

~

~

~

( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

~

(YP − Y i )

~

+

(YP − YP ) +

~

~

~

( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

~

(Z P − Z i )

~

+

(Z P − Z P )

~

~

~

( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

ovvero

ρ Pi ≅ ρ~ Pi + ~e Pi ⋅ ξ

ove

~

~

~

ρ~ Pi = ( X P − X i ) 2 + (YP − Y i ) 2 + ( Z P − Z i ) 2

(distanza calcolata nei valori approssimati)

⎡ X~ P − X i ⎤

~e i = 1 ⎢ Y~ − Y i ⎥

P

⎢ P

⎥

ρ~Pi ⎢ ~

i⎥

Z −Z

⎣ P

⎦

(versore approssimato da Pi a P)

~

⎡XP − XP⎤

~ ⎥

⎢

ξ = ⎢ YP − YP ⎥

⎢⎣ Z P − Z~P ⎥⎦

(correzioni da apportare alle coordinate approssimate)

Il problema assume dunque la forma

⎡ρ1 ⎤ ~1

1

⎢ PO ⎥ ⎡ρ P ⎤ ⎡e~X

2 ⎥ ⎢~ 2

⎢ρ 2P ⎥ ⎢~

e

ρ

⎢ 3O ⎥ = ⎢ P3 ⎥ + ⎢ X3

ρ P ⎥ ⎢e~X

⎢ρ P ⎥ ⎢~

⎢ 4O ⎥ ⎢~

4 ⎥ ⎢~ 4

e

ρ

⎢⎣ρ PO ⎥⎦ ⎢⎣ P ⎥⎦ ⎢⎣ X

e~Y1

e~Y2

e~Y3

e~Y4

e~Z1 ⎤

ξ

2 ⎥⎡ X ⎤

~

eZ ⎥ ⎢ ⎥

ξ

3 ⎥⎢ Y ⎥

~

eZ

⎢ξ ⎥

4 ⎥⎣ Z ⎦

~

eZ ⎥⎦

ovvero

ηO = ρ O − ~

ρ =ρ−~

ρ+ν

= η+ ν

η = Aξ

ora risolvibile mediante MQ.

Errori di modello:

introduzione alla verifica statistica di ipotesi

Errori di modello deterministico:

errata costruzione delle e.o. fra osservazioni e incognite,

ovvero di A e b.

In generale si ha

modello deterministico adottato

y O = Ax + b + ν

modello deterministico corretto

y O = ( A + δA)x + b + δb + ν

Ad esempio,

misuro (yO) una lunghezza in pollici e stimo

il risultato (x) in centimetri, senza convertire:

relazione adottata

yO = ax + ν, a = 1

relazione corretta

yO = ax + ν, a = 2.54cm / inc

Possono essere su tutto il modello

ma tipicamente su singole osservazioni, ovvero:

yiO = (a i + δa i )x + bi + δbi

solo per l’osservazione i-esima.

Sono eliminabili a priori mediante

corretta costruzione delle e.o. (non sempre possibile);

identificabili a posteriori solo (ma non sempre) se non

compaiono sistematicamente in tutte le osservazioni.

Comportano stime errate principalmente

dei parametri incogniti.

Errori di modello stocastico:

errata ipotesi sulla struttura della

matrice Cyy di covarianza delle osservazioni; tipicamente

sovrastima della precisione di alcune osservazioni:

relativi σ 2 = C yy sottostimati ("piccoli");

ii

sottostima delle correlazioni fra coppie di osservazioni:

relativi C yy sottostimati (o posti a zero).

ij

Ovvero:

modello stocastico adottato per l’osservazione i-esima

σ i2 = σ 02 ; σ ij = σ 0 ∀j = 1,..., m

i

ij

modello stocastico corretto

σ i2 = σ 02 + δσi2 ; σ ij = σ 0 + δσij ∀j = 1,..., m

i

ij

Eliminabili a priori mediante

corretta costruzione di Cyy (non sempre possibile);

identificabili a posteriori solo (ma non sempre) se

si dispone di osservazioni ridondanti.

Comportano stime errate

principalmente della matrice di covarianza

dei parametri incogniti.

Il metodo dei MQ non è uno stimatore robusto:

errori di modello deterministico o stocastico,

globali o su osservazioni isolate (outlier),

possono distorcere le stime.

Esistono algoritmi per:

verificare a posteriori la correttezza globale

dei modelli adottati (test del χ2);

identificare eventuali errori di modello

su singole osservazioni

(identificazione degli outlier e data snooping).

La verifica statistica di ipotesi

E' un’operazione che consente di stabilire se,

statisticamente, ovvero con una certa probabilità di errore,

due valori sono uguali o diversi.

Tipicamente: si pone l’ipotesi H0 che le grandezze oggetto

di verifica siano uguali; si costruisce una statistica

campionaria che, sotto l’ipotesi H0,

debba seguire una distribuzione nota;

che viceversa, qualora H0 sia sbagliata,

vada ad assumere valori “grandi”,

ovvero non accettabili statisticamente;

si confronta quindi la statistica campionaria con

i valori limite ammessi dalla sua distribuzione teorica.

Nelle nostre applicazioni la verifica viene finalizzata

al controllo di presenza di errori di modello.

Livello di significatività α del test:

probabilità di errore che si accetta nell’eseguire il test,

tipicamente 0.01, 0.05, 0.10.

Esempio: test del χ2 per il controllo di accuratezza.

Uno strumento di misura deve

essere caratterizzato da accuratezza σ.

Viene effettuata una serie di osservazioni yiO e

viene calcolata la varianza campionaria σ̂ 2 ;

si vuole verificare se σ̂ 2 sia statisticamente uguale a σ 2

a un certo livello di significatività α:

H 0 : σˆ 2 = σ 2

Teoria (non dimostrata):

se fosse vera l’ipotesi H0 dovrebbe valere la

1

σ2 2

2

σˆ =

χ ( N −1)

∑ ( yiO − yˆ ) ~

N −1 i

N −1

2

ove

χ n2 è la V.C. chiquadro a n gradi di libertà,

yˆ =

σ2

1

∑ yi ~ N [ y , ]

N i O

N

la relazione comporta

( N − 1)

σˆ 2

σ2

= χ 2sp ~ χ (2N −1)

si definisce χ 2N −1 (α) il valore limite tale che

P (0 ≤ χ 2N −1 ≤ χ 2N −1 (α)) = 1 − α

P(χ 2N −1 > χ 2N −1 (α)) = α

perché l'ipotesi σˆ 2 = σ 2 sia soddisfatta si deve avere

χ 2sp ≤ χ 2N −1 (α)

se

χ 2sp ≤ χ (2N −1) (α)

ovvero

H 0 : s 2 = σ 2 è vera

se

χ 2sp > χ (2N −1) (α)

H 0 : s 2 = σ 2 è falsa

La verifica di ipotesi per i dati e le reti GPS

Nell’elaborazione dei dati GPS e

nella compensazione di reti rilevate mediante GPS

tipicamente vi sono outlier dovuti

sia all’approssimata conoscenza del modello stocastico

(le osservazioni vengono ipotizzate più accurate e meno

correlate di quanto non siano in realtà);

sia alla presenza di isolati errori di modello deterministico

(alcune osservazioni possono contenere termini di disturbo

di entità significativa e non modellizzabili:

ad es. il multipath o uno stazionamento fuori centro).

Pertanto, in genere,

prima si verifica la correttezza del modello globale,

poi si individuano eventuali outlier,

infine si corregge il modello stocastico.

Il test del χ2 o test globale sul modello

(funzionale e stocastico)

Ipotesi fondamentale H 0 : σˆ 02 = σ 02 .

σˆ 02

2

Statistica di test: 2 (m − n) = χ sp

;

σ0

2

~ χ (2m − n )

se H0 è vera: χ sp

sia α il livello di significatività del test;

2

sia χ m

−n (α) il valore teorico tale che

P (0 ≤ χ 2m −n ≤ χ 2m−n (α)) = 1 − α

se χ 2sp ≤ χ (2m−n) (α) H0 viene accettata;

se χ 2sp > χ (2m−n) (α) H0 viene rigettata:

sono presenti errori di modello.

Esecuzione del test sul modello globale

Si effettua la stima ai MQ

dei parametri incogniti e delle osservabili;

si stimano gli scarti di osservazione ν̂ e quindi il σ̂ 02 ;

si fissa il livello di significatività α per il test;

si ricava il valore di χ (2m−n) (α) da apposite tabelle;

2

si calcola il χ sp

e lo si confronta con il valore teorico.

2

Nota: il valore χ m

−n (α ) viene riportato in tabella

come χ (21−α ) a ν gradi di libertà, ν = m − n

ad esempio:

sia stata effettuata una compensazione

di 10 osservazioni in 2 incognite;

a fronte di un σ 02 = 1cm 2 dichiarato a priori

si sia ottenuto un σˆ 02 = 2.375cm 2 .

Sia fissato α = 5% : 1 − α = 95% = 0.95 ;

dai dati precedenti si ricava (m − n) = 8 ;

dalla tabella si estrae il valore corrispondente alla colonna

χ 02.95 e alla riga v = 8 , ovvero

χ82 (0.05) = 15.5

2

χ sp

= ( m − n)

σˆ 02

σ 02

=8

2.375

= 19 > 15.5

1

Il test non è superato: quindi vi è, a un livello di

probabilità del 95%, un errore di modello.

Se si fosse fissato α = 1% , si sarebbe ottenuto

(colonna della tabella χ 02.99 )

χ82 (0.01) = 20.1 > χ 2sp

ovvero

vi sono errori di modello a livello di significatività 5%,

ma non a livello di significatività 1%.

Il test locale sulla singola osservazione

(ipotesi di osservazioni indipendenti)

Serve per identificare errori di modello deterministico o

stocastico su una singola osservazione yiO :

Ipotesi fondamentale di assenza di errori di modello:

ovvero H 0 :νˆi = 0

νˆ

Statistica di test: i = τ sp ;

σˆ ν i

se H0 è vera: τ sp ~ τ ( m − n )

ove τ ( m − n ) è

la distribuzione di Thomson a ( m – n ) gradi di libertà;

α livello di significatività del test.

Nota

Il test è a due code, ovvero: si devono valutare sia

scarti negativi sia scarti positivi, in modulo “troppo

grandi”

Quindi, definito τ m−n (α / 2) il valore teorico tale che

P(0 ≤ τ m−n ≤ τ m−n (α / 2)) = 1 − α

P(0 ≤ τ m−n > τ m− n (α / 2)) = α

se τ sp ≤ τ ( m − n ) (α / 2) H0 viene accettata;

se τ sp > τ ( m − n ) (α / 2) H0 viene rigettata:

l’osservazione i-esima è un sospetto outlier.

Esecuzione del test locale

La non robustezza dei MQ rende complicata

l’identificazione degli outlier poiché

un outlier modifica anche

gli scarti delle altre osservazioni;

quindi è necessario un procedimento iterativo per

identificare gli outlier (Data snooping).

A ogni iterazione si individua

l’osservazione k per la quale:

⎧⎪ τ sp > τ ( m − n ) (α / 2)

k

⎨

⎪⎩ τ sp k = max τ sp

per gestire il sospetto outlier vi sono due approcci:

1) il sospetto outlier viene eliminato dall’insieme delle

osservazioni (tipicamente quando la τ sp è

significativamente superiore al valore limite);

2) il sospetto outlier viene conservato nell’insieme di

osservazioni, diminuendone però il peso di

compensazione (ovvero aumentandone la varianza):

empiricamente si può adottare

σ i2 New = C yy (i, i ) New = ν i2

(approccio adottabile solo se l’osservazione è indipendente

dalle altre e la τ sp è superiore ma confrontabile con il

valore limite);

[

]

quindi viene ripetuta la stima ai MQ e il test globale;

ci si arresta quando non vi sono più osservazioni sospette.

Si devono poi controllare le osservazioni eliminate

(calcolando i loro scarti)

per eliminarle definitivamente o reintrodurle.

Qualora il test sul modello globale non venga superato

ma non vi siano sospetti outlier (scarti normalizzati

omogenei) vi è tipicamente un problema di sottostima

generale degli elementi della matrice di covarianza delle

osservazioni (sovrastima delle precisioni).

Accuratezza dei parametri stimati

Sono stati eseguiti il test globale sul modello e il data

snooping con esiti positivi. Si considera dunque riuscita la

stima dei parametri, x̂ ; la loro accuratezza è data dalla

relativa matrice di covarianza (nel caso senza deficienza di

rango C xˆxˆ = σˆ 02 N −1).

Ci si chiede quale sia la regione di confidenza per il valore

vero dei parametri incogniti, ovvero la regione dello

spazio n-dimensionale alla quale il vettore x appartiene

con livello di probabilità assegnata.

La regione di confidenza per il vettore dei parametri

incogniti ad un certo livello di probabilità 1-α è data dalla

(x − xˆ )T C x−ˆxˆ1 (x − xˆ ) ≤ Fn,( m − n ) (α)

ove Fn, (m - n)(α) è il valore della funzione F di Fisher a

(n, (m - n)) gradi di libertà, corrispondente alla probabilità

(1 - α);

α: in genere si scelgono i valori 0.01, 0.05, 0.10,

ovvero (1-α)=99%, 95%, 90%.

Nota

Tipicamente si è interessati alla regione di confidenza per

un sottoinsieme di parametri incogniti, ξ, dim[ξ]=r × 1.

Per analizzare la regione di confidenza di ξ:

si estrae dal vettore x̂ il sottovettore ξ̂ corrispondente ai

parametri ξ di interesse; quindi si estrae dalla matrice di

covarianza totale C xˆxˆ la matrice di covarianza del vettore

ξ̂ , C ξˆ ξˆ ;

⎡ σ12 σ

⎡ x1 ⎤

12

⎢

⎢x ⎥

2

σ

σ

2

⎢

2

21

sia x = ⎢ ⎥, C xˆxˆ =

⎢ ...

⎢ ... ⎥

...

⎢

⎢ ⎥

⎣ xn ⎦

⎣⎢σ n1 σ n 2

... σ1n ⎤

⎥

... σ 2 n ⎥

... ... ⎥

⎥

2

... σ n ⎥⎦

⎡ σ i2

⎡ xi ⎤

se ad esempio ξ = ⎢ ⎥ si ha C ξˆ ξˆ = ⎢

⎣x j ⎦

⎣⎢σ ji

σ ij ⎤

⎥

2

σ j ⎥⎦

la regione di confidenza con probabilità 1-α per il vettore

ξ è data dalla

(ξ − ξˆ )T (C ˆ ˆ ) −1 (ξ − ξˆ ) ≤ Fr ,( m − n ) (α)

ξξ

Ad esempio, nel caso di una compensazione di rete

geodetica, tipicamente si vuole conoscere per ogni punto

la regione tridimensionale di confidenza delle coordinate

[XP, YP, ZP] del punto stesso. La regione di confidenza in

questo caso è data da un ellissoide centrato in

[ Xˆ P , YˆP , Zˆ P ] , i cui parametri (semiassi e relative

direzioni) dipendono dalla matrice di covarianza delle

stime delle coordinate del punto.

Ellissoide di confidenza in tre dimensioni

Tabella della F di Fisher

Applicazioni dei MQ rilevanti al corso

Elaborazione delle osservazioni GPS

Le relazioni che legano le osservazioni GPS (fasi e codici)

alle incognite (posizione del ricevitore o componenti della

base) sono simili alle equazioni di distanza; in generale le

osservazioni sono ridondanti, anzi, tipicamente m>>n.

Nella maggior parte dei programmi per l’elaborazione dei

dati GPS il problema di stima viene linearizzato e quindi

risolto mediante MQ.

I programmi in genere applicano ai dati il test del χ2 per

fornire a posteriori un indicatore di qualità dei risultati;

viene inoltre effettuato un data snooping delle singole

osservazioni, per la rimozione di eventuali outlier.

Compensazione di reti geodetiche

Sia stato adottato uno schema di rilievo ridondante

su una rete geodetica.

E’ possibile effettuare una compensazione ai MQ sulla

rete, concettualmente simile al caso della livellazione:

le osservazioni in ingresso sono le stime delle basi fornite

dall’elaborazione dei dati GPS e le relative matrici di

covarianza; i parametri incogniti sono le coordinate

relative dei punti della rete.

La compensazione di rete permette:

una valutazione più realistica sulla precisione delle stime

delle posizioni rispetto a quella fornita dall’elaborazione

dei dati;

l’identificazione di eventuali anomalie su

singole sessioni (errori nelle efemeridi, atmosfera,...)

o su singoli punti (errore nell’altezza d’antenna,...).

Autovalutazione sui Minimi Quadrati:

argomenti e quesiti di importanza fondamentale

Fornisci una definizione per errori casuali,

di modello deterministico e di modello stocastico.

Descrivi il principio di stima dei MQ e scrivi gli stimatori

per x, y, ν, σ̂ 02 , Cxx e Cyy forniti dal metodo in assenza di

deficienza di rango.

Descrivi il problema della deficienza di rango e di come

possa operativamente essere risolto nella compensazione

di reti geodetiche.

Spiega il metodo di linearizzazione per un problema non

lineare e applicalo all’esempio delle osservazioni di

distanza.

Descrivi il test del χ2:

le finalità, la statistica di test e la sua esecuzione.

Descrivi il test sulla singola osservazione:

le finalità, la statistica di test e la sua esecuzione.

La definizione di regione di confidenza per i parametri

stimati e per un loro sottoinsieme.