POPOLAZIONE E CAMPIONI

POPOLAZIONE insieme di tutti quegli elementi che

hanno almeno una caratteristica comune (persone,

oggetti,misure, osservazioni). Consideriamo il caso di

caratteristiche associate a grandezze misurabili.

– p. 1/2

POPOLAZIONE E CAMPIONI

POPOLAZIONE insieme di tutti quegli elementi che

hanno almeno una caratteristica comune (persone,

oggetti,misure, osservazioni). Consideriamo il caso di

caratteristiche associate a grandezze misurabili.

CAMPIONE sottoinsieme finito di elementi estratti a

caso dalla popolazione.

– p. 1/2

POPOLAZIONE E CAMPIONI

POPOLAZIONE insieme di tutti quegli elementi che

hanno almeno una caratteristica comune (persone,

oggetti,misure, osservazioni). Consideriamo il caso di

caratteristiche associate a grandezze misurabili.

CAMPIONE sottoinsieme finito di elementi estratti a

caso dalla popolazione.

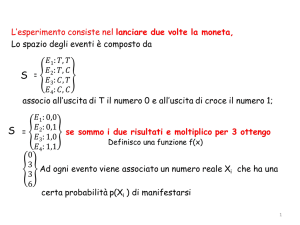

VARIABILE CASUALE X : funzione che associa in

modo univoco ad ogni elemento del campione un

numero reale.

– p. 1/2

POPOLAZIONE E CAMPIONI

– p. 2/2

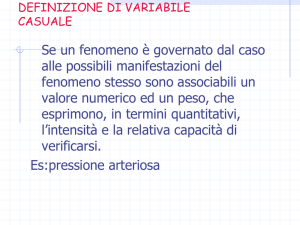

VARIABILI CASUALI

variabile casuale o aleatoria: grandezza che può assumere nel corso

di una prova un valore sconosciuto a priori. Legata al verificarsi di un

evento casuale.

– p. 3/2

VARIABILI CASUALI

variabile casuale o aleatoria: grandezza che può assumere nel corso

di una prova un valore sconosciuto a priori. Legata al verificarsi di un

evento casuale.

Funzione X che associa ad ogni elemento dello spazio dei risultati

(popolazione) S = {E1 , E2 , · · · · · ·} uno e un solo numero reale:

X(Ei ) = xi

– p. 3/2

VARIABILI CASUALI

variabile casuale o aleatoria: grandezza che può assumere nel corso

di una prova un valore sconosciuto a priori. Legata al verificarsi di un

evento casuale.

Funzione X che associa ad ogni elemento dello spazio dei risultati

(popolazione) S = {E1 , E2 , · · · · · ·} uno e un solo numero reale:

X(Ei ) = xi

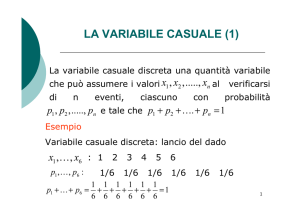

variabile casuale discreta: assume valori entro un insieme finito o

numerabile (corrispondenza univoca con i numeri naturali)

– p. 3/2

VARIABILI CASUALI

variabile casuale o aleatoria: grandezza che può assumere nel corso

di una prova un valore sconosciuto a priori. Legata al verificarsi di un

evento casuale.

Funzione X che associa ad ogni elemento dello spazio dei risultati

(popolazione) S = {E1 , E2 , · · · · · ·} uno e un solo numero reale:

X(Ei ) = xi

variabile casuale discreta: assume valori entro un insieme finito o

numerabile (corrispondenza univoca con i numeri naturali)

variabile casuale continua: assume valori entro un insieme non

numerabile (corrispondenza univoca con i numeri reali).

– p. 3/2

VARIABILI CASUALI ↔ MISURE

Un insieme finito di operazioni di misura può essere

pensato come un campione, cioè un particolare

sottoinsieme formato da elementi estratti a caso

dall’insieme di tutte le infinite possibili operazioni di

misura (popolazione) che potrebbero essere effettuate

sulla stessa grandezza fisica, eseguite col medesimo

strumento e sfruttando le medesime procedure.

– p. 4/2

VARIABILI CASUALI ↔ MISURE

Un insieme finito di operazioni di misura può essere

pensato come un campione, cioè un particolare

sottoinsieme formato da elementi estratti a caso

dall’insieme di tutte le infinite possibili operazioni di

misura (popolazione) che potrebbero essere effettuate

sulla stessa grandezza fisica, eseguite col medesimo

strumento e sfruttando le medesime procedure.

Il risultato numerico di una misura affetta da errori

casuali è una variabile casuale.

– p. 4/2

VARIABILI CASUALI DISCRETE

Hp: Ogni evento Ei abbia una probabilità pi di verificarsi

– p. 5/2

VARIABILI CASUALI DISCRETE

Hp: Ogni evento Ei abbia una probabilità pi di verificarsi

Gli elementi di S = {E1 , E2 , · · · · · ·} sono incompatibili e

P

definiscano l’intero spazio dei risultati → i=1 pi = 1

(probabilità totale).

– p. 5/2

VARIABILI CASUALI DISCRETE

Hp: Ogni evento Ei abbia una probabilità pi di verificarsi

Gli elementi di S = {E1 , E2 , · · · · · ·} sono incompatibili e

P

definiscano l’intero spazio dei risultati → i=1 pi = 1

(probabilità totale).

Analogia con il caso di una serie di N misure ripetute.

Infatti, i risultati possono essere raggruppati in M classi

di frequenza relativa fi = ni /N tali che

PM

PM

e

i=1 fi = 1

i=1 ni = N .

– p. 5/2

VARIABILI CASUALI DISCRETE

Hp: Ogni evento Ei abbia una probabilità pi di verificarsi

Gli elementi di S = {E1 , E2 , · · · · · ·} sono incompatibili e

P

definiscano l’intero spazio dei risultati → i=1 pi = 1

(probabilità totale).

Analogia con il caso di una serie di N misure ripetute.

Infatti, i risultati possono essere raggruppati in M classi

di frequenza relativa fi = ni /N tali che

PM

PM

e

i=1 fi = 1

i=1 ni = N .

Dal teorema di Bernoulli sappiamo che se N → ∞

allora f → p, per cui ritroviamo la relazione precedente.

– p. 5/2

VARIABILI CASUALI DISCRETE

Hp: Ogni evento Ei abbia una probabilità pi di verificarsi

Gli elementi di S = {E1 , E2 , · · · · · ·} sono incompatibili e

P

definiscano l’intero spazio dei risultati → i=1 pi = 1

(probabilità totale).

Analogia con il caso di una serie di N misure ripetute.

Infatti, i risultati possono essere raggruppati in M classi

di frequenza relativa fi = ni /N tali che

PM

PM

e

i=1 fi = 1

i=1 ni = N .

Dal teorema di Bernoulli sappiamo che se N → ∞

allora f → p, per cui ritroviamo la relazione precedente.

Un campione di misure ripetute in identiche condizioni

della stessa grandezza corrisponde ad eventi

incompatibili. Se N è molto grande, vale la condizione

di normalizzazione delle frequenze relative.

– p. 5/2

DISTRIBUZIONI DI PROBABILITÀ

Distribuzione di probabilità P (X) di una variabile

casuale X:

relazione che stabilisce una corrispondenza univoca tra i

valori di tale variabile e la loro probabilità.

– p. 6/2

DISTRIBUZIONI DI PROBABILITÀ

Distribuzione di probabilità P (X) di una variabile

casuale X:

relazione che stabilisce una corrispondenza univoca tra i

valori di tale variabile e la loro probabilità.

– p. 6/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di un dado

– p. 7/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di un dado

Variabile casuale: numero uscito

X = {1, 2, 3, 4, 5, 6}

– p. 7/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di un dado

Variabile casuale: numero uscito

X = {1, 2, 3, 4, 5, 6}

Distribuzione di probabilità:

P (X) = {1/6, 1/6, 1/6, 1/6, 1/6, 1/6}

– p. 7/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di 2 dadi

– p. 8/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di 2 dadi

Variabile casuale: somma dei punteggi X = 2, 3, 4, · · · 12

undici elementi → Xi = i + 1; i = 1, 2, 3, ...11

– p. 8/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di 2 dadi

Variabile casuale: somma dei punteggi X = 2, 3, 4, · · · 12

undici elementi → Xi = i + 1; i = 1, 2, 3, ...11

Il numero di possibili coppie è 62 . Dobbiamo considerare

le combinazioni che corrispondono alla stessa somma

dei punteggi, e.g. 4 = 1 + 3 = 2 + 2 = 3 + 1, 3 eventi

incompatibili (probabilità totale).

– p. 8/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di 2 dadi

Variabile casuale: somma dei punteggi X = 2, 3, 4, · · · 12

undici elementi → Xi = i + 1; i = 1, 2, 3, ...11

Il numero di possibili coppie è 62 . Dobbiamo considerare

le combinazioni che corrispondono alla stessa somma

dei punteggi, e.g. 4 = 1 + 3 = 2 + 2 = 3 + 1, 3 eventi

incompatibili (probabilità totale).

Si noti che nel lancio di due dadi, l’uscita di due numeri

corrisponde a 2 eventi compatibili indipendenti

(probabilità composta).

– p. 8/2

DISTRIBUZIONI DI PROBABILITÀ

Prova o esperimento: lancio di 2 dadi

Variabile casuale: somma dei punteggi X = 2, 3, 4, · · · 12

undici elementi → Xi = i + 1; i = 1, 2, 3, ...11

Il numero di possibili coppie è 62 . Dobbiamo considerare

le combinazioni che corrispondono alla stessa somma

dei punteggi, e.g. 4 = 1 + 3 = 2 + 2 = 3 + 1, 3 eventi

incompatibili (probabilità totale).

Si noti che nel lancio di due dadi, l’uscita di due numeri

corrisponde a 2 eventi compatibili indipendenti

(probabilità composta).

Quindi P (4) = P (1, 3) + P (2, 2) + P (3, 1) =

1/6 · 1/6 + 1/6 · 1/6 + 1/6 · 1/6 = 3/36

– p. 8/2

DISTRIBUZIONI DI PROBABILITÀ

La distribuzione di probabilità risultante è:

– p. 9/2

DISTRIBUZIONI DI PROBABILITÀ

– p. 10/2

DISTRIBUZIONI DI PROBABILITÀ

– p. 11/2

FUNZIONE DI DISTRIBUZIONE CUMULATIVA

La funzione di distribuzione cumulativa associa ad ogni valore x della

variabile casuale X la somma delle probabilità che la stessa assuma

valori ≤ x.

X

F (x) = P (X, x) =

p(xi )

xi ≤x

– p. 12/2

FUNZIONE DI DISTRIBUZIONE CUMULATIVA

La funzione di distribuzione cumulativa associa ad ogni valore x della

variabile casuale X la somma delle probabilità che la stessa assuma

valori ≤ x.

X

F (x) = P (X, x) =

p(xi )

xi ≤x

Nel caso del lancio di un dado si avra’

– p. 12/2

FUNZIONE DI DISTRIBUZIONE CUMULATIVA

La funzione di distribuzione cumulativa associa ad ogni valore x della

variabile casuale X la somma delle probabilità che la stessa assuma

valori ≤ x.

X

F (x) = P (X, x) =

p(xi )

xi ≤x

Nel caso del lancio di un dado si avra’

Nel caso di variabili discrete è rappresentata da una funzione a

gradini, non decrescente, che raggiunge il massimo a 1.

– p. 12/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

– p. 13/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

– p. 13/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

– p. 13/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

x̄ → E(x) per N → ∞: importante, abbiamo collegato la media

aritmetica osservata alla distribuzione teorica!!!

– p. 13/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

x̄ → E(x) per N → ∞: importante, abbiamo collegato la media

aritmetica osservata alla distribuzione teorica!!!

E(x) può non esistere, la serie non converge; E(x) può non

appartenere al dominio di X.

– p. 13/2

VALORE DI ASPETTAZIONE (caso discre

Lancio del dado (uscita di una faccia)

E(x) = 1/6 · 1 + 1/6 · 2...1/6 · 6 = 21

= 3.5

6

– p. 14/2

VALORE DI ASPETTAZIONE (caso discre

Lancio del dado (uscita di una faccia)

E(x) = 1/6 · 1 + 1/6 · 2...1/6 · 6 = 21

= 3.5

6

Lancio di 2 dadi (somma dei punteggi)

E(x) = 1·2+2·3+3·4+4·5+5·6+6·7+5·8+4·9+3·10+2·11+1·12

=7

36

– p. 14/2

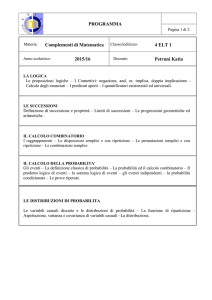

INFORMAZIONI

Prossime lezioni

Giorno Ora

Dove

17/02 14:30

P50

19/02 14:30 LABORATORIO (Via Loredan)

24/02 14:30

P50 ? da definirsi

26/02 14:30

Aula informatica (6 gruppi)

03/03 14:30

P50

05/03 14:30

Aula informatica (6 gruppi)

– p. 15/2

INFORMAZIONI

Prossime lezioni

Giorno Ora

Dove

17/02 14:30

P50

19/02 14:30 LABORATORIO (Via Loredan)

24/02 14:30

P50 ? da definirsi

26/02 14:30

Aula informatica (6 gruppi)

03/03 14:30

P50

05/03 14:30

Aula informatica (6 gruppi)

Decidere la spartizione tra i 2 due turni per l’aula inform.

– p. 15/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

– p. 16/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

– p. 16/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

– p. 16/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

x̄ → E(x) per N → ∞: importante, abbiamo collegato la media

aritmetica osservata alla distribuzione teorica!!!

– p. 16/2

VALORE DI ASPETTAZIONE

Il valore di aspettazione o speranza matematica di una variabile

casuale discreta X è

E(x) =

P

i

pi xi

Terminologia inglese: expected value

Il valore medio della variabile X su un campione finito di dimensione

N , suddiviso in M gruppi è

PM

x̄ = i=1 fi xi

Sappiamo che fi → pi per N → +∞ (Th. di Bernoulli).

x̄ → E(x) per N → ∞: importante, abbiamo collegato la media

aritmetica osservata alla distribuzione teorica!!!

E(x) può non esistere, la serie non converge; E(x) può non

appartenere al dominio di X.

– p. 16/2

VARIANZA DI UNA DISTRIBUZIONE DISCRETA

Errore di una variabile casuale: x − E(x)

– p. 17/2

VARIANZA DI UNA DISTRIBUZIONE DISCRETA

Errore di una variabile casuale: x − E(x)

Varianza: definita come il valore di aspettazione della

variabile casuale [x − E(x)]2

P

2

2

2

=

V ar(x) = σx = E [x − E(x)]

p

[x

−

E(x)]

i

i

i

– p. 17/2

VARIANZA DI UNA DISTRIBUZIONE DISCRETA

Errore di una variabile casuale: x − E(x)

Varianza: definita come il valore di aspettazione della

variabile casuale [x − E(x)]2

P

2

2

2

=

V ar(x) = σx = E [x − E(x)]

p

[x

−

E(x)]

i

i

i

Si dimostra che:

σx2 = E(x2 ) − [E(x)]2

– p. 17/2

VARIANZA DI UNA DISTRIBUZIONE DISCRETA

Errore di una variabile casuale: x − E(x)

Varianza: definita come il valore di aspettazione della

variabile casuale [x − E(x)]2

P

2

2

2

=

V ar(x) = σx = E [x − E(x)]

p

[x

−

E(x)]

i

i

i

Si dimostra che:

σx2 = E(x2 ) − [E(x)]2

Deviazione standard o errore quadratico medio σx :

radice quadrata della varianza.

– p. 17/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

Si dimostra che:

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

Si dimostra che:

E(f ) = a E(x) + b E(y) + c E(z) · · ·

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

Si dimostra che:

E(f ) = a E(x) + b E(y) + c E(z) · · ·

La media aritmetica può essere vista come combinazione

lineare delle N misure, con coefficienti tutti uguali a 1/N .

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

Si dimostra che:

E(f ) = a E(x) + b E(y) + c E(z) · · ·

La media aritmetica può essere vista come combinazione

lineare delle N misure, con coefficienti tutti uguali a 1/N .

Applicando il teorema si ottiene E(x̄) = E(x)

– p. 18/2

COMBINAZIONI LINEARI: VALORE DI ASPETTAZION

Sia f = ax + by + cz · · ·, con a, b, c coefficienti costanti

Siano E(x), E(y), E(z), · · · i valori di aspettazione

Si dimostra che:

E(f ) = a E(x) + b E(y) + c E(z) · · ·

La media aritmetica può essere vista come combinazione

lineare delle N misure, con coefficienti tutti uguali a 1/N .

Applicando il teorema si ottiene E(x̄) = E(x)

Il valore di aspettazione della popolazione delle medie

aritmetiche dei campioni di dimensione finita N coincide

con il valore di aspettazione della popolazione stessa.

– p. 18/2

COMBINAZIONI LINEARI: VARIANZA

Hp: le variabili x,y, z siano statisticamente indipendenti, cioè

corrispondenti ad eventi compatibili indipendenti.

– p. 19/2

COMBINAZIONI LINEARI: VARIANZA

Hp: le variabili x,y, z siano statisticamente indipendenti, cioè

corrispondenti ad eventi compatibili indipendenti.

Si dimostra che:

σf 2 = a2 σx 2 + b2 σy 2 + c2 σz 2 + · · ·

– p. 19/2

COMBINAZIONI LINEARI: VARIANZA

Hp: le variabili x,y, z siano statisticamente indipendenti, cioè

corrispondenti ad eventi compatibili indipendenti.

Si dimostra che:

σf 2 = a2 σx 2 + b2 σy 2 + c2 σz 2 + · · ·

Una combinazione lineare, a coefficienti costanti, di due variabili

casuali statisticamente indipendenti ha varianza uguale alla

combinazione lineare delle rispettive varianze, con coefficienti pari ai

quadrati dei coefficienti rispettivi.

– p. 19/2

COMBINAZIONI LINEARI: VARIANZA

Hp: le variabili x,y, z siano statisticamente indipendenti, cioè

corrispondenti ad eventi compatibili indipendenti.

Si dimostra che:

σf 2 = a2 σx 2 + b2 σy 2 + c2 σz 2 + · · ·

Una combinazione lineare, a coefficienti costanti, di due variabili

casuali statisticamente indipendenti ha varianza uguale alla

combinazione lineare delle rispettive varianze, con coefficienti pari ai

quadrati dei coefficienti rispettivi.

Ritrovere questo risultato nell’ambito della propagazione degli errori

nelle misure effettuate con metodi indiretti.

– p. 19/2

COMBINAZIONI LINEARI: VARIANZA

Hp: le variabili x,y, z siano statisticamente indipendenti, cioè

corrispondenti ad eventi compatibili indipendenti.

Si dimostra che:

σf 2 = a2 σx 2 + b2 σy 2 + c2 σz 2 + · · ·

Una combinazione lineare, a coefficienti costanti, di due variabili

casuali statisticamente indipendenti ha varianza uguale alla

combinazione lineare delle rispettive varianze, con coefficienti pari ai

quadrati dei coefficienti rispettivi.

Ritrovere questo risultato nell’ambito della propagazione degli errori

nelle misure effettuate con metodi indiretti.

Due variabili casuali che differiscano per una quantità costante

hanno la stessa varianza.

t = x + cost. → σt2 = σx2 (→...gli errori sistematici non alterano la

precisione dei dati...)

– p. 19/2

L’ERRORE QUADRATICO MEDIO DELLA MEDIA

1

N

PN

Variabile casuale: media aritmetica x̄ =

i=1 xi :

combinazione lineare delle N misure con coefficienti

uguali a 1/N

– p. 20/2

L’ERRORE QUADRATICO MEDIO DELLA MEDIA

1

N

PN

Variabile casuale: media aritmetica x̄ =

i=1 xi :

combinazione lineare delle N misure con coefficienti

uguali a 1/N

Varianza σx̄ 2

N

X

1

1

2

σxi = 2 · N σx 2

= 2

N i=1

N

σx̄ 2

σx 2

=

N

– p. 20/2

L’ERRORE QUADRATICO MEDIO DELLA MEDIA

1

N

PN

Variabile casuale: media aritmetica x̄ =

i=1 xi :

combinazione lineare delle N misure con coefficienti

uguali a 1/N

Varianza σx̄ 2

N

X

1

1

2

σxi = 2 · N σx 2

= 2

N i=1

N

σx̄ 2

σx 2

=

N

IMPLICAZIONI: L’errore quadratico medio della media di

un campione

– p. 20/2

L’ERRORE QUADRATICO MEDIO DELLA MEDIA

1

N

PN

Variabile casuale: media aritmetica x̄ =

i=1 xi :

combinazione lineare delle N misure con coefficienti

uguali a 1/N

Varianza σx̄ 2

N

X

1

1

2

σxi = 2 · N σx 2

= 2

N i=1

N

σx̄ 2

σx 2

=

N

IMPLICAZIONI: L’errore quadratico medio della media di

un campione

è minore dell’analogo errore delle singole misure.

– p. 20/2

L’ERRORE QUADRATICO MEDIO DELLA MEDIA

1

N

PN

Variabile casuale: media aritmetica x̄ =

i=1 xi :

combinazione lineare delle N misure con coefficienti

uguali a 1/N

Varianza σx̄ 2

N

X

1

1

2

σxi = 2 · N σx 2

= 2

N i=1

N

σx̄ 2

σx 2

=

N

IMPLICAZIONI: L’errore quadratico medio della media di

un campione

è minore dell’analogo errore delle singole misure.

tende a zero al crescere del numero di misure effettuato.

– p. 20/2

DISTRIBUZIONE UNIFORME DISCRETA

La funzione di distribuzione di probabilità assume lo stesso valore

per tutti i valori della variabile casuale: p(x) = p per ogni x = 1, · · · n

– p. 21/2

DISTRIBUZIONE UNIFORME DISCRETA

La funzione di distribuzione di probabilità assume lo stesso valore

per tutti i valori della variabile casuale: p(x) = p per ogni x = 1, · · · n

Dalla condizione di normalizzazione: → pi = 1/n

– p. 21/2

DISTRIBUZIONE UNIFORME DISCRETA

La funzione di distribuzione di probabilità assume lo stesso valore

per tutti i valori della variabile casuale: p(x) = p per ogni x = 1, · · · n

Dalla condizione di normalizzazione: → pi = 1/n

Valore si aspettazione

n

1 n(n + 1)

n+1

1X

i=

=

E(x) = 1·1/n+2·1/n · · · n·1/n = 1/n =

n i=1

n

2

2

(Si è usata la relazione

n

X

i=1

i=

n(n + 1)

dalla teoria delle progressioni aritmetiche )

2

– p. 21/2

DISTRIBUZIONE UNIFORME DISCRETA

La funzione di distribuzione di probabilità assume lo stesso valore

per tutti i valori della variabile casuale: p(x) = p per ogni x = 1, · · · n

Dalla condizione di normalizzazione: → pi = 1/n

Valore si aspettazione

n

1 n(n + 1)

n+1

1X

i=

=

E(x) = 1·1/n+2·1/n · · · n·1/n = 1/n =

n i=1

n

2

2

(Si è usata la relazione

n

X

i=1

i=

n(n + 1)

dalla teoria delle progressioni aritmetiche )

2

Varianza:

Pn 2 Pn 2

(n + 1)(2n + 1) (n + 1)2

i=1 i

i=1 i

2

σ =

−

−

=

=

n

n

6

4

n + 1 2n + 1 n + 1

n + 1 4n + 2 − 3n − 3

n2 − 1

−

=

·

=

2

3

2

2

6

12

P

)

(Si è usata la relazione ni=1 i2 = n(n+1)(2n+1)

6

– p. 21/2

DISTRIBUZIONE UNIFORME DISCRETA

La funzione di distribuzione di probabilità assume lo stesso valore

per tutti i valori della variabile casuale: p(x) = p per ogni x = 1, · · · n

Dalla condizione di normalizzazione: → pi = 1/n

Valore si aspettazione

n

1 n(n + 1)

n+1

1X

i=

=

E(x) = 1·1/n+2·1/n · · · n·1/n = 1/n =

n i=1

n

2

2

(Si è usata la relazione

n

X

i=1

i=

n(n + 1)

dalla teoria delle progressioni aritmetiche )

2

Varianza:

Pn 2 Pn 2

(n + 1)(2n + 1) (n + 1)2

i=1 i

i=1 i

2

σ =

−

−

=

=

n

n

6

4

n + 1 2n + 1 n + 1

n + 1 4n + 2 − 3n − 3

n2 − 1

−

=

·

=

2

3

2

2

6

12

P

)

(Si è usata la relazione ni=1 i2 = n(n+1)(2n+1)

6

Il valore di aspettazione e la varianza del punteggio associato al

36−1

2

lancio di un dado sono : E(x) = 6+1

2 = 3.5 e σ = 12 ∼ 2.92

– p. 21/2

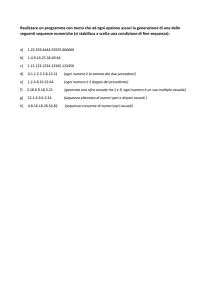

ESERCIZI

Data una serie di n misure {mi }, come cambiano media

aritmetica e scarto quadratico medio se ogni misura

è moltiplicata per 2: yi = 2 · xi ?

è incrementata di 2: yi = 2 + xi ?

– p. 22/2

ESERCIZI

Considera la seguente distribuzione di frequenza. Qual

è la frequenza mancante nella posizione occupata

dall’asterisco?

Classi

Freq. ass. Freq. cumulata in %

fino a 584

1

4.00%

584 − |1774.4

*

64.00%

1774.4 − |2964.8

4

80.00%

2964.8 − |4155.2

3

92.00%

4155.2 − |5345.6

1

92.00%

più di 5345.6

1

100.00%

A)25

B)15

C)16

D)3

– p. 23/2

ESERCIZI

Data la seguente distribuzione di probabilità:

x

0

1

2

3

4

5

6

P (x) 0.17 0.19 0.23 0.16 0.14 0.14 0.07

Quale delle seguenti affermazioni è vera?

A)P (X > 3) = 0.51

C)P (2 ≤ X ≤ 5) = 0.33

B)P (X ≤ 3) = 0.65

D)P (X < 6) = 1

– p. 24/2