Interpolazione

Dopo aver raccolto una certa popolazione di dati statistici relativi ad un certo fenomeno

da analizzare, dopo averli rappresentati graficamente ed aver sintetizzato tramite

opportuni indici (di posizione, di dispersione, di forma) i dati di un carattere quantitativo,

è possibile utilizzare delle tecniche per semplificare, attraverso l’uso di opportune

funzioni matematiche, l’informazione contenuta nei dati statistici.

Per far questo è necessario verificare se esiste un modello matematico che segua

l’evoluzione del fenomeno.

I dati rilevati potrebbero essere disturbati da un elemento “perturbatore” la cui influenza

deve essere ridotta il più possibile. Oppure i dati potrebbero presentare delle “lacune”. Il

procedimento che si utilizza per colmare queste lacune è detto INTERPOLAZIONE. Se il

processo avviene al di fuori del campo di rilevazione si parla di ESTRAPOLAZIONE. Si

parla infine di PEREQUAZIONE se si tratta di “aggiustare” i dati rilevati per “depurarli”

dagli elementi perturbatori. In generale questi tre problemi si affrontano mediante le

medesime tecniche e, in generale, ci si riferisce ad essi semplicemente con il termine

INTERPOLAZIONE.

Interpolazione Analitica

Consiste nel ricercare una funzione matematica “modello” che rappresenti nel modo

migliore la distribuzione del fenomeno osservato.

1

Interpolazione

Si parla, con evidenza di termini, di :

Interpolazione matematica o interpolazione per punti

e

Interpolazione statistica o interpolazione fra punti

Si assume che si abbia a che fare con due variabili aleatorie, che chiameremo X ed Y, e

che si debba cercare una funzione Y=f(X) ,detta funzione interpolante o curva di

regressione di Y su X , che approssimi nel “miglior” modo possibile i dati rilevati.

E’ chiaro che deve essere esplicitato il criterio di ottimo per la scelta della curva di

regressione.

In generale la funzione interpolante dipenderà da alcuni parametri (che ne determinano

le caratteristiche analitiche, ad es. il coefficiente angolare e l’intercetta all’origine per

una retta) la determinazione dei quali avviene attraverso il criterio di ottimo che viene

2

utilizzato.

Funzioni Interpolanti

E’ utile a volte stabilire a priori quali siano i tipi di funzioni interpolanti da utilizzare:

y mx q

k

y

x

retta

y ax 2 bx c

parabola

iperbole

Fasi dell’interpolazione (Regressione)

A) Scelta della funzione interpolatrice

B) Determinazione dei parametri

I. Metodo dei minimi quadrati

II. [ Metodo dei momenti ]

C) Determinazione del grado di accostamento

Si consideri inoltre il fatto che ci si occuperà solo di regressioni lineari. Con ciò si

intendono regressioni operate solo con funzioni che dipendono linearmente DAI

PARAMETRI (non dalla variabile)!

3

Regressione Lineare. Retta.

Metodo dei minimi quadrati

X

x1

x2

...

xn

Si assumano i dati statistici rilevati per le variabili statistiche X ed Y

secondo il seguente schema :

Si voglia determinare la retta di regressione di Y su X (ed

eventualmente di X su Y) secondo il metodo dei minimi quadrati:

Scriviamo:

y mx q

x m' y q'

Si consideri al seguente funzione:

Y

y1

y2

...

yn

F (m, q) yi (mx i q)

2

i

In essa compaiono i quadrati delle differenze tra i valori rilevati yi ed i valori teorici del

modello di regressione (mxi+q): il metodo dei minimi quadrati richiede che la funzione

F(m,q) sia minima e che questa condizione costituisca il criterio di ottimo per la

determinazione dei parametri m e q.

F (m, q) Minima

m, q

4

Regressione Lineare. Retta.

Metodo dei minimi quadrati

Il minimo è determinato dal seguente sistema di equazioni:

2

yi q mxi

F (m, q )

i

F ( m, q )

2 yi q mxi (1) 0

0

q

q

q

i

2

F

(

m

,

q

)

yi q mxi

0 F (m, q )

m

i

2 yi q mxi ( xi ) 0

m

m

i

yi nq m xi n y nq mnx 0

yi q mxi 0

i

i

i

2

2

y

x

q

x

m

x

n

xy

qn

x

mn

x

0

i i

i

i

yi q mxi ( xi ) 0

i

i

i

i

q y m x

xy m x 2

q

x

xy m x 2

y mx

x

xy m x y x m x

2

2

5

Regressione Lineare. Retta.

Metodo dei minimi quadrati

xy m x y x m x

2

2

mx x

2

2

*

xy y x m m

xy y x

x x

2

2

Cov ( x, y )

Var ( x)

q q* y m* x

Se facessi la regressione di X su Y otterrei :

x m' y q'

Nota: Il Punto

m'*

P x; y

xy y x

y y

2

2

Cov ( x, y )

Var ( y )

q'* x m'* y

Appartiene sempre alla retta di regressione

R : y m* x q *

m* x y m* x y

6

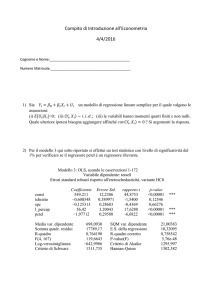

Regressione Lineare: calcolo esplicito ed

esempio con excel

Es. Excel: (08_Interp_Lineare_Retta.xls)

x_i

5

6

3

8,5

9,5

y_i

2

4

1,4

5

6

s_x_i

-1

0

-3

2,5

3,5

s_y_i

-1,5

0,5

-2,1

1,5

2,5

s_x_i*s_y_i

1,5

0

6,3

3,75

8,75

s_x_i^2

1

0

9

6,25

12,25

s_y_i^2

2,25

0,25

4,41

2,25

6,25

4

2,6

-2

-0,9

1,8

4

0,81

totali

36

21

0

0

22,1

32,5

16,22

m(x)

6

m(y)

3,5

y=q+mx

q=

-0,58intercetta

-0,58

m=

0,68pendenza

0,68

r2=

x=q'+m'y

q'=

1,231196intercetta

1,231196

m'=

1,362515pendenza

1,362515

0,92651

7

Regressione Lineare. Retta.

Metodo dei minimi quadrati: calcolo esplicito

ed esempio con excel

y su x

7

x_i

3

4

5

6

8,5

9,5

y_i

1,4

2,6

2

4

5

6

y = 0,68x - 0,58

R² = 0,9265

6

5

4

y_i

3

Lineare (y_i)

2

1

0

0

2

4

6

8

10

x su y

y = 1,3625x + 1,2312

R² = 0,9265

10

9

y_i

1,4

2,6

2

4

5

6

x_i

3

4

5

6

8,5

9,5

8

7

6

5

x_i

4

Lineare (x_i)

3

2

8

1

0

0

2

4

6

8

Relazione con il coefficiente di BravaisPearson

Si chiama coefficiente di correlazione lineare r tra le grandezza X ed Y la media

geometrica dei coefficienti angolari delle rette di regressione di Y su X e di X su Y:

r m m'

*

r m* m'* r

*

XY

XY

Dove il segno ± è scelto a seconda del segno

(concorde) dei coefficienti. Ne segue:

Che è l’indice di Bravais - Pearson

Ricordiamo che:

Per r=+1 si parla di correlazione perfetta diretta

Per r=-1 si parla di correlazione perfetta indiretta

Per r=0 si parla di correlazione nulla

Come indice per indicare la bontà della

regressione si usa, solitamente, l’indice r2

2

r 2 m* m'* r 2 2 XY 2

XY

9

Relazione con il coefficiente di BravaisPearson

Notiamo che se quando r = 0, diciamo che i dati sono incorrelati, ma, questo non significa che i

dati non siano in relazione. Per esempio, se i dati cadessero su una parabola y = (x – 1)2 per

valori di x compresi tra 0 e 2, la correlazione sarebbe vicina a 0, ma i dati sarebbero strettamente

in relazione (vedere figura sottostante con indicato il coefficiente r sopra la figura).

10

Regressione Lineare e variabili standardizzate

y mx q

mm

*

xy y x

x

2

x

2

Cov ( x, y )

q q* y m* x

Var ( x)

y m* x q* y m* x m* x y m* ( x x)

XY

Y

y y m ( x x) 2 ( x x) r

( x x)

X

X

y y

( x x)

r

YST rX ST

Variabili standardizzate

Y

X

*

Dalla regressione di X su Y otterrei:

x m' y q'

m'

*

xy y x

y y

2

2

Cov ( x, y )

Var ( y )

q'* x m'* y

X ST rYST

11

Regressione Lineare e variabili standardizzate

y mx q

YST rX ST

Variabili standardizzate

x m' y q'

X ST rYST

Nel piano cartesiano (X_ST, Y_ST) le rette sopra indicate hanno coefficienti angolari r

ed 1/r e dunque sono simmetriche rispetto alla bisettrice I-III quadrante o II-IV a

seconda del segno di r.

Al tendere di r a +1 o -1 esse tendono a coincidere con la bisettrice (casi di

correlazione perfetta diretta per r=+1 o correlazione perfetta indiretta per r=-1)

12

Calcolo parametri di regressione

Consideriamo la regressione di Y su x:

xy x y

Cov( X , Y )

m

2

Var ( X )

x2 x

*

q * y m* x

x y n x y x x y y

n

Se moltiplichiamo per n

numeratore e denominatore

otteniamo:

m

*

n

i 1

n

i

i

x n x

i 1

2

i

2

i 1

i

i

x x

n

i 1

2

i

q* y m* x

13

Calcolo parametri di regressione

n

n

i 1

i 1

S XY xi yi n x y xi x yi y

n

n

S XX x n x xi x

2

i

i 1

n

A cui aggiungiamo:

Ed, in particolare:

Cov( X , Y )

S XY

n

S XY

*

m

S XX

2

i 1

n

SYY y n y yi y

2

i

i 1

Risulterà allora:

2

2

2

i 1

Var ( X )

S XX

n

Var (Y )

SYY

n

2

2

S

XY

r 2 2 XY 2

X Y S XX SYY

14

Scomposizione della varianza e grado di

accostamento

Valutiamo il grado di accostamento e quindi la bontà della regressione andando a considerare le

differenze tra i valori teorici dettati dalla regressione che chiameremo yi* ed i valori misurati

(sperimentali) yi . Valgono le seguenti definizioni:

Def. Varianza Residua

Def. Errore Standard

Var ( R) : ES

2

E S

y

*

i yi

y y

* 2

i

i

i

n

y

RES

n

*

i

m xi q

*

2

i

n

Ricordiamo che la retta di regressione è stata ottenuta con il metodo dei minimi quadrati,

minimizzando proprio la quantità RES

Def. Varianza di Regressione (di Interpolazione) Lineare

Def. Varianza Totale (di Y)

Var (Y )

y

i

i

n

y

Var ( L)

y

*

i

i

n

y

2

SSR

n

2

TSS

n

15

Note: RES = (Sum of) Residuals Squared; SSR = Sum of Square of Regression ; TSS = Total Sum Squared

*

Scomposizione della varianza e grado di

accostamento

y y

2

Var (Y )

i

i

n

TSS

n

Var ( R)

Var ( L)

y

*

i

i

n

y

y y

i

i

n

* 2

i

2

SSR

n

16

RES

n

Scomposizione della varianza e grado di

accostamento

Per queste grandezze vale il seguente teorema :

Teo. (di Scomposizione della Varianza)

Var (Y ) Var ( L) Var ( R)

In più vale il teorema:

Teo.

Var( L)

2

Var( R)

r

1

Var(Y )

Var(Y )

TSS RES SSR

r2

SSR

RES

1

TSS

TSS

Possiamo interpretare il risultato dei precedenti teoremi affermando che più r2 si

avvicina ad 1 più la Varianza residua ( e quindi l’errore attribuibile alla regressione) è

piccolo e quindi migliore è la regressione.

17

Scomposizione della varianza e grado di

accostamento: dimostrazioni

(y y ) 0

a)

i

*

i

i

*

*

*

*

*

(

y

q

m

x

)

(

y

y

m

x

m

x

)

(

y

y

)

m

i

i

i

( xi x) 0

i

i

i

b)

i

i

i

essendo sempre nulla la somma degli scarti

*

(

y

y

i i ) xi 0

i

*

*

*

*

*

(

y

q

m

x

)

x

(

y

y

m

x

m

x

)

(

y

y

)

x

m

i

i

i

( xi x)xi

i

i

i

i

i

i

i

i

2

( yi y)xi m ( xi x)xi yi xi y xi m xi x xi

i

i

i

i

i

i

*

*

n Cov( X , Y ) m n Var ( X ) 0

n xy n y x m n x x

*

essendo

m*

2

2

Cov( X , Y )

Var( X )

2

* 2

18

Scomposizione della varianza e grado di

accostamento: dimostrazioni

(y y )y

c)

*

i

i

*

i

0

i

*

*

*

*

(

y

q

m

x

)

q

m

xi

i

i

i

q

*

yi m

*

i

q m n x q m n x m n x

xi yi n q

nq

*

*

* 2

*

q m n x q m n x m n x

y nm xy nq 2nq m x nm x

*

*

*

2

* 2

*

* 2

*

*

*

*

* 2

*

* 2

*

2

2

x

x nm cov( X , Y ) m Var ( X )

2

n( y m x) y nm xy n y m x 2n( y m x)m x n m

*

*

x

nm ( xy x y ) n m

*

q*n y m*n xy

i

q n y m n xy n q

*

* 2

* 2

*

2

2

*

*

Cov( X , Y )

nm* Cov( X , Y )

Var( X ) 0

Var( X )

*

* 2

2

*

19

Scomposizione della varianza e grado di

accostamento: dimostrazioni

y y y

d)

*

i

i

*

i

y 0

Tenendo conto dei punti a) e c) :

i

y y y

*

i

i

*

i

i

i

2

* 2

i

i

i

i

*

i

i

i

*

y

2

i

y y y y y

2

i

y y y y y

e)

y yi yi* yi* y yi yi* 0

*

y

2

i

yi y * 2 yi y * y * y y * y yi y * y * y

i

f)

2

i

2

i

i

2

2

i

Var(Y ) Var( L) Var( R)

20

Scomposizione della varianza e grado di

accostamento: dimostrazioni

Var( L)

Var( R)

r

1

Var(Y )

Var(Y )

g)

2

2

2

Cov ( X , Y )

Cov ( X , Y ) Var( X )

*

r

b

Var( X ) Var(Y )

Var 2 ( X ) Var(Y )

2

*

*

2

(

b

x

b

x

)

i

i

nVar(Y )

*

*

*

*

2

(

q

m

x

(

q

m

x

))

i

i

nVar(Y )

2

( x x)

i

i

nVar(Y )

2

*

2

(

y

y

)

i

Var( L)

nVar(Y )

Var(Y )

i

21

Tabelle a doppia entrata

Facendo riferimento alla solita tabella, scriviamo:

y mx q

x m' y q'

r

Cov( X , Y )

mm

Var( X )

*

c

x y n

i 1 j 1

r

x n

i 1

r

Cov( X , Y )

m' m'

Var(Y )

*

i

j ij

2

i i0

n x

....

yc

Tot

x1

n11

n12 .... n1 j

.... n1c

n10

x2

....

n21 n22 .... n2 j .... n2 c

.... .... .... .... .... ....

n20

....

xi

....

ni1

....

yj

....

ni 0

....

ni 2 .... nij .... nic

.... .... .... .... ....

xr nr1 nr 2 .... nrj

Tot n01 n02 .... n0 j

X

x y n

i

j ij

nx y

2

y

i ni 0 n y

i 1

2

y2

.... nrc

.... n0 c

nr 0

n

r

c

i 1 j 1

r

nx y

y1

2

x n

i

i 1

n

Con

c

Y

i0

y

j 1

j

n

n0 j

22

Tabelle a doppia entrata

Parametri di Regressione:

m*

Cov( X , Y )

Var( X )

q* y m* x

m'*

Cov( X , Y )

Var(Y )

q'* x q'* y

Rette di Regressione:

y m* x q *

x m'* y q'*

23

![2 [6] Una compagnia di assicurazione ritiene che gli assicurati](http://s1.studylibit.com/store/data/002416903_1-3377a891909164cbe7bb266e8421813f-300x300.png)