I Appello di Calcolo delle Probabilità

Laurea Triennale in Matematica 2013/14

6 febbraio 2014

Cognome:

Nome:

Email:

Se non è espressamente indicato il contrario, per la soluzione degli esercizi è possibile usare tutti i

risultati visti a lezione (compresi quelli di cui non è stata fornita la dimostrazione).

PARTE I (Esercizi 1, 2, 3)

Esercizio 1. Se estraggo casualmente due numeri distinti dall’insieme {1, 2, 3, 4, 5, 6}, qual è la

probabilità che il più grande valga 4?

Più in generale, se estraggo casualmente due numeri distinti dall’insieme {1, . . . , n}, qual è la

probabilità che il più grande valga k (con 2 ≤ k ≤ n)?

Soluzione 1. Trattiamo direttamente il caso generale. Estrarre due numeri distinti in {1, . .. , n}

equivale a estrarre un sottoinsieme di {1, . . . , n} di cardinalità pari a due. Ci sono n2 tali

sottoinsiemi, mentre quelli in cui k è il più grande sono tanti quanti i sottoinsiemi di un elemento

di {1, . . . , k − 1}, ossia k − 1. La risposta è dunque

k−1

2(k − 1)

=

.

n

n(n − 1)

2

2

Esercizio 2. Un’urna contiene n palline bianche e k palline rosse. Pesco una pallina, ne osservo il

colore, la reinserisco nell’urna insieme a un’altra dello stesso colore di quella estratta (ora nell’urna

ci sono dunque n + k + 1 palline), dopodiché pesco una seconda pallina. Indicando con X il colore

della prima pallina estratta e con Y il colore della seconda pallina estratta, possiamo descrivere X

e Y come due variabili aleatorie a valori nell’insieme E := {r, b}.

(a) Si determini il valore di P(Y = y|X = x) per ogni scelta di x, y ∈ E.

(b) Si mostri che le variabili aleatorie X e Y hanno la stessa distribuzione.

(c) Si determini la distribuzione del numero totale N di palline rosse estratte.

(d) Le variabili aleatorie (X, Y, N ) sono indipendenti?

Soluzione 2.

(a) Si ha

P(Y = r|X = r) =

k+1

,

n+k+1

P(Y = r|X = b) =

k

,

n+k+1

da cui segue che

n

,

n+k+1

n+1

.

P(Y = b|X = b) = 1 − P(Y = r|X = b) =

n+k+1

(b) La densità marginale di X è data da

k

n

P(X = r) =

,

P(X = b) =

.

n+k

n+k

Di conseguenza la distribuzione congiunta di (X, Y ) è data da

k

k+1

P(X = r, Y = r) = P(X = r)P(Y = r|X = r) =

,

n+kn+k+1

k

n

P(X = r, Y = b) = P(X = r)P(Y = b|X = r) =

,

n+kn+k+1

n

k

P(X = b, Y = r) = P(X = b)P(Y = r|X = b) =

,

n+kn+k+1

n

n+1

P(X = b, Y = b) = P(X = b)P(Y = b|X = b) =

.

n+kn+k+1

La distribuzione marginale di Y si ricava facilmente:

P(Y = r) = P(Y = r, X = r) + P(Y = r, X = b)

k+1

n

k

k

k

=

+

=

,

n+kn+k+1 n+kn+k+1

n+k

n

P(Y = b) = 1 − P(Y = r) =

.

n+k

Quindi X e Y hanno la stessa distribuzione.

P(Y = b|X = r) = 1 − P(Y = r|X = r) =

(c) Chiaramente N assume valori in {0, 1, 2} e

n(n + 1)

,

(n + k)(n + k + 1)

k(k + 1)

P(N = 2) = P(X = r, Y = r) =

,

(n + k)(n + k + 1)

P(N = 0) = P(X = b, Y = b) =

da cui P(N = 1) = 1 − P(N = 0) − P(N = 2) =

2nk

(n+k)(n+k+1) .

(d) Le variabili aleatorie non sono indipendenti perché si ha P(X = r) > 0, P(Y = r) > 0,

P(N = 0) > 0 ma P(X = r, Y = r, N = 0) = 0 6= P(X = r)P(Y = r)P(N = 0).

3

Esercizio 3. Due particelle puntiformi, che indichiamo con le lettere α e β, si muovono lungo

una retta, entrambe di moto (rettilineo) uniforme. All’istante iniziale t = 0 la particella α si trova

nell’origine x = 0, mentre la particella β si trova nel punto x = 1. Le due particelle si muovono

l’una in direzione dell’altra, con velocità rispettive U e −V , dove U e V sono variabili aleatorie

indipendenti con distribuzione Exp(1).

α

−V

U

x=0

β

x=1

Definiamo T come l’istante in cui le due particelle si incontrano, e poniamo

1

.

T

(a) Si mostri che Y ha distribuzione Gamma(2, 1), ossia

Y :=

fY (y) = y e−y 1(0,∞) (y) .

(b) Si deduca che T ha distribuzione assolutamente continua, con densità

fT (t) =

1 −1/t

e

1(0,∞) (t) .

t3

(c) Si dica se T ∈ L1 e/o T ∈ L2 . Si mostri che Cov(T, Y ) è ben definita, e la si calcoli.

(d) Si mostri che il vettore aleatorio (T, Y ) non è assolutamente continuo.

Soluzione 3. (a) All’istante t > 0 la posizione della particella A è data da U t, mentre quella

della particella B è data da 1 − V t, pertanto l”istante T si ottiene dall’equazione

UT = 1 − V T

=⇒

T =

1

,

U +V

da cui Y = 1/T = U +V . Dato che U, V sono variabili aleatorie indipendenti con distribuzione

Exp(1) = Gamma(1, 1), per un teorema visto a lezione la loro somma U + V = Y ha

distribuzione Gamma(2, 1), ossia

fY (y) = y e−y 1(0,∞) (y) .

(b) La funzione di ripartizione di T è data da FT (t) = P(T ≤ t) = 0 se t ≤ 0, mentre per t > 0

Z ∞

Z ∞

1

1

FT (t) = P(T ≤ t) = P( Y ≤ t) = P(Y ≥ t ) =

fY (y) dy =

y e−y dy

= [−y e−y ]∞

1 +

t

Z

∞

1

t

1 1

e−y dy = e− t +

t

1

t

1

e− t .

1

t

Dato che FT (·) è C 1 a tratti, la variabile aleatoria T è assolutamente continua, con densità

fT (t) = FT0 (t) =

1 −1

e t 1(0,∞) (t) .

t3

In alternativa, dato che ϕ(y) := y1 è un diffeomorfismo di (0, ∞) in sé, per un teorema visto

a lezione si ha che T = ϕ(Y ) è una variabile aleatoria assolutamente continua con densità

fT (t) = fY (ϕ−1 (t)) |(ϕ−1 )0 (t)| = fY ( 1t )

1

1

1

= 3 e− t 1(0,∞) (t) .

2

t

t

4

(c) Per ogni p ∈ (0, ∞) si ha

p

p

E(|T | ) = E(T ) =

Z

Z

p

t fT (t) dt =

0

R

∞

1

t3−p

e−1/t dt .

1

La funzione t 7→ t3−p

e−1/t è continua in (0, ∞) e inoltre ha limite 0 per t ↓ 0, grazie

all’esponenziale. I problemi di integrabilità possono pertanto arrivare solo dal comportamento

1

1

all’infinito: dato che t3−p

per t ↑ ∞, si ha E(|T |p ) < ∞, ossia T ∈ Lp , se e solo

e−1/t ∼ t3−p

se 3 − p > 1, ossia p < 2. In particolare, T ∈ L1 ma T 6∈ L2 .

Affinché Cov(T, Y ) sia ben definita, occorre verificare che:

• T ∈ L1 : questo è stato appena mostrato;

• Y ∈ L1 : questo segue dal fatto che Y ∼ Gamma(2, 1);

• T Y ∈ L1 : questo segue dal fatto che Y :=

1

T

per definizione, e dunque Y T = 1.

In particolare E(T Y ) = 1, perché Y T = 1, mentre E(Y ) = 2, perché E(Gamma(n, λ)) = nλ .

Resta da calcolare

∞

Z ∞

1 −1/t

−1/t

E(T ) =

e

dt = e

=1

t2

0

0

da cui segue che

Cov(T, Y ) = E(T Y ) − E(T )E(Y ) = 1 − 1 · 2 = −1 .

(d) Dato che T Y = 1, introducendo il sottoinsieme A := {(t, y) ∈ R2 : t > 0, y = 1t } si ha che

P((T, Y ) ∈ A) = 1. Se (T, Y ) avesse distribuzione assolutamente continua, si dovrebbe avere

Z

P((T, Y ) ∈ A) =

fT,Y (t, y) dt dy = 0 ,

A

perché l’insieme A ha misura di Lebesgue bidimensionale nulla, ottenendo una contraddizione.

5

PARTE II (Esercizi 4, 5, 6)

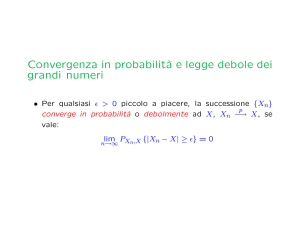

Esercizio 4. Siano (Xn )n∈N variabili aleatorie reali i.i.d., definite su uno spazio di probabilità

(Ω, A, P), la cui distribuzione è assolutamente continua con densità f (x) > 0 per ogni x ∈ R.

Fissati a, b ∈ R con a < b, introduciamo gli eventi

Dn = Dn(a,b) := {Xn ∈ (a, b)} = {ω ∈ Ω : Xn (ω) ∈ (a, b)} ,

per n ∈ N ,

e la variabile aleatoria N (a,b) , a valori in N0 ∪ {+∞}, definita da

N (ω) = N (a,b) (ω) := {n ∈ N : Xn (ω) ∈ (a, b)} ,

dove | · | indica la cardinalità di un insieme.

In tutte le domande seguenti, i parametri a, b ∈ R con a < b sono arbitrari ma fissati.

(a) Si mostri che 0 < P(Dn ) < 1.

(b) Si calcolino P lim supn∈N Dn e P lim supn∈N Dnc .

(c) Si mostri che P(N = ∞) = 1.

(d) Si mostri che la successione Yn := 1Dn converge in legge, ma non q.c..

Definiamo infine, per ogni ω ∈ Ω, il sottoinsieme Z(ω) ⊆ R ponendo

Z(ω) := Xn (ω) : n ∈ N = X1 (ω), X2 (ω), X3 (ω), . . . .

In altri termini, il sottoinsieme Z(ω) è l’immagine della successione reale (Xn (ω))n∈N .

(e) Si mostri che, per q.o. ω ∈ Ω, l’insieme Z(ω) è denso in R.

Soluzione 4. (a) Avendo le variabili aleatorie Xn la stessa distribuzione, gli eventi Dn hanno

la stessa probabilità p = p(a,b) ∈ (0, 1): infatti, per ogni a < b,

Z b

P(Dn ) = P(Xn ∈ (a, b)) = µXn ((a, b)) =

f (x) dx =: p ∈ (0, 1) ,

a

perché per ipotesi f (x) > 0 per ogni x ∈ R, quindi

R

(a,b) f (x) dx

>0e

R

R\(a,b) f (x) dx

> 0.

(b) Per definizione di indipendenza delle variabili

n , gli eventi Dn sono indipendenti.

P aleatorie XP

Dato che P(Dn ) = p > 0 per ogni n ∈ N, n∈N P(Dn ) = n∈N p = ∞. Essendo gli eventi Dn

indipendenti, segue dal Lemma di Borel-Cantelli P

che P lim supn∈N

PDn = 1. Analogamente,

dato che P(Dnc ) = 1 − p > 0 per ogni n ∈ N, si ha n∈N P(Dnc ) = n∈N (1 − p) = ∞ e quindi

P lim supn∈N Dnc = 1 ancora per Borel-Cantelli.

(c) Basta notare che l’evento {N = ∞} coincide con l’evento lim supn∈N Dn : infatti

{N = ∞} = {ω ∈ Ω : N (ω) = ∞} = {ω ∈ Ω : Xn (ω) ∈ (a, b) per infiniti valori di n ∈ N}

= {ω ∈ Ω : ω ∈ Dn per infiniti valori di n ∈ N} = lim sup Dn .

n∈N

Segue dunque che P(N = ∞) = 1.

(d) Dato che P(Dn ) = p ∈ (0, 1), la variabile aleatoria Yn = 1Dn ha distribuzione Be(p) che non

dipende da n, quindi banalmente converge in legge (verso la distribuzione Be(p)). Essa non

converge q.c. perché, per i punti precedenti, q.o. ω ∈ Ω appartiene a infiniti degli eventi

Dn e anche a infiniti degli eventi Dnc , quindi si ha Yn (ω) = 0 per infiniti valori di n ∈ N e

Yn (ω) = 1 per infiniti valori di n ∈ N, dunque la successione (Yn (ω))n∈N non ha limite.

In alternativa, per la legge 0-1 di Kolmogorov, se Yn → Y q.c. allora Y dovrebbe essere

q.c. costante. Ma dato che la convergenza q.c. implica quella in legge, si dovrebbe allo stesso

tempo avere Y ∼ Be(p) con p ∈ (0, 1), dunque Y non può essere q.c. costante.

6

(e) Un insieme A ⊆ R è denso se e solo se A ∩ (a, b) 6= ∅, per ogni a < b. Mostriamo dunque che

!

\

P ω ∈ Ω : Z(ω) ∩ (a, b) 6= ∅ ∀a < b = P

{Z ∩ (a, b) 6= ∅} = 1 ,

a,b∈R

a<b

o equivalentemente, passando al complementare,

!

P

[

{Z ∩ (a, b) = ∅}

= 0.

(1)

a,b∈R

a<b

Notiamo che, se (a0 , b0 ) ⊆ (a, b), si ha A∩(a0 , b0 ) ⊆ A∩(a, b); in particolare, se A∩(a, b) = ∅,

a maggior ragione A ∩ (a0 , b0 ) = ∅. Vale dunque l’inclusione di eventi

{Z ∩ (a, b) = ∅} ⊆ {Z ∩ (a0 , b0 ) = ∅} ,

se (a0 , b0 ) ⊆ (a, b) .

Per ogni a, b ∈ R con a < b, è possibile scegliere a0 , b0 ∈ Q (razionali) con a0 < b0 tali che

(a0 , b0 ) ⊆ (a, b). Ciò mostra che vale l’inclusione

[

[

{Z ∩ (a, b) = ∅} ⊆

{Z ∩ (a0 , b0 ) = ∅} .

a0 ,b0 ∈Q

a0 <b0

a,b∈R

a<b

(Vale in realtà l’uguaglianza, essendo l’inclusione inversa banalmente vera.) In (1) è dunque

sufficiente restringere l’unione a valori razionali a, b ∈ Q, ossia basta mostrare che

!

[

P

{Z ∩ (a, b) = ∅} = 0 .

a,b∈Q

a<b

Essendoci ricondotti all’unione di una famiglia numerabile di eventi, per subadditività

!

[

X

P

{Z ∩ (a, b) = ∅} ≤

P Z ∩ (a, b) = ∅ ,

a,b∈Q

a<b

a,b∈Q

a<b

e ci basta mostrare che P Z ∩ (a, b) = ∅ = 0, ossia P Z ∩ (a, b) 6= ∅ = 1, per ogni a < b.

Ma già sappiamo che P(N (a,b) = ∞) = 1, e chiaramente

{N (a,b) = ∞} ⊆ {Z ∩ (a, b) 6= ∅} ,

da cui la conclusione segue.

7

Esercizio 5. Nella città di Babilonia, alla fine di ogni anno, il governo distribuisce un premio

in denaro (euro) ai suoi N = 40 000 cittadini, con la seguente modalità: per ciascun cittadino

vengono estratti tre numeri reali, i primi due uniformemente in (10, 20) e il terzo uniformemente in

(0, 10); l’ammontare del premio è quindi determinato sommando i primi due numeri e sottraendo il

terzo. Tutti i numeri vengono estratti indipendentemente l’uno dall’altro.

(a) Si mostri che, fissato un cittadino qualunque, il premio X da lui ricevuto è una variabile

aleatoria con valor medio µ = E(X) = 25 euro. Quanto vale la varianza σ 2 = Var(X)?

(b) Un’associazione di consumatori svolge un’indagine, scoprendo che la somma dei premi ricevuti

da tutti i cittadini ammonta a meno di 997 000 euro. Osservando che tale valore è minore di

quanto ci si sarebbe potuti aspettare, ossia N · µ = 1 000 000 di euro, l’associazione sostiene

che non è ragionevole credere alle modalità descritte dal governo per l’attribuzione del premio.

Il portavoce del governo ribatte che una discrepanza di soli 3 000 euro è perfettamente

plausibile, data la natura casuale del meccanismo di attribuzione dei premi, e dunque i

sospetti di manipolazione non sono giustificati. Chi pensate che abbia ragione?

[Sugg. Si usi l’approssimazione normale fornita dal Teorema Limite Centrale. La tavola della

distribuzione normale è riportata in fondo a questo plico.]

Soluzione 5. (a) Siano U , V , W variabili aleatorie indipendenti, tali che U ∼ V ∼ U (10, 20) e

W ∼ U (0, 10). Dato che il valor medio di una variabile aleatoria U (a, b) vale a+b

2 e la sua

varianza vale

(b−a)2

12 ,

si ha

100

25

=

.

12

3

Il premio ricevuto da un cittadino può essere espresso come X := U + V − W . Per la linearità

del valor medio e le proprietà della varianza (osservando che U , V e W sono variabili aleatorie

indipendenti), si ha dunque

E(U ) = E(V ) = 15,

2

E(W ) = 5,

Var(U ) = Var(V ) = Var(W ) =

µ = E(X) = E(U ) + E(V ) − E(W ) = 25 ,

σ = Var(X) = Var(U ) + Var(V ) + Var(−W ) = Var(U ) + Var(V ) + Var(W ) = 25 .

(b) Sia SN := X1 + . . . + XN la somma totale dei premi ricevuti da tutti i cittadini. Calcoliamo

la probabilità che si verifichi l’evento osservato, ossia

997 000 − 40 000 · 25

SN − N µ

√

√

P(SN < 997 000) = P

<

= P(ZN < −3) ,

5 40 000

σ N

e applicando il Teorema Limite Centrale possiamo sostituire ZN ≈ Z ∼ N (0, 1), ottenendo

P(ZN < −3) ≈ P(Z < −3) = Φ(−3) = 1 − Φ(3) ' 1 − 0.9987 = 0.0013 = 0.13% .

Essendo la probabilità in questione piuttosto bassa (poco più di una su mille), è poco

verosimile che le modalità descritte per l’attribuzione del premio siano state rispettate.

8

Esercizio 6. Paolo si accinge a salire una scalinata (infinita), in cui i gradini sono etichettati (dal

basso verso l’alto) con i numeri 0, 1, 2, . . .. A ogni istante, Paolo lancia una moneta equilibrata:

se esce testa, sale di un gradino, mentre se esce croce resta sul gradino in cui si trova. Indicando

con Xn la posizione di Paolo nell’istante n, il processo (Xn )n≥0 è un’opportuna catena di Markov

sull’insieme E = {0, 1, 2, . . .} (con X0 = 0).

(a) Si scriva il valore pij della matrice di transizione della catena di Markov, per ogni i, j ∈ E. Si

disegni quindi il grafo corrispondente, completando la figura seguente con frecce e numeri, e

si determinino le classi di comunicazione, classificando gli stati (transitori, ricorrenti positivi,

ricorrenti nulli).

0

1

2

3

4

(b) Si determini una misura invariante. Si mostri che non esiste alcuna probabilità invariante.

Quanto vale limn→∞ (pn )ij ?

Soluzione 6.

(a) La matrice di transizione è data da

(

1

se j = i oppure j = i + 1

1

,

pij = (δii + δi i+1 ) = 2

2

0 altrimenti

e il grafo corrispondente è

1

2

1

2

1

2

1

2

0

1

2

3

4

1

2

1

2

1

2

1

2

1

2

È chiaro che i → j se e solo se i ≤ j, pertanto si ha i ↔ j se e solo se i = j. In altri termini,

ogni singoletto Ti := {i}, per i ∈ E, è una classe di comunicazione. Chiaramente nessuna

di tali classi è chiusa: infatti i → i + 1 ma i + 1 6→ i, per ogni i ∈ E. Dato che una classe

ricorrente è necessariamente chiusa, segue che tutte le classi Ti sono transitorie e dunque

tutti gli stati sono transitori.

(b) In generale, per quanto visto a lezione, una probabilità invariante (πi )i∈E è tale che πi = 0

per ogni stato i ∈ E transitorio. Dato che ogni stato è transitorio in questo caso,Psi dovrebbe

avere πi = 0 per ogni i ∈ E, il che è chiaramente impossibile, dovendo essere i∈E πi = 1.

Quindi non possono esistere probabilità invarianti.

P

Cerchiamo ora misure invarianti (xi )i∈E , ossia soluzioni del sistema xi = j∈E xk pki ,

con xi < ∞, per ogni i ∈ E. Per i = 0, essendo p00 = 12 e pk0 = 0 per k 6= 0, otteniamo

x0 = 12 x0 , che ha come unica soluzione x0 = 0. Per i ≥ 1, essendo pi−1 i = pii = 12 e

pki = 0 per k 6∈ {i − 1, i}, si ottiene xi = 12 (xi−1 + xi ), ossia xi = xi−1 . Quindi (xi )i∈E è una

misura invariante se e solo se xi = xi−1 per ogni i ∈ E, ossia xi = x0 = 0 per ogni i ∈ E.

L’unica misura invariante è dunque quella banale identicamente nulla. Ciò fornisce un’altra

dimostrazione del fatto che non ci sono probabilità invarianti. [Nella precedente correzione

c’era un errore.] Infine limn→∞ (pn )ij = 0 per ogni i, j ∈ E, perché ogni j ∈ E è transitorio.

9

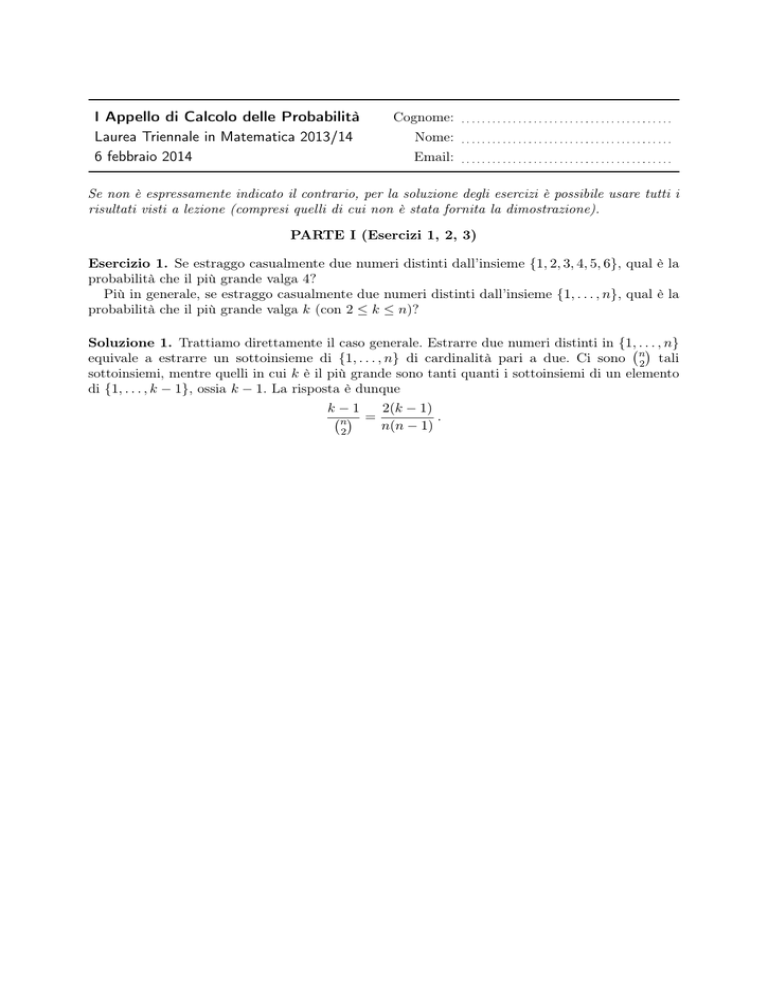

Tavola della distribuzione normale

Rz

− 1 x2

La tabella seguente riporta i valori di Φ(z) := −∞ e√22π dx, la funzione di ripartizione della

distribuzione normale standard N (0, 1), per 0 ≤ z ≤ 3.5. Ricordiamo che I valori di Φ(z) per z < 0

possono essere ricavati grazie alla formula

Φ(z) = 1 − Φ(−z) .

z

0.00

0.01

0.02

0.03

0.04

0.05

0.06

0.07

0.08

0.09

0.0

0.1

0.2

0.3

0.4

0.5

0.6

0.7

0.8

0.9

1.0

1.1

1.2

1.3

1.4

1.5

1.6

1.7

1.8

1.9

2.0

2.1

2.2

2.3

2.4

2.5

2.6

2.7

2.8

2.9

3.0

3.1

3.2

3.3

3.4

0.5000

0.5398

0.5793

0.6179

0.6554

0.6915

0.7257

0.7580

0.7881

0.8159

0.8413

0.8643

0.8849

0.9032

0.9192

0.9332

0.9452

0.9554

0.9641

0.9713

0.9772

0.9821

0.9861

0.9893

0.9918

0.9938

0.9953

0.9965

0.9974

0.9981

0.9987

0.9990

0.9993

0.9995

0.9997

0.5040

0.5438

0.5832

0.6217

0.6591

0.6950

0.7291

0.7611

0.7910

0.8186

0.8438

0.8665

0.8869

0.9049

0.9207

0.9345

0.9463

0.9564

0.9649

0.9719

0.9778

0.9826

0.9864

0.9896

0.9920

0.9940

0.9955

0.9966

0.9975

0.9982

0.9987

0.9991

0.9993

0.9995

0.9997

0.5080

0.5478

0.5871

0.6255

0.6628

0.6985

0.7324

0.7642

0.7939

0.8212

0.8461

0.8686

0.8888

0.9066

0.9222

0.9357

0.9474

0.9573

0.9656

0.9726

0.9783

0.9830

0.9868

0.9898

0.9922

0.9941

0.9956

0.9967

0.9976

0.9982

0.9987

0.9991

0.9994

0.9995

0.9997

0.5120

0.5517

0.5910

0.6293

0.6664

0.7019

0.7357

0.7673

0.7967

0.8238

0.8485

0.8708

0.8907

0.9082

0.9236

0.9370

0.9484

0.9582

0.9664

0.9732

0.9788

0.9834

0.9871

0.9901

0.9925

0.9943

0.9957

0.9968

0.9977

0.9983

0.9988

0.9991

0.9994

0.9996

0.9997

0.5160

0.5557

0.5948

0.6331

0.6700

0.7054

0.7389

0.7704

0.7995

0.8264

0.8508

0.8729

0.8925

0.9099

0.9251

0.9382

0.9495

0.9591

0.9671

0.9738

0.9793

0.9838

0.9875

0.9904

0.9927

0.9945

0.9959

0.9969

0.9977

0.9984

0.9988

0.9992

0.9994

0.9996

0.9997

0.5199

0.5596

0.5987

0.6368

0.6736

0.7088

0.7422

0.7734

0.8023

0.8289

0.8531

0.8749

0.8944

0.9115

0.9265

0.9394

0.9505

0.9599

0.9678

0.9744

0.9798

0.9842

0.9878

0.9906

0.9929

0.9946

0.9960

0.9970

0.9978

0.9984

0.9989

0.9992

0.9994

0.9996

0.9997

0.5239

0.5636

0.6026

0.6406

0.6772

0.7123

0.7454

0.7764

0.8051

0.8315

0.8554

0.8770

0.8962

0.9131

0.9279

0.9406

0.9515

0.9608

0.9686

0.9750

0.9803

0.9846

0.9881

0.9909

0.9931

0.9948

0.9961

0.9971

0.9979

0.9985

0.9989

0.9992

0.9994

0.9996

0.9997

0.5279

0.5675

0.6064

0.6443

0.6808

0.7157

0.7486

0.7794

0.8078

0.8340

0.8577

0.8790

0.8980

0.9147

0.9292

0.9418

0.9525

0.9616

0.9693

0.9756

0.9808

0.9850

0.9884

0.9911

0.9932

0.9949

0.9962

0.9972

0.9979

0.9985

0.9989

0.9992

0.9995

0.9996

0.9997

0.5319

0.5714

0.6103

0.6480

0.6844

0.7190

0.7517

0.7823

0.8106

0.8365

0.8599

0.8810

0.8997

0.9162

0.9306

0.9429

0.9535

0.9625

0.9699

0.9761

0.9812

0.9854

0.9887

0.9913

0.9934

0.9951

0.9963

0.9973

0.9980

0.9986

0.9990

0.9993

0.9995

0.9996

0.9997

0.5359

0.5753

0.6141

0.6517

0.6879

0.7224

0.7549

0.7852

0.8133

0.8389

0.8621

0.8830

0.9015

0.9177

0.9319

0.9441

0.9545

0.9633

0.9706

0.9767

0.9817

0.9857

0.9890

0.9916

0.9936

0.9952

0.9964

0.9974

0.9981

0.9986

0.9990

0.9993

0.9995

0.9997

0.9998