La probabilità

Teoria della probabilità: eventi,

proprietà additiva e moltiplicativa

L’incertezza

Nella maggior parte delle situazioni la nostra

condizione è caratterizzata dall incertezza

Incertezza

relativa ad eventi che devono ancora

accadere:

Quali numeri usciranno alla prossima estrazione del Superenalotto?

Incertezza relativa ad eventi che sono già accaduti

Chi ha vinto il Campionato italiano di calcio di Serie A nella stagione

1972-73?

Incertezza relativa ad eventi che stanno accadendo

Qual è la prevalenza di infezione da HIV nella popolazione italiana?

Incertezza

generali

relativa all esistenza e alla natura di leggi

Di quanto aumenta il rischio di avere un infarto all aumentare dei

valori di PM10?

1

L’incertezza

All incertezza contribuiscono, in misura variabile:

La nostra ignoranza, ovvero la limitatezza delle informazioni di

cui disponiamo

La variabilità dei fenomeni di cui ci occupiamo

Mentre in alcuni casi l osservazione (misura) ci permette di passare

dall incertezza alla certezza (?)

Quali numeri usciranno alla prossima estrazione del

Superenalotto?

Chi ha vinto il Campionato italiano di calcio di Serie A nella

stagione 1973-74?

in altri casi, per diverse ragioni, la misurazione potrà solo ridurre

l incertezza

Qual è la prevalenza di infezione da HIV nella popolazione

italiana?

Di quanto aumenta il rischio di avere un infarto

all aumentare dei valori di PM10?

La probabilità

Che cos è la probabilità?

A che cosa serve, in generale?

A che cosa serve, per un epidemiologo?

Interpretazione

in termini probabilistici delle misure di

occorrenza e di associazione

Un fumatore ha una probabilità di ammalarsi di tumore

5 volte superiore a quella di un non fumatore

Interpretazione in termini probabilistici delle

caratteristiche di validità di un test diagnostico

La probabilità che una persona sana risulti positiva al

test mammografico è pari allo 0.5%

Quantificazione dell effetto dell errore casuale sulle

stime campionarie

La probabilità di osservare un rischio relativo ≥ 5 in

assenza di associazione è pari al 3.2%

2

La probabilità

La probabilità è ciò che ci aiuta (meglio, che ci

dovrebbe aiutare) a ragionare (a fare

affermazioni) in maniera corretta (o, quanto

meno, coerente) in condizioni di incertezza.

Ars conjectandi (Jacob Bernoulli)

Diversi aspetti:

Filosofico:

definizioni di probabilità

assiomi e regole

Applicativo: come usare le probabilità

Matematico:

EVENTO “ALEATORIO”

Definizione

L’ evento è l’ elemento di base al quale

può essere applicata la probabilità

è

il risultato di una osservazione o di un

esperimento

è la descrizione di un potenziale risultato

è lo “stato” preso da un “sistema”

L’ evento è una proposizione logica

suscettibile di essere verificata o no

a

seconda del risultato dell’ “esperimento”

3

Eventi aleatori

Un fenomeno aleatorio è un fenomeno che può

manifestarsi in vari modi e rispetto al quale siamo,

pertanto, in condizioni di incertezza.

Un fenomeno aleatorio deve essere, almeno

teoricamente, verificabile (L esito deve essere

conoscibile).

Una variabile aleatoria (numero aleatorio) è una

variabile che può assumere diversi valori.

A

ciascuno di questi valori (esaustivi

e mutuamente esclusivi) avrà senso

attribuire una probabilità

Un evento aleatorio è una variabile aleatoria che

può assumere solo due valori (V/F, 0/1)

Da

una variabile aleatoria si passa ad

un evento raggruppando i possibili esiti in

due classi

Probabilità

Teoria “classica”

La probabilità di un evento aleatorio è il rapporto tra il

numero di esiti favorevoli ad esso e quello di tutti gli esiti

possibili, purché questi ultimi siano equiprobabili.

???

Si adatta abbastanza bene a quelle situazioni in cui i

fenomeni aleatori presentano situazioni di simmetria, in

cui nessun particolare esito è favorito rispetto agli altri

due facce di una moneta

sei facce di un dado

estrazione di una carta da un mazzo

uscita di un numero alla roulette

4

Probabilità

Teoria “classica”

Dalla definizione classica deriva che la misura della

probabilità di un evento può variare da un minimo di 0

(nessun caso favorevole) come ad esempio l'uscita del 91 al

Lotto (0 su 90), fino ad un massimo di 1 (tutti i casi

favorevoli), come ad esempio pescare una pesciolino rosso

da una vasca che contiene solo pesci rossi (n su n). Diremo,

nel primo caso, che l'evento è impossibile e nel secondo

caso che l'evento è certo.

In tutti gli altri casi:

gli eventi hanno una probabilità 0 < p < 1, tanto più vicina a zero

quanto più è difficile che l'evento accada e tanto più vicina ad 1,

quanto più è facile che accada.

Un'altra importante proprietà è che:

la somma delle probabilità di tutti i possibili esiti di un fenomeno

aleatorio deve essere 1, poiché è certo che uno qualsiasi di essi

dovrà per forza verificarsi

La nascita della teoria frequentista

5

La nascita della teoria frequentista

La nascita della teoria frequentista

6

La nascita della teoria frequentista

La nascita della teoria frequentista

7

La nascita della teoria frequentista

La nascita della teoria frequentista

8

La nascita della teoria frequentista

La nascita della teoria frequentista

9

La nascita della teoria frequentista

La nascita della teoria

frequentista (e non solo…)

10

Probabilità

Teoria “frequentista”

Supponiamo di ripetere un esperimento n volte in

condizioni sostanzialmente identiche e di contare il

numero m di volte in cui l evento A si verifica

all aumentare di n la proporzione m/n si avvicina ad un

limite fisso che è la probabilità di A

P(A) = limn→∞ (m / n)

La probabilità di un evento è dunque definita come la

frequenza relativa con cui l evento si verifica in una lunga

serie di esperimenti indipendenti condotti in condizioni

virtualmente identiche

Anche in questo caso:

La probabilità di un evento è un numero compreso tra 0 e 1

La somma delle probabilità dei possibili esiti è uguale a 1

Un esercizio per capire

Un esercizio per capire la differenza tra

FREQUENZA ASSOLUTA e FREQUENZA

RELATIVA

In

Stata, la sequenza

clear

set obs 100

gen roll=1+int(6*uniform())

tab roll

Genera 100 lanci di un dado (simulati…)

Proviamo a fare 10 lanci e poi 100, 1 000,

10 000, 100 000

Come

Come

sono le differenze ASSOLUTE tra le uscite?

sono le differenze RELATIVE?

11

Probabilità

Teoria “frequentista”

Esempi:

Se un meteorologo ci dice che c è una probabilità del

30% che oggi piova, non fa riferimento ad un modello

simmetrico di eventi equiprobabili, ma si basa sulla

frequenza osservata di giorni con pioggia con

condizioni (di temperatura, umidità, pressione etc.)

simili a quelli di oggi

Se un medico ci dice che la probabilità di successo di

un intervento chirurgico su un dato paziente è

dell 87%, si basa (dovrebbe basarsi!) sulla frequenza

osservata di successi in un numero cospicuo di

interventi dello stesso tipo eseguiti su pazienti con

caratteristiche (età, genere, condizioni fisiche,

patologie concomitanti, etc.) simili a quelle del

paziente dato

Probabilità

Definizioni a confronto

Ma possiamo davvero considerare tutti

gli eventi “ripetibili”?

Qualche

Definizione

Classica

volta e’ necessario un’altro approccio:

Approccio

Tempo

Eventi

Stima

Esempi

teorico

a priori

equiprobabili

calcolo

gioco d' azzardo

oggettivo

a posteriori

ripetibili

frequenza relativa

morbosità in

mortalità e

Frequentista

valutazione individuale da

Bayesiana

soggettivo

a priori

irripetibili

parte di un soggetto

razionale e coerente

popolazioni

stima del rischio

individuale

12

Probabilità

Teoria “soggettiva”

Secondo questa teoria, la probabilità è

una misura del grado di fiducia

soggettiva (di chi parla) che un evento si

realizzi (o che una variabile aleatoria

assuma un determinato valore) su una

scala che va da 0 (completa sfiducia che

l evento si verifichi) a 1 (certezza che

l evento si verifichi)

Ovviamente, considerazioni di simmetria

e di frequenza relativa osservata sono

alla base della valutazione soggettiva

Probabilità

Teoria “soggettiva”

La probabilità assegnata ad un evento

corrisponde a quanto sono disposto a pagare

per vincere 1 nel caso che l evento si

verifichi

Secondo

la teoria soggettiva dire che la

probabilità di A è uguale a 0.75 significa dire che

sarei disposto a pagare 75c per vincere 1€ al

verificarsi di A

La teoria soggettiva è particolarmente adatta

nel caso di eventi che possono verificarsi una

sola volta e di eventi già verificatisi ma ignoti

13

Probabilità

ogni approccio ha i suoi aspetti critici

Non tutti i fenomeni presentano simmetrie

che li rendono riconducibili a combinazioni di

eventi equiprobabili

Il fatto che all aumentare del numero di

esperimenti la frequenza relativa tenda ad un

limite è un ipotesi (legge

empirica delle

medie) che non può essere dimostrata né

matematicamente né empiricamente

Per molti eventi non è possibile immaginare,

nemmeno teoricamente, la ripetizione

dell esperimento

Probabilità: ogni approccio ha i

suoi aspetti critici

Ci piacerebbe che la probabilità fosse

una proprietà dell evento,

non

La definizione soggettiva ipotizza una

rigidità rispetto al rischio

che

dello stato mentale di chi la esprime

in genere non c è

Tuttavia, l oggettività viene

recuperata nel definire le regole da

usare

per

modificare le probabilità a priori alla luce

delle osservazioni fatte

14

Probabilità

Per fortuna, le regole di calcolo delle

probabilità

che

riguardano il modo per quantificare la

probabilità di eventi complessi,

sono largamente indipendenti dalla

teoria sottostante…

Le proprietà della probabilità

15

Eventi e teoria degli insiemi

Insieme

collezione

di elementi aventi una proprietà in

comune

nel caso degli eventi e della probabilità, si

tratta realizzazioni dello stesso evento

A

Esempi:

1) Che un soggetto sia fumatore

2) Che un soggetto sia affetto

da tumore polmonare

Eventi e teoria degli insiemi

Spazio o universo

L’

insieme che comprende tutti i possibili

elementi

Viene rappresentato spesso da un rettangolo

che rappresenta lo spazio finito dell’

esperienza a cui si sta facendo riferimento

Esempio:

La popolazione

dei suscettibili ad una

specifica patologia

(coloro cioè che

possono ammalarsi)

A

U

16

Eventi e teoria degli insiemi

Sottoinsieme

Ogni

elemento di A è anche elemento di B

evento A si verifica solo se è verificato

anche l’ evento B

A ⊂ B

L’

Esempio:

I forti fumatori (A)

sono un sottoinsieme

dei fumatori (B)

A

B

U

Eventi e teoria degli insiemi

Insieme Unione

l’

insieme che contiene tutti gli elementi di A e

tutti gli elementi di B

Si esprime come A ∪ B

∪ = “OR” (operatore booleano)

Esempio:

L’ insieme dei soggetti che

fumano (A) sigari,

(B) sigarette

A∪B

17

Eventi e teoria degli insiemi

Insieme Intersezione

l’

insieme che contiene tutti gli elementi che

appartengono sia ad A che a B

Si esprime come A ∩ B

= “AND”

(operatore booleano)

Esempio:

L’ insieme dei soggetti

che fumano (B),

e sono affetti da

tumore pomonare (A)

A

A ∩ B

∩

B

Eventi e teoria degli insiemi

Insieme complementare

l’insieme

che contiene tutti gli elementi dell’

Universo U che non appartengono ad A

comprende tutti gli eventi che escludono A

c

A

= “NOT” (operatore booleano)

∩ Ac = φ (l’evento nullo)

Esempio:

L’ insieme dei soggetti

NON affetti da

tumore pomonare (Ac)

A

Ac

18

Eventi mutuamente esclusivi

Due eventi A e B che non possono

verificarsi contemporaneamente sono

definiti “mutuamente esclusivi”

esempio:

A

è l’evento che il tumore sia di stadio III

B è l’ evento che sia di stadio IV

A ∩ B = φ

⇒

P(A ∩ B ) = 0

A

B

A

B

19

La proprietà additiva

Quando due eventi sono mutuamente

esclusivi, la proprietà additiva della

probabilità afferma che:

la

probabilità del verificarsi dell’ uno oppure

dell’altro evento

è pari alla somma della probabilità di ciascuno

dei due eventi

OR

A

P(A ∪ B ) = P(A) + P(B)

P(A ∪ B ) > P(A)

B

A

B

P(A ∪ B ) > P(B)

La proprietà additiva

Quando due eventi NON sono

mutuamente esclusivi, la proprietà

additiva della probabilità afferma che:

la

probabilità del verificarsi dell’ uno oppure

dell’altro evento

è pari alla somma della probabilità di ciascuno

dei due eventi meno la probabilità dell’ evento

intersezione (che altrimenti sarebbe contata due volte)

P(A ∪ B ) = P(A) + P(B) - P(A ∩ B )

A

A ∩ B

B

P(A ∪ B ) > P(A)

P(A ∪ B ) > P(B)

20

21

La proprietà moltiplicativa

Prendiamo in esame 1 evento aleatorio

esposizione ed 1 effetto: ad esempio

esposizione al fumo ed la presenza di BPCO

Se i due eventi non sono associati, si

combineranno casualmente, seguendo la

proprietà moltiplicativa della probabilità

10%

20%

50%

x

=

P(A AND B ) = P(A) x P(B)

P(A AND B ) < P(A); P(A AND B ) < P(B)

Eventi indipedenti e dipendenti

• L’ Epidemiologia costruttiva utilizza le misure di frequenza allo

scopo di stimare se i due eventi si associano solo casualmente, o

se l’esposizione aumenta il RISCHIO di malattia:

se l’ esposizione e la

malattia sono tra loro

indipendenti

(non esiste dunque alcuna

associazione)

La probabilità di essere

Fumatore AND Malato

è il prodotto delle

probabilità elementari

se l’ esposizione e la

malattia sono tra loro

dipendenti

(l’esposizione modifica la

probabilità di malattia)

La probabilità di essere

Fumatore AND Malato

è MAGGIORE del prodotto

delle probabilità elementari

22

La probabilità condizionata

L’ esposizione e la malattia potrebbero essere

distribuite nella popolazione come nel seguente

schema:

Malati

0,2

0,8

0,5

Non

malati

0,5

Esposti

Non

esposti

23

Eventi indipendenti

se l’ esposizione e la malattia sono tra loro

indipendenti la conoscenza dello stato di

malattia non influenza la probabilità che un

soggetto sia esposto

0,5

0,2

0,8

Malati

0,5

Non

malati

0,5

0,5

Esposti

Non esp.

0,1

0,5*0,2= 0,1

0,5*0,2=

Esposti

0,5*0,8=

0,4

Non esp.

0,5*0,8=

0,4

Eventi dipendenti

se l’ esposizione e la malattia sono tra loro

dipendenti la conoscenza dello stato di malattia

modifica la stima della probabilità che un

soggetto sia esposto

0,95

0,2

Malati

0,05

0,39

0,8

Esposti

Non esp.

Esposti

0,19

0,05*0,2= 0,01

0,95*0,2=

0,39*0,8=

0,31

Non

malati

0,61

Non esp.

0,61*0,8= 0,49

24

La probabilità condizionata

se l’ esposizione e la malattia sono tra loro

dipendenti la conoscenza dello stato di malattia

modifica la stima della probabilità che un

soggetto sia esposto

Malati

Esposti

Non esp.

Esposti

Non

malati

La conoscenza dello stato

assunto da uno dei due eventi

condiziona la stima della

probabilità che si verifichi

l’ALTRO evento:

PROBABILITA’

CONDIZIONATA

Non esp.

25

Il teorema di Bayes (1)

a partire dai prodotti marginali e dalle

probabilità nelle singole diramazioni, è possibile

“rovesciare” l’ albero delle probabilità

B

B

P(B∩A) ∪ P(B∩Ac) = P(BANDA) OR P(BANDAc) = P(B)

P(A)* P(B|A) + P(Ac)* P(B|Ac) = P(B)

(0,95*0,2) + (0,39*0,8 ) = 0,19

+ 0,31 = 0,50

Bc

P(Bc∩A) ∪ P(Bc∩Ac) = P(BcANDA) OR P(BcANDAc) = P(Bc)

Bc

P(A)* P(Bc|A) + P(Ac)* P(Bc |Ac) = P(Bc)

(0,05*0,2) + (0,61*0,8) = 0,01

+ 0,49 = 0,50

Il teorema di Bayes (2)

In questo modo è possibile modificare la stima

della probabilità che un soggetto sia malato

sulla base della conoscenza dello stato di

esposizione

0,19/0,5=

0,38

0,19+0,31=

0,5

Esposti

0,31/0,5=

0,62

0,01/0,5=

0,01+0,49=

0,5

Non

esposti

0,02

0,49/0,5=

0,19

Malati

0,5*0,38=

Non

malati

0,5*0,61= 0,31

Malati

0,5*0,02=

0,01

Non

malati

0,5*0,98=

0,49

0,98

26

Il teorema di Bayes ed i test

Il teorema di Bayes viene utilizzato

spesso nella valutazione di test

diagnostici o screening

Test

Diagnostici: hanno come obiettivo di

consentire una diagnosi di malattia

Test di Screening: utilizzati su soggetti che non

presentano alcuna sintomatologia clinica,

permettono di classificare tali individui sulla base

della probabilità di essere affetti da una

particolare patologia

Il teorema di Bayes consente di

utilizzare la probabilità per valutare le

incertezze associate ai risultati

Misure di qualità di un test

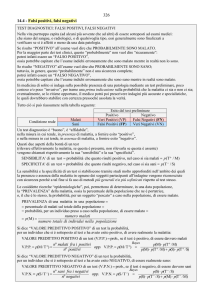

SENSIBILITA’:

la

percentuale di soggetti malati che il test

classifica come positivi

= Veri positivi / (Veri positivi + Falsi

negativi)

esprime la probabilità che il test sia positivo nei

soggetti malati

SPECIFICITA’:

la

percentuale di soggetti sani che il test

identifica come negativi

= Veri negativi / (Veri negativi + Falsi

positivi)

esprime la probabilità che il test sia negativo nei

soggetti sani

27

Qualità del test ed alberi di probabilità

Sensibilità

Prevalenza

Malati

P(A)

1- P(A)

P(B|A)

Test +

Test-

Non

malati

Test +

Test-

Specificità

Veri positivi

Falsi negativi

Falsi positivi

Veri negativi

P(Bc|Ac)

Misure di qualità di un test

VALORE PREDITTIVO DEL TEST

POSITIVO (VPP):

la

probabilità di essere malati dei soggetti risultati

positivi al test

= Veri positivi / (Veri positivi + Falsi positivi)

VALORE PREDITTIVO DEL TEST

NEGATIVO (VPN):

la

probabilità di essere sani dei soggetti risultati

negativi al test

= Veri negativi / (Veri negativi + Falsi negativi)

28

Qualità del test ed alberi di probabilità

Valore predittivo

test +

P(A|B)

Test +

P(B)

Malati

Veri positivi

Non

malati

Malati

Test-

Falsi positivi

Falsi negativi

Non

malati

Valore predittivo

test -

Veri negativi

P(Ac|Bc)

Qualità del test ed alberi di probabilità

P(A|B) =

P(A)* P(B|A)

P(A)* P(B|A) +

P(Ac)*

P(B|Ac)

Preval. * Sensib.

=

(Preval. * Sensib.) + (1-Preval.)*(1-Specif.)

Sensibilità

Prevalenza

Test

+

Veri positivi

Veri positivi

Malati

Test-

Falsi negativi

Falsi positivi

Non

malati

Test

+

Falsi positivi

Falsi negativi

Malati

Veri negativi

Non

malati

Malati

Non

malati

Test-

Test

+

TestVeri negativi

Specificità

P(Ac|Bc)=

Valore

predittivo

del test +

P(Ac)* P(Bc|Ac)

P(A)* P(Bc|A) + P(Ac)* P(Bc|Ac)

=

Valore

predittivo

del test -

(1-Preval. )* Specif.

Preval. * (1-Sensib.) + (1-Preval.)*Specif.

29

Sistema di

Classificazione citologica

Classificazione

Bethesda

Infezione

Reazioni

Lesione Intraepiteliale Squamosa (SIL)

ASCUS Basso Grado (LSIL)

Alto Grado (HSIL)

riparative

Richart

Condiloma

Reagan (OMS)

Normale

Atipia

Neoplasia Intraepitaeliale della Cervice

CIN I

CIN II

CIN III

Displasia lieve

Displasia

Moderata

Papanicolau

I

II

Displasia Carcinoma Carcinoma

grave

III

in situ

invasivo

IV

V

da: Nanda K, et al., Ann Intern Med 2000; 132:810-819

Il Pap-test

Stime di frequenza

10:1000 (p=0.01)

3:1000 (p=0.003)

da: CNR - Basi scientifiche per la definizione di linee guida

da: Loiudice et al, Eur J Cancer Prev, 1998; 7:295-304

Sensibilità

Specificità

80:1000

10:1000 (p=0.01)

(p=0.08)

0.40

0.96

0.75

0.93

10:100000

(p=0.0001)

Un esempio: il pap-test

Sensibilità

Prevalenza

Malati

P(B|A)

=0.75

P(A)=0.01

Test +

Veri positivi

Test-

Falsi negativi

1-0.75=0.25

1-0.01

=0.99

Non

malati

1-0.93=0.07

Specificità

=0.01*0.25

=0.0025

Test + Falsi positivi

=0.99*0.07

=0.0693

TestP(Bc|Ac)

=0.93

=0.01*0.75

=0.0075

Veri negativi

=0.99*0.93

=0.9207

30

Qualità del test ed alberi di probabilità

P(A|B) =

P(A)* P(B|A)

P(A)* P(B|A) + P(Ac)* P(B|Ac)

Preval. * Sensib.

=

(Preval. * Sensib.) + (1-Preval.)*(1-Specif.)

Valore predittivo

del test +

Sensibilità

0.75

Prevalenza

0.0075

Veri positivi

0.0025

0.0693

Test-

Falsi negativi

Falsi positivi

Test

+

Falsi positivi

Falsi negativi

0.0025

Malati

0.01

0.25

0.07

0,999917

Non

malati

0.93

0.0075

Veri positivi

Test

+

Test-

0.0693

Malati

Non

malati

Veri negativi

Veri negativi

0.9207

0.9207

P(A)*

+

P(Ac)*

0.0768

0.9023

0.0027

P(Ac)* P(Bc|Ac)

P(Bc|A)

Test

+

Malati

TestNon

malati

P(Bc|Ac)

=

0.9232

0.9973

Valore predittivo

del test -

Specificità

P(Ac|Bc)=

0.0976

(1-Preval. )* Specif.

Preval. * (1-Sensib.) + (1-Preval.)*Specif.

Qualità del test ed alberi di probabilità

Valore predittivo test +

0.0075/0.0768

0.0075

+0.0693

=0.0768

Malati

Test +

Veri positivi

=0.0075

=0.0976

Non

malati

Falsi positivi

Malati

Falsi negativi

0.0693/0.0768

=0.0693

=0.9023

0.0025/0.9232

=0.0027

0.0025

+0.9207

=0.0025

Test-

=0.9232

0.9207/0.9232

=0.9973

Non

malati

Veri negativi

=0.9207

Valore predittivo test -

31

32

33