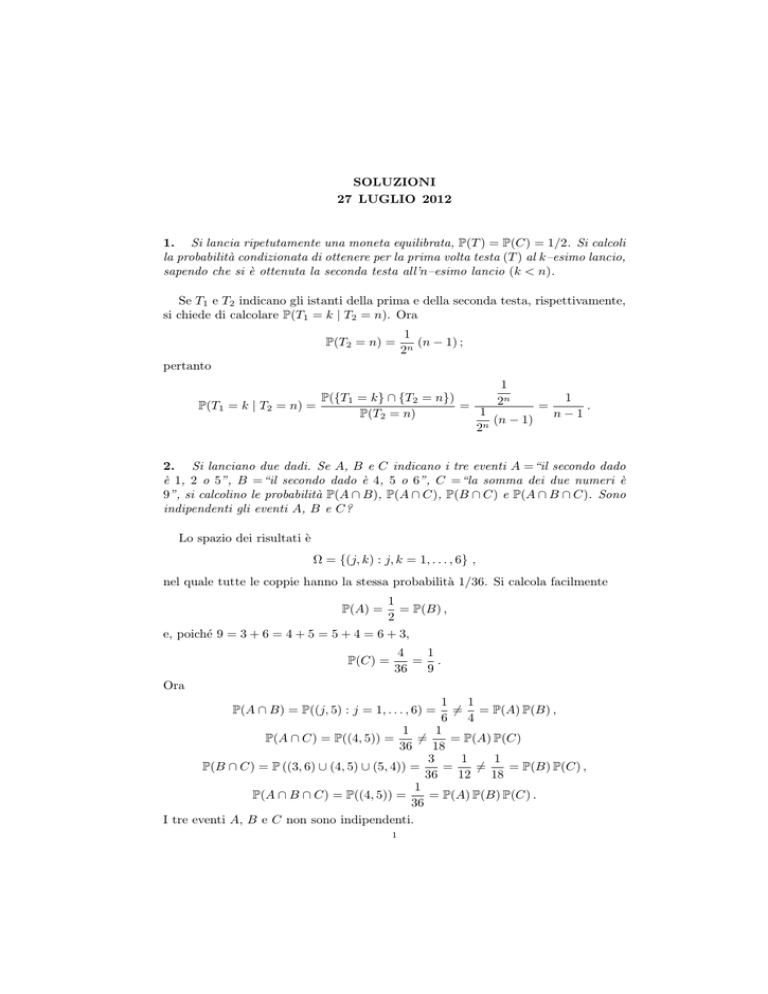

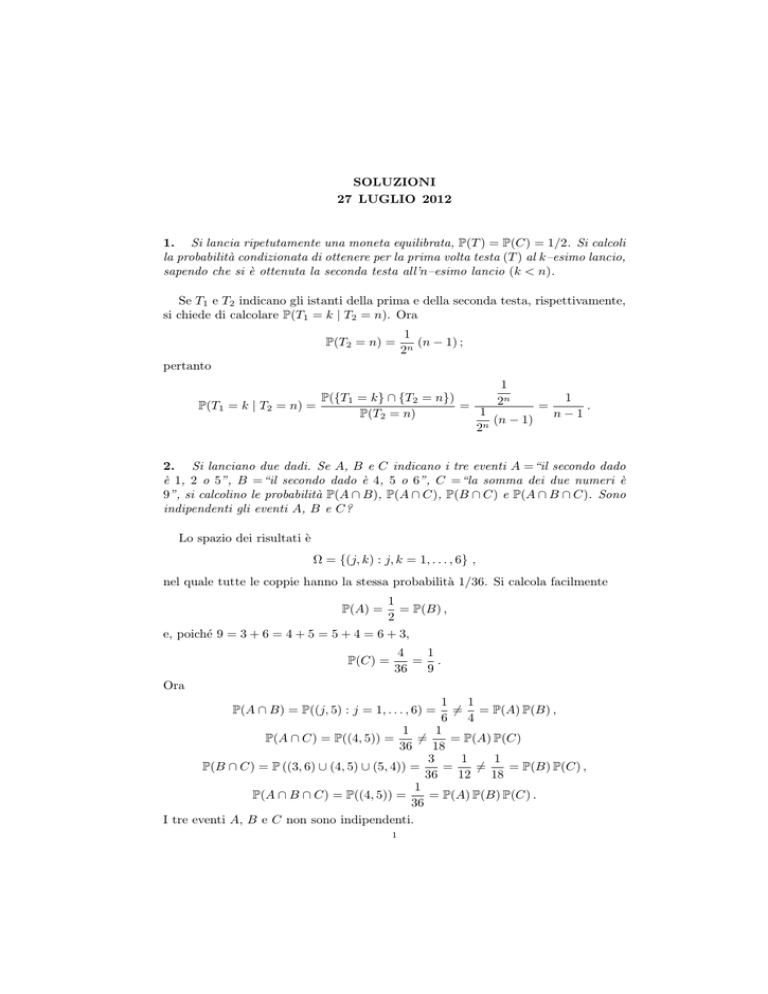

SOLUZIONI

27 LUGLIO 2012

1. Si lancia ripetutamente una moneta equilibrata, P(T ) = P(C) = 1/2. Si calcoli

la probabilità condizionata di ottenere per la prima volta testa (T ) al k–esimo lancio,

sapendo che si è ottenuta la seconda testa all’n–esimo lancio (k < n).

Se T1 e T2 indicano gli istanti della prima e della seconda testa, rispettivamente,

si chiede di calcolare P(T1 = k | T2 = n). Ora

P(T2 = n) =

1

(n − 1) ;

2n

pertanto

1

n

P({T1 = k} ∩ {T2 = n})

1

2

P(T1 = k | T2 = n) =

=

=

.

1

P(T2 = n)

n−1

(n

−

1)

2n

2. Si lanciano due dadi. Se A, B e C indicano i tre eventi A =“il secondo dado

è 1, 2 o 5”, B =“il secondo dado è 4, 5 o 6”, C =“la somma dei due numeri è

9”, si calcolino le probabilità P(A ∩ B), P(A ∩ C), P(B ∩ C) e P(A ∩ B ∩ C). Sono

indipendenti gli eventi A, B e C?

Lo spazio dei risultati è

Ω = {(j, k) : j, k = 1, . . . , 6} ,

nel quale tutte le coppie hanno la stessa probabilità 1/36. Si calcola facilmente

1

= P(B) ,

2

e, poiché 9 = 3 + 6 = 4 + 5 = 5 + 4 = 6 + 3,

P(A) =

P(C) =

4

1

= .

36

9

Ora

1

1

6= = P(A) P(B) ,

6

4

1

1

P(A ∩ C) = P((4, 5)) =

6=

= P(A) P(C)

36

18

3

1

1

P(B ∩ C) = P ((3, 6) ∪ (4, 5) ∪ (5, 4)) =

=

6=

= P(B) P(C) ,

36

12

18

1

P(A ∩ B ∩ C) = P((4, 5)) =

= P(A) P(B) P(C) .

36

I tre eventi A, B e C non sono indipendenti.

P(A ∩ B) = P((j, 5) : j = 1, . . . , 6) =

1

2

SOLUZIONI 27 LUGLIO 2012

3. Se U ha legge uniforme in (0, 1), U ∼ U(0, 1), si trovi la legge della variabile

aleatoria

√

X := −2 ln U .

Poiché U assume valori in ]0, 1[ la variabile aleatoria X è ben definita. Si ha

intanto P(X ≤ t) = 0 se t ≤ 0. Si supponga perciò t > 0:

√

t2

−2 ln U ≤ t = P 2 ln U ≤ t2 = P ln U ≥ −

P(X ≤ t) = P

2

−t2 /2

−t2 /2

=1−e

.

=P U ≥e

In definitiva, la densità di X è

2

fX (t) = t e−t

/2

1(0,+∞) (y) .

4. Nello spazio di probabilità (Ω, F, P) X e Y sono due variabili aelatorie indipendenti tali che P(X = 0) = P(X = 1) = 1/2, mentre Y ha legge uniforme in

(0, 1), Y ∼ U(0, 1). Si trovi la legge della variabile aleatoria

Z =X +Y .

Si ricorra alla formula delle probabilità totali, e, si sfrutti, quindi, l’indipendenza

di X e Y ,

P(Z ≤ t) = P(Z ≤ t | X = 0) P(X = 0) + P(Z ≤ t | X = 1) P(X = 1)

1

1

= P(Y ≤ t | X = 0) + P(1 + Y ≤ t | X = 1)

2

2

1

1

= P(Y ≤ t) + P(1 + Y ≤ t) .

2

2

Si ha intanto P(Z ≤ t) = 0 per t < 0 e P(Z ≤ t) = 1 per t ≥ 1. Se, poi, t è in (0, 2),

(

1

t,

t ∈ [0, 1] ,

P(Z ≤ t) = 21 1

2 + 2 (t − 1) , t ∈ [1, 2[ .

La densità di probabilità di Z è dunque

1

1(0,2) (t) .

2

Perciò Z ha legge uniforme in (0, 2), Z ∼ (0, 2).

fZ (t) =