Metodi di ricerca: programma per Ph.D.

Metodi Quanti – Qualitativi per

le scienze sociali

Analisi fattoriale e dintorni. (2 Incontro)

Alessandro Pepe. Ph.D.

[email protected]

Definizione di Analisi Fattoriale

“Tecnica di riduzione dei dati disegnata per rappresentare

un alto numero di attributi osservati in un numero inferiore

di dimensioni”.

“Metodo per isolare le componenti sottostanti un certo

paniere di dati multidimensionali”.

The prime use of factor analysis has been in the

development of both the operational constructs for an

area and the operational representatives for the

theoretical constructs (Gorsuch,1983)*

* Gorsuch, R. L. (1983). Factor analysis (2nd ed.). Hillsdale, NJ: Lawrence Erlbaum.

1

Definizione operativa

Factor analysis can be broadly characterized as a set of

multivariate statistical methods for data reduction and for

reaching a more parsimonious understanding of measured

variables by determining the number and nature of common

factors needed to account for the patterns of observed

correlations (Fabrigar, Wegener, MacCallum,&

Strahan,1999)*.

Introdotta da Spearman (1904), perfezionata da Thurston (1930) e

completata da Kaiser (1960) e Cattel (1966)

20.000 occorrenze in Psychinfo (Pruzek, 2005)

*Hayton, J. C., Allen, D. G., & Scarpello, V. (2004). Factor retention decisions in exploratory factor

analysis: a tutorial on parallel analysis. Organizational Research Methods, 7(2), 191-205.

Funzioni principali

La funzione di base è identificare gruppi di variabili che

presentano qualche forma di relazione tra loro (= base

correlazionale).

Funzione principale nelle scienze sociali:

Misurare costrutti a partire dai fattori costituenti e sottostanti un

certo paniere di osservazioni (analisi fattoriale - AF)

Ridurre il numero di variabili a disposizione per ottenere un

subset più gestibile di informazioni (analisi delle componenti

principali – ACP)

Scomporre la varianza.

2

Quando scegliere AF e ACP

• Tutte le volte che si studiano fenomeni non direttamente

osservabili:

– Personalità (5BFI vs. 16PF), abilità cognitive

generali, stress-lavoro correlato, soddisfazione, esiti

percorsi di formazione

• Quando si vogliono identificare e lavorare con fattori

costitutivi dei costrutti sotto indagine.

• Quando si vogliono scoprire ed esplorare pattern

“nascosti” che governano il funzionamento delle variabili

e ne disvelano i nessi.

AF e ACP non sono

L’analisi fattoriale e l’analisi delle componenti

principali non sono metodi di predizione delle

variabili (regressione multipla, modellamento

curve previsionali)

Sono “soltanto” metodi per isolare relazioni

tra le variabili che non emergono

direttamente e per valutarne la forza

esplicativa.

3

Critiche

Trova variabili artificiali, aleatorie, è possibile rintracciarne un numero

infinito.

Elementi di soggettività legati alle scelte del decisore

Ruolo

indiscusso:

Validazione di questionari e riduzione del

numero di variabili in studio, non correlate tra

loro

Riduzione delle variabili ma non dell’informazione utile.

Vantaggi:

Creazione di fattori che rappresentano la stessa realtà

ma che sono indipendenti fra loro.

Non vengono considerate le differenze fra le diverse

variabili.

Altre ragioni sensate per usare AF o ACP

In presenza di troppe “osservazioni” (item, variabili o parole):

•

•

•

•

•

Per ragionare sulla struttura dei dati o scoprire pattern stabili

Per visualizzare in modo più immediato la variabilità

Per ridurre il rumore (permutazioni casuali)

Per una migliore rappresentazioni dei dati senza eccessiva

perdita di informazione

Per costruire percorsi più robusti ed efficaci di analisi dei dati

riducendo lo spazio n dimensionale osservato in uno spazio

(n-x) dimensionale sul quale costruire nuove analisi: alberi di

classificazione, creazione di cluster

La razionale una combinazione ragionata delle variabili osservate

aumenta il potere esplicativo dai dati raccolti e di comprensione dei

fenomeni oggetto di studio

4

Cosa c’è prima dell’AF (analisi del problema)

• Processo standard di ricerca:

• Identificazione del dominio di interesse selezione

della gamma di fenomeni di interesse

(atteggiamenti, tratti di personalità, abilità verbali)

• Identificazione della popolazione di interesse selezione della gamma di soggetti di interesse

• Dati dominio e popolazione, si selezionano le

variabili di interesse (attributi di superficie) attributi

che possono essere misurati/osservati

• Le misurazioni sono relative ad ogni individuo

all’interno del campione selezionato.

Assunti dell’AF

• Esiste una normale variabilità nei valori degli individui in

relazione ai punteggi assunti dagli attributi di superficie.

• La variabilità dei punteggi rispecchia la differenze individuali

espresse attraverso gli attributi di superficie.

• Gli attributi di superficie possono correlare tra loro: alcuni

presentano alte correlazioni altri basse/nulle correlazioni.

• Il sistema di correlazioni reciproche non è caotico, ma viene

governato da un sistema di relazioni sottostanti gli attributi di

superficie attributi interni

• Gli attributi interni (=variabili latenti o costrutti) sono

caratteristiche individuali non osservabili direttamente, ma

derivabili dalla valutazione degli attributi di superficie

(=comportamenti manifesti)

5

Postulati teorici

• Al centro dell’AF vi è la relazione che esiste tra attributi

di superficie e attributi interni gli attributi interni

influenzano gli attributi di superficie in un modo

sistematico e ripetibile

• Ciò implica che quando si misura un attributo di

superficie, almeno in parte si sta anche misurando

l’influenza che l’attributo sottostante esercita (come il

magnetismo e la gravità) .

6

AF: esplorativa o confermativa?

Entrambi i metodi ricadono sotto l’ombrello dei modelli ad

equazioni strutturali (SEM), però:

• Analisi fattoriale esplorativa metodo noncondizionale, generazione di nuova struttura fattoriale

non formulata a priori, induzione esplorativa, grado di

affidabilità dei dati nell’indurre ipotesi su una struttura

plausibile

• Analisi fattoriale confermativa metodo condizionale,

conferma di strutture fattoriali formulate a priori, logica

deduttiva, grado di affidabilità dei dati nel riprodurre

strutture plausibili.

7

Cosa inficia i risultati dell’AF

Alta % Valori mancanti (missing)

Outlier (valori fuori scala)

Rispondenti seriali

Basse varianze (punteggi raggruppati, poca variabilità intrinseca)

Livelli di misurazione non adeguati e intervalli troppi stretti

Numerosità campione (50 very poor, 100 poor, 200 fair, 300 good, 500

very good and 1000+ excellent, Comrey and Lee, 1992)*

Pochi casi per osservazione (n=20 x v)

Effetto floor ed effetto ceiling

* Comrey, A. L. and Lee, H. B., (1992), A first course in factor analysis, Hillsdale, New Jersey: Erlbaum

Terminologia

Fattore variabile (costrutto) che non è direttamente osservabile ma

deve essere inferito attraverso variabili osservate.

Factor Loading (saturazione) è il coefficiente di correlazione che

mostra l’importanza (peso) di ogni variabile nel definire un fattore

Eigenvalue (autovalore) rappresenta la quota di varianza delle

variabili spiegata dal fattore

Soluzione fattoriale è il set di fattori e di relazioni tra variabili e fattori

che rappresenta la soluzione al problema fattoriale

8

Come funziona FA

Generazione matrice di correlazione

Scelte da parte del decisore (Algoritmo di generazione dei fattori)

Scelte da parte del decisore (rotazione fattori)

Analisi delle relazioni tra variabili

Presentazione tabelle di output

Scelte da parte del decisore (scelta numero fattori)

Scelte da parte del decisore (interpretazione della soluzione fattoriale)

Come funziona FA

Generazione matrice di correlazione

9

Matrice di correlazione

La logica dell’AF

Considerando tutti gli indicatori (item, parole, variabili) si spiega il 100% della

varianza dei dati osservati per studiare il fenomeno oggetto di indagine

La factor analysis consente di identificare n fattori, capaci di sintetizzare in

modo efficiente gli indicatori empirici e di ridurne la complessità; i fattori, però,

spiegano una quantità di varianza inferiore al 100%

Quindi, con l’analisi fattoriale, si decide di “sacrificare” una parte della varianza

spiegata a favore di una maggiore semplicità intepretativa

È comunque auspicabile che i fattori spieghino, in termini cumulati, almeno il

60-70% della varianza totale

10

Logica dell’AF

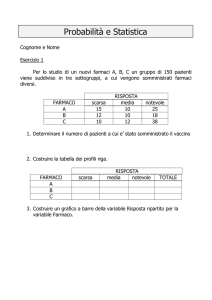

Esempio: perché scegliere una banca?

11

Come funziona FA

Generazione matrice di correlazione

Scelte da parte del decisore (Algoritmo di generazione dei fattori)

Scelte da parte del decisore (rotazione fattori)

Scelta dell’algoritmo

Per ridurre la complessità preservando la maggior parte della varianza e

cercando relazioni uniche tra variabile e fattore analisi delle componenti

principali (ACP)

Per analisi di concetti di interesse teorico (costrutti) massima

verosimiglianza (ML) Lavora per approssimazioni successive e stima

una matrice di correlazione e un’insieme di varianza che rappresentano

i dati sperimentali, eliminando la ridondanza con la minima dispersione

d’informazione.

Altri algoritmi Fattorizzazione dell’asse principale

12

La rotazione dei fattori

L’algoritmo di generazione dei fattori fa “interagire” le variabili con gli item,

simulando la rete di correlazione che lega i fattori agli indicatori. Inoltre

l’algoritmo simula anche la rete di relazione che esiste tra i fattori: fattori

correlati o fattori non correlati? si seleziona il tipo di rotazione + adatto.

E’ una fonte di soggettività diverse strutture fattoriali possono spiegare la

stessa porzione di varianza. Il termine utilizzato per descrivere il tentativo di “ridefinire” la struttura fattoriale è detto rotazione.

La rotazione dei fattori affonda nell’idea di muovere e far interagire gli item tra

loro sulla base dello spazio geometrico (=totale varianza) definito a partire dagli

item

La principale distinzione è tra metodi ortogonali (coseno tra vettori 0,

correlazione 0) e obliqui (coseno ≠ 0, correlazione ≠ 0)

Logica dell’AF

13

Soluzioni ortogonali

Ipotizza che i fattori siano statisticamente indipendenti (quindi non correlati)

L’algoritmo di generazione fattoriale “mette a zero” tutte le correlazioni tra

fattori.

Diverse tecniche di rotazione (almeno 12).

Tre ortogonali:

Varimax la più utilizzata, cerca di semplificare (=ridurre) il numero delle

colonne, cioè le variabili che generano la matrice di correlazione, semplifica

al’interpretazione del fattore

Quartimax cerca di semplificare il numero delle righe (=osservazioni),

semplifica l’interpretazione delle variabili

Equimax cerca di trovare un bilanciamento tra la semplificazione delle righe

e delle colonne.

Idea di fattore (spazio vettoriale)

Coseno α = correlazione

Se α = 90 allora r = 0

14

Dalla matrice di correlazione ai fattori

Soluzioni oblique

Ipotizza che i fattori siano statisticamente dipendenti tra loro (quindi correlati)

L’algoritmo di generazione fattoriale “calcola” tutte le possibili correlazioni tra

fattori.

Diverse tecniche di rotazione (almeno 12)

Due oblique:

Oblimin Rotazione obliqua che cerca di adattare i fattori agli item e li correla.

Promax E’ un metodo più diretto che cerca la rotazione che meglio si adatta a

rappresentare i fattori con un singolo item e lo fa direttamente.

15

Spazio vettoriale obliquo

Come funziona FA

Generazione matrice di correlazione

Scelte da parte del decisore (Algoritmo di generazione dei fattori)

Scelte da parte del decisore (rotazione fattori)

Analisi delle relazioni tra variabili

Presentazione tabelle di output

16

Tabelle di output

KMO di Bartlett e Test di sfericità dei dati

Tabella comunalità

Tabella autovalori fattoriali (Eigenvalue) e varianza spiegata

Valutazione adeguatezza AF

Kaiser-Meyer-Olkin’s measure (KMO=.83) [0 < KMO < 1]

E’ una misura di adeguatezza dei dati raccolti, è un indice che

segnala la forza delle correlazioni osservate tra le variabil in relazione

alle correlazioni parziali. Dovrebbe superare .70 (cioè il 70 % delle

correlazioni totali non è spiegato dalle correlazioni parziali tra gli item

ma dalle correlazioni con i fattori)

Test di Sfericità di Bartlett (χ2 = 4235,01, df = 276 p < .000)

Indica se sulla base dati a disposizione è effettivamente sensato

applicare un’analisi fattoriale (verifica identità della matrice). Ovvero

testa l’ipotesi nulla che le variabili nella popolazione NON siano

correlate. Se il test è significativo rifiuto l’ipotesi nulla e concludo che la

correlazione tra le variabili esiste.

17

KMO and Bartlett's Test

Kaiser-Meyer-Olkin Measure of Sampling

Adequacy.

Bartlett's Test of

Sphericity

Approx. Chi-Square

df

Sig.

,891

2166,885

276

,000

Tabelle di comunalità

La comunalità esprime la proporzione della varianza di ogni variabile

riprodotta da un certo numero di componenti. Essendo una proporzione,

essa varia tra zero e uno. Quindi ci dice quanta varianza perdiamo di

ciascuna variabile, tenendo conto le componenti che abbiamo deciso di

utilizzare.

Le comunalità indicano la parte di varianza spiegata di ogni indicatore,

considerando il modello fattoriale stimato

Notazione h2

Vanno tendenzialmente tenuti in considerazione item o variabili che

abbiano un valore di comunalità di almeno .500

18

Comunalità – Impact of Event Scale - 13

do you think of the event that shocked you without

intention?

do you think of canceling the event that shocked you from

your memory ?

do you have difficulties in concentration ?

do you feel a special emotions concerning the event that

shocked you?

are you easily disturbed or you feel more confused after

the shocking event?

do you try to avoid the places and persons that remined

you of the shocking event ?

do you try to avoid talking about the shocking event ?

does your mind surprised with a special pictures about

the shocking event

is there any thing else remind you of the shocking event?

do you try to avoid thinking of the shocking event?

do you easily disturbed?

do you feel that you are anticipated and motivited to un

expectedevent?

do you face sleeping proplemes because of pictures or

ideas that related to the shocking event?

Iniziale

1,000

Estrazio

ne

,947

1,000

,937

1,000

1,000

,532

,958

1,000

,533

1,000

,947

1,000

1,000

,543

,379

1,000

,549

1,000

1,000

1,000

,947

,516

,549

1,000

,562

Leggere la tabella degli autovalori fattoriali

E’ la tabella che ci permette di selezionare il numero di fattori estratti

più adatto per descrivere i dati empirici.

Parametri da considerare per la scelta del numero di fattori

Autovalori (Eigenvalue)

Varianza Cumulata

Varianza Totale

Tecniche per la selezione dei fattori:

Kaiser regola degli autovalori superiori a 1

Cattel analisi visuale del grafico decrescente degli autovalori

Analisi parallela confronto con dimensionalità casuali di numeri

19

Varianza totale e pesi fattoriali

Componente

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

Autovalori iniziali

% di

%

Totale

varianza cumulata

4,707

19,613

19,613

3,848

16,032

35,645

1,814

7,560

43,205

1,219

5,080

48,284

1,114

4,641

52,925

,996

4,150

57,075

,944

3,934

61,009

,881

3,672

64,682

,789

3,288

67,969

,745

3,103

71,073

,729

3,037

74,110

,652

2,716

76,826

,608

2,534

79,359

,583

2,428

81,788

,555

2,313

84,100

,533

2,222

86,323

,530

2,206

88,529

,493

2,052

90,581

,476

1,985

92,566

,427

1,780

94,346

,395

1,645

95,991

,370

1,540

97,531

,324

1,349

98,880

,269

1,120 100,000

Pesi dei fattori non ruotati

% di

%

Totale

varianza cumulata

4,707

19,613

19,613

3,848

16,032

35,645

1,814

7,560

43,205

1,219

5,080

48,284

1,114

4,641

52,925

Pesi dei fattori ruotati

% di

%

Totale

varianza cumulata

3,051

12,715

12,715

2,795

11,645

24,359

2,760

11,502

35,861

2,333

9,719

45,580

1,763

7,345

52,925

Come funziona FA

Generazione matrice di correlazione

Scelte da parte del decisore (Algoritmo di generazione dei fattori)

Scelte da parte del decisore (rotazione fattori)

Analisi delle relazioni tra variabili

Presentazione tabelle di output

Scelte da parte del decisore (scelta numero fattori)

20

Kaiser’s rule mineigen greater than 1 criterion (K1)

Il numero di fattori m sottostanti ad un paniere di variabili n è uguale al numero di

fattori m che presentano un autovalore superiore a 1 (Kaiser, 1974).

Il valore 1 fa riferimento alla “porzione” di varianza spiegata: superiore a 1

significa che è il fattore è in grado di spiegare più varianza di quanta ne

spiegherebbe da solo che senso ha quindi inserire fattori che spiegano meno

varianza di quella contenuta in una singola variabile? Problema parsimonia della

soluzione.

E’ come scrivere l’indice di un libro riportando il contenuto di ogni pagina.

E’ una regola empirica metodi simulativi usati da Kaiser nel 1951

Problemi:

1) Tende a sovrastimare il numero di fattori (Hayton, Allen & Scarpello, 2004)

2) Soggettività in casi di fattori con autovalore di poco sopra o di poco sotto il

valore 1 (Fabrigar et al., 1999).

Varianza totale e pesi fattoriali

Componente

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

Autovalori iniziali

% di

%

Totale

varianza cumulata

4,707

19,613

19,613

3,848

16,032

35,645

1,814

7,560

43,205

1,219

5,080

48,284

1,161

4,641

52,925

4,150

57,075

1,004

,944

,881

,789

,745

,729

,652

,608

,583

,555

,533

,530

,493

,476

,427

,395

,370

,324

,269

3,934

3,672

3,288

3,103

3,037

2,716

2,534

2,428

2,313

2,222

2,206

2,052

1,985

1,780

1,645

1,540

1,349

1,120

61,009

64,682

67,969

71,073

74,110

76,826

79,359

81,788

84,100

86,323

88,529

90,581

92,566

94,346

95,991

97,531

98,880

100,000

Pesi dei fattori non ruotati

% di

%

Totale

varianza cumulata

4,707

19,613

19,613

3,848

16,032

35,645

1,814

7,560

43,205

1,219

5,080

48,284

1,161

4,641

52,925

Pesi dei fattori ruotati

% di

%

Totale

varianza cumulata

3,051

12,715

12,715

2,795

11,645

24,359

2,760

11,502

35,861

2,333

9,719

45,580

1,763

7,345

52,925

CHE FARE CON

F6 ?

21

Cattel Scree Test (1966)

Tecnica che si basa sull’ispezione visuale del grafico decrescente degli autovalori

in cerca di discontinuità : “ come i detriti di una frana che smettono di rotolare alla

base del declivio” (Cattel, 1966, Raiche, Riopel & Blais, 2006, p. 6)

L’interpretazione funziona bene in caso di fattori empirici molto forti.

Problemi di soggettività quando non ci sono fattori molto forti oppure in presenza

di due o più discontinuità.

Può essere fortemente incrementato da un punto di vista matematico applicando

uno studio di regressione lineare agli autovalori residuali.

Il metodo funziona comunque meglio della regola di Kaiser (Zwick & Velice,

1986).

???

??

22

Analisi Parallela (Horn, 1965)

La terza tecnica è conosciuta con il nome di “analisi parallela” ed è

raccomandata dalla rivista Educational and Psychological Measurement per

la “proven merit and accuracy among factor retention methods” (Thompson &

Daniel, 1996).

Idea dei metodi simulativi Monte Carlo nel caso dell’AF quanto la mia

struttura fattoriale osservata nella matrice (n X v ) si differenzia da una

ipotetica struttura fattoriale ottenuta a partire da dati casuali (nr X Vr)

Ogni database presenta una sua dimensionalità fattoriale: qual è la struttura

fattoriale ipotetica ottenuta a partire dalle dimensioni della mia matrice dati?

Tre dimensioni:

Numero di casi (c)

Numero di variabili (v)

Metrica di misurazione

Procedura Analisi Parallela

Procedura su 4 passi:

1) Generare una matrice ottenuta a partire da dati casuali che sia

dimensionalmente equivalente ai dati osservati. Dimensionalmente equivalente

significa con lo stesso numero di variabili (v) e osservazioni (n) e con la stessa

metrica della misurazione (n=966, v= 24 and values ranging from 0 to 4).

2) Eseguire l’analisi fattoriale con la stesse scelte procedurali dell’analisi

effettuata su dati reali (scelta algoritmo di generazione, rotazione dei fattori).

Per eliminare il problema dell’errore di campionamento (i numeri casuali non

sono casuali davvero – stessa probabilità) le operazioni 1 e 2 vanno ripetute

almeno 50 volte (Hayton, Allen & Scarpiello, 2004).

3) Il risultato è avere a disposizione 50 strutture fattoriali, con 50 serie di

autovalori corrispondenti al numero di fattori “ipotetici” di ogni matrice casuale.

A questo punto si possono calcolare le medie degli autovalori di ogni fattori , in

modo da ottenere una tabella riassuntiva.

4) Confrontare gli autovalori casuali e gli autovalori reali vanno tenuti solo I

fattori che presentano un autovalore superiore a quello ottenuto causalmente.

23

Tab.4

Comparison between actual and generated eigenvalues.

Dimensions

F1

F2

F3

F4

F5

F6

Real

Mean

95th

percentile

eigenvalues

PA

eigenvalues

PA

eigenvalues

1,3

1,25

1,22

1,19

1,16

1,14

1,34

1,3

1,24

1,22

1,18

1,16

4,707

3,848

1,814

1,219

1,161

1.004

Note: Factors confirmed by using parallel analysis (PA) are in bold.

Quanti fattori tenere

Controllare output autovalori

Confrontare Kaiser e Cattel

Se ci sono ancora dubbi applicare analisi parallela

Controllare la % di varianza cumulata spiegata (sopra 60%)

Decidere il numero di fattori.

24

Come funziona FA

Generazione matrice di correlazione

Scelte da parte del decisore (Algoritmo di generazione dei fattori)

Scelte da parte del decisore (rotazione fattori)

Analisi delle relazioni tra variabili

Presentazione tabelle di output

Scelte da parte del decisore (scelta numero fattori)

Scelte da parte del decisore (interpretazione della soluzione fattoriale)

Interpretare i fattori

L’interpretazione dei fattori avviene a partire dai coefficienti di

saturazione degli item sul fattore identificato

Il coefficiente di saturazione è il coefficiente di correlazione che mostra

l’importanza (peso) di ogni variabile nel definire un fattore definisce anche

la quota di varianza di quell’indicatore spiegata dal fattore

Ogni indicatore (item variabile) presenta una certa correlazione con

ogni fattore l’item ideale presenta correlazione 1 con il fattore che

“misura” e correlazione 0 con tutti gli altri fattori

Forza della correlazione

0 < r < .2 bassa

.21 < r < .40 moderata

.41 < r < .65 alta

.66 < r < 1 altissima

25

Componente

1

2

8)This parent is excessively concerned about the child.

,785

10)This parent never relinquishes control of the child and wants to protect

him/her against all dangers.

21) This parent is very concerned about the health of the child

,769

24)This parent is involved with the progress of the child to an excessive

degree

23) This parent is overly concerned about the child's education

9)This parent expresses the intention to co-operate, but does not follow

through

13)This parent promises you as a teacher to help the child at home, but

does not do it

5) This parent failed to follow through with an agreement about supervising

the child's homework

2) This parent doesn't accept responsibility for the consequences of a

particular decision

14)This parent says he/she thinks you are a bad teacher

3

4

5

,764

,619

,611

,801

,768

,680

,468

,720

15)This parent calls to tell you they are unhappy

,717

20)This parent threatens to go to higher authorities when he/she suspects

an alleged misuse of professionalism

17)You feel harassed by the parent of the child

,674

,646

4) This parent uses his/her degree, knowledge or professional experience in

attempt to change the approach of the teacher

19) This parent avoids contact with you as a teacher

,672

3) This parent hardly ever comes to school

,559

22) The child of this parent looks tired and neglected

,553

11)This parent shows little initiative

,461

,507

16)This parent takes little notice of the child

,471

,501

1)As teacher you feel compelled to take sides with one of the parents.

,641

7)This parent complains about the other parent of the child

,558

6)This parent asks your opinion without having one him/herself

12)This parent uses his/her degree of expertise as an excuse for becoming

involved in the education of the child.

18)This parent is over involved in your classroom

,466

,418

,426

Costruire i fattori

Un buon fattore:

1) ha senso,

2) è semplice da interpretare,

3) 3) ha una struttura semplice

Inserire nel fattore soltanto item che presentano valori di saturazione superiori

a .40

Ogni fattore deve includere almento due variabili con valori di saturazione

superiori a .60.

Per interpretare il fattore (=dare un nome) si parte dall’analisi delle dimensioni

con valori superiori a .60. (Everaert, 2007)

26

Componente

1

2

8)This parent is excessively concerned about the child.

,785

10)This parent never relinquishes control of the child and wants to protect

him/her against all dangers.

21) This parent is very concerned about the health of the child

,769

24)This parent is involved with the progress of the child to an excessive

degree

23) This parent is overly concerned about the child's education

,764

3

4

5

F1

,619

,611

9)This parent expresses the intention to co-operate, but does not follow

through

13)This parent promises you as a teacher to help the child at home, but

does not do it

5) This parent failed to follow through with an agreement about supervising

the child's homework

2) This parent doesn't accept responsibility for the consequences of a

particular decision

14)This parent says he/she thinks you are a bad teacher

,801

,768

,680

F2

,468

,720

15)This parent calls to tell you they are unhappy

,717

20)This parent threatens to go to higher authorities when he/she suspects

an alleged misuse of professionalism

17)You feel harassed by the parent of the child

,674

F3

,646

4) This parent uses his/her degree, knowledge or professional experience in

attempt to change the approach of the teacher

19) This parent avoids contact with you as a teacher

,672

3) This parent hardly ever comes to school

,559

22) The child of this parent looks tired and neglected

F4

,553

11)This parent shows little initiative

,461

,507

16)This parent takes little notice of the child

,471

,501

1)As teacher you feel compelled to take sides with one of the parents.

,641

7)This parent complains about the other parent of the child

,558

6)This parent asks your opinion without having one him/herself

12)This parent uses his/her degree of expertise as an excuse for becoming

involved in the education of the child.

18)This parent is over involved in your classroom

,466

,418

F5

,426

Come utilizzare i risultati

Costruire scale di misurazione (fattori) a partire da osservazioni empiriche

Analisi di affidabilità (Cronbach)

Trovare dimensioni che aggregano altre variabili

Costruzione di indici compositi

Analisi fattoriali di 2°ordine.

27

Analisi fattoriale confermativa

Metodologia basata sui modelli ad equazione strutturale (SEM)

Ottima definizione di modelli di misurazione (path model) e prove di

invarianza fattoriale tra campioni con caratteristiche diverse.

L’analisi fattoriale confermativa riflette l’esistenza di un modello di

misurazione in cui le variabili osservate definiscono un set di costrutti latenti

(Hoyle, 2000) e fornisce evidenze circa la struttura fattoriale delle misure

(Jöreskog, 1993).

Si basa sull’equivalenza tra la matrice reale di correlazione (o

varianza/covarianza) e la matrice riprodotta a partire dalla struttura fattoriale

specificata.

Minore è la distanza tra le due matrici, migliore è l’adattamento del modello

teorico ai dati raccolti.

Si utilizzano software come: AMOS, LISREL, R

28

Differenze tra EFA e CFA

Esplorativa

Trovare numero fattori

Determinare la

correlazione tra fattori

La variabili sono libere

di saturare su tutti i

fattori.

Generazione di teorie

Confermativa

Numero fattori stabilito a

priori

Le correlazioni tra fattori

sono impostate a priori

Le variabili saturano su

fattori decisi a priori

Test di teorie

Assunti CFA

Dimensione del campione: 15 casi per variabile osservata.

Adeguatezza del modello: le relazioni tra le variabili devono essere

specificate a priori.

Variabili di output: Continue e normalmente distribuite.

Gestione missing: non ci devono essere missing.

Giustificazione teorica del modello: le metodologie SEM devono avere un

modello teorico ben definito a priori

29

EFA su 2 fattori

30

CFA a 2 fattori

Valutazione della bontà dell’adattamento

“no single topic in the field of Structural Equation Modelling has generated

as much attention as the issue of how to properly assess the validity of a

structural equation model” (Myerscough, 2002, p. 1109).

Un modello è definito appropriato quando la matrice di varianza-covarianza

(Σ) riprodotta dal modello di misurazione ipotetico si adatta alla matrice

reale (S). Il grado di adattamento viene definito dai model fit criteria.

Per model fit criteria fuori parametro, il modello va rifiutato.

Chi Square: si cercano di ottenere valori di chi-quadro non significativi

(=non c’è distanza tra la matrice riprodotta e la matrice reale). Il chi-quadro

è una misura sensibile all’ampiezza campionaria e per N> 150 tende a

diventare singificativo(Schumacker & Lomax, 2004).

QUINDI

Normed chi-square (X2/DF): è il χ2 riscalato sulla base dellampiezza del

campione (Jöreskog, 1969). NC indica buon adattamento per valori tra 1.0

e 3.0 (Carmines & McIver, 1981). Limiti più accettabili sono posti a 5.0

(Katou, 2008)

31

Altri indici di adattamento

Root-mean-square-residual error of approximation (RMSEA): Indice che

“misura” la distanza tra le matrici a partire dalla radice quadrata del quadrato dei

residui di varianza tra gli elementi di Σ e S (Steiger & Lind, 1980). Il modello si

rifiuta per valori a partire da .080 (Browne and Cudek, 1993). Valutazioni più

robuste si effettuano a partire dall’intervallo di confidenza al 90% dell’RMSEA

(Hu & Bentler, 1999).

Goodness of fit (GFI): il GFI misura la quantità di varianza e covarianza di S che

può essere predetta da Σ (Schumacker & Lomax, 2004). Il criterio varia tra 0

(0%) e 1 (100%), un punto di cut-off è .90 (90%) (Schumacker & Lomax, 1996).

Adjusted goodness of fit (AGFI): simile al GFI e riscalato su parametri di

complessità del modello (Gerbin & Andersen, 1993).

NFI, Model Akaike’s Information Criterion , ecc…

Esempio output

Degrees of Freedom = 63

Minimum Fit Function Chi-Square = 195.94 (P = 0.00)

Normal Theory Weighted Least Squares Chi-Square = 197.73

(P = 0.00)

Estimated Non-centrality Parameter (NCP) = 134.73

90 Percent Confidence Interval for NCP = (96.07 ; 181.01)

Minimum Fit Function Value = 0.52

Population Discrepancy Function Value (F0) = 0.36

90 Percent Confidence Interval for F0 = (0.26 ; 0.48)

Root Mean Square Error of Approximation (RMSEA) =

0.076

90 Percent Confidence Interval for RMSEA = (0.064 ;

0.088)

P-Value for Test of Close Fit (RMSEA < 0.05) = 0.00026

Expected Cross-Validation Index (ECVI) = 0.75

90 Percent Confidence Interval for ECVI = (0.65 ; 0.88)

ECVI for Saturated Model = 0.56

ECVI for Independence Model = 12.52

Chi-Square for Independence Model with 91 Degrees of

Freedom = 4655.09

Independence AIC = 4683.09

Model AIC = 281.73

Saturated AIC = 210.00

Independence CAIC = 4752.07

Model CAIC = 488.66

Saturated CAIC = 727.33

Normed Fit Index (NFI) = 0.96

Non-Normed Fit Index (NNFI) = 0.96

Parsimony Normed Fit Index (PNFI) = 0.66

Comparative Fit Index (CFI) = 0.97

Incremental Fit Index (IFI) = 0.97

Relative Fit Index (RFI) = 0.94

Critical N (CN) = 175.04

Root Mean Square Residual (RMR) = 0.036

Standardized RMR = .044

Goodness of Fit Index (GFI) = 0.93

Adjusted Goodness of Fit Index (AGFI) = 0.88

Parsimony Goodness of Fit Index (PGFI) = 0.56

32

Conclusioni

1)Scegliere se utilizzare EFA o CFA

2)Identificazione dei passi centrali per condurre

EFA

3)Leggere ed interpretare EFA

4)Cenni di CFA

33