MATRICI Vol.1

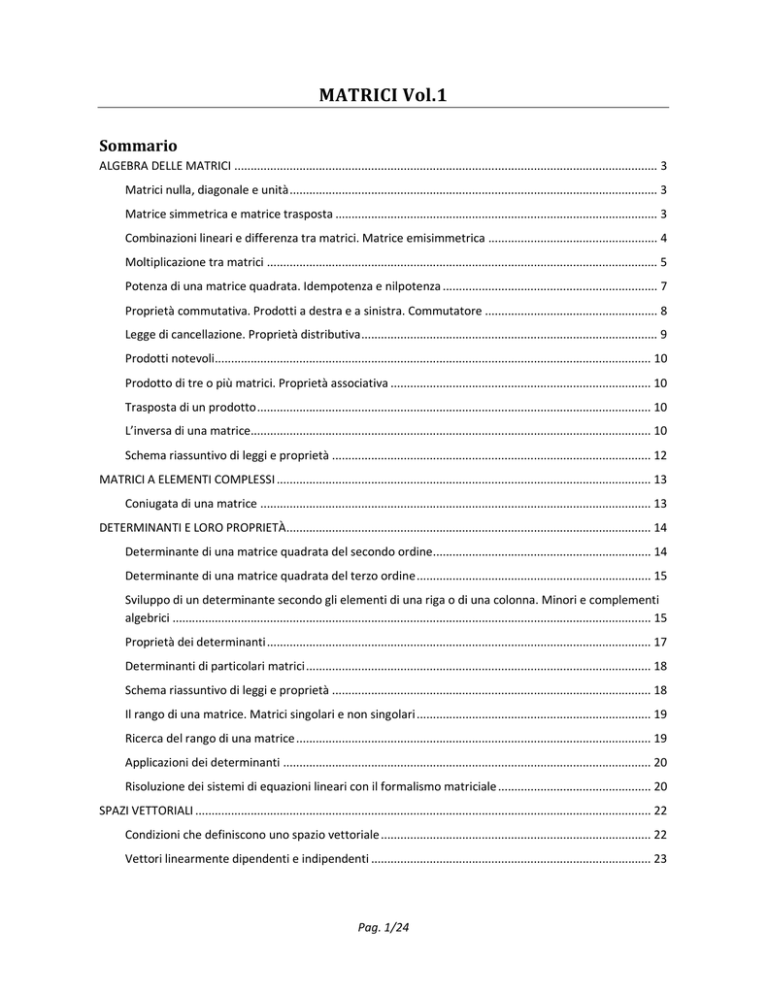

Sommario

ALGEBRA DELLE MATRICI .................................................................................................................................. 3

Matrici nulla, diagonale e unità ................................................................................................................. 3

Matrice simmetrica e matrice trasposta ................................................................................................... 3

Combinazioni lineari e differenza tra matrici. Matrice emisimmetrica .................................................... 4

Moltiplicazione tra matrici ........................................................................................................................ 5

Potenza di una matrice quadrata. Idempotenza e nilpotenza .................................................................. 7

Proprietà commutativa. Prodotti a destra e a sinistra. Commutatore ..................................................... 8

Legge di cancellazione. Proprietà distributiva ........................................................................................... 9

Prodotti notevoli...................................................................................................................................... 10

Prodotto di tre o più matrici. Proprietà associativa ................................................................................ 10

Trasposta di un prodotto ......................................................................................................................... 10

L’inversa di una matrice........................................................................................................................... 10

Schema riassuntivo di leggi e proprietà .................................................................................................. 12

MATRICI A ELEMENTI COMPLESSI ................................................................................................................... 13

Coniugata di una matrice ........................................................................................................................ 13

DETERMINANTI E LORO PROPRIETÀ................................................................................................................ 14

Determinante di una matrice quadrata del secondo ordine................................................................... 14

Determinante di una matrice quadrata del terzo ordine ........................................................................ 15

Sviluppo di un determinante secondo gli elementi di una riga o di una colonna. Minori e complementi

algebrici ................................................................................................................................................... 15

Proprietà dei determinanti ...................................................................................................................... 17

Determinanti di particolari matrici .......................................................................................................... 18

Schema riassuntivo di leggi e proprietà .................................................................................................. 18

Il rango di una matrice. Matrici singolari e non singolari ........................................................................ 19

Ricerca del rango di una matrice ............................................................................................................. 19

Applicazioni dei determinanti ................................................................................................................. 20

Risoluzione dei sistemi di equazioni lineari con il formalismo matriciale ............................................... 20

SPAZI VETTORIALI ............................................................................................................................................ 22

Condizioni che definiscono uno spazio vettoriale ................................................................................... 22

Vettori linearmente dipendenti e indipendenti ...................................................................................... 23

Pag. 1/24

Documento scaricato da http://preiser.altervista.org

Appunti liberamente scopiazzati da:

“Algebra delle matrici – volume primo – collana esami”, Ed. Tecnos – G. Orecchia, S. Spataro.

Pag. 2/24

ALGEBRA DELLE MATRICI

Matrici nulla, diagonale e unità

1) Matrice nulla. Una matrice, i cui elementi sono tutti nulli, dicesi nulla.

Esempi:

0 0 0

0 0

0 0 0

∅ = 0 0 0 ∅ = 0 0 ∅ = 0 0 0

0 0 0

0 0

Generalizzando gli esempi, si può dire che la matrice nulla può avere ordini qualsiasi, cioè può

essere quadrata o rettangolare. A seconda dell’uso che se ne deve fare, si sceglierà la quadrata o la

rettangolare.

2) Matrice diagonale. Una matrice quadrata del tipo:

a 0 0

= 0 b 0

0 0 c

In generale, quindi, una matrice quadrata di ordine dicesi matrice diagonale se tutti i suoi

elementi sono nulli tranne quelli della diagonale principale (, , ) che devono essere non tutti

nulli. Esempi:

2 0

=

0 −1

1 0 0

= 0 −2 0

0 0 0

−1

0

=

0

0

0

0

0

0

0

0

0

0

0

0

0

5

Le matrici diagonali sono sempre quadrate. D’altra parte nelle matrici rettangolari non si può

individuare una diagonale principale.

3) Matrice unità. Una matrice quadrata di ordine avente tutti gli elementi della diagonale principale

unitari e gli altri elementi nulli dicesi matrice unità. Ad esempio, le matrici unità del 2°, 3° e 4°

ordine sono, rispettivamente:

1 0 0 0

1 0 0

1 0

0 1 0 0

=

= 0 1 0 = 0 1

0 0 1 0

0 0 1

0 0 0 1

Una matrice unità è anche diagonale. Non vale il viceversa.

Attenzione! È falso ritenere che la matrice nulla ha valore zero e la matrice unità ha valore uno. La

matrice nulla è semplicemente una matrice con tutti gli elementi nulli ed a questa non è associato

alcun valore. La matrice unità è semplicemente una matrice i cui elementi della diagonale principale

sono unitari e gli altri sono tutti nulli.

Matrice simmetrica e matrice trasposta

a) Matrice simmetrica. Effettuando la somma tra le matrici:

3 0 1

3 5 3

6 5 4

= 0 0 1 e = 5 0 2 si ottiene = + = 5 0 3

3 1 0

1 2 0

4 3 0

Nella matrice si osserva un fatto importante: gli elementi simmetrici rispetto alla diagonale

principale sono uguali. Alle matrici di questo tipo si dà il nome di matrici simmetriche, che ricorda la

Pag. 3/24

particolarità che le distingue. Esse sono necessariamente quadrate, cioè di ordini , . D’altra parte

solo per le quadrate si può parlare di diagonale principale.

b) Matrice trasposta. Osservando le due matrici e (la cui somma ha dato una matrice simmetrica),

ci si accorge che le righe di sono ottenute con le colonne di . Cioè, mutando, ordinatamente, le

colonne di un matrice in righe, si ottiene una matrice, indicata con , che dicesi matrice

trasposta della . Si ha che = !"# $ è = !#" $. Quindi se:

3 0 1

3 5 3

= 0 0 1 è = 5 0 2

3 1 0

1 2 0

Con l’esempio precedente si è provata la proprietà: la somma di una matrice e della sua trasposta

dà una matrice simmetrica:

+= + = Ove è una matrice simmetrica.

È come dire che, se + dà una matrice simmetrica o l’una è la trasposta dell’altra o sono

entrambe simmetriche.

Che cosa succede se non è quadrata? Si presti bene attenzione poiché:

1°) Se è di ordine , , % è di ordini invertiti , , quindi le due matrici non possono essere

sommate.

2°) Una matrice può essere sommata alla sua trasposta solo se è quadrata.

Combinazioni lineari e differenza tra matrici. Matrice emisimmetrica

Si ricordi il concetto di combinazione lineare per i polinomi. Cioè se si hanno, ad esempio, due polinomi

&' ()) e &+ ()), dicesi combinazione lineare di questi, il polinomio ottenuto sommando i polinomi &' ()) e

&+ ()) ciascuno moltiplicato per una costante (scalare) arbitraria, rispettivamente ,' e ,+ :

-()) = ,' ∙ &' ()) + ,+ ∙ &+ ())

Più in generale, se i polinomi sono più di due (ma in numero finito):

0

-()) = ,' ∙ &' ()) + ,+ ∙ &+ ()) + … + ,0 ∙ &0 ()) = 1 ," ∙ &" ())

La combinazione lineare di matrici è la matrice:

0

"2'

= 1 ," "

"2'

ottenuta sommando le matrici date dopo aver moltiplicato ciascuna di esse per una costante (scalare)

arbitraria.

1 3

2 −1

0 1

' = + = 3 = 2 −1

3 0

2 1

Date, ad esempio, le tre matrici:

una tra le tante combinazioni lineari è la matrice: = 2' + + + (−3)3

1 3

2 −1

0

+

+ (−3) 2 −1

3 0

2

ottenuta per ,' = 2, ,+ = 1, ,3 = −3.

= 2

1

4 2

=

1

1 −5

Il modo in cui è definita la combinazione lineare tra matrici giustifica le seguenti affermazioni:

Pag. 4/24

1) Le matrici che si combinano devono essere tutte degli stessi ordini. Infatti non si può parlare di

somma tra matrici di ordini diversi.

2) La differenza tra due matrici è una particolare combinazione lineare ottenuta per ,' = 1, ,+ = −1:

= ' + (−1)+

Essa dà una matrice i cui elementi sono dati dalla differenza degli elementi corrispondenti nelle matrici

combinate linearmente.

Consideriamo adesso una matrice quadrata, la sua trasposta e la matrice che si ottiene per differenza tra

queste due:

La matrice 4 ha:

2 −1 4

2 5 3

= 5 2 1 = −1 2 4

3 4 6

4 1 6

2 −1 4

0 −6 1

2 5 3

4 = − = 5 2 1 − −1 2 4 = 6

0 −3

3 4 6

−1 3

0

4 1 6

a) Gli elementi simmetrici rispetto alla diagonale principale opposti;

b) Gli elementi della diagonale principale nulli.

Matrici con queste due caratteristiche si dicono emisimmetriche. Pertanto, se la differenza tra due matrici

dà una matrice emisimmetrica, o l’una è la trasposta dell’altra, o entrambe sono emisimmetriche. Infatti la

differenza tra due matrici emisimmetriche dà una matrice ancora emisimmetrica. Esempio:

0

2 −3

0

1 1

0 −1 −4

−2 0

5 − −1 0 2 = −1 0

3

3 −5 0

−1 −2 0

4 −3 0

3) La matrice nulla ∅ è la combinazione lineare particolare − . Esempio:

2 1 0

2 1 0

0 0 0

3 2 −1 − 3 2 −1 = 0 0 0

5 2 3

5 2 3

0 0 0

4) Essendo la differenza − = + (−), vale la seguente:

( − )% = % − %

Moltiplicazione tra matrici

La moltiplicazione tra matrici può sembrare, a prima vista, molto complicata. In realtà questa operazione,

una volta apprese le modalità per la sua effettuazione, tenendo sempre presenti le condizioni che la

permettono, non presenta particolari difficoltà. Si voglia eseguire il prodotto scalare tra due vettori

bidimensionali di date componenti

5 = !2 , 3$ 6 = !4 , 1$

Per definizione il prodotto scalare tra due vettori è data da:

5 ∙ 6 = 2 ∙ 4 + 3 ∙ 1 = 11

(somma dei prodotti delle componenti omonime). Quindi, se i vettori fossero a componenti,

5 = !)' , )+ , )3 , … , )0 $ e 6 = !7' , 7+ , 73 , … , 70 $

il loro prodotto scalare sarebbe:

Pag. 5/24

0

5 ∙ 6 = )' 7' + )+7+ + )3 73 + … + )0 70 = 1 )" 7"

"2'

Ma si è detto che un vettore, di date componenti, si può rappresentare con una matrice riga oppure con

una matrice colonna. Bene, conveniamo allora di associare:

7'

7+

ad 5 la matrice riga 8 = !)' )+ … )0 $ e ad 6 la matrice riga 9 = … .

70

Affinché il prodotto tra le due matrici dia lo stesso risultato, per moltiplicazione tra le due matrici, riga per

colonna, si deve intendere la matrice:

7'

0

7+

)

…

)

)

: = 89 = ! '

+

0 $ ∙ = !)' 7' + )+ 7+ + … + )0 70 $ = 1 )" 7"

…

"2'

70

cioè una matrice il cui unico elemento è dato dalla somma dei prodotti degli elementi della riga per i

corrispondenti elementi della colonna.

Perché si è definita la moltiplicazione proprio in questo modo, cioè riga per colonna? Non si poteva

moltiplicare riga per riga o colonna per riga o colonna per colonna? Si sarebbe potuto fare. Ma avere

definito l’operazione in tale modo ha lo scopo ben preciso di far valere per la moltiplicazione tra matrici il

maggior numero di proprietà valide per la moltiplicazione tra scalari.

Estendiamo l’operazione a matrici di ordini superiori. Si voglia moltiplicare il vettore riga 5 = !)' , )+ $ per i

7' ;'

7'

;'

vettori colonna della matrice = 7 ; , cioè: 6 = 7 e < = ; .

+

+

+

+

È come dire che si cercano i prodotti scalari 5 ∙ 6 e 5 ∙ <. Considerando le matrici associate si ha:

7'

;'

89 = !)' )+$ ∙ 7 = !)'7' + )+ 7+ $ e 8= = !)' )+ $ ∙ ; = !)' ;' + )+ ;+$

+

+

7' ;'

Allora:

8 = !)' )+$ ∙ 7 ; = !)' 7' + )+ 7+ )' ;' + )+ ;+$

+

+

Si noti che ogni elemento della matrice ottenuto è il risultato di un prodotto scalare. Si osservi inoltre che

uno dei presupposti fondamentali per eseguire la moltiplicazione è che i vettori che entrano in gioco

debbono avere lo stesso numero di componenti. Ciò è equivalente a dire che: il numero di colonne della

prima matrice deve uguagliare il numero di righe della seconda matrice.

1 −1

1

2

3

4

6

∙

=

=:

0

0

1

11 11

−1 2

Se aumentiamo le componenti dei vettori, l’operazione si estende facilmente:

1

= 3

In definitiva:

2 −1

4 2

1° L’operazione di moltiplicazione tra matrici si può sempre fare se il numero di colonne della prima

matrice è uguale al numero di righe della seconda matrice.

Si ha: >,0 0,? = :>,? (i due indici di centro devono essere uguali e la matrice : ha ordini uguali

agli indici estremi). Quando le matrici e soddisfano questa condizione, si dicono compatibili per

la moltiplicazione.

2° L’elemento @"# della matrice prodotto è dato dalla somma dei prodotti degli elementi della riga A

della matrice per gli elementi della colonna , della matrice . Cioè si ha:

Pag. 6/24

@'' @'+ @'3

: = = @+' @++ @+3 si ha, ad esempio, che:

@3' @3+ @33

l’elemento @'3 è la somma dei prodotti degli elementi della prima riga di per quelli della terza

colonna di ;

l’elemento @++ è la somma dei prodotti degli elementi della seconda riga di per quelli della

seconda colonna di ;

l’elemento @3+ è la somma dei prodotti degli elementi della terza riga di per quelli della seconda

colonna di .

Potenza di una matrice quadrata. Idempotenza e nilpotenza

Come nell’algebra degli scalari si parla di potenza di un numero, anche nell’algebra matriciale si definisce la

potenza di una matrice, tenendo presente che si può parlare di potenza solo per matrici quadrate. Infatti la

potenza ad esponente intero positivo può essere assimilata ad un prodotto, cioè:

B = ,

C = Affinché questi prodotti siano effettuabili la matrice deve essere compatibile (per moltiplicazione) con se

stessa. Ciò avviene solo se essa è quadrata.

1 −1 2

1 −1 2

5 2 −3

B = = 2 1

1 ∙ 2 1

1 = 7 1

3

3 2 −2

3 2 −2

1 −5 12

Esistono delle matrici quadrate particolari per le quali avviene ciò che non può avvenire con gli scalari, cioè

esistono matrici tali che:

1 −1 2

= 2 1

1

3 2 −2

a) B = . Queste sono dette matrici idempotenti. Per queste matrici è 0 = per qualunque > 0

intero:

2 −2

2 −2 2 −2

2 −2

=

B = ∙

=

=

1 −1

1 −1 1 −1

1 −1

La matrice unità di qualsiasi ordine è idem potente, cioè:

FB = F quindi F0 = F per qualunque > 0.

b) 0 = G con > 0 intero. Queste matrici sono dette nilpotenti di ordine :

6

4

6

4

6

4

0 0

=

B = ∙

=

−9 −6

−9 −6 −9 −6

0 0

Le matrici del tipo:

0 1 0 0

0 1 0

0 1

0 0 1 0

I+ = , I3 = 0 0 1 , IJ = ,…

0 0

0 0 0 1

0 0 0

0 0 0 0

sono nilpotenti, rispettivamente:

I+ di ordine 2

I3 di ordine 3

IJ di ordine 4

…………………….

I0 di ordine Pag. 7/24

Proprietà commutativa. Prodotti a destra e a sinistra. Commutatore

In generale la moltiplicazione tra matrici non gode della proprietà commutativa, cioè è ≠ ove e sono matrici compatibili per la moltiplicazione (il numero di colonne della prima uguaglia il numero di righe

della seconda). In generale, allora, nella moltiplicazione tra matrici:

a) Essendo >,0 e 0,> (con ≠ ) due matrici compatibili per l’operazione prodotto di per (cioè è calcolabile ) e di per (cioè è calcolabile ), è ≠ . Infatti:

>,0 ∙ 0,> = :>,> cioè è quadrata di ordine ;

0,> ∙ >,0 = :0,0 cioè è quadrata di ordine ;

b) Se poi le matrici sono del tipo >,0 e 0,? , è sicuramente ≠ dal momento che è calcolabile

il prodotto >,0 ∙ 0,? = :>,? , ma non si può effettuare il prodotto poiché il numero di

colonne di (@) è diverso dal numero di righe di ().

Le matrici quadrate e , per le quali è ≠ si dicono non commutabili.

Le matrici quadrate e , per le quali è = si dicono commutabili.

Per le matrici non commutabili si ha: − ≠ ∅

Per le matrici commutabili si ha: − = ∅

Dicesi commutatore di e e si indica con !, $ la differenza − . È chiaro allora che:

se !, $ = − = ∅ → = , le matrici e commutano;

se !, $ = − ≠ ∅ → = , le matrici e non commutano.

Vediamo qualche caso di matrici che commutano, per le quali cioè è !, $ = ∅.

1) Ogni matrice , di ordini qualsiansi, commuta con la matrice unità compatibile con per

moltiplicazione a destra o a sinistra:

!, F$ = !F, $ = ∅ cioè F = F = Una qualunque matrice, dunque, rimane inalterata se moltiplicata a destra o a sinistra per F.

2) Due matrici diagonali di uguali ordini commutano.

3 0 0

1 0

0

Siano: MN = 0 1 0 , MNN = 0 −5 0 . Si ha che:

0 0 −2

0 0 −3

3 0 0

1 0

0

3 0

MNMNN = 0 1 0 ∙ 0 −5 0 = 0 −5

0 0 −2

0 0 −3

0 0

1 0

0

3 0 0

3 0

MNN MN = 0 −5 0 ∙ 0 1 0 = 0 −5

0 0 −3

0 0 −2

0 0

L’esempio mostra che:

0

0

6

0

0

6

a) MNMNN − MNN MN = ∅ cioè !MN , MNN $ = ∅

b) MNN MN − MNMNN = ∅ cioè !MNN , MN$ = ∅

3) Ogni matrice , di ordini qualsiansi, commuta con la matrice scalare ,F compatibile con per

moltiplicazione a destra o a sinistra.

3 1

1 0

2 0

=

, ,F = 2 =

−1 2

0 1

0 2

3 1 2 0

6 2

3 1

(,F) = ∙

=

= 2

= ,

−1 2 0 2

−2 4

−1 2

Pag. 8/24

(,F) = 2 0 ∙ 3 1 = 6 2 = 2 3 1 = ,

0 2 −1 2

−2 4

−1 2

L’esempio mostra che:

a) (,F) − (,F) = ∅ cioè !, ,F$ = ∅

b) (,F) − (,F) = ∅ cioè !,F, $ = ∅

4) Ogni matrice , di ordini qualsiansi, commuta con la matrice nulla ∅ compatibile con per

moltiplicazione a destra o a sinistra.

1 −1 2

=

. Si ha che:

3 4 2

0

1 −1 2

∅ = ∙ 0 = ∅

3 4 2

0

1 −1 2

∅ = !0 0$ ∙ =∅

3 4 2

L’esempio mostra che:

a) ∅ − ∅ = ∅ cioè !, ∅$ = ∅

b) ∅ − ∅ = ∅ cioè !∅, $ = ∅

Legge di cancellazione. Proprietà distributiva

1) Legge di cancellazione. Quando nell’algebra degli scalari si scrive l’uguaglianza = si trae che

= . Questa è la legge di cancellazione. Anche in questo caso l’algebra matriciale si discosta da

quella degli scalari.

2

1

'

Si considerino le matrici = !3 2 2$ , = 0 , = O− +P

1

0

Per confermare quanto detto basta far vedere che, pur essendo ≠ , è = :

1

= !3 2 2$ ∙ 0 = !5$

1

2

1

= !3 2 2$ ∙ − = !5$

2

0

0 1

0 2

1 0 1

Si considerino le matrici = , = 0 1 , = 0 −1

2 1 0

1 1

1 0

0 1

1 0 1

1 2

= ∙ 0 1 = 2 1 0

0 3

1 1

0 2

1 0 1

1 2

= ∙ 0 −1 = 2 1 0

0 3

1 0

Anche in questo caso è = pur essendo ≠ .

Concludendo si può dire che nell’algebra matriciale non vale la legge di cancellazione.

2) Proprietà distributiva. Nell’algebra matriciale si ha:

( + ) = + ( + ) = + ma non si dimentichi che la proprietà commutativa in generale non vale, cioè:

( + ) ≠ ( + )

( + ) ≠ ( + )

Pag. 9/24

Prodotti notevoli

Nell’algebra matriciale si ha:

+

+ in generale

( + )+ = ↗ + + + ++ se !, $ ≠ ∅ ( = )

↘ + 2 + +

+ in generale

( − )+ = ↗ + − − ++ se !, $ ≠ ∅ ( = )

↘ − 2 + +

+ − + in generale

( + )( − ) = ↗ + − +

se !, $ ≠ ∅ ( = )

↘ −

E’ da sottolineare che e devono essere necessariamente quadrate.

Prodotto di tre o più matrici. Proprietà associativa

Dato che, in generale, per la moltiplicazione tra matrici non vale la proprietà commutativa, il prodotto si può eseguire associando i fattori di uno dei modi seguenti:

= () = ()

Trasposta di un prodotto

Ci si propone di vedere la relazione che intercede tra la trasposta di un prodotto ed il prodotto delle

trasposte. A tale scopo con le matrici:

5 1

3 2 −1

e = −1 2 si verifichi che () = . Infatti:

0 1 −1

3 0

7 7

= −4 2

7 −4

() = 7 2

7 −4

=

7 2

=

Dal confronto segue che () = .

Quindi in generale: la trasposta di un prodotto tra matrici di ordini , e , è uguale al prodotto delle

trasposte prese in ordine inverso. Tale regola è detta della inversione dell’ordine. Tale regola vale anche per

la trasposta del prodotto di tre o più matrici (compatibili con le operazioni da eseguire).

L’inversa di una matrice

1 2

3 −2

Siano = e= due matrici quadrate dello stesso ordine. Si calcoli e :

1 3

−1 1

1 0

= =F

0 1

1 0

= =F

0 1

Come nell’algebra degli scalari il numero , tale che moltiplicato per il numero dia: = = 1, è detto

inverso o reciproco di (e viceversa), così, nell’algebra matriciale, una matrice quadrata tale che

moltiplicata per (anche questa quadrata) dia:

Pag. 10/24

= = F

è detta inversa di (e, viceversa, inversa di ) e si indica con = Z'.

Pertanto dall’esempio si può dedurre la regola generale:

che definisce l’inversa di una matrice.

Z' = Z' = F

Il problema è quello di vedere come va calcolata Z' partendo da , e quali sono le condizioni perché la

matrice ammetta l’inversa. Al secondo quesito si risponderà dopo aver introdotto i determinanti.

Vediamo subito il primo punto. Si voglia, ad esempio, calcolare l’inversa della matrice dell’esempio

precedente, ammesso che siano soddisfatte le condizioni perché esista l’inversa della matrice:

1 2

. Per la stessa definizione di Z', deve essere:

1 3

) + 2; 7 + 2[

1 2 ) 7

1 0

1

∙

=

→\

]=

Z' = F → ) + 3; 7 + 3[

1 3 ; [

0 1

0

=

) + 2; = 1

)=3 _

`

) + 3; = 0_

;

= −1

^

→

7 + 2[ = 0

7 = −2_

`

7 + 3[ = 1

[=1

0

1

Affinché le matrici siano uguali debbono avere gli elementi corrispondenti uguali. Ne segue il sistema:

)

Z' = ;

7

3

=

[

−1

−2

1

Questo è un modo per calcolare l’inversa di una matrice di ordini , . Solo che, per grande, è

necessario risolvere un sistema con molte incognite (esattamente + incognite). Vedremo un modo meno

complicato per calcolare la matrice inversa.

Quindi:

Si può solo anticipare che: non tutte le matrici quadrate ammettono l’inversa Z' e quando

l’ammettono essa è una ed una sola.

Per la matrice inversa valgono le seguenti proprietà:

a) ()Za = Za Z'

b) (Z')Za = c) ( )Za = (Z' )

Pag. 11/24

Schema riassuntivo di leggi e proprietà

+= +

Leggi e proprietà valide in generale

Leggi e proprietà relative a casi particolari

+ =

− =4

( ) = ( + ) = + ≠ se = ∅

=∅ o =∅

=

( + ) = + ( + ) = + = + ± ± + +

= − + − +

+

= () = ()

= = !, $ = ∅

≠∅ o ≠∅

se = ( ± )+ =

→

≠ con ≠ ∅

= + ± 2 + +

se !, $ = ∅

= + − +

se !, $ = ∅

= +

+

( + )( − ) =

+

= _+ − 2 − + c

+ 2 − +

() = Z' = Z' = F

()Z' = Z' Z'

(Z' )Z' = ( )Z' = (Z')

Pag. 12/24

+

se = −

se = −

MATRICI A ELEMENTI COMPLESSI

Per le matrici ad elementi complessi valgono definizioni e teoremi analoghi a quelli già visti per le matrici ad

elementi reali.

d

= 1 − d

0

Esempi di matrici ad elementi complessi sono:

1+d

=

−1 − d

2

2−d

−d

−2 + 3d

2d

3−d

3 − 2d

2+d

0

1 7+ d

2

Coniugata di una matrice

f dicesi

Ricordando che il coniugato di un numero complesso ; = + d è ;e = − d, una matrice f il suo complesso coniugato. La

coniugata della matrice se a ciascun elemento di corrisponde in f

matrice si legge coniugata di . Esempio:

g = ;

1) =\

1+d

2

−1 − d

]

3d

Per le matrici coniugate valgono le seguenti proprietà:

f = \1 − d

2

Se e sono matrici degli stessi ordini:

f+

f

hhhhhhhh

2) (

+ ) = Se e sono matrici quadrate dello stesso ordine:

hhhhhhh

f∙

f

3) (

∙ ) = Pag. 13/24

−1 + d

]

−3d

DETERMINANTI E LORO PROPRIETÀ

Due dei motivi per cui si è sviluppata la teoria dei determinanti sono quello di risolvere i sistemi di

equazioni lineari e quello di trovare l’inversa di una matrice quadrata. Per far ciò è stato necessario

associare ad ogni matrice quadrata un numero cui si è dato il nome di determinante della matrice.

Determinante di una matrice quadrata del secondo ordine

Si voglia risolvere il seguente sistema di due equazioni lineari in due incognite:

) + 7 = i

j

≠ _

') + ' 7 = '

' '

' − ' ' − ' Un qualunque metodo di risoluzione fornisce:

Si considerino le tre matrici:

)=

=\

'

]

'

k = \

ottenuta con i coefficienti delle incognite ) ed 7,

'

7=

' − ' ' − ' ]

'

l = '

' k ottenuta da sostituendo la colonna dei coefficienti della ) con quella dei termini noti,

l ottenuta da sostituendo la colonna dei coefficienti della 7 con quella dei termini noti,

ebbene, se

alla matrice si associa il numero || = ' − '

alla matrice si associa il numero |k | = ' − '

alla matrice si associa il numero nl n = ' − ' la soluzione del sistema può essere scritta nella forma;

)=

Sia dato, ad esempio, il sistema:

1 2

1 1

|k |

||

7=

) + 27 = 5_

i

)+7=3

5 2

k = 3 1

Le tre matrici ed i numeri ad esse associati sono:

=

Quindi:

nl n

||

l = 1 5

1 3

|| = −1 |k | = −1 nl n = −2

)=

|k | −1

nl n −2

=

=1 7=

=

=2

||

||

−1

−1

Si perviene al medesimo risultato risolvendo il sistema, per esempio, con il metodo di sostituzione. Quanto

detto serve a mettere in evidenza che:

1) ad ogni matrice quadrata può essere associato un numero che si chiama il suo determinante e si

indica con

||

Pag. 14/24

2) Il numero da associare a matrici quadrate di ordine 2 è quello fornito dalla differenza dei prodotti

degli elementi delle due diagonali (principale meno secondaria).

3) Uno degli impieghi più frequenti del determinante di una matrice quadrata è nella risoluzione dei

sistemi di equazioni lineari.

Determinante di una matrice quadrata del terzo ordine

Poiché le matrici quadrate possono essere di ordine , cerchiamo di estendere la legge che ci permette di

costruire il numero (o determinante) da associare ad una matrice quadrata di qualsiasi ordine.

Il determinante di una matrice quadrata di ordine è costituito da:

1)

2)

3)

4)

! prodotti.

Ogni prodotto è formato da fattori.

Ciascun prodotto contiene elementi di righe e colonne diverse.

Ad ogni prodotto viene assegnato un segno positivo o negativo in base ad un criterio che verrà

chiarito.

Per esempio, il determinante di una matrice del 3° ordine è costituito da 3! = 6 prodotti, ciascuno formato

da tre elementi di righe e colonne diverse. Questi prodotti verranno sommati dopo aver assegnato a

ciascuno un appropriato segno.

Per individuare i 6 prodotti ed i loro segni si esegue la regola di Sarrus.

'

|| = p+

3

'

+

3

'

+ p = ' + 3 + ' +3 + '+ 3 − '+ 3 − ' + 3 − ' + 3

3

Per la seguente matrice del 3° ordine, il determinante è:

Sviluppo di un determinante secondo gli elementi di una riga o di una colonna. Minori e

complementi algebrici

Si consideri una matrice del 3° ordine

= q"r s

Il suo determinante, calcolato con la regola di Sarrus, è:

'' '+ '3

|| = p +' ++ +3 p = '' ++ 33 + '+ +3 3' + '3 +' 3+ − '' +3 3+ − '++' 33 − '3 ++ 3'

3' 3+ 33

Accoppiando opportunamente i 6 prodotti si ottengono le seguenti 6 espressioni:

a) || = ('' ++ 33 − '' +3 3+ ) − ('++3 3' − '+ +' 33 ) + ('3 +' 3+ − '3 ++ 3' ) =

= '' (++ 33 − +3 3+ ) − '+ (+3 3' − +' 33 ) + '3 (+' 3+ − ++ 3' ) =

++ +3

+' +3

+' ++

= '' t

t − '+ t

t + '3 t

t

3+

33

3'

33

3' 3+

'+ '3

'' '3

'' '+

b) || = −+' t

t + ++ t

t − +3 t

t

3+

33

3'

33

3' 3+

'+ '3

'' '3

'' '+

c) || = 3' t

t − 3+ t

t + 33 t

t

++ +3

+' +3

+' ++

++ +3

'+ '3

'+ '3

d) || = '' t

t − +' t

t + 3' t

t

3+ 33

3+ 33

++ +3

+' +3

'' '3

'' '3

e) || = −'+ t

t + ++ t

t − 3+ t

t

3' 33

3' 33

+' +3

+' ++

'' '+

'' '+

f) || = '3 t

t − +3 t

t + 33 t

t

3' 3+

3' 3+

+' ++

Pag. 15/24

In ognuna di queste 6 relazioni si può notare che si tratta della somma dei prodotti degli elementi di una

riga (o colonna) per il determinante della matrice che si ottiene sopprimendo, nella matrice data , la riga e

la colonna che si incontrano nell’elemento considerato.

−1 2 0

= 3 −2 1

4

1 5

3

−2

−2 1

−1 2

|| = 0 t

t − (1) t

t + 5t

t = −11

4 1

1 5

3 −2

Ribadiamo che il risultato non sarebbe cambiato se si fosse scelto uno qualunque degli altri cinque sviluppi.

Anche con la regola di Sarrus si ottiene lo stesso risultato.

Esempio. Sviluppiamo secondo gli elementi della terza colonna [sviluppo f)] il determinante della matrice:

Ognuno dei determinanti del 2° ordine che compaiono nelle espressioni a), b), c), d), e), f), dicesi minore

complementare dell’elemento per cui è moltiplicato.

Indicando con u"r il minore complementare dell’elemento "r , le 6 espressioni del determinante

|| = n"r n possono essere scritte nel modo seguente:

a) ''v'' − '+ v'+ + '3 v'3 = ''(+v'' ) + '+ (−v'+ ) + '3 (+v'3 )

b) −+' v+' + ++ v++ − +3 v+3 = +' (−v+' ) + ++ (+v++) + +3 (−v+3 )

c) 3' v3' − 3+ v3+ + 33 v33 = 3' (+v3' ) + 3+ (−v3+ ) + 33 (+v33)

che corrispondono allo sviluppo di || secondo le righe;

d) ''v'' − +' v+' + 3' v3' = '' (+v'' ) + +' (−v+' ) + 3' (+v3' )

e) −'+ v'+ + ++ v++ − 3+ v3+ = '+ (−v'+) + ++ (+v++ ) + 3+ (−v3+)

f) '3v'3 − +3 v+3 + 33 v33 = '3 (+v'3 ) + +3 (−v+3 ) + 33 (+v33 )

che corrispondono allo sviluppo di || secondo le colonne.

Ciascuno dei termini tra parentesi prende il nome di complemento algebrico dell’elemento per cui è

moltiplicato.

Indichiamo con "r il complemento algebrico dell’elemento "r . Si osservi che:

"r = u"r

per A + d pari

"r = −u"r per A + d dispari

In definitiva, lo sviluppo del determinante di una matrice del 3° ordine si può scrivere simbolicamente:

3

|| = 1

r2'

3

|| = 1

"2'

"r "r

"r "r

(sviluppo secondo la riga A-esima)

(sviluppo secondo la riga d-esima)

La regola di Sarrus permette di calcolare il determinante solo di matrici del 3° ordine. Lo sviluppo, invece, di

un determinante secondo una riga o una colonna può essere applicato a matrici quadrate di qualunque

ordine.

A tale scopo si definisce:

1) Minore complementare di un elemento "r di una matrice quadrata di ordine , il determinante

della matrice di ordine − 1 che si ottiene da sopprimendo la riga A-esima e la colonna d-esima

(cioè sopprimendo la riga e la colonna che si incontrano nell’elemento considerato). Esso si indica

con u"r .

Pag. 16/24

2) Complemento algebrico relativo all’elemento "r il minore complementare u"r preso con il suo

segno se A + d è pari, con segno opposto se A + d è dispari.

1 −1 1

1

2

1

−3

1

|| = w

w

1 2

3 −2

2 3 −1 −2

Si calcoli ad esempio il seguente determinante:

Scelta una qualunque linea (ad esempio la prima riga) si ha:

1 −3 1

2 −3 1

2 1 1

2 1 −3

|| = 1 p2 3 −2p + 1 p1 3 −2p + 1 p1 2 −2p − 1 p1 2 3 p = |8| + |9| + |=| − |%|

3 −1 −2

2 −1 −2

2 3 −2

2 3 −1

Ognuno di questi determinanti può essere calcolato con la regola di Sarrus oppure sviluppando secondo gli

elementi di una qualsiasi linea. Scegliendo il secondo metodo si ottiene:

|8| = 1 t 3 −2t − 2 t−3 1 t + 3 t−3 −1t = −13

−1 −2

−1 −2

3 −2

|9| = −17

|=| = 1

|%| = −12

Pertanto:

|9| = −13 − 17 + 1 − (−12) = −17

Proprietà dei determinanti

Enunciamo alcune proprietà che possono essere utili per facilitare il calcolo del determinante di una

matrice quadrata di ordine . A tale scopo si consideri una matrice il cui determinante è:

0

|| = 1 "r "r

sviluppato secondo gli elementi della A-esima riga.

−

−

−

−

−

r2'

Proprietà 1. Una matrice quadrata e la sua trasposta hanno uguale determinante. Cioè:

|| = | |

Proprietà 2. Se in una matrice quadrata gli elementi di una riga (o colonna) sono tutti nulli, il

determinante della matrice è nulla:

|| = 0

Proprietà 3. Se in una matrice quadrata si scambiano tra loro le righe (o le colonne) si ottiene

una matrice il cui determinante è || = ±|| con

|| = || se si può ottenere da con un numero pari di scambi tra le righe (o le colonne);

|| = −|| se si può ottenere da con un numero dispari di scambi tra le righe (o le colonne).

Proprietà 4. Se in una matrice due linee (righe o colonne) sono uguali, il suo determinante è

nullo. Cioè:

|| = 0

Proprietà 5. Se si moltiplicano per , gli elementi di una linea (riga o colonna) di una matrice, il

determinante della matrice risulta moltiplicato per ,.

Pag. 17/24

−

−

−

−

Proprietà 6. Se in una matrice due linee parallele (righe o colonne) sono proporzionali, il suo

determinante è nullo.

Proprietà 7. Se tutti gli elementi di una linea (righe o colonne) di una matrice sono espressi come

un binomio )" + 7" (A = 1,2, … , ), il determinante di si può esprimere come la somma di due

determinanti.

' ' '

' ' x'

' ' ' + x'

|| = p+ + + + x+ p = p+ + + p + p+ + x+ p

3 3 3 + x3

3 3 3

3 3 x3

analogamente, se ciascun elemento di una linea è esprimibile come somma di addendi, il

determinante di si può esprimere come somma di determinanti.

Proprietà 8. Il determinante di una matrice non cambia se agli elementi di una linea (riga o colonna)

si aggiungono quelli di una linea parallela moltiplicati ciascuno per uno scalare ,.

Proprietà 9. La somma dei prodotti degli elementi di una linea (riga o colonna) per i complementi

algebrici degli elementi di una linea parallela è nulla.

Determinanti di particolari matrici

1) Determinanti del prodotto di matrici quadrate.

Il determinante di un prodotto è uguale al prodotto dei determinanti. Ciò vale per matrici di ordine

:

|| = || ∙ ||

2) Determinante di una matrice diagonale.

La matrice diagonale sia, in generale:

0

0

'' 0

0 ++ 0

0

j '' , ++ , … , 00 ≠ 0.

M=

…

… … …

0

0

0 00

Per definizione il determinante di è formato da ! prodotti, ciascuno costituito da elementi

appartenenti a righe e colonne diverse. Di questi ! prodotti uno solo è diverso da zero: quello

formato con gli elementi della diagonale principale. Pertanto:

0

|M| = '' ++ … 00 = z ""

"2'

3) Determinante del prodotto di uno scalare per una matrice: || = |,|

Poiché: , = ,F = (,F), si ha:

|,| = |,F| ∙ || = , 0 ||

Schema riassuntivo di leggi e proprietà

|| = || ∙ ||

Leggi e proprietà valide in generale

|+ | = || ∙ ||

Leggi e proprietà relative a casi particolari

|M| = 0 per almeno un "r = 0

0

|M| = z ""

"2'

|,| = , 0 ||

Pag. 18/24

Il rango di una matrice. Matrici singolari e non singolari

Dalle proprietà esaminate precedentemente si deduce che:

1) Se una matrice ha determinante nullo (|| = 0), almeno una riga (o una colonna) è proporzionale

ad un’altra riga (o colonna) o perlomeno è combinazione di altre righe (o colonne)

2) Se una matrice ha determinante diverso da zero le linee (sia le righe tra loro, che le colonne tra

loro) sono indipendenti l’una dall’altra nel senso esposto nel primo punto.

Si hanno le seguenti definizioni:

a) Una matrice con || = 0 dicesi singolare;

b) Una matrice con || ≠ 0 dicesi non singolare.

Dicesi rango di una matrice il numero che esprime l’ordine del minore, di ordine maggiore, diverso da zero,

estraibile dalla matrice.

Ricerca del rango di una matrice

Per calcolare il rango di una matrice di ordine = 3 conviene procedere nel modo seguente:

a) Si sceglie un minore del secondo ordine diverso da zero.

b) Si orla questo in tutti i modi possibili con le righe e le colonne rimanenti.

c) Se tutti questi minori, di ordine 3, sono nulli si può concludere che il rango è 2.

Nel caso più generale di una matrice di ordini , :

a) Si sceglie un minore del 2° ordine diverso da zero.

b) Si orla questo in tutti i modi possibili con le righe e le colonne rimanenti.

1) Se tutti i minori di ordine 3 sono nulli si conclude che è { = 2.

2) Se si riscontra che un minore del 3° ordine è diverso da zero, allora si ripete l’operazione b)

su questo minore diverso da zero. Se tutti i minori, di ordine 4, sono nulli, si conclude che è

{ = 3; se si riscontra che un minore del 4° ordine è diverso da zero, allora si ripete

l’operazione b) su questo minore diverso da zero. E così via.

In questo metodo pratico di ricerca del rango consiste la regola di Kronecker.

Proprietà del rango:

a) Il rango di una matrice non cambia se si scambiano tra loro delle righe (o delle colonne).

Indichiamo una tale trasformazione con |"r o ("r ), intendendo così uno scambio della riga A con la

riga d (colonna A con colonna d).

b) Il rango di una matrice non cambia se si moltiplicano per una costante gli elementi di una riga (o

di un colonna). Indichiamo una tale trasformazione con |" (,) [o " (,)] intendendo che la riga (o

colonna) A è moltiplicata per ,.

c) Il rango di una matrice non cambia se si somma ad una riga (o ad una colonna) un’altra riga (o

colonna) moltiplicata per una costante. Indichiamo tale trasformazione con |" + |r (,)

[o |" + |r (,)$, intendendo che si sostituisce la riga (o colonna) A con la somma della riga A e della

riga d moltiplicata per , (lo stesso per le colonne).

Si fa notare che le trasformazioni a) e b) cambiano il determinante di rendendolo rispettivamente: ±|| e

,||. La trasformazione c), invece, lascia invariato il determinante di . Tenendo presenti queste

caratteristiche, l’applicazione di questo metodo permette di effettuare contemporaneamente la ricerca del

rango ed il calcolo del determinante.

Pag. 19/24

Applicazioni dei determinanti

I determinanti trovano un’importante applicazione nel calcolo dell’inversa di una matrice non singolare.

Siano date, ad esempio, le matrici:

2 1 3

−1 2 −1

'

= −1 1 2 e Z' = − } 3 −1 −7

1 1 1

−2 −1 3

Verifichiamo innanzi tutto che è || ≠ 0

|| = 2 + 2 − 3 − 3 + 1 − 4 = −5

−1 2

1 2 1 3

Z' = − −1 1 2 ∙ 3 −1

5

1 1 1

−2 −1

−1

−7 = F

3

Ci proponiamo adesso di vedere come si può arrivare alla matrice Z' partendo da , senza per questo

risolvere sistemi di equazioni lineari. Per raggiungere tale scopo costruiamo una matrice nel seguente

modo:

1) Si costruisce la matrice (trasposta di ).

2) Si calcolano i complementi algebrici "r degli elementi di e con essi si costruisce la matrice .

Nel caso della matrice data, si ha:

2 −1 1

1) = 1 1 1

3 2 1

1 1

1 1

1 1

2) '' = t

t = −1 '+ = − t

t = −2 '3 = t

t = −1

2 1

3 1

3 2

−1 1

2 1

2 −1

t = 3 ++ = t

t = −1 +3 = − t

t = −7

+' = − t

2 1

3 1

3 2

−1 1

2 1

2 −1

3' = t

t = −2 3+ = − t

t = −1 33 = t

t=3

1 1

1 1

1 1

Si osservi che i complementi algebrici "r della matrice sono legati a quella della trasposta dalla

relazione "r

= r" . Pertanto si può scrivere:

''

= '+

'3

+'

++

+3

3'

−1

3+ = 3

33

−2

2

−1

−1

−1

−7

3

Ebbene, l’inversa di si ottiene dividendo la matrice , così ottenuta, per il determinante di .

Z' =

1 ''

=

|| || '+

'3

+'

++

+3

3'

1 −1 2 −1

3+ = − 3 −1 −7

5

33

−2 −1 3

Pertanto: data una matrice quadrata non singolare, la sua inversa è la matrice i cui elementi sono dati dai

complementi algebrici della trasposta di , ciascuno di essi diviso per il determinante di .

Risoluzione dei sistemi di equazioni lineari con il formalismo matriciale

Un’importante applicazione dell’algebra matriciale e dei determinanti, si ha nella risoluzione dei sistemi di

equazioni lineari. Si voglia, ad esempio, risolvere il seguente sistema:

2) + 7 − ; = −13

~ ) − 37 + 2; = 13 _

) − 7 + 3; = 12

Pag. 20/24

1) Metodo di Cramer.

Si considerino le matrici:

2 1 −1

−3 1 −1

2 −3 −1

2 1 −3

= 1 −3 2 = 13 −3 2 = 1 13 2 M = 1 −3 13 1 −1 3

12 −1 3

1 12 3

1 −1 12

, , e M ottenute, rispettivamente, sostituendo nella (matrice dei coefficienti) la colonna dei

termini noti al posto delle colonne dei coefficienti delle incognite ), 7 e ;.

Poiché è

|| = −18 + 2 + 1 − 3 − 3 + 4 = −17 ≠ 0

le soluzioni sono date da:

) = || 7 = || ; =

||

Essendo:

Si ha:

|| = −17

||

|| = 34

|M|

||

|M| = −51

) = 1 7 = −2 ; = 3

2) Metodo dell’inversa

In forma compatta il sistema dato può essere scritto:

)

2 1 −1

−3

1 −3 2 ∙ 7 = 13 ;

1 −1 3

12

O più semplicemente:

8 = 9

dove è la matrice dei coefficienti, 8 è il vettore di componenti ), 7, ; e 9 è il vettore di

componenti −3,13,12.

Se la matrice non è singolare, moltiplicando a sinistra ambo i membri di 8 = 9 per Z' si

ottiene:

Z'8 = 9Z' → 8 = Z'9

Cioè, le soluzioni del sistema si ottengono effettuando il prodotto tra l’inversa di e la matrice 9.

Calcoliamo la Z' relativa al sistema dato:

2

1

1

a. = 1 −3 −1

−1 2

3

b. '' = −7 '+ = −2 '3 = −1

+' = −1 ++ = 7

+3 = −5

3' = 2

3+ = 3

33 = −7

||

c.

= −18 + 1 + 2 − 3 + 4 − 3 = −17

'' +' 3'

−7 −2 −1

'

'

d. Z' = − ' '+ ++ 3+ = − ' −1 7 −5

'3 +3 33

2

3 −7

Moltiplicando ambo i membri a sinistra per Z' si ottiene:

)

1 7

7 =

1

17

;

−2

Dal confronto segue che:

)

2 1

−3

1

1 17

7

∙

→

=

−34 = −2

−7 5

13

17

;

−3 7

12

51

3

) = 1 7 = −2 ; = 3

Pag. 21/24

SPAZI VETTORIALI

Condizioni che definiscono uno spazio vettoriale

Dato un vettore riga (o colonna) ad componenti

= !)'

)+

)3

… )0 $

)'

)+

( =

)3 )

…

)0

Se )' , )+, )3, … , )0 sono numeri reali si dice che il vettore è sul campo reale ℛ, se )' , )+, )3, … , )0 sono

numeri complessi, si dice che il vettore è sul campo complesso .

Si consideri ora un insieme di @ vettori a componenti tutti su ℛ (oppure su )

≡ (', + , 3 , … , ? )

In esso siano definite due operazioni che indichiamo con i simboli + (somma tra vettori) e ∙ (moltiplicazione

tra un vettore e uno scalare). Tra gli elementi di ci sia il vettore nullo ed il vettore −" (opposto di ogni

" ). Rispetto all’operazione somma tra vettori valga la seguente proprietà:

a) " + r = ∈ (l’insieme è chiuso rispetto all’addizione)

Trattandosi di vettori è noto che per gli elementi di valgono gli assiomi:

b) " + r = r + "

c) " + r + # = " + (r + # ) (proprietà associativa)

d) " + G = "

e) " + (−" ) = G

(proprietà commutativa)

Considerato un campo di scalari munito di unità (che indichiamo con 1), rispetto all’operazione

moltiplicazione di un vettore per uno scalare , valga la seguente proprietà:

f)

," ∈ (l’insieme è chiuso rispetto alla moltiplicazione per uno scalare)

Valgano inoltre i seguenti assiomi:

g)

h)

i)

j)

,(" + r ) = ," + ,r

(proprietà distributiva)

(,' + ,+ )" = ,' " + ,+ " (proprietà distributiva)

,' (,+ " ) = (,' ,+ )" (proprietà associativa)

1 ∙ " = "

Un insieme di @ vettori posizione, quale quello che stiamo considerando, per i quali valgano le proprietà

a) ed f), e quindi tutte le altre otto proprietà enunciate, definisce uno spazio vettoriale.

La combinazione

dà un vettore di .

,'' + ,+ + + ,3 3 + … + ,? ?

Ciò detto, indicheremo con

ℛ0 lo spazio vettoriale i cui elementi sono vettori ad componenti reali;

0 lo spazio vettoriale i cui elementi sono vettori ad componenti complesse.

Pag. 22/24

Vettori linearmente dipendenti e indipendenti

Una matrice può essere pensata come formata da vettori riga o da vettori colonna. Pertanto, ad esempio, la

matrice

1 2

=

3 1

può essere graficamente interpretata come nella fig. 1 o nella fig. 2, a seconda che la si consideri formata

da vettori riga o da vettori colonna.

y

3

y

2

1

1

x

1

1

3

fig. 1

2

x

fig.2

in ambedue i casi i vettori costituenti la matrice appartengono allo spazio vettoriale bidimensionale ℛ+ ed

individuano il piano che li contiene. Allo stesso modo, la matrice

1 3 2

2 1 −1

può essere graficamente interpretata come nella fig. 3 o nella fig. 4, rispettivamente, a seconda che la si

consideri formata da vettori riga o da vettori colonna.

=

y

3

1

1

2

x

-1

fig. 3

fig. 4

Nel primo caso si hanno due vettori riga di ℛ3 che individuano il piano che li contiene. Nel secondo caso si

hanno tre vettori colonna di ℛ+ che individuano ancora un piano.

Pag. 23/24

1 3

2 6

può essere graficamente interpretata come nella fig. 5 o nella fig. 6, a seconda che la si consideri,

rispettivamente, formata da vettori riga o da vettori colonna.

La matrice

=

y

6

y

6

3

1

x

1

1

2

fig. 5

3

x

fig. 6

In ambedue i casi i vettori costituenti la matrice appartengono allo spazio bidimensionale ℛ+ ma, essendo

sovrapposti, essi non individuano un piano, bensì la retta che li contiene.

Lo studio delle matrici , e porta alle seguenti considerazioni. I due vettori riga (o colonna) di hanno

la stessa direzione, quindi le componenti dell’uno si possono ottenere moltiplicando per uno stesso scalare

(diverso da zero) le componenti dell’altro. Diremo che i due vettori sono linearmente dipendenti. I due

vettori riga (o colonna) di hanno direzioni diverse, quindi non è possibile esprimere le componenti di uno

di essi moltiplicando per uno stesso scalare le componenti dell’altro. Diremo che i due vettori sono

linearmente indipendenti.

Analogo discorso vale per i due vettori riga di : essi risultano linearmente indipendenti, mentre i tre

vettori colonna di sono linearmente dipendenti. Ciò può sembrare strano a prima vista in quanto dalla

fig. 4 si vede che i tre vettori hanno direzioni diverse, ma è logico se si considera che per individuare un

piano sono sufficienti due direzioni (e quindi due vettori), perciò uno qualunque dei tre vettori si deve

poter esprimere in funzione dei due rimanenti, cioè deve essere una combinazione lineare degli altri due.

In generale, dati @ vettori su ℛ0 , se le combinazione lineare

?

1 ," " = ,' ' + ,+ + + ,3 3 + … + ,? ?

"2'

dà il vettore nullo solo per ,' = ,+ = ,3 = . . . = ,? = 0 i @ vettori si dicono linearmente indipendenti. Se la

combinazione lineare dà il vettore nullo per almeno un ," ≠ 0 i @ vettori si dicono linearmente dipendenti.

Ciò si verifica certamente se uno dei @ vettori è il vettore nullo; infatti la combinazione lineare è senz’altro

verificata, se r è il vettore nullo, con ,r ≠ 0 e tutti gli altri , uguali a zero.

Pag. 24/24