INTELLIGENZA ARTIFICIALE

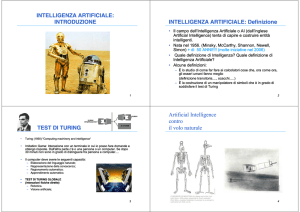

TEST DI TURING

Come potremo certificare che una macchina “pensi”?

La macchina pensa quando agisce in modo

indistinguibile da come agirebbe una mente umana

(approccio operazionale).

Limitiamoci al pensiero non ai movimenti e alle azioni

vere e proprie. Non preoccupiamoci neanche

dell'aspetto.

In altri termini dichiareremo un macchina capace di

pensare se ponendogli una serie di domande

otterremo le stesse risposte che ci aspetteremmo da

un essere umano (questo test è il test di Turing).

[ Questo punto di vista è stato sostenuto dal

matematico Alan Turing nel 1950 in un articolo

intitolato “Computing Machinery and Intelligence”

nella rivista filosofica Mind ]

Alan Turing (1912 -1954)

Come si esegue un Test di Turing?

La macchina sotto esame si nasconde in una stanza con un

essere umano. Dall'esterno un essere umano pone domande

e ottiene risposte che appaiono scritte su un monitor. Se non

riesce a distinguere quale delle due serie di risposte

provengono dalla macchina, la macchina ha superato il Test.

Problema

Supponiamo che macchine in grado di superare il test di

Turing siano state costruite.

Saremo allora certi di poter dire che tali macchine “pensano”,

“comprendono”, “sono coscienti”?

Eppure noi attribuiamo queste qualità ai nostri simili a partire

proprio da una conversazione. In tal senso il test di Turing

acquisisce una notevole forza.

Il cardine della questione mi sembra

“la

coscienza”

Problema 2

Il punto di vista operazionale fornirà davvero un

insieme di criteri ragionevole per giudicare la

presenza o l'assenza di qualità mentali in una

macchina?

Posizione di Roger Penrose:

Se la macchina fosse in grado di rispondere a tutte

le domande rivoltegli, ingannando in modo completo

e costante un sensibile interrogante, allora sarei

propendso a congetturare che la macchina sia

davvero capace di pensare, sentire, ecc...

Roger Penrose (1931)

Fisico matematico che ha

offerto notevoli contributi

nell'ambito della Relatività

Generale e della Tassellazione

del piano.

Il criterio per distinguere una macchina da un essere umano (dalla Quinta

Parte)

Discorso sul Metodo; Descartes

Qui in particolare mi ero fermato per far vedere che se ci fossero macchine

con organi e forma di scimmia o di qualche altro animale privo di ragione, non

avremmo nessun mezzo per accorgerci che non sono in tutto uguali a questi

animali; mentre se ce ne fossero di somiglianti ai nostri corpi e capaci di

imitare le nostre azioni per quanto è di fatto possibile, ci resterebbero sempre

due mezzi sicurissimi per riconoscere che, non per questo, sono uomini veri.

In primo luogo, non potrebbero mai usare parole o altri segni combinandoli

come facciamo noi per comunicare agli altri i nostri pensieri. Perché si può

ben concepire che una macchina sia fatta in modo tale da proferire parole, e

ne proferisca anzi in relazione a movimenti corporei che provochino qualche

cambiamento nei suoi organi; che chieda, ad esempio, che cosa si vuole da

lei se la si tocca in qualche punto, o se si tocca in un altro gridi che le si fa

male e così via; ma non si può immaginare che possa combinarle in modi

diversi per rispondere al senso di tutto quel che si dice in sua presenza, come

possono fare gli uomini, anche i più ottusi.

Link

http://www.turing.org.uk/turing/scrapbook/test.htm

l

http://www.macrovu.com/CCTGeneralInfo.html

INTELLIGENZA ARTIFICIALE FORTE

Nella filosofia della intelligenza artificiale l'intelligenza artificiale forte è

l'idea che opportune forme di intelligenza artificiale possano veramente

ragionare e risolvere problemi;

l'intelligenza artificiale forte sostiene che è possibile per le macchine

diventare sapienti o coscienti di sé, senza necessariamente mostrare

processi di pensiero simili a quelli umani. I

l termine intelligenza artificiale forte (AI forte, in inglese strong AI) fu

originalmente coniato da John Searle, che scrisse:

« According to strong AI, the computer is not merely a tool in the study of

the mind; rather, the appropriately programmed computer really is a

mind »

John Searle

« Secondo l'intelligenza artificiale forte, il computer non sarebbe soltanto,

nello studio della mente, uno strumento; piuttosto, un computer

programmato opportunamente è davvero una mente »

Da Wikipedia

-italiano

See also: philosophy of artificial intelligence and Chinese room

The term "strong AI" was adopted from the name of a position in the philosophy of

artificial intelligence first identified by John Searle as part of his Chinese room

argument in 1980. He wanted to distinguish between two different hypotheses about

artificial intelligence:

An artificial intelligence system can think and have a mind.

An artificial intelligence system can (only) act like it thinks and has a mind.

The first one is called "the strong AI hypothesis" and the second is "the weak AI

hypothesis" because the first one makes the stronger statement: it assumes

something special has happened to the machine that goes beyond all its abilities that

we can test. Searle referred to the "strong AI hypothesis" as "strong AI". This usage,

which is fundamentally different than the subject of this article, is common in academic

AI research and textbooks.

Wikipedia

Inglese

Continua…

The term "strong AI" is now used to describe any artificial intelligence system

that acts like it has a mind, regardless of whether a philosopher would be

able to determine if it actually has a mind or not. Dijkstra has been quoted as

saying, "The question of whether a computer can think is no more interesting

than the question of whether a submarine can swim." As Russell and Norvig

write: "Most AI researchers take the weak AI hypothesis for granted, and don't

care about the strong AI hypothesis."[59] AI researchers are interested in a

related statement (that some sources confusingly call "the strong AI

hypothesis"):

An artificial intelligence system can think (or act like it thinks) as well as or

better than people do.

This assertion, which hinges on the breadth and power of machine

intelligence, is the subject of this article.

Wikipedia

Inglese

Intelligenza Artificiale Forte

L’attività mentale è semplicemente l’esecuzione di qualche sequenza ben definita di

operazioni, cioè l’esecuzione di un algoritmo.

Esempio “algoritmo del termostato”: se la temperatura è maggiore o uguale di quella

voluta interrompe il circuito che attiva il riscaldamento se è inferiore non interrompe il

circuito che attiva il riscaldamento.

L’Attività mentale di un cervello umano dovrebbe essere qualcosa di molto più

complicato dell'algoritmo appena presentato, ma secondo la concezione dell’IA Forte

sarebbe comunque un algoritmo.

La differenza tra un termostato e una mente umana consisterebbe allora solo nella

complicazione molto maggiore dell’algoritmo eseguito dal cervello.

Se esiste un algoritmo di questo genere per il cervello allora in linea di principio lo si

potrebbe far girare in un computer. I sostenitori dell’intelligenza artificiale Forte

direbbero allora che, dovunque l’algoritmo venisse fatto girare, esso sperimenterebbe

sentimenti, avrebbe una coscienza, sarebbe una mente.

La Stanza Cinese di Searle

La questione è: un computer può comprendere una storia? Noi possiamo

raccontargliela, fargli domande a proposito della storia. Domande a cui il

computer, magari, risponderà correttamente. Ma questo significherà che il

computer ha veramente compreso ciò che gli abbiamo detto? (algoritmo di

Schank)

Per dimostrare che non è così, Searle ha ideato il concetto di

“stanza cinese”:

1.le storie devono essere raccontate in cinese;

2. tutte le operazioni dell'algoritmo del computer (che dovrebbe

portare a capire una storia in cinese) vengano fornite come un

insieme di istruzioni in inglese;

3. Searle stesso esegue le istruzioni scritte in inglese per

manipolare i simboli cinesi;

4.Le sequenze di simboli che rappresentano la storia e, poi, le

domande, sono introdotte nella stanza attraverso una piccola

fessura e anche le risposte passano attraverso la fessura (e sono

del tipo sì o no);

Searle precisa di non sapere una sola

parola di cinese, quindi non comprende

una parola del significato delle storie.

Eppure eseguendo correttamente le

operazioni indicate sul manuale di

istruzione risponderebbe correttamente

alle domande sulla storia!

CONCLUSIONE di Serale:

La semplice esecuzione di un algoritmo

NON implica che ci sia stata

comprensione.

E se, nell’esperimento della stanza cinese, sostituissimo Searle

con l’intera popolazione dell’India?

Certamente i singoli indiani non capirebbero la storia. Ma non vi

viene da pensare che i singoli indiani assomiglierebbero ai

singoli neuroni del cervello?

E i singoli neuroni del cervello non capiscono la storia cinese

esattamente come non la capiscono gli indiani. Perché allora

dovremmo attenderci che gli indiani la capiscano

Hardware, Software e macchine universali.

Hardware: dispositivi fisici e materiali che costituiscono un

computer

Software: programmi che possono essere fatti girare sul computer

Fu una grande scoperta di Alan Turing l’aver notato che una

macchina il cui software abbia superato un certo livello di

complicazione sia equivalente a una qualsiasi altra macchina

analoga.

L’equivalenza tra macchine va intesa nel senso che se abbiamo

due macchine A e B, è possibile dotare la macchina A di un

software che la faccia agire esattamente come agirebbe la

macchina B (e viceversa). [macchine di questo genere, in grado

di emulare qualsiasi altra macchina, sono dette macchine

universali]

Per l’I.A. Forte allora:

L’algoritmo che simula la mente sarebbe una mente cosciente.

L’hardware su cui si fa girare l’algoritmo che simula la mente non è

rilevante (in base all’equivalenza di Turing tra macchine

universali).

In un certo senso le idee di Turing sulle macchine universali danno

forza e sostengono l’approccio forte all’intelligenza artificiale,

spostando il peso e l’importanza sull’algoritmo piuttosto che

sulla macchina fisica (hardware).

Teletrasporto.

1)

Cervello dato da configurazione delle particelle che lo

compongono. La configurazione determina lo stato mentale

(nella configurazione sta l’informazione della individualità di un

cervello)

2)

Se riesco a creare una copia perfetta della configurazione

(stesse particelle negli stessi stati) ho ricreato lo stesso

cervello magari in una posizione diversa.

3)

Distruggo l’originale e la ‘copia’ dovrebbe essere

indistinguibile dall’orignale (cioè abbiamo teletrasportato

anche la coscienza).