DISTRIBUZIONI DI PROBABILITÀ

1.

PARTICOLARI DISTRIBUZIONI DI PROBABILITA’

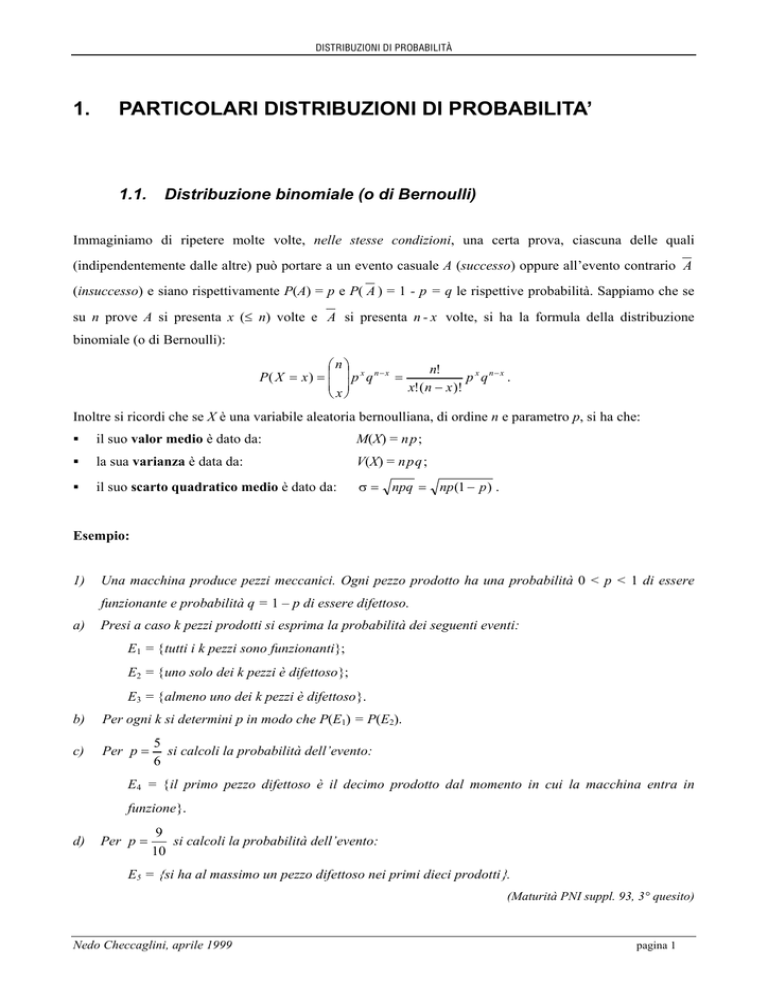

1.1.

Distribuzione binomiale (o di Bernoulli)

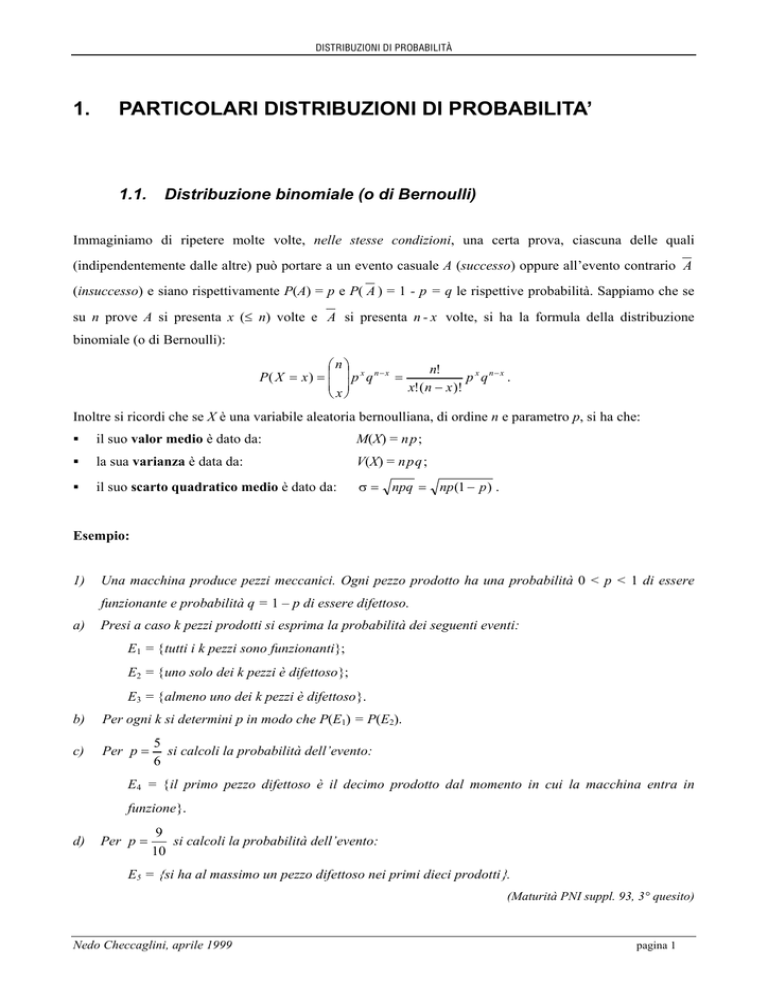

Immaginiamo di ripetere molte volte, nelle stesse condizioni, una certa prova, ciascuna delle quali

(indipendentemente dalle altre) può portare a un evento casuale A (successo) oppure all’evento contrario A

(insuccesso) e siano rispettivamente P(A) = p e P( A ) = 1 - p = q le rispettive probabilità. Sappiamo che se

su n prove A si presenta x (≤ n) volte e A si presenta n - x volte, si ha la formula della distribuzione

binomiale (o di Bernoulli):

⎛n⎞

n!

P( X = x ) = ⎜ ⎟ p x q n − x =

p x q n− x .

⎜ ⎟

!

(

)!

x

n

x

−

⎝ x⎠

Inoltre si ricordi che se X è una variabile aleatoria bernoulliana, di ordine n e parametro p, si ha che:

il suo valor medio è dato da:

M(X) = np ;

la sua varianza è data da:

V(X) = npq ;

il suo scarto quadratico medio è dato da:

σ = npq = np (1 − p ) .

Esempio:

1)

Una macchina produce pezzi meccanici. Ogni pezzo prodotto ha una probabilità 0 < p < 1 di essere

funzionante e probabilità q = 1 – p di essere difettoso.

a)

Presi a caso k pezzi prodotti si esprima la probabilità dei seguenti eventi:

E1 = {tutti i k pezzi sono funzionanti};

E2 = {uno solo dei k pezzi è difettoso};

E3 = {almeno uno dei k pezzi è difettoso}.

b)

Per ogni k si determini p in modo che P(E1) = P(E2).

c)

Per p =

5

si calcoli la probabilità dell’evento:

6

E4 = {il primo pezzo difettoso è il decimo prodotto dal momento in cui la macchina entra in

funzione}.

d)

Per p =

9

si calcoli la probabilità dell’evento:

10

E5 = {si ha al massimo un pezzo difettoso nei primi dieci prodotti}.

(Maturità PNI suppl. 93, 3° quesito)

Nedo Checcaglini, aprile 1999

pagina 1

DISTRIBUZIONI DI PROBABILITÀ

Poiché gli esiti delle varie estrazioni sono indipendenti e poiché si può supporre che il numero dei pezzi

prodotti sia grande rispetto a quelli estratti, il problema può essere considerato come una successione di n

prove bernoulliane, cioè con due sole possibilità per ogni prova:

«successo» = estrazione di un pezzo funzionante e «insuccesso» = estrazione di un pezzo non funzionante.

Si ha allora, usando la formula di distribuzione bernoulliana:

a)

⎛k ⎞

P(E1) = ⎜ ⎟ p k q 0 = p k

⎜ ⎟

⎝k ⎠

⎛ k ⎞ k −1 1

⎟ p q = k ⋅ p k −1 (1 − p )

P(E2) = ⎜

⎟

⎜

⎝ k − 1⎠

P(E3) = 1 _ P(E1) = 1 _ pk.

k

.

1+ k

b)

P(E1) = P(E2) ⇒ p k = k ⋅ p k −1 (1 − p ) = .... = p(1 + k ) = k ⇒ p =

c)

5

1

⎛5⎞ 1

e q = ⇒ P(E4) = ⎜ ⎟ ⋅ .

P(E4) = p ·q = p ·(1 - p) ⇒ per p =

6

6

⎝6⎠ 6

d)

Si avranno o zero pezzi difettosi o un pezzo difettoso nei primi dieci ⇒ P(E1) ∪ P(E2) con k=10 e

9

9

9

10

9

9

9

⎛ 9⎞

⎛ 9⎞ ⎛ 1⎞ ⎛9⎞ ⎛ 9

⎞ ⎛ 9 ⎞ ⎛ 19 ⎞

p=9/10 ⇒ p k + k ⋅ p k −1 (1 − p ) = ⎜ ⎟ + 10 ⋅ ⎜ ⎟ ⋅ ⎜ ⎟ = ⎜ ⎟ ⎜ + 1⎟ = ⎜ ⎟ ⋅ ⎜ ⎟ .

⎝ 10 ⎠

⎝ 10 ⎠ ⎝ 10 ⎠ ⎝ 10 ⎠ ⎝ 10 ⎠ ⎝ 10 ⎠ ⎝ 10 ⎠

1.2.

Distribuzione geometrica

Si indichi ancora con A l'evento successo e con A l'evento contrario (insuccesso), con P(A) = p e P( A ) = 1 -

p = q; il numero delle prove necessarie affinché si verifichi per la prima volta il "successo" è una variabile

aleatoria X (detta "tempo di attesa dell'evento").

Si ha allora la legge di distribuzione geometrica P ( X = x ) = p q x -1, in quanto l'evento X = x è dato

dall'intersezione dei due eventi indipendenti:

E1: nelle prime x - 1 prove si ottengono 0 successi;

E2: all' x-esima prova si ha un successo.

Si ha infatti allora: P ( X = x ) = p(E1∩E2 ) = p(E1).p(E2) = p q x -1 dove la variabile aleatoria di legge

geometrica indica il numero delle prove necessarie per ottenere il primo successo.

Per la legge geometrica il rapporto tra la probabilità dell’evento X = x + 1 e dell’evento X = x è costante e

pari a q.

Infatti:

Nedo Checcaglini, aprile 1999

pagina 2

DISTRIBUZIONI DI PROBABILITÀ

P ( X = x + 1)

p ⋅qx

=

= q ; questo è il motivo per cui la legge si chiama geometrica.

P( X = x)

p ⋅ q x −1

Essendo q<1 le probabilità sono sempre decrescenti, cioè: P(X = x + 1) < P(X = x).

Inoltre, se X è una variabile aleatoria geometrica, si ha che:

il suo valor medio è dato da:

M(X) = 1/p ;

la sua varianza è data da:

V(X) = q/p 2 ;

Esempi:

1)

Un’urna contiene 8 palline, di cui due bianche e le altre nere. Si effettuano ripetute estrazioni con

rimessa. Scrivere la variabile aleatoria “numero delle prove necessarie affinché si verifichi per la prima

volta l’evento pallina bianca”. Calcolare inoltre il numero medio delle estrazioni affinché esca per la prima

volta una pallina bianca.

La probabilità di estrarre una pallina bianca è: p = 1/4 = 0,25.

La probabilità di ottenere una pallina bianca per la prima volta alla prima estrazione, o alla seconda, o alla

terza … , sarà:

2

⎧1

X =⎨

⎩1/4 1/4 ⋅ 3/4

3

4

5

......

1/4 ⋅ (3/4) 2 1/4 ⋅ (3/4) 3 1/4 ⋅ (3/4) 4

.

Essendo la probabilità di estrazione pallina bianca p=0,25=1/4, ci si aspetta una pallina bianca una volta su

quattro estrazioni e quindi che il numeri medio delle estrazioni da fare per ottenere la prima pallina bianca

sia 4.

Analogamente applicando la formula della speranza matematica: M(X) = 1/p = 1/(1/4) = 4.

2) In una successione di prove bernoulliane, con probabilità p di successo in ogni prova, è

possibile fissare il numero N delle prove e studiare la probabilità condizionata del numero di

successi K, che indichiamo con P(K=k / N=n). E' anche possibile fissare il numero K di successi

che si desidera ottenere e studiare la probabilità condizionata del numero N di prove necessarie

per ottenerli, che indichiamo con P(N=n / K=k).

Il candidato:

a) fornisca la formula generale per il calcolo di P(K=k / N=n) (distribuzione binomiale);

b) fornisca la formula generale per il calcolo di P(N=n / K=k):

c) verifichi che, comunque fissati N e K, risulta sempre P(N=n / K=k)≤ P(K=k / N=n) e

fornisca una giustificazione di ciò. (maturità suppl PNI 98, quesito 3)

Nedo Checcaglini, aprile 1999

pagina 3

DISTRIBUZIONI DI PROBABILITÀ

a)

Sappiamo che effettuando n prove identiche ed indipendenti, in ciascuna delle quali si realizza

l'evento A (successo) o il suo contrario A (insuccesso), con P(A) = p e P( A ) = 1 - p = q, il numero K=k

delle volte che si presenta l'evento A nelle n prove è una variabile aleatoria di legge binomiale caratterizzata

dai parametri n e p.

Fissati n e p si ha perciò la legge di distribuzione binomiale:

n!

⎛n⎞

p k q n −k .

P(K = k / N = n ) = ⎜ ⎟ p k q n −k =

k! ( n − k )!

⎝k⎠

b)

Si indichi ancora con A l'evento successo e con A l'evento contrario (insuccesso), con P(A) = p e

P( A ) = 1 - p = q; il numero delle prove necessarie affinché si verifichi per la prima volta il "successo" è una

variabile aleatoria X (detta "tempo di attesa dell'evento") e si ha allora la legge di distribuzione geometrica

P ( X = x ) = p q x -1.

Indichiamo ora con N il numero delle prove necessarie per ottenere k successi. La variabile aleatoria N=n

rappresenta il "tempo di attesa" del k-esimo successo. Essa può assumere i valori : k, k+1, k+2 … in quanto

sono necessarie almeno k prove; si avrà allora la distribuzione di Pascal (di norma non riportata nei testi

liceali) la cui variabile aleatoria può essere considerata come la somma di k variabili indipendenti di legge

geometrica P ( X = x ) = p q x -1.

Calcoliamo allora la probabilità dell'evento N = n .

L'evento N = n è dato dall'intersezione dei due eventi indipendenti:

E1: nelle prime n - 1 prove si ottengono k - 1 successi;

E2: all' n-esima prova si ha un successo.

Le probabilità dei due eventi sono:

⎛ n −1 ⎞

⎛ n −1 ⎞

p( E1 ) = ⎜ ⎟ p k −1 q n −1−( k −1) = ⎜ ⎟ p k −1 q n −k

⎝ k −1 ⎠

⎝ k −1 ⎠

p(E2) = p

⎛ n −1 ⎞

⎛ n −1 ⎞

Si ha allora: P(N=n/K=k)=p(E1∩E2)=p(E1).p(E2) = ⎜ ⎟ p k −1 q n −k ⋅ p = ⎜ ⎟ p k q n −k che è nota anche come

⎝ k −1 ⎠

⎝ k −1 ⎠

legge di Pascal.

c)

⎛ n −1 ⎞

Si deve verificare che: ⎜ ⎟ p k q n − k

⎝ k −1 ⎠

disequazione

si

riduce

a:

⎛n⎞

≤ ⎜ ⎟ p k q n −k . Infatti, semplificando per p k q n -k≠ 0 la

⎝k⎠

⎛ n −1 ⎞ ⎛ n ⎞

⎜ ⎟ ≤⎜ ⎟

⎝ k −1 ⎠ ⎝ k ⎠

⇒

( n − 1)!

n!

≤

( k − 1)! ( n − k )! k! ( n − k )!

⇒

n

( n − 1)!

n ( n − 1)!

⇒ 1 ≤ che è sempre vero in quanto ovviamente n (numero delle prove)

≤

k

( k − 1)! ( n − k )! k ( k − 1)! ( n − k )!

≥ k (numero dei successi).

Nedo Checcaglini, aprile 1999

pagina 4

DISTRIBUZIONI DI PROBABILITÀ

1.3.

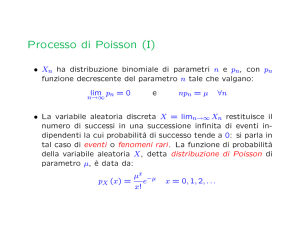

Distribuzione di Poisson

La distribuzione di Poisson (o degli “eventi rari”) si applica quando n (numero di prove) è grande e p

(probabilità) è molto piccola e sempre con specifico riferimento ad un prefissato periodo di tempo t (o di

spazio). Indicato con N(t) il n° degli intervalli di tempo considerati, con α la possibilità di un successo

nell’unità di tempo t, con n il numero di “successi” (o arrivi) simultanei nell’intervallo t, si ha la formula:

f ( α ,t ) ( n ) = P ( N ( t ) = n ) =

( αt ) −( αt )

.

e

n!

n

In questa formula α rappresenta il n° medio di arrivi nell’unità di tempo e dipende esclusivamente dal

particolare fenomeno preso in esame.

Se t = 1 la formula si scrive:

P( X = x ) =

λ −λ

e

x!

x

con αt = λ (che è la formula più usata e presente in tutti i libri di testo).

Questa distribuzione si presenta in molti fenomeni naturali, come il il numero di chiamate telefoniche al

minuto di un centralino, il numero di errori di stampa per pagina di un testo voluminoso e il numero di

particelle α emesse da una sostanza radioattiva.

Si dimostra il seguente

Teorema. Il limite, per n → +∞, di una distribuzione bernoulliana, di parametro p, è una distribuzione di

Poisson, di parametro λ = np.

Conseguentemente si ricordi che se X è una variabile casuale di Poisson, di parametro λ:

il suo valor medio è dato da:

M(X) = λ;

la sua varianza è data da:

V(X) = λ;

il suo scarto quadratico medio è dato da:

σ= λ .

Esempi:

1)

Al servizio di soccorso stradale di una certa città, aperto 24 ore su 24, arrivano in media 48 chiamate

al giorno, due in media all’ora, secondo una distribuzione di POISSON.

Il candidato:

a)

Calcoli la probabilità che nella prima ora arrivino almeno 2 chiamate;

b)

calcoli la probabilità che il tempo di attesa fino alla prima chiamata di un certo giorno sia di

almeno 1 ora;

c)

tenendo presente che il 45% delle chiamate è effettuato da donne che nel 90% dei casi richiedono

l’intervento di carri attrezzi, mentre tale intervento è richiesto dagli uomini nel 75% dei casi,

Nedo Checcaglini, aprile 1999

pagina 5

DISTRIBUZIONI DI PROBABILITÀ

determini, se si registra una richiesta di intervento di carri attrezzi, qual è la probabilità che la

richiesta sia stata effettuata da un uomo;

d)

calcoli qual è il numero medio di richieste di carro attrezzi per ora.

(Maturità PNI suppl. 96, 3° quesito)

Come già detto per t = 1 la formula di Poisson si scrive nella forma più usata: P ( X = x ) =

λ −λ

con αt =

e

x!

x

λ. (Si ricordi anche np= λ). Nel nostro caso α = 48/24= 2 .

a)

Poiché: P ( X = x ) =

( αt ) −( αt )

e

n!

n

⎡ ( 2 ⋅ 1) 0 −( 2⋅1) ( 2 ⋅ 1) 1 −( 2⋅1) ⎤

+

P ( X ≥ 2) = 1 − [P ( X = 0) + P ( X = 1)] = 1 − ⎢

e

e

⎥=

1!

⎣ 0!

⎦

P ( X ≥ 2) = 1 − ( e −2 + 2

b)

e −2 ) = 1 − 3 ⋅ (0,13534) = 0,59398

Se il tempo di attesa fino alla prima chiamata è di almeno 1 ora, allora nella prima ora, o nelle prime

due ore, o nelle prime tre ore, .........., o nelle prime 23 ore bisogna calcolare la probabilità che vi siano 0

telefonate.

t=1

⎡ ( 2 ⋅ 1) 0 −( 2⋅1) ⎤

−2

P ( X = 0) = ⎢

e

⎥ = e = 0,1353 ;

0

!

⎣

⎦

t=2

⎡ ( 2 ⋅ 2 ) 0 − ( 2⋅ 2 ) ⎤

−4

P ( X = 0) = ⎢

e

⎥ = e = 0,0183

0

!

⎣

⎦

t=3

⎡ ( 2 ⋅ 3) 0 −( 2⋅3) ⎤

−6

P ( X = 0) = ⎢

e

⎥ = e = 0,0024 ;

0

!

⎣

⎦

t=4

⎡ ( 2 ⋅ 4 ) 0 − ( 2⋅ 4 ) ⎤

−8

P ( X = 0) = ⎢

e

⎥ = e = 0,0003

0

!

⎣

⎦

⎡ ( 2 ⋅ 23) 0 −( 2⋅23) ⎤

− 46

P ( X = 0) = ⎢

e

⎥=e

0

!

⎣

⎦

Ptot = e −2 (1 + e −2 + e −4 +......+ e −44 )

t= ….

t=23

⇒

(si osservi che i termini superiori al quarto sono sicuramente trascurabili)

Nedo Checcaglini, aprile 1999

pagina 6

DISTRIBUZIONI DI PROBABILITÀ

c)

Si avrà:

P( S ) = P( M ) ⋅ P( S / M ) + P( F ) ⋅ P( S / F )

P(S/F)=90%

P ( S ) = 45% ⋅ 90% + 55% ⋅ 75% = 0,405 + 0,8175

P ( S ) = 0,405 + 0,8175 = 0,8175 = 81,75%

con :

P(S) = Richiesta di carro attrezzi.

P(F)=45%

P(F) = Probabilità chiamata effettuata da donna.

P(N/F)=10%

P(M) = Probabilità chiamata effettuata da uomo.

P(N/F) = Probabilità di telefonata di non richiesta di

P(S/M)=75%

carro attrezzi da parte di donna.

P(N/M) = Probabilità di telefonata di non richiesta di

carro attrezzi da parte di uomo.

P(M)=55%

P(S/F) = Probabilità di telefonata di richiesta di carro

attrezzi da parte di donna.

P(N/M)=25%

P(S/M) = Probabilità di telefonata di richiesta di carro

attrezzi da parte di uomo.

P(M/S) = Probabilità di telefonata effettuata da uomo,

se è stato richiesto il carro attrezzi.

Applicando la formula di Bayes:

P( M / S ) =

d)

P( M ) ⋅ P( S / M )

55% ⋅ 75%

0,4125

=

=

= 0,5046 = 50,46% =

P( S )

55% ⋅ 75% + 45% ⋅ 90% 0,4125 + 0,405

Le richieste di carro attrezzi sono lo 0,8175 delle chiamate totali ⇒ 48⋅81,75%=39,24 chiamate al

giorno (per carro attrezzi).

Il n° medio di richieste di carro attrezzi per ora, sarà: 39,24/24 = 1,635.

OSSERVAZIONE.

Quasi tutti i testi e riviste riportano una soluzione diversa del punto b), ed esattamente:

⎡ 2 0 −2 ⎤

P ( X = 0) = ⎢

e ⎥ = e − 2 = 0,1353 con λ = 2, giustificando che la richiesta fatta voglia dire “il tempo

⎣ 0!

⎦

di attesa fino alla prima chiamata di un certo giorno sia di 1 ora”;

Ci permettiamo di dissentire da tale risposta anche se, forse, tale era lo spirito di chi ha formulato il

tema di maturità, in considerazione anche del fatto che la formula della distribuzione di Poisson

riportata per prima è raramente presente nei libri di testo liceali.

Nedo Checcaglini, aprile 1999

pagina 7

DISTRIBUZIONI DI PROBABILITÀ

2)

La distribuzione di Poisson descrive molto bene il conteggio delle disintegrazioni in un campione di

nuclidi radioattivi se il campione è sufficientemente numeroso.

Un campione radioattivo contenga 2 ⋅ 1010 nuclidi ciascuno dei quali ha probabilità p = 10 −10 di decadere

in un secondo.

Calcolare:

a)

il numero medio di decadimenti in un secondo;

b)

le probabilità di osservare 0, 1, 2, 3 e 4 decadimenti in un secondo;

c)

la probabilità di osservare più di 4 decadimenti in un secondo.

(Maturità scientifica PNI suppl. 97, 3° quesito)

Si ricordi che np= λ; nel nostro caso λ = 2 ⋅ 1010 ⋅ 10 −10 = 2 .

a)

Poiché M(x) = λ ⇒ M(x) = 2.

b)

Si ha:

⎡ 2 0 −2 ⎤

P ( X = 0) = ⎢

e ⎥ = e −2

⎣ 0!

⎦

⎡21

⎤

P ( X = 1) = ⎢ e − 2 ⎥ = 2 ⋅ e − 2

⎣1!

⎦

⎡ 22

⎤

P ( X = 2) = ⎢ e − 2 ⎥ = 2 ⋅ e − 2

⎣ 2!

⎦

⎡ 23

⎤ 8

P( X = 3) = ⎢ e − 2 ⎥ = ⋅ e − 2

⎣ 3!

⎦ 6

⎡ 24

⎤ 16 −2

P ( X = 4) = ⎢ e − 2 ⎥ =

⋅e

⎣ 4!

⎦ 24

c)

Si avrà:

P( X ≥ 4) = 1 − [P ( X = 0) + P( X = 1) + P ( X = 2) + P( X = 3) + P ( X = 4)] =

1

2

3

4

⎡20

2

2 −2 2 −2 2 −4 ⎤

= 1 − ⎢ e −2 + e −2 +

e +

e +

e ⎥=

1!

2!

3!

4!

⎣ 0!

⎦

4 2⎞

⎛

= 1 − e − 2 ⎜1 + 2 + 2 + + ⎟ = 1 − 7 ⋅ e − 2

3 3⎠

⎝

OSSERVAZIONE:

Si ricordi che:

Nedo Checcaglini, aprile 1999

e = 2,718;

e −2 =

1

1

=

= 0,135.

2

7,389

e

pagina 8