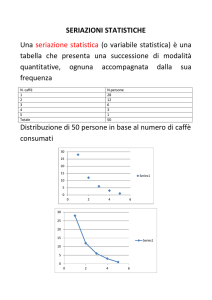

STATISTICA BIVARIATA: ALCUNI STIMOLI DI APPROFONDIMENTO

(Tecn. Lab. Biomedico e Tecn. Fisiop. e Perfus. Cardiovascolare 3°Anno)

1) ASSOCIAZIONE TRA DUE CARATTERI – RISCHIO RELATIVO E ODDS RATIO

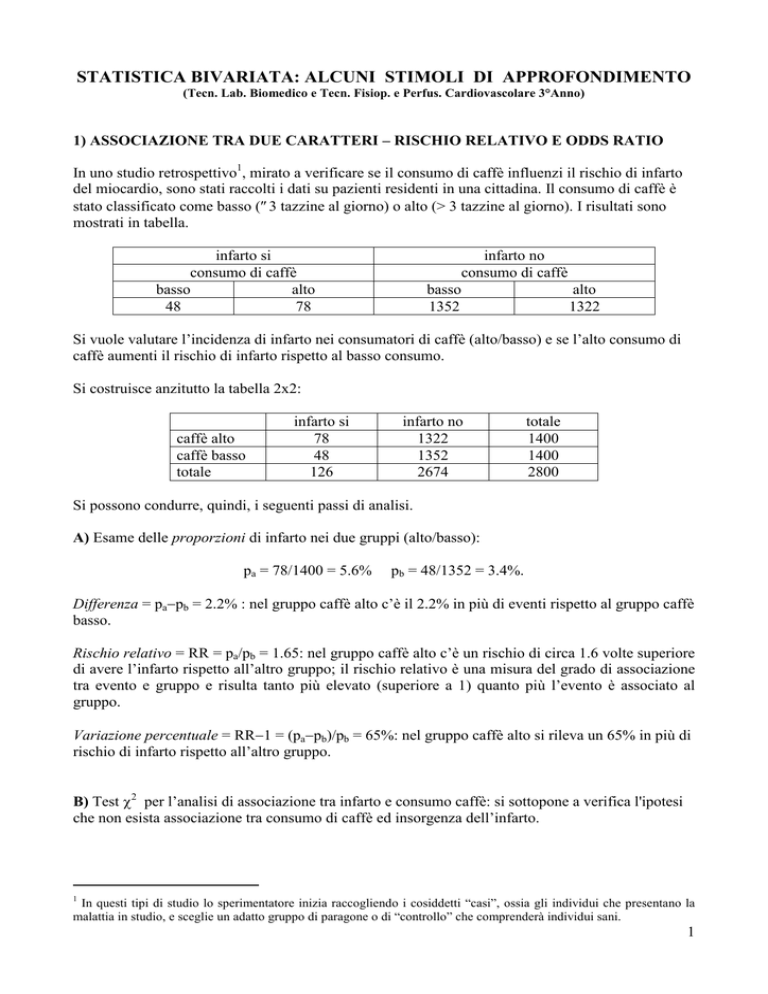

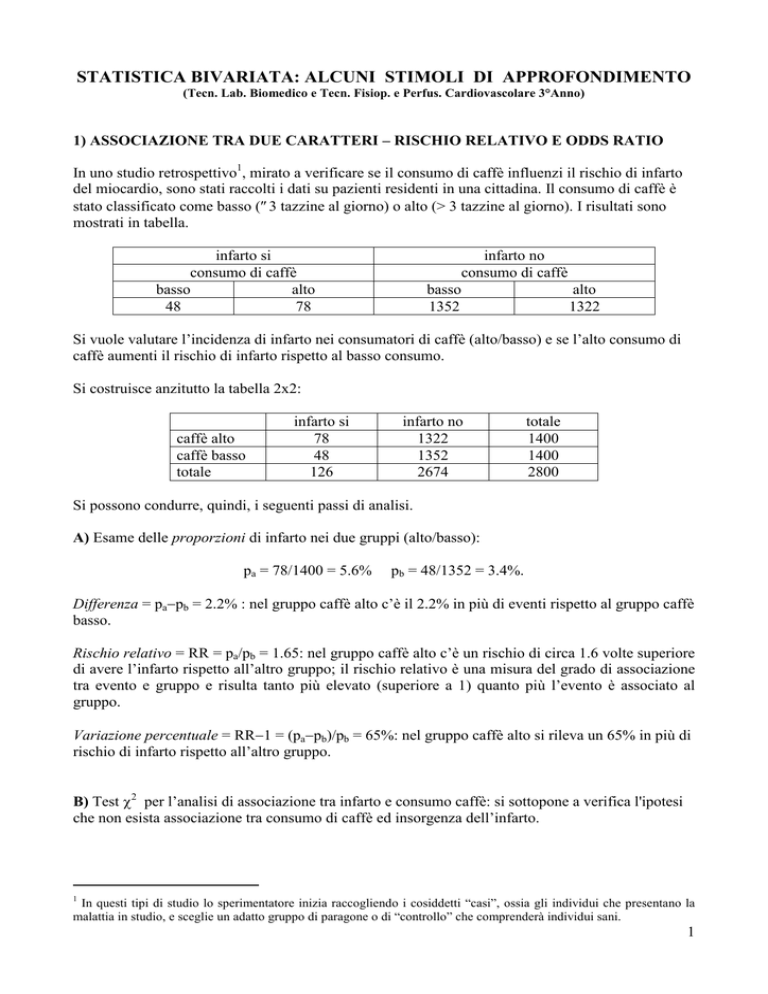

In uno studio retrospettivo1, mirato a verificare se il consumo di caffè influenzi il rischio di infarto

del miocardio, sono stati raccolti i dati su pazienti residenti in una cittadina. Il consumo di caffè è

stato classificato come basso (≤3 tazzine al giorno) o alto (> 3 tazzine al giorno). I risultati sono

mostrati in tabella.

infarto si

consumo di caffè

basso

alto

48

78

infarto no

consumo di caffè

basso

alto

1352

1322

Si vuole valutare l’incidenza di infarto nei consumatori di caffè (alto/basso) e se l’alto consumo di

caffè aumenti il rischio di infarto rispetto al basso consumo.

Si costruisce anzitutto la tabella 2x2:

caffè alto

caffè basso

totale

infarto si

78

48

126

infarto no

1322

1352

2674

totale

1400

1400

2800

Si possono condurre, quindi, i seguenti passi di analisi.

A) Esame delle proporzioni di infarto nei due gruppi (alto/basso):

pa = 78/1400 = 5.6%

pb = 48/1352 = 3.4%.

Differenza = pa−pb = 2.2% : nel gruppo caffè alto c’è il 2.2% in più di eventi rispetto al gruppo caffè

basso.

Rischio relativo = RR = pa/pb = 1.65: nel gruppo caffè alto c’è un rischio di circa 1.6 volte superiore

di avere l’infarto rispetto all’altro gruppo; il rischio relativo è una misura del grado di associazione

tra evento e gruppo e risulta tanto più elevato (superiore a 1) quanto più l’evento è associato al

gruppo.

Variazione percentuale = RR−1 = (pa−pb)/pb = 65%: nel gruppo caffè alto si rileva un 65% in più di

rischio di infarto rispetto all’altro gruppo.

B) Test χ2 per l’analisi di associazione tra infarto e consumo caffè: si sottopone a verifica l'ipotesi

che non esista associazione tra consumo di caffè ed insorgenza dell’infarto.

1

In questi tipi di studio lo sperimentatore inizia raccogliendo i cosiddetti “casi”, ossia gli individui che presentano la

malattia in studio, e sceglie un adatto gruppo di paragone o di “controllo” che comprenderà individui sani.

1

H0: non esiste associazione (la proporzione di persone che si sono ammalate nel gruppo caffè alto è

uguale alla proporzione di coloro che si sono ammalati nel gruppo caffè basso).

H1: esiste un'associazione (la proporzione di persone che si sono ammalate nel gruppo caffè alto è

diverso da quella di coloro che si sono ammalati nell’altro gruppo).

La tabella delle frequenze teoriche è la seguente:

caffè alto

caffè basso

totale

infarto si

63

63

126

infarto no

1337

1337

2674

totale

1400

1400

2800

Si ottiene:

χ2 = (78−63)2/63 + (1322−1337)2/1337 + (48−63)2/63 + (1352−1337)2/1337 = 7.48

p-value = 0.006 <0.01.

Si rifiuta allora l’ipotesi H0 che le proporzioni di persone che hanno avuto l’infarto sono uguali nei

due gruppi caffè alto e caffè basso e si è portati a concludere per un’associazione statisticamente significativa tra infarto e consumo di caffè.

C) Odds Ratio

Considerato un evento di probabilità p, l’Odds dell’evento è definito dalla quantità:

Odds = p/(1−p).

Nel caso di tabelle 2x2:

evento si

a

c

a+c

gruppo 1

gruppo 2

totale

evento no

b

d

b+d

totale

a+b

c+d

n

si definisce l’Odds Ratio come:

OR =

p1 (1 − p1 ) p1 (1 − p 2 ) ad

=

=

.

p 2 (1 − p 2 ) p 2 (1 − p1 ) bc

Poiché il rischio relativo RR è dato da:

P robab(even to nel gruppo 1) a (a + b)

=

P robab(even to nel gruppo 2) c (c + d

Risulta (nel caso di evento raro):

RR =

OR =

a b ad Probab(eve nto nel gruppo 1)

=

≈

.

c d bc Probab(eve nto nel gruppo 2)

2

L’OR è una misura di associazione tra caratteri qualitativi dicotomici e si usa negli studi retrospettivi (caso-controllo) per una stima del rischio di evento tra due gruppi. Così, in situazioni reali, si è

spesso in presenza di un evento (ad es. malattia) e di un fattore di rischio (o un trattamento) dicotomizzato in gruppi e si intende misurare il rischio di evento di uno dei due gruppi rispetto all’altro.

Una valore dell’OR maggiore di 1 indica un aumento di rischio, un valore vicino a 1 si riferisce a

nessuna differenza, mentre per un valore inferiore a 1 c’è diminuzione di rischio. Si può determinare anche l’intervallo di confidenza (IC) per l’OR (ad es. al livello di confidenza del 95%), partendo

1 1 1 1

+ + + . Calcolate le quantità2:

dal fatto che il suo errore standard è dato da: SE(ln(OR)) =

a b c d

inf = ln(OR)−1.96⋅SE(ln(OR)) e sup = ln(OR)+1.96⋅SE(ln(OR)),

l’estremo inferiore e quello superiore dell’intervallo di confidenza sono dati da:

estremo inferiore IC 95% = exp(inf) e estremo superiore IC 95% = exp(sup)

Nel problema inizialmente posto:

caffè alto

caffè basso

totale

infarto si

78

48

126

infarto no

1322

1352

2674

totale

1400

1400

2800

OR = (78⋅1352)/(48⋅1322) = 1.66.

E si determina, poi, l’intervallo di confidenza al 95%:

ln(OR)=ln(1.66)=0.508

SE(ln(OR))= 1 / 78 + 1 / 1322 + 1 / 48 + 1 / 1352 = 0.187

inf = ln(OR)−1.96⋅SE(ln(OR)=0.508−1.96⋅0.187=0.140

sup = ln(OR)+1.96⋅SE(ln(=R)=0.508+1.96⋅0.187=0.875

estremo inferiore IC = exp(inf) = exp(0.140)=1.15

estremo superiore IC = exp(sup) = exp(0.875)=2.40

OR=1.66,

IC 95%: [1.15; 2.40].

Pertanto il consumo di caffè risulta associato con il rischio di sviluppare infarto del miocardio;

l’OR=1.66 indica che chi fa un alto consumo di caffè ha un rischio 1.66 volte più alto di avere

l’infarto rispetto a chi fa un basso consumo di caffè. L’intervallo di confidenza [1.15; 2.40] non

contiene l’unità e quindi, anche con l’analisi dell’OR, si può dire che l’associazione risulta statisticamente significativa.

2

Il simbolo ln che compare nelle formule indica il logaritmo in base il numero di Nepero.

3

2) ASSOCIAZIONE TRA DUE CARATTERI – FATTORI CONFONDENTI

Quando si analizza la relazione tra un fattore di esposizione (o un trattamento) ed una malattia, un

fattore confondente è un terzo carattere che è indipendentemente associato all’esposizione ed è anche un fattore di rischio per la malattia.

La presenza di un fattore confondente può alterare l’associazione osservata tra esposizione ed evento. Ad esempio, nel caso del problema analizzato in 1), si supponga che il ricercatore abbia stratificato i soggetti in fumatori e non fumatori, ottenendo i seguenti risultati:

fumatori

non fumatori

infarto si

consumo caffè

basso

alto

28

70

20

8

infarto no

consumo caffè

basso

alto

372

930

980

392

Calcolando l’incidenza di infarto e l’OR nei i 2 gruppi (fumatori e non) per valutare l’impatto

dell’alto consumo di caffè sul rischio di infarto, si ottiene:

fumatori

caffè alto

caffè basso

totale

infarto si

70

28

98

infarto no

930

372

1302

totale

1000

400

1400

incidenza infarto = 98/1400 = 7%

ORF = 1

IC 95%: [0.63; 1.58]

non fumatori

caffè alto

caffè basso

totale

infarto si

8

20

28

infarto no

392

980

1372

totale

400

1000

1400

incidenza infarto = 28/1400 = 2%

ORNF = 1

IC 95%: [0.43; 2.29]

Pertanto, il fumo è un fattore confondente per l’infarto in relazione al consumo di caffè: chi fuma

tende anche a bere più caffè di chi non fuma e il fumo è un fattore di rischio per l’infarto. Il caffè

non ha influenza sull’infarto e l’associazione che si osserva è solo dovuta al confondimento del fumo. Tale conclusione viene rafforzata attraverso l’analisi di associazione tra infarto e fumo:

fumatori

non fumatori

totale

infarto si

98

28

126

infarto no

1302

1372

2674

totale

1400

1400

2800

χ2 = 40.7 p=1.7⋅10-10

(altamente significativo)

OR = 3.69

IC 95%: [2.41; 5.65].

4

3) SIGNIFICATIVITÀ DELLA RETTA DI REGRESSIONE

Esempio 1

In tabella sono riportati i valori assunti dai due caratteri quantitativi età (ETÀ) e pressione sistolica

(PAS) misurati in un campione di 8 soggetti:

soggetto

1

2

3

4

5

6

7

8

ETÀ (anni)

22

28

35

47

51

56

67

81

PAS (mmHg)

131

114

121

111

130

145

176

217

La semplice rappresentazione grafica dei valori osservati e della retta di regressione fornisce alcune

indicazioni importanti per l'interpretazione delle relazioni esistenti tra i due caratteri PAS (variabile

Y) ed ETÀ (variabile X).

I parametri a e b della retta di regressione

Y = b⋅X + a

si stimano attraverso il principio dei minimi

quadrati e risulta:

b=

CODEV(X, Y)

DEV(X)

e

a = y − b⋅x ,

n

DEV(X)= ∑ (x i − x ) 2

i =1

n

CODEV(X,Y) = ∑ (x i − x )(y i − y) .

i =1

Pertanto:

b= 1.54 e a = 68.75

Interpretando i valori dei coefficienti della retta di regressione si può dire:

•

l’aumento medio della pressione è di circa b=1.5 mmHg per l’aumento di un anno di età.

•

alla nascita il valore della pressione sarebbe (!) di a=68.75 mmHg, ma questa è una indicazione

teorica perché non è possibile stimare il valore della pressione arteriosa per età fuori del range

considerato (22 81 aa).

÷

Il valore del coefficiente di regressione b indica di quanto aumenta in media la variabile dipendente

Y all'aumento di una unità della variabile indipendente X.

Con il metodo dei minimi quadrati è sempre possibile ottenere la retta che meglio si adatta ai dati

rilevati, indipendentemente dalla dispersione dei punti intorno alla retta. Tuttavia il semplice calcolo

della retta non è affatto sufficiente ai fini dell’analisi statistica.

5

La retta potrebbe indicare:

•

•

una relazione reale tra le due variabili, se il valore di b è alto e la dispersione dei punti intorno

alla retta è ridotta;

relazione casuale o non significativa, quando la dispersione dei punti intorno alla retta è aprossimativamente uguale a quella intorno alla media.

La figura che segue esprime alcune situazioni di dipendenza o meno.

Il coefficiente b della retta di regressione, che determina appunto la quantità di variazione di Y per

ogni unità aggiuntiva di X, è calcolato da osservazioni sperimentali. Ciò che tuttavia interessa al ricercatore è la relazione esistente nella popolazione, e sebbene il valore di b sia differente da zero,

non è detto che nella popolazione al variare di X si abbia una variazione di Y.

La significatività del coefficiente di regressione nella popolazione (β) può essere saggiata mediante

la verifica dell’ipotesi nulla:

H 0 : β = 0.

Accettando H0 si assume che il valore reale del coefficiente angolare sia β= 0, dunque al variare di

X, Y resta costante e uguale al valore dell'intercetta a, pertanto non esiste alcun legame tra X e Y.

Rifiutando H0, si accetta l’ipotesi alternativa H1: β ≠ 0. Dunque al variare di X si ha una corrispondente variazione sistematica di Y.

Un metodo per la verifica della significatività della retta calcolata è il test F di Fisher-Snedecor, che

si basa sulla scomposizione delle devianze.

La somma dei quadrati delle distanze tra i tre punti yi , ŷ i e y definiscono le tre devianze: devianza

totale, devianza della regressione o devianza dovuta alla regressione, devianza d'errore o devianza

residua:

n

devianza totale = ∑ (y − y) 2

i =1 i

n

devianza di regressione = ∑ (ŷ − y) 2

i =1 i

n

devianza residua = ∑ (y − ŷ ) 2

i

i =1 i

devianza totale = devianza di regressione +

devianza residua

6

Dividendo la devianza di regressione e quella residua per i relativi gradi di libertà (1 ed n−1 gdl rispettivamente) si stimano la varianza di regressione e la varianza residua.

Il rapporto:

Varianza di Regression e

Varianza Residua

determina il valore del test F di Fisher con 1 e n−2 gdl (indicato con F(1,n-2)). Senza entrare nel merito della trattazione della distribuzione di tale statistica, si tenga semplicemente presente che per

applicare la metodologia del test F si può far riferimento alle Tavole della F :

•

•

Se l’F calcolato sui dati campionari è inferiore a quello tabulato (per il prefissato valore di probabilità e i gradi di libertà corrispondenti) l’ipotesi nulla H0 non può essere rifiutata (non esiste

regressione lineare statisticamente significativa).

Se l’F calcolato supera quello tabulato si rifiuta l'H0 e si accetta H1 (la regressione lineare tra le

due variabili è significativa).

Se β=0, la varianza dovuta alla regressione e quella residua sono stime indipendenti e non viziate

della variabilità dei dati. Se β≠0, la varianza residua è una stima non viziata della variabilità dei dati, mentre la varianza dovuta alla regressione è stima di una grandezza maggiore della varianza residua. Di conseguenza. il rapporto tra le due varianze è da ritenersi utile alla verifica dell'ipotesi β=0.

Si tenga comunque presente che rifiutare H0 :

•

•

non significa che non esiste relazione tra le due variabili, ma solamente che non esiste una relazione di tipo lineare;

significa che potrebbe esistere una relazione di tipo differente, come quella curvilinea di secondo grado o di grado superiore.

La trasformazione di uno o di entrambi gli assi è spesso sufficiente per ricondurre una relazione di

tipo curvilineo a quella lineare:

•

•

•

la crescita esponenziale di una popolazione nel tempo, generata da tassi costanti, diviene lineare

con la trasformazione logaritmica del tempo, usualmente riportato sull'asse delle ascisse;

la relazione curvilinea tra lunghezza e peso di individui della stessa specie diviene lineare con la

trasformazione mediante radice cubica del peso, correlato linearmente al volume;

l'analisi statistica permette qualsiasi tipo di trasformazione che determini una relazione lineare

tra due variabili

Tornando all’esempio 1, supposto che il campione estratto dalla popolazione oggetto di studio sia

significativo, con le tecniche dell’inferenza statistica occorre verificare:

• se la retta può essere assunta come rappresentativa di una relazione lineare tre le due variabili;

• se è corretto affermare che, nella popolazione di riferimento, ad una variazione di età corrisponde un cambiamento lineare della pressione sistolica;

• se, mediante il test F, β=0 (ipotesi H0) oppure β≠0 (ipotesi H1).

Si calcola la seguente tabella:

Regressione

Residua

Totale

Devianza

6543.1

2687.8

9230.9

gdl

1

6

7

Varianza

6543.1

447.9

7

F(1,6) =

6543.1

=14.61

447.9

In merito alla valutazione del risultato si può dire:

•

•

•

il valore critico riportato nelle tavole di F per 1 e 6 gdl e per un livello di significatività α=0.01

è pari a 13.75;

il valore calcolato di F è superiore a quello critico;

si rifiuta H0: si può supporre un rapporto lineare tra le variazioni di età e pressione sistolica.

La stima della significatività della retta (verifica dell'esistenza di una relazione lineare tra le variabili) può essere condotta anche con il test t di Student, con risultati equivalenti al test F.

Il test t è :

•

•

fondato su calcoli didatticamente meno evidenti di quelli del test F, ma offre il vantaggio di poter essere applicato sia in test unilaterali (β>0 oppure β<0) che in test bilaterali (β≠0);

basato sul rapporto tra il valore del coefficiente di regressione b (che rappresenta la risposta media di Y ai diversi valori di X entro il suo intervallo di variazione) ed il suo errore standard

SE(b) dato da: SE(b) = Varianza Residua DEV(X)

e utilizza la statistica:

t(n-2) =

b −β

= F(1, n − 2)

SE(b)

dove β è il valore atteso e i gdl sono n−2.

Constante

ETÀ

Coefficiente

68.748

1.538

Errore Standard

20.850

.402

t

3.297

3.822

Significatività

.016

.009

Si evidenzia anche in tal modo un rapporto lineare significativo tra le variazioni di età e pressione

sistolica.

Utilizzando il software R, dopo aver introdotto i caratteri ETA e PAS e costruito il modello lineare:

> ETA=c(22,28,35,47,51,56,67,81)

> PAS=c(131,114,121,111,130,145,176,217)

> mod=lm(PAS~ETA)

attraverso il comando: anova(mod) si ottiene:

Df Sum Sq

ETA

1 6543.0

Residuals 6 2687.8

Mean Sq F value Pr(>F)

6543.0 14.606 0.008743 **

448.0

dove Df indica i gdl, Sum Sq le devianze, Mean Sq le varianze e Pr(>F) il p-value, essendo

quest’ultimo minore di 0.01 si rifiuta l’H0.

Col comando summary(mod) si ottengono i coefficienti del modello regressivo ma anche valori del

coefficiente di determinazione R-squared, che, per i dati in esame, permette di propendere per la

bontà del modello.

8

Coefficients:

Estimate Std. Error

(Intercept) 68.7481

20.8504

ETA

1.5375

0.4023

Multiple R-squared: 0.7088,

t value

3.297

3.822

Pr(>|t|)

0.01647 *

0.00874 **

Adjusted R-squared: 0.6603

In ogni caso va osservato che l’esempio proposto ha una funzione esclusivamente didattica e che

senza dubbio una inferenza con un numero di dati così eseguo ha scarso significato applicativo.

Di seguito sono proposte altre due applicazioni della regressione, con alcuni risultati, lasciando al

lettore l’opportunità di commentare i risultati.

Esercizio n.2

X = Consumo pro-capite di tabacco per sigarette (kg/anno),

Y = Quoziente di mortalità per tumore maligno della laringe, trachea, bronchi e polmoni

(per 100.000 abitanti)

Anni

X

Y

1985

0.281

5.05

1986

0.417

5.07

1987

0.485

5.81

1988

0.604

6.50

1989

0.648

7.16

1990

0.657

8.38

1991

0.660

8.14

1992

0.719

8.05

1993

0.761

8.56

1994

0.790

9.00

Sempre attraverso l’utilizzo di R si ottengono i risultati del test F ed i coefficienti b ed a:

Df

X

1

Residuals 8

Sum Sq Mean Sq F value Pr(>F)

17.4051 17.4051 61.658 4.993e-05 ***

2.2583 0.2823

Coefficients:

Estimate Std. Error

(Intercept) 1.9759

0.6827

X

8.6285

1.0989

Multiple R-squared: 0.8852,

t value

2.894

7.852

Pr(>|t|)

0.0201 *

4.99e-05 ***

Adjusted R-squared: 0.8708.

Si può dire che qualora il consumo annuo di tabacco pro-capite aumenti di 1 kg si avrà, mediamente, un aumento di circa 9/100.000 della mortalità nella popolazione analizzata.

Analisi dei residui

10

,2

Decessi per 100.000 ab.

8

Y = 1.98 + 8.63 X

7

6

5

4

3

2

R = 0.94

1

Rsq = 0.88

0

Residui relativi (residui/decessi osservati)

9

,1

0,0

-,1

-,2

,1

,2

,3

,4

,5

,6

Consumo tabac co (kg/anno)

,7

,8

4

5

6

7

8

9

Dec essi stimati dal modello

9

Esempio 3

Studio della relazione tra Capacità Vitale CV (=volume massimo di aria che è possibile contenere

nei polmoni dopo un’inspirazione profonda) di un campione di fumatori rispetto al numero di sigarette fumate giornalmente dagli stessi.

Soggetto

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

N° Sigarette (X)

2

4

5

6

7

8

9

10

11

12

13

14

15

16

20

22

CV (l aria)

6.5

6.5

6.0

5.9

5.5

5.5

5.0

4.0

4.0

4.4

4.1

3.5

3.4

3.2

2.8

2.5

(Y)

Ecco i risultati in R:

Df Sum Sq Mean Sq

Sigarette 1 24.1889 24.1889

Residuals 14

1.6911

0.1208

F value Pr(>F)

200.25 1.097e-09 ***

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) 6.9970

0.1935

36.16

3.16e-15 ***

Sigarette -0.2250

0.0159

-14.15

1.10e-09 ***

Multiple R-squared: 0.9347,

Adjusted R-squared: 0.93

Il valore b = −0.225 indica che ogni sigaretta in più fumata comporta in media una diminuzione di

capacità vitale pari a 0.225 l. L’intercetta a = 6.99 rappresenta il valore medio di CV per i non fumatori.

10