ANALISI SERIE STORICHE

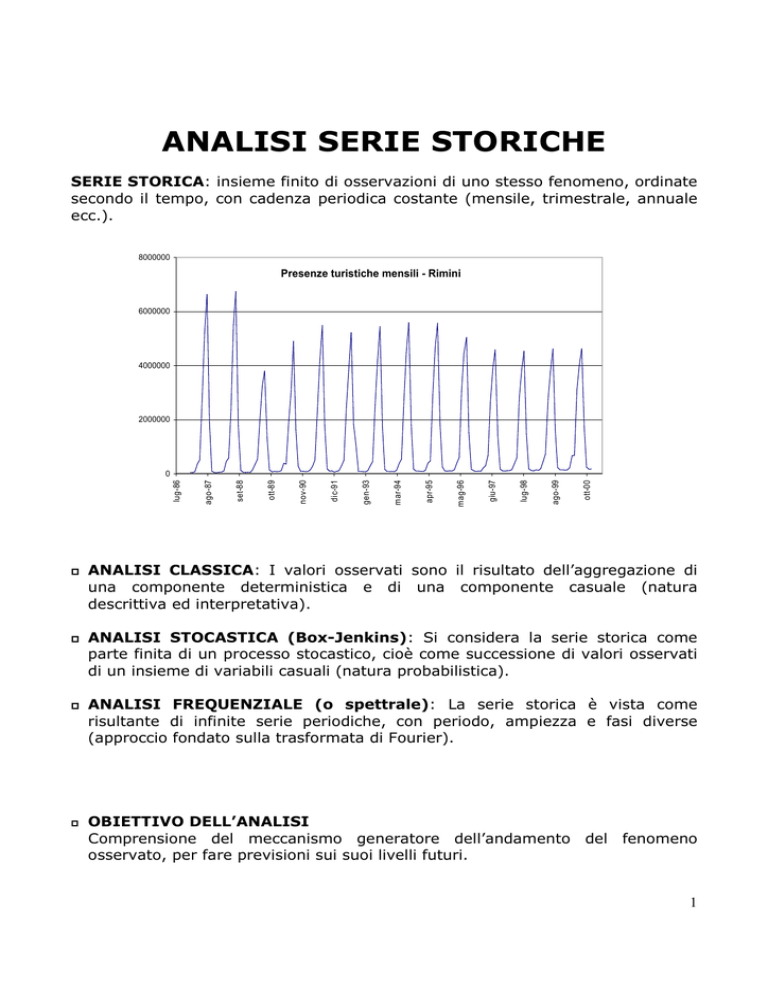

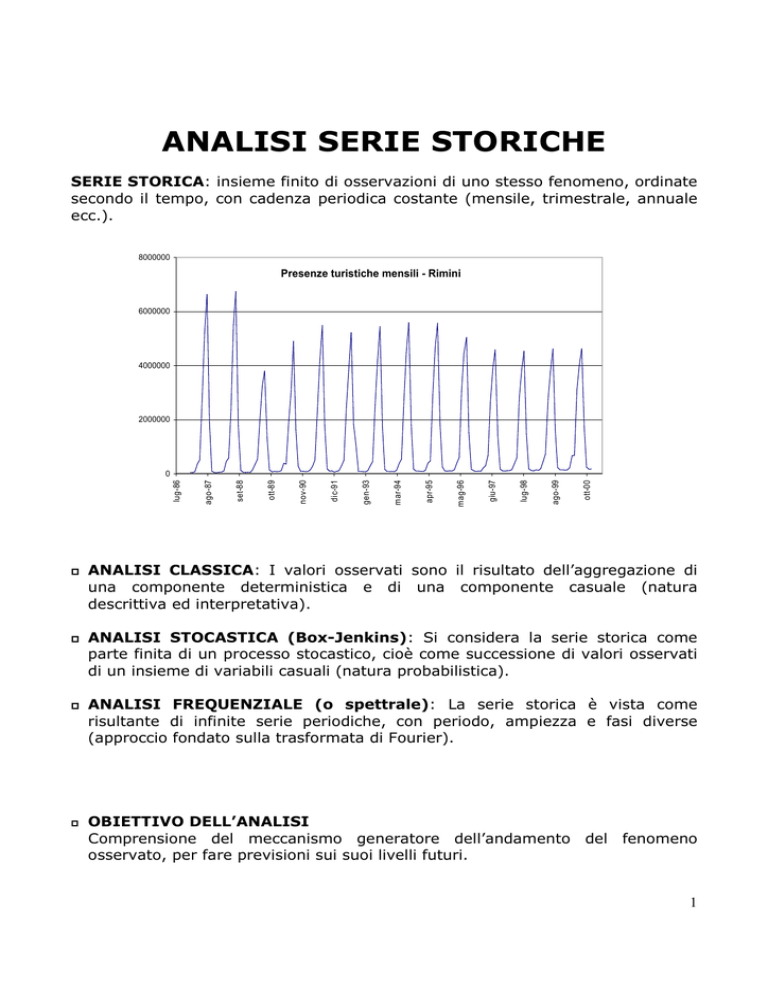

SERIE STORICA: insieme finito di osservazioni di uno stesso fenomeno, ordinate

secondo il tempo, con cadenza periodica costante (mensile, trimestrale, annuale

ecc.).

8000000

Presenze turistiche mensili - Rimini

6000000

4000000

2000000

ott-00

ago-99

lug-98

giu-97

mag-96

apr-95

mar-94

gen-93

dic-91

nov-90

ott-89

set-88

ago-87

lug-86

0

ANALISI CLASSICA: I valori osservati sono il risultato dell’aggregazione di

una componente deterministica e di una componente casuale (natura

descrittiva ed interpretativa).

ANALISI STOCASTICA (Box-Jenkins): Si considera la serie storica come

parte finita di un processo stocastico, cioè come successione di valori osservati

di un insieme di variabili casuali (natura probabilistica).

ANALISI FREQUENZIALE (o spettrale): La serie storica è vista come

risultante di infinite serie periodiche, con periodo, ampiezza e fasi diverse

(approccio fondato sulla trasformata di Fourier).

OBIETTIVO DELL’ANALISI

Comprensione del meccanismo generatore dell’andamento del fenomeno

osservato, per fare previsioni sui suoi livelli futuri.

1

PROBLEMATICHE GENERALI

L’analisi classica si basa su campioni casuali di osservazioni indipendenti: ogni

dato fornisce informazioni sulla variabile casuale che lo ha generato, ma non

aggiunge alcuna informazione sull’osservazione successiva.

L’analisi stocastica studia una serie storica fondandosi sulla connessione che

caratterizza una successione di dati temporali: la conoscenza di quanto è

avvenuto in passato condiziona ciò che avverrà in futuro.

La regolarità (stazionarietà) del fenomeno osservato condiziona notevolmente

l’analisi delle s.s., soprattutto nella fase previsiva.

1. ANALISI CLASSICA

Osservando serie storiche reali, ci si accorge della presenza di comportamenti

di lungo periodo a cui si sovrappongono comportamenti di durata inferiore,

connessi alla stagionalità, alla composizione e collocazione delle festività nel

calendario, a fatti eccezionali.

Si evidenziano perciò andamenti particolari, che possono essere ritenuti

prodotto dell’azione di FENOMENI NON RIPETITIVI (che generano movimenti di

lungo periodo) e di FENOMENI RIPETITIVI (responsabili dei movimenti

oscillatori).

L’approccio classico all’analisi delle serie storiche propone modelli nei quali i

valori osservati si considerano esprimibili, per ciascuno dei tempi considerati,

come risultanti di una componente sistematica (deterministica) e di una

componente aleatoria.

Si ipotizza inoltre che la parte sistematica del modello sia scindibile in una

componente tendenziale di lungo periodo (trend), in una componente

congiunturale (ciclo) e, se i dati sono rilevati con cadenza inferiore all’anno, in

una componente stagionale.

TREND (T): componente evolutiva, spiega l’andamento regolare di lungo

periodo; sintetizza la struttura e l’evoluzione sistematica di una serie, a

prescindere la fattori contingenti o irrilevanti.

CICLO (C): componente congiunturale, spiega le fluttuazioni pluriennali a

periodicità irregolare; spiega l’andamento di lungo periodo in termini di

alternanza tra fasi di espansione e contrazione.

2

STAGIONALITA’ (S): spiega l’influenza delle stagioni, in termini di effetti di

natura climatica o di calendario; osservabile se i dati sono rilevati con cadenza

inferiore all’anno.

ACCIDENTALITA’ (A): insieme di cause non esplicitate nelle precedenti

componenti, totalmente imprevedibili, casuali.

1.1 METODO DECOMPOSITIVO

Ogni valore osservato è esprimibile come risultato dell’azione combinata delle

componenti sistematica e accidentale.

MODELLO ADDITIVO: Yt = Tt + Ct + St + At

MODELLO MOLTIPLICATIVO: Yt = Tt x Ct x St x At

MODELLI MISTI: alcuni esempi

Yt = [Tt x Ct] + St + At

Yt = [Tt x Ct x St] + At

Yt = [Tt x St] + At

MODELLO ADDITIVO: Yt = Tt + Ct + St + At

l’ipotesi di base è che le componenti della serie storica corrispondenti alla

tendenza generale (T), alle variazioni stagionali (S), al ciclo (C) e alle

oscillazioni aleatorie (A) siano fra loro indipendenti.

MODELLO MOLTIPLICATIVO: Yt = Tt x Ct x St x At

presuppone che le componenti ciclica, stagionale e aleatoria risultino legate al

trend da una relazione di proporzionalità.

Tale modello può essere espresso in forma additiva ricorrendo alla

trasformazione logaritmica:

log Yt = log Tt + log Ct + log St + log At

VANTAGGI DEL METODO DECOMPOSITIVO

Semplicità dei modelli utilizzati

Applicabile a serie storiche di lunghezza limitata

Utile come punto di partenza per analisi successive, con modelli stocastici

3

LIMITI DEL METODO DECOMPOSITIVO

Arbitrarietà delle scelte

Convenzionalità della scomposizione

Decomposizione non unica (ad es.: se il trend cresce o decresce lentamente, la

differenza tra modello additivo e moltiplicativo si vanifica)

1.2 DETERMINAZIONE DELLA COMPONENTE SISTEMATICA

(TREND-CICLO): MEDIE MOBILI

Le MEDIE MOBILI non sono altro che medie aritmetiche di n osservazioni

successive della serie. Se il numero dei termini è dispari, le medie mobili sono

automaticamente centrate, nel senso che corrispondono al centro

dell’intervallo. Se il numero dei termini è pari, la media mobile si può centrare

calcolandola su n+1 termini ponderati con i pesi

½,1,1,1,...,1,1,1,½

Se una serie storica presenta forti fluttuazioni stagionali, per eliminare la

stagionalità si può ricorrere al calcolo di medie mobili centrate di 12 termini se i

dati sono mensili, e rispettivamente di 4, 7 o 24 termini se i dati hanno

periodicità trimestrale, giornaliera, oraria.

L’ipotesi implicita in questo procedimento è che le oscillazioni stagionali siano di

periodicità costante pari a 12 mesi (o a 4, 7, 24 periodi).

Il metodo consiste in una trasformazione lineare della serie, allo scopo di

preservare

una

delle

componenti

(trend-ciclo)

e

annullare

(approssimativamente) le altre due, stagionale e casuale.

Quando la media mobile è di termine pari (ad esempio 12, quando si

anno dati mensili) si calcola su n+1 termini:

TCt* = 1/12 [½Yt-6 + Yt-5 + Yt-4 + … + Yt + … + Yt+4 + Yt+5 + ½Yt+6]

= 1/24 Yt-6 + 1/12 Yt-5 + 1/12 Yt-4 + … + 1/12 Yt + …

… + 1/12 Yt+4 + 1/12 Yt+5 + 1/24 Yt+6

Quando la media mobile è di termine dispari (ad esempio 3, quando si

anno dati quadrimestrali) si calcola:

TCt* = 1/3 Yt-1 + 1/3 Yt + 1/3 Yt+1

4

EFFETTO: il calcolo delle medie mobili centrate riduce l’ampiezza delle

oscillazioni attribuibili agli effetti congiunti dei fattori stagionali e casuali, di

periodo esattamente pari a n (o a un suo sottomultiplo).

LIMITE (perdita di osservazioni): non si ottengono stime per gli n/2 dati

iniziali e finali.

LIMITE (effetto Slutzky-Yule): alterazione della componente accidentale con

la creazione di onde cicliche regolari nella serie generata con le medie mobili (il

metodo non elimina, infatti, fluttuazioni di periodo differente da n; tali

fluttuazioni vengono di conseguenza deformate generando onde non presenti

nella serie originale).

1.3 DETERMINAZIONE DELLA COMPONENTE

(STAGIONALITA’): MEDIE MOBILI

SISTEMATICA

Una volta applicate le medie mobili alla serie originaria si ottiene la serie dei

TC*, che rappresenta una stima della componente trend-ciclo.

Se il modello ipotizzato era un modello additivo, allora la seguente differenza

rappresenta l’effetto congiunto dei fattori stagionalità e casualità:

St + At = Yt – TCt*

Se il modello ipotizzato era un modello moltiplicativo, allora il seguente

rapporto rappresenta l’effetto congiunto dei fattori stagionalità e casualità:

St At = Yt / TCt*

RAPPORTO LORDO DI STAGIONALITA’

Se non si ha motivo di ritenere che nel corso del tempo la stagionalità si

modifichi (stagionalità rigida o costante) allora si può procedere alla

ulteriore scomposizione dei valori individuati in componente accidentale e

stagionale.

Se il modello ipotizzato era un modello additivo, allora una stima della

componente stagionale si ottiene calcolando medie aritmetiche dei valori [S(t)

+ A(t)] relativi allo stesso periodo (medie nei diversi anni del valore relativo

allo stesso mese o allo stesso quadrimestre, ecc.):

St* = MEDIA dei valori di [St + At]

5

Se il modello ipotizzato era un modello moltiplicativo, allora una stima della

componente stagionale si ottiene calcolando medie aritmetiche dei rapporti di

stag. lorda (relativi ad uno stesso mese, o quadrim., ecc.):

St* = MEDIA dei valori di [St At]

RAPPORTO NETTO DI STAGIONALITA’

1.4 ESEMPIO MEDIE MOBILI

1 TRIMESTRE

2 TRIMESTRE

3 TRIMESTRE

4 TRIMESTRE

1 TRIMESTRE

2 TRIMESTRE

3 TRIMESTRE

4 TRIMESTRE

1 TRIMESTRE

2 TRIMESTRE

3 TRIMESTRE

4 TRIMESTRE

1 TRIMESTRE

2 TRIMESTRE

3 TRIMESTRE

4 TRIMESTRE

2003

2003

2003

2003

2004

2004

2004

2004

2003

2003

2003

2003

2004

2004

2004

2004

Y(t)

TC*(t)

300

200

100

200

350

300

100

150

206,25

225,00

237,50

231,25

-

Y(t)

SA*(t)

300

200

100

200

350

300

100

150

0,48

0,89

1,47

1,30

-

=

=

=

=

1/4 [(1/2)300 +

1/4 [(1/2)200 +

1/4 [(1/2)100 +

1/4 [(1/2)200 +

=

=

=

=

100 /

200 /

350 /

300 /

200 +

100 +

200 +

350 +

100 +

200 +

350 +

300 +

200 +

350 +

300 +

100 +

(1/2)350]

(1/2)300]

(1/2)100]

(1/2)150]

206,25

225,00

237,50

231,25

6

400

350

300

Y(t)

250

200

150

100

50

0

0

2

4

6

8

10

6

8

10

tempo

400

350

TC*(t)

300

250

200

150

100

50

0

0

2

4

tempo

1.5 DESTAGIONALIZZAZIONE

In primo luogo va specificato il modello di stagionalità

Rigido (o costante): gli indici di stagionalità lorda sono stabili nel tempo

Variabile: gli indici di stagionalità lorda sono diversi nel tempo per forma e

intensità

Semi-rigido: gli indici di stagionalità lorda sono diversi nel tempo per forma

o intensità

Se il modello di stagionalità è rigido:

si calcolano gli indici netti di stagionalità e quindi si DESTAGIONALIZZA la

serie sottraendo o rapportano i dati osservati agli indici netti di stagionalità.

Ad esempio, se il modello ipotizzato è moltiplicativo, la serie destagionalizzata

si ottiene dal rapporto

Ytd / S*t

7

Se il modello di stagionalità è variabile:

si calcolano indici di stagionalità variabile (SV*), diversi per le diverse

osservazioni.

Ad esempio:

Si

considerano i rapporti di stagionalità lorda, di uno stesso mese (o

periodo), per 5 anni consecutivi (SAt-2, SAt-1, SAt, SAt+1, SAt+2)

Si ordinano i 5 termini in modo crescente

Si calcola la media aritmetica sui 3 valori centrali e si sostituisce il valore

ottenuto all’indice di stagionalità del periodo centrale t

Si applica il metodo in modo ricorsivo, come nel caso delle medie mobili

Quindi si DESTAGIONALIZZA la serie sottraendo o rapportano i dati osservati

agli indici netti di stagionalità.

Ad esempio, se il modello ipotizzato è moltiplicativo, la serie destagionalizzata

si ottiene dal rapporto

Ytd / SVt*

2. MODELLO DI REGRESSIONE

2.1 DETERMINAZIONE DELLA COMPONENTE

(TREND-CICLO): METODO ANALITICO

SISTEMATICA

Si utilizza l’analisi della regressione per trovare una curva che descriva il

modello matematico con il miglior adattamento ai dati della serie; si cerca

quindi la miglior curva interpolatrice.

Le forme funzionali più utilizzate sono le seguenti:

lineare

Yt = f(t) = b0 + b1t

2

Yt = f(t) = b0 + b1t + b2t

parabolico

Yt = f(t) = b0 eb1t

esponenziale

Yt = f(t) = b0 + b1 log t

semi-logartmico

log Yt = f(t) = b0 + b1 log t

log-logartmico

Yt = f(t) = b0 + b1 / t

iperbolico

Yt = f(t) = 1 / (b0 + b1 b2t)

logistico

Il metodo è consigliato quando l’esame (grafico) dei dati della serie evidenzia la

presenza di una relazione funzionale.

È applicabile quando non compare la componente stagionale.

8

In tal caso:

selezionare la forma o l’espressione generale per rappresentare il trend

(specificazione del modello);

effettuare l’analisi della regressione, per stimare i parametri, controllare e

validare il modello (stima e verifica del modello);

fare previsioni attraverso l’estrapolazione dell’equazione del trend.

2.2 DETERMINAZIONE DELLA COMPONENTE

(TREND-CICLO): ESEMPIO REGRESSIONE

SISTEMATICA

In generale, si attribuisce una forma funzionale a ciascuna delle componenti

Per TCt la forma funzionale più frequente è un polinomiale di grado p nel

tempo:

i = 0, …, p

TCt* = Σ biti

Per descrivere la componente stagionale St si possono utilizzare variabili

dummy (0, 1) che valgono 1 in corrispondenza del periodo di riferimento, 0

altrimenti.

2.3 DETERMINAZIONE DELLA COMPONENTE SISTEMATICA

(TREND-CICLO): ESEMPIO REGRESSIONE SEMPLICE

Con un trend di tipo lineare, se il modello non presenta stagionalità, si

pone:

Yt = TCt + At = b0 + b1t + et

Ricordando le condizioni sulla componente aleatoria (media nulla, varianza

costante, normalità distributiva, covarianza nulla), con il metodo dei minimi

quadrati si stimano i parametri del modello, si effettuano le opponune verifiche,

e quindi lo si utilizza a fini previsivi, per estrapolazione.

Con un trend di tipo lineare, con dati trimestrali e presenza di stagionalità

(uso di variabili dummy):

Yt = TCt + St + At = b0 + b1t + c1S1t + c2S2t + c3S3t + c4S4t + et

Anche in questo caso devono valere le condizioni ricordate sulla componente

aleatoria.

Con il metodo dei minimi quadrati si stimano quindi tutti i parametri del

modello, compresi quelli relativi alle variabili dummy, ponendo su di questi

almeno un vincolo. Il più usuale è (gli effetti stagionali si compensano

nell’anno):

Σ cj = c1 + c2 + c3 + c4 = 0

9

2.4 DETERMINAZIONE DELLA COMPONENTE SISTEMATICA

(TREND-CICLO): ESEMPIO DESTAGIONALIZZAZIONE

Le ipotesi più restrittive di tale modello sono:

il polinomio che descrive il ciclo-trend è lo stesso per tutto il periodo e quindi

non è previsto vi possano essere variazioni strutturali nell’andamento di

fondo della serie

i coefficienti stagionali cj sono costanti per tutto il periodo e quindi non si

prevedono effetti stagionali variabili.

Una volta ottenute le

DESTAGIONALIZZATA:

stime

dei

parametri

si

può

ricavare

la

serie

Ytd = Yt – St = Yt – Σ cjSjt

3. METODO DI BOX-JENKINS

3.1 INTRODUZIONE

Per utilizzare il modello di regressione su serie temporali, gli errori in

corrispondenza di valori differenti delle variabili esplicative devono

essere indipendenti.

Ciò in generale non è vero: le osservazioni prese in tempi successivi tendono

ad essere in relazione le une alle altre.

Pertanto, i modelli di regressione con dati che derivano da serie storiche

devono essere modificati per tener conto della correlazione tra i valori della Y.

Da qui deriva l’impostazione dell’analisi tramite modelli stocastici.

3.2 I MODELLI STOCASTICI ARIMA

L’analisi stocastica delle serie temporali consiste in una procedura messa a

punto da G.E.P. Box e G.M. Jenkins, che utilizza modelli di tipo ARIMA (Auto

Regressive Integrated Moving Avarage).

È fondata sul presupposto che le osservazioni di un fenomeno nel corso del

tempo siano generate da una struttura probabilistica sconosciuta al

ricercatore, ma alla quale si può giungere stimando i parametri,

cercando di riconoscere se e che tipo di legami temporali sussistano tra i dati

osservati.

10

Punti centrali della teoria sono:

- il ricorso ad una classe di processi stocastici a parametro discreto che

godono di particolari proprietà,

- le nozioni di funzione di autocorrelazione e di funzione di

autocorrelazione parziale.

Il PROCESSO STOCASTICO identifica una famiglia di variabili casuali Zt

ordinate secondo il tempo.

Le variabili casuali sono descritte sostanzialmente dal parametro t (in questo

caso discreto) appartenente a un determinato insieme T, che è appunto

l’insieme dei suoi possibili valori (se T è finito, si tratta di una n-pla di variabili

casuali).

Si può dunque definire una serie temporale come una particolare

realizzazione finita di un processo stocastico assunto come meccanismo

generatore: ogni valore zt della serie è interpretato come una osservazione

della corrispondente variabile casuale Zt.

Del processo stocastico che rappresenta il meccanismo generatore della serie

esaminata, si può cercare di stimare alcune caratteristiche, a partire dalla serie

stessa.

Più precisamente: si punta all’individuazione di un modello con caratteristiche e

proprietà simili a quelle del meccanismo generatore del processo.

Tale modello potrà essere poi utilizzato per fare previsioni.

La conoscenza del processo stocastico generatore equivale alla conoscenza di

tutte le distribuzioni di probabilità congiunte delle variabili aleatorie Zt.

Poiché tale obiettivo è molto difficile da raggiungere, ci si limita a prendere in

esame i momenti primo e secondo del processo.

I momenti di interesse di un processo stocastico sono:

la media

la varianza

la funzione di autocovarianza

la funzione di autocorrelazione

11

MEDIA:

µt = E[Zt]

VARIANZA:

σ2t = VAR[Zt] = E[(Zt - µt)2]

FUNZIONE DI AUTOCOVARIANZA:

γ(t, t-k) = COV[Zt , Zt-k] = E[(Zt - µt)(Zt-k – µt-k)]

FUNZIONE DI AUTOCORRELAZIONE:

ρ(t, t-k)

COV[Zt , Zt-k]

γ(t, t-k)

= CORR[Zt , Zt-k] = ---------------------------- = ------( VAR[Zt] VAR[Zt-k] )1/2

σt σt-k

La funzione di autocovarianza ha un ruolo fondamentale nella misura delle

relazioni lineari esistenti tra variabili casuali con sfasamento temporale uguale a

k.

A loro volta, le funzioni di autocorrelazione globale e parziale vengono

utilizzate per la specificazione di particolari modelli statistici, sulla base di

osservazioni empiriche.

La funzione di autocorrelazione ha le seguenti proprietà:

-1 < ρ(t, t-k) < +1

ρ(t, t) = 1

ρ(t, t-k) = ρ(t-k, t)

Vi è autocorrelazione globale quando i valori di zt sono positivamente o

negativamente correlati con i valori di zt+k.

Per k=1, vi è autocorrelazione di primo ordine,

per k=2, vi è autocorrelazione di secondo ordine, e così via.

La funzione di autocorrelazione parziale di ordine k definisce la

correlazione tra zt e zt+k, al netto degli effetti dei valori assunti da z nei tempi

intermedi.

Il procedimento inferenziale nell’analisi delle serie temporale è particolarmente

complesso perché si dispone di una sola osservazione per ogni indice temporale

corrispondente al processo stocastico.

Il problema si semplifica restringendo la classe dei processi stocastici a cui fare

riferimento introducendo alcuni vincoli, ovvero limitandosi a quei processi che

godono di particolari proprietà:

12

stazionarietà

normalità

invertibilità

ergodicità

STAZIONARIETA’: per essere stazionario (in senso debole) un processo deve

avere media e varianza costanti nel tempo e autocovarianza indipendente dal

tempo (cioè funzione del lag k ma non di t).

NORMALITA’:

il processo deve essere gaussiano; devono cioè risultare

normali le distribuzioni di probabilità delle variabili casuali che costituiscono il

processo.

INVERTIBILITA’: devono essere rispettate condizioni che consentono di

evitare la molteplicità di modelli corrispondenti a date strutture statistiche.

ERGODICITA’: osservazioni convenientemente lontane devono risultare

incorrelate; consente di ottenere stime consistenti dei parametri che

caratterizzano il processo.

Sotto le precedenti ipotesi (in pratica, valide le precedenti condizioni), le

espressioni degli stimatori dei momenti del processo stocastico sono:

m = Σ zt / n

per la MEDIA:

per la VARIANZA: s2t = Σ (zt – m)2 / n

per l’AUTOCOVARIANZA:

γk = Σ (zt – m) (zt+k – m) / n

Nel contesto delineato assumono un rilievo particolare i seguenti processi

puramente aleatori, appartenenti alla classe dei processi lineari:

AUTOREGRESSIVI (auto-regressive)

AR(p)

MEDIA MOBILE (moving average)

MA(q)

AUTOREGRESSIVI-MEDIA MOBILE

ARMA(p,q)

AUTOREGRESSIVI-INTEGRATI-MEDIA MOBILE

ARIMA(p,d,q)

13

Tali processi sono identificabili tramite l’esame delle funzioni di autocorrelazione

globale e parziale, a condizione che rispettino le proprietà già citate.

Tra i processi stocastici utilizzati in questo ambito, si definisce:

PROCESSO PURAMENTE ALEATORIO, o RUMORE BIANCO o WHITE

NOISE, una sequenza di prove indipendenti, effettuate sulla stessa

variabile casuale et, con

Media = 0

Varianza = costante

Autocovarianze = 0

3.2.1 IL PROCESSO AUTOREGRESSIVO DI ORDINE p: AR(p)

Vi sono serie temporali rispetto alle quali si può assumere che il valore

osservato al tempo t, ovvero zt, sia esprimibile mediante la combinazione

lineare di p termini immediatamente precedenti e di una componente

casuale white noise.

zt = φ1 zt-1 + φ2 zt-2 + … + φp zt-p + φ1 zt-1 + et

I coefficienti φi caratterizzano la dinamica del processo.

3.2.2 IL PROCESSO MEDIA MOBILE DI ORDINE q: MA(q)

Il modello assume che il valore osservato al tempo t, ovvero zt, sia esprimibile

come combinazione lineare di una variabile aleatoria white noise al

tempo t e in q tempi precedenti.

zt = et + θ1 et-1 + θ2 et-2 + … + θq et-q

Il processo MA consente una adeguata rappresentazione di alcune categorie di

fenomeni economici, in particolare quando è ragionevole assumere che esista

una situazione di equilibrio verso il quale il fenomeno tende a tornare una volta

che se ne è allontanato dopo uno shock di natura casuale.

3.2.3 IL PROCESSO AUTOREGRESSIVO-MEDIA

ORDINE p,q: ARMA(p,q)

MOBILE DI

Rappresenta una generalizzazione dei due precedenti.

14

Si assume che zt dipenda sia da p valori precedenti sia dalla componente

aleatoria al tempo t e in q tempi precedenti.

zt = Σ θi zt-i + Σ θj et-j

3.2.4 IL PROCESSO AUTOREGRESSIVO-INTEGRATO-MEDIA

MOBILE DI ORDINE p,q integrato d volte: ARIMA(p,d,q)

Quando una serie non è stazionaria in media, può essere ricondotta alla

stazionarietà attraverso l’operatore differenza, che in simboli è:

Dd zt = Dd-1 zt – Dd-1 zt-1

con

D0 zt = zt , D1 zt = zt – zt-1

Un processo ARMA riferito alle differenze d-esime anziché ai dati originari della

serie è denominato processo autoregressivo di ordine p, integrato d volte e a

media mobile di ordine q (Auto-Regressive Integrated Moving Average).

3.2.5 I MODELLI STOCASTICI ARIMA: FASI DELL’ANALISI

Se di dispone di una serie stazionaria e convenientemente lunga, per stabilire

da quale modello possa derivare occorre precedere per fasi:

a) identificazione del modello

attraverso l’esame delle funzioni di autocorrelazione globale e parziale

b) stima dei parametri

attraverso varie procedure:

minimi quadrati per modelli AR, metodo della massima verosimiglianza o

dei minimi quadrati non lineari per MA

c) verifica della idoneità del modello a descrivere le caratteristiche

della serie

attraverso l’analisi dei residui per controllarne indipendenza e normalità

Se il modello identificato e stimato è accettato, può essere utilizzato per scopi

previsivi o di simulazione.

Se il modello non è accettato, si procede alla iterazione delle tre fasi descritte,

fino a quando non si ottiene un modello soddisfacente.

15

3.2.6 IL MODELLO AR(1)

La formula del MODELLO AUTOREGRESSIVO DEL PRIMO ORDINE è data

da:

zt = φ1 zt-1 + et

Per analizzare una serie rispetto a questo particolare modello, seguendo le fasi

sopra citate occorre procedere nel modo seguente:

a) identificazione del modello: zt = φ1 zt-1 + et

NB: nel modello AR(1)

-

la condizione di stazionarietà è soddisfatta se |φ1| < 1

-

la funzione di autocorrelazione globale tende a zero in modo

monotono per φ1 > 0

-

la funzione di autocorrelazione globale varia tra -1 e +1 a segni

alterni

per φ1 < 0

b) stima dei parametri

-

attraverso il metodo dei minimi quadrati

c) verifica del modello

-

analisi grafica dei residui + test d’ipotesi

Si supponga di avere a disposizione una serie storica relativa ad una variabile

Y.

Per decidere se il modello AR(1) è adeguato, si può procedere calcolando il

coefficiente di autocorrelazione del primo ordine r1, oppure osservando il

diagramma di dispersione delle coppie (yt , yt-1).

Se si osserva una correlazione o una relazione lineare tra le coppie di valori (yt

, yt-1), la formula del modello autoregressivo utilizzabile per questa serie sarà:

yt = β 0 + β1 yt-1 + et

Le inferenze su questo modello possono essere effettuate utilizzando gli stessi

strumenti utilizzati nel caso generale del modello di regressione semplice, con

yt-1 che svolge il ruolo della varabile esplicativa x.

16

Quando i dati sono raccolti con cadenza infrannuale, è verosimile che vi sia un

legame tra osservazioni sfasate di un anno.

Se i dati sono raccolti con cadenza mensile, il legame rilevante è tra yt e yt-12,

se la cadenza è trimestrale tra yt e yt-4, e così via.

Pertanto, per dati mensili, il modello diventa:

yt = β 0 + β1yt-12 + εt

Per la valutazione del modello si procede quindi con gli strumenti tipici

dell’analisi di regressione.

Se il test t su β0 porta a NON rifiutare l’ipotesi nulla H0: β0 = 0, e se non

possiamo rifiutare l’ipotesi nulla H0: β1 = 1, allora il modello autoregressivo

assume la forma del cosiddetto “random walk”:

yt = yt-1 + εt

oppure

yt = yt-12 + εt

Si è detto che un elemento chiave per accertare la presenza di legami lineari

tra osservazioni sfasate di una serie temporale è il coefficiente di

autocorrelazione campionario, allo sfasamento (lag) k. Il suo stimatore è:

Σn-kt=1 [yt – media(y)] [yt+k – media(y)]

rk = −−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−−

Σnt=1 [yt – media(y)]2

Per accertare la significatività dei coefficienti di autocorrelazione occorre

procedere alla verifica dell’ipotesi

H0: ρk = 0

contro l’ipotesi alternativa H1: ρk ≠ 0.

Si procede con l’usuale test t di student, stimando l’errore standard di rk con la

formula:

srk

1 + 2 Σk-1j=1 (rj)2

=[−−−−−−−−−−−−−−−− ]1/2

n

17

Un altro criterio per accertare la presenza di autocorrelazione di primo ordine è

il test d di DURBIN-WATSON.

Una ulteriore verifica dell’assenza di autocorrelazione nella serie può essere

compiuta sottoponendo a verifica l’ipotesi nulla

H0: ρ1 = ρ2 = … = ρk = 0

contro l’ipotesi alternativa che almeno un coefficiente di autocorrelazione sia

diverso da zero.

Per saggiare tale ipotesi si procede con una statistica test nota come Q di Liung

e Box, che la seguente formula:

Q = n (n+2) ΣKk=1 (n-k)-1(rk)2

La statistica segue una distribuzione del chi-quadrato con k gradi di libertà.

4. Analisi dell’errore di previsione

ERRORE di previsione:

è definito come differenza tra valore osservato Yt e valore previsto (o stimato)

Yt*

et = Yt – Yt*

L’analisi degli errori di previsione serve a:

Verificare se un modello è accurato

Suggerire come correggere un modello

Confrontare modelli diversi

4.1 DEFINIZIONI

Media quadratica degli errori di previsione:

D2 = 1/k (Σ e2t+i) i=1,…,k

18

Saggio effettivo di variazione:

Yt+1 – Yt

------------Yt

Saggio previsto di variazione:

Y*t+1 – Yt

-------------Yt

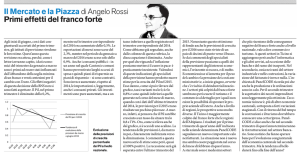

4.1 RAPPRESENTAZIONE GRAFICA

saggi previsti

Sovrastima

dell’aumento

Sottostima

dell’aumento

Sottostima

diminuzione

della

Sovrastima

diminuzione

saggi effettivi

della

19