Metodi matematici della fisica

Geometria e gruppi

a cura di

Tommaso Parolini

Appunti del corso del

prof. Alberto Santambrogio

Anno accademico 2012-2013

Dipartimento di Fisica – Università degli Studi di Milano

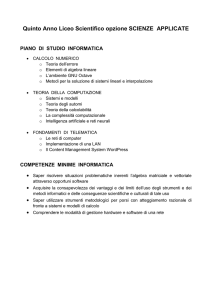

Dedico queste 100 pagine a Masca-sensei, senza la cui perseveranza non sarei mai diventato adepto di LATEX, e

senza i cui preziosi consigli questo documento non esisterebbe nella sua forma presente. ;)

Il curatore

[email protected]

Quest’opera è stata rilasciata con licenza Creative Commons Attribuzione - Condividi allo stesso modo 3.0 Italia. Per leggere una copia della licenza visita il sito web http://creativecommons.org/licenses/

by-sa/3.0/it/ o spedisci una lettera a Creative Commons, 171 Second Street, Suite 300, San Francisco,

California, 94105, USA.

Le immagini sono state realizzate in Inkscape 0.48.

Realizzato con LATEX.

versione aggiornata al 9 ottobre 2013 (completa – v1.5)

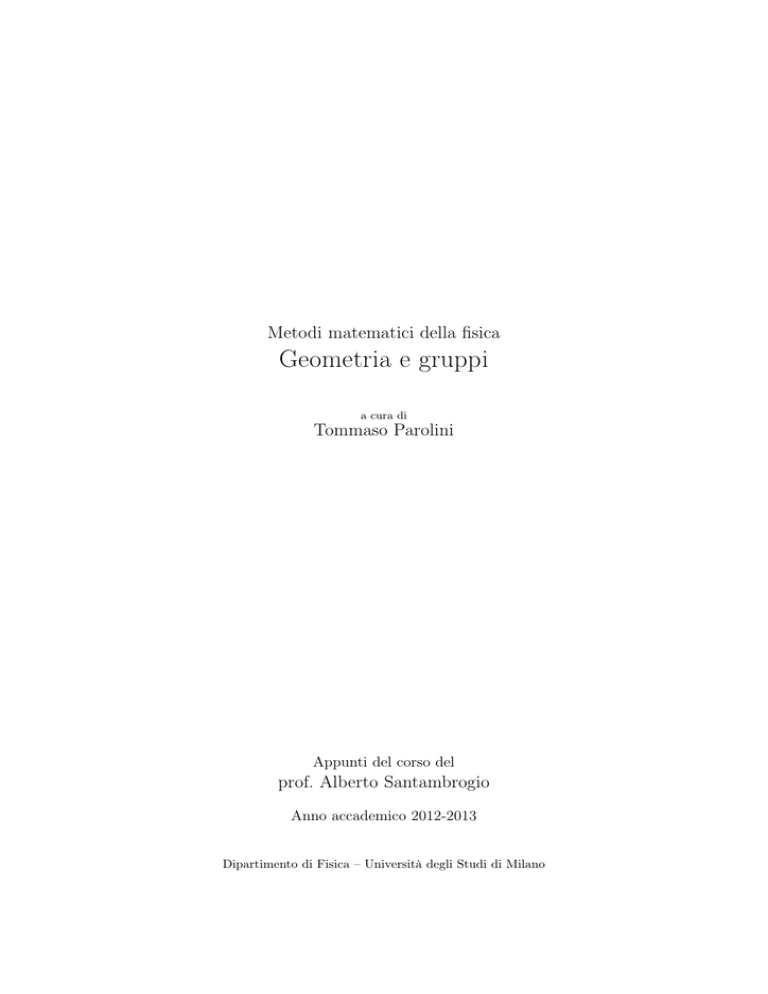

Indice

0.1

Notazione matematica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1 Cenni di geometria differenziale

1.1 Varietà differenziabili . . . . . . . .

1.1.1 Funzioni differenziabili sulle

1.2 Vettori tangenti . . . . . . . . . . .

1.3 Differenziale di una funzione . . . .

1.4 Campi vettoriali . . . . . . . . . .

1.5 Mappe di inclusione . . . . . . . .

. . . . .

varietà .

. . . . .

. . . . .

. . . . .

. . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

2 Gruppi di Lie

2.1 Definizione ed esempi . . . . . . . . . . . . . . . .

2.2 Campi left-invarianti e algebre di Lie associate . .

2.2.1 Algebra associata al gruppo lineare generale

2.3 Sottogruppi e sottoalgebre di Lie . . . . . . . . . .

2.3.1 Morfismi di gruppi e algebre di Lie . . . . .

2.3.2 Sottogruppi e sottoalgebre di Lie . . . . . .

2.3.3 Sottogruppi a un parametro . . . . . . . . .

2.3.4 La mappa esponenziale . . . . . . . . . . .

2.4 Rappresentazione aggiunta . . . . . . . . . . . . . .

2.5 Studio delle algebre di Lie . . . . . . . . . . . . . .

2.5.1 Forma di Killing . . . . . . . . . . . . . . .

2.5.2 Algebre semisemplici e criteri di Cartan . .

2.5.3 Studio delle algebre semisemplici . . . . . .

2.5.4 Complessificazione delle algebre di Lie . . .

2.5.5 Algebre complesse semisemplici . . . . . . .

2.5.6 Classificazione delle algebre complesse . . .

2.5.7 Forme reali compatte . . . . . . . . . . . .

2.5.8 Rappresentazione delle algebre semisemplici

2.5.9 Prodotti di rappresentazioni . . . . . . . . .

2.5.10 Sottoalgebre e rappresentazioni . . . . . . .

2.6 Dalle algebre ai gruppi . . . . . . . . . . . . . . . .

Bibliografia

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. . .

. . .

delle

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

. . .

5

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

6

6

8

9

11

12

14

. . . . .

. . . . .

matrici

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

15

15

17

19

22

22

23

26

27

38

42

42

45

47

50

52

61

67

68

77

83

97

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

100

0.1. Notazione matematica

0.1

5

Notazione matematica

Nella scelta della notazione si è cercato di seguire un criterio di coerenza e immediatezza, scegliendo

di volta in volta la scrittura più “naturale”; ovviamente, le scelte rispecchiano il criterio di naturalezza

proprio dell’autore, e potrebbero non essere condivise dal lettore. Ciononostante, l’autore confida nella

capacità di quest’ultimo di adattarsi a una simbologia o notazione forse non completamente familiare.

Di seguito, vengono riportate alcune delle scelte di notazione per i caratteri più ricorrenti. La notazione

adoperata è del resto spiegata nella maggior parte dei casi in cui possa risultare non immediata (e si

ascrivano i casi in cui ciò non avviene a un fallo dell’autore).

Insiemi

Gli insiemi generici, se ciò non causa ambiguità, vengono indicati con lettere maiuscole in carattere italico:

A, B.

Per gli spazi numerici standard è riservata la consueta simbologia “black board”: R per i reali, C per

i complessi, Q per i razionali, Z per gli interi e N per i naturali. Inoltre si indica con H l’insieme dei

quaternioni.

Gli spazi topologici generici (e in particolare le varietà) vengono indicati con lettere corsive: M, N , X , Y.

Per i gruppi di Lie, che sono varietà, si usano perlopiù i caratteri corsivi G, G 0 , H.

Per le algebre di Lie si adoperano lettere in carattere gotico (quasi sempre minuscolo): g, g0 , h, se si parla di

algebre reali (in particolare delle algebre dei gruppi classici su(n), u(n), so(n), . . .), o caratteri calligrafici

L , L 0 se si parla di algebre complesse (in particolare delle algebre complesse semplici Al , Bl , . . . , G2 ). Se

però si vuole porre in risalto che un’algebra è stata ottenuta complessificando un’algebra reale, si userà g̃

(e simboli analoghi); viceversa, la forma reale compatta di un’algebra complessa L sarà indicata da LC

(e il sottospazio di Cartan reale da HR ).

Matrici e applicazioni

Le matrici sono indicate da lettere maiuscole o minuscole in italico: A, B, a, b. Sono indicate in minuscolo

quando è importante far notare che sono elementi di un’algebra di matrici esponenziabile a un gruppo

di matrici, cosicché ea = A. Per la matrice identità si adopera la notazione I, talvolta indicando la

dimensione: Id , Ip×q . In modo analogo, la matrice nulla è indicata con O (con eventuali pedici per indicarne

la dimensione).

Per la funzione identità s’è usata la notazione 1, di solito con un pedice per indicare su quale spazio

agisca: 1G . Analogamente, la funzione nulla è scritta O (con eventuale pedice).

In certi casi, la distinzione tra matrice identità (o nulla) e funzione identità (o nulla) è sfumata. La scelta

se indicarla nell’uno o nell’altro modo riflette la sensibilità dell’autore.

Spesso, le applicazioni tra due spazi (varietà, gruppi di Lie, ecc.) sono denotate da lettere greche minuscole

o maiuscole. Le lettere ϕ e ψ vengono usate di solito per indicare un generico omomorfismo tra gruppi o

algebre di Lie. Fanno eccezione alcune mappe, come le mappe di moltiplicazione left e right, di aggiunzione,

esponenziale e di rappresentazione aggiunta: L, R, I, exp, Ad, ad.

I vettori generici sono indicati da lettere minuscole italiche (es. v) quando sono interpretati come entità

astratte o funzionali lineari, o con il grassetto (es. v) quando sono visti come elementi di Rn (o spazi

isomorfi). I campi vettoriali sono indicati da lettere maiuscole diritte X, Y, Z.

Indici

Per gli indici vengono quasi sempre riservate le lettere i, j, k, l, m, n, p, q (a seconda della convenienza).

Gli indici possono essere posizionati in basso o, quando ciò non possa causare ambiguità, in alto, come in

xi .

Una coppia di indici uguali, uno in alto e uno in basso, sottindendono

una somma se non diversamente

P

specificato (convenzione di sommatoria), come in εij k Tk := k εij k Tk .

Di norma gli indici vengono posizionati in alto nel caso di componenti di un vettore e per potersi servire

della convenzione di sommatoria, come in h = µi hi .

Capitolo 1

Cenni di geometria differenziale

In questa sezione viene introdotto il concetto di varietà differenziabile. La nozione di varietà (manifold

in lingua inglese) estende quella di superficie in R3 e la amplia, permettendo di trattare con spazi molto

generali in modo efficace e versatile. Si richiede che sulla varietà sia definita una struttura geometrica,

detta struttura differenziabile, che permetta alle proprietà di regolarità definite per gli oggetti sulla varietà

di mantenersi coerenti a seguito di un cambio di coordinate.

Vengono in seguito studiate brevemente le funzioni definite su una varietà e introdotto un concetto di

differenziabilità per tali funzioni, unitamente ai concetti conseguenti di spazio tangente, differenziale e

spazio cotangente. Da ultimo, vengono definite le mappe di inclusione tra varietà.

1.1

Varietà differenziabili

Per enunciare la definizione di varietà differenziabile, è conveniente definire prima alcuni concetti più

basilari.

Definizione 1.1.1. Un insieme M è uno spazio localmente euclideo di dimensione n se:

a) è uno spazio topologico di Hausdorff;

b) ogni punto dell’insieme possiede un intorno omeomorfo a un sottinsieme aperto di Rn .

La proprietà a) richiede allo spazio M di possedere una topologia 1 che ne elenchi gli aperti, e inoltre di

godere della proprietà di Hausdorff (per ogni coppia di punti distinti dell’insieme devono esistere due

aperti separati contenenti rispettivamente l’uno e l’altro punto).

La proprietà b) richiede che, in prossimità di un qualunque punto dello spazio, questo sia confondibile

con Rn (cioè che si “appiattisca” opportunamente quando “guardato abbastanza da vicino”).

Più precisamente, si dice omeomorfismo (da non confondere con omomorfismo) tra spazi topologici una

funzione invertibile che sia continua con la sua inversa, vale a dire una funzione invertibile f dallo spazio

X allo spazio Y tale che, se l’insieme A ⊂ X è un aperto di X , allora la sua immagine f (A) ⊂ Y è un

aperto di Y.

Un omeomorfismo φ : U → Rn tra l’aperto U ⊂ M e l’aperto φ(U ) ⊂ Rn è detto mappa delle coordinate,

e le sue componenti

xi := πi ◦ φ

(1.1.1)

(dove πi : Rn → R è la proiezione sull’i -esimo asse coordinato) sono dette funzioni coordinate; la dupla

(U, φ) è chiamata sistema di coordinate o carta.

Definizione 1.1.2. Una famiglia F = {(Uα , φα )} di carte dell’insieme M (con φα : Uα ⊂ M → Rn per

ogni α) è detta un atlante di M di classe Ck se:

1 Cioè una collezione di sottoinsiemi di M, comprendente l’insieme vuoto e M stesso, che sia chiusa rispetto a unioni

numerabili e intersezioni finite di suoi elementi (Rudin 1987, p. 8).

1.1. Varietà differenziabili

a) M =

[

7

Uα ;

α

k

b) ∀α, β, la funzione di transizione φαβ := φβ ◦ φ−1

α è di classe C sul proprio dominio φα (Uα ∩ Uβ ).

Se la proprietà b) è verificata, si dice che le carte (Uα , φα ) e (Uβ , φβ ) sono compatibili.

Due atlanti si dicono compatibili se la loro unione è un atlante. Si dice che F è un atlante massimale se

è un atlante e inoltre se

(U, φ) è una carta di M compatibile con ogni carta di F =⇒ (U, φ) ∈ F.

F è pertanto l’unione di tutti gli atlanti compatibili di M.

Siamo ora pronti per dare la definizione di varietà differenziabile (Warner 1971, p. 6).

Definizione 1.1.3. Se M è uno spazio localmente euclideo n-dimensionale a base numerabile1 e F

è un atlante massimale di M di classe Ck , la dupla (M, F) viene chiamata varietà differenziabile ndimensionale di classe Ck . L’atlante F è chiamato anche struttura differenziabile.

Una varietà è quindi uno spazio localmente omeomorfo a Rn ; il numero n rappresenta la dimensione della

varietà (si parla di “varietà n-dimensionale” o, brevemente, di “n-varietà”).

Osservazione 1.1.1. Per gli scopi di questo corso sarà sufficiente considerare solo varietà infinitamente

lisce (con funzioni di transizione infinitamente derivabili sul loro dominio).

Osservazione 1.1.2. La condizione di massimalità per l’atlante F è puramente tecnica, e può essere di

volta in volta data per scontata; infatti, un atlante non massimale può sempre essere reso tale aggiungendo

a esso tutte le carte compatibili della varietà.

D’ora in poi il termine “varietà” verrà abitualmente usato in riferimento allo spazio M anziché alla dupla

(M, F). Si sottintenderà altresì il termine “differenziabile”.

Esempi

a) L’insieme Rn è una n-varietà. Esso può essere descritto da una sola carta (U, φ), prendendo come

insieme U lo stesso Rn e come omeomorfismo φ : U → Rn la funzione identità.

b) L’insieme Sn := {x = (x1 , . . . , xn+1 ) | x21 + · · · + x2n+1 = 1} (sfera unitaria di dimensione n) è una

n-varietà. è infatti possibile dotare l’insieme dell’atlante

F = {(U− , φ− ), (U+ , φ+ )},

con

U± := Sn \{(0, . . . , 0, ∓1)}

e

φ± : U± → Rn ,

φ± (x) :=

xn

x1

,...,

1 ± xn+1

1 ± xn+1

.

è possibile dimotrare che queste funzioni, chiamate mappe di proiezione stereografica, sono compatibili (la funzione di transizione tra l’una e l’altra carta è liscia sull’intera n-sfera privata dei poli

nord e sud).

1 Uno spazio topologico è detto a base numerabile o secondo numerabile se esiste un sottoinsieme B (“base”) della sua

topologia T tale che ogni elemento di T può essere scritto come unione di elementi di B, e questo è numerabile (Naber 2011,

p. 56–7).

Capitolo 1. Cenni di geometria differenziale

8

c) L’insieme RPn delle rette in Rn+1 passanti per l’origine (spazio proiettivo di dimensione n) è una

n-varietà. Questo spazio può essere visto come l’insieme Rn+1 quozientato rispetto alla relazione

d’equivalenza:

x ∼ y ⇐⇒ x = λy per qualche λ ∈ R.

Denotiamo con [x1 , . . . , xn+1 ] la classe di equivalenza dei vettori multipli di (x1 , . . . , xn+1 ); allora

RPn può essere descritto dalle n + 1 carte (Ui , φi ), dove

Ui := {[x1 , . . . , xn+1 ] ∈ RPn | xi 6= 0}

n

φi : Ui → R ,

φi ([x1 , . . . , xn+1 ]) :=

xi−1 xi+1

xn+1

x1

,...,

,

,...,

xi

xi

xi

xi

,

che sono compatibili (la dimostrazione può essere effettuata per esercizio).

Data la definizione di varietà differenziabile, si possono fare alcune semplici osservazioni:

Osservazione 1.1.3. Se M è una n-varietà e U un suo sottoinsieme aperto, allora anche U è una n-varietà

(è sufficiente adattare l’atlante {(Uα , φα )} di M a U considerando le carte (U ∩ Uα , φU ∩Uα );

Osservazione 1.1.4. Se M1 è una n1 -varietà e M2 è una n2 -varietà, allora il loro prodotto cartesiano

M1 ×M2 è una (n1 +n2 )-varietà (è possibile usare le carte (Uα , φα ) di M1 e (Vβ , ψβ ) di M2 per costruire

l’atlante (Uα × Vβ , φα × ψβ ) dove φα × ψβ : Uα × Vβ → Rn1 × Rn2 ).

Esempio Lo spazio S1 × S1 , prodotto di due 1-sfere, è una 2-varietà chiamata toro.

1.1.1

Funzioni differenziabili sulle varietà

Per definire la differenziabilità di una funzione definita su una varietà si ricorre alla sua espressione in

coordinate locali.

Diamo prima la definizione nel caso di funzioni a valori reali su una varietà.

Definizione 1.1.4. Sia M una n-varietà e f : U → R una funzione a valori reali definita sull’aperto

U ⊂ M; si dice che f è differenziabile (di classe Ck ) su U se lo è la funzione f ◦ φ−1

α su φα (U ∩ Uα ) per

ogni mappa delle coordinate φα dell’atlante {(Uα , φα )} di M.

n

Si noti che f ◦ φ−1

α è un’ordinaria funzione da R in R, e quindi la nozione di differenziabilità è per essa

definita nel modo standard.

Del tutto analoga la definizione per funzioni definite tra varietà.

Definizione 1.1.5. Sia M una m-varietà e N una n-varietà, e sia f : M → N ; si dice che f è differen−1

ziabile (di classe Ck ) su M se lo è la funzione ψβ ◦ f ◦ φ−1

(Vβ )) per ogni coppia di mappe

α su φα (Uα ∩ f

φα , ψβ (dove si intende che {(Uα , φα )} è un atlante di M e {(Vβ , ψβ )} è un atlante di N ).

m

Di nuovo, la funzione ψβ ◦ f ◦ φ−1

a valori in Rn , per cui è definito in modo

α è una funzione definita su R

standard il significato di “differenziabile”.

Infine, diamo il concetto di diffeomorfismo tra due varietà.

Definizione 1.1.6. Se una mappa differenziabile tra varietà f : M → N è invertibile e l’inversa f −1 è

una mappa differenziabile, si dice che f è un diffeomorfismo tra varietà.

Di seguito, adotteremo anche la dicitura regolare per indicare una funzione differenziabile.

1.2. Vettori tangenti

1.2

9

Vettori tangenti

Definizione 1.2.1. Si indica con F(M) l’insieme delle funzioni regolari sulla varietà M a valori reali.

Definizione 1.2.2. Un vettore tangente alla varietà M nel punto p ∈ M è una funzione

v : F(M) → R

tale che:

a) v(af + bg) = av(f ) + bv(g);

b) v(f g) = v(f )g(p) + f (p)v(g) (regola di Leibniz)

per ogni a, b ∈ R e f, g ∈ F(M).

Osservazioni

• Un usuale vettore dello spazio euclideo è pensato come insieme di componenti v = t (v 1 , . . . , v n ) ∈

Rn ; prendendo come varietà M = Rn , e data una qualunque funzione differenziabile f ∈ F(Rn ), si

vede che la mappa:

v : f → v · ∇f p ∈ R,

dove p è un qualunque punto di Rn , soddisfa le proprietà a) e b) della definizione 1.2.2, ed è quindi

un vettore tangente a Rn nel punto p. Si può dimostrare che questo funzionale fornisce la derivata

direzionale di f lungo la direzione v (moltiplicata per la norma di tale vettore).

• Bisognerebbe specificare che il vettore v agisce non sulla funzione f , ma su un suo germe — cioè

sulla classe d’equivalenza delle funzioni coincidenti in un intorno di p. Ciò che conta ai fini della

derivazione, infatti, è solo la variazione locale della funzione, sicché il numero v(f ) è uguale per ogni

funzione f appartenente alla classe d’equivalenza. Per non appesantire la trattazione, a ogni modo,

continueremo a parlare di “funzioni” in luogo dei loro germi.

Definizione 1.2.3. Sia M una varietà e p ∈ M; si definisce spazio tangente a M nel punto p, e si denota

con Tp M, l’insieme dei vettori tangenti a M in p.

L’insieme Tp M può essere dotato della struttura di spazio vettoriale tramite la definizione della somma

tra vettori e della moltiplicazione per uno scalare, definite tramite l’azione dei vettori su una funzione

arbitraria f ∈ F(M):

(v + w)(f ) := v(f ) + w(f )

(λv)(f ) := λv(f )

dove v, w ∈ Tp M e λ ∈ R.

Se M è una n-varietà, allora Tp M è uno spazio vettoriale di dimensione n. Si può introdurre una base

naturale su tale spazio. Sia infatti U ⊂ M un aperto abbinato alla carta (U, φ), e sia p ∈ U ; si definiscano

gli n vettori

∂ : F(M) → R

∂xi p

∂(f ◦ φ−1 ) f 7→

∂ri

φ(p)

con le xi definite come in 1.1.1. Possiamo anche scrivere (con abuso di notazione):

∂f ∂ (f

)

:=

.

∂xi p

∂xi p

Capitolo 1. Cenni di geometria differenziale

10

Questi sono evidentemente elementi di Tp M; notiamo che la loro azione sulla funzione xj ∈ F(M) è:

∂rj ∂ j

∂(xj ◦ φ−1 ) (x ) =

=

= δij ;

i

∂xi p

∂ri

∂r

φ(p)

φ(p)

pertanto, dato un qualunque vettore v ∈ Tp M, vale la scomposizione:

i ∂ i ∂ v = v(x ) i =: v

i

∂x p

∂x p

∂ , oltre a generare Tp M, sono anche linearmente indipendenti, e

∂xi p

perciò che costituiscono effettivamente una base. I numeri reali

è possibile mostrare che i vettori

v i := v(xi )

(1.2.1)

rappresentano le componenti del vettore v in tale base.

Definizione 1.2.4. L’insieme1

T M :=

G

Tp M :=

p∈M

[

{p} × Tp M

p∈M

è detto fibrato tangente di M.

Gli elementi di T M sono in corrispondenza biunivoca con le coppie ordinate (p, v) con p ∈ M e v ∈ Tp M.

Definizione 1.2.5. La mappa

π : TM → M

(p, v) 7→ p

è detta mappa di proiezione canonica.

È possibile equipaggiare T M con una struttura differenziabile in modo da renderlo una varietà di

dimensione doppia rispetto a M.

1 Il

simbolo

F

indica l’unione disgiunta tra insiemi.

1.3. Differenziale di una funzione

1.3

11

Differenziale di una funzione

Definizione 1.3.1. Sia f : M → N una funzione regolare tra l’m-varietà M e l’n varietà N , sia p ∈ M.

Si definisce differenziale di f nel punto p la funzione

df : Tp M → Tf (p) N

definita da

df (v) : g 7→ v(g ◦ f )

per ogni v ∈ Tp M e g ∈ F(N ).

Osservazione 1.3.1. df è una mappa lineare.

Definizione 1.3.2. Una curva su una varietà M è una mappa regolare

α : I → M,

dove I è un sottoinsieme aperto di R.

Sia data una curva α : (a, b) → M; si dice vettore tangente alla curva nel punto α(t) il vettore α̇(t) ∈

Tα(t) M definito da

d α̇(t) := dα

,

(1.3.1)

dr t

la cui azione su una funzione regolare f è data esplicitamente da

d (f ◦ α).

α̇(t)(f ) =

dr t

Qualora la varietà M coincida con Rn , la nozione di vettore tangente si riconduce a quella usuale1 :

d(xi ◦ α) dxi i

i

i

α̇ (t) = α̇(t)(x ) =

= dr = ẋ (t),

dr

t

t

avendo indicato con xi (r) l’i-esima componente di α(r) ∈ Rn .

1 Si

tenga presente la definizione 1.2.1 per le componenti di un vettore.

Capitolo 1. Cenni di geometria differenziale

12

1.4

Campi vettoriali

Definizione 1.4.1. Un campo vettoriale X su una varietà M è una funzione

X : M → TM

p 7→ Xp ∈ Tp (M)

Dato un campo vettoriale X e una funzione regolare f , è naturale considerare la funzione

Xf : M → R

p 7→ (Xf ) (p) := Xp (f )

(1.4.1)

Se l’applicazione Xf ∈ F(M) è regolare per ogni f ∈ F(M), si dice che è regolare il campo X. I campi

vettoriali regolari possono quindi essere visti come endomorfismi dello spazio F(M),

X : F(M) → F(M),

associando a qualunque funzione regolare f un’altra funzione regolare Xf . La linearità è immediatamente

verificata, e vale la proprietà di Leibniz:

X(f g) = f Xg + gXf.

Definizione 1.4.2. Siano X e Y campi vettoriali regolari; è detta parentesi di Lie di X e Y l’applicazione

[X, Y] : F(M) → F(M)

f → X(Yf ) − Y(Xf ),

dove l’azione di [X, Y](f ) è da intendersi:

[X, Y](f )(p) := Xp (Yf ) − Yp (Xf ).

(1.4.2)

Osservazione 1.4.1. [X, Y] è un campo vettoriale regolare.

Osservazione 1.4.2. La parentesi di Lie può anche essere pensata secondo la definizione 1.4.1, cioè nel

seguente modo:

[X, Y] : M → T M

p 7→ [X, Y]p ,

dove l’azione di [X, Y]p è definita da

[X, Y]p (f ) := [X, Y](f )(p)

(cfr. (1.4.2)) per ogni f funzione regolare in un intorno di p, e le funzioni Xf e Yf sono definite

dall’equazione (1.4.1).

La parentesi di Lie gode delle seguenti proprietà:

a) [X, Y] = −[Y, X];

b) [aX + bY, Z] = a[X, Z] + b[Y, Z];

c) [X, [Y, Z]] + [Y, [Z, X]] + [Z, [X, Y]] = 0.

La proprietà c) è chiamata identità di Jacobi.

Definizione 1.4.3. Sia V uno spazio vettoriale e [, ] : V ×V → V un’applicazione che goda delle proprietà

a), b) e c). Allora (V, [, ]) è un’algebra di Lie.

1.4. Campi vettoriali

13

Pertanto, lo spazio vettoriale dei campi vettoriali regolari, munito dell’operazione parentesi di Lie, è

un’algebra di Lie.

Un campo vettoriale genera in modo naturale un flusso sulla varietà sulla quale è definito.

Definizione 1.4.4. Sia X un campo vettoriale regolare sulla varietà M, e sia α : (a, b) → M una curva

su tale varietà. Si dice che α è una curva integrale di X se

α̇(t) = Xα(t) .

(1.4.3)

Risulta di notevole importanza stabilire sotto quali condizioni esistano curve integrali di un dato campo

vettoriale.

Una prima risposta è fornita dal seguente

Teorema 1.4.1. Sia X un campo vettoriale regolare sulla varietà M e sia p ∈ M. Allora esistono, e

sono unici, un intervallo aperto I = (a, b) ⊂ R, non necessariamente limitato e contenente lo 0, e un

curva αp : I → M tali che:

a) αp (0) = p;

b) αp è una curva integrale di X;

c) se β : (c, d) ⊂ R → M soddisfa a) e b), allora (c, d) ⊂ (a, b) e β = α(c,d) .

Osservazione 1.4.3. La c) dice che la curva αp è definita sull’intervallo più esteso possibile, garantendo

l’unicità.

Possiamo ora definire una funzione che faccia “scorrere i punti di M lungo le curve integrali”.

Definizione 1.4.5. Viene chiamato flusso del campo vettoriale regolare X la funzione

Φt : Ut → M

Φt (p) := αp (t)

(1.4.4)

definita sull’insieme Ut = {p ∈ M | t ∈ (a(p), b(p))}.

Tralasciando le problematiche legate al dominio, questa funzione gode delle seguenti proprietà:

a) Φ0 = 1;

b) Φs ◦ Φt = Φs+t ;

c) Φt è un diffeomorfismo per ogni t, e Φ−1

t = Φ−t .

Su ipotesi di regolarità del dominio, infatti, si ha

Φ

Φ

t

s

p = αp (0) 7−→

αp (t) 7−→

ααp (t) (s);

il punto ααp (t) (s) giace sulla curva integrale passante per αp (t), naturalmente. Ma anche la mappa s 7→

αp (t + s) è una curva integrale passante per lo stesso punto (questo si verifica immediatamente ponendo

s = 0). Il teorema di unicità 1.4.1 garantisce che queste mappe sono la stessa, cioè che ααp (t) (s) = αp (s+t),

cioè la proprietà b). La proprietà a) è banale, mentre la c) è conseguenza di b).

Definizione 1.4.6. Se il dominio della curva integrale αp (t) coincide con R per ogni p ∈ M, il campo

vettoriale X è detto completo.

Un campo vettoriale completo genera una famiglia di flussi {Φt } che gode della struttura di gruppo, ed

è perciò chiamata gruppo a un parametro di trasformazioni su M.

Capitolo 1. Cenni di geometria differenziale

14

1.5

Mappe di inclusione

Ci interessa dare alcune definizioni su come è possibile includere una varietà all’interno di un’altra.

Esistono diverse nozioni di inclusione, a seconda della regolarità che si richiede alla funzione che la

realizza.

Definizione 1.5.1. Sia f : M → N una funzione differenziabile tra una m-varietà M e una n-varietà

N . f è detta immersione se il suo differenziale dfp è non singolare per ogni p ∈ M.

Definizione 1.5.2. Sia f : M → N un’immersione. Se f è una funzione iniettiva (anche detta uno a

uno), allora (M, f ) è detta sottovarietà (o submanifold ).

Definizione 1.5.3. Sia f : M → N un’immersione iniettiva. Se f è inoltre un omeomorfismo tra M e

f (M), allora è detta embedding (o imbedding).

Per comprendere meglio la differenza tra le definizioni, pensiamo di voler applicare l’insieme R all’interno del piano. La più generale immersione sarà una curva regolare qualsiasi, con una parametrizzazione

adeguata che permetta di percorrerla al variare del parametro su tutto R.

Affinché la curva sia anche una sottovarietà è però necessario richiedere l’iniettività: non possono cioè

verificarsi intersezioni o sovrapposizioni di tratti di curva.

Persino questa specificazione non previene però da situazioni patologiche: una curva in cui un estremo si

avvicina asintoticamente a un altro punto appartenente alla curva per il valore del parametro tendente

all’infinito è sì descritta da una funzione iniettiva, ma non è omeomorfa a R (a causa della presenza del

“cappio”).

Se però richiediamo che la funzione d’inclusione sia un embedding, allora la curva risultante avrà effettivamente la medesima topologia di R.

Capitolo 2

Gruppi di Lie

2.1

Definizione ed esempi

In fisica, molte proprietà di simmetria possono essere descritte in modo efficiente adoperando la teoria

dei gruppi di Lie. Questi sono varietà differenziabili che posseggono inoltre la struttura algebrica di

gruppo. Pur essendo i gruppi di Lie in generale oggetti complicati, molte loro proprietà possono essere

indagate effettuando un’“approssimazione lineare” che sfrutta una notevole proprietà di una particolare

classe di campi vettoriali, detti left-invarianti. In questo modo, a ogni gruppo di Lie risulta naturalmente

associata un’algebra di Lie (definizione 1.4.3), le cui proprietà di linearità permettono di semplificare

enormememente lo studio del gruppo, pur preservando la maggior parte delle proprietà del gruppo che si

sta studiando.

Definizione 2.1.1. Sia G una varietà differenziabile. G è un gruppo di Lie se:

a) G è un gruppo1 ;

b) l’operazione di gruppo ∗ è una funzione regolare;

c) la mappa inversa g 7→ g −1 è regolare ∀g ∈ G.

Esempi

• (Rn , +), dove + è l’ordinaria somma tra vettori, è un (banale) gruppo di Lie; lo stesso vale per

(R\{0}, ·) (con l’abituale prodotto tra reali);

• (Cn , +) e (C\{0}, ·), a patto di considerare Cn una 2n-varietà reale (piuttosto che una n-varietà

complessa, della quale non è stata data la definizione e di cui non si tratta in questo corso), sono

allo stesso modo gruppi di Lie;

• La 1-sfera unitaria S1 = {eiϑ , ϑ ∈ R}, assieme alla moltiplicazione complessa mutuata da C\{0}, è

un gruppo di Lie;

• S1 × S1 (toro) è un gruppo di Lie con l’operazione di moltiplicazione componente per componente

mutuata da S1 . Si veda la seguente osservazione per maggiore chiarezza.

Osservazione 2.1.1. Se (G, ∗G ) e (H, ∗H ) sono due gruppi di Lie, allora anche il loro prodotto cartesiano

G × H, unitamente all’operazione di gruppo ∗ definita da

(g 1 , h1 ) ∗ (g 2 , h2 ) := (g 1 ∗G g 2 , h1 ∗H h2 ) ∀(g 1 , h1 ), (g 2 , h2 ) ∈ G × H,

è a sua volta un gruppo di Lie.

1 Cioè esiste un’operazione ∗ : G ×G → G rispetto a cui G è chiuso, la quale è associativa: g∗(h∗k) = (h∗g)∗k ∀g, h, k ∈ G;

ed esiste un elemento e ∈ G, chiamato identità, tale che e ∗ g = g ∗ e = g ∀g ∈ G; e inoltre, a ogni elemento g ∈ G è associato

un elemento g −1 ∈ G, detto inverso di g, tale che g ∗ g −1 = g −1 ∗ g = e. Allora, si dice che la dupla (G, ∗) è un gruppo.

Capitolo 2. Gruppi di Lie

16

Spazio delle matrici invertibili come gruppo di Lie

Diamo inizio al paragrafo osservando che lo spazio delle matrici n × n a elementi reali Mn (R) può essere

metrizzato in modo naturale interpretando il suo generico elemento A come un punto dello spazio euclideo

2

Rn . Definendo infatti la funzione distanza

d(A, B) : Mn (R) × Mn (R) 7→ R

d(A, B) :=

X

|Aij − Bij |2

1/2

,

i,j

si osserva facilmente che (Mn (R), d) è uno spazio metrico completo. È immediato constatare che Mn (R),

2

con questa topologia indotta da Rn , è una varietà differenziabile.

È inoltre facile osservare che il sottoinsieme di Mn (R) costituito dalle matrici non singolari, detto gruppo

lineare generale:

GLn (R) := {A ∈ Mn (R)| det A 6= 0},

assieme alla moltiplicazione tra matrici definita nel modo usuale (riga per colonna), è un gruppo (non

abeliano1 ).

La mappa determinante

det : Mn (R) → R

è ovviamente regolare (essendo un polinomio di grado n). Dato che

GLn (R) = (det)−1 (R\{0}),

ed essendo R\{0} un insieme aperto, allora anche GLn (R) è un aperto2 ; per l’osservazione 1.1.3, dunque,

lo stesso GLn (R) è una varietà.

Notiamo che le operazioni di prodotto matriciale

X

(A, B) 7→ AB = C,

Cij =

Aik Bkj

k

e di matrice inversa3

A 7→ A−1 ,

(A−1 )ij = (det A)−1 (cof A)ji ,

essendo operazioni polinomiali, sono regolari.

Il gruppo lineare generale è pertanto un gruppo di Lie.

1 Un

gruppo è detto abeliano se l’operazione di gruppo è commutativa.

controimmagini di insiemi aperti tramite funzioni continue sono anch’essi aperti.

3 Nella seguente equazione, cof A indica la matrice dei cofattori (o dei complementi algebrici) di A, i cui elementi sono:

(cof A)ij := (−1)i+j (min A)ij , dove (min A)ij è il determinante della matrice quadrata ottenuta rimuovendo da A l’i-esima

riga e la j-esima colonna.

2 Le

2.2. Campi left-invarianti e algebre di Lie associate

2.2

17

Campi left-invarianti e algebre di Lie associate

Sia (G, ·) un gruppo di Lie; definiamo le mappe G → G

Lg : g 0 7→ gg 0

Rg : g 0 7→ g 0 g

(traslazione left)

(traslazione right),

per ogni g ∈ G. Questi sono diffeomorfismi, essendo regolari ed essendo il loro inverso dato da L−1

g = Lg −1

(e similmente per R). Scegliamo di concentrare l’attenzione sulla mappa L (non farebbe alcuna differenza

scegliere invece R).

Definizione 2.2.1. Sia X : G → T G un campo vettoriale. X è detto left-invariante se

dLg (X) = X ◦ Lg

∀g ∈ G.

Questo vuol dire che si ottiene lo stesso risultato valutando prima il campo in un punto g 0 ∈ G e poi

spostando il vettore tramite dLg , o prima spostandosi da g 0 a gg 0 (tramite Lg ) e poi valutando il campo.

In formule, possiamo scrivere questa constatazione nella forma

Xgg0 = dLg (Xg0 ) ∀g, g 0 ∈ G.

(2.2.1)

Notiamo che la formula 2.2.1 implica che il campo left-invariante X è completamente determinato dal suo

valore nel punto identità e di G. Infatti, prendiamo g 0 = e; allora si vede che

Xg = dLg (Xe ),

il che definisce il valore del campo in qualunque punto g ∈ G semplicemente “trasportando” il vettore Xe

tramite la mappa di traslazione L.

In effetti, esiste una vera e propria corrispondenza biunivoca tra i campi left-invarianti definiti su G e i

vettori tangenti al punto e, come verrà stabilito tra poche righe.

Prima di enunciare tale risultato, tuttavia, è possibile compiere alcune osservazioni. Denotiamo con L

l’insieme dei campi left-invarianti su G.

Osservazione 2.2.1. L è uno spazio vettoriale; in virtù delle proprietà di linearità dei campi vettoriali,

infatti, segue immediatamente che la combinazione lineare di due campi left-invarianti è anch’essa un

campo left-invariante.

Osservazione 2.2.2. I campi appartenenti a L sono necessariamente regolari.

Enunciamo ora il fondamentale teorema cui si accennava in precedenza, cominciando con un lemma.

Lemma 2.2.1. Siano f : M → N e g : N → P funzioni regolari tra varietà. Allora

d(g ◦ f ) = dg ◦ df.

Dimostrazione. Osserviamo innanzitutto che, come da definizione,

d(g ◦ f )p : Tp (M) → T(g◦f )(p) (P).

Applichiamo questo differenziale a un generico vettore v ∈ Tp (M), ottenendo così un funzionale in

T(g◦f )(p) (P), e consideriamo una funzione regolare ψ ∈ F(P); per definizione, l’azione del differenziale

sopra scritto su tale funzione è

d(g ◦ f )p (v) : ψ 7→ v(ψ ◦ (g ◦ f )).

D’altronde,

(dgf (p) ◦ dfp )(v) : ψ 7→ dfp (v)(ψ ◦ g) = v((ψ ◦ g) ◦ f ),

e dato che (ψ ◦ g) ◦ f = ψ ◦ (g ◦ f ) si ottiene la tesi.

Teorema 2.2.2. La mappa X 7→ Xe è un isomorfismo tra gli spazi vettoriali L e Te (G).

Capitolo 2. Gruppi di Lie

18

Dimostrazione. La linearità della mappa si deduce dal fatto che i campi vettoriali valutati in un punto sono

funzioni lineari. Proviamo dapprima l’iniettività. Supponiamo che X e Y siano due campi left-invarianti

e coincidenti nel punto e; allora, sfruttando la left-invarianza:

Xg = dLg (Xe ) = dLg (Ye ) = Yg

∀g ∈ G,

cioè X = Y. Dimostriamo ora che la mappa è suriettiva. Consideriamo un vettore qualunque v ∈ Te (G);

definiamo il campo vettoriale Xv dato da

Xvg := dLg (v) ∀g ∈ G;

(2.2.2)

il valore di questo campo nell’identità è1

Xve = dLe (v) = d(1)(v) = v,

cosicché v è in effetti l’immagine della mappa Xv 7→ Xve ; il campo è inoltre left-invariante in quanto

Xvgg0 = dLgg0 (v) = d(Lg ◦ Lg0 )(v) = (dLg ◦ dLg0 )(v) = dLg (Xvg0 ) ∀g, g 0 ∈ G

(dove s’è fatto uso del lemma 2.2.1), il che conclude la dimostrazione.

Il seguente teorema afferma che lo spazio L può essere dotato della struttura di algebra di Lie (vedi

definizione 1.4.3).

Teorema 2.2.3. Se X e Y sono campi left-invarianti, allora anche la loro parentesi di Lie [X, Y], definita

come in 1.4.2, è left-invariante.

Dimostrazione. Per ipotesi, X, Y ∈ L; dobbiamo mostrare che [X, Y] ∈ L, vale a dire che

dLg ([X, Y]g0 ) = [X, Y]gg0

∀g, g 0 ∈ G.

Applicando ripetutamente la definizione 1.3.1 di differenziale e la proprietà 2.2.1 di left-invarianza dei

campi, otteniamo la seguente catena di uguaglianze (dove f è una qualunque funzione regolare G → R):

dLg ([X, Y]g0 )(f ) = [X, Y]g0 (f ◦ Lg ) = Xg0 (Y(f ◦ Lg )) − Yg0 (X(f ◦ Lg )) =

= Xg0 (dLg (Y)(f )) − Yg0 (dLg (X)(f )) = Xg0 (Y(f ) ◦ Lg ) − Yg0 (X(f ) ◦ Lg ) =

= dLg (Xg0 )(Y(f )) − dLg (Yg0 )(X(f )) = Xgg0 (Y(f )) − Ygg0 (X(f )) = [X, Y]gg0 (f ).

L è detta algebra di Lie associata al gruppo di Lie G. Il teorema 2.2.2, d’altra parte, garantisce che tale

spazio è isomorfo a Te (G); tramite detto isomorfismo, è possibile dotare in maniera naturale della struttura

di algebra di Lie lo stesso Te (G). Questo viene ottenuto definendo la parentesi di Lie sullo spazio tangente:

(u, v) ∈ Te (G) × Te (G) 7→ [u, v] := [Xu , Xv ]e ∈ Te (G),

dove Xu e Xv sono definiti dalla 2.2.2. In pratica, passiamo dai vettori u, v definiti sullo spazio tangente

ai campi vettoriali Xu , Xv a essi associati via isomorfismo, e di cui sappiamo effettuare la parentesi di Lie;

quindi, passiamo nuovamente allo spazio tangente valutando il campo vettoriale così ottenuto nel punto

e.

1 Il

differenziale della funzione identità

1 è a sua volta l’identità.

2.2. Campi left-invarianti e algebre di Lie associate

19

Esempi

• Come abbiamo già constatato, (R, +) è un gruppo di Lie. Cerchiamo i suoi campi left-invarianti. Il

più generale campo vettoriale definito su R è della forma:

d Xt = λ(t) ;

dr t

la richiesta di left-invarianza si scrive

Xt = dLt (X0 ),

cioè

Xt (f ) = dLt (X0 )(f ) = X0 (f ◦ Lt ) ∀f : R → R regolare

df (r) d(f (t + r)) λ(t)

= λ(0)

;

dr dr

t

0

le derivate sono chiaramente uguali per ogni t, per cui, in definitiva:

λ(t) = λ(0),

e questo deve valere ∀t. X è pertanto left-invariante se e solo se

d Xt = λ , λ ∈ R.

dr t

Le parentesi di Lie sono triviali:

d

d

d d ,

λ1 , λ2 = λ1 λ2

= 0;

dr t

dr t

dr t dr t

questo caratterizza l’algebra di Lie su (R, +) come abeliana, la più semplice possibile.

2.2.1

Algebra associata al gruppo lineare generale delle matrici

Come abbiamo visto nel paragrafo 2.1, (GLn (R), ·) è un gruppo di Lie; ci interessa studiare l’algebra di Lie

gln (R) a esso associata. Il teorema d’isomorfismo assicura che1 gln (R) ∼ Te (GLn (R)). L’insieme GLn (R)

è un aperto in Mn (R), per cui e è interno a GLn (R): questo implica che Te (GLn (R)) = Te (Mn (R)), dato

che la definizione di spazio tangente a un punto dipende esclusivamente dai valori assunti dalle funzioni

in un intorno del punto (e questo è comune a GLn (R) e Mn (R)).

Apriamo una parentesi generale sugli spazi vettoriali per una constatazione che useremo a breve.

Consideriamo uno spazio vettoriale n-dimensionale V sul campo reale; fissata una sua base {e1 , . . . , en },

chiamiamo {e1 , . . . , en } la sua base duale, definita da ei (ej ) := δji . Notiamo che {(V, φ)}, dove

φ : V → Rn

v i ei 7→ (v 1 , . . . , v n ),

è in effetti un atlante per lo spazio V , con le ei che svolgono il ruolo di funzioni coordinate (globali), in

quanto

ei (v) = v i = (ri ◦ φ)(v)

(con la definizione 1.1.1). Pertanto, ogni spazio vettoriale è automaticamente una varietà.

1 Indichiamo

con ∼ un isomorfismo tra due spazi (a priori, spazi vettoriali; ma possibilmente anche algebre).

Capitolo 2. Gruppi di Lie

20

Lo spazio tangente a uno spazio vettoriale può essere identificato con lo spazio stesso. Il generico funzionale

su Tv (V ) (per qualche v ∈ V ) si scrive infatti:

∂ ,

a = ai

∂ei v

e a questo corrisponde tramite isomorfismo (teorema di Riesz) il vettore ai ei ∈ V di componenti ai = ai .

Si ha pertanto Tv (V ) ∼ V ∀v ∈ V .

Applichiamo queste considerazioni al caso in questione. Lo spazio Mn (R) (a differenza di GLn (R)) è uno

spazio vettoriale, perciò Te (Mn (R)) ∼ Mn (R). Possiamo riassumere la catena di isomorfismi in

gln (R) ∼ Mn (R).

Questo è a priori un isomorfismo di spazi vettoriali, cosicché nulla ci assicura che la struttura di algebra

di Lie sia preservata nel passaggio dall’algebra gln (R) allo spazio Mn (R); in realtà, lo spazio Mn (R) può

essere strutturato come algebra di Lie definendo su di esso l’operazione:

[A, B] := AB − BA ∀A, B ∈ Mn (R)

(commutatore tra A e B), che si verifica essere una parentesi di Lie.

Bisogna mostrare che l’isomorfismo sopra stabilito preserva le parentesi di Lie; fissiamo prima di tutto la

notazione, scrivendo:

gln (R) ∼ Te (GLn (R)) = Te (Mn (R)) ∼ Mn (R)

X 7→ Xe

v 7→ α(v),

con (α(v))ij := v(xij ) (cioè α(v) è la matrice che ha le stesse componenti del vettore v, visto come

2

funzionale su Rn – le cui n2 funzioni coordinate sono xij ).

Va dimostrato che, dato l’isomorfismo

β : X 7→ α(Xe ),

vale la proprietà

β([X, Y]) = [β(X), β(Y)] ∀X, Y ∈ gln (R).

Dimostrazione. Passiamo alle componenti. Si ha, per definizione (rispettivamente) di β, α e di parentesi

di Lie:

(β([X, Y]))ij = (α([X, Y]e ))ij = [X, Y]e (xij ) = Xe (Y(xij )) − Ye (X(xij )).

Osserviamo che il valore della funzione Y(xij ) nel punto A ∈ GLn (R) è (per la left-invarianza di Y)

YA (xij ) = dLA (Ye )(xij ) = Ye (xij ◦ LA );

la funzione xij ◦ LA è caratterizzata dall’azione

GLn (R) → R

B 7→ (AB)ij ,

P

P

con (AB)ij = k Aik Bkj = k xik (A)xkj (B) (per definizione di funzione coordinata xij ). Possiamo ora

applicare il vettore Ye a questa funzione e scriverne l’azione implicitamente “nascondendo” B nel seguente

modo (ricordando la linearità di Ye ):

X

X

X

YA (xij ) = Ye (xij ◦ LA ) =

xik (A)Ye (xkj ) =

xik (A) (α(Ye ))kj =

xik (A) (β(Y))kj .

k

k

k

Si ha pertanto (“nascondendo” anche A) che

X

X

X

Xe (Y(xij )) =

Xe (xik ) (β(Y))kj =

(α(Xe ))ik (β(Y))kj =

(β(X))ik (β(Y))kj .

k

k

k

2.2. Campi left-invarianti e algebre di Lie associate

21

Poiché un analogo conto vale ovviamente per Ye (X(xij )), e per la linearità dei campi, possiamo concludere

che:

(β([X, Y]))ij =

o

Xn

(β(X))ik (β(Y))kj − (β(Y))ik (β(X))kj =

= Xe (Y(xij )) − Ye (X(xij )) =

k

= [β(X), β(Y)] ij .

Questo dimostra che gln (R) coincide (via isomorfismo) con Mn (R), con il commutatore tra matrici a

svolgere il ruolo di parentesi di Lie sullo spazio.

Osservazione 2.2.3. Quanto visto per le matrici può essere pensato equivalentemente in termini di

operatori lineari agenti su uno spazio vettoriale V di dimensione n. In quest’ottica1

Mn (R) ∼ End(V )

con [O1 , O2 ] := O1 ◦ O2 − O2 ◦ O1

∀O1 , O2 ∈ End(V ).

Lo spazio degli automorfismi2 Aut(V ), assieme alla composizione di funzioni ◦, è un gruppo di Lie

(isomorfo a GLn (R)); la sua algebra di Lie è End(V ) (isomorfo a Mn (R)).

Osservazione 2.2.4. Possiamo estendere le considerazioni fatte su GLn (R) a GLn (C); in questo modo,

l’algebra di Lie del gruppo è (isomorfa a) Mn (C); occorre però tener presente che questi gruppi di Lie

(e le corrispettive algebre di Lie) sono pensati come spazi reali (di dimensione 2n2 ), piuttosto che come

spazi complessi di dimensione n2 .

1 Si denota con End(V ) lo spazio vettoriale n2 -dimensionale degli endomorfismi di V ; un endomorfismo di V è

un’applicazione lineare da V in se stesso.

2 Un automorfismo è un endomorfismo invertibile.

Capitolo 2. Gruppi di Lie

22

2.3

2.3.1

Sottogruppi e sottoalgebre di Lie

Morfismi di gruppi e algebre di Lie

Per prima cosa, è necessario definire con precisione i morfismi tra gruppi di Lie e tra algebre di Lie, di

cui si è già fatto menzione in precedenza.

Cominciamo dalle definizione dei morfismi tra gruppi di Lie.

Definizione 2.3.1. Una mappa tra gruppi di Lie ϕ : G → H è detta omomorfismo di gruppi di Lie se è

una mappa regolare e anche un omomorfismo tra gruppi (in senso algebrico1 ) .

Se ϕ è inoltre un diffeomorfismo2 , essa è detta isomorfismo di gruppi di Lie.

Se G = H, essa è detta automorfismo di gruppi di Lie.

Diamo l’importante definizione di rappresentazione di un gruppo di Lie.

Definizione 2.3.2. Se ϕ è un omomorfismo tra i gruppi di Lie G e H, e se H = Aut(V ) (V spazio

vettoriale), o equivalentemente se H = GLn (R) oppure H = GLn (C), allora ϕ è chiamata rappresentazione

del gruppo G.

Analoghe definizioni valgono per i morfismi tra algebre di Lie.

Definizione 2.3.3. Una mappa tra algebre di Lie ψ : g → h è detta omomorfismo di algebre di Lie

se è un’applicazione lineare e se preserva l’operazione di parentesi di Lie, ossia se [ψ(g1 ), ψ(g2 )]h =

ψ([g1 , g2 ]g ) ∀g1 , g2 ∈ g.

Se ψ è inoltre una biiezione, essa è detta isomorfismo di algebre di Lie.

Se g = h, essa è detta automorfismo di algebre di Lie.

Analoga anche la definizione di rappresentazione dell’algebra.

Definizione 2.3.4. Se ψ è un omomorfismo tra le algebre di Lie g e h, e se h = End(V ) (V spazio

vettoriale), o equivalentemente se h = gln (R) ovvero h = gln (C), allora ψ è chiamata rappresentazione

dell’algebra g.

Una rappresentazione di un gruppo induce in modo naturale una rappresentazione dell’algebra a esso

associata. Vale infatti il seguente

Teorema 2.3.1. Se ϕ : G → H è un omomorfismo di gruppi di Lie, allora dϕe è un omomorfismo tra le

algebre di Lie g e h.

Dimostrazione. Sia X un campo vettoriale left-invariante su G; per il teorema 2.2.2, si ha che Xe ∈ Te (G)

in modo biunivoco. Sia dϕ(X) l’unico campo left-invariante su H tale che3 dϕ(X)e0 = dϕ(Xe ), e chiamiamo

per brevità X̃ := dϕ(X); in questo modo X̃e0 = dϕ(Xe ).

Vale la proprietà

X̃ϕ(g) = dϕ(Xg ) ∀g ∈ G;

infatti, sfruttando la left-invarianza e il lemma 2.2.1, si ha

X̃ϕ(g) = dLϕ(g) (X̃e0 ) = (dLϕ(g) ◦ dϕ)(Xe ) = d(Lϕ(g) ◦ ϕ)(Xe ).

Osserviamo adesso che

Lϕ(g) ◦ ϕ : g 0 7→ ϕ(g)ϕ(g 0 ) = ϕ(gg 0 ) ∀g, g 0 ∈ G,

cosicché possiamo scrivere

d(Lϕ(g) ◦ ϕ)(Xe ) = d(ϕ ◦ Lg )(Xe ) = (dϕ ◦ dLg )(Xe ) = dϕ(Xg ).

1 Un omomorfismo tra due gruppi (algebrici) (G, +) e (H, ∗) è un’applicazione lineare f : G → H che preserva l’operazione

di gruppo, ossia tale che f (g1 ) ∗ f (g2 ) = f (g1 + g2 ) ∀g1 , g2 ∈ G.

2 Con ciò si intende che ϕ ammette inversa regolare.

3 Indichiamo con e l’elemento identità di G, e con e0 quello di H.

2.3. Sottogruppi e sottoalgebre di Lie

23

La proprietà appena dimostrata può essere scritta nella forma:

X̃ ◦ ϕ = dϕ ◦ X;

ricordiamo che dobbiamo dimostrare che1

^

[X,

Y] := dϕ([X, Y]) = [dϕ(X), dϕ(Y)] =: [X̃, Ỹ].

Procediamo con la dimostrazione avvalendoci della proprietà sopra dimostrata (qui f è una qualunque

funzione regolare sul gruppo G):

dϕ([X, Y]e )(f ) = [X, Y]e (f ◦ ϕ) = Xe (Y(f ◦ ϕ)) − Ye (X(f ◦ ϕ)) = Xe (dϕ(Y)(f )) − Ye (dϕ(X)(f )) =

= Xe (Ỹ(f ) ◦ ϕ) − Ye (X̃(f ) ◦ ϕ) = dϕ(Xe )(Ỹ(f )) − dϕ(Ye )(X̃(f )) = X̃e0 (Ỹ(f )) − Ỹe0 (X̃(f )) =

= [X̃, Ỹ]e0 (f ).

Nella penultima eguaglianza si è utilizzato il fatto che, essendo ϕ un omomorfismo, vale ϕ(e) = e0 .

Abbiamo dunque dimostrato che immagine della parentesi [X, Y]e mediante la mappa ϕ coincide con la

parentesi delle immagini [X̃, Ỹ]e0 , ossia che ϕ preserva le parentesi di Lie tra le algebre.

Osserveremo in seguito che, benché il teorema garantisca che a partire da ogni isomorfismo di gruppi può

essere trovato un corrispettivo isomorfismo di algebre, non è vero il contrario.

2.3.2

Sottogruppi e sottoalgebre di Lie

Definizione 2.3.5. Sia G un gruppo di Lie. La dupla (H, ϕ) è detta sottogruppo di Lie di G se:

a) H è un gruppo di Lie;

b) (H, ϕ) è una sottovarietà di G;

c) ϕ è un omomorfismo di gruppi di Lie.

Se vale inoltre la proprietà

d) ϕ(H) è un sottoinsieme chiuso di G,

si dice che (H, ϕ) è un sottogruppo chiuso di G.

I sottogruppi di Lie possono essere individuati cercando i sottogruppi in senso algebrico 2 del gruppo di

Lie. Questo viene mostrato dal seguente

Teorema 2.3.2. Sia H un sottoinsieme chiuso e un sottogruppo (algebrico) di G. Allora H è anche una

sottovarietà e (quindi) un sottogruppo di Lie di G.

Sottogruppi “classici”

In forza del teorema appena enunciato, individuiamo immediatamente una serie di sottogruppi di grande

rilevanza.

• SLn (R) := {A ∈ GLn (R)| det A = 1}, il gruppo lineare speciale, è un sottogruppo di Lie di GLn (R);

infatti, esso è un suo sottogruppo algebrico, ed è chiuso in quanto controimmagine, tramite la

funzione regolare “determinante”, del sottoinsieme chiuso3 {1}.

1 Si

presti attenzione al fatto che usiamo lo stesso simbolo [, ] per denotare le parentesi di Lie definite su g e su h.

Se G è un gruppo algebrico e H un suo sottoinsieme, H è detto sottogruppo di G se non è vuoto, se è chiuso rispetto

all’operazione di gruppo di G ristretta su H e se contiene l’inverso di ogni suo elemento.

3 Le controimmagini tramite funzioni continue di insiemi chiusi sono a loro volta insiemi chiusi; si confronti il paragrafo

2.1.

2

Capitolo 2. Gruppi di Lie

24

• O(n) := {A ∈ GLn (R)|AAT = I}, il gruppo ortogonale, è un sottogruppo di Lie di GLn (R); infatti,

la mappa f : A 7→ A−1 − AT da GLn (R) → Mn (R) è regolare, e

O(n) = f −1 ({0}).

• In modo analogo sono sottogruppi di Lie (di GLn (R) o di GLn (C)):

U(n) := {A ∈ GLn (C)|AA† = I},

gruppo unitario;

0n In

Sp(n) := {A ∈ U(2n)|AT J = JA−1 , J := −I

}, gruppo simplettico;

n 0n

SO(n) := {A ∈ O(n)| det A = 1},

SU(n) := {A ∈ U(n)| det A = 1},

gruppo speciale ortogonale;

gruppo speciale unitario.

Diamo ora la corrispondente definizione di sottoalgebra; questa è più semplice, dato che trattiamo con

spazi lineari (non dobbiamo preoccuparci della struttura differenziabile).

Definizione 2.3.6. Sia g un’algebra di Lie; un sottospazio h ⊂ g è detto sottoalgebra di Lie di g se

X, Y ∈ h =⇒ [X, Y] ∈ h.

Esempi

• O(2) = {A ∈ GL2 (R)|AAT = I} e SO(2) = O(2) ∩ SL2 (R).

Osserviamo che per il teorema di Binet AAT = I =⇒ det A det AT = 1 =⇒ (det A)2 = 1 =⇒

det A = ±1. Quindi il gruppo O(2) consta di due parti separate, una della quali è proprio SO(2).

Si trova che, detta A la generica matrice di O(n), la condizione AAT = I implica

a b

a) A =

con a2 + b2 = 1;

−b a

oppure

b) A =

a

b

b

−a

con a2 + b2 = 1;

(c’è un parametro libero rimanente, il che caratterizza i due insiemi come 1-varietà).

Se ora decido di passare all’algebra associata o(2), ogni informazione circa l’insieme definito dal

caso b) viene perduta; questo si circostanzia nel fatto che addirittura o(2) = so(2). In generale,

ogniqualvolta il gruppo di Lie consti di componenti topologicamente separate, il passaggio all’algebra associata elide tutte le informazioni riguardo a ogni componente connessa diversa da quella

contenente l’elemento identità – in questo caso, la matrice I. Avremo modo di osservare questo più

esplicitamente tra poco.

Che gli insiemi definiti da a) e b) siano separati è facile da osservare: affinché una matrice appartenga

a entrambi gli insiemi (entrambi chiusi), è infatti necessario che

a = −a =⇒ a = 0; ma

sia

0 1

01

allora b = 1, e le matrici ottenute sono rispettivamente −1

0 e 1 0 , che sono diverse (quindi

l’intersezione tra i due insiemi è vuota). è evidente che l’identità appartiene all’insieme definito da

a).

Osserviamo esplicitamente che la distanza1 tra una matrice A appartenente a SO(2) (caso a)) e

l’identità è pari a

p

√

d(A, I) = (a − 1)2 + b2 + (−b)2 + (a − 1)2 = 2 1 − a,

1 Vedi

paragrafo 2.1 per questa definizione di distanza.

2.3. Sottogruppi e sottoalgebre di Lie

25

e può pertanto essere ridotta arbitrariamente variando il parametro libero a; quella tra una matrice

B ∈ O(2)\SO(2) (caso b)) e l’identità, invece, è costante:

p

d(B, I) = (a − 1)2 + b2 + b2 + (−1 − a)2 = 2.

Studiamo esplicitamente l’algebra o(2): parametrizziamo la generica matrice A ∈ SO(2) facendo

sì che, per il valore nullo del parametro scelto, la matrice A coincida con l’identità. La scelta più

naturale è, in questo caso:

cos x sin x

A=

.

− sin x cos x

Questa parametrizzazione copre l’intero SO(2). Lo spazio tangente all’identità è 1-dimensionale, e

il suo generatore è

dA 0 1

=

,

T =

−1 0

dx 0

cosicché l’algebra in questione è:

so(2) = {λT | λ ∈ R} = {matrici 2 × 2 antisimmetriche};

Come tutte le algebre 1-dimensionali, o(2) è abeliana.

Abbiamo ora modo di constatare che questa algebra è identica all’algebra associata a (R, +) che

abbiamo visto nell’esempio della sezione 2.2; questo ci segnala che l’algebra di Lie associata a un

gruppo può non riuscire a distinguere gruppi molto diversi tra loro quali (R, +) e (O(2), ·).

• SU(2) = {A ∈ GL2 (C)|AA† = I, det A = 1}; si trova che le matrici appartenenti a SU(2) sono della

forma

α β

A=

, con α, β ∈ C, |α|2 + |β|2 = 1;

−β̄ ᾱ

notiamo che i parametri liberi sono ora tre, per cui l’algebra associata sarà a sua volta 3-dimensionale.

Si può dimostrare che, se α = α1 + iα2 e β = β1 + iβ2 , vale

√

d(A, I) = 2 1 − α1 .

Parametrizzando lo spazio tangente con (x1 , x2 , x3 ), e assicurandosi di centrare la parametrizzazione

sulla matrice identità nel seguente modo:

r

1

1

1

1

α2 = x3 , β1 = x2 , β2 = x1 , α1 = 1 − (x21 + x22 + x23 ),

2

2

2

4

si ottiene la base dello spazio:

∂A 0 i/2

=

;

i/2 0

∂x1 0

∂A 0

1/2

T2 =

=

;

−1/2 0

∂x2 0

∂A i/2

0

T3 =

=

;

0 −i/2

∂x1 0

T1 =

queste sono matrici proporzionali alle matrici di Pauli σj :

Tj =

i

σj ,

2

e formano una base per l’algebra

su(2) = {matrici antihermitiane a traccia nulla}.

Capitolo 2. Gruppi di Lie

26

Sono soddisfatte le relazioni di commutazione:

[Ti , Tj ] = −εij k Tk ,

(2.3.1)

dove εij k è un tensore totalmente antisimmetrico, detto di Levi-Civita, tale che ε123 = 1.

Osserviamo che le parentesi di Lie degli elementi di base determinano quelle di ogni altro elemento

dello spazio; dal fatto che non sono nulle deduciamo che su(2) è un’algebra non abeliana.

2.3.3

Sottogruppi a un parametro

Definizione 2.3.7. Un omomorfismo ϕ : R → G tra i gruppi di Lie (R, +) e (G, ·) è chiamato sottogruppo

a un parametro di G.

Le proprietà di omomorfismo sono scritte come:

a) ϕ(t + s) = ϕ(t)ϕ(s);

b) ϕ(0) = e;

c) ϕ−1 (t) = ϕ(−t).

Diamo esplicitamente alcuni esempi.

Esempi

• ϕ(t) = et è un sottogruppo a un parametro del gruppo di Lie (R\{0}, ·) in quanto es+t = es et ;

• ϕ(t) = eit è un sottogruppo a un parametro del gruppo di Lie (S1 , ·);

cos t sin t

• ϕ(t) =

è un sottogruppo a un parametro di SO(2) e di SU(2);

− sin t cos t

cos t sin t 0

• ϕ(t) = − sin t cos t 0 è un sottogruppo a un parametro di GL3 (R);

0

0

et

Siamo interessati ai sottogruppi a un parametro perché esiste una corrispondenza biunivoca tra i vettori

tangenti all’identità e i sottogruppi a un parametro di un dato gruppo di Lie. L’algebra di Lie associata,

quindi, può equivalentemente essere pensata come lo spazio dei sottogruppi a un parametro del gruppo.

Osserveremo come questo ci permetta, in una certa misura, di “tornare” al gruppo dopo essere passati da

esso all’algebra associata.

Teorema 2.3.3. La mappa

ϕ 7→ ϕ̇(0) = dϕ

d dr t=0

è una corrispondenza biunivoca tra l’insieme dei sottogruppi a un parametro di G e gli elementi dello

spazio tangente Te (G) ∼ g.

Dimostrazione. La mappa è ovviamente iniettiva in quanto a ogni omomorfismo ϕ corrisponde uno e un

solo vettore ϕ̇(0) (il vettore tangente alla curva t 7→ ϕ(t) nel punto ϕ(0)).

Dimostriamo che la mappa è suriettiva. A questo scopo, consideriamo un qualunque elemento v ∈ Te (G),

e associamo a esso il campo Xv definito dall’equazione 2.2.2; definiamo ϕv : R → G come l’unica curva

integrale di Xv tale che ϕv (0) = e (questa curva esiste per il teorema 1.4.1).

Per definizione, si ha ϕ̇v (t) = Xvϕv (t) ; in quanto curva integrale, ϕv soddisfa le richieste proprietà di

omomorfismo. Bisogna dimostrare che essa è definita sull’intera retta reale.

Consideriamo le due curve:

t 7→ ϕv (s + t);

2.3. Sottogruppi e sottoalgebre di Lie

27

t 7→ ϕv (s)ϕv (t) =: ψs (t);

queste sono entrambe curve integrali, in quanto, per la prima, vale

ϕ̇v (t) = Xϕv (t) =⇒ ϕ̇v (s + t) = Xϕv (s+t) ,

e, per la seconda, tenendo conto della left-invarianza del campo Xv :

Xvψs (t)

=

Xvϕv (s)ϕv (t)

=

dLϕv (s) (Xvϕv (t) )

= d(Lϕv (s) ◦ ϕv )

= dLϕv (s) (ϕ̇v (t)) = (dLϕv (s) ◦ dϕv )

d =

dr t

d d = dψs

= ψ̇s (t).

dr t

dr t

Dato che entrambe le curve passano per il punto ϕv (s) per t = 0, esse coincidono. Notiamo che, se la

curva ϕv è definita almeno fino al valore del parametro s, allora la curva ψs è ben definita per ogni valore

di t ∈ (0, s), il che permette di estendere la stessa ϕv fino al valore 2s del parametro (tramite l’identità

ϕv (s + t) = ψs (t)), e, iterando il procedimento, su tutto R.

Corollario 2.3.4. Ogni campo left-invariante è completo.

Dimostrazione. Ricordiamo che ogni campo left-invariante può essere considerato un campo Xv (secondo

la definizione 2.2.2) per qualche v ∈ Te G; consideriamo un elemento g ∈ G, e la curva

t 7→ Lg ◦ ϕv (t)

(la curva integrale per e traslata di g). Allora, se ψ(t) = Lg ◦ ϕv (t), applicando il ragionamento della

dimostrazione precedente con ψ(t) in luogo di ψs (t), si ha:

d v

v

Xψ(t) = XLg ◦ϕv (t) = d(Lg ◦ ϕv (t))

= ψ̇(t).

dr t

ψ è definita su tutto R, ed è la curva integrale passante per il punto g.

2.3.4

La mappa esponenziale

Abbiamo visto che, dato un campo X ∈ g (commettiamo un leggero abuso di notazione identificando il

campo vettoriale X con il vettore Xe ), questo determina un sottogruppo a un parametro ϕX di G, con

ϕ̇X (0) = Xe ∼ X.

Definizione 2.3.8. La mappa esponenziale

exp : g → G

è la mappa che associa a ogni X ∈ g l’elemento di G dato da

exp(X) := ϕX (1).

Per un motivo che apparirà chiaro tra poco, cerchiamo la relazione tra ϕX e ϕsX , con s ∈ R. Consideriamo

la mappa

h : t 7→ ϕX (st);

h è un sottogruppo a un parametro

di G perché lo è ϕX , e ḣ(t) = sϕ̇X (st) (ricordando che se α(t) è un

d curva, α̇(t) è la mappa f 7→ dr

(f

◦

α)). Quindi

t

ḣ(0) = sϕ̇X (0) = sX;

d’altra parte,

ϕ̇sX (0) = sX,

Capitolo 2. Gruppi di Lie

28

per cui, per il teorema di unicità 1.4.1, si ha h = ϕsX , ossia

ϕX (st) = ϕsX (t) ∀s, t ∈ R.

Inserendo t = 1, e rinominando s in t, otteniamo in particolare ϕX (t) = ϕtX (1), ossia

exp(tX) = ϕX (t).

La curva individuata dal campo X (cioè, ricordiamo, da Xe ) è proprio la curva exp(tX). Le proprietà di

omomorfismo si possono scrivere ora nella forma familiare:

a) exp(0) = e;

b) exp(sX) exp(tX) = exp((s + t)X);

c) exp−1 (tX) = exp(−tX).

Osservazione 2.3.1. Quello che abbiamo ricavato in maniera formale si può anche trovare in maniera

“naïve” nel caso di gruppi di matrici: consideriamo un sottogruppo a un parametro di matrici T (t), che

perciò soddisfi

T (s)T (t) = T (s + t), T (0) = I;

allora

T (s) − I

T (s + t) − T (t)

= T (t) lim

= T (t)Ṫ (0),

s→0

s

s

che è un’equazione differenziale ordinaria la cui soluzione è

Ṫ (t) = lim

s→0

T (t) = etṪ (0) .

La mappa esponenziale è il modo per “recuperare” il gruppo dopo essere passati da esso all’algebra

corrispondente. Come abbiamo già avuto modo di osservare, tuttavia, il passaggio all’algebra associata

comporta la perdita di alcune informazioni riguardanti il gruppo (ad esempio, si perde l’informazione

circa le componenti non connesse all’identità; in effetti, le curve generate dalla mappa esponenziale non

possono raggiungere tali componenti).

Calcoliamo ora il differenziale della mappa esponenziale, cominciando con un’osservazione utile di carattere generale.

Osservazione 2.3.2. Sia f : M → N una funzione regolare tra varietà, e sia p ∈ M. Un modo per

calcolare df consiste nel considerare l’immagine, tramite f , di una curva α su M passante per p. Allora,

se β(t) = f (α(t)), α(0) = p, β(0) = f (p), si ha

v = α̇(0) =⇒ w = β̇(0) = dfp (v).

Questo può risultare un metodo comodo per calcolare il differenziale di una funzione.

Infatti

dfp (v)(ψ) = v(ψ ◦ f ) ∀ψ ∈ F(N );

d

d

β̇(0)(ψ) = (ψ ◦ β) = (ψ ◦ f ◦ α) = α̇(0)(ψ ◦ f ) = v(ψ ◦ f ) = dfp (v)(ψ),

dt

dt

0

0

da cui si deduce che dfp (v) = β̇(0).

Consideriamo ora la curva α : t 7→ tX in g (retta per l’origine). Allora evidentemente α(0) = 0, α̇(0) = X;

secondo la considerazione di cui sopra, si ha quindi

d

d

(d exp)0 (X) = (exp ◦α) = (exp(tX)) = X.

dt

dt

0

0

Perciò

(d exp)0 = 1g ,

il che implica che la mappa esponenziale è localmente invertibile, avendo differenziale non singolare nel

punto 0.

Esprimiamo questa conclusione nel seguente

2.3. Sottogruppi e sottoalgebre di Lie

29

Teorema 2.3.5. La mappa esponenziale è un diffeomorfismo tra un intorno di 0 in g e un intorno di e

in G.

In altre parole, ogni elemento X ∈ g genera un sottogruppo a un parametro di G tramite la mappa

esponenziale t 7→ exp(tX); e viceversa, ogni elemento A ∈ G in un intorno di e appartiene a un sottogruppo

a un parametro di G, cioè A = exp X in un opportuno intorno di e per qualche X ∈ g.

Esempi

• Se A è una matrice, la mappa esponenziale coincide con l’esponenziazione matriciale ordinaria:

1

exp A = eA := I + A + A2 + · · · ;

2

infatti:

– eA converge per ogni A: sia µ ∈ R tale che |xij (A)| ≤ µ ∀i, j; allora si dimostra facilmente

per induzione che |xij (Aj )| ≤ (nµ)j ∀j = 1, 2, . . . , da cui

X |xij (Aj )|

j

j!

≤

X (nµ)j

j

j!

< +∞;

– ϕ : t 7→ etA è un sottogruppo a un parametro di GLn (R), poiché

a) e

sA tA

e

=

tA −1

+∞ X

+∞

X

j=0 k=0

−tA

b) (e ) = e

c) e0 = I;

+∞

X 1

1

tk sj−k Aj =

(t + s)j Aj = e(t+s)A ;

k!(j − k)!

j!

j=0

(quindi eA è invertibile);

– ϕ̇(0) = A =⇒ etA = exp (tA).

• Considero il gruppo di Lie SO(3) = {A ∈ GL3 (R)|AAT = I, det A = 1}; un suo sottogruppo a un

parametro è dato dalle rotazioni attorno all’asse x di R3 , parametrizzato da

1

0

0

A(t) = 0 cos t sin t ;

0 − sin t cos t

si può infatti mostrare che A(t) = exp (tT1 ) con

0

T1 = 0

0

0

0

−1

0

1 .

0

T1 è il generatore delle rotazioni attorno all’asse x, e si ha appunto Ȧ(0) = T1 . Un discorso analogo

può essere fatto per le rotazioni attorno all’asse y e all’asse z, generate rispettivamente dalle matrici

0 0 −1

T2 = 0 0 0

1 0 0

e

0

T3 = −1

0

1 0

0 0 .

0 0

Le tre matrici T1 , T2 e T3 generano l’algebra so(3). Ogni rotazione in R3 , d’altronde, può essere

vista come rotazione attorno a un particolare asse, e appartiene pertanto al relativo sottogruppo

Capitolo 2. Gruppi di Lie

30

a un parametro: SO(3) è quindi coperto interamente dai propri sottogruppi a un parametro, o,

equivalentemente, la mappa esponenziale è suriettiva da so(3) a SO(3). Non è difficile mostrare che

valgono le relazioni

[Ti , Tj ] = −εij k Tk ,

dove ε è il tensore di Levi-Civita; notiamo che queste relazioni sono identiche alle 2.3.1 trovate per

gli elementi di base di su(2). Pertanto, le algebre so(3) e su(2) sono isomorfe: le matrici Ti della

base di su(2) e quelle della base di so(3) sono due rappresentazioni diverse della stessa entità.

Viene ora naturale domandarsi se i corrispondenti gruppi di Lie SO(3) e SU(2) siano anch’essi

isomorfi. Notiamo che SU(2) e SO(3) sono entrambi connessi, perciò la domanda è giustificata (nel

caso di O(3), sapevamo che esso non poteva coincidere con SU(2) in quanto O(3) non è connesso).

Mostriamo che SO(3) e SU(2) non sono isomorfi.

Consideriamo a questo proposito i sottogruppi generati da T3 nell’uno e nell’altro caso:

cos t sin t 0

a) SO(3) :

exp (tT3 ) = − sin t cos t 0;

0

0

1

it/2

i/2

0

e

0

b) SU(2) :

exp (tT3 ) = exp t

=

;

0 −i/2

0

e−it/2

si osserva immediatamente che nel caso a) la matrice è 2π-periodica, mentre nel caso b) è 4πperiodica:

(

I in SO(3)

2πT3

e

=

.

−I in SU(2)

Questo è sufficiente per provare che gruppi connessi con la medesima algebra non sono necessariamente equivalenti. Avremo modo di vedere che in effetti SU(2) è un gruppo più “ricco” di

SO(3).

Ciò in cui differiscono i gruppi è un’altra proprietà topologica: non più la connessione, ma la semplice

connessione 1 . Indagheremo questo più a fondo in una sezione successiva.

Algebre di Lie dei gruppi classici Vogliamo ora servirci della mappa esponenziale per individuare

in modo semplice le algebre di Lie dei gruppi classici di matrici.

• SU(n) con n ≥ 2. La generica matrice U ∈ SU(n) è tale che U † = U −1 e det U = 1; scrivendo U

come esponenziale di un elemento dell’algebra,

U = eA ,

A ∈ su(n),

le proprietà di cui sopra si scrivono

†

(eA )† = (eA )−1 =⇒ eA = e−A =⇒ A† = −A antihermiticità;

det eA = eTrA = 1 =⇒ TrA = 0 traccia nulla.

L’algebra su(n) è pertanto formata dalle matrice antihermitiane a traccia nulla; la condizione di

antihermiticità prescrive che i numeri lungo la diagonale siano immaginari puri, dando n scelte

possibili, e che i numeri nel triangolo inferiore della matrice siano determinati da quelli nel triangolo

superiore, che possono essere scelti in n2 − n modi diversi (essendo numeri complessi); la condizione

di traccia nulla toglie un grado di libertà, cosicché la dimensione dell’algebra è pari a

dim su(n) = n2 − 1.

1 Una varietà M è semplicemente connessa se per ogni curva chiusa in essa contenuta è possibile trovare un’omotopia

che mappi la curva in un punto appartenente alla varietà. Un’omotopia tra due funzioni f, g : I → M (con I intervallo di R)

è una funzione continua H : I × [0, 1] tale che H(t, 0) = f (t) e H(t, 1) = g(t), cioè una deformazione continua del sostegno

di f in quello di g.

2.3. Sottogruppi e sottoalgebre di Lie

31

Dato che la dimensione del gruppo (inteso come varietà) e quella dell’algebra (intesa come spazio

vettoriale) sono la medesima, SU(n) è una varietà (n2 − 1)-dimensionale.

• SO(n) con n ≥ 2. La generica matrice M ∈ SO(n) è tale che M T = M −1 e det M = 1; scrivendo

M come esponenziale di un elemento dell’algebra,

M = eA ,

A ∈ so(n),

le suddette proprietà si scrivono

T

(eA )T = (eA )−1 =⇒ eA = e−A =⇒ AT = −A antisimmetria;

det eA = eTrA = 1 =⇒ TrA = 0 traccia nulla.

L’algebra so(n) è formata dalle matrice antisimmetriche; notiamo che la condizione di traccia nulla

è implicata dalla richiesta di antisimmetria, e pertanto non costituisce alcun vincolo extra; questo

si riflette nel fatto che le algebre o(n) e so(n) coincidono, come abbiamo avuto modo di vedere per

n = 3. La condizione di antisimmetria garantisce una libertà di (n2 − n)/2 (i numeri sono reali),

sicché

n2 − n

.

dim so(n) =

2

• Sp(n) con n pari. La generica matrice U ∈ Sp(n) è tale che U † = U −1 e U T = JU −1 J −1 dove

On/2 In/2

J :=

;

(2.3.2)

−In/2 On/2

scrivendo U come esponenziale di un elemento dell’algebra,

U = eA ,

A ∈ sp(n),

le proprietà si scrivono1

(eA )† = (eA )−1 =⇒ A† = −A antihermiticità;

T

(eA )T = J(eA )−1 J −1 =⇒ eA = e−JAJ

−1

=⇒ AT = −JAJ −1 .

è possibile dimostrare che

dim sp(n) =

n2 + n

.

2

• SO(p, q) := {A ∈ Mn (R) | n = p + q, AT = gA−1 g −1 , con g :=

Ip Op×q

Oq×p −Iq

, det A = 1} (il tipico

esempio di questa classe di gruppi, incontrato in relatività ristretta, è il gruppo di Lorentz SO(3, 1);

la matrice g può essere interpretata come la metrica dello spazio). Scriviamo la generica matrice

M ∈ SO(p, q) come esponenziale di un elemento dell’algebra,

M = eA ,

A ∈ so(p, q);

le proprietà di M si scrivono

(eA )T = g(eA )−1 g −1 =⇒ AT = −gAg −1 ;

det eA = 1 =⇒ TrA = 0.

la seconda proprietà, è immediato dimostrare che BeA B −1 = eBAB

invertibile B, semplicemente applicando la definizione di esponenziale.

1 Riguardo

−1

per ogni matrice A e per ogni matrice

Capitolo 2. Gruppi di Lie

32

Anche in questo caso, si può mostrare agilmente che la condizione di traccia nulla segue dalla prima;

la dimensione dell’algebra (e del gruppo) è anche in questo caso

dim so(p, q) =

n2 − n

.

2

Consideriamo il gruppo SO(1, 1), il più semplice possibile gruppo di questa classe. Questo è un

gruppo di Lie di dimensione 1. La generica matrice M ∈ SO(1, 1) si può scrivere nella forma

M=

x

y

y

con x2 − y 2 = 1;

x

scriviamo la matrice M come esponenziale di un elemento dell’algebra:

M = eA

si può dimostrare che A = t

0

1

con A ∈ so(1, 1);

1

. Esistono due possibilità per parametrizzare M , e cioè:

0

cosh t sinh t

;

sinh t cosh t

− cosh t − sinh t

b) M =

.

− sinh t − cosh t

a) M =

L’insieme di matrici del tipo a) è separato da quello delle matrici del tipo b); la matrice identità

appartiene evidentamente al primo tipo. Quindi l’insieme SO(1, 1) consta di due componenti (e si

può mostrare che O(1, 1), definito come SO(1, 1) ma senza la condizione di determinante unitario,

consta di quattro componenti). Osserviamo che in questo caso

d(M, I) =

q

p

t→∞

2(cosh t − 1)2 + 2 sinh2 t = 2 cosh2 t − cosh t −→ +∞,

cioè la distanza tra l’identità e una matrice del tipo a) può essere

√ resa grande a piacere; nel caso di

SO(2), ricordiamo, la distanza era sempre compresa tra 0 e 2 2.

Questo significa che il gruppo SO(1, 1) non è limitato. Più in generale, si può affermare il seguente

risultato: il gruppo SO(n) è un gruppo compatto per ogni n; il gruppo SO(p, q) (con p, q > 1) è

sempre non compatto.

Un’importante proprietà della mappa esponenziale è che può essere fatta commutare con gli omomorfismi.

Abbiamo già visto come ogni omomorfismo di gruppi ϕ generi automaticamente un omomorfismo tra le

corrispettive algebre, dato da dϕ.

Teorema 2.3.6. Se ϕ : G → H è un omomorfismo di gruppi di Lie, allora

∀X ∈ g

ϕ(expg X) = exph (dϕ(X))

(avendo indicato con un pedice l’algebra su cui agisce l’esponenziale; questo verrà d’ora in poi sottinteso).

Ossia, vale il seguente diagramma commutativo:

GO

ϕ

/H

O

exp

exp

g

dϕ

/h

.

2.3. Sottogruppi e sottoalgebre di Lie

33

Dimostrazione. Sia X ∈ g; considero la curva in H:

t 7→ ϕ(exp(tX)).

Il vettore tangente alla curva in t = 0 è, per la definizione 1.3.1,

d dϕ

= dϕ(X);

dt 0

d’altra parte, questa curva è un sottogruppo a un parametro di H, dato che vale la proprietà di omomorfismo

ϕ(exp(tX))ϕ(exp(sX)) = ϕ(exp((t + s)X)).

Sappiamo anche che la curva

t 7→ exp(tdϕ(X))

è l’unico sottogruppo a un parametro il cui vettore tangente nel punto 0 è dϕ(X); le due curve devono

quindi coincidere. Ponendo t = 1, si ottiene la tesi.

Questo teorema costituisce una sorta di “viceversa” del teorema 2.3.1: se ho una rappresentazione dell’algebra

ψ : g → gln (R),

posso costruire la mappa