caricato da

gioacchino.murat

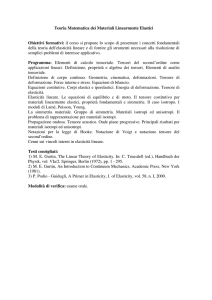

Elementi di Calcolo Tensoriale: Appunti del Corso