CORSO DI STATISTICA I (AA 2012-13)

Elenco delle possibili domande

della prova teorica in forma scritta

DOMANDE DI STATISTICA DESCRITTIVA

D1 - Serie e seriazioni statistiche.

- Serie statistiche sono il risultato della riorganizzazione in frequenze delle modalita’ osservate (Mutabile “Colore

capelli”)

- Serie statistiche ordinate sono il risultato della riorganizzazione in frequenze di caratteri ordinabili (Fenomeno

altezza: Bassa – Media – Alta)

- Seriazioni statistiche sono il risultato della riorganizzazione in frequenze di intensita’ osservate (Variabile

Statura)

D2 - La densità di frequenza: definizione e utilizzo.

Utilizzata quando si opera con variabili quantitative raggruppate in classi di intervalli di diversa ampiezza, si

definisce come il rapporto tra le frequenze associate a ciascun intervallo e le ampiezze degli intervalli stessi. Si

utilizza quando si vuole determinare la Moda del fenomeno (parleremo in tal caso di Classe Modale, ovvero l’

intervallo cui corrisponde la densita’ di frequenza maggiore) ed anche per una corretta costruzione degli

istogrammi (Le aree dei rettangoli in tal caso rappresenteranno le frequenze assolute associate a ciascun

intervallo).

D3 - Frequenza assoluta, relativa e cumulata.

- La frequenza assoluta fi associata a modalita’ od intensita’ ai, rappresenta il numero di volte con cui la modalita’

o intensita’ ai e’ stata osservata.

- La frequenza relativa fi/N associata al modalita’ od intensita’ ai, rappresenta il numero di volte con cui la

modalita’ o intensita’ ai e’ stata osservata espressa in % rispetto al numero toale N di osservazioni effettuate

- La frequenza cumulata Fi associata al modalita’ di tipo ordinale od intensita’ ai, rappresenta la quantita’

complessiva di soggetti caratterizzati da una modalita’ od intensita’ gerarchicamente non superiore a quella del

soggetto ai cui e’ associata.

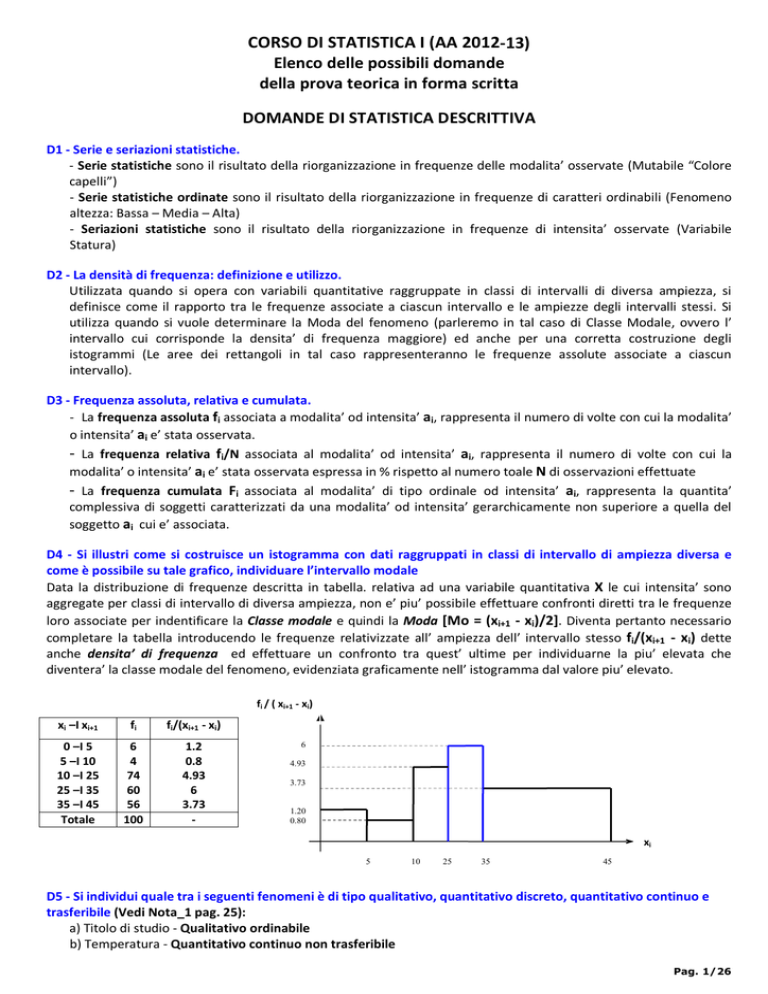

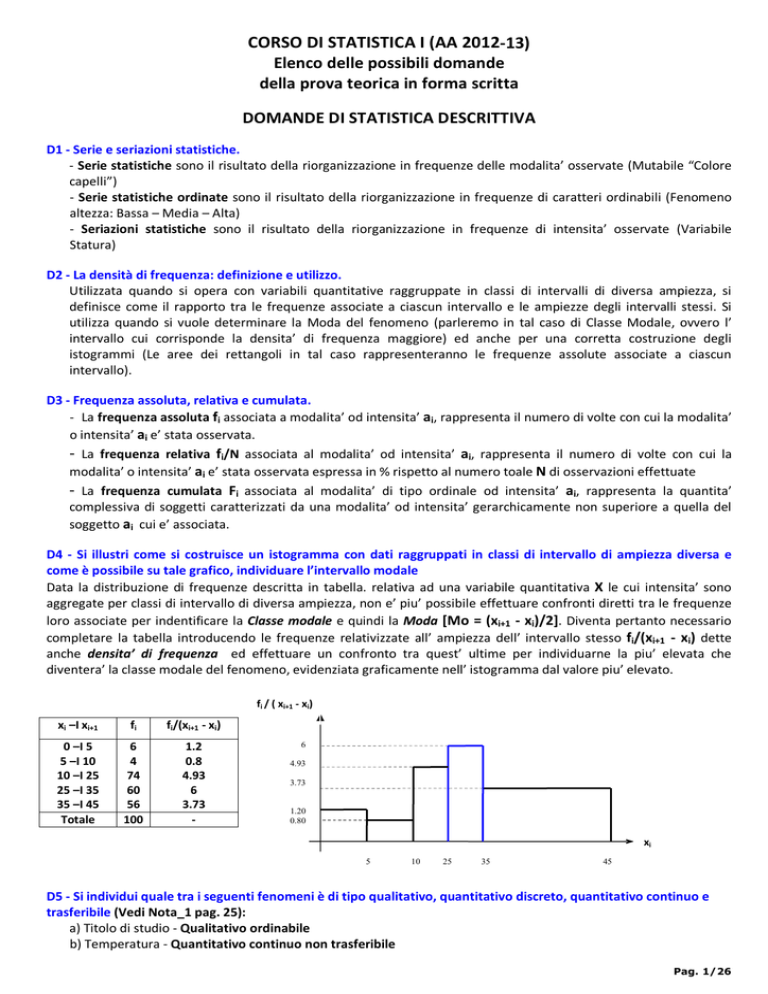

D4 - Si illustri come si costruisce un istogramma con dati raggruppati in classi di intervallo di ampiezza diversa e

come è possibile su tale grafico, individuare l’intervallo modale

Data la distribuzione di frequenze descritta in tabella. relativa ad una variabile quantitativa X le cui intensita’ sono

aggregate per classi di intervallo di diversa ampiezza, non e’ piu’ possibile effettuare confronti diretti tra le frequenze

loro associate per indentificare la Classe modale e quindi la Moda [Mo = (xi+1 - xi)/2]. Diventa pertanto necessario

completare la tabella introducendo le frequenze relativizzate all’ ampiezza dell’ intervallo stesso fi/(xi+1 - xi) dette

anche densita’ di frequenza ed effettuare un confronto tra quest’ ultime per individuarne la piu’ elevata che

diventera’ la classe modale del fenomeno, evidenziata graficamente nell’ istogramma dal valore piu’ elevato.

fi / ( xi+1 - xi)

xi –I xi+1

fi

fi/(xi+1 - xi)

0 –I 5

5 –I 10

10 –I 25

25 –I 35

35 –I 45

Totale

6

4

74

60

56

100

1.2

0.8

4.93

6

3.73

-

6

4.93

3.73

1.20

0.80

xi

5

10

25

35

45

D5 - Si individui quale tra i seguenti fenomeni è di tipo qualitativo, quantitativo discreto, quantitativo continuo e

trasferibile (Vedi Nota_1 pag. 25):

a) Titolo di studio - Qualitativo ordinabile

b) Temperatura - Quantitativo continuo non trasferibile

Pag. 1/26

c) Millimetri di pioggia - Quantitativo continuo non trasferibile

d) Colore dei capelli - Qualitativo sconnesso

e) Prontezza di riflessi - Qualitativo ordinabile

f) Peso - Quantitativo continuo non trasferibile

g) Età - Quantitativo discreto non trasferibile

h) Pressione arteriosa - Quantitativo discreto non trasferibile

i) Reddito - Quantitativo continuo trasferibile

l) Numero di pagine di una rivista - Quantitativo discreto non trasferibile

D6 - Nelle seguenti successioni di dati si individuino quelle che hanno per moda il valore 4

a) 1, 1, 6, 4, 3

b) 4, 1, 4, 3, 4 - *

c) 5, 3, 4, 6, 1

d) 2, 4, 4, 3, 1 - *

e) 4, 4, 1, 3, 3 - * (Bi-modale)

D7 - Nelle seguenti successioni di dati si individuino quelle che hanno per mediana il valore 4

a) 1, 1, 6, 4, 3

b) 4, 1, 4, 3, 4 - *

c) 5, 3, 4, 6, 1 - *

d) 2, 4, 4, 3, 1

e) 4, 4, 1, 3, 3

D8 - Se con un’automobile percorre 240 km in 120 minuti e 60 km in 60 minuti quale è stata la velocità media?

Illustrare il tipo di media utilizzata.

Ma = s/t = (s1 + s2)/(t1 + t2) = (s1 + s2)/(s1/v1) + (s2/v2)

Ma = (240 + 60)/(240/120 + 60/60) = 100 Km/h

Quella utilizzata e’ la Media Armonica

Ma = N/(∑ni =1 1/xi fi)

Nel caso in esame la Ma delle velocita’ dei singoli tratti e’ pesate per la lunghezza dei tratti stessi.

D9 - Dato un indice di dispersione D il cui campo di variazione è [Dmin , Dmax] si proceda alla sua normalizzazione,

indicando il conseguente campo di variazione dell’indice normalizzato.

0 ≤ (D – DMin)/DMax – DMin) ≤ 1

D10 - La mediana: definizione, proprietà ed esempi.

Data una mutabile ordinabile o un carattere numerico, si definisce mediana Me la modalita’ o intensita’ che soddisfa la

doppia condizione:

∑nai ≤ a0.5 f(xi) ≥ N/2

e

∑nai ≥ a0.5 f(xi) ≤ N/2

Si tratta cioe’ della modalita’ od intensita’ associata al soggetto cui corrisponde la frequenza relativa cumulata pari a

0.5, cioe’ F(Me)/N = 0.5

Nel caso di intensita’ suddivise in classi di intervallo, si parlera’ di Classe Mediana al cui interno si posizionera’ il valore

mediano Me ricavabile dalla seguente relazione Me = xi + (xi+1 - xi ) (0.5 – Fi/N)/(Fi+1/N – Fi/N)

A titolo di esempio, consideriamo la distribuzione di frequenze relativa ad una variabile quantitativa X le cui intensita’

sono aggregate per classi di intervallo di diversa ampiezza descritte in tabella, si trova che la Classe mediana della

collettivita’ analizzata sara’ la classe (xi –I xi+1) = (25 –I 35).

xi –I xi+1

0 –I 5

5 –I 10

10 –I 25

25 –I 35

35 –I 45

-

xci

2.5

7.5

17.5

30

40

-

fi

6

4

74

60

56

200

Fi

6

10

84

144

200

-

Fi /N

0.03

0.05

0.42

0.72

1

Pag. 2/26

Ne discende pertanto che il valore mediano cercato sara’ Me = 25 + (35 - 25) (0.5 – 0.42)/(0.72 – 0.42) = 27.67

Fi /N

1

0.72

0.50

0.42

Me

0.05

0.03

xi

5

10

25 27.67

35

45

D11 - Le scale delle modalità: scale nominali, ordinali, intervallari e rapporto.

- Scale nominali: le modalita’ si identificano in caratteri qualitativi aventi attributi non numerici suscettibili di

essere ordinati in modo qualunque. Tra due generiche modalita’ ai e aj esiste solo la relazione di diversita’ (ai <> aj)

- Scale ordinali: le modalita’ si identificano in caratteri qualitativi aventi attributi con significati gerarchici

rappresentabili pertanto con numeri ordinali. Tra due generiche modalita ai e aj esiste una relazione di dominanza

ai > aj oppure ai < aj

- Scale intervallari: le modalita’ si identificano in caratteri quantitativi rappresentabili pertanto con numeri reali

che permettono di quantificare la manifestazione del fenomeno in oggetto. Tra due generiche modalita’

quantitative (intensita’) xi e xj, assume significato valutare l’ ampiezza dell’ intervallo intercorrente tra loro (ai - aj)

- Scale rapporto: come le intervallari le modalita’ quantitative (intensita’) si identificano con numeri reali. I valori

in genere hanno una origine fissa generalmente coincidente con lo 0.

D12 La moda: definizioni, proprietà ed esempi.

Si definisce moda Mo di una distribuzione, la modalita’ ordinabile o no o l’ intensita’ cui’ e’ associata la frequenza piu’

elevata. Nel caso di intensita’ suddivise in classi di intervallo omogenee o no, si parlera’ di Classe Modale al cui interno

si posizionera’ il valore modale Mo ricavabile dalla seguente relazione:

Mo = (xi+1 + xi )/2

Nel caso in cui le classi di intervallo abbiano la medesima ampiezza, la Classe Modale sara’ quella cui e’ associata la

frequenza piu’ elevata, mentre nel caso in cui le classi di intervallo abbiano diversa ampiezza, la Classe Modale sara’

quella cui e’ associata la densita’ di frequenza piu’ elevata, ossia il valore piu’ elevato del rapporto fi/(xi+1 - xi )

D13 - La proprietà di baricentratura della media aritmetica.

Tale proprieta’ comporta che l’ indice di posizione Media Aritmetica μ sia, a differenza della Mo e della Me in

generale, un indice centrato ovvero tale da soddisfare la relazione:

∑i (xi - μ) fi = 0

D14 - La proprietà di minima distanza della media aritmetica.

Definito uno spazio N-dimensionale attribuendo ad ogni unita’ statistica una coordinata in tale spazio ripetuta nel caso

di molteplicita’ (fi diverso da 1), si individuino

- un punto X di coordinate (x1...x1,x2...x2,...,xN...xN) pari cioe’ alle misure rilevate per ciascuna unita’ statistica con

le loro molteplicita’

- un punto I di coordinate (I,I,..........,I) tutti uguali, corrispondenti ad un generico indice di posizione I con le loro

molteplicita’

Definita in tale spazio la distanza tra due punti X ed I come d (X,I) = √∑i (xi - I)2 fi

Si dimostra [(1) Vedasi pag. 27] che l’ indice di posizione I che minimizza la distanza della distribuzione di frequenza

analizzata e’ il valore medio aritmetico μ.

D15 - Dimostrare che la media aritmetica è un operatore lineare.

Siano (x1,x2,..,xi,...) N osservazioni effettuate su una variabile X con le loro relative molteplicita’ fi e con valore medio

μX. Siano inoltre a e b due costanti non nulle contemporanemente e tali per cui Y = aX + b

Pag. 3/26

μy = ∑i yi/N = ∑i (axi + b)/N = ∑i axi/N + ∑i b/N = a∑i xi/N + b∑i 1/N = aμX + b [(1) Per dettagli pag. 30] a conferma

della linearita’ dell’ operatore varianza.

D16 - La media armonica: definizione, proprietà ed esempi.

Si definisce Media Armonica Ma la quantita’ Ma = N/∑i fi/xi.

In base alla Condizione di Equivalenza di Chisini, e’ quell’ indice di posizione I che conserva inalterata la somma dei

reciproci delle quantita’ xi di cui e’ indice.

Es.: dati due tragitti s1 ed s2 percorsi con velocita’ distinte v1 e v2 nei tempi rispettivamente t1 e t2, la velocita’ media

necessaria a percorrere il tragitto (s1 + s2) nel tempo (t1 + t2), sapa’ appunto la Media Armonica delle velocita’ v1 e v2

pesata rispettivamente per i tragitti s1 ed s2, essendo questi ultimi generalmente diversi.

D17 - La media geometrica: definizione, proprietà ed esempi.

Si definisce Media Geometrica Ge la quantita’ Mg = √ ∏i xifi.

In base alla condizione di equivalenza di Chisini, e’ quell’ indice di posizione I che conserva inalterato il prodotto delle

quantita’ xi di cui e’ indice

Es.: dato un capitale iniziale CI, un trend (C2,C3,.....) che ha condotto ad un capitale finale CF nel periodo in

osservazione e definiti gli indici ri = Ci+1 / Ci grazie ai quali e’ possibile calcolare i rendimenti percentuali annui, l’ indice

medio costante che applicato al medesimo capitale iniziale CI, condurrebbe nello stesso periodo allo stesso capitale

finale CF e’ la media geometrica delle grandezze ri.

D18 - Le medie potenziate: definizione, proprietà loro significato in corrispondenza di alcuni valori notevoli di r.

Si definisce media potenziate di ordine r

μ(r) = [∑i xri fi /N]1/r per 0 < x1 < x2...< xn

le medie potenziate sono accettate come medie analitiche poiche’ soddisfano le seguenti condizioni generali

- Condizione di Equivalenza di Chisini: I = G(x1, x2,..., xn) = G(I, I,..., I)

- Condizione di Internalita’ di Cauchy: x1 ≤ I ≤ xn

Valgono le seguenti proprieta’:

- limrà-∞ μ(r) = x1

- limrà+∞ μ(r) = xn

- limrà0 μ(r) = μ(0) = Mg

(r)

(r+1)

-μ < μ

- r = -1 à μ(-1) = Ma (Media Armonica)

- r = 0 à μ(0) = Mg (Media Geometrica)

- r = +1 à μ(+1) = μ (Media Aritmetica)

- r = +2 à μ(+2) = Mq (Media Quadratica)

D19 - L'indice che minimizza la perdita d'informazione di ordine zero.

L’ indice di posizione I che minimizza la perdita di informazione di ordine zero L0(I) = N – f(I) e’ la moda Mo

D20 - L'indice che minimizza la perdita d'informazione di ordine uno.

L’ indice di posizione I che minimizza la perdita di informazione di ordine uno L1(I) = ∑i |xi – I|fi e’ la mediana Me

D21 - L'indice che minimizza la perdita d'informazione di ordine due.

L’ indice di posizione I che minimizza la perdita di informazione di ordine due L2(I) = ∑i |xi – I|2 fi e’ la media

aritmetica μ

D22 - La Condizione di equivalenza di Chisini: definizione ed esempi.

Dato un indice di posizione I, la condizone di Equivalenza di Chisini afferma che l’ indice stesso deve essere tale da

conservare la relazione con cui e’ stato calcolato, ovvero:

I = G(x1, x2,..., xn) = G(I, I,..., I)

Esempi:

- La media armonica Ma e’ quell’ indice di posizione I che lascia inalterata la somma dei reciproci delle quantita’ xi

di cui e’ indice à ∑i fi/xi = ∑i fi/I = N/I

- La media geometrica Ge e’ quell’ indice di posizione I che lascia inalterato il prodotto delle quantita’ xi di cui e’

indice à ∏i xifi = ∏i Ifi = In

Pag. 4/26

- la media aritmetica μ e’ quell’ indice di posizione I che lascia inalterata la somma delle quantita’ xi di cui e’ indice

à ∑i xi fi =∑i Ifi = NI

- la media quadratica μ2 (Mq) e’ l’ indice di posizione I che lascia inalterata la somma dei quadrati delle quantita’

xi di cui e’ indice à ∑i x2i fi = ∑i I2fi = NI2

D23 - La Dispersione assoluta e la dispersione relativa: definizione.

La Dispersione Assoluta e’ l’ attitudine delle unita’ osservate a presentare misurazioni differenti, ossia difformita’ tra

le unita’ nel caso di mutabili (modalita’ tra loro differenti) e distanze tra le unita’ nel caso di variabilita’ (intensita’ tra

loro differenti).

La Dispersione Relativa e’ l’ attitudine delle unita’ osservate a presentare misurazioni differenti dal loro indice di

posizione rappresentativo I, ossia difformita’ dall’ indice di posizione nel caso di mutabili e distanze dall’ indice di

posizione nel caso di variabilita’.

D24 - La variabilità relativa: sue misure e normalizzazione.

Nel caso di variabili quantitative, come misura atta a quantificare il grado di difformita’ relativa della distribuzione

dalla suo valore medio μ (indice prescelto), si utilizza lo scarto quadratico medio σ = √ ∑i (xi - μ)2 fi / N.

Una misura normalizzata di tale indice sara’ σ’ = σ/σMAX dove σ MAX rappresenta il valore massimo dello scarto

quadratico medio nel caso in cui le frequenze osservate fi (∑i fi = N) si fossero presentate associate ai soli valori

estremi x1 (f1 = f*) ed xn (fn = [(N - f*)] della distribuzione nel rispetto del vincolo di conservazione della media

aritmetica, ovvero μX = ∑i [x1 f* + xn (N - f*)]/N. In particolare si ricava che σMAX = √ [μ (x1 + xn) - x1xn – μX2] [(1)

Vedasi pag. 75].

D25 - La mutabilità assoluta: sua misura e loro normalizzazione.

Nel caso di variabili qualitative ovvero mutabili, come misura atta a quantificare il grado di la dispersione assoluta si

utilizza l’ Indice di Gini γ = ∑i (1 - fi/N) fi/N. In caso di massima concentrazione delle frequenze, l’ indice assume il suo

minimo valore γMIN ed in caso di equi-distribuzione delle frequenze l’ indice assume il suo massimo valore γMAX. In

particolare avremo 0 = γMIN ≤ γ ≤ γMAX = (1 – 1/n). Ne consegue che l’ indice normalizzato varra’ 0 ≤ γ’ = γ/(1 – 1/n)

≤1

D26 - La mutabilità relativa: sua misura e normalizzazione.

Nel caso di mutabili, come misura atta a quantificare il grado di difformita’ relativa della distribuzione dalla sua moda

Mo (indice prescelto), si utilizza l’ indice ∂ = [N – f(Mo)] / N.

Una misura normalizzata di tale indice sara’ ∂’ = ∂/∂MAX = [N – f(Mo)]/[N – f(Mo)MIN] dove f(Mo)MIN = [N/n) + 1

in cui [N/n] rappresenta la parte intera di N/n.

Tale indice pertanto misura l’ attitudine della moda Mo a rappresentare la distribuzione in frequenze della mutabile

oggetto dell’ osservazione.

D27 - La Varianza: definizione e formula.

Siano (x1, x2,....xi...., xn) n misurazioni relative ad un fenomeno quantitativo con frequenze rispettivamente (f1,

f2,....fi...., fn), si definisce varianza σ2 la media quadratica delle distanze intercorrenti tra le singole misurazioni a la

loro media aritmetica μX.

σ2 = ∑i (xi - μX)2 fi/N

D28 - Dire quali tra le seguenti affermazioni sono vere:

a - La media geometrica è sempre maggiore della mediana - Falsa

b - La media aritmetica è sempre maggiore della media geometrica - Vera

c - La media armonica è sempre maggiore della media aritmetica - Falsa

d - Moda, mediana e media aritmetica sono sempre uguali - Falsa

D29 - Si dica quando si deve ricorrere all’uso del coefficiente di variazione e quando invece si deve utilizzare un

indice di variabilità normalizzato.

Essendo in alcuni casi problematico effettuare un confronto tra misure di dispersione quando queste sono riferite a

distribuzioni di intensita’ disomogenee come ad esempio peso e statura (diversa natura) o stature tra bambini ed

adulti (diverso valore medio), in tal caso come misura della variabilita’ relativa si utilizza il numero puro c.v. detto

coefficiente di variazione, pari a c.v. = σ/μ.

Pag. 5/26

Scelti μ come media aritmetica e σ come misura della dispersione relativa, si utilizza l’ indice di variabilita’ nrmalizzato

σ’ = σ/σMAX quando si desidera conoscere la frazione di dispersione massima σMAX posseduta dalla distibuzione

analizzata, dispersione misurata appunto da σ.

D30 - Si dica qual è il campo di variazione di un qualsiasi indice di variabilità relativo e relativo normalizzato.

Per ogni misura di variabilita’ relativa D avremo che il campo di variazione dell’ indice stesso sara’ DMIN ≤ D ≤ DMAX

mentre il campo di variazione dell’ indice normalizzato sara’ 0 ≤ (D - DMIN)/(DMAX - DMIN) ≤ 1

D31 - Dimostrare che la varianza non è un operatore lineare.

Siano (x1,x2,..,xi,...) N osservazioni effettuate su una variabile X con le loro relative molteplicita’ fi con valore medio

μX e varianza σ2X.Siano inoltre a e b due costanti non nulle contemporanemente e tali per cui Y = aX + b

σ2y = ∑i (yi - μy)2/N = ∑i (axi + b - aμx - b)2/N = ∑i a2(xi - μx)2/N = a2∑i (xi - μx)2/N = a2σ2X [(1) Per dettagli 70] a

conferma della non linearita’ dell’ operatore varianza.

D32 - Il Coefficiente di Variazione: definizione e ambito di suo utilizzo.

Si definisce coefficiente di variazione il numero puro c.v. = σ/μ. Si utilizza in quei casi in cui risulta problematico

effettuare un confronto tra misure di dispersione quando queste sono riferite a distribuzioni di intensita’ disomogenee

come ad esempio peso e statura (diversa natura) o stature tra bambini ed adulti (diverso valore medio),

D33 - La tabella di massima variabilità relativa.

X

x1

x2

f

f1

f2

fMAX

f1 = f*

f2 = 0

.

.

.

xi

fi

fi = 0

.

.

.

(2 ≤ i ≤ (n - 1)

.

.

.

xn

Dove f* e quindi [(N - f*)] sono le frequenze associate ai soli valori estremi x1 (f1 =

f*) e xn (fn = [(N - f*)] della distribuzione, e i cui valori sono ricavabili imponendo il

vincolo di conservazione della media aritmetica, ovvero

μx = ∑i [x1 f* + xn (N - f*)]/ N.

.

.

fn fn = (N - f*)

D34 - La Concentrazione: definizione e natura dei caratteri su cui è definibile.

La Concentrazione e’ una misura di come l’ intensita’ di un fenomeno quantitativo trasferibile tipo il reddito, puo’

presentarsi in diversi gradi a favore di alcuni soggetti della numerosita’ scelta, anziche’ di altri, ovvero, data una

generica distribuzione ralativa ad uno dei possibili modi in cui il fenomeno quantitativo in osservazione potrebbe

assumere, la Concentrazione ci dice come la stessa quantita’ totale ∑i xifi del fenomeno potrebbe ripartirsi in maniera

alternativa, da qui’ i diversi “gradi” e la conseguente necessita’ di introdurrne una misura.

Come evidenziato, la caratteristica fondamentale del fenomeno in esame e’ quella della Trasferibilita’, cioe’ di poter

essere ceduto, del tutto od in parte a favore di un’ altra unita’ statistiche o tra le unita’ stesse.

D35 - L'indice R di Gini per la misura della Concentrazione.

Data una distribuzione relativa ad un fenomeno quantitativo trasferibile per il quale pertanto ha senso introdurre il

concetto di concentrazione, l’ Indice R di Gini viene calcolato nel seguente modo

R = A/AMAX = [N – ∑i (Di + Di-1) fi]/(N – 1)

A = 1/2 – [∑i (Di + Di-1) fi/N]/2

AMAX = (N - 1)/2N

dove

Area di concentrazione

Area di massima concentrazione

Per il calcolo di queste aree si utilizza la seguente rielaborazione della distribuzione data, dove oltre alle grandezze di

noto significato fi ed Fi si ha

X

x1

....

xi

fi

fi/N

xi fi

Fi

di

Fi/N

Di

(Di + Di-1) fi/N)/2

di = ∑ij xj fj

Di = di/dn

(Di + Di-1) fi/N)/2 Area dei trapezi o triangoli

evidenziati nella rappresentazione grafica (Fi/N, Di)

....

xn

Pag. 6/26

D36 - La spezzata di massima concentrazione e la condizione di equidistribuzione.

Prendendo come riferimento a quanto descritto al D35, le spezzate di massima concentrazione e di equidistribuzione,

si ricavano rielaborando la tabella nei seguenti modi:

- Massima concentrazione: la quantita’ totale ∑i xifi del fenomeno viene assegnata ad un solo soggetto pertanto la

tabella assumera’ la seguente forma

X

0.

∑i xifi

fiM

(N – 1)

1

fiM/N

(N – 1)/N

1/N

xi fiM

0

∑i xifi

FiM

(N – 1)

N

diM

0

∑i xifi

FiM/N

(N – 1)/N

1

DiM

0

1

(Di + Di-1) fi/N)/2

0

(N - 1)/2N

- Equidistribuzione: la quantita’ totale ∑i xifi del fenomeno viene ripartita equamente con una intensita’ pari a ∑i xifi

/N tra i diversi soggetti e pertanto la tabella assumera’ la seguente forma

X

∑i xifi /N

fiM

N

fiM/N

1

xi fiM

∑i xifi

FiM

N

diM

∑i xifi

FiM/N

1

DiM

1

(Di + Di-1) fi/N) / 2

0

D37 - La forma delle distribuzioni: l'asimmetria.

Una distribuzione di frequenza f(x) si dice simmetrica rispetto alla media μx se f(μx + k) = f(μx - k) qualunque k. Se

tale uguaglianza non e’ verificata si parlera’ di asimmetria della distribuzione. Come misura dell’ assimetria si utilizza l’

Indice γ1 di Pearson ottenuto facendo il rapporto tra il momento centrato di ordine tre e lo scarto quandratico medio

al cubo γ1 = μ3 / σx3 dove

μ3 = ∑i (xi - μx)3 fi / N = μ3 – 3 μxμ2 + 2 μx3 (μ3 dovrebbe essere sopra segnato e non sottolineato)

In caso di normalita’ γ1 = 0, mentre γ1 = 0 e’ condizione soltanto necessaria per la sussistenza della simmetria.

D38 - La forma delle distribuzioni: la curtosi.

La curtosi e’ una misura dell’ allontanamento di una distribuzione di frequenza f(x) dalla normalità distributiva,

rispetto alla quale si verifica un maggiore appiattimento (distribuzione platicurtica) o un maggiore allungamento

(distribuzione leptocurtica). Come misura dell’ assimetria si utilizza l’ Indice γ2 di Pearson, ottenuto facendo il

rapporto tra il momento centrato di ordine quattro e la varianza al quadrato γ2 = μ4/ σx4 dove

μ4 = ∑i (xi - μx)4 fi / N = μ4 – 4 μxμ3 + 6μ2 μx3 – 3 μx4 (μ4 dovrebbe essere sopra segnato e non sottolineato)

Valgono le seguenti definizioni:

- se γ2 = 3 la distribuzione e’ Normocurtica

- se γ2 > 3 la distribuzione e’ Leptocurtica

- se γ2 < 3 la distribuzione e’ Platicurtica

D39 - Si esemplifichino 6 fenomeni di cui almeno uno trasferibile (indicandolo) e in particolare: 2 quantitativi

discreti, 2 quantitativi continui e 2 qualitativi.

a) Reddito - Quantitativo continuo trasferibile

b) Età - Quantitativo discreto non trasferibile

c) Numero di pagine di una rivista - Quantitativo discreto non trasferibile

d) Peso - Quantitativo continuo non trasferibile

e) Millimetri di pioggia - Quantitativo continuo non trasferibile

f) Titolo di studio – Qualitativo ordinabile

g) Colore dei capelli - Qualitativo sconnesso

D40 - Quando un fenomeno può definirsi trasferibile?

Dato un carattere di natura quantitativa o variabile, ovvero un’unità statistica che puo’ essere misurata od espressa

mediante un numero di natura discreta o continua, diremo che il carattere e’ trasferibile se puo’ essere ceduto del tutto od in

parte ad un’ altra unita’ statistica o tra le unita’ (Es.: reddito, № di dipendenti, fatturato…)

D41 - Quali indici di posizione possono essere applicati:

a) a fenomeni qualitativi ordinabili - Moda e Mediana

b) sia a fenomeni qualitativi non ordinabili che a fenomeni quantitativi - Moda

Pag. 7/26

c) a fenomeni quantitativi - Moda, Mediana e Media

D42 - Distribuzioni marginali e distribuzioni condizionate nella tabella a doppia entrata. Il concetto di indipendenza

stocastica.

Supponiamo di aver rilevato N unita’ statistica relativamente a due fenomeni X ed Y, siano essi qualitativi o

quantitativi e di aver organizzato la distribuzione di frequenze cosi’ ottenuta in una tabella a doppia entrata [n x m]:

Y

y1

...

yj

...

ym

fi+

X

x1

.....

xi

.....

xn

f+j

Y|xi

y1

.....

yj

.....

ym

Totale

f1+

fij

f+1

f(Y|xi)

fi1

.....

fij

.....

fim

fi+

...

f+ j

fi+

...

f+m

fn+

N

Le distribuzioni marginali relative ai

singoli fenomeni unidimensionali X ed

Y costituenti la tabella a doppia

entrata, sono le due distribuzioni di

frequenze che si ottengono sommando

le righe (f+j) e le colonne (fi+) riportate

nelle due tabelle a fianco.

X

x1

.....

xi

.....

xn

Totale

fi+

f1+

.....

fi+

.....

fn+

N

Le distribuzioni condizionate sono l’ insieme delle n (m) distribuzioni di

frequenze unidimensionali relative al fenomeno Y (X) condizionato dalle altre

n (m) manifestazioni (modalita’ o valori) possibili presentate dall’ altro

fenomeno X (Y).

Y

y1

.....

yj

.....

ym

Totale

X|yj

X1

.....

xi

.....

xn

Totale

f+j

f+1

.....

f+j

.....

f+m

N

f(X|yj )

f1j

.....

fij

.....

fnj

f+j

Se, focalizzando ad esempio l’ attenzione sulle distribuzioni del fenomeno Y

condizionate dalle modalita’ o valori assunti dal fenomeno X, si verificasse che

le frequenze relative, intese come rapporto tra la fij della modalita’ o valore di

Y|xi e la corrispondente marginale fi+ non dipendesse dalla modalita’ o valore condizionante xi, parleremmo allora di

condizione di indipendenza stocastica. Viceversa si potrebbe concludere che relativamente alle unita’ statistiche

osservate, esiste una certa dipendenza stocastica tra i due fenomei X ed Y.

D43 - La Connessione: definizione e suo significato operativo.

Si definisce Connessione l’ assenza di indipendenza stocastica. Operativamente significa verificare la sussistenza o no

della condizione di indipendenza stocastica, ovvero controllare l’ uguaglianza delle frequenze effettive con le

frequenze teoriche di indipendenza stocastica f*ij = (fi+ f+j)/N (condizione sufficiente)

D44 - L'indice che misura la connessione.

L’ indice utilizzato per misurare il grado di connessione presente in una distribuzione statistica tra due fenomeni X ed

Y e l’ indice χ2 di Pizzetti-Pearson. Di seguito i passi da seguire per il suo calcolo:

1) Costruzione della tabella delle frequenze congiunte relative alla situazione di indipendenza stocastica [f*ij],

sostituendo a ciascun valore della [fij], f*ij = fi+ f+j/N

2) Costruzione della tabella delle contigenze [Cij], dove ciascun valore Cij = (fij - f*ij)

3) Costruzione della tabella [C2ij/f*ij] e calcolo della somma parziale relativa ad ogni riga e colonna e quindi quelle

totali che dovranno corrispondere, trovando cosi’ il valore del grado di connessione χ2

Per effettuarne la normalizzazione occorre calcolare il χ2MAX che χ2 potrebbe assumere. I passi da seguire sono i

seguenti:

1) Costruzione della tabella delle frequenze congiunte corrispondenti alla condizione di massima connessione [f’ij],

(per tentativi cercando di massimizzare il numero di 0 presenti in tabellla)

2) Costruzione della tabella delle contigenze [C’ij], dove ciascun valore Cij = (f’ij – f*ij)

3) Costruzione della tabella [C’2ij/f*ij] e calcolo della somma parziale relativa ad ogni riga e colonna e quindi quelle

totali che dovranno corrispondere, trovando cosi’ il valore del grado di connessione massimo χ2MAX

La conoscenza di entrambe i valori ci consentira’ quindi di eseguirne la normalizzazione:

χ’2 = χ2 /χ2MAX

D45 - Il massimo non vincolato dell'indice di Pizzetti-Pearson.

Supponiamo di aver la distribuzione di frequenze relativamente a due fenomeni X ed Y, siano essi qualitativi o

quantitativi, organizzta in una tabella a doppia entrata [n x m] descritta alla D42.

Pag. 8/26

La condizione teorica di massimo connessione viene raggiunta nel caso di tabella quadrata [n = m] disponendo le

frequenze fij solo sulla diagonale principale (f’ij = 0 per i e’ diverso da j).

Nel caso di tabella rettangolare [nxm] con m > n, una parte delle frequenze verranno disposte lungo la diagonale

principale della sottomatrice quandrata di ordine [nxn], mentre le restanti frequenze verranno disposte nelle altre

2

colonne. Si dimostra [(1) Vedasi pag. 115 - 118] che il massimo assoluto dell’ indice χ si basa sull’ ordine della

sottomatrice piu’ grande estratta dalla tabella in oggetto, in particolare

2

nxmχ MAX =

min [(n-1); (m-1)] N

D46 - Si illustri la differenza concettuale tra connessione e dipendenza.

Supponiamo di aver rilevato N unita’ statistica relativamente a due fenomeni X ed Y, Y considerata fenomeno

dipendente di tipo quantitativo ed X considerata fenomeno indipendente, indifferentemente di tipo qualitativo o

quantitativo, organizzati in una distribuzione di frequenze descritta dalla tabella a doppia entrata [n x m] descritta

alla D42.

Focalizzando l’ attenzione sulle distribuzioni del fenomeno Y condizionate dalle modalita’ o valori assunti dal

fenomeno X, possiamo dire che

- la Connessione riguarda il confronto effettuato tra le frequenze relative, intese come rapporto tra la fij del fenomeno

quantitativo Y|xi e la corrispondente marginale fi+. Nel caso in cui tale rapporto non dipendesse dalla modalita’ o

valore condizionante xi, parleremo di condizione di indipendenza stocastica. Viceversa si concluderebbe che esiste

una dipendenza stocastica del fenomeno Y dal fenomeno X.

- la Dipendenza in media riguarda il confronto effettuato tra le medie condizionate, intese come medie del fenomeno

quantitativo Y|xi. Nel caso in cui tali medie fossero uguali ovvero non dipendessero dalla modalita’ o valore

condizionante xi, parleremo di condizone di indipendenza in media [μ(Y|x1) = μ(Y|x2) = .... = μ(Y|xn) = μY].

Viceversa si potrebbe concludere che esiste una dipendenza in media del fenomeno Y dal fenomeno X.

La presenza di connessione non implica necessariamente la difformita’ delle medie condizionate. In generale potremo

quindi dire che:

- l’ Indipendenza in media e’ condizione necessaria ma non sufficiente per l’ Indipendenza stocastica

- l’ Indipendenza stocastica e’ condizione sufficiente ma non necessaria per l’ Indipendenza in media

Solo nel caso in cui i due fenomeni X ed Y fossero entrambe di tipo quantitativo, potremo parlare di

Interindipendenza in media, ovvero della mutua indipendenza in media di una variabile dall’ altra

μ(Y|x1) = μ(Y|x2) = .... = μ(Y|xn) = μY

e

μ(X|y1) = μ(X|y2) = .... = μ(X|ym) = μX

D47 - Il concetto di indipendenza in media.

Supponiamo di aver rilevato N unita’ statistica relativamente a due fenomeni X ed Y, Y considerata fenomeno

dipendente di tipo quantitativo ed X considerata fenomeno indipendente, indifferentemente di tipo qualitativo o

quantitativo, organizzati in una distribuzione di frequenze descritta dalla tabella a doppia entrata [n x m] descritta alla

D42.

Il concetto di Dipendenza/Indipendenza in media riguarda il confronto effettuato tra le medie condizionate, intese

come medie del fenomeno quantitativo Y|xi. Nel caso in cui tali medie fossero uguali ovvero non dipendessero dalla

modalita’ o valore condizionante xi, parleremo di condizione di indipendenza in media [μ(Y|x1) = μ(Y|x2) = .... =

μ(Y|xn) = μY]. Viceversa si potrebbe concludere esiste una dipendenza in media del fenomeno Y dal fenomeno X.

D48 - La dipendenza in media: definizione.

Supponiamo di aver rilevato N unita’ statistica relativamente a due fenomeni X ed Y, Y considerata fenomeno

dipendente di tipo quantitativo ed X considerata fenomeno indipendente, indifferentemente di tipo qualitativo o

quantitativo, organizzati in una distribuzione di frequenze descritta dalla tabella a doppia entrata [n x m] descritta alla

D42.

Focalizzando l’ attenzione sulle distribuzioni del fenomeno Y condizionate dalle modalita’ o valori assunti dal

fenomeno X, si definisce Indipendenza in media di Y da X, la condizione per cui le sue medie condizionate μ(Y|xi)

sono tutte contemporaneamente uguali e quindi uguali alla sua media non condizionata μY ovvero

μ(Y|x1) = μ(Y|x2) = .... = μ(Y|xn) = μY

Pag. 9/26

Parleremo di Interindipendenza in media tra X ed Y, solo nel caso in cui i due fenomeni fossero entrambe di tipo

quantitativo, quando esistera’ una mutua indipendenza in media di una variabile dall’ altra, ovvero

μ(Y|x1) = μ(Y|x2) = .... = μ(Y|xn) = μY

μ(X|y1) = μ(X|y2) = .... = μ(X|ym) = μX

e

D49 - L'indice di dipendenza in media.

Supponiamo di aver rilevato N unita’ statistica relativamente a due fenomeni X ed Y, Y considerata fenomeno

dipendente di tipo quantitativo ed X considerata fenomeno indipendente, indifferentemente di tipo qualitativo o

quantitativo, organizzati in una distribuzione di frequenze descritta dalla tabella a doppia entrata [n x m] descritta alla

D42.

L’ Indice di dipendenza in media η2 detto Rapporto di correlazione,

η2 = σ2y/σ2y = 1 – σ*2y/σ2y

0 ≤ η2 ≤ 1

( σ2y dovrebbe essere sopra segnato e non sottolineato)

e’ una misura del grado di dipendenza in media della variabile Y da X e rappresenta la frazione σ2y normalizzata di

varianza totale σ2y spiegata dalle sue medie condizonate (Y|x1) = μ (Y|x2) = .... = μ (Y|xn)

- η2 = 0 esprime la condizione di indipendenza in media μ (Y|x1) = μ (Y|x2) = .... = μ (Y|xn) = μY

2

2

*2

per cui σ y = 0 ovvero σ y = σ y cioe’ tutta la varianza della variabile Y e’ residua

- η2 = 1 esprime la condizione di massima dipendenza in media per cui σ*2y = 0 ovvero σ2y = σ2y cioe’ tutte le

distribuzioni condizionate Y|xi ehanno varianza residua nulla. Da cio’ ne deriva che ad ad ogni modalita’ od intensita’

assunta dal fenomeno X corrisponde una sola intensita’ assunta dal fenomeno Y.

D50 - Spiegare i concetti di varianza spiegata e varianza residua dalle medie condizionate.

La Varianza Spiegata σ2y dalle medie condizionate rappresenta quella frazione della varianza totale σ2y spiegata, cioe’

posseduta dalla medie condionate per il fatto che differiscono dalla μy . Formalmente rappresenta la media dei

quadrati degli scarti delle medie condizionate μ (Y|xi) dalla media μy

σ2y = σ2[μ (Y|X)] = 1/N [∑i (μ (Y|xi) – μY)2]

(σ2y dovrebbe essere sopra segnato e non sottolineato).

La Varianza Residua σ*2y dalle medie condizionate rappresenta quella frazione della varianza totale σ2y non spiegata

dalle medie condizionate per il fatto che le intensita’ yj differiscono dalle μ (Y|xi). Formalmente rappresenta la media

dei quadrati degli scarti dei valori effettivi yj dalle μ (Y|xi)i

σ*2y = μ [σ2 (Y|X)] = 1/N [∑i σ2 (Y|xi) fi+]

La Varianza Spiegata σ2y e la Varianza Residua σ*2y sono tali per cui σ2y = σ2y + σ*2y

D51 - L'indice di Gini-Goodman-Kruskal.

Consente di misurare la dipendenza di un fenomeno qualitativo (mutabile) Y da un’ altro fenomeno X sia esso

qualitativo che quantitativo. L’ indice di Gini-Goodman-Kruskal τY rappresenta la frazione di dispersione totale γY,

misurata tramite l’ Indice di Gini della mutabile Y, spiegata dalla mutabile condizionata γY (γY dovrebbe essere sopra

segnato e non sottolineato).

τY = γY/γY = 1 - γ*Y/γY

dove γY, detta dispersione spiegata, rappresenta la dispersione spiegata (cioe’ posseduta) dalle mutabili condizionate

e dove γ*Y. detta dispersione residua, rappresenta la dispersione non sopiegata (cioe’ residua) dalle mutabili

condizionate.

D52 - La Covarianza: definizione e campo di variazione.

Si definisce Covarianza, il momento centrale di 2^ ordine

σxy = 1/N [∑i ∑j (xi - μx) (yi - μy) fij] = (μxy - μx μy),

dove μxy rappresenta il momento misto di 2^ ordine, pari a

μxy = 1/N [∑i ∑j xi yi fij]

Si tratta di un operatore atto a quantificare l’ intensita’ del legame tra due fenomeni X ed Y, entrambe di tipo

quantitativo. Il relativo campo di variazione sara’:

- σx σy ≤ σxy ≤ + σx σy

Pag. 10/26

D53 - Il ruolo della covarianza nella retta di regressione.

Data l’ equazione della retta di regressione 1Y* = μy + σxy/σ2x (X - μx), si vede che la covarianza σxy oltre ad influire sul

valore del coefficiente angolare della retta stessa, determina la tipologia di legame (diretto se σxy > 0 o indiretto se σxy

< 0) ovvero determina il segno del coefficiente angolare della retta.

D54 - Il coefficiente di correlazione: definizione e suo campo di variazione.

Si definisce Coefficiente di Correlazione il rapporto

ρ = σxy / σx σy

Si tratta di un coefficiente atto a misura dell’ intensita’ del legame esistente tra le i due fenomeni X ed Y, entrambe di

tipo quantitativo. Il relativo campo di variazione sara’:

-1 ≤ ρ ≤ +1 (ρ = -1 massimo legame funzionale di tipo inverso - ρ = +1 massimo legame funzionale di tipo diretto)

D55 - La relazione tra il coefficiente di correlazione e il coefficiente angolare della retta di regressione.

Data l’ equazione della retta di regressione 1Y* = μy + σxy/σ2x (X - μx) = μy + ρ σy/σx (X - μx), si vede che il

coefficiente di correlazione ρ oltre ad influire sul valore del coefficiente angolare della retta stessa, determina la

tipologia di legame (diretto se ρ > 0 o indiretto se ρ < 0) ovvero determina il segno del coefficiente angolare della

retta.

D56 - La Condizione di accostamento dei minimi quadrati.

Date N osservazioni (xi, yi i = 1,2,...,N) effettuate su due fenomeni quantitativi X ed Y, si cerca un criterio che

permetta di trovare, nell’ ambito di una famiglia di funzioni Y* = Y*(X| a1, a2,...., ah) quella che meglio interpreta,

secondo un qualche criterio da definire, la natura della dipendenza di X da Y. In questo contesto, la condizione di

Accostamento dei Minimi Quadrati

min g(x|a1, a2,...., ah) = min ∑i (yi – y*i)2

rappresenta appunto il criterio adottato per la scelta della funzione. Si giunge a tale condizione imponendo quale

miglior interpolante, quella che minimizza nello spazio N dimensionale, la distanza d(Y, Y*) ovvero la distanza tra il

vettore dei valori osservati Y(y1, y2,...., yN) generato dalle coppie N (xi, yi) ed il vettore Y*(y*1, y*2,...., y*N) generato

dalle coppie N (xi, y*i) = [xi, Y*(xi)]

Si cerca cioe’ il min d(Y, Y*) = min √ ∑i (yi - y*i)2= min √ g(x|a1, a2,...., ah)

D57 - La retta di regressione: definizione e valore dei suoi parametri.

Si definisce Retta di Regressione il polinomio di primo grado 1Y* = a + bX che soddisfa la condizione di Accostamento

dei Minimi Quadrati

min g(x|a, b) = min ∑i (yi – y*i)2 = min ∑i (yi – y*i)2 = min ∑i [yi – (a + bxi)]2

La soluzione del problema di minimo condurra’ ai seguenti paramentri

a = (μy - μx σxy/σ2x)

b = σxy/σ2x

*

ovvero l’ equazione della retta cercata sara’ 1Y = μy + σxy/σ2x (X - μx)

D58 - Il rapporto di correlazione lineare.

Il Rapporto di Correlazione Lineare misura la frazione normalizzata di varianza speigata dalla retta di regressione

ρ2 = 1σ2y/σ2y = 1 – 1σ*2y/σ2y = σ2xy/σ2x σ2y

(1 σ2y dovrebbe essere sopra segnato e non sottolineato).

0 ≤ ρ 2x = ρ2y = ρ2 ≤ η2 ≤ 1

Sostanzialmente rappresenta una misura dell’ interdipendenza lineare che intercorre tra le due variabili X ed Y.

D59 - Spiegare i concetti di varianza spiegata e varianza residua dalla retta di regressione.

2

2

La Varianza Spiegata 1σ y dalla retta di regressione rappresenta quella frazione della varianza totale σ y spiegata,

cioe’ posseduta dalla retta di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori teorici

*

1y i dalla media μy

2

1σ y =

σ2(1Y*) = μ [(1Y* - μy)2] = σ2xy/σ2x

(1σ2y dovrebbe essere sopra segnato e non sottolineato).

Pag. 11/26

La Varianza Residua 1σ*2y dalla retta di regressione rappresenta quella frazione della varianza totale σ2y non spiegata

dalla retta di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori effettivi yi da quelli

teorici 1y*i

*2

1σ y

= μ [(Y - 1Y*)2] = 1/N [∑i (yi – 1y*i)2] = σ2y - σ2xy/σ2x

2

La Varianza Spiegata 1 σ y e la Varianza Residua 1σ

*2

y sono tali

2

2

*2

per cui σ y = 1σ y + 1σ

y

D60 - Spiegare il significato del coefficiente angolare della retta di regressione.

Data l’ equazione della retta di regressione 1Y* = μy + σxy/σ2x (X - μx) = μy + ρ σy/σx (X - μx), si vede che il

coefficiente angolare della retta, ovvero il coefficiente che moltiplica la variabile indipendente X, e’ pari a

σxy/σ2x = ρ σy/σx

risultando percio’ direttamente proporzionale alla covarianza σxy oppure al coefficiente di correlazione ρ: per questa

ragione

- la tipologia di legame (diretto se σxy(ρ) > 0 o indiretto se σxy(ρ) < 0) influisce sul segno del coefficiente angolare

della retta

- l’ intensita’ del legame funzionale tra Y ed X se σxy(ρ) ≠ 0 (max legame quando σxy(ρ) = ±1 - max scorrelazione

quando σxy(ρ) = 0) influisce sull’ entita’ della pendenza della retta.

D61 - Il sistema di equazioni per il calcolo della parabola di regressione.

Date N osservazioni (xi, yi i = 1,2,...,N) effettuate su due fenomeni quantitativi X ed Y, applicando la condizione di

Accostamento dei Minimi Quadrati alla famiglia di funzioni 2Y* = a + bX + cX2 si trova la seguente condizione:,

min g(a, b, c) = min ∑i (yi - a - bxi - cx2i)2

∂f/∂a = -∑i 2(yi - a - bxi - cx2i)2 = 0

∂f/∂a = -∑i 2(yi - a - bxi - cx2i)2 xi = 0

∂f/∂a = -∑i 2(yi - a - bxi - cx2i)2 x2i= 0

Da cui deriva

∑i yi = N a + b∑i xi + c∑i x2i

∑i xiyi = a∑i xi + b∑i x2i + c∑i x3i

∑i x2iyi = a∑i x2i + b∑i x3i + c∑i x4i

Ovvvero un sistema di 3 equazioni lineari nelle tre incognite a, b, c risolvibile ricorrendo alla notazione matriciale [(1)

Vedasi pag. 174].

D62 - La parabola di regressione: definizione, determinazione dei parametri e misura del suo adattamento ai dati

Si definisce Parabola di Regressione il polinomio di secondo grado 2Y* = a + bX + cX2 che soddisfa la condizione di

Accostamento dei Minimi Quadrati

min g(a, b, c) = min ∑i (yi - a - bxi - cx2i)2

La soluzione del problema di minimo condurra’ ai seguente sistema di tre equazioni nelle tre incognite a, b, c

∑i yi = N a + b∑i xi + c∑i x2i

∑i xiyi = a∑i xi + b∑i x2i + c∑i x3i

∑i x2iyi = a∑i x2i + b∑i x3i + c∑i x4i

Come misura dell’ addattamento ai dati si utilizza il rapporto di correlazione parabolico 2η2 che rappresenta la frazione

2

normalizzata di varianza totale σ y spiegata dalla parabola di regressione

2

2

2

2η = 2σ y/σ y

= 1 – 2σ*2y/σ2y

(2σ2y dovrebbe essere sopra segnato e non sottolineato).

0 ≤ ρ2 ≤ 2η2y ≤ η2y ≤ 1

2

2

Dove la Varianza Spiegata 2σ y dalla parabola di regressione rappresenta quella frazione della varianza totale σ

spiegata, cioe’ posseduta dalla parabola di regressione.

y

Dove la Varianza Residua 2σ*2y della parabola di regressione rappresenta quella frazione della varianza totale σ2y non

spiegata dalla parabola di regressione.

Pag. 12/26

D63 - Gli indici di miglioramento.

Si definiscono Indici di miglioramento, le quantita’ r+1ρ2 = (rσ*2y + r+1σ*2y)/ rσ*2y, ovvero le frazioni normalizzate del

decremento di varianza residua che si ottiene nel passaggio dal polinomio di grado r al polinomio di grado (r + 1).

Rappresentano in sostanza l’ incrementio di precisione raggiunto nell’ interpretare la dipendenza di Y da X con un

polinomio di grado superiore.

D64 - Spiegare i concetti di varianza spiegata e varianza residua dalla parabola di regressione.

La Varianza Spiegata 2σ2y dalla parabola di regressione rappresenta quella frazione della varianza totale σ2y spiegata,

cioe’ posseduta dalla parabola di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori

teorici 2y*i dalla media μy

2

2σ y =

σ2(2Y*) = μ [(2Y* - μy)2] = 1/N [∑i (a + bxi + c x2i - μy)2

(1σ2y dovrebbe essere sopra segnato e non sottolineato).

La Varianza Residua 2σ*2y della parabola di regressione rappresenta quella frazione della varianza totale σ2y non

spiegata dalla parabola di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori effettivi yi

da quelli teorici 2y*i

*2

2σ y

= μ [(Y - 2Y*)2] = 1/N [∑i (yi – 2y*i)2] = 1/N ∑i (yi - a - b xi - c x2i)2 =

= 1/N [∑i y2i - a ∑i yi - b ∑i xi yi - c ∑i x2i yi]

La Varianza Spiegata 2 σ2y e la Varianza Residua 2σ*2y sono tali per cui σ2y = 2σ2y + 2σ*2y

D65 - Il sistema di equazioni per il calcolo del piano di regressione.

Date N osservazioni (xi, yi i = 1,2,...,N) effettuate su tre fenomeni quantitativi X, Z ed Y, se la natura del fenomeno lo

giustifica, applicando la condizione di Accostamento dei Minimi Quadrati alla famiglia di funzioni Y*XZ = a + bX + cZ si

trova la seguente condizione:,

min g(a, b, c) = min ∑i (yi - a - bxi - czi)2

∂f/∂a = -∑i 2(yi - a - bxi - czi)2 = 0

∂f/∂a = -∑i 2(yi - a - bxi - czi)2 xi = 0

∂f/∂a = -∑i 2(yi - a - bxi - czi)2 zi= 0

Da cui deriva

∑i yi = N a + b∑i xi + c∑i zi

∑i xiyi = a∑i xi + b∑i x2i + c∑i xizi

∑i ziyi = a∑i zi + b∑i xizi + c∑i z2i

Ovvvero un sistema di 3 equazioni lineari nelle tre incognite a, b, c risolvibile ricorrendo alla notazione matriciale [(1)

Vedasi pag. 185].

D66 - Spiegare i concetti di varianza spiegata e varianza residua dal piano di regressione.

La Varianza Spiegata 2σ2y dal piano di regressione rappresenta quella frazione della varianza totale σ2y spiegata, cioe’

posseduta dal piano di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori teorici XZy*i

dalla media μy

2

XZσ y =

σ2(XZY*) = μ [(XZY* - μy)2] = 1/N [∑i (a + bxi + c zi - μy)2

(XZσ2y dovrebbe essere sopra segnato e non sottolineato).

*2

2

Dove la Varianza Residua XZσ y dal piano di regressione rappresenta quella frazione della varianza totale σ y non

spiegata dal piano di regressione. Formalmente rappresenta la media dei quadrati degli scarti dei valori effettivi yi da

quelli teorici XZy*i

*2

XZσ y

= μ [(Y – XZY*)2] = 1/N [∑i (yi – XZy*i)2] = 1/N ∑i (yi - a - b xi - c x2i)2 da cui dopo brevi passaggi

*2

XZσ y

= 1/N (∑i y2i) - aμy - bμXY - c μZY

2

*2

2

2

*2

La Varianza Spiegata XZσ y e la Varianza Residua XZσ y sono tali per cui σ y = XZσ y + XZσ y

Pag. 13/26

Come misura dell’ addattamento ai dati si utilizza il rapporto di correlazione multipla linear

2

frazione normalizzata di varianza totale σ y spiegata dal piano di regressione

2

2

2

XZη y = XZσ y /σ y

2

XZη y

che rappresenta la

= 1 – XZσ*2y /σ2y

0 ≤ XZη2y ≤ 1

D67 - Qual è la differenza tra migliore interpolante e perfetta interpolante?

Il miglior polinomio interpolante di grado r sara’ quella che corrisponde alla condizione di medie condizionate

“allineate” in presenza pero’ di residuo ineliminabile, ovvero con

2

rσ y

= σ2y < σ2y

0 ≤ rη2y = η2y < 1

*2

rσ y

= rσ*2y ≠ 0

L’ interpolante perfetta, sara’ quella che corrisponde alla condizione di medie condizionate “allineate” in senso lato

sul polinomio di grado r senza residuo, ovvero

2

rσ y

= σ2y = σ2y

0 ≤ rη2y = η2y = 1

*2

rσ y

= σ*2y = 0

Intendendo

2

2

2

rη = rσ y/σ y

= 1 – rσ*2y/σ2y

(rσ2y dovrebbe essere sopra segnato e non sottolineato).

0 ≤ ρ2 ≤ 2η2y ≤ ...... ≤ rη2y ≤......≤ n-1η2y = η2y ≤ 1

D68 - Qual è il residuo di regressione in un modello polinomiale di grado zero.

Il residuo di regressione in un modello polinomiale di grao zero, e’ rappresentato dall Varianza Residua σ*2y delle

2

medie condizionate che appunto rappresenta quella frazione della varianza totale σ y non spiegata dalle medie

condizionate per il fatto che le intensita’ yj differiscono dalle μ (Y|xi). Formalmente rappresenta la media dei quadrati

degli scarti dei valori effettivi yj dalle μ (Y|xi)i

σ*2y = μ [σ2 (Y|X)] = 1/N [∑i σ2 (Y|xi) fi+]

D69 - Il modello di regressione di massimo grado in presenza di m distribuzioni condizionate.

Nel caso di m distribuzioni condizionate, il modello di regressione di massimo grado sara’ un polinomio di grado (m-1)

m-1Y

*

= a0 + a1X + a2 X2 + a3 X3 + a4 X4 + ........ + am-1 Xm-1

In questo caso il polinomio sara’ il miglior interpolante, passera’ per le m medie condizionate (che pertanto

risulteranno “allineate” in senso lato) e di conseguenza si verifichera’ che la Varianza Spiegata m-1 σ2y = σ2y , la

Varianza Residua m-1σ*2y = σ*2y e pertanto il rapporto di correlazione del polinomio m-1ρ2 coincidera‘ con il rapporto di

2

2

2

correlazione η dovuto alle medie condizionate m-1ρ = η

D70 - Quali tra le seguenti affermazioni sono corrette:

a) l’indipendenza in media è condizione necessaria e sufficiente per l’indipendenza stocastica - Falsa

b) l’indipendenza in media è condizione necessaria e ma non sufficiente per l’indipendenza stocastica - Vera

c) l’indipendenza stocastica è condizione sufficiente per l’indipendenza in media - Vera

d) l’indipendenza stocastica può esistere solo tra fenomeni quantitativi - Falso

e) se esiste indipendenza stocastica la covarianza è nulla - Vera

f) se esiste interindipendenza in media esiste anche incorrelazione - Vera

D71 - Dati i caratteri X e Y rilevati congiuntamente su N unità statistiche e calcolate le equazioni delle rette di

regressione che rispettivamente esprimono X in funzione di Y e Y in funzione di X,

a) possono le due rette presentarsi parallele nel piano ?

*

2

Perché? No, perche’ le due rette 1Y = μy + σxy/σ x (X - μx)

*

2

e 1X = μx+ σxy/σ y (Y - μy), qualunque sia la loro

pendenza, si intersecano sempre nel punto di coordinata

(μx, μy) pertanto cio’ esclude in generale il fatto che

possano essere parallele, tranne appunto il caso della loro

coincidenza cioe’ quando ρ2 = 1.

b) possono essere perpendicolari? In che caso? Si quando le

medie condizionate sono strutturate in modo tale da

Y

μy

2/n

μx

X

x

Pag. 14/26

essere sintetizzate da rette di regressione orizzontali

ovvero ρ2 = 0.

c) se incidenti, quali sono le coordinate del punto di

intersezione? Le due rette 1Y* = μy + σxy/σ2x (X - μx) e 1X*

= μx+ σxy/σ2y (Y - μy), qualunque sia la loro pendenza, si

intersecano sempre nel punto di coordinata (μx, μy)

Al variare di ρ le due rette ruotano attorno al punto (μx, μy)

2

partendo dala condizione ρ = 0 di perpendicolarita’ per giungere

2

alla loro coincidenza quando ρ = 1 passando attraverso tutte le

condizioni intermedie. Nel grafico sono riportate le diverse

situazioni nel caso in cui 0 ≤ ρ ≤ 1 (legame X-Y di tipo diretto).

Analoghe considerazioni si possono fare quando -1 ≤ ρ ≤ 0 (legame

X-Y di tipo inverso)

2

- ρ = 0 - rette blu

2

- 0 < ρ < 1 - rette nera e viola

2

- ρ = 1 – retta rossa

d) possono essere coincidenti ? In che caso? Si, nel caso in cui ρ2 = 1 ovvero quando le rette di regressione sono

interpolanti perfette, non esiste cioe’ residuo ovvero ad ogni valore di X corrisponde un solo valore di Y ed

ovviamente viceversa.

e) possono avere coefficienti angolari di segno opposto? Perché? No, perche’ sia nel caso della 1Y* = μy + σxy/σ2x (X μx) che nel caso della 1X* = μx+ σxy/σ2y (Y - μy), il segno del coefficiente angolare dipende dalla sola σxy che e’ la

stessa in entrambe in casi.

D72 - Spiegare i vari significati che può assumere il rapporto di correlazione lineare.

Definito il Rapporto di Correlazione Lineare

ρ2 = 1σ2y/σ2y = 1 – 1σ*2y/σ2y = σ2xy/σ2x σ2y

2

(1 σ y dovrebbe essere sopra segnato e non sottolineato).

0 ≤ ρ 2x = ρ2y = ρ2 ≤ η2 ≤ 1

Da una parte, considerando le relazioni ρ2 = 1σ2y/σ2y = 1 – 1 σ*2y/σ2y, puo’ interpretarsi come una misura della

frazione normalizzata 1σ2y dellla varianza totale σ2y spiegata dalla retta di regressione

Dall’ altra parte, considerando le relazioni ρ2 = σ2xy/σ2x σ2y puo’ interpretarsi come l’ attitudine congiunta delle due

variabili X ed Y, ad essere una funzione dell’ altra, ovvero come una misura dell’ interdipendenza lineare che

intercorre tra le due variabili X ed Y.

D73 - Se ρ² = 0 quale è l’equazione della retta di regressione? Motivare la risposta

Essendo ρ² = 0, quindi ρ = 0 e conseguentemente σxy = 0, ne consegue che il coefficiente angolare della retta di

regressione σxy/σ2x = ρ σy/σx e’ nullo e pertanto l’ equazione della retta di regressione e’ 1Y* = μy .

D74 - Stabilire i possibili valori assumibili da ρ² a seconda dei seguenti casi:

a) η²(X) = 1 η² (Y) = 1 - ρ² = 1

b) η²(X) = 0.7 η² (Y) = 1 - 0 < ρ² < 1

c) η²(X) = 0 η² (Y) = 0 - ρ² = 0

d) η²(X) = 0.5 η² (Y) = 0.6 - 0 < ρ² ≤ 0.5

Pag. 15/26

CORSO DI STATISTICA I (AA 2012-13)

Elenco delle possibili domande

della prova teorica in forma scritta

DOMANDE DI PROBABILITA’

P1 - Gli eventi casuali propri.

Si definisce Evento casuale proprio ogni realta’ o accadimento o risultato relativo ad una osservazione o esperimento

realizzatosi, ma del quale non se ne consoce il risultato. Si definisce Evento elementare ogni possibile esito dell’

osservazione o esperimento.

P2 - L'operazione di unione tra eventi casuali: definizione e sue proprietà (commutativa, associativa e di

idempotenza).

Dato un esperimento e definito l’ evento certo o Spazio Campionario Ω = {ξ1 - ξ 2 - ..... - ξj - .....}, dove ξj rappresenta

il generico risultato dell’ esperimento e {ξj} un generico evento elementare, e dati A e B due generci eventi, si

definisce Evento unione A+B, l’ evento costituito dall’ insieme degli eventi elementari di A e di B.

- Proprieta’ commutativa - A+B = B+A

- Proprieta’ associativa - A+(B+C) = (A+B)+C = A+B+C

- Proprieta’ di idempotenza - A+A = A

P3 - L'operazione di intersezione tra eventi casuali: definizione e sue proprietà (commutativa, associativa e di

idempotenza).

Dato un esperimento e definito l’ evento certo o Spazio Campionario Ω = {ξ1 - ξ 2 - ..... - ξj - .....}, dove ξj rappresenta

il generico risultato dell’ esperimento e {ξj} un generico evento elementare, e dati A e B due generci eventi, si

definisce Evento intersezione A*B, l’ evento costituito dall’ insieme degli eventi elementari comuni sia ad A che a B.

- Proprieta’ commutativa - A*B = B*A

- Proprieta’ associativa - A*(B*C) = (A*B)*C = A*B*C

- Proprieta’ di idempotenza - A*A = A

P4 - Eventi dipendenti e indipendenti - Compatibili ed incompatibili.

Un evento A e’ indipendente da un evento B se P(A|B) = P(A) ovvero se P(A*B) = P(A) P(B), in caso contraio

parleremo di eventi dipendenti.

Due eventi A e B si dicono incompatibili quando al verificarsi dell’ uno non si presenta l’ altro e viceversa, ossia

quando A*B = Ø, in caso contrario parleremo di eventi compatibili.

P5 - Definire ed esemplificare una partizione dello spazio campionario.

Un insieme di n eventi A1, A2,..., An rappresenta una Partizione dello Spazio Campionario Ω, se sono a due a due

incompatibili Ai*Aj = Ø e la loro unione genera l’ evento certo A1+A2+......+An = Ω

P6 - Se due eventi sono incompatibili, sono tra loro indipendenti ? Giustificare la risposta (Vedi Nota_2 pag. 25).

Due eventi A e B sono incompatibili quando A*B = Ø ovvero P(A*B) = P(Ø) = 0, mentre due eventi sono

indipendenti quando P(A|B) = P(A) [P(B|A) = P(B)] ovvero se P(A*B) = P(A) P(B): visto che risulta P(A*B) = 0 ≠

P(A) P(B) i due eventi potrebbero essere indipendenti se e solo se P(A) = 0 oppure P(B) = 0. Cioe’ se due eventi

sono incompatibili allora non sono indipendenti (il verificarsi di uno ci dà la certezza che l’altro non può verificarsi)

Due eventi incompatibili, cioè disgiunti, non sono mai indipendenti a meno che uno dei due non abbia probabilità

nulla: il fatto stesso di escludersi vicendevolmente fa sì che il verificarsi dell’uno dipenda dal verificarsi o meno

dell’altro. Infatti per due eventi A e B indipendenti ed incompatibili si ha:

P(A|B) = P(A) P(B) = P(Ø) = 0 e quindi almeno una tra P(A) e P(B) è 0.

Se A e B sono incompatibili, abbiamo: A*B = Ø e P(A+B) = P(A) + P(B)

Se A e B sono compatibili, abbiamo: A*B ≠ Ø e P(A+B) = P(A) + P(B) - P(A*B)

Pag. 16/26

P7 - La formula della probabilità composta.

Dalle formule delle probabilita’ condizionate P(A|B) = P(A*B)/P(B) e P(B|A) = P(A*B)/P(A) si puo’ ricavare la

formula della probabilita’ composta P(A*B) = P(A|B) P(B) = P(B|A) P(A)

P8 - I vari concetti di probabilità.

- Concezione classica: dato un evento A si definisce probabilita’ P(A) dell’ evento, il rapporto tra il numero di casi

favorevoli n(A) ed il numero di casi possibili n(Ω) realizzabili nell’ esperimento oggetto dell’ osservazione P(A) =

n(A)/n(Ω)

- Concezione statistica: dato un evento A si definisce probabilita’ P(A) dell’ evento, se esiste finita, la quantita’ P(A)

= lim nà∞ n(A)/n(Ω), cioe’ il rapporto tra il numero di casi n(A) in cui e’ stato osservato A ed il numero totale di

osservazioni n, effettuate tutte nelle medesime condizioni sperimentali.

- Concezione soggettiva: dato un evento A si definisce probabilita’ P(A) dell’ evento, la misura del grado di fiducia

che il soggetto attribuisce al verificarsi dell’ evento stesso

P9 - Gli assiomi di Kolmogorov.

Dato uno spazio probabilizzabile (Ω, BΩ) dove Ω = {ω1, ω2,...., ωn} rappresenta lo spazio campionario generato dai

risultati dell’ esperimento e BΩ= {{Ø}, {ω1}, {ω2},...., {ωn}, {ω1, ω2}, ..., {ω1, ωn}, ......, {ω1, ω2,...., ωn}} l’ insieme

costituito da tutti i possibili sottoinsiemi ottenibili a partire da Ω (BΩ risultata chiuso rispetto a qualunque operazione

di unione, intersezione e complemento pertanto e’ un’ Algebra di Boole), tutte le leggi del calcolo probabilistico

possono essere dedotte dai seguenti assiomi:

1. P(A) ≥ 0 con A Є B Ω

2. P(Ω) = 1

3. P(A+B) = P(A) + P(B) se A*B = Ø

La quantita’ P(A) e’ detta probabilita’ dell’ evento A. Viene considerato 4o assioma anche la relazione delle

Probabilita’ condizionate P(A|B) = P(A*B)/P(B)

P10 - La formula delle probabilità totali.

P(A+B) = P(A) + P(B) – P(A*B)

P11 - La probabilità condizionata e la probabilità di eventi indipendenti.

- Probabilita’ condizionata: P(A|B) = P(A*B)/P(B)

[P(B|A) = P(A*B)/P(A)]

- Probabilita’ eventi indipendenti: P(A*B) = P(A) P(B) [P(A|B) = P(A)]

P12 - Il Teorema di Bayes: definizione e sua derivazione dalla formula delle probabilità condizionate.

La Formula di Bayes o Legge delle probabilita’ delle cause, consente di calcolare la probabilita’ che il manifestarsi di

un evento sia imputabile ad una specifica fra le altre possibili cause che sono tra loro incompatibili (probabilita’ a

posteriori)

P(A|B) = P(A*B)/P(B) = [P(A|B) P(B)]/[ P(A) P(B/A) + P(Ā) P(B|Ā)]

Per la dimostrazione si parte dalla P(A|B) = P(A*B)/P(B) ricordando che

P(A*B) = [P(B|A) P(A)]

P(B) = P(B*A) + P(B*Ā)

P13 - Facendo riferimento all’esperimento lancio di un dado esemplificare i seguenti casi:

a) evento certo - Ω = {f1 - f2 - f3 - f4 - f5 - f6} dove fi rappresenta il numero raffigurato sull’ i-esima faccia del dado

b) evento impossibile - Ø = { }

c) eventi compatibili - A = {f1 - f2 - f3} = {“Insieme delle facce sui cui e’ raffigurato un numero < 4”}

B = {f2 - f4 - f6} = {“Insieme delle facce sui cui e’ raffigurato un numero pari”}

d) eventi incompatibili - A = {f1 - f3 - f5} = {“Insieme delle facce sui cui e’ raffigurato un numero dispari”}

B = {f2 - f4 - f6} = {“Insieme delle facce sui cui e’ raffigurato un numero pari”}

Pag. 17/26

P14 - La probabilità dell’evento complementare.

Dato un evento A costituito da eventi elementari appartenenti allo spazio campionario Ω, per definizione di evento

complementare avremo che Ω = A + Ā pertanto ne consegue che P(Ā) = 1 - P(A)

P15 - Quali tra le seguenti affermazioni sono vere?

a) L’evento impossibile è l’evento complementare dello spazio campionario - Vero

b) La probabilità di un evento è un valore compreso tra -1 e 1 - Falso

c) Lo spazio campionario è l’insieme dei possibili eventi elementari - Vero

d) Se due eventi A e B sono incompatibili, la loro unione dà l’insieme vuoto - Vero

e) Se due eventi A e B sono indipendenti allora P(A|B) = P(A) - Vero

P16 - La v.a. uniforme discreta: definizione, legge di probabilità, media e varianza.

Una distribuzione uniforme discreta, uniforme in un intervallo [a, b] e’ una legge di distribuzione che attribuisce a

tutti gli elementi dell’ insieme dei valori assunti dalla v.a. X, in numero finito n, la medesima probabilita’. Nell’ ipotesi

che i valori assunti dalla v.a. X siano in progressione aritmetica, avremo che

f(x)

f(x) = 1/n con xi = a, ..., a + (b – a) (i - 1)/(n – 1), ..., b

x1 = a e xn = b con i Є {1, 2, ..., n}

1/n

La corrispondente funzione di ripartizione sara’

x

a …… xi ……

|0

F(x) = <| Σi i/n

|

|1

con x < x1 = a

con a ≤ xi ≤ x < xi+1 ≤ b

x1 = a e xn = b con i Є {1, 2, ..., (n – 1)}

con x ≥ xn = b

F(x)

1

2/n

1/n

x

a …… xi ……

Valore medio - μ x = (a + b)/2

2

2

Varianza - σ2x = [(b – a) (n + 1)]/[12 (n – 1)] = (n – 1)/12

b

b

2/n

P17 - La v.a. Binomiale: definizione, legge di probabilità, media e varianza.

Definita la v.a. X = {numero di elementi favorevoli o successi eseguendo n prove indipendenti a probabilita’ costanti},

avremo che X si distribuisce con Legge Binomiale, ovvero la probabilita’ che P(X=x) varra’

Bi(x|n, p) = (n x) px qn-x con x = 1, 2, ..., n dove

(n x) rappresenta il coefficiente binomiale

n = numero di prove ripetute

p = probabilita’ evento favorevole

q = (1 – p) = probabilita’ evento sfavorevole

La corrispondente funzione di ripartizione sara’

FBi = Σxj=0 (n j) pj qn-j

Valore medio - μ x = np

Varianza - σ2x = npq

P18 - La v.a. Ipergeometrica: definizione, legge di probabilità, media e varianza.

Definita la v.a. X = {numero di elementi favorevoli o successi eseguendo n prove indipendenti effettuate in blocco su

una popolazione di numerosita’ N}, avremo che X si distribuisce con Legge Ipergeometrica, ovvero la probabilita’ che

P(X=x) varra’

Pag. 18/26

H(x|N,n, p) = [(Np x) (Nq (n - x))]/(N n) con

(Np x), (Nq

max[0, (n- Nq)] ≤ x ≤ min(N, Np) e dove

(n - x)) e (N n) rappresentano coefficienti binomiali

N = numerosita’ popolazione

Np = numero elementi favorevoli

Nq = numero elementi sfavorevoli

n = numero di prove ripetute

p = frazione elementi favorevoli

q = (1 – p) = frazione elementi sfavorevoli

La corrispondente funzione di ripartizione sara’

FH = Σxj=0 [(Np j) (Nq (n - j))]/(N n)

Valore medio - μ x = np

Varianza - σ2x = npq (N – n)/(N-1)

P19 - La v.a. Geometrica: definizione, legge di probabilità, media e varianza.

Definita la v.a. X = {numero di prove indipendenti effettuate a probabilita’ costanti per ottenere il 1^ successo} avremo

che X si distribuisce con Legge Geometrica, ovvero la probabilita’ che P(X=x) varra’ x

Ge(x|p) = (1 - p)x-1 p con x = 1, 2, ... dove

p = probabilita’ evento favorevole

La corrispondente funzione di ripartizione sara’

FGe = 1 - (1 - p)x

Valore medio - μ x = 1/p

Varianza - σ2x = q/p

P20 - La v.a. Binomiale Negativa (Pascal): definizione, legge di probabilità, media e varianza.

Definita la v.a. X = {numero di prove indipendenti effettuate a probabilita’ costanti necessarie per ottenere k successi}

avremo che X si distribuisce con Legge di Pascal o Binomaile negativa, ovvero la probabilita’ che P(X=x) varra’

Pa(x|p, k) = ((x - 1) (k - 1)) pk qx-k con x = k, (k =1), ... dove

((x - 1)

(k - 1)) rappresenta il coefficiente binomiale

p = probabilita’ evento favorevole

q = (1 – p) = probabilita’ evento sfavorevole

La corrispondente funzione di ripartizione sara’

FPa = Σxj=k ((j - 1) (k - 1)) pk qj-k

Valore medio - μ x = k/p

Varianza - σ2x = kq/p

P21 - In quali casi la v.a. Ipergeometrica può essere ben approssimata dalla v.a. Binomiale?

Con riferimento alla descrizione riportata al P18, nell’ ipotesi che N à +∞ e che N >> n, una v.a. Ipergeometrica puo’

essere ben approssimata da una v.a. Binomiale.

P22 - La v.a. Poisson: definizione, legge di probabilità, media e varianza.

Con riferimento alla descrizione riportata al P17, nell’ ipotesi che n sia un valore molto grande e che p sia viceversa

molto piccolo (eventi rari) per cui il loro prodotto assumera’ un valore finito np = λ, una v.a. Binomiale puo’ essere

ben approssimata da una v.a. detta di Poisson la cui legge di probabilita’, ovvero la probabilita’ che P(X=x) varra’

Po(x|λ) = λx e-x/x! con x = 1, 2, ...

e dove λ ≥ 0

La corrispondente funzione di ripartizione sara’

FPo(x) = Σxj=0 λx e-λ/x!

Pag. 19/26

Valore medio - μ x = λ

2

Varianza - σ x = λ

P23 - In quali casi la v.a. Binomiale può essere ben approssimata dalla v.a. di Poisson?

Con riferimento alla descrizione riportata al P17, nell’ ipotesi che n sia un valore molto grande e che p sia viceversa

molto piccolo (eventi rari) per cui il loro prodotto assumera’ un valore finito np = λ, una v.a. Binomiale puo’ essere

ben approssimata da una v.a. detta di Poisson

Bi(x|n, p) ~ Po(x|λ)

P24 - In quali casi la v.a. Binomiale può ben essere approssimata alla v.a. Normale?

Con riferimento alla descrizione riportata al P17, nell’ ipotesi che n sia un valore molto grande (n à +∞) e che |p –

q|< ε ossia la differenza tra la probabilita’ dell’ evento favorevole e quello svaforevole sia piccola (p à 1/2 e q à

1/2), una v.a. Binomiale converge ad una v.a. distribuita con Legge Normale

Bi(x|n, p) ~ N(np, √npq)

P25 - La v.a. discreta: definizione, legge di probabilità, funzione di ripartizione, media e varianza

Si definisce v.a. Discreta un’ applicazione X = X(ω) che associa a ciascun evento ω dello spazio campionario Ω un

numero reale x, se i valori di interesse sono al piu’ una infinita’ numerabile: si tratta cioe’ di punti isolati sull’

asse reale cui e’ possibile associare una probabilita’.

Si definisce Legge di probabilita’, la funzione f(x) che associa a ciascun esito possibile x della v.a. X la probabilita’ che

esso si verifichi f(x) = P(x) : R à [0, 1]

Si definisce Legge di ripartizione, la funzione F(x) che associa a ciascun esito possibile x della v.a. X la corrispondente

probabilita’ cumulata F(xi) = P(X ≤ xi) = Σij P(xj)

Valore medio - μ x = Σi xi P(xi) = Σi xi f(xi)

2

2

2

2

2

Varianza - σ x = Σi (xi - μ x) P(xi) = Σi (xi - μ x) f(xi) = [Σi x i f(xi)] - μ x

P26 - La v.a. continua definizione, funzione di densità di probabilità funzione di ripartizione, media e varianza

Si definisce v.a. Continua un’ applicazione X = X(ω) che associa a ciascun evento ω dello spazio campionario Ω

un numero reale x, se i valori di interesse sono contenuti in uno o piu’ insiemi aperti limitati o non limitati.

In tal caso si definisce funzione di ripartizione, la funzione F(x) continua ovunque, che associa a ciascun esito

x

possibile x della v.a. X la corrispondente probabilita’ cumulata F(x) = P(X ≤ x) = +∞∫ f(t) dt. La funzione f(x),

denominata Funzione di densita’ di probabilita’, sara’ caratterizzata dalle seguenti proprieta’:

1) f(x) ≥ 0

2) +∞∫+∞ f(x) dx = 1

Avremo inoltre che P(a < x ≤ b) = F(b) - F(a) e che f(x) = F’(x) = dF(x)/dx

Valore medio - μ x = +∞∫+∞x f(x) dx

2

2

2

Varianza - σ x = +∞∫+∞(x - μ x) f(x) dx = +∞∫+∞x f(x) dx - μ x

P27 - Il lancio di un dado perfettamente equilibrato a quale v.a. dà origine?

Dato l’ esperimento lancio di un dado perfettamente equilibrato, se utilizziamo l’ applicazione che associa a ciascuna

delle sei facce del dado il valore corrispondente alla cifra impressa sullla faccia del dado stesso, otterremo una v.a. di

tipo discreto. Ad ogni evento elementare {fi} dello spazio campionario Ω = {f1 - f2 - f3 - f4 - f5 - f6}, risultera’ associato

uno dei primi sei numeri naturali, cui corrsipondera’ la medesima probabilita’ P(i) = P(fi) dell’ evento elementare

corrispondente {fi}, ne consegue che la forma analitica della legge di probabilita’ f(x) e della probabilita’ cumulata F(x)

saranno

|1/6

|1/6

f(xi) = <|1/6

|1/6

|1/6

|1/6

x1 = 1

x2 = 2

x3 = 3

x4 = 4

x5 = 5

x6 = 6

|0

| 1/6

| 2/6

F(x) = P(X ≤ x) = <| 3/6

| 4/6

| 5/6

per

per

per

per

per

per

x<1

1≤x<2

2≤x<3

3≤x<4

4≤x<5

5≤x<6

Pag. 20/26

|1

per

x≥1

P28 - Le principali v.a. discrete studiate: per ognuna definire la funzione di probabilità, i parametri che la

caratterizzano.

- v.a.Uniforme: vedi descrizione riportata al P16

- v.a. Binomiale: vedi descrizione riportata al P17

- v.a. Ipergeometrica: vedi descrizione riportata al P18

- v.a. Geometrica: vedi descrizione riportata al P19

- v.a.Pascal: vedi descrizione riportata al P20

- v.a.Poisson: vedi descrizione riportata al P22

P29 - La funzione di ripartizione: definizione e proprietà

Dato uno spazio probabilizzabile (Ω, BΩ) dove Ω = {ω1, ω2,...., ωn} rappresenta lo spazio campionario generato dai

risultati dell’ esperimento e BΩ= {{Ø}, {ω1}, {ω2},...., {ωn}, {ω1, ω2}, ..., {ω1, ωn}, ......, {ω1, ω2,...., ωn}} l’ insieme

costituito da tutti i possibili sottoinsiemi ottenibili a partire da Ω, l’ applicazione univoca X = X(ω) con X: Ωà

à R e’

-1

una v.a. se per ogni semiretta R(x) = (-∞, x] la sua immagine inversa A(x) = X [R(x)] e’ contenuta in B Ω.

Ne consegue che P[A(x)] = P[R(x)] = P(X ≤ x) e che allo spazio di probabilita’ (Ω, BΩ, P) in Ω, corrisponde lo spazio di

probabilita’ (R, BR, P) in R. In tali ipotesi la funzione F(x) = P(X ≤ x) con x Є R che assegna ad ogni semiretta R(X) la

probabilita’ della sua controimmagine A(x) = X-1[R(x)] e’ detta Funzione di ripartizione della v.a. X. Proprieta’:

- 0 ≤ F(x) ≤ 1)

- Se x1 < x2 allora F(x1) ≤ F(x2) cioe’ F(x) e’ una funzione non decrescente

- F(-∞) = 0 e F(+∞) = 1

- limhà0+ [F(x + h) - F(x)] = 0 cioe’ F(x) e’ una funzione continua da destra

P30 - I parametri attraverso cui si esprimono le leggi di probabilità v.a. Binomiale e la v.a. Ipergeometrica.

- v.a. Binomiale: vedi descrizione riportata al P17

- v.a. Ipergeometrica: vedi descrizione riportata al P18

P31 - Qual è il significato dei valori che sono riportati nelle tavole della Normale Standard?

I valori riportati nelle tavole della Normale Standardizzata rappresentano la funzione di ripartizione F(z) = P(Z ≤ z) al

variare di z

P32 - L'obbiettivo della formula di standardizzazione.

Data una v.a. X distribuita con Legge Normale, l’ obiettivo della standardizzazione, ottenuto tramite la trasformazione

lineare Z = (X - μ x)/σx, e’ quello di consentire l’ utilizzo delle tavole pre-calcolate messe a disposizione per la

determinazione della F(z) = P(Z ≤ z) e quindi della F(x) = P(X ≤ x)

P33 - Nella v.a. Normale quali indici coincidono? La forma distributiva è simmetrica?

Moda, mediana e valore medio coincidono. La forma distributiva e’ simmetrica, quindi caratterizzata da un indice di

Pearson γ1 = 0.

P34 - La v.a. uniforme continua (rettangolare).

Consideriamo il caso di una v.a. continua X che presenta la max incertezza nel predire il risultato atteso nel campo (a,

b). La relativa funzione di densita’ si dice uniforme o rettangolare R(a, b) e presenta la seguente forma analitica

| 1 /(b – a)

f(x) = <|

|0

con a < x < b

altrove

f( x)

1 / (b-a)

x

a

b

Pag. 21/26

La corrispondente funzione di ripartizione sara’

|0

F(x) = <|(x – a)/(b – a)

|1

con x ≤ a

con a < x <b

con x ≥ b

Valore medio - μ x = (b + a)/2

Varianza - σ2x = (b – a)2/12

F( x)

1

x

a

b

Pag. 22/26

CORSO DI STATISTICA I (AA 2012-13)

Elenco delle possibili domande

della prova teorica in forma scritta

DOMANDE DI INFERENZA STATISTICA

I1 - Stima e stimatore: definizioni e differenze.

Data una popolazione caratterizzata da aspetti incogniti quali ad esempio media μ e varianza σ2, per

1) Stima dei parametri si intendono le affermazioni fatte sui parametri stessi della popolazione a partire da un

campione della popolazione, campionamento effettutato utlizzando una tra le diverse tecniche sviluppate quali ad

esempio il C.C.S., C.C.B., C.C.S.S., etc.... Tali stime si basano su opportune funzioni dei dati campionari di cui forniscono

una sintesi quantitativa (stima puntuale - stima intervallare). Es. Stima puntuale media campionaria m = (Σni xi)/n

dove n rappresenta la numerosita’ campionaria.

2) Stimatore si intende la variabile aleatoria generata dalle funzioni indicate al punto precedente al variare del

campione scelto. Es. Stimatore Media campionaria M = (Σni Xi)/n dove Xi e’ la generica v.a. generata dalla misura xi

al variare del campione e dove pertanto M e’ la v.a. generata dalla stima m di μ al variare sempre del campione.

I2 - Le proprietà auspicabili per uno stimatore: correttezza ed efficienza.

Sia Θ uno stimatore del parametro θ di una popolazione: lo stimatore Θ si dice Corretto (non distorto) se la media

dello stimatore coincide con il parametro stesso: M(Θ) = θ qualunque n, ovvero se il valore medio di Θ calcolato

rispetto a tutte le possibili n-ple del piano di campionamento considerato e’ uguale a θ.

Siano Θ1 e Θ2 due stimatore corretti del parametro θ di una popolazione: lo stimatore Θ1 e’ da preferirsi allo

stimatore Θ2 , ovvero lo stimatore Θ1 e’ piu’ efficiente dello stimatore Θ2 se a parita’ di numerosita’ campionaria n