Corso di Perfezionamento in

Metodi di Elaborazione di Segnali e Immagini Biomediche

P. Sirabella - A. Colosimo

LE RETI NEURALI ARTIFICIALI

E LORO APPLICAZIONI D'INTERESSE BIOLOGICO

Roma

Maggio 1993

2

INDICE

Presentazione

Capitolo 1.

1.1

1.2

1.3

1.4

1.5

1.6

pag.

2

Gli algoritmi connessionisti e la simulazione dell'apprendimento

Considerazioni preliminari

Il neurone formale e la dinamica delle reti

L'apprendimento hebbiano

L'apprendimento non-hebbiano

L'apprendimento competitivo

Altre classificazioni dei modelli di apprendimento

Appendice A1 Il problema della stabilita-plasticità

Bibliografia Capitolo 1

3

5

10

14

17

20

22

25

Capitolo 2. Una Applicazione di interesse fisiologico

2.1

2.2

2.3

2.4

Le mappe autoorganizzanti di Kohonen (SOM) a conservazione di topologia

La dinamica spazio-temporale delle SOM

Semplificazione ed implementazione dell'algoritmo

Una corteccia somatosensoria simulata

Appendice A2 L'interazione laterale in modelli dinamici d'interesse biologico

Bibliografia Capitolo 2

27

29

36

42

52

54

Capitolo 3. Una Applicazione nello studio delle strutture proteiche

3.1

3.2

3.3

Il percettrone multi-strato e la regola delta generalizzata

La predizione delle strutture proteiche

Implementazione e risultati

Appendice A3 Confronto fra metodi alternativi nella predizione della struttura

secondaria di proteine

Bibliografia Capitolo 3

55

61

67

71

75

3

PRESENTAZIONE

Negli ultimi cinque anni l'argomento 'reti neurali' è ridiventato di

grande attualità dopo circa un ventennio in cui l'approccio numericostrutturale era stato largamente superato in popolarità, presso i cultori

della Intelligenza Artificiale, da quello di tipo logico-simbolico.

Esaminare i motivi di tale rinascita, pur se di grande interesse, non é

nostra intenzione in questa sede* : preferiamo presentare una sintesi

succinta dei principali lavori sull'argomento, o per lo meno di quelli

che ci hanno maggiormente ispirato e guidato nel nostro lavoro, e farla

immediatamente seguire dalla illustrazione di due applicazioni da noi

sviluppate in settori estremamente diversi della biologia quantitativa: la

simulazione di una corteccia somatosensoria e la predizione della

struttura secondaria di una proteina.

La scelta di tali argomenti non é stata, ovviamente, casuale:

innanzi tutto, si voleva sottolineare la grande flessibilità di un insieme

relativamente eterogeneo di algoritmi accomunati dall'obiettivo di

simulare l'apprendimento del S.N.C. come proprietà emergente di

insiemi numerosi di unità computazionali intrisecamente semplici e ad

alta connettività. Secondariamente, oltre che di indiscutibile valore

esplicativo e didattico, esse ci sono sembrate particolarmente adatte ad

ispirare: a) ulteriori approfondimenti negli stessi settori; b)

l'esplorazione, con le stesse tecniche, di problematiche nuove. Infine, ci

premeva dimostrare l'assunto che non é necessario il possesso di

super-specializzazioni o di super-computers per implementare in tempi

ragionevoli reti neurali capaci di affrontare problemi reali.

* Per un approfondimento, vedi la lucida introduzione di D. Parisi alla edizione italiana

del

fondamentale lavoro di Rumelhart e McLelland "PDP, microstruttura dei

processi

cognitivi", Il Mulino, 1992.

4

1. Gli algoritmi connessionisti e la simulazione

dell’apprendimento

1.1 Considerazioni preliminari

" Le Reti Neuronali Artificiali sono reti con interconnessioni ad

alto grado di parallelismo composte da semplici elementi,

generalmente adattivi. Le loro organizzazioni gerarchiche sono

pensate per interagire con il mondo reale allo stesso modo di un

sistema nervoso biologico. " [Kohonen, 1988]

L'osservazione della enorme complessità di un sistema nervoso (nell'uomo

si hanno circa 1011 neuroni e 1015 connessioni) affida alla variabilità e alla

plasticità neuronale un ruolo fondamentale per il funzionamento del cervello:

sono l'apprendimento ed il confronto continuo con il mondo gli agenti che, su

una impalcatura genetica, costruiscono e trasformano continuamente una

individualità epigenetica neuronale [Edelman,1989] [Rosenfield,1988]. Ciò si

manifesta in variazioni sia strutturali (crescita di nuove fibre nervose e nuove

ramificazioni dendritiche) che chimiche (variazioni di accoppiamento sinaptico)

[Changeux,1983]. Solo queste ultime, per il momento, sono considerate nella

progettazioni di reti neuronali artificiali.

L'utilizzo di calcolatori digitali per la realizzazione di tali reti non significa

che, per esse, vengano adottate le regole della logica digitale. Il singolo elemento

di rete, il neurone formale (vedi appresso), svolge una operazione analogica di

trasformazione, di filtraggio adattivo del segnale. La plasticità funzionale

dell’insieme, partendo da oggetti elementari come il neurone, è raggiunta grazie

al grande livello di interconnessione, alla distribuzione di processi di

retroazione, alla non linearità della trasformazione e alla stessa variabilità

adattiva dei suoi parametri.

Sulla base, quindi, delle leggi di attivazione e modificazione neuronale,

frutto della ricerca neurofisiologica, sono stati sviluppati dei modelli fisicomatematici la cui caratteristica principale è la capacità di simulare alcuni dei

comportamenti più elementari delle reti neuronali biologiche nei problemi di

apprendimento

e riconoscimento. La struttura di questi modelli,

differenziandosi dagli algoritmi tradizionali alla von Neumann a carattere

concentrato e sequenziale, è, in analogia con la struttura cerebrale, altamente

parallela : le singole unità di elaborazione, in analogia con le cellule neuronali,

Gli algoritmi connessionisti e la simulazione dell'apprendimento

5

sono caratterizzate da una funzione di trasferimento sostanzialmente semplice e

soprattutto non lineare, in cui sono presenti una soglia di attivazione ed un

valore di saturazione. Infine, l'informazione che essi elaborano è

immagazzinata nello stato dell'intero sistema: è distribuita.

Una conseguenza indiretta delle precedenti assunzioni è la rottura del

concetto di “osservatore interno”, legato spesso all'idea dell'esistenza di un

ipotetico centro di controllo delle attività cerebrali. Tale idea è la stessa che ha

portato alla tesi del calcolatore come modello del cervello: in esso,

tradizionalmente, vi è una periferia ed un centro, l'unità centrale di elaborazione

(la CPU) che governa tutte le operazioni. Il cervello non ha, invece, un centro, e

i neuroscienziati ne hanno fornito indiscutibili prove [Kandel & Schwartz,

1985]. Quello che è alla base dello studio sulle reti neuronali artificiali e perciò

la tesi del cervello come modello del calcolatore : mantenendo l'analogia con

l'esempio biologico, le funzioni fondamentali del soma (o corpo cellulare), dell'

assone e della ramificazione dendritica con le proprie sinapsi vengono

riprodotte rispettivamente dall'unità di elaborazione, dal dispositivo di uscita e

dai dispositivi di ingresso, utilizzando pesi di accoppiamento variabili per le

varie unità, che costituiscono, di fatto, la parte adattiva del sistema.

Primi lavori

1940-1960

-Logica Booleana

-Apprendimento Sinaptico

-Prime Simulazioni

-Percettrone

-Memorie Associative

McCULLOCH & PITTS (1943)

HEBB (1949)

FARLEY & CLARK (1952)

ROSENBLATT (1958)

STEINBUCH, TAYLOR (1961)

Transizione

1960-1980

-Algoritmo LMS

-Modello del Cerebellum CMAC

-Matrici di correlazione

-Apprendimento Competitivo

-Cognitron, Neocognitron

-ART, BCS

WIDROW & HOFF (1960)

ALBUS (1971)

KOHONEN (1972)

VON DER MALSBURG (1973)

FUKUSHIMA (1975)

CARPENTER & GROSSBERG

(1976)

Rinascita

1980-

-Modelli Connessionisti

-RCE

-Mappe Auto-Organizzanti

-Teoria Memorie Associative

-Boltzmann Machine

-Back Propagation

-Il volume PDP

-Darwin III

-ART 2

-Computer neuronali ottici

-Chip neuronali VLSI

-Reti neuronali e Caos

FELDMAN & BALLARD (1982)

REILLY, COOPER et al. (1982)

KOHONEN (1984)

HOPFIELD (1986)

HINTON & SEJNOWSKI (1986)

RUMELHART et al. (1986)

RUMELHART & McCLELLAND (1986)

EDELMAN, REEKE (1987)

CARPENTER & GROSSBERG (1987)

ABU-MOSTAFA & PSALTIS (1987)

GRAF et al. (1988)

FREEMAN et al. (1991)

Tabella 1 - Le tappe fondamentali nella ricerca sulle Reti Neuronali artificiali

Gli algoritmi connessionisti e la simulazione dell'apprendimento

6

Un utilizzo delle reti neuronali fra i più interessanti e accattivanti è quello

nei problemi in cui si richiede una capacità di riconoscimento di oggetti a

struttura complessa (in sostanza forme o, in un termine ormai internazionale,

patterns , principalmente visivi ed acustici), raggiunta grazie alla adattività del

sistema di memoria1.

Le applicazioni si basano principalmente sulla simulazione di processi di

apprendimento, che in base al loro carattere si possono suddividere in tre

categorie fondamentali :

Apprendimento supervisionato, dove è richiesta la presenza di un

“istruttore” esterno che, preparata una serie di esempi, assegni ad ogni stimolo

una configurazione di uscita ideale (target), cioè una rappresentazione interna

imposta. L'errore di rappresentazione generato dalla eventuale discordanza viene

utilizzato, grazie ad un meccanismo di retropropagazione, per la variazione

finalizzata delle sinapsi che, dopo una fase di addestramento, raggiungono una

condizione di equilibrio.

Apprendimento non supervisionato, dove la rete neuronale forma

spontaneamente delle rappresentazioni interne dell'insieme degli ingressi sotto

forma di classificazione.

Apprendimento auto-supervisionato, dove viene creato, sulla base di

determinati parametri interni, un errore di rappresentazione che, retropropagato,

determina le variazioni sinaptiche.

Nei successivi paragrafi saranno impostati alcuni criteri di differenziazione,

in base al sistema dinamico utilizzato, che potranno essere utili per la

comparazione tra i diversi modelli e per l'individuazione delle scelte che li hanno

prodotti. Saranno, quindi, brevemente discussi alcuni di essi in base al tipo di

apprendimento.

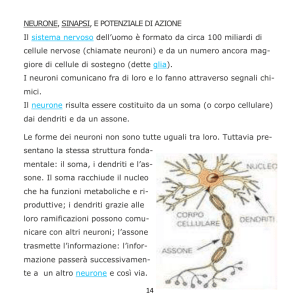

1.2 Il neurone formale e la dinamica delle reti

La modellizzazione della cellula neuronale proposta da McCulloch e Pitts

[McCulloch & Pitts,1943] è alla base, con varianti più o meno significative,

dell'equazione di attivazione di praticamente tutti i modelli neuronali tuttora in

1 E’ ben nota la complessità di tale obiettivo: ciò che viene compiuto spontaneamente e senza fatica anche

dai più semplici esseri viventi, viene ancora oggi svolto con estrema difficoltà e in numeri limitati dai casi dai

calcolatori più potenti.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

7

studio. Tale modellizzazione tratta il neurone come sistema binario a soglia, e

cioè a due stati di uscita {+1,0}, ed è stata in parte ispirata dall' osservazione

neurofisiologica per la quale i segnali tra due cellule nervose sembravano essere

caratterizzati da un comportamento di tipo esclusivo : la trasmissione del

neuroimpulso, il potenziale d'azione, è o completa o nulla. *

NEUROIMPULSO

EFFERENTE

Sj = φ(xj )

ASSONE

SOMA

φ(xj )binaria

xj

φ(xj )sigmoide

xj

xj = ∑ Siw ij +θ j

φ(xj ) lineare a soglia

i

SINAPSI

xj

w ij

Si

NEUROIMPULSO

AFFERENTE

Fig 1.1 - Neurone Formale

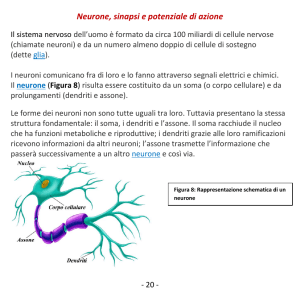

Nella figura è rappresentato il “neurone formale”, così come viene utilizzato,

generalmente, nei modelli neuronali. Esso è costituito, strutturalmente, dalle

sinapsi w ij che collegano il neurone con gli altri neuroni della rete e che

raccolgono ineuroimpulsi afferenti. Vi è poi ilcorpo cellulare, dove viene

svolta l’operazione di somma pesata di tali segnali in ingresso. Essa, modulata

da una funzionea soglia, costituirà la risposta del neurone, e verrà propagata,

attraverso l’unico dispositivo di uscita, assone

l’

, verso tutti gli altri neuroni ad

esso connessi tramite altre sinapsi.

Nella progettazione di una rete neuronale artificiale ha un'importanza

primaria la scelta del sistema di equazioni dinamiche che ne regolano

l'evoluzione. Nel caso più generale potremo scrivere

dS/dt = f (x , S , W , M)

dW/dt = g (x , S , W)

dM/dt = h (S , W)

(1.1a)

(1.1b)

(1.1c)

* Tale supposizione è, forse, dovuta anche alla contemporaneità storica, nei primi anni '40, tra i primi studi

sul calcolo neuronale e la realizzazione dei primi computers non completamente analogici.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

8

In esse, ed anche in seguito, il termine x è il vettore che rappresenta tutti

gli ingressi della rete (gli stimoli), S è il vettore associato a tutte le attività

neuronali di risposta, e W ed M sono due matrici associate ai termini adattivi di

connettività.

La prima equazione, legata alla risposta immediata del neurone, è detta

equazione di rilassamento o equazione di attivazione : nei sistemi biologici ha

costanti di tempo dell'ordine della decina di millisecondi, descrivendo fenomeni

fisici quali la diffusione di ioni leggeri. Le altre due equazioni descrivono

variazioni proteiche o di struttura anatomica, ed hanno costanti di tempo dell'

ordine di qualche giorno (o anche più). Esse sono dette equazioni di

adattamento o equazioni di apprendimento. L'ultima, in particolare,

descrive le funzioni fondamentali di una memoria associativa [Bottini, 1980,

1984].

Il neurone formale (Figura 1.1) è descritto, in sostanza, dalla legge che

determina l'attività del neurone in funzione dei segnali di ingresso: le varie vie

afferenti al neurone j-esimo portano ciascuna un segnale continuo Si (che

rappresenta l'attività sulla linea i-sima, eventualmente associata ad una

frequenza) che viene moltiplicato per un peso wij di accoppiamento

sinaptico tra il neurone j-simo e la via afferente i-sima. Per un principio di

sovrapposizione l'attività Sj del neurone (il segnale di uscita, inviato sull'assone)

sarà proporzionale alla somma pesata xj dei segnali afferenti, modulata da una

funzione di trasferimento φ(x) non lineare che tiene conto degli effetti di soglia e

di saturazione della risposta del neurone : nel caso particolare del neurone

“binario” φ(x) sarà una funzione di Heaviside a gradino binario. La legge di

McCulloch e Pitts prevede anche la possibilità di un termine di polarizzazione

θ j del neurone che equivale all'opposto di una soglia per la funzione di uscita.

In termini formali si ottiene come legge di attivazione

Sj(t+1) = φ(xj(t+1)) = φ( ΣiwijSi(t)+θ j)

(1.2a)

φ(x) = {+1 se x>0 , 0 se x ≤ 0 }

(1.2b)

dove

Una equazione di questo tipo, rappresentando la risposta immediata del

neurone, è anche nota con il nome di equazione della memoria a breve termine,

o equazione STM (Short Term Memory). Nella Figura 1.1 è illustrato

Gli algoritmi connessionisti e la simulazione dell'apprendimento

9

l'equivalente formale del neurone secondo la schematizzazione di McCulloch e

Pitts.

In realtà, però, il neurone agisce più o meno come un integratore non

lineare dissipativo dei segnali di ingresso, la cui funzione di trasferimento è

descritta da almeno una ventina di variabili di stato. Nelle formalizzazioni,

comunque, si utilizza una più semplice, ma pur sempre realistica, operazione di

trasformazione. Una descrizione più verosimile della precedente considera

l'attività di un neurone come se fosse rappresentabile da una variabile continua S

non negativa descritta da una equazione dinamica del tipo :

dS/dt = I - γ (S)

(1.2c)

della quale la (1.2) rappresenta una particolare soluzione stazionaria. Il termine

I rappresenta l'effetto integrato di tutte le correnti di membrana, mentre il

termine γ(S), di decadimento passivo, si oppone alla variazione di attivazione e

tiene conto degli effetti di non linearità attinenti alle proprietà reali del neurone

biologico, quali saturazione e fenomeni di perdita. Esso è, nel caso della (1.2), l'

inverso della funzione di trasferimento φ prima descritta.

Una espressione più completa dell' equazione STM di attivazione diventa,

nella sua forma più generale nota come modello additivo [Grossberg,1988],

dS j

dt

= - γ(S j ) + ( ∑ φ(S i )w (ij+) + θ j ) - ( ∑ φ(S i )w (ij- ) + θ j ) + I j

i

i

(1.3)

Il secondo ed il terzo termine rappresentano dei segnali di feedback,

positivo e negativo, nei quali si tiene conto delle tracce di memoria contenute

nelle sinapsi eccitatorie wij(+) e in quelle inibitorie wij(-) . Il quarto termine è il

generico input, che arriva direttamente al neurone j-simo senza l'intermediazione

di altri neuroni. L' equazione (1.3), in una variante nota come modello additivo

“shunting” e sempre dovuta a S. Grossberg [Grossberg, 1988], [Carpenter,

1989], limita l'attività del neurone nel range (-B, A)

Gli algoritmi connessionisti e la simulazione dell'apprendimento

10

dS j

dt

= − γ(S j ) + (A − S j )

∑ (eccitazioni) − (B + Sj )∑ (inibizioni)

(1.4) (*)

Tornando alla equazione dinamica semplificata (1.2c), possiamo assumere, solo

per quel che riguarda una rete neuronale artificiale, che la corrente di membrana

sia appunto esprimibile come nell' equazione (1.2)

I = Σi wij Si

(1.2d)

Se, ora, possiamo considerare stazionari, o perlomeno variabili lentamente,

i segnali di ingresso, allora S raggiungerà l'equilibrio asintotico quando dS/dt=0,

e quindi

S = γ -1 (I)

(1.2e)

I fenomeni di saturazione si innescano per alte attività neuronali, quindi il

termine di perdita γ(S) deve essere una funzione progressivamente crescente

dell' attività S. Se, poi, quest'ultima è a valori mai negativi, allora la funzione di

Heaviside è una possibile, seppur eccessivamente semplificata, funzione di

attivazione S(I).

Nei modelli ad apprendimento competitivo (vedi appresso) viene spesso

utilizzata una interpretazione geometrico-vettoriale dell'equazione di attivazione

(1.2) di McCulloch e Pitts: l'attività xj del neurone j-simo (modulata, in genere,

da una funzione di trasferimento lineare, non negativa e senza saturazione) è

vista come prodotto scalare del vettore di input S per il vettore dei pesi wj. Ciò

permette di ricavare il valore di attivazione anche dalla distanza euclidea tra i

punti rappresentativi dei rispettivi vettori : a prodotto scalare massimo

corrisponderà distanza minima, e viceversa (per vettori normalizzati).

Mentre, come già si è detto, tutti i modelli si differenziano assai poco

nell'utilizzo di una particolare equazione STM di attivazione, più rilevante

diventa la scelta di una specifica equazione di apprendimento.

* Essa è significativamente simile a quella ricavata (e che fruttò loro il Premio Nobel) da Huxley ed Hodgkin

[Hodgkin & Huxley,1952] che, nell'ambito di una modellizzazione del comportamento elettrico di una cellula

nervosa, descrive la corrente totale I di membrana come funzione del tempo e della tensione V di

depolarizzazione di membrana

I = CM ( dV ) + (V- VK)g K + (V- VNa )g Na + (V- Vl)g l

dt

dove g K , g Na , g l e VK ,V Na ,V l rappresentano rispettivamente le conduttanze (funzioni del tempo e

del potenziale di membrana) dei canali a corrente ionica di Potassio, di Sodio e a corrente di perdita (leakage

current), e le cadute di tensione su ciascun canale, mentre CM rappresenta la capacità di membrana per unità

di area.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

11

1.3 L’ apprendimento hebbiano

Che l'apprendimento avesse alla sua base un qualche forma di

trasformazione fisica nelle reti cellulari era già stato intuito da diversi

neurofisiologi, ma l'identificazione della natura e delle cause di tali

modificazioni avvenne soltanto grazie a un'intuizione di D. Hebb, alla fine degli

anni '40. Egli, finalmente, propose un meccanismo plausibile in grado di fornire

una base biologica ai processi della memoria: ipotizzò che fossero le sinapsi il

luogo in cui avvengono i cambiamenti strutturali legati all' apprendimento*.

La teoria di Hebb permise quindi di associare al neurone formale di

McCulloch e Pitts una formalizzazione della plasticità sinaptica, che descriva le

modificazioni nei termini di accoppiamento sinaptico. La sinapsi viene quindi

trattata come un rivelatore di correlazione tra l'attività Si del neurone

presinaptico e quella xj del neurone postsinaptico.

Nella teoria proposta da Hebb l'aumento di efficacia di una sinapsi

eccitatoria dipende dalla sincronicità di attivazione del neurone presinaptico e di

quello postsinaptico. Gli esperimenti di deprivazione monoculare di Hubel e

Wiesel indicarono, completando la teoria di Hebb, che la diminuzione di

efficacia di una sinapsi eccitatoria dipende dalla simultanea mancanza di

attivazione del neurone presinaptico e attivazione del neurone postsinaptico.

Ulteriori ricerche, alcune basate su esperimenti di deprivazione binoculare

[Singer,1986], mostrarono che in mancanza di attivazione del neurone

postsinaptico non si ha una variazione della efficacia sinaptica. Ciò dà luogo a

quattro possibili situazioni, mostrate dalla Figura 1.2.

Inoltre, la legge di Hebb aggiunge al modello di McCulloch e Pitts un

carattere adattivo, fondamentale per il verificarsi del processo di apprendimento.

* “Quando un assone della cellula A è abbastanza vicino da eccitare la cellula B, e prende ripetutamente parte

alla sua eccitazione, hanno luogo, in una o in entrambe le cellule, dei processi di crescita o dei mutamenti

strutturali tali da aumentare l'efficienza di A, in quanto cellula scatenante l'attività di B” [Hebb,1949].

Le motivazioni che portarono Hebb a queste conclusioni furono esclusivamente teoriche, e probabilmente

ebbero grande importanza le idee dei filosofi empiristi inglesi Hobbes e Locke sul pensiero come associazione

di idee e sul principio di contiguità : due eventi mentali occorrenti simultaneamente provocheranno un

reciproco legame di associazione, basato sulla contiguità temporale. Recentemente, inoltre, alcuni

neurobiologi hanno ipotizzato che alcuni aspetti caratteristici del fenomeno noto come Potenziamento a Lungo

Termine (LTP) potrebbero essere spiegati da un meccanismo del tipo di quello proposto da Hebb [Kelso et

al.,1986] : si tratta di un processo di fondamentale importanza per la formazione dei ricordi. Esso consiste, in

breve, in un aumento, di lunga durata, della forza di una sinapsi causato da una breve stimolazione ad alta

frequenza ("tetanica") della fibra afferente, ed è stato scoperto nell' ippocampo, che è una struttura

dell'encefalo simile alla corteccia (ma più antica filogeneticamente), implicata nei processi di

memorizzazione e nell' apprendimento dell'orientamento spaziale.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

12

presinapticopostsinaptico

B

Neurone A

Neurone B ∆w

AB

attivo

inattivo

attivo

inattivo

attivo

attivo

inattivo

inattivo

∆wAB=

>0

<0

=0

=0

variazione di

efficacia sinaptica

SINAPSIwAB

A

Figura 1.2 Regole “hebbiane” di modificazione della efficacia sinaptica

La più semplice traduzione in termini formali dell'equazione di

apprendimento (1.1b), in base alla legge di Hebb assume l'espressione

dwij

dt

= α Si x j ≥ 0

(1.5)

Si noti che, in analogia con quanto detto per la (1.2), è consuetudine

riferirsi alle equazioni di apprendimento, e quindi di modifica

dell'accoppiamento sinaptico, con il termine di equazioni LTM (Long Term

Memory). E' ovvio che le dinamiche dei due processi, STM ed LTM, siano

caratterizzate da costanti di tempo significativamente differenti.

Un'altra equazione di apprendimento che deriva strettamente da quella

hebbiana e che ha dato luogo, a sua volta, a numerose varianti è dovuta a

Grossberg [Grossberg,1968]. Con essa viene introdotto, nella legge di Hebb,

un termine di perdita o smemorizzazione

dwij

dt

= α Si x j - w ij

(1.6)

Nel caso più diffuso, per esempio, di uno stadio di ingresso nel quale i

vettori di pesi wiJ = (w1J ,,, wnJ) tendono a riprodurre il segnale afferente Si,

otterremo, per un sistema real-time (vedi appresso) :

Gli algoritmi connessionisti e la simulazione dell'apprendimento

13

dwij

dt

= α(t) Si - w ij

(1.7)

Nel caso, infine, del modello di Kohonen (vedi appresso), non abbiamo,

almeno esplicitamente, la funzione di gate dell'uscita xj del neurone che esiste

nella (1.7), e la dinamica assume la forma

dwij

dt

= α Si x j - β(x j )wij

α >0

(1.8)

dove, mentre il primo termine è tipicamente hebbiano e comporta come effetto

la sensibilizzazione del neurone ad un determinato pattern ed è la base del

comportamento adattivo, il secondo svolge una funzione di smemorizzazione

attiva, stabilzzando l'attività del neurone entro un range opportuno. Si dimostra

infatti che i vettori dei pesi tenderanno a normalizzarsi, assumendo tutti, nell'

apprendimento, la medesima lunghezza [Kohonen,1984]. L'utilizzo della (1.8) è

però generalmemte limitato ad una sua forma semplificata, che verrà descritta in

seguito.

Uno dei primi modelli che adottò la regola di apprendimento hebbiana è

noto con il nome di LEARNING MATRIX ed è dovuto a K. Steinbuch

[Steinbuch, 1961]. Esso è il precursore dei modelli ad apprendimento

competitivo capaci di organizzare e raggruppare i patterns di ingresso in

categorie, imposte dall'addestratore.

La struttura della LEARNING MATRIX è, per sommi capi, la seguente : i

valori delle sinapsi wij sono gli elementi di una matrice che avrà un numero di

colonne pari alla dimensione del vettore binario a di ingresso, e un numero di

righe pari al numero di categorie che si vogliono creare e alle quali sarà

associato un vettore binario di categorie b (tale vettore dovrà avere una ed una

sola componente uguale ad 1, e cioè b=(0..010..0) ), seguendo così il

paradigma di classificazione.

L'apprendimento avviene presentando simultaneamente il vettore di

ingresso a ed il vettore b , avendo scelto in b la categoria alla quale sarà

assegnato a. Se descriviamo il segnale presinaptico come Si = (2a i -1)={+1,-1}

e quello postsinaptico come xj = bj = {+1, 0} possiamo utilizzare, nella fase di

apprendimento, esattamente la legge di Hebb (1.2) (con la differenza che le

variazioni possono anche essere negative). Nella fase di riconoscimento, ad

Gli algoritmi connessionisti e la simulazione dell'apprendimento

14

addestramento avvenuto e a dinamica arrestata, assegneremo il pattern

presentato alla categoria J-sima se il vettore estratto dalla matrice

wJ =(w 1J,,,,,wnJ) è, scelto un criterio di distanza, il più vicino al vettore a . Se,

nella fase di riconoscimento, oltre ad arrestare la dinamica, ridefiniamo il

segnale presinaptico come S i =ai , allora possiamo produrre una risposta della

rete nel vettore b. Questo avrà la componente bJ = 1, e solo quella, se il prodotto

scalare

S x wJ = || S || || wJ || cos (S,wJ )

è il massimo per ogni riga. Tale componente identificherà la categoria alla quale

è stato assegnato il pattern a : il sistema risponderà allo stimolo dichiarandone la

classe di appartenenza.

Un' altra area di ricerca che vide l'utilizzo delle leggi di variazione sinaptica

di derivazione hebbiana è quella sulle Memorie Associative Lineari (Linear

Associative Memory - LAM) [Nakano, 1972] [Kohonen, 1972]. L' idea che è

alla base delle LAM è che, dato un insieme di patterns associati (a(p) ,b(p) ) , sia

possibile memorizzarlo in una matrice di correlazione i cui elementi siano

wij =

Σp ai(p) bj(p)

(1.9)

Nella fase del riconoscimento, presentando un pattern a(p) , otterremo come

risposta dalla rete un vettore x=a(p) Tw proporzionale e, quindi, lineare con il

pattern associato b(p) . Se, infatti, nella xj = a(p) x wj sostituiamo la (1.9)

otteniamo

xj =

Σq

(a (p) x a (q) ) bj (q)

(1.10)

Anche in questo caso la legge di variazione dei coefficienti di correlazione è

del tipo hebbiano (1.2), se consideriamo ai segnale presinaptico e bj segnale

postsinaptico. E' sempre più evidente il senso dell'affermazione per cui,

modificandosi secondo la legge di Hebb, la sinapsi tra due neuroni funga da

rivelatore di correlazione di attività.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

15

1.4 L’apprendimento non-hebbiano

L'equazione dinamica hebbiana non fu l'unica ad essere utilizzata nella

ricerca sulle reti neuronali formali : specialmente nei primi modelli l'equazione

LTM adottata è sensibilmente differente, anche se spesso conduce a risultati

analoghi. Essa, nota come Delta Rule [Rosenblatt,1958], descrive una

variazione del termine sinaptico proporzionale alla differenza Dj tra l'uscita Sj

effettiva del neurone ed un valore di target bj imposto dall' “addestratore”

Dj = (bj - Sj )

dw ij

dt

=

αD jS i

S2

(1.11a)

(1.11b)

o anche nella forma

wij(t+1) = w ij(t) + ∆wij

(1.11c)

∂(∑i Di2 )

(1.11d)

∆wij = −α

∂wij

Le variazioni sinaptiche saranno quindi tanto minori quanto più i segnali di

uscita Sj dei singoli neuroni riprodurranno i segnali di target b j . La necessità di

un valore di target rende i modelli che utilizzano tale equazione di

apprendimento ascrivibili alla classe dei modelli ad apprendimento

supervisionato. Inoltre in essi si richiede la formazione di un termine di

correzione che necessita del confronto con un valore di target : essa non può

essere fatta nelle “immediate vicinanze” delle sinapsi. Questo termine di

correzione deve essere retropropagato dallo strato di uscita agli strati inferiori,

interrompendo così il flusso di informazione (con una verosimiglianza

biologica assai debole). Ciò non succede, invece, in modelli che usano la

dinamica (1.5) di Hebb, o una delle sue molte varianti : in essi non si deve

utilizzare alcuna grandezza che non sia disponibile nella zona sinaptica.

L'assenza di un valore di target, nei modelli di impostazione hebbiana, assegna

allo stato del neurone e al segnale di ingresso la totalità delle variabili in gioco e

la legge di variazione è peculiarmente locale.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

16

In uno dei primi modelli neuronali, il PERCEPTRON, ad opera di

Rosenblatt [Rosenblatt,1958], venne adattata al neurone di McCulloch e Pitts

una legge di apprendimento differente dalla legge di Hebb. Nel PERCEPTRON

il termine di attivazione STM relativo all' uscita Sj del neurone j-simo è simile

a quello di McCulloch e Pitts (1.2), con una funzione di attivazione φ a gradino

di tipo binario

Sj(t+1) = φ(xj(t+1)) = φ( ΣiwijSi(t)+θ j)

(1.2a)

φ(x) = {+1 se x>0 , 0 se x ≤ 0 }

(1.2b)

dove

Per la determinazione del termine di apprendimento LTM l'uscita Sj del

neurone viene confrontata con un valore di target bj imposto dall'

“addestratore” e la differenza Dj viene retropropagata (vedi Figura 1.2), ed

utilizzata per la variazione delle sinapsi con il neurone presinaptico per mezzo

della Delta Rule

Dj = (bj - Sj )

(1.11a)

dw ij

dt

=

αD jS i

S2

(1.11b)

Una limitazione del PERCEPTRON di Rosenblatt venne infatti evidenziata

da Minsky e Papert [Minsky & Papert,1969] e consiste nel fatto che il

PERCEPTRON, nella sua forma originaria a due soli strati, è in grado di

classificare solo gruppi di patterns linearmente separabili : le superfici di

demarcazione sono iperpiani. Il PERCEPTRON di Rosenblatt è stato,

comunque, il capostipite di una lunga serie di modelli, detti anche a

retroaccoppiamento , che da questo hanno derivato, oltre alla Delta Rule anche

la caratteristica struttura del flusso di informazione che segue il paradigma di

classificazione (vedi appresso).

Un modello derivato dal PERCEPTRON è, per esempio, l'ADALINE,

dovuto a Widrow e Hoff [Widrow & Hoff,1960] [Widrow et al., 1988]*. Nell'

ADALINE, però, si abbandona l'approccio binario a vantaggio di quello lineare.

Il segnale che viene confrontato con quello di target viene prelevato dall'uscita

del neurone prima dell'intervento della funzione di trasferimento binaria φ : è

* Esiste un’altra importante variante (vedi appresso) del PERCEPTRON, il MULTILAYER PERCEPTRON

[Rumelhart et al., 1986].

Gli algoritmi connessionisti e la simulazione dell'apprendimento

17

quindi ancora un segnale analogico, e ciò permetterà di ottenere un indice di

errore Dj molto più sensibile allo scostamento dell'uscita xj daltarget bj

Dj = (bj - xj )

(1.11a bis)

Tale valore verrà utilizzato per la variazione delle sinapsi wij, sempre per

mezzo della Delta Rule (1.11), permettendo la minimizzazione dello scarto

quadratico medio

ΣiDi2

tra la configurazione di uscita della rete di neuroni e

quella di target. Questo algoritmo è noto con il nome LMS (Least Mean

Square).

Sj =φ(xj )

supervisore

target

φ(xj )

(perceptron)

bj

φ

(adaline)

xj

Sj = xj

Dj= bj - jS

d wi j

xj = ∑ Siw ij + θ j

calcolo dell' errore

i

wi j

dt

∝Dj

Si

1

2

m

j

Output Layer

Input Layer

1

2

3

i

n-1

n

Figura 1.2 - PERCEPTRON / ADALINE LMS

Gli algoritmi connessionisti e la simulazione dell'apprendimento

18

Nella Figura 1.2 sono rappresentati simultaneamente gli schemi del

PERCEPTRON e dell'ADALINE: da come si vede la struttura è

sostanzialmente simile, e si differenziano soltanto per il diverso utilizzo del

segnale di uscita.

1.5 Modelli ad apprendimento competitivo

Nei modelli ad apprendimento competitivo si deve verificare la condizione

per la quale avremo una configurazione di uscita caratterizzata,

spontaneamente, dalla presenza di un solo neurone attivo alla volta (o,

perlomeno, uno molto più attivo di tutti gli altri, detto neurone vincente). Il

neurone vincente codifica, classifica, comprime, raggruppa o ortogonalizza di

volta in volta gli stimoli in ingresso. Ciò permetterà di ottenere una

compressione di informazione : ad una stessa categoria saranno assegnati tutti

gli stimoli che, fissata una metrica, saranno vicini, e cioè si assomiglieranno.

Viene compiuta quella che si dice una quantizzazione vettoriale adattiva , e

cioè la separazione dei patterns di ingresso in categorie mutuamente esclusive.

I primi modelli di questo tipo furono studiati intorno agli anni '70 sulla

base di lavori dovuti a Malsburg [Malsburg (von der), 1973], Fukushima

[Fukushima,1975] e Grossberg [Grossberg,1976]. In seguito furono sviluppati

da Amari [Amari & Takeuchi,1978], Cooper [Cooper et al.,1982] e,

soprattutto, dal già citato Kohonen [Kohonen,1984].

Il modello a mappe auto-organizzanti di Kohonen (Self Organizing Maps,

SOM) e la ART di Grossberg costituiscono degli esempi paradigmatici di reti

neuronali il cui utilizzo, più che come memorie associative, è legato alla loro

capacità di categorizzazione. Essi permettono di codificare adattivamente un

universo di stimoli sotto forma di categorie; essendo, poi, nella maggior parte,

ad apprendimento non-supervisionato non beneficiano del lavoro di un

istruttore che assegni arbitrariamente la categoria alla quale lo specifico stimolo

va assegnato.

Per ottenere una rete che segua delle regole di tipo competitivo uno degli

algoritmi più usati è quello noto come ON-CENTER / OFF-SURROUND :

esso si riferisce al meccanismo di feedback per il quale ogni neurone invia a sè

stesso e a quelli immediatamente vicini un segnale di tipo eccitatorio (ONCENTER), mentre ne invia uno di tipo inibitorio ai neuroni più lontani (OFFSURROUND). Tale segnale sarà una funzione f(xj ) dell' attività del neurone

Gli algoritmi connessionisti e la simulazione dell'apprendimento

19

stesso: dalla forma di questa funzione dipenderà la maggiore o minore

modulazione della risposta della rete alla presentazione di uno stimolo. Una

delle proprietà più importanti dei modelli ad apprendimento competitivo,

dimostrata matematicamente da Grossberg [Grossberg,1976], è quella di

ottenere la distribuzione ottimale dei termini LTM wij per la rappresentazione

dell' insieme degli stimoli in ingresso.

Le equazioni di modello ad apprendimento competitivo, nella loro forma

più semplice, sono le seguenti

STM - Competitive :

1

se

∑ w ij x i ≥ Ma x {∑k w j k x k : k ≠j

}

∑i w ij x i < Ma x {∑k w j k x k : k ≠j

}

i

xj =

0

se

(1.12)

e, per la variazione delle sinapsi ,

LTM - ON_Center / OFF_Surround :

dw ij

dt

= α x j (x i- w i j )

{s o l o

pe r i l n eu r o ne v inc en t e }

(1 .1 3 )

Rete ad apprendimento

competitivo ONc/OFFs

+φ (x j ) +

- -

-

−φ (x j )

-

Strati ad

apprendimento

competitivo

CONNESSIONI

ECCITATORIE

Si

CONNESSIONI

ECCITATORIE

xi

Strato di input

Strato di

input

elemento della classe

rappresentante della classe

Pattern di

input

Figura 1.3 Possibile architettura di reti ad apprendimento competitivo

Gli algoritmi connessionisti e la simulazione dell'apprendimento

20

Finestra 1.1 - I sistemi ad apprendimento competitivo

Un sistema ad apprendimento competitivo è caratterizzato, in generale, dalle seguenti

proprietà :

a) I neuroni dello strato nel quale avviene la competizione sono raggruppati in diversi

aggregati cellulari. In ciascuno di tali aggregati esiste una rete connettiva (feedback

laterale) che unisce la totalità dei neuroni di quell'aggregato. Le connessioni sono

eccitatorie tra neuroni vicini e inibitorie tra neuroni distanti. Ogni aggregato ha un solo

neurone attivo alla volta, il vincente.

b) Tutti i neuroni dello strato competitivo ricevono lo stesso segnale dallo strato di

input.

c) La variazione sinaptica avviene soltanto sui neuroni attivi.

d) Tale variazione fa in modo che il vettore wi relativo al neurone attivo tenda ad

avvicinarsi, con velocità data dal fattore di guadagno α, al vettore di input x.

I risultati che si ottengono sono caratterizzati dalle seguenti proprietà :

a) Se l'insieme degli stimoli possiede una qualsiasi struttura, e quindi se esistono dei

raggruppamenti, il sistema li individuerà. E' naturalmente importante che tali

raggruppamenti siano riconoscibili dalle grandezze utilizzate per la descrizione dello

stimolo.

b) La particolare classificazione ottenuta sarà dipendente da una serie di condizioni

iniziali : i valori di partenza delle sinapsi - generalmente casuali - e la particolare

“storia” della presentazione degli stimoli.

c) Se la variazione delle sinapsi è tale da rendere minima la potenza r-sima dell'errore

E di ricostruzione

E=

∫

r

x - wc p(x) dx

dove dx è il volume differenziale nello spazio degli degli ingressi, p(x) è la

distibuzione di densità di probabilità degli ingressi e l'indice c=c(x) è relativo al neurone

best match per l'ingresso x, allora si dimostra [Max,1960] che si ottiene una disposizione

dei vettori di codifica w nello spazio dei segnali la cui funzione di densità puntuale è

una approssimazione di [p(x)] n/(n+r), dove n è la dimensione degli spazi di x e w. Nel

caso più frequente abbiamo r=2 e n>>r, ottenendo una approssimazione quasi ottima

della p(x).

d) Più l'insieme degli stimoli è strutturato e più la classificazione sarà stabile. Se

invece tali stimoli non sono rappresentabili in gruppi allora il sistema , ad ogni

presentazione di uno stimolo, continuerà a subire variazioni.

Quest'ultimo punto ha richiesto che venisse risolto, in un modo o nell'altro, e spesso con

soluzioni di compromesso, il dilemma della scelta tra stabilità-rigidità e instabilitàplasticità (vedi Appendice A1).

Gli algoritmi connessionisti e la simulazione dell'apprendimento

21

1.6 Altre classificazioni dei modelli di apprendimento

Modelli real-time e modelli lab-time.

Il tipo di controllo sull'evoluzione della rete e sulle dinamiche di

trasformazione (la legge di iterazione) da essa seguìte permette di individuare

due tipi di modelli : quelli a flusso continuo e controllo interno e quelli a flusso

selezionato e controllo esterno.

Nei primi non c'è una differenza qualitativa, o meglio, algoritmica, tra la

fase di apprendimento e quella di riconoscimento : la dinamica di variazione

sinaptica ha sempre la stessa equazione, che non viene alterata da un controllore

esterno nella fase di riconoscimento. Essa può essere modulata, semmai, da

una funzione α (t) decrescente nel tempo. Inoltre, non esistono controlli esterni

sul flusso di informazione: tutte le grandezze in gioco sono reperibili

localmente, o sono, perlomeno, interne. Tali modelli sono anche detti real-time.

Nei secondi, invece, è necessario un controllo esterno che, per esempio,

interrompa, ad apprendimento concluso, la dinamica delle sinapsi , oppure,

come succede nei modelli che adottano la Delta Rule, diriga il flusso di

informazioni che riporta gli errori di rappresentazione dallo strato di uscita a

quelli sottostanti (“back-propagation”) per la modificazione delle sinapsi: sono

perciò detti lab-time .

E' evidente la maggior potenza descrittiva del fenomeno biologico per i

modelli real-time: il concetto di plasticità neuronale vede una sua traduzione in

termini formali senz'altro più rispondente all'esempio biologico. La capacità di

apprendere di un sistema di tale tipo è, in alcuni modelli (Adaptive Resonance

Theory - ART) [Carpenter & Grossberg, 1987, 1988], addirittura regolata da

meccanismi di vigilanza di tipo attentivo: qualora, ad apprendimento avviato, si

presentasse uno stimolo mai visto, allora il suo contenuto di novità farebbe

attivare una modificazione sinaptica più significativa*.

Quattro paradigmi di apprendimento

Un'altra utile classificazione [Rumelhart & Zipser,1986] dei modelli in

base al tipo di apprendimento è basata sulla individuazione dei seguenti quattro

paradigmi :

* Se ne parlerà più diffusamente nell’ Appendice A1

Gli algoritmi connessionisti e la simulazione dell'apprendimento

22

Autoassociazione . In tali modelli l'addestramento della rete avviene

presentando ripetutamente una serie di patterns , che saranno memorizzati dal

sistema con un processo di autoassociazione. Ciò permetterà il recupero dei

patterns originali, rievocati nella rete con la presentazione, nella fase di

riconoscimento, di un pattern simile a quelli già visti o di un pattern originale,

presentato in forma frammentaria.

Eteroassociazione . Nella fase di apprendimento i patterns vengono

presentati sempre a coppie. Il sistema apprende quindi ad associare i due

patterns in modo tale che, alla presentazione dell'uno viene prodotto l'altro. E'

quindi possibile associare due set arbitrari di patterns. E' palese che tali modelli

siano una variante della classe precedente.

Paradigma di classificazione . Una variante più specifica del precedente, e

quindi anche del primo, permette di assegnare ai patterns di ingresso una

categoria : il pattern, che rappresenta la categoria assegnata dall'addestratore,

verrà associato, con un processo di eteroassociazione, al pattern in ingresso. Il

risultato di tale processo, differente da quelli conseguiti con eteroassociazione

ordinaria, è quello di ottenere una corretta classificazione degli stimoli in

categorie.

Rivelazione di regolarità . In quest'ultima classe, che si differenzia

notevolmente dalle precedenti, è il sistema stesso che, rivelando le caratteristiche

“più importanti” di una popolazione di stimoli, presentati ripetutamente, li

raggruppa in categorie. Esse quindi non sono fissate a priori dall'addestratore

ma vengono ricavate direttamente dall'esperienza sensoria.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

23

Appendice A1:

Il problema della stabilità-plasticità

Un sistema percettivo ideale dovrebbe essere in grado di adattarsi in modo

autonomo alle possibili, impreviste variazioni dell'ambiente informativo nel quale esso

sta evolvendo. Dovrebbe, inoltre, saper modulare la propria adattività in base alla

maggiore o minore rilevanza degli stimoli che riceve, facendo in modo di preservare

dalla distruzione le tracce di quanto già appreso senza però rinunciare alla plasticità.

I modelli ad auto-organizzazione e ad apprendimento competitivo hanno dimostrato

di avere caratteristiche di plasticità assai interessanti, ma un problema che nasce proprio

a causa della natura competitiva di tali sistemi di apprendimento, e che non è esclusivo

di essi, è quello della instabilità dei termini sinaptici. Succede infatti che la rete si

sensibilzza sempre sugli ultimi stimoli ricevuti a discapito dei precedenti (una evidenza

della

necessità

fisiologica

del

meccanismo

di

“rimozione”

?),

spostando,

di

conseguenza, ogni volta i valori dei termini LTM wij. Ciò comporta, per l'appunto, una

instabilità della memoria-rappresentazione : si possono avere delle risposte

assai

differenti per lo stesso stimolo se questo viene ripresentato dopo che ne sono stati visti

altri .

Le tecniche per ovviare a tale instabilità sono differenti e più o meno drastiche :

una consiste nell'utilizzare per l'apprendimento solo delle classi stabili di stimoli, ma

tale limitazione è accettabile solo in un numero limitato di problemi. Un' altra invece è

basata su un guadagno plastico di apprendimento che diminuisce nel tempo, o addirittura

si annulla. Ciò, però, impedisce che nuovi stimoli possano essere codificati ad

apprendimento avviato : si perde la plasticità ed il sistema diviene rigido. Una terza

tecnica compensa la instabilità utilizzando un rate

rendere

il

sistema

poco

sensibile

a

di apprendimento talmente lento da

fluttuazioni

casuali

e

dipendente,

nella

memorizzazione dei patterns, dalla frequenza con la quale questi si presentano : viene

ricordato meglio ciò che si vede più spesso, viene rimosso ciò che non si ripresenta più

e che ha perso la sua importanza informativa e, quindi, vitale . Il sistema sviluppa

meccanismi di tipo gerarchico, ma è necessariamente lento. Naturalmente queste

tecniche possono essere combinate in differenti modi.

Un trattamento della stabilità-plasticità più originale è quello adottato nella già

citata ART (Adaptive Resonance Theory) di S. Grossberg. In ART, che funziona

anch'essa con dinamiche di tipo competitivo, la fase di apprendimento è continuamente

attiva e dipendente, come già si è detto, da un controllo di tipo attentivo : viene così

salvata la plasticità della rete. Avranno degli effetti sulla modifica delle sinapsi solo

quegli stimoli che risultano nuovi

per la memoria. Tale controllo è ottenuto associando

Gli algoritmi connessionisti e la simulazione dell'apprendimento

24

al flusso Bottom-Up di apprendimento competitivo

(che

traduce

lo

stimolo

in

rappresentazione interna), comune anche agli altri tipi di reti, un flusso di tipo Top-Down

per il quale la rappresentazione interna, riconvertita , viene riportata allo stato di

ingresso per simulare un “processo di aspettazione”. Se lo stimolo è noto

la sua

aspettazione lo riproduce. Ciò dovrebbe preservare dalla cancellazione gli stimoli già

appresi, e permetterne, invece, la memorizzazione di nuovi.

Un meccanismo basato sul confronto dell'informazione sensoriale con una sua

immagine d'aspettazione è noto, nel linguaggio della Psicologia della Gestalt, come

“inferenza inconscia” [Rock & Palmer,1991]. Anche dagli studi di Helmholtz

sulla

percezione visiva [Helmholtz, 1866] e musicale [Helmholtz,1885] traspare la necessità di

un fenomeno di risonanza nel processo percettivo : noi percepiamo, in parte, ciò che ci

aspettiamo di percepire e che ci deriva dall'esperienza.

cooperazione

competizione

(Aspettazione)

Apprendimento

Bottom-Down

Apprendimento

Bottom-Up

cooperazione

competizione

Inputs

Sono noti gli studi sulla percezione visiva compiuti da Kanizsa

[Kanizsa,1976] dai

quali risulta che certe combinazioni di figure incomplete danno luogo a contorni

chiaramente visibili anche quando questi ultimi non esistono fisicamente : tali contorni

sono quindi una creazione della nostra percezione, che inferisce l'esistenza di contorni

virtuali, e cioè non presenti nella modalità sensoriale visiva.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

25

Formazione di contorni e superfici anomale [Kanizsa,1976]

La ragione di ciò non è del tutto chiara, anche se palesa una tendenza del sistema

percettivo al completamento amodale di immagini incomplete. Ma chiedersi cosa

significhi, dal punto di vista percettivo, completo e quale configurazione visiva possa

definirsi incompleta

è ben altro problema. Potrebbe essere il risultato stesso del

meccanismo di categorizzazione, ma è solo un'ipotesi, e questa inclinazione spontanea

alla estrazione di regolarità

e al dare forma all'informe

ricorda, forse, il modo di

Cezanne di rappresentare la natura, “come fosse composta da coni, cilindri e sfere”.

Un aspetto del concetto di organizzazione secondo la Gestalt è legato al principio

della pregnanza, il quale stabilisce che, in presenza di stimoli ambigui, la percezione

sarà tanto semplice, regolare

e simmetrica

quanto lo permetteranno le informazioni

raccolte dalla retina. Il concetto di regolarità e, analogamente, di completezza sono stati

associati alla quantità di informazione

contenuta nella percezione : le percezioni

"buone" e regolari contengono poca informazione, quelle "cattive" ne contengono molta.

Torna così di nuovo in gioco il meccanismo della categorizzazione come eliminazione

della ridondanza.

Quello che si verifica, quindi, in ART è un fenomeno di risonanza adattiva nelle

oscillazioni Bottom-Up e Top-Down che, instaurando un meccanismo di rivelazione di

coerenza dello stimolo con le categorie preformate, darà luogo all' apprendimento.

Nella ricerca sulle reti neuronali lo studio sulle memorie associative ha sempre

avuto un ruolo di primaria importanza. Le affinità tra i due campi sono molte, e c'è chi

ritiene che ogni rete neuronale sia, in sostanza, una memoria associativa. Non è sempre

vero, però, il viceversa.

Gli algoritmi connessionisti e la simulazione dell'apprendimento

26

Bibliografia del Capitolo 1

Amari, S. & Takeuchi, A. (1978). Mathematical theory on formation of category

detecting in nerve cells. Biological Cybernetics , 29, 127-136

Bottini, S. (1980) . An algebraic model of an associative noise-like coding memory.

Biological Cybernetics , 36, 221-228

Bottini, S. (1984) . Un modello di memoria associativa. Le Scienze - Quaderni , 19, 4146

Carpenter , G. & Grossberg, S. (1987). ART 2 : Self -organization of stable category

recognition codes for analog input patterns. Applied Optics, 26 , 4919-4930

Carpenter , G. & Grossberg, S. (1988). The ART of adaptive pattern recognition by a self

-organizing neural network. Computer , Marzo 1988, 77-88

Carpenter, G. (1989). Neural network models for pattern recognition and associative

memory. Neural Networks , 2 , 243-257

Changeux, J.P. (1983). L' homme neuronal. Paris : Librairie Artheme Fayard (trad. it.

L'uomo neuronale. Milano : Feltrinelli, 1990)

Cooper, L. et al. (1982). A theory for the developement of neuron selectivity : orientation

specificity and binocular interaction in the visual cortex. Journal of Neuroscience , 2

, 32-48

Edelman, G. (1989). The remembered present : a biological theory of consciousness. New

York: Basic Books (trad. it. Il presente ricordato, Milano : Rizzoli, 1991)

Fukushima, K. (1975). Cognitron : A self-organizing multilayered neural network.

Biological Cybernetics , 20, 121-136

Grossberg, S. (1968). Some nonlinear networks capable of learning a spatial pattern of

arbitrary complexity. Proceedings of the National Accademy of Sciences USA, 59,

368-372

Grossberg, S. (1976). Adaptive pattern classification and universal recoding, I part :

Parallel development and coding of neural feature detectors. Biological Cybernetics ,

23, 121-134

Grossberg, S. (1988). Nonlinear neural networks : Principles, mechanisms, and

architectures. Neural Networks , 1 , 17-61

Hebb, D.O. (1949). The organization of behavior. New York : Wiley (trad. it.

L'organizzazione del comportamento, Milano: Ed. F. Angeli, 1975)

Helmholtz, H. von (1885). On the Sensations of Tone as physiological basis for the

theory of music. London : Longmans,Green, and Co.

Helmholtz, H. von (1866). Treatise on physiological optics. New York : Dover, 1962.

Hodgkin, A.L. & Huxley, A.F. (1952). A quantitative description of membrane current

and its application to conduction and excitation in nerve. Journal of Physiology, 117,

500-544

Kandel, E.R. & Schwartz, J.H. (1985) . Principles of neural sciences, Elsevier Science

Publishing Co., Inc., New York (trad. ital. Principi di neuroscienze, Casa Editrice

Ambrosiana, 1988 Milano)

Kanizsa, G. (1976) . Contorni soggettivi. Le Scienze , 96 , 30-36

Kelso, S. et al. (1986). Hebbian synapses in hippocampus. Proc. Natl. Acad. Sci. USA ,

83 , 5326-5330

Kohonen, T. (1972) . Correlation Matrix Memories. IEEE Transactions on Computers ,

C-21, 353-359

Kohonen, T. (1984). Self -organization and associative memory. Berlin : Springer-Verlag

Kohonen, T. (1988). An introduction to neural computing. Neural Networks, 1 , 3-16

Malsburg (von der), C. (1973). Self -organization of orientation sensitive cells in the

striate cortex. Kybernetik , 14, 85-100

Max, J. (1960). Quantizing for minimum distortion. IRE Trans. Inform. Theory, IT-6, 2, 712

McCulloch, W.S. & Pitts, W. (1943). A logical calculus of the ideas immanent in

nervous activity. Bullettin of Mathematical Biophysics , 9 , 127-147

Minsky, M. & Papert, S. (1969). Perceptron. Cambridge , MA : MIT Press

Nakano, N. (1972). Associatron : A model of associative memory. IEEE Transactions on

Systems,Man, and Cybernetics , SMC-2, 381-388

Rock, I. & Palmer, S. (1991). L'eredità della psicologia della Gestalt. Le Scienze, 270 ,

60-66

Gli algoritmi connessionisti e la simulazione dell'apprendimento

27

Rosenblatt, F. (1958). The perceptron : A probabilistic model for information storage and

organization in the brain. Psychological Review , 65 , 386-408

Rosenfield, I. (1988). The invention of memory. New York: Basic Books (trad. it.

L'invenzione della memoria, Milano : Rizzoli,1989)

Rumelhart, D. et al. (1986). Learning representations by back-propagating errors. Nature,

323, 833-836

Rumelhart, D. & Zipser,D. (1986). Feature discovery by competitive learning.

pubblicato in Parallel Distributed Processing : Explorations in the microstructure of

cognition, I , 152-193

Singer, W. (1986). Sviluppo cerebrale e ambiente. Le Scienze - Quaderni, 31, 58-70

Steinbuch, K. (1961). Die Lernmatrix. Kybernetik , 1, 36-45

Widrow, B. & Hoff, M.E. (1960). Adaptive switching circuits.1960 IRE WESCON

Convention Record , Part 4 , 96-104

Widrow, B. et al. (1988). Layered neural nets for pattern recognition. IEEE Transactions

on acoustics,speech, and signal processing, ASSP- 36,7,1109-1118

Gli algoritmi connessionisti e la simulazione dell'apprendimento

28

2. Una applicazione di interesse fisiologico

2.1 Le mappe autoorganizzanti (SOM) di Kohonen a conservazione

di topologia

Una codifica appropriata del segnale sensorio, in base alle sue

caratteristiche più rilevanti, è certamente un presupposto fondamentale nei

problemi di riconoscimento delle forme e di elaborazione dei segnali. Si ha

spesso la necessità di rappresentare tali segnali, descritti all’origine in uno

spazio parametrico multidimensionale, in uno spazio di dimensionalità

inferiore, mantenendone però invariate le relazioni di correlazione. Si richiede,

in pratica, una operazione di riduzione di dimensionalità che conservi al meglio,

nello spazio immagine, la topologia dello spazio di partenza. Qualcosa di simile

avviene nella corteccia cerebrale, dove l'organizzazione dei neuroni è, con buona

approssimazione, bidimensionale e gli oggetti rappresentati sono descritti da

ben più di due variabili. Sono stati sviluppati diversi algoritmi in grado di

riprodurre* tale comportamento peculiare della corteccia.

Uno in particolare ha permesso di ottenere risultati interessanti, pur avendo

una struttura particolarmente semplice e, forse per questo, assai elegante. Esso è

dovuto a Teuvo Kohonen (Helsinki University of Technology, Laboratory of

Computer and Information Science) ed è noto con il nome di Self Organizing

Maps, o SOM ; esso nasce, nel 1981, inserendosi in una linea di ricerca sui

modelli ad apprendimento competitivo avviatasi con i lavori di Malsburg

[Malsburg,1973], di Amari e Takeuchi [Amari & Takeuchi,1978] [Takeuchi &

Amari , 1979]. Prima di tutto in esso si adotta uno schema ad apprendimento

non supervisionato, che lo rende indipendente dalle istruzioni di un eventuale

addestratore con un set di esempi preparati. Solo quando la rete di neuroni è già

stata addestrata, qualora sia richiesta una definizione più netta delle categorie

formate, si ricorre, in genere, ad un algoritmo di tipo supervisionato (Learning

Vector Quantization, LVQ).

Un'altra caratteristica peculiare, forse la più rilevante, è nella concezione

della rete interconnettiva tra i neuroni intrastrato, cioè nella definizione della

funzione che descrive il tipo di interazione tra i vari neuroni della rete:

l'efficienza di interconnessione è completamente indipendente dalla posizione

assoluta (le coordinate i,j) dei neuroni, mentre dipende fortemente dalla distanza

* Si noti che non sempre, anzi piuttosto raramente, la riproduzione di alcuni aspetti delle funzioni corticali

elementari è ottenuta con metodi che simulano anche la struttura stessa della corteccia.

Una applicazione di interesse fisiologico

29

Finestra 2.1 - L' ispirazione neurofisiologica delle SOM

La capacità del cervello di rappresentare economicamente il mondo esterno per

mezzo di processi di eliminazione della ridondanza informativa e di astrazioni

successive è forse alla base del suo buon funzionamento. E' inoltre documentata

sperimentalmente l'organizzazione topografica di alcune aree sensoriali primarie, dedotta

dallo studio di alcune patologie funzionali caratteristiche provocate da danni localizzati

in zone precise della corteccia. La ricerca neurofisiologica, poi, sfruttando

tecniche

di

visualizzazione sempre più raffinate e non invasive (Tomografia ad Emissione di

Positroni, MagnetoEncefaloGrafia , ecc.), fornisce esempi sempre più chiari del

verificarsi della formazione di mappe topografiche, specialmente negli animali superiori

[Knudsen et al.,1987] : nella corteccia visiva (area V4) si formano raggruppamenti

cellulari a mappe e strie (microstrutture colonnari di non più di 5 mm di diametro) che

rispondono a particolari colori, organizzati per frequenza e saturazione [Zeki,1980], a

particolari orientamenti (nell' area V1) [Ts'o et al., 1990], o a patterns più complessi,

come ad esempio volti umani, [Damasio et al.,1982], [Rolls,1984]; nella corteccia uditiva

è stata osservata una precisa organizzazione tonotopica, quasi logaritmica con la

frequenza, dei campi recettivi [Oldfield,1988], o una rappresentazione ordinata dei ritardi

nell'eco e degli spostamenti Doppler nella corteccia uditiva del pipistrello [Suga &

O'Neill,1979]; nell'ippocampo

è stata osservata una forma di rappresentazione dello

spazio ambientale più o meno come una carta geografica [Olton,1977], anche se in studi

più recenti [Eichenbaum & Cohen,1988] è stata rilevata, sempre nell'ippocampo, una

corrispondenza non biunivoca tra l'informazione spaziale e la sua

rappresentazione

interna, in virtù di una multimodalità di codifica dei neuroni ippocampali; nella corteccia

somato-sensoria esiste una rappresentazione recettoriale dell'intero corpo organizzata

spazialmente [Kaas,1979], ed è inoltre stata osservata una capacità riorganizzativa in

seguito a lesioni che rende, quindi, la struttura topografica di tali mappe somato-sensorie

una conquista della plasticità, e non una semplice eredità genetica

[Merzenich et al.,

1983].

Questa organizzazione topografico-localizzata è riscontrabile solo nelle mappe

sensoriali primarie, anche se esistono studi che dimostrerebbero l'organizzazione di

alcune regioni dei centri del linguaggio in base al contenuto semantico delle parole

[Petersen et al., 1988] ed altri che evidenzierebbero la rappresentazione spaziale di

grafemi e relazioni ortografiche [Caramazza & Hillis, 1990]. Gli strati della corteccia

che svolgono funzioni associative più elevate, come, per esempio, la corteccia

entorinale (dove vengono svolte le funzioni di associazione tra i vari segnali sensori),

non mostrano, infatti, una organizzazione spaziale evidente.

Una applicazione di interesse fisiologico

30

tra di essi sulla corteccia simulata, e la distribuzione dei “feedback” laterali

all'interno della corteccia dovrebbe, in prima approssimazione, essere la stessa

intorno ad ogni neurone. Questa modifica permette di ottenere una rete ordinata

spazialmente, che, nella costruzione di una rappresentazione degli stimoli,

conservi, sulla corteccia, la topologia dello spazio nel quale tali stimoli sono

descritti : stimoli simili attivano zone della corteccia adiacenti.

Infine, nelle equazioni differenziali non lineari di attivazione e di

apprendimento sono contenute delle semplici, ma importanti, modifiche che

contribuiscono a stabilizzare il processo di apprendimento.

2.2 La dinamica spazio-temporale delle S.O.M.

L'interazione laterale e le connessioni tempo-invarianti

I primi modelli ad apprendimento competitivo, che adottavano un

algoritmo di interazione laterale del tipo ON-CENTER/OFF-SURROUND

espresso dalle (1.12) e (1.13)*, mostravano già una capacità auto-organizzativa.

Nell'equazione di apprendimento il termine di guadagno plastico α può avere un

andamento temporalmente decrescente e sempre limitato da 0<α(t)<1. La

scelta del “neurone vincente” può essere fatta in base a criteri di similitudine,

che generalmente si riducono alla misura di una distanza d(x,wi) : il vincente è

il neurone per il quale

d(x,wc ) = min i{d(x,wi)}

In un modello come quello appena descritto si verifica il fatto, però, che

tutte le cellule agiscono indipendentemente, non essendoci una vera e propria

interazione spaziale tra i neuroni. L'ordine con il quale essi sono assegnati a

dominii differenti dello spazio dei segnali di ingresso è più o meno casuale, e

fortemente dipendente dai valori iniziali wi(0) delle sinapsi. Il fenomeno di

ordinamento osservato è locale.

* STM - Competitive :

x j = 1 se ∑ w ij xi ≥ Max∑ w jkx k :k ≠ j

k

i

;

x j = 0 se ∑ w ij x i < Max∑ w jk xk :k ≠ j

k

i

e, per la variazione delle sinapsi,

LTM - ON_Center / OFF_Surround :

dw ij

dt

= α x j (x i − w ij )

(solo per il neurone vincente

)

Una applicazione di interesse fisiologico

31

L'introduzione di un più forte carattere auto-organizzante, massimizzato

nella prima fase dell'addestramento in modo da indirizzare la rete ad un

ordinamento prima della formazione di una qualsiasi mappa stabile, venne

adottato nelle prime versioni delle SOM di Kohonen (1981). L'ordinamento

finale della mappa perde così il carattere locale per assumerne uno globale, a

lungo raggio* .

Nel modello di Kohonen, infatti, l'utilizzo di una particolare funzione di

feedback laterale, coinvolgente i neuroni di tutta la corteccia, permette un

ordinamento coerente a largo raggio : questa funzione di interazione (Figura

2.1), nota con il nome di “Mexican Hat”, si ritrova nello studio di molti sistemi

sensorii biologici come, per esempio, quelli attinenti alla percezione visiva. La

sua funzione è fondamentale nei processi di esaltazione di contrasto. Una sua

applicazione caratteristica è, come filtro numerico, nelle tecniche di trattamento

delle immagini [Smith et al.,1988].

E' nota una versione analitica dell’interazione laterale, dovuta a D.Marr

(famoso per le sue ricerche sulla visione umana) e E.Hildreth [Marr &

Hildreth,1980], nella quale si ottiene il kernel del filtro dal Laplaciano di un

filtro Gaussiano. L'assunto principale di tale scelta è che il contorno di una

immagine G(x,y) dovrebbe essere associato a zone con massimo gradiente in

intensità. Se i punti di massima e minima pendenza si trovano in

corrispondenza dei punti di flesso, dove si annulla la derivata seconda della

funzione, essi potranno essere in corrispondenza dei punti di annullamento del

Laplaciano Λ della funzione G(x,y)

G′′(x,y) = ΛG(x,y) =

∂2 G ∂2 G

+

=0

∂x2 ∂y2

(2.1)

Nel caso, appunto, del Laplaciano di una Gaussiana Marr e Hildreth

ottennero una funzione di interazione laterale del tipo

1-(x 2 + y2 )

F(x,y) =

exp

2s2

(x 2 + y 2 )

−

2s2

(2.2)

* La maggior parte delle reti neuronali biologiche ha una organizzazione di tipo bidimensionale, in “fogli”. In

ciascuno di essi esiste una rete interconnettiva laterale che collega densamente le singole cellule - si stima

che ogni neurone sia collegato sinapticamente con altri 103÷104 neuroni dello stesso strato e che altrettante

siano le connessioni interstrato. Si è già vista l'importanza dell'informazione spaziale nei modelli ad

apprendimento competitivo : essa, però, rimane latente, e, forse, inefficiente, in algoritmi semplificati come

quello ON-CENTER / OFF-SURROUND.

Una applicazione di interesse fisiologico

32

Essi sostennero, inoltre, che tali filtri dovevano estendersi in modo tale da

ricoprire l'intero “range” di gradazioni e frequenze spaziali dell'immagine da

filtrare, come avviene nel sistema visivo.

1

F(x,y)

1

0,8

feedback laterale

0,8

0,6

0,6

0,4

0,4

0,2

0,2

0

0

-0,2

-0,2

Y

spazio neurale

X

Nella figura è riportato il grafico del nucleo del filtro di convoluzione utilizzato da

Marr e Hildreth per risolvere i problemi di esaltazione del contrasto ed estrazione dei

bordi nella visione artificiale (eq. 2.2). La stessa relazione è stata proposta da altri

ricercatori nel campo delle neuroscienze come funzione di interazione laterale (con

inibizione laterale) per spiegare il meccanismo dell'autoorganizzazione con

conservazione di topologia che si osserva in molte strutture corticali. Secondo questa

ipotesi due neuroni vicini sulla corteccia (che ha una struttura in prima

approssimazione bidimensionale) sarebbero accoppiati sinapticamente in modo

eccitatorio, mentre due neeuroni più lontani subirebbero una interazione di tipo

inibitorio. L'intensità (in valore assoluto) dell'interazione diminuisce con la distanza.

Tipi di interazione laterale di questa natura sono stati osservati sperimentalmente.

Figura 2.1 - Mexican Hat

Nelle SOM i termini di accoppiamento di interazione laterale non sono

adattivi, dipendendo dalla sola distanza, ma sono, per semplicità, costanti nel

tempo. Le sinapsi adattive wij , invece, sono quelle che accoppiano ogni

neurone della “corteccia” con gli assoni afferenti che portano il segnale

sensorio: si assume che tutti i neuroni appartenenti a questa corteccia ricevano

simultaneamente tale segnale, e che, cosa importante, tale segnale sia a valori

continui. Ogni neurone avrà quindi un numero di sinapsi adattive pari alla

dimensione del vettore che descrive lo stimolo sensorio. Una rappresentazione

unidimensionale è riportata nella Figura 2.2 :

Una applicazione di interesse fisiologico

33

Segnali X di input

Sinapsi adattive

ij w

di input

Sinapsi di

feedback

laterale

Segnali Y di output

Figura 2.2

La funzione di attivazione Sij(t) del neurone i,j-simo terrà conto perciò sia

degli ingressi relativi al segnale sensorio, mediati dalle sinapsi adattive, che di

quelli dovuti alle attività degli altri neuroni del suo stesso strato, mediati questi

ultimi dalla funzione F(x,y) di feedback laterale

n =+ k m =+K

Sij (t) = φ ηij (t) + ∑ ∑ F(n,m)Si + n,j + m(t − 1)

n =− k m =−K

(2.3)

dove il primo termine ηij (t) rappresenta l'eccitazione sensoria di ingresso,

mentre il secondo tiene conto degli effetti di feedback : le sommatorie sono da

intendersi estese a tutta la rete. La funzione di attivazione φ è generalmente una

sigmoide, ed è importante dire che lo stesso Kohonen non pone particolari

vincoli nella scelta della funzione F(x,y) di feedback laterale. E’ sufficiente che

essa risponda a caratteristiche abbastanza generali, affinchè si ottenga il risultato

sperato : una parte centrale eccitatoria ed una periferica inibitoria.

Tale risultato, raggiunto con il ricalcolo ciclico delle attività Sij (t) dei

neuroni per mezzo della (2.3) per gli intervalli successivi alla formazione dell'

eccitazione di ingresso ηij (t) (che, per ora, si considera limitata al tempo t=0), è

appunto una progressiva organizzazione di tali attività Sij (t) in “bolle”, e cioè in

raggruppamenti di neuroni attivi intorno al più attivo di tutti (per quel

determinato stimolo xi(t) ).

Una applicazione di interesse fisiologico

34

t=500

t=300

t=200

t=90

"Bolla" di attività su un array

bidimensionale di neuroni

Formazione di una "bolla" di attività

su un array monodimensionale di neuroni

Nelle simulazioni riprodotte in figura è stata utilizzata una rete di neuroni, non

ancora “organizzati”, ad attività iniziale casuale; si è quindi applicata

ripetutamente la (2.3) per il ricalcolo ciclico delle attività - senza presentare

alcuno stimolo -, e sono stati ottenuti i “clusters” mostrati. Quindi, tale fenomeno

di “clusterizzazione” avviene anche se gli stimoli sono “noise like”, e cioè quelli

relativi unicamente all'interazione laterale, senza l’intervento di uno stimolo

strutturato.

Nota:

Una analogia interessante, anche se azzardata, è quella con gli esperimenti fatti

sulla formazione di mappe e strie nella corteccia visiva : si è osservata, infatti, la

formazione di strutture ordinate - in particolare, striate - nella disposizione delle

cellule corticali rispondenti a stimoli visivi per l'occhio destro e per l'occhio

sinistro [Constantine-Paton & Law, 1983]. Un fenomeno interessante si verifica

quando viene indotta una deprivazione monoculare : un occhio riceverà segnale

“noise like” mentre l'altro riceverà stimoli visivi ordinari e correlati. In questo

caso non si osserva più, sulla corteccia, la formazione di strie, a causa di

meccanismi di tipo competitivo. Se, invece, la deprivazione è binoculare allora

torna a formarsi la struttura striata, con due sorgenti “noise like“.

Figura 2.3

La dimensione di tali bolle è in qualche modo legata al rapporto E/I tra la

parte eccitatoria e quella inibitoria della F(x,y), e, più precisamente, le bolle

avranno il raggio tanto minore quanto maggiore sarà il contributo inibitorio. Il

verificarsi del meccanismo di “clusterizzazione” è dipendente dalla scelta di

alcuni parametri, quali appunto il rapporto E/I, la larghezza della F(x,y) e la sua

forma : essi sono pertanto da determinarsi empiricamente.

Un’osservazione importante è che si può ottenere una prima

organizzazione delle attività neuronali semplicemente utilizzando la sola

equazione di attivazione, riapplicata ciclicamente: non si è ancora parlato, infatti,

di una particolare equazione di apprendimento per le sinapsi adattive.

Il requisito fondamentale di tale equazione deve essere quello di portare i

vettori w sinaptici N-dimensionali a riprodurre, ordinatamente e in modo

Una applicazione di interesse fisiologico

35

ottimale, l'insieme dei vettori di stimolo. La distanza d(x,wi) deve decrescere

monotonamente, e la variazione δwi deve essere tale da verificare

[ gradwi d(x,wi) ]T • δwi < 0

(2.4)

Inoltre, nel processo di apprendimento, la fase della variazione delle sinapsi

dovrebbe avere una costante di tempo sensibilmente maggiore di quella della

elaborazione delle attività neuronali : come si è detto, nei circuiti biologici il

verificarsi dell'attivazione ha tempi caratteristici dell'ordine della decina di

millisecondi, mentre le variazioni proteiche e strutturali, nell'apprendimento,

hanno tipicamente tempi dell'ordine di qualche settimana. Ciò si traduce, per la

legge di iterazione del modello, nella necessità di due fasi : la prima, di

convoluzione spaziale delle attività neuronali, con la quale - per mezzo della

(2.3) - si produce una prima organizzazione nella rete. Dopo aver atteso la

convergenza della prima fase si avvia la seconda, più lenta, nella quale, per

mezzo di una equazione di apprendimento, si modificano i valori delle sinapsi

adattive. Nel prossimo paragrafo sarà descritta l'equazione di apprendimento

usata, tenendo presente che è solo una delle possibili.

Le connessioni tempo-varianti

L'equazione di apprendimento LTM utilizzata da Kohonen nelle SOM

[Kohonen,1984] appartiene alla classe generica del tipo

dw/dt ≡ w' = Φ(x;w;S)x - Θ(x;w;S)w

(2.5)

x = stimolo = (x 1 ,,, xn )T

S = risposta = wTx

w = sinapsi = (w 1 ,,, wn )T

dove Φ e Θ sono funzioni scalari, eventualmente non lineari, dello stimolo x,

della risposta S e dello stato stesso della sinapsi w. Sostanzialmente le

variazioni sinaptiche avverranno soltanto nella direzione di x, w o una loro