AMPLIFICATORI DI POTENZA PER COMUNICAZIONI WIRELESS

Davide Antonino Salvatore Sanalitro

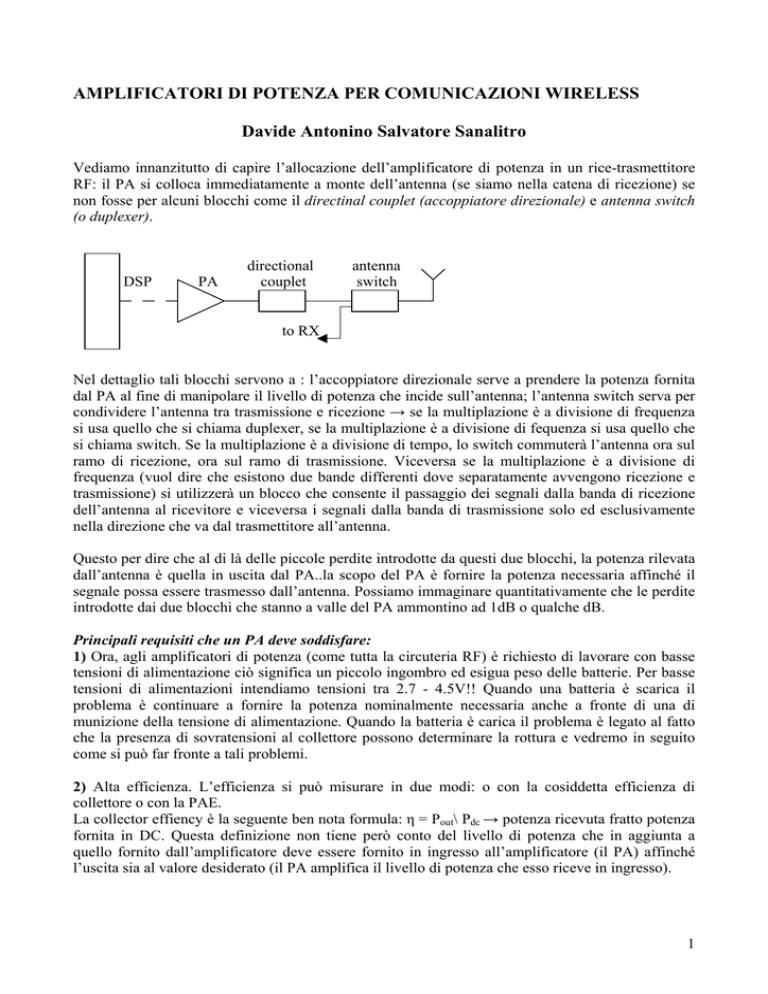

Vediamo innanzitutto di capire l’allocazione dell’amplificatore di potenza in un rice-trasmettitore

RF: il PA si colloca immediatamente a monte dell’antenna (se siamo nella catena di ricezione) se

non fosse per alcuni blocchi come il directinal couplet (accoppiatore direzionale) e antenna switch

(o duplexer).

DSP

PA

directional

couplet

antenna

switch

to RX

Nel dettaglio tali blocchi servono a : l’accoppiatore direzionale serve a prendere la potenza fornita

dal PA al fine di manipolare il livello di potenza che incide sull’antenna; l’antenna switch serva per

condividere l’antenna tra trasmissione e ricezione → se la multiplazione è a divisione di frequenza

si usa quello che si chiama duplexer, se la multiplazione è a divisione di fequenza si usa quello che

si chiama switch. Se la multiplazione è a divisione di tempo, lo switch commuterà l’antenna ora sul

ramo di ricezione, ora sul ramo di trasmissione. Viceversa se la multiplazione è a divisione di

frequenza (vuol dire che esistono due bande differenti dove separatamente avvengono ricezione e

trasmissione) si utilizzerà un blocco che consente il passaggio dei segnali dalla banda di ricezione

dell’antenna al ricevitore e viceversa i segnali dalla banda di trasmissione solo ed esclusivamente

nella direzione che va dal trasmettitore all’antenna.

Questo per dire che al di là delle piccole perdite introdotte da questi due blocchi, la potenza rilevata

dall’antenna è quella in uscita dal PA..la scopo del PA è fornire la potenza necessaria affinché il

segnale possa essere trasmesso dall’antenna. Possiamo immaginare quantitativamente che le perdite

introdotte dai due blocchi che stanno a valle del PA ammontino ad 1dB o qualche dB.

Principali requisiti che un PA deve soddisfare:

1) Ora, agli amplificatori di potenza (come tutta la circuteria RF) è richiesto di lavorare con basse

tensioni di alimentazione ciò significa un piccolo ingombro ed esigua peso delle batterie. Per basse

tensioni di alimentazioni intendiamo tensioni tra 2.7 - 4.5V!! Quando una batteria è scarica il

problema è continuare a fornire la potenza nominalmente necessaria anche a fronte di una di

munizione della tensione di alimentazione. Quando la batteria è carica il problema è legato al fatto

che la presenza di sovratensioni al collettore possono determinare la rottura e vedremo in seguito

come si può far fronte a tali problemi.

2) Alta efficienza. L’efficienza si può misurare in due modi: o con la cosiddetta efficienza di

collettore o con la PAE.

La collector effiency è la seguente ben nota formula: η = Pout\ Pdc → potenza ricevuta fratto potenza

fornita in DC. Questa definizione non tiene però conto del livello di potenza che in aggiunta a

quello fornito dall’amplificatore deve essere fornito in ingresso all’amplificatore (il PA) affinché

l’uscita sia al valore desiderato (il PA amplifica il livello di potenza che esso riceve in ingresso).

1

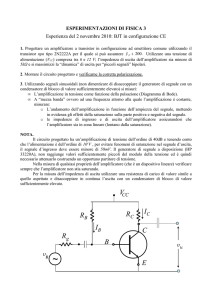

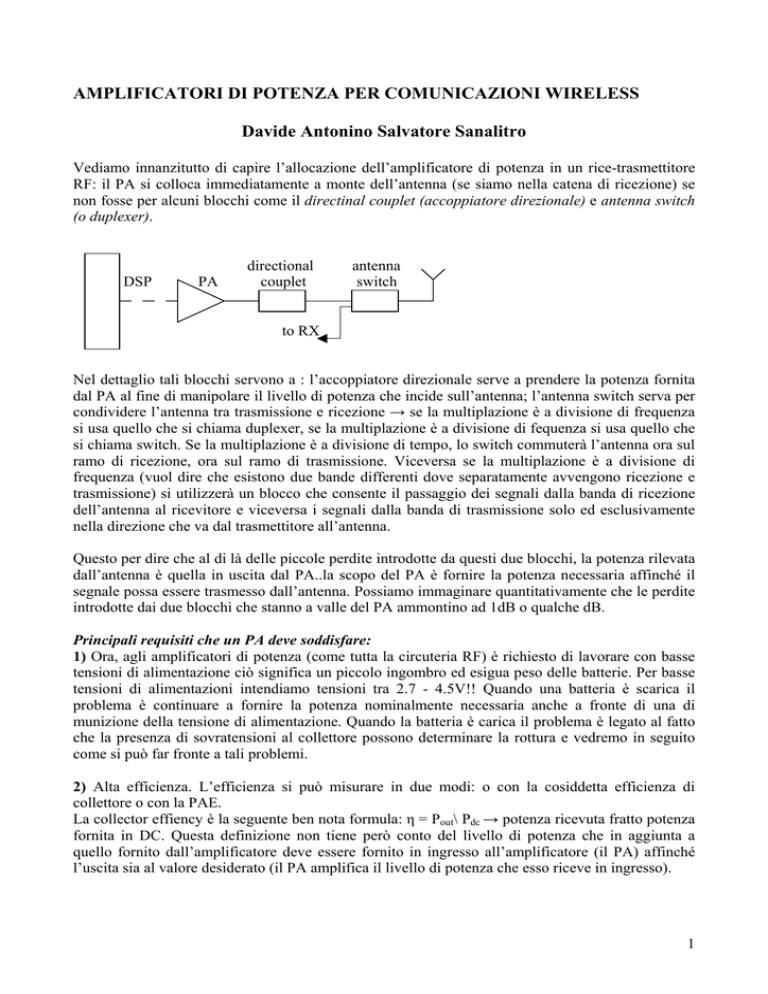

Per individuare e capire meglio quanto appena detto possiamo aiutarci con la seguente figura:

Vcc

Pdc

Pin

Pout

RF

RF

Per tener conto di questo ulteriore contributo si fa riferimento al PAE (Power Added Efficiency):

PAE = (Pout – Pin) \ Pdc

Ora, un amplificatore di potenza con efficienza buona ha valori di PAE che partono dal 50%. Avere

un’alta efficienza significa: per una data potenza d’ingresso consumare poco, consumare poco

significa allungare lo stand-by della rete.

3) Alta potenza d’uscita. I valori di alta potenza d’uscita dipendono dallo standard con cui si ha a

che fare. Nel caso del GSM a 1800MHz si richiedono 30dBm, cioè 1W di potenza in uscita

all’antenna; in realtà a causa delle perdite che si hanno in quei blocchi a valle del PA di cui prima

accennati, la specifica dello standard all’antenna si riflette in una specifica sul PA di qualche dbm

più alto, tipicamente sui 32dBm. Nel caso GSM a 900MHz si richiede una potenza più alta, circa

33dBm che diventano al PA 35dBm. Per la WCDMA si va verso potenze più basse, circa 25dBm

che si traducono al PA in 27dBm.

4) Alta frequenza operativa → questa dipende dallo standard: 0.9GHz per il GSM, e cosi via..!

Tutte queste criticità hanno fatto si che il mercato dei PA sia dominato da dispositivi realizzati

usando tecnologie altamente performanti quali arsenurio di gallio, silicio e germanio. Tali tecniche

a fronte di ottime prestazioni presentano però dei forti limiti di costo e di integrazione.

Esiste in tal senso tutto un filone di ricerca finalizzato allo studio teso a dimostrare le buone

performance che si possono ottenere usando invece il vecchio e caro silicio :

2

Quello sopra riportato è un esempio di quanto appena detto: tecnologia al silicio puro con la quale

sono stati ottenuti risultati soddisfacenti riportati sopra in tabella.

E’ una tecnologia fornita da ST e va sotto il nome di HSB3, è una tecnologia a 0.8μm (che

rappresenta la minima geometria dell’emettitore), richiede per la sua fabbricazione 17 steps di

maschere (e sono pochi), presenta isolamento a giunzione, ci sono tre livelli di metal più uno

opzionale in oro, è una tecnologia che permette di realizzare capacitori MIM (metallo isolante

metallo) di circa 07fF/μm2, con l’ultimo strato di metal si possono realizzare induttori integrati ma è

possibile fare anche dei varactor, BJT pnp!!

Facciamo adesso una distinzione netta tra due tipi di applicazioni: applicazioni 2G e applicazioni

3G → facciamo questo per capire che da differenti performance di sistema derivano differenti

performance del PA:

La cosa che principalmente distingue i sistemi 3G da quelli di seconda generazione sono data rate

più elevate!! → Col GSM si riesce a fare 9.6 Kbit al secondo; col WCDMA si riesce a fare 2 Mbit

al secondo.

Si riesce a fare questo o tramite una banda di canale più larga infatti il GSM ha una banda di canale

di 200KHz, mentre il WCDMA ha una banda di canale di 5MHz. Ma non solo: nei sistemi di terza

generazione si sfruttano delle tecniche di modulazione spettro-efficienti cioè delle tecniche di

modulazione che riescono a trasmettere nell’unità di banda più bit al secondo!! Questo si fa usando

la modulazione di ampiezza oltre a quella di fase. Quindi si intuisce che a parità di banda i sistemi

3G riescono a trasmettere più bit nell’unità di tempo e in aggiunta a questo la banda è comunque più

larga.

Tali caratteristiche hanno come conseguenza sul PA che in un caso il problema della linearità non è

rilevante, nell’altro caso il problema della linearità è di fondamentale importanza.

Resta da capire come mai nel caso di modulazione di sola fase la linearità non è vitale mentre lo è

nel caso di modulazioni di fase e ampiezza. Per capire questo basta fare mente locale su come varia

il guadagno in dB dell’amplificatore in funzione della potenza di ingresso in dBm.

3

Idealmente il guadagno dovrebbe essere costante, sempre lo stesso qualsiasi sia il livello di potenza.

Ma nella pratica sostanzialmente non è così perché c’è un livello di corrente in uscita oltre il quale

l’amplificatore non riesce ad andare, questo fa sì che giunto un certo livello di potenza il guadagno

cala perché la potenza d’uscita non riesce ad aumentare mentre la potenza d’ingresso aumenta:

G [dB]

Pin [dBm]

Che poi questa non è altro la curva con la quale abbiamo definito il punto di compressione ad 1dB.

Con riferimento a questa curva si può notare la seguente: supponiamo di avere a che fare con una

modulazione di sola fase e di lavorare con l’amplificatore in pieno regime non lineare, cioè per

valori di potenza in ingresso per i quali il guadagno manifesta compressione. Ora, se non modulo

l’ampiezza significa che l’ampiezza è costante e quindi costante sarà anche il guadagno per cui è

vero che l’amplificatore lavora compresso ma non altera la forma d’onda per cui non altero il

contributo informativo che nella fase è contenuto perché il guadagno se pur compresso è sempre

quello per questo anche se non modulo l’ampiezza l’eventuale compressione è irrilevante!!

Supponiamo ora invece di avere a che fare con un sistema in cui abbiamo sia modulazione di

ampiezza che di fase: modulare l’ampiezza significa che non ho un livello di potenza fissato e

costante ma ho un livello di potenza di ingresso che varia nel tempo → quindi se trasmette in media

27dBm significa che in un dato istante ne trasmetterò 26 e in un dato istante 28 quindi sul grafico

non vado a leggere un valore di potenza fissato e quindi un guadagno fissato ma vado a leggere un

livello di potenza che varia all’interno di un certo range e quindi pure il guadagno varierà in un

certo range (il guadagno non è più costante se l’ampiezza è modulata), ma se il guadagno non è

costante significa che sto alterando l’informazione che la forma d’onda sta portando(l’informazione

è stavolta contenuta nell’ampiezza)!!

Allora, in soldoni, come vado incontro ad una più stringente esigenza di linearità? → erogando più

corrente. Più sono generoso in termini di corrente di polarizzazione e più il dispositivo è lineare, ma

consumare più corrente significa essere meno efficienti!!

Allora in conclusione: gli amplificatori di potenza deputati ad elaborare segnali modulati in

ampiezza e fase sono meno efficienti e questo spiega come mai i telefonini di 3G hanno batterie più

grandi.

Capiamo quindi come da esigenze di sistema (di data rates) vengono fuori differenti prestazioni e

specifiche sull’amplificatore di potenza.

4

CLASSI DI FUNZIONAMENTO DEGLI AMPLIFICATORI DI POTENZA

Riguardo alle prime tre classi sappiamo che c’è un compromesso tra efficienza e linearità:

Vedremo che la classe C a dispetto di quanto finora a noi saputo mostra dei limiti invalicabili di non

linearità perché quando si lavora a RF se si vogliono ottenere efficienze maggiori bisogna cercare

delle alternative a tali alternative sono offerte dalle classi D,E e F. Le classi D e F sono da usare

quando si hanno delle tecnologie in grado di implementare dei buoni switch (tipicamente tecnologie

ed effetto di campo); la classe F si usa invece quando non si ha questo vantaggio (come nelle

tecnologie bipolari).

Classe A

E’ una classe di classe che ha un angolo di conduzione di 360°, cioè la corrente scorre sempre

positiva nel transistore e questo determina due cose: il fatto che il transistore sia sempre acceso fa si

che il guadagno si mantenga costane (e che quindi il dispositivo sia lineare), di contro il fatto che il

dispositivo sia sempre acceso determina un consumo più alto di quello che utilizzando altre classi si

po’ ottenere e quindi una bassa efficienza.

ALTA LINEARITA’ E BASSA EFFICIENZA!!

5

Ora, per capire quant’è l’efficienza massima occorre dare un occhiata alle forme d’onda d’uscita di

un PA in classe A:

Notiamo una tensione di collettore che va da 0 a 2VCC, cioè una tensione d’uscita che supera il

livello della tensione dia alimentazione. La cosa inizialmente può destare sorpresa in realtà la cosa è

così grazie al carico induttivo RFC (RF chocke, si intende un grosso induttore che alle frequenze di

lavoro è un circuito aperto; DCB è un DC block cioè un grosso capacitore che alle frequenze di

lavoro può ritenersi un cortocircuito quindi alle frequenze di lavoro il carico è praticamente RL).

Ora, in presenze di un carico induttivo non essendoci alcun divieto per la tensione ai capi

dell’induttore di essere negativa di fatto la tensione del collettore può essere anche più alta della

tensione di alimentazione. Ed è per questo che col carico induttivo abbiamo efficienze del 50% (col

carico resistivo avevamo efficienze del 25%). Caricando induttivamente si riesce ad ottenere una

prima armonica di tensione di collettore pari proprio alla tensione di alimentazione.

Ovviamente le curve sono idealizzate e lo intuisce dal fatto che la curva tracciata raggiunge lo zero

ma noi sappiamo che in realtà lo zero non lo raggiunge mai perché bisogna sempre al solito

garantire i soliti 0.2V della VCEsat . Ma c’è un ulteriore causa di perdita: la resistenza distribuita serie

di collettore che è attraversata da tutta la corrente di collettore. Guarda caso, nei momenti in cui la

tensione d’uscita va bassa la corrente di collettore è massima e quindi è massima anche la caduta di

tensione della resistenza serie di collettore, è quindi di rilievo l’entità di questa resistenza di

collettore come parametro di merito rispetto alla possibilità di raggiungere elevate tensioni di uscita

e quindi elevate efficienze. Per tali effetti raramente un amplificatore in classe A raggiunge

efficienze del 50%.

Allora il classe A si usa o quando i problemi di consumo non sussistono proprio (come un

dispositivo alimentato direttamente dalla linea a 50Hz) oppure quando le esigenze di linearità sono

particolarmente stringenti.

Ma come fa la tensione a scendere se la corrente sale?

6

Classe AB, B e C

Sono classi caratterizzate da angoli di conduzione inferiori ai 360°. SE questo angolo di conduzione

è compreso si parla di classe AB; se è uguale a π si parla di classe B; se è compreso tra zero e π si

parla di classe C.

Man mano che riduco l’angolo di conduzione si fa via via più basso, l’efficienza diventa migliore

ma la forma d’onda diventa sempre più impulsiva e quindi sempre più ricca di armoniche rendendo

l’uscita sempre meno lineare. Per cui c’è l’esigenza di usare un opportuno filtraggio in uscita per far

si che a fronte delle armoniche di corrente che inietto sul carico si manifesta sempre e comunque

una tensione d’uscita sinusoidale → si fa ciò sfruttando un carico che idealmente è un risuonatore

parallelo: esso mostrerà una certa impedenza alla fondamentale; alla seconda,terza armonica esso

mostrerà un’impedenza nulla e quindi svilupperà una tensione nulla. E quindi l’unica a svilupparsi

in uscita è la tensione di prima armonica. Alla fondamentale il gruppo LC risuona e il carico offerto

è la sola RL, alle armoniche superiori prevale la reattanza capacitiva che tende a a zero. → Quanto

descritto non è altro che l’idealizzazione di un risuonatore RLC parallelo, ma nella pratica il carico

non si farà realmente così → ma si sfrutterà una rete di matching che ci sarà a valle del transistore

con l’antenna…questa rete di matching oltre a svolgere la sua funzione principale di rete di

adattamento di impedenza svolgerà anche una funzione di filtraggio analoga a quella che farebbe un

risuonatore parallelo.

Ora è vero che riducendo l’angolo di conduzione si migliora l’efficienza ma questo non è vero fino

ad un angolo di conduzione zero. I motivi sono quelli di cui abbiamo già parlato prima: sono i limiti

sulla dinamica della tensione in uscita, cioè la VCEsat e la caduta di tensione sulla resistenza serie di

collettore → ed esse sono tanto più determinanti quanto più alto è il picco di corrente (man mano

che riduco l’angolo di conduzione a parità di potenza media il picco della corrente tende ad

aumentare) → più alto è il picco della corrente di collettore tanto più la caduta di tensione sulla

resistenza serie di collettore tende ad essere sempre più grande e a limitare sempre più la dinamica

della tensione d’uscita. Esisterà quindi un angolo di conduzione al di sotto del quale non si avrà

convenienza ad andare!!

7

Quanto detto è riportato nel seguente grafico:

L’efficienza di collettore reale tiene conto delle perdite di resistenza serie ed essa quindi risulterà

sicuramente inferiore di quella ideale al variare dell’angolo di conduzione. Si nota che man meno

che l’angolo di conduzione diminuisce l’efficienza dapprima cresce raggiungendo un picco poi

decresce → proprio come prima preannunciato: non è vero che diminuendo l’angolo di conduzione

si migliora sempre l’efficienza.

Capiamo quindi che l’amplificatore in classe C ha un limite intrinseco nel sviluppare elevate

efficienze.

Se voglio efficienze più alte di quelle che un classe C non è in grado di dare posso usare un classe

D.

8

Classe D

Se ho a disposizione una tecnologia ad effetto di campo posso fare dei buoni switch e posso quindi

sfruttare una topologia circuitale come quella dl classe D:

Ci sono due interruttori commutati con un duty cycle del 50% in modo tale che quando uno è aperto

l’altro è chiuso e viceversa. Nel nodo centrale del ramo dove ho i due interruttori si sviluppa una

tensione VA che per metà del periodo è pari a VCC e per metà del periodo è pari a zero. A partire da

questa VA per opportuno filtraggio posso ottenere una forma d’uscita sinusoidale. Vediamo stavolta

il filtraggio come deve essere: stavolta sul carico non sto iniettando armoniche di corrente ma sto

fornendo al carico armoniche di tensione → e allora per rigettare le armoniche di tensione il carico

deve essere tale da mostrare un certo valore alla fondamentale ed infinito a tutte le armoniche

superiori così a fronte delle armoniche superiori di tensione al nodo VA non entrano le armoniche

superiori di corrente all’uscita perché vedono un’impedenza infinita e quindi sul carico RL si

svilupperà una tensione sinusoidale che è quella della fondamentale. Se ci facciamo caso così come

prima il carico era un risuonatore parallelo ideale, in questo caso il carico che rispecchia questo

comportamento è il risuonatore serie ed è per questo che a valle dei due switch abbiamo un carico

risuonatore serie. → L e C sono ovviamente accordati alla fondamentale.

Con questa configurazione l’efficienza che si riesce ad ottenere è idealmente del 100% perché

abbiamo supposto gli switch ideale e una switch ideale quando è aperto non è attraversato da

corrente, quando è chiuso non ha tensione ai suoi capi e quindi la potenza dissipata da uno switch

ideale è zero. Tutta la potenza dell’alimentazione la si converte in potenza RF!!

Ma nella realtà ovviamente non è così perché la commutazione degli switch non sarà mai ideale: ci

sarà un lasso di tempo durante il quale ai capi dello switch ci saranno sia tensione che corrente, in

quel caso si dissipa e l’efficienza decresce.

Inoltre c’è un altro effetto da segnalare per il classe D quanto ad efficienza: l’effetto delle capacità

degli switch. Uno switch lo faccio con un MOS che avrà una capacità d’uscita il cui effetto è quello

di immagazzinare energia quando l’interruttore è aperto e disperderla poi dissipandola sulla

resistenza rSDon dello switch quando quest’ultimo si chiude..tutta energia che va a discapito del

bilancio della potenza d’uscita e che quindi riduce le potenzialità del classe D.

9

Per migliorare questo specifico effetto si utilizzare il classe E.

Classe E

Fa sempre parte della categoria di funzionamento switching perché fa sempre uso di transistori

adoperati come interruttori ma è migliore sotto i seguenti punti di vista.

La componente circuitale del classe E è qua sotto illustrata:

In particolare Lo e Co sono accordati alla fondamentale così da far passare sul carico solo la tensione

sinusoidale; e il parametro jX è una reattanza induttiva usata per ottenere le forme d’onda così come

si presentano qui sotto:

Si vede che quando lo switch è chiuso la corrente cresce e quindi sull’induttore si immagazzina

energia; quando lo switch si apre la tensione ai capi dello stesso prima sale e poi ridiscende.

Ora, affinché si chiami classe E la tensione ai capi dello switch deve essere tale da soddisfare le

seguenti condizioni nell’istante immediatamente precedente la chiusura dello switch:

vs = 0 ; dvs\ dt = 0

10

Si deve quindi dimensionare il parametro jX in maniera tale che la tensione ai capi dello switch sia

zero un istante prima che lo switch si chiuda. Il vantaggio che perpetuo facendo ciò è che la carica

nella capacità parassita dello switch si è già dissipata sul carico (e non sulla resistenza dello switch)

prima che lo stesso switch si chiuda. Se faccio cioè in modo che il condensatore sia già scarico

prima che lo switch si chiuda non ho problemi che tutta la sua energia si perde sulla rSdon .

Il classe migliora quindi le perdite in commutazione (un po’ quello che volevamo fare nel classe B).

Inoltre un’altra condizione che richiediamo è cheun istante prima che lo switch si chiuda:

dvs\ dt = 0

Cioè vogliamo che la vs arrivi piatta ad ωt = 2π, perché un eventuale intercetta nel punto di

commutazione dà vita ad un effetto tanto più basso quanto più quella curva si mantiene

uniformemente bassa in corrispondenza dell’istante di commutazione.

Con questa classe riusciamo quindi ad ottenere migliori performance in termini di efficienza ma per

implementare un buon classe E c’è l’esigenza da un punto di vista ingegneristico di implementare

un buon interruttore.

Se però si sta usando una tecnologia con la quale questo buon interruttore non lo si riesce a fare e si

vuole però ottenere una buona efficienza si usa quello che si chiama classe F.

Classe F

La seguente è una delle possibili topologie di classe F:

La classe F non individua univocamente una ed una sola topologia ma una categoria di topologie

accumunate dall’avere carichi multi-risonanti al fine di migliorare l’efficienza.

La topologia riportata differisce dal classe AB solo per la presenza del gruppo risonante L3, C3

insieme al carico. La forma di corrente è praticamente la stessa di un classe B.

Vediamo cosa comporta l’aggiunta di questo risuonatore parallelo: il risuonatore parallelo L1-C1-RL

è accordato alla fondamentale e ciò comporterebbe in assenza del risuonatore parallelo L3-C3 che

11

alla terza armonica il carico offerto sarebbe zero ma invece la presenza del risuonatore L3-C3 che è

accordato alla terza armonica fa si che alla terza armonica il carico offerto è infinito. A tal punto alle

armoniche superiori il carico offerto sarà ovviamente zero. Quindi la differenza sta nell’impedenza

che il carico esibisce alla terza armonica.

Il fatto che alla terza armonica il carico sia infinito fa sì che compaia sulla forma della tensione una

terza armonica i cui effetti li possiamo notare nel seguente grafico:

In tratto sottile abbiamo la forma d’onda che si avrebbe se non ci fosse il risuonatore L3-C3 ; in

tratto nerretto abbiamo la curva così come si modifica a causa dell’aggiunta di questo.

L’aggiunta di questo risuonatore fa sì che la forma d’onda di questo risuonatore approssimi ad

un’onda quadra. Capiamo quindi che si fosse un altro risuonatore accordato alla quinta armonica la

forma d’onda sarebbe ancora più prossima all’onda quadra.

Supponiamo idealmente che la forma d’onda sia proprio quadra: in questo caso la perdita ai capi del

dispositivo attivo sarebbe zero perché dove ho tensione non ho corrente e dove ho corrente non ha

tensione.

Con questo ragionamento capiamo che l’aggiunta della terza armonica ha ridotto le perdite e quindi

migliorato l’efficienza. Il concetto è quindi modellare il carico con più risuonatori.

Notiamo inoltre che in questa classe non si ha alcuno switch perché è il carico stesso a madellare

con le sue risonanze le forme d’onda ai capi del condensatore ed è per questo che la classe F riesce

a fare tranquillamente anche con dispositivi bipolari.

Nell’esempio illustrato: con l’utilizzo della terza armonica l’efficienza sale all’88.4% a confronto

del 68% che si ottiene col classe B in assenza della terza armonica.

Ora, il problema è che gestire un risuonatore con risonanze multiple è difficile cause le varie

tolleranze di processo, ragion per cui le cose finora dette sono un po’ ideali.

Nelle applicazioni realmente pratiche difficilmente si va oltre la singola risonanza. C’è allora da

scegliere tra due alternative: risonanza serie e risonanza parallelo.

12

Bisogna quindi capire tra i due quale, ai nostri fini, risulta essere migliore. Vediamo un esempio di

applicazione con carico risonante serie e uno con carico risonante parallelo:

NOTA: l’applicazione illustrata con carico risonante parallelo non è altro che quella del classe B.

Vediamo che tra le due applicazioni si scambiano le forme d’onde di tensione e corrente.

Nel risuonatore serie quella pulsante è la tensione, quella sinusoidale la corrente. Il carico non

ammette armoniche di corrente superiori e quindi esso sarà percorso solo da una corrente

sinusoidale.

Per i nostri scopi si comporta meglio un risuonatore risonante serie per i seguenti motivi:

•

•

Abbiamo detto che tanto più la corrente sul collettore è pulsante tanto più si determina una

caduta di tensione sulla resistenza di collettore e tanto più si limita lo sviluppo di dinamica

di tensione. Tra i due casi quello che ha la corrente sinusoidale piuttosto che pulsante è

quello del risuonatore serie e quindi sarà il risuonatore parallelo a dissipare di più perché ha

una corrente pulsante. Sotto questo punto di vista è migliore il risuonatore serie.

Osservando le figure si può intuire che il valore ottimo dell’impedenza alla fondamentale

richiesto dalla topologia con carico risonante serie è più alto rispetto al carico ottimo alla

fondamentale richiesto dalla topologia con carico risuonante parallelo. → cioè la stessa

potenza viene ottenuta nel caso di risuonatore serie con una prima armonica di tensione più

grande rispetto al risuonatore parallelo, e con una prima armonica di corrente più bassa

rispetto al caso risuonatore parallelo. Ma il rapporto tra la fondamentale della tensione e la

fondamentale della corrente sul transistore non è altro che la resistenza di carico perché è

quest’ ultima che impone proprio tale rapporto. Questo significa che in questo caso è

richiesto un valore di RL più grande di quello competente al caso del risuonatore parallelo

per erogare una data potenza e questo comporta un vantaggio per noi. → La RL la abbiamo

ottenuta per trasformazione di impedenza a partire dai 50Ω dell’antenna. Facendosi i conti

con le correnti e le tensioni in gioco si trova che la RL che si sta utilizzando nel caso serie è

13

•

di circa 5 ohm, quella del caso parallelo è di circa 1ohm. Ed è ovviamente più facile fare una

trasformazione dai 50 Ω ai 5 Ω perché il rapporto di trasformazione è più piccolo rispetto

che a trasformare dai 50 Ω a 1 Ω. Fare un rapporto di trasformazione più piccolo è più

facile, perché farne uno più grande comporterebbe un’area di matching maggiore, maggiori

tolleranze e una sensibilità maggiore alle perdite nell’area di matching. Capiamo quindi che

anche sotto questo aspetto è preferibile un carico risuonatore serie piuttosto che uno

parallelo.

Altro motivo, abbastanza pratico, che porta a preferire il carico serie a quello parallelo è che

l’ultimo stadio di amplificazione è un open collector → significa che c’è un pin che esce

fuori dal die e si collega al carico direttamente. Cioè l’uscita del dispositivo coincide con il

collettore del transistore. Come esce fuori dal chip il collettore? Con un filo di bonding

(spessore di circa 25μm) e tale filo si comporta, nel range di frequenze che a noi interessano,

come un’induttanza. E allora se il circuito è open collector e come prima cosa c’è un

induttore io mi ritrovo già quell’induttore che mi servirebbe nel carico serie. Quindi spesso

sono anche le modalità con cui si assembla un dispositivo che portano a preferire il carico

risuonatore serie.

Vediamo adesso ad alcuni aspetti pratici riguardanti la realizzazione e la progettazione di

amplificatori di potenza a cominciare da questo esempio di architettura:

Quello riportato è un esempio tipico di come si può fare un amplificatore. E’ un amplificatore a tre

stadi ognuno dei quali è un amplificatore comune fato con reti di matching all’ingresso ed in uscita

al di fuori del chip e reti di matching inter-stadio invece integrate. Ad esempio tra il secondo e il

terzo stadio usa una rete di matching a tre elementi: un induttore a spirale in serie e due

condensatori, uno in seri ed uno in parallelo. In ingresso ed in uscita si è invece usata una rete a due

elementi: un induttore in parallelo e un condensatore in serie, in particolare questo induttore fu fatto

con un filo di bonding. L’inconveniente è che del filo di bonding non si riesce a prevedere in

maniera esatta la forma (il valore d’induttanza lo si prevede tramite dei tools di simulazione).

14

Gli induttori usati come fili di bonding sono LW, L1, L2. in particolare LW è stato usato come

induttore per realizzare un risuonatore serie con tutto ciò che stava a valle di LW in modo da

ottenere in uscita tensione sinusoidale e corrente pulsante.

Sottolineamo adesso un aspetto importante a proposito dei circuiti RF: per avere il massimo

trasferimento di potenza ,finora abbiamo sempre detto che, è necessario che l’impedenza d’uscita

sia pari all’impedenza coniugata della sorgente. E’ quindi necessario un adattamento!!

Invece, nel caso del PA, quando si parla di adattamento specialmente con riferimento all’ultimo

stadio (quello che lavora in maniera più non lineare di tutti) non si intende l’adattamento su base

coniugata e i motivi di ciò li elenchiamo qui di seguito:

•

•

Quando uno stadio lavora in maniera molto non lineare il concetto stesso di impedenza

viene a cadere perché quando parliamo di impedenza facciamo riferimento ad un approccio

d’analisi di tipo fasoriale e guarda caso l’analisi fasoriale si può applicare solo nei circuiti

lineari. Quindi a rigore c’è da dire che il concetto di impedenza per reti non lineari non vale.

Inoltre, quando abbiamo adattamento su base coniugata, metà della potenza che fornisce la

sorgente si perde sulla resistenza di sorgente stessa e questo è contro ogni criterio di

efficienza.

L’approccio per realizzare il matching negli amplificatori di potenza quello che si chiama load-line

matching. → esso consiste nel cercare non la massima potenza sul carico ma scegliere quel carico

che mi assicura la potenza che mi serve con la massima efficienza. Per comprende quanto appena

detto seguiamo un esempio che si riferisce al caso semplice del classe A: lo standard mi dice che

vuole garantito un certo livello di potenza Pout e per farlo ci danno una determinata tensione di

alimentazione. Ora se è vero che per il classe A: Pout = VCC2 \ 2RL (siamo in condizioni di massima

efficienza per il classe A) allora il carico RL dovrà essere RL = VCC2 \ 2Pout. Che poi in un classe A

la VCC non è altro che l’escursione della tensione d’uscita. E dalla definizione di RL abbiamo una

specifica anche sulla corrente di polarizzazione:

RL è definita come il rapporto tra la prima armonica di tensione e la prima armonica di corrente.

Formule simili a quelle ottenute dal classe A si possono ottenere per le altre classi di

funzionamento. Cioè per qualunque classe, assegnata una specifica di potenza e una determinata

tensione di alimentazione, è possibile ricavare quanto deve valere la resistenza di carico affinché

questa potenza sia data al carico con la massima efficienza che quella classe riesce a garantire.

Quindi nel caso degli amplificatori di potenza l’adattamento su base coniugata è di quanto più

lontano si possa avere!!!

15

Di fatto se noi andassimo a guardare l’impedenza d’uscita del transistore essa non è uguale al

coniugato dell’impedenza di carico. Ovvero ci sarà risonanza della reattiva ma sulla parte reale non

ci sarà la relazione che normalmente ci si aspetta da un adattamento su base coniugata → ed è facile

immaginare quanto appena detto perché l’impedenza di un emettitore comune (ci mettiamo nel caso

sopra riportato) è grande e se devo sviluppare potenze dell’ordine del Watt il carico dovrebbe essere

di qualche decina di ohm ma la resistenza d’uscita di un emettitore comune non è ohm.

Ora, tenendo a mente lo schematico di quanto detto prima come questo adattamento si può fare in

un caso concreto come quello qui sotto illustrato:

Questa è una board applicativa sulla quale è stato settato l’amplificatore del quale abbiamo mostrato

la topologia prima ed in particolare l’amplificatore è quello contenuto nel package al centro in

neretto. Rappresentiamo adesso la rete di matching in uscita che concretamente è stata fatta nalla

board sopra riportata:

NOTA: T3 è l’ultimo stadio di amplificazione.

16

Lw è l’induttore del filo di bonding con il quale esce fuori il collettore dello stesso transistore.

Parte poi il ramo di polarizzazione che attraverso un chocke collega il collettore dell’ultimo stadio

alla tensione di alimentazione. Sul percorso del segnale c’è invece un condensatore in serie CM2 ed

uno in parallelo CM1 , e poi c’è una pista a 50Ω con un condensatore sliding CM3.

Un condensatore sliding è un condensatore di cui posso controllare la posizione e il valore per

ottimizzare il matching. Questa è una tecnica che si utilizza spesso quando in fase di primo test non

si ha un’idea esatta dell’impedenza che si vuole ottenere e allora ci si vuole riservare un margine di

libertà nell’adattamento; il margine di libertà sono la posizione e il valore. L’adattamento è

realizzato col laod-line matching di cui si è parlato prima.

Infine i 50Ω rappresentano il carico offerto dall’antenna all’amplificatore.

Sono usati poi anche dei condensatori elettrolitici al fine di filtrare la tensione di alimentazione!!

Power amplifier design – additional features

Riprendiamo lo schematico che faceva da esempio ad una possibile architettura di un PA:

Notiamo un misterioso blocchettino che abbiamo chiamato rete di polarizzazione e tale blocco

assolve anche altri compiti oltre a quello della polarizzazione. Facciamo un breve accenno a quelli

che sono questi compiti, queste funzionalità aggiuntive a cui gli amplificatori di potenza per i fini

concreti devono soddisfare:

•

•

•

•

Power down

Temperature stability

Output power derating

VSWR protection

17

Power down: la catena di trasmissione non è detto che trasmetta su base continua. Consideriamo

l’esempio di una multiplazione a divisione di tempo → sarà ammissibile l’ipotesi in cui il

trasmettitore trasmette a bust: sta acceso per un po’, poi si spegne, poi si riaccende per un altro po’ e

così via. Sarebbe allora inutile sprecare la corrente che in polarizzazione il PA richiede quando il

trasmettitore non deve trasmettere; ciò andrebbe contro l’esigenza di efficienza. E allora si pensa

bene di spegnere l’amplificatore di potenza quando non bisogna trasmettere. Per fare ciò è

necessario che il dispositivo sia dotato di un opportuno terminale di controllo (un segnale

comandato) di tipo digitale comandato in maniera tale che se portato ad un livello negativo riduce la

corrente complessivamente assorbita dal PA a meno di un TOT. Ed è proprio la rete di

polarizzazione a fare questo compito: avrà dentro un meccanismo, una circuiteria opportuna

asservita ad un comando esterno che azzera le correnti di polarizzazione in tutti gli stadi quando non

si trasmissione.

Stabilità in temperatura: i PA per RF (così come molti dei circuiti con cui si ha a che fare) devono

correttamente funzionare in un certo range di temperature che solitamente va dai –20°C agli 80°C.

su questo intervallo di temperatura le specifiche devono essere soddisfatte con uno scostamento non

più grande di un TOT. Capiamo che assicurare delle specifiche costanti in un certo range di

temperature a meno di un TOT richieda che la polarizzazione sia scelta opportunamente quanto a

dipendenza dalla temperatura. La rete di polarizzazione deve allora dare uno shape in temperatura

opportuno alle correnti di polarizzazione affinché non tanto le correnti si mantengano costanti ma le

prestazioni RF si mantengano costanti → non è detto che per mantenere in temperatura il guadagno

costante io debba mantenere la corrente costante.

Output power derating: abbiamo detto che nel caso del GSM si richiedano in banda base 33dBm

all’antenna, ciò significa che l’amplificatore deve essere in grado di dare fino a 33dBm all’antenna

ma in realtà il livello di potenza a cui si trasmette non è uno ed uno solo ed è comandato in

particolare dalla stazione radio-base a secondo delle condizioni di propagazione. Se ad esempio

l’antenna radio-base ritiene di ricevere il segnale in maniera sufficiente allora si può anche

abbassare il livello di trasmissione; se viceversa ritiene di ricevere un segnale di qualità bassa allora

la stazione radio-base richiederà di aumentare il livello di trasmissione. Quindi i 33dBm del caso

GSM si riferiscono al caso peggiore di una trasmissione particolarmente sfavorevole: “trasmetti a

massima potenza perché non sto sentendo niente”. C’è allora la necessità di comandare in qualche

maniera il livello di potenza e tale operazione si chiama power derating e tale operazione viene

svolta tramite la rete di polarizzazione. Un meccanismo può essere quello di controllare la potenza

emessa, ridurre il livello rispetto a quello nominale sottraendo corrente di polarizzazione.

VSWR protection: il livello di tensione fornito dalla batteria va da un minimo ad un massimo e agli

estremi di questo range di tensione si risente di problemi diversi. A bassi livelli di alimentazione

abbiamo il problema di erogare la potenza; ad alti livelli di tensione di alimentazione abbiamo il

problema della robustezza. Il problema è che l’impedenza che l’antenna offre al PA non è costante:

notiamo che se l’antenna l’avviciniamo ad un corpo conduttore cambia l’impedenza d’ingresso..si

crea disadattamento. E allora quello che si verifica in presenza di un disadattamento del carico è un

incremento dei picchi di tensione al collettore dell’ultimo stadio. Quando il carico è disadattato si

può causare una situazione di sovratensione al collettore dell’ultimo stadio. Per capire ciò

assimiliamo l’ultimo stadio come un generatore di corrente che pompa un segnale di 1° ad un

carico, se questo carico raddoppia e l’ultimo stadio continua a comportarsi come un generatore di

corrente la tensione che si sviluppa sul carico raddoppia. E questo in particolare è ancor più vero

quando la tensione di alimentazione è già in partenza più alta come quando la batteria è in carica →

in queste condizioni il PA può rompersi definitivamente. In tal senso è utile confrontare le

tecnologie all’arsenurio di gallio e quelle al silicio: col silicio si possono fare teoricamente le stesse

prestazioni dell’arsenurio di gallio purché il transistore risulti più debole, meno robusto. In tali casi

è necessario aggiungere una circuteria addizionale che circuitalmente e non dal punto di vista

18

dispositivistico risolva il problema della robustezza. Vediamo ora di capire come si può proteggere

un amplificatore di potenza dal punto di vista circuitale: supponiamo di applicare all’ultimo stadio

un rilevatore di picco che consumerà pochi mA e quindi non pesa sulle performance dell’ultimo

stadio (che invece è percorso da Ampere di corrente) e quindi con un diodo ed un condensatore

riesco a capire, a meno di una caduta sul diodo, qual è la tensione di picco al collettore; confronto

poi questo valore con uno di riferimento, di soglia e decido qualora mi renda conto con un

comparatore che la tensione di picco al collettore supera quella di riferimento di operare per

risolvere ciò → opero abbattendo il guadagno della catena, così all’ultimo stadio non arriva segnale

e quindi non ci sarà nemmeno tensione sul collettore (a meno della continua). Quanto descritto si

realizza con un semplice circuito retroazionato. Abbatto il guadagno d’anello ad esempio riducendo

le correnti. E questa è un’altra funzionalità a cui la circuiteria al contorno del PA deve soddisfare.

Basic mirror biasing

Analizziamo ora il modello base di un circuito con la quale si realizza la polarizzazione di un

amplificatore di potenza:

Attenzione: questo circuito

non c’entra niente col circuito

di polarizzazione di un LNA.

La LB non ha nulla a che

vedere con quella di un LNA.

Lo stadio di amplificazione lo si polarizza con una struttura a diodo che sfrutta un N-esimo di area

al fine di realizzare un fattore di specchio 1-N; anche le correnti allora staranno in tale rapporto.

Ora, se voglio una corrente di polarizzazione stabile in temperatura basta che faccio stabile la

corrente che polarizza il diodo.

C’è un transistore per il recupero di corrente.

I resistori, in particolare la RB gliela mettiamo per non perdere segnale sul ramo di corrente. I

pericoli a cui si va incontro se non si ottempera a questa necessità sono diversi. In particolare si

allude a cosa può significare in un PA il perdere un ε di corrente sul ramo di polarizzazione:

sicuramente si perde in termini di guadagno ed inoltre una corrente che si perde sul ramo di

polarizzazione e che quindi va a disturbare la rete di polarizzazione stessa può tornare in gioco da

qualche altra parte del circuito (nostro malgrado) → per esempio può presentarsi come un disturbo

attivo erogato dalla circuito di polarizzazione al carico ed allora si può malauguratamente verificare

19

che lungo questo percorso parassita che comprende la catena di amplificazione e il percorso

parassita di feedback si può verificare che il guadagno in dB è maggiore di zero, è cioè maggiore

dell’unità. Succede allora che se si ha un accoppiamento del genere (accoppiamento di questa

potenza persa con qualche altra parte del circuito) il PA oscilla, cioè dà in uscita qualcosa anche in

assenza di segnale → in tali condizioni il PA è inservibile.

Si limita allora la potenza che si inietta nella rete di polarizzazione mettendo la resistenza RB, poi

per bilanciare questa RB deve metterne una pari a N* RB → lo scopo dello specchio è quello di fare

delle VBE uguali. Per fare le due VBE uguali, prescindendo dalla caduta sull’induttore che in

continua è zero, devono essere uguali le cadute sulle due resistenze RB e N* RB, e allora siccome

sulla base di T1 ci scorre una corrente N volte più piccola devo mettergli una resistenza N volte più

grande.

L’induttanza LB e il capacitore CB sono messi nella stessa ottica perché l’induttanza alle frequenze

di lavoro tende ad aprirsi e ad offrire quindi un’impedenza alta e il capacitore ha lo stesso scopo

perché se una certa porzione del segnale se ne va su CB, il condensatore butta tale porzione a massa.

In base a queste considerazioni sembra potersi dire che più grande faccio la RB e meglio è! In realtà

così non è perché ci sono altri tipi di considerazioni che ci portano a dire una scelta di RB troppo

grande è controproducente per i seguenti motivi:

Più grande si fa RB e meno potenza si perde

Voltage biasing vs. current biasing. Facciamo riferimento al seguente grafico che illustra

come varia, in funzione della potenza d’ingresso, il valor medio della corrente di collettore:

ic avg

RB bassa

Ic*

RB alta

Pin [dBm]

Pin*

Intanto non deve stupirci il fatto che il valore della corrente media vari col livello della potenza in

ingresso (basta pensare al classe B). su come la corrente media varia in funzione della Pin incide

molto il valore della RB. per valori di RB bassi si assiste ad un incremento della corrente media di

collettore al variare della potenza d’ingresso. Viceversa il livello di corrente media scende

all’aumentare del livello di potenza quando RB è alta. Ora supponiamo che per dare un certo livello

di potenza nominale in uscita dobbiamo dare un livello di potenza in ingresso pari a Pin* e per fare

ciò occorre come livello di corrente media proprio la Ic*. Supponiamo adesso che in uscita ci serva

meno potenza (vedi grafico) e allora a secondo se siamo con RB alta o bassa abbiamo consumi

diversi della corrente media di collettore. Ragionevolmente conviene usare una RB bassa perché

limita l’esubero di corrente a livelli di potenza che sono minori di quelli che il PA si deve trovare ad

erogare.

NOTA: le considerazioni che stiamo facendo valgono esclusivamente per i bipolari.

20

Allora capiamo il perché una RB non è sempre conveniente. E’ conveniente dal punto di vista

dell’isolamento ma non dal punto di vista dell’efficienza, del consumo.

C’è un’altra considerazione che mi porta a preferire un valore di RB non troppo alto: in

presenza di un BJT a base corta la tensione di breackdown tra collettore ed emettitore VBCE

è più alta rispetto al caso di base lunga. Ora, per questioni di robustezza conviene avere

tensioni di breakdown più alte possibili e che allora non mi convenga lavorare con alte

impedenze sulla base ma con basse impedenze (R = ρl / S). E quindi avere una bassa RB mi

può convenire perché abbiamo capito che il transistore risulta più robusto se caricato con

un’impedenza bassa.

E’ allora necessario un trade-off per trovare la RB ottimale!!

Vedremo poi che ai fini della linearità la RB gioca un ruolo importante → perché per motivi legati

ad una diversa variazione di ic (e quindi del guadagno) in funzione della potenza di ingresso si gioca

molto sulla linearità. In particolare c’è un valore di RB ottimo in base alla quale la linearità è

favorita.

Layout e package

Le scelte di layout e package hanno risvolti importanti sulle prestazioni del dispositivo, in

particolare hanno risvolti importanti sul guadagno dell’amplificatore. Ciò che più fa soffrire il PA

dal punto di vista del guadagno è il parassita induttivo sull’emettitore di ciascuno stadio. Per

collegare l’emettitore di un transistore alla massa (configurazione a emettitore comune) si usa un

percorso parassita in qualunque modo lo si collega e alle frequenze di lavoro tipicamente questo

parassita si comporta in maniera induttiva. E’ quindi come se avessimo un emettitore di comune

affetto da induttanza di degenerazione dovuta ai parassiti di collegamento. Per dire se il parassita

introdotto da questo collegamento è rilevante o meno è necessario confrontarlo con 1/gm, perché se

la degenerazione è ben più bassa di 1/ gm la trasconduttanza e il guadagno dello stadio rimangono

quelli che competono allo stadio alla configurazione ad emettitore comune ideale, cioè gm. Se

invece la degenerazione è ben più alta di 1/ gm la trasconduttanza tenderà ad 1/(l’impedenza che fa

la degenerazione).

Ora l’1/ gm di un transistore bipolare con una corrente di polarizzazione di 1A è circa 25mΩ. si

capisce quindi che si fa presto a fare un’induttanza parassita che supera i 25mΩ con la conseguenza

che il guadagno si abbatte notevolmente (causa la degenerazione induttiva) e ulteriori conseguenze

sull’efficienza perché se il guadagno di uno stadio crolla significa che lo stadio a monte deve dare

più potenza, consuma di più e quindi nel complesso si perde in efficienza.

E allora se è così critico l’aspetto dell’induttanza di degenerazione parassita bisogna ad esso porre

rimedio. Per fare ciò è necessario capire cosa costituisce questa induttanza di degenerazione.

Dall’emettitore che c’è sul die sulla fetta di silicio alla massa della board su cui il package è saldato

cosa abbiamo? Dall’emettitore abbiamo una pista che mi collega al pad di bonding, poi abbiamo il

filo di bonding che mi collega al piedino 6, poi il piedino 6 sarà saldato sulla massa della board.

Abbiamo allora tre componenti che costituiscono questo parassita induttivo. Dobbiamo capire

come minimizzare questi contributi: lo facciamo con scelte di layout e di package opportune.

21

In tal senso vediamo il layout dello schematico visto in precedenza:

Questo

è

esemplificativo di una

strategia di layout.

In rosa abbiamo il

piano di massa.

I numeretti che compaiono corrispondono proprio ad alcuni punti di quello schematico.

Allora minimizziamo quei tre contributi a partire da quello dovuto alla pista che collega l’emettitore

al pad di bonding: posso fare un’inter-connessione a bassa induttanza facendo una connessione

larga e corta.

Restano da ridurre gli altri due contributi: per essi è necessario un opportuno package che

esemplificativamente è il seguente:

22

Notiamo che il package usato non ha i classici piedini che si saldano sulla board, ha invece delle

piazzole metalliche, ed ha inoltre un piattello metallico esposto nella parte i inferiore del package

che si salda direttamente sulla massa della board. Il die viene direttamente saldato sul pad esposto, e

il pad esposto viene saldato sulla massa della board.

Per capire meglio è utile vedere il package in sezione:

La massa non passa attraverso i piedini ma attraverso il pad esposto. Questo significa che se ho un

piano di massa sul die lo posso collegare al pad esposto (che è collegato alla massa della board) con

tutti i fili di bonding che voglio. Quanto detto è intuibile dal seguente dettaglio fotografico:

Il risultato qual’è ? Il piano di massa è a bassa induttanza, fili di bonding gliene posso mettere

quanti ne voglio e proporzionalmente ridurre il valore dell’induttanza perché col parallelo

l’induttanza si riduce, piedini non ne uso perché il pad esposto è direttamente saldato sulla board e

quindi ho minimizzato come volevo l’induttanza parassita nel collegamento fra l’emettitore e la

massa solo grazie a scelte di layout e assemblaggio.

Inoltre un package del genere favorisce anche la dissipazione di calore perché il pad esposto funge

come da dissipatore.

23

Illustriamo adesso delle curve che mostrano le prestazioni dello schematico in esame:

Psat: potenza di saturazione → potenza oltre la quale il dispositivo non è in grado di andare

Ora, il PA in questione ha una Psat ha un massimo di 34dBm ed una efficienza massime del 57%

lavorando con una Vcc = 2.7V e una f = 1.8GHz. E questo PA è realizzato con tecnologia al silicio.

Altre prestazioni interessanti offerte da questo PA sono:

24

Effetti non lineari negli amplificatori di potenza in ambito RF

Inviluppo complesso

Spieghiamo innanzitutto il concetto di inviluppo complesso di un segnale modulato.

Un generico modulato in ampiezza e fase si può sempre scrivere nella seguente veste:

A e Ф variano nel tempo proprio perché stiamo modulando in modulo e fase. La stessa cosa

possiamo scriverla non con notazione polare (cioè ampiezza e fase) ma con una notazione

cartesiana (cioè componente in fase I(t) e una in quadratura Q(t)).

Comunque lo si rappresenti, siamo in grado di associare al segnale modulato, istante per istante, un

vettore avente per ampiezza A(t) e per fase Ф(t) ovvero come un vettore che ha come componente x

la I(t) e come componente y la Q(t):

Dato che A e Ф variano nel tempo, varieranno nel

tempo pure la lunghezza e la fase di questo vettore

che sul piano I-Q descriverà un certo disegno.

La traiettoria seguita da questo vettore è quella che

chiamiamo inviluppo complesso del segnale

modulato. Quindi l’informazione non sta nella

frequenza della portante ma sta nell’ampiezza e

nella fase del segnale modulato.

Tale inviluppo complesso lo rappresentiamo come:

25

Ora, dato l’inviluppo complesso quando si parla di potenza si possono indicare due cose → potenza

media e potenza di inviluppo:

Vediamo di capire cosa si intende per potenza di inviluppo. Rappresentiamo in funzione del tempo

il segnale modulato in ampiezza e fase:

v(t)

t

Quella rappresentata è la modulazione in ampiezza. Se prendo questo segnale in un intervallo ∆t

sufficientemente piccolo il segnale mi appare sinusoidale con ampiezza pari al valore che A(t) ha in

quel intervallo temporale e quindi posso associare a tale porzione una potenza come se tale porzione

fosse sinusoidale con quella ampiezza e questa è quella che si chiama potenza di inviluppo. La

potenza di inviluppo è allora pari a:

Ovviamente la potenza di inviluppo è definita in funzione del tempo perché A stessa varia nel

tempo.

La potenza media invece sappiamo già perfettamente cos’è: la media della potenza di inviluppo:

Quindi quando dicevamo che l’UMTS lavora con 27dBm al PA si intendeva la potenza media, il

che significa che la potenza di inviluppo una volta è 26dBm, una volta è 28dBm, una volta è

27dBm, cioè la potenza di inviluppo è variabile nel tempo.

Si capisce che per un segnale ad inviluppo costante (cioè modulato solo in fase) i due concetti di

potenza di inviluppo e potenza media coincidono. E questo è il caso del GSM dato che i segnali

GSM sono modulati solo in fase.

Con riferimento a questi due concetti di potenza si definisce quello che si chiama peak-to-averageratio ossia il rapporto picco-media indicato con PAR:

٨

Penv

PAR =

Pavg

Con Penv cappelletto si sta indicando il livello

massimo della potenza di inviluppo.

26

Ciò significa che ad esempio in una applicazione UMTS con PAR = 3dB se la potenza media è

27dB allora la potenza di inviluppo istantaneamente può arrivare a 30dB.

Il PAR è una caratteristica della modulazione utilizzata.

Ora, tanto più alto è il PAR tanto più stringente è il requisito di linearità sul PA. Il perché è banale:

se ho un PAR di 20dB allora dobbiamo tentare di costruire un PA che è in grado di elaborare non la

potenza media ma idealmente fino a 10dB in più rispetto al valore medio.

Ora se la modulazione è ad inviluppo costante la linearità non è importante ed infatti nel caso del

GSM il PAR ha il valore più piccolo, cioè 1.

Confrontiamo gli inviluppi:

Il percorso tracciato sul piano I-Q dall’inviluppo complesso di un segnale modulato solo in fase è

un cerchio perché inviluppo costante significa che il modulo è costante e modulo costante significa

raggio costante:

27

Il percorso tracciato sul piano I-Q dall’inviluppo complesso di un segnale modulato in fase e in

ampiezza non è più un cerchio e con un po’ di sforzo si riescono ad individuare otto punti della

costellazione in cui c’è un addensamento del segnale:

E quindi l’inviluppo complesso in presenza di modulazione di ampiezza ha questi “ricci”, vediamo

di cosa ne è di questi riccioli nel momento in cui il segnale incontra le non linearità del PA:

A causa della Psat di cui abbiamo parlato prima, l’inviluppo del segnale in uscita si altera: esso non

potrà superare un certo cerchio perché dire che c’è una potenza massima che il PA è in grado di

erogare significa dire che c’è un’ampiezza massima che il PA è in grado di erogare; ma

un’ampiezza massima definisce sul piano dell’inviluppo un cerchio → ciò vuol dire che tutto quello

che vorrebbe andare fuori da questo cerchio viene tagliato.

28

Vediamo cosa ne è dello spettro corrispondente a questo fenomeno qui:

Lo spettro originale (in blu) era perfettamente contenuto all’interno della sua banda di canale. A

causa delle non linearità introdotte dal PA, lo spettro cresce lateralmente e va ad invadere le

porzioni dello spettro allocate ad altri utenti → quindi non ho fatto altro che disturbare la

trasmissione degli altri utenti.

L’effetto di queste non linearità è stato già trattato in un’analisi a due toni quando si è parlato di

IM3, IP3, P1dB. Si è utilizzato come modello delle non linearità uno sviluppo in serie di potenze

del tipo:

Sviluppo che abbiamo per semplicità arrestato al terzo termine con delle ipotesi nel fare questo. Poi

abbiamo visto cosa succede dando in pasto ad un sistema non lineare del terzo ordine una oppia di

sinusoidi di frequenza molto vicina:

29

Ci siamo resi conto che vengono fuori tutta una serie di termini a certa frequenze i cui coefficienti

sono riportati nella seguente tabella:

Abbiamo visto che l’effetto delle non linearità pari è poco grave perché determina un contributo

spurio fuori dalla banda. Mentre è pericoloso l’effetto delle non linearità dispari perché determina la

comparsa di toni nella banda di nostro interesse; in particolare:

Da questo spettro spettro abbiamo estratto i concetti di IM3, IM5, IP3. La validità dei concetti

legati all’analisi dei due toni è legata alle ipotesi citate prima: cioè che le non linearità in gioco non

siano tali da richiedere l’utilizzo di ordine 4, 5 e così via. Cioè nel momento in cui stiamo troncando

al terzo ordine stiamo dicendo che sì abbiamo una non linearità ma è una debole non linearità. E

questo tipo di non linearità può andare bene quando si parla di LNA ma non va bene quando si parla

di PA perché le non linearità del PA sono molto più forti. Quindi quando si parla di PA solitamente

non si parla di IM3 di solito, ben che meno di IP3.

30

Ci sono altri parametri che si prestano date le caratteristiche del segnale a quantificare le non

linearità del PA e li descriveremo adesso: se il segnale d’ingresso non è a due toni ma è un passa

banda come normalmente si utilizza lo spettro che è generato dall’intermodulazione, dalle non

linearità del PA è il seguente:

Abbiamo il segnale originario che occupa una certa banda; abbiamo le non linearità del terzo ordine

che occupano una banda tre volte più grande; abbiamo le non linearità del quinto ordine che

occupano una banda cinque volte più grande.

A meno della presenza di un’eventuale banda di guardia, le non linearità del 3° e del 5° ordine

vanno a sporcare i canali adiacenti a quello nostro di interesse.

Ora, il rapporto tra la potenza trasmessa nel canale desiderato e quella spuria trasmessa nel canale

adiacente definisce quello che si chiama ACPR: adjacent channel power ratio. Questo ACPR è una

misura di quanto la non linearità sta disturbando le comunicazioni altrui.

Ma a ben vedere la non linearità del PA non lede solo le comunicazioni dei canali adiacenti ma

introdurrà un danno anche alla mia comunicazione perché falsa il contenuto informativo che c’è nel

mio canale. E allora per quantificare quest’altro aspetto si usa un altro parametro che va sotto il

nome di EVM: error vector magnitudo. Vediamo di capire come è definito questo EVM: in ogni

istante di tempo si ha un valore dell’inviluppo complesso, un vettore che vorrei trasmettere; mio

malgrado l’inviluppo complesso del segnale che realmente si trasmette a causa delle non linearità

del PA sarà diverso:

Si potrà definire istante per istante un vettore errore come differenza tra i due → il valore RMS di

questo vettore normalizzato al valore RMS della portante del segnale trasmesso definisce l’EVM.

31

L’EVM è un valore espresso in termini percentuali ed indica di quanto si è sporcato il canale di

interesse stesso.

Esempio WCDMA richiede: 33dBc ACPR e 17.5% EVM.

Vediamo un’altra causa di non linearità. Abbiamo già visto come varia il guadagno in funzione

della potenza d’ingresso e detto che in assenza della modulazione d’ampiezza il problema della non

linearità non sussiste. Riprendiamo tale discorso:

All’aumentare della potenza d’ingresso si ha

inizialmente una fase di espansione perché

ad esempio come accade in classe B la

corrente cresce con il livello di potenza, e se

cresce la corrente cresce pure il guadagno e

si assiste quindi ad una fase di espansione.

Poi quando la dinamica di tensione tocca i

limiti fisici (quando ad esempio comincia a

saturare con la VCEsat) entra in gioco la

compressione perché ci si approssima alla

Psat. La non linearità introdotta dalla

variazione del guadagno in funzione della

potenza d’ingresso si chiama distorsione

AM-AM, significa che modulo l’ampiezza

per via di una variazione del guadagno a

causa della modulazione delle ampiezze in

ingresso.

Vediamo adesso di capire la non linearità AM- PM. Come dovrebbe essere la differenza di fase tra

ingresso e uscita del PA affinché il PA sia idealmente lineare? Dovrebbe essere costante. Per cui ci

accontenteremo di una differenza di fase costante al variare della potenza di ingresso; ma nella

realtà così non è. In particolare a causa delle non linearità dovute agli elementi reattivi del modello

(del transistore) la differenza di fase tra ingresso e uscita cambia al variare della potenza d’ingresso,

così come il guadagno. Quindi stiamo non solo amplificando diversamente ma anche sfasando

diversamente il segnale a secondo della potenza d’ingresso del segnale. → questa si chiama

distorsione AM-PM.

Questa distorsione non viene fuori se si tratta il segnale con la classica serie di Taylor, non viene

fuori alcun termine di sfasamento da tale analisi. E di fatto per modellizzare fenomeni di questo

genere si richiedono degli strumenti analitici più complessi come la serie di Volterra che può essere

assimilata come uno sviluppo in serie di potenza con coefficienti complessi.

32

Tecniche di linearizzazione

Come si può fare un PA lineare, che riesca cioè a lavorare anche a fronte di un segnale modulato

in ampiezza?

L’approccio più semplice è quello del power backoff (PBO) → Supponiamo che il nostro segnale

modulato in ampiezza abbia un rapporto picco-media di 3dB e che il segnale da trasmettere sia in

media i soliti 27dBm..allora dobbiamo essere in grado di elaborare fino a 30dBm. L’approccio più

banale per la progettazione di un PA è fare un PA che sa erogare fino a 30 per poi sfruttarlo a 27.

cioè sovra-dimensioniamo il PA dal punto di vista dell’erogazione di potenza così che il PA si trova

a lavorare alla potenza lineare richiesta in un range entro cui lui manifesta linearità. Cos’ì il PA si

trova a lavorare sufficientemente lontano dalla saturazione. Questo approccio sortisce degli effetti

indesiderati ed è totalmente in disaccordo con qualsiasi requisito di efficienza perché se sovradimensiono il PA significa che sovra-dimensiono anche la corrente dissipata.

Quindi quello del power backoff è l’approccio più semplice ma sicuramente il meno efficace.

Esiste una regola empirica alla quale ci si attiene nella progettazione quando si adotta la tecnica del

power backoff:

PBO = PAR

Tale regola empirica corrisponde all’assunzione seguente:

٨

Penv P1dB

=

Pavg Pavg

PAR

PBO

Cioè corrisponde al dire che il picco della potenza di inviluppo coincide con la P1dB. Cioè nel

momento in cui l’inviluppo assume la sua massima potenza il PA si troverà nel punto di

compressione. Si fa cioè in modo che le fluttuazioni della potenza di inviluppo non superino mai il

P1dB.

Pertanto capiamo che il power backoff indica di quanto sovra-dimensioniamo il P1dB rispetto alla

potenza media del segnale.

A questo si tratta di vedere se esiste un modo per salvare sia l’efficienza che la linearità. Delle

tecniche esistono per fare ciò ma a discapito della complessità circuitale.

E’ necessario applicare delle tecniche di linearizzazione che possono essere classificate così:

•

•

•

A livello di sistema

A livello di circuito

A livello di dispositivo

a secondo che all’effetto della linearizzazione sia interessato tutto il trasmettitore, o solo il circuito

che fa la funzione di PA, o addirittura il solo transistore.

33

Esempio di linearizzazione a livello di sistema

Cartesian feddback

Il cuore di questo schema coincide con l’architettura di un trasmettitore a singola conversione

perché c’è un mixer in quadrata seguito da un PA che è proprio lo scema di base di un trasmettitore

a singola conversione.

L’uscita viene prelevata con un accoppiatore direzionale, opportunamente attenuata e inviata in

ingresso ad un mixer in quadratura down-converter che riporta il segnale dall’RF alla banda base.

Una volta che il segnale è in banda base (quindi componente I e componente Q che essendo nella

catena di feedback sono indicate col pedice f) lo si confronta col segnale d’ingresso che viene dal

DSP (anch’esso scomposto in componente I e Q). Ed è la differenza tra questi segnali a pilotare la

catena diretta (come in tutti i circuiti retroazionati) cioè ad essere posta in ingresso al mixer upconverter. I due blocchi loop compensation implementati come dei passa-basso poi servono per la

compensazione del loop al fine di garantire stabilità ed in virtù dell’alto guadagno d’anello tale loop

è in grado di stabilizzare tutto il trasmettitore → Resta da capire come: partiamo dal presupposto

che in virtù dell’alto guadagno d’anello c’è quello che in altre sedi abbiamo chiamato cortocircuito

virtuale cioè il fatto che I e If, Q e Qf sono circa uguali. Consideriamo inoltre che il segnale mandato

al mixer down-converter attenuato è un piccolo segnale. Posso dunque pensare che il mixer downconverter lavori su questo segnale in maniera lineare, cioè che manifesti tra l’ingresso che gli diamo

noi e l’uscita in banda base una apprezzabile linearità. Possiamo allora dire che If e Qf (e quindi

anche I e Q) siano le versioni linearmente down convertite del segnale RF che funge da ingresso al

mixer down-converter (che poi è il segnale d’uscita). Ma dire ciò equivale a dire che RFout è la

versione linearmente up convertita di I e Q.

Quindi nell’ipotesi di down-converter lineare ed in virtù dell’elevato guadagno d’anello, l’uscita è

la versione up convertita delle componenti in fase ed in quadratura che ci sono in ingresso.

34

Ovviamente come in tutti i circuiti retroazionati è critica la linearità e le performance della catena di

retroazione → se malauguratamente il down conveter non è lineare io risento nella relazione tra

ingresso e uscita di tutte le non linearità.

Il phase-shifter serve perché: il segnale che viaggia lungo il loop sappiamo che è complesso, con

una parte reale e una immaginaria; questo segnale complesso nel loop subisce una rotazione e

questo phase-shifter serve per compensare tale retroazione, compensazione senza la quale si rischia

l’instabilità.

Esempio di linearizzazione a livello di circuito

Predistorsione

Se siamo in un dato momento di sapere che caratteristiche di distorsione, di non linearità ha il

circuito e siamo in grado di produrre in senso inverso un blocco detto predistorsore messo al monte

del PA che compensi perfettamente le non linearità del PA allora possiamo giocarci in quel dato

momento tutte le non linearità. Così facendo la catena risulta perfettamente lineare. Per capire

meglio basta osservare la caratteristica vo-vi sopra tracciata.

Quanto detto in una qualche misura si può fare, con i limiti del caso ovviamente. I limiti del caso

sono che:

Non si riesce perfettamente a conoscere quali sono le caratteristiche distorcenti

Non è detto che riusciamo a riprodurre tali distorsioni in maniera inversa

Non è detto che sia in grado di seguire nel tempo ed in temperatura il modo con cui queste

distorsioni variano e questo è il difetto di tutti i sistemi ad anello aperto come è quello che

stiamo trattando.

Quindi potrei stimare quanto vale all’inizio questa distorsione e compensarla compatibilmente con

la distorsione misurata. Ma la distorsione nel tempo , o in temperatura, varia ed io continuo invece a

compensare sempre nello stesso modo e quindi posso non ottenere lo scopo indesiderato se non in

via approssimativa. → A meno che non si usa quella che si chiama predistorsione adattiva dotata di

un sistema di feedback che a campione rileva l’uscita e adatta i parametri di correzione a come le

35

caratteristiche di distorsione del PA sono variate nel tempo. Ma in tal caso la complessità circuitale

cresce notevolmente.

Esempio di linearizzazione a livello di dispositivo

Vediamo come la RB della rete di polarizzazione del PA possa essere usata a nostro favore per

migliorare le caratteristiche di linearità del singolo transistore. Per capire ciò facciamo riferimento a

due curve, una che descrive il guadagno in funzione della potenza d’ingresso e quella che descrive

il corrispondente IM3 al variare della potenza d’ingresso:

L’IM3 ha una caratteristica con una specie di notch per un certo livello di potenza d’ingresso.

Sappiamo che per piccolo segnale IM3 cresce di 2dB per dB, quindi inizialmente la curva di IM3

cresce con una pendenza 2 a 1. Quando poi interviene la regione di non linearità elevata che ariane

al comportamento del PA, la curva devia dall’andamento teorico di un’analisi arrestata al terzo

ordine che mi dà una pendenza 2 a 1 abbassandoci per un notch e poi risalendo.

A cosa è dovuto il notch? Il notch è dovuto al fatto che i due fenomeni di non linearità che

interessano la curva del guadagno (espansione e compressione) sortiscono effetti diversi sull’IM3 e

in corrispondenza di una determinata potenza tendono a compensarsi. Per tale livello di potenza

d’ingresso il transistore si comporta meglio perché più basso è IM3 e meglio è.

Come si può sfruttare questo notch? La posizione del notch e il valore che la gobba di IM3 ha, sono

funzioni della RB che c’è nella rete di polarizzazione. Vediamo perché è pericolosa questa gobba:

questa gobba è pericolosa perché mi fa rischiare di andare fuori specifica di IM3 prima ancora di

arrivare alla potenza nominale. E’ essenziale allora nel dimensionamento della linearità far si che

tutta la gobba sia sotto la specifica di IM3 che ci è stata assegnata.

Detto ciò esiste un valore di RB che minimizza questa gobba e che quindi mi consente di

ottimizzare le caratteristiche di non linearità del transistore.

36

In altre parole → sulla curva di IM3 giocano due cose: il valore di RB e il livello di corrente. E’ da

tenere presente che più bassa è la corrente più alta la gobba si presenta. E teniamo presente che

esiste un valore di resistenza ottima che mi consente di ottenere per una fissata corrente la gobba

più bassa possibile. Data tale RB se la specifica di IM3 è molto al di sotto del valore richiesto, mi

gioco ciò che ho in eccesso riducendo il livello di corrente così la specifica di IM3 è sempre

soddisfatta ma con un livello di corrente inferiore, il che è un vantaggio!! E allora siamo in grado di

ottenere la stessa specifica su IM3 con un valore di corrente più basso.

37