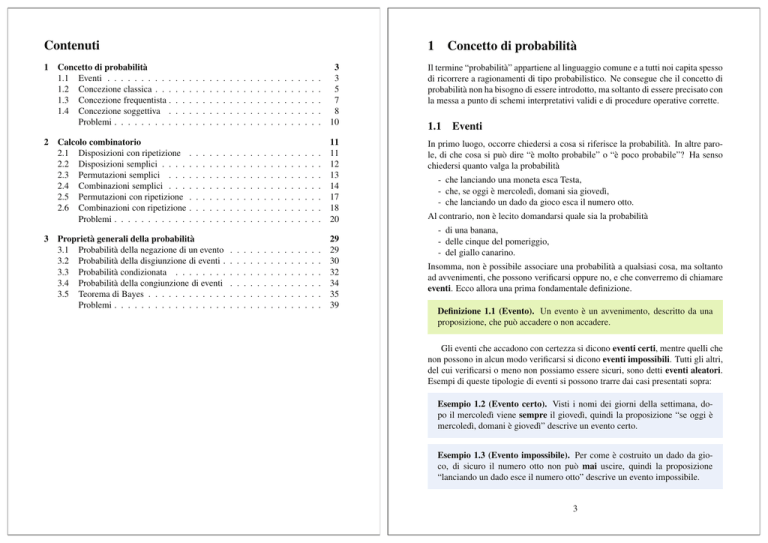

Contenuti

1 Concetto di probabilità

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

3

3

5

7

8

10

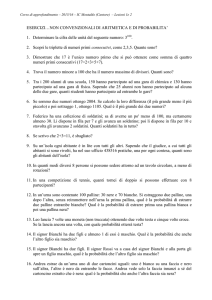

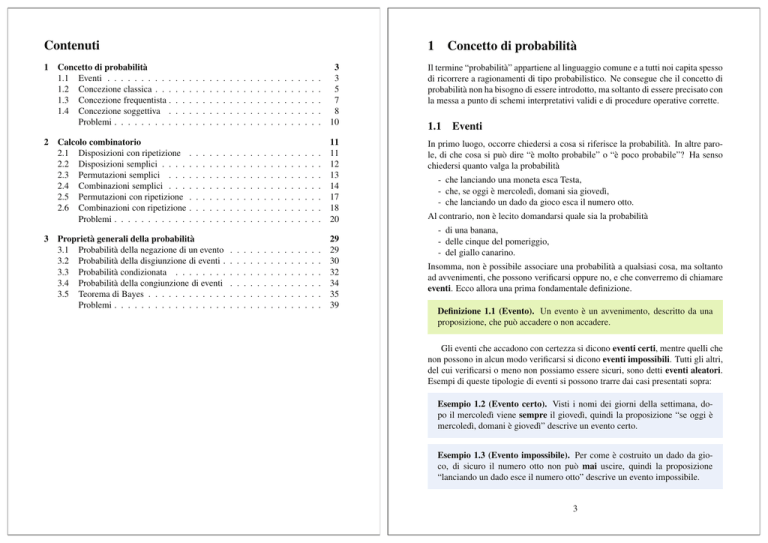

Il termine “probabilità” appartiene al linguaggio comune e a tutti noi capita spesso

di ricorrere a ragionamenti di tipo probabilistico. Ne consegue che il concetto di

probabilità non ha bisogno di essere introdotto, ma soltanto di essere precisato con

la messa a punto di schemi interpretativi validi e di procedure operative corrette.

2 Calcolo combinatorio

2.1 Disposizioni con ripetizione

2.2 Disposizioni semplici . . . .

2.3 Permutazioni semplici . . .

2.4 Combinazioni semplici . . .

2.5 Permutazioni con ripetizione

2.6 Combinazioni con ripetizione

Problemi . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

11

11

12

13

14

17

18

20

In primo luogo, occorre chiedersi a cosa si riferisce la probabilità. In altre parole, di che cosa si può dire “è molto probabile” o “è poco probabile”? Ha senso

chiedersi quanto valga la probabilità

.

.

.

.

.

.

29

29

30

32

34

35

39

1 Concetto di probabilità

1.1 Eventi . . . . . . . . . .

1.2 Concezione classica . . .

1.3 Concezione frequentista .

1.4 Concezione soggettiva .

Problemi . . . . . . . . .

.

.

.

.

.

3 Proprietà generali della probabilità

3.1 Probabilità della negazione di un evento

3.2 Probabilità della disgiunzione di eventi .

3.3 Probabilità condizionata . . . . . . . .

3.4 Probabilità della congiunzione di eventi

3.5 Teorema di Bayes . . . . . . . . . . . .

Problemi . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1.1 Eventi

- che lanciando una moneta esca Testa,

- che, se oggi è mercoledì, domani sia giovedì,

- che lanciando un dado da gioco esca il numero otto.

Al contrario, non è lecito domandarsi quale sia la probabilità

- di una banana,

- delle cinque del pomeriggio,

- del giallo canarino.

Insomma, non è possibile associare una probabilità a qualsiasi cosa, ma soltanto

ad avvenimenti, che possono verificarsi oppure no, e che converremo di chiamare

eventi. Ecco allora una prima fondamentale definizione.

Definizione 1.1 (Evento). Un evento è un avvenimento, descritto da una

proposizione, che può accadere o non accadere.

Gli eventi che accadono con certezza si dicono eventi certi, mentre quelli che

non possono in alcun modo verificarsi si dicono eventi impossibili. Tutti gli altri,

del cui verificarsi o meno non possiamo essere sicuri, sono detti eventi aleatori.

Esempi di queste tipologie di eventi si possono trarre dai casi presentati sopra:

Esempio 1.2 (Evento certo). Visti i nomi dei giorni della settimana, dopo il mercoledì viene sempre il giovedì, quindi la proposizione “se oggi è

mercoledì, domani è giovedì” descrive un evento certo.

Esempio 1.3 (Evento impossibile). Per come è costruito un dado da gioco, di sicuro il numero otto non può mai uscire, quindi la proposizione

“lanciando un dado esce il numero otto” descrive un evento impossibile.

3

Esempio 1.4 (Evento aleatorio). Potenzialmente, il lancio di una moneta

può restituire sia Testa che Croce, ma prima di effettuarlo non è dato di

sapere quale delle due facce uscirà. Per questo la proposizione “lanciando

una moneta esce Testa” denota un evento aleatorio.

Gli eventi aleatori hanno origine da prove con esito imprevedibile, che per

l’appunto sono dette prove aleatorie. Gli eventi che consistono in singoli risultati

di una prova aleatoria si dicono elementari, mentre quelli che corrispondono a

più risultati si dicono composti.

Esempio 1.5 (Evento elementare). La proposizione “il lancio di un dado

restituisce il numero quattro” descive un evento elementare, dal momento

che il quattro è un singolo risultato.

Esempio 1.6 (Evento composto). L’evento descritto dalla proposizione “il

lancio di un dado restituisce un numero dispari” è composto, in quanto al

suo verificarsi contribuiscono tre diversi risultati: uno, tre e cinque.

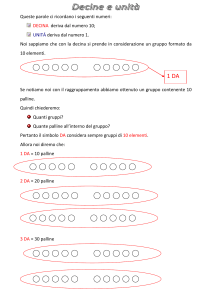

L’insieme di tutti i possibili riU

sultati di una prova aleatoria, che

•

•

••

•

si denota normalmente con U, è

evento composto

•

•

chiamato spazio dei risultati. Un

• •

qualsiasi evento E può essere visto

• •

come sottinsieme di U (E ⊆ U):

evento elementare

in tal senso, gli eventi elementar

U

ri sono sottinsiemi di un solo ele•

•

•

•

mento, mentre quelli composti ne

•

•

evento avvenuto

•

contengono più di uno.

• •

Un evento E risulta verifica• •

to quando il risultato r della proevento non avvenuto

va aleatoria gli appartiene (r ∈ E),

mentre non si verifica se il risultato r della prova aleatoria non gli appartiene

(r ∈

/ E). Dunque, se un evento E contiene tutti i possibili risultati (E = U), avviene in ogni caso, quindi è certo; se un evento E non contiene alcun risultato (E = 0),

/

non può mai accadere, quindi è impossibile; infine, se un evento E contiene alcuni

risultati ma non tutti (E ⊂ U), allora può verificarsi ma non con certezza, quindi

è aleatorio. Al fine di quantificare la possibilità che gli eventi aleatori hanno di

accadere è stato introdotto il concetto di probabilità.

4

1.2 Concezione classica

Data una prova aleatoria, il corrispondente spazio dei risultati U contiene tutti

gli esiti che ne possono derivare o, in altri termini, i casi possibili. Un evento

aleatorio E, visto come sottinsieme di U, conterrà solo alcuni risultati, vale a dire

i casi favorevoli ad E stesso.

Si può pensare, allora, di ottenere una stima del “grado di possibilità” di un

evento contando i casi ad esso favorevoli: quanti più saranno i casi favorevoli,

tanto più sarà “probabile” che l’evento si verifichi. Se fra due eventi relativi alla

stessa prova aleatoria ce n’è uno con un maggior numero di casi favorevoli, diremo

che è “più probabile” dell’altro; se, invece, i casi favorevoli all’uno sono quanti

quelli favorevoli all’altro, diremo che i due eventi sono equiprobabili.

Esempio 1.7. In relazione al lancio di un dado a sei facce, consideriamo i

seguenti tre eventi:

F

G

- E: esce un numero maggiore di 2;

1

2

- F: esce un numero pari;

3

4

- G: esce un numero dispari.

6

5

Si vede immediatamente che i casi faU

E

vorevoli ad E sono quattro, mentre sono soltanto tre i casi favorevoli a F e a G. Di conseguenza, possiamo dire

che E è più probabile di F e di G, i quali, invece, sono fra loro equiprobabili.

In questo esempio, in cui gli eventi si riferivano alla stessa prova aleatoria, è

bastato contare i casi favorevoli. Ma questo metodo rimane valido confrontando

eventi relativi a prove aleatorie diverse? Per capirlo facciamo un altro esempio.

Esempio 1.8. Consideriamo la seguente coppia di eventi relativi a prove

aleatorie distinte:

- E: nel lancio di una moneta esce Testa;

- F: nel lancio di un dado esce un multiplo di tre.

Ad F corrispondono due casi favorevoli, mentre ad E uno solo. Significa che

F è più probabile di E? Il buon senso e l’esperienza dicono di no. Occorre

tenere conto del fatto che i casi possibili non sono in egual numero per le

due prove: è vero che 1 è meno di 2, ma 1 su 2 è più di 2 su 6.

Ne consegue che, in generale, per confrontare la probabilità di due eventi ci si

deve riferire non al numero dei casi favorevoli in assoluto, ma al rapporto fra

il numero dei casi favorevoli e quello dei casi possibili. Va sottolineato che il

5

semplice conteggio di casi favorevoli e casi possibili, essendo una procedura totalmente “democratica”, presuppone che gli esiti siano tutti ugualmente possibili,

nel senso che non ve ne sia nessuno privilegiato rispetto agli altri.

Ne discende in modo naturale la seguente definizione di probabilità dovuta a

Pierre Simone Laplace, detta comunemente definizione classica.

Definizione 1.9 (Probabilità classica). La probabilità di un evento E è

uguale al rapporto fra il numero fE dei casi favorevoli ad E e il numero u

dei casi possibili, laddove essi siano tutti ugualmente possibili:

fE

P(E) = .

(1.1)

u

def.

Per quanto detto sopra, si deve sempre cercare una rappresentazione dello spazio

dei risultati che rispetti la condizione di equipossibilità. Ove i temini del problema

non lo consentissero, come nel caso di un dado truccato, la formula (1.1) non è in

alcun modo applicabile.

Esempio 1.10. Consideriamo una prova aleatoria in cui vengano lanciati

due dadi e successivamente calcolata la somma dei loro due punteggi.

Supponiamo di voler calcolare la probabilità dell’evento

E: “la somma è minore di 4”.

Adottando i possibili valori della somma come risultati e applicando su di

essi la formula (1.1) si cade in errore. Ad esempio, così facendo, lo spazio

dei risultati risulterebbe essere U = {2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12} e i casi

2

favorevoli sarebbero il 2 e il 3, quindi fE = 2, u = 11, da cui P(E) = 11

.

Il problema è che i valori della somma non sono equipossibili (per esempio il 2 si ottiene solo come 1+1, mentre il 3 si ottiene come 1+2 e come

2+1, quindi in due modi anziché uno solo). Allora scegliamo come spazio

dei risultati {1, 2, 3, 4, 5, 6}×{1, 2, 3, 4, 5, 6}, cioè quello formato da tutte le

coppie dei singoli punteggi dei due dadi. Questi casi sono tutti ugualmente

1

, la risposta

possibili e si ha fE = 1 + 2 = 3, u = 6 · 6 = 36, da cui P(E) = 12

corretta.

Proprietà 1.11. La probabilità in senso classico gode di queste tre proprietà

fondamentali:

a) la probabilità di un evento E è sempre compresa fra zero e uno,

0 ≤ P(E) ≤ 1;

(1.2a)

b) la probabiltà di un evento impossibile è nulla,

P(0)

/ = 0;

(1.2b)

c) la probabilità di un evento certo è pari a uno,

P(U) = 1.

(1.2c)

1.3 Concezione frequentista

Il calcolo della probabilità in senso classico viene condotto a priori, vale a dire

senza la necessità di effettuare realmente alcuna prova aleatoria. Questa possibilità si fonda sulla conoscenza delle caratteristiche “interne” del sistema oggetto

della prova: ad esempio, la regolarità di una moneta oppure la distribuzione delle

palline in un sacchetto fra i loro vari colori. Se tali informazioni non dovessero essere disponibili, vengono a mancare gli ingredienti da inserire nella formula (1.1),

quindi occorre affrontare il problema della probabilità da un’altro punto di vista.

Nel caso in cui la situazione permetta comunque di ripetere un esperimento

quante volte si vuole e sempre nelle medesime condizioni (un esempio potrebbe

essere quello di un dado truccato), si può registrare il numero n di prove eseguite

e il numero mE delle prove in cui l’evento E si è verificato. In analogia con quanto

si fa in probabilità classica con casi favorevoli e casi possibili, si può poi calcolare

la frequenza relativa osservata dell’evento E, definita come segue.

Definizione 1.12 (Frequenza relativa). La frequenza relativa f (E) di un

evento E sottoposto a n prove, effettuate nelle stesse condizioni, è il rapporto

fra il numero mE in cui l’evento E si è verificato e il numero n delle prove

eseguite:

mE

f (E) =

.

(1.3)

n

def.

Dalla definizione 1.9, osservando che il numero fE dei casi favorevoli può

variare solo fra 0 e il numero u dei casi possibili, che un evento impossibile non

ha casi favorevoli e che per un evento certo i casi possibili sono tutti favorevoli, si

ricavano subito le seguenti tre proprietà generali della probabilità classica, che ci

si aspetta a buon senso da una qualsiasi nozione di probabilità.

La rassomiglianza fra le formule (1.1) e (1.3) è evidente. Lo conferma il fatto

che, come è facile verificare, la frequenza relativa gode di proprietà analoghe a

alle (1.2), valide per la probabilità classica, anche se in un’accezione diversa.

6

7

Proprietà 1.13. La frequenza relativa degli eventi gode di queste tre

proprietà fondamentali:

nelle stesse condizioni, non resta che affidarsi ad una valutazione soggettiva, intesa come grado di fiducia che un soggetto può attribuire al verificarsi di un certo

evento.

a) la frequenza relativa di un evento E è sempre compresa fra zero e uno,

0 ≤ f (E) ≤ 1;

(1.4a)

b) la frequenza relativa di un evento E0 che non si è verificato in alcuna

prova (non significa che l’evento sia impossibile!) è nulla,

f (E0 ) = 0;

(1.4b)

c) la frequenza relativa di un evento E1 che si è verificato in tutte le prove

(non significa che l’evento sia certo!) è pari a uno,

f (E1 ) = 1.

(1.4c)

Il legame fra frequenza relativa e probabilità è sancito dalla seguente proprietà.

Proprietà 1.14 (Legge empirica del caso). Dato un evento E, sottoposto a

prove tutte nelle stesse condizioni, il valore della sua frequenza relativa f (E)

si avvicina sempre di più al valore della probabilità P(E) all’aumentare

del numero n di prove effettuate.

Da qui discende in modo naturale una seconda concezione della probabilità dovuta

a Richard von Mises, detta comunemente concezione frequentista.

Definizione 1.15 (Probababilità frequentista). La probabilità di un evento

E è la frequenza relativa del suo verificarsi quando il numero delle prove

effettuate è da ritenersi “sufficientemente alto”:

def.

(1.5)

P(E) = f (E) .

Esempio 1.16. Dovendo giocare la schedina del Totocalcio, al momento di

compilare la riga relativa alla prossima partita del Bologna, non si può certo

applicare la definizione classica di probabilità, né si può ripetere la partita

quante volte si vuole per vedere cosa succede. Si può soltanto stimare “ad

occhio” la probabilità di vittoria della squadra.

Ciò significa che, in tal modo, il livello di probabilità assegnato ad uno stesso

evento cambia da un soggetto all’altro, diversamente da quanto accade con

nella concezione classica e in quella frequentista. Questa probabilità, detta appunto soggettiva, non è tuttavia puramente qualitativa. In opportune condizioni,

infatti, essa è perfettamente quantificabile, secondo un principio codificato dal

matematico italiano Bruno de Finetti.

Definizione 1.17 (Probabilità soggettiva). La probabilità di un evento E è

il rapporto fra la somma pE che si è disposti a pagare in una scommessa e la

somma vE che si riceverà nel caso l’evento E si verifichi, in modo tale che

non si verifichino vincite o perdite certe:

pE

P(E) = .

(1.6)

vE

def.

Esempio 1.18. Se scommettiamo 20e sulla vittoria dell’Italia al prossimo

campionato del mondo di calcio e riteniamo equo che l’agenzia di scommesse ci restituisca 40e in caso di vittoria, significa che diamo l’Italia vincente

con una probabilità pari al 50%.

Nel caso ancora più sfortunato in cui non sia possibile né conoscere “internamente” il sistema oggetto dell’esperimento, né ripetere a piacimento la prova aleatoria

L’esclusione di vincite o perdite sicure ci garantisce che la probabilità di un

evento sia compresa fra zero e uno. Infatti, dando per scontato che in caso

di vincita il banco paghi, una probabilità negativa implicherebbe di scommettere

una somma negativa, cioè incassare invece di spendere al momento della giocata,

ottenendo così un guadagno sicuro. D’altra parte una probabilità maggiore di uno

vorrebbe dire che, anche in caso di vincita, non verrebbe restituita neanche la

somma giocata, determinando così una perdita certa.

In particolare, secondo la (1.6), ad un evento impossibile dovremo attribuire

probabilità nulla, perchè assegnando ad esso una probabilità maggiore di zero

avremmo una perdita certa: puntando una cifra anche piccolissima su un evento

8

9

Questa concezione di probabilità eredita le proprietà (1.4) dalla frequenza relativa, quindi gode delle stesse identiche proprietà della probabilità classica. Una

differenza sostanziale sta nel fatto che, mentre la probabilità classica può essere

calcolata a priori, quella frequentista può essere determinata solo a posteriori,

cioè dopo l’effettiva esecuzione delle prove aleatorie.

1.4 Concezione soggettiva

impossibile non si può che rimetterci. D’altra parte, ad un evento certo dovremo

attribuire una probabilità pari a uno, in quanto attribuendo ad esso una probabilità minore di uno, si riceverebbe più della somma puntata e, dal momento che

l’evento accadrebbe di sicuro, si determinerebbe automaticamente un guadagno.

In conclusione, la probabilità soggettiva gode di tre proprietà fondamentali

identiche alle (1.2), e quindi valide in tutte e tre le concezioni di probabilità.

Problemi

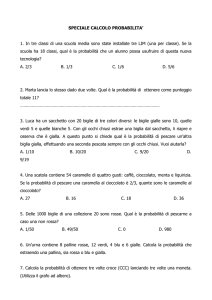

1.1. Dei seguenti eventi relativi al lancio di due dadi, specifica se sono certi

(C), impossibili (I) o aleatori (A):

a) con almeno uno dei due dadi è uscito il numero 4;

b) la somma dei due punteggi è maggiore di 9;

2 Calcolo combinatorio

Il calcolo della probabilità in senso classico richiede di contare i casi possibili e

quelli favorevoli ad un dato evento. In linea di principio, si può costruire esplicitamente tutto lo spazio dei risultati, selezionare fra gli esiti ottenuti quelli favorevoli,

e vedere quanti sono. Nella pratica, però, questa sequenza di operazioni si rivela

il più delle volte assai dispendiosa, se non addirittura proibitiva.

Fortunatamente, ai fini del computo della probabilità, non interessa quali siano

i casi possibili e i casi favorevoli, ma soltanto il loro numero, e il calcolo combinatorio fornisce per l’appunto strumenti che permettono di eseguire tali conteggi

in modo più semplice e rapido.

2.1 Disposizioni con ripetizione

c) il rapporto fra il punteggio di un dado e quello dell’altro è minore o

uguale a 0.1;

d) il prodotto dei due punteggi è un numero primo;

e) la somma dei due punteggi è pari quando essi sono uguali.

A, A, I, A, C

Consideriamo un esempio di problema che si incontra molto frequentemente e

cerchiamo di estrapolarne una regola di calcolo valida in generale.

Esempio 2.1. Supponiamo di avere a nostra disposizione un’urna con

dentro tre bussolotti contrassegnati dalle lettere “A”, “B” e “C”. Pensiamo

ora di estrarne uno a caso e di rimetterlo all’interno dell’urna, poi di

estrarne un secondo. Che probabilità c’è si

A

pescare, nell’ordine, “C” e “B”?

A

1.2. Immaginando di effettuare nella pratica le seguenti prove aleatorie,

descrivine gli spazi dei risultati:

a) si lanciano in aria tre monete diverse;

b) si lancia in aria una moneta e un dado da gioco a sei facce;

c) da un sacchetto contenente quattro gettoni di colori diversi (R, G, V, B),

se ne estraggono due pescandone prima uno, poi, dopo averlo rimesso

dentro, pescando l’altro;

d) in un’urna contenente palline numerate da 1 a 5, si infila una mano e se

ne estraggono due insieme.

{T,C}×{T,C}×{T,C}, {T,C}×{1, 2, 3, 4, 5, 6}, {R,G,V,B}×{R,G,V,B},

{1}×{2,3,4,5} ∪ {2}×{1,3,4,5} ∪ {3}×{1,2,4,5} ∪ {4}×{1,2,3,5} ∪ {5}×{1,2,3,4}

1.3. Applicando la definizione classica, calcola le probabilità degli eventi

proposti nel problema 1.1.

11 1

1

36 , 6 ,

10

0, 6 , 1

C’è un solo caso favorevole, ma quanti sono i casi possibili? Come suggerito dal diagramma ad albero, per ognuno dei tre possibili risultati della prima estrazione, ci sono

tre possibili risultati della seconda. Di conseguenza, volendo contare i casi possibili,

abbiamo 3 + 3 + 3 = 3 · 3 = 32 .

B

C

B

C

A

B

C

A

B

C

E se ci fosse stata anche una “D”? Seguendo la stessa linea di ragionamento,

avremmo ottenuto 4+4+4+4 = 4·4 = 42 . La base della potenza coincide

con il numero di risultati possibili per la singola estrazione, ossia dal

numero di bussolotti tra cui peschiamo.

E se, con tre bussolotti a disposizione, ne avessimo estratti non due, ma tre

uno dopo l’altro rimettendoli nell’urna? Per ognuno dei tre possibili risultati

della prima estrazione, ne avremmo avuti tre per la seconda, e per ognuno di

questi ancora tre per la terza, ottenendo così (3 + 3 + 3) + (3 + 3 + 3) + (3 +

3 + 3) = 3 · 3 + 3 · 3 + 3 · 3 = 3 · 3 · 3 = 33 . Sicchè il numero di estrazioni

non influisce sulla base della potenza, ma coincide con l’esponente.

11

Questo schema di ragionamento si adatta a tutti i problemi in cui si hanno n oggetti

a disposizione e da essi se ne estraggono k con la possibilità di ripetizioni. Diamo

un nome a questa categoria di situazioni e scriviamo una formula generale.

Definizione 2.2 (Disposizioni con ripetizione). Si chiamano “disposizioni

con ripetizione di n oggetti distinti di classe k” tutti i gruppi di k elementi,

anche ripetuti, scelti fra gli n, che differiscono per almeno un elemento o

per il loro ordine. Il numero delle disposizioni con ripetizione è dato da

R

Dn,k

= nk .

(2.1)

Questo schema di ragionamento si adatta a tutti i problemi in cui si hanno n

oggetti a disposizione e da essi se ne estraggono k senza la possibilità di ripetizioni. Diamo un nome a questa categoria di situazioni e scriviamo esplicitamente

una formula generale.

Definizione 2.4 (Disposizioni semplici). Le disposizioni semplici di n oggetti distinti di classe k (con k ≤ n) sono tutti i gruppi di k elementi, scelti

senza ripetizioni fra gli n, che differiscono per almeno un elemento o per il

loro ordine. Il numero delle disposizioni semplici è dato da

Dn,k = n · (n − 1) · . . . · (n − k + 1) .

(2.2)

2.2 Disposizioni semplici

Come nel caso delle disposizioni con ripetizione, partiamo da un esempio comune

e cerchiamo poi di generalizzare il discorso traendone una regola generale.

Esempio 2.3. Supponiamo di trovarci nella situazione dell’esempio 2.1, ma

di estrarre un bussolotto a caso e poi, senza rimetterlo all’interno dell’urna,

di estrarne un secondo. Che probabilità c’è

B

si pescare, nell’ordine, “C” e “B”?

A

C

C’è un solo caso favorevole, ma quanti sono i casi possibili? Come suggerito dal diaA

B

gramma ad albero, si può seguire una linea

C

di ragionamento analoga a quella utilizzata

nell’esempio 2.1, ma questa volta alla seconA

C

da estrazione, non avremo più il bussolotto

B

estratto alla prima. Ne segue che, per ognuno dei tre risulatati possibili della prima estrazione, si hanno solo due risultati

per la seconda. I casi possibili sono allora 2 + 2 + 2 = 3 · 2.

Se ci fosse stata anche una “D”, ne avremmo avuti 3 + 3 + 3 + 3 = 4 · 3,

quindi il fattore più elevato del prodotto coincide con il numero di risultati

possibili per la prima estrazione.

Se, con quattro bussolotti a disposizione, ne avessimo estratti non due, ma

tre senza rimetterli nell’urna, per ognuno dei quattro possibili risultati della

prima estrazione, ne avremmo avuti tre per la seconda, e per ognuno di questi

ancora due per la terza, ottenendo così (2 + 2 + 2) + (2 + 2 + 2) + (2 + 2 +

2) + (2 + 2 + 2) = 3 · 2 + 3 · 2 + 3 · 2 + 3 · 2 = 4 · 3 · 2. Sicchè il numero di

estrazioni coincide con il numero dei fattori.

12

2.3 Permutazioni semplici

Adesso, grazie alla formula (2.2), sappiamo contare in quanti modi si possono

estrarre, in ordine e senza ripetizioni, k oggetti da un insieme di n. E se ne estraessimo n, cioè tutti quelli a disposizione? In quel caso le n-uple non si distinguerebbero in nessun caso per gli elementi in esse contenuti, dal momento che sarebbero

sempre gli stessi, ma soltanto per l’ordine in cui si presenterebbero. Diamo un

nome a questa specie particolare di disposizioni semplici.

Definizione 2.5 (Permutazioni semplici). Si chiamano “permutazioni

semplici di n oggetti distinti” tutti i gruppi formati dagli n oggetti che

differiscono per il loro ordine. Il numero delle permutazioni è dato da

Pn = Dn,n = n · (n − 1) · . . . · 1.

(2.3)

Il numero delle permutazioni risulta spesso molto più elevato di quanto il buon

senso potrebbe suggerire.

Esempio 2.6. Proviamo a calcolare in quanti modi ventidue studenti

possono uscire uno per volta dalla loro aula. In tanti modi quanti sono gli

ordinamenti possibili di ventidue elementi:

P22 = 22 · 21 · . . . · 2 · 1 = 1124000727777607680000 .

Anche uscendo ogni giorno in un modo diverso, per esaurire tutti gli

ordinamenti servirebbero più di tre miliardi di miliardi di anni.

Siccome ricorre molto spesso in matematica, alla funzione che esprime il

numero delle permutazioni si è convenuto di dare un nome preciso.

13

Definizione 2.7 (Fattoriale). Si dice “fattoriale” la funzione così definita:

se n = 0,

1

se n = 1,

n! = 1

(2.4)

n · (n − 1) · . . . · 1

se n ≥ 2.

La scrittura “5!” si legge “cinque fattoriale” oppure “il fattoriale di cinque”.

Utilizzando il fattoriale, il numero delle permutazioni si scrive direttamente come

Pn = n! , mentre per quello delle disposizioni semplici si ha

Dn,k = n · (n − 1) · . . . · (n − k + 1)

=

n · (n − 1) · . . . · (n − k + 1) · (n − k) · (n − k − 1) · . . . · 1

(n − k) · (n − k − 1) · . . . · 1

=

n!

n · (n − 1) · . . . · 1

=

.

(n − k) · (n − k − 1) · . . . · 1 (n − k)!

La notazione di fattoriale non è indispensabile, è semplicemente una comodità,

poiché, come abbiamo visto, consente di esprimere in modo sintetico prodotti di

molti termini.

2.4 Combinazioni semplici

Nell’esempio 2.3 sulle disposizioni semplici, ci si chiedeva in quanti modi fosse

possibile pescare, in ordine e senza reintroduzione, due bussolotti da un’urna che

ne conteneva tre. Ora, partendo dalle stesse condizioni, proviamo a cambiare un

po’ la modalità di estrazione.

Esempio 2.8. Supponiamo ancora una volta di avere a disposizione un’urna con dentro tre bussolotti contrassegnati dalle lettere “A”, “B” e “C” e di

estrarne come sempre due, ma questa volta “in blocco”, cioè contemporaneamente, oppure mettendoli in ordine alfabetico subito dopo averli pescati.

In un caso non ha proprio senso parlare di ordine, nell’altro un unico ordine

viene imposto indipendentemente da come escano i bussolotti. Ad ogni modo, così facendo, l’ordine non ha più alcuna rilevanza: l’unica cosa che conta è quali bussolotti vengono estratti. Questo significa che i raggruppamenti

che differiscono per almeno un elemento continuano ad essere distinti, come

nel caso delle disposizioni semplici, mentre quelli che differiscono solo per

l’ordinamento adesso sono conteggiati come uno solo.

14

Dunque, per ogni raggruppamento non ordinato di due bussolotti, ci sono

due disposizioni semplici, che corrispondono ai due modi di ordinarli.

In altri termini, siccome le

estrazione

estrazione

permutazioni di due oggetti

ordinata

non ordinata

sono due, i raggruppamenti

(A, B) (B, A) ←→ {A, B}

non ordinati di due bussolot(A,C) (C, A) ←→ {A,C}

ti distinti sono la metà delle

(B,C) (C, B) ←→ {B,C}

disposizioni semplici.

Ma cosa succederebbe se

estrazione

estrazione

aavessimo quattro bussolotordinata

non ordinata

ti contrassegnati dalle lette(A, B,C) (B, A,C) (C, B, A)

←→ {A, B,C}

re “A”, “B”, “C”, “D”, e ne

(A,C, B) (B,C, A) (C, A, B)

estraessimo tre contempora(B,C, D) (C, D, B) (D, B,C)

←→ {B,C, D}

neamente? Di nuovo, i rag(B, D,C) (C, B, D) (D,C, B)

gruppamenti che differireb(A,C, D) (D, A,C) (C, D, A)

←→ {A,C, D}

bero per almeno un elemento

(C, A, D) (D,C, A) (A, D,C)

sarebbero diversi come per le

(A, B, D) (B, D, A) (D, A, B)

←→ {A, B, D}

disposizioni semplici, mentre

(D, B, A) (A, D, B) (B, A, D)

quelli che differirebbero solo

per l’ordinamento verrebbero conteggiati come uno solo. Dunque, per ogni

raggruppamento non ordinato di tre bussolotti, ci sono tante disposizioni

semplici quanti sono i modi di ordinarli. In conclusione, poiché le permutazioni di tre oggetti sono sei, i raggruppamenti non ordinati di tre bussolotti

distinti sono un sesto delle disposizioni semplici.

A questo punto diamo un nome ai raggruppamenti non ordinati di cui abbiamo

parlato e, generalizzando le considerazioni dell’esempio, scriviamo la formula

generale che esprime il loro numero.

Definizione 2.9 (Combinazioni semplici). Si chiamano “combinazioni

semplici di n elementi distinti di classe k” (con k ≤ n) tutti i gruppi di k elementi scelti fra gli n che differiscono almeno per un elemento (non importa

l’ordine). Il numero delle combinazioni semplici è dato da

Dn,k

n!

Cn,k =

=

.

(2.5)

Pk

k! (n − k)!

Siccome la funzione che esprime il numero delle combinazioni semplici, come

il fattoriale, ricorre molto spesso in matematica, si è convenuto di assegnarle un

nome preciso.

15

Definizione 2.10 (Coefficiente binomiale). Vengono chiamati “coefficienti

binomiali n su k” i numeri dati da

n

n!

, con 0 ≤ k ≤ n .

(2.6)

=

k

k! (n − k)!

def.

Dalla definizione seguono immediatamente alcune proprietà dei coefficienti binomiali. Ponendo k = 0 o k = n, si ha

n

n

n!

=

=

= 1,

(2.7a)

0

n

0! n!

come dire che esiste un solo modo per estrarre in blocco nessuno o tutti gli

elementi da un gruppo di n; ponendo invece k = 1 o k = n − 1, si ottiene

n

n

n!

= n,

(2.7b)

=

=

1! (n − 1)!

1

n−1

come dire che ci sono n modi di estrarre un elemento fra n e altrettanti ne esistono

per estrarne contemporaneamente n − 1. Ciò è ragionevole, dal momento che

estrarre contemporaneamente n − 1 oggetti significa lasciarne da parte uno. Più

in generale, estrarre in blocco k elementi fra n equivale a lasciarne n − k, quindi i

modi di estrarre k elementi in blocco fra n sono tanti quanti i modi di estrarne

alla stessa maniera n − k. In termini di coefficienti binomiali, questa proprietà

delle combinazioni semplici è espressa dall’equazione

n

n

=

,

(2.8)

k

n−k

la quale si ricava osservando che (2.6) rimane invariata cambiando d’ordine i

fattoriali al denominatore.

Ma perché ai coefficienti binomiali è stato attribuito questo nome? La ragione

risiede nella formula scoperta da Isaac Newton per scrivere la potenza n-esima

del binomio (a + b) come polinomio omogeneo di grado n in a e b.

Teorema 2.11 (Binomio di Newton). Dati a, b ∈ R, la potenza n-esima della

loro somma è data da

n n n−k k

n

a

b

(a + b) = ∑

k=0 k

(2.9)

n (n − 1) n−2 2

n

n−1

n−1

n

= a + n a b+

a

b + ...+ n ab

+b .

2

16

Un caso particolare della (2.9) è il ben noto quadrato del binomio (a + b)2 =

a2 + 2ab + b2 . La formula generale può sembrare un po’ astrusa, ma, con gli strumenti del calcolo combinatorio, diventa più comprensibile: guardando ad (a + b)n

come ad un prodotto di n termini tutti uguali ad (a + b), e pensando di svilupparlo

secondo la proprietà distributiva della moltiplicazione rispetto all’addizione, ci si

rende conto che compaiono tanti monomi a n−k b k quanti sono i modi di combinare

n − k fattori “a” e k fattori “b” per formare un prodotto di n, quindi, per l’appunto,

in numero pari alle combinazioni semplici di n oggetti di classe k.

Ad un’importante conseguenza del teorema 2.12 si arriva considerando il caso

particolare a = b = 1, per il quale la formula (2.9) restituisce

n n n n

n n

n

=

1

=

(2.10)

∑ k ∑ k

∑ k 1n−k 1k = (1 + 1)n = 2n .

k=0

k=0

k=0

Osservando che il coefficiente binomiale nk è il numero dei sottinsiemi di k elementi presi da un insieme di n, e ricordando che un sottinsieme di un insieme di n

elementi può averne da un minimo di 0 ad un massimo di n, si deduce dalla (2.10)

che i possibili sottinsiemi di un insieme di n elementi sono 2n .

2.5 Permutazioni con ripetizione

Nel paragrafo 2.3 abbiamo considerato le permutazioni di n oggetti diversi fra di

loro. Ma che cosa accade se alcuni di essi sono indistinguibili?

Esempio 2.12. Consideriamo tutti gli anagrammi, anche privi di senso ,

della parola PASTO. Sono tanti quante le permutazioni delle cinque lettere

che la compongono, vale a dire

P5 = 5! = 5 · 4 · 3 · 2 · 1 = 120.

Contiamo ora gli anagrammi della parola SASSO. Possiamo partire anche in

questo caso dalle permutazioni P5 , ma dobbiamo tenere conto del fatto che

al posto delle tre lettere distinte (la P, la S e la T) abbiamo tre lettere uguali

(le tre S). Ne deriva che, mentre permutando le tre consonanti di PASTO

si ottengono parole sempre diverse, facendo lo stesso con SASSO le parole

sono uguali. Per esempio, tenendo fisse le vocali agli ultimi due posti, da

PASTO si ottengono gli anagrammi

PSTAO, PTSAO, STPAO, SPTAO, TPSAO, TSPAO.

Si hanno 3! = 6 casi distinti, che corrispondono alle permutazioni delle

tre consonanti. Se al posto di P e T mettiamo due S, tutti i casi elencati

divengono uguali a SSSAO e perciò indistinguibili.

17

Pensando allora alle 120 permutazioni di 5 lettere, ci si rende conto che ogni

raggruppamento è ripetuto 6 volte, quindi, per ottenere il numero effettivo

degli anagrammi di SASSO, occorre dividere i 120 di PASTO per 6. Allo

scopo di indicare che tre dei cinque elementi sono uguali, scriviamo

P5 5!

P5(3) = = = 20.

P3 3!

Se invece, partendo sempre da PASTO, sostituissimo la S e la T con due

P e la O con una A, ottenendo così PAPPA, nel calcolo degli anagrammi

dovremmo tenere conto del fatto che non avremmo più uguali soltanto tre

le consonanti, ma anche le due vocali. Quindi, per contare nel modo giusto

gli anagrammi di PAPPA, occorrerebbe dividere i 120 di PASTO non solo

per 6, come abbiamo fatto prima, ma anche per due, in modo da eliminare la

ripetizione dovuta allo scambio delle due vocali:

P5

5!

P5(3,2) =

=

= 10.

(2.11)

P3 · P2 3! 2!

Raggruppamenti come quelli descritti nell’esempio sono detti permutazioni

con ripetizione e la formula, seguendo lo stesso ragionamento appena adottato,

può essere generalizzata al caso in cui gli elementi ripetuti sono k, h, . . . , r con

k + h + . . . + r ≤ n.

Definizione 2.13 (Permutazioni con ripetizione). Si dicono “permutazioni

con ripetizione di n elementi di cui k, h, . . . , r ripetuti” tutti i gruppi formati

dagli n elementi che differiscono per l’ordine in cui si presentano gli elementi distinti e la posizione che occupano gli elementi ripetuti. Il numero

delle permutazioni con ripetizione è dato da

Pn

n!

Pn(k,h,...,r) =

=

.

(2.12)

Pk · Ph · . . . · Pr

k! h! . . . r!

2.6 Combinazioni con ripetizione

Esempio 2.14. Supponiamo di voler distribuire sei palline in quattro scatole. In quanti modi è possibile compiere questa operazione? Se le palline

fossero distinguibili, come nel caso in cui fossero numerate, la risposta si

esprimerebbe in termini di disposizioni con ripetizione:

R

D4,6

= 46 = 4096.

Se però le palline sono assolutamente identiche, allora l’ordine non interessa più e i raggruppamenti, da disposizioni, divengono combinazioni. Le

disposizioni con ripetizione che differiscono solo per l’ordine delle palline

diventano una sola combinazione, quindi le combinazioni con ripetizione

sono meno delle corrispondenti disposizioni.

Per contarle, mettiamo in fila le 4 scatole, poi rappresentiamo con 4 − 1 =

3 righe le separazioni fra di esse e con 6 cerchietti le palline da collocare.

In totale abbiamo quindi 9 segni, 4 − 1 = 3 righe (separazioni) e 6 cerchietti

(palline). Specificare la successione di questi 9 elementi equivale a definire

una distribuzione delle 6 palline nelle 4 scatole: ad esempio

equivale a mettere una pallina nella prima scatola, due nella seconda,

nessuna nella terza e le restanti tre nella quarta, invece

equivale a metterne una nelle prime due e due nelle ultime due. Usando

questa rappresentazione, si vede quindi che distribuire le palline identiche

nelle scatole equivale a scegliere quali posizioni assegnare ai 6 cerchietti fra

i 6 + 4 − 1 = 9 segni. I modi di compiere questa operazione sono tanti quante

le combinazioni semplici di 6 + 4 − 1 = 9 oggetti di classe 6, cioè

6+4−1

9

9!

=

=

= 84.

6

6

6! 3!

Nel paragrafo 2.3, abbiamo imparato a contare le combinazioni semplici, vale a

dire i modi di scegliere k oggetti da un insieme di n senza ripetizioni e non considerando il loro ordine. Vediamo ora cosa cambia continuando a non considerare

l’ordinamento, ma ammettendo la possibilità di ripetizioni. In altri termini ci apprestiamo a studiare le combinazioni con ripetizione. Come al solito proviamo

a mettere a fuoco la questione con l’aiuto di un esempio.

Il ragionamento che abbiamo seguito nell’esempio per 4 scatole e 6 palline può

essere facilmente esteso ad un qualunque numero n di scatole e k di palline. Poiché, poi, le scatole sono in definitiva oggetti tra i quali scegliere con la possibilità

di ripetizioni e le palline sono in sostanza le scelte stesse, questo schema si applica in effetti a tutte le situazioni in cui è in gioco la costruzione di raggruppamenti

non ordinati di k elementi estratti con ripetizione da un insieme di n. Diamo allora

una definizione precisa a questi raggruppamenti.

18

19

Definizione 2.15 (Combinazioni con ripetizione). Si dicono “combinazioni con ripetizione di n elementi di classe k” tutti i gruppi di k oggetti, scelti

anche più di una volta fra gli n, che differiscono per almeno un elemento

(non importa l’ordine). Il numero delle combinazioni con ripetizione è dato

dalla formula

n+k−1

(n + k − 1)!

R

Cn,k

=

=

.

(2.13)

k

(n − 1)! k!

2.6. Quante colonne del totocalcio si possono compilare tenendo fissi i risultati di quattro partite?

19683

2.7. Quanti codici a cinque cifre si possono formare usando le cifre decimali

da 1 a 9?

59049

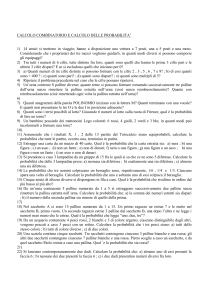

Problemi

2.1. Si lanciano due dadi, uno dopo l’altro. Quanti sono i casi in cui entrambe le facce presentano numeri pari?

9

2.2. Quanti numeri di tre cifre, anche ripetute, si possono formare con gli

elementi dell’insieme A = {3, 5, 6, 7, 8}?

125

2.3. Quanti numeri di tre cifre, anche ripetute, si possono formare con gli

elementi dell’insieme A = {0, 3, 5, 6, 7, 8}?

180

2.4. In un’urna abbiamo delle palline numerate da 1 a 10. Per tre volte si

estrae una pallina, rimettendola ogni volta dentro l’urna. Calcola le possibili

terne ordinate che si possono ottenere. Fai lo stesso calcolo nel caso in cui

la pallina estratta non venga rimessa nell’urna.

1000, 720

2.8. Trova quanti codici a cinque cifre si possono formare con le cifre decimali da 0 a 9 sapendo che la prima cifra non può essere 0.

90000

2.9. Quanti numeri di tre cifre tutte diverse si possono costruire con gli

elementi dell’insieme A = {4, 5, 6, 7, 8}? Quanti di essi cominciano con la

cifra 8?

60, 12

2.10. In quanti modi si possono affidare in un dato momento tre mansioni

avendo a disposizione cinque dipendenti?

60

2.11. In quanti modi diversi otto persone possono sedersi in cinque posti in

un cinema molto affollato?

6720

2.5. In un’urna abbiamo dieci palline numerate da 1 a 10. Calcola quante

terne ordinate si possono ottenere estraendo successivamente una pallina per

tre volte, rimettendola ogni volta nell’urna dopo l’estrazione, tali che il primo numero sia divisibile per tre.

2.12. Calcola quanti numeri di quattro cifre diverse si possono formare con

le nove cifre dell’insieme A = {1, 2, 3, 4, 5, 6, 7, 8, 9}.

20

21

300

3024

2.13. Quanti numeri di cinque cifre diverse si possono formare con le dieci

cifre decimali?

27216

2.14. Calcola quante sigle di cinque elementi, tutti diversi, si possono formare con le ventuno lettere dell’alfabeto e le dieci cifre decimali, sapendo

che i primi tre posti devono essere occupati dalle lettere e gli ultimi due dalle

cifre.

718200

2.15. Ad un torneo di calcio partecipano sedici squadre. Quante partite

si devono effettuare fra girone di andata e di ritorno, sapendo che tutte le

squadre si devono incontrare?

240

2.16. In qunti modi si possono mettere in fila tre bambini e quattro bambine?

E nel caso in cui prima vi siano tutte le femmine e poi tutti i maschi?

5040, 144

2.17. In una gara partecipano otto concorrenti. In quanti modi può presentarsi la classifica finale?

40320

2.20. Calcola quante sigle di sette elementi tutti diversi si possono scrivere con le cifre dell’insieme A = {1, 2, 3} e le lettere dell’insieme B =

{a, b, c, d}, sapendo che le cifre precedono le lettere.

144

2.21. Calcola in quanti modi si possono mettere in fila cinque bambine e

quattro bambini se tutte le bambine devono stare vicine fra loro.

14400

2.22. Ad un congresso, nove persone devono sedere intorno ad un tavolo

rotondo. Calcola in quanti modi diversi possono prendere posto, assumendo

che una sistemazione si equivalga ad un’altra se ognuno ha lo stesso vicino

destro e lo stesso vicino sinistro.

40320

2.23. Un’urna contiene nove palline numerate, di cui sei rosse e tre bianche.

Se ne estraggono contemporaneamente cinque. Calcola

a) quanti gruppi diversi di cinque palline si possono avere;

b) quanti di cinque palline tutte rosse;

c) quanti di quattro rosse e una bianca;

d) quanti di tre rosse e due bianche;

e) quanti di due rosse e tre bianche.

126, 6, 45, 60, 15

2.24. Quante cinquine si possono formare con i 90 numeri del lotto? Quanti

terni e quanti ambi?

2.19. Quanti numeri di dieci cifre diverse si possono scrivere con le dieci

cifre decimali?

2.25. Calcola quante sono le cinquine al lotto che contengono il numero 9 e

il numero 46.

22

23

2.18. In quanti modi si possono distribuire nove premi a nove bambini?

362880

3265920

43949268, 117480, 4005

109736

2.26. Calcola in quanti modi si possono estrarre quattro carte da un mazzo

di quaranta se conta solo quali carte si hanno in mano alla fine.

2.33. Una moneta viene lanciata otto volte. In quanti modi si può presentare

una successione di sei teste e due croci?

2.27. Con lo stesso criterio, in quanti modi si possono estrarre cinque carte

di fiori da un mazzo di cinquantadue? E cinque carte nere?

2.34. In quanti modi si possono sistemare sei oggetti non distinti in nove

scatole diverse sapendo che in ogni scatola deve esserci al massimo un oggetto?

91390

1287, 65780

2.28. Calcola quanti sono i sottinsiemi di quattro elementi presi da un insieme di sei.

15

2.29. In quanti modi si può formare un campione di dieci persone da intervistare in un gruppo di trenta?

30045015

2.30. A una riunione partecipano sei persone che si stringono la mano reciprocamente. Calcola quante strette di mano si scambiano in totale.

15

28

84

2.35. In quanti modi possono disporsi in fila tre gettoni rossi e quattro gialli

se il primo deve essere per forza giallo?

20

2.36. Lanciando contemporaneamente quattro dadi uguali, quante sono le

combinazioni con cui si possono presentare le sei facce?

126

2.37. In quanti modi diversi si possono distribuire otto tavolette di cioccolato

a cinque bambini?

495

2.31. Supponiamo di avere dieci palline tutte della stessa forma, di cui

cinque nere, tre rosse e due gialle. Calcola

a) in quanti modi si possono disporre in fila;

b) in quante fila le palline gialle occupano i primi due posti;

c) in quanti modi si possono disporre in maniera che le palline di uno

stesso colore siano tutte vicine.

2520, 56, 6

2.32. Calcola quanti anagrammi, anche privi di significato, si possono fare

con le parole MENTE, STESSA, TRATTATIVA.

2.38. In quanti modi diversi si possono distribuire quattro tavolette di cioccolato a sei bambini, riservandosi la possibilità di darne più di una ad uno

stesso bambino?

126

2.39. In quanti modi possiamo collocare sei palline uguali in quattro urne?

E in quanti modi possiamo farlo così da non lasciare vuota nessuna urna?

60, 120, 25200

24

25

84, 10

2.40. Le targhe automobilistiche italiane sono formate in sequenza da due

lettere dell’alfabeto inglese, tre cifre decimali e ancora due lettere. Con questo sistema, quanti veicoli possono essere immatricolati?

456976000

2.41. Una signora ha comprato dodici bulbi di tulipani tutti diversi per piantarli in due piccole aiuole del suo giardino. In una c’è spazio per cinque

bulbi, nell’altra per sette.

In quanti modi può fare la scelta di quali mettere da una parte e quali dall’altra? Ipotizzando che nelle aiuole i tulipani vengano disposti in riga, in

quanti modi la signora può portare a termine il suo lavoro?

792, 479001600

2.42. In un gioco di società, si usa un sacchetto con dentro dischetti di legno

recanti ognuno una diversa lettera dell’alfabeto italiano. Ai fini del gioco,

occorre pescarne quattro una dopo l’altra, senza rimetterle ogni volta nel

sacchetto.

Qual è la probabilità che le lettere escano in ordine alfabetico? E se invece

le lettere pescate fossero reintrodotte nel sacchetto prima di prenderne altre,

con quale probabilità sarebbero tutte vocali?

625

1

24 , 194481

2.43. Un arciere scocca otto frecce cercando di centrare un bersaglio circolare suddiviso in cinque cerchi concentrici di colori diversi. Alla fine conta

quante frecce sono finite all’interno di ogni cerchio.

Qual è il numero dei possibili risultati che l’arciere può ottenere da tale conteggio?

2.45. In una gara automobilistica, alla partenza ci sono sette auto da corsa.

Nell’ipotesi che tutti i piloti taglino il traguardo, quante sono le possibili sequenze d’arrivo? E invece nell’ipotesi che tre dei piloti, ma non è dato di

sapere quali, si ritirino prima di completare il percorso previsto? E ancora,

quante sono le possibili sequenze d’arrivo ammettendo ogni possibile eventualità in merito ai ritiri?

35

7 , 323

5

2.47. Nella scatola di un gioco per bambini, ci sono due mazzi di quattro

carte ognuno e su ogni carta di ciascun mazzo è disegnato un diverso animale

della fattoria. I due mazzi sono identici, tranne per il fatto che in uno le carte

hanno il retro tutto giallo e nell’altro tutto verde.

Se ora si mischiano i due mazzi e si mettono le carte rivolte verso l’alto in

fila su un tavolo, in quanti modi si può presentare la sequenza senza tenere

conto se le figure sono orientate verso l’alto o verso il basso? E se invece

ne tenessimo conto? Girando le carte a faccia in giù, quante sarebbero le

possibili sequenze?

2520, 645120, 70

2.48. In una pizzeria, sono disponibili venti ingredienti, fra cui il pomodoro

e la mozzarella. Quante pagine dovrebbe avere il menu se in ognuna di esse

ci fosse spazio per dieci voci e il gestore volesse includere nell’elenco tutte

le possibili pizze farcite con tre ingredienti, in aggiunta al pomodoro e alla

mozzarella?

1048576, 78732

26

2.46. Nel pollaio di una casa di campagna, c’è un gallo insieme ad otto

galline rosse, cinque bianche e sette nere. Durante la notte un ladro di polli,

senza poter distinguere un animale dall’altro per l’oscurità, in tutta fretta ne

infila sei dentro un sacco. Che probabilità c’è che, una volta a casa, trovi

nel sacco solo galline? E qual è la probabilità che trovi due galline di ogni

colore?

1287

2.44. Una piccola staccionata è costituita da dieci assi poste verticalmente

una accanto all’altra. Avendo a disposizione vernice di quattro colori diversi

e dipingendo ogni asse a tinta unita, quante diverse staccionate si possono

realizzare scegliendo liberamente i colori? E invece evitando di dipingere

due assi adiacenti dello stesso colore?

5040, 840, 13700

27

82

2.49. Due vicini di casa hanno l’orto in comune e coltivano ortaggi di vario

tipo. Uno ha venti carote quasi pronte per essere raccolte, l’altro soltanto

quindici. Durante la notte, una talpa andando alla cieca, mangia tre carote.

Qual è la probabilità che il mattino dopo uno dei due vicini trovi intatte tutte

le proprie carote?

29

119

3 Proprietà generali della probabilità

Essendo gli eventi descritti da proposizioni, è lecito applicare ad essi le operazioni della logica proposizionale, come ad esempio la negazione, la disgiunzione,

la congiunzione o una qualsiasi loro composizione. Il tema di fondo cui sarà

dedicata questa sezione è appunto l’insieme delle regole di trasformazione della

probabilità rispetto alle operazioni logiche. Le proprietà che metteremo in luce

consentiranno di calcolare la probabilità di eventi a partire da quella di altri eventi, senza necessariamente procedere al conteggio diretto dei casi favorevoli e dei

casi possibili, come abbiamo fatto fino a questo punto.

3.1 Probabilità della negazione di un evento

Alla domanda “Se domani la probabilità di pioggia è del 32%, qual è la probabilità

che non piova?”, tutti replichiamo subito “68%!” e l’operazione che compiamo

quasi automaticamente per dare la risposta è

¬E

U

sottrarre il 32% dal 100%, cioè la probabilità

E

dell’evento certo.

•

• ••

La base teorica di questo modo di proce• •

• • •

•

dere sta nel fatto che ogni risultato che non è

•

• •

•

•

favorevole ad un evento è favorevole alla sua

negazione, quindi, come insiemi, un evento e

il suo contrario sono complementari. Per questo ci si riferisce spesso alla negazione di un

evento come al suo evento complementare. Ne consegue che, se una prova aleatoria ammette u risultati possibili e fra di essi f sono favorevoli ad un evento E,

allora i casi favorevoli all’evento contrario ¬ E sono per forza i restanti u − f .

Ne deriva che la probabilità di ¬ E, vista come rapporto fra casi favorevoli e casi

possibili, è data da

P(¬ E) =

f

u− f

= 1 − = 1 − P(E).

u

u

Questo ragionamento permette di formulare una relazione di validità generale che

lega la probabilità di un evento a quella del suo complementare.

Teorema 3.1 (Probabilità dell’evento contrario). Dati un evento E e la

sua probabilità P(E), la probabilità della negazione di E, cioè dell’evento

complementare ¬ E, è data dalla formula

P(¬ E) = 1 − P(E).

28

(3.1)

29

3.2 Probabilità della disgiunzione di eventi

Dati due eventi aleatori E ed F, ci si può chiedere quanto valga la probabilità di

E ∨ F, cioè dell’evento “ E o F ”. In altre parole, ci si può porre il problema di

come si comporti la probabilità rispetto alla disgiunzione logica di eventi.

Esempio 3.2. Relativamente al lancio di un dado regolare, prendiamo la

seguente coppia di seguenti eventi aleatori:

- E: “esce un numero minore di tre”,

- F: “esce un numero maggiore di tre”.

I casi favorevoli ad E sono due (l’uno e il due), mentre quelli favorevoli

ad F sono tre (il quattro, il cinque e il sei), quindi P(E) = 31 e P(F) = 21 .

Consideriamo ora l’evento

- E ∨ F: “esce un numero minore di tre o maggiore di tre”.

Dal momento che i casi favorevoli a E ∨ F sono cinque (i numeri da uno a sei

diversi da tre), si ha che P(E ∨ F) = 56 = P(E) + P(F) , quindi la probabilità

della disgiunzione di E ed F è pari alla somma delle loro probabilità..

Si potrebbe essere tentati di concludere che una semplice regola di somma come

quella che l’esempio sembra suggerire possa valere in generale, ma riflettendo con

più attenzione si vede subito che non è così.

Dati due qualsiasi eventi aleatori E ed F, l’evento E ∨ F si verifica ogni volta

che si presenta un risultato favorevole ad E o ad F, quindi, come insieme, esso

coincide con la loro unione; analogamente, E ∧ F, cioè la congiunzione logica “E

e F”, si verifica ogni volta che si presenta un risultato favorevole sia ad E che ad F,

quindi, come insieme, esso coincide con la

• •

U

loro intersezione. Per questo, E ∨ F ed E ∧

•

• •

F sono anche indicati rispettivamente con

•

•

•

•

•

•

E ∪ F e E ∩ F, e ci si riferisce ad essi come

•

• •

•

all’evento unione e all’evento intersezione

•

•

• •

di E ed F. In generale, come chiarisce la

• •

•

•

figura, il numero dei casi favorevoli a E ∪ F

•

F

E

è dato dalla formula

E ∩F

fE∪F = fE + fF − fE∩F ,

Se E e F possono accadere contemporaneaU

• •

E

•

mente ossia, come si suol dire, sono compa• •

•

•

•

tibili, per trovare P(E ∪F) occorre conosce•

•

•

re il valore di P(E ∩F) oltre a quelli di P(E)

• • •

F

•

•

•

e P(F). Impareremo qualcosa in proposito

• •

• •

•

nella prossima sezione. Tuttavia, come si

•

•

vede chiaramente nella figura, il problema

si semplifica moltissimo quando E e F si

escludono a vicenda ossia sono incompatibili, perché in questo caso E ∩ F = 0,

/

quindi P(E ∩ F) = 0, da cui si ha P(E ∪ F) = P(E) + P(F).

Teorema 3.3 (Probabilità della disgiunzione di due eventi). La probabilità

della disgiunzione logica di due eventi E ed F è pari alla somma delle loro

probabilità diminuita della probabilità del loro evento intersezione:

P(E ∪ F) = P(E) + P(F) − P(E ∩ F).

(3.2a)

In particolare, nel caso di eventi incompatibili, si ha

(3.2b)

P(E ∪ F) = P(E) + P(F).

Basandosi su diagrammi di Venn simili a quello nella pagina accanto, si possono

generalizzare questi risiltati a più di due eventi. Per tre si ottiene ad esempio

P(E1 ∪ E2 ∪ E3 ) = P(E1 ) + P(E2) + P(E3) − P(E1 ∩ E2 )

− P(E2 ∩ E3 ) − P(E3 ∩ E1 ) + P(E1 ∩ E2 ∩ E3 ),

con quattro si ha

P(E1 ∪ E2 ∪ E3 ∪ E4 ) = P(E1 ) + P(E2) + P(E3) + P(En)

− P(E1 ∩ E2 ) − P(E1 ∩ E3 ) − P(E1 ∩ E4 )

− P(E2 ∩ E3 ) − P(E2 ∩ E4 ) − P(E3 ∩ E4 )

+ P(E1 ∩ E2 ∩ E3 ) + P(E2 ∩ E3 ∩ E4 )

+ P(E3 ∩ E4 ∩ E1 ) − P(E1 ∩ E2 ∩ E3 ∩ E4 )

(3.3)

(3.4)

e così via, assegnando il segno più alle probabilità di intersezioni di numeri dispari

di eventi e il segno meno alle probabilità di intersezioni di numeri pari di eventi.

In particolare, in caso di incompatibilità, vale la seguente regola.

dove si tiene conto del fatto che, sommando semplicemente i casi favorevoli ad E

ed a F, verrebbero conteggiati due volte quelli favorevoli ad entrambi. Dividendo

per i casi possibili, si ricava un’analoga relazione fra probabilità:

fE∪F

fE + fF − fE∩F

fE fF fE∩F

=

= + −

= P(E)+ P(F)− P(E ∩F).

P(E ∪F) =

u

u

u

u

u

Teorema 3.4 (Teorema della probabilità totale). Se n eventi E1 , E2 . . . , En

sono a due incompatibili, allora la probabilità della loro unione è pari alla

somma delle loro singole probabilità:

30

31

P(E1 ∪ E2 ∪ . . . ∪ En ) = P(E1 ) + P(E2) + . . . + P(En ).

(3.5)

3.3 Probabilità condizionata

In molte situazioni, ci si trova a determinare la probabilità di un evento avendo

informazioni sul verificarsi di un altro ad esso collegato. Evidentemente, l’accesso a tali informazioni condiziona il calcolo, e per questo si introduce una nuova

nozione di probabilità, detta per l’appunto probabilità condizionata.

Definizione 3.5 (Probabilità condizionata). Dati due eventi E e F compatibili, si dice probabilità di E condizionata dal verificarsi di F, e si scrive

P(E|F), la probabilità che E avvenga nell’ipotesi che accada F.

Per meglio comprendere il significato pratico della definizione, studiamo il seguente esempio concreto.

Esempio 3.6. Supponiamo di aver estratto a caso una pallina da un sacchetto

che ne conteneva quindici, numerate progressivamente, ma di non poterla

guardare e quindi di non sapere quale delle quindici essa sia. Consideriamo

i due eventi

- E1 : “è stato estratto un numero minore di sei”,

- E2 : “è stato estratto un numero maggiore di dieci”.

I casi favorevoli ad E1 sono cinque e altrettanti sono quelli favorevoli ad E2 ,

perciò P(E1 ) = P(E2 ) = 13 . Supponiamo ora che qualcuno in grado di vedere

la pallina ci riveli che essa è contrasseU

gnata da un numero primo, ossia che è

8

9

avvenuto l’evento aleatorio F descritto da

10

E

- F: “il numero estratto è primo”.

6

1

2

4

12

5 3

14 11

15 13 7

1

Conoscendo questo dettaglio, le probabilità di E1 ed E2 cambiano, perché i ca- E2

F

si possibili sono ora soltanto i sei numeri

primi minori o uguali a quindici, mentre

E2 ∩ F

2

gli altri nove, in quanto composti, devono

3 5

essere scartati. Come si vede nella figura,

11

E1 ∩ F

13 7

i casi favorevoli ad E1 si restringono così

F

ai soli tre numeri primi fra uno e cinque,

e quelli favorevoli ad E2 ai due numeri primi fra undici e quindici. Le nuove

probabilità condizionate dal verificarsi di F sono allora P(E1 |F) = 63 = 12 6=

P(E1 ) e P(E2 |F) = 62 = 13 = P(E2 ). Il fatto che P(E1 |F) 6= P(E1 ) mentre

P(E2 |F) = P(E2 ) indica che la condizione F influenza il verificarsi di E1

mentre non influenza affatto il verificarsi di E2 .

32

Seguendo la linea di ragionamento adottata nell’esempio, si può generalizzare il

discorso e riscrivere la probabilità condizionata nei termini di quella ordinaria.

Consideriamo due eventi E ed F compatibili e indichiamo con fE e fF i numeri dei casi ad essi favorevoli. Denotando come al solito con u il numero dei

casi possibili, le probabilità di E ed F sono date da P(E) = fuE , P(F) = fuF . Se

ipotizziamo che E debba avvenire sotto la condizione F, allora i casi possibili da

u si riducono a fF e fra i casi favorevoli ad E vanno selezionati solo quelli favorevoli anche ad F, quindi da fE si passa a fE∩F , cioè ai casi favorevoli all’evento

intersezione E ∩ F. In pratica, come si vede nella figura della pagina precedente,

nel calcolo della probabilità condizionata l’evento F funge da spazio dei risultati

e, di conseguenza, E è sostituito da E ∩ F. La probabilità condizionata è allora

def.

P(E|F) =

fE∩F

fE∩F u

=

· =

fF

u

fF

fE ∩ F

u

fF

u

=

P(E ∩ F)

.

P(F)

(3.6)

Come emerge chiaramente anche dall’esempio 1.6, la probabilità condizionata di

un evento E rispetto al verificarsi di un evento F può coincidere oppure no con

la probabilità non condizionata di E. In merito a tale distinzione, si usa dare la

seguente definizione.

Definizione 3.7 (Eventi indipendenti ed eventi dipendenti). Due eventi E

ed F fra loro compatibili si dicono stocasticamente indipendenti se si ha

P(E|F) = P(E) e in quel caso si scrive E ⊥ F.

Se invece P(E|F) 6= P(E), gli eventi E ed F si dicono stocasticamente dipendenti: si parla di dipendenza positiva se P(E|F) > P(E), cioè

se F rende più probabile il verificarsi di E, mentre si parla di dipendenza

negativa se P(E|F) < P(E), cioè se F rende E meno probabile.

Gli eventi E1 ed F dell’esempio 1.6 sono dunque positivamente dipendenti, mentre E2 ed F sono stocasticamente indipendenti.

Va sottolineato che dipendenza e indipendenza, come appena definiti, sono

attributi di una coppia di eventi, e non di uno particolare dei due rispetto all’altro. Per essere sicuri che la definizione 1.8 abbia davvero senso, occorre quindi

accertarsi che non possa mai succedere che E sia indipendente da F e però F sia

dipendente da E. Controlliamo che se E è indipendente da F, F sia indipendente

da E e che se E è dipendente da F, F sia dipendente da E: usando (3.6), si vede

che in effetti

E ⊥ F ⇐⇒ P(E|F) = P(E) ⇐⇒

⇐⇒

P(E ∩ F)

P(E ∩ F)

= P(E) ⇐⇒

=1

P(F)

P(E) · P(F)

P(F ∩ E)

= P(F) ⇐⇒ P(F|E) = P(F) ⇐⇒ F ⊥ E.

P(E)

33

Con argomenti simili, si può provare anche che, come suggerisce il buon senso,

se un evento è indipendente da un altro, lo è anche dalla sua negazione. Più

esplicitamente, se E ⊥ F, allora E ⊥ (¬ F), (¬ E) ⊥ F e (¬ E) ⊥ (¬ F).

Nota 3.8 (Dipendenza e compatibilità). Due eventi incompatibili si escludono a vicenda, quindi esercitano uno sull’altro un impedimento assoluto.

In altre parole, due eventi incompatibili sono fra loro totalmente dipendenti in senso negativo. Incompatibilità e indipendenza non vanno quindi

confuse, essendo in tal senso una opposta all’altra.

3.4 Probabilità della congiunzione di eventi

Dati due eventi aleatori E ed F, ci si può chiedere quanto valga la probabilità di

E ∧ F, cioè dell’evento “ E ed F ”. In altre parole, ci si può porre il problema di

come si comporti la probabilità rispetto alla congiunzione logica di eventi. La

riposta segue immediatamente da (3.6), da cui si deduce che in generale P(E ∩

F) = P(E|F) · P(F). Nel caso in cui E ed F siano stocasticamente indipendenti,

si ha P(E|F) = P(F) e P(E ∩ F) = P(E) · P(F), cioè la probabilità dell’evento

intersezione è pari al prodotto delle singole probabilità.

Teorema 3.9 (Teorema della probabilità composta). Dati due eventi

aleatori E ed F, la probabilità di E ∩ F, cioè che E ed F si verifichino

contemporaneamente, è data dalla formula

(3.7a)

P(E ∩ F) = P(F) · P(E|F) .

In particolare, se E ed F sono indipendenti, allora si ha

(3.7b)

P(E ∩ F) = P(E) · P(F) .

Questo risultato può essere generalizzato a più di due eventi che devono accadere

uno dopo l’altro, considerando sempre quello precedente come verificato. Nel

caso di tre eventi, si trova la formula

P(E1 ∩ E2 ∩ E3 ) = P(E1 ) · P(E2 |E1 ) · P(E3| E1 ∩ E2 ) ,

(3.8a)

È chiaro adesso come passare a quattro eventi, cinque eventi e così via.

34

- E1 : “la prima carta è di bastoni”,

- E2 : “la seconda carta è di bastoni”.

Prendendo la seconda solo dopo aver reinserito la prima e rimescolando, le

estrazioni avvengono nelle medesime condizioni e la prima pescata non può

in alcun modo influenzare la seconda. Ne segue che in questo caso E1 ed

E2 sono indipendenti, perciò la probabilità che entrambe le carte siano di

bastoni è pari a

10 10

1

P(E1 ∩ E2 ) = P(E1 ) · P(E2 ) =

·

=

.

40 40 16

Se invece estraiamo la seconda carta senza reinserire la prima, le due pescate

non avvengono nelle stesse condizioni e la prima di esse influenza la seconda. Ne segue che in questo caso E1 ed E2 sono dipendenti. Infatti pescare

una carta di bastoni quando un’altra dello stesso seme è già stata estratta non

è più, come avveniva nel caso precedente, P(E2 |E1 ) = 10

40 = P(E2 ), ma bensì

9

P(E2 |E1 ) = 39

6= P(E2 ). Questa volta la probabilità che entrambe le carte

siano di bastoni è allora

10 9

3

P(E1 ∩ E2 ) = P(E1 ) · P(E2 |E1 ) =

·

=

.

40 39 52

Si noti che con la reintroduzione, non a caso, il risultato si può esprimere in

termini di disposizioni con ripetizione:

R

D10,2

fE∩F

102

1

P(E1 ∩ E2 ) =

= R = 2=

.

u

D40,2 40

16

Analogamente, senza reintroduzione, il risultato si può esprimere in termini

di disposizioni semplici:

D10,2

10 · 9

3

fE∩F

=

=

=

.

P(E1 ∩ E2 ) =

u

D40,2 40 · 39 52

Il teorema della probabilità composta restituisce una formula semplice anche per

la probabilità dell’unione di eventi indipendenti. Infatti da (3.2a) si ottiene

P(E ∪ F) = P(E) + P(F) − P(E) · P(F).

che per eventi a due a due indipendenti si semplifica in

P(E1 ∩ E2 ∩ E3 ) = P(E1 ) · P(E2 ) · P(E3) .

Esempio 3.10. Supponiamo di pescare da un mazzo di carte piacentine due

di esse una dopo l’altra e fissiamo l’attenzione sui due eventi

(3.8b)

(3.9)

3.5 Teorema di Bayes

I risultati fin qui ottenuti possono essere combinati al fine di studiare la vasta gamma di situazioni pratiche in cui un dato evento può accadere sotto una molteplicità

35

di condizioni possibili che si escludono fra di loro. Cominciamo con un esempio

concreto per fissare meglio le idee.

Esempio 3.11. In un centralino ci sono due linee: la prima risponde a caso al

40% delle chiamate e la seconda al restante 60%. La prima linea è occupata

il 20% delle volte, mentre la seconda lo è nel 10% dei casi. Chiamando

quel centralino, qual è la probabilità di trovare la linea libera e parlare con

un operatore? Prima di tutto diamo qualche nome agli eventi che entrano in

gioco nel problema:

- E: “la linea è libera”,

- F1 : “viene usata la prima linea”,

- F2 : “viene usata la seconda linea”.

Gli eventi incompatibili F1 ed F2 rappresentano le due condizioni possibili

sotto cui l’evento E può verificarsi o non verificarsi: l’operatore può risultare

libero o occupato sulla prima o sulla seE

F1

F2

conda linea. Di conseguenza, come appare evidente nella figura, l’evento “la linea

è libera” può essere visto come l’unione

dei due eventi “viene usata la prima linea ed è libera” e “viene usata la seconda

linea ed è libera”. In formule,

E = (E ∩ F1) ∪ (E ∩ F2 ) .

Dal momento che gli eventi E ∩ F1 e

E ∩ F2 sono incompatibili, perché non si

usano contemporaneamente entrambe le

linee, la probabilità di E è la somma delle

loro singole probabilità:

P(E) = P(E ∩ F1 ) + P(E ∩ F2 ).

U

E ∩ F1

4

10

E ∩ F2

8

10

E

2

10

¬E

F1

Applicando il teorema della probabilità composta ai due eventi intersezione,

P(E) = P(F1 ) · P(E|F1) + P(F2) · P(E|F2)

4 8

6 9

86

=

· + ·

=

,

10 10 10 10 100

quindi la probabilità di trovare un operatore libero è del 86% contro una del

14% di trovare la linea occupata.

Esempio 3.11 (Problema inverso). Nell’impossibilità di sapere su quale

linea stia effettivamente parlando, un utente che trovi l’operatore libero potrebbe porsi il problema inverso chiedendosi “Che probabilità c’è che io stia

usando la prima linea?”. Questa volta, il fatto che l’operatore è disponibile è noto, quindi l’utente non sta cercando la probabilità che chiamando ci

si connetta alla prima linea, ma la probabilità che ciò accada condizionata

dal fatto che la linea è libera. In formule, la quantità da determinare non è

dunque P(F1 ), ma bensì P(F1|E).

Applicando il teorema della probabilità composta e tenendo a mente il

risultato già ottenuto per P(E), si trova

P(F1 ) · P(E|F1)

P(F1 ∩ E) P(E ∩ F1 )

=

=

P(E)

P(E)

P(F1 ) · P(E|F1) + P(F2) · P(E|F2)

4 8

32

·

16

= 4 810 106 9 = 100

=

,

86

43

10 · 10 + 10 · 10

100

P(F1|E) =

16

≈ 37% che, avendo trovato la linea libera,

quindi c’è una probabilità di 43

questa sia la prima e ovviamente c’è una probabilità di 27

43 ≈ 63% che, avendo

trovato la linea libera, questa sia la seconda.

9

La probabilità di connettersi alla prima

E

10

6

10

linea è P(F1 ) = 40%, mentre quella di

F2

connettersi alla seconda è P(F2 ) = 60%.

1

¬E

10

Ipotizzando di connettersi alla prima, la

probabilità di trovarla libera è P(E|F1 ) = 80%: stiamo cioè parlando della

probabilità di trovare l’operatore libero condizionata dall’usare la prima linea. Analogamente, ipotizzando di connettersi alla seconda, la probabilità

di trovarla libera è P(E|F2) = 90%: stiamo cioè parlando della probabilità di

trovare l’operatore libero condizionata dall’usare la seconda linea.

Per estendere il ragionamento seguito a più di due condizioni, basta pensare ad

un centralino con più di due linee. Questo, in generale, corrisponde a considerare

un evento E che può verificarsi sotto n condizioni alternative F1 , F2 , . . . , Fn . Tali

condizioni, nel complesso, costituiscono una partizione dello spazio dei risultati

U, cioè una collezione di eventi aleatori a due a due incompatibili che esauriscono

tutti i casi possibili:

36

37

Fi ∩ Fj = 0/

∀ i, j = 1, . . . , n,

i 6= j ;

(3.10a)

(3.10b)

F1 ∪ F2 ∪ . . . ∪ Fn = U.

Come abbiamo osservato nell’esempio, l’evento E si può quindi vedere come

unione delle sue intersezioni con ciascuna condizione:

E = (E ∩ F1 ) ∪ (E ∩ F2) ∪ . . . ∪ (E ∩ Fn ).

(3.11)

Tali intersezioni, essendo F1 , F2 , . . . , Fn incompatibili, lo sono a loro volta, quindi

la probabilità di E è la somma delle loro singole probabilità:

P(E) = P(E ∩ F1) + P(E ∩ F2 ) + . . . + P(E ∩ Fn ).

(3.12)

Applicando ora il teorema della probabilità composta ad ogni evento intersezione,

otteniamo un teorema che spiega come calcolare la probabilità di un evento che

può avvenire sotto un certo numero di condizioni alternative, sapendo la probabilità di ognuna di esse e la probabilità dell’evento stesso supponendo verificata

ciascuna delle condizioni.

Teorema 3.12. Dato un evento E e un insieme di condizioni alternative

F1 , F2 , . . . , Fn sotto le quali E si può verificare, vale la regola

P(E) = P(F1 ) · P(E|F1) + . . . + P(Fn) · P(E|Fn) .

P(Fi ∩ E) P(E ∩ Fi ) P(Fi ) · P(E|Fi)

=

=

.

P(E)

P(E)

P(E)

(3.14)

Applicando poi al denominatore dell’ultimo termine il teorema 1.12, si arriva ad

un risultato di grande rilievo dovuto a Thomas Bayes.

Teorema di Bayes 3.13. Dato un evento E e un insieme di condizioni alternative F1 , F2 , . . . , Fn sotto le quali E può avvenire, la probabilità che, essendosi verificato E, questo sia accaduto sotto la condizione Fi è data per ogni

i = 1, . . . , n dalla formula

P(Fi |E) =

P(Fi ) · P(E|Fi)

.

P(F1 ) · P(E|F1) + . . . + P(Fn) · P(E|Fn)

38

3.1. Una busta contiene delle figurine numerate progressivamente da uno a

ventotto. Calcola la probabilità di estrarre a caso una figurina contrassegnata

da un numero dispari o multiplo di quattro.

3

4

3.2. Un cassetto contiene diciotto calzini blu, sei neri e quattro rossi. Qual è

la probabilità che, estraendone uno a caso, esso sia blu o rosso?

11 14

3.3. Calcola la probabilità che, lanciando un dado, si verifichi almeno uno

dei due eventi “esce un numero dispari” e “esce un numero minore di quattro”.

2

3

(3.13)

Anche il ragionamento seguito nella soluzione al problema inverso proposto nella

seconda parte dell’esempio può essere facilmente generalizzato. Usando il teorema della probabilità composta, si trova immediatamente la probabilità che, dato il

verificarsi dell’evento E, a determinarlo sia stata la condizione Fi :

P(Fi |E) =

Problemi

(3.15)

3.4. Una scatola contiene cinquantaquattro fra cioccolatini, caramelle e torroncini. Sapendo che i cioccolatini sono il doppio dei torroncini e le caramelle sono una volta e mezza i torroncini, calcola la probabilità di prendere

a caso un cioccolatino o una caramella.

7

9

3.5. Un’urna contiene trenta palline numerate. Calcola la probabilità che,

estraendo a caso una pallina,

- essa rechi un numero dispari,

- essa rechi un numero minore di dieci,

- essa rechi un numero dispari o minore di dieci.

1

3 19

2 , 10 , 30

3.6. Si estrae a sorte una carta da un mazzo di quaranta carte da briscola.

Calcolare la probabilità che la carta

- sia un re o un sette,

- un re o una carta di denari,

- un asso o una carta di coppe o una figura.

39

1

13 11

5 , 40 , 20

3.7. Qual è la probabilità che lanciando un dado esca un numero maggiore

di tre, sapendo che è uscito un numero pari?

2

3

3.8. Un’urna contiene ventidue palline numerate. Calcola la probabilità che,

estraendone una, essa rechi un numero multiplo di tre, sapendo che è uscito

un numero dispari.

4

11