Università degli Studi di Bari “Aldo Moro”

Facoltà di Scienze Matematiche, Fisiche e Naturali

Corso di laurea in Fisica

Soluzioni numeriche dell’equazione di

Schrödinger

Davide Nuzzi

Relatori:

Dott. Francesco Vincenzo Pepe

Chiar.mo Prof. Paolo Facchi

Anno Accademico 2014-2015

It always bothers me that, according to the laws as we understand them today, it

takes a computing machine an infinite number of logical operations to figure out

what goes on in no matter how tiny a region of space, and no matter how tiny a

region of time. How can all that be going on in that tiny space? Why should it take

an infinite amount of logic to figure out what one tiny piece of space/time is going

to do? So I have often made the hypotheses that ultimately physics will not require a

mathematical statement, that in the end the machinery will be revealed, and the laws

will turn out to be simple, like the chequer board with all its apparent complexities.

- Richard Feynman, The Character of Physical Law

Indice

Introduzione

1

1 Evoluzione temporale e stati stazionari

2

1.1

L’equazione di Schrödinger . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2

1.2

Propagatore dell’equazione di Schrödinger . . . . . . . . . . . . . . . . . . . . . .

3

1.3

Rotazione di Wick . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5

1.4

Evoluzione nel tempo immaginario verso lo stato fondamentale . . . . . . . . . .

6

1.5

Formula di Feynman-Kac . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8

1.6

Soluzioni numeriche . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

9

2 Metodo di splitting degli operatori

10

2.1

Formula di Baker-Campbell-Hausdorff . . . . . . . . . . . . . . . . . . . . . . . .

10

2.2

Applicazione del metodo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

11

2.3

Analisi della velocità di convergenza . . . . . . . . . . . . . . . . . . . . . . . . .

12

2.4

Implementazione al calcolatore . . . . . . . . . . . . . . . . . . . . . . . . . . . .

13

3 Metodo di Shooting

16

3.1

Metodo di Numerov . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

16

3.2

Scelta delle condizioni iniziali . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

18

3.3

Metodo di Shooting . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

19

4 Diffusione Montecarlo

22

4.1

Integrale sui cammini di Feynman . . . . . . . . . . . . . . . . . . . . . . . . . .

22

4.2

Interpretazione dell’integrale sui cammini . . . . . . . . . . . . . . . . . . . . . .

23

4.3

Valutazione del propagatore con metodo Montecarlo . . . . . . . . . . . . . . . .

26

ii

Indice

4.4

Walkers e processo di branching . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5 Applicazioni

5.1

5.2

5.3

28

33

Buca di potenziale infinita . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

33

5.1.1

Soluzione analitica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

34

5.1.2

Soluzione numerica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

35

Oscillatore armonico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

36

5.2.1

Soluzione analitica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

37

5.2.2

Soluzione numerica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

39

Oscillatore quartico . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

40

5.3.1

Soluzione con metodo variazionale . . . . . . . . . . . . . . . . . . . . . .

40

5.3.2

Soluzione numerica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

42

Conclusioni

i

Appendice A: Integrali Gaussiani

ii

Appendice B: Propagatore per una particella libera

iii

Bibliografia

iv

iii

Introduzione

Nel 1926 Erwin Schrödinger giunse alla risoluzione di un problema molto importante all’epoca,

la determinazione dello spettro energetico dell’atomo d’idrogeno, con un metodo molto diverso

da quelli impiegati dai suoi predecessori.

Per la prima volta la quantizzazione dell’energia derivava non da un postulato, come nel modello

atomico di Bohr-Sommerfeld, ma scaturiva naturalmente dalla risoluzione di un’equazione, quella

che poi verrà chiamata equazione di Schrödinger indipendente dal tempo, che aveva la stessa

forma di un’equazione agli autovalori.

In [1] Schrödinger scrive ≪[...] the notion of “whole numbers ”, merely as such, is not introduced

[...] (the quantization) arises in the same natural way as it does in the case of the node-numbers

of a vibrating string≫. L’analogia con le onde stazionarie su una corda è più che appropriata, in

quanto l’equazione di Schrödinger rappresenta il primo tentativo riuscito di ricavare un’equazione

per le onde di materia, teorizzate da L. de Broglie nel 1924.

L’equazione di Schrödinger rappresenta ancora oggi uno degli strumenti più utilizzati per la risoluzione di problemi quantistici in regime non relativistico e ha applicazioni pratiche nello studio

della struttura della materia, in chimica e in spettroscopia.

Non tutti i problemi possono però essere risolti in maniera esatta ed è indispensabile sviluppare

tecniche di risoluzione numerica accurate ed efficienti. Lo scopo di questa tesi è analizzare alcune

di queste tecniche dal punto di vista teorico e mostrare i risultati della loro applicazione.

Nello specifico, nel Capitolo 1 verrà mostrato come il problema della determinazione dello stato

fondamentale può essere ricondotto a un problema di evoluzione temporale lungo il tempo immaginario. Saranno poi sviluppati due metodi di risoluzione numerica, lo splitting degli operatori

e la diffusione Montecarlo, rispettivamente nei capitoli 2 e 4, che utilizzano questo approccio

per approssimare lo stato fondamentale. Nel Capitolo 3 verrà invece introdotto un metodo di

integrazione numerica dell’equazione di Schrödinger detto metodo di Numerov, affiancato dall’algoritmo di shooting per la ricerca degli autovalori, che permette di determinare in maniera

accurata lo stato fondamentale e i primi livelli eccitati. Nel Capitolo 5 queste tecniche verranno

utilizzate per risolvere l’equazione di Schrödinger per tre tipi di potenziali: la buca di potenziale

infinita, l’oscillatore armonico e l’oscillatore quartico. Per i primi due verrà ricavata la soluzione

analitica mentre per il terzo si utilizzerà un’approssimazione variazionale. Si confronteranno

infine i risultati esatti con quelli ottenuti dalle simulazioni numeriche.

1

Capitolo 1

Evoluzione temporale e stati

stazionari

1.1

L’equazione di Schrödinger

In meccanica quantistica un sistema fisico è descritto da un vettore |ψi all’interno di un parti-

colare spazio di Hilbert H. La dimensione e la natura di tale spazio sono determinate una volta

che si siano scelte le osservabili d’interesse per il problema. All’interno di questo lavoro ci si

limiterà allo studio di sistemi costituiti da una singola particella in moto unidimensionale, in

assenza di spin. Gli spazi di Hilbert considerati saranno quindi L2 (Ω) con Ω ⊂ R.

L’evoluzione del sistema è totalmente determinata una volta assegnati l’operatore Hamiltoniano

Ĥ e lo stato iniziale |ψ(t = 0)i ed è governata dall’equazione di Schrödinger:

i~

d |ψ(t)i

= Ĥ |ψ(t)i .

dt

(1.1.1)

Essa è quindi deterministica, a esclusione del caso in cui si effettui la misura di una grandezza

fisica e, in accordo con il postulato del collasso della funzione d’onda, lo stato del sistema subisce una variazione discontinua e di natura probabilistica. Per la precisione, considerata una

grandezza fisica A a cui è associato un operatore hermitiano Â, e detto a un autovalore di tale

operatore, allora se una misura della grandezza nello stato |ψi restituisce come risultato a lo

stato del sistema viene istantaneamente proiettato nell’autospazio relativo ad a.

All’interno di questo lavoro verrà analizzata la sola evoluzione determinata dall’equazione di

Schrödinger, escludendo quindi il processo di misura.

È importante osservare che se lo stato iniziale del sistema coincide con un autostato di un’osservabile, non è detto che rimanga autostato della stessa durante l’evoluzione.

Un’importante eccezione a ciò è data dagli autostati dell’operatore Ĥ, gli stati stazionari, che

sono anche autostati di ogni operatore  tale che [Â, Ĥ] = 0. Essi sono soluzioni dell’equazione

agli autovalori per l’Hamiltoniano

Ĥ |ψn i = En |ψn i ,

2

(1.1.2)

Capitolo 1: Evoluzione temporale e stati stazionari

detta equazione di Schrödinger indipendente dal tempo.

Come è facile osservare utilizzando la (1.1.2) all’interno della (1.1.1) e risolvendo, l’evoluzione

temporale per questi stati è data da

iEn (t − t0 )

|ψn (t)i = exp −

~

|ψn (t0 )i .

(1.1.3)

Essi variano quindi soltanto per un fattore di fase e, poiché in meccanica quantistica vettori che

differiscono solo per un fattore di fase vengono identificati tra loro, si può affermare che gli stati

stazionari rimangono inalterati durante l’evoluzione del sistema.

Questa proprietà è essenziale al fine di applicare le tecniche di risoluzione che verranno illustrate

nei capitoli successivi.

La risoluzione dell’equazione (1.1.2), in particolare la determinazione dello spettro energetico, è

essenziale nella quasi totalità dei casi in cui bisogna indagare il comportamento di un sistema

quantistico. Si vede inoltre che la determinazione dello spettro energetico e dei relativi autostati

permette anche di ricavare l’evoluzione temporale di uno stato arbitrario sistema e quindi rende

possibile lo studio di processi dinamici.

Come già detto, all’interno di questa tesi si considereranno solo sistemi costituiti da una singola

particella senza spin, libera di muoversi in una direzione spaziale sotto l’azione di un potenziale

V (x). In tal caso l’operatore di Hamilton si ottiene sostituendo nell’espressione classica H =

T + V gli operatori corrispondenti all’energia cinetica e all’energia potenziale.

Scegliendo di lavorare nel contesto dello spazio di Hilbert H = L2 (R), i cui vettori sono dati

da ψ(x) = hx|ψi, le cosiddette funzioni d’onda, è possibile riscrivere l’equazione agli autovalori

come:

Ĥ ψn (x) = En ψn (x),

(1.1.4)

dove in questo caso H è l’operatore Hamiltoniano espresso nella rappresentazione della posizione.

d

e si può riscrivere la (1.1.2) come:

In questa base l’impulso ha forma P = −i~ dx

~2 d2

−

+

V

(x)

ψn (x) = En ψn (x),

2m dx2

(1.1.5)

che è l’equazione di Schrödinger unidimensionale per il moto di una particella di massa m.

Nel resto della trattazione ci si riferirà con il nome di l’equazione di Schrödinger sia al caso

dipendente dal tempo che a quello indipendente, non facendo distinzione neppure tra le equazioni

nello spazio H e quelle nello spazio delle funzioni d’onda. Sarà possibile dedurre il caso a cui si

fa riferimento dal contesto e dalla notazione utilizzata.

1.2

Propagatore dell’equazione di Schrödinger

Si consideri un sistema descritto all’istante iniziale da un ket |ψ(t0 )i che evolve in accordo con

l’equazione di Schrödinger. Al tempo t lo stato sarà |ψ(t)i e questa transizione deve poter essere

3

Capitolo 1: Evoluzione temporale e stati stazionari

rappresentata tramite l’azione di un operatore unitario K̂, detto propagatore:

|ψ(t)i = K̂(t, t0 ) |ψ(t0 )i .

(1.2.1)

Si vede che questo operatore deve essere necessariamente unitario in modo da conservare la

p

norma kψk = hψ|ψi. E’ importante che la norma del vettore di stato sia pari all’unità e che

lo rimanga ad ogni istante di tempo in quanto ciò equivale, nella rappresentazione delle funzioni

d’onda, a richiedere che la probabilità di trovare il sistema in un punto qualsiasi dello spazio sia

pari ad uno.

Sostituendo la (1.2.1) all’interno dell’equazione di Schrödinger (1.1.1) si ha quindi un’equazione

per il propagatore stesso:

dK̂(t, t0 )

= Ĥ K̂(t, t0 ).

(1.2.2)

dt

Se l’Hamiltoniana non ha una dipendenza esplicita dal tempo, l’equazione può essere integrata

i~

formalmente portando all’espressione per l’operatore di evoluzione temporale:

!

iĤ(t − t0 )

.

K̂(t, t0 ) = exp −

~

(1.2.3)

Il ket evolve quindi nel modo seguente:

iĤ(t − t0 )

|ψ(t)i = exp −

~

!

|ψ(t0 )i .

(1.2.4)

Una proprietà semplice ma importante che il propagatore deve soddisfare è che K̂(t0 , t0 ) = I,

dove con I si indica l’operatore identità. Ciò viene imposto banalmente dalla sua definizione.

D’ora in avanti si assumerà spesso t0 = 0 (senza perdita di generalità se Ĥ non dipende dal

tempo) e si scriverà K̂(t, t0 ) = K̂(t).

Si può mostrare ora il legame tra l’evoluzione temporale e gli stati stazionari menzionata nella

sezione precedente. Assumendo per semplicità che Ĥ sia dotato solo di spettro discreto con

autovalori En , in modo che gli autostati |φn i formino un sistema ortonormale completo, se si

sviluppa lo stato iniziale rispetto alla base dell’energia, si ha:

|ψ(0)i =

∞

X

n=0

hφn |ψ(0)i |φn i =

∞

X

n=0

cn |φn i .

Sostituendo questa espressione nella (1.2.4), si arriva all’espressione

!

∞

∞

X

X

iĤt

iEn t

|ψ(t)i =

cn exp −

|φn i =

cn exp −

|φn i ,

~

~

n=0

n=0

(1.2.5)

(1.2.6)

dove nell’ultimo passaggio si è sfruttato il fatto che l’operatore Ĥ è diagonale nella rappresentazione dell’energia.

Questa relazione evidenzia che, una volta risolta l’equazione di Schrödinger indipendente dal

tempo, se è noto come lo stato iniziale del sistema possa essere scomposto rispetto agli stati stazionari (cioè se sono noti i coefficienti cn ) allora l’evoluzione temporale è completamente

4

Capitolo 1: Evoluzione temporale e stati stazionari

determinata. Si vedrà come a partire da questa espressione sia possibile risolvere in maniera

semplice, dal punto di vista teorico, il problema della determinazione dello stato fondamentale.

È istruttivo soffermarsi ulteriormente sul propagatore e su come esso possa essere interpretato

nel contesto dello spazio delle funzioni d’onda.

A partire dall’espressione (1.2.1), passando alla rappresentazione delle coordinate

Z

ψ(x, t) =

dx0 K(x, t; x0 , t0 )ψ(x0 , t0 )

(1.2.7)

R

si vede che la funzione d’onda al tempo t può essere ottenuta come convoluzione del propagatore

(nella rappresentazione della posizione) con la funzione d’onda all’istante iniziale. Il propagatore

ha un legame molto stretto con le funzioni di Green, strumento molto utilizzato nella risoluzione

di equazioni differenziali lineari.

Il significato della (1.2.7) può essere ulteriormente chiarito esplicitando l’espressione per il

propagatore:

K̂(x, t; x0 , t0 ) = hx|K̂(t, t0 )|x0 i .

(1.2.8)

Questa formula si può interpretare come evoluzione temporale del |x0 i, dal tempo t0 al tempo t,

seguita dalla proiezione su |xi. Si sta facendo quindi evolvere lo stato di una particella localizzata

con certezza in x0 all’istante t0 e ci si sta chiedendo quale sia la probabilità di trovarla nella

posizione x all’istante t. Per la precisione la probabilità cercata è il modulo quadro dell’elemento

di matrice appena scritto.

Si può osservare come ponendo t = t0 si abbia

K(x, t0 ; x0 , t0 ) = hx|x0 i = δ(x − x0 ).

(1.2.9)

in accordo con l’interpretazione appena suggerita.

1.3

Rotazione di Wick

Si assume ora che Ĥ sia un operatore positivo, cioè tale che hψ|Ĥ|ψi ≥ 0, ∀ |ψi ∈ H. Da ciò

consegue che ogni autovalore En nello spettro è non negativo.

Sotto queste ipotesi si vede facilmente che se all’interno dell’espressione (1.2.6) si effettua la

sostituzione

t

→

−iτ

(1.3.1)

l’evoluzione temporale della funzione d’onda assume un carattere totalmente diverso. Si passa

da una sovrapposizione di autostati modulati con fattori periodici nel tempo a una sovrapposizione di autostati i cui coefficienti decadono tutti esponenzialmente rispetto alla nuova variabile

temporale:

|ψ(τ )i =

∞

X

En τ

cn exp −

|φn i

~

n=0

(1.3.2)

Le conseguenze di questa sostituzione verranno analizzate nella prossima sezione mentre adesso

ci si concentrerà sull’approfondirne il significato matematico.

5

Capitolo 1: Evoluzione temporale e stati stazionari

La (1.3.1) è detta rotazione di Wick in quanto, essendo τ ∈ R, è possibile interpretarla come

una rotazione del propagatore nel piano complesso in senso orario di un angolo pari a

π

2.

Per

la precisione si sta effettuando il prolungamento analitico dell’operatore di evoluzione temporale

all’asse immaginario nel piano complesso.

La rotazione di Wick è in realtà un risultato più generale utilizzato per passare da una metrica

a segnatura (+, +, +, −) come quella dello spaziotempo di Minkowski alla metrica euclidea con

segnatura (+, +, +, +), in quanto implica (dt)2 = −(dτ )2 .

E’ utile, al fine dell’analisi che verrà effettuata nel Capitolo 4, osservare che la rotazione di Wick

modifica sostanzialmente la natura dell’equazione di Schrödinger (1.1.1). Nella rappresentazione

della posizione si ha

∂ψ(x, τ )

~ ∂ 2 ψ(x, τ ) V (x)

−

=

ψ(x, τ ).

∂τ

2m ∂x2

~

(1.3.3)

Nel caso di una particella libera (V (x) = 0) l’equazione di Schrödinger coincide con l’equazione

del calore, detta anche equazione di diffusione, con D = ~/2m come coefficiente di diffusione.

1.4

Evoluzione nel tempo immaginario verso lo stato fondamentale

Il livello energetico con energia minore, indicato con E0 , è detto stato fondamentale (si è ancora

nell’ipotesi di Ĥ positivo e quindi E0 > 0). Supponiamo che lo stato fondamentale E0 sia

non degenere e indichiamo con E1 , E2 , ... gli altri livelli energetici, detti stati eccitati. Di certo

En > E0 , ∀n > 0. Ordinando lo spettro per energie crescenti si può scrivere quindi

E0 < E1 ≤ ... ≤ En ≤ ...

Scrivendo in forma estesa la sommatoria all’interno della (1.3.2):

E1 τ

E0 τ

|φ0 i + c1 exp −

|φ1 i + ...

|ψ(τ )i = c0 exp −

~

~

(1.4.1)

(1.4.2)

appare evidente come lo stato converga al vettore nullo: |ψ(τ )i → 0 per τ → ∞. La rotazione

di Wick fa sı̀ che il propagatore perda la proprietà di unitarietà, in quanto kψk → 0. Sebbene

tutti gli stati stazionari nella sommatoria decadano esponenzialmente nel tempo, la relazione tra

i valori delle energie fa sı̀ che i termini corrispondenti ai livelli eccitati tendano ad annullarsi più

velocemente di quanto faccia la proiezione sullo stato fondamentale.

Ciò suggerisce che si possa fare in modo che lo stato del sistema evolva verso lo stato fondamentale, eliminando progressivamente gli stati eccitati dal suo sviluppo. Questo passaggio può

essere effettuato normalizzando la funzione d’onda al tempo τ e valutando in questo caso il limite

τ → ∞:

∞

X

2En τ

,

kψ(τ )k = hψ(τ )|ψ(τ )i =

|cn | exp −

~

n=0

2

6

2

(1.4.3)

Capitolo 1: Evoluzione temporale e stati stazionari

En τ

cn exp −

|φn i

|ψ(τ )i

~

n=0

s

=

kψ(τ )k

∞

P

2En τ

2

|cn | exp −

~

n=0

∞

P

τ →∞

−−−−→

|φ0 i .

(1.4.4)

Si è quindi arrivati ad un risultato essenziale. Un qualunque stato che non sia ortogonale allo

stato fondamentale tende ad evolvere nel tempo immaginario proprio verso lo stato fondamentale

se normalizzato come nella (1.4.4).

Come appena sottolineato, è importante che hψ(0)|φ0 i =

6 0 in quanto in caso contrario si avrebbe

c0 = 0 e il primo termine dello sviluppo in stati stazionari verrebbe a mancare. In questo caso

la |ψi convergerebbe allo stato relativo al primo livello eccitato, come si vede facilmente dalla

(1.4.4).

Dal punto di vista puramente teorico, la procedura descritta risolve completamente il problema

di identificazione dello spettro energetico e più in generale della risoluzione dell’equazione di

Schrödinger. Infatti a partire dallo stato fondamentale è possibile ottenere facilmente l’energia

ad esso relativa, che coincide con il valore di aspettazione dell’Hamiltoniano in tale stato:

E0 = hφ0 |Ĥ|φ0 i .

(1.4.5)

La determinazione dei livelli eccitati, in assenza di degenerazione, può essere effettuata con la

medesima procedura, considerando ogni livello eccitato come lo stato fondamentale di un nuovo

Hamiltoniano, ottenuto proiettando via dallo spazio di Hilbert lo stato fondamentale del vecchio.

Formalmente, se si sfrutta la relazione di completezza per scrivere l’operatore Ĥ nella cosiddetta

rappresentazione spettrale

Ĥ =

∞

X

n=0

En |φn i hφn |

(1.4.6)

si può immaginare di separarlo in un termine che dipende dal solo stato fondamentale e in un

∞

P

altro operatore Ĥ ′ =

En |φn i hφn | interpretabile come un nuovo Hamiltoniano di cui |φ1 i è

n=1

lo stato fondamentale. Si definisce quindi

Ĥ ′ = Ĥ − E0 |φ0 i hφ0 |

(1.4.7)

e si cerca lo stato fondamentale di questo nuovo Hamiltoniano, che corrisponde al primo livello

eccitato di Ĥ.

Il procedimento cosı̀ descritto è valido solo in assenza di degenerazione per gli stati, ma può

essere facilmente esteso al caso di degenerazione. In tal caso l’autospazio relativo ad E0 ha dimensione maggiore di uno e lo stato |ψi converge ad un qualsiasi autovettore all’interno di questo

autospazio. Quando si rimuove |φ0 i dallo spazio H (per la precisione si rimuove il sottospazio

da esso generato) viene rimossa solo una parte dell’autospazio relativo a E0 .

Se si indica con dn la degenerazione del livello En e con φkn il k-esimo vettore all’interno base

ortonormale per l’autospazio relativo a En , la (1.4.2) diviene

|ψ(τ )i =

dn

∞ X

X

n=0 k=1

En τ k cn,k exp −

φn .

~

7

(1.4.8)

Capitolo 1: Evoluzione temporale e stati stazionari

Proiettando fuori dallo spazio lo stato φ10 in accordo con la (1.4.7) l’evoluzione lungo il tempo

immaginario dello stato del sistema diviene

E0 τ 2 E0 τ 3 |ψ(τ )i = c0,2 exp −

φ0 + c0,3 exp −

φ0 + ...

~

~

(1.4.9)

e normalizzando lo stato, per τ → ∞ si ha:

d

0

|ψ(τ )i τ →∞ 1 X

−−−−→

c0,k φk0 ,

kψ(τ )k

c

(1.4.10)

k=2

dove c2 =

d0

P

k=2

2

|c0,k | . Il sistema evolve quindi sempre verso un vettore appartenente allo stesso

sottospazio e non verso il primo livello eccitato.

Ciò non rappresenta un ostacolo, ma fornisce una procedura per valutare la degenerazione di un

valore di energia, identificare una base ortonormale per l’autospazio relativo e procedere successivamente all’identificazione dei livelli eccitati. È sufficiente ripetere iterativamente la procedura,

proiettando ogni volta via dallo spazio i ket trovati e controllare il valore di attesa dell’Hamiltoniano in ogni stato. Se per le prime n volte si trova lo stesso valore di energia E e successivamente

un valore diverso dell’energia allora si è certi che lo stato fondamentale sia n volte degenere e i

primi n ket trovati sono una base ortonormale per l’autospazio corrispondente.

Nel contesto dell’equazione di Schrödinger unidimensionale è possibile provare che lo spettro

discreto è non degenere e quindi la procedura appena illustrata nel caso generale non sarà necessaria nei casi analizzati in questa tesi.

1.5

Formula di Feynman-Kac

Nella sezione precedente si è visto come è possibile collegare l’operatore di evoluzione temporale

con l’energia dello stato fondamentale E0 , facendo evolvere lungo il tempo immaginario una

funzione d’onda arbitraria. È possibile però esprimere la relazione tra l’Hamiltoniana Ĥ e

l’energia dello stato fondamentale in una forma più elegante, che non dipenda dallo stato iniziale

(arbitrario) del sistema.

Partendo dalla definizione del propagatore e usando la relazione di completezza

I, si può scrivere:

iĤ(t − t0 )

K(x, t; x0 , t0 ) = hx|K̂(t, t0 )|x0 i =

hx|φn i hφn | exp −

~

n,m

X

iEn (t − t0 )

δn,m hφm |x0 i =

=

hx|φn i exp −

~

n,m

X

iEn (t − t0 )

.

=

φn (x)φn (x0 ) exp −

~

n

X

8

!

P+∞

n=0

|φn i hφn | =

|φm i hφm |x0 i =

(1.5.1)

Capitolo 1: Evoluzione temporale e stati stazionari

Assumendo t0 = 0 ed effettuando la rotazione di Wick,

K(x, τ ; x0 ) =

X

n

En τ

.

φn (x)φn (x0 ) exp −

~

(1.5.2)

Se si calcola il propagatore tra lo stesso punto iniziale e finale (x0 = x) e si integra rispetto a

questa variabile, si ha

Z

Z

X

X

En τ

En τ

2

dx K(x, τ ; x) =

exp −

,

dx |φn (x)| =

exp −

~

~

n

n

(1.5.3)

dove si è sfruttata la normalizzazione delle autofunzioni dell’energia.

Prendendo il logaritmo di entrambi i membri, moltiplicando per 1/τ ed effettuando il limite

τ → ∞, si ottiene

1

lim ln

τ →∞ τ

Z

!

X

E0

En τ

1

=−

exp −

dx K(x, τ ; x) = lim ln

τ →∞ τ

~

~

n

(1.5.4)

dove, come nella sezione precedente, si è sfruttato il fatto che tutti gli esponenziale corrispondenti

ai livelli eccitati tendano a zero più velocemente di quello relativo allo stato fondamentale.

Invertendo l’espressione ed effettuando il cambiamento di variabile t = τ /~ si ha quindi la nota

formula di Feynman-Kac:

1

E0 = lim − ln Tr e−tH ,

t→∞

t

(1.5.5)

dove con Tr si è indicata la funzione traccia di un operatore.

1.6

Soluzioni numeriche

Si è mostrato che la risoluzione dell’equazione di Schrödinger indipendente dal tempo è un problema equivalente alla valutazione dell’evoluzione temporale di una funzione d’onda arbitraria

lungo il tempo immaginario. Per la sua semplicità concettuale, questo metodo risulta molto

versatile e si presta bene ad essere alla base di metodi approssimati di soluzione.

Esistono infatti numerose tecniche numeriche atte a valutare l’evoluzione temporale predetta

dall’equazione di Schrödinger e in questa tesi se ne analizzeranno due.

La prima è quella dello splitting degli operatori, analizzata nel Capitolo 2, che si basa su una

valutazione approssimata dell’espressione (1.2.4).

La seconda è quella della diffusione montecarlo, analizzata nel Capitolo 4, che sfrutta la possibilità di esprimere il propagatore attraverso il formalismo degli integrali di cammino di Feynman.

Viene inoltre presentato un metodo di risoluzione diretto dell’equazione indipendente dal tempo, che non sfrutta quindi il formalismo del tempo immaginario ma si basa sull’integrare numericamente l’equazione differenziale, valutando contemporaneamente autovalori e autofunzioni

attraverso una procedura detta shooting. Questo metodo sarà illustrato nel Capitolo 3.

9

Capitolo 2

Metodo di splitting degli

operatori

In questa sezione verrà analizzato un metodo di calcolo approssimato per il propagatore dell’equazione di Schrödinger basato sull’evoluzione nel tempo immaginario. Esso consentirà di

valutare l’evoluzione temporale di una funzione d’onda qualsiasi verso lo stato fondamentale.

Nello specifico si mostrerà come è possibile separare il termine cinetico e il termine potenziale all’interno dell’espressione del propagatore e valutarli singolarmente nella funzione d’onda,

puntualizzando come questa procedura possa essere eseguita in maniera efficiente con un calcolatore.

Si studierà poi brevemente quali informazioni sullo spettro energetico possono essere ricavate

sulla base della velocità di convergenza della funzione d’onda verso lo stato fondamentale.

2.1

Formula di Baker-Campbell-Hausdorff

Al fine di ottenere un’espressione approssimata per il propagatore, che ne permetta una semplice

valutazione, è necessario introdurre un risultato sviluppato nel contesto dei gruppi di Lie.

Dati due operatori X ed Y , tali che in generale [X, Y ] 6= 0, il prodotto degli operatori exp(X) e

exp(Y ) può essere sviluppato come segue:

1

1

([X, [X, Y ]] − [Y, [X, Y ]]) + ... .

exp(X) exp(Y ) = exp X + Y + [X, Y ] +

2

12

(2.1.1)

Questo risultato è detto formula di Baker-Campbell-Hausdorff.

Ricordando che l’espressione per il propagatore tra l’istante t e l’istante t + ∆t è

!

!

iĤ∆t

i(T̂ + V̂ )∆t

K̂(t, t + ∆t) = exp −

= exp −

,

~

~

10

(2.1.2)

Capitolo 2: Metodo di splitting degli operatori

dove con T̂ e V̂ si sono indicati rispettivamente gli operatori energia cinetica ed energia potenziale, si potrebbe pensare di identificare X e Y rispettivamente con i due operatori

X=−

iT̂ ∆t

,

~

Y =−

iV̂ ∆t

,

~

(2.1.3)

In questo caso si ottiene:

iT̂ ∆t

exp −

~

!

iV̂ ∆t

exp −

~

!

!

iĤ∆t ∆t2

= exp −

+ 2 [T̂ , V̂ ] + ... .

~

2~

(2.1.4)

Si potrebbe quindi semplicemente fattorizzare il propagatore nel prodotto di due esponenziali

riferiti separatamente al termine cinetico e a quello potenziale, commettendo un errore di ordine

(∆t)2 .

Si vede però che è possibile migliorare l’approssimazione portandola a O[(∆t)3 ] generalizzando

la formula di (2.1.1) al caso di tre operatori X, Y, Z:

1

exp(X) exp(Y ) exp(Z) = exp X + Y + Z + ([X, Y ] + [Y, Z] + [Z, X]) + ... .

2

(2.1.5)

Se identifichiamo questi operatori con

X=Z=−

iV̂ ∆t

,

2~

Y =−

iT̂ ∆t

~

(2.1.6)

vediamo che [X, Z] = 0 e che [X, Y ] + [Y, Z] = [X, Y ] + [Y, X] = 0, quindi il termine O[(∆t)2 ]

scompare dall’espressione, e nello scrivere

!

!

!

!

iĤ∆t

iV̂ ∆t

iT̂ ∆t

iV̂ ∆t

exp −

= exp −

exp −

exp −

~

2~

~

2~

(2.1.7)

si commette un errore dell’ordine (∆t)3 .

2.2

Applicazione del metodo

La sezione precedente rende chiaro il nome utilizzato per questo metodo: l’operatore di evoluzione temporale viene diviso in più pezzi, ognuno dipendente dal solo termine cinetico o potenziale,

al fine di renderne semplice la valutazione.

Nella rappresentazione della posizione infatti gli operatori exp −iV̂ ∆t/2~ agiscono come fattori moltiplicativi per ψ(x) e la loro valutazione è immediata. Il termine cinetico

!

!

iT̂ ∆t

iP̂ 2 ∆t

exp −

= exp −

~

2m~

(2.2.1)

non è invece diagonale nella rappresentazione delle coordinate e non è quindi semplice determinare il modo in cui esso opera sulla funzione d’onda. La maniera più immediata per risolvere questo

problema è trasformare la funzione d’onda dalla rappresentazione delle coordinate a quella degli

impulsi attraverso la trasformata di Fourier:

1

ψ̃(p) = F (ψ(x)) = √

2π~

Z

+∞

−∞

11

ipx

,

dx ψ(x) exp −

~

(2.2.2)

Capitolo 2: Metodo di splitting degli operatori

1

ψ(x) = F −1 (ψ̃(p)) = √

2π~

Z

+∞

dp ψ̃(p) exp

−∞

ipx

~

.

(2.2.3)

Poiché P̂ è un operatore moltiplicativo nella rappresentazione degli impulsi la valutazione del

termine cinetico in questa base è immediata:

!

ip2 ∆t

iP̂ 2 ∆t

ψ̃(p) = exp −

ψ̃(p).

exp −

2m~

2m~

(2.2.4)

La valutazione dell’espressione (2.1.2) che permette di far evolvere la funzione d’onda tra il tempo

t e quello t+∆t è quindi possibile attraverso l’approssimazione data dallo splitting dell’operatore

(2.1.7) e l’uso della trasformata di Fourier.

Esplicitamente, data la funzione d’onda ψ(x, t), si opera prima con il termine potenziale, poi si

effettua la trasformata di Fourier e si opera con il termine cinetico (che agisce come un fattore

moltiplicativo), poi si torna nella rappresentazione delle coordinate attraverso l’ anti-trasformata

di Fourier e infine si applica il secondo termine potenziale. In questo modo si ottiene ψ(x, t + ∆t)

con un errore O(∆t3 ). Questo risultato dipende dalla scelta di dividere esattamente a metà

l’intervallo temporale , nel ripartirlo tra i due operatori contenenti il termine di potenziale.

Di seguito questa procedura è illustrata in maniera estesa:

ip2 ∆t

iV (x)∆t

iV (x)∆t

F −1 exp −

F exp −

ψ(x, t)

ψ(x, t + ∆t) ≈ exp −

2~

2m~

2~

(2.2.5)

Si può osservare che quando si è effettuato lo splitting del propagatore si è scelto di dimezzare il

termine contenente il potenziale, ma anche la scelta del termine cinetico sarebbe stata possibile e

infatti le due sono perfettamente equivalenti dal punto di vista teorico. Tuttavia la valutazione di

due termini cinetici avrebbe richiesto ben quattro operazioni tra trasformate e anti-trasformate

di Fourier e ciò, nell’implementazione del metodo su un calcolatore, causa un notevole aumento

del carico computazionale.

La procedura descritta permette di far evolvere nel tempo una qualsiasi funzione d’onda e rappresenta quindi un metodo per risolvere l’equazione di Schrödinger dipendente dal tempo.

È sufficiente ora effettuare la rotazione di Wick per trasformarla in una procedura per la

valutazione dello stato fondamentale, come spiegato ampiamente nel Capitolo 1.

2.3

Analisi della velocità di convergenza

La convergenza verso lo stato fondamentale si ottiene attraverso il decadimento delle autofunzioni corrispondenti ai livelli eccitati nella (1.4.2). Poiché la vita media di ogni esponenziale

dipende dal valore di energia del livello corrispondente, è possibile creare un collegamento tra la

velocità di convergenza del metodo allo stato fondamentale e la differenza di energia tra i vari

livelli. Si possono quindi ottenere informazioni indicative sullo spettro sulla base della velocità di

convergenza verso lo stato fondamentale, in particolare è possibile stimare in maniera accurata

la distanza del primo livello eccitato.

12

Capitolo 2: Metodo di splitting degli operatori

Supponendo di porci a un tempo τ tale da considerare nulli tutti i termini nello sviluppo tranne

il fondamentale e il primo livello eccitato, possiamo valutare in maniera esplicita il valore di

E1 − E0 dalla distanza tra la funzione d’onda e il livello fondamentale. Questa approssimazione

è tanto migliore quanto più è grande il rapporto (E2 − E1 )/(E1 − E0 ).

La distanza tra la funzione ψ(x, τ ) che costituisce la nostra approssimazione dello stato fondamentale e il risultato esatto φ0 (x) può essere valutata come la norma della differenza tra le due.

Usando quindi la (1.4.4) per esplicitare la funzione d’onda normalizzata e fermando la serie ai

primi due termini, si può scrivere:

|ψ(τ )i

kψ(τ )k − |φ0 i ≈ 2 1 −

2

!− 12

c1 2(E1 − E0 )τ

,

1 + exp −

c0

~

(2.3.1)

Nel limite τ → ∞ si può sviluppare in serie di Maclaurin la funzione rispetto alla variabile

piccola

2

c1 2(E1 − E0 )τ

.

z = exp −

c0

~

(2.3.2)

Fermando lo sviluppo al prim’ordine e passando alla rappresentazione della posizione, si può

scrivere

2

c1 ψ(x, τ )

2(E1 − E0 )τ

kψ(x, τ )k − φ0 (x) ≈ z = c0 exp −

~

2

(2.3.3)

2

dove con k·k2 si è indicata la norma nello spazio delle funzioni a quadrato sommabile L2 (R).

Quindi per tempi lunghi la distanza tra la funzione approssimata con il metodo e la soluzione

esatta decresce esponenzialmente, con vita media λ dipendente dalla differenza (E1 − E0 ). Si

può quindi invertire il ragionamento e partire dal valore di λ ottenuto dal fit della simulazione

numerica

ψ(x, τ )

ln − φ0 (x)

= a − λτ

kψ(x, τ )k

2

(2.3.4)

2

per stimare la distanza del primo livello eccitato:

E1 − E0 ≈

2.4

~

.

2λ

(2.3.5)

Implementazione al calcolatore

Fino ad ora si è illustrato l’algoritmo per valutare lo stato fondamentale dal punto di vista prettamente teorico. Nel caso reale in cui si debba risolvere il problema al calcolatore non si dispone

di funzioni d’onda continue ma di un campionamento delle stesse su una griglia. Non è possibile

neppure considerare x ∈ R ma ci si deve restringere ad un dominio finito [xmin , xmax ] ⊂ R.

Ciò non è una limitazione eccessiva se gli autostati dell’equazione di Schrödinger, che devono

essere normalizzabili, si annullano rapidamente per |x| → ∞. In questi casi è possibile scegliere

è sufficiente scegliere una regione [xmin , xmax ] abbastanza grande da poter considerare ragione-

volmente nulla la funzione d’onda al di fuori di essa.

13

Capitolo 2: Metodo di splitting degli operatori

Nel caso unidimensionale, detto N il numero di punti per la griglia su cui campionare la funzione

d’onda è possibile discretizzare quest’ultima come:

ψi = ψ(xi ) ,

xi = xmin + i∆x ,

i ∈ {1, ..., N }

(2.4.1)

dove con ∆x = (xmax − xmin )/N si è indicato lo step spaziale, cioè la distanza tra due punti

successivi sulla griglia. Maggiore è il valore di N (e quindi più piccolo è lo step spaziale), migliore

sarà l’approssimazione della funzione d’onda.

È necessario modificare anche la trasformata di Fourier in modo da tenere conto della discretizzazione della funzione d’onda. Scegliendo di campionare anche al funzione trasformata ψ̃ come

un array di N valori, con impulsi equispaziati nell’intervallo [pmin , pmax ], si può scrivere:

N

X

1

ipj xk

∀j = 1...N ψ̃j = ψ̃(pj ) = √

.

(2.4.2)

∆x

ψk exp −

~

2π~

k=1

L’intervallo [pmin , pmax ] va scelto simmetrico attorno allo zero (in quanto nel termine cinetico del

propagatore la dipendenza è da p2 ) e ampio abbastanza da non trascurare frequenze significative.

Se l’intervallo viene però scelto troppo ampio le instabilità numeriche possono creare rumore per

|p| grandi e portare ad errori non trascurabili.

La definizione dell’anti-trasformata è analoga.

Nella sezione (1.4) si è mostrato come la convergenza allo stato fondamentale si ha nel limite τ → ∞. Questo è ovviamente irrealizzabile nella realtà e il calcolo va fermato ad un tempo T

sufficientemente grande. Una stima di questo tempo può essere data osservando che nell’espressione (1.4.2) il termine esponenziale più lento nell’annullarsi sia quello corrispondente allo stato

fondamentale, quindi deve essere T ≫ ~/(E1 − E0 ).

La trattazione effettuata fin’ora per l’evoluzione lungo il tempo immaginario si basa sul partire

da una funzione d’onda all’istante iniziale τ = 0, farla evolvere evolvere per un tempo sufficien-

temente grande e alla fine normalizzarla. Nella (2.2.5) la funzione d’onda viene invece propagata

per un solo step temporale ∆τ a partire dall’istante τ . Ovviamente a partire da questa espressione si può ottenere la propagazione per un tempo finito T sfruttando le proprietà di composizione

del propagatore:

|ψ(T )i = K̂(T, T − ∆τ ) ... K̂(2∆τ, ∆τ ) K̂(∆τ, 0) |ψ(0)i .

(2.4.3)

Quindi da un punto di vista prettamente teorico si vede che far evolvere la funzione d’onda per

l’intero tempo T e normalizzarla alla fine oppure farla evolvere di un solo step ∆τ , normalizzarla,

e iterare questo procedimento per n = T /∆τ volte, porta allo stesso risultato e quindi alla stessa

approssimazione dello stato fondamentale.

Da un punto di vista numerico i due procedimenti non sono però equivalenti in quanto dopo

un tempo T troppo lungo si ha che kψk ≈ 0 e quindi, per via della precisione con cui vengono

memorizzati i valori della funzione d’onda nel calcolatore, andare a normalizzare la funzione

d’onda alla fine vuol dire commettere un errore significativo sul valore della norma della funzione d’onda, ottenuto effettuando un’integrazione numerica. Nella simulazione realizzata per

14

Capitolo 2: Metodo di splitting degli operatori

questo lavoro si è quindi scelto di normalizzare la funzione d’onda dopo ogni step di evoluzione

temporale.

Nella sezione (1.4) è stata sviluppata anche una procedura per valutare i primi livelli eccitati oltre allo stato fondamentale. Innanzitutto bisogna puntualizzare che l’errore commesso nella

determinazione dei livelli energetici e delle funzioni d’onda cresce quando si valutano stati con

energia maggiore. Ciò perché quando si valuta numericamente la funzione d’onda dello stato

fondamentale, per via dell’errore O(∆τ 3 ) e del tempo di simulazione finito, si giunge solo ad una

sua approssimazione. Quando si scrive quindi il nuovo Hamiltoniano Ĥ ′ come prescritto dalla

(1.4.7) esso risente di questo errore e il suo stato fondamentale non sarà più, nemmeno in linea

teorica, coincidente con il primo stato eccitato dell’Hamiltoniano di partenza.

La propagazione dell’errore è comune a tutti i metodi di risoluzione dell’equazione di Schrödinger

che cercano i livelli eccitati a partire dai livelli precedentemente valutati. Il metodo di shooting

descritto nel prossimo capitolo invece non soffre di questo problema, in quanto integra direttamente l’equazione di Schrödinger per ogni differente autovalore dell’energia, e commette in linea

di principio lo stesso errore su tutti i livelli energetici.

Come è evidente dalla (1.4.7), per operare con il nuovo Hamiltoniano è sufficiente procedere esattamente come fatto per lo stato fondamentale e poi eliminare dalla funzione d’onda le

componenti lungo le direzioni degli stati già valutati, una procedura molto simile a quella di

ortonormalizzazione di Gram–Schmidt. Anche in questo caso la procedura va ripetuta ad ogni

step temporale, nonostante ciò non sia richiesto in linea di principio in quanto annullando i

coefficienti cn corrispondenti ai primi n livelli essi dovrebbero rimanere nulli per la successiva

evoluzione della funzione d’onda. Ciò deriva da errori numerici che hanno modo di accumularsi

su diversi step temporali e di riportare alla luce termini dello sviluppo che in teoria dovrebbero

essere definitivamente annullati dalla proiezione fuori dallo spazio.

È per questo motivo che la ricerca del primo livello eccitato, ad esempio, viene effettuata seguendo questa procedura e non semplicemente cercando di partire da una funzione d’onda iniziale

che non contenga alcuna componente dello stato fondamentale (c0 = 0). Infatti per potenziali

V (x) pari le proprietà di simmetria delle autofunzioni dell’energia permettono di osservare che

la funzione d’onda corrispondente allo stato fondamentale è necessariamente pari, mentre quella

corrispondente al primo livello eccitato è necessariamente dispari. Basterebbe quindi partire da

una funzione d’onda iniziale dispari ψ(x, t = 0) = −ψ(−x, t = 0) perché il metodo converga

al primo livello eccitato, senza alcuna modifica all’Hamiltoniano. Come già detto ciò numeri-

camente non accade e le simulazioni mostrano che per quanto la funzione d’onda inizialmente

tenda verso il primo livello eccitato, dopo un tempo sufficientemente lungo si ha una transizione

verso lo stato fondamentale.

15

Capitolo 3

Metodo di Shooting

Il metodo che verrà esposto in questo capitolo, a differenza di quello esposto nel capitolo precedente e di quello che vedremo nel successivo, non si basa sul formalismo del tempo immaginario,

ma affronta il problema con un approccio numerico più standard nel contesto della risoluzione di

equazioni differenziali. L’equazione di Schrödinger viene risolta attraverso una discretizzazione

dello spazio e degli operatori differenziali, detta metodo di Numerov, mentre la determinazione

dello spettro viene effettuata con un algoritmo di bisezione, detto metodo di Shooting.

3.1

Metodo di Numerov

Uno degli approcci numerici standard per la risoluzione di un’equazione differenziale ordinaria

è il metodo di Runge-Kutta, un metodo del quart’ordine nello step di discretizzazione spaziale

∆x, molto versatile e stabile.

Nel caso dell’equazione di Schrödinger indipendente dal tempo è però possibile derivare un altro

metodo, più elegante e semplice di quello di Runge-Kutta e di un ordine maggiore in ∆x. Esso è

detto metodo di Numerov e può essere utilizzato per risolvere ogni equazione differenziale nella

forma

d2 ψ

= f (x)ψ(x) + g(x).

dx2

(3.1.1)

Nel nostro caso, essendo l’equazione di Schrödinger:

d2 ψ

2m

= 2 (V (x) − E) ψ(x),

dx2

~

(3.1.2)

si ha che g(x) = 0, e il metodo verrà derivato sotto questa assunzione più particolare.

È opportuno osservare che per risolvere l’equazione di Schrödinger è necessario trovare contemporaneamente il valore di E e la funzione ψ(x), mentre il metodo di risoluzione numerica permette

solo di valutare la funzione ψ ad E fissato. Si supporrà quindi di fissare il valore di E e di

risolvere l’equazione in questo caso, per poi mostrare nelle sezioni successive come determinarne

gli autovalori.

16

Capitolo 3: Metodo di Shooting

Sia ∆x lo step spaziale che verrà utilizzato in seguito per discretizzare la funzione d’onda su

un reticolo unidimensionale. Si vuole sviluppare la funzione ψ, soluzione dell’equazione, in serie

di Taylor tra punti distanti ∆x. Per la precisione si effettua lo sviluppo di ψ(x+∆x) e ψ(x−∆x)

attorno al punto x:

ψ(x + ∆x) = ψ(x) +

ψ(x − ∆x) = ψ(x) +

∞

X

ψ (n) (x)

∆xn ,

n!

n=1

∞

X

ψ (n) (x)

(−1)n ∆xn .

n!

n=1

(3.1.3)

(3.1.4)

Le potenze pari dei due sviluppi sono uguali, mentre le potenze dispari sono opposte. Andando

a sommare le due espressioni si ottiene:

ψ(x + ∆x) + ψ(x − ∆x) = 2ψ(x) + ψ (2) (x)∆x2 +

ψ (4) (x)

∆x4 + O(∆x6 ).

12

(3.1.5)

Si vuole ricondurre questa a un’equazione nei soli termini ψ(x), ψ(x + ∆x), ψ(x − ∆x), in modo

da poterla poi risolvere algebricamente e, fissati due punti iniziali per la funzione d’onda, poter

determinare iterativamente tutti gli altri. Il termine ψ (2) (x) può essere ottenuto direttamente

dall’equazione differenziale, mentre resta da stimare il termine con la derivata quarta.

Per semplicità di notazione si introduce l’operatore di differenza centrale δ definito in modo che:

δ(ψ(x), ∆x) = ψ(x + ∆x) + ψ(x − ∆x) − 2ψ(x).

(3.1.6)

La formula precedente si scrive quindi come

δ(ψ(x), ∆x) = ψ (2) (x)∆x2 +

ψ (4) (x)

∆x4 + O(∆x6 ).

12

(3.1.7)

Derivando l’espressione precedente rispetto a x si ha

δ(ψ (2) (x), ∆x) = ψ (4) (x)∆x2 +

ψ (6) (x)

∆x4 + O(∆x6 ),

12

(3.1.8)

dove si è sfruttata la naturale linearità dell’operatore δ appena introdotto. Moltiplicando per

∆x2 /12 ed isolando la derivata quarta si ha

ψ (4) (x)

∆x2

ψ (6) (x)

∆x4 =

δ(ψ (2) (x), ∆x) −

∆x6 + O(∆x8 ),

12

12

144

(3.1.9)

e sostituendo questa espressione nella (3.1.7) si ottiene

δ(ψ(x), ∆x) = ψ (2) (x)∆x2 +

∆x2

δ(ψ (2) (x), ∆x) + O(∆x6 ).

12

(3.1.10)

Sfruttando infine l’espressione dell’equazione di Schrödinger ψ (2) (x) = f (x)ψ(x),

δ(ψ(x), ∆x) = ψ(x)f (x)∆x2 +

∆x2

δ(ψ(x)f (x), ∆x) + O(∆x6 ).

12

(3.1.11)

Basta quindi sviluppare gli operatori di differenza centrale e isolare il termine ψ(x + ∆x) per

poter integrare l’intera soluzione.

17

Capitolo 3: Metodo di Shooting

Per implementare il metodo al calcolatore è necessario fissare un intervallo [xmin , xmax ] su cui

valutare la funzione d’onda, campionandola in un numero N di punti su una griglia uniforme di

step ∆x = (xmax − xmin )/(N − 1). Conviene quindi esprimere le funzioni d’onda campionate in

una notazione più consona, indicando:

ψn = ψ(xn )

,

fn = f (xn ) ,

xn = xmin + n∆x

,

n ∈ {1, ..., N − 1}

(3.1.12)

La soluzione numerica esplicita dell’equazione di Schrödinger per una particella puntiforme in

moto unidimensionale è quindi data dalle relazioni:

2

2ψn 1 + 5∆x

1−

−

ψ

f

n−1

n

12

ψn+1 =

2

∆x

1−

fn+1

12

con

2m

fn = 2 (V (xn ) − E).

~

3.2

∆x2

12 fn−1

,

(3.1.13)

(3.1.14)

Scelta delle condizioni iniziali

La procedura illustrata permette di valutare un punto della funzione d’onda a partire dai due

punti che lo precedono, quindi la determinazione dell’intera funzione d’onda richiede che siano

forniti almeno i due punti iniziali ψ0 e ψ1 . Per la notazione adottata ciò vorrebbe dire conoscere

ψ(xmin ) e ψ(xmin + ∆x) e quindi i due punti più vicini all’estremo sinistro dell’intervallo di

integrazione. Si vede in realtà che è possibile scegliere in maniera più arbitraria i punti da cui

partire con l’integrazione: è sufficiente infatti fissare due qualsiasi punti adiacenti sulla griglia

e integrare in entrambe le direzioni fino agli estremi dell’intervallo. Spostandosi verso xmax si

può utilizzare proprio la (3.1.13), mentre spostandosi verso xmin è sufficiente invertire questa

espressione esplicitando ψn−1 in funzione di ψn e ψn+1 .

Nonostante questa libertà nella scelta dei punti da cui iniziare l’integrazione, dal punto di vista

computazionale è necessario procedere con maggiore cautela.

Le soluzioni relative ad alcuni potenziali, come ad esempio il potenziale armonico V (x) = 21 kx2 ,

presentano il giusto comportamento asintotico solo per valori di E corretti. La quantizzazione

dell’energia e la presenza di uno spettro discreto nascono infatti dal corretto comportamento

della funzione d’onda ai bordi del dominio, mentre l’equazione differenziale ammette soluzioni

per ogni valore di E ed esse in generale non appartengono a L2 (R). Se quindi il valore di E

scelto non è pari all’autovalore dell’energia, la soluzione trovata tenderà a divergere agli estremi

del dominio.

Ciò rende difficile iniziare l’integrazione a partire da xmin verso xmax , in quanto si inizierebbe

ad integrare da una regione in cui la funzione d’onda tende ad avere un comportamento non

corretto ed è fortemente soggetta ad instabilità numeriche.

Se il potenziale, come nei casi analizzati in questa tesi, è una funzione pari, V (x) = V (−x), è

18

Capitolo 3: Metodo di Shooting

di gran lunga preferibile iniziare l’integrazione a partire da x = 0, dove è noto che la funzione

d’onda ha un buon comportamento, e spostarsi contemporaneamente verso entrambi gli estremi

del dominio di integrazione. Per la precisione, essendo le soluzioni necessariamente funzioni pari

o dispari, è sufficiente integrare a partire da x = 0 verso uno solo dei due estremi e ottenere

l’altra parte della funzione d’onda per simmetria.

Resta quindi da determinare una procedura per un’accurata scelta di ψ(x = 0) e di ψ(x = ∆x)

(scegliendo quindi di integrare verso l’estremo destro del dominio).

Indichiamo con ψn l’autofunzione relativa all’n-esimo valore dell’energia En , con n ≥ 0. È

possibile dimostrare, nel contesto dell’equazione di Schrödinger unidimensionale, un risultato

molto importante noto come teorema dei nodi [2] [3]. Esso afferma che l’autofunzione ψn ha

esattamente n nodi, cioè si annulla n volte (al finito, mentre il comportamento ψn (x) → 0 sugli

estremi del dominio fa sı̀ che gli zeri siano complessivamente, al finito e all’infinito, n + 2). Come

si è detto se il potenziale è pari le autofunzioni sono funzioni pari o dispari, cioè:

ψ(x) = ±ψ(−x).

(3.2.1)

Le funzioni dispari sono caratterizzate quindi da ψ(0) = 0, cioè hanno sempre un nodo nell’origine. Inoltre per la simmetria, ogni volta che ψ(x) = 0, necessariamente deve essere ψ(−x) = 0,

sia nel caso di funzioni pari che di funzioni dispari. Quindi in accordo con il teorema dei nodi si

deduce che le autofunzioni ψn hanno la stessa parità di (−1)n .

Supponendo di cercare l’autofunzione relativa all’n-esimo livello eccitato, se n è dispari ci si

aspetta che la funzione d’onda si annulli nell’origine. Ciò permette di fissare ψ(0) = 0 e a ψ(∆x)

a un valore arbitrario, e sceglierli come punti da cui iniziare l’integrazione. L’arbitrarietà nella

scelta deriva dal fatto che tutte le funzioni d’onda φn (x) = k · ψn (x), con k costante, sono

anch’esse soluzioni a n fissato per la linearità dell’equazione di Schrödinger analizzata e quindi

al più si troverà una funzione d’onda non normalizzata, che potrà essere normalizzata alla fine

dell’integrazione.

Se invece n è pari è il valore di ψ(0) che può essere fissato arbitrariamente, mentre il valore

di ψ(∆x) va scelto con più cautela. Sfruttando la simmetria della funzione è però noto che

ψ(−∆x) = ψ(∆x) e i punti −∆x, 0, ∆x sono tre punti adiacenti sulla griglia di simulazione,

quindi si può determinare il valore di ψ(∆x) a partire direttamente dalla (3.1.13), ottenendo

ψ(∆x) = ψ(0)

1−

1−

5∆x2

12 f (0)

,

∆x2

12 f (∆x)

(3.2.2)

per poi procedere normalmente con l’applicazione del metodo.

3.3

Metodo di Shooting

In questa sezione verrà discussa la procedura utilizzata per risalire al valore corretto per gli

autovalori. Come già evidenziato il metodo di Numerov permette di integrare l’equazione di

19

Capitolo 3: Metodo di Shooting

Schrödinger per un qualsiasi valore di E e il comportamento della soluzione trovata agli estremi

del dominio è indicativo di quanto il valore di E scelto sia lontano da un valore accettabile.

Si è inoltre mostrato come all’n-esimo valore dell’energia En corrisponda un’autofunzione con

esattamente n nodi al finito. È quindi possibile in linea di principio scegliere casualmente un

valore di E, effettuare l’integrazione numerica contando il numero di nodi presenti nella soluzione

e sulla base di questo numero correggere il valore di E ed effettuare una nuova integrazione.

La semplice forma dell’equazione differenziale garantisce infatti che le soluzioni dipendano in

maniera continua dal parametro E, quindi se si prende E ∈ [En , En+1 ] si è certi che la soluzione

avrà un numero di nodi al finito compreso tra n ed n + 1. Se il numero di nodi trovati durante

l’integrazione è maggiore di quello previsto ciò vuol dire che il valore di E scelto è troppo grande

e va diminuito, viceversa nel caso si trovi un numero di nodi minore.

Se il numero di nodi trovati è esattamente quello atteso non si può essere certi però di aver

scelto il valore di E corretto, anzi, si vede che nell’intero intervallo E ∈ [En , En+1 ) il numero

di nodi al finito è pari ad n ed essi diventano n + 1 solo per E ∈ [En+1 , En+2 ). Una maniera

semplice di risolvere questo problema è di tenere conto anche degli zeri all’infinito: si impone

che la funzione d’onda abbia esattamente n + 2 zeri e ciò equivale a richiedere che per |x| → ∞

si abbia il comportamento corretto ψ(x) → 0. Nel caso reale in cui la funzione d’onda viene

campionata all’interno di un intervallo finito [xmin , xmax ] ciò equivale a richiedere che la funzione

d’onda si annulli sul bordo di questo intervallo.

Poiché nell’analisi fatta in questa tesi si considerano solo potenziali pari e l’integrazione della

funzione d’onda viene fatta solo verso un estremo del dominio, il numero di nodi m che deve

essere richiesto non è pari a n + 2 ma si ha:

n+2

2

m=

n+3

2

se n pari.

(3.3.1)

se n dispari.

dove si è tenuto conto del fatto che la funzione d’onda relativa a n dispari ha sempre uno zero

nell’origine, che si suppone venga contato durante il processo di integrazione.

Riassumendo, dopo aver fissato n e quindi dopo aver scelto il livello energetico a cui si è interessati, si sceglie per E un valore arbitrario e si integra la funzione d’onda attraverso l’algoritmo di

Numerov, contando il numero di nodi che essa presenta. Si confronta poi questo con il valore di

m ottenuto attraverso la formula precedente, se si ha un numero maggiore di nodi il valore di E

scelto è troppo alto e va diminuito, viceversa se il numero di nodi è minore si è scelto E troppo

piccolo e va aumentato. Si è certi che il numero di nodi trovati andrà a coincidere con m solo

nel caso in cui E vada a coincidere con l’autovalore En .

La procedura illustrata, che analizza gli zeri della soluzione in modo da soddisfare le condizioni

al contorno, è detta metodo di Shooting.

Resta solo da fissare un metodo per variare adeguatamente il valore di E e garantire la più

veloce convergenza all’autovalore. Si sfrutta un algoritmo di bisezione: si fissa il primo valore di

E (0) a metà di un intervallo [Emin , Emax ] facendo attenzione a scegliere quest’ultimo in modo che

20

Capitolo 3: Metodo di Shooting

l’autovalore vi cada ragionevolmente all’interno e si applica il metodo per la prima volta. Se il valore di E (0) dovesse risultare troppo alto è certo che l’autovalore non potrà trovarsi nell’intervallo

[E (0) , Emax ] e certamente dovrà trovarsi nell’altra metà. Si fissa quindi come nuovo intervallo

[Emin , E (0) ] e si prende E (1) a metà di quest’ultimo, ripetendo la procedura. Allo stesso modo

se il valore trovato per E ad una certa iterazione dovesse risultare troppo basso bisognerebbe

scegliere come intervallo, per l’iterazione successiva, quello comprendente l’estremo superiore.

Reiterando questa procedura un numero sufficiente di volte ci si può avvicinare arbitrariamente

all’autovalore En , a meno dell’errore commesso nella discretizzazione della funzione d’onda con

il metodo di Numerov.

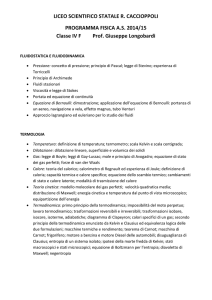

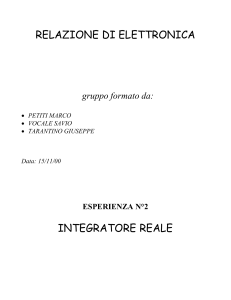

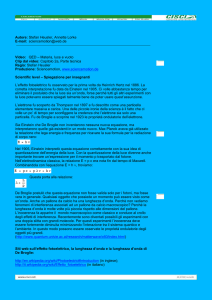

Una rappresentazione grafica di questo procedimento, nel caso dell’oscillatore quartico, è presentata in Figura 3.1.

i=1

i=5

i = 10

i = 15

i = 20

ψ(x)

1

0

−1

−3

−2.5

−2

−1.5

−1

−0.5

0

x

0.5

1

1.5

2

2.5

3

Figura 3.1: Ricerca del primo stato eccitato dell’oscillatore quartico con il metodo di shooting

al variare dell’iterazione i, con ∆x = 4 · 10−5 .

Per concludere, c’è bisogno di fare un’osservazione sulle autofunzioni ottenute in questa maniera.

Per quanto si è detto riguardo al comportamento asintotico delle soluzioni, a meno di scegliere il

valore di E esatto, esse presenteranno sempre un comportamento divergente per |x| grandi. Tale

comportamento comincerà più lontano dall’origine tanto più precisa è l’approssimazione per E,

ma è teoricamente ineliminabile. Ciò fa sı̀ che per quanto i risultati per gli autovalori ottenuti

con questo metodo siano molto accurati, le autofunzioni risultano spesso non normalizzabili a

causa di queste divergenze. Esse possono essere corrette a posteriori annullando la funzione per

|x| grandi e poi normalizzando oppure si può scegliere di integrare la funzione in una regione

spaziale [xmin , xmax ] tale da spingere le divergenze al di fuori di essa con un numero sufficiente

di reiterazioni del metodo.

21

Capitolo 4

Diffusione Montecarlo

Questo metodo di risoluzione numerica si basa, come nel caso del metodo di splitting degli operatori, su una valutazione esplicita del propagatore lungo il tempo immaginario.

Inizialmente verrà analizzato più a fondo il significato matematico del propagatore e verrà mostrato come è possibile esprimerlo attraverso il formalismo degli integrali di cammino di Feynman.

A partire da questa nuova formulazione sarà possibile introdurre un metodo Montecarlo per la

valutazione del propagatore, che verrà interpretato facendo riferimento al legame tra l’equazione

di Schrödinger e l’equazione del calore, accennata nel Capitolo 1.

4.1

Integrale sui cammini di Feynman

A partire dalla formula di Baker-Campbell-Hausdorff introdotta nella sezione 2.1 si può arrivare

ad un’espressione alternativa per l’esponenziale della somma di due operatori auto-aggiunti in

uno spazio di Hilbert separabile.[4]

Sotto queste ipotesi vale infatti la formula di Lie-Trotter :

N

.

eA+B = lim eA/N eB/N

N →∞

(4.1.1)

Possiamo quindi riscrivere il propagatore dell’equazione di Schrödinger nella maniera seguente

!

i(T̂ + V̂ )t

=

K̂(t) = exp −

~

!

!

!

!!

(4.1.2)

iV̂ t

iT̂ t

iV̂ t

iT̂ t

,

= lim exp −

exp −

... exp −

exp −

N →∞

N~

N~

N~

N~

{z

}

|

N volte

come prodotto di 2N esponenziali, metà dei quali dipende dal solo termine cinetico e metà dal

solo termine potenziale.

È possibile esprimere il limite nella rappresentazione delle coordinate, inserendo la relazione di

22

Capitolo 4: Diffusione Montecarlo

completezza tra ogni coppia di esponenziali, per (N − 1) volte:

K(x, x0 ; t) = hx|K̂(t)|x0 i =

Z

iV̂ t

iT̂ t

iV̂ t

iT̂ t

= lim

dx1 ... dxN −1 hx|e− N ~ e− N ~ |xN −1 i ... hx1 |e− N ~ e− N ~ |x0 i .

N →∞

(4.1.3)

RN −1

Dobbiamo ora valutare ognuno degli N elementi di matrice che compaiono all’interno dell’integrale. Il termine contenente il potenziale è diagonale nella rappresentazione delle coordinate e

quindi può essere portato fuori, lasciando l’elemento di matrice del termine cinetico. Quest’ultimo può essere interpretato come il propagatore di una particella libera che si muove tra xn−1

ed xn nel tempo ∆t = t/N , e la sua espressione viene valutata nell’Appendice A. Si ottiene

!

!

iV̂ ∆t

iT̂ ∆t

hxn |exp −

exp −

|xn−1 i =

~

~

!

iT̂ ∆t

iV (xn )∆t

(4.1.4)

hxn |exp −

|xn−1 i =

= exp −

~

~

r

iV (xn )∆t im (xn − xn−1 )2

m

=

.

exp −

+

2πi~∆t

~

2~

∆t

Possiamo ora esplicitare il propagatore tra i due punti dello spaziotempo (x0 , t0 ) e (x, t) attraverso

questi propagatori infinitesimi, cosa che venne fatta per la prima volta da R. Feynman. È

opportuno osservare che all’interno dell’espressione compaiono (N − 1) integrali, mentre ci sono

N termini che rappresentano i propagatori infinitesimi, il che vuol dire che l’espressione finale,

scritta in maniera compatta, sarà:

K(x, x0 ; t) = lim cN

N →∞

Z

RN −1

N

−1

Y

n=1

dxn

!

exp

N X

im (xn − xn−1 )2

n=1

2~

∆t

!

i∆t

−

V (xn )

, (4.1.5)

~

m N2

.

2πi~∆t

Si darà ora un’interpretazione di questo risultato e si mostrerà come, dopo aver effettuato la

cN =

rotazione di Wick, questa espressione per il propagatore si presti facilmente ad una valutazione

attraverso un metodo Montecarlo.

4.2

Interpretazione dell’integrale sui cammini

Verrà mostrato ora brevemente come sia possibile dare un’interpretazione alla (4.1.5) e quale sia

la sua validità matematica, senza però esulare dagli argomenti di questa tesi.

Sia L(x(t), ẋ(t), t) la lagrangiana di una particella classica puntiforme di massa m, dove la

coordinata x rappresenta la posizione. L’intera trattazione può essere estesa in maniera naturale

al caso tridimensionale e a sistemi più complessi. Indicata con x(t) la traiettoria seguita dal

sistema si definisce l’azione come:

S[x(t)] =

Z

0

t

dt′ L (x(t′ ), ẋ(t′ ), t′ ) .

23

(4.2.1)

Capitolo 4: Diffusione Montecarlo

Questo integrale può essere valutato come limite di una somma integrale di Riemann sotto

opportune condizioni di regolarità per L. In tal caso:

S[x(t)] = lim ∆t

N →∞

N

X

n=1

L (x(n∆t), ẋ(n∆t), n∆t) ,

(4.2.2)

dove ∆t = t/N .

Poiché si tratta di un sistema meccanico classico, la lagrangiana è la differenza tra energia

cinetica e quella potenziale:

S[x(t)] = lim ∆t

N →∞

N

X

n=1

1

m

2

dx

dt

dove si è indicato xn = x(n∆t).

2 n∆t

!

− V (xn ) ,

Per N → ∞ si ha che ∆t → 0 quindi la derivata può essere espressa come

2

2 x(t) − x(t − ∆t) (xn − xn−1 )2

dx =

lim

= lim

.

∆t→0

∆t→0

dt

∆t

∆t2

t=n∆t

(4.2.3)

(4.2.4)

n∆t

Complessivamente, l’azione ha espressione

S[x(t)] = lim

N →∞

N X

m (xn − xn−1 )2

2

n=1

∆t

− ∆t V (xn ) .

Confrontando questa relazione con la (4.1.5) appare evidente che si possa scrivere:

!

N

−1

m N2 Z

Y

i

SN [x(t)] ,

K(x, x0 ; t) = lim

dxn exp

N →∞ 2πi~∆t

~

RN −1

n=1

(4.2.5)

(4.2.6)

dove SN [x(t)] è l’approssimazione in N suddivisioni della somma di Riemann (4.2.2).

Il propagatore quantistico che esprime l’ampiezza di probabilità per una particella che si muove

tra x0 e x nel tempo t può essere quindi collegata all’azione classica. I valori di x0 , x1 , ..., xN −1 , x

corrispondono ora ai vertici di una spezzata che viene interpretata come una traiettoria per la

particella classica. Si suppone che la particella si muova lungo questa spezzata, che nel limite

N → ∞ diviene una curva continua, e si valuta l’azione lungo quella traiettoria. Tale valore

viene poi reso immaginario dal termine

i

~

e se ne valuta l’esponenziale. L’azione va calcolata

per ogni possibile valore delle variabili di integrazione x1 , x2 , ..., xN −1 , cioè per ogni possibile

traiettoria che collega il punto x0 a x. L’ampiezza di probabilità per lo spostamento della parti

cella quantistica si può ottenere sovrapponendo le fasi exp ~i S(t) valutate lungo tutti i possibili

cammini tra il punto di partenza e quello di arrivo, che includono la traiettoria classica, per cui

l’azione è stazionaria.

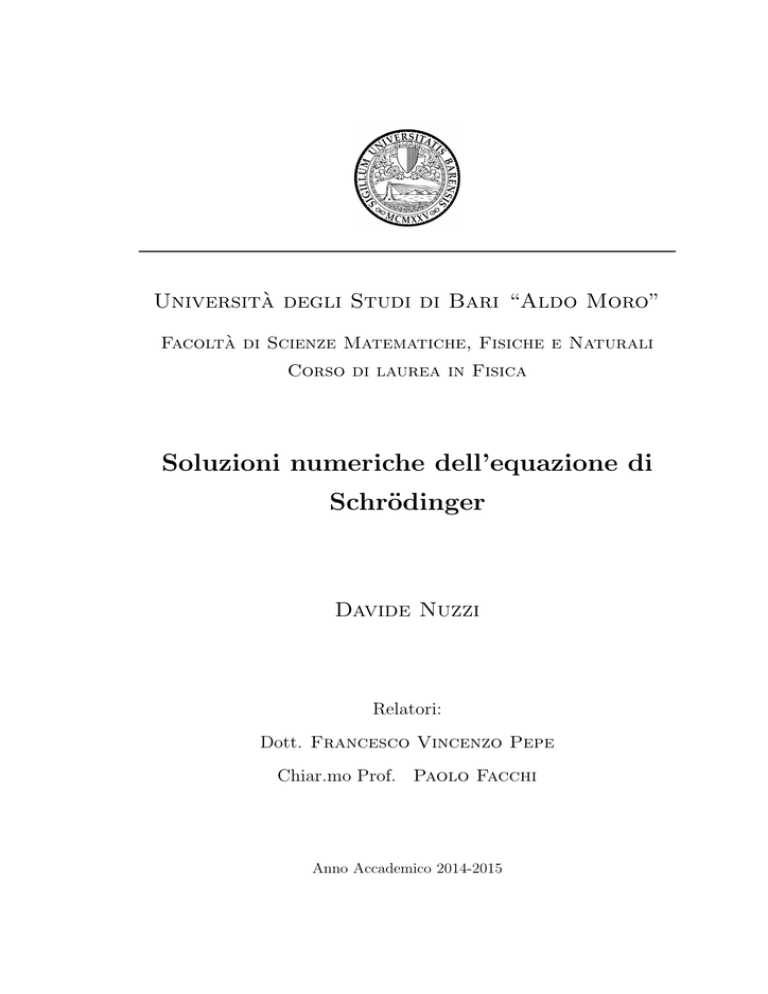

Una rappresentazione intuitiva di ciò è mostrata in figura 4.1.

È possibile mostrare che si può ottenere un limite classico per questa espressione [5]. Nel caso di

sistemi macroscopici l’azione assume valori che tipicamente sono più grandi di ~ di svariati ordini

di grandezza e ciò fa sı̀ che traiettorie lontane da quella classica provochino grandi variazioni di

24

Capitolo 4: Diffusione Montecarlo

1.2

1

0.8

x

0.6

0.4

0.2

0

−0.2

0

0.5

1

1.5

2

2.5

3

3.5

4

n∆t

Figura 4.1: Rappresentazione intuitiva dell’integrale sui cammini di Feynman per una particella che si propaga da x = 0 all’istante t = 0 fino a x = 1 all’istante t = 4∆t. La

traiettoria classica è rappresentata dalla linea continua, mentre le altre traiettorie

hanno opacità dipendente dalla loro distanza da quella classica

fase nel termine integrando, portando alla cancellazione dei loro contributi. Solo le traiettorie

molto vicine a quella classica interferiscono costruttivamente e danno contributo al propagatore.

Come si è detto, nel limite N → ∞ la spezzata diviene una curva x(t) e si può interpretare

la (4.2.6) come un integrale funzionale.

Il funzionale:

W [x(t)] = exp

i

S[x(t)]

~

(4.2.7)

viene integrato lungo tutte le traiettorie possibili x, definendo una nuova misura:

[dx] = lim

N →∞

m N2

2πi~∆t

Si può quindi scrivere:

K(x, x0 ; t) =

Z

N

−1

Y

Z

[dx] exp

dxn

(4.2.8)

(4.2.9)

RN −1 n=1

i

S[x(t)]

~

Queste espressioni rappresentano unicamente una riscrittura compatta del limite (4.2.6). Si può

far vedere che l’oggetto [dx] per come è stato definito non può essere una misura in quanto non

soddisfa la σ-additività, ma il propagatore lungo il tempo immaginario, utile per gli scopi di

questo lavoro, risulta posto su solide basi matematiche [6].

25

Capitolo 4: Diffusione Montecarlo

4.3

Valutazione del propagatore con metodo Montecarlo

Facendo riferimento alla (4.1.5) ed effettuando la rotazione di Wick t → −iτ si può scrivere

! N

Z

N

−1

Y

Y

K(x, x0 ; τ ) = lim

dxn

W (xn ) · P (xn , xn−1 )

(4.3.1)

N →∞

RN −1

n=1

n=1

V (xn )∆τ

W (xn ) = exp −

~

r

m

m(xn − xn−1 )2

exp −

P (xn , xn−1 ) =

2π~∆τ

2~∆τ

Dove il significato delle nuove funzioni W e P verrà chiarito a breve.

Si vuole puntualizzare che questo nuovo propagatore, in cui i termini oscillanti sono diventati

degli esponenziali reali, è ben definito e a differenza del propagatore di Feynman permette di

definire una misura [dx] che sia matematicamente corretta, detta misura di Wiener.

Questa misura è fortemente collegata alla teoria dei processi stocastici e all’equazione del calore,

ma nella trattazione qui esposta non si percorrerà questa strada e ci si concentrerà sul valutare

numericamente la (4.3.1) con un metodo Montecarlo e di darne solo successivamente un’interpretazione in termini di processo stocastico.

Verrà ora esposto brevemente il metodo di integrazione Montecarlo prima di applicarlo al nostro

caso. Si consideri un integrale nella forma:

Z

dx1 ... dxN f (x1 , ..., xN )P (x1 , ..., xN )

I=

(4.3.2)

RN

dove |I| < +∞ e la P rappresenta una densità di probabilità, con:

P (x1 , ..., xN ) ≥ 0 ∀(x1 , ..., xN ) ∈ RN ,

Z

dx1 ... dxN P (x1 , ..., xN ) = 1.

RN

Allora il valore di I può essere approssimato con la quantità

I=

Dove per ogni k la ennupla

N

1 X (k)

(k)

f x1 , ..., xN ,

N

(4.3.3)

k=1

(k)

(k)

viene estratta a caso in accordo con la densità di

x1 , ..., xN

probabilità P . Si può dimostrare, attraverso la legge dei grandi numeri, che:

lim I = I

N →∞

(4.3.4)

Basta quindi effettuare per N volte, con N sufficientemente grande, il campionamento della

funzione f in punti estratti casualmente (in accordo con la densità di probabilità P ) per ottenere

una buona stima dell’integrale.

Nel caso in esame conviene fare riferimento non direttamente al propagatore K(x, x0 ; t), ma alle

26

Capitolo 4: Diffusione Montecarlo

funzioni d’onda. Ricordando che, in accordo con la (1.2.7), la funzione d’onda a un istante t

può essere ottenuta come convoluzione tra il propagatore e la funzione d’onda all’istante iniziale,

possiamo scrivere

ψ(x, τ ) = lim

N →∞

Z

RN

N

−1

Y

dxn

n=0

!

N

Y

n=1

!

W (xn ) · P (xn , xn−1 ) ψ(x0 , 0),

(4.3.5)

Dove l’integrazione è stata estesa anche alla variabile x0 . Ora è più chiaro il significato delle P (xn , xn−1 ), che possono essere interpretate come densità di probabilità in accordo con le

richieste del metodo Montecarlo, attraverso la corrispondenza

!

N

Y

W (xn ) ψ(x0 , 0) → f (x0 , ...xN −1 )

n=1

N

Y

P (xn , xn−1 )

n=1

→

P (x0 , ..., xN −1 )

Si vede facilmente che quest’ultima soddisfa le richieste per essere interpretata come densità

di probabilità, essendo positiva in quanto prodotto di esponenziali reali ed è normalizzata. La

normalizzazione deriva dalla proprietà

Z

dxn−1 P (xn , xn−1 )P (xn−1 , xn−2 ) = P (xn , xn−2 ),

(4.3.6)

R

che può essere verificata con un calcolo diretto.

Si è quindi trovato un modo per approssimare la funzione d’onda ad un generico istante τ , che richiede solo di valutare un certo numero di volte il termine W in punti estratti casualmente da una

particolare distribuzione di probabilità. Rimane solo quindi da fissare una procedura per estrarre

le ennuple (x0 , ..., xN −1 ) in modo che si distribuiscano come previsto dalla P (x0 , ..., xN −1 ).

Prima di concentrarci su questo problema osserviamo che, come evidenziato nel Capitolo 1,

la funzione d’onda valutata in questa maniera non convergerebbe allo stato fondamentale per

τ → ∞ ma tenderebbe ad annullarsi. Si potrebbe pensare di normalizzare la ψ(x, τ ) al tempo

τ in modo da eliminare gli stati eccitati e preservare il solo stato fondamentale, che decade più

lentamente. Il metodo esaminato in questo capitolo rende però difficile effettuare un’operazione

di normalizzazione, quindi è necessario procedere in maniera differente rispetto a come si è fatto

per l’operator splitting.

Si ridefinisce il livello di riferimento per l’energia potenziale sottraendo da V (x) un termine ER

costante:

V (x)

→

V (x) − ER

Ciò modifica la (1.4.2) introducendo un ulteriore termine all’esponente:

(E1 − ER )τ

(E0 − ER )τ

φ0 (x) + c1 exp −

φ1 (x) + ...

ψ(x, τ ) = c0 exp −

~

~

che va a cambiare totalmente il comportamento per tempi lunghi della funzione d’onda.

• Se ER > E0 , la funzione d’onda tende a divergere esponenzialmente.

27

(4.3.7)

(4.3.8)

Capitolo 4: Diffusione Montecarlo

• Se ER = E0 , la funzione d’onda converge allo stato fondamentale a meno di un fattore

costante c0 .

• Se ER < E0 , la funzione d’onda tende ad annullarsi.

Ciò permette quindi di andare a cercare il valore dell’energia dello stato fondamentale studiando

il comportamento della norma della funzione d’onda.

Come si è detto resta da esplicitare come è possibile costruire l’ennupla di punti in accordo

con la densità di probabilità P .

Osserviamo che ogni termine P (xn , xn−1 ) rappresenta una gaussiana di media xn e varianza

σ 2 = ~∆τ /m. Quindi fissato xN = x il termine xN −1 è estratto da una distribuzione gaussiana

centrata in xN e con tale varianza. Ottenuto questo punto, si procede campionando xN −2 da

una distribuzione centrata in xN −1 , e cosı̀ via fino a x0 :

(k)

(k)

x(k)

n = xn−1 + σ ρn

∀k = 1... N ,

∀n = 0... N − 1

(4.3.9)

(k)

con ρn un numero casuale estratto da una distribuzione gaussiana di media 0 e varianza 1.

Questa sequenza di numeri rappresenta un random walk unidimensionale: ogni nuova coordinata

può essere ottenuta facendo uno spostamento casuale a partire dalla posizione precedente. Questa caratteristica non deve stupire, in quanto dopo la rotazione di Wick stiamo effettivamente

risolvendo l’equazione del calore e il legame tra essa e il moto Browniano è ben noto, a partire

dal lavoro pioneristico di Einstein nel 1905 [7]. Questa interpretazione verrà ulteriormente approfondita nella prossima sezione.

4.4

Walkers e processo di branching