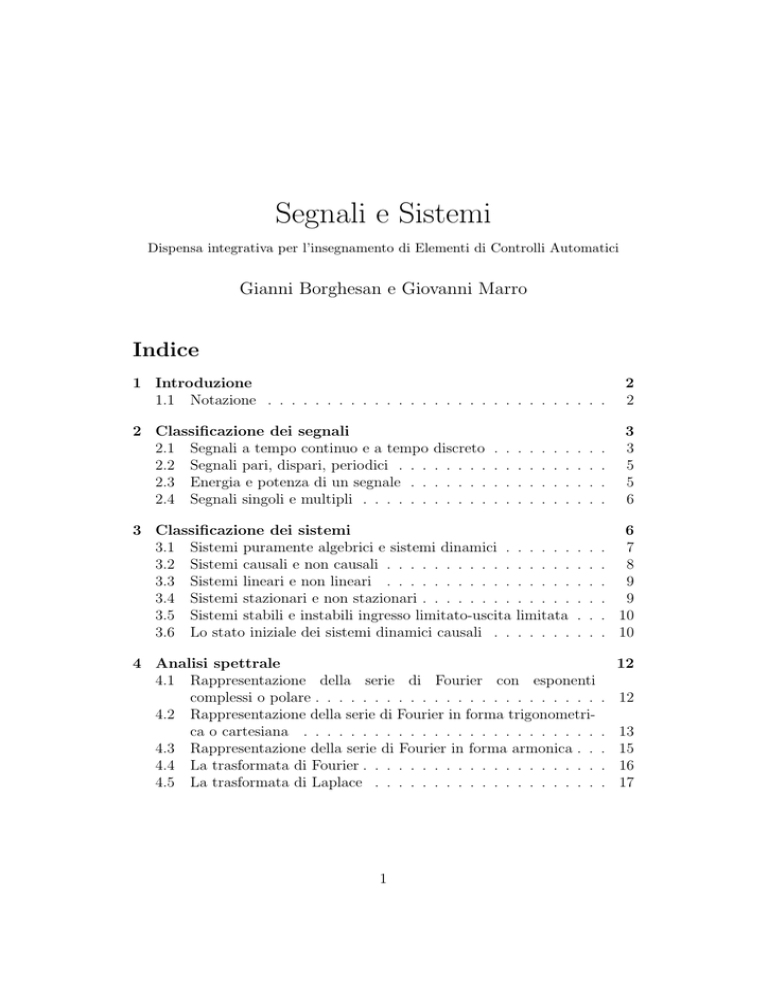

Segnali e Sistemi

Dispensa integrativa per l’insegnamento di Elementi di Controlli Automatici

Gianni Borghesan e Giovanni Marro

Indice

1 Introduzione

1.1 Notazione . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2

2

2 Classificazione dei segnali

2.1 Segnali a tempo continuo e a tempo

2.2 Segnali pari, dispari, periodici . . .

2.3 Energia e potenza di un segnale . .

2.4 Segnali singoli e multipli . . . . . .

3

3

5

5

6

discreto

. . . . .

. . . . .

. . . . .

.

.

.

.

.

.

.

.

3 Classificazione dei sistemi

3.1 Sistemi puramente algebrici e sistemi dinamici .

3.2 Sistemi causali e non causali . . . . . . . . . . .

3.3 Sistemi lineari e non lineari . . . . . . . . . . .

3.4 Sistemi stazionari e non stazionari . . . . . . . .

3.5 Sistemi stabili e instabili ingresso limitato-uscita

3.6 Lo stato iniziale dei sistemi dinamici causali . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. . . . .

. . . . .

. . . . .

. . . . .

limitata

. . . . .

.

.

.

.

.

.

.

.

.

.

.

.

6

. 7

. 8

. 9

. 9

. 10

. 10

4 Analisi spettrale

4.1 Rappresentazione della serie di Fourier con esponenti

complessi o polare . . . . . . . . . . . . . . . . . . . . . . . .

4.2 Rappresentazione della serie di Fourier in forma trigonometrica o cartesiana . . . . . . . . . . . . . . . . . . . . . . . . .

4.3 Rappresentazione della serie di Fourier in forma armonica . .

4.4 La trasformata di Fourier . . . . . . . . . . . . . . . . . . . .

4.5 La trasformata di Laplace . . . . . . . . . . . . . . . . . . .

1

12

. 12

.

.

.

.

13

15

16

17

1

Introduzione

Questo fascicoletto riporta alcuni complementi allo studio di Controlli

Automatici .

1.1

∈

∀

R

Rn

C

Cn

x∗

Z

C0

Ci

x(·)

x̃(·)

[α, β]

[α, β)

Notazione

appartenente a

per ogni

insieme dei numeri reali

insieme delle n-uple (vettori) di numeri reali

insieme dei numeri complessi

insieme delle n-uple (vettori) di numeri complessi

coniugato del numero complesso x

insieme dei numeri interi

classe delle funzioni limitate e continue a tratti

classe delle funzioni derivabili i volte q.o. con i-esima derivata ∈ C0

segnale a tempo continuo (x : R → R o x : R → C)

segnale a tempo discreto (x : Z → R o x : Z → C)

intervallo chiuso

intervallo aperto a destra

2

2

Classificazione dei segnali

Un segnale è una funzione che rappresenta il succedersi dei valori di una

grandezza fisica variabile nel tempo.

2.1

Segnali a tempo continuo e a tempo discreto

I segnali possono essere a tempo continuo o a tempo discreto. Questi si

rappresentano tipicamente come è indicato in Fig.1. Con il simbolo x(·) o x̃(·)

si indicherà l’ intero segnale a tempo continuo o discreto (la tilde caratterizza

il tempo discreto), mentre con x(t) o x̃(k) si indicherà il valore del segnale

all’ istante t o k.

x

0

x̃

-5 -4 -3 -2 -1 0 1 2

t

3

4 5

6

k

Figura 1: Segnali a tempo continuo e a tempo discreto.

Si noti che in entrambe le rappresentazioni è stata definita ed indicata con 0

un’ origine dei tempi , che determina la scala dei tempi. Quando l’ intervallo

di tempo in cui è definito il segnale non è specificato, si assume implicitamente

che sia t ∈ (−∞, ∞) o k ∈ (−∞, ∞). In altri casi esso viene dato, ad esempio

t ≥ 0 o k ≥ 0, oppure t ∈ [ta , tb ] o k ∈ [ka , kb ]. Anche l’ intervallo dei valori che

può assumere il segnale può essere o non essere esplicitamente specificato.

Esempi di segnali a tempo continuo: la temperatura in un ambiente, la corrente in un circuito elettrico, la pressione dell’ aria in un punto, che produce

un suono, rivelabile dall’ orecchio o da un microfono. Il microfono è un trasduttore, cioè un dispositivo che converte un segnale (pressione dell’ aria) in

un segnale di diverso tipo (tensione elettrica fra due terminali o corrente

elettrica in un circuito).

Esempi di segnali a tempo discreto: l’ indice di chiusura giornaliero della

Borsa di Milano, il traffico giornaliero in una stazione ferroviaria.

I segnali deterministici sono segnali i cui valori sono completamente assegnati

in ogni istante, mentre i segnali stocastici sono caratterizzati solo statisticamente. Ad esempio l’ indice di chiusura giornaliero della Borsa di Milano per

3

il passato è un segnale deterministico, per il futuro è un segnale stocastico.

Nel nostro contesto ci si occuperà solo di segnali deterministici.

x, x̃

x̃, x

0

0

t, k

k, t

Figura 2: Conversione da tempo continuo a tempo discreto e viceversa.

Spesso i segnali a tempo discreto si ottengono eseguendo il campionamento di

segnali a tempo continuo, come è indicato in Fig.2 a sinistra. Al campionamento in genere è associata la quantizzazione: al valore del segnale a tempo

continuo, espresso da un numero reale, viene associato un valore numerico

espresso da un numero finito di cifre, per cui esso può variare solo per incrementi finiti in un dato intervallo. La conversione inversa, da segnali a tempo

continuo a segnali a tempo discreto, viene eseguita mediante dispositivi di

tenuta, come è indicato in Fig.2 a destra.

I segnali a tempo continuo a valori reali si dicono anche segnali analogici ,

mentre i segnali a tempo discreto e a valori discreti si dicono segnali digitali .

I dispositivi che eseguono la conversione da segnali analogici a segnali digitali

si dicono convertitori analogico-digitale, mentre i dispositivi che eseguono la

conversione inversa si dicono convertitori digitale-analogico. I due tipi di

dispositivi vengono rappresentati negli schemi a blocchi come è indicato in

Fig.3.

x

A/D

x̃

x̃

D/A

x

Figura 3: Convertitore analogico-digitale e digitale-analogico.

Esempio: un suono registrato su un CD audio è campionato e quantizzato e

può essere riconvertito in segnale a tempo continuo mediante un dispositivo

di tenuta, amplificato e riconvertito in suono con un altoparlante.

È intuitivo che se il campionamento avviene a frequenza sufficientemente

elevata e la quantizzazione è sufficientemente fine la conversione di un segnale

4

analogico (a valori reali in un dato intervallo) in un segnale digitale (con un

numero finito di valori in un dato intervallo) e la conversione inversa possono

essere eseguite con errore trascurabile.

2.2

Segnali pari, dispari, periodici

Un segnale si dice pari se soddisfa la relazione

x(−t) = x(t) ∀ t

o

x̃(−k) = x̃(k) ∀ k

Un segnale si dice dispari se soddisfa la relazione

x(−t) = −x(t) ∀ t

o

x̃(−k) = −x̃(k) ∀ k

Gli esempi più comuni di segnali pari e dispari sono, rispettivamente, i segnali

x(t) = cos(ωt) e x(t) = sin(ωt).

Un segnale si dice periodico di periodo T o N se soddisfa la relazione

x(t + T ) = x(t) ∀ t

o

x̃(k + N ) = x̃(k) ∀ k

Il periodo fondamentale T0 o N0 è il più piccolo valore di T o N per cui le

precedenti relazioni sono soddisfatte.

2.3

Energia e potenza di un segnale

x

x

t

t

Figura 4: Segnale a energia finita e a potenza media finita.

L’ energia di un segnale a tempo continuo o discreto si definisce come

Z ∞

∞

X

2

E=

|x(t)| dt

o

E=

|x̃(k)|2

∞

k=−∞

5

La potenza media o valore efficace di un segnale a tempo continuo o discreto

si definisce come

1

P = lim

T →∞ T

Z

N

X

1

P = lim

|x̃(k)|2

N →∞ 2N + 1

k=−N

T /2

2

|x(t)| dt

o

−T /2

Esempi di segnali a tempo continuo ad energia finita e potenza media finita

sono rappresentati in Fig.4.

Per segnali periodici il valore efficace si riferisce al periodo e si definisce come

Z

1 X

1

|x(t)|2 dt

o

P =

|x̃(k)|2

(1)

P =

T T

N N

2.4

Segnali singoli e multipli

Nelle precedenti considerazioni con i simboli x(·) o x̃(·) ci si può riferire ad

una funzione che lega un solo valore reale alla variabile indipendente tempo

o ad una funzione che lega un vettore (n-upla di numeri reali) alla variabile

indipendente tempo. Nei due casi il segnale si dice rispettivamente singolo o

multiplo.

3

Classificazione dei sistemi

Un sistema è un modello matematico approssimante il comportamento di un

processo fisico, che lega un segnale di uscita o risposta y(·) ad un segnale di

ingresso o eccitazione x(·).

x

sistema

monovariabile

x1

x2

y

xp

sistema

multivariabile

y1

y2

yq

Figura 5: Sistema monovariabile e sistema multivariabile.

I sistemi si dicono a tempo continuo o a tempo discreto, a seconda del tipo di

segnale da essi elaborato. Nel caso dei sistemi a tempo continuo il segnale di

ingresso si suppone limitato e continuo a tratti (cioè con un numero finito di

punti di discontinuità per ogni intervallo temporale di misura finita), mentre

nel caso dei sistemi a tempo discreto il segnale di ingresso si suppone limitato.

6

Quindi un sistema equivale ad una trasformazione fra due funzioni. Nel caso

dei sistemi a tempo continuo si può scrivere

y(·) = F x(·) con x(·), y(·) definite in t ∈ (−∞, ∞)

(2)

mentre nel caso dei sistemi a tempo discreto si ha

ỹ(·) = F x̃(·) con x̃(·), ỹ(·) definite in k ∈ (−∞, ∞)

(3)

I segnali di ingresso e di uscita possono essere singoli o multipli. Nel primo

caso il sistema si dice monovariabile o SISO (single input-single output), nel

secondo si dice multivariabile o MIMO (multi input-multi output). In questo

secondo caso il valore della funzione di ingresso è un vettore a p componenti

reali e quello della funzione di uscita è un vettore a q componenti reali. Gli

schemi corrispondenti sono rappresentati in Fig.5.

3.1

Sistemi puramente algebrici e sistemi dinamici

Un sistema si dice puramente algebrico o privo di memoria se la sua uscita

all’ istante generico t o k dipende solo dal valore dell’ ingresso in quello stesso

istante. In caso contrario il sistema si dice dinamico o fornito di memoria.

R1

vi

R2

R

vu

vi

C

vu

Figura 6: Sistema puramente algebrico e sistema dinamico.

Esempi: Le relazioni

R2

vi (t) ,

t ∈ (−∞, ∞)

R1 + R2

Z t

1

vi (τ ) − vu (τ ) dτ ,

t, τ ∈ (−∞, ∞)

vu (t) =

R C −∞

vu (t) =

(4)

(5)

che si riferiscono ai circuiti elettrici di Fig.6, descrivono rispettivamente un

sistema a tempo continuo privo di memoria e un sistema a tempo continuo

fornito di memoria.

7

Le relazioni

ỹ(k) = k 2 x̃(k) ,

ỹ(k) =

k

X

p

k ∈ (−∞, ∞)

x̃(h) ,

k, h ∈ (−∞, ∞)

(6)

(7)

h=−∞

descrivono rispettivamente un sistema a tempo discreto privo di memoria e

un sistema a tempo discreto fornito di memoria.

3.2

Sistemi causali e non causali

Un sistema si dice causale se per ogni valore del tempo l’ uscita y(t) o ỹ(k)

all’ istante generico t o k dipende solo dai valori dell’ ingresso all’ istante

attuale o agli istanti precedenti, cioè da valori della funzione x(τ ), τ ∈ (−∞, t]

o x̃(h), h ∈ (−∞, k]. In caso contrario il sistema si dice non causale.

Esempi. I sistemi (4), (5), (6), (7) sono causali. Altri esempi di sistemi

causali sono

y(t) = x(t − t0 ) ,

t ∈ (−∞, ∞)

ỹ(k) = x̃(k − k0 ) ,

k ∈ (−∞, ∞)

(8)

(9)

con t0 reale non negativo e k0 intero non negativo. Questi sistemi sono detti

ritardi finiti, in quanto il segnale di uscita è uguale al segnale di ingresso

ritardato di t0 o k0 , mentre i sistemi

y(t) = x(t + t0 ) ,

t ∈ (−∞, ∞)

ỹ(k) = x̃(k + k0 ) ,

k ∈ (−∞, ∞)

detti anticipi finiti , sono non causali. L’ integratore

Z t

x(τ ) dτ ,

t, τ ∈ (−∞, ∞)

y(t) =

(10)

(11)

(12)

−∞

è un sistema causale, mentre il derivatore

d

x(t) ,

t ∈ (−∞, ∞)

(13)

dt

è non causale. Si considerino infatti i segnali gradino unitario, rappresentato

a sinistra in Fig.7 e rampa unitaria, rappresentato a destra nella stessa figura.

Per integrare il gradino ricavandone la rampa è sufficiente conoscerne i valori

fino all’ istante attuale, mentre il calcolo della derivata della rampa all’ istante

0 è un’ operazione non causale, in quanto per eseguire il limite destro (e quindi

ricostruire la discontinuità del gradino) occorre conoscere valori futuri.

y(t) =

8

1

1

1

0

t

0

t

Figura 7: Gradino unitario e rampa unitaria.

3.3

Sistemi lineari e non lineari

Un sistema a tempo continuo descritto dall’ equazione (2), si dice lineare se,

essendo

y1 (·) = F x1 (·) ,

y2 (·) = F x2 (·)

vale la relazione

α1 y1 (·) + α2 y2 (·) = F α1 x1 (·) + α2 x2 (·)

per ogni coppia di numeri reali α1 , α2 . La definizione di linearità per un

sistema a tempo discreto descritto dall’ equazione (3) è del tutto analoga.

Un sistema che non sia lineare si dice non lineare.

Esempi: i sistemi (4), (5), (6), (8), (9), (10), (11), (12), (13) sono lineari,

mentre il sistema (7) è non lineare.

3.4

Sistemi stazionari e non stazionari

Un sistema a tempo continuo si dice stazionario o tempo invariante se una

traslazione nel tempo in anticipo o in ritardo del segnale di ingresso produce

la stessa traslazione nel tempo del segnale di uscita, cioè se

y(t − t0 ) = F x(t − t0 ) ,

t ∈ (−∞, ∞)

per ogni valore reale di t0 , positivo o negativo. Un sistema che non sia

stazionario si dice non stazionario o tempo variante. Analogamente, per un

sistema a tempo discreto la stazionarietà corrisponde alla relazione

ỹ(k − k0 ) = F x̃(k − k0 ) ,

k ∈ (−∞, ∞)

per ogni valore intero di k0 , positivo o negativo.

Esempi: i sistemi (4), (5), (7), (8), (9), (10), (11), (12), (13) sono stazionari,

mentre il sistema (6) è non stazionario.

9

3.5

Sistemi stabili e instabili ingresso limitato-uscita

limitata

Un sistema a tempo continuo si dice stabile ingresso limitato-uscita limitata

(i.l.u.l.) se per ogni costante reale k1 tale che il segnale di ingresso soddisfi

la relazione

|x(t)| ≤ k1 ,

t ∈ (−∞, ∞)

esiste una costante reale k2 tale che il corrispondente segnale di uscita soddisfa

la relazione

|y(t)| ≤ k2 ,

t ∈ (−∞, ∞)

Un sistema che non sia stabile i.l.u.l. si dice instabile ingresso limitato-uscita

limitata. Nel caso dei sistemi a tempo discreto la definizione di stabilità

i.l.u.l. è del tutto analoga.

Esempi: i sistemi (4), (5), (7), (8), (9), (10), (11), (13) sono stabili i.l.u.l.,

mentre i sistemi (6), (12) sono instabili i.l.u.l.

3.6

Lo stato iniziale dei sistemi dinamici causali

In molti casi il comportamento dei sistemi dinamici causali viene analizzato

a partire da un certo istante, in genere l’ origine 0 dell’ asse tempi. In questi

casi in luogo dei modelli (2), (3) si usano modelli del tipo

y(·) = F s0 , x(·) con x(·), y(·) definite in t ∈ [0, ∞)

(14)

ỹ(·) = F s0 , x̃(·) con x̃(·), ỹ(·) definite in k ∈ [0, ∞)

(15)

in cui s0 indica lo stato iniziale, consistente in un parametro (numero reale,

vettore o funzione) che compendia l’ informazione necessaria per determinare

il comportamento futuro del sistema.

In questi casi si definisce la risposta libera, cioè dovuta al solo stato iniziale,

con segnale di ingresso identicamente nullo

y1 (·) = F(s0 , 0) ,

ỹ1 (·) = F(s0 , 0)

e la risposta forzata, dovuta al solo segnale di ingresso, con stato iniziale

nullo,

y2 (·) = F 0, x(·) ,

ỹ2 (·) = F 0, x̃(·)

Nel caso dei sistemi lineari la risposta è data dalla somma della risposta

libera e della risposta forzata ed entrambe le risposte sono funzioni lineari.

Esempi: il sistema (5) si può descrivere con la relazione

Z t

1

vu (t) = s0 +

vi (τ ) − vu (τ ) dτ ,

t, τ ∈ [0, ∞)

(16)

RC 0

10

con s0 = vu (0). La conoscenza della tensione di carica del condensatore

all’ istante t = 0 equivale pertanto alla conoscenza del segnale di ingresso vi (·)

nell’ intervallo t ∈ (−∞, 0). Il sistema (7) equivale a

ỹ(k) = s0 +

k

X

p

x̃(h) ,

s0 = ỹ(0) , k, h ∈ [0, ∞)

h=0

Il sistema (12) equivale a

Z t

x(τ ) dτ ,

y(t) = s0 +

s0 = y(0) , t, τ ∈ [0, ∞)

0

11

4

Analisi spettrale

L’ analisi spettrale permette di caratterizzare un segnale attraverso le sue

frequenze. Gli strumenti utilizzati per trovare il contenuto frequenziale di

un segnale sono lo sviluppo in serie in serie di Fourier e la trasformata di

Fourier , rispettivamente per i segnali periodici e i segnali aperiodici, definiti

in t ∈ (−∞, ∞). Dalla trasformata di Fourier si deduce la trasformata di

Laplace, per segnali definiti in t ∈ [0, ∞), di largo impiego nello studio dei

sistemi causali il cui segnale di uscita dipende sia dalla funzione applicata

all’ ingresso sia dallo stato iniziale.

4.1

Rappresentazione della serie

esponenti complessi o polare

di

Fourier

con

Lo sviluppo in serie di Fourier di una funzione x(t) periodica di periodo T

continua a tratti e a valori complessi corrisponde ad un cambio di coordinate

dal dominio del tempo al dominio delle frequenze. Come nel caso dello

sviluppo in serie di Taylor, lo sviluppo in serie di Fourier rappresenta un

cambio di coordinate in cui la base è rappresentata da funzioni, cioè la

funzione oggetto è espressa da una combinazione lineare di altre funzioni

ϕn (t), n ∈ Z, in genere a valori complessi, che si suppongono ortogonali, cioè

soddisfacenti la proprietà

Z

ϕn (t) ϕ∗m (t)dt = T δnm

(17)

T

in cui con ϕ∗ si indica il coniugato del numero complesso ϕ e con δnm , si indica

il simbolo di Kronecker , che per definizione vale 1 se n = m, 0 se m 6= n.

La (17) è soddisfatta dalle funzioni

ϕn (t) = ejnΩt ,

con Ω =

2π

T

Infatti in questo caso è

ϕn (t) ϕ∗m (t) = ej(n−m)Ωt = cos(n − m)Ωt + j sin(n − m)Ωt

funzione manifestamente uguale ad 1 per n = m e periodica di periodo T , il

cui integrale in T vale pertanto T per n = m e 0 per n 6= m. Lo sviluppo in

serie di Fourier della funzione x(t) è espresso dalla relazione

x(t) =

∞

X

n=−∞

12

cn ejnΩt

(18)

in cui i coefficienti cn si calcolano con le relazioni

Z

1

x(t) e−jnΩt dt

cn =

T T

(19)

che si deducono moltiplicando per e−jmΩt /T ambo i membri della (18) e

integrando nel periodo:

Z

Z

∞

∞

X

1

1 X

jnΩt −jmΩt

−jmΩt

cn e

e

dt =

cn δnm = cm

x(t) e

dt =

T T

T n=−∞

T

n=−∞

Le (18) e (19) si dicono equazione di sintesi ed equazione di analisi . I

coefficienti ck sono numeri complessi, detti coefficienti complessi di Fourier.

Nel caso in cui il segnale sia reale vale la relazione

cn = c∗−n

(20)

Consideriamo ora il valore efficace, partendo dalla definizione data in precedenza, e dimostriamo il teorema di Parseval , che lega la potenza media o

valore efficace ai coefficienti della serie di Fourier:

Z

∞

X

1

2

(21)

|x(t)| dt =

|cn |2

T T

n=−∞

che si dimostra con i seguenti passaggi

Z

Z

∞

X

1

1

2

|x(t)| dt =

cn c∗m ejnΩt e−jmΩt dt

P =

T T

T T n,m=−∞

Z

∞

1 X

∗

jnΩt −jmΩt

=

cn cm

e

e

dt

T n,m=−∞

T

=

∞

X

n,m=−∞

4.2

cn c∗m δnm

=

∞

X

|cn |2

n=−∞

Rappresentazione della serie di Fourier in forma

trigonometrica o cartesiana

Si considera il caso in cui la funzione x(t) sia reale, caso in cui è soddisfatta

la (20). Si noti che nello sviluppo (18) il termine corrispondente ad n = 0,

che si può scrivere

Z

1

c0 =

x(t) dt

T T

13

rappresenta il valor medio nel periodo, mentre le coppie corrispondenti ciascuna ad un dato valore di n ed al suo opposto danno luogo a termini in seno

e coseno dei tipi an cos nΩt e bn sin nΩt. Infatti per ciascuna di tali coppie

valgono le relazioni

c−n e−jnΩt + cn ejnΩt = (Re cn − j Im cn ) (cos nΩt − j sin nΩt) +

(Re cn + j Im cn ) (cos nΩt + j sin nΩt)

= 2 Re cn cos nΩt − 2 Im cn sin nΩt

mentre la (19) si può scrivere

1

cn = Re cn + j Im cn =

T

Z

T

1

x(t) cos nΩt dt − j

T

Z

x(t) sin nΩt dt

T

Posto

a0 = 2 c 0 ,

an = 2 Re cn ,

bn = −2 Im cn ,

(n > 0)

(22)

si deduce immediatamente la forma trigonometrica dello sviluppo in serie di

Fourier, le cui equazioni di sintesi e analisi sono

∞

a0 X

x(t) =

+

an cos nΩt + bn sin nΩt

2

n=1

2

an =

T

Z

T

2

x(t) cos nΩt dt , bn =

T

Z

x(t) sin nΩt dt (n ≥ 0)

(23)

(24)

T

Questo tipo di rappresentazione mostra con chiarezza le propietà che hanno

gli sviluppi in serie di segnali pari e dispari; un segnale pari può essere

sviluppato in serie di soli coseni:

∞

a0 X

x(t) =

+

an cos nΩt

2

n=1

Analogamente, un segnale periodico dispari si sviluppa come somma di soli

seni:

∞

X

x(t) =

bn sin nΩt

n=1

Altro vantaggio di questa rappresentazione è la possibilità di scomporre il

segnale nella somma di un segnale pari ed un segnale dispari. Utilizzando

questa propietà si possono caratterizzare i segnali reali pari e dispari sviluppati in serie polare: un segnale pari avrà coefficienti cn reali, mentre uno

dispari avrà coefficienti immaginari puri, con cn = − c−n .

14

La potenza media in questo caso è data da

∞

P =

4.3

a20 X 2

+

an + b2n

4

n=1

(25)

Rappresentazione della serie di Fourier in forma

armonica

Questa rappresentazione è adatta a rappresentare solamente segnali reali.

Essa mette in evidenza con chiarezza ampiezza Cn e angolo di fase ϑn della nesima armonica. C0 è detta componente continua, mentre la prima armonica

è detta fondamentale. Le equazioni di sintesi ed analisi sono rispettivamente

x(t) = C0 +

∞

X

Cn cos(nΩt − ϑn )

(26)

n=1

C0 =

a0

,

2

Cn =

p

a2n + b2n ,

ϑn = arg(an + j bn )

(27)

e la potenza media è

∞

X

P =

Cn2

(28)

n=0

La (26) si ricava applicando relazione trigonometrica

cos α cos β + sin α sin β = cos (α − β)

alla (23), considerando che le (27) esprimono le relazioni

an = Cn cos ϑn ,

bn = Cn sin ϑn

Una forma armonica equivalente alle (26), (27) è

x(t) = C0 +

∞

X

Cn sin(nΩt + ϕn )

n=1

C0 =

a0

,

2

Cn =

p

a2n + b2n ,

15

ϕn = arg(bn + j an )

4.4

La trasformata di Fourier

Si applichi lo sviluppo in serie (18) ad una funzione periodica f (t) a valori

reali o complessi, si ponga F (nΩ) = cn (funzione discreta con periodo Ω della

pulsazione continua ω) e si applichi il fattore 1/T . Contemporaneamente si

applichi il fattore T alla (19), ottenendo le relazioni

∞

1 X

f (t) =

F (nΩ) ejnΩt

T n=−∞

F (nΩ) =

(29)

T /2

Z

f (t) e−jnΩt dt

(30)

−T /2

che sono, ovviamente, anch’ esse legate dalla proprietà di biunivocità. Si

suppone che la funzione f (t), non necessariamente periodica, sia ad energia

finita, cioè che soddisfi la condizione

Z ∞

|f (t)| dt ≤ M < ∞

(31)

−∞

Posto ω = nΩ, ∆Ω = ω/n = Ω, la (30) si può scrivere

Z π/∆Ω

f (t) e−jωt dt

F (ω) =

−π/∆Ω

e, per ∆Ω → 0 (n → ∞),

F (ω) =

∞

Z

f (t) e−jωt dt

(32)

−∞

mentre la (29), che si può scrivere

f (t) =

∞

1 X

F (nΩ) ejnΩt ∆Ω

2π n=−∞

al limite per ∆Ω → 0 diventa

1

f (t) =

2π

Z

∞

F (ω) ejωt dω

(33)

−∞

Le (32) e (33) definiscono rispettivamente la trasformata di Fourier e

l’ antitrasformata di Fourier , che si applicano a funzioni impulsive, definite nell’ intervallo t ∈ (∞, ∞), limitate, continue a tratti e ad energia limitata,

16

f

f

e−σc t

0

t

0

a)

1

σc

t

b)

Figura 8: Segnali trasformabili secondo Fourier e secondo Laplace.

cioè soddisfacenti la (31). Un esempio è riportato in Fig.8,a. Il teorema

di Parseval consente di calcolare l’ energia del segnale dalla trasformata di

Fourier. Esso è espresso dalla relazione

Z ∞

Z ∞

1

2

|F (ω)|2 dω

|f (t)| dt =

E=

(34)

2π

−∞

−∞

4.5

La trasformata di Laplace

Si consideri ora una funzione f (t) a valori reali o complessi del tipo rappresentato in Fig.8,b, definita in [0, ∞), continua a tratti, limitata per ogni

valore finito del tempo e tale che esista un numero reale σ̄ per cui è

Z ∞

|f (t)| e−σ̄t dt ≤ M < ∞

(35)

0

Se la (35) è soddisfatta per un dato valore di σ̄, essa è soddisfatta per

ogni valore maggiore di esso. L’ estremo inferiore σc dell’ intervallo (in molti

casi aperto) dei valori di σ̄ per cui la (35) è soddisfatta si dice ascissa di

convergenza di f (t). Sotto tali condizioni la funzione f (t) e−σt ammette

trasformata di Fourier per ogni σ > σc . Tale trasformata di Fourier è

Z ∞

f (t) e(−σ−jω)t dt

(36)

F (σ + jω) =

0

definita nel semipiano del piano complesso Re s > σc . L’ antitrasformata è

Z j∞

1

−σt

f (t) e

=

F (σ + jω) ejωt dω

2π −j∞

cioè

1

f (t) =

2π

Z

j∞

F (σ + jω) e(σ+jω)t dω

−j∞

17

e, operando il cambio di variabili s = σ + jω,

1

f (t) =

2πj

Z

σ0 +j∞

F (s) est ds

(37)

σ0 −j∞

in cui l’ integrale nel piano complesso si intende eseguito lungo una retta parallela all’ asse imaginario, di ascissa σ0 , contenuta nel semipiano di convergenza. Lungo tale retta si ha ds = dσ + jdω = jdω. La trasformata di Laplace

di f (t) è definita dalla (36), che si può scrivere nella forma più compatta

F (s) =

Z

∞

f (t) e−st dt

0

mentre la (37) definisce l’ antitrasformata di Laplace di F (s).

18

(38)