ANNO ACCADEMICO 2008-2009

Facoltà di Scienze Matematiche, Fisiche e Naturali

Corso di Laurea in Fisica

Tesi di Laurea

Dinamica di reti neuronali

Candidato:

Simona Olmi

Relatore:

Correlatore:

prof. Roberto Livi

dott. Alessandro Torcini

28 luglio 2009

Indice

1 Elementi di neurofisiologia

1

1.1 I neuroni . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1

1.2 I segnali neuronali ed il potenziale di azione . . . . . . . . . . . . . .

3

1.3 Le sinapsi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.4 Introduzione alla dinamica neuronale . . . . . . . . . . . . . . . . . .

5

1.5 La membrana cellulare del neurone . . . . . . . . . . . . . . . . . . .

7

1.6 Canali ionici e correnti ioniche . . . . . . . . . . . . . . . . . . . . . .

9

1.7 Origine del potenziale di riposo . . . . . . . . . . . . . . . . . . . . . 11

1.7.1

Un modello cellulare semplificato . . . . . . . . . . . . . . . . 11

1.7.2

L’equazione di Nerst . . . . . . . . . . . . . . . . . . . . . . . 12

1.7.3

Effetto del sodio e pompe ioniche . . . . . . . . . . . . . . . . 13

1.7.4

Effetto della permeabilità ionica e dei meccanismi di trasporto 14

1.8 Proprietà elettriche passive della membrana . . . . . . . . . . . . . . 16

2 Modelli semplificati di neuroni e reti neurali

19

2.1 Dal modello di Hodgkin-Huxley al modello leaky integrate and fire . . 20

2.2 Neuroni leaky integrate-and-fire . . . . . . . . . . . . . . . . . . . . . 25

2.2.1

Correnti sinaptiche . . . . . . . . . . . . . . . . . . . . . . . . 28

2.2.2

Adattamento del tasso di sparo e refrattarietà . . . . . . . . . 30

I

2.3 Reti neurali . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

2.3.1

Rete di neuroni LIF globalmente accoppiati: il modello . . . . 34

2.3.2

Mappa guidata dall’evento . . . . . . . . . . . . . . . . . . . . 37

2.3.3

Stabilità lineare . . . . . . . . . . . . . . . . . . . . . . . . . . 39

2.4 Impulso di durata finita . . . . . . . . . . . . . . . . . . . . . . . . . 41

2.4.1

Lunghezze d’onda grandi . . . . . . . . . . . . . . . . . . . . . 43

2.4.2

Lunghezze d’onda piccole . . . . . . . . . . . . . . . . . . . . . 44

2.4.3

Diagramma di fase e correzioni di taglia finita . . . . . . . . . 44

2.4.4

Altri stati collettivi della rete . . . . . . . . . . . . . . . . . . 47

2.5 Desincronizzazione in reti neurali diluite . . . . . . . . . . . . . . . . 50

Capitolo 1

Elementi di neurofisiologia

In questo capitolo introdurremo alcuni concetti basilari relativi alla neurofisiologia

del neurone. In particolare, dopo una breve descrizione della morfologia del neurone e delle sinapsi, analizzeremo quei particolari segnali elettrici emessi durante la

dinamica neuronale chiamati potenziali di azione i quali rappresentano l’unità elementare di informazione scambiabile fra i neuroni. Inoltre descriveremo in dettaglio

le caratteristiche della membrana cellulare, sia a riposo che eccitata, con particolare

attenzione alle sue proprietà elettriche.

1.1

I neuroni

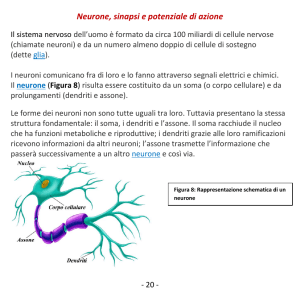

I neuroni sono cellule del sistema nervoso altamente specializzate e dedicate al

trasferimento, immagazzinamento ed elaborazione delle informazioni. Tale elaborazione avviene attraverso segnali elettrici dovuti a differenze di potenziale associate

a correnti elettriche di natura ionica (essenzialmente sono rilevanti solo gli ioni sodio, potassio, calcio e cloro) che attraversano la membrana cellulare del neurone.

I neuroni sono in numero molto elevato e sono connessi fra di loro in modo molto

intricato (vedi fig.1.1): ad esempio nella corteccia cerebrale si ha una densità superiore a 104 neuroni/mm3 . Tipicamente, pur nella varietà di tipi di cellule neuronali

(neuroni della corteccia cerebrale, motoneuroni del midollo spinale, ecc.), possiamo

riconoscere tre parti morfologicamente e funzionalmente distinte: il corpo cellulare

o soma; i dendriti e gli assoni. Il soma ha una struttura compatta che risulta approssimativamente sferica (di circa 70 µm di diametro) ed è sostanzialmente l’unità

deputata all’elaborazione dell’informazione. I dendriti sono estensioni del soma con

una struttura molto ramificata che si estendono per distanze che possono raggiungere il millimetro ed hanno la funzione di raccogliere i segnali provenienti dagli altri

neuroni e trasmetterli al soma. Gli assoni sono lunghe protuberanze (anche oltre

un metro nei neuroni motori degli organismi animali superiori) che si proiettano dal

soma e la loro funzione consiste nella trasmissione del segnale generato dal soma

verso i dendriti di un’altro neurone. Usando la terminologia dei circuiti elettronici si

può quindi dire che i dendriti rappresentano il dispositivo di ingresso (”input”), gli

assoni il dispositivo di uscita (”output”) e il soma l’unità di elaborazione delle informazioni. La morfologia di un particolare tipo di neurone nonché la sua posizione

nella rete neuronale forniscono indizi sulla funzione espletata: ad esempio il livello

di arborizzazione fornisce un’idea del numero di connessioni che può ricevere e verso

quante altre cellule neuronali invii i propri segnali (vedi fig.1.2).

Figura 1.1. Neuroni della corteccia dei mammiferi osservati al microscopio. Possiamo distinguere neuroni con corpi cellulari triangolari e circolari: la cellula b è

un classico esempio di cellula piramidale con corpo triangolare [10].

Figura 1.2.

Forme e dimensioni dei neuroni [11].

1.2

I segnali neuronali ed il potenziale di azione

Si definisce potenziale di membrana la differenza di potenziale misurata ai capi di

due elettrodi, uno posto all’interno della cellula neuronale ed uno posto nel liquido

extracellulare circostante. Quando si parla di segnale neuronale ci si riferisce alla

variazione temporale e spaziale del potenziale di membrana. Quando il neurone è

a riposo, ossia non è in qualche modo eccitato dall’esterno (e chiariremo nel seguito

cosa si intende), il potenziale di membrana assume un valore caratteristico denominato potenziale di riposo, tipicamente dell’ordine di -65mV, ossia l’interno della

cellula si trova ad un potenziale inferiore rispetto all’esterno.

I potenziali di azione sono impulsi di tensione tipici generati durante la dinamica

neuronale; essi hanno una forma pressoché stereotipata e non sono soggetti ad attenuazione o distorsione durante la propagazione lungo l’assone. In fig.2.3 è riportata

la forma tipica di un potenziale di azione. Si notino le seguenti caratteristiche:

• l’impulso di tensione ha una durata di circa 1-2 ms ed una ampiezza misurata

fra il minimo ed il massimo di circa 100-120 mV;

• nella prima fase dell’impulso si assiste ad una crescita veolce del potenziale di

membrana fino ad arrivare ad una fase denominata di depolarizzazione dove

il potenziale di membrana diventa positivo, cioè l’interno della cellula si trova

ad un potenziale superiore rispetto all’esterno;

• nella fase di discesa l’impulso prima di ritornare al valore di riposo passa

attraverso una fase denominata di iperpolarizzazione, tipicamente della durata

di circa 10 ms (e quindi molto piú lenta della depolarizzazione), in cui la cellula

presenta un potenziale di membrana inferiore rispetto a quello di riposo.

Il potenziale di azione, che una volta generato nella cellula neuronale, viaggia lungo

l’assone ed è trasmesso agli altri neuroni, costituisce l’unità elementare associata

alla trasmissione dei segnali neuronali. Tipicamente quindi quando ci si riferisce al

segnale emesso da un neurone si intende la sequenza temporale di questi potenziali

di azione, detta anche treno di impulsi (in inglese spike train).

Figura 1.3.

1.3

Forma tipica di un potenziale di azione (o impulso) [9].

Le sinapsi

La sinapsi costituisce essenzialmente la giunzione tra due neuroni ossia la struttura

attraverso la quale le informazioni sono trasferite da una cellula nervosa all’altra.

In tale contesto si definisce neurone presinaptico il neurone ”trasmettente” i potenziali di azione, a monte della sinapsi, e neurone postsinaptico il neurone ”ricevente”

i potenziali di azione, a valle della sinapsi. Con questa terminologia la sinapsi è

quindi la regione in cui l’assone del neurone presinaptico ”interagisce” con il dendrite del neurone postsinaptico. Si definisce inoltre potenziale postsinaptico (che ha

come acronimo PPS ) la risposta in tensione del neurone postsinaptico conseguente

all’arrivo del potenziale di azione proveniente dal neurone presinaptico.

Si distinguono essenzialmente due tipi di sinapsi: la sinapsi chimica e la sinapsi elettrica (altrimenti detta gap-junction). La sinapsi chimica, della quale è riportato lo schema in fig.1.4, risulta la più comune nel cervello dei vertebrati e si

basa sul meccanismo che andiamo a descrivere. Il potenziale di azione generato

dal neurone presinaptico, giunto all’estremità dell’assone depolarizza localmente la

membrana cellulare causando il rilascio all’interno della fessura sinaptica (ossia il

piccolo spazio tra le due membrane cellulari presinaptiche e postsinaptiche), da

parte di strutture poste sull’assone denominate vescicole sinaptiche, di particolari

sostanze chimiche denominate neurotrasmettitori. Il neurotrasmettitore, non appena raggiunto il versante postsinaptico della sinapsi, è rivelato da speciali molecole

(chemorecettori ) poste sulla membrana postsinaptica che provocano l’apertura (o

direttamente o tramite una catena di segnali biochimici) di specifici canali attraverso i quali una corrente ionica fluisce dal liquido extracellulare alla cellula. L’ingresso

di questi ioni porta a sua volta ad una variazione del valore del potenziale di membrana postsinaptico. Dunque in una sinapsi chimica si ha prima la trasformazione

di un segnale elettrico in un segnale chimico sulla membrana presinaptica e poi la

successiva trasformazione sulla membrana postsinaptica di un segnale chimico in un

segnale elettrico. La sinapsi elettrica realizza invece un accoppiamento elettrico tra

due neuroni attraverso canali ionici altamente specializzati (detti gap-junctions) che

collegano la membrana presinaptica e postsinaptica. La sinapsi elettrica permette

perciò un flusso di corrente diretto tra neuroni adiacenti.

Figura 1.4. Esempio di sinapsi chimica: la terminazione presinaptica libera una

sostanza chimica, il neurotrasmettitore, in risposta ad una depolarizzazione [11].

1.4

Introduzione alla dinamica neuronale

Abbiamo già accennato che l’arrivo di un potenziale di azione dal neurone presinaptico provoca una risposta in tensione (il potenziale postsinaptico) nel potenziale di

membrana del neurone ricevente. A tal proposito si distingue tra potenziale postsinaptico eccitatorio (che ha come acronimo PPSE ) e potenziale postsinaptico inibitorio (che ha come acronimo PPSI ) a seconda che l’effetto sia quello di aumentare

ovvero di diminuire il valore del potenziale di membrana. Analogo significato ha

la distinzione tra sinapsi eccitatoria e sinapsi inibitoria ovvero tra stimolo depolarizzante e stimolo iperpolarizzante. Il numero di contatti sinaptici dipende dal

tipo di neurone: ad esempio i neuroni della corteccia cerebrale (neuroni corticali )

possiedono migliaia di contatti sinaptici (da 3 · 103 a 104 ) con gli altri neuroni della

corteccia dei quali circa l’85% sono eccitatori ed il resto inibitori. In realtà solo una

frazione dell’ordine del 5-10% risultano sinapsi realmente attive [1, 13]. Per avere

un’idea dell’ampiezza di un PPSE si veda la fig.1.5 in cui sono riportati i PPSE

registrati su una cellula neuronale ed il relativo istogramma delle altezze di picco:

come si vede il valor medio è dell’ordine di 0.5 mV. In fig.1.6 è riportata una rappre-

Figura 1.5. Registrazione di 479 PPSE sul soma di cellule piramidali della corteccia visuale del ratto, in presenza di attività neuronale spontanea (fig.A). Istogramma delle altezze di picco dei PPSE (fig.B) [14].

sentazione schematica della dinamica neuronale che si instaura in risposta all’arrivo

di impulsi da neuroni presinaptici:

fig.A: un neurone postsinaptico i riceve impulsi da due neuroni presinaptici j = 1,2;

ui (t) e urest rappresentano rispettivamente il potenziale di membrana e il valore

(f )

del potenziale di riposo del neurone i; la quantità ǫi1 (t − t1 ) rappresenta il

(f )

potenziale postsinaptico generato dall’arrivo all’istante t1

di un impulso dal

neurone j = 1;

(f )

fig.B: un impulso che arriva dall’altro neurone presinaptico j = 2 ad un istante t2 ,

entro un intervallo di tempo sufficientemente breve, causa un secondo potenziale postsinaptico che si somma al precedente; in questo regime la risposta

del neurone postsinaptico risulta approssimativamente lineare nel senso che la

risposta è circa proporzionale agli input che riceve;

fig.C: quando ui (t) raggiunge un valore tipico, θ, denominato soglia di attivazione,

il comportamento del neurone diviene altamente non lineare: è generato un

potenziale di azione (il picco dell’impulso rappresentato da una freccia è fuori

dalla scala della figura) che ha una forma stereotipata e quindi senza legame

con gli stimoli che lo hanno prodotto; inoltre il neurone, per tutta la durata

del potenziale di azione, diviene per cosı̀ dire ”insensibile”, ovvero refrattario,

agli stimoli che gli arrivano dagli altri neuroni.

La refrattarietà neuronale si distingue in genere in refrattarietà assoluta e refrattarietà relativa. La refrattarietà assoluta è quell’arco temporale (di circa 2ms) corrispondente alla durata del potenziale di azione in cui è impossibile che venga generato

un altro potenziale di azione. La refrattarietà relativa, che segue temporalmente la

refrattarietà assoluta, coincide con la fase di iperpolarizzazione del neurone in cui è

”difficile” ma non impossibile che il neurone venga eccitato fino ad emettere un altro

potenziale di azione. Conseguentemente il periodo di refrattarietà fornisce un limite

inferiore al minimo intervallo temporale tra due potenziali di azione consecutivi.

Figura 1.6.

1.5

Rappresentazione della dinamica neuronale [9].

La membrana cellulare del neurone

La membrana cellulare del neurone (vedi fig.1.7) è composta da molecole di lipidi e

proteine. Le molecole lipidiche sono disposte in un doppio strato con uno spessore

di circa 6nm. In questa matrice lipidica si trovano alcune molecole proteiche che

attraversano tutto lo spessore della membrana cellulare entrando quindi in contatto

sia con l’interno della cellula che con il liquido extracellulare. Tali particolari proteine prendono il nome di canali proteici, ovvero canali di membrana, canali acquosi

o canali ionici (la ragione di tali denominazioni sarà chiara a breve). La membrana

cellulare può essere attraversata dalle sostanze dall’esterno all’interno o viceversa

attraverso vari meccanismi. Vi sono ad esempio alcuni tipi di molecole (alcoli o

glicerolo) che attraversano la membrana sciogliendosi nel doppio strato lipidico e

riemergendo dall’altro lato; in tal caso la facilità di penetrazione dipende dal grado

di solubilità nei lipidi. Gli ioni inorganici (sodio, potassio, calcio e cloro) che, come

abbiamo già detto, costituiscono le correnti ioniche alla base dell’attività elettrica

neuronale, si muovono attraverso la membrana o legandosi a particolare molecole

dette molecole di trasporto, che li veicolano, ovvero attraverso i canali proteici sopra citati. Si noti comunque che il meccanismo di trasporto adottato durante la

generazione di un potenziale di azione risulta quello dei canali proteici, in quanto i

flussi di ioni coinvolti (dell’ordine di 106 ioni/s) risultano ben oltre le possibilità di

azione delle molecole di trasporto. Nella struttura dei canali proteici (vedi fig.1.7)

si possono riconoscere i seguenti elementi:

• un poro centrale pieno d’acqua;

• una regione del poro che agisce da filtro di selettività regolando il transito degli

ioni in base alle dimensioni ed alle caratteristiche chimico-fisiche;

• un sistema di porte (in inglese gates) che si aprono e si chiudono in modo

stocastico facendo oscillare il canale tra uno stato di apertura ed uno stato

di chiusura; di norma lo stato di chiusura predomina quando il potenziale di

membrana si trova al valore di riposo. 1 .

1

Esiste peraltro l’eccezione costituita da alcuni canali per i quali lo stato di apertura è predominante nella membrana a riposo: si tratta per lo più, come vedremo nel seguito, di quei canali del

cloro e del potassio che risultano responsabili proprio del valore del potenziale di riposo.

Figura 1.7.

1.6

a) Struttura della membrana cellulare del neurone; b) struttura di un

canale ionico [11].

Canali ionici e correnti ioniche

Quando il canale ionico si trova in uno stato di apertura il canale è detto attivato,

altrimenti quando si trova in uno stato di chiusura è detto inattivato. È opportuno sottolineare che essendo l’apertura e chiusura dei canali un processo di natura

stocastica l’attivazione o disattivazione di un canale sta a significare solo un aumentata o diminuita probabilità di apertura del canale e non uno stato di apertura

o chiusura continua (vedi fig.1.8). Esistono varie modalità di attivazione, ossia di

apertura, di un canale. In particolare se l’apertura del canale può essere regolata

dal valore del potenziale di membrana i canali si dicono voltaggio-attivati. A titolo

di esempio citiamo in questa categoria di canali il canale voltaggio-dipendente del

sodio che, come vedremo in seguito (??), è quello responsabile della depolarizzazione

della membrana che provoca la fase di salita del potenziale di azione. Riguardo alla

selettività alla specificità ionica i canali si possono distinguere in cationici e anionici

a seconda che risultino rispettivamente permeabili agli ioni positivi o negativi. La

permeabilità di una membrana ad una specie ionica, indicata con p, è una proprietà

intrinseca della membrana che misura la ”facilità” con cui gli ioni attraversano la

membrana stessa; essa è definita in modo empirico dalla relazione [1, 17]:

J = −p∆[C]

(1.1)

dove J è il flusso molare (misurato in mol/(cm2 ·s)) e ∆[C] rappresenta la differenza

di concentrazione ionica ai due lati della membrana (misurata in mol/cm3 ). P ha

le dimensioni di una velocità ed è solitamente misurata in cm/s. La permeabilità

dipende solo dal tipo e dal numero di canali ionici presenti sulla membrana. In

particolare i canali cationici possono essere specifici o non specifici qualora risultino

o meno specializzati per una particolare specie ionica (ad esempio si hanno canali

specifici del Na+ , K+ , Ca2+ ). I canali anionici risultano essenzialmente costituiti

dai canali del cloro (Cl− ), che è di gran lunga il maggior permeante anionico nelle

soluzioni biologiche.

Figura 1.8. Esempio di corrente di canale. Come si vede tale corrente risulta di

impulsi di forma quasi rettangolare che possono essere posti in relazione con lo

stato di apertura e chiusura dei canali stessi [15].

La conduttanza è invece una misura dell’abilità della membrana di trasportare corrente elettrica ed è misurata soltitamente in Siemens, con simbolo S, dove 1S =

1Ω −1 . Poichè la corrente è trasportata dagli ioni, la conduttanza di una membrana non dipenderà solo dalle proprietà della membrana (cioè dalla permeabilità)

ma anche dalla concentrazione ionica all’interno ed all’esterno della cellula (ovvero il

numero dei portatori liberi di carica). Non è tuttavia possibile ricavare una relazione

matematica generale tra permeabilità e conduttanza perchè tale relazione dipende

strettamente dalle modalità con cui gli ioni attraversano il canale (semplice diffusione attraverso i pori pieni d’acqua ovvero modelli più complicati che analizzano

l’interazione canale-ione permeante). In generale quindi la corrente che attraversa

un canale ionico dipenderà [11, 16, 17]):

• dalla conduttanza del canale;

• dal gradiente di concentrazione tra l’interno e l’esterno della cellula che tende

a produrre un flusso dalla zona a maggior concentrazione a quella a minor

concentrazione secondo la legge empirica enunciata da Fick [17]:

Jdif f = −D

d[C]

dx

(1.2)

dove Jdif f rappresenta il flusso dovuto alla diffusione (misurato in numero di

ioni/(cm2 ·s)), D è il coefficiente di diffusione (misurato in cm2 /s) e [C] è la

concentrazione ionica (qui espressa in numero di ioni/cm3 );

• dalla differenza di potenziale applicata alla membrana.

1.7

1.7.1

Origine del potenziale di riposo

Un modello cellulare semplificato

In fig.1.9 è presentato un modello cellulare semplificato [11] ma che coglie l’essenza

dell’origine del potenziale di riposo della cellula neuronale. La cellula contiene ioni

potassio (K + ), sodio (Na+ ), cloro (Cl− ) ed altri anioni (A− ) di grandi dimensioni ed

è a sua volta immersa in una soluzione di sodio, potassio e cloro. Le concentrazioni

ioniche mostrate in figura sono espresse in millimoli per litro (che ha per simbolo

mM dove 1mM = 10−3 mol/l). Nelle cellule neuronali sono presenti altri ioni, come

il calcio e il magnesio, ma il loro contributo al potenziale di riposo è trascurabile.

In questo modello la membrana cellulare è completamente impermeabile al sodio

ed all’anione interno (A− ) e risulta invece permeabile al potassio ed al cloro. Il

potassio risulta più concentrato dentro la cellula che fuori e tende quindi a muoversi

verso l’esterno secondo il proprio gradiente di concentrazione. D’altro canto, come

abbiamo precedentemente illustrato, la superficie interna della membrana è negativa

rispetto a quella esterna, e quindi il gradiente di potenziale tende ad attrarre il

potassio dentro la cellula. In una cellula a riposo il gradiente di concentrazione ed

il gradiente elettrico sono in equilibrio. Si definisce potenziale di equilibrio di una

specie ionica il valore del potenziale di membrana al quale non si ha alcun flusso

netto di quella specie ionica. Per il cloro il gradiente di concentrazione ed il gradiente

elettrico hanno direzione opposta rispetto al potassio.

Figura 1.9. Un modello semplificato per le distribuzioni ioniche all’interno ed

all’esterno della cellula. Le frecce rappresentano le direzioni dei gradienti di concentrazione ed elettrici per il potassio (K + ) e per il cloro (Cl− ). Le concentrazioni

sono espresse in millimoli per litro [11].

1.7.2

L’equazione di Nerst

Il potenziale di equilibrio di ogni specie ionica è legato alle concentrazioni intracellulari ed extracellulari attraverso la cosiddetta equazione di Nerst:

Eione =

kT [n]e

ln

q

[n]i

(1.3)

dove: Eione è il potenziale di equilibrio dello ione; [n]e , [n]i sono rispettivamente

le concentrazioni extracellulari ed intracellulari; k ≃ 1.38 · 10−23 J/K è la costante

di Boltzmann; T è la temperatura assoluta in Kelvin; q è la carica elettrica (in

Coulomb) della specie ionica. È possibile capire l’origine dell’equazione di Nerst

attraverso il seguente ragionamento (vedi anche fig.1.10). Dalla meccanica statistica

′

di Boltzmann per sistemi in equilibrio termico si ha che la probabilità p(U < U <

′

′

′

U + dU) che una molecola si trovi in uno stato di energia U < U < U + dU

′

′

risulta: p(U < U < U + dU) ∝ exp(−U/kT ) [18]. Consideriamo adesso degli

ioni con carica positiva q in un campo elettrico statico. La loro energia nel punto

x risulta U(x) = qV (x) dove V (x) è il potenziale nel punto x. La probabilità

di trovare uno ione in una regione nell’intorno del punto x è perciò proporzionale

alla quantità exp(−qV (x)/kT ). Reinterpretando la densità di probabilità come una

quantità proporzionale ad una densità ionica [n(x)], ovvero ad una concentrazione,

si ha:

[n(x1 )]

p(U(x1 ))

=

= exp(−q(V (x1 ) − V (x2 ))/kT )

p(U(x2 ))

[n(x2 )]

(1.4)

e dunque all’equilibrio termodinamico si ha che un gradiente di potenziale elettrostatico ∆V = (V (x1 ) − V (x2 )) genera un gradiente di densità ionica . Ma poichè

questo è un assunto su uno stato di equilibrio la relazione deve valere anche nell’altro senso: ossia un gradiente di concentrazione genera un gradiente di potenziale

elettrostatico. Risolvendo la (1.4) rispetto al gradiente di potenziale si ha che all’equilibrio termodinamico vale ∆V =

Figura 1.10.

kT

q

2

ln [n]

che è appunto l’equazione di Nerst.

[n]1

Origine del potenziale di Nerst [9].

La quantità kT /q ha le dimensioni di una differenza di potenziale elettrico e per

una specie ionica monovalente (per la quale q = e, dove e ≃ 1.6 · 10−19 C è il valore

assoluto della carica dell’elettrone) è uguale a circa 25mV a temperatura ambiente

(T ≃ 300K). Per il modello cellulare mostrato in fig.1.9 nel quale il rapporto delle

concentrazioni del cloro e del potassio è uguale e pari a 1:30 si avrà a T ≃ 300K:

Ek ≃ −85mV , ECl ≃ −85mV . Nel modello cellulare semplificato, essendo gli ioni

potassio e cloro gli unici in grado di muoversi attraverso la membrana ed essendo

entrambi in equilibrio a -85mV, la cellula non manifesta alcun guadagno o perdita

netta di ioni: il potenziale di riposo della cellula semplificata coincide quindi con il

potenziale di equilibrio del potassio e del cloro.

1.7.3

Effetto del sodio e pompe ioniche

Lo ione sodio (Na+ ) è molto più concentrato all’esterno che all’interno della cellula (vedi fig.1.9), dunque per opporsi all’ingresso del sodio dovuto al gradiente di

concentrazione la membrana deve avere una differenza di potenziale tra l’interno e

l’esterno positiva: infatti usando le concentrazioni di fig.1.9 si ha che a T ≃ 300K

il potenziale di equilibrio del sodio risulta EN a ≃ +34mV . Dunque in una cellula

neuronale, dove il potenziale di riposo della membrana è negativo, sia il gradiente

di concentrazione sia il potenziale di membrana favoriscono l’ingresso del sodio. La

membrana cellulare è scarsamente permeabile al sodio ma il sia pur limitato ingresso di questo ione depolarrizza leggermente la membrana rispetto al potenziale

di equilibrio del potassio con la conseguenza che il potassio, fuori dall’equilibrio,

fluisce verso l’esterno. Per mantenere lo stato di equilibrio (ovvero le concentrazioni

ioniche costanti) a fronte di queste perdite continue esistono delle cosiddette pompe

ioniche che trasportano il sodio fuori dalla cellula ed il potassio dentro la cellula

in modo da mantenere uno stato stazionario, ovvero una sistuazione di equilibrio

dinamico. Il più importante sistema di trasporto è costituito dalla pompa Na-K che

trasporta tre ioni sodio fuori dalla cellula per ogni due ioni potassio portati invece

all’interno: in tal caso si dice che il rapporto di accoppiamento Na:K della pompa è

di 3:2. Tale situazione è rappresentata in fig.1.11 dove le frecce tratteggiate indicano

i movimenti ionici passivi (ovvero guidati solo dal bilancio tra i gradienti elettrici e

di concentrazione) mentre le frecce continue e i circoli indicano le pompe ioniche. La

lunghezza delle frecce indica l’entità dei movimenti netti ionici: per ciascuno ione il

flusso totale è nullo all’equilibrio.

Figura 1.11.

1.7.4

Flussi ionici passivi e pompe ioniche in una cellula in stato

stazionario [11].

Effetto della permeabilità ionica e dei meccanismi di

trasporto

Abbiamo visto nel paragrafo 1.7.2 che il potenziale di riposo della membrana è

determinato principalmente dal rapporto delle concentrazioni transmembranali del

potassio. Esiste tuttavia una dipendenza non solo dalle concentrazioni ioniche ma

anche dalla permeabilità alle specie ioniche. L’equazione di campo costante, detta

anche equazione GHK dagli autori D.E. Goldman [19], A.L. Hodgkin e B. Katz [20],

esprime tale dipendenza:

Vm =

kT pk [K + ]e + pN a [Na+ ]e + pCl [Cl− ]i

;

ln

e

pk [K + ]i + pN a [Na+ ]i + pCl [Cl− ]e

(1.5)

dove Vm è il potenziale di riposo della membrana; e (valore assoluto della carica dell‘elettrone) indica la carica degli ioni monovalenti; il simbolo [I]j , dove I =

K + ,Na+ ,Cl− e j = i,e, indica la concentrazione interna ed esterna delle specie

ioniche; pk , pN a , pCl rappresentano le permeabilità ioniche di ogni ione.

Tale

equazione è basata sul presupposto che, a potenziale costante, non deve cambiare

la carica sulla membrana anche se gli ioni la attraversano in piccole quantità . Di

conseguenza le correnti trasportate dalle perdite di sodio verso l’interno, di potasso

verso l’esterno e dalle altre perdite del cloro devono dare come somma zero. Altrimenti si detetrminerebbe un accumulo, o una perdita, costante di carica e quindi una

deriva costante del potenziale di membrana. Il nome equazione di campo costante

è legato al fatto che una delle ipotesi alla base di essa è che il campo elettrico all’interno della membrana sia uniforme. Come si vede l’equazione ricorda quella di

Nerst ma considera tutte le specie ioniche presenti ”pesate” con la loro permeabilità

e corrisponde pertanto a quello che intuitivamente era possibile aspettarsi: ovvero

che il potenziale di membrana tende tanto più al valore del potenziale di equilibrio

di una specie ionica quanto più la sua permeabilità è maggiore di quella delle altre

specie ioniche. È possibile dimostrare [11] che non vi è una grossa dipendenza del

potenziale di riposo dal cloro e pertanto il suo contributo è spesso trascurato; in tal

caso l’equazione di campo costante viene cosı̀ riscritta:

Vm=

kT [K + ]e + b[Na+ ]e

;

ln

e

[K + ]i + b[Na+ ]i

(1.6)

dove b = pN a /pk . Una descrizione ancora più accurata è fornita dall’equazione di

stato stazionario [21] che considera anche gli effetti dei processi di trasporto attivo

della pompa ionica Na − K:

Vm=

kT r[K + ]e + b[Na+ ]e

ln

;

e

r[K + ]i + b[Na+ ]i

(1.7)

dove r è il rapporto di accoppiamento del sistema di trasporto (nel caso della pompa

Na − K si ha r = 3/2). Si capisce facilmente come gli effetti della pompa si

ripercuotano sul potenziale di membrana: infatti il diverso flusso di ioni Na+ e K +

(tre ioni sodio fuori dalla cellula per ogni due ioni potassio portati invece all’interno)

causato dalla pompa genera una corrente ionica netta verso l’esterno; questo flusso

di cariche positive verso l’esterno tende a iperpolarizzare la membrana ad un valore

leggermente più negativo (ossia avvicina il potenziale di membrana un po’ di più al

potenziale di equilibrio del potassio) di quello che ci si aspetterebbe solo in base a

meccanismi passivi. Per avere un’idea dell’entità del contrbuto delle pompe ioniche si

confronti il valore del potenziale di riposo predetto dall’equazione di campo costante

e dall’equazione di stato stazionario relativamente ad assoni di calamaro in acqua

di mare alla temperatura di T ≃ 300K: usando l’equazione di campo costante

si trova Vm ≃ −67mV , mentre usando l’equazione di stato stazionario si trova

Vm ≃ −73mV (abbiamo usato i seguenti valori realistici: [K + ]i = 400mM, [K + ]e =

10mM, [Na+ ]i = 50mM, [Na+ ]e = 460mM, b = pN a /pk = 0.04, r = 1.5).

1.8

Proprietà elettriche passive della membrana

Da un punto di vista elettrico la più semplice schematizzazione di una porzione di

membrana cellulare a riposo fa ricorso a tre elementi circuitali: una resistenza (R),

una capacità (C), ed un generatore di tensione V uguale al potenziale di riposo (vedi

fig.1.12 e fig.1.13). La presenza della resistenza si spiega con l’esistenza dei canali

Figura 1.12.

Schematizzazione elettrica di una porzione di membrana cellulare

del neurone. Vrest indica il potenziale di riposo [1].

Figura 1.13. Equivalente circuitale dell’intera membrana cellulare. I simboli R e

C in questo caso rappresentano il paralllelo rispettivamente di tutte le resistenze e

le capacità delle singole porzioni di membrana; Vrest indica il potenziale di riposo;

Iinj rappresenta una corrente iniettata dentro la cellula [1].

ionici che realizzano un contatto tra l’interno e l’esterno della cellula. La resistena

di membrana è di solito riportata come una resistenza di membrana specifica, Rm ,

definita come una resistenza per unità di superficie (in unità Ω · cm2 ). R è quindi

ottenuta dividendo Rm per l’area della membrana considerata. Rm è determinata

principalmente dalle permeabilità a riposo del potassio e del cloro. Valori tipici di

Rm variano da circa 103 Ω · cm2 per membrane con molti canali ionici a circa 5 x 104

Ω · cm2 per membrane con pochi canali ionici. Ma oltre a permettere il passaggio

di correnti ioniche, la membrana accumula cariche sulla superfici interna ed esterna,

ed è proprio questa separazione che detemina il potenziale di membrana. La realizzazione di questa separazione di cariche conferisce alla membrana le proprietà di un

condensatore. La capacità di membrana è di solito specificata in termini di una capacità di membrana specifica, Cm , definita come una capacità per unità di superficie

(in unità F/cm2 ). C è quindi ottenuta moltiplicando Cm per l’area della membrana considerata. Cm è tipicamente dell’ordine di 1µF/cm2 . Tramite la relazione

Qm = Cm V , dove Qm è la quantità di carica per unità di superficie, ed assumendo

V ≃ -65mV si ha che Qm ≃ (1µ F/cm2 ) x (65mV) ≃ 6.5 x 10−8 C/cm2 che equivale, dividendo per il valore assoluto della carica dell’elettrone, a circa 4 x 1011 ioni

monovalenti per cm2 . Ci preme sottolineare che tale schematizzazione descrive solo

il comportamento passivo della membrana e non prende in considerazione eventuali

componenti non lineari o attivi come ad esempio conduttanze voltaggio-dipendenti

(vedi ??).

Capitolo 2

Modelli semplificati di neuroni e

reti neurali

In questo capitolo uniamo tutti gli elementi costitutivi di un neurone (dendriti,

sinapsi, conduttanze dipendenti dal potenziale, assoni) al fine di ottenere un modello

funzionale della singola cellula; con questo modello a nostra disposizione possiamo

chiederci quali operazioni può effettuare o quanto sia efficace nel codificare informazione. Iniziamo questa operazione trascurando l’albero dei dendriti e rimpiazzando la descrizione dei processi di sparo fondata sulle conduttanze (ovvero la descrizione fornita dalle equazioni realistiche di Hodgkin-Huxley per le correnti di membrana), con una descrizione basata sull’utilizzo di modelli formali, come il modello

leaky integrate and fire, che tratteremo. Questo modello descrive in modo estremamente semplificato la dinamica sottosoglia, cioè la dinamica prima dell’insorgenza

del potenziale di azione, mentre il potenziale di azione è descritto sinteticamente

come evento impulsivo, assumendo implicitamente di aver a che fare con un impulso stereotipato. In questo modo possiamo ridurre incredibilmente la complessità

del problema e caratterizzare il comportamento elettrico dei neuroni attraverso una

singola equazione differenziale ordinaria piuttosto che tramite equazioni accoppiate,

non lineari e alle derivate parziali. Tali semplificazioni ci permettono di trattare reti

formate da un gran numero di neuroni interconnessi, di simularne la dinamica e di

analizzare le soluzioni collettive, non banali, e verificarne la stabilità. La comprensione di un qualsiasi sistema complesso passa dunque per la scelta di un livello di

descrizione che afferra le proprietà fondamentali del sistema e trascura quelle non

essenziali per lo scopo proposto.

2.1

Dal modello di Hodgkin-Huxley al modello

leaky integrate and fire

Il modello di Hodgkin-Huxley è un modello realistico a quattro dimensioni (in cui

cioè la dinamica del neurone è descritta da quattro variabili), pensato per riprodurre i dati sperimentali relativi ad una particolare fibra nervosa, l’assone gigante

del calamaro [5]. Questo modello è costituito da un sistema di quattro equazioni

differenziali del primo ordine che descrivono la dinamica del potenziale di membrana

e delle tre correnti ioniche fondamentali: la corrente di sodio (IN a ), la corrente del

potassio (IK ) e la corrente di perdita, o di dispersione, (IL dall’inglese leakage current), dovuta principalmente al cloro (Cl− ), ma che riassume anche l’effetto di altre

specie ioniche presenti, ma non descritte esplicitamente. Il meccanismo alla base di

queste correnti ioniche risiede nel fatto che le conduttanze della membrana cellulare

per il sodio (gN a ) e per il potassio (gK ) sono dipendenti dalla differenza di potenziale applicata alla membrana, dunque la probabilità che i canali si aprano aumenta

con la depolarizzazione della membrana. L’apertura dei canali avviene tuttavia con

tempi e modalità diverse: la depolarizzazione della membrana attiva inizialmente un

aumento della conduttanza del sodio (seguita da una successiva inattivazione) e solo

Figura 2.1.

Fase di salita del potenziale di azione.

con un certo ritardo temporale quella del potassio. Inoltre l’effetto sul potenziale di

membrana dell’aumento della conduttanza è diverso per il sodio e per il potassio:

• per quanto riguarda il sodio si ha un processo di retroazione positiva; infatti

una piccola depolarizzazione aumenta il numero di canali aperti e questo, a

sua volta, dà luogo ad un ulteriore ingresso del sodio secondo il gradiente

elettrochimico e ad una depolarizzazione ancor più grande;

• per quanto riguarda il potassio, si ha invece che il flusso in uscita secondo

il gradiente elettrochimico, dovuto alla depolarizzazione, porta alla ripolarizzazione della membrana e quindi alla conseguente riduzione della conduttanza

per il potassio fino al valore di riposo (retroazione negativa).

Il profilo tipico di un potenziale di azione è quindi spiegabile, per quanto riguarda

la fase di salita, con un improvviso grande aumento della permeabilità di membrana

al sodio (vedi figura 2.1); la conseguente corrente del sodio porta rapidamente il

potenziale di membrana a spostarsi verso il potenziale di equilibrio del sodio stesso

(EN a ). La fase di caduta del potenziale di azione, ovvero la ripolarizzazione della

membrana, è dovuta ad un successivo aumento della permeabilità al potassio (vedi

figura 2.2): a causa della corrente del potassio, il potenziale di membrana si sposta

Figura 2.2.

Fase di caduta del potenziale di azione.

questa volta, verso il potenziale di equilibrio del potassio (Ek ).

Figura 2.3.

Ricostruzione teorica dell’andamento del potenziale d’azione e relative

variazioni di conduttanza del sodio e del potassio [11].

Il modello di Hodgkin-Huxley spiega inoltre l’esistenza di un livello di soglia del

potenziale di membrana al di sopra del quale nasce l’impulso; tale fenomeno può

essere compreso immaginando di far passare una corrente attraverso la membrana

depolarizzandola solo sino alla soglia e poi di interrompere la corrente. Essendo il

potenziale di membrana lontano dal potenziale di equilibrio del potassio, vi sarà un

aumento della corrente di potassio in uscita, ma verranno attivati anche alcuni canali

di sodio, aumentando la corrente di sodio in ingresso. Alla soglia questi aumenti di

corrente sono esattamente uguali e opposti (equilibrio dinamico), e la membrana è in

una condizione simile a quella di riposo, a parte il fatto che la conduttanza del sodio

ora è instabile. La depolarizzazione oltre la soglia determina cosı̀ un aumento di

gN a sufficiente a superare immediatamente il valore della conduttanza del potassio a

riposo, ma, non appena uno ione in più di potassio lascia la cellula, rispetto al valore

di soglia, la depolarizzazione diminuisce e la prevalenza della corrente di potassio

determina la ripolarizzazione.

Un ultimo aspetto capace di essere spiegato con questo modello è il tempo di

refrattarietà; dopo l’emissione di un potenziale di azione abbiamo a che fare con due

periodi diversi di retrattarietà: il periodo di refrattarietà assoluto e quello relativo.

Il periodo assoluto è l’intervallo durante il quale non può essere assolutamente emesso un potenziale di azione, anche se il neurone è soggetto ad uno stimolo qualsivoglia

grande; il periodo relativo è l’intervallo temporale immediatamente successivo durante il quale la generazione di un nuovo potenziale di azione è inibita, ma non

impossibile. Il periodo refrattario assoluto coincide essenzialmente con l’intera durata del potenziale di azione ed è causato dall’inattivazione dei canali Na+ che in

precedenza si erano aperti per depolarizzare la membrana; questi canali rimangono

inattivi finché la membrana non si ripolarizza, dopodiché si chiudono, si riattivano e

riacquistano la loro capacità di aprirsi in risposta ad uno stimolo. Il periodo refrattario relativo segue temporalmente quello assoluto; i canali potassio si aprono per

terminare il potenziale di azione ripolarizzando la membrana, dunque la conduttanza di membrana del potassio cresce drasticamente. Gli ioni K + che fluiscono in gran

numero fuori dalla cellula fanno sı̀ che il potenziale di membrana si avvicini molto al

potenziale di equilibrio del potassio; questo determina una breve iperpolarizzazione

della membrana, cosiché il potenziale di membrana diventa più negativo dell’usuale

potenziale di riposo. Finché la conduttanza del potassio non raggiunge il suo valore

di riposo, è necessario uno stimolo maggiore per raggiungere il valore di soglia e dar

vita ad una seconda depolarizzazione. Il raggiungimento del potenziale di equilibrio

di riposo determina la fine del periodo di refrattarietà relativo.

Un neurone dunque genererà un potenziale di azione quando il suo potenziale di

membrana raggiungerà un valore di soglia compreso tra −55 e −50 mV . Durante lo

sparo del potenziale di azione, il potenziale di membrana descresce rapidamente e

assume un valore che è iperpolarizzato rispetto al potenziale di soglia. Il meccanismo

per cui le conduttanze dipendenti dal potenziale K + e Na+ producono dei potenziali

di azione è ben compreso e modellizzabile accuratamente; d’altra parte i modelli dei

neuroni possono essere semplificati se non sono esplicitamente inclusi i meccanismi

biofisici responsabili dei potenziali di azione. I modelli integrate-and-fire effettuano

questa semplificazione supponendo che il potenziale di azione sia generato ogni volta

che il potenziale di membrana del neurone modello raggiunge un valore di soglia Θ;

dopo l’emissione del potenziale di azione, al potenziale viene riassegnato un valore R

inferiore al potenziale di soglia, R < Θ. Tali modelli formali partono dal presupposto

che un potenziale di azione costituisca un evento stereotipato, per cui viene descritta

solo la dinamica sottosoglia di un’unica variabile (modello unidimensionale); inoltre

non riproducono in modo dettagliato i potenziali di azione né includono l’effetto di

adattamento o il tempo di refrattarietà. L’insorgenza del potenziale di azione è cosı̀

caratterizzata solo dal tempo di sparo (o in inglese firing time).

2.2

Neuroni leaky integrate-and-fire

Il modello integrate-and-fire è stato proposto da Lapicque nel 1907, molto prima che

fosse compreso il meccanismo di generazione dei potenziali di azione; nonostante la

sua età e la sua semplicità, questo modello rappresenta ancora una descrizione estremamente utile dell’attività neuronale. Trascurando una descrizione biofisica del

potenziale di azione, a questi modelli rimane il compito, più semplice, di modellizzare la dinamica del potenziale di membrana sotto soglia. Questo compito può

esser svolto con vari livelli di rigore; nella versione più semplice, sono ignorate tutte

le conduttanze di membrana attive, compresi gli input sinaptici, e l’intera conduttanza di membrana è schematizzata con un singolo termine di perdita, passivo,

im = ḡL (V − EL ), con im corrente di membrana, V potenziale di membrana, EL

potenziale di riposo di un singolo ione e ḡL parametro da aggiustare per ottenere la

conduttanza di membrana a riposo per uno ione. Questa versione è denominata passiva o modello leaky integrate-and-fire (al quale ci riferiremo anche come LIF). Le

conduttanze neuronali sono approssimativamente costanti per piccole fluttuazioni

attorno al potenziale di membrana di riposo; il modello LIF assume che questa

costanza si mantenga nell’intero range di variazione del potenziale sotto soglia. Per

alcuni neuroni, questa si rivela un’approssimazione ragionevole, mentre per altri non

lo è; con queste approssimazioni il neurone si comporta come un circuito elettrico

costituito da una resistenza ed una capacità in parallelo (figura 2.4) ed il potenziale

di membrana si determina cosı̀ attraverso l’equazione

cm

dV

Ie

= −im +

dt

A

(2.1)

dove cm è la capacità per unità di superficie della membrana, A è la superficie della

membrana, im è la corrente di membrana per unità di superficie ed Ie è la corrente

di elettrodo, che usualmente non è espressa come corrente per unità di superficie;

con im = ḡL (V − EL ) si ha

cm

dV

Ie

= −ḡL (V − EL ) + .

dt

A

(2.2)

È conveniente moltiplicare l’equazione (2.2) per la resistenza specifica di membrana

Figura 2.4. Circuito equivalente per il modello di neurone. Il neurone è rappresentato a sinistra, da un singolo insieme di superficie A con una sinapsi ed un

s indica

elettrodo che inietta corrente. Nel circuito equivalente a destra, il cerchio una conduttanza sinaptica che dipende dall’attività di un neurone presinaptico.

Viene indicata inoltre una singola conduttanza gs , anche se, in genere, ce ne posv indica una conduttanza che dipende dal

sono essere di tipi diversi. Il cerchio potenziale, mentre Ie è la corrente che passa attraverso l’elettrodo. [12].

rm , data in questo caso da rm = 1/ḡL ; questo cancella il fattore ḡL nel membro a

destra dell’equazione e lascia un fattore cm rm = τm nel membro di sinistra, dove τm

è la costante di tempo di membrana del neurone. L’ultimo termine del membro di

destra varia in accordo al fatto che rm /A = Rm , dove Rm è la resistenza di membrana

totale. Si arriva cosı̀ all’equazione fondamentale per i modelli leaky integrate-andfire:

τm

dV

= EL − V + Rm Ie .

dt

(2.3)

Per generare i potenziali di azione in questo modello occorre aggiungere una regola:

assegnare al potenziale il valore R ogniqualvolta il potenziale V raggiunga il valore di

soglia e venga sparato un potenziale di azione. L’equazione (2.3) indica che, quando

Ie = 0, il potenziale di membrana si rilassa esponenzialmente con una costante di

tempo τm a V = EL ; EL è dunque il potenziale di riposo della cellula modello.

Il potenziale di membrana per il modello passivo integrate-and-fire è determinato

integrando l’equazione (2.3) e applicando la regola di soglia e di riassegnazione del

valore del potenziale per la generazione del potenziale di azione. In figura (2.5) è

mostrata la risposta di un neurone LIF ad una corrente di elettrodo che varia nel

tempo.

Figura 2.5. Modello leaky integrate and fire guidato da una corrente di elettrodo

che varia temporalmente. Il grafico superiore indica il potenziale di membrana,

mentre quello inferiore la corrente guida. I potenziali d’azione sono semplicemente

sovrapposti alla traiettoria del potenziale di membrana ogniqualvolta il potenziale

raggiunga il valore di soglia. [12].

Il tasso di sparo di un modello LIF in risposta ad una corrente iniettata costante

può essere calcolato analiticamente. Quando Ie è indipendente dal tempo, il potenziale sotto soglia V (t) può essere facilmente calcolato risolvendo l’equazione (2.3):

V (t) = EL + Rm Ie + (V (0) − EL − Rm Ie )exp(−t/τm ),

(2.4)

dove V (0) è il valore di V al tempo t = 0. Questa equazione è valida per il modello

integrate-and-fire solo finché V rimane sotto soglia. Supponiamo che a t = 0 il

neurone abbia appena sparato un potenziale di azione e si abbia V (0) = R; il

potenziale di azione successivo si avrà quando il potenziale di membrana raggiunge

il valore di soglia, cioè, ad un tempo t = tisi dove

V (tisi ) = Θ = EL + Rm Ie + (R − EL − Rm Ie )exp(−tisi /τm ).

(2.5)

Risolvendo per tisi , ovvero per il tempo a cui si ha il potenziale di azione successivo,

possiamo determinare l’intervallo tra uno sparo e l’altro (in inglese interspike interval

o ISI) per una corrente Ie costante, o, equivalentemente, il suo inverso, che possiamo

chiamare il tasso di sparo del neurone,

risi =

1

Rm Ie + El − R

= τm ln(

)

tisi

Rm Ie + EL − Θ

−1

.

(2.6)

Questa espressione è valida se Rm Ie > Θ − EL , altrimenti risi = 0. Per valori

sufficientemente grandi di Ie , possiamo approssimare linearmente il logaritmo ln(1 +

z) ≈ z per piccoli z in modo da avere

risi

"

Rm Ie + El − Θ

≈

τm (Θ − R)

#

,

(2.7)

+

che mostra che il tasso di sparo cresce linearmente con Ie per grandi Ie .

La figura (2.6A) mostra risi in funzione di Ie ; il tasso di sparo, determinato come

l’inverso dell’intervallo temporale tra i primi due impulsi sparati da un neurone

corticale in vivo in risposta ad una corrente iniettata (cerchi pieni), è in accordo con i

risultati ricavati dal modello LIF, anche se il neurone reale esibisce una caratteristica

di adattamento del tasso di sparo prima di raggiungere uno stato stazionario (figura

2.6B), che il modello LIF può riprodurre solo usando parametri diversi da quelli che

venivano usati per riprodurre gli impulsi iniziali.

2.2.1

Correnti sinaptiche

Nel caso in cui il neurone riceva degli impulsi da altri neuroni, la cosa si può modelizzare nell’ambito dei modelli LIF sostituendo alla corrente esterna Ie che compare

nell’equazione (2.3) la corrente sinaptica Isin . In particolare l’effetto prodotto da un

solo impulso ricevuto dal neurone al tempo t corrisponde ad una corrente

Isin = −Gm [V + W ]τm δ(t)

(2.8)

per una sinapsi che risponda in modo infinitamente rapido [29]. Dove Gm = 1/Rm è

la conduttanza di membrana, W è il potenziale di inversione della sinapsi il cui segno

Figura 2.6. (A)Comparazione dei tassi di sparo in funzione della corrente iniettata, calcolati l’uno con il modello integrate and fire, l’altro attraverso le misure

su un neurone corticale in vivo. I dati puntiformi derivano da una cellula piramidale nella corteccia visiva primaria di un gatto. I cerchi pieni mostrano l’inverso

dell’ISI per i primi due impulsi sparati, mentre i cerchi vuoti mostrano il tasso

di sparo nello stato quasi stazionario, dopo l’adattamento del tasso di sparo. (B)

Registrazione dello sparo di un neurone corticale, soggetto ad una corrente iniettata costante, in cui è visibile l’adattamento. (C) Traiettoria del potenziale di

membrana e potenziali di azione per un modello integrate and fire con una corrente

aggiuntiva. [12].

determina se l’effetto dell’impulso è eccitatorio o inibitorio. Dato che il potenziale

di membrana V ha segno negativo, la sinapsi è detta eccitatoria (rispettivamente

inibitoria) se W < 0 (W > 0); il segno di V è all’origine anche del segno negativo

nell’equazione (2.8). Nel caso in cui il neurone sia connesso ad altri N neuroni

pre-sinaptici il modello LIF si può riscrivere come

τm V̇ = EL − V − τm (V + W )

(m)

dove il tempo tj

N X

X

j=1 m

(m)

δ(t − tj ) ,

(2.9)

rappresenta l’istante di ricezione dell’impulso m-esimo emesso dal

j-esimo neurone pre-sinaptico.

Un modello ancora più semplificato, ma largamente usato in letteratura e che

mette in connessione la dinamica LIF con quella di oscillatori è il seguente

v̇ = c − v −

N X

X

j=1 m

(m)

δ(t − tj ) ,

(2.10)

dove si è assunto che EL = 0, che il tempo unitario sia τm , che il potenziale di

membrana sia stato riscalato come v = (V − R)/(Θ − R), in modo che v ∈ [0,1].

Nell’equazione 2.10 il termine c rappresenta una corrente esterna adimensionale. In

assenza di stimoli esterni, la soluzione dell’equazione 2.10 è semplicemente v(t) =

-50

Θ

-52

-54

v

-56

-58

R

-60

150

175

tempo

200

Figura 2.7. Andamento temporale del potenziale di membrana per un neurone

LIF soprasoglia in assenza di stimoli presinaptici. Le frecce indicano l’istante in

cui avviene l’emissione di un potenziale di azione.

c(1 − exp(−t)), quindi se c < 1 il suo valore asintotico resta sempre sotto soglia,

altrimenti se c > 1 il potenziale di membrana raggiunge soglia e viene riazzerato in

modo ripetitivo con periodo tisi = ln[(c − 1)/c]. In questo caso il neurone è detto

soprasoglia e la sua dinamica ricorda quella di un semplice oscillatore armonico

sovrasmorzato ed è riportata in figura 2.7

2.2.2

Adattamento del tasso di sparo e refrattarietà

L’adattamento del tasso di sparo è una caratteristica comune dei neuroni piramidali

corticali e consiste nell’allungamento degli ISI col passare del tempo in presenza

di una corrente costante iniettata nella cellula, prima di raggiungere un valore di

stato stazionario. La considerazione di questo fenomeno ci permette di mostrare

come un modello LIF possa essere modificato per incorporare una dinamica più

complessa. Il modello LIF che abbiamo descritto nel paragrafo precedente è basato

su due approssimazioni separate: una descrizione altamente semplificata del potenziale di azione e una approssimazione lineare per la corrente di membrana totale.

I dettagli del processo di generazione del potenziale di azione non sono importanti

per l’obiettivo proposto dalla nostra modellizzazione, inoltre la corrente di membrana è modellizzata con dettagli sufficienti. Illustriamo il processo di adattamento

del tasso di sparo usando un modello di conduttanza che ha caratteristiche simili

a quelle delle conduttanze neuronali misurate che giocano un ruolo importante nel

produrre questo effetto. Modellizziamo l’adattamento del tasso di sparo includendo

nell’equazione fondamentale un’ulteriore corrente,

τm

dV

= EL − V − rm gsra (V − EK ) + Rm Ie .

dt

(2.11)

La conduttanza di adattamento del tasso di sparo gsra è stata schematizzata come

una conduttanza K + , cosiché, quando viene attivata, iperpolarizza il neurone, rallentando qualsiasi impulso che può sopraggiungere. EK è il potenziale di inversione

del potassio. Assumiamo che questa conduttanza si rilassi esponenzialmente a 0 con

una costante temporale τsra soddisfacendo l’equazione

τsra

dgsra

= −gsra .

dt

(2.12)

Ogniqualvolta un neurone genera un impulso, gsra è accresciuto di un fattore ∆gsra ,

cioè gsra → gsra + ∆gsra ; durante una sequenza di sparo ripetuta, la corrente si

costruisce attraverso una sequenza di passi causando l’adattamento del tasso di

sparo.

La probabilità che un neurone spari è significativamente ridotta nel breve lasso

temporale successivo alla generazione di un potenziale di azione; tale effetto refrattario non è incluso nel modello base integrate-and-fire. Il modo più semplice per

introdurre nel modello un periodo di refrattarietà assoluto è quello di aggiungere una

condizione alla regola base di superamento della soglia tale che proibisca lo sparo

per un periodo di tempo immediatamente successivo all’emissione dell’impulso. La

refrattarietà può essere incorporata in un modo più realistico aggiungendo una conduttanza simile a quella introdotta per l’adattamento del tasso di sparo; stavolta

la conduttanza dovrà avere un tempo di recupero più veloce ed un incremento più

grande in seguito ad un potenziale di azione. Grazie ad un consistente incremento, il

potenziale del neurone si avvicina, in valore, al potenziale di equilibrio del potassio

EK in seguito ad un potenziale di azione, prevenendo in maniera temporanea un

ulteriore sparo e producendo un periodo di refrattarietà assoluto. Nel momento in

cui questa conduttanza approssima il valore 0, lo sparo sarà possibile anche se inizialmente poco probabile, producendo un periodo di refrattarietà relativo. Quando

il recupero è completato, si ristabilisce la periodicità di sparo usuale.

2.3

Reti neurali

Una rete neurale è, formalmente, un grafo i cui nodi sono costituiti dai neuroni e

le cui connessioni sono costituite dalle sinapsi; ciascuna connessione è pesata con

la corrispondente efficienza sinaptica. Le sinapsi costituiscono cosı̀ un grafo con

connessioni specifiche e direzionate. Ciascun nodo è caratterizzato da un’equazione

di evoluzione in cui lo stato del neurone dipende dai neuroni spazialmente connessi,

ovvero dai neuroni presinaptici; i pesi sinaptici possono essere fissati ma possono

anche evolvere nel tempo (plasticità sinaptica), in accordo con la storia dei due

nodi connessi dalla sinapsi. Se consideriamo le reti neurali come sistemi dinamici,

possiamo dare una formulazione canonica della dinamica neuronale; ciascun neurone

i è caratterizzato dal suo stato, Xi , che appartiene ad un certo insieme compatto I ∈

RM . M è il numero di variabili che caratterizzano lo stato di un neurone; assumiamo

inoltre che tutti i neuroni siano descritti dallo stesso numero di variabili. Il LIF

corrisponde al caso in cui M = 1, Xi = Vi è il potenziale di membrana del neuroni

i e I = [Vmin ,Vmax ]. L’evoluzione di N neuroni è data cosı̀ da un sistema dinamico

deterministico del tipo:

dX

= Fγ (X,t),

dt

tempo continuo,

(2.13)

o,

X(t + 1) = Fγ [X(t),t],

tempo discreto.

(2.14)

La variabile X = {Xi }N

i=1 rappresenta lo stato dinamico di una rete con N neuroni

al tempo t; tipicamente X ∈ M = IN , dove M è lo spazio delle fasi dell’equazione

(2.14) ed Fγ (M) ⊂ M. La mappa Fγ : M → M dipende da un set di parametri

γ ∈ RP ; il caso tipicamente considerato in seguito sarà γ = (W,I(ext) ), dove W è

la matrice dei pesi sinaptici, mentre I(ext) rappresenta una corrente o uno stimolo

esterno. Cosı̀ γ è un punto nello spazio dei parametri di controllo P = N 2 + N

dimensionale.

Un neurone i emette un potenziale d’azione ogni qual volta il suo stato Xi appartiene ad una certa regione connessa P1 del suo spazio delle fasi, altrimenti è quiescente se X ∈ P0 = I\P1 . Per N neuroni identici questo porta ad una “partizione

naturale” P dello spazio delle fasi M. Chiamiamo Λ = {0,1}N , ω= [ωi ]N

i=1 ∈ Λ,

allora P = {Pω }ω∈Λ , dove Pω = Pω1 ×Pω2 × · · · × PωN . Equivalentemente, se X

∈ Pω , si ha che tutti i neuroni con ωi = 1 stanno sparando, mentre quelli con ωk = 0

sono quiescenti.

A ciascuna condizione iniziale X ∈ M possiamo associare un “raster plot” ω̃ = {ω

(t)}+∞

t=0 tale che X (t) ∈ Pω(t) , ∀t ≥ 0; cosı̀ ω̃ è la sequenza di configurazioni di sparo

mostrata dalla rete neurale quando viene preparata nella condizione iniziale X (vedi

figura 2.8). Conoscere il raster plot è dunque equivalente a conoscere la lista dei

tempi di sparo di tutti i neuroni. Ad esempio, se abbiamo a che fare con una rete

omogenea di N neuroni, dove la dinamica di ciascun neurone è periodica, possiamo

dedurre, dall’osservazione del raster plot, che la dinamica della rete è asincrona;

100

0.8

80

Indice di Neurone

1

0.6

vk

0.4

0.2

0

60

40

20

226

226.2

226.4

226.6

Tempo

226.8

227

227.2

0

1750

1800

1850

1900

1950

Tempo

Figura 2.8. (a) La figura mostra l’andamento del potenziale di membrana del kesimo neurone in funzione del tempo, in una rete omogenea di N neuroni. (b) Nella

seconda figura è riportato l’indice del neurone che spara in funzione del tempo.[26]

dunque, se indichiamo con T l’ISI di ciascun neurone, il tasso di sparo della rete è

costante e pari a T /N.

2.3.1

Rete di neuroni LIF globalmente accoppiati: il modello

La comprensione del meccanismo di elaborazione dell’informazione nel cervello può

essere perseguita analizzando le proprietà dinamiche dei modelli di reti neurali; pensare di avvicinarsi a questo problema nella sua assoluta generalità è un obiettivo

incredibilmente ambizioso, dal momento che occorre tenere in conto (i) del ruolo

della topologia delle connessioni, (ii) della dinamica delle stesse connessioni, al fine

di rappresentare la plasticità sinaptica, (iii) della dinamica interna a ciascun modello di neurone, che può dipendere dal numero di canali ionici ma anche da altre

variabili e parametri, (iv) dalla diversità tra i neuroni e le loro connessioni e, infine,

(v) dall’inevitabile presenza di rumore. Ad ogni modo possiamo congetturare che

almeno alcuni meccanismi di base siano robusti e possano dipendere solo da pochi

ingredienti; infatti anche i modelli semplici composti da unità identiche globalmente

accoppiate esibiscono proprietà dinamiche interessanti e, indubbiamente, non ovvie

e non totalmente comprese. Consideriamo ad esempio il cosidetto ”splay state”, che

costituisce un modo collettivo che emerge in reti di oscillatori non lineari completamente accoppiati (vedi figura 2.8); questo stato è caratterizzato dal fatto che tutte

le oscillazioni abbiano la stessa forma d’onda X e che le fasi di tali oscillatori si

dispongano sul cerchio unitario in modo equispaziato. Inoltre lo stato del singolo

oscillatore xk può essere descritto al tempo t da

xk (t) = X(t + kT /N) = A cos(ωt + 2πk/N);

ω = 2π/T ;

k = 1, · · · ,N

(2.15)

dove N è il numero di oscillatori del sistema, T il periodo dell’oscillazione collettiva,

X la forma d’onda comune ed A l’ampiezza dell’oscillazione. La stabilità degli

stati stazionari di questi sistemi è ancora un problema dibattuto. In particolare,

nel contesto delle reti neurali, ove lo “splay state” è caratterizzato da un tasso

di sparo costante dei neuroni, si possono trovare sia dimostrazioni del fatto che

lo “splay state” sia stabile solo in presenza di accoppiamenti eccitatori [28], sia

dimostrazioni del fatto che sia possibile trovare tale stato stabile in presenza di reti

con accoppiamento completamente inibitorio [25].

Il metodo usato di solito per determinare le proprietà di stabilità di tali semplici modelli è basato sull’approssimazione di campo medio; questo ci permette di

ottenere lo spettro degli autovalori associati alla matrice di stabilità nel limite termodinamico N → ∞, dove N denota il numero di neuroni. La stima della stabilità

lineare dello splay state costituisce il passo preliminare verso una completa comprensione delle proprietà dinamiche della rete neurale; per effettuare tale stima si

può introdurre la sezione di Poincaré, vedi (??), che trasforma il sistema dinamico

originale in una mappa che connette le configurazioni dinamiche della rete neurale

corrispondenti a momenti in cui si ha l’emissione di impulsi neurali consecutivi. La

mappa viene costruita tra gli impulsi consecutivi emessi da qualsivoglia neurone e

viene combinata con un opportuno riscalamento degli indici dei neuroni in modo da

ridurre la complessità computazionale del calcolo e da ottenere espressioni analitiche

per valori grandi ma finiti di N.

Consideriamo dunque una rete di N identici neuroni LIF; la dinamica dell’iesimo neurone è descritta da una singola variabile, il potenziale di membrana vi (t),

che obbedisce all’equazione differenziale

v̇i = a − vi + gE(t)

(2.16)

dove tutte le variabili e i parametri sono espressi in unità adimensionali opportunamente riscalate. In accordo con la precedente equazione, il potenziale di membrana

rilassa al valore a + gE(t), ma, non appena raggiunge il valore di soglia vi = 1,

viene riscalato a vi = 0 e viene inviato, simultaneamente, un impulso a tutti gli

altri neuroni (questa procedura di riassegnazione del valore del potenziale è un modo approssimato per descrivere il meccanismo di scarica presente nei neuroni reali).

Il parametro a > 1 corrisponde alla corrente di input soprasoglia, mentre g limita

la forza del campo E(t) agendo come accoppiamento efficace. Il campo E(t) è la

sovrapposizione lineare degli impulsi emessi ogniqualvolta il potenziale di membrana

di ciascun singolo neurone raggiunge il valore di soglia. Assumiamo che la forma di

un impulso emesso a t = 0 sia data da Es (t) =

α2 t −αt

e

N

, dove 1/α è l’ampiezza del-

l’impulso. Questo è equivalente ad affermare che il campo totale evolva in accordo

all’equazione

Ë(t) + 2αĖ(t) + α2 E(t) =

α2 X

δ(t − tn ) ,

N n|tn <t

(2.17)

dove la sommatoria nel membro a destra rappresenta il termine di sorgente dovuto

agli impulsi emessi a tempi tn < t. Quindi la dinamica della rete è data da N

equazioni (2.16) più la (2.17) che descrive l’evoluzione del campo.

2.3.2

Mappa guidata dall’evento

È conveniente trasformare le equazioni differenziali in una mappa a tempo discreto;

per fare questo occorre integrare l’equazione (2.17) tra il tempo tn e il tempo tn+1 ,

dove tn è il tempo immediatamente successivo all’emissione dell’n-simo impulso. La

mappa risultante è

E(n + 1) = E(n)e−ατ (n) + NQ(n)τ (n)e−ατ (n)

Q(n + 1) = Q(n)e−ατ (n) +

α2

,

N2

(2.18)

(2.19)

dove τ (n) = tn+1 − tn è l’intervallo temporale tra un impulso e il successivo e dove

abbiamo introdotto la nuova variabile Q := (αE + Ė)/N. L’ equazione (2.16) può

essere integrata anche esplicitando la dipendenza temporale nota del campo E

vi (n + 1) = vi (n)e−τ (n) + a 1 − e−τ (n) + gF (n)

i = 1, . . . ,N .

(2.20)

dove F è

NQ(n)

τ (n)e−ατ (n)

e−τ (n) − e−ατ (n)

E(n) +

−

NQ(n) .

F (n) =

α−1

α−1

(α − 1)

!

(2.21)

L’intervallo temporale tra un impulso e l’altro τ è ottenuto imponendo la condizione

vm (n + 1) = 1,

"

vm (n) − a

τ (n) = ln

1 − gF (n) − a

#

.

(2.22)

dove l’indice m identifica il neurone più vicino a soglia. Le equazioni (??, 2.19)

e (2.21) possono essere scritte in una forma più compatta esprimendo F (n) come

funzione di τ (n) per mezzo dell’equazione (2.22),

vi (n + 1) = vi (n)e−τ (n) + 1 − vm (n)e−τ (n)

j = 1, . . . ,N − 1 .

(2.23)

Dal momento che in una rete di neuroni indistinguibili viene preservato l’ordine dei

potenziali vi , è conveniente per prima cosa ordinarli e poi introdurre il sistema di

riferimento comovente, ovvero xj (n) = vj−n (n). In questo sistema di riferimento

l’indice del neurone più vicino a soglia è costante e può essere scelto sempre uguale

a 1, senza perdere di generalità; l’equazione di aggiornamento può dunque essere

scritta come

xj−1 (n + 1) = xj (n)e−τ (n) + 1 − x1 (n)e−τ (n)

j = 1, . . . ,N − 1 ,

(2.24)

con la condizione al contorno xN = 0 e dove,

"

x1 (n) − a

τ (n) = ln

1 − gF (n) − a

#

.

(2.25)

L’insieme di equazioni (2.18, 2.19, 2.24, 2.25, 2.21) definisce una mappa a tempo

discreto che è completamente equivalente all’insieme di equazioni differenziali di

partenza. Si ottiene cosı̀, che una rete di N neuroni identici può essere descritta per

mezzo di N + 1 equazioni, due delle quali tengono conto della dinamica di E(n),

mentre le rimanenti N − 1 equazioni descrivono l’evoluzione dei neuroni (un grado

di libertà è stato perso perso andiamo da uno sparo all’altro, ovvero xN non è più

una variabile dal momento che è stata posta, per definizione, sempre uguale a 0). Il

modello ha una dimensione finita, inoltre, in questo sistema di riferimento, lo splay

state periodico si riduce ad un punto fisso che soddisfa le seguenti condizioni:

τ (n) ≡

T

,

N

E(n) ≡ Ẽ ,

(2.26)

Q(n) ≡ Q̃ ,

x̃j−1 = x̃j e−T /N + 1 − x̃1 e−T /N ,

(2.27)

(2.28)

dove T è il tempo che intercorre tra due emissioni di impulso consecutive dello stesso

neurone. Attraverso un semplice calcolo si ottiene

−1

−1

α2 Q̃ = 2 1 − e−αT /N

, Ẽ = T Q̃ eαT /N − 1

.

N

La soluzione dell’equazione (2.28) coinvolge una serie geometrica, la quale, insieme

alla condizione di bordo x̃N = 0, porta ad un’equazione trascendentale per il periodo

T ; senza dar luogo a sorprese, il risultato è indipendente dall’ampiezza dell’impulso

α. Per semplicità riportiamo solo i termini all’ordine O(1/N) nel limite N ≫ 1,

aT + g 1 − e−j T /N ,

"T

#

aT + g

T = ln

.

(a − 1)T + g

x̃N −j =

(2.29)

(2.30)

Se supponiamo di aver a che fare con neuroni disaccoppiati in regime di sparo ripetitivo, cioè se prendiamo a > 1, il periodo T è ben definito nel caso eccitatorio (g > 0)

solo per g < 1 (T → 0 quando g si avvicina ad 1), mentre nel caso inibitorio (g < 0),

esiste una soluzione significativa per qualsiasi valore dell’accoppiamento (T → ∞

per g → −∞).

2.3.3

Stabilità lineare

Al fine di effettuare l’analisi di stabilità dello splay state, è necessario linearizzare le

equazioni (2.18, 2.19, 2.24) attorno al punto fisso (2.26, 2.27, 2.28),

δE(n + 1) = e−αT /N δE(n) + T e−αT /N δQ(n)

−

αẼ − N Q̃e−αT /N δτ (n) ,

δQ(n + 1) = e−αT /N δQ(n) − αQ̃e−αT /N δτ (n) ,

δxj−1 (n + 1) = e−T /N [δxj (n) − δx1 (n)] + e−T /N (x̃1 − x̃j )δτ (n) ,

(2.31)

(2.32)

(2.33)

dove abbiamo introdotto δτ (n), la cui espressione può essere ottenuta linearizzando

le equazioni (2.25,2.21)

δτ (n) = τx δx1 (n) + τE δE(n) + τQ δQ(n) ;

(2.34)

dove τx := ∂τ /∂x1 e dove sono state adottate definizioni analoghe per τE e τQ .

La condizione al contorno xN ≡ 0 imposta dal sistema di riferimento comovente

dà δxN = 0. In pratica, il problema di stabilità è risolto calcolando lo spettro di

1.0

Im{µk}

0.5

0.0

-0.5

-1.0

-1.0

-0.5

0.0

Re{µκ}

0.5

1.0

Figura 2.9. Cerchio unitario e moltiplicatori esatti dello spettro di Floquet per la

mappa completa per N = 20 (cerchi rossi) e N = 10 (cerchi blue) per accoppiamento eccitatorio. I parametri sono a = 3.0, g = 0.4, e α = 30.0.[26]

Floquet dei moltiplicatori {µk }, k = 1, · · · ,N + 1, associati con il problema agli autovalori dell’insieme di equazioni lineari (2.31,2.32,2.33); tale calcolo deve essere, in

generale, effettuato, numericamente. Discutiamo innanzitutto il caso banale g = 0;

in questo caso si trova che µk = exp(iϕk ), dove ϕk =

2πk

,

N

k = 1, · · · ,N − 1, e

µN = µN +1 = exp(−αT /N). Gli ultimi due esponenti interessano la dinamica del

campo di accoppiamento E(t), il cui decadimento è regolato dalla scala temporale α−1 . Non appena l’accoppiamento è acceso, piccole fluttuazioni di ampiezza

∼ O(g/N) influenzano la dinamica dei neuroni e i moltiplicatori dello spettro di

Floquet assumono la forma

µk = eiϕk eT (λk +iωk )/N , ϕk =

2πk

, k = 1, . . . ,N − 1 ,

N

(2.35)

µN = eT (λN +iωN )/N , µN +1 = eT (λN+1 +iωN+1 )/N ,

dove λk e ωk sono la parte reale e immaginaria degli esponenti di Floquet.

In figura (2.9) mostriamo i moltiplicatori dello spettro di Floquet dello splay

state nel caso di accoppiamento eccitatorio e valori di N finiti. I moltiplicatori con

k = 1, · · · ,N − 1 sono molto vicini al cerchio unitario, mentre i due moltiplicatori

isolati µN e µN +1 giacciono molto vicini all’asse reale all’interno del cerchio unitario.

Dal momento che, già per g/N ≈ O(10−2 ), i moltiplicatori del caso accoppiato

possono essere visti come una “perturbazione” piccola del caso non accoppiato (cioè

con g = 0), possiamo cercare di dar vita ad un approccio perturbativo. Prima

di effettuare questo tipo di analisi occorre sottolineare che la variabile ϕk gioca lo

stesso ruolo giocato dal numero d’onda nell’analisi di stabilità lineare di sistemi

spazialmente estesi, cosı̀ che possiamo dire che λk caratterizza la stabilità del kesimo modo. Nell’analisi che segue è conveniente distinguere tra i modi caratterizzati

da ϕk ≈ 0, mod(2π) +O(1/N) e tutti gli altri modi. Si identificano dunque due

componenti spettrali che richiedono di essere trattate in modo matematicamente

diverso: la prima componente corrisponde alla condizione kµk − 1k ∼ N −1 ed è

identificata con la dicitura “lunghezze d’onda grandi” (in inglese long wavelenghts

o LWs); la seconda componente corrisponde a kµk − 1k ∼ O(1) ed è identificata con

“lunghezze d’onda brevi” (in inglese short wavelenghts o SWs).

2.4

Impulso di durata finita

Analizziamo adesso il problema di stabilità dello splay state per reti soggette ad

impulsi con α finito (cioè indipendente dalla dimensione del sistema) per grandi

valori di N. Considerando i termini all’ordine 1/N, la mappa ad evento guidato

(vedi equazioni (2.18, 2.19, 2.24) ) si semplifica nel seguente insieme di N + 1

equazioni:

E(n + 1) = (1 − ατ )E(n) + NQ(n)τ ,

Q(n + 1) = (1 − ατ )Q(n) +

α2

,

N2

xj−1 (n + 1) = (1 − τ )xj (n) + 1 − x1 (n) + τ ,

(2.36)

(2.37)

(2.38)

dove j = 1, . . . ,N −1 mentre τ x1 è stato approssimato con τ poiché 1−x1 ≈ O(1/N).

L’espressione per l’intervallo di intersparo (2.25) si semplifica cosı̀ in

τ (n) =

1 − x1 (n)

.

a − 1 + gE(n)

(2.39)

La soluzione periodica per il campo che tiene conto di tutti gli impulsi diventa

Ẽ = T −1 e Q̃ = α/NT , mentre x̃j e il periodo T sono ancora dati dall’equazioni

(2.29, 2.30). Lo spettro degli autovalori di Floquet µk , k = 1, · · · ,N + 1 può essere

ottenuto linearizzando le equazioni (2.36, 2.37, 2.38) nell’intorno di questa soluzione

periodica e assumendo che ciascuna perturbazione cresca come µnk

µk δE = (1 − αT /N)δE + T δQ ,

µk δQ = (1 − αT /N)δQ −

(2.40)

α2

δτ ,

NT

(2.41)

µk δxj−1 = (1 − T /N)δxj − δx1 + (1 − x̃j )δτ ,

(2.42)

Un’espressione esplicita per δτ si può ottenere valutando la derivata dell’equazione

(2.39)

δτ = −

T2

T

δE − δx1 .

N

g

Sostituendo quanto trovato nelle equazioni (2.40,2.41,2.42), vediamo che il problema

agli autovalori consiste nel trovare le N + 1 radici µk del polinomio associato; una

semplificazione parziale del problema può essere ottenuta estraendo dalle equazioni

(2.41) e (2.42) la dipendenza di δτ dalla perturbazione del potenziale del neurone

più vicino a soglia δx1

δτ = Kδx1

(2.43)

dove

α2 gT

K = −(a − 1 + g/T ) + 2

N (µk − 1 + αT /N)2

"

#−1

.

(2.44)

Infine, sostituendo questa espressione nell’equazione (2.40), otteniamo un insieme

chiuso di equazioni per le perturbazioni del potenziale di membrana,

µk δxj−1 = (1 − T /N)δxj + (K − 1)δx1 − K x̃j δx1 .

(2.45)

Dopo aver imposto la condizione di bordo δxN = 0, l’equazione (2.45) si riduce alla

seguente equazione agli autovalori:

µkN −1 eT

1 − µkN −1

1 − µkN −1 eT

= K(a + g/T )

− [K(a − 1 + g/T ) + 1]

,

1 − µk

1 − µk eT /N

(2.46)

dove K è una funzione di µk . Al fine di risolvere questa equazione analiticamente è

necessario effettuare la distinzione tra lunghezze d’onda grandi e piccole.

2.4.1

Lunghezze d’onda grandi

Consideriamo i modi per cui kµk −1k ∼ N −1 (o, equivalentemente, ϕk ≈ 0, mod(2π)