Introduzione alle Reti Neurali

E.Mumolo

[email protected]

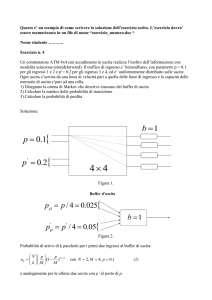

Reti neurali artificiali

Modelli di calcolo parallelo vagamente ispirati dalla biologia.

Caratteristiche principali:

Una rete non è programmata per realizzare un algoritmo ma apprende

tramite esempi

Capacità di apprendimento: fornendo esempi opportuni una rete riesce a

organizzarsi per realizzare una funzione arbitraria y= f (x)

Capacità di generalizzare: la rete correttamente addestrata può fornire una

risposta anche a richieste non incluse negli esempi

Tolleranza agli errori: indipendenza al rumore di ingresso

Tolleranza ai guasti funzionamento ragionevole anche se qualche neurone

non funziona correttamente

Neurone biologico

Ingressi: Dendriti

Uscita: Assone

Connessione Assone-Dendriti mediante sinapsi

I neuroni agiscono a soglia → quando la somma degli

ingressi supera un certo valore il neurone produce una

uscita

Neurone artificiale

Funzione non lineare

w i ∈ R pe s i

θ ∈ R s o g lia

h : fu n zio n e di a tt iv a zio n e

Uscita: 1 se somma pesata degli ingressi > soglia; -1 altrimenti

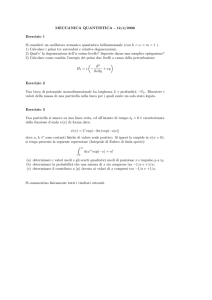

Funzioni di attivazione

2

20

1 .5

18

16

12

8

6

١

y=

١ + exp(− x)

0 .5

y= x

10

Sigmoide

1

Lineare

14

0

-0 .5

-1

4

-1 .5

2

-2

-1 0

0

0

2

4

6

8

10

12

14

16

18

-8

-6

-4

-2

0

2

4

6

8

10

20

2

Tangente iperbolica

1 .5

1

0 .5

y=

0

-0 .5

-1

-1 .5

-2

-1 0

-8

-6

-4

-2

0

2

4

6

8

10

exp( x ) − exp(− x )

exp( x) + exp(− x)

Strutture a singolo strato → Percettrone

Percettrone

Rosenblatt (1962)

Separatore lineare

Ingressi: vettori di numeri

reali

Uscita :1 or -1

y = sign(v)

c0

1

∑

+

++

+ +

+

+

+

+

+

++ +

+

+ +

+

+

+

++ +

+ + + + ++

+ +

+

+

+

+

++

y= −1

v = c0 + c1 x1 + c2 x2

c2

c1

x1

x2

y = +1

c0 + c1 x1 + c2 x2 = 0

Strutture MultiStrato

→ Rete Neurale Feed Forward

Strato d'uscita

2o strato nascosto

1o strato nascosto

Ingressi

x1

x2

…..

xn

Proprietà fondamentale delle reti

Approssimatori universali

Teorema: Ogni funzione limitata può essere

approssimata con una rete neurale con un numero finito

di strati nascosti con precisione arbitraria

Tipi di approssimatori;

– Lineari: il numero di parametri cresce

esponenzialmente con le variabili

– Non lineari: il numero di parametri cresce linearmente

con le variabili

Addestramento della rete

(Apprendimento)

Backpropagation

Backpropagation

Backpropagation

Backpropagation

Problemi non separabili linearmente

Strutture

Singolo strato

Due strati

Tre strati

Tipi di regioni

Semipiano

Regioni

convesse

Regioni di

arbitraria

complessità

Problemi XOR

A

B

B

A

A

B

B

A

A

B

B

A

Configurazioni generiche