B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

CAP. 2 - CAMPIONAMENTO e DISTRIBUZIONI

CAMPIONARIE

Introduzione

Nella premessa a queste note si è avuto modo di distinguere la statistica descrittiva dalla

statistica induttiva (inferenza statistica) sottolineando che si opera nel primo ambito

quando si dispone di tutte le manifestazioni del fenomeno d’interesse, in tali circostanze

la statistica (descrittiva) si risolve in un insieme di metodi che consentono una

compattazione adeguata delle informazioni disponibili per rendere possibile o,

quantomeno, facilitare la comprensione degli aspetti del fenomeno che più interessano (a

fini conoscitivi e/o decisionali).

Se per qualche motivo (perché impossibile o perché non conveniente) non si dispone

di tutte le manifestazioni del fenomeno ma soltanto di un sottoinsieme di queste, si

dispone cioè di un campione casuale di manifestazioni del fenomeno d’interesse, la

statistica (induttiva) si caratterizza come l’insieme delle teorie e dei metodi che

consentono di pervenire, utilizzando i dati campionari, a delle conclusioni che siano “il

più vicino possibile” a quelle cui si sarebbe pervenuti disponendo di tutte le

manifestazioni del fenomeno.

Nel caso in cui si ritiene che il fenomeno sia governato da una legge esprimibile

analiticamente (modello probabilistico), anche se nella generalità dei casi si tratta di una

approssimazione alla realtà, qualunque insieme di manifestazioni del fenomeno a

disposizione rappresenta necessariamente un campione essendo l’intera popolazione

rappresentata dal modello (superpopolazione).

2.1 Campioni casuali

Se con P si indica l’insieme di tutte le possibili manifestazioni del fenomeno di interesse

e con Cp un suo sottoinsieme (Cp P), operando su Cp (campione) si vogliono trarre

conclusioni valide per P , si vuole, cioè, inferire dal campione alla popolazione.

La statistica (induttiva) tratta in modo quasi esclusivo dei campioni casuali (campioni

probabilistici), cioè, dei sottoinsiemi Cp di P cui si perviene attraverso l’applicazione di

un qualche meccanismo di selezione avente natura probabilistica. Non costituisce, quindi,

parte integrante della statistica induttiva (inferenza statistica) l’analisi dei campioni non

probabilistici; rientrano in quest’ultima categoria i cosiddetti campioni ragionati e quelli

per i quali non è noto il meccanismo generatore.

143

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

E’ campionamento ragionato quello che individua le unità campionarie, cioè le unità

statistiche portatrici delle informazioni (manifestazioni del fenomeno d’interesse),

attraverso l’applicazione di procedure basate sull’impiego ragionato dell’informazione

disponibile al momento in cui si procede all’individuazione delle unità che andranno a

costituire il campione. In proposito si deve, comunque, sottolineare che le informazioni

disponibili costituiscono spesso la base di schemi di campionamento probabilistico più

complessi (campionamento sistematico, campionamento stratificato, campionamento a

grappolo, campionamento a più stadi, campionamento stratificato a più stadi, ecc.), ma

in tali circostanze le informazioni disponibili vengono utilizzate solo per incrementare

l’efficienza (attraverso una riduzione della variabilità campionaria) del processo di

induzione dal campione alla popolazione, e non per individuare le singole unità che

andranno a costituire il campione che saranno comunque estratte casualmente.

In questa sede si tratterà esclusivamente del campionamento casuale semplice; cioè,

dei campioni cui si perviene procedendo all’estrazione di n (dimensione del campione)

elementi che hanno la stessa probabilità di essere inclusi nel campione.

Nell’ambito del campionamento si ipotizzerà sempre (almeno a livello teorico)

l’esistenza di un modello probabilistico capace di rappresentare adeguatamente il

fenomeno che interessa analizzare. In altre parole, si assumerà che la popolazione P sia

rappresentata da una variabile casuale semplice o multipla con una propria funzione di

distribuzione non completamente nota. Ovviamente, se la funzione di distribuzione fosse

completamente nota si tornerebbe al caso di disponibilità completa di tutte le possibili

manifestazioni del fenomeno d’interesse.

Se si fa riferimento al caso unidimensionale, ma ragionamento analogo vale anche nel

caso multidimensionale, la situazione di riferimento è quella di una variabile casuale

semplice X con funzione di distribuzione F x ; 1 ,2 ,....,k F x ; , dove

(1 ,2 ,....,k ) è l’insieme (vettore) dei parametri caratteristici del modello definiti

nello spazio parametrico Θ k Θ k ; cioè, lo spazio di variabilità dei parametri che

caratterizzano lo specifico modello, rappresentativo della specifica situazione reale,

nell’ambito della famiglia di distribuzioni espressa dalla funzione F , .

Se, come avviene usualmente, si considera la funzione di massa (caso discreto) o di

densità (caso continuo) di probabilità della variabile casuale X , si dirà che si sta trattando

della variabile casuale semplice X con funzione di massa o di densità di probabilità

f x ; 1 ,2 ,....,k f x ; .

Si è detto che esiste un problema di inferenza statistica quando la funzione di

distribuzione F , non è completamente nota; al riguardo si possono distinguere

almeno due situazioni di mancanza di conoscenza: la prima situazione è quella

caratterizzata da una conoscenza parziale della funzione F x ;

nel senso che si

conosce la forma analitica della funzione ma non si conosce il valore di tutti o di alcuni

parametri caratteristici della funzione stessa, in questa circostanza si parla di inferenza

144

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

statistica parametrica. La seconda situazione è quella d’ignoranza completa: non si

conosce sia il valore dei parametri sia la forma analitica della funzione di massa o di

densità di probabilità; in questa circostanza si parla di inferenza statistica non

parametrica. Una terza situazione, intermedia rispetto alle due precedenti, è quella in cui

si specificano certe componenti del modello (ad esempio si suppone che la v.c.

appartenga alla famiglia esponenziale ma non si specifica la sottofamiglia: forma

funzionale della funzione di massa o di densità). Se si opera in tale contesto si parla di

inferenza statistica semi-parametrica, nel senso che la forma analitica del modello

probabilistico rappresentativo del fenomeno in esame è specificata solo parzialmente.

Si ricorda che la dizione inferenza statistica non parametrica non è certamente la più

appropriata in quanto interpretabile come se, in questo ambito, le procedure di statistica

induttiva non riguardassero i parametri. Ovviamente, questa interpretazione è fuorviante,

infatti, con la dizione “non parametrica” si vuole, molto semplicemente, caratterizzare le

situazioni inferenziali nelle quali non si conosce forma analitica e valore dei parametri

caratteristici, elementi questi entrambi coinvolti nelle procedure inferenziali. La dizione

corretta per caratterizzare tali situazioni è quella di inferenza statistica libera da

distribuzione (distribution free).

E’ già stato sottolineato che in queste note si parlerà in modo esclusivo di

campionamento casuale semplice; in realtà il limite è ancora più rigido, infatti, la

trattazione sarà limitata al campionamento casuale semplice con ripetizione

(campionamento bernoulliano), in questo contesto le variabili casuali associate a

ciascuna unità campionaria risultano indipendenti e identicamente distribuite (i.i.d.).

Al riguardo si deve, comunque, sottolineare che nelle situazioni reali, soprattutto

quando si procede all'estrazione di unità campionarie da popolazioni finite, il

campionamento che si realizza è quello esaustivo (campionamento casuale semplice

senza ripetizione), ma è anche vero che nella generalità dei casi le differenze tra i due

schemi di campionamento diventa operativamente irrilevante avendo a che fare con

popolazioni di dimensione molto elevate, dimensione che diventa infinita nel caso di

variabili casuali continue. Tale motivazione giustifica la trattazione del campionamento

bernoulliano molto più semplice dal punto di vista analitico. Al riguardo si sottolinea,

comunque, che i campioni casuali semplici senza ripetizione pur non soddisfacendo

l’ipotesi di indipendenza soddisfano l’ipotesi di scambiabilità1.

Definizione 1

1

Se X1, X2,...,Xn costituiscono un insieme di variabili casuali indipendenti

Nel caso di campionamento con ripetizione è soddisfatta la condizione (cfr. Definizione 1)

n

F x1 ,x2 ,....,xn ; F xi ;

i 1

Mentre la condizione di scambiabilità è molto meno restrittiva e richiede il soddisfacimento della relazione

F x1 ,x2 ,....,xn ; F x 1 ,x 2 ,....,x n ;

per tutte le permutazioni

1 , 2 ,....., n .

145

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

e identicamente distribuite (i.i.d.), la loro funzione di massa o di densità

di probabilità congiunta soddisfa l'uguaglianza

f x1 ,x2 ,....,xn ; θ1 ,θ2 ,....,θk f x ;

n

f x1 ; f x2 ; .... f xi ; .... f xn ; f xi ;

i 1

allora si dice che l’insieme di variabili casuali i.i.d. X1, X2,...,Xn

costituisce un campione casuale semplice di n

osservazioni

indipendenti relativo alla variabile casuale X che ha funzione di massa o

di densità di probabilità equivalente a quella (comune) di ciascuna

componente

Xi

del campione. Il punto campionario

X

ad n

'

X1, X 2 ,...., X n è definito nello spazio o universo dei campioni

dimensioni C n X Cn .

Nella formula sopra riportata con

f xi ; , per i = 1, 2,..,n, si è indicata la

funzione di massa, o di densità di probabilità, dell'i-esimo elemento costituente il

campione. Avendo supposto l'indipendenza tra le osservazioni campionarie, si avrà, come

già sottolineato, l'uguaglianza (equivalenza) tra la distribuzione della variabile casuale X

relativa alla popolazione e la variabile Xi (tale deve essere intesa a priori, cioè prima

dell'effettiva estrazione del campione) relativa all'i-esimo elemento campionario (i = 1, 2

...,n).

Dalla definizione risulta che se, ad esempio, si volesse estrarre un campione di n

elementi da una popolazione distribuita normalmente, con media e varianza 2 , la

funzione di densità di probabilità del campione casuale è

n

f x1 , x2 ,...., xn f x1 , x2 ,...., xn ; , 2 f xi ; , 2

n

i 1

1

2 2

e

1 xi

2

2

1

2

2

n/2

e

1

2 2

i 1

n

xi

2

i 1

Se l'estrazione del campione di n elementi riguardasse una v.c. di Poisson

caratterizzata dal parametro , la funzione di massa di probabilità del campione casuale

è:

f x1 , x2 ,...., xn f x1 , x2 ,...., xn ;

n

n

f xi ; λ

i 1

i 1

λ xi λ

e

xi!

µ,2 )

Alle due funzioni f(x1, x2,...,xn;

e f(x1,x2, ..., xn; ) sopra riportate e, in

generale, ad ogni funzione di massa o di densità di probabilità campionaria può essere

associata una seconda interpretazione che introduce nella trattazione un concetto di

estrema rilevanza: la funzione di verosimiglianza. Si tratta di una funzione del tutto

146

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

equivalente, in termini formali, alla funzione di massa o di densità di probabilità

campionaria, ma che da questa si diversifica sostanzialmente. Infatti, la funzione

f x1 , x2 ,...., xi ,...., xn ; f

n

x; f xi ;

i 1

x1 , x2 ,...., xi ,...., xn

è detta di verosimiglianza quando alla n-pla

vengono attribuiti i

valori campionari osservati; pertanto, essendo x1 , x2 ,...., xi ,...., xn quantità note, la

f x1 , x2 ,...., xi ,...., xn ;

è, in realtà, funzione del solo parametro (o parametri)

per un campione prefissato. Per evidenziare questa particolare interpretazione si può

rappresentare algebricamente la funzione di verosimiglianza con l’espressione

n

L L / X x f / xi

i 1

'

dove X

X1, X 2 ,...., X n

casuale) associata alle

n

rappresenta la variabile casuale ad n dimensioni (vettore

rilevazioni campionarie, mentre

x' x1, x2 ,....., xn

rappresenta il punto campionario, cioè una specifica determinazione del vettore

casuale X , definito nello spazio o universo dei campioni a n dimensioni .

Pertanto, nella prima interpretazione, la funzione

n

f x; f xi ;

i 1

si riferisce all’universo dei campioni, si tratta, come già sottolineato, di un riferimento a

priori, cioè prima dell’effettiva estrazione del campione. In questo contesto, le variabili

che interessano sono, appunto le n componenti, X1, X2,…,Xn, associate a ciascun punto

campionario per un dato valore del parametro , o del vettore dei parametri

Nella seconda interpretazione, la variabile di riferimento è il parametro (vettore dei

parametri) incognitoin quanto si assume l’avvenuta estrazione campionaria delle unità

statistiche di osservazione e le variabili associate a ciascuna unità (punto campionario)

hanno assunto una specifica determinazione, sono cioè delle costanti note, mentre

(parametro o vettore dei parametri) assume la natura di variabile essendo tale entità

un’incognita del problema. Al riguardo si sottolinea che nel contesto della così detta

inferenza statistica classica ,pur essendo teoricamente variabile in quanto incognito,

non ha la natura di variabile casuale, interpretazione questa, che come si avrà modo di

chiarire successivamente, è propria dell'inferenza statistica bayesiana. Un tentativo, non

completamente riuscito a parere delle scrivente, di attribuzione di natura aleatoria al

parametro (o parametri) è rappresentato dalla cosi detta inferenza fiduciale proposta da

Fisher nel 1930 attraverso l'introduzione del concetto di probabilità inversa che non ha

natura di distribuzione di probabilità a priori. Comunque, alcune generalizzazioni e

sviluppi recenti dell'inferenza fiduciale sembrano fornire una risposta soddisfacente ad

alcune perplessità insite nell'impostazione iniziale data da Fisher 2.

2

Al riguardo si può consultare, tra gli altri, Hannig (2009), On generalized fiducial inference, Statistica Sinica, 19.

147

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

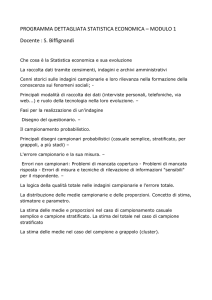

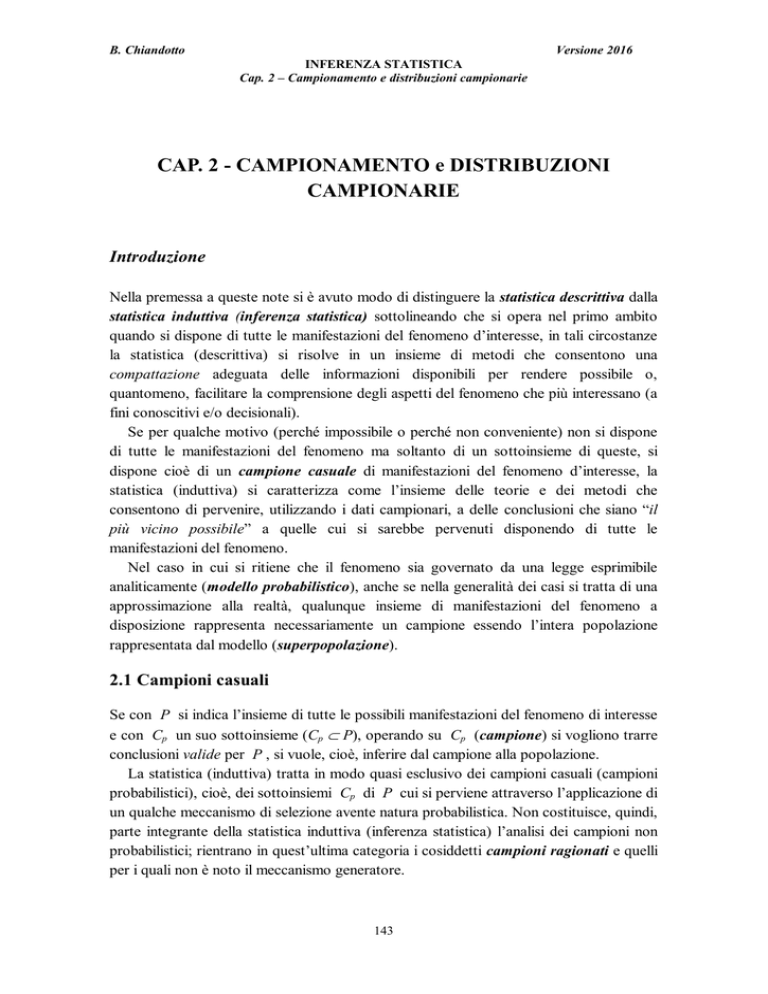

Esempio 2.1

Si consideri una popolazione bernoulliana (variabile casuale di Bernoulli X che può assumere

i due valori 0, assenza del carattere, ed 1, presenza del carattere) con parametro caratteristico

= p e si supponga che da tale popolazione si voglia procedere all’estrazione di n = 6, n =

12 ed n = 36 unità campionarie rimettendo ogni volta l’unità estratta nella popolazione

(campionamento bernoulliano). In tali situazioni la funzione di massa di probabilità è quella

sotto riportata

n

n

f(x1,x2,…,xn;p) =

f(x ;p) =

i

xi

n

p i 1 ( 1 p )

n

xi

i 1

i 1

dove basterà sostituire ad n i valori 6, 12 e 36.

Se si procede alla rilevazione campionaria nei tre casi sopra considerati e le sequenze

osservate sono, rispettivamente:

- (1,0,1,1,1,1) per n = 6 (x=5);

- (1,1,0,1,1,1,1,1,1,1,0,1) per n = 12 (x=10);

- (0,1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,0,1,1,1,0,0,1,1,1,1,1,0,1,0,1,1) per n = 36 (x=30).

Le funzioni di verosimiglianza sono :

L(p) = p5 (1-p)1

per 0 p 1

10

2

L(p) = p (1-p)

per 0 p 1

30

6

L(p) = p (1-p)

per 0 p 1

la cui rappresentazione grafica è riportata alla pagina successiva.

Osservando la Fig. 2.1 si rileva in modo molto evidente la tendenza alla normalità della

funzione di verosimiglianza al crescere della dimensione campionaria.

Per una comprensione più immediata sia dei metodi statistici che verranno trattati in

seguito, sia delle loro proprietà, occorre sempre tenere presente la distinzione fra

variabile casuale e determinazioni (valori osservati) della variabile casuale stessa: prima

di effettuare l'estrazione campionaria gli elementi costituenti il campione X1, X2,...,Xn,

sono variabili casuali; infatti, l'elemento generico Xi (i = 1, 2 ..,n) ha, come già

sottolineato, una struttura del tutto analoga a quella della variabile casuale X, ha cioè la

stessa funzione di distribuzione e, quindi, stessa funzione di massa o di densità di

probabilità. Dopo aver osservato i risultati campionari, le quantità x1 , x2 ,...., xn

costituiscono particolari determinazioni della variabile casuale X.

Poiché gli elementi costituenti un campione sono delle variabili casuali, è variabile

casuale anche ogni funzione T(X1,X2,…,Xn) non costante degli stessi. Tale funzione, che

non dipende dai parametri incogniti 1 , 2 ,...., k ,viene usualmente detta statistica

(dall’inglese statistic). Sarà, quindi, possibile derivare la funzione di massa o di densità di

probabilità di tale variabile in funzione della distribuzione di massa o di densità di

probabilità delle variabili casuali associate ai singoli elementi campionari.

148

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

L(p)

0.08

0.07

0.06

n= 6 , x = 5

0.05

0.04

0.03

0.02

0.01

0

0

0.1

0.2

0.3

0.4

0.5

0.6

0.7

0.8

0.9

1

L(p)

0.005

0.0045

n =12 , x = 10

0.004

0.0035

0.003

0.0025

0.002

0.0015

0.001

0.0005

0

0

0.1

0.2

0.3

0.4

0.5

0.6

0.7

0.8

0.9

1

L(p)

n =36 , x = 30

0,0000001

9E-08

8E-08

7E-08

6E-08

5E-08

4E-08

3E-08

2E-08

1E-08

0

0

0,1

0,2

0,3

0,4

0,5

0,6

0,7

0,8

0,9

1

Fig. 2.1 – Funzione di verosimiglianza relativa a n prove con ripetizione effettuate su una

popolazione in cui ciascuna unità è caratterizzata dalla presenza o assenza di uno

specifico carattere

149

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

2.2 Sufficienza

Da quanto sopra detto, qualunque statistica, cioè qualunque funzione

T(X1,X2,…,Xn)=T(X’) degli elementi campionari che non contiene parametri incogniti, è

essa stessa variabile casuale come gli elementi Xi (i = 1, 2,….,n) costituenti il campione.

Una statistica potrebbe, al limite, contenere tutte le informazioni campionarie,

rappresentare, cioè, un punto campionario nello spazio ad n dimensioni. Nella generalità

dei casi la funzione T compatta le informazioni, riducendo lo spazio di riferimento da

n dimensioni a k dimensioni dove k n è il numero dei parametri che caratterizzano

la v.c. che si sta trattando.

X

Definizione 1 (Sufficienza). Se

'

X1, X 2 ,...., X n

costituisce un campione

casuale semplice bernoulliano estratto da una popolazione rappresentata

dalla variabile casuale, discreta o continua X , con funzione di massa o di

densità di probabilità f(x;) , una statistica T X = T(X1,X2,…,Xn) si

dice sufficiente per il modello f(x;) se e solo se la distribuzione del

campione condizionata da un qualunque valore assunto dalla statistica

T(.) , cioè f(x1,x2,…,xn / T=t), è la stessa per qualunque valore di , cioè,

se e solo se la distribuzione condizionata del punto campionario

X

'

X1, X 2 ,...., X n

non varia al variare di non dipende da

Per comprendere il significato della definizione, si supponga per semplicità che T X

sia una v.c. discreta e t un possibile valore di T X , allora

P X x T X t ( x )

P X x T X t ( x )

P T X t ( x )

ma

X x T X t x 3, quindi

P X x T X t x P X x

quindi

P X x

p( x | )

P X x T X t ( x )

P T X t ( x ) q t ( x ) |

3

Infatti, l’uguaglianza

T X t x deve valere per qualunque funzione

150

T(.) ivi incluso

T X X .

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

dove p( x | ) è la distribuzione di massa di probabilità congiunta del campione X e

q t x | è la distribuzione di massa di probabilità di T X . Quindi, T X è una

statistica sufficiente per θ se, e solo se, per ogni x il rapporto

p( x | )

è una costante

q t ( x ) |

non dipendente da θ.

Il risultato ottenuto in precedenza conduce alla formulazione del seguente teorema:

Teorema 1: Se p( x; ) è la distribuzione di massa di probabilità congiunta di X e

q(t; ) è la distribuzione di massa di probabilità di T X , allora T X è

una statistica sufficiente per θ se, e solo se, x Ω il rapporto

p ( x; )

q(T ( x ); )

è una costante non dipendente da θ.

Esempio 2.2

Siano X 1 ,...,X n variabili casuali i.i.d. di Bernoulli con parametro p, 0 < p < 1. Allora

T X X1 ... X n è sufficiente per p. Infatti, osservando che T X indica il numero di Xi

uguali ad 1 ed ha una distribuzione binomiale b(n, p) allora

p xi (1 p )1 xi p xi (1 p) (1 xi )

n

p ( x; p )

p t (1 p) n t

q T ( x ); p n t

n t

n t

n t

n t

n t

t

t p (1 p)

t p (1 p)

t p (1 p )

1

Un risultato questo che non dipende dal parametro p.

Esempio 2.3

Siano X 1 ,...,X n variabili casuali i.i.d. da una popolazione N , 2 , con parametro σ2 noto.

Allora la media campionaria T X X è sufficiente per μ. Infatti, la distribuzione di densità

congiunta del campione X è:

f ( x; ) (2 2 ) 1/2 exp ( xi ) 2 2 2

i

(2 2 ) n /2 exp ( xi x x ) 2

i

2

2

(2 2 ) n /2 exp ( xi x ) 2 n ( x ) 2

i

151

2

2

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

e, poiché X segue una distribuzione N , n , allora il rapporto

2

(2 2 ) n /2 exp ( xi x ) 2 n( x ) 2 2 2

f ( x; )

i

2

2

1/2

2

q t ( x );

(2 n ) exp n x 2

n 1 2 (2 2 ) ( n 1)/2 exp ( xi x )2

i

2

2

non dipende da μ.

La definizione 1 ed il teorema 1 spesso non consentono una facile verifica della

proprietà di sufficienza, obiettivo questo che si può invece conseguire se si fa riferimento

ad un famoso teorema usualmente noto come criterio di fattorizzazione di NeymanFisher.

Teorema 2 (Criterio di fattorizzazione di Neyman-Fisher): Dato un campione casuale

semplice X1, X2,…,Xn estratto da una popolazione X con funzione di massa

o di densità di probabilità f(x;) , dove rappresenta il parametro

incognito, una statistica T(X1,X2,…,Xn) è sufficiente per il modello f(x;) se

e solo se vale la relazione:

n

f x1 , x2 ,..., xn ; f xi ; g T x1 , x2 ,..., xn ; hx1 , x2 ,..., xn

i 1

dove h(x1,x2,…,xn) è una funzione non negativa dei soli elementi campionari

e gT x1 , x2 ,..., xn ; è una funzione non negativa che dipende da e

dagli elementi campionari solo attraverso la funzione T .

Dimostrazione (caso discreto).

Poiché T X è una statistica sufficiente la distribuzione condizionata di X dato

T X t x non dipende da ma tenendo presente che:

X x T X t x P X x P X x T X t x

si ha

f ( x | ) P ( X x ) P X x T X t ( x )

P T X t ( x ) P X x T X t ( x )

per la sufficienza P X x T X t ( x ) P X x T X t ( x )

g (T ( x ) | ) h( x ).

152

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Si supponga che f ( x; ) g (T ( x); ) h( x) , ma

P T X t x

x:T X t x

h x

f x; g t x ;

x:T X t x

inoltre

se X x e T X t x , allora T x t x ma

P X x T X t x

P X x T X t x

P X x

P T X t x

P T X t x

g t x ; h x

g t x ;

x:T X t x

X x T X t x , quindi

h x

h x

h x

x:T X t x

che non dipende da , cioè, T X è una statistica sufficiente.

Corollario – Una statistica T = T(X1,X2,…..,Xn) è sufficiente per se e solo se la

funzione di verosimiglianza associata al punto campionario assume la forma

L gt x1 , x2 ,....., xn ;

Esempio 2.3 (continua)

Per il modello normale, la funzione di densità può essere scomposta nei fattori

f ( x ) (2 2 ) n / 2 exp

con h( x) (2 )

2 n / 2

x x / 2 exp n( x )

n

2

2

i

i 1

exp

(x x )

2

i

i

2

(2 2 )

(2 2 ) che non dipende dal parametro

2

2

incognito μ e g (t | ) exp n( x ) (2 )

che, viceversa, dipende dal campione

x solo attraverso la funzione t x x .

Per i modelli probabilistici appartenenti alla famiglia esponenziale l’individuazione di

statistiche sufficienti è immediata se si fa riferimento al criterio di fattorizzazione; infatti,

se X1 ,..., X n sono variabili casuali i.i.d. relative ad un campione estratto da una

distribuzione di massa o di densità di probabilità f ( x; ) che appartiene alla famiglia

esponenziale si ha:

f x; a h x e t x

quindi

153

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

n

f ( x1 , x2 ,....., xn ; ) f

x; f xi ;

i 1

a

n

n

h xi e

n

t xi

g T X ; h X

i 1

i 1

n

t xi

dove g T X ; a e

n

, h X

i 1

n

h xi e T X t xi , quindi

i 1

n

i 1

T X è statistica sufficiente per θ.

La definizione di sufficienza e il criterio di fattorizzazione possono essere facilmente

estesi al caso in cui la funzione di densità o di massa di probabilità è caratterizzata da un

vettore di k parametri 1 , 2 ,..., k cui corrisponde un vettore di k statistiche

'

T X T1 X , T2 X ,..., Tk X

'

(le dimensioni dei due vettori non devono

necessariamente coincidere).

La verosimiglianza assume la forma

n

L( x )

f x ;

i

i 1

a

n

n

hx e

n

i t xi

i 1

i

g T x; h x .

i 1

Se la famiglia esponenziale è regolare, le statistiche definite nel vettore T X , prese

nel loro insieme, sono congiuntamente sufficienti per 1 , 2 ,..., k .

Se la famiglia esponenziale è regolare, cioè se il supporto della v.c. X non dipende da

, il vettore T X T1 X , T2 X ,..., Tk X è sufficiente per .

'

Relativamente al concetto di sufficienza valgono, inoltre, le seguenti proprietà:

se T(.) è una statistica sufficiente (o un vettore di statistiche sufficienti), si

dimostra che qualsiasi trasformazione biunivoca di tale statistica (o vettore di

statistiche) è anch’essa sufficiente;

nel criterio di fattorizzazione, se in luogo di f(x; ) si considera il suo logaritmo

naturale log f(x; ), la scomposizione di tale funzione in due componenti si

realizza in modo analogo, con la differenza che i due fattori anziché moltiplicarsi

si traducono nella somma dei loro logaritmi. Infatti:

log f x1, x2 ,..., xn ; log g T x1, x2 ,..., xn ; h x1, x2 ,..., xn

log g T x ; h x log g T x ; log h x g1 T x ; h1 x

La proprietà richiamata in quest’ultimo punto sta ad indicare che se T(x) è sufficiente

per se e solo se log f (x; ) può essere scomposto nella somma di due funzioni

154

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

g1(T(x); ) e h1(x), di cui: la prima dipende dal parametro e dal campione solo attraverso

la funzione T(.); la seconda dipende solo dagli elementi del campione.

Esempio 2.3 (continua)

Per il modello normale, qualora sia μ che σ2 risultino incognite (cosicché il vettore dei

parametri risulti ( , 2 ) ), ogni parte della densità campionaria congiunta che dipende o

da μ o σ2 deve essere inclusa, per il teorema di fattorizzazione, nella funzione g(.). Da quanto

visto in precedenza si ha che

f ( x ) (2 2 ) n /2 exp ( xi x ) 2 n( x ) 2 / (2 2 )

i

(2 2 ) n /2 exp

(n 1)t

2

n(t1 ) 2 (2 2 )

g (t1 , t2 | , )h( x )

2

con

t1 x ,

t 2 ( xi x ) 2 (n 1)

h( x) 1 .

e

Quindi

i

T X T1 X , T2 X X , S 2 sono statistiche congiuntamente sufficienti per ( , 2 ) .

Riguardo alle statistiche sufficienti si deve, infine, sottolineare che l’intero campione X

è per definizione esso stesso una statistica sufficiente (con T x x e h x 1 per

ogni x ). Da ciò segue che ogni funzione biunivoca di una statistica sufficiente è ancora

una statistica sufficiente. Infatti, sia T * x r T x , con T x sufficiente e r

funzione biunivoca con inversa r–1. Allora, per il Teorema di fattorizzazione,

f ( x | ) g T ( x) | h( x) g r 1 T * ( x) / h( x) g * T * ( x) / h( x)

quindi T * ( x ) è una statistica sufficiente.

La non unicità delle statistiche sufficienti solleva un problema di scelta tra le

alternative possibili; ovviamente la scelta ottimale ricadrà sulla statistica caratterizzato

dal più elevato livello (in termini esplicativi) di sintesi, senza dover rinunciare ad alcuna

delle informazioni necessarie alla conoscenza dei parametri incogniti; una tale statistica

viene detta sufficiente minimale

Una statistica sufficiente minimale non è unica, in quanto una qualunque sua funzione

biunivoca è ancora una statistica sufficiente minimale.

2.3 Distribuzioni campionarie

Definizione 2 Si dice distribuzione campionaria ogni distribuzione di probabilità che

evidenzia la relazione esistente tra i possibili valori che possono essere

assunti (nell'universo dei campioni) da una qualsiasi funzione

T(X1,X2,…,Xn)=T(X) (ad es. un indice sintetico) applicata agli n

elementi campionari (casuali) e la distribuzione di massa o di densità di

155

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

probabilità associata agli n elementi costituenti il campione stesso.

Si consideri la funzione, definita sugli elementi X1, X2,...,Xn, di un campione casuale

semplice con ripetizione relativo ad una certa variabile X che ha momento

s-esimo (s = 1,2,3,…) pari a s e varianza pari a 2:

1 n

X s = Ts (X1,X2,...,Xn) = X is ; s=1,2,...

n i 1

che viene usualmente detto momento campionario, o momento empirico, di ordine s

rispetto all'origine. Evidentemente tale momento varierà al variare del campione e

descriverà una variabile casuale, la cui funzione di massa o di densità di probabilità

dipenderà dalla funzione di massa o di densità di probabilità delle variabili casuali

X1,X2,…,Xn, e quindi, dalla funzione di massa o di densità di probabilità della variabile

casuale X.

È facile verificare che il valore medio (momento primo rispetto all’origine) del

momento campionario s-esimo X s è pari al momento s-esimo della variabile X, infatti,

1 n

1 n

E X s E X is E X is E X s μ s

n i 1

n i 1

quindi, per s=1 si avrà

1 n

1 n

1 n

E X E X i E X i E X = E(X)= µ1=µ

n i 1

n i 1 n i 1

cioè, il valor medio della media campionaria è uguale alla media della popolazione.

La varianza della media campionaria è data da

1 n

1 n

2

Var X x2 Var

Xi 2

Var X i

n

n

n

i 1

i 1

cioè, la varianza della media campionaria è pari alla varianza della popolazione divisa per

la dimensione del campione.

La radice quadrata positiva (scostamento quadratico medio o deviazione standard)

della varianza campionaria di uno stimatore viene usualmente denominata errore

standard o errore di campionamento, volendo con ciò sottolineare la sua particolare

caratteristica di misura della bontà di uno stimatore in termini di variabilità. Tale

denominazione viene utilizzata tutte le volte che si procede al calcolo della varianza sulle

distribuzioni campionarie di indici sintetici; su questo punto si avrà comunque modo di

soffermarsi a lungo successivamente.

Nel caso di campionamento semplice esaustivo (senza ripetizione) si ha:

n

1 n

1 n

V ar X σ x2 Var X i 2 Var X i Cov X i , X j

i 1 i j

n i 1 n i 1

2

n - 1 σ *

1

σ

2 n σ 2 n (n 1 ) σ *

n

n

n

156

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

dove σ* CovX i ,X j per ogni i,j. Se si assume n=N, si ha:

Var X

da cui σ* -

σ 2 n - 1 σ *

0

n

n

σ2

che sostituito nella precedente espressione da

N 1

2

σ 2 n - 1 σ

σ2 N - n

Var X

n n N 1 n N - 1

N n

viene, come già sottolineato, usualmente detto fattore di correzione e

N1

fornisce una misura della maggiore efficienza del campionamento esaustivo rispetto al

campionamento con ripetizione.

Definendo la varianza campionaria (corretta) attraverso l’espressione:

n

1

X i X 2

S 2 T(X 1 ,X 2 ,...,X n )

n 1 i 1

si può verificare, nell'ipotesi di campionamento bernoulliano (campione casuale semplice

con ripetizione), che E (S2) è uguale a 2, cioè il valor medio della varianza campionaria

corretta è pari alla varianza della popolazione. Mentre la varianza della varianza

campionaria corretta S2 è espressa da:

1

n3 4

Var S 2 4

n

n 1

dove

dove 4 rappresenta il momento quarto rispetto alla media (momento centrale) della

4

popolazione ( 4 E X ) dalla quale viene estratto il campione mentre

4 2 .

2

Il computo del valore atteso della varianza campionaria corretta non presenta alcuna

difficoltà, infatti:

n

n

2

1

1 n

n

E S2 E

Xi X

E X i2 X 2 2X X i

i 1

i 1

n 1 i 1

n 1 i 1

n

1

n

n

n E X 2 2 n E X 2

2

2

EX2

n 1

n 1

n 1

n 1

ma

Var X E X 2 E X

2

2

2 2

n

n

2

2 n 1 2

2

2

2

EX

n

n

da cui

E S2

n

n

n

n

2

EX2

2

n 1

n 1

n 1

n 1

157

2 n 1 2

n

2 2 2 .

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Relativamente più laborioso è il computo della varianza della varianza campionaria

corretta, di seguito si riporta il momento secondo della varianza campionaria e la sua varianza

che si ottiene sottraendo a tale momento il momento primo al quadrato, cioè 2 .

2

n 1 2 4

E S 2 4

n

n n 1

2

2

2

1

n3 4

Var S 2 E S 2 E S 2 4

.

n

n 1

Esempio 2.4 (distribuzioni campionarie per campioni estratti da popolazioni discrete)

Si considerino cinque palline identiche a meno dei contrassegni numerici (1, 3, 5, 7, 9) che su

di esse sono riportati. La distribuzione di frequenza relativa alla variabile casuale associata

all’estrazione di una pallina può essere rappresentata nel modo seguente

Modalità

xi

Frequenze assolute

ni

1

3

5

7

9

1

1

1

1

1

Frequenze relative

fi=ni/n

(probabilità: pi)

1/5

1/5

1/5

1/5

1/5

Tab. 2.1 - Popolazione discreta uniforme

Si supponga di aver estratto 100 campioni casuali, di dimensione n = 2, dalla popolazione

riportata nella Tab.2.1 e che l'operazione di campionamento (effettuata reinserendo ogni volta

l'unità estratta nella popolazione) abbia dato luogo alle 100 coppie di risultati riportati nella

Tab. 2.2.

Se per ogni coppia di risultati campionari si procede al computo della media

X M 1 T X 1 , X 2

X1 X2

2

dove (X1, X2) rappresenta la coppia degli elementi costituenti il campione, si potrà derivare la

distribuzione campionaria sperimentale (relativa ai 100 campioni estratti) della media

aritmetica che sono riportati nella Tab. 2.3, dove, evidentemente, la frequenza assoluta ni sta

ad indicare il numero dei campioni (su 100 estratti) di due elementi per il quale si è realizzata

quella particolare modalità x i (media aritmetica dei due elementi campionari).

La distribuzione campionaria sperimentale della variabile riportata nella Tab. 2.3 costituisce

una approssimazione della distribuzione campionaria (teorica) di X . Se si procedesse

all'estrazione di una seconda serie di 100 campioni, di dimensione 2, si otterrebbe una diversa

distribuzione campionaria sperimentale di

158

X , tale da costituire

anche essa

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

un'approssimazione della distribuzione campionaria teorica di X . Considerando le due serie

di esperimenti ad un tempo (cioè 200 campioni di dimensione 2) si dovrebbe ottenere una

distribuzione campionaria sperimentale di X più vicina alla distribuzione teorica di quanto

non siano le due distribuzioni considerate separatamente.

N.

Campione

N.

Campione

N.

Campione

N.

Campione

N.

Campione

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

(3,3)

(5,3)

(1,1)

(7,3)

(1,5)

(3,5)

(5,5)

(5,7)

(9,3)

(3,3)

(5,7)

(7,3)

(3,7)

(3,3)

(1,7)

(5,9)

(9,1)

(3,9)

(7,3)

(7,5)

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

(5,3)

(9,3)

(5,9)

(7,3)

(5,5)

(9,9)

(9,5)

(9,7)

(7,3)

(3,7)

(3,1)

(5,5)

(9,1)

(5,9)

(5,9)

(9,1)

(3,1)

(7,1)

(7,7)

(7,9)

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

(3,7)

(1,7)

(5,7)

(7,7)

(1,9)

(3,3)

(3,7)

(3,1)

(1,1)

(1,7)

(1,5)

(9,1)

(7,7)

(7,3)

(5,9)

(3,5)

(9,7)

(5,7)

(5,1)

(1,3)

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

(5,1)

(3,5)

(3,1)

(7,7)

(1,1)

(9,7)

(1,3)

(9,5)

(3,5)

(9,7)

(9,7)

(1,3)

(1,5)

(7,1)

(3,5)

(5,5)

(3,5)

(9,5)

(7,1)

(9,5)

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

(1,9)

(3,7)

(9,3)

(9,1)

(5,9)

(5,3)

(1,9)

(9,5)

(1,9)

(5,5)

(9,3)

(1,1)

(3,3)

(1,3)

(5,1)

(1,5)

(1,5)

(7,1)

(7,1)

(3,5)

Tab. 2.2 - Prospetto dei risultati relativi a 100 campioni di dimensione 2, estratti casualmente

dalla popolazione riportata nella Tab. 2.1

Media campionaria

M1 xi

1

2

3

4

5

6

7

8

9

Frequenza assoluta

ni

4

8

13

18

25

10

15

6

1

Frequenza relativa

fi = ni/100

0,04

0,08

0,13

0,18

0,25

0,10

0,15

0,06

0,01

Tab. 2.3 - Distribuzione campionaria sperimentale della media aritmetica relativa ai risultati

159

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

riportati nella Tab. 2.2

Per determinare la distribuzione campionaria teorica della variabile casuale X si può seguire

la via sotto indicata.

a) - Si considerano tutte le possibili coppie di valori (X1, X2) estraibili (con ripetizione) dalla

popolazione riportata nella Tab. 2.1, che sono

(1,1)

(1,3)

(1,5)

(1,7)

(1,9)

(3,1)

(3,3)

(3,5)

(3,7)

(3,9)

(5,1)

(5,3)

(5,5)

(5,7)

(5,9)

(7,1)

(7,3)

(7,5)

(7,7)

(7,9)

(9,1)

(9,3)

(9,5)

(9,7)

(9,9)

e su queste coppie di valori vengono calcolate le medie aritmetiche;

b) - Si determina la probabilità relativa a ciascuna coppia (X1, X2). Essendo il campione

estratto con ripetizione da una popolazione uniforme si avrà

P X 1 x1 X 2 x2 P X 1 x1 P X 2 x2

1

25

per i, j = 1, 2, 3, 4, 5;

c) - Si sommano le probabilità relative alle coppie di valori che danno luogo alla stessa

media.

Il risultato delle operazioni indicate ai punti a), b), c), possono essere riassunti nella tabella

seguente

Modalità

M1 xi

1

2

3

4

5

6

7

8

9

Probabilità

f xi pi

0,04 0,08 0,12 0,16 0,20 0,16 0,12 0,08 0,04

Tab. 2.4 - Distribuzione campionaria (teorica) della media aritmetica per campioni di

dimensione 2 estratti dalla popolazione uniforme riportata nella Tab. 2.1

Il confronto tra i dati relativi alla distribuzione campionaria teorica e quelli relativi alla

distribuzione campionaria empirica è riportato nella figura seguente

160

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

0,25

0,2

0,18

0,16

0,16

0,13

0,12

0,15

0,12

0,1

0,08

0,08

0,06

0,04

0,04

0,01

1

2

3

4

5

Frequenze empiriche

6

7

8

9

Frequenze teoriche (probabilità)

Fig. 2.2 - Distribuzione campionaria sperimentale (come da Tab. 2.3) e teorica (come da Tab.

2.4) per la media calcolata su campioni di dimensione 2 estratti dalla popolazione

uniforme X: 1, 3, 5, 7, 9

Utilizzando i dati riportati nella Tab. 2.4 si derivano le uguaglianze

E X 5 , Var X σ x2

σ2

4

2

che verificano empiricamente la proprietà che ha il valor medio (valore atteso) della variabile

casuale media campionaria X di essere uguale al valor medio (media aritmetica) della

variabile casuale relativa all'intera popolazione e della varianza che risulta essere pari alla

varianza della popolazione divisa per la numerosità del campione.

Esempio 2.5 (distribuzioni campionarie per campioni estratti da popolazioni discrete)

Si considerino 6 palline identiche a meno della numerazione: {, , , , , }. La

funzione di massa della v.c. X = “risultato dell’estrazione di una pallina” è allora data da

x 1

1 / 2

1 / 3

x3

f(x) =

x9

1 / 6

0 altrimenti

Per tale v.c. è facile derivare i principali momenti. Il seguente prospetto riassume il calcolo di

= E(X) = 3 e 2 = Var(X) = E(X2) – E(X)2 = 17 – 32 = 8.

f(x)

x f(x)

x2 f(x)

1/2

1/2

1/2

1/3

1

3

1/6

3/2

27/2

1

3

17

Tab. 2.5 – Prospetto di calcolo di E(X) e Var(X).

x

1

3

9

Si considerino ora tutti i possibili campioni x = (x1, x2) di dimensione n = 2 che possono essere

161

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

estratti con reimmissione dalla v.c. in oggetto. La “lista” di questi campioni forma l’universo

dei campioni che possono essere estratti dalla v.c. X. L’universo dei campioni può a sua volta

essere rappresentato dalla v.c. doppia X = (X1, X2), i cui valori e la cui distribuzione sono

riportati nella Tab. 2.6 (la probabilità di ciascuna coppia è semplicemente il prodotto delle

probabilità dei singoli, dato che le estrazioni sono indipendenti).

x = (x1, x2) (1,1) (1,3) (1,9) (3,1) (3,3) (3,9) (9,1) (9,3) (9,9)

f(x)

1/4 1/6 1/12 1/6 1/9 1/18 1/12 1/18 1/36

Tab. 2.6 – Funzione di massa della v.c. doppia X = (X1, X2).

tot

1

Qualunque statistica calcolata su X = (X1, X2) è una v.c. e ha di conseguenza una sua

distribuzione campionaria.

Media campionaria: T(X ) = X = (X1 + X2)/2

La seguente tabella riporta, per ogni campione, la relativa media campionaria con la sua

probabilità

x = (x1, x2) (1,1) (1,3) (1,9) (3,1) (3,3) (3,9) (9,1) (9,3) (9,9) tot

f(x)

1/4 1/6 1/12 1/6 1/9 1/18 1/12 1/18 1/36 1

x

1

2

5

2

3

6

5

6

9

Tab. 2.7 – Prospetto per la costruzione della funzione di massa della media campionaria.

La funzione di massa della media campionaria è riportata nella tabella seguente

x

f( x )

1

2

3

5

6

9

tot

1/4

1/3

1/9

1/6

1/9

1/36

1

Tab. 2.8 – Funzione di massa della media campionaria X .

Si può verificare che E( X ) = 3 e Var( X ) = 4.

Varianza campionaria corretta: T(X ) = S2 = [(X1 – X )2 + (X2 – X )2]/(2 – 1)

La tabella che segue riporta, per ogni campione, i valori assumili dalla varianza campionaria

corretta con le relative probabilità

x = (x1, x2) (1,1) (1,3) (1,9) (3,1) (3,3) (3,9) (9,1) (9,3) (9,9) tot

f(x)

1/4 1/6 1/12 1/6 1/9 1/18 1/12 1/18 1/36 1

2

s

0

2

32

2

0

18

32

18

0

Tab. 2.9 – Prospetto per la costruzione della funzione di massa della varianza campionaria

corretta.

Da tale tabella si ricava facilmente la funzione di massa della varianza campionaria corretta,

nella quale si sommano le probabilità relative alle coppie di valori uguali.

162

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

s2

0

2

18

32

tot

2

f(s )

7/18 1/3 1/9 1/6

1

Tab. 2.10 – Funzione di massa della varianza campionaria corretta S 2.

Utilizzando un prospetto di calcolo simile a quello utilizzato per calcolare i momenti di f(x), si

può verificare che E(S2) = 8 e V(S2) = 144.

Minimo campionario: T(X ) = x(m) = min{X1, X2}

La seguente tabella riporta, per ogni campione, il relativo minimo campionario con la sua

probabilità

x = (x1, x2) (1,1) (1,3) (1,9) (3,1) (3,3) (3,9) (9,1) (9,3) (9,9) tot

f(x)

1/4 1/6 1/12 1/6 1/9 1/18 1/12 1/18 1/36 1

x(m)

1

1

1

1

3

3

1

3

9

Tab. 2.11 – Prospetto per la costruzione della funzione di massa del minimo campionario.

Da tale tabella si ricava facilmente la funzione di massa del minimo campionario, nella quale

si sommano le probabilità relative alle coppie di valori che danno luogo allo stesso minimo.

x(m)

1

3

9

tot

f(x(m))

3/4 2/9 1/36 1

Tab. 2.12 – Funzione di massa del minimo campionario X(m).

Si può verificare che E(x(m)) = 1,67 e Var(x(m)) = 2,26.

Massimo campionario: T(X ) = x(M) = max{X1, X2}

La tabella seguente riporta, per ogni campione, il relativo massimo campionario con la sua

probabilità

x = (x1, x2) (1,1) (1,3) (1,9) (3,1) (3,3) (3,9) (9,1) (9,3) (9,9) tot

f(x)

1/4 1/6 1/12 1/6 1/9 1/18 1/12 1/18 1/36 1

x(M)

1

3

9

3

3

9

9

9

9

Tab. 2.13 – Prospetto per la costruzione della funzione di massa del massimo campionario.

Da tale tabella si ricava facilmente la funzione di massa del massimo campionario, nella quale

si sommano le probabilità relative alle coppie di valori che danno luogo allo stesso massimo.

x(M)

1

3

9

tot

f(x(M))

1/4

4/9 11/36 1

Tab. 2.14 – Funzione di massa del massimo campionario x(M).

Si può verificare che E(x(M)) = 4, 3 e Var(x(M)) = 10, 2 .

163

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

2.4 Campionamento da popolazioni normali

Per campioni estratti da popolazioni normali vale il seguente teorema:

Teorema 1 Se X1, ..,Xn costituiscono un campione casuale di elementi relativi ad una

popolazione normale, di media µ e varianza 2, allora la variabile casuale

campionaria:

1 n

X Xi

i)

n i 1

è distribuita normalmente con media µ e varianza 2/n;

n

1 n

X

2

Y 2 X i μ i

σ i 1

i 1

2

ii)

è distribuita come un 2 con g = n gradi di libertà;

X

n

X

2

(n 1 )S

i 1

2

σ

σ2

è distribuita come un 2 con g = (n - 1) gradi di libertà.

2

V

iii)

i

Dimostrazione

i)

- La funzione generatrice dei momenti della v.c X è data

1 Xi t

n

X t

mx t E e

E e i 1

per l'indipendenza delle v.c. X i

n

1 Xi t n

1

Xi t

n

E e i 1 E (e n )

i 1

per la normalità delle v.c. X i

n

n

E (e

i 1

1

Xi t

n

n

) e

1

t2

t

2

n

2 n2

e

t

t2 2

2 n

i 1

che è la f.g.m. di una v.c. normale di media e varianza 2 / n.

ii) - La funzione generatrice dei momenti della v.c Y è data da

164

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

t n X i

m y t E e E e i 1

2

Y t

per l'indipendenza delle v.c. X i

t n X i

E e i 1

X

n

t i

E (e )

i 1

2

2

per la normalità delle v.c. X i e ricordando che il quadrato

di una v.c. normale standardizzata ha distribuzione χ12

n

E (e

X

t i

2

n

) ( 1 2 t)

i 1

1

2

( 1 2 t)

n

2

i 1

che è la f.g.m. di una v.c. chi quadro con n gradi di libertà n2 .

iii) - La funzione generatrice dei momenti della v.c Y è data da

my t E e

Y t

(1 2 t)

n /2

t n X i

E e i 1

2

per l'indipendenza delle v.c. X i

n

m y t E (e

X

t i

2

n

) E (e

i 1

X X X

t i

2

n

) E (e

i 1

X X

t i

2

e

X

t

2

)

i 1

se si ipotizza l'indipendenza tra le n v.c. scarto X i X e la v.c. X si ha

n

E (e

X X

t i

2

e

X

t

i 1

= E (e

n

E (e

t

Xi X

i 1

Xi X

i 1

n

) E (e

X X

t i

2

) E (e

X

t

2

)

i 1

n

t

2

2

) E (e

X

t

/ n

n

2

) E (e

t

Xi X

i 1

2

) (1 2 t ) 1/ 2

2

) E (e

tV

) E (e

Y t

)(1 2 t )

1/ 2

(1 2 t )

n /2

(1 2 t )

1/ 2

(1 2 t )

che è la f.g.m. di una v.c. chi quadro con n - 1 gradi di libertà ; quindi, la v.c. V

2

n-1

n 1

2

n21.

Si dimostra ora l’indipendenza tra il vettore delle v.c. scarto

X 1 X , X 2 X ,.........., X n X e la v.c. X , il che implica l’indipendenza tra

165

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

n

V

X

i 1

i

X

2

2

n 1 S 2

2

e la v.c. X .

Si consideri la f.g.m. del vettore casuale a n+1 dimensioni

X , X

X , X 2 X ,.........., X n X

1

mx , x1 x , x2 x ,....., xn x t , t1 , t2 ,....., tn E e

X t X 1 X t1 X 2 X t2 ..... X n X tn

n

1 X i t X i ti t j 1 X i

t ti t X i

n i 1

n

i 1

j 1

i 1

E e i 1 n

E e

per la normalità e l'indipendenza delle v.c. X i

n

n

n

n

1 n

dove

t

tj

n

j

1

2

E e

i 1

n

e

t

ti t X i

n

n

e

i 1

2

t

2

n t

n n ti t

ti t

2

i 1 n

i 1

dove e

t

t 2 2

2 n

e

t

2

ti t

t

n

t

t

i

2

n

t

t 2 2

2 n

n

ti t 2 2 / 2

e i 1

è la f.g.m. della v.c. distribuita normalmente X e

n

ti t 2 2 /2

e i 1

X

1

è la f.g.m. del vettore casuale a n dimensioni

X , X 2 X ,.........., X n X

Pertanto

,

poiché

la

f.g.m.

del

vettore

casuale

a

n+1

dimensioni

X , X 1 X , X 2 X ,.........., X n X è uguale al prodotto di due funzioni

generatrici dei momenti,

una relativa al vettore a n dimensioni

X1 X , X 2 X ,.........., X n X l’altra relativa alla v.c.

X

ne deriva

l’indipendenza tra le variabili casuali X e V , quindi la variabile casuale campionaria

X μ

W

Z

V/(n 1)

σ/

n

(n 1) S 2

σ2

X μ

S/ n

dove

T

X μ

S/ n

ha una distribuzione del tipo t di Student con (n - 1) gradi di libertà essendo basata sul

rapporto tra una variabile casuale normale standardizzata e la radice quadrata di una

variabile del tipo 2 divisa per i propri gradi di libertà.

166

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Sul concetto di gradi di libertà si avrà modo di tornare in seguito, qui basta

sottolineare che i gradi di libertà relativi alla variabile casuale campionaria Y sono n

perché n sono le variabili casuali indipendenti (X1 - ), (X2 - ),…(Xn - ) che entrano

nel suo computo. Mentre i gradi di libertà relativi alla variabile casuale campionaria V

sono (n – 1) in quanto, pur essendo n gli elementi, le n variabili casuali scarto

X1 X , X 2 X ,... X n X che entrano nel suo computo , soltanto (n – 1) sono

tra loro indipendenti , infatti, le n variabili scarto sono (per costruzione) soggette al

vincolo

n

X

i 1

i

X0

2.5 Campionamento da popolazioni non normali

Nei casi in cui l'evidenza empirica o ragioni teoriche escludono la normalità della

popolazione cui si riferisce il campione (casuale) di dati a disposizione, e non si hanno

altre informazioni sulla popolazione stessa, si può fare ricorso al teorema del limite

centrale che individua la normale come distribuzione approssimata della variabile casuale

media campionaria. Si riporta di nuovo l'enunciato del teorema nella sua forma più

semplice adeguandolo al contesto del campionamento.

Teorema 2 (del limite centrale) - Se X1, X2,...,Xn costituiscono un campione casuale

semplice di n elementi relativi ad una qualunque popolazioni di media µ e

varianza (finita) 2, allora la variabile casuale media campionaria

1 n

X Xi

n i 1

per n sufficientemente elevato ha una distribuzione approssimativamente

normale, con media µ e varianza 2/n.

Va sottolineato, inoltre, che la tendenza alla normalità della variabile casuale X , si

realizza anche quando le osservazioni campionarie si riferiscono ad n popolazioni

distinte, purché esse abbiano media e varianza finita. Si avrà pertanto che (ricordando

quanto detto a proposito di combinazioni di variabili casuali normali indipendenti) la

distribuzione campionaria di una qualsiasi combinazione lineare di medie calcolate su un

gruppo di campioni indipendenti tende alla normalità al crescere della numerosità di

ciascuno dei campioni considerati.

Benché il teorema del limite centrale riguardi grandi campioni, nelle applicazioni

empiriche più frequenti, l'approssimazione normale risulta soddisfacente anche per

campioni di modeste dimensioni. Se le osservazioni campionarie si riferiscono a

popolazioni distinte, si avrà una buona approssimazione per i piccoli campioni n 30

solo quando le distribuzioni di tali popolazioni non si discostano troppo dalla

167

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

distribuzione normale e le loro varianze non sono molto diverse.

Tornando al problema dell’approssimazione della distribuzione della media

campionaria per campioni riferiti ad una stessa popolazione non normale, si deve

osservare che la bontà dell’approssimazione dipende, oltre che dalla dimensione

campionaria anche dalla natura e dalla forma della distribuzione originaria dalla quale il

campione è stato estratto.

Nella Fig. 2.3 è riportata la distribuzione della media campionaria standardizzata per

campioni di diverse dimensioni estratta da popolazioni continue definite dai modelli:

a) X:

3x 3

b) X:

x 1 , f(x) e x 1

, f(x) 2 3

f ( x) 2 3

f ( x) e

x 1

Fig. 2.3 - Distribuzione della media campionaria per campioni di diverse dimensioni estratti

da due diverse popolazioni continue.

Come si può facilmente desumere osservando le figure, a parità di dimensione

campionaria, l’approssimazione migliore è quella relativa alla distribuzione uniforme

(distribuzione simmetrica) rispetto alla distribuzione di tipo esponenziale che presenta

una asimmetria abbastanza pronunciata.

168

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Esempio 2.5

Si supponga di estrarre un campione casuale semplice di dimensione n da una popolazione di

tipo dicotomico, cioè da una popolazione caratterizzata dalla presenza o meno di un

determinato carattere; si supponga inoltre che la proporzione delle unità che possiede il

carattere di interesse sia pari a p , mentre 1 - p = q è la proporzione delle unità che non

possiede il carattere in questione. La popolazione dalla quale viene estratto il campione di dati

può essere, in base a quanto detto, rappresentata da una variabile casuale bernoulliana

caratterizzata dal parametro p del tipo

X : x0 = 0 , x1 = 1

P(X = x0) = q , P(X = x1) = p

il cui valor medio e varianza sono rispettivamente = p e 2 = p q .

Ora, se si considera il punto campionario (X1, X2,...,Xn ) si vede come, nell’universo dei

campioni, ciascuna componente Xi (i=1, 2, ..., n) sia una variabile casuale del tutto simile alla

variabile casuale X che rappresenta la popolazione.

Si avrà pertanto che la variabile casuale campionaria

n

P T(X 1 , X 2 ,..., X n )

i 1

Xi

n

che indica la proporzione delle unità che nel campione presentano quel determinato carattere,

avrà una distribuzione di tipo binomiale (variabile casuale binomiale relativa), con valor

medio E(P) = = p e varianza p2 = p q/n . Questa conclusione consente d’interpretare la

variabile casuale binomiale relativa, ottenuta attraverso una combinazione lineare di variabili

casuali di bernoulli indipendenti, come distribuzione campionaria di proporzioni o percentuali.

Ovviamente, se si definisce come variabile casuale campionaria

n

XT Xi

i 1

cioè il totale di successi nelle n estrazioni campionarie indipendenti effettuate, tale variabile è

esattamente una variabile casuale binomiale con parametri caratteristici n e p , con media

= n p e varianza 2 = n p q; il che consente d’interpretare la variabile casuale binomiale

come somma di n variabili casuali di bernoulli indipendenti caratterizzate da uno stesso

parametro p.

Nelle Figg. 2.4 e 2.5 è riportata la distribuzione binomiale (opportunamente standardizzata)

per diversi valori di n e di p e la relativa approssimazione con la distribuzione normale.

Come si può facilmente desumere osservando le figure, a parità di dimensione campionaria

l’approssimazione è tanto più buona quanto più p è prossimo al valore 0,5 (distribuzione

simmetrica); ovviamente l’approssimazione migliora al crescere della dimensione

campionaria.

169

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Fig. 2.4 - Istogrammi della distribuzione binomiale per p = 0,2 e diversi valori di n e relativa

approssimazione con la variabile casuale normale standardizzata.

170

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

Fig. 2.5 - Istogrammi della distribuzione binomiale per p = 0,5 e diversi valori di n e

relativa approssimazione con la variabile casuale normale standardizzata

171

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

2.6 Campionamento da due popolazioni indipendenti

Nelle pagine precedenti sono state calcolate media e varianza delle variabili casuali,

media campionaria X e varianza campionaria (corretta) S2, associate a campioni estratti

da una qualunque popolazione. Di queste due variabili, di loro trasformazioni e del

rapporto tra loro particolari trasformazioni, è stata derivata anche la distribuzione

campionaria nel caso di campionamento da popolazioni normali. Si è, inoltre, data

indicazione della distribuzione asintotica (cioè della distribuzione cui si perviene facendo

tendere ad infinito la dimensione del campione) della media campionaria per campioni

estratti da popolazioni non normali. Si procederà ora alle stesse elaborazioni in

riferimento a differenze tra medie campionarie e al rapporto tra varianze campionarie

facendo specifico riferimento a campioni estratti da due popolazioni normali.

Si supponga ora di estrarre con ripetizione due campioni casuali indipendenti, di

dimensione m ed n , da due popolazioni distinte rappresentate dalle variabili casuali X e

Y, il cui valore medio e varianza sono rispettivamente x , x2 , y , y2 .

Sugli elementi campionari (X1, X2,...,Xm ) e (Y1, Y2,...,Yn ) si calcolino le quattro

statistiche

1 n

1 m

Y Yi

;

X Xi

n i 1

m i 1

S x2

1 m

X i X 2 ;

m 1 i 1

S y2

1 n

Yi Y 2

n 1 i 1

si calcolino, cioè, le due medie campionarie e le due varianze campionarie corrette, e si

definiscano le nuove entità (differenza tra medie campionarie e differenza tra varianze

campionarie corrette)

V X Y

W S x2 S y2

Le due variabili campionarie V e W, nell’universo dei campioni, hanno medie e

varianze espresse dalle uguaglianze seguenti

E (V ) x y

Var (V ) x2 y2

E (W )

2

x

x2

m

y2

n

2

y

Var (W ) Var ( S x2 ) Var ( S y2 )

Inoltre, se i due campioni sono estratti da popolazioni normali indipendenti vale il

seguente teorema

Teorema 3 Se X1, X2, ..., Xm costituisce un campione casuale estratto da una

popolazione normale di media x e varianza σ x2 , Y1, Y2, ..., Yn un campione

172

B. Chiandotto

Versione 2016

INFERENZA STATISTICA

Cap. 2 – Campionamento e distribuzioni campionarie

casuale estratto da una popolazione normale di media y e varianza σ y2 ,

1.

allora:

la variabile casuale campionaria

1 m

1 n

U X Y X i Yi

m i 1

n i 1

è distribuita normalmente con media x - y e varianza

mu t E eU t E e

x t

2.

x2 t 2

y t

X Y t

E e E e

Y t

X t

x y t mx

2y t 2

2

σ x2 σ y

, infatti:

m

n

m 2

n 2

e

e

e

la variabile casuale campionaria

2

2y t 2

n 2

n Y

X x

i

y

V i

x i 1 y

i 1

2

2

2

Z x Z y

2

è distribuita come una variabile casuale con m+n gradi di libertà, infatti:

2

m

mv t E eV t E e

1 2 t

3.

m

2

1 2 t

n

2

Z

2

2

x Zy

t

E e

E eZx

2

1 2 t

Z y2 t

t

mn

2

la variabile casuale campionaria

2

2

m

n

Xi X

(m 1) S2x (n 1) S y

Yi Y

W

Wx Wy

σ 2x

σ 2y

σ x i 1 σ y

i 1

2

è distribuita come una variabile casuale 2 con m+n-2 gradi di libertà, infatti:

W t

W +W t

mw t E eW t E e x y E e Wx t E e y

1 2 t

4.

m 1

2

1 2 t

n 1

2

1 2 t

mn2

2

la variabile casuale campionaria

( m 1 )S x2

F

x2

( n 1 )S y2

y2

/( m 1 )

/( n 1 )

2

S x2 y

2 2

Sy x

definita come rapporto tra due variabili casuali 2 indipendenti divise per i rispettivi gradi

di libertà, è distribuita come una variabile casuale F di Fisher-Snedecor con m-1 ed

n-1 gradi di libertà.

Le considerazioni svolte a proposito delle distribuzioni campionarie degli indici

sintetici media e varianza, possono essere naturalmente estese ad altri indici caratteristici

quali mediana, quartili, scostamento quadratico medio, coefficiente di variazione, ecc.

173