Introduzione alla statistica non parametrica

Introduzione alla statistica non parametrica

Statistica parametrica e non parametrica

Premessa

Esempio

Metodi non parametrici

Mediana e rango

Metodi parametrici e non parametrici (1)

I metodi parametrici utilizzati per la soluzione di problemi di

carattere univariato e multivariato hanno, come limitazione, la

necessità di dover ricorrere all’introduzione di ipotesi molto

restrittive, spesso ingiustificate se non impossibili da giustificare,

irrealistiche, non sempre chiare, difficilmente interpretabili,

formulate ad hoc per poter fare inferenza. A questo si deve

aggiungere che le assunzioni che rendono valida l’applicazione di

tali metodi (normalità, omoschedasticità, indipendenza e identica

distribuzione della componente stocastica erratica) sono di norma

raramente soddisfatte e, quand’anche soddisfatte, i risultati sono

spesso ottenuti tramite approssimazione.

Introduzione alla statistica non parametrica

Statistica parametrica e non parametrica

Premessa

Esempio

Metodi non parametrici

Mediana e rango

Metodi parametrici e non parametrici (2)

Sempre più spesso, per problemi multivariati complessi studiati in

ambito biomedico, ingegneristico, psicologico, farmacologico, negli

esperimenti clinici, nel controllo della qualità, quando

non è noto il modello distributivo,

non si può invocare la normalità,

l’inferenza riguarda variabili di tipo qualitativo,

la numerosità del campione è inferiore al numero di variabili,

ci sono dati mancanti non a caso,

si passa da un approccio parametrico ad uno non parametrico,

ovviando così, senza perdita sostanziale di efficienza, le limitazioni

sopra accennate.

Introduzione alla statistica non parametrica

Statistica parametrica e non parametrica

Premessa

Esempio

Metodi non parametrici

Mediana e rango

Test parametrici

Presentano la caratteristica comune di avere per oggetto ipotesi

parametriche, cioè ipotesi riguardanti ad esempio il valore del

parametro di una o più popolazioni come, per esempio la media e la

varianza. La determinazione della zona di rifiuto è basata sulla

distribuzione che la statistica test segue sotto l’ipotesi nulla,

distribuzione che dipende da un modello distributivo della

popolazione (in generale la normale); solo per ampiezze campionarie

elevate è svincolata da tale modello distributivo. Nella pratica, la

natura della distribuzione non è verificata, mentre sarebbe bene

sottoporre sempre i dati ad un test di normalità, controllando il

valore assunto da parametri come simmetria e curtosi o verificando

l’adattamento dell’istogramma alla curva di distribuzione.

Introduzione alla statistica non parametrica

Statistica parametrica e non parametrica

Premessa

Esempio

Metodi non parametrici

Mediana e rango

Passaggio alla statistica non parametrica

Tra i dati che non si adattano alla distribuzione normale vi sono i

punteggi (score) e le votazioni utilizzati da osservatori, come

medici, psicologi, insegnanti, giudici di gara, ecc., per valutare

fenomeni come l’intelligenza, la capacità di memoria, il rendimento

a scuola, la produttività nel lavoro, la prestazione atletica, ecc.

In tutti questi casi la scala non è riferita a grandezze fisiche, bensì a

diversi livelli qualitativi di espressione del fenomeno, trasformati

numericamente solo in base a convenzione. Ad esempio, nei licei si

attribuisce 6 per indicare la sufficienza, mentre all’università si

attribuisce 18.

Introduzione alla statistica non parametrica

Statistica parametrica e non parametrica

Premessa

Esempio

Metodi non parametrici

Mediana e rango

Parametri d’interesse

In ambito non parametrico, indicatore rappresentativo di una

distribuzione è la mediana che, diversamente dalla media, è uno

stimatore robusto. Sfruttando l’informazione che, per una qualsiasi

v.c. continua,

Pr(X > M e) = Pr(X 6 M e) =

1

,

2

diventa più agevole derivare la distribuzione delle statistiche test. In

alternativa, si possono utilizzare le v.c. rango (rank), definite come

l’intero corrispondente al posto che la v.c. occupa quando si passa

dal campione casuale (X1 , X2 , . . . , Xn ) al campione casuale

ordinato in senso crescente (X(1) , X(2) , . . . , X(n) ). La v.c. rango

per un campione di dimensione n costituisce una permutazione

casuale degli interi (1, 2, . . . , n).

Introduzione alla statistica non parametrica

Test non parametrici

Introduzione

Regione critica

Conclusioni

Test sui segni (1)

Sia M e la mediana della v.c. continua X e si costruisca un test per

verificare H0 : M e = M e0 contro H1 : M e 6= M e0 . Se è vera H0

circa metà delle osservazioni dovrebbe essere superiore (inferiore) a

M e0 , per cui la regola di decisione dovrà essere costruita in modo

che si rifiuti H0 se nel campione tale requisito non è soddisfatto.

Per un campione casuale (X1 , X2 , . . . , Xn ), il numero delle

osservazioni Tn superiori a M e0 è una v.c. binomiale tale che

Tn ∼ Bi(n, θ).

Quindi verificare l’ipotesi nulla H0 : M e = M e0 ,

verificare

1

vs.

H1 : θ 6=

H0 : θ =

2

equivale a

1

.

2

Introduzione alla statistica non parametrica

Test non parametrici

Introduzione

Regione critica

Conclusioni

Test sui segni (2)

Sotto H0 , Tn ∼ Bi(n, θ), per cui in media, il campione conterrà n2

osservazioni al di sopra (di sotto) di M e0 . Pertanto, si può definire

la seguente RC(α):

|Tn − n/2| > cα/2

ove il valore critico cα/2 è determinato in modo che

α = Pr(|Tn − n/2| > c α2 )

= 1 − Pr(n/2 − cα/2 < Tn < n/2 + cα/2 )

2cα/2 + 1

√

' 2 1−Φ

n

utilizzando l’approssimazione alla normale della v.c. binomiale con

la correzione per la continuità.

Introduzione alla statistica non parametrica

Test non parametrici

Introduzione

Regione critica

Conclusioni

Test sui segni (3)

Essendo Φ(zα/2) = 1 − α/2, si ha che

cα/2

√

zα/2 n − 1

'

.

2

Se Tn è la statistica test definita come il numero di unità superiori

alla mediana M e0 , la regione critica RC(α) diventa:

√

(

zα/2 n

−

Tn 6 n+1

2

2√

Tn >

n+1

2

+

zα/2 n

2

Tale procedura è detta test dei segni perchè per il calcolo della

statistica test si è soliti contrassegnare con + (−) i valori superiori

(non superiori) a M e0 e poi contare il numero di segni positivi

presenti nella sequenza.

Introduzione alla statistica non parametrica

Test non parametrici

Introduzione

Regione critica

Conclusioni

Test sui segni (4)

Questo test può essere utilizzato nel caso di dati appaiati.

Supponiamo di voler verificare l’effetto di un’azione nota

(medicinale, messaggio pubblicitario, ecc.) sulla stessa unità

statistica: Xi è la variabile rilevata prima dell’esperimento e Yi è il

risultato dell’esperimento sullo stesso individuo. Supponendo che le

variabili oggetto dell’esperimento siano continue, possiamo indicare

con

+ l’evento {Xi > Yi };

− l’evento {Xi < Yi };

θ = Pr(Xi > Yi ).

Se è vera H0 : Xi = Yi , ovvero non vi è alcun effetto, si avrà

θ = 1/2. Il numero dei segni + è equivalente al numero di successi

in una successione di n prove indipendenti con probabilità costante

pari a θ; quindi, è una v.c. Bi(n, θ).

Introduzione alla statistica non parametrica

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test sui ranghi

Calcolo dei ranghi (1)

Si consideri il seguente vettore di dati:

41

9

84

1

67

123

81

Si ordinino le osservazioni in una graduatoria crescente e si

sostituisca poi ad ogni valore il posto occupato nella graduatoria,

cioè 1 al valore più piccolo, 2 al successivo, e così via. Questi nuovi

numeri sono i ranghi. Il vettore contenente i ranghi associato al

vettore di dati sopra considerato sarà:

3

2

6

1

4

7

5

Introduzione alla statistica non parametrica

Test sui ranghi

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Calcolo dei ranghi (2)

Consideriamo ora alcune varianti:

a) sostituiamo il valore 123 con il valore 1230 e i ranghi non

cambiano, infatti si ha

41 9 84 1 67 1230 81

3 2 6 1 4 7 5

b) sostituiamo il valore 123 con il valore 12.3 e alcuni ranghi

cambiano di una posizione, infatti

41 9 84 1 67 12.3 81

4 2 7 1 5 3 6

c) sostituiamo infine il valore 123 con il valore 0 e si ottiene

41 9 84 1 67 0 81

4

3

7

2

5

1

6

Introduzione alla statistica non parametrica

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test sui ranghi

Calcolo dei ranghi (3)

Questi esempi dimostrano come i ranghi siano molto robusti anche

in presenza di variazioni notevoli nei dati. Nel caso in cui tutti i dati

vengano trasformati in modo lineare (additivo o moltiplicativo) o

non lineare (esponenziale o logaritimico), i ranghi non cambiano in

quanto i dati mantengono la stessa posizione. In generale, qualsiasi

trasformazione, purchè monotona, non altera i ranghi. Come ultimo

esempio si consideri il caso in cui i dati sopra considerati sono tutti

elevati al quadrato. I ranghi non cambiano e in particolare si ha:

412

1681

92

81

842

7056

3

2

12

1

6

672

4489

1

4

1232

15129

7

812

6561

5

Introduzione alla statistica non parametrica

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test sui ranghi

Calcolo dei ranghi (4)

Con riferimento all’ultimo esempio, bisogna prestare attenzione

quando ci sono dei numeri negativi. Infatti in tal caso i quadrati dei

valori negativi si rifletterebbero sulla scala dei valori positivi

sconvolgendo completamente l’ordine originario. Infine, quando

esistono valori uguali, a ciascuno di essi si attribuisce la media dei

ranghi che spetterebbero agli stessi valori se questi fossero diversi.

per esempio, per il vettore di dati

32

63

41

85

32

51

85

79

85

27

68

il vettore contentente i ranghi ad esso associato sarà:

2.5

6

4

10

2.5

5

10

8

10

1

7

Introduzione alla statistica non parametrica

Test sui ranghi

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test dei ranghi con segno di Wilcoxon (1)

Questo test può essere utilizzato per verificare se un campione

casuale possiede una certa mediana o se le differenze appaiate

hanno mediana pari a 0. E’ l’equivalente non parametrico del test t

di Student per campioni appaiati (dipendenti). Se si considera il

campione casuale (X1 , Y1 ), (X2 , Y2 ), . . . , (Xn , Yn ) delle

osservazioni appaiate, indichiamo con Di = (Yi − Xi ) le

corrispondenti differenze, mentre se si tratta di un solo campione

indichiamo con Di = (Xi − M e0 ) le differenze rispetto ad un

valore prefissato M e0 per la mediana. Si assuma che le v.c. Di

siano continue, simmetriche, indipendenti e tutte con la stessa

mediana. Supponiamo che |Di |, i = 1, 2, . . . , n siano le differenze

in valore assoluto non nulle a cui si attribuiscono i ranghi da 1 (per

min |Di | ad n (per max |Di |). Nel caso di ranghi coincidenti si

provvede a sostituirle con la loro media artitmetica.

Introduzione alla statistica non parametrica

Test sui ranghi

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test dei ranghi con segno di Wilcoxon (2)

Le ipotesi da verificare sono:

1

H0 : M e(Di ) = 0 vs. H1 : M e(Di ) > 0,

2

H0 : M e(Di ) = 0 vs. H1 : M e(Di ) < 0,

3

H0 : M e(Di ) = 0 vs. H1 : M e(Di ) 6= 0,

e le corrispondenti RC sono:

1

Tn > cα ,

2

Tn 6 c∗α ,

3

cα/2 6 Tn 6 c∗α/2 .

Introduzione alla statistica non parametrica

Test sui ranghi

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test dei ranghi con segno di Wilcoxon (3)

In tutti i casi, la statistica test è data dalla somma dei ranghi

r(|Di |) corrispondenti alle differenze Di > 0, ovvero

Tn =

n

X

r(|Di |)I(Di > 0),

i=1

dove I(·) è la funzione indicatrice. Si può dimostrare che sotto

l’ipotesi nulla

n(n + 1)(2n + 1)

n(n + 1)

V(Tn ) =

.

E(Tn ) =

4

24

Se n è abbastanza grande (n > 15), si può ricorrere

all’approssimazione normale (modificata per la correzione di

continuità)

T − n(n + 1)/4 − 1/2 d

pn

→ N (0, 1).

n(n + 1)(2n + 1)/24

Introduzione alla statistica non parametrica

Test sui ranghi

Esempi

Introduzione

Ipotesi e regioni critiche

Statistica test

Un altro test sui segni

Test sui segni di McNemar

Consideriamo ancora il caso di dati appaiati. Siano

P

U = #(Di > 0) = i I(Di > 0) il numero di differenze

positive,

ν = #(Di 6= 0) il numero di differenze non nulle.

Allora, sotto H0 , la statistica U ha distribuzione binomiale con

parametri ν e 1/2, ovvero U ∼ Bin(ν, 1/2). Sotto l’ipotesi

alternativa H1 , U ha ancora distribuzione binomiale, ma con

parametri ν e θ > 1/2. Per esempio, con ν = 20 e U = 17, si ha

che

X 20 Pr(U > 17|D) =

2−20 = 0.0013,

i

i>17

che è significativo a livello α = 0.005.

Introduzione alla statistica non parametrica

Dati appaiati

Introduzione

Esempio

Ipotesi e modello

Altri modelli

Un problema con dati appaiati nel caso univariato (1)

Consideriamo il caso in cui si vuole verificare l’efficacia del

trattamento nella riduzione dell’ansia in campione di 9 soggetti. Si

presuma che i soggetti siano omogenei rispetto ad altre importanti

condizioni, quali età e stato di salute, che in genere sono le variabili

esplicative in questo tipo di esperimenti. Si assuma poi che la v.c.

risposta Y misuri l’ansia: in particolare rappresenta il punteggio

ottenuto in un test psicologico somministrato ai 9 soggetti.

Ciascuna unità viene osservata prima del trattamento, al tempo A

(baseline observation), e dopo il trattamento, al tempo B. Ci si

aspetta che il trattamento riduca l’ansia.

Introduzione alla statistica non parametrica

Dati appaiati

Introduzione

Esempio

Ipotesi e modello

Altri modelli

Un problema con dati appaiati nel caso univariato(2)

Le risposte bivariate sono dipendenti con rispetto alle unità, dato

che le misurazioni vengono fatte in tempi diversi ma negli stessi

soggetti, mentre le n coppie di osservazioni sono indipendenti, in

quanto relative ad unità diverse. Se si assume che gli individui siano

omogenei in relazione alle condizioni sperimentali, l’insieme dei dati

appaiati {(YAi , YBi ), i = 1, ..., n} può essere visto come un

campione casuale di n coppie i.i.d. di osservazioni estratte da una

variabile bivariata (YA , YB ). Sia Xi = YAi − YBi , i = 1, 2, . . . , 9, la

differenza pre-post trattamento osservata.

Introduzione alla statistica non parametrica

Dati appaiati

Introduzione

Esempio

Ipotesi e modello

Altri modelli

I dati

I valori osservati sono riportati nella tabella sottostante:

i

1

2

3

4

5

6

7

8

9

YA

19

22

18

18

24

30

26

28

15

YB

16

23

13

17

20

22

30

21

11

X

3

-1

5

1

4

8

-4

7

4

Introduzione alla statistica non parametrica

Introduzione

Esempio

Ipotesi e modello

Altri modelli

Dati appaiati

Formalizzazione del problema

Le ipotesi d’interesse sono

d

H0 : YA = YB

vs.

d

H1 : YA > YB .

dove H1 rappresenta l’ipotesi di dominanza stocastica. Uno dei

modelli utilizzati per descrivere la variabile risposta osservata, è il

modello con effetti additivi fissi, in cui

YAi = µ + ZAi e YBi = µ − δ + ZBi , i = 1, . . . , n,

dove µ è la costante di popolazione; δ è l’effetto del trattamento,

assunto sotto H1 finito e strettamente positivo, ZAi e ZBi sono

componenti d’errore casuali identicamente distribuite, indipendenti

tra le unità, ma non necessariamente indipendenti entro le unità.

Introduzione alla statistica non parametrica

Dati appaiati

Introduzione

Esempio

Ipotesi e modello

Altri modelli

Modelli alternativi

Tra i modelli più utilizzati per descrivere la variabile risposta

osservata sono da citare:

i modelli con effetti additivi fissi e unità non omogenee in cui

YAi = µ + ηi + ZAi e YBi = µ + ηi − δ + ZBi ,

i modelli con effetti additivi che variano da individuo a

individuo del tipo

YAi = µ + ηi + ZAi e YBi = µ + ηi − δi + ZBi ,

i modelli con effetti stocastici generalizzati dove

YAi = µ + ηi + ZAi e YBi = µ + ηi + ZBi − ∆Bi .

Introduzione alla statistica non parametrica

Dati appaiati

Introduzione

Esempio

Ipotesi e modello

Altri modelli

Confronto tra modelli

Prendendo come modello di riferimento il modello con effetti

additivi fissi, sotto H0 la variabile differenza X = δ + ZA − ZB è

simmetrica rispetto allo 0, mentre sotto H1 è simmetrica rispetto al

parametro δ, indicatore dell’effetto del trattamento. Quando si usa

come variabile di riferimento la variabile differenza X il modello a

effetti additivi fissi e il modello ad effetti additivi fissi e unita non

omogenee coincidono, infatti si ha che

Xi = YAi − YBi = δ + ZAi − ZBi .

Dunque se non vi è un reale effetto del trattamento ed eventuali

variazioni osservate sono apportate solo da ηi , si dice che X è

covariate-free.

Introduzione alla statistica non parametrica

Soluzioni del problema

Soluzione parametrica

Soluzione non parametrica

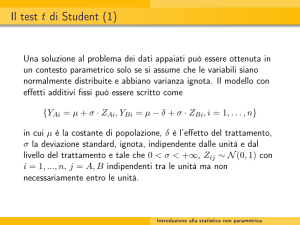

Il test t di Student (1)

Una soluzione al problema dei dati appaiati può essere ottenuta in

un contesto parametrico solo se si assume che le variabili siano

normalmente distribuite e abbiano varianza ignota. Il modello con

effetti additivi fissi può essere scritto come

{YAi = µ + σ · ZAi , YBi = µ − σ · δ + ZBi , i = 1, . . . , n}

in cui µ è la costante di popolazione, δ è l’effetto del trattamento,

σ la deviazione standard, ignota, indipendente dalle unità e dal

livello del trattamento e tale che 0 < σ < +∞, Zij ∼ N (0, 1) con

i = 1, ..., n, j = A, B indipendenti tra le unità ma non

necessariamente entro le unità.

Introduzione alla statistica non parametrica

Soluzioni del problema

Soluzione parametrica

Soluzione non parametrica

Il test t di Student (2)

La statistica test più usata è data da

√

X· n

T =

σ

b

P

P

in cui σ̂ 2 = i (Xi − X)2 /(n − 1) e X = i Xij /n con le

2 ). Sotto H la statistica T ha distribuzione t di

Xi ∼ N (δ, σX

0

Student centrale con (n − 1) g.d.l, mentre sotto H1 è distribuita

come una t di Student non centrale con un parametro di non

centralità positivo così che valori grandi diventano significativi. Il

parametro ignoto σX è solo un parametro di disturbo e T è una

statistica invariante rispetto al valore assunto da questa quantità.

Per i dati dell’esempio precedente, il valore della statistica è

T0 = 2.3635 e il p-value è pari a p = 0.0229 (test a una coda).

Introduzione alla statistica non parametrica

Soluzioni del problema

Soluzione parametrica

Soluzione non parametrica

Metodi non parametrici di permutazione

Caratteristica dei test di permutazione è il condizionamento

all’insieme dei dati osservati che è un insieme di statistiche

sufficienti qualunque sia il modello sottostante di riferimento. I test

di permutazioni vengono chiamati distribution free, ossia le

distribuzioni dei test prescindono completamente dalla legge che

governa la variabile aleatoria su cui si vuol fare inferenza e non è

necessario fare assunzioni stringenti sulla distribuzione dei termini

d’errore. I metodi non parametrici di permutazione non sono una

panacea per tutti i problemi inferenziali di interesse. Se, sotto H0 ,

1

non ci si condiziona ad un insieme di statistiche sufficienti,

2

assume l’ipotesi di scambiabilità dei dati,

le soluzioni ottenute sono tutt’altro che esatte.

Introduzione alla statistica non parametrica

Metodi non parametrici di permutazione

Un pò di teoria

Monte Carlo condizionato

Step algoritmo

Definizione dello spazio di permutazione campionario (1)

d

Si osservi innanzitutto che l’ipotesi H0 : {YA = YB } implica la

scambiabilità delle variabili YA e YB entro ciascuna unità rispetto ai

due tempi di rilevazione A e B. Il segno di ciascuna differenza Xi ,

per i = 1, . . . , n, si può pensare sia attribuito

P con probabilità 1/2.

Si consideri inoltre la statistica test T = i Xi . La distribuzione

condizionata FT (t|X) di T , quando i punti osservati

X = {Xi , i = 1, . . . , n} sono fissati, si ottiene sotto l’ipotesi che

H0 sia vera, cioè attribuendo casualmente e in tutti i modi possibili

i segni + e − a ciascuna differenza con uguale probabilità.

P ∗ Per fare

∗

questo, si può considerare la distribuzione di T = i Xi , in cui le

Xi∗ sono ottenute attribuendo casualmente il segno + o − alla

differenza Xi , i = 1, . . . , n, con probabilità 1/2.

Introduzione alla statistica non parametrica

Metodi non parametrici di permutazione

Un pò di teoria

Monte Carlo condizionato

Step algoritmo

Definizione dello spazio di permutazione campionario (2)

La distribuzione di probabilità di X∗ = {Xi∗ , i = 1, . . . , n} ,

condizionatamente a X, è uniforme dentro lo spazio di

permutazione X/X , ovvero tutti i punti sono equiprobabili. In

particolare, per il nostro problema, lo spazio campionario di

permutazione X/X contiene M = 2ν punti, perchè la permutazione

dei segni sulle n − ν differenze nulle non produce effetto. Sia

F (z|X) = Pr{T ∗ ≤ z|X}

la funzione di ripartizione condizionata (c.d.f.) ottenuta via

permutazione, indotta da T dato X. Indicato To = T (X) il valore

osservato di T , se il p-value λ = Pr{T ∗ ≥ To |X} è superiore al

livello di soglia fissato α, H0 viene accettata, secondo le usuali

regole dei test per la verifica d’ipotesi.

Introduzione alla statistica non parametrica

Metodi non parametrici di permutazione

Un pò di teoria

Monte Carlo condizionato

Step algoritmo

Tecniche di ricampionamento condizionato

Vi sono due criteri per permutare i dati: si permutano in modo

sistematico tutti i dati o si prende in considerazione solo un

campione estratto casualmente dallo spazio di permutazione. In

genere, lo spazio di permutazione X/X ha cardinalità così grande

che non si possono esaminare tutti i suoi punti. Quindi, la scelta

del secondo metodo comporta una riduzione dei calcoli, senza

perdita di attendibilità del risultato o potenza del test. Il metodo di

simulazione di Monte Carlo Condizionato (C.M.C.) consente di

effettuare, tramite simulazione, un campionamento di punti

dall’orbita di permutazione condizionale all’insieme dei dati

ossservati. Il campionamento C.M.C. altro non è se non la

replicazione dei campionamenti senza reinserimento.

Introduzione alla statistica non parametrica

Metodi non parametrici di permutazione

Un pò di teoria

Monte Carlo condizionato

Step algoritmo

Descrizione dell’algoritmo

Il metodo C.M.C. opera secondo l’algoritmo sotto riportato:

s.1) calcolo del valore osservato To della statistica T : To = T (X),

sull’insieme X osservato;

s.2) per ciascuna delle n differenze in X, si consideri

un’attribuzione casuale dei segni in modo tale da ottenere X∗ ;

s.3) calcolo di T ∗ = T (X∗ );

s.4) si ripetano B volte, in maniera indipendente, i passi descritti in

s.2) e s.3).

Introduzione alla statistica non parametrica

Metodi non parametrici di permutazione

Un pò di teoria

Monte Carlo condizionato

Step algoritmo

Conclusione dell’algoritmo

Per concludere, i B insiemi X∗ contenenti le permutazioni, sono un

campionamento casuale da X/X . I corrispondenti B valori T ∗

simulano la distribuzione nulla di permutazione di T e consentono

di stimare la c.d.f. di permutazione F (z|X) e la funzione del livello

di significatività L(z|X) = Pr{T ∗ ≥ z|X} tramite la e.d.f.

b ∗ (z) = #(T ∗ ≥ z)/B

FbB∗ (z) = #(T ∗ ≤ z)/B e la funzione L

B

rispettivamente. All’aumentare del numero B di iterazioni Monte

Carlo, migliorano le stime delle funzioni F (·|X) e L(·|X). Il p-value

stimato a partire dal valore osservato To è dato da

b=L

b ∗B (To ) = #(T ∗ ≥ To )/B.

λ

b ≤ α, si rifiuta H0 secondo le usuali regole della verifica

Se λ

d’ipotesi.

Introduzione alla statistica non parametrica