Verifica di ipotesi e intervalli di confidenza

nella regressione multipla

Eduardo Rossi2

2 Università

di Pavia (Italy)

Maggio 2013

Rossi

MRLM

Econometria - 2013

1 / 54

Sommario

Verifica di ipotesi e intervalli di confidenza per un singolo

coefficiente

Verifica di ipotesi congiunte su più coefficienti

Altri tipi di ipotesi che implicano più coefficienti

Variabili di interesse, variabili di controllo e come decidere quali

variabili includere in un modello di regressione

Rossi

MRLM

Econometria - 2013

2 / 54

Verifica di ipotesi e intervalli di confidenza

Verifica di ipotesi e intervalli di confidenza per un

singolo coefficiente

Per verifica di ipotesi e intervalli di confidenza nella regressione

multipla si segue la stessa logica utilizzata per la pendenza in un

modello a singolo regressore.

β̂1 −E[β̂1 ]

√

≈ N (0, 1) (TLC).

Var[β̂1 ]

Perciò le ipotesi su β1 possono essere verificate mediante la

consueta statistica-t e gli intervalli di confidenza costruiti come

{β̂1 ± 1, 96SE(β̂1 )}.

Lo stesso per β2 , . . . , βk .

Rossi

MRLM

Econometria - 2013

3 / 54

Verifica di ipotesi e intervalli di confidenza

Esempio

\ = 698, 933 − 2, 2798 STR

TestScr

(10,364)

\ = 686, 032 − 1, 1013 STR − 0, 649777 PctEL

TestScr

(8,7282)

(0,4329)

(1)

(0,5195)

(2)

(0,031032)

Il coefficiente di STR in (2) è l’effetto su TestScore del cambio di

unità in STR, mantenendo costante la percentuale di studenti non

di madrelingua nel distretto.

Il coefficiente di STR si dimezza.

L’intervallo di confidenza al 95% per il coefficiente di STR in (2) è

{−1, 10 ± 1, 960, 43} = {−1, 95, −0, 26}.

la statistica test t dell’ipotesi nulla βSTR = 0 è

t = −1, 10/0, 43 = −2, 54, perciò rifiutiamo l’ipotesi al livello di

significatività del 5%.

Rossi

MRLM

Econometria - 2013

4 / 54

Verifica di ipotesi e intervalli di confidenza

Verifica di ipotesi congiunte

Sia Expn = spese per studente e si consideri il modello di

regressione:

TestScorei = β0 + β1 STRi + β2 Expni + β3 PctELi + ui

L’ipotesi nulla per cui ”le risorse scolastiche non contano“, e

l’alternativa per cui invece contano, corrisponde a:

H0 : β1 = 0 e β2 = 0

l’ipotesi alternativa

H1 : o β1 6= 0 o β2 6= 0 o entrambi

Rossi

MRLM

Econometria - 2013

5 / 54

Verifica di ipotesi e intervalli di confidenza

Verifica di ipotesi congiunte

H0 : β1 = 0 e β2 = 0

H1 : o β1 6= 0 o β2 6= 0 o entrambe

Un’ipotesi congiunta specifica un valore per due o più coefficienti,

ossia impone una restrizione su due o più coefficienti:

H0 : βi = βi,0 , . . . , βj = βj,0

per un totale di q restrizioni.

Nell’esempio precedente, q = 2 e le due restrizioni sono

β1 = β2 = 0.

Se una (o più) delle uguaglianze sotto l’ipotesi nulla è falsa, allora

l’ipotesi nulla congiunta è falsa.

Ipotesi alternativa è che almeno una delle uguaglianze della H0

non valga.

Rossi

MRLM

Econometria - 2013

6 / 54

Verifica di ipotesi e intervalli di confidenza

Verifica di ipotesi congiunte

Un’idea di ”buon senso” è quella di rifiutare se l’una o l’altra delle

statistiche-t supera 1,96 in valore assoluto.

ma questa verifica ”coefficiente per coefficiente” non è valida: la

verifica risultante ha un tasso di rifiuto troppo elevato sotto

l’ipotesi nulla (più del 5%)!

Rossi

MRLM

Econometria - 2013

7 / 54

Verifica di ipotesi e intervalli di confidenza

Perchè non possiamo verificare coefficiente per

coefficiente?

Perchè il tasso di rifiuto sotto l’ipotesi nulla non è il 5%.

Calcoleremo la probabilità di rifiutare in modo non corretto

l’ipotesi nulla usando la verifica del ”buon senso” basata sulle due

statistiche- t singole. Per semplificare il calcolo, supponete che

siano distribuite in modo indipendente (non è vero in generale - lo

è solo in questo esempio).

Siano t1 e t2 le statistiche-t:

t1 =

β̂1 − 0

SE(β̂1 )

t1 =

β̂2 − 0

SE(β̂2 )

La verifica ”coeff. per coeff.” è: Rifiuta H0 : β1 = β2 = 0 se

|t1 | > 1, 96 e/o |t2 | > 1, 96

Qual è la probabilità che questa verifica ”coeff. per coeff.” rifiuti

H0 , quando H0 è effettivamente vero? (Dovrebbe essere 5%.)

Rossi

MRLM

Econometria - 2013

8 / 54

Verifica di ipotesi e intervalli di confidenza

Perchè non possiamo verificare coefficiente per

coefficiente?

Ipotesi t1 e t2 sono indipendenti (falso!) La probabilità di rifiutare in

modo non corretto l’ipotesi nulla mediante la verifica ”coeff. per coeff.”

= PrH0 {|t1 | > 1, 96 e/o |t2 | > 1, 96}

= 1 − PrH0 {|t1 | ≤ 1, 96 e |t2 | ≤ 1, 96}

= 1 − PrH0 {|t1 | ≤ 1, 96} × PrH0 {|t2 | ≤ 1, 96}

= 1 − (0, 95)2 = 0, 0975 > 0, 05

Rossi

MRLM

Econometria - 2013

9 / 54

Verifica di ipotesi e intervalli di confidenza

Dimensione del test

La dimensione del test (la percentuale di rifiuto della nulla quando

è vera) usando le singole statistiche per decidere sull’ipotesi

congiunta non è il 5%!

In effetti, la sua dimensione dipende dalla correlazione tra t1 e t2

(e quindi dalla correlazione tra β̂1 e β̂2 ).

Due soluzioni:

1

Utilizzare un valore critico diverso in questa procedura - non 1,96

(questo è il ”metodo Bonferroni”, raramente utilizzato nella

pratica).

2

Utilizzare una statistica test diversa studiata per verificare subito

sia β1 = 0 sia β2 = 0(ipotesi congiunta): la statistica F (questa è

la pratica comune).

Rossi

MRLM

Econometria - 2013

10 / 54

Statistica F

Ipotesi congiunte in notazione matriciale

Si consideri un’ipotesi congiunta che è lineare nei coefficienti e impone

q restrizioni, con q ≤ k + 1.

Ognuna di queste restrizioni può riguardare uno o più coefficienti di

regressione (un sistema di restrizioni). Restrizioni lineari

H0 : Rβ = r

H1 : Rβ 6= r

(q × 1)

r

(q × (k + 1))

R

r(R)

Rossi

=

q ≤k+1

MRLM

Econometria - 2013

11 / 54

Statistica F

Restrizioni lineari - Esempio

Dato il MRLM:

Yi = β0 + β1 X1i + . . . + βk Xki + ui

Ipotesi nulla:

H0 : β1 + β2 = 0

R = 0, 1, 1, 0, . . . , 0

r=0

β0

β1

Rβ = 0, 1, 1, 0, . . . , 0 . = β1 + β2

..

βk

Rossi

MRLM

Econometria - 2013

12 / 54

Statistica F

Restrizioni lineari - Esempio modello partizionato

Y = X1 β 1 + X2 β 2 + u

X1 (n × k1 )

X2 (n × k2 )

β 1 (k1 × 1)

β 2 (k2 × 1)

k + 1 = k1 + k2

H0 : β 1 = 0

H0 : Rβ = 0

Rossi

MRLM

Econometria - 2013

13 / 54

Statistica F

Restrizioni lineari - Esempio modello partizionato

dove

R=

Rβ =

h

h

Iq

i

..

. 0(q×k2 )

i β .

Iq .. 0(q×k2 )

1

β2

= β1

dove q = k1 . Sotto H0 il modello si riduce a

Y = X2 β 2 + u

Rossi

MRLM

Econometria - 2013

14 / 54

Statistica F

Statistica F

La statistica F per verificare l’ipotesi congiunta

H0 : Rβ = r

è

F =

Rossi

h

i−1

(Rβ̂ − r)

(Rβ̂ − r)0 RΣ̂β̂ R0

q

MRLM

Econometria - 2013

15 / 54

Statistica F

Distribuzione asintotica della statistica F

Dato che

√

d

n(β̂ − β) −→ N (0, Σ√n(β̂−β) )

segue che sotto H0

√

√

d

n(Rβ̂ − r) = nR(β̂ − β) −→ N (0, RΣ√n(β̂−β) R0 )

dati i risultati sulle forme quadratiche di vettori di v.c. asintoticamente

normali, sotto H0 :

i−1

h

[(Rβ̂ − r)]0 RΣβ̂ R0

[(Rβ̂ − r)]

i−1 √

h

√

d

= [ n(Rβ̂ − r)]0 RΣ√n(β̂−β) R0

[ n(Rβ̂ − r)] −→ χ2q

perchè Σβ̂ = Σ√n(β̂−β) /n. Poichè

p

Σ̂√n(β̂−β) −→ Σ√n(β̂−β)

Rossi

MRLM

Econometria - 2013

16 / 54

Statistica F

Distribuzione asintotica della statistica F

Per il teorema di Slutsky:

h

i−1 √

√

d

[ n(Rβ̂ − r)] −→ χ2q

n(Rβ̂ − r)]0 RΣ̂√n(β̂−β) R0

o

h

i−1

d

[(Rβ̂ − r)]0 RΣ̂β̂ R0

[(Rβ̂ − r)] −→ χ2q

segue che

F =

h

i−1

(Rβ̂ − r)0 RΣ̂β̂ R0

(Rβ̂ − r)

q

d

−→

χ2q

q

d

cioè F −→ Fq,∞ = χ2q /q. E’ equivalente calcolare

h

i−1

[(Rβ̂ − r)], in questo caso

qF = [(Rβ̂ − r)]0 RΣ̂β̂ R0

d

qF −→ χ2q

Rossi

MRLM

Econometria - 2013

17 / 54

Statistica F

Regione di rifiuto statistica F

Valore critico:

α

α

Fq,∞

: Pr{Fq,∞ > Fq,∞

}=α

per un livello di significatività 0 ≤ α ≤ 1.

La procedura di test consiste nel calcolare F e rifiutare H0 se il suo

α }, tale che abbia

valore cade nella regione critica, cioè se F act > Fq,∞

una probabilità minore di α di essere estratta dalla distribuzione Fq,∞ .

P-value della statistica F:

p-value = Pr{Fq,∞ > F act }

Se p-value > α (prefissato) accetto H0 altrimenti rifiuto.

Rossi

MRLM

Econometria - 2013

18 / 54

Statistica F

Significatività della regressione

L’ipotesi nulla che tutti i coefficienti siano nulli ad eccezione

dell’intercetta.

H0 : β1 = β2 = . . . = βk = 0

H1 : βj 6= 0 per almeno un j, j = 1, 2, . . . , k

Sotto H0 nessuno dei regressori spiega alcunchè della variazione in Yi .

L’intercetta, sotto H0 , è la media di Yi :

E(Yi ) = β0

Rossi

MRLM

Econometria - 2013

19 / 54

Statistica F

Statistica F quando q = 1

Quando q = 1, la statistica F verifica una sola restrizione

R (1 × (k + 1)),

r (1 × 1)

h

i−1

[(Rβ̂ − r)]

[(Rβ̂ − r)]0 RΣ̂β̂ R0

1

[(Rβ̂ − r)]2

i = t2

= h

RΣ̂β̂ R0

è il quadrato della statistica t.

Rossi

MRLM

Econometria - 2013

20 / 54

Statistica F

Statistica F - Esempio

const

STR

EXPN stu

EL PCT

Coefficient

Std. Error

t-ratio

p-value

649.578

−0.286399

0.00386790

−0.656023

15.4583

0.482073

0.00158072

0.0317844

42.0212

−0.5941

2.4469

−20.6397

0.0000

0.5528

0.0148

0.0000

Media variabile dipen

SSR

R2

F (3, 416)

654.1565

85699.71

0.436592

147.2037

S.Q.M. variabile dipen

S.E. della regressione

R̄2

P-value(F )

19.05335

14.35301

0.432529

5.20e–65

H0 : βstr = 0 βexpn = 0

Statistica Test: F (2, 416) = 5.434, con p − value = 0.00468.

Rossi

MRLM

Econometria - 2013

21 / 54

Statistica F

Regioni di confidenza per coefficienti multipli

Una regione di confidenza asintoticamente valida per due o più

elementi di β può essere costruita come l’insieme dei valori che, se

considerati come ipotesi nulla, non sono rifiutati dalla statistica F .

Sia δ (q × 1) formato dagli elementi di β per i quali si desidera una

regione di confidenza

δ = Rβ

La statistica test F per l’ipotesi nulla δ = δ 0 è

F = (δ̂ − δ 0 )0 [RΣ̂β̂ R0 ]−1 (δ̂ − δ 0 )/q

con δ̂ = Rβ̂. Una regione di confidenza al 95% per δ è l’insieme di

valori δ 0 che non sono rifiutati dalla F .

Rossi

MRLM

Econometria - 2013

22 / 54

Statistica F

Regioni di confidenza per coefficienti multipli

Una regione di confidenza 1 − α per δ è

0.95

{δ : (δ̂ − δ)0 [RΣ̂β̂ R0 ]−1 (δ̂ − δ)/q ≤ Fq,∞

}

La regione di confidenza è costituita dai punti interni all’ellissoide che

si ottiene quando vale l’uguaglianza.

Rossi

MRLM

Econometria - 2013

23 / 54

Statistica F

Ellisse di confidenza (k = 2)

Yi = β1 X1i + β2 X2i + ui

i = 12, . . . , n

Regione di confidenza per (β1 , β2 ):

1 0 β1

Rβ =

0 1 β2

Nel caso k = 2, la forma quadratica:

(β̂ − β)0 Σ̂−1 (β̂ − β)

β̂

Σ−1

β̂

σ̂12 σ̂1,2

=

σ̂1,2 σ̂22

(βb1 − β1 )2 σ̂12 + 2(βb1 − β1 )(βb2 − β2 )σ̂1,2 + (βb2 − β2 )2 σ̂22

Rossi

MRLM

Econometria - 2013

24 / 54

Statistica F

Ellisse di confidenza (k = 2)

Il contorno della funzione implicita

ax2 + byx + cy 2 = K

è un’ellisse con centro (x = 0, y = 0), inclinata positivamente quando

b < 0.

In questo caso, ellisse inclinata

positivamente quando σ̂1,2 < 0

negativamente quando σ̂1,2 > 0

Rossi

MRLM

Econometria - 2013

25 / 54

Statistica F

Regioni di confidenza per coefficienti multipli

P

βb1 e βb2 sono positivamente correlati quando

x1t x2t < 0.

P

b

b

β1 e β2 sono negativamente correlati quando

x1t x2t > 0.

Rossi

MRLM

Econometria - 2013

26 / 54

Statistica F

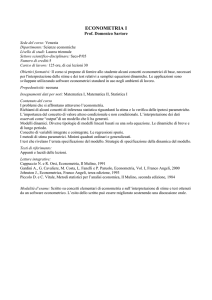

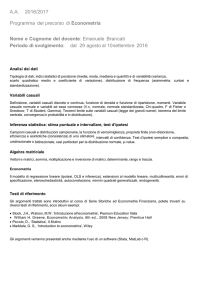

Regioni di confidenza per coefficienti multipli - Esempio

\eval = 4, 082 + 0, 149 beauty − 0, 198 female

course

(0,033)

(0,032)

(0,051)

2

T = 463 R̄ = 0, 0622 F (2, 460) = 16, 331

σ̂ = 0, 53732

Ellisse di confidenza al 95% e intervalli marginali al 95%

-0,05

-0,1

-0,15

female

0,149, -0,198

-0,2

-0,25

-0,3

-0,35

0,06

0,08

0,1

0,12

0,14

0,16

0,18

0,2

0,22

0,24

beauty

Rossi

MRLM

Econometria - 2013

27 / 54

Errori normali e omoschedastici

Errori normali e omoschedastici

Se gli errori sono normali (condizionatamente a X) e omoschedastici,

u|X ∼ N (0, σu2 In )

allora lo stimatore ha una distribuzione normale multivariata in

campionin finiti:

β̂ = β + (X0 X)−1 X0 u

β̂ ∼ N (β, σu2 (X0 X)−1 )

Rossi

MRLM

Econometria - 2013

28 / 54

Errori normali e omoschedastici

Distribuzione di s2

Se valgono le assunzioni generalizzate degli OLS nel MRLM, allora

s2 =

u0 MX u

n−k−1

per la normalità condizionale di u

0

u

u

MX

∼ χ2n−k−1

σu

σu

quindi

χ2n−k−1

s2

∼

σu2

n−k−1

s2 ∼

Rossi

σu2

χ2

n − k − 1 n−k−1

MRLM

Econometria - 2013

29 / 54

Errori normali e omoschedastici

Errori standard classici

Var[β̂|X] = σu2 (X0 X)−1

\

Var[

β̂|X] = s2 (X0 X)−1

lo standard error di βi :

q

SE(β̂i ) = s e0i (X0 X)−1 ei

Rossi

MRLM

Econometria - 2013

30 / 54

Errori normali e omoschedastici

Statistica t̃

Data la statistica:

t̃ =

β̂i − βi,0

SE(β̂i )

se valgono le sei assunzioni generalizzate dei minimi quadrati, la

distribuzione campionaria esatta di t̃

t̃ ∼ tn−k−1

Rossi

MRLM

Econometria - 2013

31 / 54

Errori normali e omoschedastici

Dimostrazione

Se

Z ha una distribuzione N (0, 1)

W ha una distribuzione χ2m

3 Z e W sono indipendentemente distribuite

allora

Z

p

∼ tm

W/m

Ora

1

2

t̃ =

β̂i − βi,0

SE(β̂i )

β̂i − βi,0

=p 0

2

s ei (X0 X)−1 ei

β̂i − βi,0

p

=p

2

2

s /σu σu2 e0i (X0 X)−1 ei

Rossi

MRLM

Econometria - 2013

32 / 54

Errori normali e omoschedastici

Dimostrazione

p

(β̂i − βi,0 )/ σu2 e0i (X0 X)−1 ei

p

t̃ =

s2 /σu2

1

Sotto H0

p

(β̂i − βi,0 )

|X ∼ N (0, 1)

σu2 e0i (X0 X)−1 ei

2

(n − k − 1)

Rossi

s2

∼ χ2n−k−1

σu2

MRLM

Econometria - 2013

33 / 54

Errori normali e omoschedastici

Dimostrazione

Si può scrivere

Z

t̃ = p

W/(n − k − 1)

con

(β̂i − βi,0 )

Z=p

∼ N (0, 1)

σu2 e0i (X0 X)−1 ei

e

W = (n − k − 1)

Rossi

s2

∼ χ2n−k−1

σu2

MRLM

Econometria - 2013

34 / 54

Errori normali e omoschedastici

Dimostrazione

Indipendenza tra β̂ e s2 . Dato che

β̂ = β + (X0 X)−1 X0 u

s2 =

u0 MX u

n−k−1

β̂ e s2 sono indipendenti se X0 X)−1 X0 u e u0 MX u sono indipendenti.

Dato che u|X ∼ N (0, σu2 In )

(X0 X)−1 X0 u|X ∼ N (0, σu2 (X0 X)−1 )

MX u|X ∼ N (0, σu2 MX )

Rossi

MRLM

Econometria - 2013

35 / 54

Errori normali e omoschedastici

Dimostrazione

Poichè

Cov[(X0 X)−1 X0 u, MX u|X] = E[(X0 X)−1 X0 uu0 MX |X]

= (X0 X)−1 X0 E[uu0 |X]MX

= (X0 X)−1 X0 σu2 In MX

= 0k×n

perchè

X0 MX = 0k×n

Segue che i due vettori sono indipendenti e che β̂ e s2 sono

indipendenti.

Si può concludere che

t̃ =

Rossi

β̂i − βi,0

SE(β̂i )

∼ tn−k−1

MRLM

Econometria - 2013

36 / 54

Errori normali e omoschedastici

Distribuzione della statistica F̃

La statistica F con omoschedasticità si ottiene sostituendo Σ̂β̂ con

s2 (X0 X)−1

F̃ =

(Rβ̂ − r)0 [R(X0 X)−1 R0 ]−1 (Rβ̂ − r)

qs2

se valogono le sei assunzioni generalizzate degli OLS, sotto l’ipotesi

nulla

F̃ ∼ Fq,n−k−1

F̃ è la versione di Wald.

Rossi

MRLM

Econometria - 2013

37 / 54

Errori normali e omoschedastici

Dimostrazione

Il rapporto

W1 /n1

∼ Fn1 ,n2

W2 /n2

dove

1

W1 ∼ χ2n1

2

W2 ∼ χ2n2

3

W1 e W2 sono indipendentemente distribuite.

Verifichiamo che queste tre condizioni siano verificate nel caso che

stiamo considerando.

Rossi

MRLM

Econometria - 2013

38 / 54

Errori normali e omoschedastici

Dimostrazione

Sia

W1 = (Rβ̂ − r)0 [σu2 R(X0 X)−1 R0 ]−1 (Rβ̂ − r)

e

W2 = (n − k − 1)

s2

σu2

possiamo scrivere

F̃ =

Rossi

W1 /q

W2 /n − k − 1

MRLM

Econometria - 2013

39 / 54

Errori normali e omoschedastici

Dimostrazione

Dato che

β̂|X ∼ N (β, σu2 (X0 X)−1 )

e sotto H0 , Rβ̂ − β = Rβ̂ − r

(Rβ̂ − r)|X ∼ N (0, σu2 R(X0 X)−1 R0 )

quindi

(Rβ̂ − r)0 [σu2 R(X0 X)−1 R]−1 (Rβ̂ − r) ∼ χ2q

Abbiamo già visto che

χ2n−k−1

s2

∼

σu2

n−k−1

Rossi

MRLM

Econometria - 2013

40 / 54

Errori normali e omoschedastici

Dimostrazione

Infine, poichè β̂ e s2 sono indipendentemente distribuiti, segue che

Rβ̂ − r e s2

sono indipendentemente distribuiti, implicando che W1 e W2 sono

indipendentemente distribuite.

Le tre condizioni sono verificate, quindi

F̃ ∼ Fq,n−k−1

Rossi

MRLM

Econometria - 2013

41 / 54

Errori normali e omoschedastici

La distribuzione Fq,n−k−1

La distribuzione Fq,n−k−1 è tabulata in molti punti.

Per n → ∞, la distribuzione Fq,n−k−1 tende asintoticamente alla

distribuzione χ2 /q, cioè Fq,∞ .

Per q non troppo grande e n ≥ 100, la distribuzione Fq,n−k−1 e la

distribuzione χ2q /q sono sostanzialmente identiche.

Molti pacchetti di regressione calcolano il valore-p della statistica

F mediante la distribuzione Fq,n−k−1 .

Rossi

MRLM

Econometria - 2013

42 / 54

Errori normali e omoschedastici

Altro modo di calcolo della statistica F̃

Quando il termine di errore ui è omoschedastico, la F può essere

scritta in termini di miglioramento dell’adattamento della regressione

(misurato con la SSR o l’R2 ).

Eseguire due regressioni, una sotto l’ipotesi nulla (regressione

”vincolata”) e una sotto l’ipotesi alternativa (regressione ”non

vincolata”).

Confrontare la somma dei quadrati dei residui (SSR) delle due

regressioni.

Confrontare gli adattamenti delle regressioni - gli R2 - se il

modello ”non vincolato” si adatta sufficientemente meglio,

rifiutare l’ipotesi nulla

Rossi

MRLM

Econometria - 2013

43 / 54

Errori normali e omoschedastici

Altro modo di calcolo della statistica F̃

Dato il MRLM:

Yi = β0 + β1 X1i + . . . + βk Xki + ui

ui ∼ i.i.d.N (0, σu2 )

H0 : Rβ = r

stima del modello sotto l’ipotesi nulla:

β̃ = arg

min

β:Rβ−r=0

(Y − Xβ)0 (Y − Xβ)

la somma dei quadrati della regressione vincolata

SSRr = (Y − Xβ̃)0 (Y − Xβ̃)

la somma dei quadrati della regressione non vincolata

SSRur = (Y − Xβ̂)0 (Y − Xβ̂)

F̃ =

Rossi

SSRr − SSRur n − k − 1

∼ Fq,n−k−1

SSRur

q

MRLM

Econometria - 2013

44 / 54

Errori normali e omoschedastici

Altro modo di calcolo della statistica F̃

Denotando i residui della regressione vincolata:

ũ = Y − Xβ̃

ũ0 ũ − û0 û n − k − 1

û0 û

q

P 2 P

P

P

/

ũ

(Y

−

Ȳ )2 − i û2i / i (Yi − Ȳ )2 n − k − 1

i

i i

i P

P

=

2

2

q

i (Yi − Ȳ )

i ûi /

2

2

(1 − Rr ) − (1 − Rur ) n − k − 1

=

2

1 − Rur

q

2

2

R −R n−k−1

= ur 2 r

1 − Rur

q

F̃ =

Rossi

MRLM

Econometria - 2013

45 / 54

Errori normali e omoschedastici

Altro modo di calcolo della statistica F̃

Rr2 è l’R2 della regressione vincolata

2 è l’R2 della regressione non vincolata

Rur

q = numero di restrizioni sotto l’ipotesi nulla

Più grande è la differenza tra l’R2 vincolato e non vincolato,

maggiore è il miglioramento dell’adattamento aggiungendo le

variabili in questione – maggiore è la F in presenza di

omoschedasticità.

Rossi

MRLM

Econometria - 2013

46 / 54

Errori normali e omoschedastici

Regressione ”vincolata” e ”non vincolata”

Esempio: i coefficienti di STR e Expn sono zero?

Regressione senza vincolo, sotto H1 :

TestScorei = β0 + β1 STRi + β2 Expni + β3 PctELi + ui

Regressione vincolata, sotto H0 : β1 = β2 = 0:

TestScorei = β0 + β3 PctELi + ui

Il numero di vincoli sotto H0 è q = 2.

L’adattamento risulterà migliore (R2 sarà maggiore) nella

regressione non vincolata.

Di quanto dovrà aumentare R2 affinchè i coefficienti di Expn e

PctEL siano giudicati statisticamente significativi?

Rossi

MRLM

Econometria - 2013

47 / 54

Errori normali e omoschedastici

Esempio

Regressione vincolata:

\ i = 644, 7 − 0, 671STRi

TestScore

R2 = 0, 4149

Regressione non vincolata:

\ i = 649, 6−0, 29STRi +3, 87Expni −0, 656PctELi

TestScore

R2 = 0, 4366

Quindi, con q = 2, n = 420, k = 3:

2 − R2 n − k − 1

Rur

r

2

1 − Rur

q

(0, 4366 − 0, 4149) (420 − 3 − 1)

=

= 8, 01

(1 − 0, 4366)

2

F̃ =

Valore critico al 1% = 4,61, H0 è rifiutata.

Nota: F robusta all’eteroschedasticità è 5,43...

Rossi

MRLM

Econometria - 2013

48 / 54

Errori normali e omoschedastici

La statistica F̃ classica-riepilogo

La statistica F̃ classica rifiuta quando aggiungendo le due variabili

si aumenta R2 di ”quanto basta” - vale a dire, quando

aggiungendo le due variabili si migliora l’adattamento della

regressione di ”quanto basta”.

Se gli errori sono omoschedastici, ma non gaussiani, la statistica

F̃ classica ha una distribuzione in grandi campioni che è χ2q /q.

Se invece gli errori sono eteroschedastici, la distribuzione in grandi

campioni della statistica F̃ classica non è χ2q /q.

Se gli errori sono omoschedastici e gaussiani la statistica F̃

classica ha una distribuzione Fq,n−k−1 .

Rossi

MRLM

Econometria - 2013

49 / 54

Errori normali e omoschedastici

La statistica F̃ classica e la distribuzione F

L’uso della statistica F̃ e della distribuzione F è giustificato solo

sotto condizioni molto forti - troppo forti per essere realistiche.

Dovreste utilizzare la statistica F robusta all’eteroschedasticità,

con i valori critici della χ2q /q.

Per n ≥ 100, la distribuzione Fq,n−k−1 è essenzialmente la

distribuzione χ2q /q.

Per n piccolo, a volte i ricercatori utilizzano la distribuzione F

perchè ha valori critici più grandi e in tal senso è più prudente.

Rossi

MRLM

Econometria - 2013

50 / 54

Errori normali e omoschedastici

Verifica di restrizioni singole su coefficienti multipli

Yi = β0 + β1 X1i + β2 X2i + ui

Considerate l’ipotesi nulla e l’ipotesi alternativa,

H0 : β1 = β2 vs H1 β1 6= β2

Questa ipotesi nulla impone una singola restrizione ( q = 1) su

coefficienti multipli – non si tratta di ipotesi congiunte con restrizioni

multiple (confrontate con β1 = β2 = 0).

Rossi

MRLM

Econometria - 2013

51 / 54

Errori normali e omoschedastici

Verifica di restrizioni singole su coefficienti multipli

Ecco due metodi per la verifica di restrizioni singole su coefficienti

multipli:

Riorganizzare (”trasformare”) la regressione: Riorganizzare i

regressori in modo che la restrizione diventi una restrizione su un

singolo coefficiente in una regressione equivalente; oppure,

Eseguire la verifica direttamente: Alcuni software, tra cui GRETL,

consentono di verificare le restrizioni utilizzando direttamente

coefficienti multipli

Rossi

MRLM

Econometria - 2013

52 / 54

Errori normali e omoschedastici

Metodo 1: Riorganizzare (”trasformare”) la regressione

Yi = β0 + β1 X1i + β2 X2i + ui

Considerate l’ipotesi nulla e l’ipotesi alternativa,

H0 : β1 = β2 vs H1 β1 6= β2

Sommare e sottrarre β2 X1i :

Yi = β0 + (β1 − β2 )X1i + β2 (X1i + X2i ) + ui

Yi = β0 + γ1 X1i + β2 Wi + ui

dove

γ1 = β1 − β2

Wi = (X1i + X2i )

Rossi

MRLM

Econometria - 2013

53 / 54

Errori normali e omoschedastici

Metodo 1: Riorganizzare (”trasformare”) la regressione

Equazione originale:

Yi = β0 + β1 X1i + β2 X2i + ui

Equazione riorganizzata (”trasformata”):

Yi = β0 + γ1 X1i + β2 Wi + ui

Quindi,

H0 = γ1 = 0 vs H1 : γ1 6= 0

corrisponde a

H0 : β1 = β2 vs H1 : β1 6= β2

Queste due regressioni hanno lo stesso R2 , gli stessi valori previsti e gli

stessi residui. Il problema di verifica è ora semplice: verificare se γ1 = 0

nella regressione trasformata.

Rossi

MRLM

Econometria - 2013

54 / 54