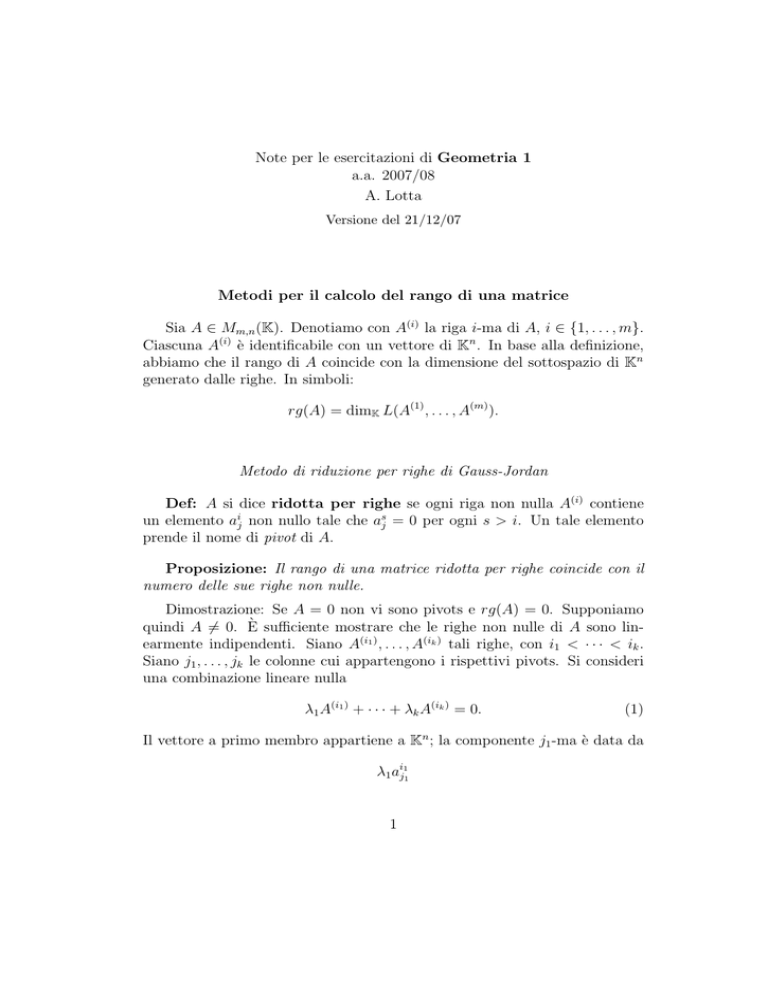

Note per le esercitazioni di Geometria 1

a.a. 2007/08

A. Lotta

Versione del 21/12/07

Metodi per il calcolo del rango di una matrice

Sia A ∈ Mm,n (K). Denotiamo con A(i) la riga i-ma di A, i ∈ {1, . . . , m}.

Ciascuna A(i) è identificabile con un vettore di Kn . In base alla definizione,

abbiamo che il rango di A coincide con la dimensione del sottospazio di Kn

generato dalle righe. In simboli:

rg(A) = dimK L(A(1) , . . . , A(m) ).

Metodo di riduzione per righe di Gauss-Jordan

Def: A si dice ridotta per righe se ogni riga non nulla A(i) contiene

un elemento aij non nullo tale che asj = 0 per ogni s > i. Un tale elemento

prende il nome di pivot di A.

Proposizione: Il rango di una matrice ridotta per righe coincide con il

numero delle sue righe non nulle.

Dimostrazione: Se A = 0 non vi sono pivots e rg(A) = 0. Supponiamo

quindi A 6= 0. È sufficiente mostrare che le righe non nulle di A sono linearmente indipendenti. Siano A(i1 ) , . . . , A(ik ) tali righe, con i1 < · · · < ik .

Siano j1 , . . . , jk le colonne cui appartengono i rispettivi pivots. Si consideri

una combinazione lineare nulla

λ1 A(i1 ) + · · · + λk A(ik ) = 0.

(1)

Il vettore a primo membro appartiene a Kn ; la componente j1 -ma è data da

λ1 aij11

1

in quanto, per definizione di pivot, asj1 = 0 per ogni s > i1 . Dunque dalla (1)

segue che λ1 aij11 = 0 e quindi λ1 = 0 perchè aij11 6= 0. Sostituendo quindi in

(1) ricaviamo

λ2 A(i2 ) + · · · + λk A(ik ) = 0.

Considerando ora la componente j2 -ma si ricava che λ2 aij22 = 0 e quindi

λ2 = 0. Procedendo in questo modo si ottiene che tutti i coefficienti λi sono

nulli.

Definiamo ora due operazioni elementari con le quali si può operare su

una matrice per modificarla, cambiandone le righe, in modo da non alterarne

il rango:

(I) Moltiplicazione di una riga per uno scalare non nullo;

(II) Sostituzione di una riga con la somma della riga stessa con un’altra.

Osserviamo che ciascuna delle operazioni (I) e (II) non altera lo spazio

generato dalle righe, cioè se B è ottenuta da A effettuando una di tali operazioni, allora

L(B (1) , . . . , B (m) ) = L(A(1) , . . . , A(m) ).

Dunque in particolare

rg(A) = rg(B).

Teorema: Ogni matrice A si può trasformare, mediante un numero finito

di operazioni elementari, in una matrice ridotta per righe.

Dimostrazione: Il seguente algoritmo trasforma A in una matrice ridotta

per righe: detta A(i1 ) la prima riga non nulla di A (se non esiste, A = 0 e

quindi A è già ridotta), si scelga un elemento aij11 non nullo di A(i) . Operando

su ciascuna riga successiva A(s) non nulla sostituendola con

aij11 A(s) − asj1 A(i1 )

si ottiene una nuova matrice B tale che bsj1 = 0 per ogni s > i1 . Ora, se tutte

le righe di B successive alla i1 -ma sono nulle, B risulta ridotta per righe con

pivot bij11 = aij11 sulla riga i1 -ma e colonna j1 -ma. In caso contario, si opera su

B prendendo in condiderazione la prima riga non nulla di indice maggiore di

i1 , scegliendo un elemento non nullo di tale riga e ripetendo quanto fatto in

precedenza. Si procede finchè vi sono righe non nulle su cui operare. .

2

Metodo degli orlati di Kronecker

Si ricordi che il rango di A coincide con il massimo degli ordini dei minori

non nulli di A. Il seguente risultato permette di ridurre il più possibile il

numero di minori da calcolare per determinare il rango.

Def: Sia M un minore di A di ordine r. Si chiama orlato di M ogni

minore di ordine r + 1 di cui M è un minore1 .

In altri termini, se M è un minore individuato da r righe ed r colonne

fissate di A, i minori orlati di M sono quelli che si ottengono fissando un’altra

riga ed un’altra colonna in aggiunta alle precedenti.

Teorema degli orlati: Sia M un minore non nullo di A di ordine r. Se

tutti gli orlati di M sono nulli, allora il rango di A è pari ad r.

Questo risultato fornisce il seguente algoritmo per calcolare il rango di

A: si individua un elemento non nullo di A e si esaminano tutti i minori

orlati di tale elemento: se sono tutti nulli il rango è 1; in caso contrario,

scelto un minore di ordine due M2 non nullo, si calcolano gli orlati di M2 .

Se questi sono tutti nulli, il rango è 2, altrimenti si procede scegliendo un

orlato non nullo M3 e si itera il procedimento calcolando gli orlati di M3 . Si

termina quando si individua un minore non nullo Mr di ordine r i cui orlati,

se esistono, sono tutti nulli, ricavando che r = rg(A).

1

Qui si abusa del linguaggio identificando un minore con la sottomatrice di A corrispondente.

3

Metodi per la risoluzione di un sistema lineare

Si consideri un sistema lineare di m equazioni nelle n incognite x1 , . . . , xn :

Ax = b

(2)

dove A ∈ Mm,n (K) e b ∈ Km . Denotiamo con C = (A|b) la matrice completa

del sistema. Si ricordi che (2) è compatibile se e solo se rg(A) = rg(C)

(Teorema di Rouché-Capelli).

Descriviamo di seguito due metodi per discutere e risolvere un sistema.

Metododo di riduzione ad un sistema di Cramer

Utilizzando il metodo di Kronecker si calcolano il rango r di A e di C e

si stabilisce se il sistema è risolubile. Sia A0 una sottomatrice non singolare

di A di ordine r corrispondente alle righe di indici i1 < i2 · · · < ir ed alle

colonne j1 , . . . , jr .

Allora si osserva che il sistema in esame è equivalente al sistema di Cramer

A0 x 0 = b 0

(3)

di ordine r nelle incognite xj1 , . . . , xjr . Le altre incognite si considerano

come parametri liberi e confluiscono nei termini noti, ovvero, denotando con

0

j10 , . . . , jn−r

gli indici colonna diversi da j1 , . . . , jr :

0

b0s = bis − a0ji0 s xj10 − · · · − a0ji0 s xjn−r

n−r

1

s = 1, . . . , r.

Dunque per ogni valore (λ1 , . . . , λn−r ) attribuito alle incognite libere, si

ottiene una soluzione del sistema (3) e quindi di (2) che può calcolarsi con la

formula di Cramer. Diremo quindi che il sistema ammette ∞n−r soluzioni.

4

Riduzione del sistema per righe

Per stabilire se il sistema (2) è risolubile, si può procedere col seguente

algoritmo: se C contiene almeno una riga del tipo (0 . . . 0 α) con α 6= 0,

allora il sistema non ha soluzioni. Altrimenti si considera la prima riga non

nulla di C e si procede alla riduzione per righe di C scegliendo ad ogni

passo un pivot non appartenente all’ultima colonna. Ogni trasformazione

effettuata trasforma il sistema (2) in uno equivalente. Se ad un certo passo

non è possibile scegliere un pivot sulle prime n − 1 colonne, il sistema non

è compatibile perchè equivalente ad un sistema contenente un’equazione del

tipo 0 = α con α 6= 0.

Terminata, se possibile, la procedura di riduzione per righe, si perviene

ad una matrice ridotta C 0 e quindi ad un sistema equivalente

A0 x = b 0

(4)

in cui sia A0 che C 0 = (A0 |b0 ) sono ridotte per righe e dello stesso rango.

Dunque questo sistema è compatibile e quindi tale è il sistema iniziale (2).

Detti j1 , . . . , jr gli indici delle colonne occupate dai pivots di C 0 , il sistema

(4) si risolve agevolmente nelle incognite xj1 , . . . , xjr cominciando dall’ultima

equazione non banale (cioè non della forma 0 = 0) ricavando l’incognita xjr

(l’unica che compare tra le xj1 , . . . , xjr ) in funzione di tutte le altre; si procede

quindi a ritroso risolvendo tutte le altre equazioni rispetto alle incognite

rimanenti. Le n − r incognite diverse da xj1 , . . . , xjr svolgono quindi il ruolo

di parametri liberi al variare dei quali si ottengono ∞n−r soluzioni.

Un’ulteriore osservazione utile sui metodi discussi sopra per calcolare il

rango di una matrice è la seguente:

Proposizione: Sia A ∈ Mm,n (K) una matrice di rango k.

1) Se M è un minore di ordine k non nullo di A corrispondente alle

colonne di A di indici j1 , . . . , jk , allora tali colonne sono linearmente indipendenti.

2) Sia C una matrice ridotta per righe ottenuta trasformando A mediante

operazioni elementari sulle righe. Se j1 , . . . , jk sono gli indici delle colonne

di C a cui appartengono i pivots, allora le corrispondenti colonne di A sono

linearmente indipendenti.

5

Dimostrazione:

1) Se M = det(A0 ) con A0 sottomatrice di ordine k, allora A0 è non

singolare e quindi di rango k. In particolare le colonne di A0 sono linearmente

indipendenti. Ora, se le colonne corrispondenti di A fossero linearmente

dipendenti, tali risulterebbero le colonne di A0 , il che è una contraddizione.

2) Denotiamo con C 0 la matrice quadrata di ordine k le cui colonne sono

le colonne di C contenenti i pivots, ovvero di indici j1 , . . . , jk (si noti che per

ottenere una matrice quadrata occorre eliminare le eventuali righe nulle di

C 0 ). Allora anche C 0 è ridotta per righe con gli stessi pivots, e quindi ha

rango k, ovvero det(C 0 ) 6= 0. Denotiamo poi con A0 la matrice le cui colonne

sono le colonne di A di indici j1 , . . . , jk (A0 ha m righe e k colonne). Vogliamo

provare che le colonne A(j1 ) , . . . , A(jk ) di A sono linearmente indipendenti. La

condizione di lineare indipendenza consiste nel fatto che l’unica combinazione

lineare nulla

x1 A(j1 ) + · · · + xk A(jk ) = 0

è quella con i coefficienti tutti nulli; ciò si può esprimere equivalentemente

con l’affermazione che il sistema omogeneo

A0 x = 0

x1

x2

nelle incognite x = .. ammette solo la soluzione banale. Ora, osserviamo

.

xk

che le stesse operazioni elementari che trasformano A in C trasformano A0

in C 0 per cui il sistema in esame è equivalente al sistema

C 0x = 0

che è di Cramer e quindi ammette la sola soluzione nulla.

6