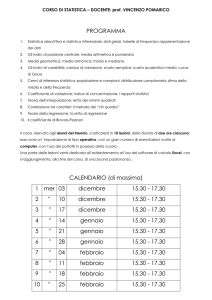

Lezione 18

A. Iodice

Regressione

lineare

semplice

Lezione 18

Assunzioni sul

modello di

regressione

semplice

Statistica

Stimatore

della varianza

Alfonso Iodice D’Enza

[email protected]

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Università degli studi di Cassino

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

1 / 45

Outline

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

1

Regressione lineare semplice

2

Assunzioni sul modello di regressione semplice

3

Stimatore della varianza

4

Verifica di ipotesi sul coefficiente angolare della retta di

regressione

5

Regressione su tabella a doppia entrata

A. Iodice ()

Lezione 18

Statistica

2 / 45

Modello di regressione lineare semplice

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

In molte applicazioni il ruolo delle variabili x ed Y non è lo stesso, in particolare,

assegnato un certo valore al predittore x (indicato pertanto con la lettera

minuscola), il valore che Y assume dipende in qualche modo da x. La relazione

più semplice tra le variabili è quella lineare, e il modello corrispondente è

Y = β0 + β1 x;

tale modello presuppone che, stabiliti i parametri β0 e β1 , sia possibile

determinare esattamente il valore di Y conoscendo il valore di x: salvo eccezioni,

questo non si verifica mai.

Il modello

Alla determinazione del valore di Y , oltre che la componente deterministica

β0 + β1 x, concorre anche una componente casuale detta errore non osservabile ,

una variabile casuale con media 0

Y = β0 + β1 x + .

Analogamente, la relazione di regressione lineare semplice può essere espressa in

termini di valore atteso

E[Y |x] = β0 + β1 x.

poichè E[] = 0.

A. Iodice ()

Lezione 18

Statistica

3 / 45

Modello di regressione lineare semplice

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

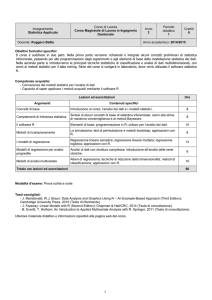

Si consideri di voler analizzare la relazione tra il peso del rullo di un taglia erba e l’entità della depressione

riscontrata nel prato da tagliare. Sia Y la depressione (depression) e x il peso del rullo utilizzato (weight).

Per vedere se l’utilizzo del modello di regressione lineare semplice sia ragionevole in questo caso occorre

raccogliere delle coppie di osservazioni (xi , yi ) e rappresentarle graficamente attraverso il diagramma di

dispersione.

Il diagramma di dispersione (scatter plot)

units

1

2

3

4

5

6

7

8

9

10

weight

1.9

3.1

3.3

4.8

5.3

6.1

6.4

7.6

9.8

12.4

depression

2.0

1.0

5.0

5.0

20.0

20.0

23.0

10.0

30.0

25.0

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

4 / 45

La retta di regressione

Lezione 18

La retta di regressione

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

La retta di regressione fornisce una

approssimazione della dipendenza dei valori

di Y dai valori di X. La relazione di

dipendenza non è esattamente riprodotta

dalla retta; i valori ŷi = β0 + β1 xi sono

dunque i valori teorici, ovvero i valori che la

variabile Y assume, secondo il modello

Y = β0 + β1 x, in corrispondenza dei

valori xi osservati.

Le differenze ei tra i valori teorici ŷi e i

valori osservati yi vengono definite residui.

Questo perchè per ciascuna osservazione il

modello è dato da

yi =

β0 + β1 xi

|

{z

}

comp. deterministica

+

rette passanti per la nube di punti

i

|{z}

comp. casuale

Determinazione della retta di regressione

L’identificazione della retta avviene attraverso la determinazione dei valori di B0 , e B1 , stime dell’intercetta

e del coefficiente angolare o pendenza, rispettivamente. La retta ’migliore’ è quella che passa più ’vicina’ ai

punti osservati. In altre parole, si vuole trovare la retta per la quale le differenze tra i valori teorici ŷi e i

valori osservati yi siano minime.

A. Iodice ()

Lezione 18

Statistica

5 / 45

La retta di regressione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Metodo dei minimi quadrati

La retta di regressione è tale che la somma dei residui al

quadrato sia minima. Formalmente

n

n

n

X

X

X

2

2

2

ei =

(yi − ŷi ) =

(yi − B0 − B1 xi )

i=1

i=1

Il problema consiste dunque nel ricercare B0 e B1 che

minimizzano la precedente espressione. Da un punto di

vista operativo bisogna risolvere il seguente sistema di

equazioni (condizioni del primo ordine o stazionarietà).

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

i=1

∂

n

X

∂B0 i=1

Stimatori dei parametri della retta di

regressione:(B0 )

−2

n

X

(yi − B0 − B1 xi ) =

i=1

2

(yi − B0 − B1 xi )

=0

n

X

yi − n ∗ B0 − B1

i=1

∂

n

X

∂B1 i=1

2

(yi − B0 − B1 xi )

=0

n

X

xi = 0

i=1

B0 = ȳ − B1 x̄

Nota: si tratta di punti di minimo perchè le derivate

seconde ∂B0 B0 f (B0 , B1 ) = −2(−n),

P

2

∂B1 B1 f (B0 , B1 ) = −2 n

i (−xi )

sono sempre non negative.

A. Iodice ()

Lezione 18

Statistica

6 / 45

La retta di regressione

Lezione 18

A. Iodice

Stimatori dei parametri della retta di

regressione:(B1 )

Regressione

lineare

semplice

I residui

Assunzioni sul

modello di

regressione

semplice

le differenze tra i valori stimati ŷi e i valori

osservati yi vengono definite residui. La

retta di regressione è tale che la somma dei

residui al quadrato sia minima.

Formalmente

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

n

n

X

X

2

2

RSS =

ei =

(yi − ŷi ) =

i=1

=

n

X

i=1

−2

xi (yi − B0 − B1 xi ) = 0

i=1

n

X

x i y i − B0

i=1

B1

B1

n

X

2

xi =

n

n

X

2

xi

RSS (residual sum of squares)

B1 =

A. Iodice ()

n

Lezione 18

n

X

xi y i −

Pn

i=1

xi

n

i=1

−(

n

X

!

2

xi )

=n

n

X

i=1

Pn

yi

Pn

− B1

i=1

n

X

n

X

xi yi −

xi

i=1

xi

!

n

yi

i=1

Pn

σxy

xi yi − i=1 xi i=1 yi

=

Pn

2 − (Pn

2

2

x

x

)

σx

i

i=1 i

i=1

i=1

n

2

xi = 0

i=1

i=1

Pn

n

X

xi − B1

i=1

n

X

i=1

Regressione su

tabella a

doppia entrata

n

X

i=1

i=1

2

(yi − B0 − B1 xi )

i=1

n

X

Statistica

7 / 45

Determinazione della retta di regressione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

...statistiche descrittive

P10

P10

i=1 xi = 6.07

i=1 yi = 14.1

ȳ =

10

10

rP

rP

10 (x −x̄)2

10 (y −ȳ)2

i

i

i=1

i=1

sx =

=

3.04

sy =

10

10

P10

i=1 (xi −x̄)(yi −ȳ) = 24.7

sxy =

10

σxy

rxy = σ σ = 0.8

x y

x̄ =

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

= 10.1

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

8 / 45

Determinazione della retta di regressione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Calcolo dei coefficienti

Richiamando le quantità calcolate in precedenza e le formule per il calcolo dei parametri si ha

σ

B1 = σxy

B0 = ȳ − B1 x̄ = 14.1 − (2.66 ∗ 6.07) = −2.04

2 = 2.66

x

Y = −2.04 + 2.66x rappresenta la retta di regressione stimata

La retta ’migliore’

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

9 / 45

Interpretazione dei valori dei coefficienti di

regressione

Lezione 18

A. Iodice

Regressione

lineare

semplice

B0 rappresenta l’intercetta della retta di regressione ed

indica il valore della variabile di risposta Y quando il

predittore x assume valore 0.

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

B1 rappresenta l’inclinazione della retta di regressione,

ovvero la variazione della variabile di risposta Y in

conseguenza di un aumento unitario del predittore x.

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

10 / 45

Assunzioni sul modello

Lezione 18

A. Iodice

Il modello di regressione lineare semplice è

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Y = β0 + β1 x + e l’errore non osservabile è una variabile aleatoria con valore atteso pari a 0. Per

poter fare inferenza sono necessarie alcune assunzioni:

la variabile aleatoria i si distribuisce come una Normale di parametri 0 e

σ 2 : dunque la varianza dell’errore non osservabile i non dipende dal

predittore xi ;

Stimatore

della varianza

cov(i , j ) = 0, ∀i 6= j (i, j = 1, . . . , n), questo comporta che la risposta

relativa al predittore xi è indipendente da quella relativa al predittore xj ;

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

x è nota e non stocastica (priva di errore);

dalle precedenti assunzioni segue che ∀i la variabile di risposta Yi si

distribuisce secondo una Normale di parametri

Regressione su

tabella a

doppia entrata

E[Yi ] = β0 + β1 xi

A. Iodice ()

Lezione 18

e

var(Yi ) = σ 2 .

Statistica

11 / 45

Assunzioni sul modello

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

fonte: Statistics for Business and Economics (Anderson, Sweeney and Williams, (2011))

A. Iodice ()

Lezione 18

Statistica

12 / 45

Lo stimatore della varianza σ 2

Lezione 18

A. Iodice

La quantità σ 2 è incognita e deve essere stimata a partire dai dati. A questo

scopo si consideri che la standardizzazione di Yi si distribuisce secondo una

normale

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

Yi − (β0 + β1 xi )

Yi − E[Yi ]

p

=

.

σ

var(Yi )

La somma dei quadrati delle Yi standardizzate è

Pn

2

i=1 (Yi − β0 − β1 xi )

2

σ

ed essendo la somma di n normali standardizzate indipendenti, si distribuisce

come una variabile aleatoria chi-quadro con n gradi di libertà.

Sostituendo i parametri β0 e β1 con gli stimatori dei minimi quadrati B0 e B1 la

precedente diventa

Pn

2

i=1 (Yi − B0 − B1 xi )

σ2

è un chi-quadro con n-2 gradi di libertà, in quanto si perde un grado di libertà per

ogni parametro stimato.

A. Iodice ()

Lezione 18

Statistica

13 / 45

Lo stimatore della varianza σ 2

Lezione 18

A. Iodice

Il numeratore della precedente rappresenta la somma dei quadrati dei residui

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

n

X

(Yi − B0 − B1 xi )2 =

i=1

n

X

e2 = RSS;

i=1

è un chi-quadro con n-2 gradi

da quanto trovato in precedenza, la quantità RSS

σ2

di libertà.

Poichè il valore atteso di un chi-quadro è uguale ai gradi di libertà possiamo

scrivere

E[RSS]

RSS

=

n

−

2

da

cui

E

= σ2 ,

σ2

n−2

lo stimatore della varianza σ 2 è dunque RSS

. Lo stimatore dello scarto

n−2

quadratico

medio

σ

viene

definito

errore

standard

della stima e corrisponde a

q

RSS

.

n−2

A. Iodice ()

Lezione 18

Statistica

14 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Un’ipotesi molto importante da verificare nel modello di regressione lineare

semplice è che il coefficiente angolare della retta di regressione sia pari a 0: se

infatti β1 = 0 allora la variabile di risposta non dipende dal predittore, in altre

parole non c’è regressione sul predittore.

Per ottenere il test H0 : β1 = 0 vs H1 : β1 6= 0 è necessario studiare la

distribuzione dello stimatore B1 di β1 : se B1 si discosta da 0 allora si rifiuta H0 ,

altrimenti non si rifiuta. Ma di quanto B1 deve discostarsi da 0?

A questo scopo si consideri che B1 si distribuisce come una Normale e occorre

definirne i parametri.

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

15 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Si consideri la seguente formalizzazione alternativa dello stimatore B1

Regressione

lineare

semplice

B1 =

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

σxy

=

σx2

Pn

Pn

(xi − x̄) Yi − Ȳ /n

i=1 (xi − x̄) Yi − Ȳ

=

=

Pn

P

2

n

2

i=1 (xi − x̄) /n

i=1 (xi − x̄)

i=1

=0

z

}|

{

n

X

Pn

(xi − x̄)

i=1 (xi − x̄) Yi − Ȳ

Pn

(xi − x̄) Yi − (xi − x̄) Ȳ

=

Pn

2

i=1 (xi − x̄)

!

n

n

X

X

(xi − x̄)

=

Yi =

δ i Yi

Pn

2

i=1 (xi − x̄)

i=1

i=1

{z

}

|

=

i=1

i=1

Pn

i=1

(xi − x̄)2

=

ponendo tale quantità=δi

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

16 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Due relazioni interessanti che riguardano δi :

Regressione

lineare

semplice

=0

n

X

Assunzioni sul

modello di

regressione

semplice

δi =

i=1

n

X

i=1

1

(xi − x̄)

= Pn

Pn

2

2

(x

−

x̄)

(x

i

i − x̄)

i=1

i=1

}|

{

z

n

X

(xi − x̄) = 0

i=1

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

n

X

i=1

δi2

=

n

X

"

(xi − x̄)

Pn

i=1

= Pn

i=1

Regressione su

tabella a

doppia entrata

A. Iodice ()

i=1

#2

(xi − x̄)2

= hP

n

n

X

1

2

i=1 (xi − x̄)

i2

(xi − x̄)2 =

i=1

1

(xi − x̄)2

Lezione 18

Statistica

17 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

E’ a questo punto possibile dimostrare che lo stimatore B1 di β1 è non distorto.

A. Iodice

"

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

E[B1 ] = E

n

X

#

δ i Yi =

i=1

=

n

X

n

X

δi β0 + β1

Regressione su

tabella a

doppia entrata

δ i xi

= β1

i=1

| {z }

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

δi E [Yi ] =

| {z }

i=1

β0 +β1 xi

i=1

n

X

δi (β0 + β1 xi ) =

i=1

n

X

i=1

(xi − x̄)

Pn

2

i=1 (xi − x̄)

!

xi =

| {z }

=0

Stimatore

della varianza

n

X

δi = Pn

(xi −x̄)

(xi −x̄)2

i=1

= β1 P n

i=1

n

X

1

2

(xi − x̄)

(xi − x̄) xi = β1 Pn

i=1

i=1

n

X

1

2

(xi − x̄)

x2i − x̄

i=1

n

X

xi =

i=1

| {z }

=nx̄

= β1 P n

i=1

1

(xi − x̄)2

n

X

Pn

2

i=1 (xi − x̄)

x2i − nx̄2 = β1 Pn

i=1

i=1

|

{z

(xi − x̄)2

= β1

}

P

2

= n

i=1 (xi −x̄)

A. Iodice ()

Lezione 18

Statistica

18 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

La varianza dello stimatore B1 è data da

2

= bY , b è una costante, var(Z) = b var(Yi ))

= costante

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

X

n

var (B1) = var

Y

δ

i = ( poichè se Z

i

i=1

| {z }

n

X

=

(δi )2

i=1

|

= Pn

{z

i=1

}

σ2

var(Yi ) = Pn

2

| {z }

(x

i − x̄)

i=1

=σ 2

1

(xi −x̄)2

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

19 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

la Normale standard

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

sP

n

i=1

(xi − x̄)2

(B1 − β1 )

σ2

non consente ancora di costruire una statistica test perchè è ancora presente il

parametro incognito σ 2 : tuttavia si può stimare tale parametro attraverso RSS

n−2

che, come visto in precedenza, si distribuisce secondo un chi-quadrato con n-2

gradi di libertà; sostituendo a σ 2 il suo stimatore si ha

s

P

2

(n − 2) n

i=1 (xi − x̄)

(B1 − β1 ).

RSS

Poichè questa quantità ha al numeratore una Normale standard ed al

denominatore un chi-quadro rapportato ai propri gradi di libertà, si distribuisce

come una distribuzione t di student con n-2 gradi di libertà.

A. Iodice ()

Lezione 18

Statistica

20 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

A questo punto la statistica test da utilizzare sotto H0 (β1 = 0) è

s

ST =

Pn

2

i=1 (xi − x̄)

B1 ∼ tn−2

RSS

Il test di livello α di H0 è ha la seguente regola di decisione:

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

(n − 2)

se

| ST |≥ tn−2,α/2

allora si rifiuta H0

se

| ST |< tn−2,α/2

allora non si rifiuta H0

Nell’esempio roller, il valore della statistica test è ST = 3.808,

il p − value corrispondente è 0.00518.

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

21 / 45

Intervallo di confidenza su β1

Lezione 18

A. Iodice

Regressione

lineare

semplice

A partire dalla statistica test per il test su β1 , è possibile definire l’intervallo di

confidenza, i cui estremi sono:

Assunzioni sul

modello di

regressione

semplice

s

B1 ± t(α/2,n−2)

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

RSS

Pn

2

i=1 (xi − x̄)

{z

}

√

(n − 2)

|

var(B1 )

con riferimento all’esempio roller, gli estremi dell’intervallo sono, ad un livello di

confidenza del 95% sono [1.05, 4.28].

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

22 / 45

Bontà di adattamento e diagnostica

Lezione 18

A. Iodice

Regressione

lineare

semplice

Una volta stimato il modello di regressione, è necessario misurare la bontà

dell’adattamento del modello ai dati e analizzare i residui per controllare che le

assunzioni di normalità con media nulla e varianza costante dei residui siano

rispettate.

Strumenti analitici: coefficiente di determinazione lineare R2

Assunzioni sul

modello di

regressione

semplice

Strumenti grafici: plot dei residui

plot variabili esplicative vs. residui: in caso di relazione non lineare

nella configurazione dei punti allora la relazione con la variabile

esplicativa potrebbe non essere di primo grado (lineare), ma di grado

superiore;

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

plot valori stimati dal modello vs. residui: se i residui aumentano

all’aumentare dei valori stimati dal modello, allora potrebbe essere

necessario effettuare una trasformazione della variabile di risposta;

Normal probability plot: confronto tra i quantili della distribuzione

dei residui osservati e quella di una normale standardizzata;

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

23 / 45

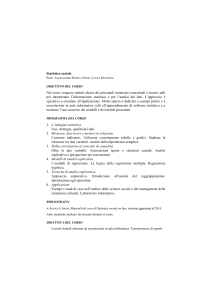

Plot dei residui

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Perchè la retta possa essere considerata una buona approssimazione della relazione che intercorre tra Y ed

X è necessario che i residui abbiano un andamento casuale rispetto ai valori della x. Se, ad esempio,

all’aumentare dei valori della x aumentassero sistematicamente anche i residui, allora la relazione potrebbe

non essere non lineare: la retta di regressione ne sarebbe dunque una cattiva approssimazione.

variabili esplicative vs residui

Per verificare che l’andamento dei residui sia effettivamente casuale rispetto ad x, è possibile utilizzare un

diagramma di dispesione tra i valori xi ed i corrispondenti residui ei (i = 1, . . . , n)

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

24 / 45

Plot dei residui

Lezione 18

A. Iodice

Regressione

lineare

semplice

Perchè la retta possa essere considerata una buona approssimazione della relazione che intercorre tra Y ed x

è necessario che i residui abbiano un andamento casuale rispetto ai valori della x. Se, ad esempio,

all’aumentare dei valori della x aumentassero sistematicamente anche i residui, allora la relazione potrebbe

non essere non lineare: la retta di regressione ne sarebbe dunque una cattiva approssimazione.

valori stimati ŷ vs residui

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

25 / 45

Quantile-quantile plot

Lezione 18

A. Iodice

Regressione

lineare

semplice

Per controllare che l’assunzione della normalità dei residui sia rispettata si ricorre al confronto tra i quantili

della distribuzione Normale standard ed i quantili della distribuzione dei residui osservati.

Q-Q plot

Quanto più i punti del grafico risultano allineati lungo la bisettrice del primo quadrante, tanto migliore sarà

l’adattamento dei residui osservati alla distribuzione normale.

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

26 / 45

coefficiente di determinazione lineare R2

Lezione 18

Ricordando che la devianza il numeratore della varianza...

A. Iodice

SSy =

n

X

2

(yi − ȳ)

i=1

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

=

=

2

(yi − ŷi + ŷi − ȳ)

=

i=1

2

(yi − ŷi ) +

n

X

n

X

2

(ŷi − ȳ) + 2

i=1

i=1

i=1

n

X

n

X

n

X

2

(yi − ŷi ) +

i=1

2

(ŷi − ȳ) + 2(

i=1

(yi − ŷi )(ŷi − ȳ)

yi −

i=1

n

X

ŷi )(

i=1

n

X

ŷi − nȳ)

i=1

Poiché ŷi è una trasformazione lineare di xi , allora

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

n

X

n

X

=

µŷ = B0 + B1 x̄ = (ricordando che B0 = ȳ − B1 x̄)

= ȳ − B1 x̄ +B1 x̄ = ȳ

| {z }

B0

dunque µŷ = ȳ →

Regressione su

tabella a

doppia entrata

Pn

i=1 ŷi

n

SSy =

n

X

=

Pn

i=1 yi

n

2

(yi − ŷi ) +

i=1

=

n

X

i=1

A. Iodice ()

da cui

n

X

Pn

i=1

ŷi −

2

2

n

X

i=1

yi = 0, quindi

(ŷi − ȳ) + 2 ∗ 0 ∗ (

i=1

(ŷi − ȳ) +

Pn

n

X

ŷi − nȳ)

i=1

2

(yi − ŷi )

= SSr + RSS

i=1

Lezione 18

Statistica

27 / 45

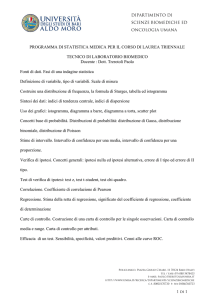

Decomposizione della devianza

Lezione 18

La devianza può essere decomposta dunque nelle seguenti quantità SSy = SSr + RSS

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

SSy =

Pn

(yi − ȳ)2 devianza totale

SSr =

Pn

(ŷi − ȳ)2 devianza di regressione

RSS =

i=1

i=1

Pn

i=1

(yi − ŷi )2 devianza dei residui

Interpretazione grafica

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

28 / 45

Bontà dell’adattamento

Lezione 18

A. Iodice

Intituitivamente, l’adattamento della retta è migliore quanto maggiore sarà proporzione di variabilità totale

che la retta di regressione riesce a spiegare; ovvero, l’adattamento della retta è migliore quanto minore sarà

la variabilità residua. Una misura di come il modello approssima i dati osservati è data dal coefficiente di

determinazione lineare R2 , dato da

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

R

2

SSr

SSy

Pn

= Pi=1

n

i=1

ovvero

R

2

RSS

=1−

SSy

(ŷi − µy )2

(yi − µy )2

Pn

= 1 − P i=1

n

(yi − ŷi )2

2

i=1 (yi − µy )

esempio di calcolo R2

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

SSy =

Pn

i=1

(yi − ȳ)2 = 1020.9

2

i=1 (ŷi − ȳ) = 657.97

Pn

RSS =

(y

−

ŷ

)2 = 362.93

i

i

i=1

SSr =

Pn

R

Regressione su

tabella a

doppia entrata

=

ovvero

R

A. Iodice ()

2

=1−

2

=

RSS

SSy

SSr

SSy

=1−

Lezione 18

=

657.97

1020.9

282.1862

5058.4

= 0.64

= 1 − 0.36 = 0.64

Statistica

29 / 45

Bande di confidenza e di previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

Utilizzo del modello per stima e previsione

Se il modello stimato si adatta bene ai dati e se la relazione tra Y e X è

significativa, si può utilizzare la retta di regressione stimata per la stima e la

previsione.

Banda di confidenza

La banda di confidenza è composta dalle stime intervallari, ognuna costruita sul

valore atteso di Y dato il valore corrispondente di xi .

Banda di previsione

La banda di previsione è composta dalle stime intervallari, ognuna costruita sul

singolo valore di Y dato il valore corrispondente di xi .

A. Iodice ()

Lezione 18

Statistica

30 / 45

Bande di confidenza e di previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

...qualche definizione

Assunzioni sul

modello di

regressione

semplice

xp è un valore specifico assunto dalla variabile indipendente X;

yp è il valore assunto da Y quando X = xp ;

Stimatore

della varianza

E [yp ] è il valore atteso di Y quando X = xp ;

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

ŷp = B0 + B1 xp , il valore stimato dalla retta di regressione,

dunque è la stima di E [xp ] per X = xp .

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

31 / 45

Bande di confidenza e di previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Intervallo di confidenza su E[Y | X = xp ] = E[yp ]

Per costruire lo stimatore intervallare su E[yp ] dato che X = xp è necessario

stimarne la varianza, lo stimatore in questione è

s2ŷp

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

RSS

=

n−2

"

1

(xp − x̄)2

+ Pn

2

n

i=1 (xi − x̄)

#

pertanto l’intervallo di confidenza è dato da

ŷp ± t α ,(n−2) sŷp

2

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

32 / 45

Bande di confidenza e di previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Intervallo di previsione su yp

Per costruire lo stimatore intervallare su yp è necessario stimarne la varianza, lo

stimatore in questione consiste di due componenti

Assunzioni sul

modello di

regressione

semplice

la varianza

di un singolo di valore Y rispetto alla sua media E[yp ]

la varianza associata all’utilizzo di un singolo valore ŷp per stimare E[yp ]

(già stimata in precedenza s2ŷp )

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

RSS

n−2

s2singolo =

RSS

+ s2ŷp

n−2

pertanto l’intervallo di previsione è dato da

ŷp ± t α ,(n−2) ssingolo

2

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

33 / 45

Intervallo di confidenza su E(yp )

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

Bande di confidenza

A. Iodice ()

Lezione 18

Statistica

34 / 45

Intervallo di previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

Bande di previsione

A. Iodice ()

Lezione 18

Statistica

35 / 45

Bande di confidenza e previsione

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

36 / 45

Regressione su distribuzione doppia di frequenze

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Si consideri di aver osservato su 10 rivenditori di componenti

informatiche le variabili numero di punti vendita e Fatturato

settimanale complessivo. Si studi la dipendenza del fatturato dal

numero di punti vendita.

fino a 5000

tra 5000 e 10000

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

fino a 2

3

1

tra 2 e 4

2

2

tra 4 e 6

0

2

Si stimino i coefficienti della retta di regressione.

Si valuti la bontà di adattamento della retta ai dati.

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

37 / 45

Regressione distribuzione doppia di frequenze

Lezione 18

A. Iodice

Essendo le modalità delle variabili qualitative espresse in intervalli di valori, è necessario fare riferimento ai

centri di ciascun intervallo. La tabella è dunque data da

Regressione

lineare

semplice

Y /X

2500

7500

Tot

Assunzioni sul

modello di

regressione

semplice

1

3

1

4

3

2

2

4

5

0

2

2

Tot

5

5

10

Le medie aritmetiche si ottengono a partire dalle distribuzioni marginali di frequenze:

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

µx =

µy =

Regressione su

tabella a

doppia entrata

k

1 X

n j=1

h

1X

n i=1

xj n.j =

yi ni. =

1

10

1

10

× (1 × 4) + (3 × 4) + (5 × 2) =

× (2500 × 5) + (7500 × 5) =

4 + 12 + 10

10

12500 + 37500

10

= 2.6

= 5000

dove h rappresenta numero di righe della tabella, k il numero di colonne della tabella.

A. Iodice ()

Lezione 18

Statistica

38 / 45

Regressione: distribuzione doppia di frequenze

Lezione 18

Per calcolare le varianze si fa riferimento agli scarti dalla media al quadrato

A. Iodice

Y /X

(2500 − 5000)2

(7500 − 5000)2

Tot

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

(1 − 2.6)2

3

1

4

(3 − 2.6)2

2

2

4

(5 − 2.6)2

0

2

2

Tot

5

5

10

Le varianze si ottengono a partire dalle distribuzioni marginali di frequenze:

Stimatore

della varianza

2

σx =

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

k

1 X

2

n j=1

(xj − µx ) n.j =

2

+ ((5 − 2.6) × 2) =

2

σy =

Regressione su

tabella a

doppia entrata

=

h

1X

n i=1

1

10

2

10.24 + 0.64 + 11.52

10

2

(yi − µy ) ni. =

31250000 + 31250000

10

2

× ((1 − 2.6) × 4) + ((3 − 2.6) × 4)+

1

10

= 2.24

2

2

× (2500 × 5) + (7500 × 5)

= 6250000

dove h rappresenta numero di righe della tabella, k il numero di colonne della tabella.

A. Iodice ()

Lezione 18

Statistica

39 / 45

Esercizio regressione: distribuzione doppia di

frequenze

Lezione 18

Per calcolare la covarianza si deve fare riferimento alle distribuzioni condizionate di frequenza.

Y /X

(2500 − 5000)

(7500 − 5000)

Tot

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

σxy =

h X

k

1 X

n i=1 j=1

(1 − 2.6)

3

1

4

(3 − 2.6)

2

2

4

(5 − 2.6)

0

2

2

yi

xi

yi − µ y

xi − µx

2500

2500

2500

2500

2500

7500

7500

7500

7500

7500

1

1

1

3

3

1

3

3

5

5

(2500-5000)

(2500-5000)

(2500-5000)

(2500-5000)

(2500-5000)

(7500-5000)

(7500-5000)

(7500-5000)

(7500-5000)

(7500-5000)

(1-2.6)

(1-2.6)

(1-2.6)

(3-2.6)

(3-2.6)

(1-2.6)

(3-2.6)

(3-2.6)

(5-2.6)

(5-2.6)

Tot

5

5

10

(yi − µy ) × (xj − µx ) × nij =

1

((2500 − 5000)(1 − 2.6) × 3 + (2500 − 5000)(3 − 2.6) × 2+

10

+ (7500 − 5000)(1 − 2.6) × 1 + (7500 − 5000)(3 − 2.6) × 2+

Regressione su

tabella a

doppia entrata

=

+ (7500 − 5000)(5 − 2.6) × 2) =

A. Iodice ()

12000 − 2000 − 4000 + 2000 + 12000

Lezione 18

10

= 2000

Statistica

40 / 45

Esercizio regressione: distribuzione doppia di

frequenze

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Avendo calcolato le quantità µx = 2.6, µy = 5000, σx2 = 2.24 e

σxy = 2000, è possibile calcolare i coefficienti della retta di

regressione

Calcolo dei coefficienti

b1 =

σxy

σx2

=

2000

2.24

= 892.571

b0 = µy − b1 µx = 5000 − (892.571 ∗ 2.6) = 2679.315

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

quindi l’equazione della retta di regressione è

Regressione su

tabella a

doppia entrata

Dunque, il valore stimato ŷi corrispondente ad un valore xi

assegnato è ŷi = b0 + b1 x.

y = b0 + b1 x = 2679.315 + 892.571x

A. Iodice ()

Lezione 18

Statistica

41 / 45

Valutazione della bontà di adattamento

Lezione 18

A. Iodice

Ricordando che

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Regressione su

tabella a

doppia entrata

R

2

=

Devr

Devy

Pn

= Pi=1

n

i=1

ovvero

R

2

=1−

Deve

Devy

(ŷi − ȳ)2

(yi − ȳ)2

Pn

(yi − ŷi )2

2

i=1 (yi − ȳ)

= 1 − Pi=1

n

con Devy = Devr + Deve

SSy =

Pn

(yi − ȳ)2 devianza totale

SSr =

Pn

(ŷi − ȳ)2 devianza di regressione

RSS =

i=1

i=1

Pn

i=1

(yi − ŷi )2 devianza dei residui

Per ottenere R2 , misura della bontà di adattamento, si deve calcolare solo la devianza dei residui, avendo

2

già calcolato σy

.

A. Iodice ()

Lezione 18

Statistica

42 / 45

Calcolo della devianza dei residui

Lezione 18

A. Iodice

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

RSS =

Pn

i=1

(yi − ŷi )2 devianza dei residui

in base alla retta di regressione stimata, i valori ŷi stimati in funzione

dei valori xi sono

Stimatore

della varianza

ŷ1 = b0 + b1 x1 = 2679.315 + 892.571 × 1 = 3571.886

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

ŷ2 = b0 + b1 x2 = 2679.315 + 892.571 × 3 = 5357.028

ŷ3 = b0 + b1 x3 = 2679.315 + 892.571 × 5 = 7142.17

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

43 / 45

Calcolo della devianza dei residui

Lezione 18

Per calcolare i residui yi − ŷi nel caso di tabella a doppia entrata si procede come segue

A. Iodice

yi /ŷj

y1 = 2500

y2 = 7500

Tot

Regressione

lineare

semplice

Assunzioni sul

modello di

regressione

semplice

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

RSS =

Ph

i=1

ŷ1 = 3571.886

3

1

4

Pk

i=1

ŷ2 = 5357.028

2

2

4

ŷ3 = 7142.17

0

2

2

Tot

5

5

10

((yi − ŷj )2 ) × nij devianza dei residui per tabella doppia

calcolo della devianza dei residui

RSS =

h X

k

X

2

2

2

((yi − ŷj ) ) × nij = ((2500 − 3571.886) ) × 3 + ((2500 − 5357.028) ) × 2+

i=1 j=1

2

2

2

+ ((7500 − 3571.886) ) × 1 + ((7500 − 5357.028) ) × 2 + ((7500 − 7142.17) ) × 2 =

= 44642859

SSy =

Regressione su

tabella a

doppia entrata

n

X

2

(yi − ȳ)

2

= σy × n = 6250000 × 10 = 62500000

i=1

R

A. Iodice ()

2

=1−

RSS

SSy

Lezione 18

= 1 − 0.71 = 0.29

Statistica

44 / 45

Verifica dell’ipotesi che β1 = 0

Lezione 18

A. Iodice

Regressione

lineare

semplice

A questo punto il valore della statistica test (stimatore standardizzato di β1 ) è

Assunzioni sul

modello di

regressione

semplice

s

ST =

(n − 2)

Pn

(xi − x̄)2

B1 =

RSS

i=1

Stimatore

della varianza

Verifica di

ipotesi sul

coefficiente

angolare della

retta di

regressione

Tenuto conto del fatto che

P10

i=1

r

(10 − 2)22.4

2679.315 = 5.37

44642859

(xi − x̄)2 = n × σ 2 = 10 × 2.24 = 22.4.

Poiché il p − value corrispondente è 2 × 0.0003, non si può rifiutare H0 .

Regressione su

tabella a

doppia entrata

A. Iodice ()

Lezione 18

Statistica

45 / 45