APPUNTI DI ALGEBRA

LINEARE

DI

MARIAGIOVANNA CZARNECKI

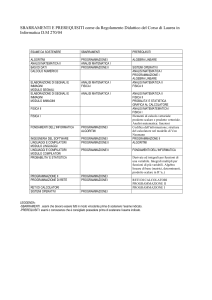

INFORMATICA - CORSO DI ALGEBRA LINEARE

UNIVERSITÀ CA’ FOSCARI VENEZIA

ANNO ACCADEMICO 2014-2015, I SEMESTRE

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

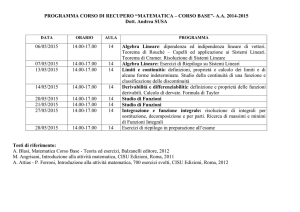

Indice:

SEMIGRUPPI ................................................................................................................................................... 3

MONOIDI ......................................................................................................................................................... 3

INSIEMI DI FUNZIONI ................................................................................................................................... 4

RELAZIONI ...................................................................................................................................................... 4

SEMIGRUPPO DELLE FUNZIONI ................................................................................................................ 5

MONOIDE DELLE FUNZIONI SU A ............................................................................................................. 5

INSIEME DELLE PARTI ................................................................................................................................. 6

SOTTOSEMIGRUPPI ...................................................................................................................................... 6

SOTTOMONOIDI ............................................................................................................................................ 7

SOTTOMONOIDE GENERATO ..................................................................................................................... 9

PROPRIETÀ PER DIMOSTRARE L’ESISTENZA DEL SOTTOMONOIDE GENERATO ........................ 9

COSTRUZIONI A PARTIRE DA UN MONOIDE ........................................................................................ 10

OMOMORFISMO DI MONOIDI................................................................................................................... 10

ENDOMORFISMO ......................................................................................................................................... 11

ISOMORFISMO ............................................................................................................................................. 11

AUTMORFISMO............................................................................................................................................ 11

INSIEME DI TUTTI GLI ENDOMORFISMI DI M ...................................................................................... 12

INVERSO ........................................................................................................................................................ 12

GRUPPI ........................................................................................................................................................... 13

SOTTOGRUPPO DI UN GRUPPO ................................................................................................................ 13

OMOMORFISMO DEL GRUPPO ................................................................................................................. 14

PRODOTTO DIRETTO DI GRUPPO ............................................................................................................ 14

INSIEME DELLE CLASSI RESTO ............................................................................................................... 14

MONOIDE DELLE CLASSI RESTO ............................................................................................................ 15

PROPRIETA’ FONDAMENTALI ................................................................................................................. 15

ANELLO ......................................................................................................................................................... 15

ANELLO CON IDENTITA’ ........................................................................................................................... 16

ANELLO COMMUTATIVO .......................................................................................................................... 16

DOMINI DI INTEGRITA’ ............................................................................................................................. 17

CAMPI ............................................................................................................................................................ 17

1

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

ANELLO DEI POLINOMI ............................................................................................................................. 17

ANELLO DELLE MATRICI.......................................................................................................................... 18

SOMMA E MOLTIPLICAZIONE DI MATRICI .......................................................................................... 18

SOMMA ...................................................................................................................................................... 19

MOLTIPLICAZIONE ................................................................................................................................. 19

ANELLO DELLE MATRICI QUADRATE DI DIMENSIONE n SULL’ANELLO R ................................. 20

SPAZI VETTORIALI ..................................................................................................................................... 21

PROPRIETA’ DEL PRODOTTO SCALARE ................................................................................................ 21

SOTTOSPAZIO VETTORIALE .................................................................................................................... 23

SOTTOSPAZIO GENERATO ........................................................................................................................ 23

COMBINAZIONE LINEARE ........................................................................................................................ 24

SPAZIO VETTORIALE DELLE MATRICI .................................................................................................. 24

INSIEME DI GENERATORI DELLO SPAZIO VETTORIALE DELLE MATRICI ................................... 25

FUNZIONE LINEARE ................................................................................................................................... 26

NUCLEO (KERNEL) ..................................................................................................................................... 27

DIPENDENZA E INDIPENDENZA LINEARE ............................................................................................ 28

BASI ................................................................................................................................................................ 30

TEOREMA DI SOSTITUZIONE DELLE BASI (36.16 Facchini) ................................................................ 31

ESTENSIONE PER LINEARITA’ ................................................................................................................. 33

MATRICE ASSOCIATA AD UNA APPLICAZIONE LINEARE ................................................................ 36

SOMMA DI SPAZI VETTORIALI ................................................................................................................ 39

FUNZIONI LINEARI IN MATRICI .............................................................................................................. 41

ISOMORFISMO ............................................................................................................................................. 41

RANGO DI UNA MATRICE ......................................................................................................................... 42

SISTEMI DI EQUAZIONI LINEARI ............................................................................................................ 44

TEOREMA DI CRAMER (41.1 Facchini) ..................................................................................................... 46

DETERMINANTE .......................................................................................................................................... 47

ESPANSIONE PER COFATTORI ................................................................................................................. 47

ESPANSIONE PER COFATTORI RISPETTO ALLA COLONNA j ........................................................... 48

MINORE COMPLEMENTARE (di ordine i, j) .............................................................................................. 49

TRASPOSIZIONE .......................................................................................................................................... 50

PROPRIETA’ DEL DETERMINANTE ......................................................................................................... 51

ELIMINAZIONE DI GAUSS ......................................................................................................................... 51

2

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

REGOLA DI CRAMER .................................................................................................................................. 53

TEOREMA DI ROUCHE’- CAPELLI ........................................................................................................... 53

ALTRE APPLICAZIONE DELL’ELIMINAZIONE DI GAUSS .................................................................. 54

AUTOVALORI E AUTOVETTORI DI MATRICI ....................................................................................... 54

APPUNTI DI ALGEBRA LINEARE

SEMIGRUPPI

Un semigruppo è un insieme S con un’operazione (S,∙). L’operazione è binaria su S poiché prende

coppie di elementi S x S e va a finire in S.

∙ : S x S S

S x S = {(x, y): x, y ∈ S}

Gode di proprietà associativa: (x∙y)∙z = x∙(y∙z) per ogni x, y ,z ∈ S

Esempi:

(N,∙) ∙ qui è una moltiplicazione.

(N,+)

MONOIDI

Un monoide è un semigruppo (M,∙) con un elemento 1M ∈ M neutro per l’operazione tale che per

ogni x ∈ M, 1M ∙x = x = x∙1M. (M,∙, 1M)

1M è l’elemento neutro sia a destra che a sinistra.

3

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Esempi:

(N,∙,1) con ∙ moltiplicazione.

(N,+,0)

(R,+,0)

INSIEMI DI FUNZIONI

Consideriamo f: AB con A, B insiemi. BA = {f | f: AB} sarà, allora, l’insieme delle funzioni

da A a B.

Esempi:

RR = {f | f: RR}

√2 ∈ R ma √2 ∉ RR

La funzione f definita da f(x) = x2, per ogni x ∈ R, appartiene all’insieme di funzioni RR .

x ↦ x2 ∈ RR (modo compatto per definire una funzione).

Anche la funzione sin(x) appartiene a RR : x ↦ sin(x) ∈ RR .

x ↦ 1/x ∉ RR, poiché non si può prendere 0 come input. La scrittura corretta, dunque,

sarebbe:

x ↦ 1/x ∈ R0R.

Consideriamo, ora, gli insiemi B={0,1} e A={a, b} e l’insieme delle funzioni

BA={f | f: AB}.

Un elemento di BA è una funzione che prende in input una lettera (a oppure b) e restituisce 1

o 0. L’insieme considerato ha 4 elementi:

1. a ↦ 1 , b ↦ 0

2. a ↦ 0 , b ↦ 1

3. a ↦ 0 , b ↦ 0

4. a ↦ 1 , b ↦ 1

RELAZIONI

Una relazione R è un sottoinsieme del prodotto cartesiano di A x B: R ⊆ A x B. Si tratta di un

insieme di coppie ordinate, quindi A x B ≠ B x A.

Esempi di relazioni con A={a, b} e B={0, 1}:

R1={(a, 0)}

R2={(a, 0), (b, 0)}

R3={(a, 0), (a, 1)}

4

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Una funzione (ovvero un elemento di BA) è una relazione f ⊆ A x B tale che:

∀ x ∈ A. ∃ y ∈ B | (x, y) ∈ f (TOTALITA’)

∀ x ∈ A e ∀ y, z ∈ B. ((x, y) ∈ f e (x, z) ∈ f) y=z

(DETERMINAZIONE)

SEMIGRUPPO DELLE FUNZIONI

Il generico semigruppo delle funzioni si indica nel seguente modo: (BA, ◦), con BA insieme delle

funzioni e con operazione di composizione ◦.

Esempio:

RR con f, g elementi di RR

f ◦ g ∈ RR è la funzione tale che ∀ x ∈ R (f ◦ g)(x) = f(g(x))

Prendiamo, ora, due funzioni f: R R (x ↦ x2) e g: R R (x ↦ 2x) ed effettuiamo le

composizioni (f ◦ g)(x) e (g ◦ f)(x).

Otteniamo:

(f ◦ g)(x) = f(g(x)) = f(2x) = 4x2

(g ◦ f)(x) = g(f(x)) = g(x2) = 2x2

Verifichiamo ora che (BA, ◦) sia un semigruppo. A tale scopo è necessario provare che per esso vale

l’associatività, ovvero che (f ◦ g) ◦ h = f ◦ (g ◦ h) per ogni f, g, h ∈ BA.

((f ◦ g) ◦ h)(x) = (f ◦ g)(h(x)) = f(g(h(x)))

(f ◦ (g ◦ h))(x) = f((g ◦ h)(x)) = f(g(h(x))) quindi (BA, ◦) è un semigruppo.

In alcuni casi il semigruppo delle funzioni è un monoide.

MONOIDE DELLE FUNZIONI SU A

Il monoide delle funzioni su A è dato da (AA, ◦, idA) con la funzione identità idA: A A come

elemento neutro.

Dimostriamo che vale l’elemento neutro id:

(f ◦ id)(x) = f(x)

(id ◦ f)(x) = id(f(x)) = f(x)

Le due espressioni sono equivalenti quindi id è l’elemento neutro per il monoide delle funzioni.

Riportiamo, di seguito, alcune considerazioni relative alla finitezza dell’insieme delle funzioni BA:

5

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Se A e B sono finiti allora anche BA è finito

Se A è infinito e B è finito allora BA è infinito

Se A è finito e B è infinito allora BA è infinito

INSIEME DELLE PARTI

Se A è un insieme, indichiamo con P(A) l’insieme i cui elementi sono tutti e soli i sottoinsiemi di

A: P(A)={x: x ⊆ A}. Gli elementi sono 2n con n numero di elementi appartenenti ad A.

Esempio:

Se consideriamo l’insieme A={0, 1}, il numero degli elementi è 22=4. L’insieme delle parti di A

così ottenuto è P(A)={ Ø, {0}, {1}, A}.

Non è corretto scrivere 0 ∈ P(A) poiché in P(A) c’è l’insieme contenente 0. La scrittura esatta è,

dunque, {0} ∈ P(A).

SOTTOSEMIGRUPPI

Dati gli insiemi T ed S,

(T, ∙) è sottosemigruppo del semigruppo (S, ∙) se T ⊆ S ed è tale che T sia chiuso rispetto

all’operazione ∙ cioè che per ogni a, b ∈ T, a ∙ b ∈ T.

Esempi:

(Z0, ∙), con ∙ moltiplicazione, è sottosemigruppo di (Z, ∙)

Dato l’insieme A, (P(A), ∪, Ø) è un semigruppo poiché l’unione gode di associatività ed è

anche un monoide con Ø come elemento neutro. Dato B ⊆ A, allora (P(B), ∪) è

sottosemigruppo di (P(A), ∪).

P(B) ⊆ P(A) poiché B ⊆ A.

Dati X e Y ∈ P(B) cioè X e Y ⊆ B, X ∪ Y ⊆ B quindi X ∪ Y ∈ P(B).

(interi pari, ∙) è sottosemigruppo di (Z, ∙), poiché moltiplicando numeri pari fra loro si

ottengono altri numeri pari, il che indica la chiusura dell’insieme rispetto all’operazione di

moltiplicazione.

6

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

SOTTOMONOIDI

Dato (T, ∙) sottosemigruppo di un monoide (M, ∙, 1M), diciamo che (T, ∙) è sottomonoide qualora

1M ∈ T.

Sia (M, ∙, 1M) monoide. Il più piccolo sottomonoide è ({1M}, ∙, 1M}).

Ora, dato (P(B), ∪, Ø) sottosemigruppo del monoide (P(A), ∪, Ø), (P(B), ∩, B) è sottomonoide di

(P(A), ∩, A)? Non sempre: lo è solo se A = B poiché l’elemento neutro deve essere lo stesso per

entrambi gli insiemi.

Dato un monoide (M, ∙, 1M), possiamo definire an (∀ n ∈ N ed a ∈ M).

a0=1 elemento neutro

an+1 = a∙an

an = a∙a∙a∙a…∙a (n volte)

Allora:

an = 1 se n=0

an = a∙an-1 se n>0

Esempio:

a, b ∈ R

(ab)n = anbn

Domanda: se (M, ∙, 1M) è un monoide, è vero che per ogni a, b ∈ M ed ogni n ∈ N vale (ab)n = anbn

?

Non sempre: solo se M è commutativo.

E’ necessario, dunque, applicare la COMMUTATIVITÀ:

(ab)2 = (ab)(ab)

a2b2 = (aa)(bb)

Se M è commutativo:

a(bc) = (ab)c

(ab)2 = (ab)(ab) = associativa a(b(ab)) = a((ba)b)

a2b2 = (aa)(bb) = associativa a(a(bb)) = associativa a((ab)b)

Quindi è verificato che a((ba)b) = a((ab)b)

con ab = ba (per proprietà commutativa)

Esempio:

prendiamo il semigruppo (S, ∙,) e i sottosemigruppi (T1, ∙) e (T2, ∙) .

Definiamo ora T1T2 = {t1t2 : t1 ∈ T1, t2 ∈ T2}.

Non è necessariamente vero che T1T2 ⊆ T1 e T1 T2 ⊆ T2, mentre è vero che (T1T2, ∙) ⊆ S

(T1T2, ∙) è sottosemigruppo di S? Non sempre.

Se (S, ∙) è commutativo, allora (T1T2, ∙) è sottosemigruppo di (S, ∙).

7

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Due elementi arbitrari di T1T2 sono (t1t2) e (t11t12)

(t1t2)(t11t12) = (t1t11)( t2t12) ∈ T1T2.

Esempio:

consideriamo, ora, il monoide delle parole su {0, 1}:

({0, 1}*, ∙, ɛ)

{0, 1}* è l’insieme di tutte le sequenze finite di simboli 0 e 1

Esempio: 010100 ∈ {0, 1}*

∙ è l’operazione di concatenazione, ovvero la giustapposizione di stringhe

Esempio: (010)∙(100) = 010100

ɛ è la stringa vuota “ ”

Si tratta di un monoide commutativo? No, poiché la concatenazione non gode di commutatività:

abbiamo, infatti, che (100)∙(010) = 100010 e (010)(100) = 010100 100010 ≠ 010100.

T1 = ({0}*, ∙, ɛ) e T2 = ({1}*, ∙, ɛ) sono sottomonoidi per ({0, 1}*, ∙, ɛ)

T1T2 = {0*1*} = {0n1n : n, m ∈ N}.

Consideriamo ancora il monoide delle parole ({0, 1}*, ∙, ɛ) e prendiamo L = {0n1m : n, m ≥ 0}.

(L, ∙, ɛ) non è sottomonoide di ({0, 1}*, ∙, ɛ) poiché non è chiuso per l’operazione di

concatenazione: abbiamo, infatti (0011)(000111) = 0011000111 che non è di forma 0n1m e, quindi,

non appartiene a L.

Sia, ora (M, ∙, 1M) monoide.

Se (T, ∙, 1M) e (S, ∙, 1M) sono sottomonoidi di M, allora (S, ∙, 1M) ∩ (T, ∙, 1M) è sottomonoide di

(M, ∙, 1M).

(S, ∙, 1M) ∪ (T, ∙, 1M) è sottomonoide di (M, ∙, 1M)?

Non sempre: infatti, se esaminiamo il monoide M = ({0, 1}*, ∙, ɛ) e T = ({0n : n≥0}, ∙, ɛ) ed S =

({1m: m≥0}, ∙, ɛ), otteniamo:

S ∩ T = ({ɛ}, ∙, ɛ)

S ∪ T = {1m: m≥0} ∪ {0n : n≥0} non è sottomonoide di M = ({0, 1}*, ∙, ɛ) poiché non è

chiuso rispetto alla concatenazione (es: 10 ∉ S ∪ T).

E’ possibile, tuttavia, ottenere un sottomonoide a partire da S ∪ T: bisogna a tal fine assicurarne la

chiusura. Introdurremo, a questo punto, la nozione di sottomonoide generato da S ∪ T, il quale è

più grande di S ∪ T poiché contiene anche la concatenazione di elementi di S e T. Esso è, inoltre, il

più piccolo sottomonoide di M contente S ∪ T [S ∪ T] = M (in questo caso abbiamo un

sottomonoide improprio).

8

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

SOTTOMONOIDE GENERATO

Sia (M, ∙, 1M) un monoide e sia X ⊆ M.

Allora [X], ovvero il sottomonoide di M generato da X, è il più piccolo sottomonoide di M

contenente X.

Esempi:

[M] = M

[Ø] = {1n} con 1n elemento neutro del monoide M

PROPRIETÀ PER DIMOSTRARE L’ESISTENZA DEL SOTTOMONOIDE GENERATO

Chiusura per intersezione dei sottomonoidi:

siano M monoide, S e T sottomonoidi, allora S ∩ T è sottomonoide di M.

Dunque, se M è un monoide e {Si}i ∈ I (con Si famiglia di sottomonoidi) sono sottomonoidi allora

∩( i ∈ I) Si è sottomonoide.

[X] è l’intersezione di tutti i sottomonoidi di M che contengono X.

Intersezione di una famiglia: [X] = ∩{S:S sottomonoide di M e S ⊇ X}

Esempi:

1. (N,+,0)

X={3,2}

Y={0,1}

[X] = {0,3,2,5…} (infinito)

[Y] = N

2. (P(N), ∩ N)

X = { Ø, N}

[X] = X (finito)

3. (P(N), ∪, N)

X = { Ø, N}

[X] = X (finito)

LEMMA (caratterizzazione di [X]):

[X]={1M} ∪ {x1∙x2…xn : n≥1, xi ∈ X per ogni i=1…n con n ∈ N }. Se X={a} allora [a]={an| n ∈ N}

9

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Dimostrazione: sia N={1M} ∪ {x1∙x2…xn : n≥1, xi ∈ X per ogni i=1…n con n ∈ N. basta dimostrare

che N è un sottomonoide di M, che N contiene X e che N è contenuto in ogni sottomonoide di M

contenente X. N è un sottomonoide di M poiché è un sottoinsieme chiuso, N ⊇ X; se, poi, P è un

sottomonoide di M contenente X, allora 1M ∈ P e x1∙x2…xn ∈ P per ogni xi ∈ X e quindi N ⊆ P,

provando, così, che [X]=N.

La seconda parte della dimostrazione segue alla prima.

COSTRUZIONI A PARTIRE DA UN MONOIDE

PRODOTTO DIRETTO

Siano (S, *, 1S) e (T, ∙, 1T) monoidi. Definisco il loro prodotto diretto S x T:

(S x T, +, 1SxT) con S x T prodotto cartesiano di insiemi.

L’operazione “+” è data come segue: (s1, t1) + (s2, t2) = (s1 * s2, t1 ∙ t2) con (s1 * s2) ∈ S e

(t1 ∙ t2) ∈ T.

L’elemento neutro è (1S, 1T) = 1SxT

E’ chiuso per l’operazione “+” poiché (s, t) + (1S, 1T) = (s * 1S, t ∙ 1T).

OMOMORFISMO DI MONOIDI

Un omomorfismo è una funzione che preserva un struttura.

Data due monoidi (M, +M, 1M) e (N, +N, 1N), un omomorfismo è una funzione f: M N tale che:

1. f(x +M y) = f(x) +N f(y) per ogni x, y ∈ M.

(x +M y) è un valore che viene trasportato in N.

2. f(1M) = 1N

Esempio:

f: (R+, ∙, 1) (R, +, 0)

loge: (R+, ∙, 1) (R, +, 0)

ln(xy) = lnx + lny

ln1 = 0

LEMMA:

Sia f: M N omomorfismo di monoidi.

1. f(M) = {f(x): x ∈ M} è un sottomonoide di N con f(M) immagine di M rispetto ad f.

10

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

2. f-1(N) = {x ∈ M | f(x) ∈ N} è un sottomonoide di M.

Dimostrazione:

1. Consideriamo (M, +M, 1M) e (N, +N, 1N).

Dimostriamo che 1N ∈ f(M). devo dimostrare che z +N y ∈ f(M).

Se z, y ∈ f(M) per definizione esistono 2 elementi z', y' ∈ M tali che z = f(z') , y = f(y')

z +N y = f(z') +N f(y') = f(z' +N y').

ENDOMORFISMO

Omomorfismo di un monoide in se stesso : M e N coincidono, stessa operazione ed elemento

neutro.

ISOMORFISMO

E’ un omomorfismo biiettivo.

Una funzione f è biiettiva se è sia suriettiva (f: A B, per ogni y ∈ B esiste x ∈ A: f(x) = y) che

iniettiva (f: A B, per ogni x, y ∈ A (f(x) = f(y) x = y) oppure per ogni x, y ∈ A (x ≠ y f(x) ≠

f(y)).

Esempio:

ln: R+ R

AUTMORFISMO

Si tratta di un isomorfismo di un monoide in se stesso: il monoide di arrivo e di partenza è lo stesso.

11

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

INSIEME DI TUTTI GLI ENDOMORFISMI DI M

Sia M un monoide. End(M) ⊆ MM (anche detto Hom(M))

LEMMA:

(End(M), ◦, idM) è un monoide (è sottomonoide di MM).

Devo mostrare che gli endomorfismi sono chiusi per composizione cioè che, dati f, g ∈ End(M)

f ◦ g ∈ End(M).

Dimostrare che f ◦ g preserva la somma:

(f ◦ g)(x +M y) = f(g(x +M y)) = f(g(x) +M g(y)) = f(g(x)) +M f(g(y)) = (f ◦ g)(x) +M (f ◦ g)(y).

A questo punto è necessario dimostrare che idM è un endomorfismo.

(f ◦ g)(1M) = f(g(1M)) = f(1M) = 1M.

idM(x +M y) = idM(x) +M idM(y) (IDENTITA’ PRESERVA LA SOMMA).

Abbiamo, così, dimostrato che (End(M), ◦, idM) è monoide degli endomorfismi di M.

INVERSO

Nel caso di un monoide (M, ∙, 1), diciamo che a ∈ M è invertibile a destra se esiste c ∈ M tale che

a∙c = 1. Diciamo che a è invertibile a sinistra se esiste b ∈ M tale che b∙a = 1 (si considerano destra

e sinistra poiché non è detto che l’operazione sia commutativa; possono esserci molti inversi destri

o sinistri).

Un elemento a ∈ M è invertibile se è invertibile sia a destra che a sinistra cioè se ha inverso destro e

sinistro.

LEMMA:

Sia (M, ∙, 1) monoide e a ∈ M invertibile.

Allora inversi destro e sinistro coincidono tutti gli inversi destri e sinistri coincidono quindi solo

un elemento può invertire a.

Dimostrazione:

Se b è inverso sinistro allora

b = b ∙ 1 = b(ac) (poiché c è l’inverso destro)

b(ac) = (ba)c (poiché è commutativo)

(ba)c = 1c = c

Quindi inversi destro e sinistro coincidono.

Se ha è inverso, dunque, ha un UNICO INVERSO.

12

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Nel caso di monoide in notazione moltiplicativa, l’inverso di a è a-1.

Nel caso, invece, di monoide in notazione additiva, l’inverso di a è –a.

GRUPPI

Consideriamo (M, +, 0): esso è un gruppo se è un monoide in cui ogni elemento di M è invertibile.

Siccome ogni elemento ha un inverso posso pensare che un gruppo sia un monoide dotato di una

funzione unaria che mappa a -a tale che a – a = 0.

a + (-a) = 0; (-a) + a = 0 0 è l’elemento neutro del monoide considerato.

Esempi:

(Q – {0}, ∙, 1) è un gruppo poiché x ∙ (1/x) = 1.

(N, +, 0) non è un gruppo poiché manca l’opposto.

(Z, +, 0) è un gruppo poiché x + (-x) = 0

(P(N), ∪, Ø) non è un gruppo poiché dovrebbe esistere un insieme Y tale che X ∪ Y (X, Y ∈

P(N)) = Ø.

5. (P(N), ∩, N) non è un gruppo poiché dovrebbe esistere un insieme Y tale che X ∩ Y (X, Y

∈ P(N)) = N.

6. (End(M), ◦, idM) è un monoide ma non un gruppo. Per essere invertibile per goni funzione f

deve esistere una funzione g tale che t ◦ g = g ◦ f = idM.

Una funzione è invertibile se è biiettiva.

1.

2.

3.

4.

Sia (G, ∙, 0) un gruppo e x ∈ G. l’operazione che mappa x -x è un’ INVOLUZIONE cioè

l’inverso dell’inverso: (x-1)-1 = x.

SOTTOGRUPPO DI UN GRUPPO

Un sottogruppo di un gruppo è un sottomonoide in cui vale lo stesso elemento inverso.

Sia G gruppo.

H è sottogruppo di G (notazione: H ⊴ G) se H è un sottomonoide di G tale che a-1 ∈ H.

Esempio:

13

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

L’insieme di tutti i multipli interi di N nZ = {nq: q ∈ Z} per ogni n ∈ N è un sottogruppo di Z

poiché:

1. Contiene lo 0.

2. E’ sottomonoide.

3. E’ chiuso per la somma.

4. E’ chiuso per l’operazione di inverso: l’inverso di nq è n(-q).

OMOMORFISMO DEL GRUPPO

Si tratta di un omomorfismo di monoidi f: G H (G, H gruppi) in cui f(x-1) = f(x)-1.

Definizione:

f: G H è omomorfismo di gruppi se:

1. f è omomorfismo delle strutture di monoide di G ed H

2. per ogni x ∈ G, f(x-1) = (f(x))-1 (operazione di inversione del gruppo). Ciò segue dal fatto

che f è omomorfismo di monoidi.

PRODOTTO DIRETTO DI GRUPPO

Definizione:

Siano G ed H gruppo.

G x H gruppo avente come insieme inverso G x H = {(g, h): g ∈ G, h ∈ H} e avente operazione

(g, h) * (g', h') = (g ∙G g', h ∙H h') ed elemento neutro (1G, 1H).

INSIEME DELLE CLASSI RESTO

Z/≡n = {[a] ≡n : a ∈ Z} è insieme della classi resto ovvero l’insieme i cui elementi sono classi di

equivalenza di mod n.

La congruenza mod n è una relazione binaria sugli interi.

a ≡n b si dice “a congruo b modulo n”.

a e b differiscono per un multiplo di n n divide (a-b).

[a] ≡n = {b ∈ Z : a ≡n b}

Esempio:

14

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Prendiamo in considerazione n = 3

Z/≡3 = {[a] ≡3 a ∈ Z}.

[a] ≡3 = {b ∈ Z: {[a] ≡3 b}.

Ad esempio la classe di equivalenza [2] ≡3 è costituita dai numeri b tali che 3 divide (2 – b).

Se b = 1 (2 – 1)/3 non soddisfa la definizione di congruenza quindi 1 ∉ [2] ≡3.

Se b = 2 (2 – 2)/3 = 0 quindi 2 ∈ [2] ≡3.

[2] ≡3 = {2, 5, 8, 11, 14, 17,…, -1, -4, -7,…}

[0] ≡3 = {0, 3, 6, -3, -6,…}

[1] ≡3 = {1, 4, 7, 10,…}

[4] ≡3 = [1] ≡3 = [-5] ≡3 (tutti i numeri che differiscono per un multiplo di 3).

Z/≡3 = {[a] ≡3 : a ∈ Z} = {[0] ≡3, [1]

corrisponde al modulo considerato.

≡3,

[2]

≡3}

possiamo notare che il numero degli elementi

MONOIDE DELLE CLASSI RESTO

(Z/≡n, +, [0] ≡n) monoide.

[a] ≡3 + [b] = [a + b]

[a] ≡3 + [0] = [a + 0] = [a]

[2] + [1] = [0]

[1] + [1] = [2]

[11] + [7] = [18] = [0] poiché 18 è un multiplo di 3.

PROPRIETA’ FONDAMENTALI

Se [a] = [a'] e [b] = [b'], allora [a] + [b] = [a'] + [b'].

Ciò assicura che l’operazione “+” sia ben definita.

La somma è un’operazione compatibile con ≡n ed è una congruenza per ≡n.

(Z/≡n, +, [0] ≡n) è un gruppo?

Lo è se e solo se n è primo.

ANELLO

(R, +, ∙, 0)

15

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Proprietà:

1. (R, +, 0) è un gruppo commutativo abeliano

2. (R, ∙) è un semigruppo

3. Vale la distributività:

a(b + c) = ab + ac a sinistra

(b + c)a = ba + ca a destra

per ogni a, b, c ∈ R.

Esempio:

(Z, +, ∙, 0) è un anello.

ANELLO CON IDENTITA’

(R, +, ∙, 0, 1) è un anello con identità se (R, ∙, 1) è monoide e 0 ≠ 1.

ANELLO COMMUTATIVO

Un anello commutativo è un anello (R, +, ∙, 0) tale che (R, ∙) è commutativo.

(Z, +, ∙, [0], [1]) è un anello commutativo con identità.

LEMMA:

sia R un anello. Allora 0 ∙ a = a ∙ 0 = 0 per ogni a ∈ R (lo 0 commuta con il “∙”).

Dimostrazione:

0a = (0 + 0)a = 0a + 0a quindi 0 = 0a – 0a = 0a + 0a – 0a = 0a (-0a opposto additivo).

Opposto e moltiplicazione:

(-a)b

Per ogni a, b ∈R

(-a)b = a(-b) = -(ab)

Dimostrazione:

(-a)b + (ab) = 0 = (ab) + (-a)b

(-a)b + (ab) = (-a + a)b = 0b = 0

(ab) + (-a)b = (a – a)b = 0b = 0

16

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

DOMINI DI INTEGRITA’

Un dominio di integrità è un anello commutativo con identità tale che non vi siano divisori dello 0.

Un divisore dello 0 è u elemento a ∈ R tale che a ≠ 0 ed esiste b ∈ R\{0} tale che ab = 0.

In un dominio di integrità, se ab = 0 allora a = 0 o b = 0.

CAMPI

Un campo è un anello commutativo con identità in cui ogni elemento non nullo è invertibile e se

ac = ab e a ≠ 0 allora b = c.

Se consideriamo (R, +, ∙, 0, 1), (R\{0}, ∙, 1) deve essere un gruppo.

LEMMA:

Ogni campo è dominio di integrità

Dimostrazione:

sia R un campo. Se R non è dominio di integrità, allora esistono a, b ∈ R tali che ab = 0, a ≠ 0, b ≠

0; ma a è invertibile in R e quindi b = 1b = a-1ab = a-10 = 0 il che è assurdo.

Esempi di campi:

Z/≡n = {[a] ≡n : a ∈ Z}

(Z/≡n, +, ∙, [0], [1]) è un campo se n è primo.

[a] + [b] = [a + b]

[a] ∙ [b] = [a ∙ b]

Z/≡5 n = 5: primo, quindi abbiamo un campo

{[0], [1], [2], [3], [4]}

Ogni elemento non nullo ha inverso moltiplicativo.

Chi è, ad esempio, l’inverso moltiplicativo di [3]? numero b ∈ Z tale che [3] ∙ [b] = [1] = [3b]

quindi b = 2.

ANELLO DEI POLINOMI

Sia R un anello. Uso gli elementi di R come coefficienti.

17

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

R[x] = {∑𝑛𝑖=1 𝑎i 𝑥i 𝑛 : ai ∈ R, n ≥ 0} insieme di base per la struttura ad anello.

x: indeterminata

Esempio:

Anello R[x]

3x2 + 3x + 1 ∈ R[x]

1 è l’elemento neutro per R[x]

Se R è un campo, anche R[x] lo è?

1

No, poiché (x2 + x) ∙ (…) = 1 non esiste: infatti 𝑥 2 +𝑥 ∉ R[x], dal momento che non ha la forma aixin.

ANELLO DELLE MATRICI

0

0

(

0

0

Righe

0 0

0 0

0 0

0 0

0

0

) colonne

0

0

Casi particolari:

1. Vettore riga (0 0 0 0)

0

0

2. Vettore colonna ( )

0

0

Le matrici sono identificate da una dimensione.

Matrici (n x m) ad elementi in R (anello).

𝑎11

.

( .

𝑎n1

.

.

.

.

.

.

.

.

𝑎1m

.

. )

𝑎nm

aij ∈ R per ogni i = 1,…, n e j = 1,…, m

I coefficienti delle matrici possono essere tutto ciò che forma un anello ( ad esempio i polinomi).

SOMMA E MOLTIPLICAZIONE DI MATRICI

18

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

SOMMA

La somma gode di proprietà commutativa.

Le matrici che vengono sommate devono avere la stessa dimensione.

Esempio:

1 7

A = (3 2)

5 0

4 0

B = (0 0 )

1 0

5 0

A + B = (3 2)

6 0

Abbreviazioni:

A = (aij)

B = (bij)

Con i = 1,…, n e j = 1,…, m

A + B = (aij + bij)

MOLTIPLICAZIONE

La moltiplicazione non gode di proprietà commutativa.

Le colonne della prima matrice devono avere lo stesso numero delle righe della seconda.

.

An x p = (.

.

.

ABn x k = (.

.

. .

. .

. .

.

.

Bp x k = (.

.

.

.)

.

.

.

.)

.

.

.)

.

A1 x p ∙ Bp x 1 = (𝑎1

.

𝑏1

. 𝑎𝑝 ) ∙ ( . ) = ∑𝑝 𝑎i 𝑏i

𝑖=1

.

𝑏𝑝

19

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Ad esempio (2 4

0

6

5 1) ∙ ( ) = 0 + 24 +5 + 0 = 29

1

0

𝑏𝑖𝑗

𝑎𝑖𝑗

AB = (

𝑐𝑖𝑗

)∙

=(

(

AB = cij = ∑

𝑝

ℎ=1

)

)

𝑎ih 𝑏hj prodotto i-esima riga di A per j-esima colonna di B.

ANELLO DELLE MATRICI QUADRATE DI DIMENSIONE n SULL’ANELLO R

(Mn(R), +, ∙, 0, 1)

0

0

0=(

0

0

0

0

0

0

0

0

0

0

0

0

) Matrice nulla

0

0

1

0

1=(

0

0

0

1

0

0

0

0

1

0

0

0

) Matrice identica

0

1

20

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

SPAZI VETTORIALI

Per gli spazi vettoriali vengono messe in relazione due strutture:

1. CAMPO (K, +K, ∙K, 0K, 1K)

2. GRUPPO ABELIANO (V, +V, 0V)

Uno spazio vettoriale, quindi, è una coppia formata da un campo e da un gruppo abeliano.

Gli elementi del gruppo abeliano sono i VETTORI.

Gli elementi del campo sono i COEFFICIENTI.

C’è un’operazione detta prodotto scalare che è una funzione binaria che prende un elemento di K e

di V e ne restituisce uno di V.

KxVV

(α, v) ↦ αv con α ∈ K, v ∈ V

PROPRIETA’ DEL PRODOTTO SCALARE

1. Associatività: (αβ)v = α(βv) per ogni α, β ∈ K, v ∈ V.

2. Distributività:

a. α(v + w) = αv + αw

b. (α + β)v = αv + βv

Per ogni α, β ∈ K, v, w ∈ V

3. Identità: 1v = v per ogni v ∈ V (1 identità di K).

I coefficienti vengono anche chiamati SCALARI.

Esempi:

1. Sia K un campo, allora l’insieme Kn = {(α1,…, αn): αi ∈ K, i = 1,…, n} (con n ≥ 1) è spazio

vettoriale su K.

Il gruppo abeliano è (Kn, +, (0,…, 0)) e il campo è K.

Prodotto scalare:

λ ∙ (α1,…, αn) = (λα1,…, λαn) con λ ∈ K, (α1,…, αn) ∈ K

1 ∙ (α1,…, αn) = (α1,…, αn)

(α1,…, αn) + (β1,…, βn) = (α1β1,…, αnβn)

2. K0 = {0}

0+0=0

21

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

a∙0=0

3. Gruppo dei polinomi a coefficienti in un campo K:

(K[x], +, 0) gruppo abeliano

Spazio vettoriale su K stesso

Prodotto scalare:

α∈K

p(x), q(x) ∈ K[x] polinomi nell’indeterminata x

(α, p(x)) ↦ q(x)

𝑛

Quindi p(x) = ∑𝑖=0 𝛽i 𝑥 𝑖

𝑛

α(p(x)) = ∑𝑖=0(𝛼𝛽i )𝑥 𝑖 = q(x)

1p(x) = p(x)

4. K è spazio vettoriale su K (esempio banale).

Ogni campo è spazio vettoriale su se stesso.

Il campo gode di associatività, distributività e identità.

LEMMA (34.6 Facchini):

Sia V uno spazio vettoriale su K.

a) α ∙ 0V = 0V per ogni α ∈ K

Come negli anelli, anche negli spazi vettoriali α0V = 0V non è un assioma e quindi va

dimostrato.

b) 0V ∙ v = 0V per ogni vettore v ∈ V.

c) (-α)v = α(-v) = -(αv) per ogni α ∈ K e ogni v ∈ V

-α opposto in K, -v opposto nella struttura del gruppo abeliano V

d) αv = 0V se e solo se α = 0K oppure v = 0V.

Dimostrazione:

a) se α ∈ K abbiamo α0V = α(0V + 0V) = α0V + α0V. Sommiamo ad ambo i membri l’opposto

dell’elemento α0V di V ed otteniamo che 0V = α0V.

b) se v ∈ V abbiamo 0Kv = (0K + 0K)v. Sommiamo ad ambo i membri l’opposto dell’elemento

0Kv di V ed otteniamo che 0V = 0Kv.

c) dobbiamo dimostrare che (-α)v è l’opposto di αv nel gruppo abeliano additivo V. bisogna

dunque mostrare che (-α)v + αv = 0V. (-α)v + αv = (-α + α)v = 0Kv = 0V. Analogamente

notiamo che α(-v) = -(αv).

d) (⟸) (supponiamo vero ciò che sta a destra e dimostriamo ciò che sta a sinistra).

22

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Supponiamo α = 0K oppure v = 0V.

1. Se α = 0K allora per (b) otteniamo αv = 0V

2. Se v = 0V allora per (a) otteniamo αv = 0V

(⟹)

Supponiamo αv = 0V

Ci sono due possibilità:

1. α = 0K allora è vero che α = 0K o v = 0V

2. α ≠ 0K allora esiste α-1 (poiché ogni k non nullo ha un inverso)

v = 1Kv sicuramente vero quindi v = 0V

infatti v = 1Kv = α-1(αv) = α-10V = 0V per proprietà (a).

SOTTOSPAZIO VETTORIALE

Sia V uno spazio vettoriale su K.

U ⊆ V è sottospazio vettoriale di V (su campo K) se U è sottogruppo di V e U è chiuso per il

prodotto scalare per ogni α ∈ K e ogni μ ∈ U, αμ ∈ U.

Esempi:

1. K[x] ≤ n insieme dei polinomi a coefficienti di K ed indeterminata x di grado al più n.

𝑛

K[x] ≤ n = {∑𝑖=0 ai 𝑥 𝑖 : ai ∈ K per ogni i = 1,…, n}

K[x] ≤ n è sottospazio vettoriale di K(x) sul campo K.

2. R[x]≤2 contiene x2, 1 + x2, 0, 2x, √2x

Non contiene x3.

3. (R2, +, 0) è uno spazio vettoriale su R costituito da coppie di reali con somma componente

per componente ovvero somma tale che (x1, y1) + (x2, y2) = (x1 + x2, y1 + y2).

Ha prodotto scalare α(x, y) = (αx, αy)

(Z2, +, 0) è sottogruppo di (R2, +, 0) ma non è sottospazio vettoriale.

SOTTOSPAZIO GENERATO

PROPOSIZIONE (34.12 Facchini):

Sia V un sottospazio vettoriale su K e sia X ⊆ V.

<X> è il più piccolo sottospazio vettoriale di V su K contenente X.

Sia V uno spazio vettoriale su K.

23

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Sia X = {v1,…, vm} ⊆ V

<X> = {∑𝑚

𝑖=1 αi 𝑣𝑖 : αi ∈ K, i = 1,…, m}

<X> è insieme delle combinazioni lineari (sommatorie di vettori). Contiene il vettore nullo.

<Ø> = {0V} per convenzione il sottospazio vettoriale generato dall’insieme vuoto è così definito

(sottospazio nullo).

Se V è uno spazio vettoriale su K e X ⊆ V tale che <X> = V diciamo che X è un insieme di

generatori di V. V è generato dai vettori dell’insieme X.

Esempio:

(R3, +, 0) sul campo R

X = {(1, 0, 0), (0, 1, 0), (0, 0, 1)} <X> genera tutto R3 <X> = R3 = {αe1 + βe2 + γe3: α, β, γ ∈

R} (combinazioni lineari).

Un qualsiasi vettore v ∈ R3 è N = (α, β, γ) con α, β, γ ∈ R quindi v = αe1 + βe2 + γe3

X' = {e1, e2, e3, (4, 7, 9)}

<X'> = R3? Sì, perché <X'> = { αe1 + βe2 + γe3 + δ(4, 7, 9): α, β, γ, δ ∈ R} ⊇ <X>

Lo spazio generato da X' è uguale a quello generato da X < X'> = <X>

<X'> = { αe1 + βe2 + γe3 + 0(4, 7, 9): α, β, γ, δ ∈ R} = <X'> = { αe1 + βe2 + γe3 + δ(4, 7, 9): α, β, γ,

δ ∈ R} U { αe1 + βe2 + γe3 + δ(4, 7, 9): α, β, γ, δ ∈ R, δ ≠ 0}.

Se V è spazio vettoriale su K e X ⊆ V tale che <X> = V, allora Y ⊆ V tale che Y ⊇ X si ha

<Y> = V.

COMBINAZIONE LINEARE

DEFINIZIONE (34.13 Facchini):

consideriamo m ≥ 1 vettori v1, v2,…, vm appartenenti ad uno spazio vettoriale V su K. Chiamiamo

combinazione lineare (a coefficienti in K) dei vettori v1, v2,…, vm ogni espressione del tipo α1v1 +

α2v2 +…+ αmvm con α1, α2,…, αm ∈ K.

SPAZIO VETTORIALE DELLE MATRICI

Prendiamo in considerazione un campo K.

(Mm x n (K), +, 0)

m x n elementi presi nel campo K.

24

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Prodotto scalare:

𝑎11

𝑎1𝑛

α(

𝛼𝑎11

𝛼𝑎1𝑛

)= (

𝑎𝑚1

𝑎𝑚𝑛

)

𝛼𝑎𝑚1

𝛼𝑎𝑚𝑛

INSIEME DI GENERATORI DELLO SPAZIO VETTORIALE DELLE MATRICI

Combinazione lineare di matrici: somma di matrici moltiplicate per scalari

Sia Eij = (i ∈ {1,…, m}, j ∈ {1,…, n})

Nella matrice in questione 1 è l’elemento in posizione (i, j)

0

0

1

(0

M2 x 2(R)

1 0

E11 = (

)

0 0

E21 = (

0

1

0

)

0

E12 = (

0

0

1

)

0

E22 = (

0

0

0

)

1

0)

X = {Eij: 1 ≤ i ≤ m, 1 ≤ j ≤ n} è tale che <X> = Mm x n (K)

M2 x 2(R) spazio generato dall’insieme <{E11, E12, E21, E22}>

M2 x 2(R) = <{E11, E12, E21, E22}>

Perché:

𝛼 𝛽

𝛼 𝛽

1 0

0 1

0

sia (

) ∈ M2 x 2(R) allora (

)= 𝛼 (

)+β(

)+ 𝛾 (

𝛾 𝛿

𝛾 𝛿

0 0

0 0

1

0

0 0

)+δ(

)

0

0 1

Esempi:

1. (K[x] ≤ n, +, 0) spazio vettoriale su K

Sia X = {0, x, x', x2,…, xn} insieme di generatori di K[x] ≤ n

𝑛

<X> = K[x] ≤ n perché un polinomio p ∈ K[x] ≤ n è per definizione p = ∑𝑖=0 𝑎i x i

25

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

2. (K[x], +, 0) spazio vettoriale su K

Esiste un insieme finito di generatori?

No, poiché se fissiamo X ⊆ K[x] finito, allora tra i polinomi che stanno in X c’è un grado

massimo.

Esempio di spazio vettoriale:

KX con X insieme qualsiasi non vuoto.

KX = {f: f funzione da X in K}

KX è un gruppo abeliano (KX, +, 0) con:

+ (di K): operazione data da (f + g)(x) = f(x) + g(x) (per ogni f, g ∈ KX e ogni x ∈X)

0(x) = 0 (con lo 0 di K): funzione costante a valore 0

X

(K , +, 0) spazio vettoriale su K con prodotto scalare.

(αf)(x) = α ∙ f(x) (per ogni α ∈ K e ogni f ∈ KX e ogni x ∈ X).

FUNZIONE LINEARE

Applicazione lineare / omomorfismo di spazi vettoriali

DEFINIZIONE (35.1 Facchini):

Siano U, V spazi vettoriali sul campo K.

Proprietà:

1. f: U V è funzione lineare se f(x + y) = f(x) + f(y) per ogni x, y ∈ U.

2. f (αx) = αf(x) per ogni x ∈ U e ogni α ∈ K.

Se f: U V è una funzione lineare biiettiva, la chiamiamo isomorfismo lineare.

f(0V) = 0V

f(-u) = -f(u) per ogni u ∈ U (il primo “-“ è l’opposto additivo di u in U, mentre il secondo di f(u) in

V).

Esempio:

(R3, +, 0), (R2, +, 0)

f(x, y, z) = (2x, 3y + z)

Verifichiamo se f è funzione lineare.

u = (x1, x2, x3)

v = (y1, y2, y3)

f(u + v) = f(x1 + y1, x2 + y2, x3 + y3) = (2x1 + 2y1, 3x2 + 3y2 + x3 + y3)

f(u) + f(v) = (2x1, 3x2 + x3) + (2y1, 3y2 + y3) = (2x1 + 2y1, 3x2 + 3y2 + x3 + y3) quindi la prima

proprietà è soddisfatta.

26

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

αf(u) = α(2x1, 3x2 + x3) = (2αx1, 3αx2 + αx3)

f(αu) = f(αx1, αx2, αx3) = (2αx1, 3αx2 + αx3) quindi anche la seconda proprietà è soddisfatta.

La funzione, dunque, è lineare.

LEMMA (35.7 Facchini):

f: U V funzione lineare tra spazi vettoriali su K.

a) Se X è sottospazio di U allora f(X) (immagine dell’insieme X) è sottospazio di V.

b) Se Y è sottospazio di V allora f-1(Y) è sottospazio di U.

Dimostrazione:

a) Sappiamo che f(X) è un sottogruppo di V e f-1(Y) un sottogruppo di U. Siano f(u), f(u') due

elementi qualsiasi di f(X) (cioè u, u' ∈ X). Allora dobbiamo calcolare f(u) + f(u') = f(u + u').

il risultato è un’immagine di un vettore di X quindi sta in f(X). Se α ∈ K allora αf(u) = f(αu)

∈ f(X).

b) Per provare che f-1(Y) è un sottospazio di U basta osservare che se α ∈ K e v ∈ f-1(Y), allora

f(v) ∈ Y, da cui f(αv) = αf(v) ∈ Y e quindi αv ∈ f-1(Y).

NUCLEO (KERNEL)

DEFINIZIONE (35.8 Facchini):

Sia f: U V una funzione lineare.

kerf = {u ∈ U: f(u) = 0V}. Si tratta dell’insieme dei vettori la cui immagine è il vettore nullo 0 nello

spazio di arrivo,

kerf ⊆ U è sottospazio di U.

Siano u, u' ∈ kerf.

f(u + u') = f(u) + f(u') = 0V + 0V = 0V quindi è un elemento di kerf.

f(αu) deve stare in V.

f(αu) = αf(u) = α0V = 0V.

Quindi kerf è sottospazio vettoriale.

Kn è spazio vettoriale su K.

(_, _, _) gli elementi di Kn sono ennuple.

fA : Kn Km. vogliamo mostrare che da una matrice A ∈ Mmxn(K) posso definire fA creata usando

la matrice A.

fA(v) = Av (con moltiplicazione fra matrici).

27

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

𝛼1

.

v ∈ Kn quindi v = ( . )

𝛼𝑛

𝑎11

.

. 𝑎1𝑛

𝛽1

𝛼1

.

.

.

.

.

( . )=

.

.

𝛼𝑛

𝑎

𝑎

𝛽

𝑚𝑛 )

( 𝑚1

( 𝑚)

fA(v + v) = fA(v) + fA(v)

fA(αv) = α fA(v) = A(λv) = λ(Av)

fA(u + v) = A(u + v) = Au + Av

Moltiplicazione matriciale.

DIPENDENZA E INDIPENDENZA LINEARE

DEFINIZIONE (36.1 Facchini):

Insieme di vettori linearmente indipendenti:

Sia V uno spazio vettoriale su K e siano v1,…,vm vettori ∈ V.

Si dicono linearmente indipendenti se e solo se per ogni combinazione lineare che coinvolge

v1,…,vm (α1v1 + α2v2 +…+ αmvm = 0V) dando il vettore nullo, abbiamo che α1 = α2 =…= αm = 0K.

Si dicono linearmente dipendenti se non sono linearmente indipendenti.

v1,…,vm si dicono linearmente dipendenti se e solo se esiste una sequenza α1 … αm di scalari non

tutti nulli tali che ∑𝑚

𝑖=1 αi 𝑣𝑖 = 0V.

Esempio:

se prendiamo in considerazione i vettori v, v, u essi saranno sicuramente linearmente dipendenti

poiché stiamo prendendo dei doppioni.

α1 = 1, α2 = -1, α3 = 0 α1v + α2v + α3u = 0V

Affinché siano linearmente indipendenti non bisogna prendere doppioni.

Anche se c’è il vettore nullo abbiamo dipendenza:

v1, v2, 0V, v3

α1 = α2 = α4 = 0, α3 = 1 α1v1 + α2v2 + α30V + α4v3 = 0V

Esempio di vettori linearmente indipendenti:

e1, e2, e3 ∈ R3

28

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

ei = (0,…, 1,…, 0) 1 è la componente i – esima.

e1 = (1, 0, 0), e2 = (0, 1, 0), e3 = (0, 0, 1)

e1, e2, e3 sono linearmente indipendenti.

Dimostrazione:

sia ∑3𝑖=1 αi 𝑒𝑖 = 0 vettore nullo.

Allora:

1. α11 + α20 + α30 = 0 α1 = 0

2. α10 + α21 + α30 = 0 α2 = 0

3. α10 + α20 + α31 = 0 α3 = 0

PROPOSIZIONE (36.4 Facchini):

i vettori v1…vm ∈ V sono linearmente dipendenti se e solo se uno è combinazione lineare degli altri

(esiste j ∈ 1,…, m ed esistono α1,…, αj-1,…, αj+1,…, αm tali che vj = ∑𝑚

𝑘=1 αk 𝑣𝑘 con k ≠ j.

Dimostrazione:

(⟹)

Supponiamo che v1…vm siano linearmente dipendenti cioè che esistano coefficienti non tutti nulli

α1…αm ed esista j tale che αj ≠ 0 tale che ∑𝑚

𝑘=1 αk 𝑣𝑘 = 0 (siamo in un gruppo abeliano quindi vale

la commutatività).

𝑚

Quindi αjvj = ∑𝑘=1(−αk )𝑣k con k ≠ j.

𝑚

(αj-1)( αjvj) = (αj-1)(∑𝑘=1(−αk )𝑣k)

𝑚

vj = ∑𝑘=1(−αk αj-1)vk

Allora vj è combinazione lineare di α1,…, αj-1,…, αj+1,…, αm

(⟸)

Supponiamo vj = ∑𝑚

𝑘=1 αk 𝑣𝑘 con k ≠ j siccome siamo in un gruppo abeliano possiamo usare

l’opposto additivo.

0 = v j = ∑𝑚

𝑘=1 αk 𝑣𝑘 con k ≠ j combinazione di vettori che danno il vettore nullo v1…vm sono

linearmente dipendenti.

PROPOSIZIONE (36.8 Facchini):

{v0,…, vm} insieme di vettori (quindi non ci sono doppioni), se:

1. <{v0,…, vm}> = V insieme che genera V

2. v0 è combinazione lineare di v1,…, vm

allora <{v1,…, vm}> = V l’insieme senza v0 genera lo stesso spazio.

Dimostrazione:

assumiamo che le ipotesi siano vere.

Dobbiamo mostrare che qualsiasi vettore in V è combinazione lineare di v1,…, vm.

Sia u ∈ V.

29

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

u = ∑𝑚

𝑘=0 αk 𝑣𝑘 poichè {v0,…, vm} generano V.

𝑚

𝑚

u = (∑𝑚

𝑘=1 αk 𝑣𝑘 ) + α0(∑𝑘=1 βk 𝑣𝑘 ) = ∑𝑘=1(αk + 𝛼0 𝛽𝑘 )vk

BASI

DEFINIZIONE (36.9 Facchini):

Sia V uno spazio vettoriale su K.

Sia B ⊆ V un insieme finito di vettori.

B è base di V se V è generato da B (V = <B>) e B è linearmente indipendente.

Sia X ⊆ V: più grande è X più cose può generare ma diminuisce la possibilità che sia linearmente

indipendente.

PROPRIETA’ DI UNA BASE:

Una base è un insieme massimale di vettori linearmente indipendenti. Per ogni B' ⊃ B, B' non è

linearmente indipendente.

LEMMA (36.14 Facchini):

Se X è un insieme che genera V allora X contiene una base di V.

PROPOSIZIONE (36.15 Facchini):

Sia B ⊆ V (finito) allora le seguenti affermazioni sono equivalenti:

a) B è base di V

b) B è un insieme linearmente indipendente massimale di vettori

c) B è un insieme minimale di generatori

Dimostrazione:

1. (a) ⟹ (b)

Supponiamo vera (a).

Sia B una base di V.

Per definizione B è linearmente indipendente. Bisogna dimostrare, ora, che è massimale

B' ⊃ B deve essere non linearmente indipendente.

Sia B' ⊃ B e sia v ∈ B' – B.

Allora, poiché <B> = V, abbiamo che v = ∑𝑚

𝑖=1 𝛼𝑖 𝑢𝑖 con B = {u1,…, um}.

Quindi B' è linearmente dipendente.

2. (b) ⟹ (a)

Supponiamo che B sia un insieme linearmente indipendente massimale.

Bisogna dimostrare che B genera tutto V.

B è linearmente indipendente per ipotesi.

Dimostriamo che B genera V <B> = V

30

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Sia v ∈ V un vettore qualsiasi dello spazio V e sia B = {u1,…, um}.

Dobbiamo considerare due casi:

a. v ∈ B.

Se v ∈ B, esiste i ∈ {1,…, m} tale che ui = v.

Scelgo α1 = 1, αj = 0 per ogni j ∈ {1,…, m}-{1}.

∑𝑚

𝑖=1 𝛼𝑖 𝑢𝑖 = v combinazione lineare dei vettori di B che ci dà v.

b. v ∉ B.

Allora B' = {v} U B è l’insieme che estende propriamente B quindi non è

linearmente indipendente a causa di v cioè v è combinazione lineare dei vettori di B

ovvero v ∈ <B> v è un vettore qualsiasi dello spazio V quindi <B> = V (lo spazio

generato da B è tutto V).

3. (a) ⟹ (c)

Supponiamo che B sia base per V (quindi per definizione B è insieme minimale di

generatori). Dobbiamo dimostrare che è minimale.

Sia B' ⊂ B. Vogliamo mostrare che <B'> ≠ V (l’insieme generato da B' non è V), quindi

<B'> ⊂ V (esiste v che non è combinazione lineare di B').

Sia v ∈ B - B'.

Siccome B genera V, v è combinazione lineare dei vettori di B.

Dobbiamo dimostrare che v ∉ <B'>.

Se per assurdo v ∈ B' (quindi v sarebbe combinazione lineare dei vettori di B') allora anche

v ∈ <B – {v}> cioè B non sarebbe linearmente indipendente e non potrebbe essere una base,

il che sarebbe in contraddizione con l’ipotesi. ASSURDO.

4. (c) ⟹ (a)

Sia B insieme minimale di generatori di V.

Dimostriamo che è una base.

Per ipotesi <B> = V.

Ci manca da dimostrare che B è linearmente indipendente.

Per il lemma 36.14, B contiene una base. B è un insieme minimale di generatori quindi non

possiamo togliere nulla allora B è proprio quella base.

TEOREMA DI SOSTITUZIONE DELLE BASI (36.16 Facchini)

Sia V uno spazio vettoriale su K.

Sia B = {v1,…, vn} una base di V.

Siano w1,…, wm vettori linearmente indipendenti in V.

Allora m ≤ n (non si possono prendere più vettori di v1,…, vn per avere una base) e l’insieme B' =

{w1,…, wm, vm+1,…, vn} è una base di V.

Esempio:

31

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

siano w1 = (0, 3, 2) e w2 = (7, 1, 0)

w1 e w2 sono linearmente indipendenti tra loro.

Possiamo applicare il teorema di sostituzione delle basi. Togliamo i vettori linearmente indipendenti

sostituendoli con altri vettori linearmente indipendenti e ottenendo, così, una nuova base. Possiamo

sostituire w1 e w2 al posto di due vettori in {e1, e2, e3} e ottenere una nuova base. Se m = n allora

abbiamo una base: se in R3 prendo 3 vettori linearmente indipendenti automaticamente ho una base.

COROLLARIO (36.17 Facchini):

Tutte le basi di uno spazio hanno la stessa cardinalità.

DIMENSIONE DI V:

dim(V) = cardinalità di una base qualsiasi di V (se c’è) altrimenti dim(V) = ∞ (se non c’è nessuna

base di V allora ha dimensione infinita).

Esempio (36.1 Facchini):

Q[x] ≤ 2 spazio vettoriale i cui elementi sono polinomi a coefficiente razionale con grado al più 2.

A = {2, 1+x, 1-x2, -2x-x2, x2} (q1, q2, q3, q4, q5).

Dimostriamo che <A> = Q[x] ≤ 2.

Sia p ∈ Q[x] ≤ 2 : bisogna mostrare che p è combinazione lineare di A cioè che esistono α1, α2, α3, α4,

α5 tali che p = ∑5𝑖=1 αi 𝑞𝑖

p = a + bx + cx2

dimostrare che a + bx + cx2 = ∑5𝑖=1 αi 𝑞𝑖 = 2α1 + α2 + α3 + (α2 - 2α4)x + (- α3 - α4 + α5)x2.

a = 2α1 + α2 + α3

b = α2 - 2α4

c = - α3 - α4 + α5

Per ogni a, b, c ∈ Q devono esistere α1, α2, α3, α4, α5 ∈ Q tali che il sistema sia soddisfatto.

α2 = -b + 2α4

α1 = ½(a - α2 - α3)

α4 = -c - α3 + α5

la cardinalità della base è 3 poiché Q[x] ≤ 2 ha base {1, x, x2}, quindi da A possiamo ottenere una

base eliminando due vettori.

Tutti i vettori corrispondenti ai coefficienti superflui possono essere eliminati.

COROLLARIO (36.19 Facchini):

sia V uno spazio vettoriale di dimensione finita.

Siano w1…wm vettori di V linearmente indipendenti.

Esiste una base di V contenente w1…wm.

Dimostrazione:

32

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

sia dim(V) = n e sia {v1…vn} una base di V. per il teorema di sostituzione si può ottenere un’altra

base B di V sostituendo m vettori vi con gli m vettori w1…wm. quindi B è una base di V che

contiene w1…wm.

PROPOSIZIONE (36.20 Facchini):

se V è spazio vettoriale di dimensione finita e U ⊆ V allora dim(U) ≤ dim(V).

Dimostrazione:

per assurdo supponiamo che esista uno spazio vettoriale V di dimensione finita n con un sottospazio

vettoriale U di dimensione infinita. Allora nessun sottoinsieme finito di U è una base di U: per la

proposizione 36.15 ogni sottoinsieme B di U costituito da vettori linearmente indipendenti non è

massimale, ovvero, per ogni sottoinsieme B di U costituito da vettori linearmente indipendenti

esiste un sottoinsieme B' di U a sua volta costituito da vettori linearmente indipendenti e contenete

B propriamente. Costruiamo la successione u1,u1…un+1 di vettori linearmente indipendenti di U.

Avendo U dimensione infinita, sarà U ≠ {0} e quindi esiste u1 ∈ U e u1 ∉ 0. In questo caso la

successione è banalmente costituita da vettori linearmente indipendenti. Supponiamo, adesso, di

avere i vettori linearmente indipendenti u1,u1…ui di U. Dal momento che U non ha insiemi di

vettori linearmente indipendenti massimali, l’insieme B = {u1,u1…ui} è propriamente contenuto in

B', insieme di vettori linearmente indipendenti di U, e, quindi, esiste ui+1 ∈ B' ⊆ U tale che

u1,u1…ui, ui+1 siano linearmente indipendenti. Dopo n passi troveremo n + 1 vettori u1,u1…un+1 di U

linearmente indipendenti. Ma l’esistenza di n + 1 vettori linearmente indipendenti contraddice il

teorema di sostituzione. Ciò dimostra che ogni sottospazio U di uno spazio vettoriale V di

dimensione finita ha dimensione finita. Inoltre dim(U) ≤ dim(V) per il teorema 36.16.

ESTENSIONE PER LINEARITA’

TEOREMA (38.1 Facchini):

siano V e W degli spazi vettoriali su un campo K.

Sia B = { v1, …, vn} una base di V e sia w1…wn una ennupla di vettori di W.

Esiste un’unica applicazione lineare f: V W: f(vi) = wi (per i = 1, …, n).

Dimostrazione:

1. Esistenza: definiamo f come segue: dobbiamo definire f(v) per v ∈ V arbitrario.

Sia v ∈ V: siccome B è base, v = ∑𝑛𝑖=1 αi 𝑣𝑖

f(v) = ∑𝑛𝑖=1 αi 𝑤𝑖 .

2. Linearità: dobbiamo dimostrare f(βv) = βf(v).

f(βv) = f(∑𝑛𝑖=1 βαi 𝑣 ) (applicando proprietà distributiva) = ∑𝑛𝑖=1 βαi 𝑤𝑖 .

33

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

βf(v) = β(∑𝑛𝑖=1 αi 𝑤𝑖 ) = ∑𝑛𝑖=1 βαi 𝑤𝑖 .

3. Somma: siano v = ∑𝑛𝑖=1 αi 𝑣𝑖 e u = ∑𝑛𝑖=1 βi 𝑣𝑖

a) f(v + u) = f(u) + f(v)

𝑛

𝑛

b) f(u + v) = f( ∑𝑖=1(βi + αi )𝑣𝑖 ) = ( ∑𝑖=1(βi + αi )𝑤𝑖 )

𝑛

𝑛

𝑛

c) f(u) + f(v) = ∑𝑖=1(βi 𝑤𝑖 ) + ∑𝑖=1(αi 𝑤𝑖 ) = ( ∑𝑖=1(βi + αi )𝑤𝑖 )

4. Dimostriamo l’uguaglianza f(vi) = wi:

f(vi) = f(∑𝑛𝑖=1 αi 𝑣𝑖 ) = ∑𝑛𝑖=1 αi 𝑤𝑖 = wk poiché la sommatoria contiene un solo elemento e

quindi è il medesimo.

5. Unicità (vale a dire f è l’unica funzione lineare U W):

sia g: V W lineare tale che g(vi) = wi (i = 1,…, n).

Sia v un vettore di V f(v) = ∑𝑛𝑖=1 αi 𝑤𝑖 , v = ∑𝑛𝑖=1 αi 𝑣𝑖

𝑛

𝑛

g(v) = ∑𝑖=1 g(αi 𝑣𝑖 ) = ∑𝑖=1 αi 𝑔(𝑣𝑖 ) = ∑𝑛𝑖=1 αi 𝑤𝑖 .

LEMMA (38.3 Facchini):

Siano V e W spazi vettoriali su K.

Sia B = { v1, …, vn} una base di V e sia f: V W lineare.

Allora f è isomorfismo se e solo se f(B) = { f(v1),…, f(vn)} è una base di W.

Dimostrazione:

(⟹)

Supponiamo che f sia isomorfismo. Dimostriamo che è una base.

𝑛

a) Siano α1,…, αn tali che ∑𝑖=1 αi 𝑓(𝑣𝑖 ) = 0W.

𝑛

Per linearità f(∑𝑖=1 αi 𝑣𝑖 ) = 0w.

Isomorfismo biiettiva iniettiva ∑𝑛𝑖=1 αi 𝑣𝑖 = 0V α1 = α2 = … = 0K

b) Base (i vettori generano tutto lo spazio):

sia w ∈ W esiste v ∈ V tale che f(v) = w (suriettività derivata dall’isomorfismo).

𝑛

Ma v = ∑𝑛𝑖=1 αi 𝑣𝑖 allora f(v) = ∑𝑖=1 αi 𝑓(𝑣𝑖 ) = w

(⟸)

Supponiamo f(B) base di W.

a) Suriettività:

𝑛

𝑛

per ogni w ∈ W esiste una combinazione lineare ∑𝑖=1 αi 𝑓(𝑣𝑖 ) = w quindi f(∑𝑖=1 αi 𝑣𝑖 ) = w

è suriettiva.

b) Iniettività:

supponiamo f(v) = f(u) (u, v ∈ V).

f(v) + (-f(u)) = f(u) + (-f(u))

f(v) + f(-u) = 0W

f(v – u) = 0W

Sappiamo che f(0V) = 0W, quindi dimostriamo che v = u (v – u = 0V).

34

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Background:

ker f = {v ∈ V: f(v) = 0W}

f è iniettiva se e solo se ker f = {0V}.

Se ker f ≠ {0V} non sarebbe iniettiva (due vettori).

Contropositiva: ker f = {0V} iniettiva.

Da ciò deriva f(v – u) = 0W v – u = 0V v = u (abbiamo usato l’implicazione che ker f = {0V}.

Dobbiamo, tuttavia, dimostrarlo.

Sia v ∈ V, f(v) = 0W v = 0V.

Dimostrazione:

𝑛

esiste una combinazione lineare ∑𝑖=1 αi 𝑓(𝑣𝑖 ) = 0W α1 = α2 = … = αn = 0K

𝑛

𝑛

∑𝑖=1 αi 𝑓(𝑣𝑖 ) = 0W = f(∑𝑖=1 αi 𝑣𝑖 )

Quindi v = 0V + 0V + 0V + … 0V.

L’iniettività è dimostrata perciò abbiamo un isomorfismo.

TEOREMA (38.4 Facchini):

sia W uno soazio vettoriale su K e sia dim(W) = n, allora W ≅ Kn.

Dimostrazione:

sia dim(W) = n

dim(Kn) = n perché Kn ha base { e1, e2,…, en} (formata da vettori canonici).

W ha base { w1, w2,…, wn}.

Allora:

e1 w1

e2 w2

en wn

Esiste un’unica funzione lineare f: Kn W tale che f(ei) = wi per ogni i = 1,..., n. La funzione f è

isomorfismo (per il lemma 38.3).

PROPOSIZIONE (38.5 Facchini):

sia f: V W una funzione lineare, V e W sono spazi vettoriali su un campo K (sappiamo che f(V)

è sottospazio di W e ker f è sottospazio di V).

Sia V di dimensione finita allora f(V) ha dimensione finita e dim(V) = dim(ker f) + dim(f(V)).

f(V) = {f(v): v ∈ V}.

Se f è iniettiva allora ker f = {0V} e quindi dim(ker f) = 0

(<Ø> = {0V} e la dimensione del sottospazio nullo è 0).

Quindi, dim(V) = dim(f(V)) e quindi V ≅ f(V), ossia V è isomorfo a f(V), poiché tutti gli spazi

sullo stesso campo, se hanno la stessa dimensione, sono isomorfi.

35

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Perciò, f è ismorfismo.

COROLLARIO (38.7 Facchini):

sia f: V V un endomorfismo lineare.

Sia V di dimensione finita.

Allora f è suriettiva se e solo se f è iniettiva (ipotesi di iniettività implica suriettività).

Dimostrazione:

(⟸)

Iniettivià implica suriettività: segue dalla formula dim(V) = dim(ker f) + dim(f(V)).

f(V) ⊆ V f(V) = V (tutti i vettori di V sono immagine di un qualche vettore di V).

Sapendo che dim(ker f) = 0, dim(f(V)) = dim(V).

f(V) ha una base {a1,…, an} e V ha una base {b1,…, bn}.

Per il teorema di sostituzione si possono sostituire i vettori delle due basi ottenendo la stessa base

f(V) = V, quindi è lo stesso spazio.

(⟹)

Supponiamo f suriettiva.

f(V) = V quindi dim(V) = dim(f(V)).

Perciò dim(ker f) = 0 ker f = {0V} f è iniettiva.

Dimostrato ciò, giungiamo alla conclusione che gli spazi vettoriali sono fortemente caratterizzati

dalle loro basi.

MATRICE ASSOCIATA AD UNA APPLICAZIONE LINEARE

Sia f: V W un’applicazione lineare, dim(W) = m e dim(V) = n.

fA: Km Kn , solo che al posto di Km e Kn abbiamo due spazi arbitrati V e W su campo K.

fA(v) = Av

dim(W) = m W ha base { w1,…, wm}.

dim(V) = n V ha base { v1,…, vn}.

f(vj) è vettore di W per ogni j = 1,…, n e quindi f(vj) è combinazione lineare di w1,…, wn.

per ogni j ∈ {1,…, n} esistono m coefficienti a1j, a2j,…, amj tali che f(vj) = ∑

𝑎11 . 𝑎1𝑗 .

𝑎21 . 𝑎2𝑗 .

Af = ( .

.

.

.

𝑎𝑚1 . 𝑎𝑚𝑗 .

Nella colonna j-esima i

della base di W.

𝑚

𝑖=1

αij 𝑤𝑖 .

𝑎1𝑛

𝑎2𝑛

. ) matrice che dipende dalla funzione e la descrive completamente.

𝑎𝑚𝑛

coefficienti (elementi di K) esprimono f(vj) come combinazione lineare

36

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Af è la matrice associata ad f rispetto alle basi considerate, ovvero { w1,…, wn} e { v1,…, vn}.

Af ∈ Mnxn (K).

Come si calcola f(v) per un qualsiasi v ∈ V?

Sappiamo che v = ∑

∑

𝑛

𝑗=1

αj 𝑓(𝑣𝑗 ) = ∑

𝑛

𝑗=1

𝑛

𝑗=1

αj 𝑣𝑗 quindi f(v) = ∑

αj (∑

𝑚

𝑖=1

𝑛

𝑗=1

𝑛

αj 𝑓(𝑣𝑗 ) (per la linearità di f).

aij 𝑤𝑗 ) = ∑

𝑗=1

∑

𝑚

𝑖=1

𝑚

αj 𝑎𝑖𝑗 𝑤𝑖 = ∑

(∑

𝑖=1

𝑛

𝑖=1

αj 𝑎𝑖𝑗 )𝑤𝑖 (per

commutatività e distributività).

𝛼1

𝛽1

.

.

Se Cv = ( . ) allora AfCv = ( )

.

𝛼𝑛

𝛽𝑚

𝛽𝑚 coefficienti dati dalla moltiplicazione AfCv con cui si esprime f(v) come combinazione lineare

di w1,…, wn.

Come calcolo f(v)? f(v) = ∑𝑚

𝑖=1 βi 𝑤𝑖

Parto da f e da due basi { v1,…, vn} e { w1,…, wm}.

Per calcolare f(v):

𝛼1

𝑛

.

1. Trovare il vettore colonna ( . ) tale che v = ∑ αj 𝑣𝑗 .

𝑗=1

𝛼𝑛

2. Trovare f(vj) per j = 1,…, n.

3. Riempire la matrice Af.

𝛼1

𝛽1

.

.

4. Calcolare il vettore colonna ( ) dato dalla moltiplicazione Af ( . ).

.

𝛼𝑛

𝛽𝑚

𝑚

5. Calcolare f(v) = ∑𝑖=1 βi 𝑤𝑖 .

Esempio (39.7 pagina 345 Facchini):

f: R3 R3

e1 = (1, 0, 0)

f(e1) = e1

f(e2) = e1 + e2

f(e3) = e1 - 2e2

Capire la legge della funzione f.

37

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Vogliamo scrivere la matrice Af rispetto alle basi canoniche.

f(1, 0, 0) = (1, 0, 0) = 1 ∙ e1 + 0 ∙ e2 + 0 ∙ e3

f(0, 1, 0) = (1, 1, 0) = 1 ∙ e1 + 1 ∙ e2 + 0 ∙ e3

f(0, 0, 1) = 1 ∙ e1 + (-2) ∙ e2 + 0 ∙ e3

1 1

Af = (0 1

0 0

1

−2)

0

Trovare f(v) per v qualsiasi.

Consideriamo, ad esempio, v = (-2, 7, 9)

𝛼1

−2

(𝛼2 ) = ( 7 )

𝛼3

9

𝛽1

1 1 1

−2

14

(𝛽2 ) = (0 1 −2) ( 7 ) = (−11)

𝛽3

0 0 0

9

0

f(x, y, z) = ∑3𝑖=1 βi 𝑤𝑖 = ∑3𝑖=1 βi 𝑒𝑖

𝛽1

𝑥

x+y+z

(𝛽2 ) = Af (𝑦) = ( 𝑦 − 2𝑧 ) = (x + y +z) ∙ e1 + (y – 2z) ∙ e2 = (x + y + z, y – 2z, 0).

𝑧

𝛽3

0

Abbiamo, così, ottenuto la legge generale di f.

LEMMA:

sia W uno spazio vettoriale su K e sia {w1,…, wm} una sua base. Allora per ogni u ∈ W esiste

𝛽1

.

un’unica m-upla ( ) tale che u = ∑𝑚

𝑖=1 βi 𝑤𝑖 .

.

𝛽𝑚

Dimostrazione:

𝛽1

.

sia u ∈ W. Sicuramente esiste una m-upla ( ) tale che ∑𝑚

𝑖=1 βi 𝑤𝑖 = u poiché {w1,…, wm} è una

.

𝛽𝑚

base.

38

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

𝛼1

.

𝑚

𝑚

Supponiamo che ( . ) sia tale che ∑𝑚

𝑖=1 αi 𝑤𝑖 = u. Allora ∑𝑖=1 αi 𝑤𝑖 = ∑𝑖=1 βi 𝑤𝑖 .

𝛼𝑚

𝑚

Siccome W è gruppo abeliano, si può fare (∑𝑚

𝑖=1 αi 𝑤𝑖 ) – (∑𝑖=1 βi 𝑤𝑖 ) = 0W.

𝑚

Si può raccogliere a fattor comune (per proprietà associativa) ∑𝑖=1(αi − βi )𝑤𝑖 = 0W.

Poiché {w1,…, wm} è una base, per indipendenza lineare di {w1,…, wm}, abbiamo che αi − βi = 0K

per ogni i = 1,…, m, cioè αi = βi per ogni i = 1,…, m.

DEFINIZIONE:

dato W spazio vettoriale su K con base {w1,…, wm} possiamo definire due funzioni:

1. χ: W Km

𝛼1

𝛼1

.

.

v ↦ ( . ) , dove ( . ) è l’unica m-upla tale che v = ∑𝑚

𝑖=1 αi 𝑤𝑖 .

𝛼𝑚

𝛼𝑚

m

2. σ: K W

𝛼1

.

( . ) ↦ ∑𝑚

𝑖=1 αi 𝑤𝑖 .

𝛼𝑚

Sono funzioni lineari, biiettiva e una è l’inversa dell’altra.

TEOREMA:

le funzioni χ e σ sono biiettive, lineari e l’una inversa dell’altra. Allora W ≅ Km (isomorfo).

SOMMA DI SPAZI VETTORIALI

Sia V uno spazio vettoriale su K.

Siano U, W ⊆ V sottospazi.

Allora U ∩ W è sottospazio di V.

U ⊕ W = {u + w: u ∈ U, w ∈ W} è sottospazio di V.

Con ⊕ si indica la somma diretta interna (interna poiché abbiamo spazi vettoriali che sono già

sottospazi vettoriali di uno spazio vettoriale più grande).

TEOREMA (37.1 Facchini):

FORMULA DI GRASSMAN

Sia V uno spazio vettoriale su K.

Siano U, W sottospazi di dimensione finita di V.

39

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Allora U ∩ W e U ⊕ W hanno dimensione finita e vale che dim(U) + dim(W) = dim(U ⊕ W) +

dim(U ∩ W).

LEMMA (37.2 Facchini):

(spiega quando V può essere visto come somma di due sottospazi)

Sia V uno spazio vettoriale su K e siano U, W sottospazi di V.

Allora le seguenti affermazioni sono equivalenti:

a) U + W = V e U ∩ W = {0V}

b) Ogni vettore v ∈ V si scrive come somma di vettori di U e W in maniera unica:

∀ v ∈ V ∃! u ∈ U, ∃! w ∈ W: v = u + w

Dimostrazione:

1. (a) ⟹ (b)

Sia v ∈ V. Siccome V = U + W, esistono u ∈ U, w ∈ W tali che u + w = v (ora bisogna

dimostrare che sono unici).

Supponiamo che esistano u' ∈ U e w' ∈ W tale che u' + w' = v. Allora u + w = u' + w' (ora

bisogna sfruttare il fatto di essere in un gruppo abeliano).

Quindi u - u' = w – w' i vettori coincidono quindi sono sia vettori di U che di W.

Siccome U ∩ W = {0V}, u - u' = 0 e w – w' = 0 cioè u = u' e w = w' (unicità).

2. (b) ⟹ (a)

Supponiamo che ∀ v ∈ V ∃! u ∈ U, ∃! w ∈ W: v = u + w ①

Ciò implica che V ⊆ U + W (V sottoinsieme di U + W).

Ma U + W ⊆ V quindi U + W = V.

Sia x ∈ U ∩ W.

Applichiamo la proprietà ① al vettore nullo.

0 = u + w per opportuni u ∈ U e w ∈ W.

Posso scegliere u = 0 e w = 0 oppure 0 = x – x per ciascun x ∈ V.

Quindi ciò vale anche per x ∈ U: 0 + 0 = 0 = x – x .

Allora, per unicità, x = 0, cioè U ∩ W = {0V}.

Esercizio (39.6 Facchini):

si dimostri che B = {(1, 0, 0), (1, 1, 0), (1, 1, -1)} è base di R3.

v1 = (1, 0, 0), v2 = (1, 1, 0), v3 = (1, 1, -1)

1. Dimostrare che i vettori di B sono linearmente indipendenti.

2. Dimostrare che i vettori di B generano tutto lo spazio.

0

Siano α, β, γ tali che αv1 + βv2 + γv3 = 0 (0 di R3 quindi (0) )

0

(α, 0, 0) + (β, β, 0) + (γ, γ, -γ) = 0

40

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

α+β+γ

α+β+γ

α=0

( β+γ )

β+γ β=0

𝛾=0

−𝛾

−𝛾

Mostriamo che <{v1, v2, v3}> = R3

Sia u ∈ R3. Devo trovare 3 coefficienti reali α, β, γ tali che u = αv1 + βv2 + γv3.

α+β+γ

𝑥

𝑦

Per ogni x, y, z ∈ R esistono α, β, γ tali che ( ) = ( β + γ )

𝑧

−𝛾

Dimostrare che esiste sempre una soluzione nelle incognite α, β, γ.

α= x−y−z+z =x−y

x= α+β+γ

x=α+β−z

α=x−β+z

β= y+z

y= β+γ γ = y−β β= y+z

𝛾 = −𝑧

𝑧 = −𝛾

𝛾 = −𝑧

𝛾 = −𝑧

FUNZIONI LINEARI IN MATRICI

ISOMORFISMO

V, W spazi vettoriali con dim(V) = n, dim(W) = m.

Le matrici Mmxn (K) (dim = mxn) sono uno spazio vettoriale su K.

HomK (V, W) è uno spazio vettoriale su K i cui elementi sono le funzioni lineare da V W.

La struttura di HomK (V, W) è:

(f+g)(v) = f(v) + g(v)

(αf)(v) = αf(v)

per ogni v ∈ V.

0

.

Base di Mmxn (K) Eij = (

.

0

. . .

. 1 .

. . .

. . .

0

.

)

.

0

Mmxn (K) oltre ad essere spazio vettoriale è anche anello (con moltiplicazione).

Una matrice A ∈ Mn (K) è invertibile se esiste una matrice B ∈ Mn (K) tale che A ∙ B = I (matrice

identica).

1 0 0 0

0 1 0 0

I=(

)

0 0 1 0

0 0 0 1

C’è una fortissima connessione fra HomK (Kn, Kn) ≅ Mn (K) come spazio vettoriale e come anello.

41

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

PROPOSIZIONE (39.8 Facchini):

Sia μ: HomK (V, W) Mmxn (K).

f ↦ Af

Siano V, W spazi vettoriali di dimensione finita : dim(W) = m, dim (V) = n.

Allora μ è isomorfismo lineare di spazi vettoriali.

Prendiamo HomK (Kn, Kn) fra tutti gli spazi di dimensione n.

v ∈ Kn.

Se A, B ∈ Mn (K) e possiamo effettuare la moltiplicazione A ∙ B, allora A e B hanno le funzioni

associate fA ed fB. A ∙ B ha come funzione associata fA ◦ fB.

fA ◦ fB = fAB.

La matrice identica viene mandata nella funzione identità.

AB = I

Da matrice invertibile a funzione invertibile: esiste la funzione inversa.

fA ◦ fB = fAB = fI = idKn

Una matrice è invertibile se e solo se la funzione ad essa associata è invertibile.

Invertibile iniettiva suriettiva biiettiva invertibile sia a destra che a sinistra.

Quindi, se una matrice è invertibile, lo è sia a sinistra che a destra.

f Af

f è la funzione f ↦ Af

COROLLARIO (39.7 Facchini):

sia A ∈ Mn (K)

allora AB = I se e solo se BA = I (se una matrice ha inverso destro allora ha anche inverso sinistro).

B si dice matrice inversa di A. dal momento che un inverso, se esiste, è uncico, possiamo indicare B

con A-1.

A ∙ A-1 = I = A-1∙ A

RANGO DI UNA MATRICE

A ∈ Mn (K)

Il rango è il numero massimo di colonne (o righe) linearmente indipendenti.

Una matrice è una giustapposizione di colonne:

A = A1| A2| … |An Ai ∈ Km

42

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Km è spazio vettoriale quindi ha la nozione di indipendenza lineare.

Il rango di una matrice può essere maggiore di n?

Il rango deve essere ≤ m poiché m è i massimo numero di vettori linearmente indipendenti in Km

(Km ha base di dim = n).

rg (A) ≤ m e rg (A) ≤ n quindi rg (A) ≤ min(m,n)

2 4 8 16

2 4 8 16

A = 2 4 8 16 con m = 5 e n = 4

2 4 8 16

(2 4 8 16)

rg (A) = 1 poiché ogni vettore è combinazione lineare dell’altro.

Matrici e funzioni sono strettamente connesse fra loro.

F: V W

dim (V) = n, dim (W) = m

Il rango di f è dim (f(V)) ovvero è la dimensione dell’immagine di f.

rg (f) = dim (f(V))

PROPOSIZIONE (39.11 Facchini):

rg (f) = rg (Af)

rg (f) = rg (Af) ≤ m

Cosa succede quando rg (f) = m?

dim (f(V)) = m = dim (f(W)) quindi f(V) = W cioè f è suriettiva poiché la funzione coincide con

la dimensione dello spazio di arrivo.

Se m ≠ n f non è isomorfismo.

PROPOSIZIONE (39.12 Facchini):

sia A ∈ Mn (K).

Allora A è invertibile se e solo se rg (A) = n.

Dimostrazione:

sia A ∈ Mn (K) invertibile.

(⟹)

A definisce una funzione lineare fA(X) = AX.

rg (fA) = rg (A) perché applichiamo la proposizione 39.11 sapendo che la matrice associata a f A

rispetto alle basi canoniche di Kn è A.

[AfA = A] matrice associata alla matrice associata alla funzione associata ad A.

B ↦ fB

43

Mariagiovanna Czarnecki

Informatica - Corso di Algebra Lineare

Università Ca’ Foscari Venezia

Anno accademico 2014-2015, I semestre

Af f

(⟸)

Siccome A è invertibile, esiste A-1 inversa.

Allora fA è suriettiva perché per ogni Y ∈ Kn (ogni vettore colonna è immagine secondo fA),

Y = IY = (A ∙ A-1)Y = A ∙ (A-1Y) = fA(A-1Y)

f è endomorfismo dello spazio Kn in se stesso ed fA è biiettiva.

Siccome fA è un endomorfismo di Kn ed è suriettiva allora è biiettiva.

Questo implica che fA sia invertibile.

rg (A) = rg (fA) ma la dim(fA(Kn)) = dim(Kn) = n,

quindi rg (A) = rg (fA) = n.

Supponiamo rg (A) = n (bisogna dimostrare ora che A è invertibile).

rg (fA) = n = dim(fA(Kn)) cioè fA(Kn) = Kn poiché fA(Kn) è sottospazio di Kn con dimensione n.